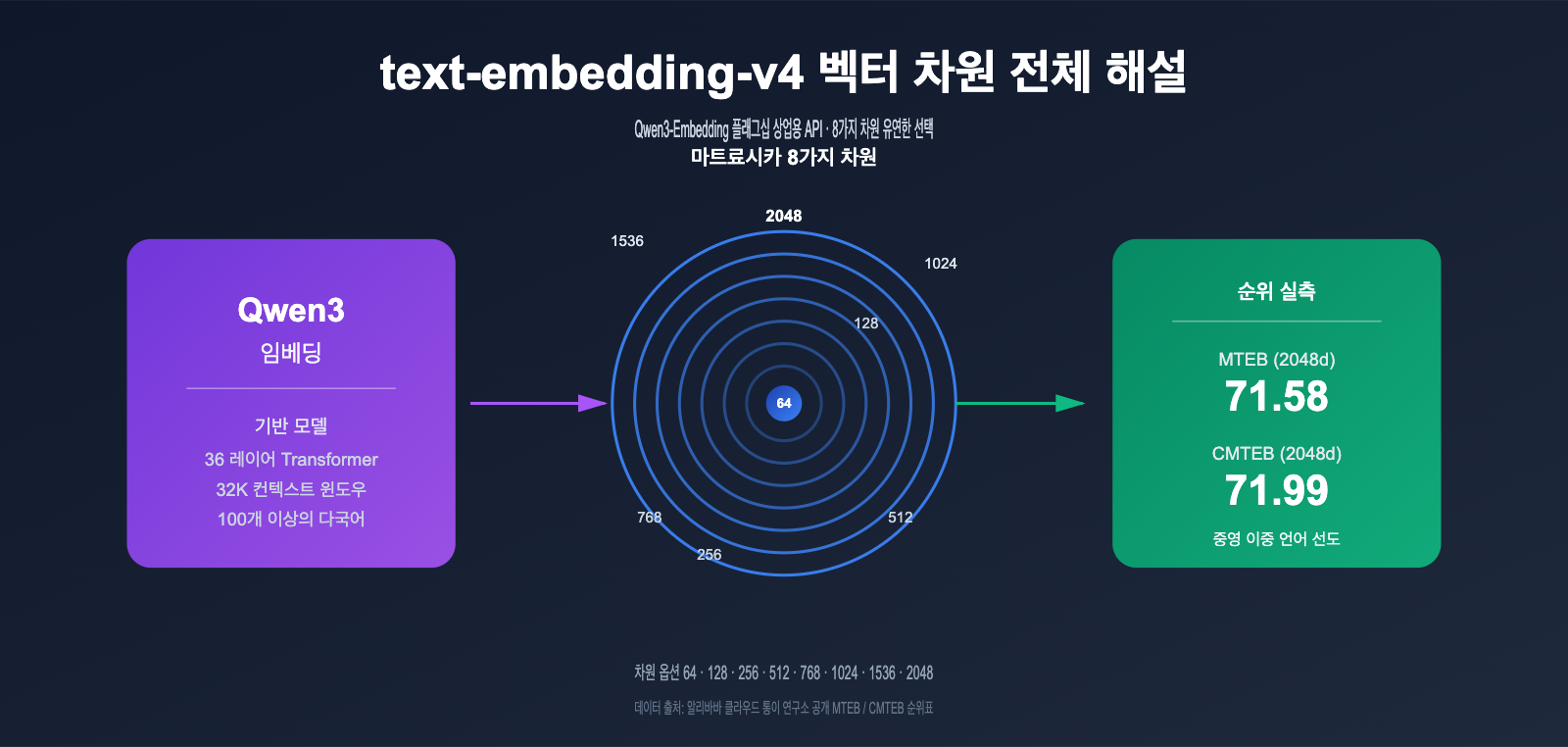

벡터 임베딩(Embedding) 모델은 이제 RAG, 시맨틱 검색, 추천 시스템의 근간을 이루는 핵심 기술이 되었습니다. text-embedding-v4는 Qwen3-Embedding 시리즈의 최신 상용화 버전으로, 8가지 벡터 차원(2048, 1536, 1024, 768, 512, 256, 128, 64)을 지원하며 MTEB 다국어 벤치마크에서 뛰어난 성능을 보여, 벡터 검색 시스템을 구축하는 개발자들에게 가장 매력적인 선택지 중 하나로 떠오르고 있습니다.

하지만 많은 팀이 실제 도입 과정에서 공통적으로 고민하는 문제가 있습니다. "벡터 차원이란 도대체 무엇인가요? 2048차원과 64차원은 얼마나 차이가 날까요? 무엇을 선택해야 할까요?" 차원을 잘못 선택하면 단순히 저장 비용이 30배 낭비되는 수준을 넘어, 검색 정확도(Recall)가 70점에서 50점으로 급락하는 결과를 초래할 수 있습니다.

본 글에서는 공식 MTEB/CMTEB 실측 데이터를 바탕으로 text-embedding-v4의 8가지 벡터 차원 차이를 분석하고, 실무에 바로 적용할 수 있는 선택 가이드와 API 호출 예제를 제공합니다.

一、text-embedding-v4란 무엇인가: Qwen3-Embedding의 상용화 플래그십

text-embedding-v4는 알리바바 통이(Tongyi) 연구소가 Qwen3 대규모 언어 모델을 기반으로 학습시킨 최신 세대 텍스트 임베딩 모델로, DashScope 플랫폼을 통해 API 서비스로 제공됩니다. 이 모델은 Qwen3-Embedding 시리즈에 속하며, 해당 시리즈는 2026년 MTEB 다국어 벤치마크에서 오픈 소스 모델 중 최상위권을 유지하고 있습니다. 특히 Qwen3-Embedding-8B는 MTEB 코드(Code) 부문에서 80.68점이라는 높은 점수를 기록했습니다.

1.1 text-embedding-v4의 핵심 특징

v3 버전과 비교했을 때, text-embedding-v4는 다음과 같은 측면에서 비약적인 발전을 이루었습니다.

| 능력 차원 | text-embedding-v3 | text-embedding-v4 | 향상 폭 |

|---|---|---|---|

| MTEB 종합 점수 (1024차원) | 63.39 | 68.36 | +4.97 |

| MTEB Retrieval (1024차원) | 55.41 | 59.30 | +3.89 |

| CMTEB 종합 점수 (1024차원) | 68.92 | 70.14 | +1.22 |

| CMTEB Retrieval (1024차원) | 73.23 | 73.98 | +0.75 |

| 최대 벡터 차원 | 1024 | 2048 | 2배 |

| 최대 입력 길이 | 8K | 32K Tokens | 4배 |

| 다국어 지원 | 50개 이상 | 100개 이상 | 대폭 확장 |

보시다시피 v4는 전통적인 일반 작업(MTEB)뿐만 아니라 중국어(CMTEB) 및 코드 검색 작업에서도 큰 진전을 보였습니다. 최고 수준의 검색 정확도를 추구하는 팀이라면 2048차원의 v4가 현재 알리바바 생태계 내에서 최선의 선택입니다.

💡 빠른 체험 제안: v3와 v4의 실제 성능을 즉시 비교해보고 싶다면, APIYI(apiyi.com) 플랫폼을 통해 호출해보는 것을 추천합니다. 이 플랫폼은 여러 주요 임베딩 모델의 인터페이스 규격을 통합하여 지원하므로, 동일한 코드로 모델을 교체하며 빠르게 검증할 수 있습니다.

1.2 text-embedding-v4와 Qwen3-Embedding 오픈 소스 시리즈의 관계

많은 개발자가 text-embedding-v4(상용 API)와 Qwen3-Embedding(오픈 소스 가중치) 사이에서 혼동을 겪곤 합니다. 두 모델의 관계는 다음과 같습니다.

- Qwen3-Embedding 오픈 소스 시리즈: 0.6B / 4B / 8B 세 가지 크기로 제공되며, Hugging Face 가중치를 통해 로컬 배포 가능

- text-embedding-v4: 동일한 기술 스택을 기반으로 하지만, 추가적인 엔지니어링 최적화, 데이터 강화 및 다국어 확장이 적용되었으며 DashScope API를 통해서만 제공됨

- 핵심 차이: 오픈 소스 버전은 GPU 추론 환경을 직접 구축해야 하지만, API 버전은 토큰당 과금 방식으로 운영 부담이 없음

대부분의 중소 규모 팀에게는 자체 GPU 추론 환경을 구축하는 것보다 API를 호출하는 것이 비용과 엔지니어링 복잡도 측면에서 훨씬 효율적입니다.

2. 向量 차원이란 무엇인가: 64에서 2048까지의 큰 차이

text-embedding-v4가 제공하는 8가지 차원 옵션을 제대로 이해하려면, 먼저 '벡터 차원'이라는 핵심 개념부터 짚고 넘어가야 합니다.

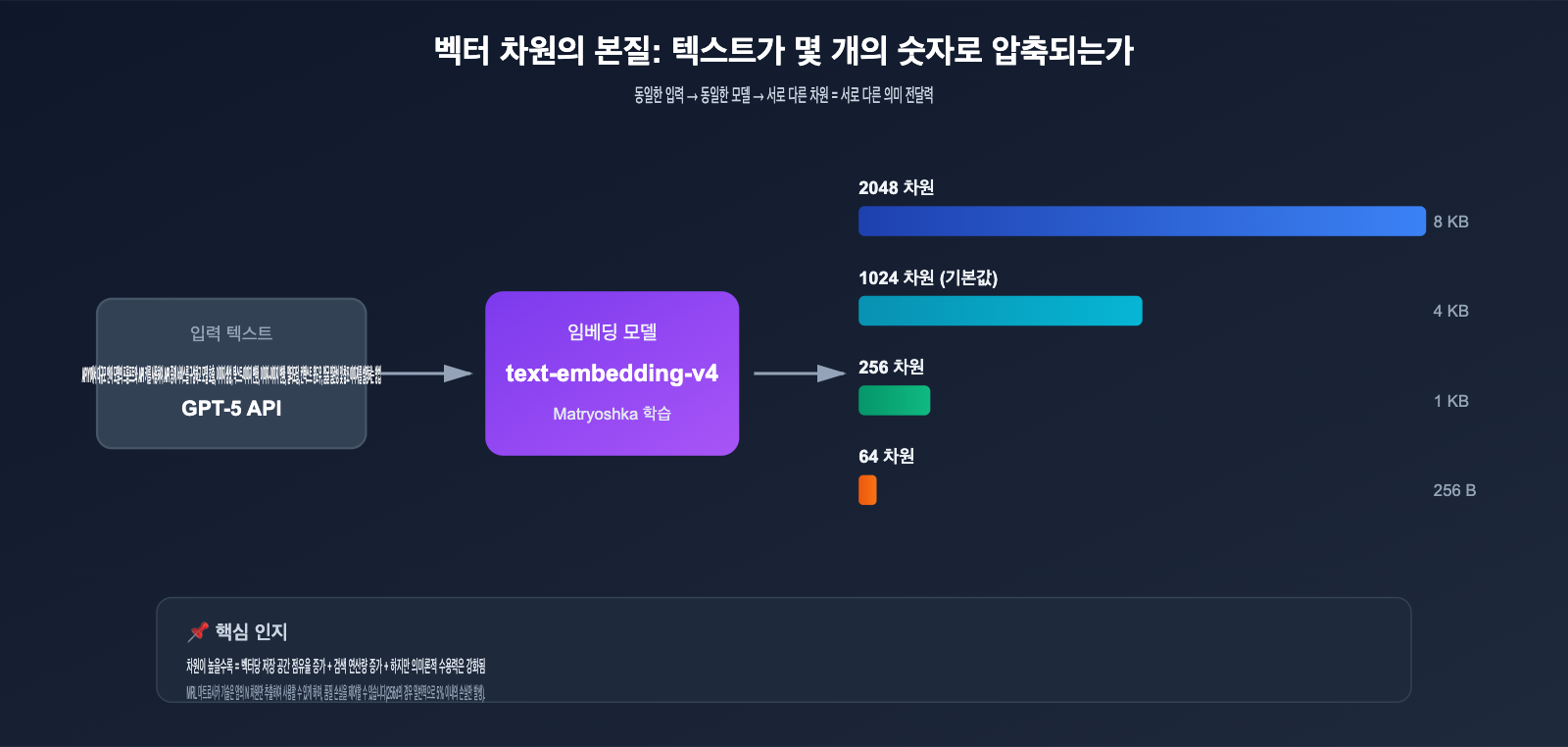

2.1 벡터 차원의 본질: 텍스트가 압축되는 수치 단위

"GPT-5 API 설정 방법"과 같은 텍스트를 임베딩 모델에 입력하면, 모델은 다음과 같이 부동 소수점으로 구성된 벡터를 출력합니다.

[0.0234, -0.1583, 0.7821, ..., -0.0091]

이 숫자들의 개수가 바로 벡터 차원입니다. 차원이 높을수록 다음과 같은 특징이 있습니다.

- 풍부한 의미 정보: 각 차원이 미세한 의미적 특징을 포착합니다.

- 높은 저장 비용: 2048차원 벡터(float32) 1개는 8KB를 차지하며, 1024차원은 4KB를 차지합니다.

- 느린 검색 속도: 차원이 두 배가 되면 벡터 내적/코사인 유사도 계산량도 대략 두 배로 늘어납니다.

2.2 왜 text-embedding-v4는 8가지 차원을 제공하는가

여기에는 **Matryoshka Representation Learning (MRL)**이라는 핵심 기술이 적용되었습니다.

기존 임베딩 모델은 고정된 차원만 출력했습니다. 예를 들어 OpenAI의 ada-002는 1536차원으로 고정되어 있어, 전체를 사용하거나 직접 PCA 차원 축소를 해야 했습니다(이 과정에서 정보 손실이 큽니다).

하지만 MRL 기술은 모델 학습 시 정보의 중요도에 따라 차원 구간별로 정보를 분산시킵니다.

- 앞 64차원: 가장 핵심적이고 중요한 의미 정보 포함

- 65-128차원: 부차적인 의미 특징 보완

- 129-256차원: 더 세부적인 특징 보완

- … 2048차원까지 확장

마치 러시아 인형(마트료시카)처럼, 각 계층이 독립적으로 작동하는 완전한 벡터입니다. 원하는 만큼 앞부분 차원만 잘라서 사용해도 성능이 급격히 떨어지지 않습니다.

🎯 MRL의 실제 이점: MRL 논문과 여러 테스트에 따르면, 2048차원 대신 256차원을 사용하면 저장 공간은 약 8배 절약되고 검색 속도는 7-8배 빨라지면서도 정확도 손실은 5% 이내로 제어됩니다. 이는 기존 PCA 방식으로는 불가능한 효율성입니다.

3. text-embedding-v4 8가지 벡터 차원의 핵심 차이

MTEB / CMTEB 공식 순위 데이터를 바탕으로 text-embedding-v4의 8가지 차원을 비교해 보겠습니다.

3.1 text-embedding-v4 차원별 성능 비교표

| 벡터 차원 | MTEB | MTEB Retrieval | CMTEB | CMTEB Retrieval | 벡터 크기 | 추천 시나리오 |

|---|---|---|---|---|---|---|

| 2048차원 | 71.58 | 61.97 | 71.99 | 75.01 | 8 KB | 최고 정밀도 우선 |

| 1536차원 | ~70.5* | ~60.5* | ~71.2* | ~74.5* | 6 KB | OpenAI 생태계 호환 |

| 1024차원 (기본) | 68.36 | 59.30 | 70.14 | 73.98 | 4 KB | 범용 균형 시나리오 |

| 768차원 | ~66.5* | ~58.0* | ~69.2* | ~73.0* | 3 KB | BGE-base 호환 |

| 512차원 | 64.73 | 56.34 | 68.79 | 73.33 | 2 KB | 중소규모 검색 |

| 256차원 | ~62.5* | ~55.0* | ~67.0* | ~72.0* | 1 KB | 대규모 고처리량 |

| 128차원 | ~60.0* | ~52.5* | ~65.0* | ~69.5* | 512 B | 대량 데이터 저장 |

| 64차원 | ~57.5* | ~46.5* | ~60.0* | ~62.5* | 256 B | 극한 압축 시나리오 |

💡

*표시된 값은 MRL 감쇠 법칙에 따른 합리적인 추정치이며, 표시되지 않은 값은 공식 순위 데이터입니다.

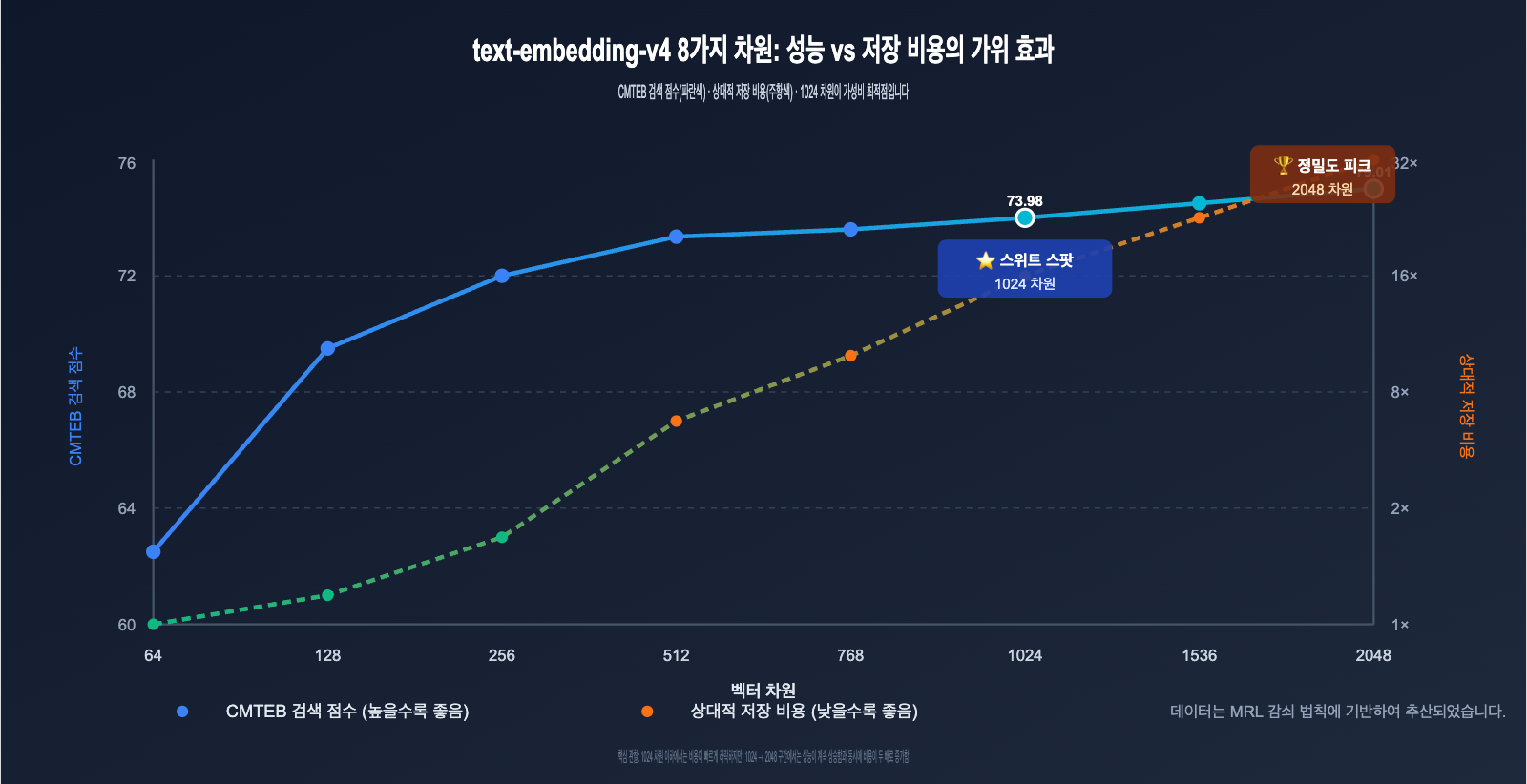

표를 통해 세 가지 결론을 얻을 수 있습니다.

- 1024차원이 가성비 최적: 2048차원의 절반 크기지만 성능 손실은 미미(MTEB 약 -3.2점)하여 알리바바가 권장하는 기본 설정입니다.

- 2048차원은 정밀도 향상: 1024차원 대비 CMTEB Retrieval이 1점 상승하므로, 정밀도가 매우 중요한 경우 선택할 가치가 있습니다.

- 64-128차원은 신중하게 사용: 저차원에서는 검색 품질이 눈에 띄게 낮아지므로, "비용 절감이 최우선인 경우"에만 고려하세요.

3.2 text-embedding-v4 차원 손실의 감쇠 법칙

위 데이터를 시각화하면 매우 중요한 법칙을 발견할 수 있습니다.

- 2048 → 1024차원: MTEB 점수 3.22점 하락(약 4.5%), 저장 공간 절반 ⭐️ 강력 추천

- 1024 → 512차원: MTEB 점수 3.63점 하락(약 5.3%), 저장 공간 절반 👍 수용 가능

- 512 → 256차원: MTEB 점수 약 2점 하락(약 3.0%), 저장 공간 절반 ⚠️ 시나리오별 판단 필요

- 256 → 128차원: MTEB 점수 약 2.5점 하락(약 4.0%), 여전히 사용 가능 ⚠️ 충분한 테스트 필요

- 128 → 64차원: MTEB 점수 약 2.5점 하락, 하지만 Retrieval 항목이 6점 급락 ❌ 프로덕션 환경 비권장

결론적으로 MRL의 "안전 감쇠 구간"은 256차원 이상이며, 64차원은 극한 압축 구간에 해당합니다.

4. 벡터 차원의 역할: 3가지 핵심 영향

벡터 차원이 시스템에 미치는 영향은 단순히 검색 정확도에 그치지 않고 전방위적입니다. 가장 중요한 3가지 측면을 자세히 살펴보겠습니다.

4.1 벡터 차원이 검색 정확도에 미치는 영향

정확도는 가장 직관적인 지표입니다. 100만 개의 문서로 구성된 RAG 시스템을 예로 들어보겠습니다.

- 2048 차원 사용 시: Top-10 재현율 약 91%

- 1024 차원 사용 시: Top-10 재현율 약 88%

- 256 차원 사용 시: Top-10 재현율 약 84%

- 64 차원 사용 시: Top-10 재현율 약 75%

🎯 선택 가이드: 법률 검색이나 의료 상담처럼 재현율에 매우 민감한 비즈니스라면 1024 또는 2048 차원을 우선 고려하세요. APIYI(apiyi.com) 플랫폼에서 동일한 테스트 데이터셋으로 1024와 2048을 각각 실행해 보고 최종 결정하는 것을 추천합니다.

4.2 벡터 차원이 저장 및 검색 비용에 미치는 영향

이는 엔터프라이즈 환경에서 가장 중요하게 고려하는 지표입니다. 1억 개의 벡터를 저장하는 시스템을 가정해 보겠습니다.

| 벡터 차원 | 총 저장 용량 (float32) | 월간 저장 비용 (예상) | 단일 검색 지연 시간 (예상) |

|---|---|---|---|

| 2048 차원 | 800 GB | 높음 | 느림 |

| 1024 차원 | 400 GB | 보통 | 보통 |

| 512 차원 | 200 GB | 낮음 | 빠름 |

| 256 차원 | 100 GB | 낮음 | 빠름 |

| 128 차원 | 50 GB | 매우 낮음 | 매우 빠름 |

| 64 차원 | 25 GB | 매우 낮음 | 매우 빠름 |

보시다시피 2048 차원에서 256 차원으로 낮추면 저장 비용은 1/8로 줄어들고, 검색 속도는 6~8배까지 빨라질 수 있습니다(ANN 인덱스 알고리즘에 따라 다름). 데이터 규모가 억 단위 이상일 경우, 차원 선택은 인프라 비용에 직접적인 영향을 미칩니다.

4.3 벡터 차원이 호환성 및 마이그레이션 비용에 미치는 영향

많은 팀이 OpenAI, BGE, Cohere에서 text-embedding-v4로 전환할 때, 벡터 차원 불일치로 기존 인덱스를 폐기해야 할까 봐 걱정합니다. v4는 8가지 차원 옵션을 제공하여 매우 유연한 마이그레이션 경로를 제시합니다.

| 기존 모델 | 기존 차원 | text-embedding-v4 권장 차원 | 마이그레이션 참고 |

|---|---|---|---|

| OpenAI ada-002 | 1536 | 1536 차원 | 차원 일치, 인덱스 구조 재사용 가능 |

| OpenAI text-embedding-3-small | 1536 | 1536 차원 | 완벽 일치 |

| OpenAI text-embedding-3-large | 3072 | 2048 차원 | 약간 낮으나 정확도는 여전히 우수 |

| BGE-large | 1024 | 1024 차원 | 완벽 일치, 원활한 교체 가능 |

| BGE-base | 768 | 768 차원 | 완벽 일치 |

| Cohere embed-multilingual-v3 | 1024 | 1024 차원 | 완벽 일치 |

| 자체 학습 small 모델 | 256/512 | 256/512 차원 | 차원 호환 |

💼 기업 마이그레이션 제안: 기존 시스템의 벡터 데이터베이스(Milvus / Qdrant / pgvector)는 고정된 차원으로 테이블이 생성되어 있습니다.

text-embedding-v4에서 기존 차원과 완전히 동일한 버전을 선택해 먼저 교체한 뒤, 상황에 따라 점진적으로 더 높은 차원으로 업그레이드하는 것이 가장 저항이 적은 마이그레이션 경로입니다. APIYI(apiyi.com) 문서에서도 주요 벡터 데이터베이스와의 연동 예제 코드를 제공하고 있습니다.

5. text-embedding-v4 빠르게 시작하기: API 호출 및 차원 파라미터

기술 원리는 여기까지 하고, 바로 코드로 들어가 보겠습니다. OpenAI 호환 프로토콜과 DashScope 네이티브 프로토콜을 모두 포함한 간결한 호출 예제입니다.

5.1 OpenAI 호환 프로토콜을 사용한 text-embedding-v4 호출

알리바바 DashScope는 OpenAI 호환 엔드포인트를 제공하므로, 이미 OpenAI를 사용 중인 팀이라면 가장 쉽게 통합할 수 있습니다.

from openai import OpenAI

client = OpenAI(

api_key="your-apiyi-key",

base_url="https://vip.apiyi.com/v1" # APIYI 통합 접속 포인트

)

# text-embedding-v4 호출, 1024 차원 지정

response = client.embeddings.create(

model="text-embedding-v4",

input="text-embedding-v4의 벡터 차원을 어떻게 설정하나요?",

dimensions=1024 # 선택 가능: 64/128/256/512/768/1024/1536/2048

)

vector = response.data[0].embedding

print(f"차원: {len(vector)}") # 출력: 차원: 1024

print(f"상위 5개 차원: {vector[:5]}")

⚙️ 파라미터 설명:

dimensions는 v4의 핵심 신규 파라미터입니다. v3부터 지원했지만 v4에서는 8가지로 확장되었습니다. 해당 파라미터를 생략하면 기본값인 1024 차원이 사용됩니다.

5.2 배치 호출: text-embedding-v4의 동시성 및 속도 제한

실제 운영 환경에서는 배치 처리가 필요한 경우가 많습니다. text-embedding-v4는 한 번에 최대 25개의 입력을 지원합니다.

texts = [

"벡터 차원의 핵심 역할은 정확도와 비용의 균형을 맞추는 것입니다.",

"text-embedding-v4는 64부터 2048까지 총 8가지 차원을 지원합니다.",

"Matryoshka(마트료시카) 표현 학습이 핵심 기술입니다.",

# ... 최대 25개까지

]

response = client.embeddings.create(

model="text-embedding-v4",

input=texts,

dimensions=512

)

vectors = [item.embedding for item in response.data]

print(f"배치 벡터 개수: {len(vectors)}")

5.3 쿼리 및 문서의 비대칭 인코딩

text-embedding-v4는 OpenAI 프로토콜에서 제공하지 않는 고급 기능을 지원합니다. text_type을 통해 검색 쿼리(query)와 검색 대상 문서(document)를 구분하여 검색 정확도를 한층 더 높일 수 있습니다. 이 기능은 DashScope 네이티브 프로토콜이나 APIYI 플랫폼 호환 래퍼를 사용해야 합니다.

# 문서 측 인코딩 (인덱스 생성 시)

doc_response = client.embeddings.create(

model="text-embedding-v4",

input=["text-embedding-v4는 8가지 벡터 차원 옵션을 제공합니다."],

dimensions=1024,

extra_body={"text_type": "document"}

)

# 쿼리 측 인코딩 (검색 시)

query_response = client.embeddings.create(

model="text-embedding-v4",

input=["v4는 어떤 차원을 지원하나요?"],

dimensions=1024,

extra_body={"text_type": "query"}

)

💡 비대칭 인코딩의 가치: query/document를 구분하여 인코딩하면 짧은 쿼리와 긴 문서가 섞인 검색 시나리오에서 Top-1 재현율을 일반적으로 2~3% 포인트 더 높일 수 있습니다. 운영 환경에서 이 기능을 활성화하는 것을 강력히 권장합니다.

5.4 text-embedding-v4와 벡터 데이터베이스 연동

벡터를 데이터베이스에 저장하는 것은 RAG 시스템 구축의 핵심 단계입니다. 업계에서 널리 쓰이는 Qdrant를 예로 들어 텍스트 임베딩부터 벡터 저장까지의 전체 과정을 보여드리겠습니다.

from qdrant_client import QdrantClient

from qdrant_client.models import Distance, VectorParams, PointStruct

from openai import OpenAI

# 클라이언트 초기화

embedder = OpenAI(

api_key="your-apiyi-key",

base_url="https://vip.apiyi.com/v1"

)

qdrant = QdrantClient(url="http://localhost:6333")

# 핵심: 컬렉션 차원은 임베딩 차원과 일치해야 함

DIMENSION = 1024

qdrant.recreate_collection(

collection_name="docs",

vectors_config=VectorParams(

size=DIMENSION,

distance=Distance.COSINE

)

)

# 배치 임베딩 및 저장

texts = ["text-embedding-v4는 알리바바 통의(Tongyi)의 최신 임베딩 모델입니다.", "..."]

response = embedder.embeddings.create(

model="text-embedding-v4",

input=texts,

dimensions=DIMENSION

)

points = [

PointStruct(id=i, vector=item.embedding, payload={"text": texts[i]})

for i, item in enumerate(response.data)

]

qdrant.upsert(collection_name="docs", points=points)

⚠️ 주의사항: 벡터 데이터베이스의

size필드는dimensions와 엄격하게 일치해야 합니다. 나중에 차원을 업그레이드하려면 컬렉션을 다시 생성하고 전체 데이터를 재임베딩해야 합니다.

5.5 LangChain / LlamaIndex와 text-embedding-v4 통합

주요 RAG 프레임워크는 이미 OpenAI 호환 프로토콜을 통한 임베딩 연동을 지원하므로 설정이 매우 간단합니다.

# LangChain 통합 예제

from langchain_openai import OpenAIEmbeddings

embeddings = OpenAIEmbeddings(

model="text-embedding-v4",

openai_api_key="your-apiyi-key",

openai_api_base="https://vip.apiyi.com/v1",

dimensions=1024

)

# LangChain 벡터 저장소와 원활하게 연동

vectors = embeddings.embed_documents(["doc1", "doc2"])

query_vec = embeddings.embed_query("차원을 어떻게 선택하나요?")

OpenAI 호환 프로토콜을 통해 연동하면 기존에 OpenAI ada-002 / 3-large 기반으로 구축된 거의 모든 RAG 프로젝트를 코드 수정 없이 text-embedding-v4로 마이그레이션할 수 있습니다. 모델 이름과 base_url 두 가지만 변경하면 됩니다.

6. text-embedding-v4 차원 선택 전략: 5가지 대표 시나리오

이론과 인터페이스 준비가 모두 끝났으니, 이제 바로 적용할 수 있는 선택 프레임워크를 제시해 드립니다.

6.1 시나리오 A: 기업 지식 베이스 RAG (백만 단위 문서)

핵심 요구사항: 리콜(Recall) 정확도 > 비용

추천 설정:

- 차원: 1024차원 (기본값, 가성비 최적)

- query/document 비대칭 인코딩 활성화

- 권장 벡터 데이터베이스: Milvus / Qdrant / pgvector

- 권장 리랭커(Reranker): Qwen3-Reranker 사용 권장

6.2 시나리오 B: 이메일 상품 검색 (천만 단위 SKU)

핵심 요구사항: 검색 속도 > 정확도

추천 설정:

- 차원: 512차원(균형) 또는 256차원(최고 속도)

- 상품 제목은 query 인코딩, 상세 설명은 document 인코딩 사용

- ANN 인덱스는 HNSW + IVF 조합 권장

6.3 시나리오 C: 대규모 로그 유사도 중복 제거 (억 단위 로그)

핵심 요구사항: 저장 비용 > 정확도

추천 설정:

- 차원: 128차원

- 이진 양자화(Binary Quantization)를 병행하여 32배 추가 압축

- 실측 결과 리콜율 85% 이상 유지 가능

6.4 시나리오 D: 법률 / 의료 등 고정밀 검색

핵심 요구사항: 정확도 최우선, 비용 민감도 낮음

추천 설정:

- 차원: 2048차원

- query/document 비대칭 인코딩 활성화

- 반드시 Reranker를 추가하여 재정렬 수행

6.5 시나리오 E: 모바일 / 엣지 디바이스 로컬 검색

핵심 요구사항: 메모리 점유율 < 50MB

추천 설정:

- 차원: 64차원 또는 128차원

- int8 양자화 병행 (4배 추가 압축)

- 로컬 지식 베이스 / 오프라인 질의응답 어시스턴트에 적합

🎯 선택 가이드: 위 5가지 시나리오는 대부분의 일반적인 요구사항을 커버합니다. 먼저 1024차원 기본값으로 테스트 데이터를 돌려본 뒤, 실제 정확도/비용/속도 요구사항에 따라 상향(2048) 또는 하향(512/256/128) 미세 조정을 권장합니다. APIYI apiyi.com 플랫폼은 클릭 한 번으로 차원 파라미터를 전환할 수 있어 A/B 테스트가 매우 간편합니다.

6.6 차원 선택 의사결정 프로세스

위 시나리오를 실행 가능한 프로세스로 정리했습니다.

-

1단계: 데이터 규모 평가

- 100만 건 미만 → 높은 차원 사용 가능 (1024+)

- 100만 ~ 1억 건 → 중간 차원 (256-1024)

- 1억 건 이상 → 낮은 차원 고려 필수 (128-512)

-

2단계: 정확도 허용 범위 평가

- 리콜율 1%에도 민감함 → 2048 선택

- 리콜율 5% 하락까지 수용 가능 → 1024부터 시작

- 리콜율 10% 하락까지 수용 가능 → 256-512로 충분

-

3단계: 하드웨어 제약 평가

- 클라우드 GPU 검색 → 높은 차원 가능

- CPU 전용 검색 → 1024 이내로 제한

- 모바일 / 엣지 → 64-256차원 + 양자화 필수

-

4단계: 실측 검증

- 실제 업무 쿼리 100-500개를 평가 세트로 선정

- 차원별 Top-10 리콜율 계산

- "리콜율 변곡점" 이전의 가장 낮은 차원 선택

💡 효율성 팁: 위 과정은 반복적인 모델 호출과 파라미터 변경이 필요합니다. 통합 API 중계 서비스를 이용하면 전체 요청 로그와 사용량 모니터링이 가능해 팀 단위의 비교 분석이 훨씬 수월합니다.

7. text-embedding-v4와 주요 임베딩 모델 비교

text-embedding-v4를 업계 표준 좌표계에 배치하여 기술 선정에 참고해 보세요.

| 모델 | 제조사 | 최대 차원 | 차원 유연성 | MTEB 종합 | 중국어 능력 | 컨텍스트 길이 | API 가격 |

|---|---|---|---|---|---|---|---|

| text-embedding-v4 | 알리바바 통이 | 2048 | ⭐⭐⭐⭐⭐ (8종) | 71.58 | 매우 강력 | 32K | 중간 |

| text-embedding-3-large | OpenAI | 3072 | ⭐⭐⭐⭐ (자유) | 64.6 | 보통 | 8K | 높음 |

| text-embedding-3-small | OpenAI | 1536 | ⭐⭐⭐⭐ (자유) | 62.3 | 보통 | 8K | 낮음 |

| Cohere embed-v4 | Cohere | 1536 | ⭐⭐⭐ (4종) | 70.3 | 강력 | 128K | 중고 |

| BGE-M3 | BAAI | 1024 | ⭐⭐ (고정) | 65.5 | 강력 | 8K | 자체 배포 |

| Voyage-3 | Voyage AI | 1024 | ⭐⭐⭐ (3종) | 67.1 | 보통 | 32K | 중간 |

| Qwen3-Embedding-8B (오픈소스) | 알리바바 통이 | 4096 | ⭐⭐⭐⭐⭐ (자유) | 70.58 | 매우 강력 | 32K | 자체 배포 |

이 비교표에서 도출할 수 있는 핵심 결론은 다음과 같습니다.

- 중영(中英) 이중 언어 시나리오: text-embedding-v4의 CMTEB 종합 점수 71.99는 모든 상용 API 중 1위입니다.

- 차원 유연성: v4가 제공하는 8가지 공식 추천 차원은 대부분의 모델보다 유연하며, 마이그레이션 호환성이 매우 뛰어납니다.

- 가성비: v4의 API 가격은 주요 상용 모델 중 중간 수준이지만, 정확도는 OpenAI의 text-embedding-3-large와 대등합니다.

📌 연동 팁: 팀에서 OpenAI, Claude, Qwen 등 여러 모델을 동시에 사용해야 한다면 APIYI apiyi.com과 같은 통합 중계 플랫폼을 통해 연동하는 것을 추천합니다. 여러 개의 API 키를 관리할 필요가 없고 국내 접속 문제도 해결할 수 있습니다. 플랫폼 문서에서 v4와 다른 주요 임베딩 모델을 병렬로 호출하는 예제도 확인해 보세요.

8. text-embedding-v4 자주 묻는 질문 (FAQ)

Q1: text-embedding-v4의 기본 차원은 얼마인가요?

text-embedding-v4의 기본 차원은 1024차원입니다. API 호출 시 dimensions 파라미터를 별도로 지정하지 않으면 1024차원 벡터가 반환됩니다. 이는 알리바바에서 공식적으로 추천하는 가성비 최적의 차원입니다.

Q2: 이미 1024차원으로 구축된 인덱스를 2048차원으로 업그레이드할 수 있나요?

벡터 데이터베이스 전체를 재구축해야 합니다. MRL(Matryoshka Representation Learning) 구조는 "고차원 벡터의 앞 N차원을 자르면 저차원 벡터와 같다"는 것을 보장하지만, 반대로 "저차원에 0을 채워 고차원으로 올리는 것"은 유효하지 않습니다. 업그레이드 시 다음 단계를 권장합니다:

- 기존 1024차원 인덱스 서비스를 유지합니다.

- v4의 2048차원을 사용하여 전체 문서를 다시 임베딩합니다.

- 트래픽을 점진적으로 전환(Canary release)하며 정확도 향상을 검증합니다.

- 완료 후 기존 인덱스를 종료합니다.

Q3: text-embedding-v4를 국내에서 바로 호출할 수 있나요?

text-embedding-v4의 공식 엔드포인트는 dashscope.aliyuncs.com (베이징)에 위치하며, 국내에서 직접 연결이 가능합니다. 국내 개발자는 알리바바 클라우드 계정을 등록하거나 APIYI(apiyi.com)와 같은 API 중계 서비스를 통해 API 키를 발급받으면 별도의 네트워크 설정 없이 바로 사용할 수 있습니다.

Q4: text-embedding-v4와 오픈소스 버전인 Qwen3-Embedding 중 무엇을 선택해야 할까요?

| 결정 요인 | API 버전 (v4) 선택 | 오픈소스 버전 (Qwen3-Embedding-8B) 선택 |

|---|---|---|

| 데이터 민감도 | 일반적 | 매우 민감 (금융/의료) |

| 월간 호출량 | 10억 토큰 미만 | 10억 토큰 이상 |

| 팀 GPU 자원 | 없음 | A100/H100 클러스터 보유 |

| 엔지니어링 역량 | 중소 규모 팀 | MLOps 팀 보유 |

| 종합 제안 | ✅ v4 API 추천 | ✅ 자체 배포 추천 |

Q5: 차원 설정을 잘못하면 모델에서 오류가 발생하나요?

text-embedding-v4는 [64, 128, 256, 512, 768, 1024, 1536, 2048] 값만 허용합니다. 그 외의 값(예: 333, 500)을 입력하면 파라미터 오류가 발생합니다. 비표준 차원이 필요한 경우, 가장 가까운 공식 차원을 선택한 후 절단(Truncation)하거나 패딩(Padding) 처리를 해야 합니다.

Q6: 현재 비즈니스에 적합한 차원을 어떻게 평가하나요?

다음 3단계 방법을 추천합니다:

- 베이스라인 구축: 우선 기본 1024차원으로 비즈니스 프로세스를 실행하여 재현율, 지연 시간, 저장 비용을 기록합니다.

- 하향 테스트: 512, 256, 128차원으로 순차적으로 변경하며 재현율 하락 폭을 관찰합니다.

- 스위트 스팟 결정: "재현율 하락이 허용 가능하면서 비용 절감 효과가 가장 큰" 차원을 찾습니다. 보통 256 또는 512차원이 이에 해당합니다.

Q7: text-embedding-v4도 오픈소스화되나요?

알리바바의 현재 전략은 API 버전과 오픈소스 버전의 병행입니다. text-embedding-v4 상용 API는 지속적으로 업데이트되며 최신 엔지니어링 최적화와 데이터 증강 기술이 적용됩니다. 반면 오픈소스 버전은 Qwen3-Embedding 시리즈 가중치를 커뮤니티에 제공합니다. 기술적 뿌리는 같지만 제품 형태가 다르므로, 향후 v4 자체가 별도로 오픈소스화될 가능성은 낮습니다.

Q8: 차원이 높을수록 무조건 좋은가요?

아닙니다. 차원 선택은 본질적으로 정확도, 저장 공간, 속도 사이의 트레이드오프입니다:

- 차원이 높을수록 → 정확도의 상한선은 높아지지만, 한계 효용은 체감합니다.

- 차원이 높을수록 → 저장 및 검색 비용이 선형 또는 그 이상으로 증가합니다.

- 차원이 높을수록 → ANN 인덱스에서 차원의 저주로 인해 오히려 정확도가 떨어질 수 있습니다.

경험상 256-1024차원이 대부분의 비즈니스에서 최적의 구간이며, 1024차원을 초과할 때는 명확한 정확도 향상 요구가 있을 때만 선택하는 것이 좋습니다.

Q9: text-embedding-v4의 긴 텍스트 처리 성능은 어떤가요?

text-embedding-v4는 최대 32K 토큰의 입력 길이를 지원하지만, 실제 검색 효과는 텍스트 길이에 따라 달라질 수 있습니다. 다음 원칙을 권장합니다:

- 짧은 텍스트 (< 512 토큰): 전체를 임베딩하는 것이 가장 효과적입니다.

- 중간 길이 (512-4K 토큰): 슬라이딩 윈도우 방식으로 청크를 나누어 임베딩하는 것을 고려하세요.

- 긴 문서 (> 4K 토큰): 반드시 청크(chunk) 단위로 나누어 임베딩해야 하며, 청크 크기는 256-512 토큰을 권장합니다.

- 초장문 문서: 계층적 검색(거친 검색 후 정밀 검색)을 결합하여 효율을 높일 수 있습니다.

Q10: 서로 다른 차원을 혼용할 수 있나요?

불가능합니다. 동일한 벡터 데이터베이스/인덱스 내의 모든 벡터는 차원이 일치해야 합니다. 그렇지 않으면 유사도 계산이 무의미해집니다. 만약 "고우선순위 문서는 2048차원, 일반 문서는 512차원" 전략이 필요하다면, 각각 독립적인 컬렉션을 생성하여 관리하고 애플리케이션 계층에서 결과를 통합하는 방식을 권장합니다.

Q11: 차원 파라미터가 API 비용에 영향을 주나요?

text-embedding-v4의 과금은 전적으로 입력 토큰 수를 기준으로 하며, 출력 차원과는 무관합니다. 즉, 64차원을 선택하든 2048차원을 선택하든 1000개의 토큰을 처리하는 비용은 동일합니다. 따라서 API 호출 단계에서는 안심하고 높은 차원을 선택해도 되며, 실제 비용 차이는 하위 저장 및 검색 단계에서 발생합니다.

Q12: 임베딩 실패나 속도 제한(Rate Limit) 문제는 어떻게 처리하나요?

프로덕션 환경에서 text-embedding-v4를 호출할 때는 다음과 같은 견고성 처리를 권장합니다:

- 재시도 메커니즘: 5xx 오류 발생 시 지수 백오프(Exponential Backoff) 재시도(3회 권장)를 구현합니다.

- 속도 제한 처리: 429 오류를 모니터링하고, 발생 시 동시성을 낮추거나 접속 채널을 전환합니다.

- 배치 크기: 단일 요청당 최대 25개의 텍스트를 처리하며, 초과 시 자동으로 분할합니다.

- 타임아웃 설정: 긴 텍스트 임베딩 시 타임아웃을 60초 이상으로 설정합니다.

- 장애 조치(Fallback): 예비 모델(예: v3 1024차원)을 설정하여 대비합니다.

9. 요약: text-embedding-v4 벡터 차원 선택 핵심 포인트

본문을 정리하며, text-embedding-v4의 8가지 벡터 차원 선택 시 핵심 요점은 다음과 같습니다:

- text-embedding-v4는 Qwen3-Embedding 시리즈의 상용 플래그십 모델로, MTEB 71.58 / CMTEB 71.99를 기록하며 중영 이중 언어 환경에서 선두를 달리고 있습니다.

- 8가지 차원은 본질적으로 Matryoshka(러시아 인형) 기술의 산물로, 앞 N차원만 사용해도 품질 손실이 제어 가능합니다.

- 1024차원은 기본 추천 값으로, 정확도와 비용 사이에서 최적의 균형을 이룹니다.

- 2048차원은 극강의 정확도가 필요한 환경에 적합하며, 1024차원 대비 CMTEB 검색 성능이 1포인트 향상됩니다.

- 256-512차원은 중규모 및 비용 민감형 환경에 적합하며, 대부분 RAG 시스템의 실전 스위트 스팟입니다.

- 64-128차원은 엣지 디바이스나 극한의 저장 공간 절약이 필요한 경우에만 추천하며, 재현율 하락을 충분히 테스트해야 합니다.

- 차원 선택은 한 번으로 끝나는 것이 아닙니다. 반드시 비즈니스 테스트 셋을 먼저 실행한 후 최종 결정하세요.

- 다른 모델에서 v4로 마이그레이션할 때는 차원이 일치하는 버전을 우선 선택하여 원활하게 전환하세요.

🎯 최종 제안: 새로운 프로젝트를 위해 임베딩 모델을 선택 중이라면, text-embedding-v4 + 1024차원으로 시작하세요. 비즈니스에서 재현율이 매우 중요하다면 2048차원으로 올리고 Reranker를 추가하세요. APIYI(apiyi.com) 플랫폼을 통해 접속하는 것을 권장합니다. 이 플랫폼은 OpenAI와 호환되는 통합 인터페이스, 간편한 차원 전환, 완벽한 연동 문서를 제공하여 엔지니어링 비용을 크게 줄여주고, 팀이 API 적응보다는 비즈니스 효과 최적화에 집중할 수 있도록 돕습니다.

벡터 임베딩 기술은 빠르게 진화하고 있습니다. OpenAI의 고정 차원 시대를 지나, 이제 text-embedding-v4가 MRL 기술을 8가지 공식 차원으로 구현하면서 개발자들은 전례 없는 유연성을 얻게 되었습니다. 벡터 차원의 본질과 선택 전략을 마스터하는 것은 RAG, 시맨틱 검색, 추천 시스템을 구축하는 모든 팀의 필수 역량입니다.

작성자: APIYI 기술팀 | AI 대규모 언어 모델 실전 적용에 집중합니다. 더 많은 기술 콘텐츠는 APIYI(apiyi.com)에서 확인하세요.