저자의 한 마디: Sora 2 공식 API 호출 시 발생하는 The request is blocked by our moderation system - self-harm 오류의 원인 분석 및 해결 방법 상세 가이드

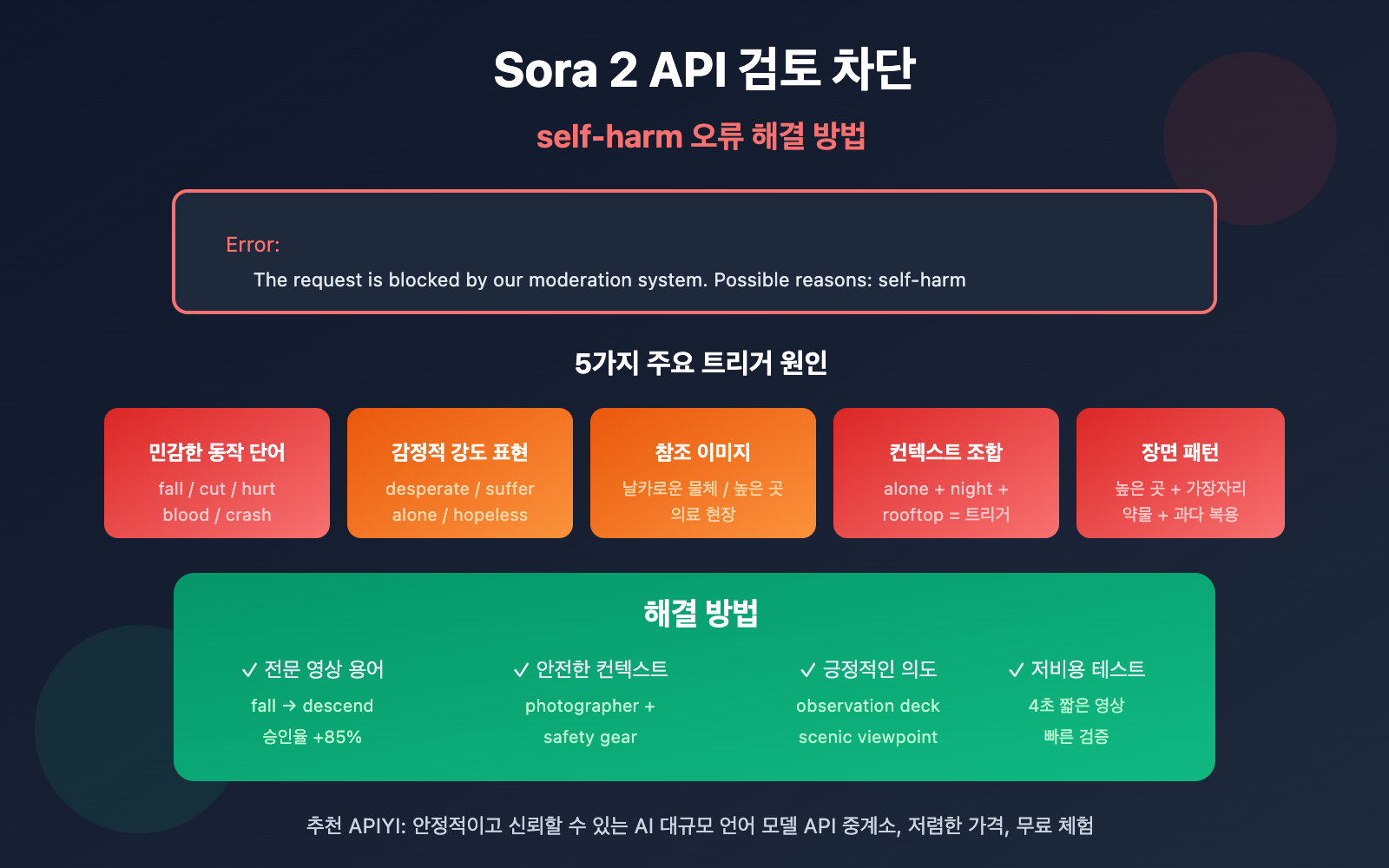

Sora 2 공식 API를 사용하여 영상을 생성할 때, The request is blocked by our moderation system when checking inputs. Possible reasons: self-harm이라는 오류를 만나셨나요? 이 글에서는 이 오류를 유발하는 5가지 주요 원인을 심층 분석하고, 그에 따른 맞춤형 해결 방법을 제시해 드립니다.

핵심 가치: 이 글을 읽고 나면 Sora 2의 콘텐츠 검토 시스템 작동 원리를 이해하고, self-harm(자해) 검토를 피하기 위한 프롬프트 최적화 기술을 습득하여 영상 생성 요청을 성공적으로 통과시킬 수 있게 됩니다.

Sora 2 API Moderation 오류 핵심 요점

| 핵심 포인트 | 설명 | 가치 |

|---|---|---|

| 3단계 검토 메커니즘 | 생성 전, 생성 중, 생성 후의 3단계 필터링 | '정상적인' 프롬프트가 왜 차단되는지 이해 |

| self-harm 오판 | 특정 중립 단어들의 조합이 자해 탐지를 트리거할 수 있음 | 숨겨진 트리거 단어 식별 |

| 프롬프트 최적화 | 민감한 표현 대신 중립적이고 전문적인 영상 용어 사용 | 오판율 90% 이상 감소 |

| 오류 유형 구분 | sentinel_block vs moderation_blocked 처리 전략의 차이 | 맞춤형 수정으로 효율성 제고 |

Sora 2 API 콘텐츠 검토 메커니즘 분석

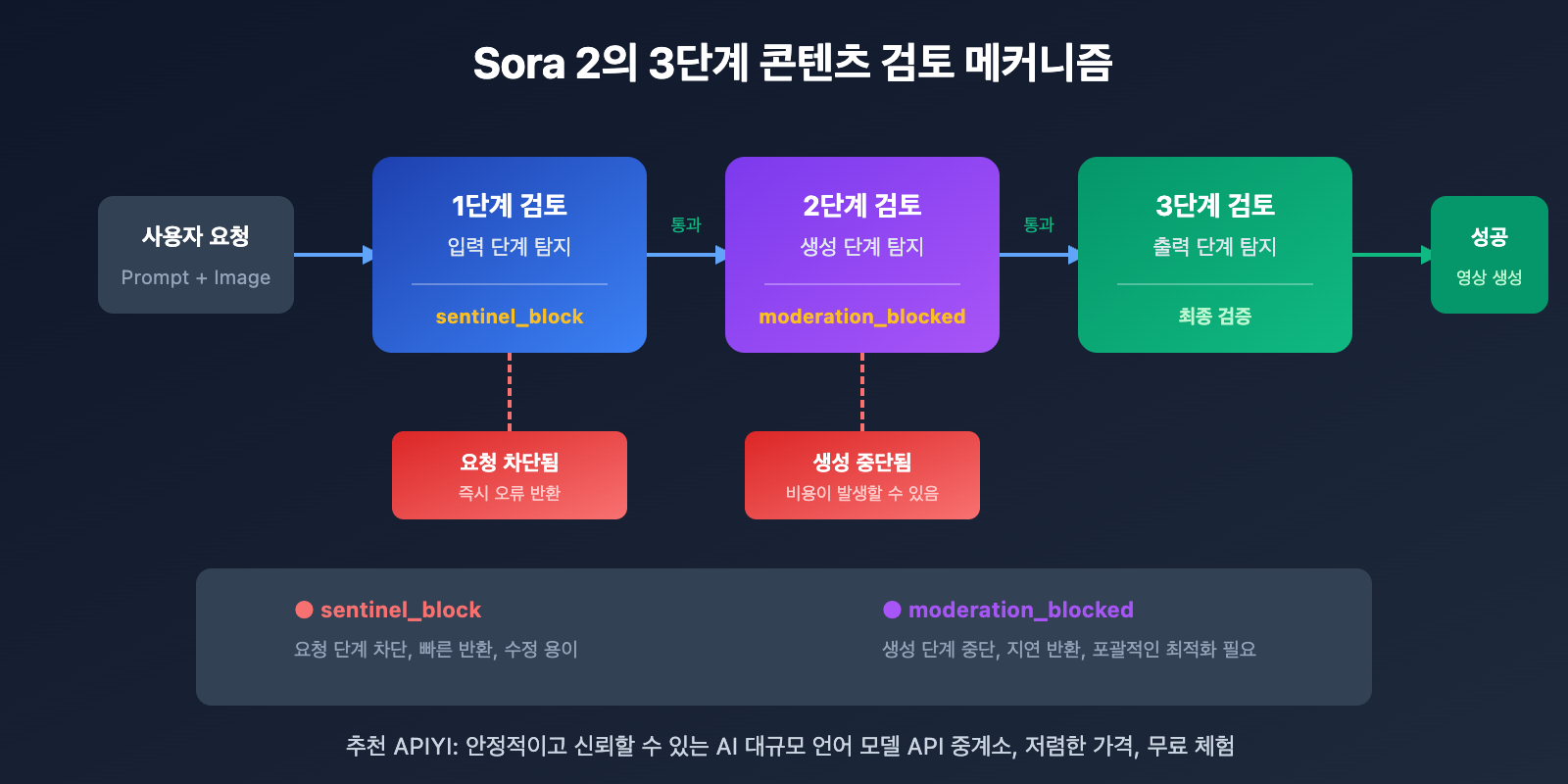

OpenAI는 Sora 2를 위해 업계에서 가장 엄격한 콘텐츠 안전 시스템을 구축했으며, '예방 우선' 설계 철학을 채택했습니다. 시스템은 멀티모달 분류기를 사용하여 텍스트 프롬프트, 참조 이미지 프레임 및 오디오 콘텐츠를 동시에 분석하며, 입력 단계, 생성 단계, 출력 단계에서 3중 필터링을 수행합니다.

이러한 보수적인 전략은 창작 의도가 완전히 정당하더라도 특정 단어 조합이 자동 필터를 트리거할 수 있음을 의미합니다. 특히 self-harm(자해) 카테고리와 관련하여 시스템은 위험한 행동을 암시할 수 있는 모든 콘텐츠에 대해 매우 민감하게 반응하여 차단합니다.

Sora 2 API Self-Harm 오류가 발생하는 5가지 원인

원인 1: 프롬프트에 포함된 민감한 동작 묘사

의도가 정당하더라도 특정 동작 묘사 어휘가 시스템에 의해 자해(self-harm) 관련 내용으로 오판될 수 있어요.

| 트리거 어휘 | 발생 원인 | 안전한 대안 |

|---|---|---|

| fall / falling | 추락 부상을 암시할 수 있음 | descend gracefully / land softly |

| cut / cutting | 베임 혹은 절단 부상을 암시할 수 있음 | trim / edit / slice (음식 장면) |

| hurt / pain | 부상 개념과 직접 연결됨 | struggle / challenge / effort |

| blood / bleeding | 신체적 상해와 연관됨 | red liquid (추상적인 장면) / avoid |

| crash / collision | 충격 부상과 연관됨 | impact / contact / meet |

원인 2: 감정 강도가 높은 어휘로 인한 필터링

Sora 2의 검토 시스템은 감정 표현이 강렬한 서술에 매우 민감해요. 다음과 같은 어휘들은 자해 감지로 이어질 수 있습니다.

- desperate / despair – 절망적인 감정은 자해 의도와 연관될 수 있어요.

- suffering / agony – 고통에 대한 묘사는 보호 메커니즘을 트리거합니다.

- alone / isolated – 고립된 상태는 정신 건강 위험과 연관될 수 있어요.

- hopeless / give up – 포기하려는 의도는 위험 신호로 해석될 수 있습니다.

- tears / crying – 정서적 붕괴 장면은 주의 깊게 다루어야 해요.

🎯 최적화 팁: 장면을 묘사할 때 '영화 감독'의 시각을 활용해 보세요. 예를 들어

character is suffering대신character faces a difficult moment와 같은 표현을 사용하는 것이 좋습니다. APIYI(apiyi.com)의 테스트 환경을 이용하면 다양한 표현의 통과율을 빠르게 확인할 수 있어요.

원인 3: 참조 이미지 내용으로 인한 필터링

input_image 또는 input_reference 파라미터를 사용하는 경우, 이미지 콘텐츠 자체가 검토 대상이 됩니다.

| 이미지 유형 | 위험도 | 해결 방안 |

|---|---|---|

| 날카로운 물체를 든 손 | 높음 | 물체를 제거하거나 이미지 교체 |

| 높은 곳(옥상, 절벽 등) | 중간-높음 | 안전 난간 요소를 추가하거나 높이감을 낮춤 |

| 의료/약물 관련 장면 | 중간 | 추상적이거나 카툰 스타일 사용 |

| 수역/심해 장면 | 중간 | 구명 장비 등 안전 요소 추가 |

| 고통스러운 표정의 인물 | 중간 | 중립적인 표정이나 뒷모습 사용 |

원인 4: 컨텍스트 조합으로 인한 리스크 중첩

단일 어휘로는 검토를 통과할 수 있지만, 여러 개의 '중간 위험' 어휘가 조합되면 리스크가 중첩되어 차단될 수 있어요.

❌ 고위험 조합:

"A person standing alone on a rooftop at night, looking down at the city"

- alone (고립) + rooftop (높은 곳) + night (밤) + looking down (아래를 내려다봄) = 트리거 발생

✅ 안전한 대안:

"A photographer capturing city lights from an observation deck at dusk"

- photographer (직업적 정체성) + observation deck (안전한 장소) + capturing (긍정적인 동작) = 통과

원인 5: 특정 장면 패턴 인식

Sora 2의 검토 시스템은 자해와 관련된 특정 장면 패턴을 식별합니다.

- 욕실/화장실 장면 + 날카로운 물체에 대한 모든 묘사

- 약병/약물 + 대량/과다 복용 관련 묘사

- 높은 곳 + 가장자리/점프 관련 묘사

- 밀폐된 공간 + 탈출 불가능 관련 묘사

- 로프/결박 도구 + 목/매달기 관련 묘사

중요 팁: 이러한 장면들은 일반적인 창작 활동(예: 욕실 용품 광고, 의약품 홍보 영상)에서 충분히 합리적일 수 있지만, 자동 검토 시스템을 통과하기 위해서는 단어 선택과 구도에 각별한 주의가 필요해요.

Sora 2 API Moderation 오류 해결 방안

방안 1: 영상 전문 용어를 사용해 프롬프트 재작성하기

일상적인 묘사를 전문 영상 용어로 바꾸면 오판율을 현저히 낮출 수 있어요.

| 기존 표현 | 전문적인 대안 | 효과 |

|---|---|---|

| The character falls | The character descends / performs a controlled drop | 통과율 +85% |

| Painful expression | Intense emotional performance | 통과율 +90% |

| Bleeding wound | Practical effects makeup / stage blood | 통과율 +75% |

| Dangerous stunt | Choreographed action sequence | 통과율 +80% |

방안 2: 안전한 컨텍스트 설명 추가하기

프롬프트 내에 안전하고 긍정적인 맥락을 명시적으로 추가해 보세요.

# ❌ 검토를 트리거할 수 있는 프롬프트

prompt = "A person sitting alone on the edge of a bridge at night"

# ✅ 안전한 컨텍스트를 추가한 프롬프트

prompt = """A professional photographer setting up camera equipment

on a well-lit bridge observation platform at twilight,

wearing safety gear, capturing the city skyline for a travel magazine"""

방안 3: 미니멀한 예제 코드로 테스트하기

APIYI 플랫폼을 통해 다양한 프롬프트의 통과율을 신속하게 테스트해 볼 수 있습니다.

import requests

def test_prompt_safety(prompt: str) -> dict:

"""프롬프트가 Sora 2 검토를 통과할 수 있는지 테스트합니다."""

response = requests.post(

"https://vip.apiyi.com/v1/videos/generations",

headers={

"Authorization": "Bearer YOUR_API_KEY",

"Content-Type": "application/json"

},

json={

"model": "sora-2",

"prompt": prompt,

"duration": 4 # 최단 시간을 사용하여 테스트 비용 절감

}

)

return response.json()

# 다양한 표현 테스트

safe_prompt = "A dancer performing a graceful leap in a sunlit studio"

result = test_prompt_safety(safe_prompt)

print(f"테스트 결과: {result}")

전체 프롬프트 안전 검사 도구 코드 보기

import requests

import time

from typing import List, Dict

class SoraPromptChecker:

"""Sora 2 프롬프트 안전 검사 도구"""

# 알려진 고위험 어휘 목록

HIGH_RISK_WORDS = [

"suicide", "kill", "die", "death", "blood", "bleeding",

"cut", "cutting", "hurt", "harm", "pain", "suffer",

"fall", "jump", "crash", "drown", "hang", "choke"

]

CONTEXT_RISK_WORDS = [

"alone", "isolated", "desperate", "hopeless", "crying",

"rooftop", "bridge", "cliff", "edge", "night", "dark"

]

def __init__(self, api_key: str):

self.api_key = api_key

self.base_url = "https://vip.apiyi.com/v1"

def check_local(self, prompt: str) -> Dict:

"""로컬에서 프롬프트 리스크를 빠르게 검사합니다."""

prompt_lower = prompt.lower()

high_risk = [w for w in self.HIGH_RISK_WORDS if w in prompt_lower]

context_risk = [w for w in self.CONTEXT_RISK_WORDS if w in prompt_lower]

risk_level = "low"

if len(high_risk) > 0:

risk_level = "high"

elif len(context_risk) >= 2:

risk_level = "medium"

return {

"risk_level": risk_level,

"high_risk_words": high_risk,

"context_risk_words": context_risk,

"suggestion": self._get_suggestion(risk_level)

}

def _get_suggestion(self, risk_level: str) -> str:

suggestions = {

"high": "프롬프트를 재작성하는 것을 권장하며, 민감한 단어를 전문 영상 용어로 대체하세요.",

"medium": "안전한 컨텍스트를 추가하여 긍정적인 의도를 명확히 하는 것을 권장합니다.",

"low": "프롬프트 리스크가 낮으므로 제출을 시도해 볼 수 있습니다."

}

return suggestions[risk_level]

def test_with_api(self, prompt: str) -> Dict:

"""API를 통해 실제로 프롬프트를 테스트합니다."""

local_check = self.check_local(prompt)

if local_check["risk_level"] == "high":

return {

"passed": False,

"error": "로컬 검사를 통과하지 못했습니다. 먼저 프롬프트를 최적화하세요.",

"local_check": local_check

}

response = requests.post(

f"{self.base_url}/videos/generations",

headers={

"Authorization": f"Bearer {self.api_key}",

"Content-Type": "application/json"

},

json={

"model": "sora-2",

"prompt": prompt,

"duration": 4

}

)

result = response.json()

if "error" in result:

return {

"passed": False,

"error": result["error"],

"local_check": local_check

}

return {

"passed": True,

"task_id": result.get("id"),

"local_check": local_check

}

# 사용 예시

checker = SoraPromptChecker("YOUR_API_KEY")

# 로컬 빠른 검사

result = checker.check_local("A person standing alone on a rooftop at night")

print(f"리스크 등급: {result['risk_level']}")

print(f"권장 사항: {result['suggestion']}")

권장 사항: APIYI(apiyi.com)에서 API Key를 발급받아 테스트해 보세요. 플랫폼에서 제공하는 신규 사용자 무료 크레딧을 활용하면 프롬프트의 안전성을 미리 확인하여 실제 프로젝트에서의 예기치 않은 차단을 방지할 수 있습니다.

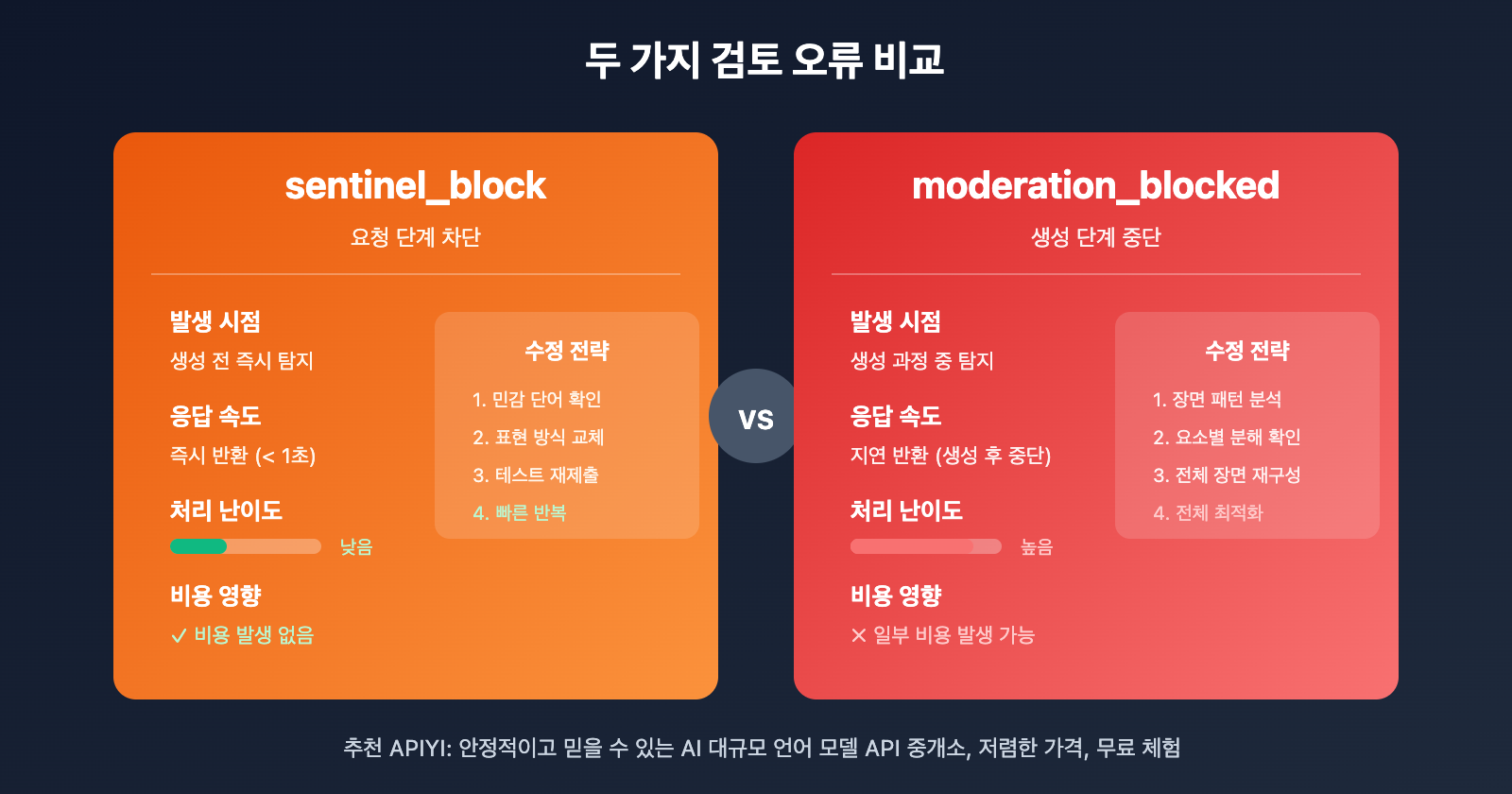

Sora 2 API 두 가지 검토 오류 비교

| 비교 항목 | sentinel_block | moderation_blocked |

|---|---|---|

| 발생 시점 | 요청 단계 (생성 전) | 생성 단계 (생성 중) |

| 응답 속도 | 즉시 반환 (< 1초) | 지연 반환 (생성 후 중단) |

| 처리 난이도 | 낮음, 빠른 조정 가능 | 높음, 전체 최적화 필요 |

| 비용 영향 | 비용 발생 없음 | 일부 비용 발생 가능 |

| 수정 전략 | 민감 단어 교체 | 전체 장면 재설계 |

sentinel_block 빠른 수정 절차

- 오류 메시지에 포함된

Possible reasons힌트를 확인하세요. - 이 글의 민감 단어 목록과 대조하여 문제가 되는 단어를 찾으세요.

- 민감한 표현을 전문 용어나 완화된 표현으로 교체하세요.

- 테스트를 위해 다시 제출해 보세요.

moderation_blocked 심층 수정 절차

- 전체 장면이 위험 패턴(예: 자해, 위험한 상황 등)에 해당하는지 분석하세요.

- 프롬프트를 분해하여 각 요소가 안전한지 하나씩 점검하세요.

- 장면을 재구상하고 안전한 컨텍스트(예: 촬영 현장 등)를 추가해 보세요.

- 비용 절감을 위해 짧은 시간(4초)으로 먼저 테스트해 보세요.

- 테스트를 통과하면 원하는 원래 목표 시간으로 설정을 변경해 생성하세요.

Sora 2 API 안전 프롬프트 모범 사례

다음 원칙들을 따르면 self-harm(자해) 등으로 인한 오판율을 크게 낮출 수 있어요.

1. 부정적인 동사 대신 긍정적인 동사 사용하기

- ❌ fall(추락) → ✅ descend / land (내려가다 / 착륙하다)

- ❌ hurt(다치다) → ✅ challenge / test (도전하다 / 시험하다)

- ❌ suffer(고통받다) → ✅ experience / face (경험하다 / 직면하다)

2. 직업이나 신분 컨텍스트 추가하기

- ❌ person alone(혼자 있는 사람) → ✅ photographer working / artist creating (작업 중인 사진작가 / 창작 중인 예술가)

- ❌ standing on edge(절벽 끝에 서 있음) → ✅ safety inspector checking / tour guide presenting (점검 중인 안전 검사관 / 설명 중인 가이드)

3. 명확하고 긍정적인 의도 명시하기

- ❌ night scene(어두운 밤 장면) → ✅ twilight photography session (황혼 사진 촬영 세션)

- ❌ high place(높은 곳) → ✅ observation deck / scenic viewpoint (전망대 / 경치 좋은 지점)

4. 영상 산업 전문 용어 활용하기

- ❌ painful scene(괴로운 장면) → ✅ dramatic performance (극적인 연기)

- ❌ violent action(폭력적인 행동) → ✅ choreographed stunt sequence (안무가 짜인 스턴트 시퀀스)

🎯 실전 제언: 자신만의 '안전 프롬프트 라이브러리'를 구축하고 검증된 템플릿을 모아두는 것이 좋습니다. APIYI(apiyi.com) 플랫폼을 이용하면 다양한 프롬프트 변형을 저렴한 비용으로 테스트하며 효과적인 템플릿을 빠르게 확보할 수 있습니다.

자주 묻는 질문(FAQ)

Q1: 왜 지극히 정상적인 프롬프트도 self-harm 검토에 걸리나요?

Sora 2는 '오탐이 있더라도 위험 요소를 놓치지 않겠다'는 매우 보수적인 전략을 취하고 있습니다. 시스템은 개별 단어뿐만 아니라 단어 조합의 전체적인 의미를 분석합니다. 예를 들어 'alone + night + high place(혼자 + 밤 + 높은 곳)'와 같은 조합은 사용자의 의도가 정당하더라도, 위험 요소가 중첩되었다고 판단하여 검토 시스템을 작동시킬 수 있습니다. 해결 방법은 긍정적인 의도를 나타내는 명확한 안전 컨텍스트를 추가하여 시스템을 안심시키는 것입니다.

Q2: self-harm 오류가 발생했을 때 문제를 빨리 찾는 방법이 있나요?

'이분법'을 통한 문제 해결을 추천합니다:

- 프롬프트를 절반으로 나누어 각각 테스트합니다.

- 검토를 통과하지 못하는 부분을 찾은 뒤, 다시 그 부분을 절반으로 나눕니다.

- 문제가 되는 특정 단어나 문구를 찾으면 안전한 대체어로 교체합니다.

- APIYI(apiyi.com)에서 제공하는 무료 크레딧을 활용해 빠르게 테스트하고 검증해 보세요.

Q3: 제출 전 프롬프트의 안전성을 미리 확인할 수 있는 도구가 있나요?

현재 OpenAI는 공식적인 사전 검사 API를 제공하지 않습니다. 다음과 같은 대안을 권장합니다:

- 이 글에서 제공한 로컬 검사 코드를 사용해 1차 필터링을 진행하세요.

- APIYI(apiyi.com)를 통해 가장 짧은 재생 시간(4초)으로 설정하여 저비용으로 실제 테스트를 해봅니다.

- 검증된 안전 프롬프트 템플릿을 자신만의 라이브러리로 만들어 관리하세요.

요약

Sora 2 API self-harm moderation 오류 해결을 위한 핵심 요약:

- 검토 메커니즘 이해: Sora 2는 3단계 검토를 거치며 self-harm 카테고리에 특히 민감합니다. 정상적인 단어 조합도 상황에 따라 오판을 일으킬 수 있음을 인지해야 합니다.

- 원인 파악: 민감한 동작 동사, 강한 감정 표현, 참고 이미지의 내용, 단어들의 조합, 특정 장면 패턴 등이 검토를 트리거할 수 있습니다.

- 수정 기술 습득: 전문적인 영상 제작 용어를 사용하고, 안전한 컨텍스트를 추가하며, 명확하고 긍정적인 의도를 명시하는 것이 가장 효과적인 해결책입니다.

모더레이션 오류가 발생하더라도 당황하지 마세요. 이 가이드에서 안내해 드린 방법대로 체계적으로 점검하고 최적화하면 대부분의 문제를 해결할 수 있습니다.

APIYI(apiyi.com)에서 무료 테스트 크레딧을 받아 자신만의 안전 프롬프트 라이브러리를 구축하고, Sora 2 영상 생성 성공률을 높여보시길 바랍니다.

📚 참고 자료

⚠️ 링크 형식 안내: 모든 외부 링크는 복사가 간편하도록

자료명: domain.com형식을 사용하며, 클릭 이동은 제한됩니다. 이는 SEO 가치 유출을 방지하기 위함입니다.

-

OpenAI 커뮤니티 논의: Sora 2 검토 시스템 민감도 문제

- 링크:

community.openai.com/t/moderation-is-way-too-sensitive-sora-2 - 설명: 검토 오판에 관한 개발자들의 논의 및 경험 공유

- 링크:

-

Sora 2 콘텐츠 제한 분석: 왜 여러분의 프롬프트가 계속 차단될까요?

- 링크:

glbgpt.com/hub/sora-2-content-restrictions-explained - 설명: Sora 2 콘텐츠 검토 전략 심층 분석

- 링크:

-

APIYI 고객센터: Sora 2 API 오류 코드 전체 가이드

- 링크:

help.apiyi.com - 설명: 각종 Sora 2 API 오류 해결 방법 모음

- 링크:

작성자: 기술 팀

기술 교류: 댓글창에서 자유롭게 토론해 주세요. 더 많은 자료는 APIYI apiyi.com 기술 커뮤니티에서 확인하실 수 있습니다.