Note de l'auteur : Analyse approfondie des causes et solutions face à l'erreur « The request is blocked by our moderation system – self-harm » lors de l'appel à l'API officielle de Sora 2.

Vous rencontrez l'erreur The request is blocked by our moderation system when checking inputs. Possible reasons: self-harm lors de la génération de vidéos avec l'API officielle de Sora 2 ? Cet article analyse en détail les 5 causes courantes de déclenchement de cette erreur et propose des solutions ciblées.

Valeur ajoutée : En lisant cet article, vous comprendrez le fonctionnement du système de modération de Sora 2 et maîtriserez les techniques d'optimisation des invites pour éviter les blocages liés au « self-harm » (automutilation), garantissant ainsi le succès de vos requêtes.

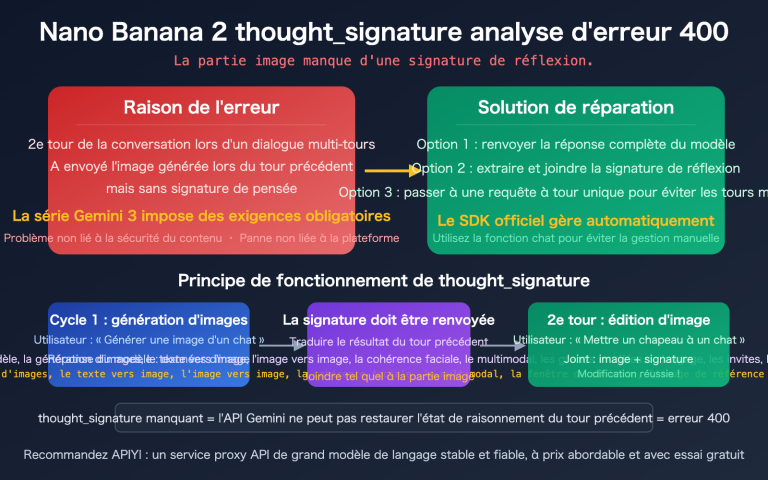

Points clés du blocage de modération de l'API Sora 2

| Point clé | Description | Valeur |

|---|---|---|

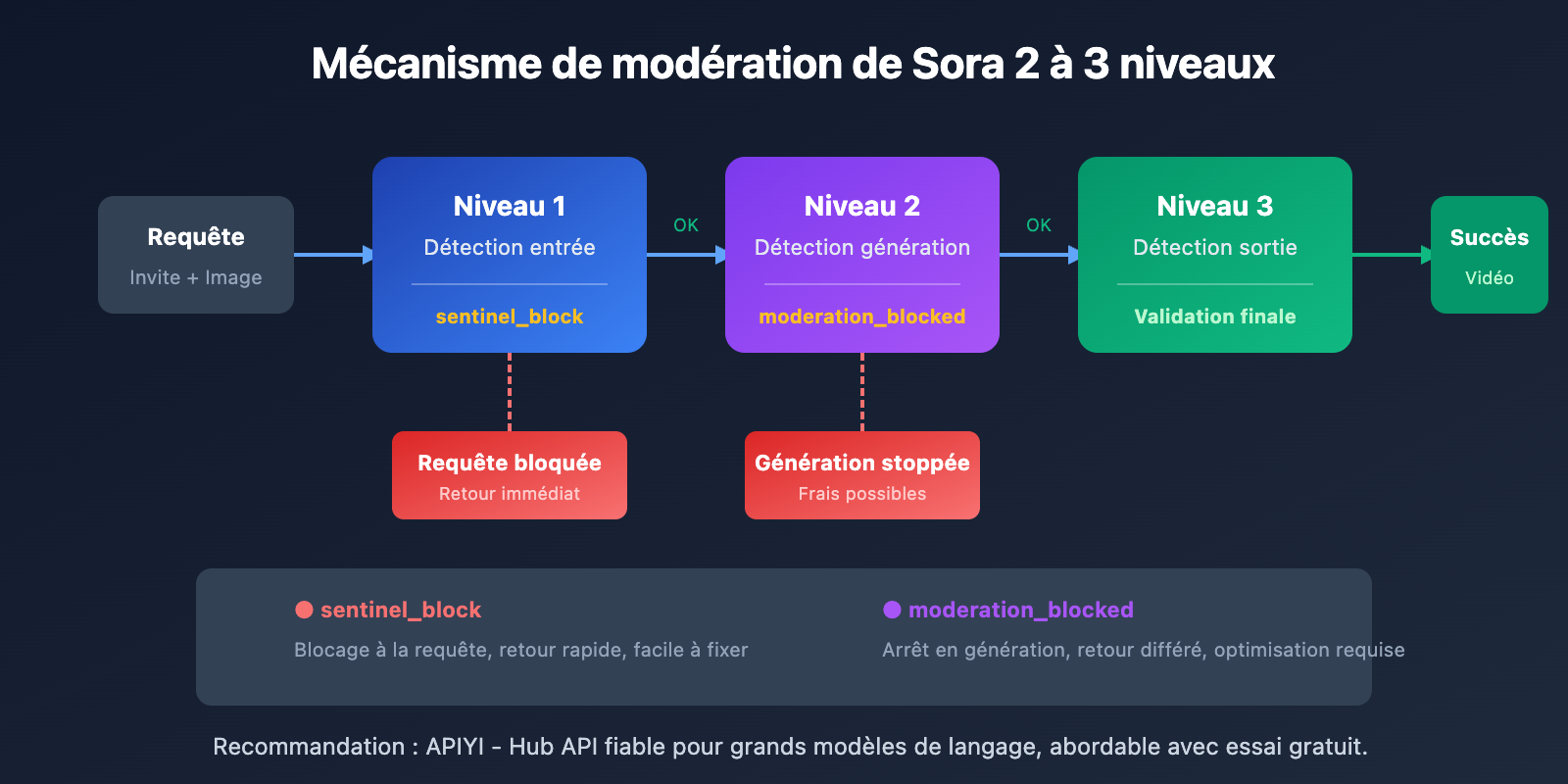

| Modération à 3 niveaux | Filtrage avant, pendant et après la génération | Comprendre pourquoi une invite « normale » peut être bloquée |

| Faux positifs self-harm | Des combinaisons de mots neutres peuvent déclencher l'alerte | Identifier les déclencheurs cachés |

| Optimisation d'invite | Utiliser des termes cinématographiques neutres et professionnels | Réduire le taux d'erreur de plus de 90 % |

| Types d'erreurs | Stratégies différentes pour sentinel_block vs moderation_blocked |

Correction ciblée pour plus d'efficacité |

Analyse du mécanisme de modération du contenu de l'API Sora 2

OpenAI a mis en place pour Sora 2 le système de sécurité du contenu le plus rigoureux du secteur, basé sur une philosophie de « prévention prioritaire ». Le système utilise des classificateurs multimodaux pour analyser simultanément les invites textuelles, les images de référence et le contenu audio, effectuant un triple filtrage lors des phases d'entrée, de génération et de sortie.

Cette stratégie conservatrice implique que même si votre intention créative est parfaitement légitime, certaines combinaisons de mots peuvent déclencher les filtres automatiques. En particulier concernant la catégorie « self-harm » (automutilation), le système intercepte tout contenu susceptible d'évoquer des comportements dangereux.

5 raisons pour lesquelles l'API Sora 2 renvoie une erreur « Self-Harm » (Auto-mutilation)

Raison 1 : L'invite contient des descriptions d'actions sensibles

Même si votre intention est tout à fait légitime, certains verbes d'action peuvent être mal interprétés par le système comme étant liés à l'auto-mutilation :

| Termes déclencheurs | Cause du déclenchement | Alternative sécurisée |

|---|---|---|

| fall / falling | Peut suggérer une chute volontaire | descend gracefully / land softly |

| cut / cutting | Peut suggérer une blessure par coupure | trim / edit / slice (scène de cuisine) |

| hurt / pain | Directement lié au concept de douleur | struggle / challenge / effort |

| blood / bleeding | Associé à une blessure corporelle | red liquid (scène abstraite) / à éviter |

| crash / collision | Associé à un impact violent | impact / contact / meet |

Raison 2 : Vocabulaire à forte intensité émotionnelle

Le système de modération de Sora 2 est très sensible aux expressions émotionnelles intenses. Les termes suivants peuvent déclencher une détection « self-harm » :

- desperate / despair – Le désespoir peut être associé à une intention d'auto-mutilation.

- suffering / agony – Les descriptions de souffrance activent les mécanismes de protection.

- alone / isolated – L'état d'isolement est corrélé aux risques de santé mentale.

- hopeless / give up – L'intention d'abandon peut être interprétée comme un signal de danger.

- tears / crying – Les scènes d'effondrement émotionnel doivent être traitées avec prudence.

🎯 Conseil d'optimisation : Adoptez une perspective de « réalisateur de cinéma » pour décrire la scène. Par exemple, remplacez

character is sufferingparcharacter faces a difficult moment. Vous pouvez valider rapidement le taux de passage de différentes formulations via l'environnement de test d'APIYI (apiyi.com).

Raison 3 : Le contenu de l'image de référence déclenche la modération

Si vous utilisez les paramètres input_image ou input_reference, le contenu de l'image lui-même est soumis à l'examen :

| Type d'image | Risque de déclenchement | Solution |

|---|---|---|

| Main tenant un objet tranchant | Élevé | Retirer l'objet ou changer d'image |

| Lieux en hauteur (toit, falaise) | Moyen-Élevé | Ajouter des barrières de sécurité ou réduire l'impression de hauteur |

| Scène médicale / médicaments | Moyen | Utiliser un style abstrait ou dessin animé |

| Zones aquatiques / eau profonde | Moyen | Ajouter des éléments de sécurité (équipement de sauvetage, etc.) |

| Personnage avec une expression de douleur | Moyen | Utiliser une expression neutre ou filmer de dos |

Raison 4 : Accumulation de risques par combinaison contextuelle

Un mot isolé peut passer la modération, mais la combinaison de plusieurs termes à « risque modéré » peut entraîner un blocage :

❌ Combinaison à haut risque :

"A person standing alone on a rooftop at night, looking down at the city"

- alone (isolement) + rooftop (hauteur) + night (nuit) + looking down (regard vers le bas) = Déclenchement

✅ Alternative sécurisée :

"A photographer capturing city lights from an observation deck at dusk"

- photographer (identité professionnelle) + observation deck (lieu sécurisé) + capturing (action positive) = Validé

Raison 5 : Reconnaissance de schémas de scènes spécifiques

Le système de modération de Sora 2 identifie certains schémas de scènes classiquement associés à l'auto-mutilation :

- Scène de salle de bain + toute description d'objet tranchant.

- Flacons de pilules / médicaments + description de quantité importante ou excessive.

- Scène en haute altitude + description de bordure ou de saut.

- Espaces clos + description d'impossibilité de s'échapper.

- Cordes / liens + description liée au cou ou à la suspension.

Note importante : Ces scènes peuvent être parfaitement justifiées dans une création normale (comme une publicité pour produits de bain ou un film de prévention médicale), mais elles nécessitent une attention particulière dans le choix des mots et de la composition pour éviter un blocage automatique.

Solutions aux erreurs de modération de l'API Sora 2

Solution 1 : Utiliser des termes techniques de l'audiovisuel pour réécrire l'invite

Transformer une description quotidienne en termes professionnels du cinéma peut réduire considérablement les faux positifs :

| Expression originale | Alternative professionnelle | Efficacité |

|---|---|---|

| The character falls | The character descends / performs a controlled drop | Taux de passage +85% |

| Painful expression | Intense emotional performance | Taux de passage +90% |

| Bleeding wound | Practical effects makeup / stage blood | Taux de passage +75% |

| Dangerous stunt | Choreographed action sequence | Taux de passage +80% |

Solution 2 : Ajouter un contexte de sécurité explicite

Précisez clairement un contexte sûr et positif dans votre invite :

# ❌ Invite susceptible de déclencher la modération

prompt = "A person sitting alone on the edge of a bridge at night"

# ✅ Après ajout d'un contexte de sécurité

prompt = """A professional photographer setting up camera equipment

on a well-lit bridge observation platform at twilight,

wearing safety gear, capturing the city skyline for a travel magazine"""

Solution 3 : Utiliser un code de test minimaliste

Testez rapidement le taux de passage de différentes invites via la plateforme APIYI :

import requests

def test_prompt_safety(prompt: str) -> dict:

"""Teste si une invite passe la modération de Sora 2"""

response = requests.post(

"https://vip.apiyi.com/v1/videos/generations",

headers={

"Authorization": "Bearer VOTRE_CLE_API",

"Content-Type": "application/json"

},

json={

"model": "sora-2",

"prompt": prompt,

"duration": 4 # Utiliser la durée la plus courte pour réduire les coûts de test

}

)

return response.json()

# Test de différentes formulations

safe_prompt = "A dancer performing a graceful leap in a sunlit studio"

result = test_prompt_safety(safe_prompt)

print(f"Résultat du test : {result}")

Voir le code complet de l’outil de vérification de sécurité des invites

import requests

import time

from typing import List, Dict

class SoraPromptChecker:

"""Outil de vérification de sécurité pour les invites Sora 2"""

# Liste des mots à haut risque connus

HIGH_RISK_WORDS = [

"suicide", "kill", "die", "death", "blood", "bleeding",

"cut", "cutting", "hurt", "harm", "pain", "suffer",

"fall", "jump", "crash", "drown", "hang", "choke"

]

CONTEXT_RISK_WORDS = [

"alone", "isolated", "desperate", "hopeless", "crying",

"rooftop", "bridge", "cliff", "edge", "night", "dark"

]

def __init__(self, api_key: str):

self.api_key = api_key

self.base_url = "https://vip.apiyi.com/v1"

def check_local(self, prompt: str) -> Dict:

"""Vérification locale rapide des risques de l'invite"""

prompt_lower = prompt.lower()

high_risk = [w for w in self.HIGH_RISK_WORDS if w in prompt_lower]

context_risk = [w for w in self.CONTEXT_RISK_WORDS if w in prompt_lower]

risk_level = "low"

if len(high_risk) > 0:

risk_level = "high"

elif len(context_risk) >= 2:

risk_level = "medium"

return {

"risk_level": risk_level,

"high_risk_words": high_risk,

"context_risk_words": context_risk,

"suggestion": self._get_suggestion(risk_level)

}

def _get_suggestion(self, risk_level: str) -> str:

suggestions = {

"high": "Il est conseillé de réécrire l'invite en utilisant des termes techniques de cinéma pour remplacer les mots sensibles.",

"medium": "Il est conseillé d'ajouter un contexte de sécurité pour clarifier l'intention positive.",

"low": "Le risque de l'invite est faible, vous pouvez essayer de la soumettre."

}

return suggestions[risk_level]

def test_with_api(self, prompt: str) -> Dict:

"""Test réel de l'invite via l'API"""

local_check = self.check_local(prompt)

if local_check["risk_level"] == "high":

return {

"passed": False,

"error": "Échec de la vérification locale, veuillez d'abord optimiser l'invite.",

"local_check": local_check

}

response = requests.post(

f"{self.base_url}/videos/generations",

headers={

"Authorization": f"Bearer {self.api_key}",

"Content-Type": "application/json"

},

json={

"model": "sora-2",

"prompt": prompt,

"duration": 4

}

)

result = response.json()

if "error" in result:

return {

"passed": False,

"error": result["error"],

"local_check": local_check

}

return {

"passed": True,

"task_id": result.get("id"),

"local_check": local_check

}

# Exemple d'utilisation

checker = SoraPromptChecker("VOTRE_CLE_API")

# Vérification locale rapide

result = checker.check_local("A person standing alone on a rooftop at night")

print(f"Niveau de risque : {result['risk_level']}")

print(f"Suggestion : {result['suggestion']}")

Conseil : Obtenez une clé API sur APIYI (apiyi.com) pour effectuer vos tests. La plateforme offre des crédits gratuits aux nouveaux utilisateurs, ce qui est idéal pour vérifier la sécurité de vos invites et éviter les blocages inattendus dans vos projets finaux.

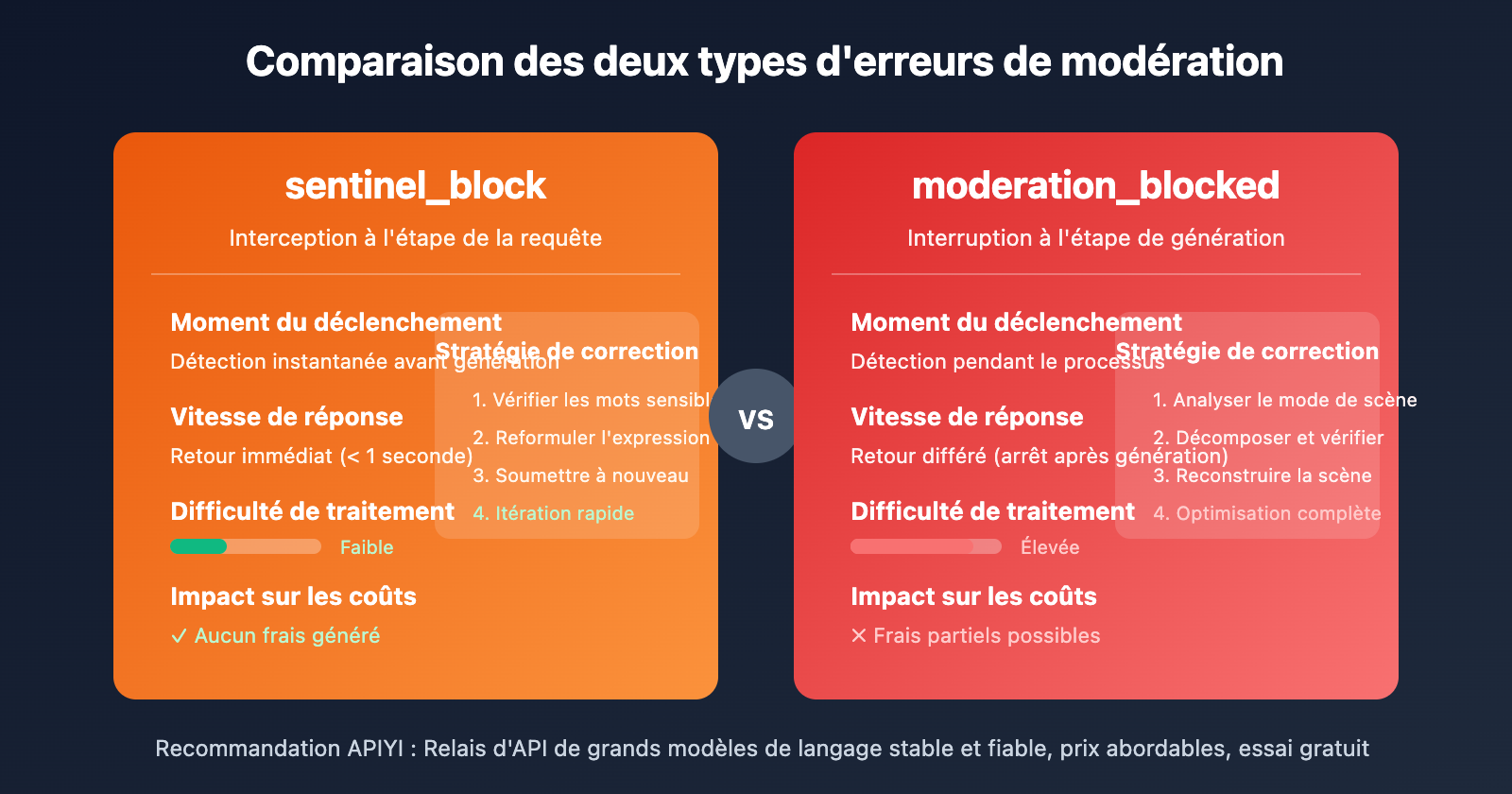

Comparaison des deux types d'erreurs de modération de l'API Sora 2

| Dimension de comparaison | sentinel_block | moderation_blocked |

|---|---|---|

| Moment du déclenchement | Étape de la requête (avant génération) | Étape de génération (en cours) |

| Vitesse de réponse | Retour immédiat (< 1s) | Retour différé (interruption après génération) |

| Difficulté de traitement | Faible, un ajustement rapide suffit | Élevée, nécessite une optimisation globale |

| Impact sur les coûts | Aucun frais généré | Frais partiels possibles |

| Stratégie de correction | Remplacer les mots sensibles | Redessiner l'ensemble de la scène |

Procédure de correction rapide pour sentinel_block

- Vérifiez l'indice

Possible reasonsdans le message d'erreur. - Comparez avec la liste des mots sensibles de cet article pour localiser le terme problématique.

- Utilisez des termes techniques ou professionnels pour remplacer les expressions sensibles.

- Soumettez à nouveau pour test.

Procédure de correction approfondie pour moderation_blocked

- Analysez si la scène globale correspond à un profil de risque.

- Décomposez l'invite et vérifiez chaque élément un par un.

- Repensez la scène en ajoutant un contexte de sécurité.

- Effectuez un test à faible coût sur une courte durée (4 secondes).

- Une fois le test réussi, relancez la génération avec la durée finale souhaitée.

Bonnes pratiques pour les invites de sécurité de l'API Sora 2

En suivant ces principes, vous pouvez réduire considérablement le taux de faux positifs liés à l'automutilation (self-harm) :

1. Utiliser des verbes positifs au lieu de verbes négatifs

- ❌ fall (tomber) → ✅ descend / land (descendre / atterrir)

- ❌ hurt (blesser) → ✅ challenge / test (relever un défi / tester)

- ❌ suffer (souffrir) → ✅ experience / face (vivre / faire face à)

2. Ajouter un contexte professionnel ou d'identité

- ❌ person alone (personne seule) → ✅ photographer working / artist creating (photographe au travail / artiste en création)

- ❌ standing on edge (debout sur le bord) → ✅ safety inspector checking / tour guide presenting (inspecteur de sécurité en vérification / guide touristique présentant le lieu)

3. Préciser une intention positive

- ❌ night scene (scène de nuit) → ✅ twilight photography session (séance photo au crépuscule)

- ❌ high place (endroit élevé) → ✅ observation deck / scenic viewpoint (plateforme d'observation / point de vue panoramique)

4. Utiliser la terminologie de l'industrie cinématographique

- ❌ painful scene (scène douloureuse) → ✅ dramatic performance (performance dramatique)

- ❌ violent action (action violente) → ✅ choreographed stunt sequence (séquence de cascade chorégraphiée)

🎯 Conseil pratique : Créez votre propre « bibliothèque d'invites sécurisées » en collectant des modèles testés et validés. Via la plateforme APIYI (apiyi.com), vous pouvez tester de nombreuses variantes d'invites à moindre coût et accumuler rapidement des modèles efficaces.

Questions fréquemment posées

Q1 : Pourquoi des invites tout à fait normales déclenchent-elles la modération « self-harm » ?

Sora 2 adopte une stratégie conservatrice : « mieux vaut prévenir que guérir ». Le système analyse la sémantique globale des combinaisons de mots plutôt que les mots pris individuellement. Certaines combinaisons (comme « seul + nuit + endroit élevé »), même si l'intention est légitime, peuvent déclencher la modération à cause de l'accumulation de facteurs de risque. La solution consiste à ajouter un contexte de sécurité explicite pour démontrer une intention positive.

Q2 : Après avoir reçu une erreur « self-harm », comment localiser rapidement le problème ?

Il est recommandé d'utiliser la méthode de la « dichotomie » :

- Divisez votre invite en deux parties et testez-les séparément.

- Une fois la partie déclenchant la modération identifiée, continuez à la diviser.

- Après avoir trouvé le mot ou l'expression spécifique, utilisez une alternative sûre.

- Utilisez les crédits gratuits d'APIYI (apiyi.com) pour effectuer des tests de validation rapides.

Q3 : Existe-t-il des outils de pré-vérification pour tester la sécurité des invites avant l’envoi ?

Actuellement, OpenAI ne fournit pas d'API officielle de pré-vérification. Voici les solutions suggérées :

- Utilisez le code de vérification locale fourni dans cet article pour un premier filtrage.

- Passez par APIYI (apiyi.com) pour effectuer des tests réels à bas coût avec la durée la plus courte (4 secondes).

3.积累 et maintenez votre propre bibliothèque de modèles d'invites sécurisées.

Conclusion

Voici les points clés pour résoudre les erreurs de modération « self-harm » de l'API Sora 2 :

- Comprendre le mécanisme de modération : Sora 2 utilise une modération à trois niveaux et se montre particulièrement sensible à la catégorie « self-harm ». Certaines combinaisons de mots ordinaires peuvent provoquer des faux positifs.

- Identifier les causes de déclenchement : Les verbes d'action sensibles, les termes d'intensité émotionnelle, le contenu des images de référence, les combinaisons contextuelles et les types de scènes peuvent tous déclencher une alerte.

- Maîtriser les techniques de correction : L'utilisation de termes techniques cinématographiques, l'ajout d'un contexte de sécurité et la clarification d'une intention positive sont les solutions les plus efficaces.

Ne paniquez pas face à une erreur de modération. En suivant la méthode de diagnostic et d'optimisation de cet article, vous pourrez résoudre la grande majorité des situations.

Nous vous recommandons d'utiliser APIYI (apiyi.com) pour obtenir des crédits de test gratuits, créer votre propre bibliothèque d'invites sécurisées et ainsi augmenter le taux de réussite de vos générations de vidéos avec Sora 2.

📚 Ressources

⚠️ Note sur le format des liens : Tous les liens externes utilisent le format

Nom de la ressource : domain.com. Ils sont faciles à copier mais ne sont pas cliquables afin d'éviter la perte de poids SEO.

-

Discussions de la communauté OpenAI : Problèmes de sensibilité du système de modération de Sora 2

- Lien :

community.openai.com/t/moderation-is-way-too-sensitive-sora-2 - Description : Partages d'expériences et discussions des développeurs concernant les erreurs de jugement de la modération (faux positifs).

- Lien :

-

Analyse des restrictions de contenu de Sora 2 : Pourquoi votre invite est-elle toujours bloquée ?

- Lien :

glbgpt.com/hub/sora-2-content-restrictions-explained - Description : Analyse approfondie des stratégies de modération de contenu de Sora 2.

- Lien :

-

Centre d'aide APIYI : Guide complet des codes d'erreur de l'API Sora 2

- Lien :

help.apiyi.com - Description : Recueil de solutions pour les différents types d'erreurs signalées par l'API Sora 2.

- Lien :

Auteur : Équipe technique

Échanges techniques : N'hésitez pas à venir discuter dans la section des commentaires. Pour plus de ressources, vous pouvez consulter la communauté technique APIYI sur apiyi.com