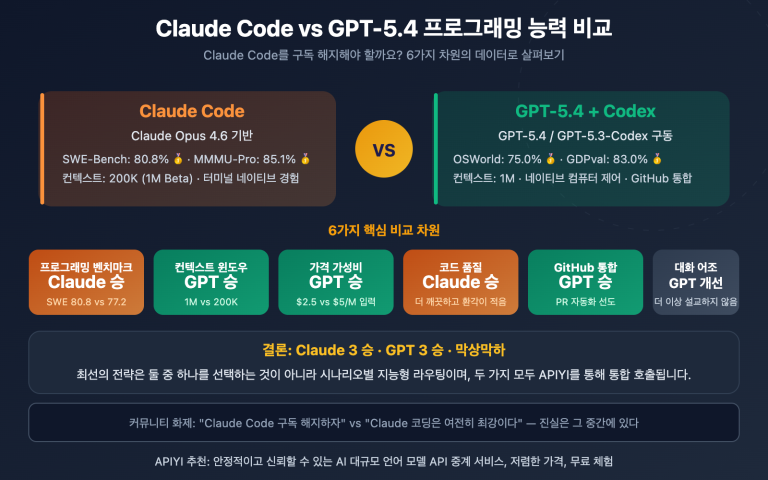

작성자 주: SWE-bench Pro, Terminal-Bench 2.0, LiveCodeBench 등 6가지 핵심 벤치마크 테스트를 바탕으로, 실제 프로그래밍 환경에서 GPT-5.5와 Claude Opus 4.7의 성능 차이를 심층 분석하고 명확한 선택 가이드를 제시합니다.

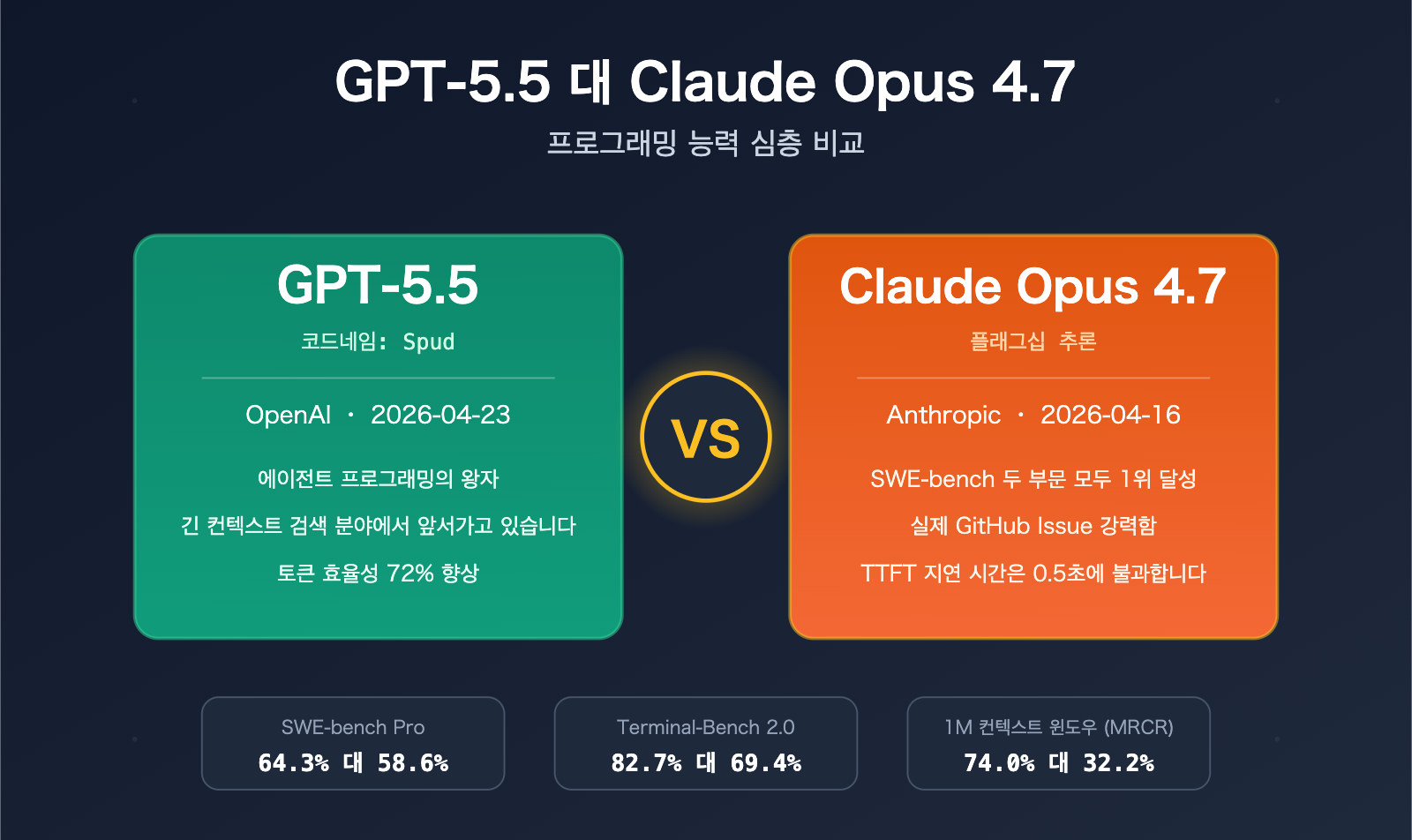

GPT-5.5와 Claude Opus 4.7의 프로그래밍 능력 대결은 2026년 4월 AI 프로그래밍 분야에서 가장 뜨거운 주제입니다. 본문에서는 OpenAI GPT-5.5(코드명 Spud)와 Anthropic Claude Opus 4.7을 SWE-bench Pro, Terminal-Bench 2.0, 긴 컨텍스트 검색, 토큰 효율성, API 가격 등 다양한 측면에서 비교하여 명확한 도입 전략을 제안합니다.

"둘 다 장단점이 있다"는 식의 어중간한 분석이 아닙니다. 공식 벤치마크 데이터를 바탕으로, 각기 다른 상황에서 어떤 모델을 선택해야 할지 명확한 답을 드립니다. Anthropic이 2026년 4월 16일 Claude Opus 4.7을 출시하고, OpenAI가 4월 23일 GPT-5.5를 연이어 발표하면서 7일 간격으로 이어진 두 거대 모델의 프로그래밍 능력 대결이 시작되었습니다.

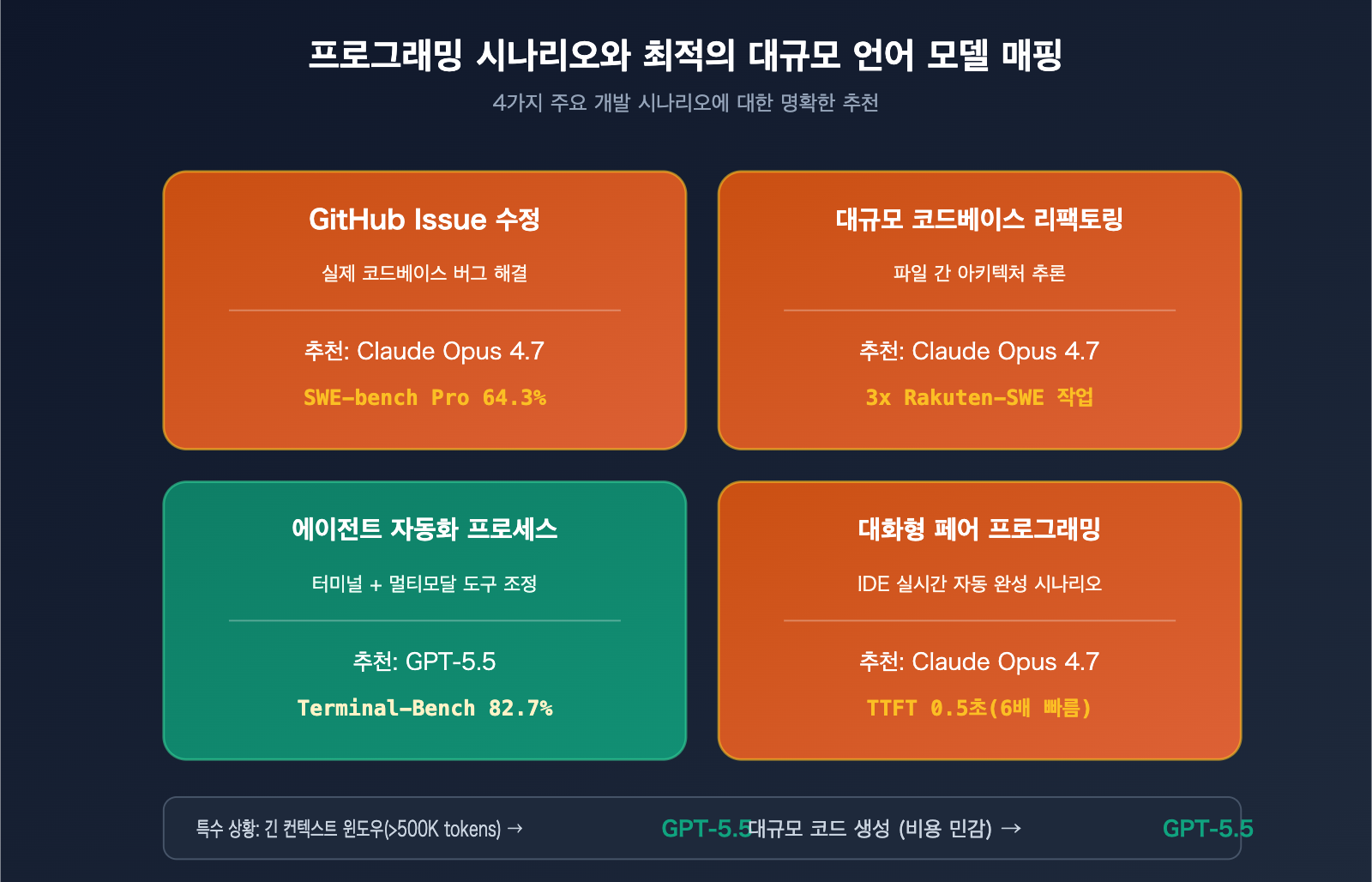

핵심 가치: 이 글을 읽고 나면 GitHub 이슈 해결, 에이전트 기반 프로그래밍, 긴 컨텍스트 리팩토링, 인터랙티브 코딩 등 4가지 대표적인 상황에서 GPT-5.5와 Claude Opus 4.7 중 무엇을 선택해야 할지 확실히 알게 되실 겁니다.

GPT-5.5와 Claude Opus 4.7 핵심 차이 한눈에 보기

두 모델의 핵심 포지셔닝이 다르기 때문에 프로그래밍 능력의 강점도 확연히 갈립니다. 다음 표는 프로그래밍 관련 주요 항목에서의 핵심 차이를 요약한 것입니다.

| 비교 항목 | GPT-5.5 | Claude Opus 4.7 |

|---|---|---|

| 출시일 | 2026-04-23 | 2026-04-16 |

| 코드명 | Spud | – |

| 컨텍스트 윈도우 | 1M 토큰 | 1M 토큰 |

| 최대 출력 | 128K 토큰 | 128K 토큰 |

| 핵심 강점 | 에이전트 기반 프로그래밍, 긴 컨텍스트 검색 | 실제 GitHub 이슈 해결, 아키텍처 추론 |

| 일반적인 TTFT | ~3초 | ~0.5초 |

| 토큰 효율성 | 출력 토큰이 Opus보다 72% 적음 | 토큰 소모량은 높으나 정확도 높음 |

| API 입력 | $5/M 토큰 | $5/M 토큰 |

| API 출력 | $30/M 토큰 | $25/M 토큰 |

| 대용량 프롬프트 추가 요금 | >200K 유지 | >200K 시 2배로 증가 ($10/$37.50) |

GPT-5.5 프로그래밍 능력 포지셔닝

GPT-5.5는 OpenAI가 현재까지 선보인 가장 강력한 에이전트 기반 프로그래밍 모델입니다. 터미널 워크플로우, 긴 컨텍스트 검색, 교차 도구 조정 기능이 뛰어나 다단계 작업이나 도구 호출이 필요한 자동화 프로그래밍 프로세스에 특히 적합합니다. OpenAI는 이 모델을 '장기 프로그래밍 작업'을 위한 최우선 선택지로 포지셔닝하고 있으며, Expert-SWE 내부 벤치마크에서는 20시간 분량의 인간 작업량을 처리하는 능력을 보여주었습니다.

Claude Opus 4.7 프로그래밍 능력 포지셔닝

Claude Opus 4.7은 실제 소프트웨어 엔지니어링 작업에서 다시 한번 왕좌를 탈환했습니다. SWE-bench Verified에서 87.6%, SWE-bench Pro에서 64.3%를 기록하며 기존의 모든 경쟁 모델을 크게 앞질렀습니다. Anthropic이 Rakuten-SWE-Bench에서 실측한 결과에 따르면, Opus 4.7이 해결한 생산 작업량은 Opus 4.6의 3배에 달하며, 특히 GitHub 이슈 해결이나 대규모 코드 베이스 리팩토링과 같이 아키텍처 추론이 필요한 작업에 매우 적합합니다.

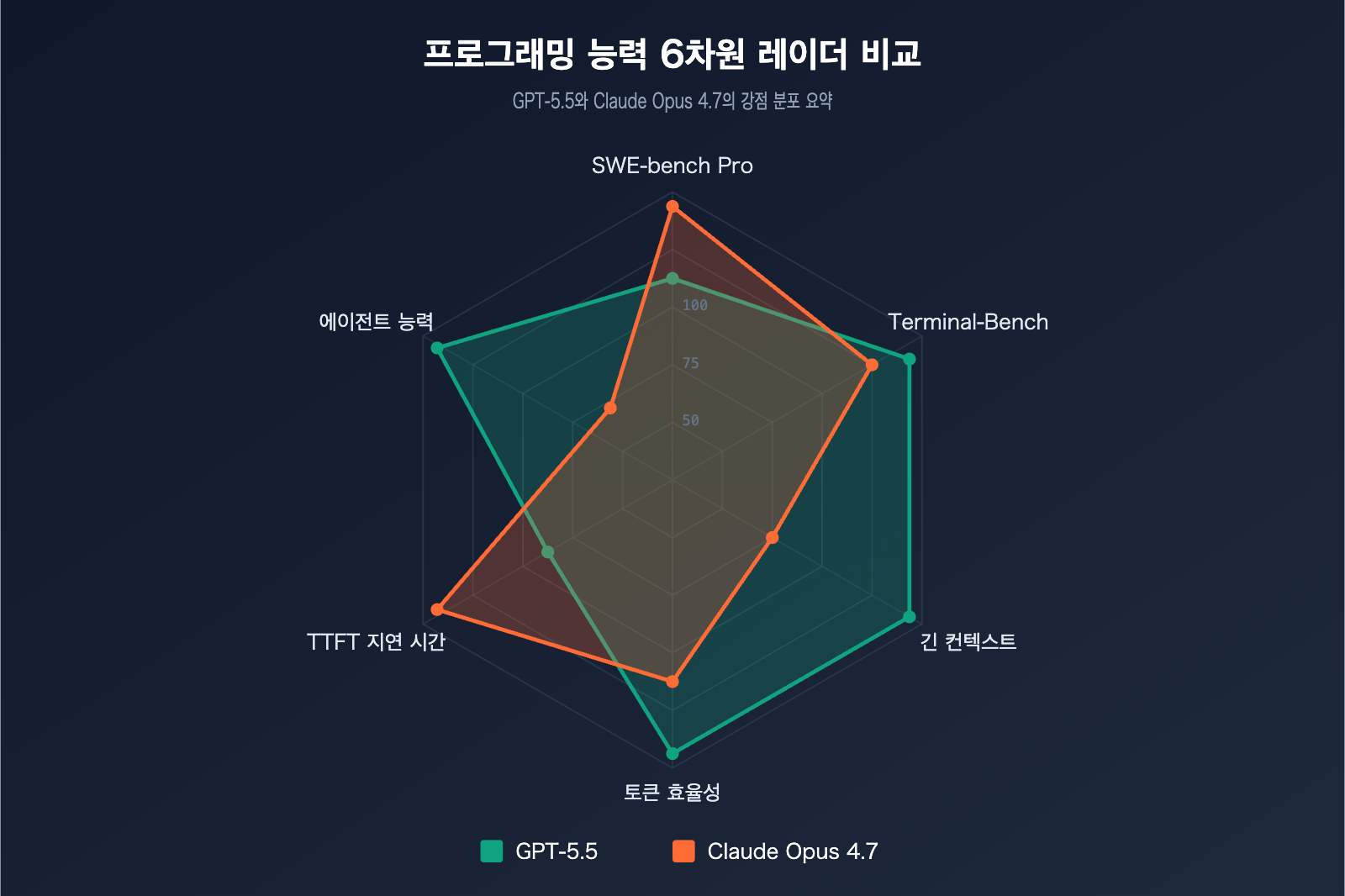

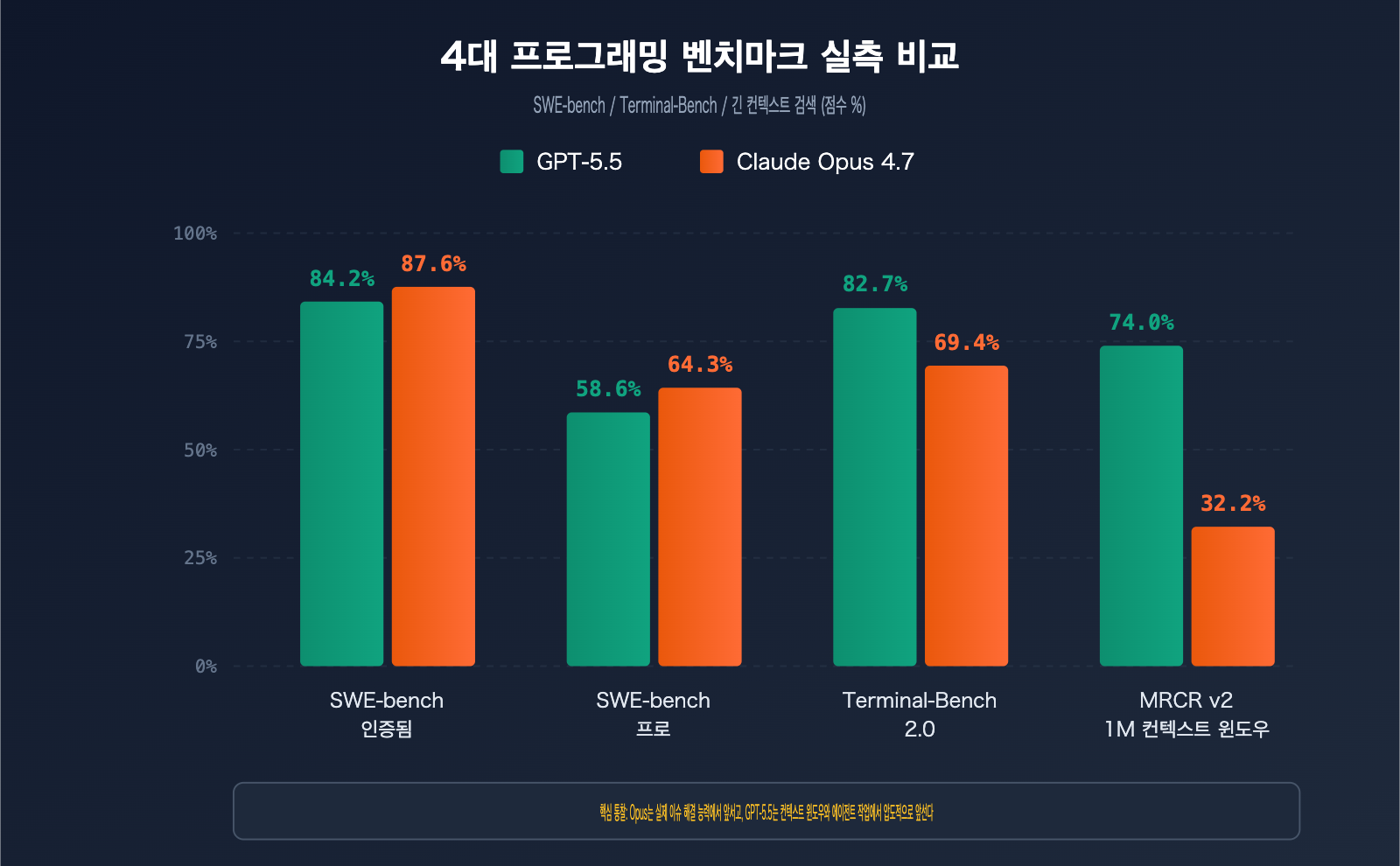

GPT-5.5 대 Claude Opus 4.7 벤치마크 실측 비교

벤치마크는 모델의 프로그래밍 능력을 객관적으로 판단할 수 있는 가장 확실한 지표입니다. 주요 프로그래밍 벤치마크 6개 항목에서 두 모델의 공식 데이터를 정리해 보았습니다.

| 벤치마크 | 테스트 내용 | GPT-5.5 | Claude Opus 4.7 | 승자 |

|---|---|---|---|---|

| SWE-bench Verified | 검증된 GitHub 이슈 수정 | 84.2% | 87.6% | Opus 4.7 |

| SWE-bench Pro | 다중 파일 복합 이슈 수정 | 58.6% | 64.3% | Opus 4.7 |

| Terminal-Bench 2.0 | 터미널 명령어 워크플로우 | 82.7% | 69.4% | GPT-5.5 |

| Expert-SWE | 장기 프로그래밍(중앙값 20시간) | 73.1% | – | GPT-5.5 |

| OSWorld-Verified | 데스크톱 에이전트 작업 | 78.7% | 78.0% | GPT-5.5(근소) |

| MRCR v2 (512K-1M) | 긴 컨텍스트 8-needle 검색 | 74.0% | 32.2% | GPT-5.5 |

SWE-bench Pro 실전 분석

SWE-bench Pro는 실제 GitHub 이슈 해결 능력을 평가하는 골드 스탠다드입니다. Claude Opus 4.7이 64.3%로 GPT-5.5(58.6%)를 앞서고 있는데, 이는 실제 코드베이스 버그 수정 100건당 Opus 4.7이 약 6건을 더 해결할 수 있다는 의미입니다.

특히 Opus 4.7은 이전 버전인 Opus 4.6(53.4%) 대비 무려 10.9% 포인트나 상승했는데, 이는 단일 버전 업데이트에서 보기 드문 큰 폭의 도약입니다. GitHub 이슈 수정 중심의 워크플로우를 가진 팀이라면 현재로선 Claude Opus 4.7이 최선의 선택입니다.

테스트 제안: 두 모델이 내 코드베이스에서 어떤 성능을 보여줄지 직접 확인하고 싶다면? APIYI(apiyi.com) 플랫폼을 통해 병렬 테스트를 진행해 보세요. 이 플랫폼은 GPT-5.5와 Claude Opus 4.7의 통합 인터페이스 호출을 지원하여 손쉽게 비교할 수 있습니다.

Terminal-Bench 2.0 실전 분석

Terminal-Bench 2.0은 터미널 환경에서 계획, 반복, 도구 조율 등 복잡한 작업을 수행하는 모델의 능력을 테스트합니다. GPT-5.5는 82.7%를 기록하며 Opus 4.7(69.4%)을 13% 포인트 차이로 크게 따돌렸습니다.

이 격차는 GPT-5.5의 에이전트 워크플로우 최적화 덕분입니다. 도구 선택의 정밀함, 다단계 작업 처리의 안정성, 오류 발생 시 복구 능력에서 우위를 점하고 있습니다. 쉘 명령어, 파일 조작, CI/CD 통합 비중이 높은 작업 환경이라면 GPT-5.5가 더 안정적인 선택지입니다.

긴 컨텍스트 검색 능력 격차

MRCR v2의 512K-1M 토큰 범위 8-needle 검색 테스트에서 GPT-5.5는 74.0%, Opus 4.7은 32.2%를 기록하며 무려 41.8% 포인트의 격차를 보였습니다.

즉, 전체 코드 저장소(500K+ 토큰)를 모델이 이해해야 할 때 GPT-5.5의 컨텍스트 기억 정확도가 훨씬 높다는 뜻입니다. '전체 모노레포 기반 리팩토링' 같은 작업 시에는 GPT-5.5가 단순한 우위를 넘어 업무 수행 가능 여부를 결정짓는 핵심 요소가 될 수 있습니다.

GPT-5.5와 Claude Opus 4.7 프로그래밍 실전 추천

벤치마크 데이터는 구체적인 상황에 적용할 때 비로소 의미가 있습니다. 아래 표는 5가지 대표적인 프로그래밍 상황에 대한 명확한 모델 추천입니다.

| 프로그래밍 상황 | 추천 모델 | 핵심 이유 | 기대 효과 |

|---|---|---|---|

| GitHub Issue 해결 | Claude Opus 4.7 | SWE-bench Pro 5.7% 포인트 리드 | 해결 성공률 10% 향상 |

| 대규모 코드베이스 리팩토링 | Claude Opus 4.7 | 파일 간 구조 추론 능력 우수 | 아키텍처 파손 위험 감소 |

| 에이전트(Agentic) 자동화 | GPT-5.5 | Terminal-Bench 13.3% 포인트 리드 | 다단계 작업 안정성 높음 |

| 긴 컨텍스트(>500K) 이해 | GPT-5.5 | MRCR v2 41.8% 포인트 리드 | 깊은 컨텍스트 검색 신뢰도 확보 |

| 인터랙티브 페어 프로그래밍 | Claude Opus 4.7 | TTFT 0.5초로 빠른 응답 | 원활한 코딩 흐름 유지 |

| 대량 코드 생성 | GPT-5.5 | 토큰 효율 72% 향상, 비용 절감 | 종합 비용 효율성 우수 |

상황 1: 실제 GitHub Issue 해결 → Claude Opus 4.7 추천

"Issue 설명을 바탕으로 AI가 바로 병합 가능한 PR을 작성하게 만드는 것"이 핵심 목표라면, Claude Opus 4.7이 단연 최고의 선택입니다. SWE-bench Verified에서 87.6%를 기록했다는 것은 잘 정의된 버그 수정 작업의 90% 가까이를 바로 처리할 수 있음을 의미합니다.

주의할 점은 87.6%의 수치가 곧바로 전체 엔지니어링 작업의 자동화율을 뜻하는 것은 아니라는 점입니다. 이는 '완벽한 과제 명세'를 가정한 이상적인 테스트 결과이며, 실제 업무 흐름에서는 Issue 설명의 품질이 성공률에 큰 영향을 미칩니다.

상황 2: 긴 컨텍스트 코드 이해 → GPT-5.5 추천

전체 모노레포(보통 500K~1M 토큰)를 읽고 의사결정을 내려야 할 때, GPT-5.5는 현재 유일하게 신뢰할 수 있는 선택지입니다. Opus 4.7은 1M 컨텍스트 구간에서의 8-needle 검색 정확도가 32.2%에 불과하여, 코드 베이스 깊숙한 곳의 핵심 정의를 놓칠 가능성이 큽니다.

이 격차는 아키텍처 수준의 차이입니다. 전체 코드베이스 뷰에 의존하는 워크플로우(예: 전역 이름 변경, API 호환성 검사)라면 Opus 4.7로는 원활한 진행이 어려울 수 있습니다.

상황 3: 에이전트(Agentic) 프로그래밍 워크플로우 → GPT-5.5 추천

에이전트 프로그래밍은 AI가 스스로 계획을 세우고 도구를 호출하며 반복 수정하는 워크플로우를 의미합니다. GPT-5.5는 Terminal-Bench 2.0에서 82.7%를 기록하며 Opus 4.7을 크게 앞섰으며, 특히 다음 작업들에서 매우 안정적입니다.

- 자동화 배포 스크립트 작성 및 실행

- 다중 서비스 디버깅 및 로그 분석

- CI/CD 파이프라인 문제 해결

- 데이터 파이프라인 구축 및 모니터링

통합 제안: 에이전트 프로그래밍 워크플로우를 구축할 때는 APIYI(apiyi.com)와 같은 통합 플랫폼을 통해 GPT-5.5를 호출하는 것을 추천합니다. API 키 관리, 호출 비용 모니터링, 필요 시 예비 모델 전환이 한결 간편해집니다.

상황 4: 인터랙티브 페어 프로그래밍 → Claude Opus 4.7 추천

인터랙티브 코딩 환경은 지연 시간에 매우 민감합니다. Opus 4.7의 TTFT(첫 토큰 생성 시간)는 약 0.5초로, GPT-5.5의 3초에 비해 6배 빠릅니다. 이 차이는 반복적인 상호작용 상황에서 매우 크게 느껴집니다.

Cursor, Claude Code, Continue 같은 IDE 통합 도구를 사용하여 잦은 코드补全(자동 완성)을 수행한다면, Opus 4.7의 낮은 지연 시간이 훨씬 더 매끄러운 코딩 경험을 제공할 것입니다.

GPT-5.5와 Claude Opus 4.7 API 호출 예제

두 모델을 빠르게 테스트해 볼 수 있도록 초간단 호출 예제를 준비했습니다. 두 모델 모두 OpenAI SDK 형식과 호환되므로 마이그레이션 부담이 거의 없습니다.

GPT-5.5 초간단 호출

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.5",

messages=[{"role": "user", "content": "Python으로 퀵 정렬 구현해 줘"}]

)

print(response.choices[0].message.content)

Claude Opus 4.7 초간단 호출

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="claude-opus-4-7",

messages=[{"role": "user", "content": "Python으로 퀵 정렬 구현해 줘"}]

)

print(response.choices[0].message.content)

두 모델 병렬 비교 테스트 코드 확인하기

import openai

import time

from typing import Dict

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

def benchmark_model(model: str, prompt: str) -> Dict:

"""단일 모델의 응답 시간과 출력 길이를 테스트합니다"""

start = time.time()

response = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}],

max_tokens=2000

)

elapsed = time.time() - start

return {

"model": model,

"elapsed_seconds": round(elapsed, 2),

"output_tokens": response.usage.completion_tokens,

"content_preview": response.choices[0].message.content[:200]

}

# 프로그래밍 능력 비교 테스트

test_prompt = """

Python으로 LRU 캐시 클래스를 구현해 주세요. 조건:

1. get(key) 및 put(key, value) 메서드 지원

2. 용량이 꽉 차면 가장 오래된 항목을 자동으로 제거

3. 모든 작업의 시간 복잡도는 O(1)이어야 함

4. 완전한 단위 테스트 포함

"""

# 두 모델 병렬 테스트

gpt_result = benchmark_model("gpt-5.5", test_prompt)

claude_result = benchmark_model("claude-opus-4-7", test_prompt)

print(f"GPT-5.5: {gpt_result['elapsed_seconds']}s, {gpt_result['output_tokens']} tokens")

print(f"Claude Opus 4.7: {claude_result['elapsed_seconds']}s, {claude_result['output_tokens']} tokens")

테스트 권장: APIYI(apiyi.com)에서 무료 테스트 크레딧을 받아보세요. 동일한 계정 내에서 통합된 base_url과 API 키를 사용해 OpenAI나 Anthropic 계정을 따로 신청할 필요 없이 GPT-5.5와 Claude Opus 4.7을 병렬로 테스트할 수 있습니다.

GPT-5.5와 Claude Opus 4.7 종합 비용 분석

API 가격 책정은 모델 선정 시 반드시 고려해야 할 핵심 지표입니다. 겉보기에는 Opus 4.7의 출력 토큰 단가가 17% 저렴해 보이지만, 종합적으로 분석하면 결과는 달라집니다.

| 비용 차원 | GPT-5.5 | Claude Opus 4.7 | 실제 영향 |

|---|---|---|---|

| 입력 단가 | $5/M tokens | $5/M tokens | 동일 |

| 출력 단가 | $30/M tokens | $25/M tokens | Opus가 17% 저렴 |

| >200K 프롬프트 | 기존 가격 유지 | 2배 상승($10/$37.50) | 긴 컨텍스트는 GPT 유리 |

| 동일 작업 출력 토큰 | 100% 기준 | GPT 대비 72% 더 많음 | GPT가 종합적으로 저렴 |

| TTFT 지연 시간 | ~3초 | ~0.5초 | Opus 경험 우수 |

| 대량 작업 실제 비용 | 1.0x 기준 | 1.4-1.5x 기준 | GPT가 비용 효율적 |

비용 비교의 핵심 발견

토큰 효율성이 가격 비교의 본질을 바꿉니다. 동일한 프로그래밍 작업에서 GPT-5.5는 Opus 4.7보다 평균적으로 72% 적은 출력 토큰을 사용합니다. Opus의 단가가 17% 저렴하더라도, 1.72배에 달하는 토큰 사용량을 곱하면 실제 작업 비용은 GPT-5.5가 훨씬 낮습니다.

긴 컨텍스트 환경에서는 격차가 더 벌어집니다. 프롬프트가 200K 토큰을 초과할 경우, Opus 4.7의 입력 및 출력 가격은 각각 $10와 $37.50으로 2배 상승하지만, GPT-5.5는 기존 가격을 유지합니다. 전체 모노레포 분석과 같이 긴 컨텍스트 이해가 필요한 워크플로우에서는 GPT-5.5의 비용 이점이 2~3배까지 커질 수 있습니다.

요약 및 해석

Claude Opus 4.7의 비용 특징: 토큰당 가격은 메이저 모델 중 경쟁력이 있습니다. 하지만 대량 생성 작업 시 높은 토큰 소비량이 총비용을 끌어올리며, 200K를 초과하는 긴 컨텍스트 환경에서는 가격이 2배로 뛰어 예산 압박이 커집니다.

GPT-5.5의 비용 특징: 토큰당 단가는 약간 높지만, 뛰어난 토큰 효율성과 긴 컨텍스트 시 추가 비용이 없다는 점 덕분에 대규모 및 장문 컨텍스트 환경에서 종합적인 비용 경쟁력이 높습니다. OpenAI는 가격 설계 단계에서부터 에이전트 기반 워크플로우의 비용 구조를 고려한 것으로 보입니다.

비용 측정 권장: 실제 프로젝트 비용은 프롬프트 길이, 출력 길이, 호출 빈도 등 여러 요인에 따라 달라집니다. APIYI(apiyi.com) 플랫폼을 통해 두 모델을 연동하여 세부적인 호출 내역과 비용을 확인한 후 데이터 기반의 의사결정을 내리는 것을 권장합니다.

자주 묻는 질문 FAQ

Q1: GPT-5.5와 Claude Opus 4.7 중 어떤 것이 프로그래밍 능력이 더 뛰어난가요?

절대적인 "더 뛰어난" 모델은 없으며, 수행하는 작업에 따라 다릅니다. Claude Opus 4.7은 SWE-bench Pro(64.3% 대 58.6%) 및 Verified(87.6%)에서 앞서 있어, 실제 GitHub 이슈 수정이나 대규모 코드베이스 리팩토링에 적합합니다. 반면 GPT-5.5는 Terminal-Bench 2.0(82.7% 대 69.4%)과 긴 컨텍스트 윈도우 검색(74.0% 대 32.2%)에서 우위를 점하고 있어, 에이전트 기반 프로그래밍 워크플로우나 모노레포 전체를 아우르는 코드 이해 작업에 더 강점을 보입니다.

Q2: GPT-5.5와 Claude Opus 4.7의 API 가격 차이는 무엇인가요?

두 모델 모두 입력 토큰은 1M당 $5입니다. 출력 토큰의 경우 Opus 4.7($25/M)이 GPT-5.5($30/M)보다 17% 저렴합니다. 하지만 Opus 4.7은 프롬프트가 200K를 초과하면 가격이 두 배로 뛰는 반면, GPT-5.5는 동일 가격을 유지합니다. 또한 GPT-5.5의 출력 토큰 소모량이 Opus보다 72% 적다는 점을 고려하면, 대량 작업을 처리할 때 GPT-5.5의 종합 비용 효율이 더 좋습니다.

Q3: GPT-5.5와 Claude Opus 4.7은 언제 출시되었나요?

Claude Opus 4.7은 Anthropic이 2026년 4월 16일에 발표했으며, 현재 Claude API, Amazon Bedrock, Google Cloud Vertex AI, Microsoft Foundry에서 모두 이용 가능합니다. GPT-5.5(내부 코드명: Spud)는 OpenAI가 2026년 4월 23일에 발표했습니다. 업계 최고의 프로그래밍 모델 두 종이 단 7일 차이로 등장하며 치열한 경쟁을 예고했습니다.

Q4: 어떤 프로그래밍 상황에서 Claude Opus 4.7을 선택해야 하나요?

다음과 같은 상황에서는 Opus 4.7을 우선적으로 추천합니다:

- GitHub 이슈 수정: SWE-bench Pro에서 5.7% 포인트 앞선 성능

- 대규모 코드베이스 리팩토링: 파일 간 아키텍처 추론 능력 우수

- 대화형 페어 프로그래밍: TTFT가 0.5초로 응답 속도가 6배 빠름

- 코드 품질 검토: Rakuten-SWE-Bench 측정 결과 코드 품질 점수가 더 높음

Q5: API를 통해 GPT-5.5와 Claude Opus 4.7을 빠르게 호출하는 방법은 무엇인가요?

두 모델을 모두 지원하는 API 중계 서비스 플랫폼을 활용해 테스트하는 것을 추천합니다:

- APIYI(apiyi.com)에 접속하여 계정을 생성합니다.

- 통합 API 키와 무료 테스트 크레딧을 받습니다.

- 본문의 예제 코드에서

base_url을https://vip.apiyi.com/v1으로 변경하고,model파라미터에 각각gpt-5.5또는claude-opus-4-7을 지정하여 호출하세요.

APIYI는 OpenAI, Anthropic, Google 등 주요 모델의 표준화된 인터페이스를 제공하므로, 번거로운 계정 신청 절차 없이도 GPT-5.5와 Claude Opus 4.7의 성능을 즉시 비교해 볼 수 있습니다.

Q6: GPT-5.5와 Claude Opus 4.7의 알려진 한계점은 무엇인가요?

GPT-5.5 한계:

- TTFT 지연 시간이 약 3초로, 실시간 대화형 시나리오에서는 다소 느리게 느껴질 수 있음

- 실제 GitHub 이슈 수정 작업에서 Opus 4.7에 비해 다소 부족함

Claude Opus 4.7 한계:

- 긴 컨텍스트 윈도우 검색 능력이 다소 취약함(1M 범위 기준 32.2%)

- 프롬프트가 200K를 넘을 경우 비용이 두 배가 되어 긴 컨텍스트 처리 시 부담이 큼

- 출력 토큰 소모량이 많아 대량 작업 시 종합 비용이 높음

- Terminal-Bench 등 에이전트 관련 작업 수행 능력이 GPT-5.5에 비해 낮음

Q7: GPT-5.5와 Claude Opus 4.7을 동시에 사용하는 것이 좋을까요?

전문 개발 팀이라면 두 모델을 함께 사용하는 것을 강력히 추천합니다. 추천하는 업무 분담 전략은 다음과 같습니다. GitHub 이슈 수정, 코드 리뷰, 핵심 아키텍처 결정에는 Opus 4.7을 사용하고, 긴 컨텍스트 분석, 에이전트 기반 자동화 워크플로우, 대량의 코드 생성 작업에는 GPT-5.5를 사용해 보세요. 이렇게 혼용하면 각 모델의 장점을 살리면서 비용과 성능 사이에서 최적의 균형을 찾을 수 있습니다.

GPT-5.5와 Claude Opus 4.7 핵심 요약

- 실제 이슈 수정엔 Opus: Claude Opus 4.7은 SWE-bench Pro와 Verified에서 모두 앞서며, 실제 GitHub 이슈 해결에 최적입니다.

- 에이전트 프로그래밍엔 GPT: GPT-5.5는 Terminal-Bench 2.0에서 13% 포인트 앞서며, 복합적인 도구 호출 작업에서 더 안정적입니다.

- 긴 컨텍스트엔 GPT: MRCR v2 테스트에서 GPT-5.5(74%)가 Opus(32.2%)를 압도하며, 1M 컨텍스트 처리에 가장 신뢰할 수 있습니다.

- 응답 속도가 중요하다면 Opus: Opus의 TTFT는 0.5초로, GPT보다 6배 빨라 대화형 코딩 경험이 훨씬 매끄럽습니다.

- 비용 효율을 중시한다면 GPT: GPT-5.5의 출력 토큰 소모량이 Opus보다 72% 적어, 전반적인 작업 비용이 더 낮습니다.

- 빠른 병렬 테스트: APIYI(apiyi.com) 계정 하나로 두 모델을 통합 호출하여 실제 환경에서 간편하게 비교해 보세요.

요약

GPT-5.5와 Claude Opus 4.7의 프로그래밍 능력 비교에 대한 핵심 결론입니다.

- 절대적인 1위는 없습니다: 두 모델은 각자 확실한 강점을 가진 분야가 있으므로, 무조건 "최고의 모델" 하나만 고집하는 것은 잘못된 접근 방식입니다.

- 작업 중심의 모델 선정: 이슈 해결, 에이전트(Agentic) 작업, 긴 컨텍스트 처리, 대화형 코딩 등 본인의 핵심 프로그래밍 시나리오를 먼저 정의한 뒤 주력 모델을 결정하세요.

- 듀얼 모델 활용 권장: 전문 개발 팀이라면 두 모델을 모두 연결해 상황에 따라 최적의 모델로 라우팅하는 방식을 통해 생산성을 극대화하는 것이 좋습니다.

만약 하나만 선택해야 한다면, GitHub 이슈 해결 및 코드 리뷰가 주 업무라면 Claude Opus 4.7을, 에이전트 기반 자동화나 긴 코드 분석이 주 업무라면 GPT-5.5를 추천합니다.

APIYI(apiyi.com)를 통해 빠르게 모델을 테스트해보세요. 해당 플랫폼은 GPT-5.5와 Claude Opus 4.7의 통합 API를 제공하며, 무료 테스트 크레딧과 상세한 비용 내역을 지원하므로 데이터 기반의 의사결정을 내리기에 가장 편리한 경로입니다.

관련 읽을거리 (Related Articles)

GPT-5.5와 Claude Opus 4.7의 프로그래밍 능력 비교에 관심이 있다면 다음 콘텐츠를 계속해서 읽어보시는 것을 추천합니다.

- 📘 Claude Opus 4.7 심층 분석: SWE-bench 87.6%를 달성한 엔지니어링 역량 – Opus 4.7의 성능 원천을 심층 분석합니다.

- 📊 GPT-5.5 Spud 실전 가이드: 에이전트 프로그래밍의 새로운 강자를 활용하는 8가지 팁 – GPT-5.5의 고급 활용법을 익혀보세요.

- 🚀 2026 AI 프로그래밍 모델 선정 가이드: GPT부터 Claude까지 전체 비교 – 더 거시적인 관점의 모델 선정 방법론을 탐구합니다.

📚 참고 자료

-

OpenAI 공식 GPT-5.5 소개: 핵심 벤치마크 및 능력 설명

- 링크:

openai.com/index/introducing-gpt-5-5 - 설명: SWE-bench, Terminal-Bench 등 핵심 벤치마크를 포함한 GPT-5.5 공식 발표 문서

- 링크:

-

Anthropic 공식 Claude Opus 4.7 출시 안내: 모델 포지셔닝 및 성능 데이터

- 링크:

anthropic.com/news/claude-opus-4-7 - 설명: SWE-bench Verified/Pro 상세 데이터를 포함한 Opus 4.7 공식 출시 문서

- 링크:

-

SWE-Bench Pro 공개 리더보드: 제3자 독립 검증

- 링크:

labs.scale.com/leaderboard/swe_bench_pro_public - 설명: Scale AI가 운영하는 SWE-Bench Pro 공개 리더보드로, 두 모델의 실제 순위를 확인할 수 있습니다.

- 링크:

-

Vellum LLM 리더보드 2026: 종합 AI 모델 비교

- 링크:

vellum.ai/llm-leaderboard - 설명: 프로그래밍, 추론, 긴 컨텍스트 윈도우 등 다각적인 측면을 아우르는 종합 비교 플랫폼입니다.

- 링크:

-

Artificial Analysis 모델 비교: 성능 및 비용 분석

- 링크:

artificialanalysis.ai/models/comparisons/gpt-5-5-vs-claude-opus-4-7-non-reasoning - 설명: TTFT, 처리량(Throughput), 종합 비용에 대한 세밀한 비교 데이터를 제공합니다.

- 링크:

저자: APIYI 기술팀

기술 교류: 댓글로 자유롭게 의견을 나누어 주세요. 더 많은 자료는 APIYI 문서 센터(docs.apiyi.com)에서 확인하실 수 있습니다.