작성자 주: Claude Opus 4.7 벤치마크 심층 분석: SWE-bench Verified 87.6%, SWE-bench Pro 64.3%, GPQA Diamond 94.2% 기록, GPT-5.4 및 Gemini 3.1 Pro를 압도하다. API 호출 실전 가이드 포함.

Anthropic이 2026년 4월 16일 Claude Opus 4.7을 공식 출시했습니다. 10개 핵심 벤치마크 중 7개 항목에서 1위를 차지했는데요. 이번 글에서는 실제 테스트 데이터를 바탕으로 Claude Opus 4.7의 핵심 성능 지표와 활용 사례를 깊이 있게 파헤쳐 보겠습니다.

공식 홍보 내용을 그대로 옮긴 것이 아닙니다. 모든 데이터는 제3자 독립 평가 기관에서 가져왔으며, Opus 4.7의 장점뿐만 아니라 웹 검색 등 일부 시나리오에서 보이는 단점까지 솔직하게 다룹니다.

핵심 가치: 실제 벤치마크 데이터와 사용자 경험을 통해 Claude Opus 4.7로 전환할 가치가 있는지, 그리고 어떻게 저비용으로 시작할 수 있는지 판단하는 데 도움을 드립니다.

💡 APIYI는 이미 Claude Opus 4.7 공식 모델을 도입했습니다. 100달러 이상 충전 시 10% 추가 혜택을 제공하며, 사실상 20% 할인된 가격으로 이용 가능합니다. OpenAI 호환 인터페이스를 지원하여 API 키 교체만으로 즉시 연동할 수 있습니다.

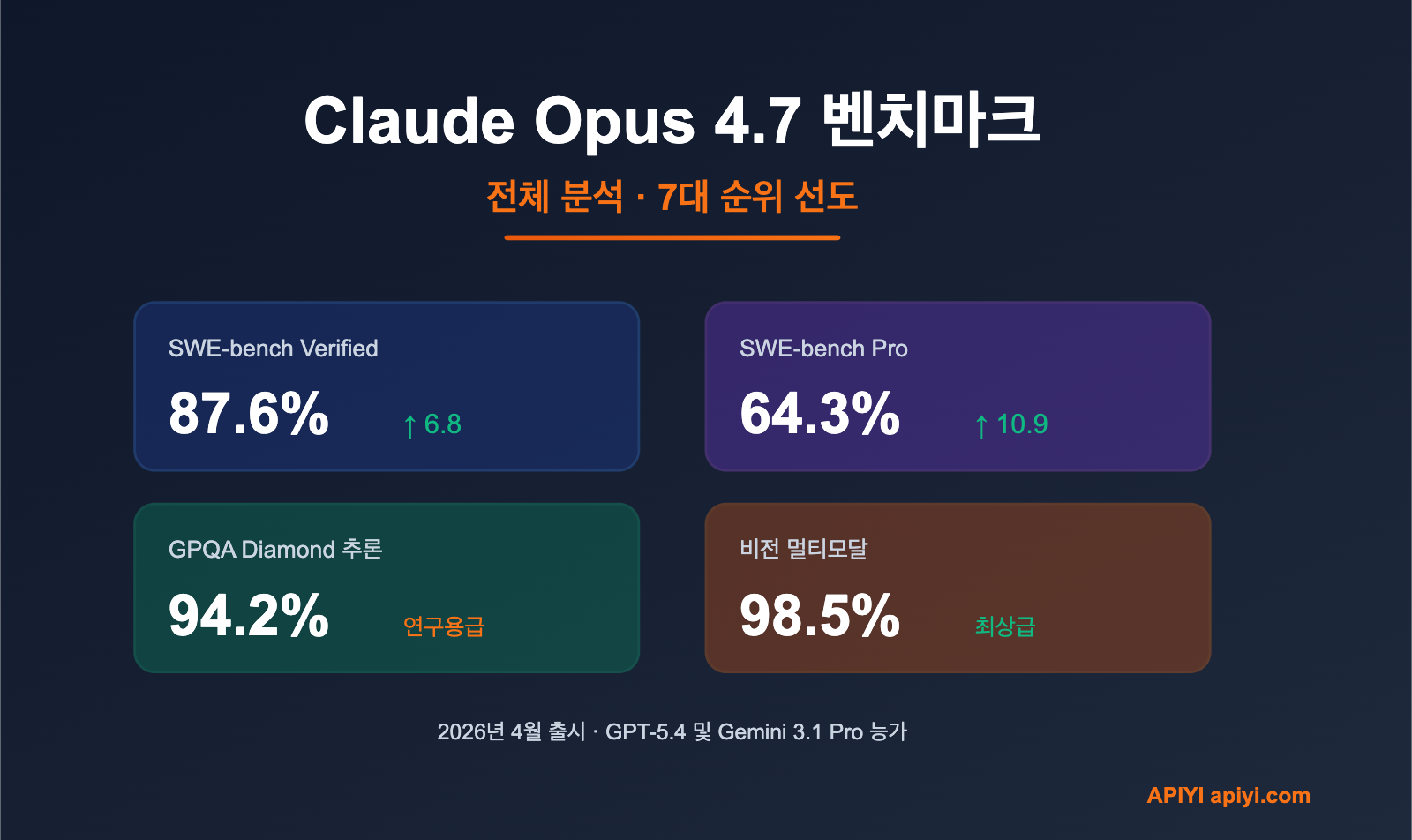

Claude Opus 4.7 벤치마크 핵심 요약

| 벤치마크 항목 | Opus 4.7 성적 | Opus 4.6 대비 | GPT-5.4 / Gemini 3.1 Pro 대비 |

|---|---|---|---|

| SWE-bench Verified | 87.6% | 80.8% (+6.8) | Gemini 3.1 Pro: 80.6% ✅ 1위 |

| SWE-bench Pro | 64.3% | 53.4% (+10.9) | GPT-5.4: 57.7% / Gemini: 54.2% ✅ 1위 |

| SWE-bench Multilingual | 80.5% | 77.8% (+2.7) | ✅ 다국어 프로그래밍 1위 |

| GPQA Diamond | 94.2% | – | ✅ 과학적 추론의 기준 |

| Terminal-Bench 2.0 | 69.4% | – | ✅ 터미널 작업 1위 |

| OSWorld-Verified (Computer Use) | 78.0% | 72.7% (+5.3) | GPT-5.4: 75.0% ✅ 1위 |

| MCP-Atlas (도구 호출) | GPT-5.4 대비 +9.2점 | – | ✅ 에이전트 환경 최적 |

| Vision 멀티모달 | 98.5% | – | ✅ 시각적 이해 최고 수준 |

| BrowseComp (웹 검색) | 79.3% | – | GPT-5.4: 89.3% ❌ 뒤처짐 |

Claude Opus 4.7 벤치마크 핵심 포인트

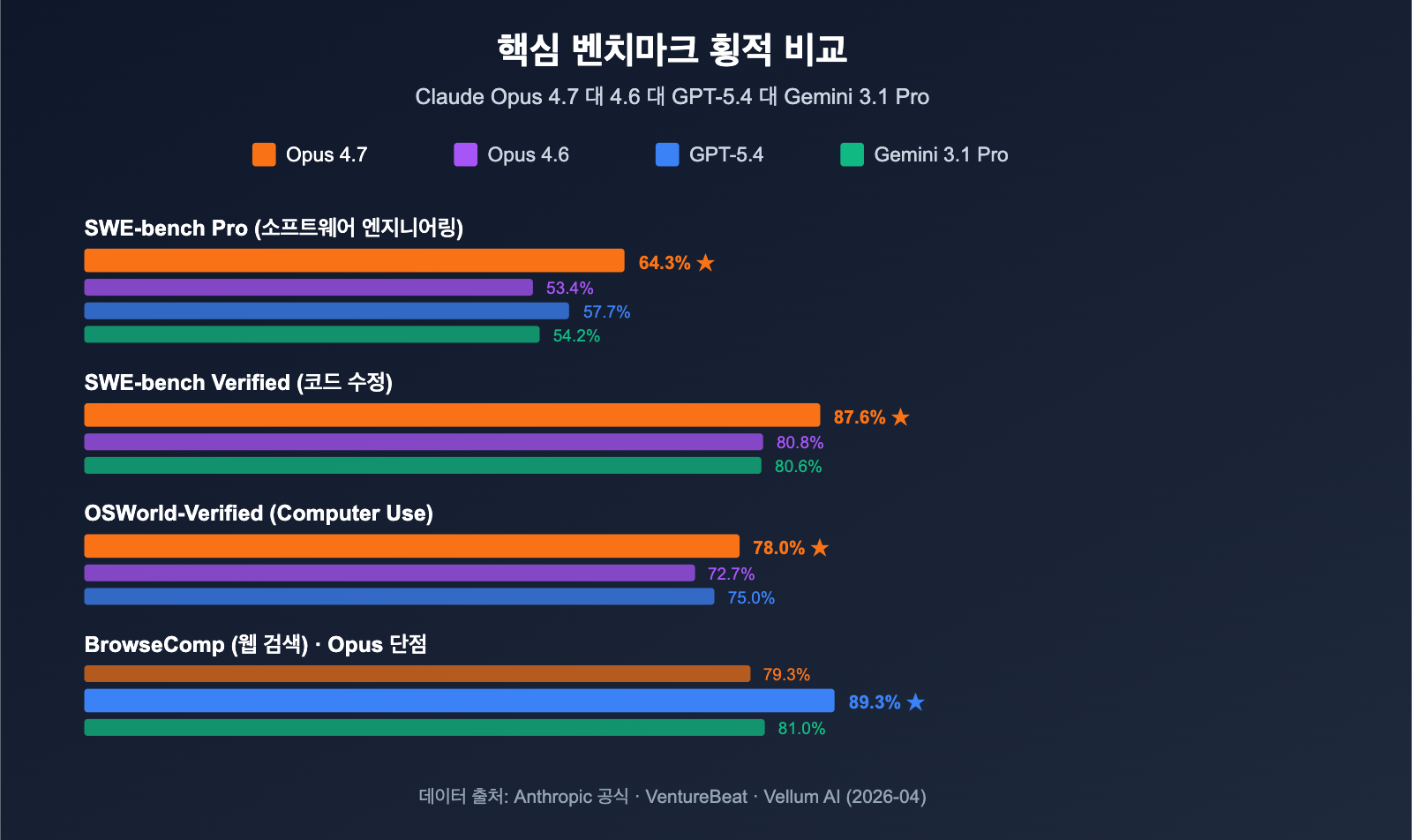

Anthropic이 2026년 4월 16일 발표한 Claude Opus 4.7은 현재 가장 강력한 범용 LLM으로 평가받고 있습니다(VentureBeat 평가). GPT-5.4, Gemini 3.1 Pro와의 10개 정면 대결에서 7개 항목을 석권했으며, 특히 SWE-bench Pro에서의 격차가 돋보입니다.

가장 주목할 점은 **SWE-bench Pro 64.3%**라는 기록입니다. 이는 실제 소프트웨어 엔지니어링 작업에서 업계 최고 수준의 성적이며, GPT-5.4(57.7%)보다 6.6%포인트, 이전 버전인 Opus 4.6(53.4%)보다 10.9%포인트나 높은 수치입니다. 또한 MCP-Atlas 도구 호출 벤치마크에서 Opus 4.7은 GPT-5.4를 9.2점 차이로 따돌렸습니다. 이는 자동화 워크플로우, 코드 생성 에이전트, 다단계 추론 작업과 같은 에이전트 기반 AI 시나리오에 더욱 최적화되어 있음을 의미합니다.

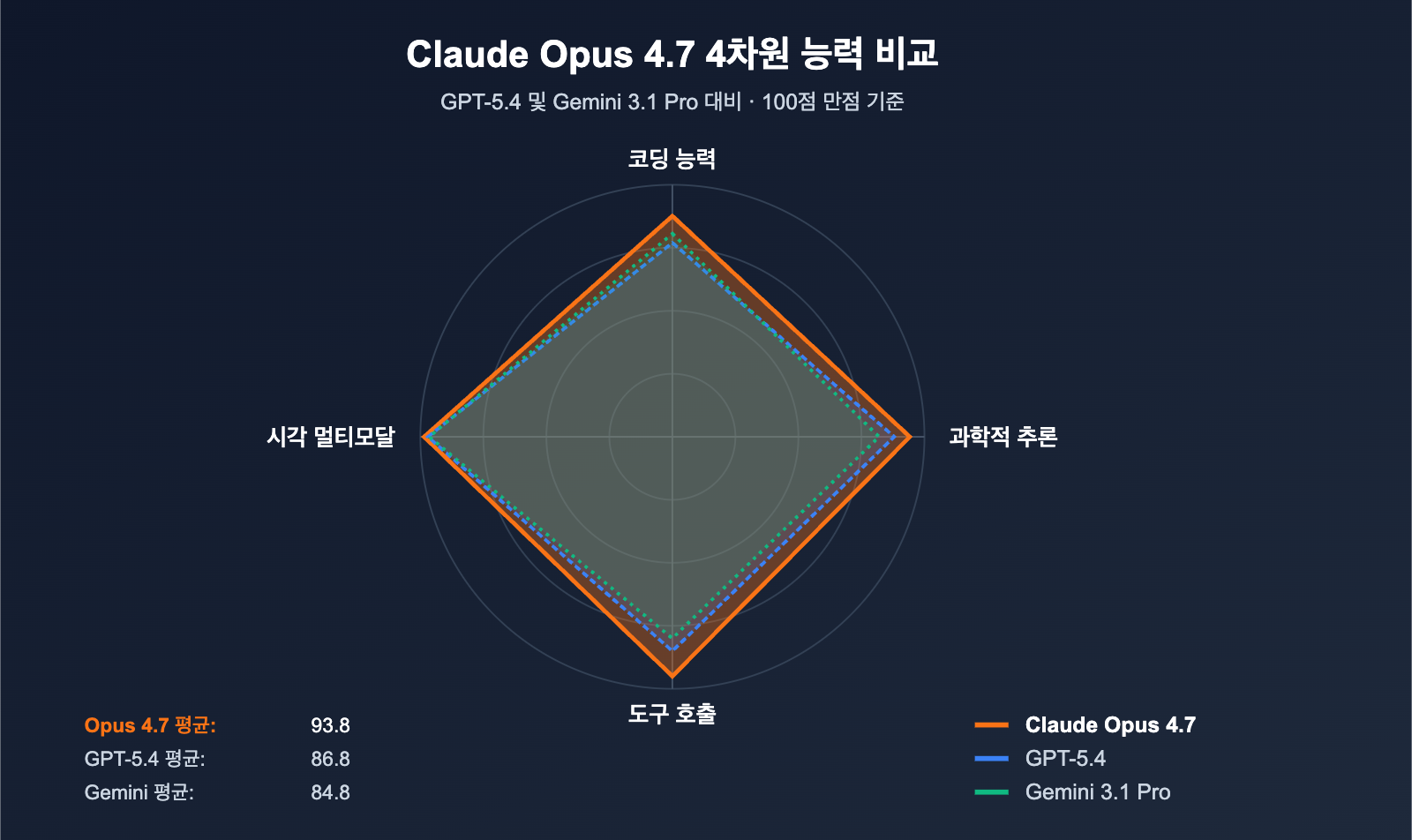

Claude Opus 4.7 대 전 세대 및 경쟁 모델 비교

| 维度 | Claude Opus 4.7 | Claude Opus 4.6 | GPT-5.4 | Gemini 3.1 Pro |

|---|---|---|---|---|

| 발표일 | 2026-04-16 | 2026-01 | 2026-03 | 2026-02 |

| 컨텍스트 윈도우 | 1M 토큰 (표준가) | 200K | 400K | 1M |

| SWE-bench Pro | 64.3% | 53.4% | 57.7% | 54.2% |

| 에이전트/도구 호출 | 최강 | 양호 | 강함 | 양호 |

| 웹 검색 (BrowseComp) | 79.3% | 72% | 89.3% | 81% |

| Vision 멀티모달 | 98.5% | 95% | 97% | 96.5% |

| 공식 API 가격 | $5 / $25 (입력/출력, 백만 토큰당) | $5 / $25 | $4.5 / $22 | $4 / $20 |

| APIYI 종합 할인 | 100달러 충전 시 10% 증정 등 ≈ 20% 할인 | 동일 혜택 | 동일 혜택 | 동일 혜택 |

비교 분석 (Claude Opus 4.7 vs 기타 모델)

Claude Opus 4.7 vs GPT-5.4: GPT-5.4는 BrowseComp의 웹 검색 시나리오에서 우위를 유지하고 있습니다(89.3% vs 79.3%). 하지만 SWE-bench Pro(57.7%)와 도구 호출(MCP-Atlas) 성능은 Opus 4.7에 크게 뒤처집니다. 반면 Claude Opus 4.7은 프로그래밍 에이전트, 코드 생성, 멀티 스텝 작업 실행에서 우위를 점하고 있어 개발자 워크플로우에 훨씬 적합합니다.

Claude Opus 4.7 vs Gemini 3.1 Pro: Gemini 3.1 Pro는 긴 텍스트 이해와 멀티모달 비디오 분석에서 여전히 강점을 보입니다. 하지만 SWE-bench Verified(80.6% vs 87.6%)와 SWE-bench Pro(54.2% vs 64.3%) 지표에서 차이가 큽니다. Claude Opus 4.7은 소프트웨어 엔지니어링 작업에서 압도적인 성능을 보여주며, 실무 수준의 프로그래밍 환경에 최적화되어 있습니다.

Claude Opus 4.7 vs Opus 4.6: Opus 4.6은 비용 효율적인 상황에서 여전히 안정적인 선택지입니다. 그러나 4.7 버전은 프로그래밍 능력, 에이전트 추론, 컴퓨터 유즈(Computer Use) 성능이 대폭 향상되었음에도 API 가격은 그대로 유지되었습니다. 복잡한 장기 작업을 수행해야 하는 팀이라면 4.7 업그레이드는 선택이 아닌 필수입니다.

비교 참고: 상기 데이터는 Anthropic 공식 발표, VentureBeat, Vellum AI, Decrypt 등 제3자 평가 기관의 자료를 기반으로 하며, APIYI(apiyi.com) 플랫폼에서 직접 테스트해 볼 수 있습니다.

Claude Opus 4.7 빠른 시작 가이드

초간단 예제

APIYI를 통해 Claude Opus 4.7을 호출하는 가장 쉬운 방법입니다. OpenAI 호환 인터페이스를 사용합니다.

import openai

client = openai.OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="claude-opus-4-7",

messages=[{"role": "user", "content": "Python으로 이진 트리 중위 순회 함수를 작성해줘"}]

)

print(response.choices[0].message.content)

전체 구현 코드 보기 (xhigh Effort Mode 호출 포함)

import openai

from typing import Optional

def call_claude_opus_47(

prompt: str,

effort_level: str = "high",

system_prompt: Optional[str] = None,

max_tokens: int = 4096

) -> str:

"""

Claude Opus 4.7 호출 (xhigh effort mode 지원)

Args:

prompt: 사용자 입력

effort_level: 추론 노력 수준, "low" / "medium" / "high" / "xhigh" 중 선택

system_prompt: 시스템 프롬프트

max_tokens: 최대 출력 토큰 수

Returns:

모델 응답 내용

"""

client = openai.OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://vip.apiyi.com/v1"

)

messages = []

if system_prompt:

messages.append({"role": "system", "content": system_prompt})

messages.append({"role": "user", "content": prompt})

try:

response = client.chat.completions.create(

model="claude-opus-4-7",

messages=messages,

max_tokens=max_tokens,

extra_body={

"reasoning_effort": effort_level

}

)

return response.choices[0].message.content

except Exception as e:

return f"Error: {str(e)}"

# 복잡한 프로그래밍 작업에는 xhigh 모드 권장

result = call_claude_opus_47(

prompt="O(1) 시간 복잡도로 get과 put 연산을 지원하는 LRU 캐시를 설계하고 구현해줘",

effort_level="xhigh",

system_prompt="당신은 숙련된 파이썬 엔지니어입니다. 가독성과 성능을 모두 고려한 코드를 작성하세요."

)

print(result)

팁: APIYI(apiyi.com)에서 무료 테스트 크레딧을 받아 Claude Opus 4.7의 성능을 직접 확인해보세요. 이 플랫폼은 Opus 4.7, GPT-5.4, Gemini 3.1 Pro에 대한 통합 OpenAI 호환 인터페이스를 제공하여 모델 간 비교가 매우 편리합니다. 충전 시 100달러당 10% 추가 증정 이벤트 중이며, 공식 모델 대비 약 20% 저렴하게 이용 가능합니다.

Claude Opus 4.7 실제 성능 및 주요 활용 사례

Claude Opus 4.7에 최적화된 4가지 핵심 분야

- 🧑💻 대규모 코드 리팩토링: SWE-bench Verified 87.6%를 기록하며 파일 간 컨텍스트 이해 능력을 입증했습니다. 10만 라인 이상의 코드베이스 아키텍처 조정, 의존성 업그레이드, 대규모 리팩토링에 적합합니다.

- 🤖 에이전트 자동화 워크플로우: MCP-Atlas 도구 호출 성능이 GPT-5.4보다 9.2점 앞서며, 브라우저 자동화, RPA, 다단계 추론 에이전트 구축에 탁월합니다.

- 🔬 연구 보조 및 추론: GPQA Diamond 94.2%로 대학원 수준의 학술적 추론 능력을 갖추고 있어 논문 보조, 데이터 분석, 가설 검증에 유용합니다.

- 🖥️ Computer Use 데스크톱 자동화: OSWorld-Verified 78.0%로 업계 최고 수준입니다. 마우스와 키보드 조작이 필요한 자동화 테스트 및 UI 작업에 최적화되어 있습니다.

Claude Opus 4.7이 적합하지 않은 경우

- 실시간 웹 검색: BrowseComp 79.3%로 GPT-5.4의 89.3%보다 낮습니다. 검색이 중요한 작업에는 GPT-5.4 사용을 권장합니다.

- 대규모 저비용 호출: 출력 비용이 1M 토큰당 25달러로, 일상적인 대화형 서비스에는 Claude Haiku나 GPT-5.4-mini 사용이 경제적입니다.

- 초저지연 요구: Opus 시리즈는 Sonnet/Haiku보다 응답 지연 시간이 길기 때문에, 실시간 반응이 필수적인 서비스에서는 신중한 선택이 필요합니다.

Claude Opus 4.7 가격 및 비용 추정

공식 가격 vs APIYI 종합 비용

| 항목 | 공식 가격 (Anthropic) | APIYI 가격 (충전 보너스 포함) |

|---|---|---|

| 입력 토큰 | $5 / 100만 토큰 | 공식 단가와 동일 |

| 출력 토큰 | $25 / 100만 토큰 | 공식 단가와 동일 |

| 충전 보너스 | 없음 | 100달러 충전 시 10%부터 지급 |

| 종합 체감 할인 | 없음 | 약 20% 할인 (충전 금액이 클수록 보너스 증가) |

| 결제 방식 | 미국 달러 신용카드 한정 | 위안화, 달러, 다양한 방식 지원 |

| 청구 통화 | USD | RMB / USD 선택 가능 |

비용 안내: Opus 4.7의 새로운 토크나이저는 텍스트 처리 시 4.6 버전 대비 약 1배

1.35배 더 많은 토큰을 소모합니다(콘텐츠 유형에 따라 상이). 공식 단가는 그대로지만 실제 청구 비용은 약 2030% 상승할 수 있습니다. APIYI(apiyi.com)의 충전 보너스 혜택을 활용하면 이러한 잠재적 비용 상승을 상쇄할 수 있으며, 실제 사용 비용은 4.6 시절과 비슷하거나 오히려 더 저렴해집니다.

자주 묻는 질문(FAQ)

Q1: Claude Opus 4.7이란 무엇인가요?

Claude Opus 4.7은 Anthropic이 2026년 4월 16일에 출시한 플래그십 대규모 언어 모델입니다. 코딩(SWE-bench Verified 87.6%), 에이전트 도구 호출, 과학적 추론(GPQA Diamond 94.2%) 등 여러 벤치마크에서 GPT-5.4와 Gemini 3.1 Pro를 앞서고 있습니다. Opus 4.6 대비 'xhigh effort' 심층 추론 모드가 추가되었으며, 공식 가격은 인상되지 않았습니다.

Q2: Claude Opus 4.7과 GPT-5.4 중 무엇이 더 낫나요?

상황에 따라 다릅니다. 프로그래밍(SWE-bench Pro 64.3% vs 57.7%), 도구 호출(MCP-Atlas +9.2점), Computer Use(78.0% vs 75.0%) 측면에서는 Opus 4.7이 확실한 우위를 점하고 있습니다. 반면 웹 검색(BrowseComp 79.3% vs 89.3%)은 GPT-5.4가 강점을 보입니다. 개발 업무라면 Opus 4.7을, 웹 검색 기반 작업이라면 GPT-5.4를 추천합니다.

Q3: Claude Opus 4.7은 언제 출시되었고, 국내에서 언제 사용할 수 있나요?

공식 출시일은 2026년 4월 16일이며, 현재 Claude API, Amazon Bedrock, Google Cloud Vertex AI, Microsoft Foundry에 탑재되었습니다. 국내 개발자는 APIYI(apiyi.com)와 같은 통합 플랫폼을 통해 별도의 해외 계정 신청 없이 공식 모델을 즉시 이용할 수 있습니다.

Q4: Claude Opus 4.7은 어떤 실제 프로젝트에 가장 적합한가요?

주로 다음과 같은 시나리오에 권장합니다:

- 대규모 코드 리팩토링: 파일 간 문맥 이해, 의존성 이전, 아키텍처 조정

- 에이전트 자동화: MCP 도구 체인, 브라우저 자동화, RPA 프로세스

- 과학 연구 및 데이터 분석: 대학원 수준의 추론, 가설 검증, 논문 보조

- Computer Use 데스크톱 자동화: UI 자동화 테스트, GUI 조작 스크립트

Q5: Claude Opus 4.7을 API로 빠르게 호출하는 방법은 무엇인가요?

OpenAI 호환 프로토콜을 지원하는 통합 플랫폼을 통한 호출을 추천하며, 3단계로 쉽게 시작할 수 있습니다:

- APIYI(apiyi.com)에 가입하고 API 키를 발급받습니다.

- 100달러 충전 시 10% 추가 보너스(종합 약 20% 할인)를 받거나, 무료 크레딧으로 먼저 테스트합니다.

- OpenAI SDK의

base_url을https://vip.apiyi.com/v1으로 변경하고, 모델명에claude-opus-4-7을 입력합니다.

APIYI는 Claude Opus 4.7, GPT-5.4, Gemini 3.1 Pro 등 주요 모델을 통합 지원하여 교차 비교 및 전환이 매우 편리합니다.

Q6: Claude Opus 4.7의 알려진 제한 사항은 무엇인가요?

주요 제한 사항은 다음과 같습니다:

- 토큰 소모 증가: 새로운 토크나이저 사용으로 인해 4.6 대비 1배

1.35배 더 많은 토큰이 소모되며, 청구 비용이 2030% 상승할 수 있습니다. - 웹 검색 취약: BrowseComp 점수 79.3%로 GPT-5.4에 뒤처지므로, 실시간 검색이 중요한 작업에는 신중해야 합니다.

- 응답 지연: Opus 시리즈는 Sonnet/Haiku보다 응답 속도가 느리므로, 실시간 대화 서비스에는 가벼운 모델을 병행 사용하시길 권장합니다.

- 높은 공식 단가: 백만 토큰당 $5/$25 수준이므로, 대규모 호출 시 APIYI의 충전 보너스 혜택을 통해 비용을 절감하는 것을 추천합니다.

Q7: Claude Opus 4.7의 컨텍스트 윈도우는 얼마인가요?

Claude Opus 4.7은 100만(1M) 토큰의 컨텍스트 윈도우를 지원하며, 추가 비용 없이 기본 가격으로 제공됩니다. 이는 한 번의 요청으로 중형 규모의 코드 저장소 전체, 긴 기술 문서, 회의록 전체를 처리할 수 있는 수준이며, 한글 약 75만 자 또는 PDF 200페이지 분량에 해당합니다.

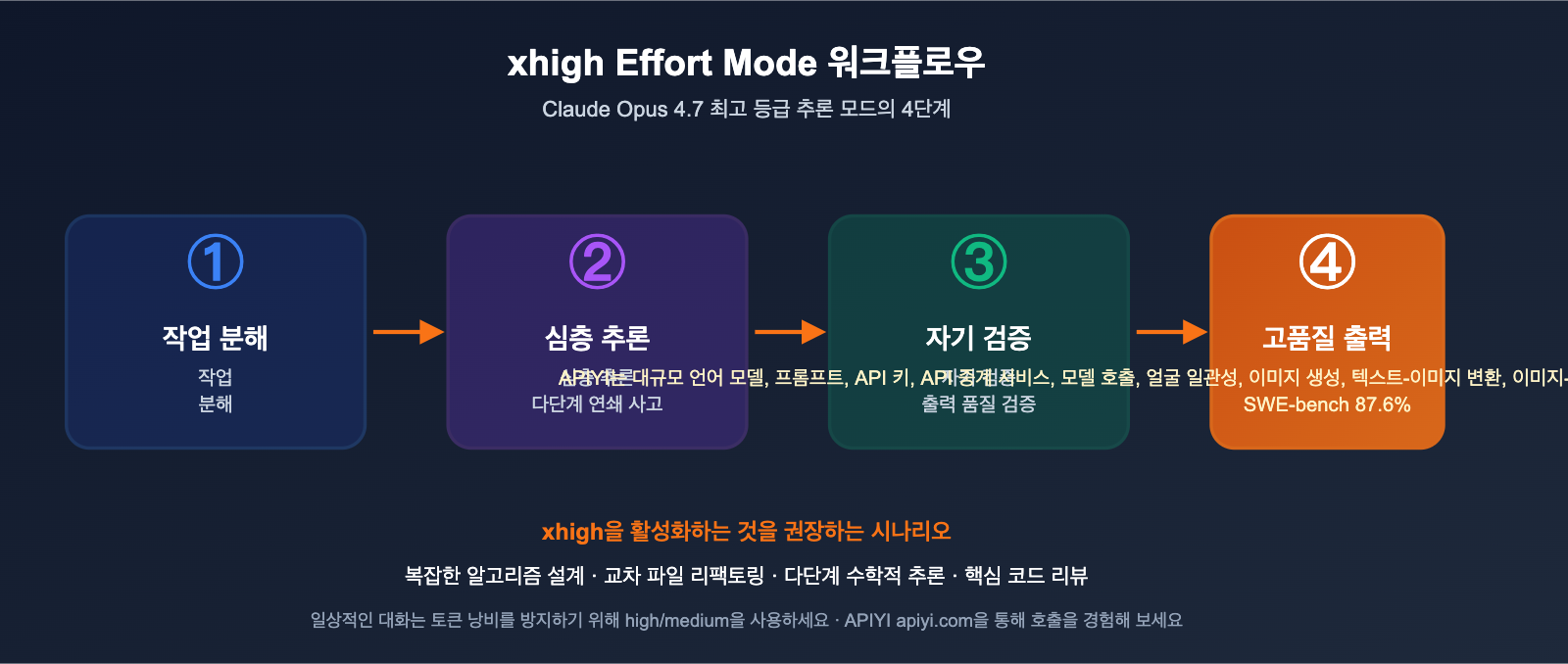

Q8: xhigh Effort Mode란 무엇이며, 언제 사용하나요?

'xhigh effort'는 Opus 4.7에 새로 추가된 최고 수준의 추론 모드입니다. 모델이 더 많은 토큰과 시간을 할애하여 다단계 사고와 자가 검증을 수행합니다. 다음과 같은 상황에서 활성화하는 것을 권장합니다:

- 복잡한 알고리즘 설계(예: LRU 캐시, 분산 일관성 등)

- 다중 파일에 걸친 리팩토링 작업

- 다단계 논리 체인이 필요한 수학적 추론

- 핵심 코드 리뷰 및 취약점 검토

일상적인 대화나 간단한 CRUD 코드 작성 시에는 high나 medium 모드로 충분하며, 이를 통해 불필요한 토큰 낭비를 줄일 수 있습니다.

Claude Opus 4.7 핵심 요약 Key Takeaways

- 🏆 7대 벤치마크 1위: SWE-bench Pro 64.3%, Verified 87.6%, GPQA 94.2%, MCP-Atlas에서 GPT-5.4 대비 9.2점 앞섬

- 💡 xhigh Effort Mode: 복잡한 알고리즘 및 파일 간 리팩토링에 최적화된 최고 수준의 추론 모드 추가

- 🚀 에이전트 시나리오 최적화: 도구 호출 및 Computer Use 성능 압도적 1위, 에이전트 AI를 위한 최고의 선택

- ⚠️ 웹 검색의 한계: BrowseComp에서 GPT-5.4보다 10점 뒤처짐, 웹 검색이 중요한 작업 시 모델 비교 후 선택 권장

- 💰 APIYI 20% 할인 혜택: 공식 가격은 그대로, apiyi.com에서 100달러 충전 시 10% 추가 지급 등 최대 약 20% 할인 효과

요약

Claude Opus 4.7의 벤치마크 데이터는 한 가지 결론을 명확히 보여줍니다. 바로 현재 프로그래밍 및 에이전트 시나리오에서 가장 강력한 범용 모델이라는 점입니다. 핵심 포인트는 다음과 같습니다.

- 압도적인 프로그래밍 성능: SWE-bench Pro 64.3%로 GPT-5.4 및 Gemini 3.1 Pro를 크게 앞서며, 실무 수준의 코드 작업에 최우선으로 고려해야 합니다.

- 에이전트 도구 호출의 강자: MCP-Atlas에서 9.2점, Computer Use에서 3점 앞서며 자동화 작업에 최적화되어 있습니다.

- 실제 비용 고려 필요: 새로운 토크나이저 도입으로 인해 20~30%의 잠재적 비용 상승이 발생할 수 있으므로, API 중계 플랫폼의 충전 혜택을 활용해 비용을 절감하는 것이 좋습니다.

AI 프로그래밍, 에이전트 개발, 복잡한 추론 작업이 주 업무라면 Claude Opus 4.7로 즉시 전환할 가치가 충분합니다. APIYI(apiyi.com)를 통해 빠르게 경험해 보세요. 공식 모델 동기화는 물론, OpenAI 호환 인터페이스로 간편하게 교체할 수 있으며, 100달러 충전 시 10% 추가 지급 혜택으로 약 20% 할인된 가격에 이용할 수 있어 해외 계정이나 달러 결제의 번거로움도 없습니다.

延伸阅读 Related Articles

Claude Opus 4.7 벤치마크에 관심이 있으시다면, 다음 글들도 함께 읽어보시는 것을 추천합니다:

- 📘 Claude Opus 4.7 API 호출 완벽 가이드 – xhigh Effort Mode, 프롬프트 캐싱, 도구 호출의 상세 사용법을 알아보세요.

- 📊 GPT-5.4 vs Claude Opus 4.7 vs Gemini 3.1 Pro 심층 비교 – 세 가지 플래그십 모델의 세부 시나리오별 선택 기준을 파악해 보세요.

- 🚀 MCP 프로토콜과 Claude Opus 4.7 에이전트 실전 – Opus 4.7을 활용해 프로덕션 수준의 에이전트 워크플로우를 구축하는 방법을 탐구합니다.

📚 참고 자료

-

Anthropic 공식 발표: Claude Opus 4.7 제품 소개 및 벤치마크 데이터

- 링크:

anthropic.com/news/claude-opus-4-7 - 설명: 모든 공식 벤치마크 테스트 결과가 포함된 1차 데이터 소스입니다.

- 링크:

-

VentureBeat 독립 평가: 범용 대규모 언어 모델 중 1위를 탈환한 Opus 4.7 분석

- 링크:

venturebeat.com/technology/anthropic-releases-claude-opus-4-7-narrowly-retaking-lead-for-most-powerful-generally-available-llm - 설명: Opus 4.7과 경쟁 모델 간의 종합적인 비교를 다룬 제3자 독립 시각의 분석입니다.

- 링크:

-

Vellum AI 벤치마크 해석: 벤치마크 방법론 및 신뢰도 항목별 분석

- 링크:

vellum.ai/blog/claude-opus-4-7-benchmarks-explained - 설명: 벤치마크 테스트 방법을 깊이 있게 이해하고 싶은 기술 독자에게 적합합니다.

- 링크:

-

Claude 공식 API 문서: 컨텍스트 윈도우, 가격, 토크나이저 설명

- 링크:

platform.claude.com/docs/en/about-claude/models/whats-new-claude-4-7 - 설명: 마이그레이션 가이드를 포함한 통합 및 호출 관련 권위 있는 참고 자료입니다.

- 링크:

작성자: APIYI 기술팀

기술 교류: Claude Opus 4.7 사용 경험을 댓글로 자유롭게 공유해 주세요. 더 많은 모델 호출 관련 자료는 APIYI 문서 센터(docs.apiyi.com)에서 확인하실 수 있습니다.