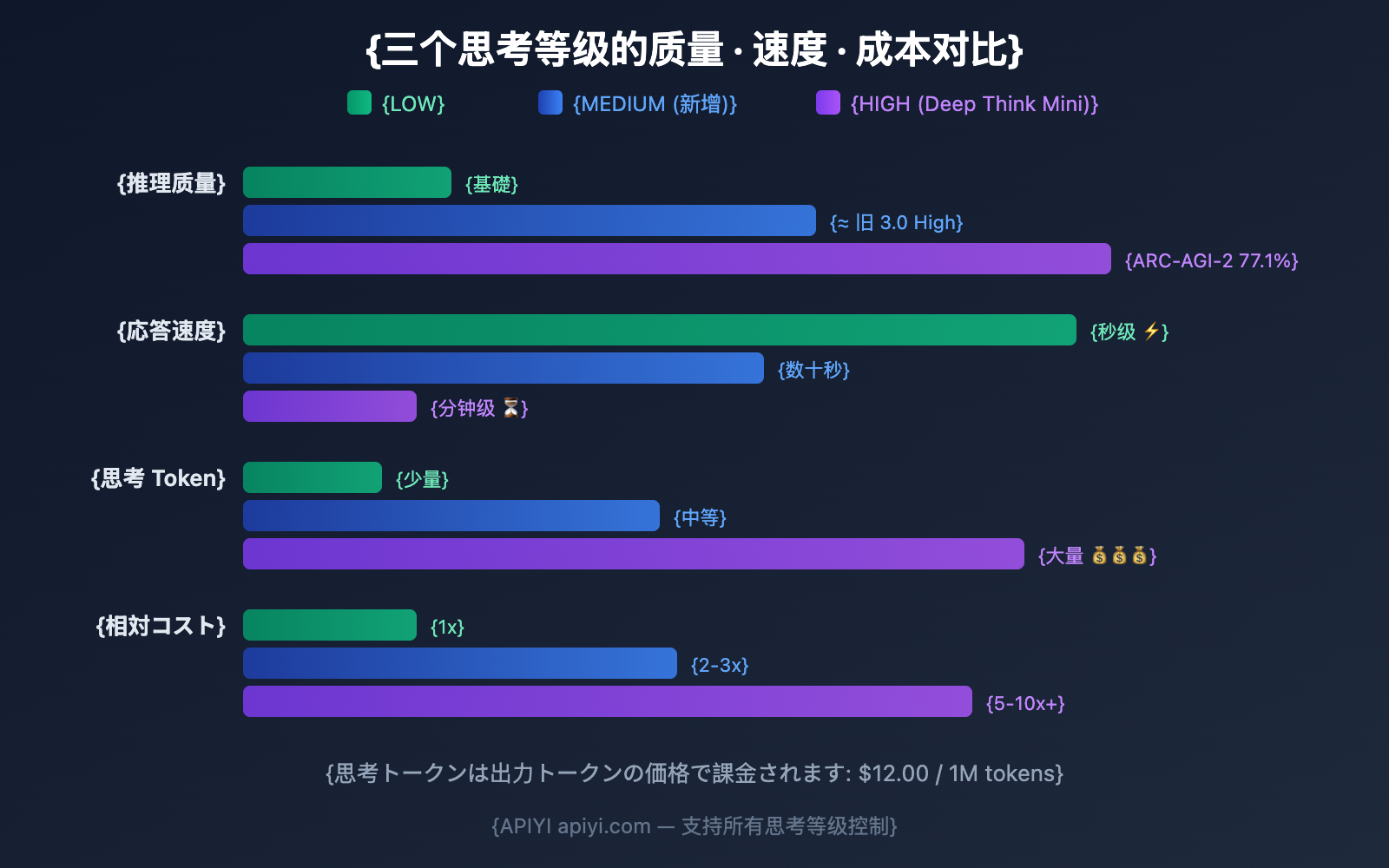

Gemini 3.1 Pro Preview では、新たに medium(中間)思考レベル が追加されました。これは前世代の Gemini 3 Pro との最大の違いの一つです。現在、low、medium、high の 3 つのレベル間でモデルの推論深度を正確に制御できるようになり、特に high モードでは Deep Think Mini 能力が有効化されます。

コアバリュー: この記事を読み終えることで、thinkingLevel パラメータの完全な設定方法をマスターし、品質、速度、コストの間で最適なバランスを見つけることができるようになります。

Gemini 3.1 Pro 思考レベル対応マトリックス

まずは全体像を確認しましょう。Gemini モデルによって対応している思考レベルが異なります。

| 思考レベル | Gemini 3.1 Pro | Gemini 3 Pro | Gemini 3 Flash | 説明 |

|---|---|---|---|---|

| minimal | ❌ 非対応 | ❌ 非対応 | ✅ 対応 | 思考をほぼオフにする。Flash のみ対応 |

| low | ✅ 対応 | ✅ 対応 | ✅ 対応 | 高速レスポンス、最小コスト |

| medium | ✅ 新しく対応 | ❌ 非対応 | ✅ 対応 | バランスの取れた推論。3.1 Pro の核心的進化 |

| high | ✅ 対応 (デフォルト) | ✅ 対応 (デフォルト) | ✅ 対応 (デフォルト) | 最も深い推論。Deep Think Mini を起動 |

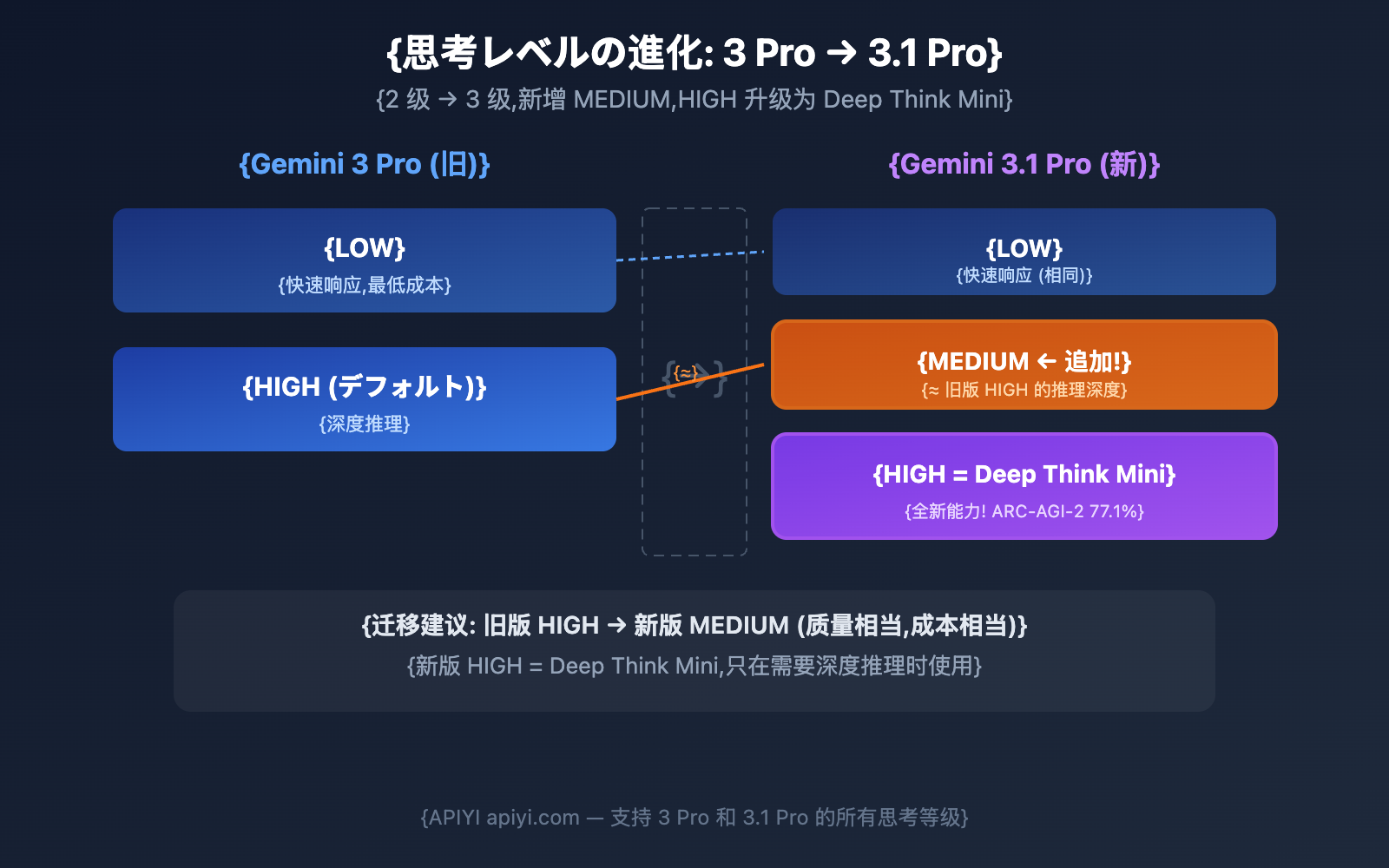

重要な変化: 3 Pro → 3.1 Pro の思考レベルのアップグレード

| 比較項目 | Gemini 3 Pro | Gemini 3.1 Pro |

|---|---|---|

| 利用可能なレベル | low, high (2段階のみ) | low, medium, high (3段階) |

| デフォルトレベル | high | high |

| high モードの意味 | 深い推論 | Deep Think Mini (より強力) |

| 思考のオフ設定 | 不可 | 不可 |

核心的な理解: Gemini 3 Pro の high モードの推論深度は、Gemini 3.1 Pro の medium に相当します。一方で、3.1 Pro の high は全く新しい Deep Think Mini であり、推論深度は前世代を遥かに凌駕しています。

🎯 移行のアドバイス: 以前 Gemini 3 Pro の high モードを使用していた場合、3.1 Pro に切り替えた後はまず medium を使用することをお勧めします(同様の品質とコストを維持するため)。深い推論が必要な場合にのみ high を有効にしてください。APIYI (apiyi.com) は、すべての Gemini モデルと思考レベルをサポートしています。

Gemini 3.1 Pro 思考レベル API 設定方法

APIYI 経由での呼び出し (OpenAI 互換フォーマット)

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # APIYI 統合インターフェース

)

# LOW モード: 高速レスポンス

response_low = client.chat.completions.create(

model="gemini-3.1-pro-preview",

messages=[{"role": "user", "content": "この英文を日本語に翻訳してください: Hello World"}],

extra_body={

"thinking": {"type": "enabled", "budget_tokens": 1024}

}

)

# MEDIUM モード: バランスの取れた推論 (新機能!)

response_med = client.chat.completions.create(

model="gemini-3.1-pro-preview",

messages=[{"role": "user", "content": "このコードにメモリリークのリスクがないか確認してください"}],

extra_body={

"thinking": {"type": "enabled", "budget_tokens": 8192}

}

)

# HIGH モード: Deep Think Mini

response_high = client.chat.completions.create(

model="gemini-3.1-pro-preview",

messages=[{"role": "user", "content": "証明: すべての正の整数nに対して、n^3-nは6で割り切れる"}],

extra_body={

"thinking": {"type": "enabled", "budget_tokens": 32768}

}

)

Google SDK によるネイティブ呼び出し

from google import genai

from google.genai import types

client = genai.Client()

# thinkingLevel パラメータを使用

response = client.models.generate_content(

model="gemini-3.1-pro-preview",

contents="あなたのプロンプト",

config=types.GenerateContentConfig(

thinking_config=types.ThinkingConfig(

thinking_level="MEDIUM" # "LOW" / "MEDIUM" / "HIGH"

)

),

)

# 思考トークンの消費量を確認

print(f"思考トークン: {response.usage_metadata.thoughts_token_count}")

print(f"出力トークン: {response.usage_metadata.candidates_token_count}")

REST API 呼び出し

POST https://generativelanguage.googleapis.com/v1beta/models/gemini-3.1-pro-preview:generateContent

{

"contents": [{"parts": [{"text": "あなたのプロンプト"}]}],

"generationConfig": {

"thinkingConfig": {

"thinkingLevel": "MEDIUM"

}

}

}

⚠️ 重要事項:

thinkingLevelとthinkingBudgetは同時に使用できません。同時に使用すると 400 エラーが返されます。Gemini 3 以降のモデルではthinkingLevel、Gemini 2.5 モデルではthinkingBudgetの使用が推奨されます。

Gemini 3.1 Pro 3つの思考レベル詳細比較

LOW: 最速かつ低コスト

| 項目 | 詳細 |

|---|---|

| 推論の深さ | 最小限の思考トークンですが、思考しないモデルよりも優れています |

| レスポンス速度 | 秒単位 (最速) |

| コスト | 最低 (思考トークンが少ない → 出力トークンが少ない → 費用が安い) |

| 活用シーン | オートコンプリート、分類、構造化データの抽出、簡単な翻訳、要約 |

| 不向きなケース | 複雑な推論、数学的証明、多段階のデバッグ |

MEDIUM: バランス重視の推奨設定 (新機能)

| 項目 | 詳細 |

|---|---|

| 推論の深さ | 中程度の思考トークン、旧バージョン 3.0 Pro の High レベルに相当 |

| レスポンス速度 | 中程度の遅延 |

| コスト | 中程度 |

| 活用シーン | コードレビュー、ドキュメント分析、日常的なコーディング、標準的な API 呼び出し、Q&A |

| 不向きなケース | IMO(国際数学オリンピック)レベルの数学、極めて複雑な多段階推論 |

HIGH: Deep Think Mini (デフォルト)

| 項目 | 詳細 |

|---|---|

| 推論の深さ | 推論を最大化し、Deep Think Mini の能力を有効化 |

| レスポンス速度 | 数分かかる場合があります (IMO 問題で約8分) |

| コスト | 最高 (大量の思考トークンが出力価格で課金されます) |

| 活用シーン | 複雑なデバッグ、アルゴリズム設計、数学的証明、研究タスク、エージェントワークフロー |

| 特殊能力 | 思考シグネチャ (thought signatures) により、API 呼び出しをまたいで推論の連続性を維持 |

Gemini 3.1 Pro 思考トークンの課金ルール

料金体系を理解することは、適切な思考レベルを選択する上で非常に重要です。

コア課金原則

| 課金項目 | 説明 |

|---|---|

| 思考トークンは課金対象か | はい。出力トークンと同じ価格で課金されます。 |

| 出力トークンの価格 | $12.00 / 100万トークン(思考トークンを含む) |

| 課金基準 | 要約だけでなく、内部の推論チェーン全体に対して課金されます。 |

| 思考の要約 | APIは思考の要約のみを返しますが、課金は生成された全思考トークン数に基づいて行われます。 |

Googleの公式説明:

「思考モデルは、最終的な回答の質を向上させるために完全な思考プロセスを生成し、その後、思考プロセスへの洞察を提供するために要約を出力します。APIからは要約のみが出力されますが、料金は要約を作成するためにモデルが生成する必要があった全思考トークンに基づいて計算されます。」

3つのレベルのコスト見積もり

| レベル | 推定思考トークン | 1,000回あたりのコスト | 月間コストの傾向 |

|---|---|---|---|

| LOW | 〜500-2K / 回 | $6-24 | 最小 |

| MEDIUM | 〜2K-8K / 回 | $24-96 | 中程度 |

| HIGH | 〜8K-32K+ / 回 | $96-384+ | 高め、複雑なタスクではさらに増加 |

💰 コスト最適化: すべてのリクエストに HIGH が必要なわけではありません。日常的なタスクの80%を LOW または MEDIUM に設定し、複雑なタスクの20%のみに HIGH を使用することで、APIの支出を50〜70%削減できます。APIYI(apiyi.com)プラットフォームを通じて柔軟に設定可能です。

タスクの種類と Gemini 3.1 Pro 思考レベルの対応ガイド

詳細なシナリオ別推奨設定

| タスクの種類 | 推奨レベル | 理由 | 予想レイテンシ |

|---|---|---|---|

| 簡単な翻訳 | LOW | 推論が不要なため | < 5秒 |

| テキスト分類 | LOW | パターンマッチングタスク | < 5秒 |

| 要約抽出 | LOW | 情報の圧縮であり、推論ではない | < 10秒 |

| オートコンプリート | LOW | レイテンシに敏感なため | < 3秒 |

| コードレビュー | MEDIUM | 適度な分析が必要 | 10-30秒 |

| ドキュメントQ&A | MEDIUM | 理解と回答のプロセス | 10-30秒 |

| 日常的なコーディング | MEDIUM | 一般的なコード生成 | 15-40秒 |

| バグ分析 | MEDIUM | 中程度の複雑さの推論 | 20-40秒 |

| 複雑なデバッグ | HIGH | 多段階の推論チェーン | 1-5分 |

| 数学的証明 | HIGH | Deep Think Mini | 3-8分 |

| アルゴリズム設計 | HIGH | 深い推論が必要 | 2-5分 |

| 調査・分析 | HIGH | 多角的な深い分析 | 2-5分 |

| エージェントワークフロー | HIGH | 思考の継続性を維持するため | タスクによる |

動的なレベル選択:ベストプラクティス・コード

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # APIYI 統合インターフェース

)

# タスクの種類に応じて思考レベルを自動選択

THINKING_CONFIG = {

"simple": {"type": "enabled", "budget_tokens": 1024}, # LOW

"medium": {"type": "enabled", "budget_tokens": 8192}, # MEDIUM

"complex": {"type": "enabled", "budget_tokens": 32768}, # HIGH

}

def smart_think(prompt, complexity="medium"):

"""タスクの複雑度に基づいて思考レベルを自動設定"""

return client.chat.completions.create(

model="gemini-3.1-pro-preview",

messages=[{"role": "user", "content": prompt}],

extra_body={"thinking": THINKING_CONFIG[complexity]}

)

# 簡単な翻訳 → LOW

resp1 = smart_think("翻訳: Good morning", "simple")

# コードレビュー → MEDIUM

resp2 = smart_think("このコードのセキュリティをレビューしてください: ...", "medium")

# 数学的証明 → HIGH (Deep Think Mini)

resp3 = smart_think("リーマン予想の特定のケースを証明してください", "complex")

Gemini 3.1 Pro vs 3 Pro: 思考レベルの進化比較

Deep Think Mini は一体どこが凄いのか

Gemini 3.1 Pro の 「HIGH」モードで有効化される 「Deep Think Mini」 は、今回のアップデートにおける最大の目玉です。

Deep Think Mini とは何か

Deep Think Mini は独立したモデルではなく、Gemini 3.1 Pro の HIGH 思考レベルにおける特殊な推論モードです。Google はこれを「Gemini Deep Think のミニバージョン」と説明しています。Deep Think は Google 専用の強力な推論モデルです(ARC-AGI-2 スコア 84.6%)。

Deep Think Mini の実測パフォーマンス

| テスト項目 | Deep Think Mini (3.1 Pro HIGH) | Gemini 3 Pro HIGH | 向上率 |

|---|---|---|---|

| ARC-AGI-2 | 77.1% | 31.1% | +148% |

| IMO 数学問題 | ~8 分で解答 | 解答不可 | 不可能が可能に |

| 複雑なプランニングタスク | ベンチマークで 40-60% 向上 | Gemini 2.5 Pro との比較 | 大幅な向上 |

思考シグネチャ (Thought Signatures)

Deep Think Mini には、**「思考シグネチャ (thought signatures)」**という独自の技術が導入されています。これは、暗号化され改ざん不可能な、中間推論状態の表現です。

エージェントのワークフローにおいて、モデルの推論は複数の API 呼び出しにまたがることがよくあります。思考シグネチャは、前回の呼び出しの推論コンテキストを次回の呼び出しに引き継ぐことができ、推論の連続性を維持します。これは、多段階のエージェントタスクにおいて特に重要です。

どのようなタスクで Deep Think Mini を使うべきか

| HIGH (Deep Think Mini) を使う価値があるもの | HIGH を使う必要がないもの |

|---|---|

| 数学オリンピック級の推論 | 単純な四則演算 |

| ファイルをまたぐ複雑なバグ修正 | 構文エラーの修正 |

| アルゴリズムの設計と最適化 | CRUD コード生成 |

| 学術論文の手法分析 | 文章の要約 |

| 多段階エージェントの長期タスク | 単発の Q&A |

| セキュリティ脆弱性の詳細分析 | フォーマット変換 |

💡 実用的なアドバイス: Deep Think Mini の強力さには代償があります。それは、レイテンシ(遅延)とコストがどちらも高いことです。本当に「深い思考」が必要なタスクでのみ HIGH を使用し、日常的なタスクには MEDIUM で十分でしょう。APIYI (apiyi.com) を通じて、リクエストごとに柔軟に切り替えることが可能です。

thinkingLevel vs thinkingBudget: 混同に注意

Googleには思考を制御するための2つのパラメータがあり、それぞれ異なるモデルシリーズに適用されます。

| パラメータ | 対象モデル | 値の型 | 説明 |

|---|---|---|---|

| thinkingLevel | Gemini 3+ (3 Flash, 3 Pro, 3.1 Pro) | 列挙型: MINIMAL/LOW/MEDIUM/HIGH | Gemini 3 シリーズに推奨 |

| thinkingBudget | Gemini 2.5 (Pro, Flash, Flash Lite) | 整数: 0-32768 | 2.5 シリーズに適用 |

⚠️ 2つのパラメータを同時に使用することはできません! 同時に渡すと 400 エラーが返されます。

| シナリオ | 正しい方法 | 誤った方法 |

|---|---|---|

| Gemini 3.1 Pro を呼び出す | thinkingLevel: "MEDIUM" を使用 |

thinkingBudget: 8192 を使用 |

| Gemini 2.5 Pro を呼び出す | thinkingBudget: 8192 を使用 |

thinkingLevel: "MEDIUM" を使用 |

| 両方のパラメータを渡す | — | 400 エラー ❌ |

🎯 簡単な覚え方: Gemini 3 シリーズ → thinkingLevel (文字列のレベル)、Gemini 2.5 シリーズ → thinkingBudget (数値のトークン数)。APIYI (apiyi.com) は両方のパラメータ形式に対応しています。

よくある質問

Q1: thinkingLevel を設定しない場合のデフォルトはどのレベルですか?

デフォルトは HIGH です。つまり、明示的に設定しない場合、リクエストごとに Deep Think Mini の全推論能力が使用され、最大の思考トークンを消費します。コストを節約するために、タスクの実際の必要性に応じて適切なレベルを設定することをおすすめします。APIYI (apiyi.com) を通じて、リクエスト単位で柔軟に制御可能です。

Q2: 思考トークンの料金体系はどうなっていますか? 高額ですか?

思考トークンは出力トークンと同じ価格で課金されます($12.00 / 1M tokens)。HIGH モードでは、1つの複雑なリクエストで3万以上の思考トークンを消費することがあり、費用は約 $0.36 になります。一方、LOW モードで同じリクエストを行った場合、消費される思考トークンは1000程度で、費用は約 $0.012 で済むこともあります。その差は最大30倍に達します。

Q3: 3.1 Pro の MEDIUM は 3.0 Pro の HIGH と同じですか?

ほぼ同等です。Googleの説明によると、3.1 Pro の MEDIUM は「ほとんどのタスクの処理に適したバランスの取れた思考」を提供し、これは 3.0 Pro の HIGH の位置付けと一致します。3.0 Pro から 3.1 Pro に移行する場合、HIGH を MEDIUM に変更することで、同様の品質とコストを維持できます。APIYI (apiyi.com) を利用すれば、両方のバージョンを同時に呼び出して比較することも可能です。

Q4: 思考機能をオフにすることはできますか?

Gemini 3.1 Pro では思考を完全にオフにすることはできません。最低でも LOW に設定する必要があり、基礎的な推論は行われます。思考を全く行わないレスポンスが必要な場合は、Gemini 3 Flash の MINIMAL モードの使用を検討してください。

Gemini 3.1 Pro 思考レベルに関するよくある誤解

| 誤解 | 事実 |

|---|---|

| 「HIGHレベルが最も回答の質が高いため、常に使うべきだ」 | HIGHは単純なタスクではMEDIUMと品質が近く、コストは5〜10倍高くなります。 |

| 「LOWレベルは推論能力が非常に低い」 | LOWでも思考しないモデルより優れており、思考トークンが少ないだけです。 |

| 「MEDIUMは新機能なので、不安定かもしれない」 | MEDIUMの推論の深さは旧バージョン 3.0 ProのHIGHに相当し、十分に検証されています。 |

| 「思考トークンは課金されない」 | 課金されます! 出力トークンと同額($12/MTok)で計算されます。 |

| 「3.1 Proの思考をオフにできる」 | できません。最低でもLOWに設定する必要があり、基礎的な推論は行われます。 |

| 「thinkingLevelとthinkingBudgetは併用できる」 | できません! 同時に使用すると400エラーが返されます。 |

| 「高レベルに設定すると遅延は長くなるが、結果はすぐに返ってくる」 | HIGHモードは結果が返り始めるまで数分かかる場合があり、単なるわずかな遅延ではありません。 |

まとめ:Gemini 3.1 Pro 思考レベル選択クイックリファレンス

| レベル | 一言で言うと | 活用シーン | 相対コスト |

|---|---|---|---|

| LOW | 最速・最安 | 翻訳、分類、要約、補完 | 1x |

| MEDIUM | バランス重視の第一候補(新機能) | コーディング、レビュー、分析、Q&A | 2-3x |

| HIGH | Deep Think Mini | 数学、デバッグ、研究、エージェント | 5-10x+ |

主な推奨事項:

- 日常的な開発には MEDIUM — 品質が良くコストも手頃で、旧バージョンのHIGHに相当します。

- 単純なタスクには LOW — 思考トークンの費用を70%以上節約できます。

- 深い推論には HIGH — Deep Think Miniの能力は唯一無二ですが、コストに注意が必要です。

- デフォルトは HIGH — 設定しないと最も高価なモードになるため、意識的に調整することをお忘れなく。

タスクの種類に応じて思考レベルを動的に切り替え、品質とコストの最適なバランスを実現するために、APIYI(apiyi.com)プラットフォームの利用をおすすめします。

参考資料

-

Google AI ドキュメント: Gemini 思考設定ガイド

- リンク:

ai.google.dev/gemini-api/docs/thinking - 説明: thinkingLevel パラメータの完全なドキュメント

- リンク:

-

Google AI ドキュメント: Gemini 3.1 Pro モデルページ

- リンク:

ai.google.dev/gemini-api/docs/models/gemini-3.1-pro-preview - 説明: 思考レベルのサポートマトリックスと注意事項

- リンク:

-

Gemini API 料金ページ: 思考トークンの課金に関する説明

- リンク:

ai.google.dev/gemini-api/docs/pricing - 説明: 思考トークンは出力トークンの価格で課金されます

- リンク:

-

VentureBeat: Deep Think Mini 徹底レビュー

- リンク:

venturebeat.com/technology/google-gemini-3-1-pro-first-impressions - 説明: IMO(国際数学オリンピック)の問題を8分で解いた実測データ

- リンク:

-

Google 公式ブログ: Gemini 3.1 Pro リリース発表

- リンク:

blog.google/innovation-and-ai/models-and-research/gemini-models/gemini-3-1-pro - 説明: 3段階の思考システムと Deep Think Mini の公式紹介

- リンク:

📝 著者: APIYI Team | 技術的な交流については APIYI (apiyi.com) をご覧ください

📅 更新日: 2026年2月20日

🏷️ キーワード: Gemini 3.1 Pro 思考レベル, thinkingLevel, Deep Think Mini, LOW MEDIUM HIGH, API 呼び出し, 推論制御