作者注:Gemini 3.1 Flash-Lite Preview 以 380 tok/s 输出速度和 $0.25/M 超低成本上线,本文深度解析其 5 大核心优势、基准测试数据、竞品对比与 API 接入方法

Google DeepMind 在 2026 年 3 月 3 日正式发布了 Gemini 3.1 Flash-Lite Preview——这是 Gemini 3 系列中速度最快、成本最低的模型。基于 Gemini 3 Pro 架构,输出速度达到约 380 tokens/s,比 Gemini 2.5 Flash 首 Token 响应快 2.5 倍,输出速度提升 45%。

核心价值: 本文将从性能基准、成本对比、功能特性、适用场景和 API 接入 5 个维度,帮你全面了解这个新上线的轻量级模型,判断是否适合你的业务场景。

Gemini 3.1 Flash-Lite Preview 核心参数速览

以下是从 Google AI 官方文档和 DeepMind 模型卡提取的核心技术参数:

| 参数项 | Gemini 3.1 Flash-Lite Preview | 说明 |

|---|---|---|

| 模型 ID | gemini-3.1-flash-lite-preview |

API 调用时使用此 ID |

| 架构基础 | Gemini 3 Pro | 继承 Pro 级多模态架构 |

| 上下文窗口 | 1,048,576 tokens (1M) | 约 1,500 页 A4 文档 |

| 最大输出 | 65,536 tokens (64K) | 支持长文本生成 |

| 输出速度 | ~380 tokens/s | 在 132 个模型中排名第 2 |

| 输入价格 | $0.25 / 百万 tokens | Gemini 3 系列最低 |

| 输出价格 | $1.50 / 百万 tokens | Pro 版的 1/8 |

| 知识截止 | 2025 年 1 月 | 与 Gemini 3 Pro 一致 |

| 状态 | Preview | 预览版,正式版待发布 |

值得注意的是,Gemini 3.1 Flash-Lite Preview 基于 Gemini 3 Pro 架构构建,这意味着它在「缩小版」的体量下保留了 Pro 级别的多模态理解能力。Google 将其定位为「高频、轻量级任务」的首选模型。

🎯 接入建议: Gemini 3.1 Flash-Lite Preview 已在 API易 apiyi.com 上线,价格与 Google 官方一致。充值 100 美金起送 10 美金,最低可享八折优惠,一站式使用 400+ 大模型。

Gemini 3.1 Flash-Lite Preview 5 大核心优势

优势 1: 极速推理——380 tok/s 输出速度

Gemini 3.1 Flash-Lite Preview 的输出速度达到约 380 tokens/s,根据 Artificial Analysis 的评测数据,在 132 个主流模型中排名第 2。相比前代 Gemini 2.5 Flash 的 249 tok/s,性能提升约 45%。

首 Token 响应时间 (TTFT) 方面更是亮眼——比 Gemini 2.5 Flash 快 2.5 倍。对于需要即时反馈的应用场景(如聊天机器人、实时翻译),这个提升意义重大。

优势 2: 极低成本——输入仅 $0.25/M tokens

在 Gemini 3 系列中,Flash-Lite 的价格仅为 Pro 版本的 1/8。具体而言:

| 模型 | 输入价格 | 输出价格 | 混合费率 (3:1) |

|---|---|---|---|

| Gemini 3.1 Flash-Lite | $0.25/M | $1.50/M | $0.56/M |

| Gemini 3 Pro | $2.00/M | $12.00/M | $4.50/M |

| Claude 4.5 Haiku | $1.00/M | $5.00/M | $2.00/M |

| GPT-5 mini | $0.15/M | $0.60/M | $0.26/M |

Flash-Lite 在价格和性能之间取得了出色的平衡——虽然不是绝对最便宜的,但考虑到其 380 tok/s 的输出速度和 1M 上下文窗口,性价比极高。

优势 3: 百万级上下文窗口

1,048,576 tokens 的上下文窗口意味着你可以在单次请求中处理:

- 约 1,500 页 A4 文档

- 完整的代码仓库

- 长达数小时的音频/视频内容

这在轻量模型中是非常罕见的配置。相比之下,GPT-5 mini 仅支持 128K,Claude 4.5 Haiku 支持 200K。

优势 4: 全模态输入支持

尽管定位为轻量模型,Gemini 3.1 Flash-Lite Preview 支持 5 种输入模态:

- 文本: 核心能力

- 图像: 图片内容分析和理解

- 音频: 语音转录和分析

- 视频: 视频内容理解

- PDF: 文档解析和摘要

输出方面仅支持文本,但对于大多数数据处理和分析任务来说,这已经足够。

优势 5: Thinking Mode 支持

作为轻量模型,Gemini 3.1 Flash-Lite Preview 竟然支持 Thinking Mode(扩展思考模式),这在同级模型中几乎是独一无二的。启用后模型会进行逐步推理,在科学知识、数学计算等任务上显著提升准确率。

🎯 平台推荐: 想快速测试 Gemini 3.1 Flash-Lite Preview 的 Thinking Mode 表现?通过 API易 apiyi.com 可直接调用,支持 400+ 主流大模型的统一接口。

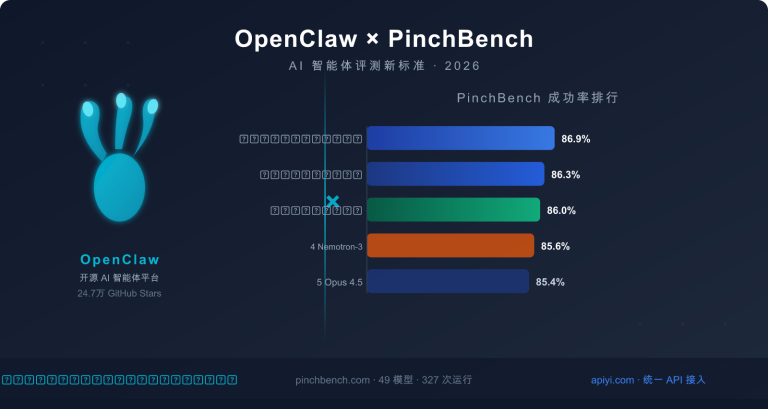

Gemini 3.1 Flash-Lite Preview 基准测试数据

以下是来自 Google DeepMind 模型卡和 Artificial Analysis 的评测数据:

Gemini 3.1 Flash-Lite Preview 基准测试解读

从数据来看,Flash-Lite 在轻量模型中的表现相当亮眼:

- GPQA Diamond 86.9%: 科学知识推理能力在同级模型中领先

- Video-MMMU 84.8%: 视频理解能力是其多模态优势的体现

- MMMU-Pro 76.8%: 多模态推理表现优秀

- Arena Elo 1432: 在 Arena.ai 排行榜上获得高分,证明实际使用体验好

- 智能指数 34/100: 远超同级模型平均水平 19,在 132 个模型中排名第 19

在 11 项基准测试中,Flash-Lite 有 6 项取得了同级别最佳成绩,这对于一个轻量级模型来说是非常出色的表现。

🎯 实测建议: 基准测试数据仅供参考,实际效果因场景而异。建议通过 API易 apiyi.com 进行真实场景测试,平台提供免费额度,支持快速对比多个模型。

Gemini 3.1 Flash-Lite Preview 与竞品对比

| 对比维度 | Gemini 3.1 Flash-Lite | Claude 4.5 Haiku | GPT-5 mini |

|---|---|---|---|

| 输出速度 | ~380 tok/s ⚡ | ~108 tok/s | ~71 tok/s |

| 输入价格 | $0.25/M | $1.00/M | $0.15/M ⚡ |

| 输出价格 | $1.50/M | $5.00/M | $0.60/M ⚡ |

| 上下文窗口 | 1M tokens ⚡ | 200K tokens | 128K tokens |

| 多模态输入 | 5 种 ⚡ | 2 种 | 2 种 |

| Thinking Mode | ✅ | ❌ | ❌ |

| Function Calling | ✅ | ✅ | ✅ |

| Batch API | ✅ | ✅ | ✅ |

对比总结:

- 速度优先: Flash-Lite 的 380 tok/s 是 Haiku 的 3.5 倍、GPT-5 mini 的 5.4 倍

- 成本优先: GPT-5 mini 的绝对价格更低,但 Flash-Lite 在速度上的优势可以弥补成本差距

- 功能优先: Flash-Lite 在上下文长度(1M)和多模态支持(5 种)上明显领先

🎯 选择建议: 选择哪个轻量模型取决于具体场景。我们建议通过 API易 apiyi.com 进行实际对比测试,平台支持以上所有模型的统一接口调用,便于快速切换和评估。

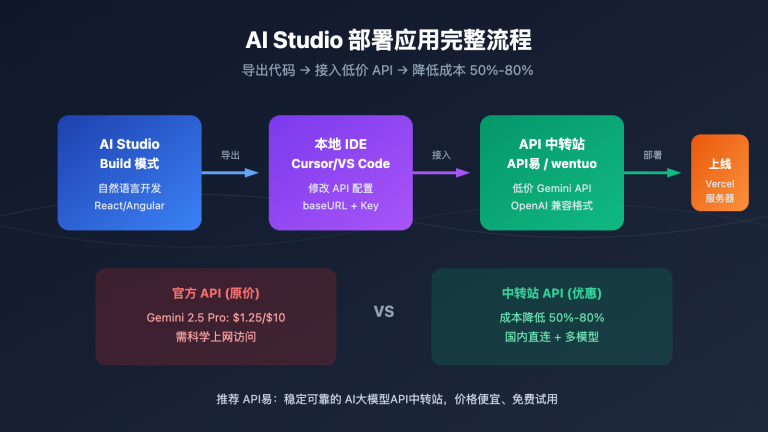

Gemini 3.1 Flash-Lite Preview 快速上手

极简示例

以下是通过 API易平台调用 Gemini 3.1 Flash-Lite Preview 的最简代码,10 行即可运行:

from openai import OpenAI

client = OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="gemini-3.1-flash-lite-preview",

messages=[{"role": "user", "content": "用一句话解释量子计算"}]

)

print(response.choices[0].message.content)

查看完整实现代码(含 Thinking Mode)

from openai import OpenAI

from typing import Optional

def call_flash_lite(

prompt: str,

system_prompt: Optional[str] = None,

max_tokens: int = 2000,

enable_thinking: bool = False

) -> str:

"""

调用 Gemini 3.1 Flash-Lite Preview

Args:

prompt: 用户输入

system_prompt: 系统提示词

max_tokens: 最大输出token数

enable_thinking: 是否启用 Thinking Mode

"""

client = OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

messages = []

if system_prompt:

messages.append({"role": "system", "content": system_prompt})

messages.append({"role": "user", "content": prompt})

try:

response = client.chat.completions.create(

model="gemini-3.1-flash-lite-preview",

messages=messages,

max_tokens=max_tokens

)

return response.choices[0].message.content

except Exception as e:

return f"Error: {str(e)}"

# 使用示例

result = call_flash_lite(

prompt="分析以下代码的时间复杂度并给出优化建议",

system_prompt="你是一个高级算法工程师"

)

print(result)

建议: 通过 API易 apiyi.com 获取 API Key 和免费测试额度,快速验证 Gemini 3.1 Flash-Lite Preview 在你的场景下的表现。充值 100 美金起送 10 美金,最低可享八折优惠。

Gemini 3.1 Flash-Lite Preview 适用场景

推荐使用场景

| 场景 | 说明 | 为什么选 Flash-Lite |

|---|---|---|

| 大规模翻译 | 多语言内容翻译工作流 | 380 tok/s 极速输出 + 低成本 |

| 内容审核 | 用户生成内容分类过滤 | 高频调用 + 成本可控 |

| 数据提取 | 结构化数据抽取和整理 | 支持 JSON Schema 输出 |

| Agent 路由 | 作为路由层分发请求 | 超低延迟 + Function Calling |

| 文档处理 | PDF/长文档解析摘要 | 1M 上下文 + 多模态输入 |

| 音频转录 | 语音转文字和分析 | 原生音频输入支持 |

不推荐的场景

- 复杂创意写作: Pro 级模型在深度创作上更有优势

- 图像/音频生成: Flash-Lite 仅支持文本输出

- 实时流式对话: 不支持 Live API

- 需要最高推理准确性: 对于要求极致准确度的场景,建议使用 Gemini 3.1 Pro

🎯 场景建议: 不确定哪个模型最适合你的场景?通过 API易 apiyi.com 可以快速在 Gemini 3.1 Flash-Lite、Claude Haiku、GPT-5 mini 之间切换对比,找到最优方案。

常见问题

Q1: Gemini 3.1 Flash-Lite Preview 与 Gemini 2.5 Flash 有什么区别?

核心区别在于架构和性能: Flash-Lite 基于 Gemini 3 Pro 架构(而非 Gemini 2 架构),首 Token 响应快 2.5 倍,输出速度提升 45% 达到 ~380 tok/s。同时新增了 Thinking Mode、代码执行等高级功能。

Q2: Preview 版本稳定性如何?适合生产环境使用吗?

Preview 版本功能和性能可能在正式版中有调整。建议在非关键业务中先行测试,关键业务可设置降级方案。通过 API易 apiyi.com 调用时,可以方便地在模型之间切换,实现灵活的降级策略。

Q3: 如何快速开始测试 Gemini 3.1 Flash-Lite Preview?

推荐通过支持多模型的 API 聚合平台进行测试:

- 访问 API易 apiyi.com 注册账号

- 获取 API Key 和免费额度

- 使用本文的代码示例,将 model 设为

gemini-3.1-flash-lite-preview即可 - 充值 100 美金起送 10 美金,最低可享八折优惠

总结

Gemini 3.1 Flash-Lite Preview 的核心要点:

- 极速性能: ~380 tok/s 输出速度,132 个模型中排名第 2,首 Token 响应比 2.5 Flash 快 2.5 倍

- 高性价比: 输入 $0.25/M、输出 $1.50/M,仅为 Gemini 3 Pro 的 1/8,适合高频大规模调用

- 功能全面: 1M 上下文 + 5 种输入模态 + Thinking Mode + Function Calling,轻量模型中配置最全面

- Pro 级基因: 基于 Gemini 3 Pro 架构,在 GPQA Diamond(86.9%)等基准测试中表现出色

对于需要大规模、低成本、高速度的 AI 应用场景,Gemini 3.1 Flash-Lite Preview 是当前最值得关注的轻量模型之一。

推荐通过 API易 apiyi.com 快速接入测试,平台价格与 Google 官方一致,充值 100 美金起送 10 美金,最低可享八折优惠,一站式使用 400+ 大模型。

📚 参考资料

-

Google AI 官方模型文档: Gemini 3.1 Flash-Lite Preview 完整技术规格

- 链接:

ai.google.dev/gemini-api/docs/models/gemini-3.1-flash-lite-preview - 说明: 官方 API 文档,包含最新参数和功能列表

- 链接:

-

Google DeepMind 模型卡: 基准测试数据和安全评估

- 链接:

deepmind.google/models/model-cards/gemini-3-1-flash-lite/ - 说明: 官方模型卡,包含详细基准测试成绩和训练信息

- 链接:

-

Artificial Analysis 评测: 独立第三方性能和价格分析

- 链接:

artificialanalysis.ai/models/gemini-3-1-flash-lite-preview - 说明: 包含输出速度、TTFT、智能指数等独立评测数据

- 链接:

-

Google 官方博客: Gemini 3.1 Flash-Lite 发布公告

- 链接:

blog.google/innovation-and-ai/models-and-research/gemini-models/gemini-3-1-flash-lite/ - 说明: 官方发布文章,介绍产品定位和核心特性

- 链接:

作者: APIYI 技术团队

技术交流: 欢迎在评论区讨论,更多资料可访问 API易 docs.apiyi.com 文档中心