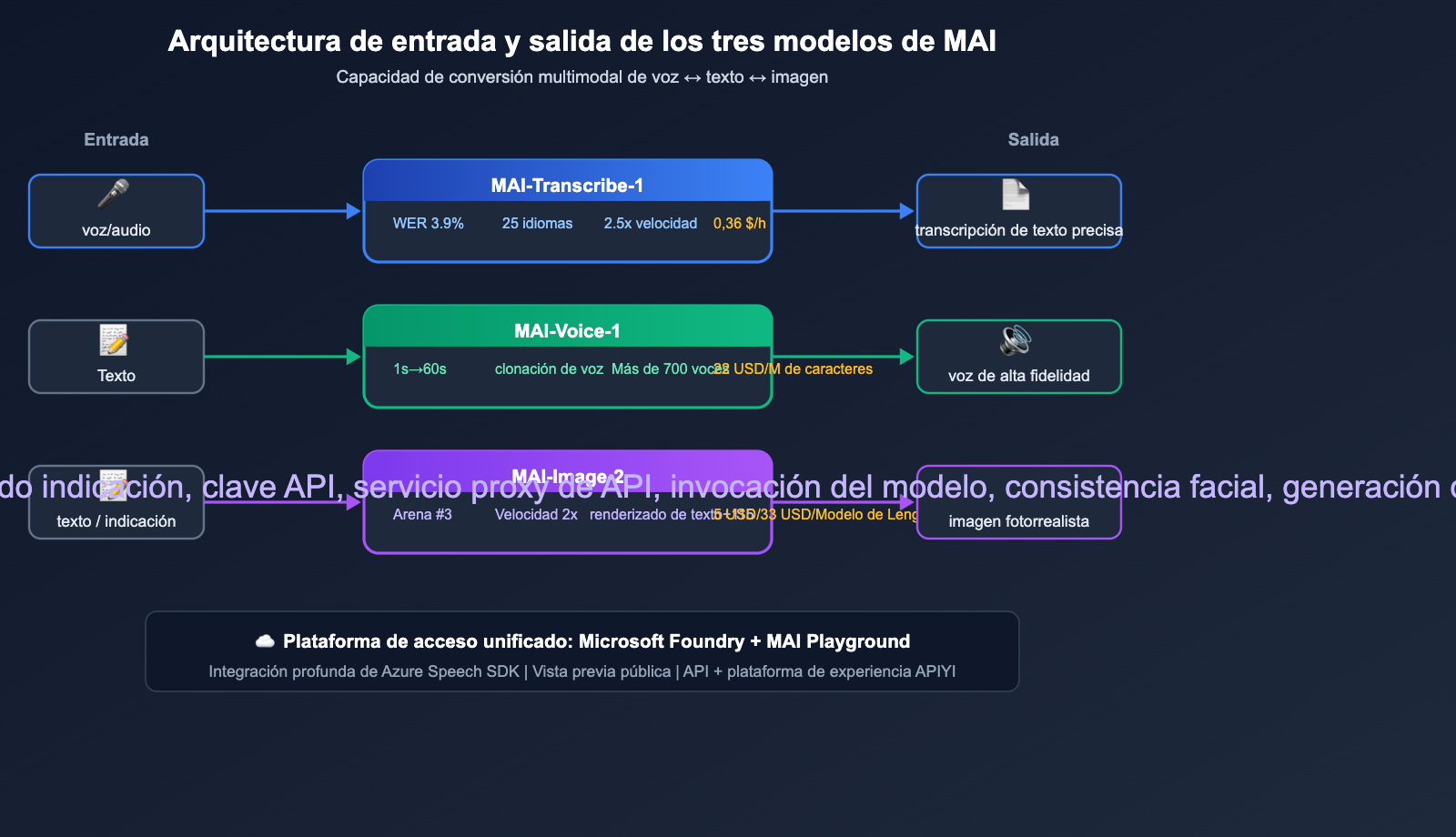

El 2 de abril de 2026, el equipo de superinteligencia MAI de Microsoft presentó oficialmente 3 modelos base de desarrollo propio: MAI-Transcribe-1 (transcripción de voz a texto), MAI-Voice-1 (generación de voz) y MAI-Image-2 (generación de imágenes). Este es el primer lanzamiento importante de productos desde la formación del equipo MAI, liderado por Mustafa Suleyman, y marca el inicio de la construcción de capacidades de modelos de IA independientes de OpenAI por parte de Microsoft.

Valor central: Entiende en 3 minutos los parámetros técnicos clave, el rendimiento de referencia, los precios de la API y el impacto en el panorama de la industria de la IA de los tres nuevos modelos de Microsoft MAI.

Resumen rápido: Los 3 nuevos modelos de Microsoft MAI

| Elemento de información | Detalles |

|---|---|

| Fecha de lanzamiento | 2 de abril de 2026 |

| Lanzado por | Equipo de superinteligencia MAI de Microsoft (CEO: Mustafa Suleyman) |

| Modelos lanzados | MAI-Transcribe-1 / MAI-Voice-1 / MAI-Image-2 |

| Acceso a la plataforma | Microsoft Foundry + MAI Playground |

| Importancia estratégica | Primeros modelos base multimodales desarrollados internamente por Microsoft, reduciendo la dependencia de OpenAI |

| Estado actual | Vista previa pública (Public Preview) |

Estos tres modelos cubren las áreas de reconocimiento de voz, generación de voz y generación de imágenes, marcando la primera vez que Microsoft lanza modelos base competitivos de forma independiente tras renegociar los términos de colaboración con OpenAI.

Análisis profundo del modelo de voz a texto de Microsoft: MAI-Transcribe-1

Parámetros técnicos clave de MAI-Transcribe-1

MAI-Transcribe-1 es el modelo de reconocimiento de voz más potente de Microsoft hasta la fecha, logrando el primer lugar general en el benchmark FLEURS.

| Dimensión del parámetro | MAI-Transcribe-1 |

|---|---|

| Idiomas admitidos | 25 idiomas |

| FLEURS Benchmark WER | ~3.9% (Primero en general) |

| Velocidad de procesamiento | 2.5 veces más rápido que la solución Azure Fast |

| Coste de GPU | Aproximadamente un 50% menos que la competencia |

| Precio de la API | $0.36/hora |

| Ventaja principal | WER más bajo en 11 idiomas clave |

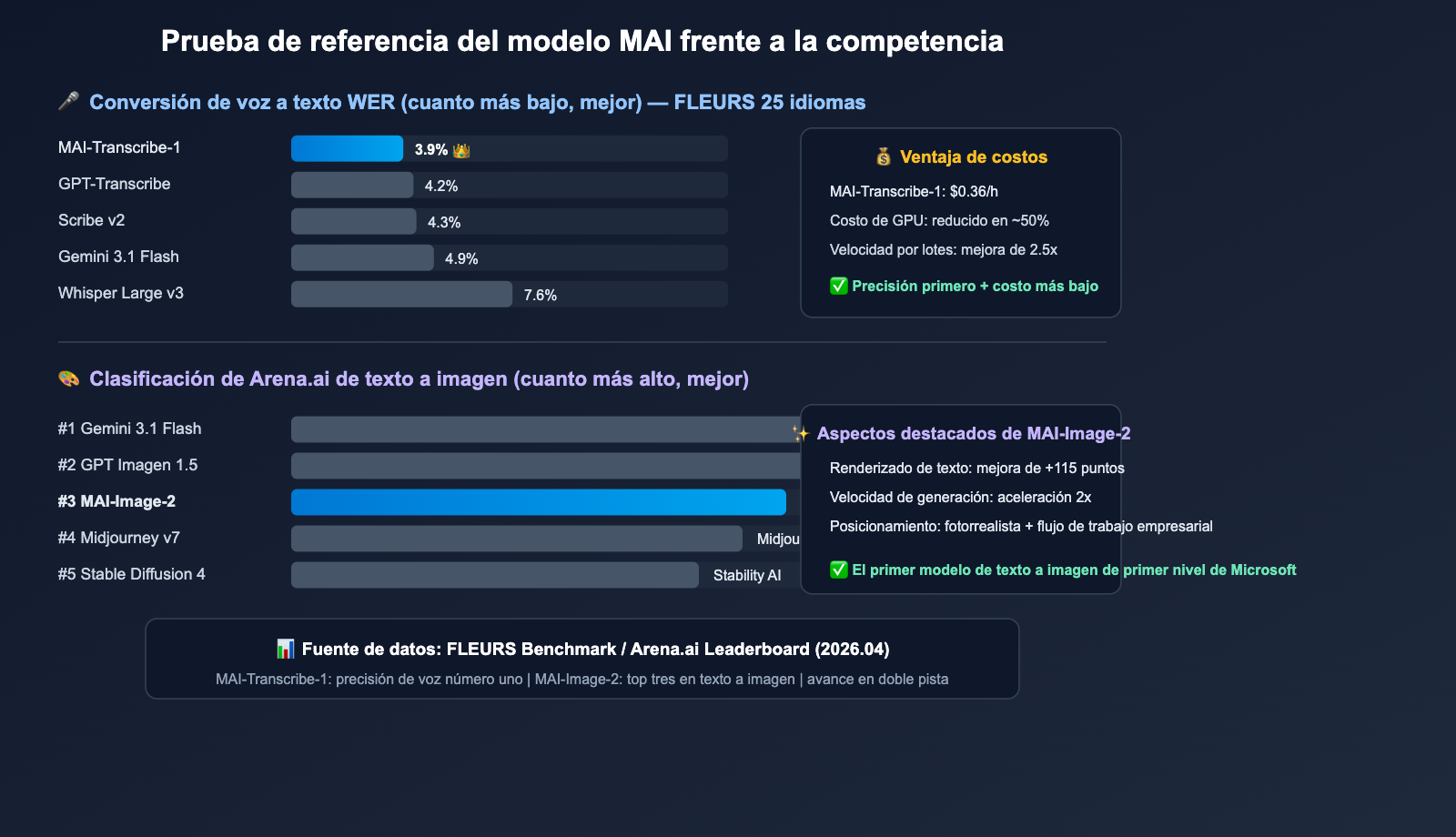

Comparativa de WER de MAI-Transcribe-1 frente a la competencia

En el benchmark de 25 idiomas FLEURS, la tasa de error de palabras (WER) de MAI-Transcribe-1 lidera en todos los aspectos:

| Modelo | FLEURS WER | Idiomas con ventaja | Referencia de precio |

|---|---|---|---|

| MAI-Transcribe-1 | ~3.9% | 11/25 primero | $0.36/hora |

| GPT-Transcribe (OpenAI) | ~4.2% | — | Facturación por token |

| Scribe v2 (ElevenLabs) | ~4.3% | — | Desde $0.40/hora |

| Gemini 3.1 Flash | ~4.9% | — | Facturación por token |

| Whisper Large v3 | ~7.6% | — | Código abierto gratuito |

Las 5 ventajas principales de MAI-Transcribe-1

1. Precisión multilingüe de nivel empresarial

MAI-Transcribe-1 ocupa el primer lugar general en 25 idiomas, logrando el WER más bajo de la industria en 11 idiomas clave (incluidos inglés, chino, japonés, español, etc.). En los 14 idiomas restantes, también supera a Whisper Large v3 y supera a Gemini 3.1 Flash en 11 de ellos.

2. Velocidad de procesamiento por lotes 2.5 veces mayor

En comparación con la solución de transcripción de voz Azure Fast anterior de Microsoft, la velocidad de procesamiento por lotes de MAI-Transcribe-1 ha aumentado 2.5 veces. Esto significa una mejora significativa en la eficiencia para escenarios como la revisión de grabaciones de centros de llamadas, la generación por lotes de actas de reuniones y la creación de subtítulos de video.

3. Coste de GPU reducido en aproximadamente un 50%

Gracias a la optimización de la arquitectura del modelo, MAI-Transcribe-1 ha reducido los costes de inferencia de GPU a la mitad mientras mantiene una precisión de primer nivel. Esto reduce drásticamente el coste total de propiedad para tareas de transcripción de voz a gran escala.

4. Amplia gama de escenarios de aplicación

- Sistemas IVR: Transcripción en tiempo real de respuesta de voz interactiva.

- Centros de llamadas: Transcripción y análisis automático de conversaciones de servicio al cliente.

- Subtítulos en vivo: Generación de subtítulos en tiempo real para eventos y reuniones.

- Producción de video: Generación automática de subtítulos para contenido de video.

- Investigación de mercado: Transcripción por lotes de grabaciones de entrevistas.

5. Precio de API competitivo

El precio de $0.36/hora tiene una clara ventaja competitiva en servicios de transcripción de voz de nivel empresarial, especialmente considerando su rendimiento líder en WER.

🎯 Consejo para desarrolladores: Para los desarrolladores que necesitan integrar capacidades de transcripción de voz en sus aplicaciones, MAI-Transcribe-1 proporciona acceso a la API a través de Microsoft Foundry. Si necesitas invocar múltiples modelos de IA simultáneamente (como transcripción de voz + generación de texto + generación de imágenes), puedes usar la plataforma APIYI (apiyi.com) para gestionar de forma unificada las llamadas a la API de diferentes proveedores, simplificando la complejidad de ingeniería de la integración de múltiples modelos.

Análisis técnico del modelo de generación de voz MAI-Voice-1 de Microsoft

Parámetros clave de MAI-Voice-1

MAI-Voice-1 es el modelo de generación de voz de alta eficiencia lanzado por Microsoft, cuyo punto fuerte es su rendimiento excepcional en la generación.

| Dimensión del parámetro | MAI-Voice-1 |

|---|---|

| Eficiencia de generación | Menos de 1 segundo para generar 60 segundos de audio en una sola GPU |

| Clonación de voz | Crea una voz personalizada con solo 10 segundos de muestra de audio |

| Biblioteca de voces | Más de 700 voces preestablecidas disponibles |

| Precio de API | $22 por millón de caracteres |

| Integración | Azure Speech / Microsoft Foundry |

| Aplicaciones existentes | Funciones de expresión de audio y podcast de Copilot |

Características técnicas principales de MAI-Voice-1

1. Eficiencia de generación extrema

Es capaz de generar 60 segundos de voz de alta calidad en menos de 1 segundo utilizando una sola GPU. Esta eficiencia convierte a MAI-Voice-1 en uno de los sistemas de síntesis de voz más eficaces del mercado, ideal para aplicaciones que requieren retroalimentación de voz en tiempo real.

2. Clonación de voz en 10 segundos

La función de voz personal permite a los usuarios crear voces personalizadas altamente realistas con solo 10 segundos de muestra de audio. No obstante, el uso de esta función requiere pasar por el proceso de aprobación de IA responsable de Microsoft.

3. Galería de más de 700 voces

A través de la integración con Azure Speech, los desarrolladores pueden acceder a más de 700 voces preestablecidas que cubren una amplia variedad de idiomas, acentos y estilos, satisfaciendo las necesidades de diversos escenarios de aplicación.

4. Salida de voz con gran expresividad

MAI-Voice-1 no solo genera una voz clara, sino que también simula matices emocionales, incluyendo cambios de tono, ritmo de pausas y expresividad emocional, lo que hace que la voz generada suene mucho más natural y viva.

💡 Escenarios de aplicación: MAI-Voice-1 es especialmente adecuado para la producción de audiolibros, la generación automática de podcasts, respuestas de voz para atención al cliente y asistencia para la accesibilidad, entre otros. Los desarrolladores pueden combinarlo con un Modelo de Lenguaje Grande para generar texto y luego convertirlo a voz mediante MAI-Voice-1, construyendo así una línea de trabajo completa de asistente de voz por IA. Puedes acceder fácilmente a la fase de generación de texto con LLM a través de la plataforma APIYI apiyi.com.

MAI-Image-2: Análisis detallado del modelo de generación de imágenes más potente de Microsoft

Parámetros clave de MAI-Image-2

MAI-Image-2 es el primer modelo de generación de imágenes desarrollado internamente por Microsoft que cuenta con una competitividad de primer nivel en los rankings de la industria.

| Dimensión del parámetro | MAI-Image-2 |

|---|---|

| Ranking en Arena.ai | 3.º puesto (solo por detrás de Gemini 3.1 Flash y GPT Image 1.5) |

| Velocidad de generación | Más de 2 veces más rápido que la generación anterior |

| Mejora en renderizado de texto | Mejora de 115 puntos respecto a la generación anterior |

| Precio de entrada | $5 por millón de tokens |

| Precio de salida | $33 por millón de tokens |

| Ventaja principal | Fotorrealismo, renderizado de texto potente, precisión en diseños complejos |

Posición de MAI-Image-2 en el ranking de Arena.ai

| Puesto | Modelo | Fabricante | Ventaja principal |

|---|---|---|---|

| 1 | Gemini 3.1 Flash Image | El más fuerte en multimodalidad integral | |

| 2 | GPT Image 1.5 | OpenAI | Líder en diversidad creativa |

| 3 | MAI-Image-2 | Microsoft | Renderizado de texto + Fotorrealismo |

| 4 | Midjourney v7 | Midjourney | Estilo artístico destacado |

| 5 | Stable Diffusion 4 | Stability AI | Ecosistema de código abierto |

Los 4 puntos técnicos destacados de MAI-Image-2

1. Fotorrealismo

MAI-Image-2 ha alcanzado un nuevo nivel en la generación de imágenes con estilo fotográfico realista. Los efectos de iluminación volumétrica, las texturas de materiales y las transiciones de luces y sombras alcanzan un estándar cercano a las fotografías reales, siendo ideal para publicidad comercial y exhibición de productos.

2. Mejora significativa en la capacidad de renderizado de texto

En comparación con el modelo anterior, la capacidad de renderizado de texto dentro de la imagen de MAI-Image-2 ha mejorado en 115 puntos. Esto significa que, al generar infografías, carteles, letreros y otras imágenes que contienen elementos textuales, la claridad y precisión del texto son notablemente superiores.

3. Precisión en el manejo de diseños complejos

En tareas de generación que involucran múltiples objetos, relaciones espaciales complejas y escenas detalladas, MAI-Image-2 demuestra una mayor precisión de composición que sus competidores, reduciendo problemas de superposición de objetos y desproporción.

4. Integración en flujos de trabajo de nivel empresarial

WPP, el grupo publicitario más grande del mundo, ya está utilizando MAI-Image-2 a gran escala para la producción creativa. Microsoft posiciona este modelo como una herramienta de productividad para diseñadores y especialistas en marketing, integrándolo profundamente en el ecosistema de Microsoft 365.

🔧 Práctica técnica: En aplicaciones reales de generación de imágenes por IA, los desarrolladores suelen necesitar comparar los resultados de varios modelos. A través de la plataforma APIYI (apiyi.com), es posible acceder de forma unificada a las API de diversos modelos de generación de imágenes como DALL-E y Stable Diffusion, facilitando el cambio rápido entre modelos y la comparación de resultados.

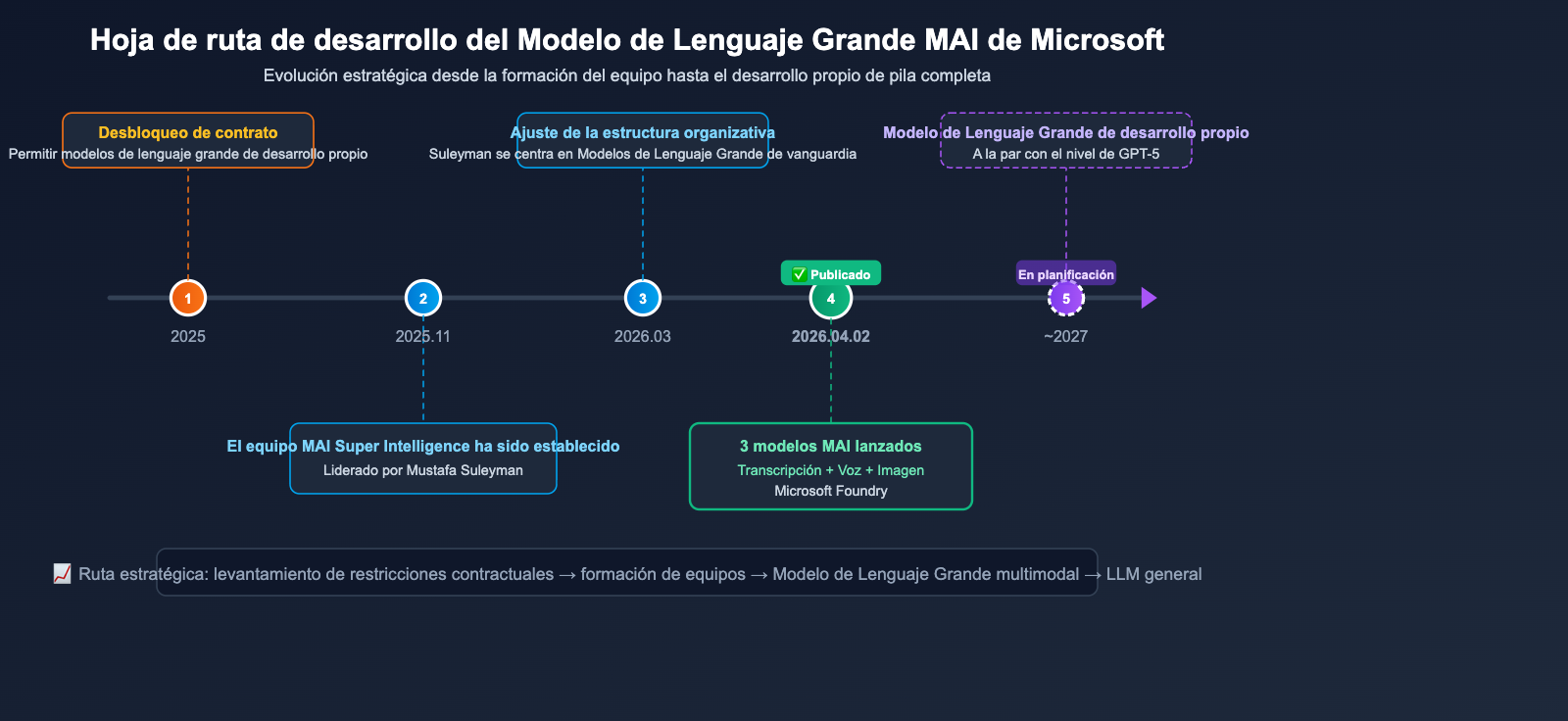

Estrategia MAI de Microsoft: El primer paso para romper la dependencia de OpenAI

¿Por qué Microsoft desarrolla sus propios modelos?

La relación entre Microsoft y OpenAI está experimentando cambios sutiles. El lanzamiento de estos tres modelos MAI es una señal estratégica clara.

Cronología clave:

- 2025: Microsoft renegocia los términos de colaboración con OpenAI, eliminando las restricciones contractuales que limitaban a Microsoft para desarrollar sus propios modelos de IA generales.

- Noviembre de 2025: Mustafa Suleyman forma el equipo de superinteligencia MAI, centrado en la investigación y desarrollo de modelos de vanguardia.

- Marzo de 2026: Satya Nadella anuncia una reestructuración organizativa; Suleyman se centra totalmente en modelos de vanguardia y deja de dirigir las operaciones diarias de Copilot.

- 2 de abril de 2026: El equipo MAI lanza los tres primeros modelos base de desarrollo propio.

- Objetivo para 2027: Plan de lanzamiento de un Modelo de Lenguaje Grande general que compita al nivel de GPT-5.

Situación actual de la matriz de modelos de IA de Microsoft

| Categoría de modelo | Proporcionado por OpenAI | Desarrollo propio de Microsoft (MAI) |

|---|---|---|

| LLM general | GPT-5.4 (Núcleo de Copilot) | En planificación (2027) |

| Reconocimiento de voz | Whisper / GPT-Transcribe | MAI-Transcribe-1 ✅ |

| Generación de voz | — | MAI-Voice-1 ✅ |

| Texto a imagen | DALL-E 3 | MAI-Image-2 ✅ |

| Modelo de código | Codex | En planificación |

¿Qué significa esto para los desarrolladores?

Microsoft está construyendo un sistema de suministro de modelos de IA de "doble vía": por un lado, sigue utilizando el LLM general de OpenAI (GPT-5.4) y, por otro, lanza alternativas propias en los sectores de voz e imagen. Esto significa que los desarrolladores tendrán más opciones dentro del ecosistema de Microsoft.

🎯 Perspectiva de la industria: El lanzamiento de los modelos de desarrollo propio de Microsoft significa que la competencia en el mercado de modelos de IA se intensificará aún más. Para los desarrolladores, elegir qué modelo usar y a través de qué canal acceder a él se vuelve fundamental. Al acceder de forma unificada a las API de modelos de IA de múltiples fabricantes a través de la plataforma APIYI (apiyi.com), es posible cambiar de modelo base sin modificar el código, respondiendo así a un mercado en rápida evolución.

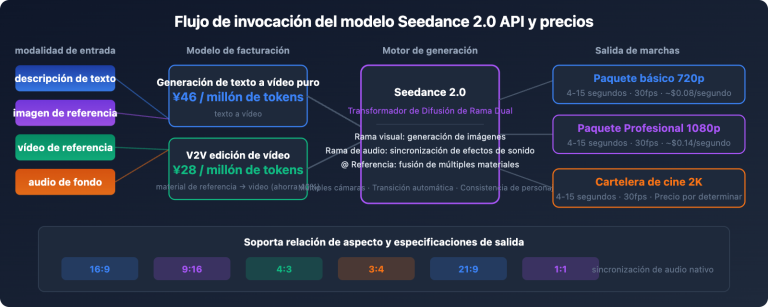

Precios y acceso a la API de los modelos Microsoft MAI

Resumen de precios de los tres modelos

| Modelo | Método de facturación | Precio | Plataforma de acceso |

|---|---|---|---|

| MAI-Transcribe-1 | Por duración de audio | $0.36/hora | Microsoft Foundry / Azure Speech |

| MAI-Voice-1 | Por número de caracteres | $22/millón de caracteres | Microsoft Foundry / Azure Speech |

| MAI-Image-2 | Por número de tokens | Entrada $5/millón + Salida $33/millón de tokens | Microsoft Foundry |

Métodos de acceso

Opción 1: Microsoft Foundry

Los tres modelos ofrecen acceso a la API a través de la plataforma para desarrolladores Microsoft Foundry en modalidad de vista previa pública. Los desarrolladores pueden realizar la invocación del modelo directamente a través de los puntos finales de API de Foundry.

Opción 2: MAI Playground

MAI Playground es la nueva plataforma de experiencia de modelos de Microsoft, donde los desarrolladores pueden probar gratuitamente las capacidades de MAI-Transcribe-1 y MAI-Voice-1 para evaluar rápidamente si se ajustan a sus casos de uso.

Opción 3: Integración con Azure Speech

MAI-Transcribe-1 y MAI-Voice-1 están profundamente integrados en el servicio Azure Speech, por lo que los usuarios actuales de Azure pueden invocarlos directamente a través del SDK de Azure Speech.

💰 Optimización de costes: Al construir aplicaciones de IA multimodal, la transcripción de voz, la generación de texto y la generación de imágenes suelen requerir la combinación de modelos de diferentes proveedores. A través de la plataforma APIYI (apiyi.com), puedes gestionar de forma unificada tus claves API y el consumo, evitando los costes de gestión que supone registrarse por separado en múltiples plataformas. La plataforma admite el acceso a modelos de diversos proveedores, incluidos Microsoft, OpenAI, Anthropic y Alibaba Cloud, entre otros.

Análisis del impacto de los modelos Microsoft MAI en la industria de la IA

Impacto en el mercado de modelos de IA

1. Cambios en el panorama de la tecnología de reconocimiento de voz

Con una tasa de error de palabras (WER) de 3.9%, MAI-Transcribe-1 desafía directamente a GPT-Transcribe de OpenAI (4.2%) y a Scribe v2 de ElevenLabs (~4.3%). Sumado a una ventaja de costes del 50%, se espera que capture rápidamente cuota de mercado en la transcripción de voz a nivel empresarial.

2. Intensificación de la competencia en generación de imágenes (texto a imagen)

MAI-Image-2 ha alcanzado el top 3 en Arena.ai, consolidando un panorama de tres grandes competidores en el sector de texto a imagen: Google (Gemini 3.1 Flash), OpenAI (GPT Image 1.5) y Microsoft (MAI-Image-2). Esto ejerce una mayor presión sobre proveedores independientes como Midjourney y Stability AI.

3. La tendencia de los gigantes de la IA hacia el "desarrollo propio de pila completa"

Siguiendo los pasos de Google (serie Gemini) y Meta (serie Llama), Microsoft también ha comenzado a construir capacidades de modelos de IA de pila completa. Esto significa que la competencia futura en el mercado de la IA se concentrará cada vez más en unos pocos grandes fabricantes.

Impacto en los desarrolladores

- Más opciones de modelos: El ecosistema de Microsoft ya no se limita únicamente a OpenAI.

- Competencia de precios más intensa: La competencia entre múltiples proveedores impulsará una mayor reducción en los precios de las API.

- Uso combinado de múltiples modelos: Los desarrolladores deben aprender a seleccionar de forma flexible modelos de diferentes proveedores según el escenario.

🚀 Consejo de desarrollo: Ante la creciente oferta de modelos de IA, recomendamos a los desarrolladores utilizar plataformas de acceso unificado como APIYI (apiyi.com) para gestionar la invocación del modelo y evitar el bloqueo por parte de un único proveedor. La plataforma ofrece una interfaz estándar compatible con OpenAI, por lo que cambiar de modelo solo requiere modificar el parámetro

model.

Preguntas frecuentes sobre los modelos MAI de Microsoft

Q1: ¿Qué relación existe entre los modelos MAI y los modelos de OpenAI?

Los modelos MAI han sido desarrollados de forma independiente por el equipo de superinteligencia MAI de Microsoft y no tienen relación con OpenAI. Actualmente, Microsoft sigue una estrategia de "doble vía": los Modelos de Lenguaje Grande generales continúan utilizando GPT-5.4 de OpenAI, mientras que para los ámbitos de voz e imagen, la compañía ha lanzado su propia serie MAI. Tras la renegociación del contrato entre Microsoft y OpenAI en 2025, se eliminaron las cláusulas que limitaban el desarrollo de modelos propios por parte de Microsoft.

Q2: ¿Cuánto mejor es MAI-Transcribe-1 en comparación con Whisper?

En la prueba de referencia de 25 idiomas FLEURS, la tasa de error de palabras (WER) de MAI-Transcribe-1 es de aproximadamente el 3,9 %, mientras que la de Whisper Large v3 es de alrededor del 7,6 %, lo que supone una diferencia notable en precisión. Además, la velocidad de procesamiento por lotes de MAI-Transcribe-1 es 2,5 veces mayor que la solución Azure Fast, reduciendo los costes de GPU en cerca de un 50 %. No obstante, la ventaja de Whisper reside en que es de código abierto y gratuito, ideal para escenarios extremadamente sensibles a los costes.

Q3: ¿Puede MAI-Image-2 reemplazar a DALL-E?

Según el ranking de Arena.ai, la clasificación general de MAI-Image-2 (3.º puesto) es superior a la de DALL-E 3. MAI-Image-2 destaca especialmente en el renderizado de texto y en el fotorrealismo. Sin embargo, DALL-E sigue teniendo un desempeño único en ciertos estilos creativos. Para los usuarios empresariales, la profunda integración de MAI-Image-2 con el ecosistema de Microsoft puede resultar un atractivo mayor.

Q4: ¿Cómo puedo probar rápidamente estos tres modelos MAI?

La forma más rápida es visitar MAI Playground (la nueva plataforma de experiencia de modelos de Microsoft) para probarlos de forma gratuita. El acceso oficial a la API requiere pasar por la plataforma de desarrolladores Microsoft Foundry. Si tu aplicación necesita invocar múltiples modelos de IA simultáneamente, puedes utilizar la plataforma APIYI (apiyi.com) para gestionar de forma unificada el acceso a las API de diferentes proveedores, simplificando así el flujo de desarrollo.

Q5: ¿Cuándo planea Microsoft lanzar su propio Modelo de Lenguaje Grande general?

Según información pública, Microsoft está desplegando clústeres de chips Nvidia GB200 con el objetivo de construir una potencia de cálculo de vanguardia en los próximos 12 a 18 meses. Se espera que alrededor de 2027 se lance un Modelo de Lenguaje Grande general propio capaz de competir con el nivel de GPT-5. Hasta entonces, el Modelo de Lenguaje Grande central de Copilot seguirá utilizando GPT-5.4 de OpenAI.

Resumen de los 3 nuevos modelos de Microsoft MAI

El equipo MAI de Microsoft ha presentado unos resultados impresionantes tras solo 5 meses de trabajo:

- MAI-Transcribe-1: Alcanzó el primer puesto en el benchmark FLEURS con un WER de ~3.9%, logrando una velocidad 2.5 veces mayor y reduciendo los costes en un 50%, con un precio de $0.36/hora.

- MAI-Voice-1: Genera 60 segundos de voz en menos de 1 segundo utilizando una sola GPU, admite clonación de voz de 10 segundos y cuenta con más de 700 voces preestablecidas.

- MAI-Image-2: Ocupa el tercer lugar en el ranking de texto a imagen de Arena.ai, con una mejora de 115 puntos en renderizado de texto y soporte para diseños complejos y fotorrealismo.

El lanzamiento de estos tres modelos no solo demuestra la capacidad de desarrollo propio de Microsoft, sino que también marca una tendencia acelerada hacia el "desarrollo de pila completa por parte de los gigantes" en la industria de la IA. Para los desarrolladores, la oferta de modelos es cada vez mayor; por ello, utilizar plataformas de acceso unificado como APIYI (apiyi.com) para gestionar la invocación del modelo de múltiples proveedores se convertirá en una estrategia clave para mejorar la eficiencia del desarrollo y reducir los costes de cambio.

📝 Autor: Equipo de APIYI | Para más análisis técnicos sobre modelos de IA y guías de acceso a API, visita el Centro de Ayuda de APIYI: help.apiyi.com