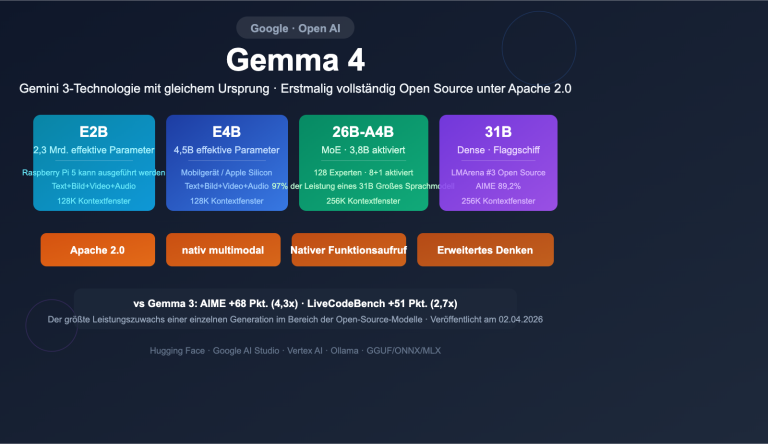

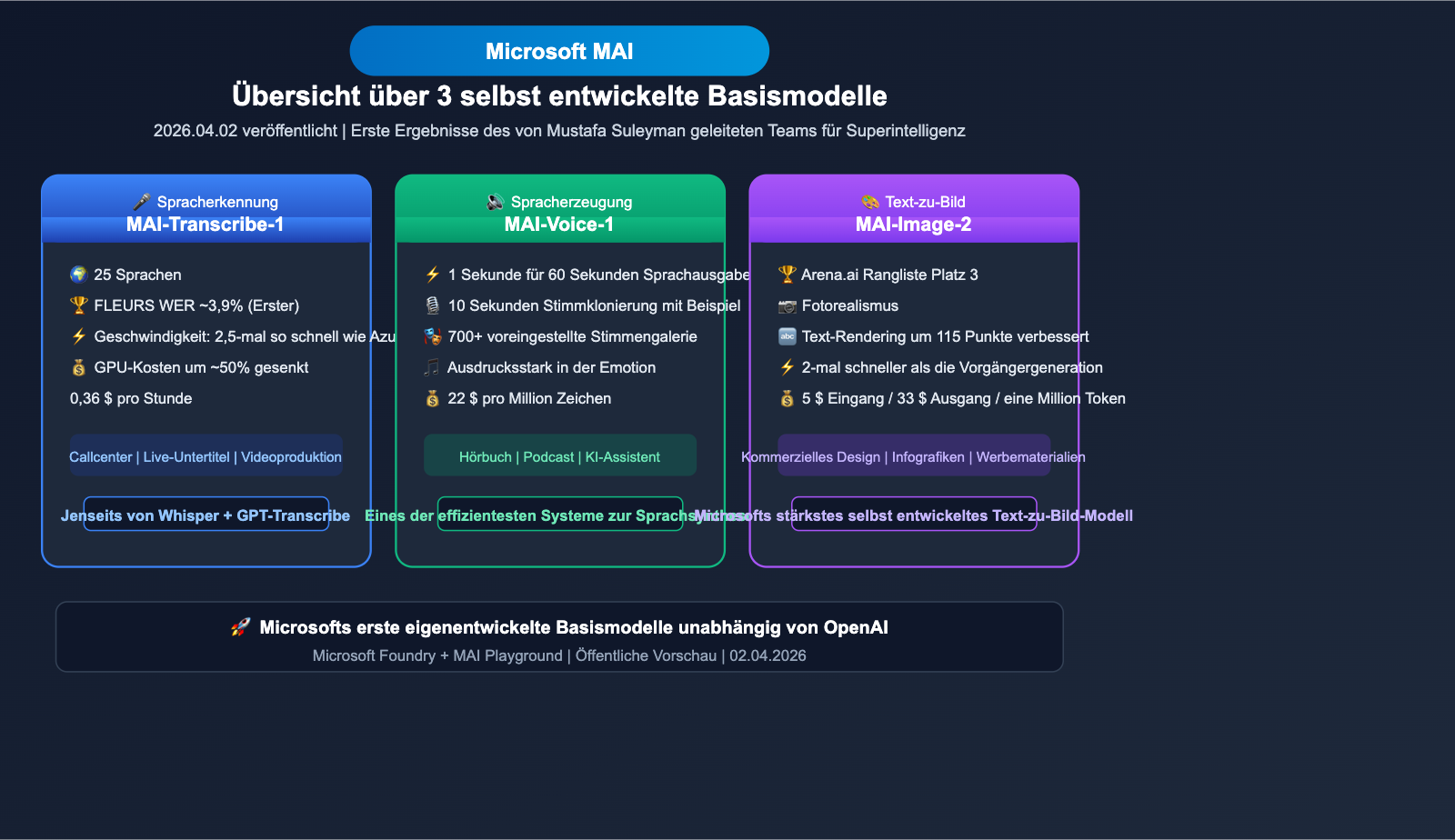

Am 2. April 2026 hat das Microsoft MAI Super Intelligence Team offiziell 3 selbst entwickelte Basismodelle vorgestellt: MAI-Transcribe-1 (Spracherkennung), MAI-Voice-1 (Sprachgenerierung) und MAI-Image-2 (Text-zu-Bild). Dies ist die erste große Produktveröffentlichung seit der Gründung des MAI-Teams unter der Leitung von Mustafa Suleyman und markiert den Beginn von Microsofts Strategie, KI-Modellkapazitäten unabhängig von OpenAI aufzubauen.

Kernbotschaft: Erfahren Sie in 3 Minuten alles über die technischen Parameter, Benchmarks, API-Preise und die Auswirkungen der drei neuen Microsoft MAI-Modelle auf die KI-Branche.

Überblick: Die 3 neuen MAI-Modelle von Microsoft

| Informationspunkt | Details |

|---|---|

| Veröffentlichungsdatum | 2. April 2026 |

| Herausgeber | Microsoft MAI Super Intelligence Team (CEO: Mustafa Suleyman) |

| Veröffentlichte Modelle | MAI-Transcribe-1 / MAI-Voice-1 / MAI-Image-2 |

| Plattform-Zugang | Microsoft Foundry + MAI Playground |

| Strategische Bedeutung | Microsofts erste selbst entwickelte multimodale Basismodelle zur Verringerung der Abhängigkeit von OpenAI |

| Aktueller Status | Public Preview |

Diese drei Modelle decken die Bereiche Spracherkennung, Spracherzeugung und Bilderzeugung ab. Es handelt sich um die ersten wettbewerbsfähigen Basismodelle, die Microsoft nach der Neuverhandlung der Kooperationsbedingungen mit OpenAI eigenständig auf den Markt bringt.

MAI-Transcribe-1: Tiefenanalyse des Microsoft-Modells für Spracherkennung

Technische Kernparameter von MAI-Transcribe-1

MAI-Transcribe-1 ist das bisher leistungsstärkste Spracherkennungsmodell von Microsoft und belegt im FLEURS-Benchmark den ersten Platz in der Gesamtwertung.

| Parameterdimension | MAI-Transcribe-1 |

|---|---|

| Unterstützte Sprachen | 25 Sprachen |

| FLEURS-Benchmark WER | ~3,9 % (Gesamtsieger) |

| Verarbeitungsgeschwindigkeit | 2,5-mal schneller als die Azure Fast-Lösung |

| GPU-Kosten | ca. 50 % niedriger als bei Konkurrenzprodukten |

| API-Preis | 0,36 $/Stunde |

| Hauptvorteil | Niedrigste WER in 11 Kernsprachen |

Vergleich der WER von MAI-Transcribe-1 mit Wettbewerbern

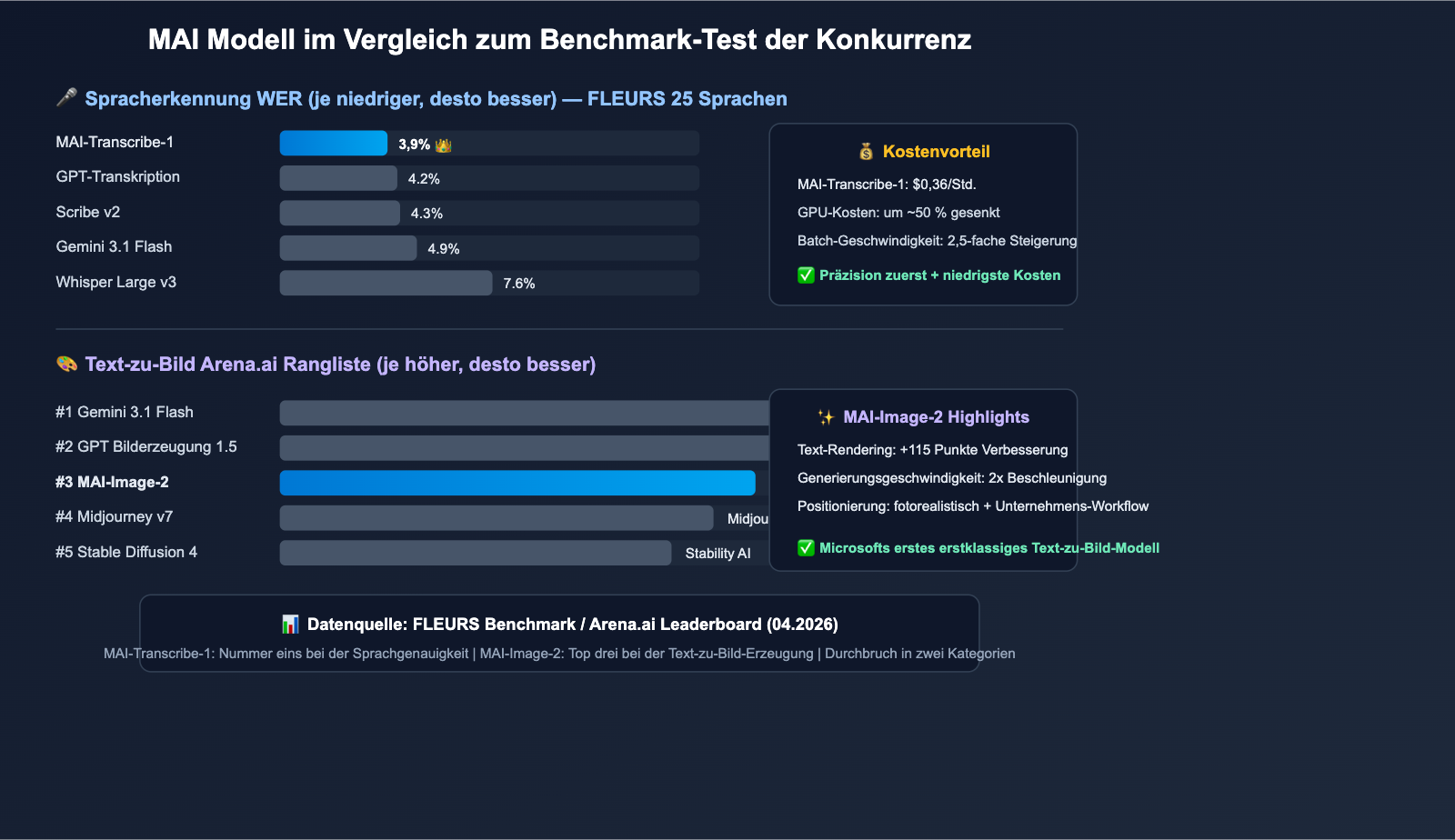

Im FLEURS-Benchmark für 25 Sprachen führt MAI-Transcribe-1 bei der Wortfehlerrate (WER) auf ganzer Linie:

| Modell | FLEURS WER | Anzahl führender Sprachen | Preisreferenz |

|---|---|---|---|

| MAI-Transcribe-1 | ~3,9 % | 11/25 Platz 1 | 0,36 $/Stunde |

| GPT-Transcribe (OpenAI) | ~4,2 % | — | Abrechnung nach Token |

| Scribe v2 (ElevenLabs) | ~4,3 % | — | ab 0,40 $/Stunde |

| Gemini 3.1 Flash | ~4,9 % | — | Abrechnung nach Token |

| Whisper Large v3 | ~7,6 % | — | Open Source kostenlos |

Die 5 Hauptvorteile von MAI-Transcribe-1

1. Mehrsprachige Präzision auf Unternehmensebene

MAI-Transcribe-1 belegt in 25 Sprachen den ersten Platz in der Gesamtwertung. In 11 Kernsprachen (darunter Englisch, Chinesisch, Japanisch, Spanisch usw.) erreicht es die branchenweit niedrigste WER. Auch in den restlichen 14 Sprachen übertrifft es Whisper Large v3 und schlägt in 11 davon das Modell Gemini 3.1 Flash.

2. 2,5-fache Steigerung der Stapelverarbeitungsgeschwindigkeit

Im Vergleich zur bisherigen Azure Fast-Lösung für Sprachtranskription wurde die Stapelverarbeitungsgeschwindigkeit von MAI-Transcribe-1 um das 2,5-fache gesteigert. Dies bedeutet eine signifikante Effizienzsteigerung für Szenarien wie die Analyse von Call-Center-Aufzeichnungen, die automatisierte Erstellung von Besprechungsprotokollen und die Untertitelung von Videos.

3. Senkung der GPU-Kosten um ca. 50 %

Durch Optimierungen der Modellarchitektur konnten die GPU-Inferenzkosten bei gleichbleibender Spitzenpräzision etwa halbiert werden. Dies senkt die Gesamtbetriebskosten für groß angelegte Sprachtranskriptionsaufgaben erheblich.

4. Breite Anwendungsmöglichkeiten

- IVR-Systeme: Echtzeit-Transkription bei interaktiven Sprachdialogsystemen

- Call-Center: Automatische Transkription und Analyse von Kundengesprächen

- Live-Untertitel: Generierung von Untertiteln in Echtzeit bei Veranstaltungen und Meetings

- Videoproduktion: Automatische Erstellung von Untertiteln für Videoinhalte

- Marktforschung: Stapeltranskription von Interviewaufzeichnungen

5. Wettbewerbsfähige API-Preise

Der Preis von 0,36 $/Stunde bietet einen deutlichen Wettbewerbsvorteil bei Sprachtranskriptionsdiensten für Unternehmen, insbesondere in Anbetracht der führenden WER-Leistung.

🎯 Entwickler-Tipp: Für Entwickler, die Sprachtranskriptionsfunktionen in ihre Anwendungen integrieren möchten, bietet MAI-Transcribe-1 einen API-Zugang über Microsoft Foundry. Wenn Sie gleichzeitig verschiedene KI-Modelle (z. B. Sprachtranskription + Textgenerierung + Bilderzeugung) aufrufen müssen, können Sie die API-Aufrufe verschiedener Anbieter über die Plattform APIYI (apiyi.com) zentral verwalten und so die technische Komplexität der Integration mehrerer Modelle vereinfachen.

Technische Analyse des Microsoft-Sprachgenerierungsmodells MAI-Voice-1

Kernparameter von MAI-Voice-1

MAI-Voice-1 ist das hocheffiziente Sprachgenerierungsmodell von Microsoft, dessen Hauptmerkmal die extrem hohe Generierungsgeschwindigkeit ist.

| Parameter-Dimension | MAI-Voice-1 |

|---|---|

| Generierungseffizienz | Unter 1 Sekunde für 60 Sekunden Audio auf einer GPU |

| Stimmklonung | Erstellung einer benutzerdefinierten Stimme mit nur 10 Sekunden Audiomaterial |

| Stimmenbibliothek | Über 700 voreingestellte Stimmen verfügbar |

| API-Preise | 22 $ pro Million Zeichen |

| Integrationsmethode | Azure Speech / Microsoft Foundry |

| Bestehende Anwendungen | Copilot-Audioausgabe und Podcast-Funktionen |

Technische Hauptmerkmale von MAI-Voice-1

1. Extreme Generierungseffizienz

Auf einer einzelnen GPU können innerhalb von weniger als einer Sekunde 60 Sekunden hochwertige Sprache generiert werden. Diese Effizienz macht MAI-Voice-1 zu einem der leistungsfähigsten Sprachsynthese-Systeme, das sich besonders für Anwendungen eignet, die eine Sprachausgabe in Echtzeit erfordern.

2. 10-Sekunden-Stimmklonung

Die Funktion „Personal Voice“ ermöglicht es Benutzern, mit nur 10 Sekunden Audiomaterial eine hochpräzise, benutzerdefinierte Stimme zu erstellen. Diese Funktion unterliegt jedoch den Richtlinien von Microsoft für verantwortungsvolle KI und erfordert eine entsprechende Genehmigung.

3. Über 700 Stimmen zur Auswahl

Durch die Integration in Azure Speech können Entwickler auf über 700 voreingestellte Stimmen zugreifen, die eine Vielzahl von Sprachen, Akzenten und Stilen abdecken und so unterschiedliche Anforderungen erfüllen.

4. Ausdrucksstarke Sprachausgabe

MAI-Voice-1 erzeugt nicht nur klare Sprache, sondern kann auch emotionale Nuancen simulieren – einschließlich Tonfalländerungen, Pausenrhythmen und emotionalem Ausdruck, was die generierte Sprache natürlicher und lebendiger macht.

💡 Anwendungsbereiche: MAI-Voice-1 eignet sich besonders für die Produktion von Hörbüchern, die automatische Generierung von Podcasts, Sprachantwortsysteme im Kundenservice sowie für Barrierefreiheitslösungen. Entwickler können Texte mithilfe eines großen Sprachmodells erstellen und diese anschließend über MAI-Voice-1 in Sprache umwandeln, um eine vollständige KI-Sprachassistenten-Pipeline aufzubauen. Über die Plattform APIYI (apiyi.com) lässt sich die LLM-Textgenerierung bequem integrieren.

MAI-Image-2: Detaillierte Analyse von Microsofts leistungsstärkstem Text-zu-Bild-Modell

Die Kernparameter von MAI-Image-2

MAI-Image-2 ist das erste von Microsoft selbst entwickelte Text-zu-Bild-Modell, das in Branchen-Rankings auf höchstem Niveau konkurrenzfähig ist.

| Parameter-Dimension | MAI-Image-2 |

|---|---|

| Arena.ai-Ranking | Platz 3 (nur hinter Gemini 3.1 Flash und GPT Image 1.5) |

| Erzeugungsgeschwindigkeit | Über 2-mal schneller als der Vorgänger |

| Text-Rendering-Verbesserung | 115 Punkte Steigerung gegenüber dem Vorgänger |

| Eingabepreis | $5 pro Million Token |

| Ausgabepreis | $33 pro Million Token |

| Kernvorteile | Fotorealismus, starkes Text-Rendering, Präzision bei komplexen Layouts |

Position von MAI-Image-2 im Arena.ai-Ranking

| Rang | Modell | Anbieter | Kernvorteil |

|---|---|---|---|

| 1 | Gemini 3.1 Flash Image | Beste multimodale Gesamtleistung | |

| 2 | GPT Image 1.5 | OpenAI | Führend bei kreativer Vielfalt |

| 3 | MAI-Image-2 | Microsoft | Text-Rendering + Fotorealismus |

| 4 | Midjourney v7 | Midjourney | Herausragender künstlerischer Stil |

| 5 | Stable Diffusion 4 | Stability AI | Open-Source-Ökosystem |

Die 4 technischen Highlights von MAI-Image-2

1. Fotorealismus

MAI-Image-2 erreicht bei der Erzeugung von Bildern im fotorealistischen Stil ein neues Niveau. Details wie volumetrische Lichteffekte, Materialtexturen und Licht-Schatten-Übergänge kommen der Qualität echter Fotos sehr nahe – ideal für kommerzielle Werbung und Produktpräsentationen.

2. Deutlich verbessertes Text-Rendering

Im Vergleich zum Vorgängermodell wurde die Fähigkeit von MAI-Image-2, Text innerhalb von Bildern darzustellen, um 115 Punkte verbessert. Dies bedeutet eine deutlich höhere Klarheit und Genauigkeit bei der Erstellung von Infografiken, Postern oder Schildern, die Textelemente enthalten.

3. Präzision bei komplexen Layouts

Bei Aufgaben, die mehrere Objekte, komplexe räumliche Beziehungen und detaillierte Szenen erfordern, zeigt MAI-Image-2 eine höhere Kompositionspräzision als Konkurrenzmodelle und reduziert Probleme wie Objektüberlappungen oder falsche Proportionen.

4. Integration in Workflows auf Unternehmensebene

WPP, die weltweit größte Werbegruppe, setzt MAI-Image-2 bereits in großem Umfang für die kreative Produktion ein. Microsoft positioniert das Modell als Produktivitätswerkzeug für Designer und Marketingexperten, das tief in das Microsoft 365-Ökosystem integriert ist.

🔧 Technische Praxis: Bei der praktischen Anwendung der KI-Bilderzeugung müssen Entwickler häufig die Ergebnisse verschiedener Modelle vergleichen. Über die Plattform APIYI (apiyi.com) können APIs für verschiedene Bilderzeugungsmodelle wie DALL-E oder Stable Diffusion zentral eingebunden werden, was den schnellen Wechsel und direkten Vergleich zwischen verschiedenen Modellen erleichtert.

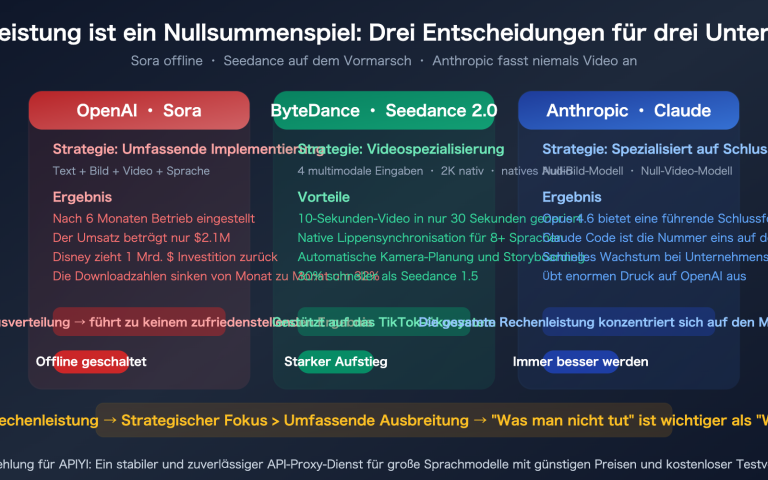

Microsofts MAI-Strategie: Der erste Schritt zur Unabhängigkeit von OpenAI

Warum Microsoft eigene Modelle entwickelt

Die Beziehung zwischen Microsoft und OpenAI durchläuft einen subtilen Wandel. Die Veröffentlichung der drei MAI-Modelle ist ein klares strategisches Signal.

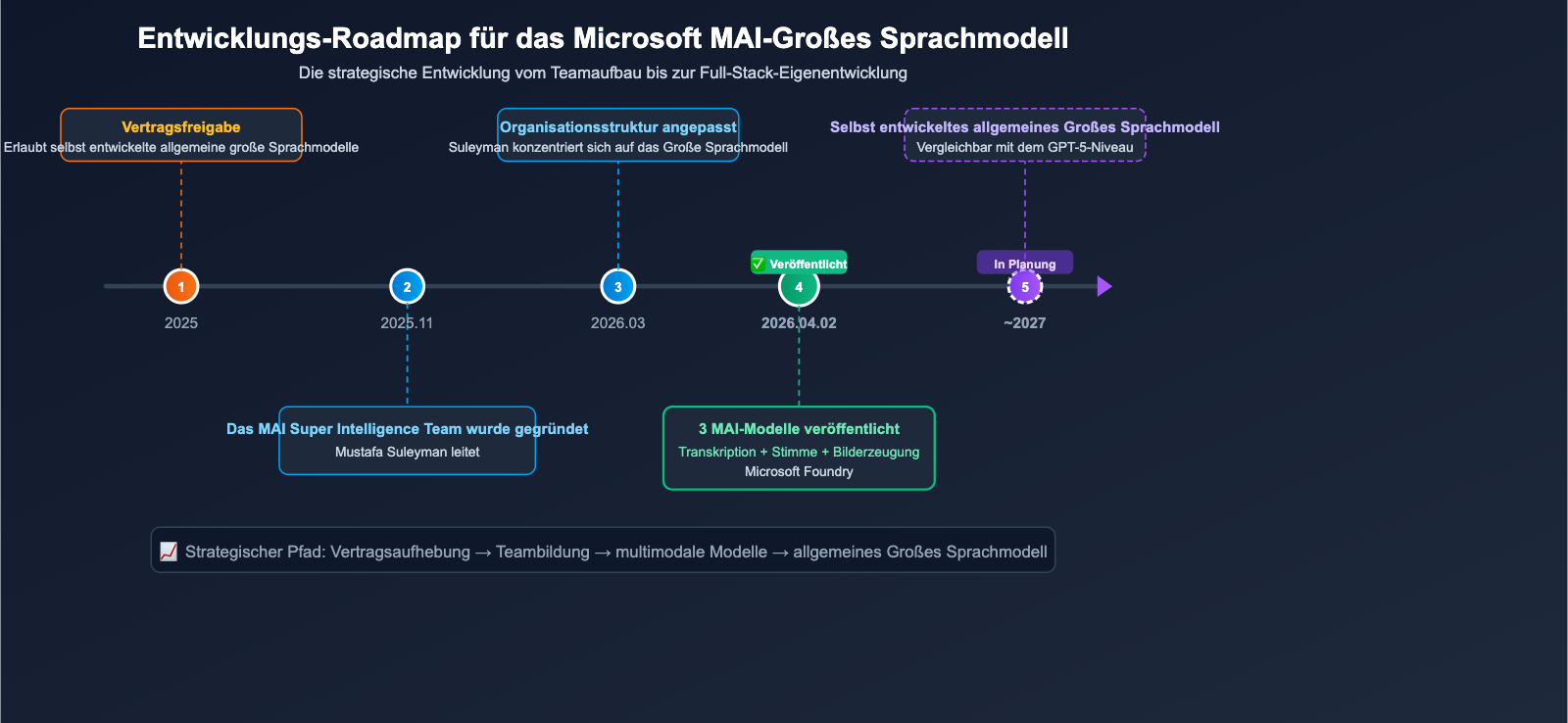

Wichtige Meilensteine:

- 2025: Microsoft und OpenAI verhandeln die Kooperationsbedingungen neu und heben die vertraglichen Beschränkungen auf, die Microsoft bisher an der Entwicklung eigener allgemeiner KI-Modelle hinderten.

- November 2025: Mustafa Suleyman gründet das MAI-Super-Intelligence-Team, das sich auf die Forschung an modernsten Modellen konzentriert.

- März 2026: Satya Nadella kündigt eine Umstrukturierung an; Suleyman konzentriert sich vollständig auf zukunftsweisende Modelle und ist nicht mehr für das Tagesgeschäft von Copilot verantwortlich.

- 2. April 2026: Das MAI-Team veröffentlicht die ersten drei selbst entwickelten Basismodelle.

- Ziel für 2027: Einführung eines allgemeinen Großes Sprachmodell, das mit der GPT-5-Klasse konkurrieren soll.

Status quo der Microsoft KI-Modellmatrix

| Modellkategorie | OpenAI-Angebot | Microsoft Eigenentwicklung (MAI) |

|---|---|---|

| Allgemeines LLM | GPT-5.4 (Copilot-Kern) | In Planung (2027) |

| Spracherkennung | Whisper / GPT-Transcribe | MAI-Transcribe-1 ✅ |

| Spracherzeugung | — | MAI-Voice-1 ✅ |

| Text-zu-Bild | DALL-E 3 | MAI-Image-2 ✅ |

| Codemodelle | Codex | In Planung |

Was das für Entwickler bedeutet

Microsoft baut ein "zweigleisiges" KI-Modell-Versorgungssystem auf: Einerseits wird weiterhin das allgemeine LLM von OpenAI (GPT-5.4) genutzt, andererseits werden im Bereich Sprache und Bild eigene Alternativen eingeführt. Das bedeutet für Entwickler mehr Auswahlmöglichkeiten innerhalb des Microsoft-Ökosystems.

🎯 Branchen-Einblick: Die Einführung der selbst entwickelten Microsoft-Modelle bedeutet, dass der Wettbewerb auf dem KI-Modellmarkt weiter zunehmen wird. Für Entwickler wird die Wahl des Modells und des Zugangsweges immer entscheidender. Über die Plattform APIYI (apiyi.com) können Sie die KI-Modell-APIs verschiedener Anbieter zentral einbinden und so flexibel zwischen den zugrundeliegenden Modellen wechseln, ohne den Code ändern zu müssen – eine wichtige Fähigkeit, um auf die sich schnell verändernde Marktlage zu reagieren.

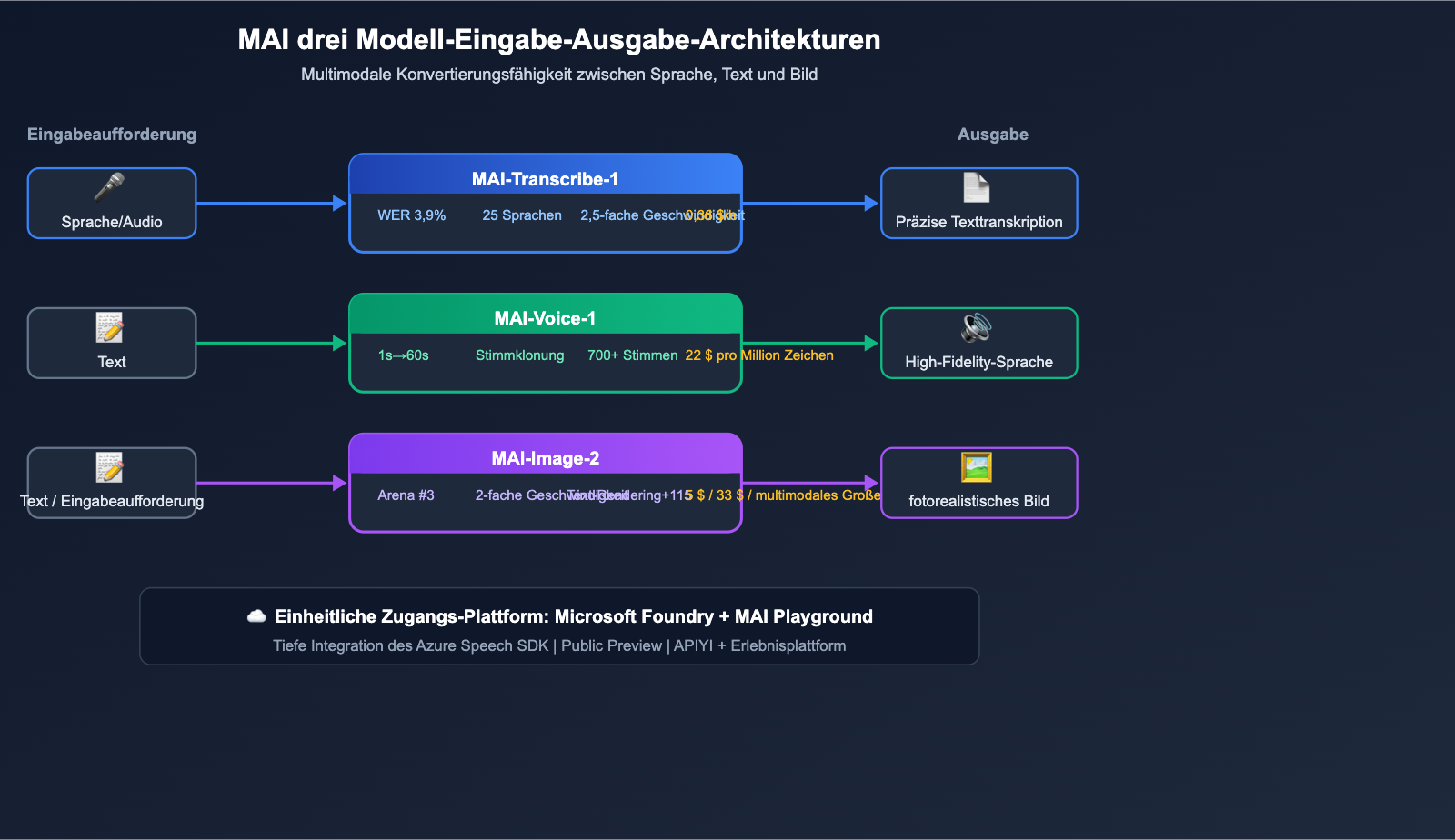

Microsoft MAI-Modell-API: Preisgestaltung und Integrationsmöglichkeiten

Preisübersicht der drei Modelle

| Modell | Abrechnungsmodell | Preis | Integrationsplattform |

|---|---|---|---|

| MAI-Transcribe-1 | pro Audiominute | $0,36/Stunde | Microsoft Foundry / Azure Speech |

| MAI-Voice-1 | pro Zeichen | $22/Million Zeichen | Microsoft Foundry / Azure Speech |

| MAI-Image-2 | pro Token | Input $5/Million + Output $33/Million Token | Microsoft Foundry |

Integrationsmöglichkeiten

Option 1: Microsoft Foundry

Alle drei Modelle sind über die Entwicklerplattform Microsoft Foundry als öffentliche Vorschauversion für den API-Zugriff verfügbar. Entwickler können die Modelle direkt über die API-Endpunkte von Foundry aufrufen.

Option 2: MAI Playground

MAI Playground ist die neue Plattform von Microsoft zum Ausprobieren von Modellen. Entwickler können dort die Funktionen von MAI-Transcribe-1 und MAI-Voice-1 kostenlos testen, um schnell zu bewerten, ob sie für ihre Anwendungsfälle geeignet sind.

Option 3: Azure Speech-Integration

MAI-Transcribe-1 und MAI-Voice-1 sind tief in den Azure Speech-Dienst integriert. Bestehende Azure-Nutzer können diese direkt über das Azure Speech SDK aufrufen.

💰 Kostenoptimierung: Beim Aufbau multimodaler KI-Anwendungen müssen häufig Modelle verschiedener Anbieter für Sprachtranskription, Textgenerierung und Bilderzeugung kombiniert werden. Über die Plattform APIYI (apiyi.com) können Sie API-Schlüssel und Nutzung zentral verwalten und so den Verwaltungsaufwand vermeiden, der durch die separate Registrierung bei mehreren Plattformen entsteht. Die Plattform unterstützt den Modellzugriff von zahlreichen Anbietern, darunter Microsoft, OpenAI, Anthropic und Alibaba Cloud.

Analyse der Auswirkungen der Microsoft MAI-Modelle auf die KI-Branche

Auswirkungen auf den KI-Modellmarkt

1. Veränderung der Wettbewerbslandschaft bei der Spracherkennung

MAI-Transcribe-1 fordert mit einer WER (Word Error Rate) von 3,9 % direkt OpenAI GPT-Transcribe (4,2 %) und ElevenLabs Scribe v2 (~4,3 %) heraus. In Kombination mit einem Kostenvorteil von 50 % ist das Modell gut positioniert, um schnell Marktanteile im Bereich der Sprachtranskription für Unternehmen zu gewinnen.

2. Verschärfter Dreikampf bei der Text-zu-Bild-Generierung

MAI-Image-2 hat es in die Top 3 von Arena.ai geschafft, wodurch sich im Bereich der Bilderzeugung ein Dreikampf zwischen Google (Gemini 3.1 Flash), OpenAI (GPT Image 1.5) und Microsoft (MAI-Image-2) etabliert hat. Dies erhöht den Druck auf unabhängige Anbieter wie Midjourney und Stability AI erheblich.

3. Trend zur „Full-Stack-Eigenentwicklung“ bei KI-Giganten

Nach Google (Gemini-Serie) und Meta (Llama-Serie) beginnt nun auch Microsoft mit dem Aufbau umfassender KI-Modellkapazitäten. Dies bedeutet, dass sich der Wettbewerb auf dem KI-Markt künftig immer stärker auf wenige große Akteure konzentrieren wird.

Auswirkungen auf Entwickler

- Größere Modellauswahl: Im Microsoft-Ökosystem ist OpenAI nicht mehr die einzige Option.

- Verschärfter Preiswettbewerb: Der Wettbewerb zwischen mehreren Anbietern wird die API-Preise weiter senken.

- Kombination verschiedener Modelle: Entwickler müssen lernen, je nach Szenario flexibel Modelle verschiedener Anbieter auszuwählen.

🚀 Entwicklungsempfehlung: Angesichts der schnell wachsenden Auswahl an KI-Modellen empfiehlt es sich für Entwickler, Modellaufrufe über eine einheitliche Plattform wie APIYI (apiyi.com) zu verwalten, um eine Abhängigkeit von einem einzelnen Anbieter zu vermeiden. Die Plattform bietet standardisierte, OpenAI-kompatible Schnittstellen, sodass für einen Modellwechsel lediglich der

model-Parameter angepasst werden muss.

Häufig gestellte Fragen zu Microsofts MAI-Modellen

Q1: In welcher Beziehung stehen die MAI-Modelle zu den OpenAI-Modellen?

Die MAI-Modelle wurden unabhängig vom Microsoft MAI Super-Intelligence-Team entwickelt und stehen in keiner Verbindung zu OpenAI. Microsoft verfolgt derzeit eine „Zwei-Schienen-Strategie“: Während für allgemeine LLMs weiterhin GPT-5.4 von OpenAI eingesetzt wird, führt das Unternehmen für Sprach- und Bildanwendungen die eigenentwickelte MAI-Serie ein. Nach Neuverhandlungen mit OpenAI im Jahr 2025 wurden die Vertragsklauseln aufgehoben, die Microsofts Eigenentwicklungen einschränkten.

Q2: Wie viel besser ist MAI-Transcribe-1 im Vergleich zu Whisper?

Im FLEURS-Benchmark für 25 Sprachen liegt die Wortfehlerrate (WER) von MAI-Transcribe-1 bei etwa 3,9 %, während Whisper Large v3 bei ca. 7,6 % liegt – ein deutlicher Vorsprung bei der Genauigkeit. Zudem ist die Batch-Verarbeitungsgeschwindigkeit von MAI-Transcribe-1 2,5-mal höher als bei der Azure Fast-Lösung, bei einer Senkung der GPU-Kosten um etwa 50 %. Whisper punktet jedoch weiterhin durch seine Open-Source-Natur und Kostenfreiheit, was es für kostenkritische Szenarien attraktiv macht.

Q3: Kann MAI-Image-2 DALL-E ersetzen?

Laut dem Arena.ai-Ranking liegt MAI-Image-2 (Platz 3) insgesamt vor DALL-E 3. Besonders bei der Textdarstellung und dem fotorealistischen Anspruch bietet MAI-Image-2 klare Vorteile. DALL-E zeigt jedoch bei bestimmten kreativen Stilen weiterhin eine einzigartige Performance. Für Unternehmenskunden dürfte die tiefe Integration von MAI-Image-2 in das Microsoft-Ökosystem das entscheidende Argument sein.

Q4: Wie kann ich die drei MAI-Modelle schnell ausprobieren?

Am schnellsten geht es über das MAI Playground, Microsofts neue Plattform zum Testen von Modellen. Für eine offizielle API-Anbindung ist die Microsoft Foundry-Entwicklerplattform erforderlich. Falls Ihre Anwendung mehrere KI-Modelle gleichzeitig nutzen muss, können Sie die API-Anbindungen verschiedener Anbieter über die Plattform APIYI (apiyi.com) zentral verwalten, um den Entwicklungsprozess zu vereinfachen.

Q5: Wann plant Microsoft die Veröffentlichung eines eigenen, allgemeinen Großes Sprachmodell?

Öffentlichen Informationen zufolge baut Microsoft derzeit Nvidia GB200-Chip-Cluster auf, um in den nächsten 12 bis 18 Monaten eine Rechenleistung auf dem neuesten Stand der Technik zu schaffen. Ein eigenes, allgemeines Großes Sprachmodell, das mit GPT-5 konkurrieren kann, wird für etwa 2027 erwartet. Bis dahin wird das Kern-LLM von Copilot weiterhin auf OpenAI GPT-5.4 basieren.

Zusammenfassung der 3 neuen MAI-Modelle von Microsoft

Das MAI-Team von Microsoft hat nach nur fünf Monaten Bestehen beeindruckende erste Ergebnisse vorgelegt:

- MAI-Transcribe-1: Belegt den ersten Platz beim FLEURS-Benchmark für die Wortfehlerrate (WER) mit ca. 3,9 %, bietet eine 2,5-fache Geschwindigkeitssteigerung, senkt die Kosten um 50 % und ist für 0,36 $/Stunde verfügbar.

- MAI-Voice-1: Erzeugt 60 Sekunden Sprache in unter einer Sekunde auf einer einzelnen GPU, unterstützt 10-sekündiges Voice-Cloning und bietet über 700 voreingestellte Stimmen.

- MAI-Image-2: Erreicht den 3. Platz im Arena.ai-Ranking für Text-zu-Bild, verbessert die Textdarstellung um 115 Punkte und unterstützt komplexe Layouts sowie fotorealistische Ergebnisse.

Die Veröffentlichung dieser drei Modelle unterstreicht nicht nur die Eigenentwicklungsfähigkeiten von Microsoft, sondern signalisiert auch einen beschleunigten Trend zur „Full-Stack-Eigenentwicklung“ durch Branchenriesen. Für Entwickler wächst die Auswahl an Modellen stetig. Die Nutzung einheitlicher Integrationsplattformen wie APIYI (apiyi.com) zur Verwaltung von Modellaufrufen verschiedener Anbieter wird daher zu einer Schlüsselstrategie, um die Entwicklungseffizienz zu steigern und Wechselkosten zu senken.

📝 Autor: APIYI Team | Weitere technische Analysen zu KI-Modellen und Leitfäden zur API-Integration finden Sie im APIYI-Hilfezentrum: help.apiyi.com