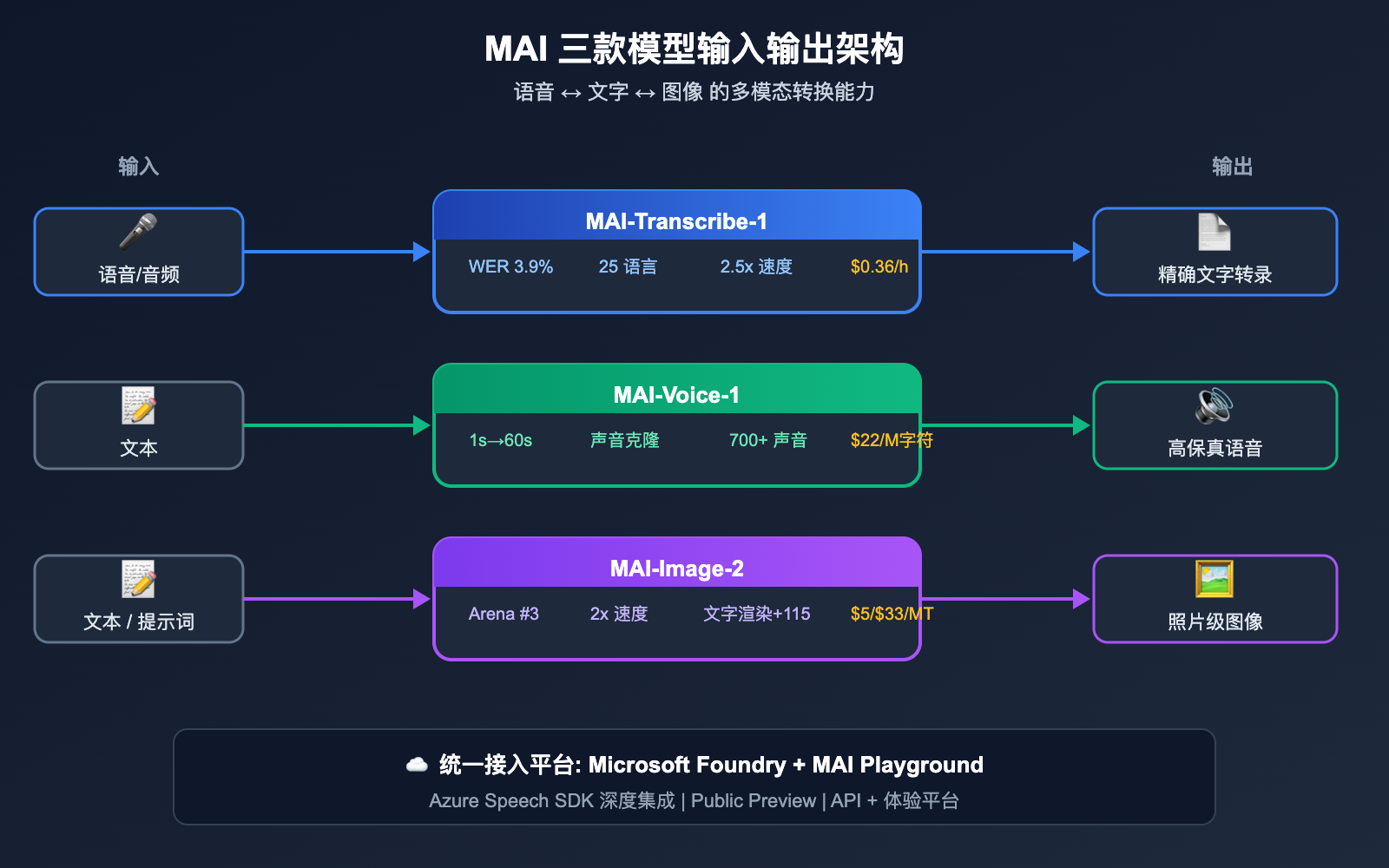

2026 年 4 月 2 日,微软 MAI 超级智能团队正式发布了 3 款自研基础模型——MAI-Transcribe-1(语音转文字)、MAI-Voice-1(语音生成)和 MAI-Image-2(文生图)。这是自 Mustafa Suleyman 领导的 MAI 团队成立以来的首次重大产品发布,标志着微软开始构建独立于 OpenAI 的 AI 模型能力。

核心价值: 3 分钟了解微软 MAI 三款新模型的核心技术参数、基准表现、API 定价以及对 AI 行业格局的影响。

微软 MAI 3 款新模型核心信息速览

| 信息项 | 详情 |

|---|---|

| 发布时间 | 2026 年 4 月 2 日 |

| 发布方 | 微软 MAI 超级智能团队 (CEO: Mustafa Suleyman) |

| 发布模型 | MAI-Transcribe-1 / MAI-Voice-1 / MAI-Image-2 |

| 平台入口 | Microsoft Foundry + MAI Playground |

| 战略意义 | 微软首批自研多模态基础模型,降低对 OpenAI 的依赖 |

| 当前状态 | 公开预览 (Public Preview) |

这三款模型分别覆盖语音识别、语音生成和图像生成三大赛道,是微软在与 OpenAI 重新谈判合作条款后,首次独立推出的有竞争力的基础模型。

MAI-Transcribe-1 微软语音转文字模型深度解析

MAI-Transcribe-1 核心技术参数

MAI-Transcribe-1 是微软迄今为止最强的语音识别模型,在 FLEURS 基准测试中取得了综合第一的成绩。

| 参数维度 | MAI-Transcribe-1 |

|---|---|

| 支持语言 | 25 种语言 |

| FLEURS 基准 WER | ~3.9% (综合第一) |

| 处理速度 | 比 Azure Fast 方案快 2.5 倍 |

| GPU 成本 | 比竞品降低约 50% |

| API 价格 | $0.36/小时 |

| 核心优势 | 11 种核心语言 WER 最低 |

MAI-Transcribe-1 与竞品 WER 对比

在 FLEURS 25 语言基准测试中,MAI-Transcribe-1 的词错误率(WER)表现全面领先:

| 模型 | FLEURS WER | 优势语言数 | 价格参考 |

|---|---|---|---|

| MAI-Transcribe-1 | ~3.9% | 11/25 第一 | $0.36/小时 |

| GPT-Transcribe (OpenAI) | ~4.2% | — | 按 Token 计费 |

| Scribe v2 (ElevenLabs) | ~4.3% | — | $0.40/小时起 |

| Gemini 3.1 Flash | ~4.9% | — | 按 Token 计费 |

| Whisper Large v3 | ~7.6% | — | 开源免费 |

MAI-Transcribe-1 的 5 大核心优势

1. 企业级多语言精度

MAI-Transcribe-1 在 25 种语言中综合排名第一,其中 11 种核心语言(包括英语、中文、日语、西班牙语等)的 WER 达到业界最低。在剩余 14 种语言中也优于 Whisper Large v3,并在其中 11 种语言上超过 Gemini 3.1 Flash。

2. 批量处理速度提升 2.5 倍

相比微软此前的 Azure Fast 语音转写方案,MAI-Transcribe-1 的批量处理速度提升了 2.5 倍。这对于呼叫中心录音回溯、会议纪要批量生成、视频字幕制作等场景意味着显著的效率提升。

3. GPU 成本降低约 50%

通过模型架构优化,MAI-Transcribe-1 在保持顶级精度的同时,GPU 推理成本降低了约一半。这使得大规模语音转写任务的总拥有成本大幅下降。

4. 适用场景广泛

- IVR 系统: 交互式语音应答的实时转写

- 呼叫中心: 客服对话自动转录和分析

- 直播字幕: 活动和会议的实时字幕生成

- 视频制作: 视频内容的自动字幕生成

- 市场调研: 访谈录音的批量转写

5. API 价格具有竞争力

$0.36/小时的定价在企业级语音转写服务中具有明显的价格优势,特别是考虑到其领先的 WER 表现。

🎯 开发者提示: 对于需要在应用中集成语音转写能力的开发者,MAI-Transcribe-1 通过 Microsoft Foundry 提供 API 接入。如果你同时需要调用多种 AI 模型(如语音转写 + 文本生成 + 图像生成),可以通过 API易 apiyi.com 平台统一管理不同厂商的 API 调用,简化多模型接入的工程复杂度。

MAI-Voice-1 微软语音生成模型技术解读

MAI-Voice-1 核心参数

MAI-Voice-1 是微软推出的高效语音生成模型,其核心亮点是极致的生成效率。

| 参数维度 | MAI-Voice-1 |

|---|---|

| 生成效率 | 单 GPU 不到 1 秒生成 60 秒音频 |

| 声音克隆 | 仅需 10 秒音频样本即可创建自定义声音 |

| 声音库 | 700+ 预置声音可选 |

| API 价格 | $22/百万字符 |

| 集成方式 | Azure Speech / Microsoft Foundry |

| 已有应用 | Copilot 音频表达和播客功能 |

MAI-Voice-1 核心技术特点

1. 极致生成效率

在单个 GPU 上不到 1 秒即可生成 60 秒的高质量语音。这一效率使得 MAI-Voice-1 成为目前最高效的语音合成系统之一,特别适合需要实时语音反馈的应用场景。

2. 10 秒声音克隆

Personal Voice 功能允许用户仅通过 10 秒的音频样本就创建高度还原的自定义声音。不过,该功能需要通过微软的负责任 AI 审批流程才能使用。

3. 700+ 声音画廊

通过 Azure Speech 集成,开发者可以访问超过 700 种预置声音,覆盖多种语言、口音和风格,满足不同应用场景的需求。

4. 表情丰富的语音输出

MAI-Voice-1 不仅能生成清晰的语音,还能模拟情感色彩——包括语气变化、停顿节奏和情感表达,使生成的语音更加自然和富有表现力。

💡 应用场景: MAI-Voice-1 特别适合有声读物制作、播客自动生成、客服语音回复、无障碍辅助等场景。开发者可以结合大语言模型生成文本,再通过 MAI-Voice-1 转为语音,构建完整的 AI 语音助手管线。通过 API易 apiyi.com 平台可以便捷地接入 LLM 生成文本的环节。

MAI-Image-2 微软最强文生图模型详解

MAI-Image-2 核心参数

MAI-Image-2 是微软首个在业界排行榜上具备顶级竞争力的自研文生图模型。

| 参数维度 | MAI-Image-2 |

|---|---|

| Arena.ai 排名 | 第 3 名 (仅次于 Gemini 3.1 Flash 和 GPT Image 1.5) |

| 生成速度 | 比前代快 2 倍以上 |

| 文字渲染提升 | 比前代提升 115 分 |

| 输入价格 | $5/百万 Token |

| 输出价格 | $33/百万 Token |

| 核心优势 | 照片级真实感、强文字渲染、复杂布局精度 |

MAI-Image-2 在 Arena.ai 排行榜的位置

| 排名 | 模型 | 厂商 | 核心优势 |

|---|---|---|---|

| 1 | Gemini 3.1 Flash Image | 多模态综合最强 | |

| 2 | GPT Image 1.5 | OpenAI | 创意多样性领先 |

| 3 | MAI-Image-2 | 微软 | 文字渲染 + 照片级真实感 |

| 4 | Midjourney v7 | Midjourney | 艺术风格突出 |

| 5 | Stable Diffusion 4 | Stability AI | 开源生态 |

MAI-Image-2 的 4 大技术亮点

1. 照片级真实感

MAI-Image-2 在写实摄影风格的图片生成上达到了新高度。体积光效果、材质纹理、光影过渡等细节表现接近真实照片水准,适合商业广告和产品展示场景。

2. 文字渲染能力大幅提升

相比前代模型,MAI-Image-2 的图内文字渲染能力提升了 115 分。这意味着生成信息图表、海报、标识牌等包含文字元素的图片时,文字清晰度和准确性显著提升。

3. 复杂布局处理精度

在包含多个对象、复杂空间关系和详细场景的生成任务中,MAI-Image-2 展现出比竞品更高的构图精度,减少了对象重叠和比例失调的问题。

4. 企业级工作流集成

全球最大的广告集团 WPP 已经在大规模使用 MAI-Image-2 进行创意制作。微软将该模型定位为设计师和营销人员的生产力工具,与 Microsoft 365 生态深度整合。

🔧 技术实践: 在实际的 AI 图片生成应用中,开发者通常需要对比多个模型的生成效果。通过 API易 apiyi.com 平台可以统一接入 DALL-E、Stable Diffusion 等多种图片生成模型的 API,便于在不同模型之间快速切换和效果对比。

微软 MAI 战略:脱离 OpenAI 依赖的第一步

为什么微软要自研模型

微软与 OpenAI 的关系正在经历微妙的变化。这次 MAI 三款模型的发布,是一个清晰的战略信号。

关键时间线:

- 2025 年: 微软与 OpenAI 重新谈判合作条款,取消了此前限制微软自研通用 AI 模型的合同约束

- 2025 年 11 月: Mustafa Suleyman 组建 MAI 超级智能团队,专注前沿模型研发

- 2026 年 3 月: Satya Nadella 宣布组织架构调整,Suleyman 全面聚焦前沿模型,不再负责 Copilot 日常运营

- 2026 年 4 月 2 日: MAI 团队发布首批三款自研基础模型

- 2027 年目标: 计划推出与 GPT-5 级别竞争的通用大语言模型

微软 AI 模型矩阵现状

| 模型类别 | OpenAI 提供 | 微软自研 (MAI) |

|---|---|---|

| 通用 LLM | GPT-5.4 (Copilot 核心) | 规划中 (2027) |

| 语音识别 | Whisper / GPT-Transcribe | MAI-Transcribe-1 ✅ |

| 语音生成 | — | MAI-Voice-1 ✅ |

| 文生图 | DALL-E 3 | MAI-Image-2 ✅ |

| 代码模型 | Codex | 规划中 |

对开发者意味着什么

微软正在构建一个「双轨并行」的 AI 模型供给体系:一方面继续使用 OpenAI 的通用 LLM(GPT-5.4),另一方面在语音和图像赛道推出自研替代方案。这意味着开发者在微软生态中将拥有更多选择。

🎯 行业洞察: 微软自研模型的推出,意味着 AI 模型市场的竞争将进一步加剧。对开发者而言,选择哪个模型、通过哪个渠道接入变得更加关键。通过 API易 apiyi.com 平台统一接入多家厂商的 AI 模型 API,可以在不修改代码的情况下灵活切换底层模型,应对快速变化的市场格局。

Microsoft MAI 模型 API 定价与接入方式

三款模型定价一览

| 模型 | 计费方式 | 价格 | 接入平台 |

|---|---|---|---|

| MAI-Transcribe-1 | 按音频时长 | $0.36/小时 | Microsoft Foundry / Azure Speech |

| MAI-Voice-1 | 按字符数 | $22/百万字符 | Microsoft Foundry / Azure Speech |

| MAI-Image-2 | 按 Token 数 | 输入 $5/百万 + 输出 $33/百万 Token | Microsoft Foundry |

接入方式

方式一: Microsoft Foundry

所有三款模型均通过 Microsoft Foundry 开发者平台以公开预览的形式提供 API 接入。开发者可以直接通过 Foundry 的 API 端点进行调用。

方式二: MAI Playground

MAI Playground 是微软新推出的模型体验平台,开发者可以在此免费试用 MAI-Transcribe-1 和 MAI-Voice-1 的能力,快速评估是否适合自己的应用场景。

方式三: Azure Speech 集成

MAI-Transcribe-1 和 MAI-Voice-1 均深度集成到 Azure Speech 服务中,现有 Azure 用户可以直接通过 Azure Speech SDK 调用。

💰 成本优化: 在构建多模态 AI 应用时,语音转写、文本生成和图片生成通常需要组合使用不同厂商的模型。通过 API易 apiyi.com 平台可以统一管理 API 密钥和用量,避免分别注册多个平台带来的管理成本。平台支持包括微软、OpenAI、Anthropic、阿里云等多家厂商的模型接入。

微软 MAI 模型对 AI 行业的影响分析

对 AI 模型市场的影响

1. 语音识别赛道格局变化

MAI-Transcribe-1 以 3.9% 的 WER 直接挑战 OpenAI 的 GPT-Transcribe(4.2%)和 ElevenLabs 的 Scribe v2(~4.3%),加上 50% 的成本优势,有望快速抢占企业级语音转写市场份额。

2. 文生图三强争霸加剧

MAI-Image-2 登上 Arena.ai 前三,使得文生图赛道形成了 Google(Gemini 3.1 Flash)、OpenAI(GPT Image 1.5)、微软(MAI-Image-2)三强格局。对 Midjourney 和 Stability AI 等独立厂商形成更大压力。

3. AI 巨头「全栈自研」成为趋势

继 Google(Gemini 系列)、Meta(Llama 系列)之后,微软也开始构建全栈 AI 模型能力。这意味着未来 AI 市场的竞争将越来越集中在少数大厂之间。

对开发者的影响

- 更多模型选择: 微软生态中不再只有 OpenAI 一个选择

- 价格竞争加剧: 多厂商竞争将推动 API 价格进一步下降

- 多模型组合使用: 开发者需要学会根据场景灵活选择不同厂商的模型

🚀 开发建议: 面对快速增长的 AI 模型选择,建议开发者通过 API易 apiyi.com 等统一接入平台管理多模型调用,避免被单一厂商锁定。平台提供 OpenAI 兼容的标准接口格式,切换模型只需修改 model 参数。

微软 MAI 模型常见问题

Q1: MAI 模型和 OpenAI 模型是什么关系?

MAI 模型是微软 MAI 超级智能团队独立研发的,与 OpenAI 无关。微软目前采用「双轨并行」策略:通用 LLM 继续使用 OpenAI 的 GPT-5.4,而在语音和图像领域推出自研的 MAI 系列。2025 年微软与 OpenAI 重新谈判后,取消了限制微软自研模型的合同条款。

Q2: MAI-Transcribe-1 比 Whisper 好多少?

在 FLEURS 25 语言基准测试中,MAI-Transcribe-1 的 WER 约为 3.9%,而 Whisper Large v3 约为 7.6%,准确率差距明显。同时 MAI-Transcribe-1 的批量处理速度是 Azure Fast 方案的 2.5 倍,GPU 成本降低约 50%。不过 Whisper 的优势在于开源免费,适合对成本极度敏感的场景。

Q3: MAI-Image-2 能替代 DALL-E 吗?

从 Arena.ai 排名看,MAI-Image-2(第 3)的整体排名高于 DALL-E 3。特别是在文字渲染和照片级真实感方面,MAI-Image-2 有明显优势。但 DALL-E 在某些创意风格上仍有独特表现。对于企业用户来说,MAI-Image-2 与 Microsoft 生态的深度整合可能是更大的吸引力。

Q4: 如何快速体验这三款 MAI 模型?

最快的方式是访问 MAI Playground(微软新推出的模型体验平台)免费试用。正式的 API 接入需要通过 Microsoft Foundry 开发者平台。如果你的应用需要同时调用多种 AI 模型,可以通过 API易 apiyi.com 平台统一管理不同厂商的 API 接入,简化开发流程。

Q5: 微软计划什么时候发布自研的通用大语言模型?

根据公开信息,微软正在部署 Nvidia GB200 芯片集群,计划在未来 12-18 个月内构建前沿级算力。预计 2027 年前后将推出能够与 GPT-5 级别竞争的自研通用 LLM。在此之前,Copilot 的核心 LLM 仍将使用 OpenAI 的 GPT-5.4。

微软 MAI 3 款新模型总结

微软 MAI 团队成立仅 5 个月便交出了令人瞩目的首份答卷:

- MAI-Transcribe-1: FLEURS 基准 WER 第一名(~3.9%),速度提升 2.5 倍,成本降低 50%,定价 $0.36/小时

- MAI-Voice-1: 单 GPU 不到 1 秒生成 60 秒语音,支持 10 秒声音克隆,700+ 预置声音

- MAI-Image-2: Arena.ai 文生图排行榜第 3 名,文字渲染提升 115 分,支持复杂布局和照片级真实感

这三款模型的发布不仅展示了微软的自研能力,更标志着 AI 行业「巨头全栈自研」的趋势正在加速。对于开发者来说,模型选择越来越多,通过 API易 apiyi.com 等统一接入平台管理多厂商的 AI 模型调用,将成为提升开发效率和降低切换成本的关键策略。

📝 作者: APIYI Team | 更多 AI 模型技术解读和 API 接入指南,请访问 API易帮助中心: help.apiyi.com