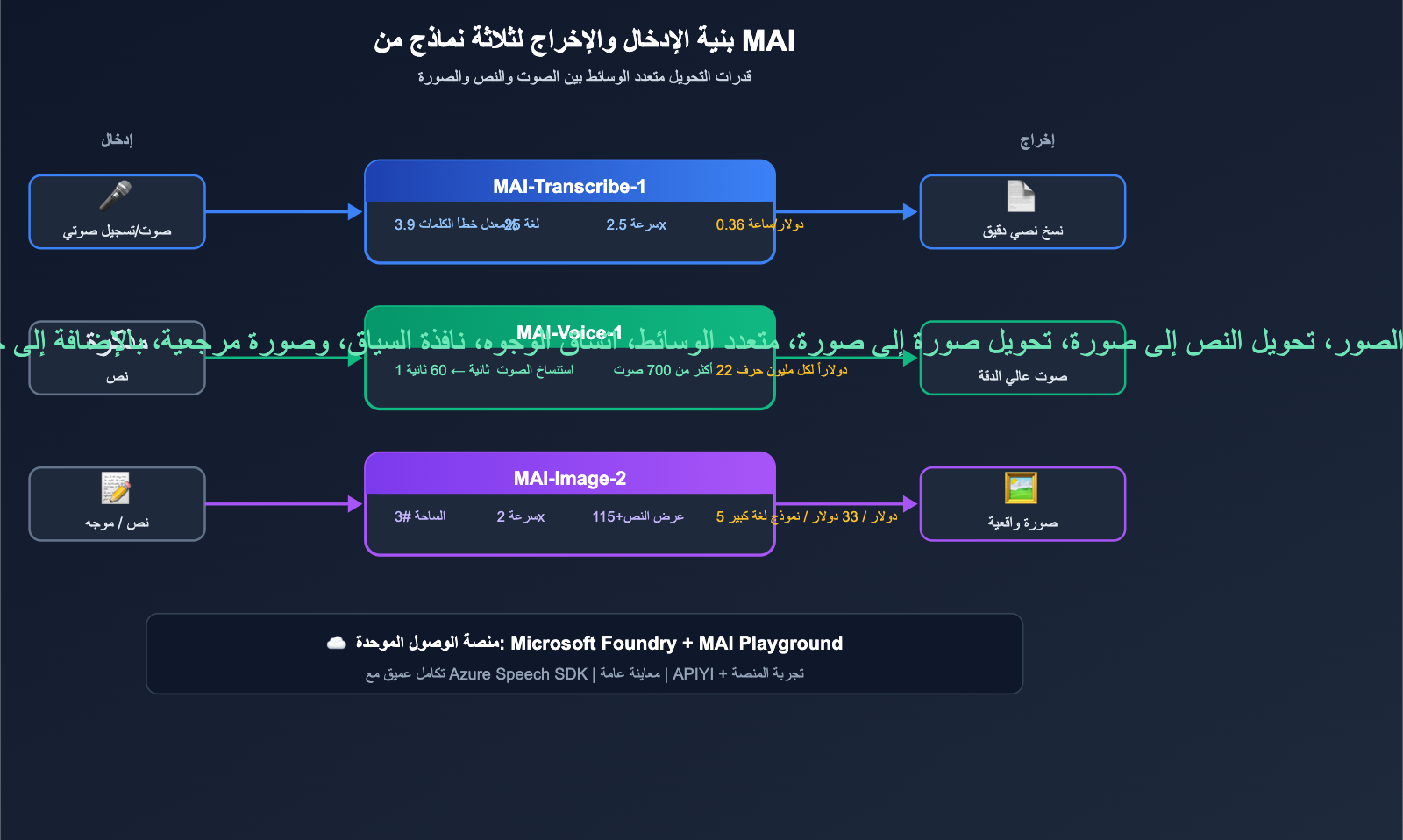

في 2 أبريل 2026، أطلق فريق "مايكروسوفت MAI" للذكاء الاصطناعي الفائق رسميًا 3 نماذج أساسية مطورة ذاتيًا، وهي: MAI-Transcribe-1 (لتحويل الصوت إلى نص)، وMAI-Voice-1 (لتوليد الصوت)، وMAI-Image-2 (لتحويل النص إلى صورة). يمثل هذا الإطلاق أول خطوة استراتيجية كبرى لفريق MAI منذ تأسيسه بقيادة مصطفى سليمان، مما يشير إلى بدء مايكروسوفت في بناء قدرات نماذج ذكاء اصطناعي مستقلة عن OpenAI.

القيمة الجوهرية: تعرف في 3 دقائق على المعايير التقنية الأساسية، وأداء القياس، وتسعير الـ API، وتأثير هذه النماذج الثلاثة الجديدة من مايكروسوفت على مشهد صناعة الذكاء الاصطناعي.

نظرة سريعة على المعلومات الأساسية لنماذج مايكروسوفت MAI الثلاثة الجديدة

| عنصر المعلومات | التفاصيل |

|---|---|

| تاريخ الإصدار | 2 أبريل 2026 |

| الجهة المصدرة | فريق الذكاء الاصطناعي الفائق MAI في مايكروسوفت (الرئيس التنفيذي: مصطفى سليمان) |

| النماذج الصادرة | MAI-Transcribe-1 / MAI-Voice-1 / MAI-Image-2 |

| بوابة المنصة | Microsoft Foundry + MAI Playground |

| الأهمية الاستراتيجية | أول مجموعة من نماذج الأساس متعددة الوسائط التي طورتها مايكروسوفت ذاتياً، لتقليل الاعتماد على OpenAI |

| الحالة الحالية | معاينة عامة (Public Preview) |

تغطي هذه النماذج الثلاثة مجالات التعرف على الصوت، وتوليد الصوت، وتوليد الصور، وهي المرة الأولى التي تطلق فيها مايكروسوفت نماذج أساس تنافسية بشكل مستقل بعد إعادة التفاوض على شروط التعاون مع OpenAI.

تحليل معمق لنموذج تحويل الصوت إلى نص MAI-Transcribe-1 من مايكروسوفت

المعايير التقنية الأساسية لنموذج MAI-Transcribe-1

يعد MAI-Transcribe-1 أقوى نموذج للتعرف على الصوت من مايكروسوفت حتى الآن، حيث حقق المركز الأول عالمياً في اختبارات الأداء FLEURS.

| بُعد المعيار | MAI-Transcribe-1 |

|---|---|

| اللغات المدعومة | 25 لغة |

| معدل خطأ الكلمات (WER) في FLEURS | ~3.9% (الأول إجمالاً) |

| سرعة المعالجة | أسرع بـ 2.5 مرة من حل Azure Fast |

| تكلفة معالج الرسوميات (GPU) | أقل بنحو 50% من المنافسين |

| سعر الـ API | 0.36 دولار/ساعة |

| الميزة الجوهرية | أقل معدل خطأ (WER) في 11 لغة رئيسية |

مقارنة معدل خطأ الكلمات (WER) لنموذج MAI-Transcribe-1 مع المنافسين

في اختبار الأداء FLEURS لـ 25 لغة، يتفوق نموذج MAI-Transcribe-1 في معدل خطأ الكلمات (WER) بشكل شامل:

| النموذج | معدل خطأ الكلمات (WER) في FLEURS | عدد اللغات المتفوق فيها | مرجع السعر |

|---|---|---|---|

| MAI-Transcribe-1 | ~3.9% | الأول في 11/25 لغة | 0.36 دولار/ساعة |

| GPT-Transcribe (OpenAI) | ~4.2% | — | محاسبة حسب الرموز (Token) |

| Scribe v2 (ElevenLabs) | ~4.3% | — | يبدأ من 0.40 دولار/ساعة |

| Gemini 3.1 Flash | ~4.9% | — | محاسبة حسب الرموز (Token) |

| Whisper Large v3 | ~7.6% | — | مفتوح المصدر ومجاني |

المزايا الخمس الرئيسية لنموذج MAI-Transcribe-1

1. دقة متعددة اللغات بمستوى المؤسسات

يحتل MAI-Transcribe-1 المرتبة الأولى إجمالاً عبر 25 لغة، حيث حقق أقل معدل خطأ (WER) في الصناعة لـ 11 لغة أساسية (بما في ذلك الإنجليزية، الصينية، اليابانية، الإسبانية، وغيرها). كما يتفوق على Whisper Large v3 في اللغات الـ 14 المتبقية، ويتجاوز أداء Gemini 3.1 Flash في 11 منها.

2. زيادة سرعة المعالجة الجماعية بمقدار 2.5 مرة

مقارنة بحل Azure Fast السابق للتحويل الصوتي من مايكروسوفت، زادت سرعة المعالجة الجماعية لنموذج MAI-Transcribe-1 بمقدار 2.5 مرة. وهذا يعني تحسناً كبيراً في الكفاءة لسيناريوهات مثل مراجعة تسجيلات مراكز الاتصال، وتوليد محاضر الاجتماعات الجماعية، وإنتاج ترجمات الفيديو.

3. خفض تكلفة معالجة الرسوميات (GPU) بنحو 50%

من خلال تحسين بنية النموذج، تم خفض تكلفة استدلال الـ GPU إلى النصف تقريباً مع الحفاظ على دقة فائقة. وهذا يؤدي إلى انخفاض كبير في التكلفة الإجمالية للملكية لمهام التحويل الصوتي واسعة النطاق.

4. نطاق واسع من سيناريوهات الاستخدام

- أنظمة IVR: التحويل اللحظي للاستجابة الصوتية التفاعلية.

- مراكز الاتصال: النسخ والتحليل التلقائي لمحادثات خدمة العملاء.

- ترجمة البث المباشر: توليد ترجمات فورية للفعاليات والاجتماعات.

- إنتاج الفيديو: توليد ترجمات تلقائية لمحتوى الفيديو.

- أبحاث السوق: التحويل الجماعي لتسجيلات المقابلات.

5. سعر API تنافسي

يتمتع سعر 0.36 دولار/ساعة بميزة تنافسية واضحة في خدمات التحويل الصوتي للمؤسسات، خاصة عند النظر إلى أدائه الرائد في معدل خطأ الكلمات (WER).

🎯 نصيحة للمطورين: بالنسبة للمطورين الذين يحتاجون إلى دمج قدرات التحويل الصوتي في تطبيقاتهم، يوفر MAI-Transcribe-1 إمكانية الوصول عبر API من خلال Microsoft Foundry. إذا كنت بحاجة إلى استدعاء نماذج ذكاء اصطناعي متعددة في نفس الوقت (مثل التحويل الصوتي + توليد النصوص + توليد الصور)، يمكنك استخدام منصة APIYI apiyi.com لإدارة استدعاءات الـ API من مختلف الموردين بشكل موحد، مما يبسط تعقيدات الهندسة الخاصة بدمج نماذج متعددة.

تحليل تقني لنموذج توليد الصوت MAI-Voice-1 من مايكروسوفت

المعايير الأساسية لنموذج MAI-Voice-1

يُعد MAI-Voice-1 نموذجاً عالي الكفاءة لتوليد الصوت أطلقته مايكروسوفت، وتتمثل ميزته التنافسية في كفاءة التوليد الفائقة.

| بُعد المعيار | MAI-Voice-1 |

|---|---|

| كفاءة التوليد | أقل من ثانية واحدة لتوليد 60 ثانية من الصوت على وحدة معالجة رسومية (GPU) واحدة |

| استنساخ الصوت | يتطلب 10 ثوانٍ فقط من العينة الصوتية لإنشاء صوت مخصص |

| مكتبة الأصوات | أكثر من 700 صوت مسبق الإعداد |

| سعر الـ API | 22 دولاراً لكل مليون حرف |

| طريقة التكامل | Azure Speech / Microsoft Foundry |

| التطبيقات الحالية | ميزات التعبير الصوتي والبودكاست في Copilot |

الخصائص التقنية الأساسية لنموذج MAI-Voice-1

1. كفاءة توليد فائقة

يمكن للنموذج توليد 60 ثانية من الصوت عالي الجودة في أقل من ثانية واحدة باستخدام وحدة معالجة رسومية واحدة. هذه الكفاءة تجعل من MAI-Voice-1 أحد أكثر أنظمة تركيب الصوت كفاءة حالياً، وهو مناسب بشكل خاص لسيناريوهات التطبيقات التي تتطلب استجابة صوتية فورية.

2. استنساخ الصوت في 10 ثوانٍ

تتيح ميزة "الصوت الشخصي" (Personal Voice) للمستخدمين إنشاء أصوات مخصصة عالية الدقة باستخدام عينة صوتية مدتها 10 ثوانٍ فقط. ومع ذلك، يتطلب استخدام هذه الميزة الموافقة عبر عملية الذكاء الاصطناعي المسؤول الخاصة بمايكروسوفت.

3. معرض يضم أكثر من 700 صوت

من خلال التكامل مع Azure Speech، يمكن للمطورين الوصول إلى أكثر من 700 صوت مسبق الإعداد، تغطي لغات ولهجات وأنماطاً متعددة، لتلبية احتياجات سيناريوهات التطبيقات المختلفة.

4. مخرجات صوتية غنية بالتعبيرات

لا يكتفي MAI-Voice-1 بتوليد صوت واضح فحسب، بل يمكنه محاكاة النبرات العاطفية – بما في ذلك تغيرات النبرة، وإيقاع التوقفات، والتعبير العاطفي، مما يجعل الصوت المولد أكثر طبيعية وحيوية.

💡 سيناريوهات التطبيق: يعد MAI-Voice-1 مناسباً بشكل خاص لإنتاج الكتب الصوتية، والإنتاج التلقائي للبودكاست، والردود الصوتية لخدمة العملاء، والمساعدة في الوصول لذوي الاحتياجات الخاصة، وغيرها من السيناريوهات. يمكن للمطورين دمج نماذج اللغة الكبيرة لتوليد النصوص، ثم تحويلها إلى صوت عبر MAI-Voice-1، لبناء خط أنابيب كامل للمساعد الصوتي المعتمد على الذكاء الاصطناعي. يمكنك الوصول بسهولة إلى مرحلة توليد النصوص بواسطة نماذج اللغة الكبيرة عبر منصة APIYI apiyi.com.

MAI-Image-2: نظرة تفصيلية على أقوى نموذج لتحويل النص إلى صورة من مايكروسوفت

المعايير الأساسية لنموذج MAI-Image-2

يُعد MAI-Image-2 أول نموذج لتوليد الصور من تطوير مايكروسوفت الذاتي، والذي يتمتع بقدرة تنافسية عالية في تصنيفات الصناعة.

| بُعد المعيار | MAI-Image-2 |

|---|---|

| تصنيف Arena.ai | المركز الثالث (بعد Gemini 3.1 Flash و GPT Image 1.5) |

| سرعة التوليد | أسرع بمرتين من الجيل السابق |

| تحسين عرض النصوص | تحسن بمقدار 115 نقطة عن الجيل السابق |

| سعر الإدخال | 5 دولارات لكل مليون Token |

| سعر الإخراج | 33 دولاراً لكل مليون Token |

| المزايا الأساسية | واقعية فوتوغرافية، عرض نصوص قوي، دقة في التخطيط المعقد |

موقع MAI-Image-2 في تصنيف Arena.ai

| الترتيب | النموذج | الشركة المصنعة | الميزة الأساسية |

|---|---|---|---|

| 1 | Gemini 3.1 Flash Image | الأفضل في تعدد الوسائط الشامل | |

| 2 | GPT Image 1.5 | OpenAI | رائد في تنوع الإبداع |

| 3 | MAI-Image-2 | Microsoft | عرض النصوص + واقعية فوتوغرافية |

| 4 | Midjourney v7 | Midjourney | أسلوب فني متميز |

| 5 | Stable Diffusion 4 | Stability AI | نظام بيئي مفتوح المصدر |

4 نقاط تقنية بارزة في MAI-Image-2

1. واقعية فوتوغرافية

وصل MAI-Image-2 إلى مستويات جديدة في توليد الصور بأسلوب التصوير الفوتوغرافي الواقعي. حيث تقترب تفاصيل مثل تأثيرات الإضاءة الحجمية، وملمس المواد، وانتقالات الضوء والظل من مستوى الصور الحقيقية، مما يجعله مناسباً للإعلانات التجارية وعروض المنتجات.

2. تحسن كبير في قدرة عرض النصوص

مقارنة بالجيل السابق، تحسنت قدرة MAI-Image-2 على عرض النصوص داخل الصور بمقدار 115 نقطة. وهذا يعني وضوحاً ودقة أكبر عند توليد صور تحتوي على عناصر نصية مثل الرسوم البيانية، والملصقات، واللافتات.

3. دقة معالجة التخطيطات المعقدة

في مهام التوليد التي تتضمن كائنات متعددة، وعلاقات مكانية معقدة، ومشاهد مفصلة، أظهر MAI-Image-2 دقة في التكوين تفوق المنافسين، مما يقلل من مشاكل تداخل الكائنات واختلال النسب.

4. التكامل مع سير عمل المؤسسات

بدأت مجموعة WPP، أكبر مجموعة إعلانية في العالم، بالفعل في استخدام MAI-Image-2 على نطاق واسع للإنتاج الإبداعي. وتضع مايكروسوفت هذا النموذج كأداة إنتاجية للمصممين والمسوقين، مع تكامل عميق داخل نظام Microsoft 365.

🔧 ممارسة تقنية: في تطبيقات توليد الصور بالذكاء الاصطناعي الفعلية، يحتاج المطورون عادةً إلى مقارنة نتائج توليد نماذج متعددة. من خلال منصة APIYI (apiyi.com)، يمكن دمج واجهات برمجة التطبيقات (API) لمجموعة متنوعة من نماذج توليد الصور مثل DALL-E وStable Diffusion بشكل موحد، مما يسهل التبديل السريع بين النماذج ومقارنة النتائج.

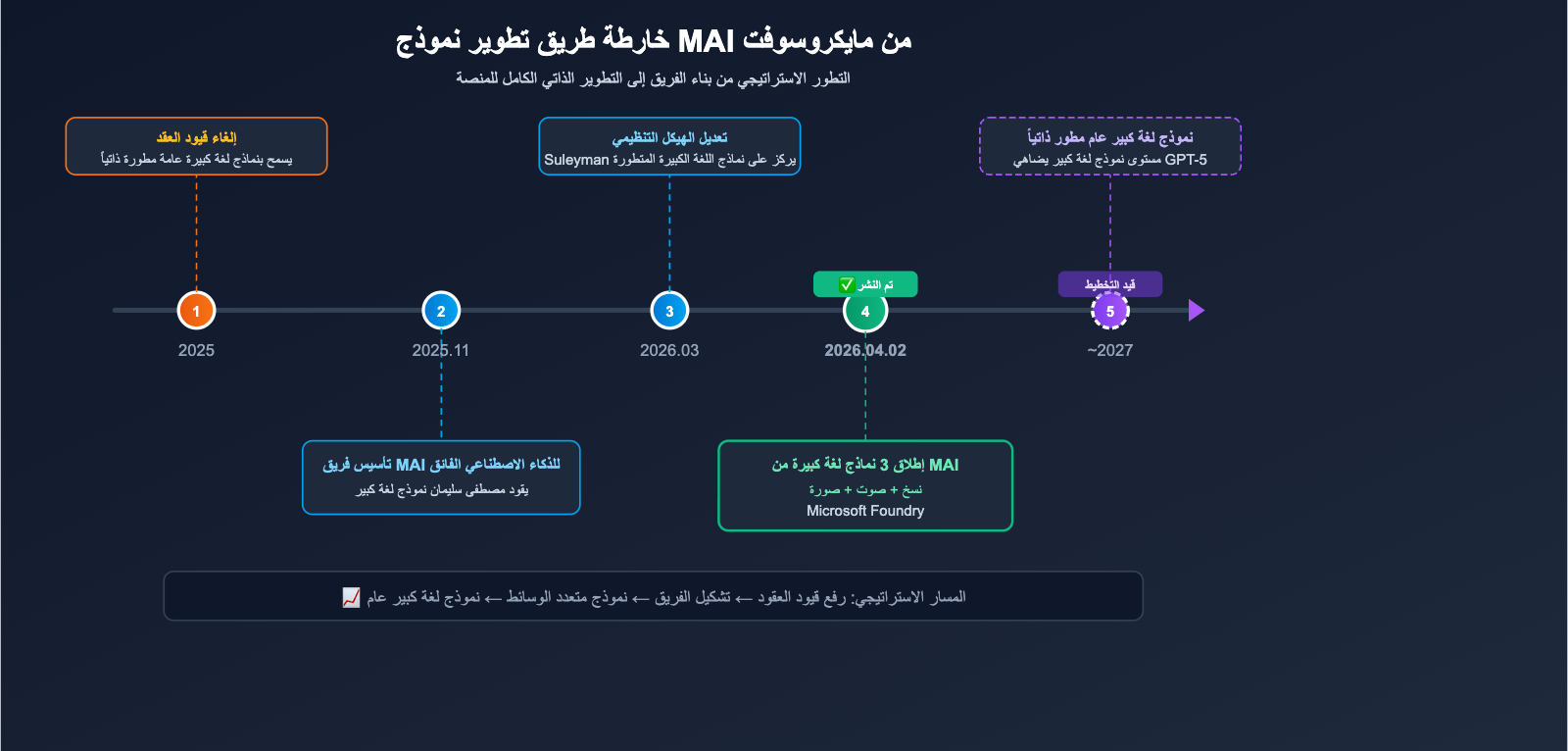

استراتيجية مايكروسوفت MAI: الخطوة الأولى نحو التحرر من الاعتماد على OpenAI

لماذا تتجه مايكروسوفت لتطوير نماذجها ذاتياً؟

تمر العلاقة بين مايكروسوفت وOpenAI بتغيرات دقيقة، ويُعد إطلاق نماذج MAI الثلاثة إشارة استراتيجية واضحة.

الجدول الزمني الرئيسي:

- 2025: أعادت مايكروسوفت وOpenAI التفاوض على شروط التعاون، مما ألغى القيود التعاقدية التي كانت تمنع مايكروسوفت من تطوير نماذج ذكاء اصطناعي عامة خاصة بها.

- نوفمبر 2025: أسس مصطفى سليمان فريق MAI للذكاء الاصطناعي الفائق، للتركيز على تطوير النماذج المتطورة.

- مارس 2026: أعلن ساتيا ناديلا عن تعديلات في الهيكل التنظيمي، حيث ركز سليمان بشكل كامل على النماذج المتطورة، وتوقف عن إدارة العمليات اليومية لـ Copilot.

- 2 أبريل 2026: أطلق فريق MAI الدفعة الأولى من ثلاثة نماذج أساسية مطورة ذاتياً.

- هدف 2027: التخطيط لإطلاق نموذج لغة كبير عام ينافس مستوى GPT-5.

الوضع الحالي لمصفوفة نماذج الذكاء الاصطناعي لدى مايكروسوفت

| فئة النموذج | توفر OpenAI | تطوير مايكروسوفت الذاتي (MAI) |

|---|---|---|

| نموذج لغة كبير عام | GPT-5.4 (جوهر Copilot) | قيد التخطيط (2027) |

| التعرف على الصوت | Whisper / GPT-Transcribe | MAI-Transcribe-1 ✅ |

| توليد الصوت | — | MAI-Voice-1 ✅ |

| تحويل النص إلى صورة | DALL-E 3 | MAI-Image-2 ✅ |

| نموذج الكود | Codex | قيد التخطيط |

ماذا يعني هذا للمطورين؟

تبني مايكروسوفت نظاماً لتوفير نماذج الذكاء الاصطناعي بـ "مسارين متوازيين": الاستمرار في استخدام نماذج OpenAI العامة (GPT-5.4)، وفي الوقت نفسه طرح بدائل مطورة ذاتياً في مجالات الصوت والصورة. وهذا يعني أن المطورين سيحصلون على خيارات أكثر داخل نظام مايكروسوفت البيئي.

🎯 رؤية صناعية: إن إطلاق نماذج مايكروسوفت المطورة ذاتياً يعني أن المنافسة في سوق نماذج الذكاء الاصطناعي ستشتد أكثر. بالنسبة للمطورين، أصبح اختيار النموذج المناسب والقناة المناسبة للوصول إليه أمراً بالغ الأهمية. من خلال منصة APIYI (apiyi.com)، يمكنك دمج واجهات برمجة التطبيقات لنماذج الذكاء الاصطناعي من شركات متعددة بشكل موحد، مما يتيح لك التبديل بمرونة بين النماذج الأساسية دون تعديل الكود، لمواكبة تغيرات السوق السريعة.

تسعير وطرق الوصول إلى نماذج Microsoft MAI API

نظرة عامة على تسعير النماذج الثلاثة

| النموذج | طريقة المحاسبة | السعر | منصة الوصول |

|---|---|---|---|

| MAI-Transcribe-1 | حسب مدة الصوت | $0.36/ساعة | Microsoft Foundry / Azure Speech |

| MAI-Voice-1 | حسب عدد الأحرف | $22/مليون حرف | Microsoft Foundry / Azure Speech |

| MAI-Image-2 | حسب عدد الرموز (Token) | المدخلات $5/مليون + المخرجات $33/مليون Token | Microsoft Foundry |

طرق الوصول

الطريقة الأولى: Microsoft Foundry

تتوفر النماذج الثلاثة جميعها عبر منصة المطورين Microsoft Foundry كمعاينة عامة للوصول إلى API. يمكن للمطورين إجراء استدعاء النموذج مباشرة عبر نقاط نهاية API الخاصة بـ Foundry.

الطريقة الثانية: MAI Playground

تعد MAI Playground منصة تجربة النماذج الجديدة التي أطلقتها مايكروسوفت، حيث يمكن للمطورين تجربة قدرات MAI-Transcribe-1 و MAI-Voice-1 مجانًا، لتقييم مدى ملاءمتها لسيناريوهات تطبيقاتهم بسرعة.

الطريقة الثالثة: التكامل مع Azure Speech

تم دمج MAI-Transcribe-1 و MAI-Voice-1 بعمق في خدمة Azure Speech، ويمكن لمستخدمي Azure الحاليين استدعاء النماذج مباشرة عبر Azure Speech SDK.

💰 تحسين التكلفة: عند بناء تطبيقات ذكاء اصطناعي متعدد الوسائط، غالبًا ما تحتاج إلى دمج نماذج من موردين مختلفين لعمليات تحويل الصوت إلى نص، وتوليد النصوص، وتوليد الصور. من خلال منصة APIYI (apiyi.com)، يمكنك إدارة مفاتيح API وحجم الاستخدام بشكل موحد، مما يجنبك تكاليف الإدارة الناتجة عن التسجيل في منصات متعددة بشكل منفصل. تدعم المنصة الوصول إلى نماذج من شركات متعددة بما في ذلك مايكروسوفت، OpenAI، Anthropic، وعلي بابا كلاود.

تحليل تأثير نماذج Microsoft MAI على صناعة الذكاء الاصطناعي

التأثير على سوق نماذج الذكاء الاصطناعي

1. تغير مشهد سوق التعرف على الصوت

يتحدى نموذج MAI-Transcribe-1 بمعدل خطأ في الكلمات (WER) يبلغ 3.9% مباشرةً نموذج GPT-Transcribe من OpenAI (4.2%) ونموذج Scribe v2 من ElevenLabs (~4.3%)، ومع ميزة خفض التكلفة بنسبة 50%، فمن المتوقع أن يستحوذ بسرعة على حصة سوقية في مجال تحويل الصوت إلى نص للمؤسسات.

2. اشتداد المنافسة بين الثلاثة الكبار في تحويل النص إلى صورة

صعد نموذج MAI-Image-2 إلى المراكز الثلاثة الأولى في Arena.ai، مما خلق مشهدًا تنافسيًا ثلاثي الأقطاب في مجال تحويل النص إلى صورة بين جوجل (Gemini 3.1 Flash)، وOpenAI (GPT Image 1.5)، ومايكروسوفت (MAI-Image-2). وهذا يضع ضغوطًا أكبر على الشركات المستقلة مثل Midjourney وStability AI.

3. توجه عمالقة الذكاء الاصطناعي نحو "التطوير الذاتي الكامل"

بعد جوجل (سلسلة Gemini) وميتا (سلسلة Llama)، بدأت مايكروسوفت أيضًا في بناء قدرات نماذج ذكاء اصطناعي متكاملة. وهذا يعني أن المنافسة في سوق الذكاء الاصطناعي ستتركز بشكل متزايد بين عدد قليل من الشركات الكبرى.

التأثير على المطورين

- خيارات أكثر للنماذج: لم يعد نظام مايكروسوفت البيئي مقتصرًا على OpenAI فقط.

- اشتداد المنافسة السعرية: ستؤدي المنافسة بين الموردين المتعددين إلى دفع أسعار API للانخفاض بشكل أكبر.

- استخدام مجموعات نماذج متعددة: يحتاج المطورون إلى تعلم كيفية اختيار نماذج من موردين مختلفين بمرونة بناءً على السيناريو.

🚀 نصيحة للمطورين: في ظل الخيارات المتزايدة لنماذج الذكاء الاصطناعي، ننصح المطورين بإدارة استدعاء النماذج المتعددة عبر منصات وصول موحدة مثل APIYI (apiyi.com)، لتجنب الارتهان لمورد واحد. توفر المنصة واجهات قياسية متوافقة مع OpenAI، حيث يتطلب تبديل النموذج تعديل معامل

modelفقط.

الأسئلة الشائعة حول نماذج MAI من مايكروسوفت

س1: ما هي العلاقة بين نماذج MAI ونماذج OpenAI؟

تم تطوير نماذج MAI بشكل مستقل بواسطة فريق "MAI Super Intelligence" التابع لمايكروسوفت، ولا علاقة لها بـ OpenAI. تتبنى مايكروسوفت حالياً استراتيجية "المسار المزدوج": حيث تستمر في استخدام GPT-5.4 من OpenAI لنماذج اللغة الكبيرة (LLM) العامة، بينما تطلق سلسلة MAI المطورة ذاتياً في مجالات الصوت والصورة. بعد إعادة التفاوض مع OpenAI في عام 2025، ألغت مايكروسوفت البنود التعاقدية التي كانت تقيد تطويرها لنماذجها الخاصة.

س2: ما مدى تفوق MAI-Transcribe-1 على Whisper؟

في اختبار قياس الأداء FLEURS لـ 25 لغة، سجل نموذج MAI-Transcribe-1 معدل خطأ في الكلمات (WER) يبلغ حوالي 3.9%، بينما سجل Whisper Large v3 حوالي 7.6%، مما يظهر فجوة واضحة في الدقة. في الوقت نفسه، تبلغ سرعة المعالجة المجمعة لـ MAI-Transcribe-1 ضعف سرعة حل Azure Fast بـ 2.5 مرة، مع خفض تكاليف وحدة معالجة الرسومات (GPU) بنحو 50%. ومع ذلك، تظل ميزة Whisper في كونه مفتوح المصدر ومجانياً، مما يجعله مناسباً للسيناريوهات الحساسة للغاية تجاه التكلفة.

س3: هل يمكن لنموذج MAI-Image-2 أن يحل محل DALL-E؟

بناءً على تصنيفات Arena.ai، يتفوق MAI-Image-2 (المرتبة الثالثة) في الترتيب العام على DALL-E 3. ويتمتع MAI-Image-2 بميزة واضحة خاصة في عرض النصوص والواقعية الفوتوغرافية. لكن DALL-E لا يزال يتمتع بأداء فريد في بعض الأنماط الإبداعية. بالنسبة لمستخدمي الشركات، قد يكون التكامل العميق لـ MAI-Image-2 مع نظام مايكروسوفت البيئي عامل جذب أكبر.

س4: كيف يمكنني تجربة نماذج MAI الثلاثة بسرعة؟

الطريقة الأسرع هي زيارة MAI Playground (منصة تجربة النماذج الجديدة من مايكروسوفت) لتجربتها مجاناً. يتطلب الوصول الرسمي عبر API استخدام منصة مطوري Microsoft Foundry. إذا كان تطبيقك يحتاج إلى استدعاء نماذج ذكاء اصطناعي متعددة في وقت واحد، يمكنك استخدام منصة APIYI (apiyi.com) لإدارة الوصول إلى API من مختلف الشركات بشكل موحد، مما يبسط عملية التطوير.

س5: متى تخطط مايكروسوفت لإصدار نموذج لغة كبير عام مطور ذاتياً؟

وفقاً للمعلومات العامة، تقوم مايكروسوفت حالياً بنشر مجموعات شرائح Nvidia GB200، وتخطط لبناء قدرات حوسبة رائدة خلال الـ 12-18 شهراً القادمة. ومن المتوقع إطلاق نموذج لغة كبير عام مطور ذاتياً يمكنه منافسة مستوى GPT-5 بحلول عام 2027 تقريباً. وحتى ذلك الحين، سيستمر Copilot في استخدام GPT-5.4 من OpenAI كنموذج لغة كبير أساسي.

ملخص لثلاثة نماذج جديدة من فريق MAI التابع لشركة مايكروسوفت

بعد مرور 5 أشهر فقط على تأسيسه، قدم فريق MAI التابع لشركة مايكروسوفت أولى إنجازاته المبهرة:

- MAI-Transcribe-1: حقق المركز الأول في معيار FLEURS بمعدل خطأ في الكلمات (WER) يبلغ حوالي 3.9%، مع زيادة في السرعة بمقدار 2.5 ضعف، وخفض في التكاليف بنسبة 50%، بسعر 0.36 دولار لكل ساعة.

- MAI-Voice-1: قادر على توليد 60 ثانية من الصوت في أقل من ثانية واحدة باستخدام وحدة معالجة رسومية (GPU) واحدة، ويدعم استنساخ الصوت في 10 ثوانٍ، مع توفير أكثر من 700 صوت مسبق الإعداد.

- MAI-Image-2: احتل المركز الثالث في تصنيف Arena.ai لتقنيات تحويل النص إلى صورة، مع تحسن بمقدار 115 نقطة في عرض النصوص، ويدعم التخطيطات المعقدة والواقعية الفائقة التي تضاهي الصور الفوتوغرافية.

لا يقتصر إطلاق هذه النماذج الثلاثة على استعراض قدرات مايكروسوفت في البحث والتطوير الذاتي فحسب، بل يشير أيضاً إلى تسارع اتجاه "التطوير الذاتي الكامل" لدى عمالقة التكنولوجيا في قطاع الذكاء الاصطناعي. وبالنسبة للمطورين، ومع تزايد خيارات النماذج المتاحة، أصبح استخدام منصات الوصول الموحدة مثل APIYI (apiyi.com) لإدارة استدعاء النموذج من مزودين متعددين استراتيجية أساسية لتعزيز كفاءة التطوير وتقليل تكاليف التبديل بين النماذج.

📝 الكاتب: فريق APIYI | للمزيد من التحليلات التقنية حول نماذج الذكاء الاصطناعي وأدلة الوصول إلى واجهات برمجة التطبيقات (API)، يرجى زيارة مركز مساعدة APIYI: help.apiyi.com