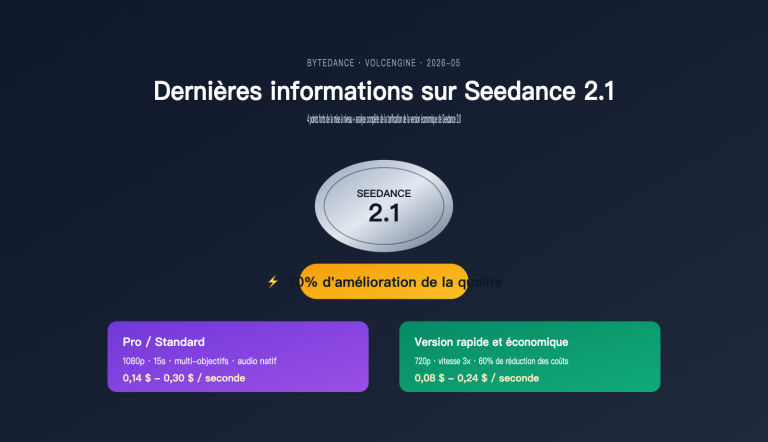

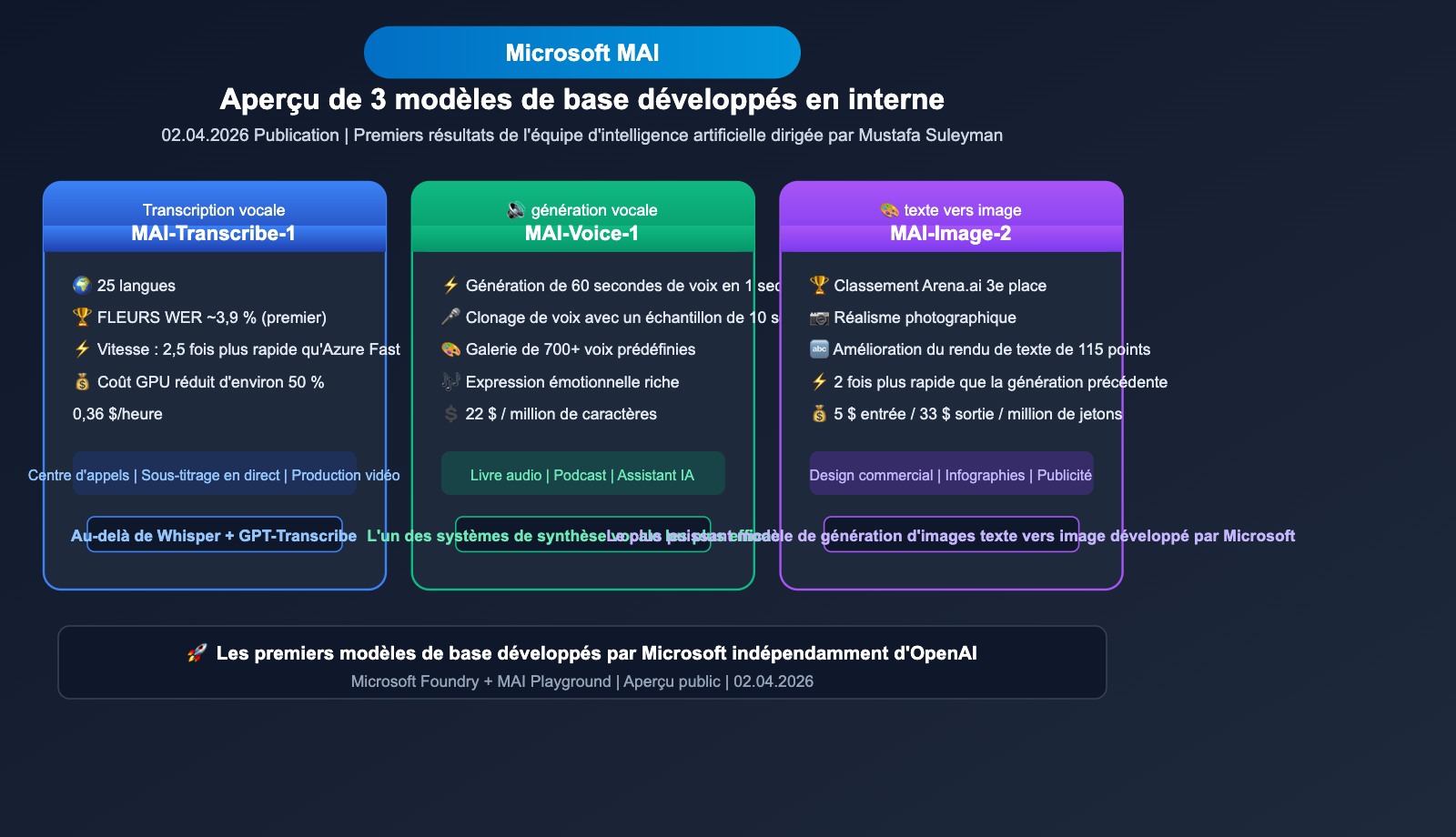

Le 2 avril 2026, l'équipe Microsoft MAI a officiellement dévoilé 3 modèles fondamentaux développés en interne : MAI-Transcribe-1 (transcription audio), MAI-Voice-1 (génération vocale) et MAI-Image-2 (génération d'images). Il s'agit du premier lancement majeur depuis la création de l'équipe MAI dirigée par Mustafa Suleyman, marquant le début de la stratégie de Microsoft pour bâtir des capacités d'IA indépendantes d'OpenAI.

Valeur ajoutée : Découvrez en 3 minutes les caractéristiques techniques, les performances, la tarification API et l'impact sur l'industrie de ces trois nouveaux modèles Microsoft MAI.

Aperçu des 3 nouveaux modèles MAI de Microsoft

| Élément | Détails |

|---|---|

| Date de lancement | 2 avril 2026 |

| Éditeur | Équipe Microsoft MAI Super Intelligence (PDG : Mustafa Suleyman) |

| Modèles publiés | MAI-Transcribe-1 / MAI-Voice-1 / MAI-Image-2 |

| Accès plateforme | Microsoft Foundry + MAI Playground |

| Importance stratégique | Premiers modèles multimodaux fondamentaux développés en interne par Microsoft, réduisant la dépendance envers OpenAI |

| État actuel | Aperçu public (Public Preview) |

Ces trois modèles couvrent les domaines de la reconnaissance vocale, de la génération vocale et de la génération d'images. Il s'agit des premiers modèles fondamentaux compétitifs lancés indépendamment par Microsoft après la renégociation des termes de son partenariat avec OpenAI.

Analyse approfondie du modèle de transcription vocale MAI-Transcribe-1

Paramètres techniques clés de MAI-Transcribe-1

MAI-Transcribe-1 est le modèle de reconnaissance vocale le plus puissant jamais conçu par Microsoft, atteignant la première place globale lors des tests de référence FLEURS.

| Dimension des paramètres | MAI-Transcribe-1 |

|---|---|

| Langues supportées | 25 langues |

| WER (référence FLEURS) | ~3,9 % (1er au classement général) |

| Vitesse de traitement | 2,5 fois plus rapide que la solution Azure Fast |

| Coût GPU | Réduit d'environ 50 % par rapport aux concurrents |

| Prix API | 0,36 $/heure |

| Avantage clé | WER le plus bas sur 11 langues principales |

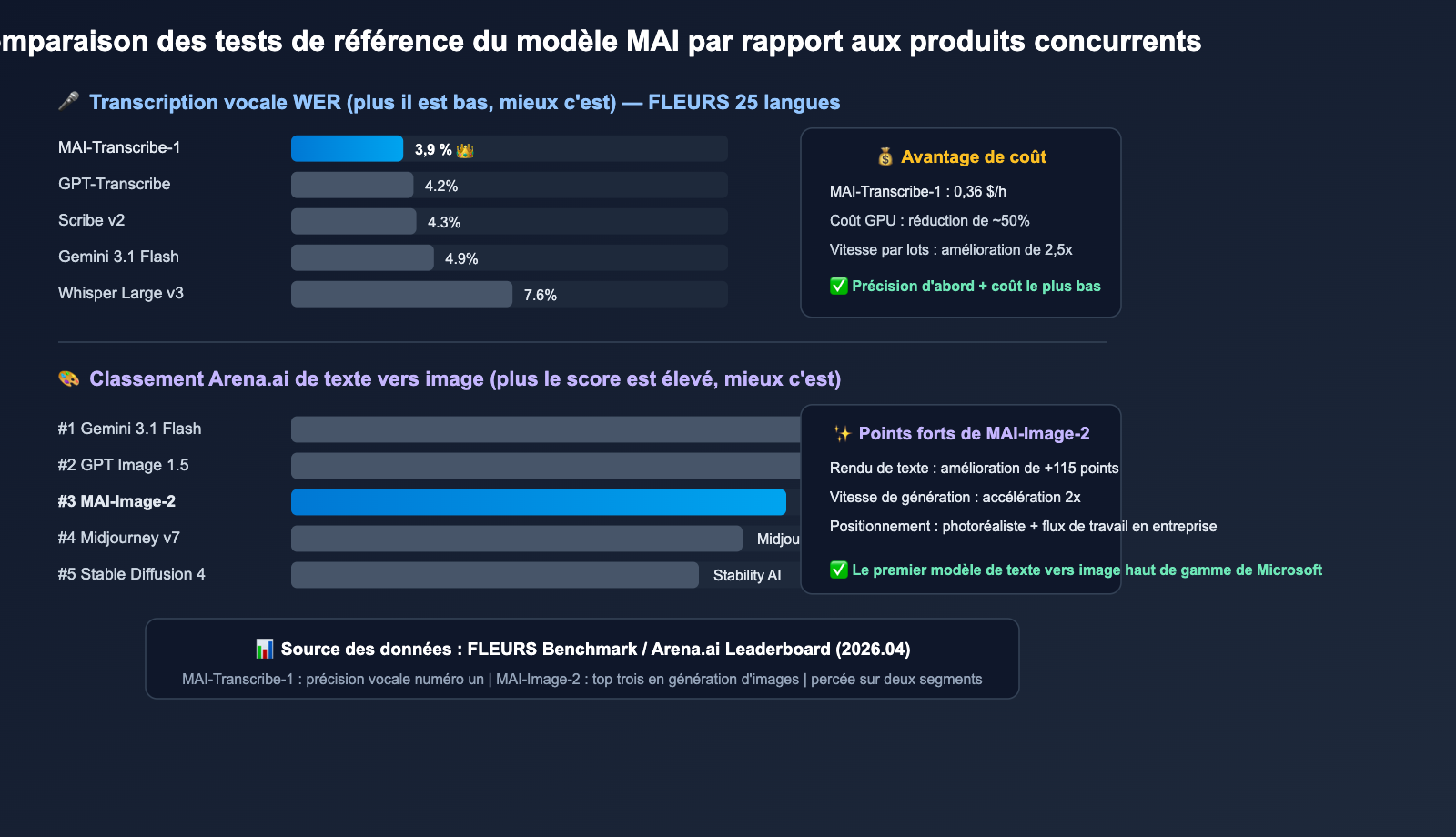

Comparaison du WER de MAI-Transcribe-1 avec la concurrence

Dans le test de référence FLEURS sur 25 langues, le taux d'erreur de mots (WER) de MAI-Transcribe-1 surpasse largement la concurrence :

| Modèle | WER FLEURS | Nombre de langues dominantes | Référence prix |

|---|---|---|---|

| MAI-Transcribe-1 | ~3,9 % | 11/25 (1er) | 0,36 $/heure |

| GPT-Transcribe (OpenAI) | ~4,2 % | — | Facturation par jeton |

| Scribe v2 (ElevenLabs) | ~4,3 % | — | À partir de 0,40 $/heure |

| Gemini 3.1 Flash | ~4,9 % | — | Facturation par jeton |

| Whisper Large v3 | ~7,6 % | — | Open source gratuit |

Les 5 avantages majeurs de MAI-Transcribe-1

1. Précision multilingue de niveau entreprise

MAI-Transcribe-1 se classe premier au niveau mondial sur 25 langues, avec le WER le plus bas du secteur pour 11 langues clés (dont l'anglais, le chinois, le japonais, l'espagnol, etc.). Pour les 14 autres langues, il surpasse également Whisper Large v3 et devance Gemini 3.1 Flash sur 11 d'entre elles.

2. Vitesse de traitement par lots multipliée par 2,5

Par rapport à la solution de transcription Azure Fast précédente, la vitesse de traitement par lots de MAI-Transcribe-1 a été multipliée par 2,5. Cela représente un gain d'efficacité significatif pour des scénarios tels que l'analyse d'enregistrements de centres d'appels, la génération de comptes-rendus de réunions ou la création de sous-titres vidéo.

3. Coûts GPU réduits d'environ 50 %

Grâce à l'optimisation de l'architecture du modèle, les coûts d'inférence GPU de MAI-Transcribe-1 ont été réduits de moitié tout en maintenant une précision de haut niveau. Cela permet de diminuer considérablement le coût total de possession pour les tâches de transcription vocale à grande échelle.

4. Large éventail de cas d'utilisation

- Systèmes IVR : Transcription en temps réel pour les serveurs vocaux interactifs

- Centres d'appels : Transcription et analyse automatiques des conversations clients

- Sous-titrage en direct : Génération de sous-titres en temps réel pour des événements et conférences

- Production vidéo : Génération automatique de sous-titres pour le contenu vidéo

- Études de marché : Transcription par lots d'enregistrements d'entretiens

5. Prix API compétitif

Le tarif de 0,36 $/heure offre un avantage concurrentiel évident sur le marché des services de transcription d'entreprise, surtout compte tenu de ses performances supérieures en matière de WER.

🎯 Conseil aux développeurs : Pour les développeurs souhaitant intégrer des capacités de transcription vocale dans leurs applications, MAI-Transcribe-1 propose un accès via API sur Microsoft Foundry. Si vous avez besoin d'invoquer simultanément plusieurs modèles d'IA (comme la transcription vocale, la génération de texte et la génération d'images), vous pouvez utiliser la plateforme APIYI (apiyi.com) pour centraliser la gestion des appels API de différents fournisseurs et simplifier la complexité technique de l'intégration multi-modèles.

Analyse technique du modèle de génération vocale MAI-Voice-1 de Microsoft

Paramètres clés de MAI-Voice-1

MAI-Voice-1 est un modèle de génération vocale haute performance lancé par Microsoft, dont l'atout majeur réside dans son efficacité de génération exceptionnelle.

| Dimension des paramètres | MAI-Voice-1 |

|---|---|

| Efficacité de génération | Moins d'une seconde pour générer 60 secondes d'audio sur un seul GPU |

| Clonage vocal | Seulement 10 secondes d'échantillon audio nécessaires pour créer une voix personnalisée |

| Bibliothèque vocale | Plus de 700 voix prédéfinies disponibles |

| Prix API | 22 $ par million de caractères |

| Méthode d'intégration | Azure Speech / Microsoft Foundry |

| Applications existantes | Fonctionnalités audio et podcast de Copilot |

Caractéristiques techniques principales de MAI-Voice-1

1. Efficacité de génération extrême

Sur un seul GPU, il est possible de générer 60 secondes de voix de haute qualité en moins d'une seconde. Cette efficacité fait de MAI-Voice-1 l'un des systèmes de synthèse vocale les plus performants à ce jour, particulièrement adapté aux scénarios nécessitant un retour vocal en temps réel.

2. Clonage vocal en 10 secondes

La fonctionnalité "Personal Voice" permet aux utilisateurs de créer une voix personnalisée hautement fidèle à partir de seulement 10 secondes d'échantillon audio. Notez toutefois que cette fonctionnalité nécessite l'approbation du processus d'IA responsable de Microsoft avant toute utilisation.

3. Galerie de plus de 700 voix

Grâce à l'intégration avec Azure Speech, les développeurs peuvent accéder à plus de 700 voix prédéfinies, couvrant une grande variété de langues, d'accents et de styles pour répondre aux besoins de différents cas d'usage.

4. Sortie vocale riche en émotions

MAI-Voice-1 ne se contente pas de générer une voix claire ; il est capable de simuler des nuances émotionnelles, incluant les variations de ton, le rythme des pauses et l'expression des sentiments, rendant la voix générée beaucoup plus naturelle et expressive.

💡 Cas d'usage : MAI-Voice-1 est particulièrement adapté à la production de livres audio, à la génération automatique de podcasts, aux réponses vocales du service client et à l'assistance à l'accessibilité. Les développeurs peuvent combiner un grand modèle de langage pour générer du texte, puis utiliser MAI-Voice-1 pour le convertir en voix, afin de construire un pipeline complet d'assistant vocal IA. Vous pouvez facilement intégrer l'étape de génération de texte par LLM via la plateforme APIYI apiyi.com.

MAI-Image-2 : Analyse détaillée du modèle de génération d'images le plus puissant de Microsoft

Paramètres clés de MAI-Image-2

MAI-Image-2 est le premier modèle de génération d'images développé en interne par Microsoft à atteindre un niveau de compétitivité de premier plan dans les classements de l'industrie.

| Dimension des paramètres | MAI-Image-2 |

|---|---|

| Classement Arena.ai | 3e place (juste derrière Gemini 3.1 Flash et GPT Image 1.5) |

| Vitesse de génération | Plus de 2 fois plus rapide que la génération précédente |

| Amélioration du rendu de texte | +115 points par rapport à la génération précédente |

| Prix d'entrée | 5 $ / million de jetons |

| Prix de sortie | 33 $ / million de jetons |

| Avantages clés | Réalisme photographique, rendu de texte puissant, précision des mises en page complexes |

Position de MAI-Image-2 dans le classement Arena.ai

| Rang | Modèle | Éditeur | Avantages clés |

|---|---|---|---|

| 1 | Gemini 3.1 Flash Image | Le plus complet en multimodal | |

| 2 | GPT Image 1.5 | OpenAI | Leader en diversité créative |

| 3 | MAI-Image-2 | Microsoft | Rendu de texte + réalisme photographique |

| 4 | Midjourney v7 | Midjourney | Style artistique remarquable |

| 5 | Stable Diffusion 4 | Stability AI | Écosystème open source |

Les 4 points forts techniques de MAI-Image-2

1. Réalisme photographique

MAI-Image-2 atteint de nouveaux sommets dans la génération d'images au style photographique réaliste. Les effets de lumière volumétrique, les textures des matériaux et les transitions d'ombre et de lumière sont proches du rendu d'une véritable photographie, ce qui le rend idéal pour la publicité commerciale et la présentation de produits.

2. Amélioration significative du rendu de texte

Comparé au modèle précédent, la capacité de rendu de texte intégré à l'image de MAI-Image-2 a progressé de 115 points. Cela signifie une clarté et une précision nettement supérieures lors de la génération d'infographies, d'affiches, de panneaux de signalisation ou de tout autre visuel contenant des éléments textuels.

3. Précision dans le traitement des mises en page complexes

Pour les tâches de génération impliquant plusieurs objets, des relations spatiales complexes et des scènes détaillées, MAI-Image-2 fait preuve d'une précision de composition supérieure à celle de ses concurrents, réduisant ainsi les problèmes de chevauchement d'objets et de déséquilibre des proportions.

4. Intégration dans les flux de travail d'entreprise

WPP, le plus grand groupe publicitaire mondial, utilise déjà massivement MAI-Image-2 pour ses créations. Microsoft positionne ce modèle comme un outil de productivité pour les designers et les marketeurs, avec une intégration profonde dans l'écosystème Microsoft 365.

🔧 Pratique technique : Dans les applications réelles de génération d'images par IA, les développeurs doivent souvent comparer les résultats de plusieurs modèles. La plateforme APIYI (apiyi.com) permet d'accéder de manière unifiée aux API de divers modèles de génération d'images tels que DALL-E ou Stable Diffusion, facilitant ainsi le basculement rapide et la comparaison des performances entre différents modèles.

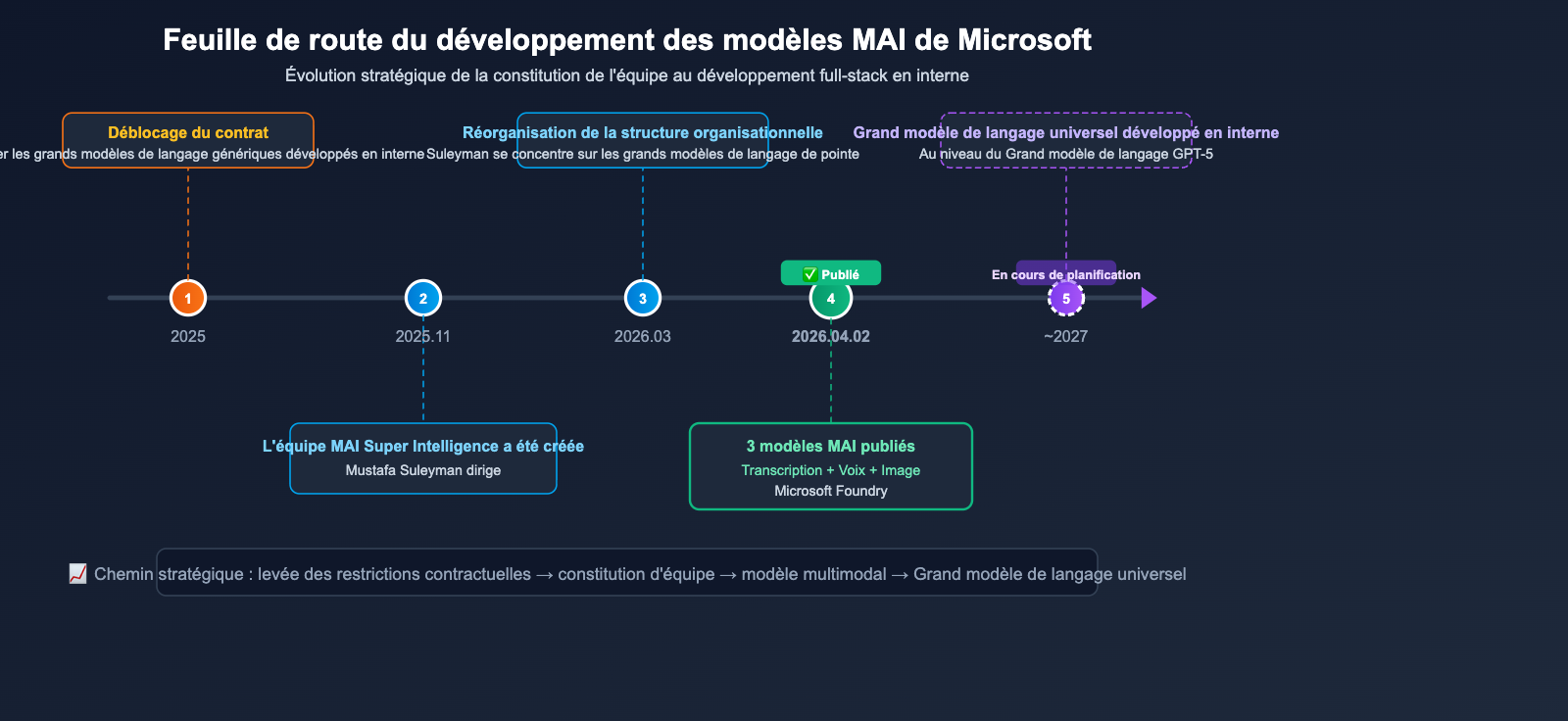

Stratégie MAI de Microsoft : Le premier pas vers l'indépendance vis-à-vis d'OpenAI

Pourquoi Microsoft développe ses propres modèles

La relation entre Microsoft et OpenAI connaît des évolutions subtiles. Le lancement des trois modèles MAI constitue un signal stratégique clair.

Chronologie clé :

- 2025 : Renégociation des termes de partenariat entre Microsoft et OpenAI, levant les contraintes contractuelles qui limitaient Microsoft dans le développement de modèles d'IA génériques en interne.

- Novembre 2025 : Mustafa Suleyman forme l'équipe d'intelligence supérieure MAI, dédiée à la recherche sur les modèles de pointe.

- Mars 2026 : Satya Nadella annonce une restructuration organisationnelle ; Suleyman se concentre désormais exclusivement sur les modèles de pointe, quittant la gestion quotidienne de Copilot.

- 2 avril 2026 : L'équipe MAI publie ses trois premiers modèles de base développés en interne.

- Objectif 2027 : Lancement prévu d'un grand modèle de langage générique capable de rivaliser avec le niveau de GPT-5.

État actuel de la matrice des modèles IA de Microsoft

| Catégorie de modèle | Fourni par OpenAI | Développé par Microsoft (MAI) |

|---|---|---|

| LLM générique | GPT-5.4 (cœur de Copilot) | En planification (2027) |

| Reconnaissance vocale | Whisper / GPT-Transcribe | MAI-Transcribe-1 ✅ |

| Génération vocale | — | MAI-Voice-1 ✅ |

| Texte vers image | DALL-E 3 | MAI-Image-2 ✅ |

| Modèle de code | Codex | En planification |

Ce que cela signifie pour les développeurs

Microsoft construit un système d'approvisionnement en modèles d'IA à « double voie » : d'une part, continuer à utiliser les LLM génériques d'OpenAI (GPT-5.4), et d'autre part, lancer des alternatives internes pour les domaines de la voix et de l'image. Cela signifie que les développeurs disposeront d'un choix plus large au sein de l'écosystème Microsoft.

🎯 Aperçu de l'industrie : Le lancement des modèles développés en interne par Microsoft signifie que la concurrence sur le marché des modèles d'IA va s'intensifier. Pour les développeurs, le choix du modèle et du canal d'accès devient crucial. Grâce à la plateforme APIYI (apiyi.com), qui permet d'accéder de manière unifiée aux API de plusieurs fournisseurs d'IA, il est possible de basculer entre les modèles sous-jacents sans modifier le code, afin de s'adapter à un marché en évolution rapide.

Tarification et intégration des modèles Microsoft MAI

Aperçu des tarifs des trois modèles

| Modèle | Mode de facturation | Prix | Plateforme d'intégration |

|---|---|---|---|

| MAI-Transcribe-1 | Par durée audio | 0,36 $/heure | Microsoft Foundry / Azure Speech |

| MAI-Voice-1 | Par nombre de caractères | 22 $/million de caractères | Microsoft Foundry / Azure Speech |

| MAI-Image-2 | Par nombre de jetons | Entrée 5 $/million + Sortie 33 $/million de jetons | Microsoft Foundry |

Méthodes d'intégration

Option 1 : Microsoft Foundry

Les trois modèles sont disponibles via la plateforme développeur Microsoft Foundry sous forme d'aperçu public pour l'accès API. Les développeurs peuvent effectuer l'invocation du modèle directement via les points de terminaison API de Foundry.

Option 2 : MAI Playground

MAI Playground est la nouvelle plateforme d'expérience de modèles de Microsoft. Les développeurs peuvent y tester gratuitement les capacités de MAI-Transcribe-1 et MAI-Voice-1 pour évaluer rapidement leur adéquation avec leurs cas d'usage.

Option 3 : Intégration Azure Speech

MAI-Transcribe-1 et MAI-Voice-1 sont profondément intégrés au service Azure Speech. Les utilisateurs Azure existants peuvent les appeler directement via le SDK Azure Speech.

💰 Optimisation des coûts : Lors de la création d'applications d'IA multimodal, la transcription vocale, la génération de texte et la génération d'images nécessitent souvent la combinaison de modèles provenant de différents fournisseurs. La plateforme APIYI apiyi.com permet de gérer de manière centralisée vos clés API et votre consommation, évitant ainsi les coûts de gestion liés à l'inscription sur plusieurs plateformes. La plateforme prend en charge l'accès aux modèles de nombreux fournisseurs, dont Microsoft, OpenAI, Anthropic et Alibaba Cloud.

Analyse de l'impact des modèles MAI de Microsoft sur l'industrie de l'IA

Impact sur le marché des modèles d'IA

1. Évolution du paysage de la reconnaissance vocale

Avec un taux d'erreur de transcription (WER) d'environ 3,9 %, MAI-Transcribe-1 défie directement GPT-Transcribe d'OpenAI (4,2 %) et Scribe v2 d'ElevenLabs (4,3 %). Couplé à un avantage de coût de 50 %, il est en bonne position pour conquérir rapidement des parts de marché dans la transcription vocale en entreprise.

2. Intensification de la concurrence dans le texte vers image

L'arrivée de MAI-Image-2 dans le top 3 d'Arena.ai consolide un trio de tête dans le domaine du texte vers image : Google (Gemini 3.1 Flash), OpenAI (GPT Image 1.5) et Microsoft (MAI-Image-2). Cela exerce une pression accrue sur des acteurs indépendants comme Midjourney et Stability AI.

3. La tendance de l'auto-développement « full-stack » chez les géants de l'IA

Après Google (série Gemini) et Meta (série Llama), Microsoft commence également à construire ses propres capacités de modèles d'IA full-stack. Cela signifie que la concurrence sur le marché de l'IA sera de plus en plus concentrée entre quelques grands acteurs.

Impact sur les développeurs

- Plus de choix de modèles : L'écosystème Microsoft ne se limite plus uniquement à OpenAI.

- Concurrence accrue sur les prix : La rivalité entre fournisseurs poussera les prix des API à la baisse.

- Combinaison de modèles : Les développeurs doivent apprendre à choisir de manière flexible les modèles de différents fournisseurs en fonction du scénario.

🚀 Conseil de développement : Face à la croissance rapide des options de modèles d'IA, nous recommandons aux développeurs d'utiliser une plateforme d'accès unifiée comme APIYI apiyi.com pour gérer l'invocation du modèle et éviter le verrouillage par un seul fournisseur. La plateforme propose des interfaces standard compatibles avec OpenAI, permettant de changer de modèle simplement en modifiant le paramètre

model.

FAQ sur les modèles MAI de Microsoft

Q1 : Quelle est la relation entre les modèles MAI et les modèles OpenAI ?

Les modèles MAI sont développés indépendamment par l'équipe « Super Intelligence » de Microsoft MAI et n'ont aucun lien avec OpenAI. Microsoft adopte actuellement une stratégie de « double voie » : les LLM généralistes continuent d'utiliser GPT-5.4 d'OpenAI, tandis que la gamme MAI, développée en interne, est déployée pour les domaines de la voix et de l'image. Après la renégociation du contrat entre Microsoft et OpenAI en 2025, les clauses limitant le développement de modèles propriétaires par Microsoft ont été supprimées.

Q2 : En quoi MAI-Transcribe-1 est-il meilleur que Whisper ?

Lors du test de référence linguistique FLEURS 25, le taux d'erreur (WER) de MAI-Transcribe-1 est d'environ 3,9 %, contre 7,6 % pour Whisper Large v3, ce qui montre un écart de précision significatif. Parallèlement, la vitesse de traitement par lots de MAI-Transcribe-1 est 2,5 fois supérieure à celle de la solution Azure Fast, avec une réduction des coûts GPU d'environ 50 %. Cependant, l'avantage de Whisper réside dans son caractère open-source et gratuit, ce qui le rend idéal pour les scénarios extrêmement sensibles aux coûts.

Q3 : MAI-Image-2 peut-il remplacer DALL-E ?

D'après le classement Arena.ai, MAI-Image-2 (3e) se situe globalement au-dessus de DALL-E 3. Il présente un avantage net, notamment en matière de rendu de texte et de réalisme photographique. Toutefois, DALL-E conserve une approche unique pour certains styles créatifs. Pour les entreprises, l'intégration poussée de MAI-Image-2 avec l'écosystème Microsoft pourrait constituer un argument de poids.

Q4 : Comment tester rapidement ces trois modèles MAI ?

Le moyen le plus rapide est de visiter le MAI Playground (la nouvelle plateforme d'expérience de modèles de Microsoft) pour un essai gratuit. L'accès API officiel nécessite de passer par la plateforme développeur Microsoft Foundry. Si votre application doit invoquer plusieurs modèles d'IA simultanément, vous pouvez utiliser la plateforme APIYI apiyi.com pour gérer de manière centralisée les accès API de différents fournisseurs et simplifier votre processus de développement.

Q5 : Quand Microsoft prévoit-il de publier son propre grand modèle de langage généraliste ?

Selon les informations publiques, Microsoft déploie actuellement des clusters de puces Nvidia GB200 et prévoit de construire une puissance de calcul de pointe dans les 12 à 18 prochains mois. Le lancement d'un LLM généraliste propriétaire, capable de rivaliser avec le niveau de GPT-5, est prévu aux alentours de 2027. D'ici là, le LLM au cœur de Copilot continuera d'utiliser GPT-5.4 d'OpenAI.

Résumé des 3 nouveaux modèles de Microsoft MAI

L'équipe MAI de Microsoft a rendu une copie impressionnante seulement 5 mois après sa création :

- MAI-Transcribe-1 : Première place sur le benchmark FLEURS avec un WER d'environ 3,9 %, une vitesse multipliée par 2,5, un coût réduit de 50 % et une tarification à 0,36 $/heure.

- MAI-Voice-1 : Génère 60 secondes de voix en moins d'une seconde sur un seul GPU, prend en charge le clonage vocal en 10 secondes et propose plus de 700 voix prédéfinies.

- MAI-Image-2 : 3e place au classement de génération d'images Arena.ai, avec une amélioration de 115 points sur le rendu de texte, et une prise en charge des mises en page complexes ainsi qu'un réalisme photographique.

Le lancement de ces trois modèles démontre non seulement les capacités de recherche et développement de Microsoft, mais marque également l'accélération de la tendance des « géants du secteur misant sur le développement full-stack ». Pour les développeurs, le choix de modèles ne cesse de s'élargir. Utiliser des plateformes d'accès unifiées comme APIYI (apiyi.com) pour gérer l'invocation du modèle auprès de multiples fournisseurs deviendra une stratégie clé pour booster l'efficacité du développement et réduire les coûts de transition.

📝 Auteur : Équipe APIYI | Pour plus d'analyses techniques sur les modèles d'IA et des guides d'accès aux API, veuillez visiter le centre d'aide APIYI : help.apiyi.com