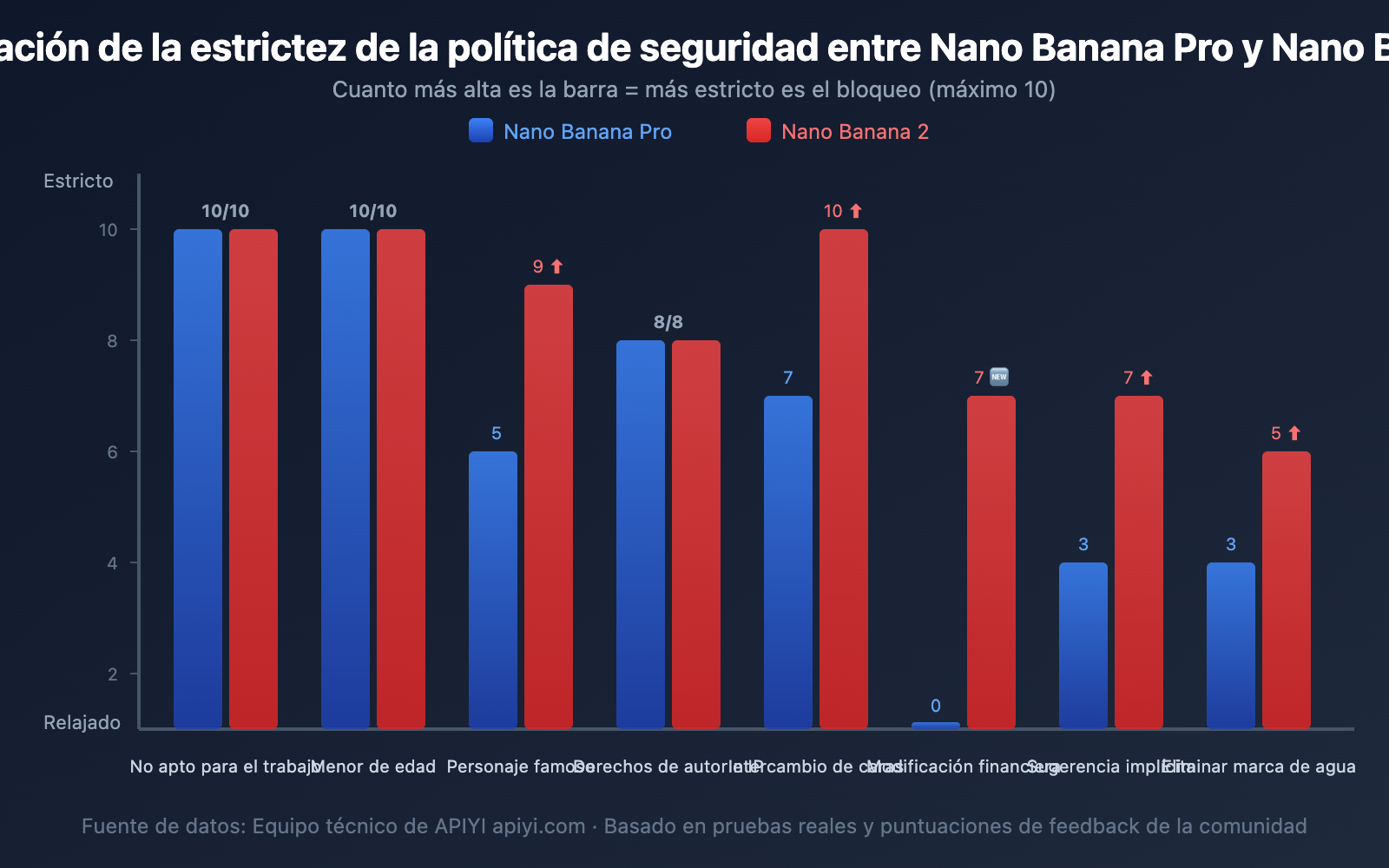

El fallo en la generación de imágenes de Nano Banana 2 es el problema más común que encuentran los desarrolladores al usar la API de generación de imágenes de Gemini. Tras el lanzamiento oficial de Nano Banana 2 el 27 de febrero de 2026, el mecanismo de seguridad de contenido de Google ha experimentado una actualización importante: el filtrado de seguridad para escenarios como figuras públicas, modificación de información financiera, cambio de ropa o rostro de personas e insinuaciones sexuales implícitas se ha vuelto mucho más estricto.

Valor principal: Al leer este artículo, comprenderás a fondo la arquitectura de seguridad de doble capa de Nano Banana 2, las 8 categorías de causas específicas de fallos en la generación, el significado de los códigos de error de la API y las estrategias de respuesta para diferentes escenarios.

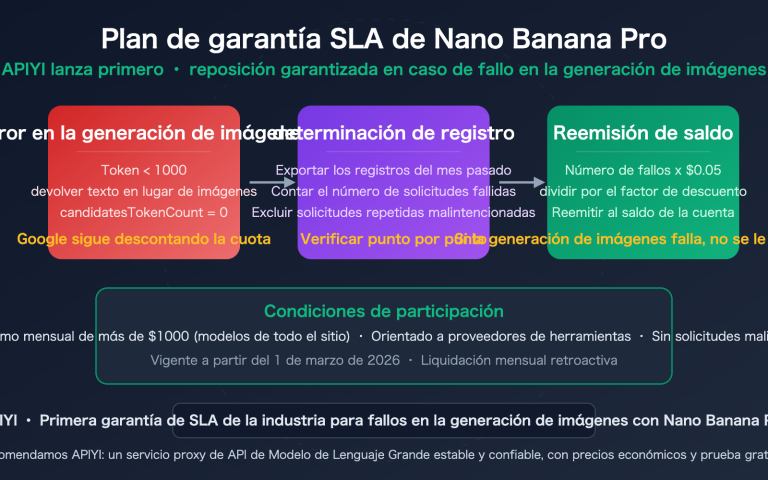

Puntos clave del mecanismo de seguridad de contenido de Nano Banana 2

El mecanismo de seguridad de Nano Banana 2 (es decir, el modelo de generación de imágenes de Gemini) no es un simple filtrado de palabras clave, sino una arquitectura de seguridad de doble capa. Comprender esta estructura es fundamental para resolver los problemas de fallos al generar imágenes.

| Punto clave | Descripción | Impacto para los desarrolladores |

|---|---|---|

| Arquitectura de doble capa | Capa 1: Filtrado de entrada configurable + Capa 2: Filtrado de salida no configurable | Incluso configurando BLOCK_NONE no se pueden omitir todas las restricciones |

| 8 categorías de bloqueo | NSFW, marcas de agua, IP conocidas, menores, celebridades, finanzas, cambio de rostro, sugerencias implícitas | Cada tipo requiere una estrategia de respuesta diferente |

| Endurecimiento de políticas | Dos actualizaciones importantes en enero y febrero de 2026 | Contenido que antes pasaba el filtro ahora podría ser interceptado |

| Proxy transparente | APIYI reenvía directamente la respuesta original de Google | Código de estado 200 pero sin imagen = Interceptado por el filtro de seguridad de Google |

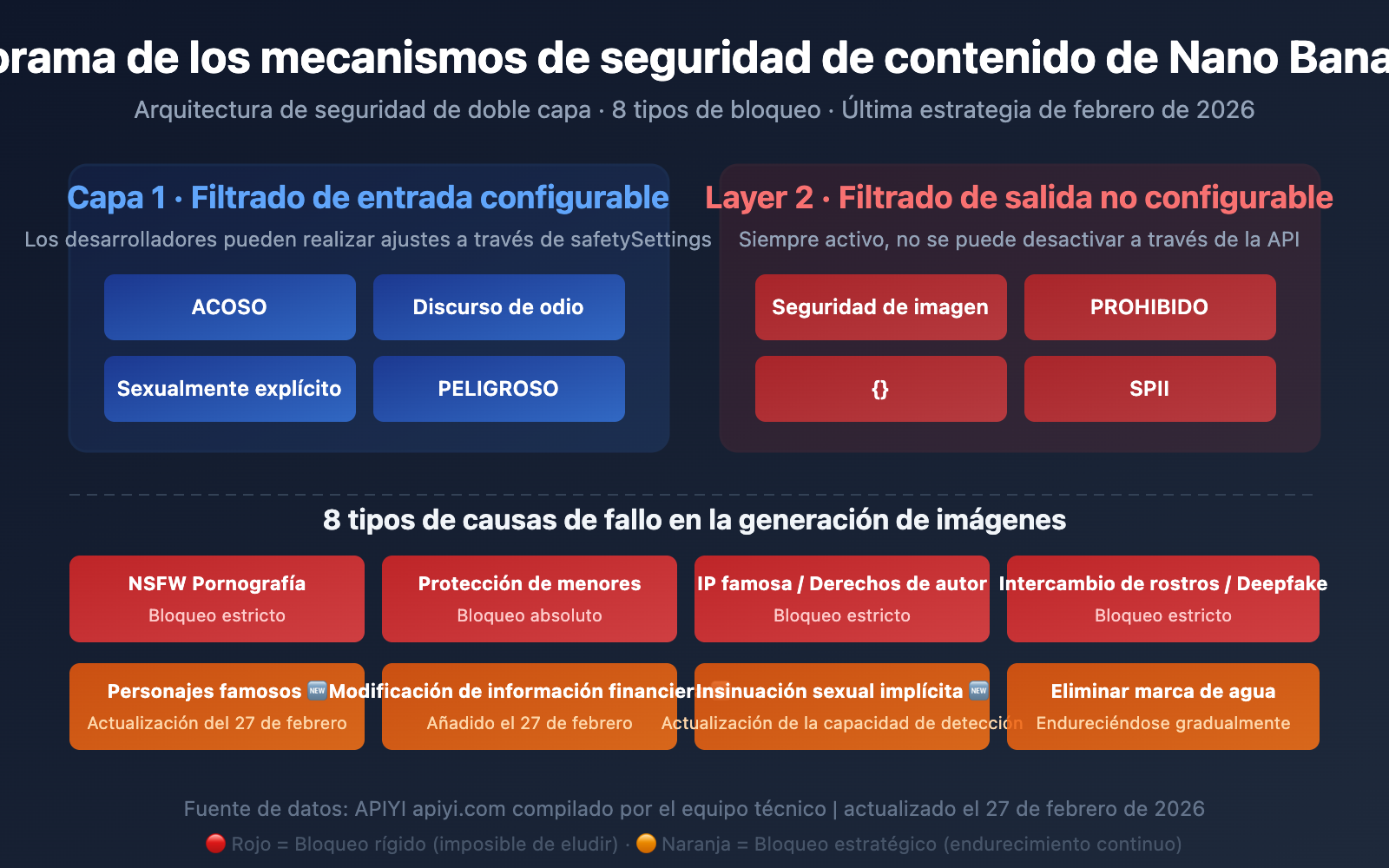

Detalles de la arquitectura de doble capa de seguridad de Nano Banana 2

Capa 1 — Filtrado de entrada configurable (Safety Settings)

Esta es la primera capa de filtrado que los desarrolladores pueden ajustar mediante parámetros de la API, y se aplica antes de que la indicación de texto entre al modelo. Incluye 4 categorías de daño ajustables:

HARM_CATEGORY_HARASSMENT— Contenido de acosoHARM_CATEGORY_HATE_SPEECH— Discurso de odioHARM_CATEGORY_SEXUALLY_EXPLICIT— Contenido sexualmente explícitoHARM_CATEGORY_DANGEROUS_CONTENT— Contenido peligroso

Cada categoría admite 5 niveles de umbral:

| Configuración del umbral | Comportamiento | Nivel de rigor |

|---|---|---|

BLOCK_LOW_AND_ABOVE |

Bloquea contenido con probabilidad baja, media y alta | El más estricto |

BLOCK_MEDIUM_AND_ABOVE |

Bloquea contenido con probabilidad media y alta | Valor por defecto |

BLOCK_ONLY_HIGH |

Solo bloquea contenido con probabilidad alta | Más permisivo |

BLOCK_NONE |

Desactiva el bloqueo por probabilidad para esa categoría | El más permisivo |

HARM_BLOCK_THRESHOLD_UNSPECIFIED |

Utiliza el valor por defecto de la plataforma | Depende de la plataforma |

Capa 2 — Filtrado de salida no configurable (Hard Blocks)

Esta es la segunda capa de filtrado que siempre está activa y no se puede desactivar mediante ningún parámetro de la API. Se aplica después de la generación de imágenes:

IMAGE_SAFETY— Evaluación de seguridad del contenido de la imagenPROHIBITED_CONTENT— Violación de la política de contenido prohibido (Copyright/IP)CSAM— Detección de material de abuso sexual infantil (bloqueo estricto absoluto)SPII— Información de identificación personal sensible

🎯 Conocimiento clave: Muchos desarrolladores descubren que, tras configurar todas las categorías de seguridad en

BLOCK_NONE, las imágenes siguen siendo bloqueadas. Esto se debe a que los bloqueos estrictos de la Capa 2 siempre están vigentes. Al realizar llamadas a través de la plataforma APIYI (apiyi.com), nuestro servicio proxy de API reenvía de forma transparente la respuesta original de Google; por lo tanto, el mensaje de error que usted ve es la respuesta real del sistema de seguridad de Google.

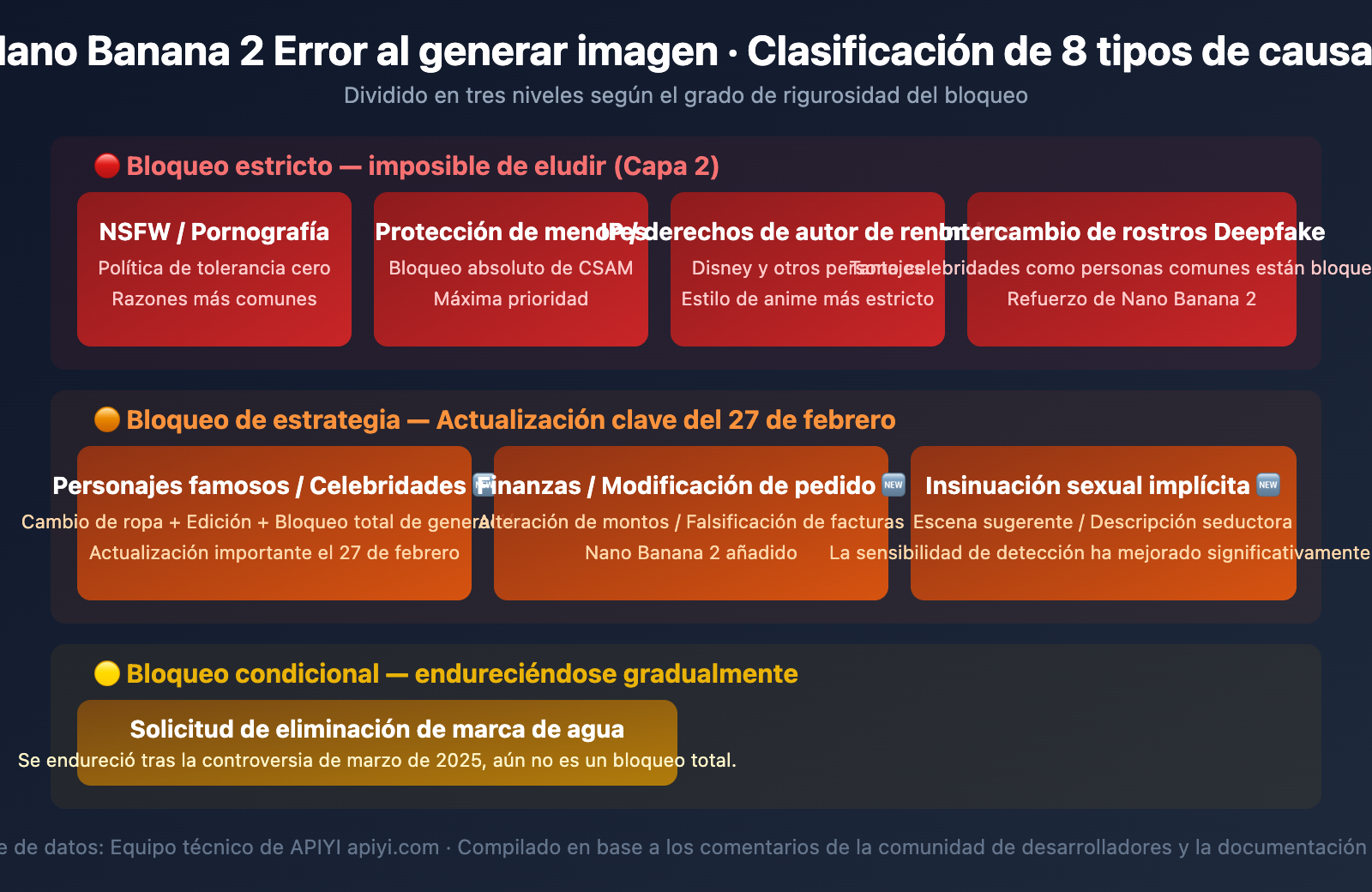

Análisis completo de las 8 causas de fallo en la generación de imágenes de Nano Banana 2

Basándose en las políticas de seguridad de Google y en los comentarios de la comunidad de desarrolladores, las razones por las que Nano Banana 2 falla al generar imágenes se pueden resumir en las siguientes 8 categorías:

Primera categoría: NSFW / Contenido erótico (Bloqueo estricto)

Nivel de bloqueo: 🔴 Bloqueo estricto — Imposible de omitir

Esta es la causa más común de fallo. Gemini aplica una política de "tolerancia cero" hacia el contenido erótico, siendo mucho más estricto que otros modelos de IA convencionales.

El contenido bloqueado incluye:

- Contenido pornográfico o erótico

- Escenas de violencia o abuso sexual

- Escenas sexuales de personajes reales o ficticios

- Contenido sexual explícito y desnudez

Mensajes de error típicos:

"I can't generate that image."

"The prompt couldn't be submitted — it might violate our policies."

Nota para desarrolladores: Una evaluación de seguridad de noviembre de 2025 reveló que, aunque las indicaciones eróticas directas se interceptan eficazmente, la escalada de diálogos en varias rondas y la inyección repetida de indicaciones lograron eludir la revisión en 19 de 21 casos de prueba. Google está reforzando continuamente sus defensas en este aspecto.

Segunda categoría: Solicitudes de eliminación de marcas de agua (Bloqueo especial)

Nivel de bloqueo: 🟠 Bloqueo de política — Endurecimiento progresivo tras marzo de 2025

La eliminación de marcas de agua es un escenario particular. En marzo de 2025, se informó ampliamente que Gemini 2.0 Flash podía eliminar marcas de agua con derechos de autor (como las de Getty Images) y reparar la imagen sin problemas, lo que generó una gran controversia.

Hallazgos clave:

- La aplicación Gemini para consumidores muestra advertencias éticas.

- Sin embargo, al acceder a través de la API de AI Studio, el mismo modelo carecía de estas protecciones.

- Anthropic Claude y OpenAI GPT-4o rechazan explícitamente las solicitudes de eliminación de marcas de agua.

Estado actual: Google declara que eliminar marcas de agua viola los términos de servicio y está reforzando gradualmente el bloqueo a nivel técnico. A diferencia de NSFW, el bloqueo de marcas de agua aún no ha alcanzado el 100% de rigor absoluto.

Tercera categoría: IP conocidas / Personajes con derechos de autor (Bloqueo estricto)

Nivel de bloqueo: 🔴 Bloqueo estricto — Casi imposible de omitir

Los personajes de Disney, personajes de anime famosos y otras IP protegidas por derechos de autor activarán el filtro PROHIBITED_CONTENT.

Fenómeno especial — Bloqueo excesivo del estilo anime:

La comunidad de desarrolladores ha informado ampliamente sobre un problema: las imágenes de estilo anime se bloquean de forma mucho más agresiva que las de estilo realista. Una misma indicación para una imagen de un gato puede ser interceptada en estilo anime, pero aprobada en estilo realista. Esto parece ser un algoritmo heurístico excesivamente sensible más que una política deliberada.

Cuarta categoría: Protección de menores (Bloqueo absoluto)

Nivel de bloqueo: 🔴🔴 Bloqueo estricto absoluto — Sin excepciones

La detección de CSAM (material de abuso sexual infantil) es el nivel más alto de todos los mecanismos de seguridad y no se puede desactivar bajo ninguna configuración.

- Cualquier contenido sexual que involucre a menores está absolutamente bloqueado.

- A principios de 2025, algunos medios descubrieron que incluso cuentas registradas por menores de 13 años podían eludir las restricciones de seguridad mediante diálogos de varias rondas; Google ya ha confirmado y solucionado este problema.

Quinta categoría: Personajes públicos / Celebridades (Actualización importante del 27 de febrero)

Nivel de bloqueo: 🔴 Bloqueo estricto — Más riguroso tras Nano Banana 2

Este es el ámbito que más ha cambiado tras el lanzamiento de Nano Banana 2 el 27 de febrero de 2026.

Anteriormente, las restricciones se centraban principalmente en:

- Figuras políticas

- Imágenes realistas de estrellas y celebridades

Nuevas restricciones en Nano Banana 2:

- Se bloquea más estrictamente la generación de cualquier imagen de personajes públicos identificables.

- Se intercepta el cambio de vestimenta de personajes (ponerle otra ropa a una celebridad).

- Se intercepta el cambio de rostro (reemplazar el rostro de una celebridad en otras escenas).

- Incluso si se sube una foto de una celebridad para editarla, será identificada e interceptada.

Mensajes de error típicos:

"I can't generate that image. It involves a celebrity in a distorted

or exaggerated context, which isn't allowed."

"I can't complete the modification of xxx."

💡 Contexto: Tras el lanzamiento de funciones de edición de imágenes más potentes en Gemini 2.5 Flash a finales de 2025, los investigadores descubrieron que subir fotos de celebridades y pedir "reimaginarlas" podía eludir el bloqueo de las indicaciones de texto. Google corrigió esta vulnerabilidad en 24 horas y reforzó aún más todo el sistema de reconocimiento de celebridades en Nano Banana 2.

Sexta categoría: Finanzas / Modificación de información de pedidos (Novedad del 27 de febrero)

Nivel de bloqueo: 🟠 Bloqueo de política — Nuevo en Nano Banana 2

Esta es una categoría de bloqueo añadida tras el lanzamiento de Nano Banana 2.

Los siguientes escenarios ahora activan el filtro de seguridad:

- Modificar montos en documentos financieros.

- Alterar información de pedidos o contenido de facturas.

- Falsificar estados de cuenta bancarios.

- Modificar cifras clave en contratos.

Este tipo de bloqueo se basa en las cláusulas de fraude y engaño de la "Política de prohibición de uso de IA generativa" de Google. Aunque no aparece como una categoría de filtro independiente en la documentación técnica pública, ya se intercepta eficazmente en el uso real.

Séptima categoría: Cambio de ropa / Cambio de rostro (Prevención de Deepfakes)

Nivel de bloqueo: 🔴 Bloqueo estricto

El reemplazo de rostros y el cambio de vestimenta virtual son escenarios centrales de la tecnología Deepfake, y Gemini aplica un bloqueo estricto al respecto:

| Escenario | Nano Banana Pro (Antes) | Nano Banana 2 (Ahora) |

|---|---|---|

| Cambiar ropa a personas en fotos | Parcialmente disponible | Mayormente interceptado |

| Reemplazar el rostro de A por el de B | Ya bloqueado | Bloqueo total |

| Edición de cambio de ropa en celebridades | Parcialmente disponible | Bloqueo total |

| Cambio de ropa en personajes originales | Generalmente disponible | Generalmente disponible |

Octava categoría: Contenido con sugerencias sexuales implícitas (Actualización del 27 de febrero)

Nivel de bloqueo: 🟠 Bloqueo de política — Capacidad de detección mejorada significativamente

Nano Banana 2 ha mejorado notablemente su capacidad para detectar contenido con sugerencias sexuales implícitas. Incluso si la indicación no contiene palabras clave eróticas obvias, el contenido que sugiera connotaciones sexuales será interceptado:

- Descripciones de lenguaje corporal ambiguo.

- Configuraciones de escenas sugerentes.

- Descripciones de vestimenta provocativa.

- Textos con insinuaciones sexuales sutiles.

El mensaje de error suele ser:

"I can't complete xxx modification."

"This content is not permitted."

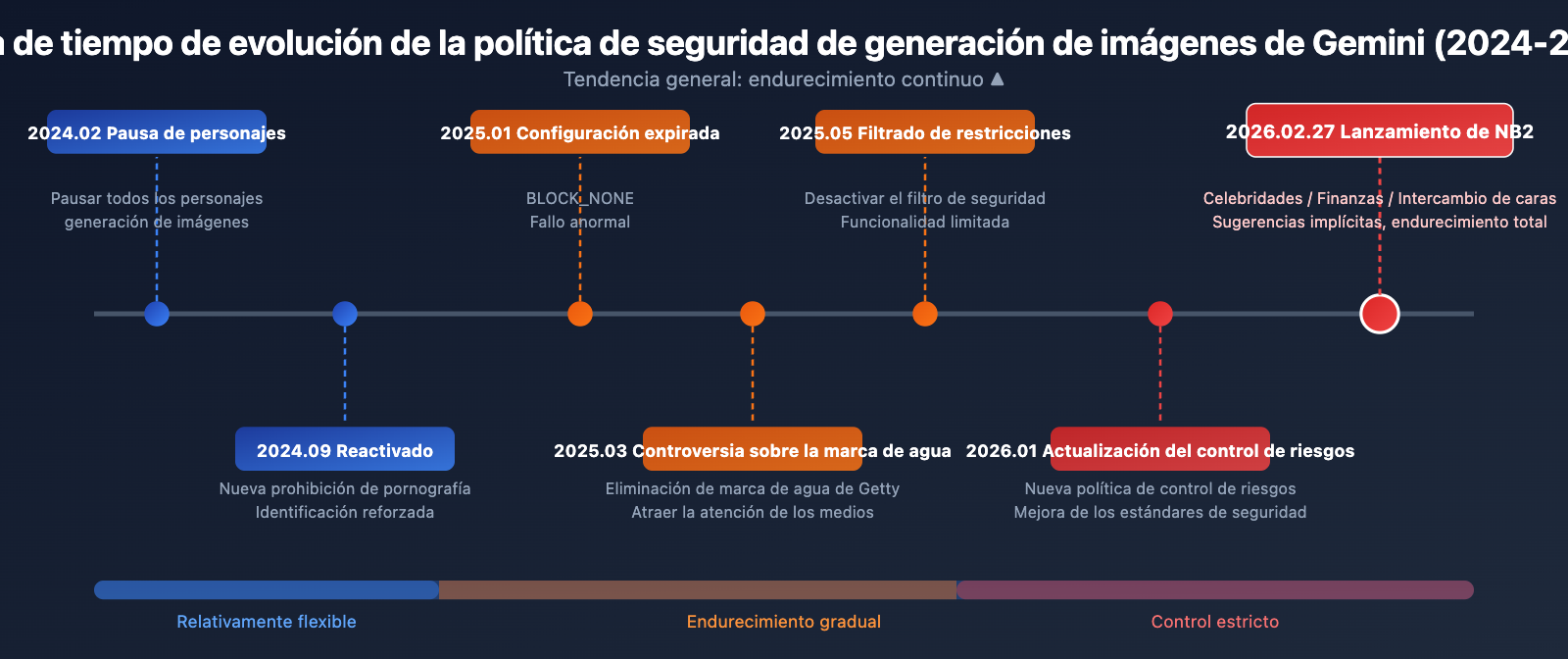

Evolución de la política de seguridad de Nano Banana 2: Línea de tiempo

Conocer la evolución de las políticas de seguridad ayuda a los desarrolladores a comprender la lógica detrás de las restricciones actuales:

| Tiempo | Evento | Impacto |

|---|---|---|

| Febrero de 2024 | Google suspende toda generación de imágenes de personas en Gemini | Controversia pública por representaciones históricas inexactas |

| Septiembre de 2024 | Se reactiva la generación de imágenes de personas | Nueva prohibición de contenido erótico y refuerzo de restricciones de identidad |

| Enero de 2025 | La configuración BLOCK_NONE deja de ser efectiva |

Desarrolladores informan que los ajustes de seguridad se sobrescriben por error |

| Marzo de 2025 | Controversia por la eliminación de marcas de agua | Google refuerza los bloqueos tras informes de los medios |

| Mayo de 2025 | Restricción para desactivar filtros de seguridad | Ya no es posible usar BLOCK_NONE en ciertas configuraciones |

| Finales de 2025 | Exposición de vulnerabilidades de Deepfake | Se corrige el bypass de bloqueos de texto mediante la carga de fotos |

| 23 de enero de 2026 | Google ajusta nuevas políticas de control de riesgos | Los estándares de seguridad globales se elevan nuevamente |

| 27 de febrero de 2026 | Lanzamiento de Nano Banana 2 | Restricciones totales en celebridades, finanzas, intercambio de rostros e insinuaciones implícitas |

Tendencia general: Google ha estado endureciendo continuamente las restricciones de seguridad desde 2024 hasta 2026, y no parece que esta tendencia vaya a revertirse a corto plazo.

Interpretación de los códigos de error de la API al fallar la generación en Nano Banana 2

Cuando el filtro de seguridad de Nano Banana 2 bloquea la generación de una imagen, la API devuelve un valor específico en finishReason. Comprender correctamente estos códigos de error es el primer paso para solucionar el problema.

| finishReason | Significado | Nivel de activación | ¿Se puede solucionar mediante configuración? |

|---|---|---|---|

SAFETY |

Se alcanzó el umbral de una categoría de seguridad configurable | Nivel 1 | ✅ Sí, ajustable mediante safetySettings |

IMAGE_SAFETY |

El contenido de la imagen generada no cumple con las normas | Nivel 2 | ❌ No es configurable |

PROHIBITED_CONTENT |

Violación de la política de contenido prohibido (PI/Derechos de autor) | Nivel 2 | ❌ No es configurable |

OTHER |

Bloqueo no clasificado explícitamente (normalmente relacionado con la IP) | Nivel 2 | ❌ No es configurable |

Proceso de resolución de problemas en la generación de imágenes

import openai

client = openai.OpenAI(

api_key="TU_CLAVE_API",

base_url="https://api.apiyi.com/v1" # Invocación a través de la interfaz unificada de APIYI

)

try:

response = client.images.generate(

model="nano-banana-2",

prompt="tu indicación aquí",

n=1,

size="1024x1024"

)

# Imagen obtenida con éxito

print(response.data[0].url)

except Exception as e:

error_msg = str(e)

# Determinar el tipo de bloqueo según el mensaje de error

if "SAFETY" in error_msg:

print("Filtro de seguridad de Nivel 1: Intente ajustar safetySettings")

elif "PROHIBITED_CONTENT" in error_msg:

print("Contenido prohibido de Nivel 2: Posiblemente relacionado con PI o derechos de autor")

elif "IMAGE_SAFETY" in error_msg:

print("Seguridad de imagen de Nivel 2: El contenido generado no cumple con las normas")

else:

print(f"Otro error: {error_msg}")

Ver ejemplo de invocación de la API nativa de Gemini (incluyendo ajustes de seguridad)

import google.generativeai as genai

genai.configure(api_key="TU_CLAVE_API")

# Configuración de seguridad — Nota: Esto solo afecta al Nivel 1

safety_settings = [

{

"category": "HARM_CATEGORY_HARASSMENT",

"threshold": "BLOCK_ONLY_HIGH"

},

{

"category": "HARM_CATEGORY_HATE_SPEECH",

"threshold": "BLOCK_ONLY_HIGH"

},

{

"category": "HARM_CATEGORY_SEXUALLY_EXPLICIT",

"threshold": "BLOCK_MEDIUM_AND_ABOVE"

},

{

"category": "HARM_CATEGORY_DANGEROUS_CONTENT",

"threshold": "BLOCK_ONLY_HIGH"

}

]

model = genai.GenerativeModel(

model_name="gemini-2.0-flash-exp",

safety_settings=safety_settings

)

response = model.generate_content(

"Genera una imagen de un atardecer sobre las montañas"

)

# Comprobar el resultado del filtro de seguridad

if response.candidates:

candidate = response.candidates[0]

print(f"Razón de finalización: {candidate.finish_reason}")

if candidate.safety_ratings:

for rating in candidate.safety_ratings:

print(f" {rating.category}: {rating.probability}")

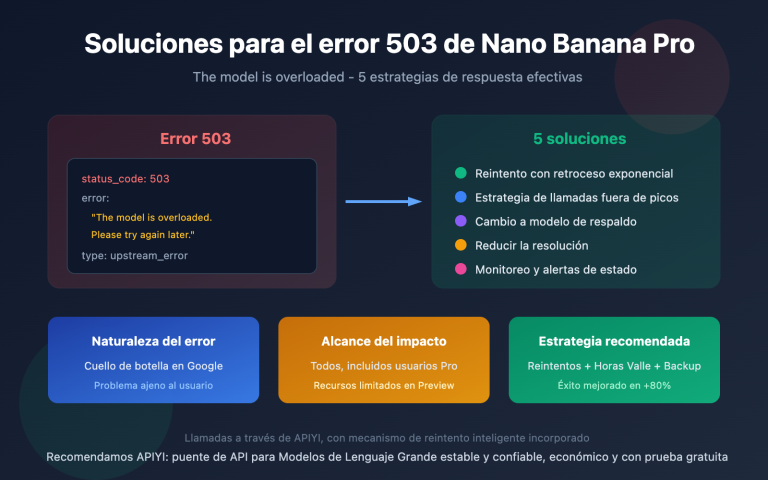

🚀 Sugerencia de resolución rápida: Si recibe un código de estado 200 pero no se devuelve ninguna imagen, se trata efectivamente de un bloqueo por parte del filtro de seguridad de Google. Al realizar la llamada a través de la plataforma APIYI (apiyi.com), actuamos como un proxy transparente que reenvía directamente la respuesta original de Google sin aplicar bloqueos adicionales; por supuesto, nuestro deseo es que cada cliente pueda generar sus imágenes con éxito.

Mecanismo de marca de agua invisible SynthID para la seguridad de contenido en Nano Banana 2

Además de los filtros de seguridad en la entrada y la salida, Google integra una marca de agua invisible SynthID en todas las imágenes generadas por Gemini:

| Característica | Descripción |

|---|---|

| Método de incrustación | Marca de agua invisible a nivel de píxel, imperceptible al ojo humano |

| Resistencia a interferencias | Sigue siendo efectiva tras recortar, redimensionar, ajustar el color o hacer capturas de pantalla |

| Dificultad de eliminación | Intentar eliminar la marca de agua reduce significativamente la calidad de la imagen |

| Alcance | Todas las imágenes generadas por Gemini, independientemente del nivel de pago |

| Método de verificación | Terceros pueden verificar si una imagen fue generada por IA a través de SynthID |

Una contradicción notable: Google aplica marcas de agua imborrables en sus propias imágenes generadas, pero se ha descubierto que su modelo puede eliminar marcas de agua de imágenes ajenas. Esta asimetría generó un amplio debate en marzo de 2025.

Estrategias ante fallos en la generación de imágenes con Nano Banana 2

Dependiendo del tipo de error al generar imágenes, los desarrolladores pueden aplicar diferentes estrategias:

Escenarios ajustables (Capa 1)

Si el código de error es SAFETY, significa que se ha activado el filtro configurable de la Capa 1:

- Ajustar safetySettings: Cambia el umbral de la categoría correspondiente de

BLOCK_MEDIUM_AND_ABOVEaBLOCK_ONLY_HIGH. - Optimizar la indicación: Evita el uso de palabras sensibles que puedan activar las clasificaciones de seguridad.

- Generación por pasos: Divide escenas complejas en varios pasos más sencillos.

Escenarios no ajustables (Capa 2)

Si el código de error es IMAGE_SAFETY, PROHIBITED_CONTENT u OTHER:

- Cambiar la dirección creativa: Evita temas sensibles como celebridades o personajes con derechos de autor.

- Usar personajes originales: Diseña tus propios personajes para evitar conflictos de propiedad intelectual (IP).

- Simplificar la escena: Reduce los elementos complejos que puedan activar la detección de seguridad.

- Revisar la imagen de entrada: Si utilizas la función de imagen a imagen, asegúrate de que la imagen de referencia no contenga rostros de personas famosas.

Consejos especiales para desarrolladores de productos para el usuario final

Si estás desarrollando un producto orientado al consumidor, te recomendamos encarecidamente:

- Moderación de contenido previa: Realiza un pre-filtrado de la entrada del usuario antes de realizar la invocación del modelo.

- Mensajes de error amigables: Traduce los mensajes de error técnicos en inglés de la API a avisos en español que sean fáciles de entender para el usuario.

- Estrategia de reintentos: Para errores

SAFETYde la Capa 1, puedes intentar reajustar y reintentar; para errores de la Capa 2, no lo intentes de nuevo. - Monitoreo de consumo: Las solicitudes bloqueadas por los filtros de seguridad siguen consumiendo cuota de la API.

💰 Recordatorio de costes: Aunque las solicitudes bloqueadas por filtros de seguridad no devuelven una imagen, generan un cierto coste de invocación de la API. A través de la plataforma APIYI (apiyi.com) puedes consultar registros de llamadas detallados para optimizar tus indicaciones y reducir las llamadas infructuosas.

Si estás trabajando en un producto para el usuario final, te recomendamos consultar esta guía detallada de manejo de errores: Guía de manejo de errores de la API Gemini 3 Pro Image Preview xinqikeji.feishu.cn/wiki/Rslqw724YiBwlokHmRLcMVKHnRf

Comparativa de seguridad de contenido: Nano Banana Pro vs Nano Banana 2

| Dimensión de seguridad | Nano Banana Pro | Nano Banana 2 | Cambio |

|---|---|---|---|

| Contenido NSFW / Pornografía | Bloqueo estricto | Bloqueo estricto | Sin cambios |

| Generación de personajes famosos | Bloqueo parcial | Bloqueo total | ⬆️ Endurecimiento significativo |

| Edición de vestimenta de personajes | Parcialmente disponible | Bloqueo mayoritario | ⬆️ Endurecimiento significativo |

| Intercambio de rostros (Face Swap) | Bloqueo | Bloqueo total | ⬆️ Ligero endurecimiento |

| Modificación de información financiera | Sin bloqueo explícito | Nuevo bloqueo | 🆕 Nueva restricción |

| Sugerencias sexuales implícitas | Detección parcial | Detección mejorada | ⬆️ Mejora en capacidad de detección |

| Propiedad Intelectual (IP) | Bloqueo | Bloqueo | Sin cambios |

| Protección de menores | Bloqueo absoluto | Bloqueo absoluto | Sin cambios |

| Eliminación de marcas de agua | Parcialmente disponible | Endurecimiento progresivo | ⬆️ Endurecimiento continuo |

| Falsos positivos en estilo anime | Existentes | Existentes | Sin cambios (pendiente de mejora) |

Preguntas frecuentes

Q1: ¿Código de estado 200 pero no se devuelve ninguna imagen? ¿A qué se debe?

El código de estado 200 indica que la solicitud a la API fue exitosa, pero la generación de la imagen fue interceptada por el filtro de seguridad de Nivel 2 (Layer 2) de Google. Al realizar la invocación del modelo a través de la plataforma APIYI (apiyi.com), actuamos como un proxy transparente que reenvía directamente la respuesta original de Google sin aplicar restricciones adicionales. Revisa el campo finishReason en los datos devueltos para conocer el motivo específico del bloqueo.

Q2: ¿Por qué se sigue bloqueando la imagen a pesar de configurar BLOCK_NONE?

BLOCK_NONE solo desactiva los bloqueos probabilísticos en el Nivel 1 (filtrado de entrada configurable). Los filtros del Nivel 2 (filtrado de salida no configurable) como IMAGE_SAFETY, PROHIBITED_CONTENT o CSAM siempre están activos y no se pueden desactivar mediante ningún parámetro de la API. Esto es una decisión de diseño de Google, no un error.

Q3: ¿Bloquea Nano Banana 2 más contenido que Nano Banana Pro?

Sí. Tras el lanzamiento de Nano Banana 2 el 27 de febrero de 2026, Google endureció significativamente sus políticas de seguridad en cuatro dimensiones: figuras públicas, modificación de información financiera, cambio de ropa/rostro (consistencia facial) y contenido sexual implícito. Si una indicación que antes funcionaba en Nano Banana Pro ahora falla, es muy probable que se deba a estas nuevas restricciones. Te recomendamos revisar los registros de invocación en APIYI (apiyi.com) para identificar la causa exacta.

Q4: ¿Por qué las imágenes de estilo anime se bloquean con más frecuencia?

Este es un problema ampliamente reportado por la comunidad de desarrolladores. A veces, con la misma indicación, el estilo anime es bloqueado mientras que el estilo realista es aprobado. Parece ser un algoritmo heurístico excesivamente sensible en el filtro de seguridad, posiblemente relacionado con la detección de propiedad intelectual (IP) de derechos de autor. No hay una explicación oficial, pero no parece ser una restricción estratégica intencionada.

Q5: ¿Cómo distinguir si la restricción es de APIYI o de Google?

APIYI, como servicio proxy de API transparente, reenvía directamente la respuesta original de Google sin aplicar restricciones de contenido adicionales. Si la generación de imágenes falla, es 100% una respuesta del filtro de seguridad de Google. En APIYI queremos que cada cliente logre generar sus imágenes con éxito. Puedes confirmarlo revisando los registros detallados de invocación del modelo en la plataforma apiyi.com.

Resumen

El mecanismo de seguridad de contenido de Nano Banana 2 ha evolucionado continuamente desde 2024 hasta 2026, con una tendencia clara hacia un mayor rigor. Para los desarrolladores, esto implica:

- Comprender la arquitectura de doble capa: Es fundamental para resolver problemas de generación fallida (Nivel 1 ajustable, Nivel 2 no ajustable).

- Estar atentos a los cambios de política: Las actualizaciones de enero y febrero de 2026 trajeron nuevas restricciones significativas.

- Optimizar la indicación: Es más efectivo que ajustar la configuración de seguridad, ya que la mayoría de los bloqueos ocurren en el Nivel 2.

- Gestionar correctamente los errores: Especialmente en productos para el usuario final, es necesario manejar con elegancia las interceptaciones de seguridad.

Te recomendamos realizar tus pruebas de invocación del modelo Nano Banana 2 a través de la plataforma APIYI (apiyi.com), que ofrece una interfaz unificada y registros detallados para identificar rápidamente el motivo exacto de cualquier fallo en la generación.

📝 Autor: APIYI Team | Equipo técnico de APIYI

🔗 Intercambio técnico: Visita apiyi.com para obtener más guías de uso de modelos de IA y soporte técnico

📅 Fecha de actualización: 27 de febrero de 2026