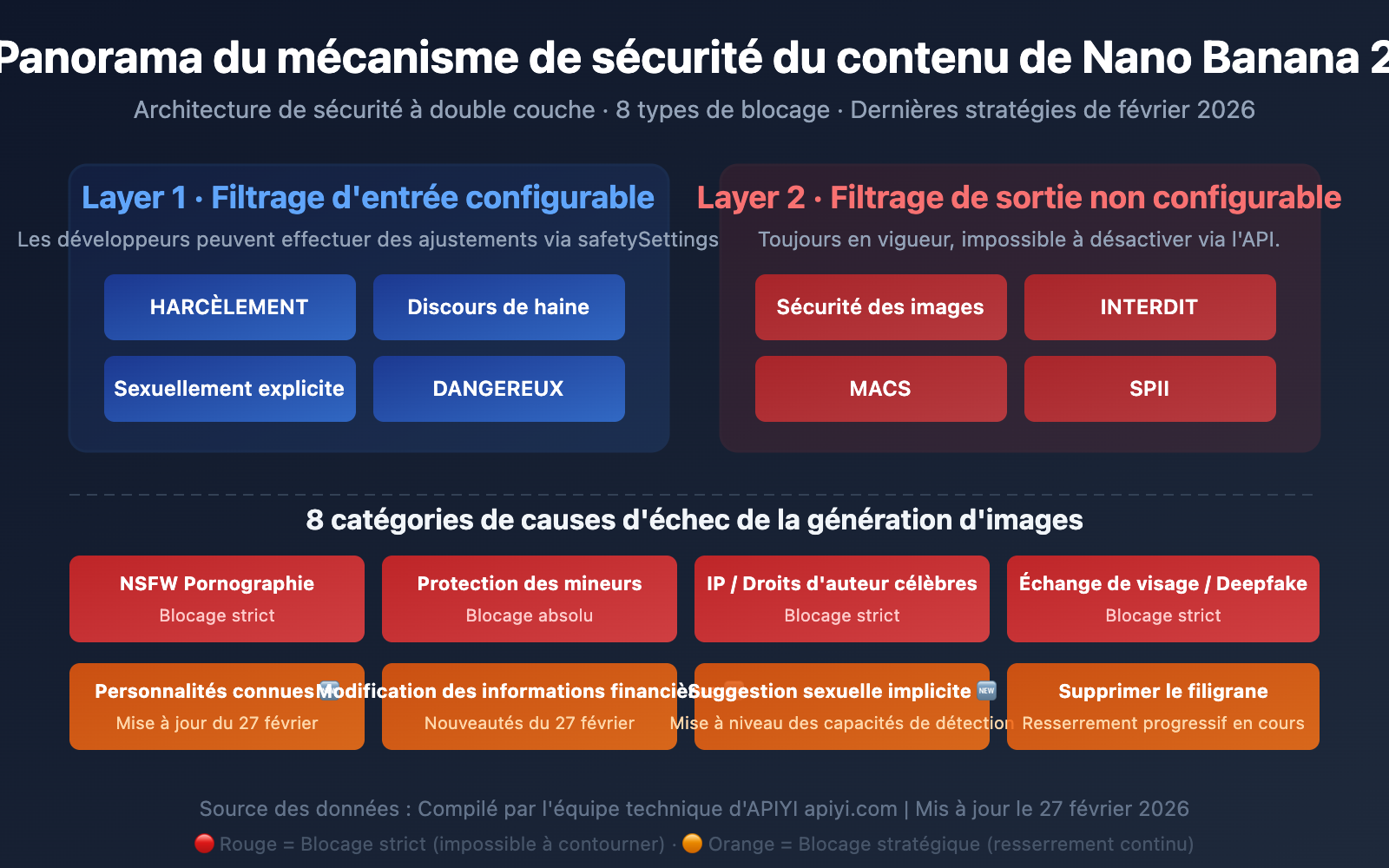

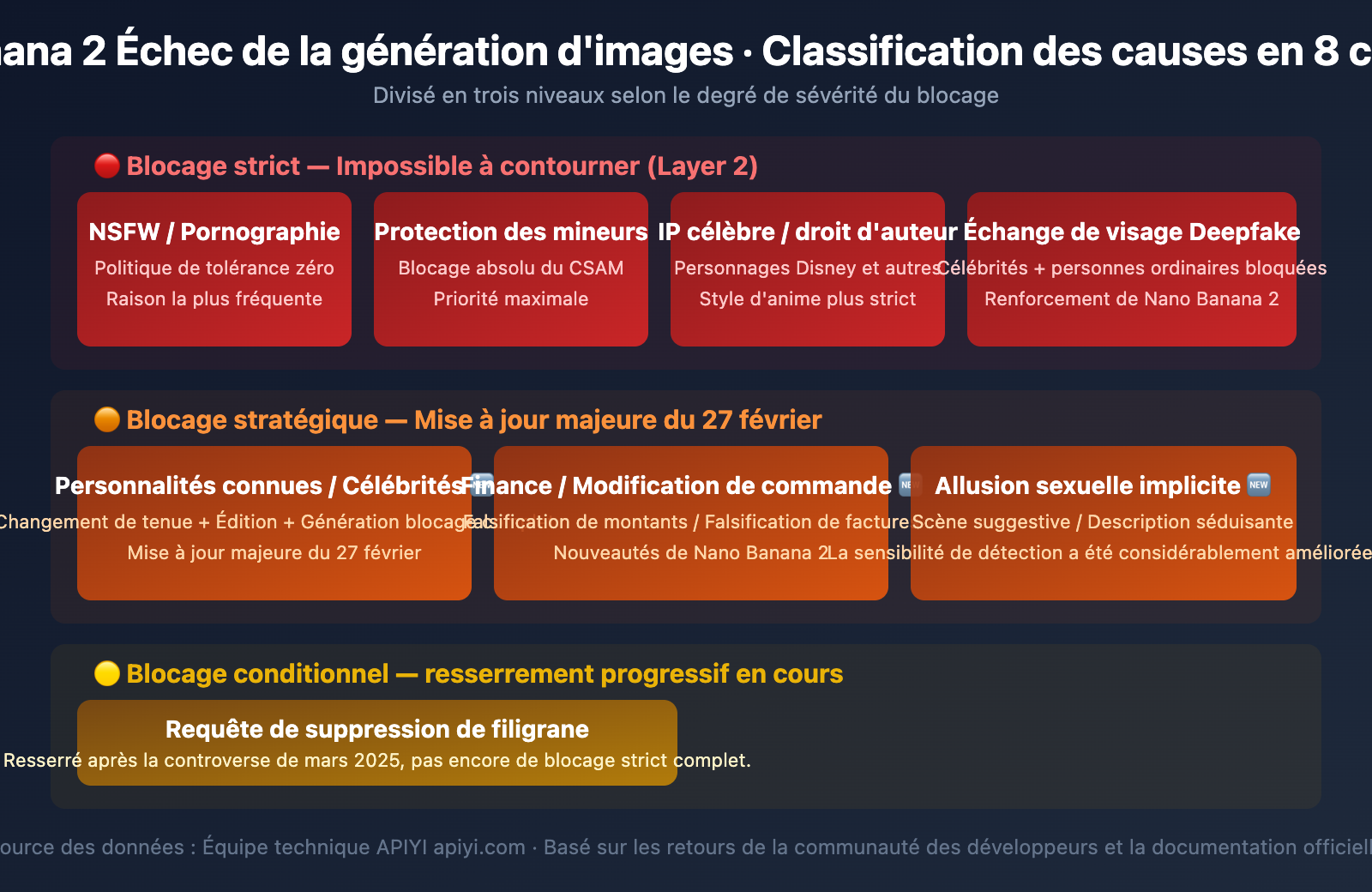

L'échec de génération d'images avec Nano Banana 2 est le problème le plus fréquemment rencontré par les développeurs utilisant l'API de génération d'images Gemini. Depuis le lancement officiel de Nano Banana 2 le 27 février 2026, le mécanisme de sécurité du contenu de Google a bénéficié d'une mise à jour majeure. Le filtrage de sécurité est désormais beaucoup plus strict pour des scénarios tels que les personnalités publiques, la modification d'informations financières, le changement de vêtements ou de visage (face swap), ainsi que les allusions sexuelles implicites.

Valeur ajoutée : En lisant cet article, vous comprendrez en profondeur l'architecture de sécurité à double couche de Nano Banana 2, les causes spécifiques de 8 types d'échecs de génération, la signification des codes d'erreur de l'API, ainsi que les stratégies d'adaptation pour différents scénarios.

Points clés du mécanisme de sécurité du contenu de Nano Banana 2

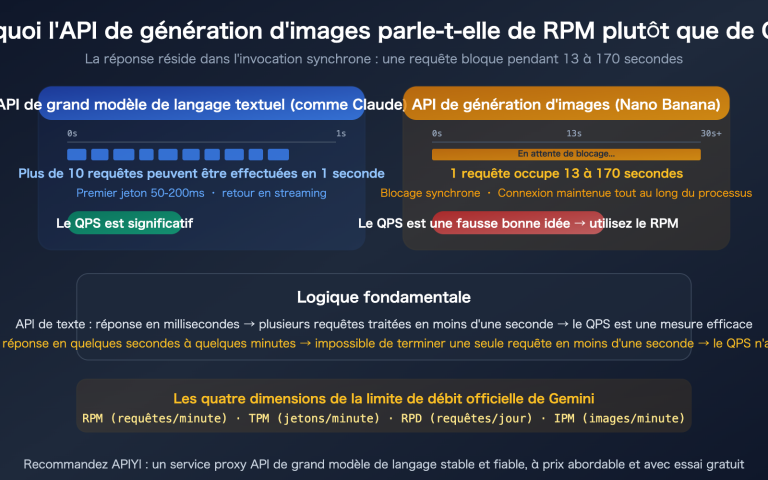

Le mécanisme de sécurité de Nano Banana 2 (c'est-à-dire le modèle de génération d'images Gemini) n'est pas un simple filtrage par mots-clés, mais une architecture de sécurité à double couche. Comprendre cette architecture est essentiel pour résoudre les problèmes d'échec de génération d'images.

| Point clé | Description | Impact pour les développeurs |

|---|---|---|

| Architecture à double couche | Couche 1 : filtrage d'entrée configurable + Couche 2 : filtrage de sortie non configurable | Même avec le réglage BLOCK_NONE, toutes les restrictions ne peuvent pas être contournées |

| 8 catégories de blocage | NSFW, filigranes, IP célèbres, mineurs, célébrités, finance, échange de visages, suggestions implicites | Différentes catégories nécessitent différentes stratégies d'intervention |

| Resserrement des politiques | Deux mises à jour majeures en janvier et février 2026 | Le contenu qui passait auparavant peut désormais être intercepté |

| Proxy transparent | APIYI transmet directement la réponse originale de Google | Code d'état 200 mais pas d'image = interception par le filtre de sécurité de Google |

Détails de l'architecture à double couche de sécurité de Nano Banana 2

Couche 1 — Filtrage d'entrée configurable (Safety Settings)

Il s'agit de la première couche de filtrage que les développeurs peuvent ajuster via les paramètres de l'API. Elle s'applique avant que l'invite textuelle n'entre dans le modèle. Elle comprend 4 catégories de risques ajustables :

HARM_CATEGORY_HARASSMENT— Contenu de harcèlementHARM_CATEGORY_HATE_SPEECH— Discours de haineHARM_CATEGORY_SEXUALLY_EXPLICIT— Contenu sexuellement expliciteHARM_CATEGORY_DANGEROUS_CONTENT— Contenu dangereux

Chaque catégorie prend en charge 5 niveaux de seuil :

| Réglage du seuil | Comportement | Niveau de sévérité |

|---|---|---|

BLOCK_LOW_AND_ABOVE |

Bloque les contenus à probabilité faible, moyenne et élevée | Le plus strict |

BLOCK_MEDIUM_AND_ABOVE |

Bloque les contenus à probabilité moyenne et élevée | Valeur par défaut |

BLOCK_ONLY_HIGH |

Bloque uniquement les contenus à probabilité élevée | Plus souple |

BLOCK_NONE |

Désactive le blocage par probabilité pour cette catégorie | Le plus souple |

HARM_BLOCK_THRESHOLD_UNSPECIFIED |

Utilise la valeur par défaut de la plateforme | Dépend de la plateforme |

Couche 2 — Filtrage de sortie non configurable (Hard Blocks)

Il s'agit d'une deuxième couche de filtrage toujours active, impossible à désactiver via les paramètres de l'API, qui s'applique après la génération de l'image :

IMAGE_SAFETY— Évaluation de la sécurité du contenu de l'imagePROHIBITED_CONTENT— Violation de la politique de contenu interdit (Copyright/IP)CSAM— Détection de matériel d'abus sexuel sur mineur (blocage strict absolu)SPII— Informations d'identification personnelle sensibles

🎯 Constat clé : De nombreux développeurs constatent que les images restent bloquées même après avoir réglé toutes les catégories de sécurité sur

BLOCK_NONE. La raison réside dans le fait que les blocages stricts de la Couche 2 sont toujours effectifs. Lors d'une invocation du modèle via la plateforme APIYI (apiyi.com), notre proxy transparent transmet directement la réponse originale de Google ; par conséquent, les messages d'erreur que vous voyez sont les retours réels du système de sécurité de Google.

Analyse complète des 8 catégories de raisons d'échec de génération Nano Banana 2

Selon la politique de sécurité de Google et les nombreux retours de la communauté des développeurs, les raisons de l'échec de génération d'images avec Nano Banana 2 peuvent être résumées en 8 catégories :

Catégorie 1 : NSFW / Contenu pornographique (Blocage strict)

Niveau de blocage : 🔴 Blocage strict — Impossible à contourner

C'est la raison la plus courante d'échec de génération. Gemini adopte une politique de « tolérance zéro » envers le contenu pornographique, bien plus stricte que d'autres modèles AI majeurs.

Les contenus bloqués incluent :

- Contenu pornographique ou érotique

- Scènes de violence sexuelle ou d'abus sexuel

- Scènes sexuelles impliquant des personnages réels ou fictifs

- Contenu suggestif et nudité

Messages d'erreur typiques :

"I can't generate that image."

"The prompt couldn't be submitted — it might violate our policies."

Note pour les développeurs : Une évaluation de sécurité en novembre 2025 a révélé que, bien que les invites pornographiques directes soient interceptées efficacement, les escalades de conversations multi-tours et les injections d'invites répétées ont réussi à contourner la modération dans 19 cas sur 21 testés. Google renforce continuellement ses défenses dans ce domaine.

Catégorie 2 : Requêtes de suppression de filigrane (Blocage spécial)

Niveau de blocage : 🟠 Blocage politique — Resserrement progressif après mars 2025

La suppression de filigrane est un cas particulier. En mars 2025, il a été largement rapporté que Gemini 2.0 Flash était capable de supprimer les filigranes de copyright (comme ceux de Getty Images) et de restaurer l'image de manière transparente, ce qui a suscité une vive controverse.

Découvertes clés :

- L'application grand public Gemini affiche un avertissement éthique.

- Cependant, via l'accès API AI Studio, le même modèle manque de ces garde-fous.

- Anthropic Claude et OpenAI GPT-4o rejettent explicitement les demandes de suppression de filigrane.

État actuel : Google a déclaré que la suppression de filigrane viole les conditions d'utilisation et renforce progressivement le blocage au niveau technique. Contrairement au NSFW, le blocage de la suppression de filigrane n'a pas encore atteint un niveau de blocage strict à 100 %.

Catégorie 3 : IP célèbres / Personnages sous copyright (Blocage strict)

Niveau de blocage : 🔴 Blocage strict — Presque impossible à contourner

Les personnages Disney, les personnages d'anime célèbres et d'autres IP protégées par le droit d'auteur déclenchent le filtre PROHIBITED_CONTENT.

Phénomène particulier — Sur-blocage du style anime :

La communauté des développeurs rapporte largement un problème : les images de style anime sont bloquées de manière plus agressive que les styles réalistes. Pour une même invite de chat, le style anime peut être intercepté alors que le style réaliste passe. Cela semble être un algorithme heuristique trop sensible plutôt qu'une stratégie délibérée.

Catégorie 4 : Protection des mineurs (Blocage absolu)

Niveau de blocage : 🔴🔴 Blocage strict absolu — Aucune exception

La détection CSAM (matériel d'abus sexuel sur mineur) est le niveau le plus élevé de tous les mécanismes de sécurité et ne peut être désactivée sous aucune configuration.

- Tout contenu à caractère sexuel impliquant des mineurs est absolument bloqué.

- Début 2025, certains médias ont découvert que même avec des comptes enregistrés pour des mineurs de 13 ans, il était possible de contourner les restrictions via des dialogues multi-tours — Google a depuis confirmé et corrigé ce problème.

Catégorie 5 : Personnalités / Célébrités (Mise à jour majeure du 27 février)

Niveau de blocage : 🔴 Blocage strict — Plus rigoureux après Nano Banana 2

C'est le domaine qui a connu le plus de changements après le lancement de Nano Banana 2 le 27 février 2026.

Auparavant, les restrictions visaient principalement :

- Les personnalités politiques.

- Les images réalistes de stars et de célébrités.

Nouvelles restrictions de Nano Banana 2 :

- Toute génération d'image de personnalité célèbre identifiable est bloquée plus strictement.

- Le changement de vêtements (habiller une célébrité différemment) est intercepté.

- L'échange de visages (placer le visage d'une célébrité dans une autre scène) est intercepté.

- Même si vous téléchargez la photo d'une célébrité pour l'éditer, elle sera identifiée et bloquée.

Messages d'erreur typiques :

"I can't generate that image. It involves a celebrity in a distorted

or exaggerated context, which isn't allowed."

"I can't complete the modification of xxx."

💡 Contexte : Après le lancement des fonctions d'édition d'images plus puissantes de Gemini 2.5 Flash fin 2025, des chercheurs ont découvert que télécharger la photo d'une célébrité et demander de la "réimaginer" permettait de contourner le blocage des invites textuelles. Google a corrigé cette faille en 24 heures et a renforcé l'ensemble du système de reconnaissance des célébrités dans Nano Banana 2.

Catégorie 6 : Finance / Modification d'informations de commande (Nouveau depuis le 27 février)

Niveau de blocage : 🟠 Blocage politique — Nouveau dans Nano Banana 2

Il s'agit d'une nouvelle catégorie de blocage apparue avec Nano Banana 2.

Les scénarios suivants déclenchent désormais un filtre de sécurité :

- Modification de montants dans des documents financiers.

- Altération d'informations de commande ou de contenu de factures.

- Falsification de relevés bancaires.

- Modification de chiffres clés dans des contrats.

Ce type de blocage est basé sur les clauses relatives à la fraude et à la tromperie de la « Politique d'interdiction d'utilisation de l'IA générative » de Google. Bien qu'il n'apparaisse pas comme une catégorie de filtre indépendante dans la documentation technique publique, il est désormais intercepté efficacement en pratique.

Catégorie 7 : Habillage / Échange de visages (Prévention Deepfake)

Niveau de blocage : 🔴 Blocage strict

Le remplacement de visage et l'habillage virtuel sont des scénarios d'application clés de la technologie Deepfake. Gemini applique un blocage strict à ce sujet :

| Scénario | Nano Banana Pro (Avant) | Nano Banana 2 (Maintenant) |

|---|---|---|

| Changer les vêtements d'une personne sur une photo | Partiellement disponible | Majoritairement intercepté |

| Remplacer le visage de A par celui de B | Déjà bloqué | Totalement bloqué |

| Édition d'habillage de célébrité | Partiellement disponible | Totalement bloqué |

| Habillage de personnage original | Généralement disponible | Généralement disponible |

Catégorie 8 : Contenu à suggestion sexuelle implicite (Mise à jour du 27 février)

Niveau de blocage : 🟠 Blocage politique — Capacité de détection considérablement accrue

Nano Banana 2 a considérablement renforcé sa capacité à détecter les contenus à suggestion sexuelle implicite. Même si l'invite ne contient pas de mots-clés pornographiques explicites, tout contenu impliquant une suggestion sexuelle sera intercepté :

- Descriptions de langage corporel ambigu.

- Paramètres de scène suggestifs.

- Descriptions de tenues provocantes.

- Textes à sous-entendus sexuels subtils.

Le message d'erreur est généralement :

"I can't complete xxx modification."

"This content is not permitted."

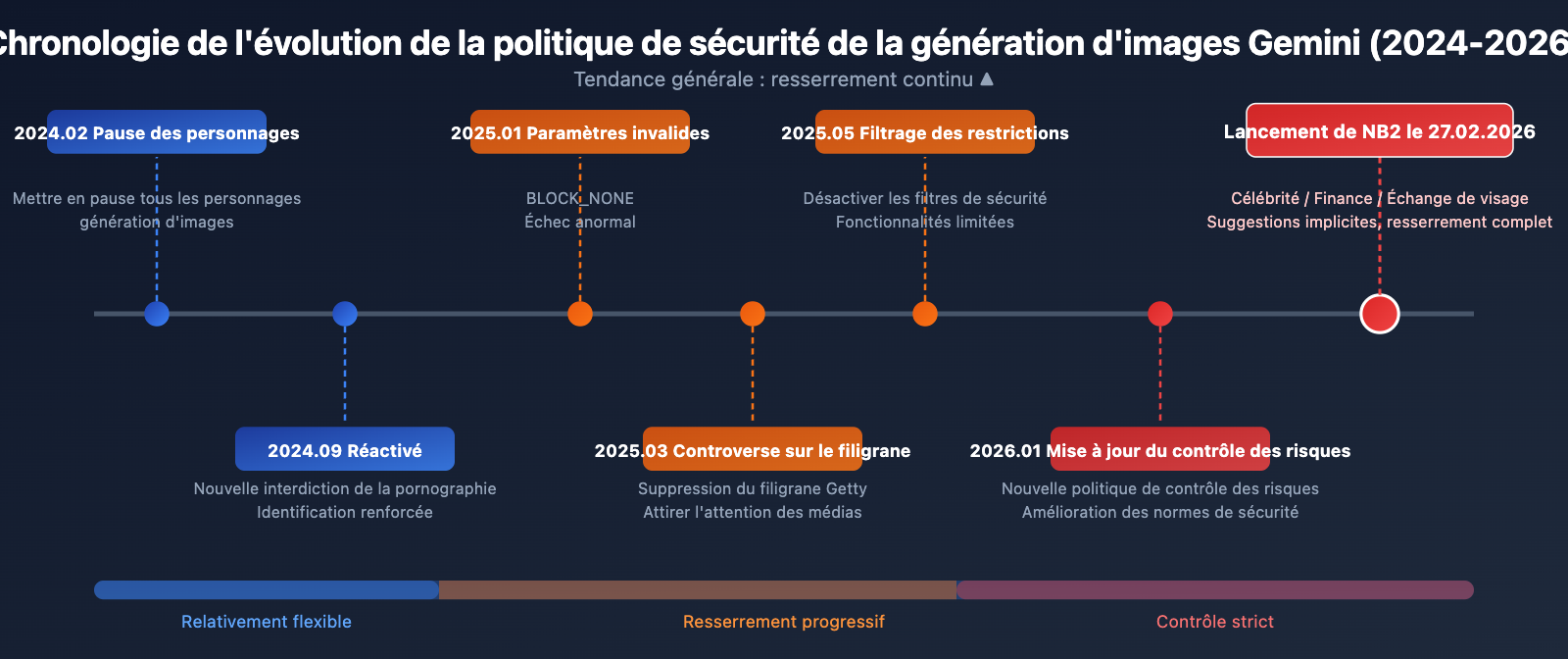

Évolution de la stratégie de sécurité de Nano Banana 2

Comprendre l'évolution des politiques de sécurité permet aux développeurs de mieux appréhender la logique des restrictions actuelles :

| Date | Événement | Impact |

|---|---|---|

| Février 2024 | Google suspend toute génération d'images de personnes pour Gemini | Controverse publique suite à des représentations historiques inexactes |

| Septembre 2024 | Réactivation de la génération d'images de personnes | Nouvelles interdictions sur le contenu pornographique et renforcement des restrictions d'identification |

| Janvier 2025 | Le paramètre BLOCK_NONE devient inopérant |

Les développeurs signalent que les paramètres de sécurité sont écrasés par erreur |

| Mars 2025 | Controverse sur la suppression des filigranes | Google renforce les blocages associés suite à la couverture médiatique |

| Mai 2025 | Restriction de la désactivation des filtres de sécurité | Impossible d'utiliser BLOCK_NONE dans certaines configurations |

| Fin 2025 | Découverte de failles Deepfake | Correction de la faille permettant de contourner les blocages textuels via l'importation de photos |

| 23 janvier 2026 | Google ajuste sa nouvelle politique de contrôle des risques | Nouvelle hausse des standards de sécurité globaux |

| 27 février 2026 | Lancement de Nano Banana 2 | Durcissement complet concernant les célébrités, la finance, le face-swap et les allusions implicites |

Tendance générale : De 2024 à 2026, Google a continuellement durci ses restrictions de sécurité, une tendance qui ne devrait pas s'inverser de sitôt.

Interprétation des codes d'erreur API lors de l'échec de génération d'images avec Nano Banana 2

Lorsque le filtre de sécurité de Nano Banana 2 intercepte la génération d'une image, l'API renvoie une valeur finishReason spécifique. Bien comprendre ces codes d'erreur est la première étape pour résoudre le problème.

| finishReason | Signification | Niveau de déclenchement | Résoluble par configuration ? |

|---|---|---|---|

SAFETY |

Seuil de classification de sécurité configurable atteint | Niveau 1 | ✅ Ajustable via safetySettings |

IMAGE_SAFETY |

Contenu de l'image générée non conforme | Niveau 2 | ❌ Non configurable |

PROHIBITED_CONTENT |

Violation de la politique de contenu interdit (PI/Droits d'auteur) | Niveau 2 | ❌ Non configurable |

OTHER |

Blocage non classé explicitement (souvent lié à l'IP) | Niveau 2 | ❌ Non configurable |

Flux de dépannage en cas d'échec de génération

import openai

client = openai.OpenAI(

api_key="VOTRE_CLÉ_API",

base_url="https://api.apiyi.com/v1" # Appel via l'interface unifiée de APIYI

)

try:

response = client.images.generate(

model="nano-banana-2",

prompt="votre invite ici",

n=1,

size="1024x1024"

)

# Image récupérée avec succès

print(response.data[0].url)

except Exception as e:

error_msg = str(e)

# Déterminer le type de blocage selon le message d'erreur

if "SAFETY" in error_msg:

print("Filtrage de sécurité Niveau 1 : essayez d'ajuster safetySettings")

elif "PROHIBITED_CONTENT" in error_msg:

print("Contenu interdit Niveau 2 : peut concerner la propriété intellectuelle ou les droits d'auteur")

elif "IMAGE_SAFETY" in error_msg:

print("Sécurité d'image Niveau 2 : le contenu généré est jugé non conforme")

else:

print(f"Autre erreur : {error_msg}")

Voir l’exemple d’appel API natif Gemini (avec paramètres de sécurité)

import google.generativeai as genai

genai.configure(api_key="VOTRE_CLÉ_API")

# Configuration des paramètres de sécurité — Note : cela n'affecte que le Niveau 1

safety_settings = [

{

"category": "HARM_CATEGORY_HARASSMENT",

"threshold": "BLOCK_ONLY_HIGH"

},

{

"category": "HARM_CATEGORY_HATE_SPEECH",

"threshold": "BLOCK_ONLY_HIGH"

},

{

"category": "HARM_CATEGORY_SEXUALLY_EXPLICIT",

"threshold": "BLOCK_MEDIUM_AND_ABOVE"

},

{

"category": "HARM_CATEGORY_DANGEROUS_CONTENT",

"threshold": "BLOCK_ONLY_HIGH"

}

]

model = genai.GenerativeModel(

model_name="gemini-2.0-flash-exp",

safety_settings=safety_settings

)

response = model.generate_content(

"Generate an image of a sunset over mountains"

)

# Vérifier les résultats du filtrage de sécurité

if response.candidates:

candidate = response.candidates[0]

print(f"Raison de fin : {candidate.finish_reason}")

if candidate.safety_ratings:

for rating in candidate.safety_ratings:

print(f" {rating.category}: {rating.probability}")

🚀 Conseil de dépannage rapide : Si vous rencontrez un code d'état 200 mais qu'aucune image n'est renvoyée, il s'agit bien d'une interception par le filtre de sécurité de Google. Lors d'un appel via la plateforme APIYI (apiyi.com), nous agissons comme un service proxy API transparent et relayons directement la réponse originale de Google sans aucun filtrage supplémentaire — nous souhaitons évidemment que chaque client puisse réussir ses invocations du modèle.

Sécurité du contenu Nano Banana 2 : mécanisme de tatouage numérique invisible SynthID

En plus du filtrage de sécurité en entrée et en sortie, Google intègre un tatouage numérique invisible SynthID dans toutes les images générées par Gemini :

| Caractéristique | Description |

|---|---|

| Méthode d'intégration | Tatouage invisible au niveau du pixel, imperceptible à l'œil nu |

| Résistance aux interférences | Reste efficace après recadrage, redimensionnement, ajustement des couleurs ou capture d'écran |

| Difficulté de suppression | Supprimer le tatouage réduit considérablement la qualité de l'image |

| Champ d'application | Toutes les images générées par Gemini, quel que soit le niveau d'abonnement |

| Méthode de vérification | Les tiers peuvent vérifier si une image est générée par IA via SynthID |

Une contradiction notable : Google appose des tatouages indélébiles sur ses propres images générées, alors que son modèle a été surpris en train de pouvoir supprimer les tatouages sur les images d'autrui — cette asymétrie a suscité de larges débats en mars 2025.

Stratégies face aux échecs de génération d'images avec Nano Banana 2

Selon le type d'échec rencontré, les développeurs peuvent adopter différentes stratégies :

Scénarios ajustables (Layer 1)

Si le code d'erreur est SAFETY, cela signifie que le filtre configurable de niveau 1 (Layer 1) a été déclenché :

- Ajuster les safetySettings : modifiez le seuil de classification concerné de

BLOCK_MEDIUM_AND_ABOVEàBLOCK_ONLY_HIGH. - Optimiser l'invite : évitez d'utiliser des termes sensibles susceptibles de déclencher les classifications de sécurité.

- Génération par étapes : décomposez les scènes complexes en plusieurs étapes simples.

Scénarios non ajustables (Layer 2)

Si le code d'erreur est IMAGE_SAFETY, PROHIBITED_CONTENT ou OTHER :

- Modifier la direction créative : évitez les sujets sensibles tels que les célébrités ou les personnages sous copyright.

- Utiliser des personnages originaux : concevez vos propres personnages pour éviter les conflits de propriété intellectuelle.

- Simplifier la scène : réduisez les éléments complexes qui pourraient déclencher une détection de sécurité.

- Vérifier l'image d'entrée : si vous utilisez le mode image vers image, assurez-vous que l'image source ne contient pas de visages de célébrités.

Conseils spécifiques pour les développeurs de produits grand public

Si vous développez un produit destiné aux utilisateurs finaux, il est fortement recommandé de :

- Modération de contenu en amont : effectuez un pré-filtrage des entrées utilisateur avant l'invocation du modèle.

- Messages d'erreur conviviaux : traduisez les messages d'erreur techniques de l'API en conseils clairs et compréhensibles pour l'utilisateur.

- Stratégie de tentative (Retry) : pour les erreurs

SAFETYdu Layer 1, vous pouvez tenter une nouvelle génération après ajustement. Pour les erreurs du Layer 2, ne faites pas de nouvelle tentative. - Surveillance de la consommation : les requêtes interceptées par les filtres de sécurité consomment tout de même votre quota d'API.

💰 Rappel sur les coûts : bien que les requêtes bloquées par les filtres de sécurité ne renvoient pas d'image, elles génèrent tout de même des frais d'invocation du modèle. Via la plateforme APIYI (apiyi.com), vous pouvez consulter les journaux d'appels détaillés pour optimiser vos invites et réduire les appels inutiles.

Si vous travaillez sur un produit grand public, je vous recommande de consulter ce guide plus détaillé sur la gestion des erreurs : Guide de gestion des erreurs de l'API Gemini 3 Pro Image Preview xinqikeji.feishu.cn/wiki/Rslqw724YiBwlokHmRLcMVKHnRf

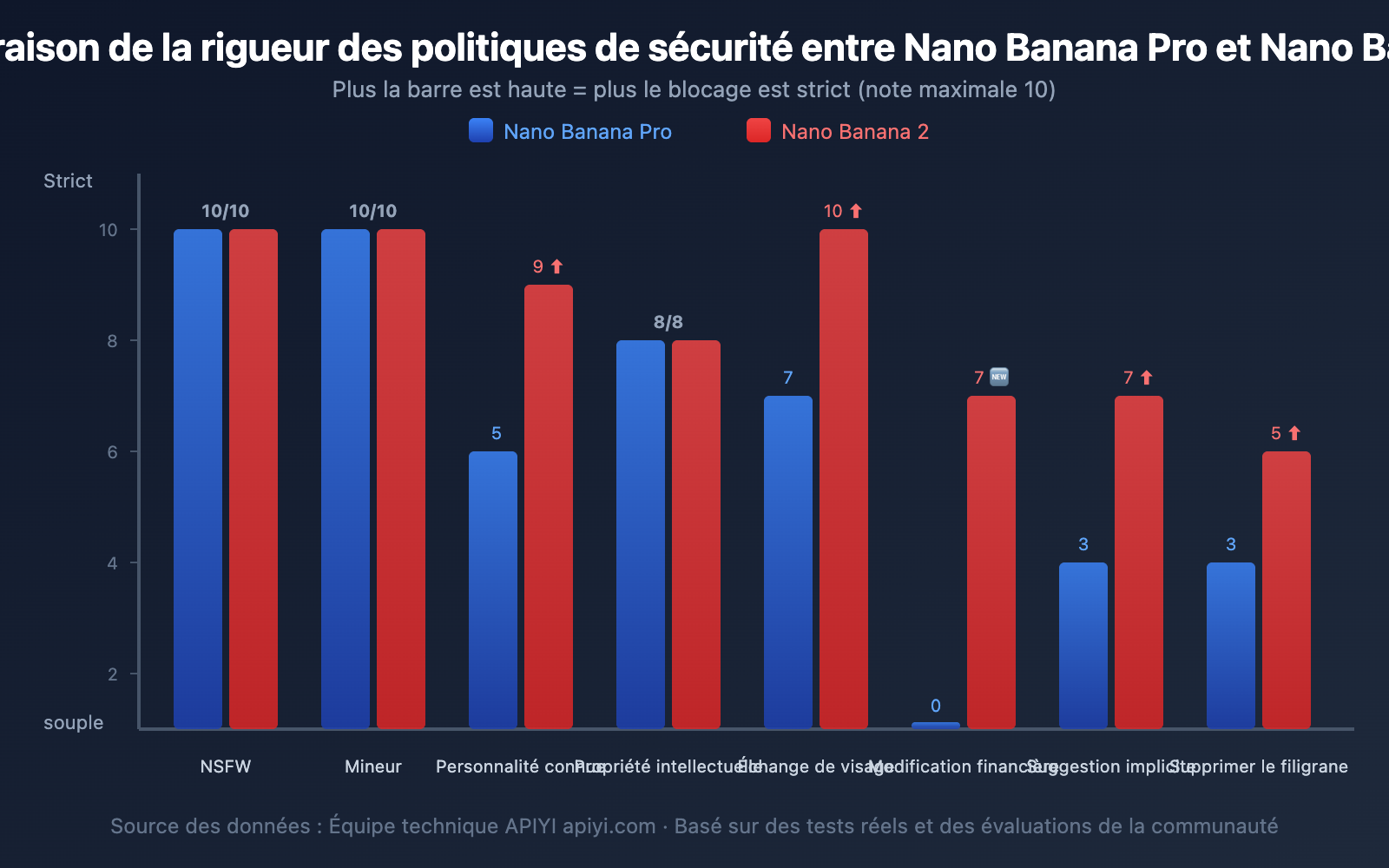

Comparaison de la sécurité des contenus : Nano Banana Pro vs Nano Banana 2

| Dimension de sécurité | Nano Banana Pro | Nano Banana 2 | Évolution |

|---|---|---|---|

| Contenu pornographique NSFW | Blocage strict | Blocage strict | Stable |

| Génération de célébrités | Blocage partiel | Blocage total | ⬆️ Fort durcissement |

| Édition de vêtements (personnages) | Partiellement disponible | Majoritairement bloqué | ⬆️ Fort durcissement |

| Échange de visages (Face Swap) | Bloqué | Blocage total | ⬆️ Léger durcissement |

| Modification d'infos financières | Pas de blocage explicite | Nouveau blocage | 🆕 Nouvelle restriction |

| Suggestions sexuelles implicites | Détection partielle | Détection renforcée | ⬆️ Capacité de détection accrue |

| Propriété intellectuelle (IP) | Bloqué | Bloqué | Stable |

| Protection des mineurs | Blocage absolu | Blocage absolu | Stable |

| Suppression de filigranes | Partiellement disponible | Durcissement progressif | ⬆️ Durcissement continu |

| Erreurs de détection (style Anime) | Présentes | Présentes | Stable (à améliorer) |

Questions Fréquemment Posées

Q1 : Code d’état 200 mais aucune image renvoyée, quelle en est la raison ?

Le code d'état 200 indique que la requête API elle-même a réussi, mais que la génération d'image a été interceptée par le filtre de sécurité de niveau 2 (Layer 2) de Google. Lors d'une invocation du modèle via la plateforme APIYI (apiyi.com), nous agissons comme un service proxy API transparent et relayons directement la réponse originale de Google sans aucune restriction supplémentaire. Vérifiez le champ finishReason dans les données renvoyées pour comprendre la raison spécifique du blocage.

Q2 : Pourquoi l’image est-elle toujours bloquée malgré le réglage BLOCK_NONE ?

Le paramètre BLOCK_NONE permet uniquement de désactiver les blocages probabilistes du niveau 1 (filtrage d'entrée configurable). Les filtres du niveau 2 (filtrage de sortie non configurable) tels que IMAGE_SAFETY, PROHIBITED_CONTENT ou CSAM sont toujours actifs et ne peuvent être désactivés par aucun paramètre API. C'est une volonté de conception de Google, pas un bug.

Q3 : Nano Banana 2 bloque-t-il plus de contenu que Nano Banana Pro ?

Oui. Depuis le lancement de Nano Banana 2 le 27 février 2026, Google a considérablement durci ses politiques de sécurité sur quatre dimensions : personnalités publiques, modification d'informations financières, changement de vêtements/visage et allusions sexuelles implicites. Si des invites qui fonctionnaient auparavant avec Nano Banana Pro échouent maintenant, il est fort probable que cela soit dû à ces nouvelles restrictions. Nous vous conseillons de consulter les journaux d'appels sur APIYI (apiyi.com) pour identifier la cause précise.

Q4 : Pourquoi les images de style anime sont-elles plus facilement bloquées ?

C'est un problème largement rapporté par la communauté des développeurs. Pour une même invite, le style anime peut être bloqué alors que le style réaliste est accepté. Il semble s'agir d'un algorithme heuristique trop sensible dans le filtre de sécurité, potentiellement lié à la détection de droits d'auteur (IP). Il n'y a pas d'explication officielle pour le moment, mais ce n'est pas une restriction stratégique intentionnelle.

Q5 : Comment savoir s’il s’agit d’une limite d’APIYI ou de Google ?

APIYI, en tant que service proxy API transparent, transmet directement la réponse brute de Google sans ajouter de restrictions de contenu supplémentaires. Si la génération d'images échoue, c'est à 100 % dû aux filtres de sécurité de Google. APIYI souhaite évidemment que chaque client réussisse ses générations. Vous pouvez confirmer cela en consultant les journaux d'appels détaillés sur la plateforme apiyi.com.

Résumé

Le mécanisme de sécurité du contenu de Nano Banana 2 a connu une évolution continue entre 2024 et 2026, avec une tendance globale au durcissement constant. Pour les développeurs, voici les points clés :

- Comprendre l'architecture à deux niveaux est la base pour résoudre les échecs de génération : le niveau 1 est ajustable, le niveau 2 ne l'est pas.

- Suivre l'évolution des politiques : les mises à jour de janvier et février 2026 ont introduit de nouvelles restrictions significatives.

- Optimiser les invites est plus efficace que de modifier les paramètres de sécurité, car la majorité des blocages surviennent au niveau 2.

- Soigner la gestion des erreurs, particulièrement pour les produits destinés au grand public, afin de traiter élégamment les différents types d'interceptions de sécurité.

Nous vous recommandons d'utiliser la plateforme APIYI (apiyi.com) pour vos tests d'invocation du modèle Nano Banana 2. Elle propose une interface unifiée et des journaux d'appels détaillés, facilitant le diagnostic rapide des causes d'échec de génération.

📝 Auteur : APIYI Team | Équipe technique APIYI

🔗 Échanges techniques : Visitez apiyi.com pour plus de guides sur l'utilisation des modèles IA et de support technique

📅 Date de mise à jour : 27 février 2026