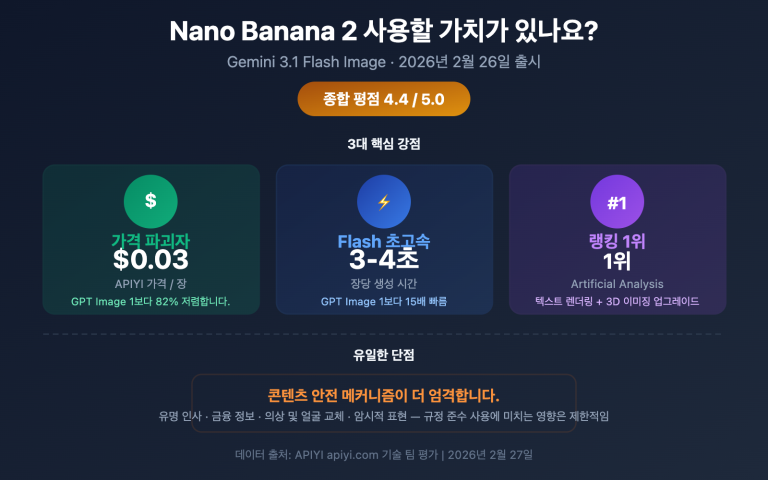

Nano Banana 2 이미지 생성 실패는 개발자들이 Gemini 이미지 생성 API를 사용할 때 가장 자주 겪는 문제입니다. 2026년 2월 27일 Nano Banana 2가 정식 출시된 이후, 구글의 콘텐츠 안전 메커니즘이 대대적으로 업그레이드되었습니다. 유명 인사, 금융 정보 수정, 인물 의상 및 얼굴 교체, 은유적인 성적 암시 등 다양한 시나리오에서 안전 필터링이 더욱 엄격해졌습니다.

핵심 가치: 이 글을 통해 Nano Banana 2의 이중 안전 아키텍처, 8가지 이미지 생성 실패 원인, API 오류 코드의 의미, 그리고 상황별 대응 전략을 완벽하게 이해할 수 있습니다.

Nano Banana 2 콘텐츠 안전 메커니즘 핵심 요점

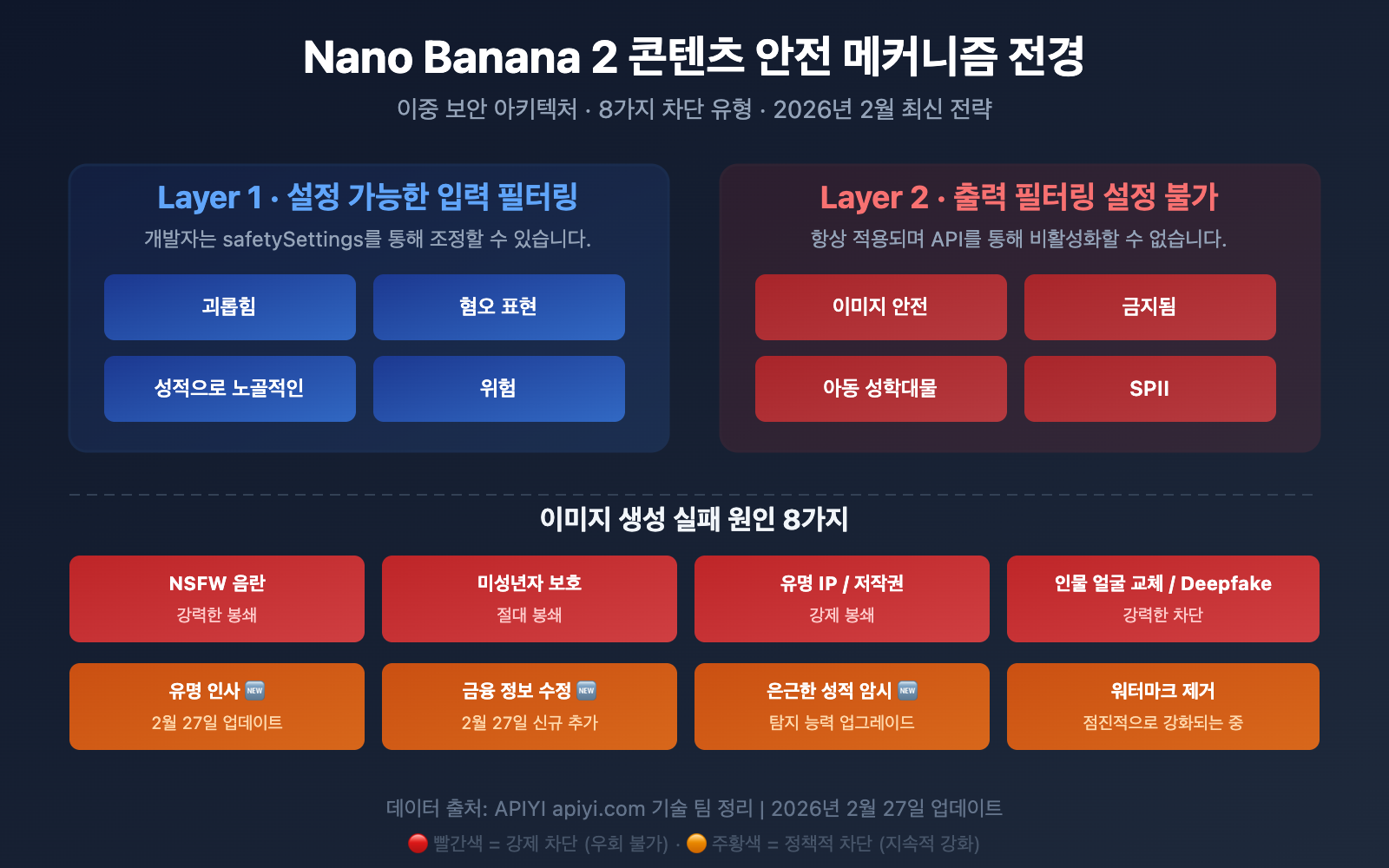

Nano Banana 2(즉, Gemini 이미지 생성 모델)의 안전 메커니즘은 단순한 키워드 필터링이 아닙니다. 바로 이중 안전 아키텍처로 구성되어 있죠. 이 구조를 이해하는 것이 이미지 생성 실패 문제를 해결하는 핵심입니다.

| 핵심 요점 | 설명 | 개발자에게 미치는 영향 |

|---|---|---|

| 이중 아키텍처 | Layer 1 설정 가능한 입력 필터링 + Layer 2 설정 불가능한 출력 필터링 | BLOCK_NONE으로 설정해도 모든 제한을 우회할 수는 없음 |

| 8가지 차단 유형 | NSFW, 워터마크, 유명 IP, 미성년자, 유명인, 금융, 얼굴 교체, 은유적 암시 | 유형별로 서로 다른 대응 전략 필요 |

| 정책 강화 | 2026년 1월 및 2월, 두 차례의 대규모 업데이트 | 이전에는 통과되었던 콘텐츠도 현재는 차단될 수 있음 |

| 투명 프록시 | APIYI는 구글의 원본 응답을 직접 전달함 | 상태 코드 200이지만 이미지가 없음 = 구글 안전 필터에 의해 차단됨 |

Nano Banana 2 콘텐츠 안전 이중 아키텍처 상세 설명

Layer 1 — 설정 가능한 입력 필터링 (Safety Settings)

개발자가 API 파라미터를 통해 조정할 수 있는 첫 번째 필터링 단계로, 프롬프트가 모델에 입력되기 전에 적용됩니다. 4가지 조절 가능한 유해성 카테고리가 포함됩니다.

HARM_CATEGORY_HARASSMENT— 괴롭힘 콘텐츠HARM_CATEGORY_HATE_SPEECH— 혐오 표현HARM_CATEGORY_SEXUALLY_EXPLICIT— 성적으로 노골적인 콘텐츠HARM_CATEGORY_DANGEROUS_CONTENT— 위험한 콘텐츠

각 카테고리는 5가지 임계값 설정을 지원합니다.

| 임계값 설정 | 동작 | 엄격도 |

|---|---|---|

BLOCK_LOW_AND_ABOVE |

낮음, 중간, 높음 확률의 콘텐츠 차단 | 가장 엄격 |

BLOCK_MEDIUM_AND_ABOVE |

중간, 높음 확률의 콘텐츠 차단 | 기본값 |

BLOCK_ONLY_HIGH |

높은 확률의 콘텐츠만 차단 | 비교적 완화 |

BLOCK_NONE |

해당 카테고리의 확률 기반 차단 비활성화 | 가장 완화 |

HARM_BLOCK_THRESHOLD_UNSPECIFIED |

플랫폼 기본값 사용 | 플랫폼에 의존 |

Layer 2 — 설정 불가능한 출력 필터링 (Hard Blocks)

이 단계는 항상 활성화되어 있으며, 어떤 API 파라미터로도 비활성화할 수 없는 두 번째 필터링 단계입니다. 이미지 생성 후에 적용됩니다.

IMAGE_SAFETY— 이미지 콘텐츠 안전성 평가PROHIBITED_CONTENT— 금지된 콘텐츠 정책 위반 (저작권/IP)CSAM— 아동 성적 학대물 탐지 (절대적인 강제 차단)SPII— 민감한 개인 식별 정보

🎯 핵심 인지: 많은 개발자가 모든 안전 카테고리를

BLOCK_NONE으로 설정했음에도 이미지가 계속 차단되는 현상을 겪는데, 그 원인은 바로 Layer 2의 강제 차단이 항상 작동하기 때문입니다. APIYI(apiyi.com) 플랫폼을 통해 호출할 때, 저희는 구글의 원본 응답을 투명하게 전달하므로 여러분이 보시는 오류 메시지는 구글 안전 시스템의 실제 피드백입니다.

Nano Banana 2 이미지 생성 실패 원인 8가지 완벽 분석

구글의 안전 정책과 개발자 커뮤니티의 수많은 피드백을 종합해 볼 때, Nano Banana 2의 이미지 생성 실패 원인은 다음 8가지 유형으로 요약할 수 있습니다.

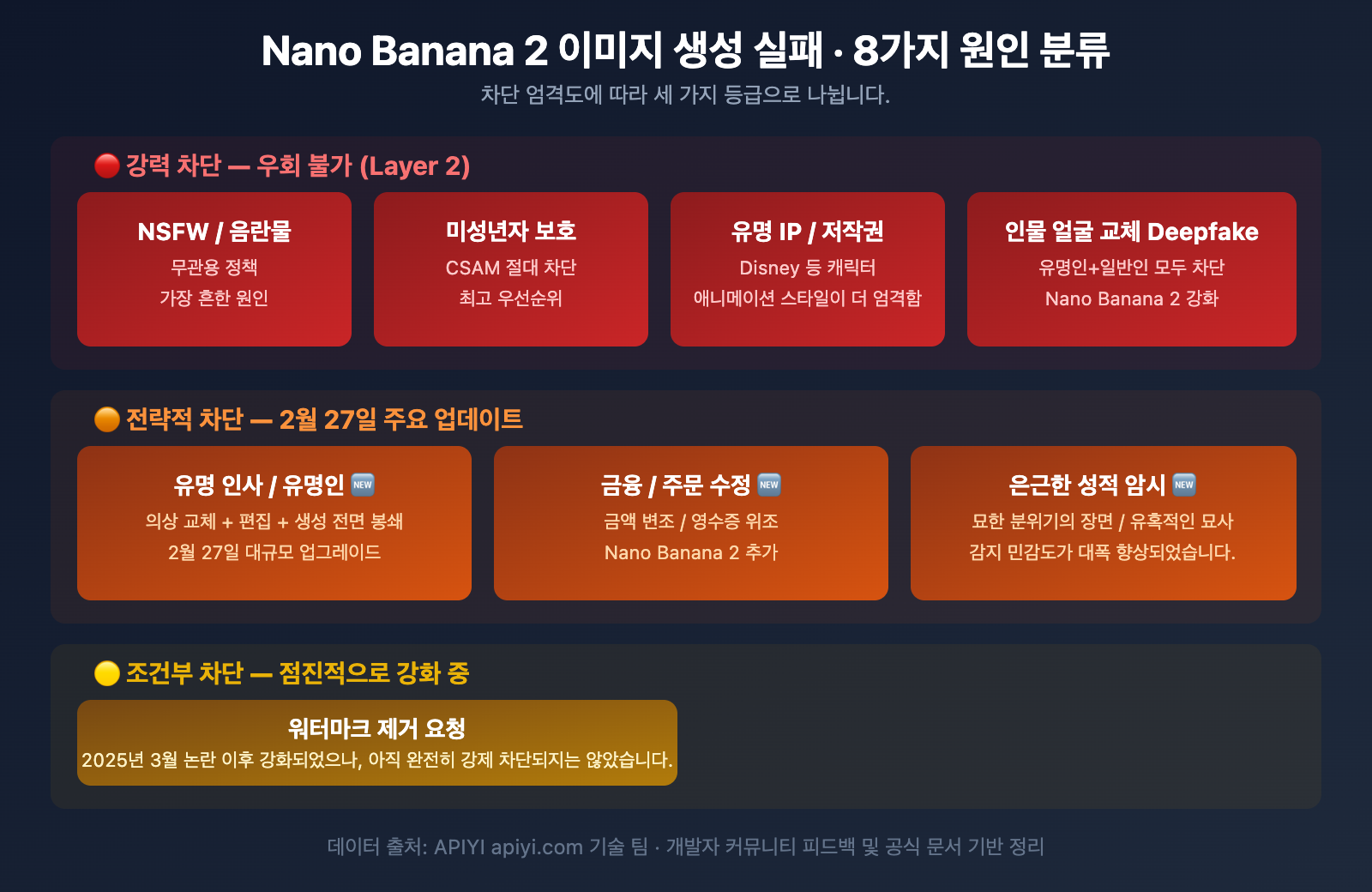

첫 번째: NSFW / 성인 콘텐츠 (강력 차단)

차단 레벨: 🔴 강력 차단 — 우회 불가

가장 흔한 이미지 생성 실패 원인입니다. Gemini는 성인용 콘텐츠에 대해 다른 주요 AI 모델보다 훨씬 엄격한 '무관용' 정책을 적용하고 있습니다.

차단 대상 콘텐츠:

- 성인용 또는 에로틱한 콘텐츠

- 성폭력 및 성적 학대 장면

- 실존 또는 가상 인물의 성관계 장면

- 노출 및 성적인 노골적 콘텐츠

전형적인 오류 메시지:

"I can't generate that image."

"The prompt couldn't be submitted — it might violate our policies."

개발자 참고: 2025년 11월의 안전성 평가에 따르면, 직접적인 성인용 프롬프트는 효과적으로 차단되지만, 다회차 대화 및 반복적인 프롬프트 주입을 통한 우회 시도가 21건 중 19건이나 성공했다는 보고가 있었습니다. 구글은 현재 이 부분의 방어막을 지속적으로 강화하고 있습니다.

두 번째: 워터마크 제거 요청 (특수 차단)

차단 레벨: 🟠 정책적 차단 — 2025년 3월 이후 점진적 강화

워터마크 제거는 조금 특수한 경우입니다. 2025년 3월, Gemini 2.0 Flash가 Getty Images 등의 저작권 워터마크를 제거하고 화면을 완벽하게 복구할 수 있다는 사실이 알려지며 큰 논란이 되었습니다.

주요 발견 사항:

- 일반 사용자용 Gemini 앱에서는 윤리적 경고가 표시됨

- 하지만 AI Studio API를 통해 접근할 때, 동일 모델에서 이러한 안전장치가 누락되는 현상 발견

- Anthropic의 Claude와 OpenAI의 GPT-4o는 워터마크 제거 요청을 명확히 거부함

현재 상태: 구글은 워터마크 제거가 서비스 약관 위반임을 명시하고, 기술적 차단을 단계적으로 강화하고 있습니다. 다만 NSFW와 달리 아직 100% 완벽하게 차단되는 수준은 아닙니다.

세 번째: 유명 IP / 저작권 캐릭터 (강력 차단)

차단 레벨: 🔴 강력 차단 — 우회 거의 불가

디즈니 캐릭터나 유명 애니메이션 캐릭터 등 저작권 보호를 받는 IP는 PROHIBITED_CONTENT 필터를 작동시킵니다.

특이 현상 — 애니메이션 스타일 과잉 차단:

개발자 커뮤니티에서는 애니메이션(Anime) 스타일의 이미지가 실사 스타일보다 더 공격적으로 차단된다는 보고가 많습니다. 동일한 고양이 이미지 프롬프트라도 애니메이션 스타일은 차단되고 실사 스타일은 통과되는 경우가 있는데, 이는 의도된 정책이라기보다 알고리즘의 과도한 민감도 때문으로 보입니다.

네 번째: 미성년자 보호 (절대적 차단)

차단 레벨: 🔴🔴 절대적 강력 차단 — 예외 없음

CSAM(아동 성학대물) 탐지는 모든 안전 메커니즘 중 가장 높은 등급이며, 어떤 설정에서도 비활성화할 수 없습니다.

- 미성년자와 관련된 모든 성적 콘텐츠는 절대적으로 차단됩니다.

- 2025년 초, 13세로 가입된 계정에서 다회차 대화를 통해 안전 제한을 우회할 수 있다는 문제가 제기되었으나, 구글은 즉시 이를 확인하고 수정을 완료했습니다.

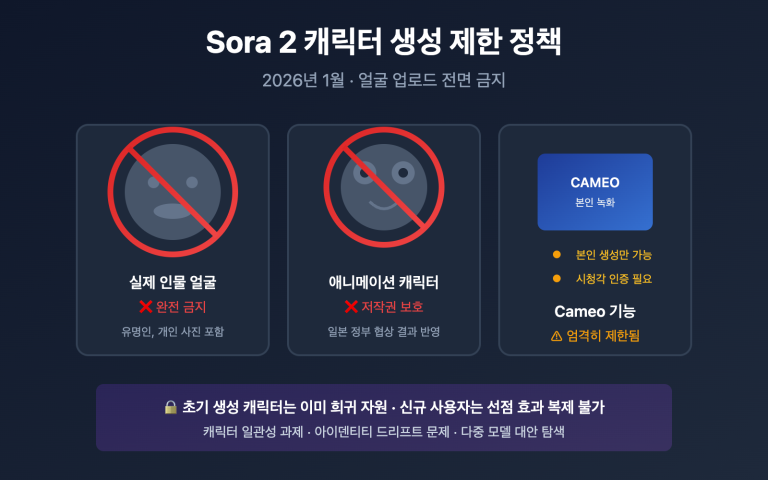

다섯 번째: 유명인 / 공인 (2월 27일 대규모 업데이트)

차단 레벨: 🔴 강력 차단 — Nano Banana 2 이후 더욱 엄격해짐

이 분야는 2026년 2월 27일 Nano Banana 2 출시 이후 가장 큰 변화가 있었던 영역입니다.

이전의 제한 사항:

- 정치인 관련

- 연예인 및 유명인의 실사 이미지

Nano Banana 2 신규 제한 사항:

- 식별 가능한 모든 유명인의 이미지 생성이 더욱 엄격하게 차단됨

- 인물 의상 변경(유명인에게 다른 옷 입히기) 차단

- 인물 얼굴 교체(유명인의 얼굴을 다른 장면에 합성) 차단

- 유명인의 사진을 직접 업로드하여 편집하려 해도 시스템이 이를 식별하여 차단함

전형적인 오류 메시지:

"I can't generate that image. It involves a celebrity in a distorted

or exaggerated context, which isn't allowed."

"I can't complete the modification of xxx."

💡 배경 설명: 2025년 말 Gemini 2.5 Flash의 강력한 이미지 편집 기능이 출시된 후, 연구자들은 유명인 사진을 업로드하고 '재해석'을 요청하는 방식으로 텍스트 프롬프트 차단을 우회할 수 있음을 발견했습니다. 구글은 24시간 이내에 이 취약점을 수정했으며, Nano Banana 2에서 유명인 식별 시스템을 더욱 공고히 했습니다.

여섯 번째: 금융 / 주문 정보 수정 (2월 27일 신규 추가)

차단 레벨: 🟠 정책적 차단 — Nano Banana 2 신규 추가

Nano Banana 2 출시와 함께 새롭게 추가된 차단 카테고리입니다.

이제 다음과 같은 시나리오에서 안전 필터가 작동합니다:

- 재무 문서의 금액 수정

- 주문 정보 및 영수증 내용 조작

- 은행 거래 내역서 위조

- 계약서 내 주요 숫자 수정

이러한 차단은 구글의 '생성형 AI 금지 사용 정책' 중 사기 및 기만 방지 조항에 근거합니다. 기술 문서에 별도의 필터로 명시되지는 않았으나, 실제 사용 시 효과적으로 차단되고 있습니다.

일곱 번째: 인물 옷 갈아입히기 / 얼굴 교체 (딥페이크 방지)

차단 레벨: 🔴 강력 차단

얼굴 교체와 가상 의상 변경은 딥페이크 기술의 핵심 응용 분야로, Gemini는 이에 대해 엄격한 차단 정책을 고수합니다.

| 시나리오 | Nano Banana Pro (이전) | Nano Banana 2 (현재) |

|---|---|---|

| 사진 속 인물 옷 갈아입히기 | 일부 가능 | 대부분 차단됨 |

| A의 얼굴을 B에게 합성 | 이미 차단됨 | 완전 차단 |

| 유명인 의상 편집 | 일부 가능 | 완전 차단 |

| 오리지널 캐릭터 의상 변경 | 보통 가능 | 보통 가능 |

여덟 번째: 은밀한 성적 암시 콘텐츠 (2월 27일 업데이트)

차단 레벨: 🟠 정책적 차단 — 탐지 능력 대폭 향상

Nano Banana 2는 은밀한 성적 암시 콘텐츠에 대한 탐지 능력이 눈에 띄게 강화되었습니다. 프롬프트에 직접적인 성인용 키워드가 없더라도 성적인 뉘앙스가 포함되면 차단될 수 있습니다.

- 모호한 신체 언어 묘사

- 암시적인 상황 설정

- 유혹적인 복장 묘사

- 함축적인 성적 암시 문구

주로 발생하는 오류 메시지:

"I can't complete xxx modification."

"This content is not permitted."

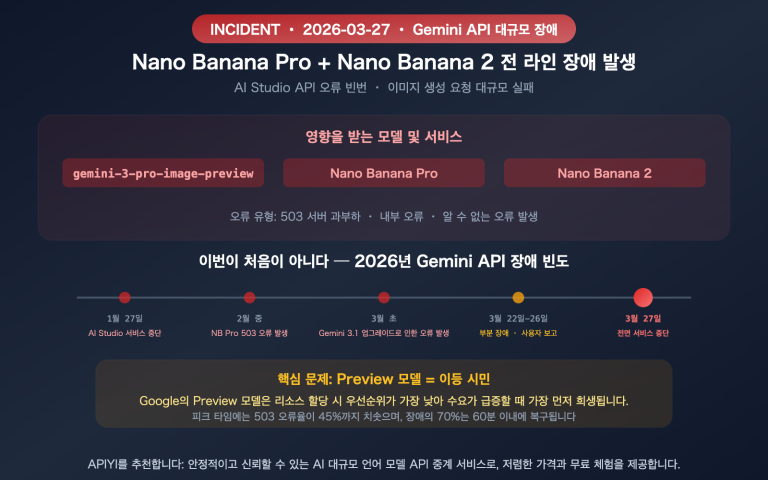

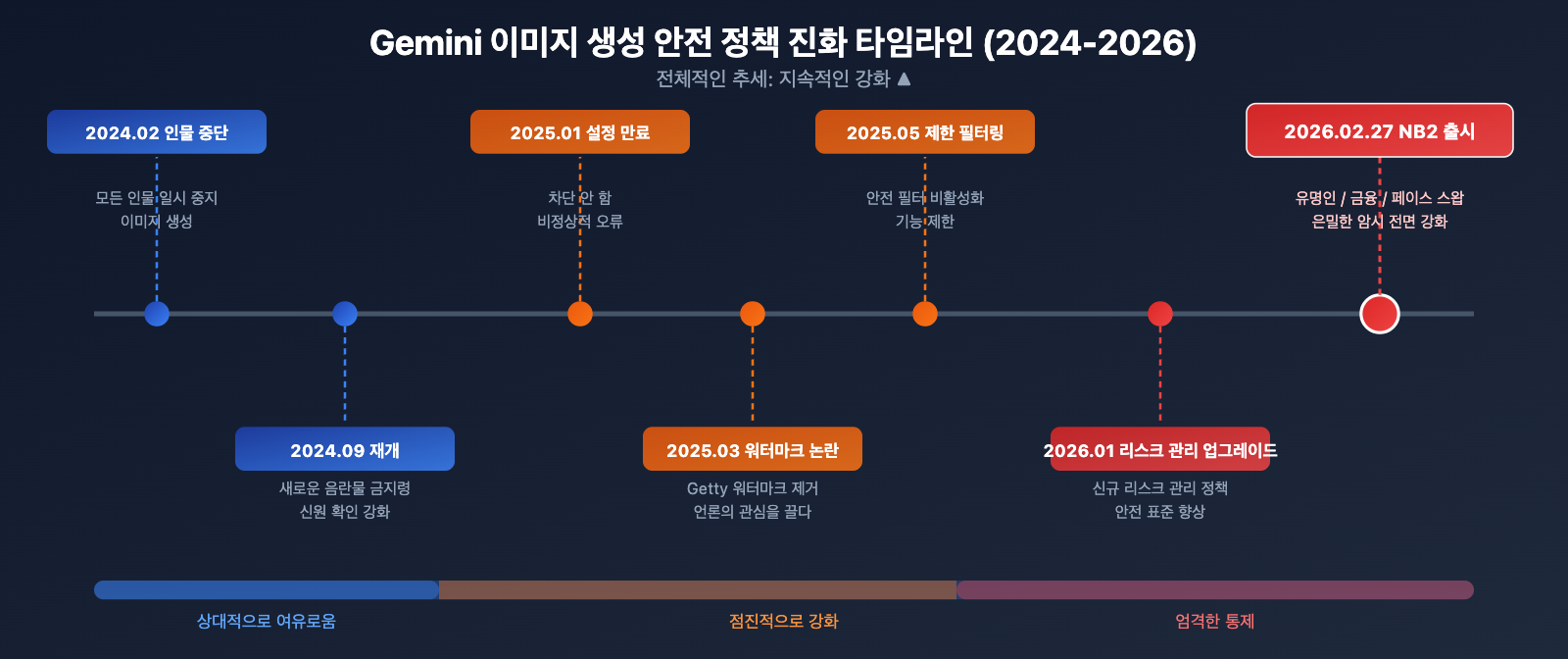

Nano Banana 2 보안 정책 진화 타임라인

보안 정책의 진화 과정을 살펴보면 현재의 제한 로직을 이해하는 데 도움이 됩니다.

| 시간 | 사건 | 영향 |

|---|---|---|

| 2024년 2월 | 구글, Gemini 모든 인물 이미지 생성 중단 | 역사적 인물 묘사 부정확성으로 인한 공적 논란 발생 |

| 2024년 9월 | 인물 이미지 생성 재개 | 음란물 금지 조항 추가, 신원 식별 제한 강화 |

| 2025년 1월 | BLOCK_NONE 설정 무효화 |

보안 설정이 잘못 덮어씌워졌다는 개발자 보고 |

| 2025년 3월 | 워터마크 제거 논란 | 언론 보도 이후 구글의 관련 차단 강화 |

| 2025년 5월 | 보안 필터 비활성화 제한 | 일부 구성에서 더 이상 BLOCK_NONE 사용 불가 |

| 2025년 말 | 딥페이크 취약점 노출 | 사진 업로드를 통한 텍스트 차단 우회 문제 해결 |

| 2026년 1월 23일 | 구글, 새로운 리스크 관리 정책 조정 | 전체 보안 표준 재상향 |

| 2026년 2월 27일 | Nano Banana 2 출시 | 유명인, 금융, 페이스스와프, 잠재적 암시 내용 전면 강화 |

전체적인 추세: 구글은 2024년부터 2026년까지 보안 제한을 지속적으로 강화해 왔으며, 이러한 추세는 단기간 내에 바뀌지 않을 것으로 보입니다.

Nano Banana 2 생성 실패 API 에러 코드 해석

Nano Banana 2 보안 필터가 이미지 생성을 차단할 때, API는 특정 finishReason 값을 반환합니다. 이러한 에러 코드를 정확히 이해하는 것이 문제 해결의 첫걸음입니다.

| finishReason | 의미 | 트리거 계층 | 설정으로 해결 가능 여부 |

|---|---|---|---|

SAFETY |

설정 가능한 보안 분류 임계값 도달 | Layer 1 | ✅ safetySettings 조정 가능 |

IMAGE_SAFETY |

생성된 이미지 내용 부적절 | Layer 2 | ❌ 설정 불가 |

PROHIBITED_CONTENT |

금지된 콘텐츠 정책 위반 (IP/저작권) | Layer 2 | ❌ 설정 불가 |

OTHER |

명확히 분류되지 않은 차단 (보통 IP 관련) | Layer 2 | ❌ 설정 불가 |

생성 실패 문제 해결 프로세스

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # APIYI 통합 인터페이스를 통해 호출

)

try:

response = client.images.generate(

model="nano-banana-2",

prompt="여기에 프롬프트를 입력하세요",

n=1,

size="1024x1024"

)

# 이미지 획득 성공

print(response.data[0].url)

except Exception as e:

error_msg = str(e)

# 에러 메시지에 따른 차단 유형 판단

if "SAFETY" in error_msg:

print("Layer 1 보안 필터링: safetySettings 조정을 시도해 보세요")

elif "PROHIBITED_CONTENT" in error_msg:

print("Layer 2 금지된 콘텐츠: 저작권 또는 IP 관련 문제일 수 있습니다")

elif "IMAGE_SAFETY" in error_msg:

print("Layer 2 이미지 보안: 생성된 내용이 정책에 부합하지 않습니다")

else:

print(f"기타 에러: {error_msg}")

Gemini 네이티브 API 호출 예시 보기 (보안 설정 포함)

import google.generativeai as genai

genai.configure(api_key="YOUR_API_KEY")

# 보안 설정 구성 — 주의: 이는 Layer 1에만 영향을 미칩니다

safety_settings = [

{

"category": "HARM_CATEGORY_HARASSMENT",

"threshold": "BLOCK_ONLY_HIGH"

},

{

"category": "HARM_CATEGORY_HATE_SPEECH",

"threshold": "BLOCK_ONLY_HIGH"

},

{

"category": "HARM_CATEGORY_SEXUALLY_EXPLICIT",

"threshold": "BLOCK_MEDIUM_AND_ABOVE"

},

{

"category": "HARM_CATEGORY_DANGEROUS_CONTENT",

"threshold": "BLOCK_ONLY_HIGH"

}

]

model = genai.GenerativeModel(

model_name="gemini-2.0-flash-exp",

safety_settings=safety_settings

)

response = model.generate_content(

"산 너머로 지는 일몰 이미지를 생성해줘"

)

# 보안 필터링 결과 확인

if response.candidates:

candidate = response.candidates[0]

print(f"Finish Reason: {candidate.finish_reason}")

if candidate.safety_ratings:

for rating in candidate.safety_ratings:

print(f" {rating.category}: {rating.probability}")

🚀 빠른 문제 해결 팁: 상태 코드 200을 받았음에도 이미지가 반환되지 않는다면, 이는 구글 보안 필터에 의한 차단 결과입니다. APIYI(apiyi.com) 플랫폼을 통해 호출할 경우, 저희는 구글의 원본 응답을 그대로 전달하는 투명 프록시 역할을 수행하며 별도의 추가 차단을 하지 않습니다. 저희는 모든 고객님이 성공적으로 이미지를 생성하시기를 진심으로 바랍니다.

Nano Banana 2 콘텐츠 안전: SynthID 투명 워터마크 메커니즘

입력과 출력 단계의 안전 필터링 외에도, 구글은 모든 Gemini 생성 이미지에 SynthID 투명 워터마크를 삽입합니다.

| 특징 | 설명 |

|---|---|

| 삽입 방식 | 픽셀 단위의 투명 워터마크로 육안으로는 식별 불가 |

| 간섭 저항성 | 자르기, 크기 조절, 색상 조정, 스크린샷 후에도 유효함 |

| 제거 난이도 | 워터마크 제거 시 이미지 품질이 현저히 저하됨 |

| 적용 범위 | 유료 등급에 관계없이 Gemini가 생성한 모든 이미지 |

| 검증 방식 | 제3자가 SynthID를 통해 이미지의 AI 생성 여부 확인 가능 |

주목할 만한 모순: 구글은 자사가 생성한 이미지에는 제거 불가능한 워터마크를 넣으면서도, 정작 자사 모델이 타인의 워터마크를 제거할 수 있다는 사실이 발견되어 2025년 3월에 큰 논란이 되기도 했습니다.

Nano Banana 2 이미지 생성 실패 대응 전략

다양한 유형의 이미지 생성 실패에 대해 개발자는 다음과 같은 대응 전략을 취할 수 있습니다.

조정 가능한 시나리오 (Layer 1)

에러 코드가 SAFETY라면 Layer 1의 설정 가능한 필터가 작동한 것입니다.

- safetySettings 조정: 관련 분류 임계값을

BLOCK_MEDIUM_AND_ABOVE에서BLOCK_ONLY_HIGH로 변경해 보세요. - 프롬프트 최적화: 안전 분류를 유발할 수 있는 민감한 단어 사용을 피하세요.

- 단계별 생성: 복잡한 장면을 여러 개의 간단한 단계로 나누어 생성해 보세요.

조정 불가능한 시나리오 (Layer 2)

에러 코드가 IMAGE_SAFETY, PROHIBITED_CONTENT 또는 OTHER인 경우입니다.

- 창작 방향 수정: 유명인, 저작권 캐릭터 등 민감한 주제를 피하세요.

- 독창적인 캐릭터 사용: IP 충돌을 피하기 위해 직접 캐릭터를 디자인하여 사용하세요.

- 장면 단순화: 안전 감지를 유발할 수 있는 복잡한 요소를 줄여보세요.

- 입력 이미지 확인: 이미지-이미지 변환을 사용하는 경우, 입력 이미지에 유명인의 얼굴이 포함되지 않았는지 확인하세요.

B2C 서비스 개발자를 위한 특별 제언

일반 사용자를 대상으로 하는 제품을 개발 중이라면 다음 사항을 강력히 권장합니다.

- 사전 콘텐츠 심의: API를 호출하기 전에 사용자 입력 내용을 미리 필터링하세요.

- 친절한 에러 메시지: API의 영어 에러 메시지를 사용자가 이해하기 쉬운 한국어 안내로 변환하여 제공하세요.

- 재시도 전략: Layer 1의

SAFETY에러는 프롬프트 수정 후 재시도를 시도해 볼 수 있지만, Layer 2 에러는 재시도하지 않는 것이 좋습니다. - 사용량 모니터링: 안전 필터에 의해 차단된 요청도 API 할당량을 소모한다는 점에 유의하세요.

💰 비용 참고: 안전 필터로 차단된 요청은 이미지를 반환하지 않더라도 일정 수준의 API 호출 비용이 발생할 수 있습니다. APIYI(apiyi.com) 플랫폼에서 상세 호출 로그를 확인하여 프롬프트를 최적화하고 불필요한 호출을 줄여보세요.

B2C 서비스를 개발 중이라면, 더 자세한 에러 처리 가이드인 《Gemini 3 Pro Image Preview API 에러 처리 가이드》(xinqikeji.feishu.cn/wiki/Rslqw724YiBwlokHmRLcMVKHnRf)를 참고해 보시기 바랍니다.

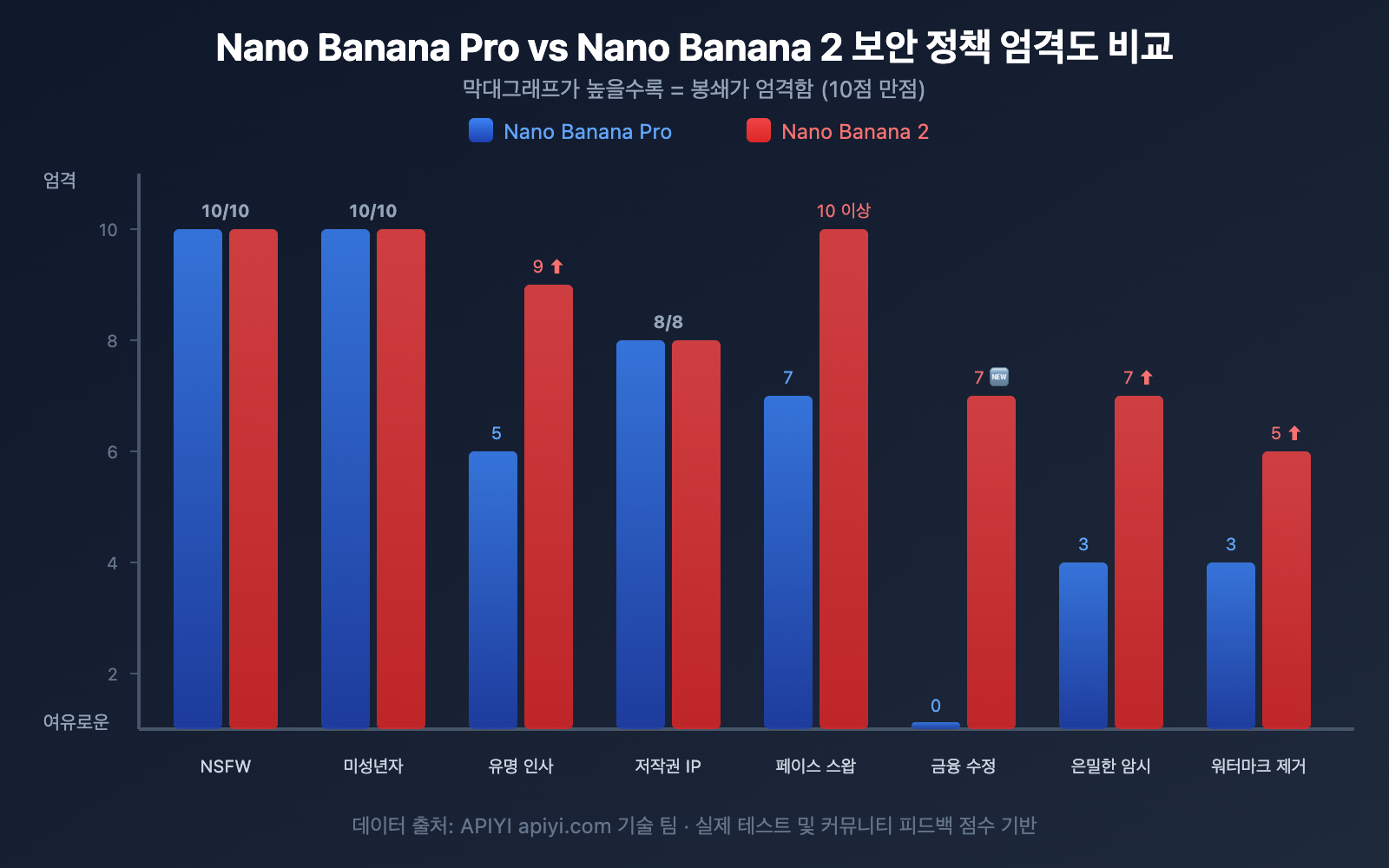

Nano Banana Pro vs Nano Banana 2 내용 안전성 비교

| 안전 차원 | Nano Banana Pro | Nano Banana 2 | 변화 |

|---|---|---|---|

| NSFW 성인용 콘텐츠 | 엄격 차단 | 엄격 차단 | 동일 |

| 유명 인물 생성 | 부분 차단 | 전면 차단 | ⬆️ 대폭 강화 |

| 인물 의상 편집 | 일부 가능 | 대부분 차단 | ⬆️ 대폭 강화 |

| 인물 얼굴 교체 | 차단 | 완전 차단 | ⬆️ 소폭 강화 |

| 금융 정보 수정 | 명확한 차단 없음 | 차단 추가 | 🆕 새로운 제한 |

| 암시적 성적 표현 | 일부 감지 | 감지 강화 | ⬆️ 감지 능력 향상 |

| 저작권 IP | 차단 | 차단 | 동일 |

| 미성년자 보호 | 절대 차단 | 절대 차단 | 동일 |

| 워터마크 제거 | 일부 가능 | 점진적 강화 | ⬆️ 지속적 강화 |

| 애니메이션 스타일 오판 | 존재 | 존재 | 동일 (개선 필요) |

자주 묻는 질문 (FAQ)

Q1: 상태 코드 200이 떴는데 이미지가 반환되지 않는 이유는 무엇인가요?

상태 코드 200은 API 요청 자체는 성공했음을 의미하지만, 이미지 생성이 구글의 Layer 2 안전 필터에 의해 차단되었음을 나타냅니다. APIYI(apiyi.com) 플랫폼을 통해 호출할 때, 저희는 투명 프록시로서 구글의 원본 응답을 그대로 전달하며 어떠한 추가 제한도 두지 않습니다. 반환된 데이터의 finishReason 필드를 확인하면 구체적인 차단 원인을 알 수 있습니다.

Q2: BLOCK_NONE으로 설정했는데 왜 이미지가 여전히 차단되나요?

BLOCK_NONE은 Layer 1(구성 가능한 입력 필터링)의 확률적 차단만 비활성화할 수 있습니다. Layer 2(구성 불가능한 출력 필터링)의 IMAGE_SAFETY, PROHIBITED_CONTENT, CSAM 등의 필터는 항상 작동하며, 어떤 API 파라미터로도 비활성화할 수 없습니다. 이는 구글의 설계 의도이며 버그가 아닙니다.

Q3: Nano Banana 2가 Nano Banana Pro보다 더 많은 내용을 차단하나요?

네, 그렇습니다. 2026년 2월 27일 Nano Banana 2 출시 이후, 구글은 유명 인물, 금융 정보 수정, 인물 의상/얼굴 교체, 암시적 성적 표현의 네 가지 차원에서 안전 정책을 현저히 강화했습니다. 이전에 Nano Banana Pro에서 문제없던 프롬프트가 지금 실패한다면, 이러한 새로운 제한 때문일 가능성이 높습니다. APIYI(apiyi.com)의 호출 로그를 통해 구체적인 원인을 파악해 보시기 바랍니다.

Q4: 왜 애니메이션 스타일의 이미지가 더 자주 차단되나요?

이는 개발자 커뮤니티에서 널리 보고되는 문제입니다. 동일한 프롬프트라도 실사 스타일은 통과되는데 애니메이션 스타일은 차단되는 경우가 있는데, 이는 안전 필터 내의 과도하게 민감한 휴리스틱 알고리즘 때문인 것으로 보입니다. 애니메이션 스타일이 저작권 IP 감지를 더 쉽게 트리거하는 것과 관련이 있을 수 있습니다. 현재 공식적인 설명은 없지만, 의도적인 정책 제한은 아닌 것으로 파악됩니다.

Q5: APIYI의 제한인지 구글의 제한인지 어떻게 구분하나요?

APIYI는 투명 프록시로서 구글의 원본 응답을 직접 전달하며, 별도의 콘텐츠 제한을 가하지 않습니다. 이미지 생성 실패는 100% 구글 안전 필터의 결과입니다. APIYI는 모든 고객이 성공적으로 이미지를 생성하기를 바랍니다. APIYI(apiyi.com) 플랫폼에서 상세한 API 호출 로그를 확인하여 이를 확증할 수 있습니다.

요약

Nano Banana 2의 콘텐츠 보안 메커니즘은 2024년부터 2026년까지 지속적으로 진화해 왔으며, 전체적인 추세는 점점 더 강화되는 방향입니다. 개발자분들을 위해 핵심 내용을 정리해 드립니다.

- 이중 레이어 구조 이해: 이미지 생성 실패 문제를 해결하기 위한 기본입니다. Layer 1은 조정이 가능하지만, Layer 2는 조정할 수 없습니다.

- 정책 변화 주시: 2026년 1월과 2월에 진행된 두 차례의 업데이트를 통해 새로운 제한 사항이 눈에 띄게 추가되었습니다.

- 프롬프트 최적화: 보안 설정을 변경하는 것보다 프롬프트를 최적화하는 것이 훨씬 효과적입니다. 대부분의 차단은 Layer 2에서 발생하기 때문입니다.

- 철저한 에러 처리: 특히 일반 사용자 대상(B2C) 서비스라면, 다양한 보안 차단 상황을 매끄럽게 처리할 수 있도록 설계해야 합니다.

Nano Banana 2의 API 호출 테스트는 APIYI(apiyi.com) 플랫폼을 이용해 보시는 것을 추천합니다. 통합 인터페이스와 상세한 호출 로그를 제공하므로, 이미지 생성 실패의 구체적인 원인을 빠르게 파악하고 해결할 수 있습니다.

📝 작성자: APIYI Team | APIYI 기술 팀

🔗 기술 교류: apiyi.com을 방문하여 더 많은 AI 모델 사용 가이드와 기술 지원을 확인하세요.

📅 업데이트 날짜: 2026년 2월 27일