El 30 de abril de 2026, xAI completó el despliegue total de la API de Grok 4.3. Reducir el precio de entrada en aproximadamente un 40%, ampliar la ventana de contexto a 1M de tokens y ofrecer soporte nativo para entrada de video por primera vez son tres hitos que prácticamente han reescrito el modelo de costos para las aplicaciones de agentes inteligentes. Este artículo ofrece un análisis completo sobre las actualizaciones clave, los detalles de precios, la comparativa de rendimiento y las rutas de implementación de la API de Grok 4.3.

Valor central: Entiende en 3 minutos toda la información clave sobre la API de Grok 4.3, su impacto en la industria y la forma más rápida de integrarla en el país a través de un servicio proxy de API.

Resumen de información clave de la API de Grok 4.3

Esta actualización de xAI combina "reducción de precios + expansión de capacidad + multimodalidad". A solo 4 meses de la generación anterior, Grok 4.20, xAI ha logrado bajar un escalón completo la curva de costos de los modelos de razonamiento con una iteración de versión principal. Primero, alineemos todos los parámetros clave en una tabla, y luego desglosaremos cada punto en las siguientes secciones.

Antes de entrar en la tabla de parámetros, vale la pena aclarar el posicionamiento de Grok 4.3 dentro del ecosistema de productos de xAI. Actualmente, los modelos de API que ofrece xAI se dividen en tres niveles: Grok 4 Fast, que apuesta por una "relación costo-beneficio extrema"; Grok 4.3, el "buque insignia de razonamiento"; y Grok Code Fast 1, enfocado en tareas de programación. Grok 4.3 es la versión que xAI recomienda encarecidamente a todos los usuarios de API como predeterminada, señalándola explícitamente en la documentación como el modelo insignia "más inteligente y rápido".

Tabla de parámetros clave de la API de Grok 4.3

| Elemento | Detalles |

|---|---|

| Fecha de lanzamiento oficial | 30 de abril de 2026 (API disponible al público) |

| Lanzamiento Beta | 17 de abril de 2026 (Usuarios de SuperGrok Heavy) |

| ID del modelo | grok-4.3 |

| Ventana de contexto | 1,000,000 tokens (1M) |

| Velocidad de salida | Aprox. 207 tokens/segundo |

| Precio de entrada | $1.25 / millón de tokens |

| Precio de salida | $2.50 / millón de tokens |

| Modalidades soportadas | Texto, imágenes (≤ 20 MiB por imagen), video (nuevo) |

| Modo de razonamiento | Activado por defecto (Reasoning Always-On) |

| Corte de conocimiento | Noviembre de 2024 |

| Descuento Batch API | 50–80% del precio estándar (procesamiento en 24h) |

| Índice de inteligencia AA | 53 (muy superior a la mediana de 34 en su rango de precio) |

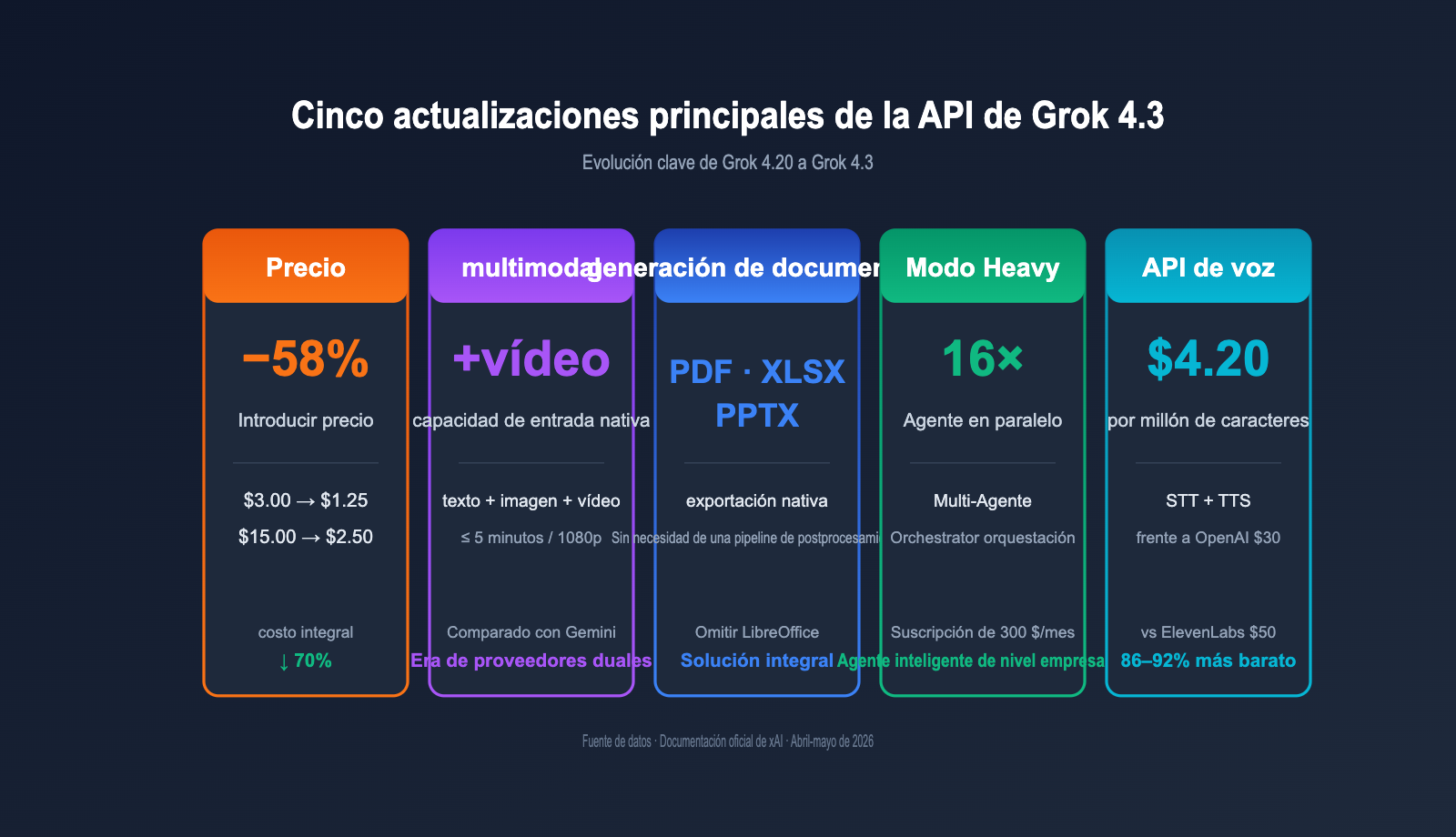

Cinco actualizaciones principales de la API de Grok 4.3

La actualización de xAI va mucho más allá de los cambios de precio; hemos condensado todas las novedades en cinco dimensiones para que puedas entenderlas rápidamente.

| Dirección de actualización | Era 4.20 | Estado actual de Grok 4.3 | Impacto |

|---|---|---|---|

| Precio | $3.00 / $15.00 | $1.25 / $2.50 | Reducción de entrada ~58% |

| Multimodalidad | Texto + Imagen | Texto + Imagen + Video | Los agentes pueden ver videos directamente |

| Generación de documentos | Solo salida de texto | Salida nativa PDF/XLSX/PPTX | Ahorra el pipeline de post-procesamiento |

| Sistema Heavy | Agente único | Programación paralela de 16 agentes | Tareas complejas en una sola ejecución |

| API de voz | Sin API independiente | API STT/TTS $4.20/millón de caracteres | 86–92% más barato que OpenAI |

🎯 Sugerencia de prueba rápida: Para los desarrolladores, acceder a la API de Grok 4.3 a través de APIYI (apiyi.com) es una de las formas más estables. Solo debes configurar el

base_urlcomohttps://vip.apiyi.com/v1y el campo del modelo comogrok-4.3. La velocidad de respuesta es idéntica a la oficial y es compatible con el SDK de OpenAI.

Análisis profundo de precios de la API de Grok 4.3

El precio es el aspecto que más ha llamado la atención en esta versión. A continuación, desglosamos la factura en cuatro niveles: precio unitario, procesamiento por lotes (Batch), llamadas a herramientas y suscripciones.

Precios estándar de la API de Grok 4.3

La lista de precios oficial de xAI especifica claramente las tarifas por token. Los siguientes datos provienen de la documentación oficial de xAI y de las cotizaciones en tiempo real de OpenRouter.

| Ítem | Precio unitario | Notas |

|---|---|---|

| Tokens de entrada | $1.25 / millón | Incluye tokens de texto de imágenes y fotogramas de video |

| Tokens de salida | $2.50 / millón | Incluye tokens de salida de los pasos de razonamiento |

| Tokens de entrada en caché | $0.31 / millón | Se factura a este precio al acertar en la caché |

| Entrada de imagen | Facturado por token | Máximo 20 MiB por imagen |

| Entrada de video | Facturado por token de fotograma | Nueva capacidad |

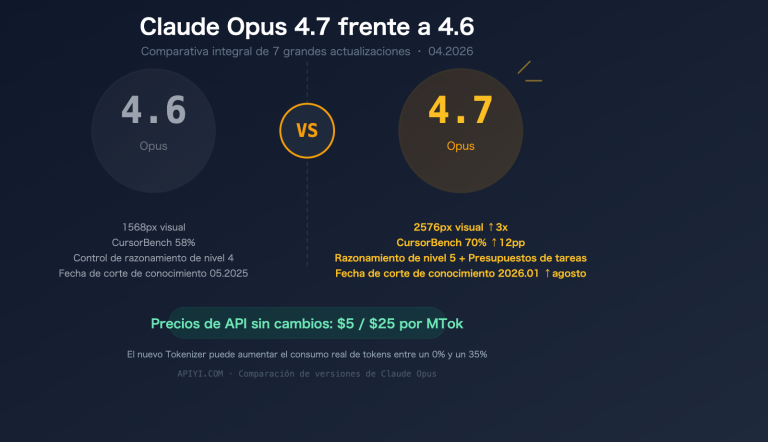

Si realizamos la conversión basándonos en la proporción habitual de 3:1 entre entrada y salida, el precio mixto de la API de Grok 4.3 es de aproximadamente $1.56 por millón de tokens. En comparación con la serie GPT-5 y Claude Opus 4.7, este precio se sitúa en el rango más económico dentro de la categoría de modelos de razonamiento.

Precios de llamadas a herramientas del servidor de Grok 4.3

La API de Grok 4.3 incorpora herramientas del lado del servidor. Los siguientes tres tipos de herramientas se facturan según el número de llamadas, separadas de los costos por token.

| Tipo de herramienta | Precio | Escenario de aplicación |

|---|---|---|

| Búsqueda web | $5 / 1k llamadas | Búsqueda en tiempo real |

| Búsqueda en X (Twitter) | $5 / 1k llamadas | Búsqueda en la línea de tiempo de X |

| Ejecución de código | $5 / 1k llamadas | Ejecución de código en entorno aislado (sandbox) |

💡 Consejo de optimización de costos: Recomendamos combinar Grok 4.3 con Grok 4 Fast en escenarios de concurrencia media. Envíe las consultas simples a 4 Fast (el costo es solo 1/4 del de 4.3) y deje las tareas de razonamiento complejo para 4.3. La plataforma APIYI (apiyi.com) permite cambiar entre ambos modelos bajo la misma

base_url, sin necesidad de reescribir la lógica de autenticación.

Suscripción SuperGrok Heavy de Grok 4.3

Además de la facturación por API, xAI ha lanzado la suscripción SuperGrok Heavy para usuarios intensivos.

| Nivel de suscripción | Cuota mensual | Contenido incluido |

|---|---|---|

| Grok Free | $0 | Uso limitado de Grok 4.3 |

| SuperGrok | $30 / mes | Cuota mayor + entrada de video |

| SuperGrok Heavy | $300 / mes | Modo 16-Agent Heavy + prioridad de velocidad + funciones tempranas |

Este nivel de suscripción compite con ChatGPT Pro ($200/mes) y Claude Max ($200/mes). Aunque el precio es ligeramente superior, el modo 16-Agent Heavy es, hoy por hoy, el producto más cercano a un "clúster de agentes inteligentes de nivel empresarial" disponible públicamente.

Estimación de costos reales de la API de Grok 4.3

A muchos equipos les preocupa cuánto ahorrarán realmente al migrar a Grok 4.3. Hemos realizado una estimación con tres volúmenes de negocio típicos, asumiendo una proporción de entrada/salida de 3:1.

| Volumen de negocio | Volumen mensual de tokens | Cuota mensual Grok 4.3 | Cuota mensual Claude Opus 4.7 | Ahorro |

|---|---|---|---|---|

| Desarrollador individual | 10M | ~$15 | ~$185 | -92% |

| SaaS mediano | 500M | ~$780 | ~$9,200 | -92% |

| Atención al cliente empresarial | 5,000M | ~$7,800 | ~$92,000 | -92% |

Tenga en cuenta que, cuando la tasa de aciertos de prompt caching de Claude Opus 4.7 es alta, el costo real puede reducirse entre un 30% y un 50%. Grok 4.3 también admite descuentos por entrada en caché ($0.31 / millón de tokens), por lo que la tabla muestra el "precio base sin caché". La diferencia real será ligeramente menor, pero seguirá manteniéndose en un orden de magnitud de 6 a 8 veces.

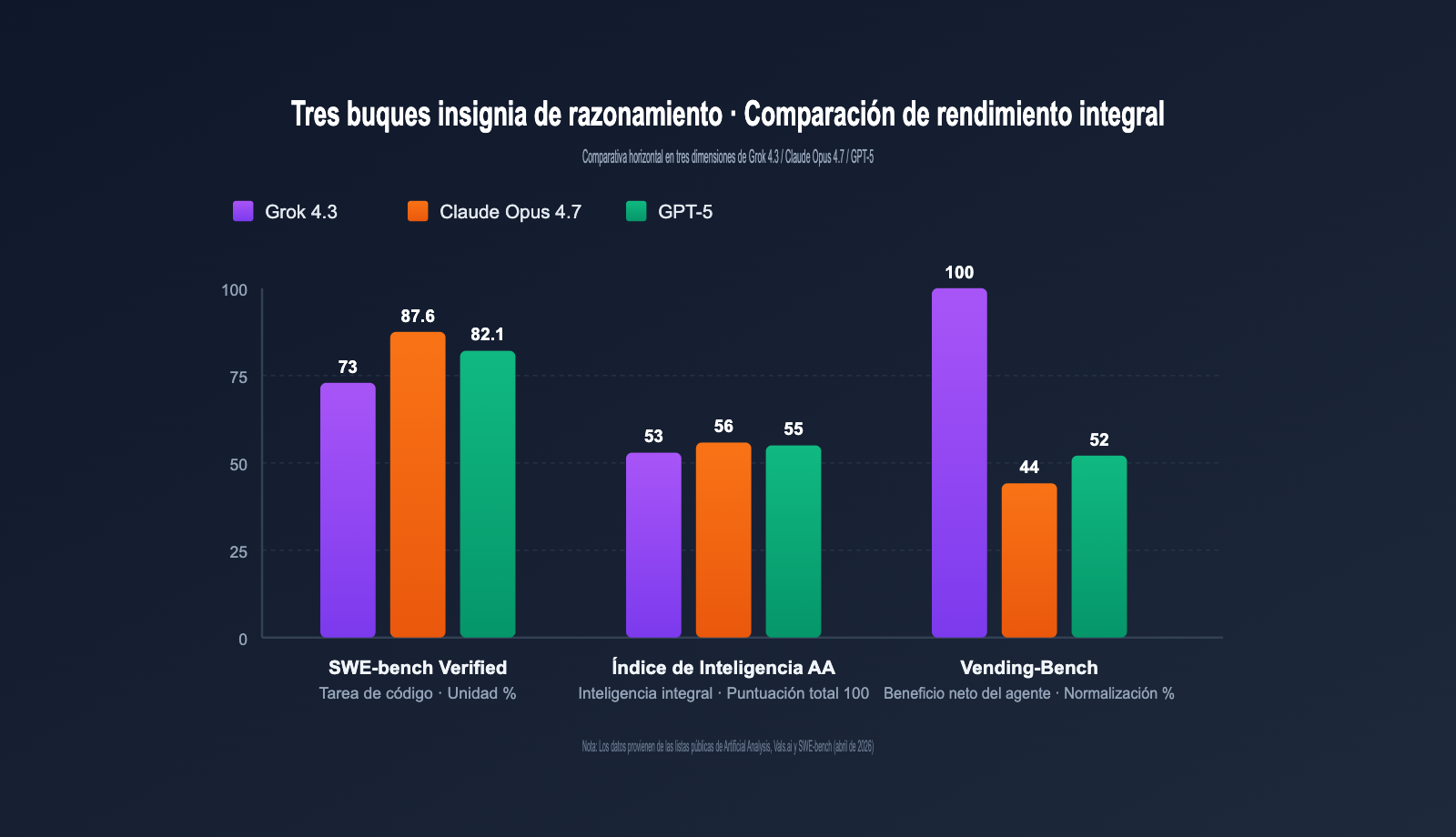

Comparativa de rendimiento de la API de Grok 4.3

El precio no lo es todo. Hemos utilizado datos públicos de los principales rankings recientes para evaluar la posición real de Grok 4.3 en tareas de razonamiento, codificación y agentes.

Comparativa integral de Grok 4.3 con modelos de su categoría

La siguiente tabla resume los datos de referencia disponibles públicamente antes de finales de abril de 2026. Los precios son los precios de lista de la API.

| Modelo | Índice de Inteligencia AA | SWE-bench Verified | Velocidad de salida | Precio de entrada | Ventana de contexto |

|---|---|---|---|---|---|

| Grok 4.3 | 53 | ~73% | 207 tps | $1.25 | 1M |

| Claude Opus 4.7 | 56 | 87.6% | 78 tps | $15.00 | 200k |

| GPT-5 (Razonamiento alto) | 55 | 82.1% | 95 tps | $5.00 | 400k |

| Gemini 3 Pro | 54 | 79.4% | 130 tps | $3.50 | 2M |

| Grok 4 Fast | 41 | 58.2% | 235 tps | $0.30 | 256k |

Podemos extraer varias conclusiones claras:

- La codificación no es el punto fuerte de Grok 4.3: En SWE-bench, queda aproximadamente 14 puntos porcentuales por detrás de Claude Opus 4.7.

- El terreno de Grok 4.3 es el trabajo con agentes: En tareas de simulación de larga secuencia como Vending-Bench, Grok 4.3 supera a Opus 4.7 en aproximadamente 1.26 veces.

- Combinación imbatible de rendimiento y precio: Con una velocidad de 207 tps y un precio de entrada de $1.25, es único en su categoría de modelos de razonamiento.

Rendimiento de Grok 4.3 en diferentes tipos de tareas

Desglosando por granularidad de tarea, observamos los siguientes resultados en la práctica:

| Tipo de tarea | Rendimiento de Grok 4.3 | Escenarios recomendados |

|---|---|---|

| Resumen de contexto largo | ⭐⭐⭐⭐⭐ | Ventana de 1M + alto rendimiento, procesa libros enteros sin problemas |

| Flujo de trabajo con agentes | ⭐⭐⭐⭐⭐ | Rendimiento superior en tareas de larga cadena tipo Vending-Bench |

| Generación y refactorización de código | ⭐⭐⭐⭐ | Inferior a Opus 4.7, pero la ventaja de precio compensa la brecha |

| Razonamiento matemático complejo | ⭐⭐⭐⭐ | La serie AIME se acerca a GPT-5 |

| Comprensión multimodal | ⭐⭐⭐⭐ | La entrada de video es una capacidad nueva, precisión aceptable |

| Memoria a largo plazo | ⭐⭐ | Aún no admite memoria persistente, requiere una capa de memoria externa |

🎯 Consejo de selección: La elección del modelo depende principalmente de sus casos de uso específicos y requisitos de calidad. Recomendamos realizar pruebas reales a través de la plataforma APIYI (apiyi.com), que admite llamadas a interfaces unificadas para los principales modelos de razonamiento como Grok 4.3, Claude Opus 4.7 y GPT-5, facilitando la comparación horizontal con datos de negocio reales.

Análisis detallado de las tres nuevas capacidades de la API de Grok 4.3

Más allá del precio, Grok 4.3 trae consigo tres nuevas capacidades que merecen una mención especial, ya que estaban totalmente ausentes en la era de Grok 4.20.

Capacidad de entrada de video en Grok 4.3

Grok 4.3 es el primer modelo de API de xAI que admite la entrada de video de forma nativa. No se trata de "transcribir primero y luego alimentar con texto", sino de procesar los fotogramas del video directamente a través de un codificador visual.

Parámetros de video admitidos:

| Parámetro | Límite |

|---|---|

| Duración por video | ≤ 5 minutos (recomendado oficialmente) |

| Resolución de video | ≤ 1080p |

| Muestreo de fotogramas | Extracción automática a 1–4 fps |

| Formatos de archivo | mp4, mov, webm |

| Método de facturación | Facturación por tokens de imagen tras la extracción de fotogramas |

En escenarios de aplicación real, hay dos direcciones claras: primero, la extracción de eventos clave en videos de vigilancia/seguridad y, segundo, el resumen estructurado de videos educativos o de reuniones. Esto último, combinado con una ventana de contexto de 1M, permite "cargar una clase completa de 4 horas y obtener notas completas por capítulos".

La siguiente tabla resume varias aplicaciones típicas de entrada de video que hemos observado, junto con sus puntos técnicos clave.

| Escenario de aplicación | Puntos técnicos clave | Dificultad de implementación |

|---|---|---|

| Detección de eventos en video de vigilancia | Configurar una indicación del sistema para centrarse en eventos, fps a 2 | Baja |

| Actas de reuniones en video | Extraer audio sincronizado con STT, fotogramas de video para identificar cambios de orador | Media |

| Notas de capítulos de videos educativos | Dividir videos largos en segmentos de 5 minutos, luego resumir | Baja |

| Documentación de videos de demostración de productos | Identificar pasos de la interfaz mediante fotogramas, generar tutoriales ilustrados | Media |

| Moderación de contenido de videos cortos | Videos ≤ 60 segundos, llamadas concurrentes por lotes | Baja |

Capacidad de generación de documentos en Grok 4.3

La función más subestimada de la nueva versión es, irónicamente, la generación de documentos. Grok 4.3 puede generar directamente archivos PDF, Excel (XLSX) y PowerPoint (PPTX) descargables durante la conversación, con el contenido rellenado por el modelo en tiempo real.

# Ejemplo minimalista: Hacer que Grok 4.3 genere directamente un Excel de informe financiero

from openai import OpenAI

client = OpenAI(

api_key="TU_CLAVE_API",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="grok-4.3",

messages=[{

"role": "user",

"content": "Genera un informe comparativo de la industria SaaS del Q4 2025 en formato XLSX, incluyendo columnas de ingresos, tasa de crecimiento y margen bruto"

}],

extra_body={"output_format": "xlsx"}

)

# La respuesta contiene la URL del archivo descargable

print(response.choices[0].message.attachments[0].url)

Ver código completo de generación de documentos (incluye cambio entre formatos PDF/PPTX)

from openai import OpenAI

import requests

import os

client = OpenAI(

api_key="TU_CLAVE_API",

base_url="https://vip.apiyi.com/v1"

)

OUTPUT_FORMATS = ["pdf", "xlsx", "pptx"]

def generate_doc(prompt: str, fmt: str, save_dir: str = "./outputs"):

"""Llama a Grok 4.3 para generar un documento en el formato especificado y guardarlo localmente"""

if fmt not in OUTPUT_FORMATS:

raise ValueError(f"El formato debe ser uno de {OUTPUT_FORMATS}")

response = client.chat.completions.create(

model="grok-4.3",

messages=[{"role": "user", "content": prompt}],

extra_body={"output_format": fmt}

)

attachment = response.choices[0].message.attachments[0]

file_url = attachment.url

file_name = attachment.filename or f"output.{fmt}"

os.makedirs(save_dir, exist_ok=True)

save_path = os.path.join(save_dir, file_name)

file_resp = requests.get(file_url, timeout=60)

file_resp.raise_for_status()

with open(save_path, "wb") as f:

f.write(file_resp.content)

return save_path

if __name__ == "__main__":

pdf_path = generate_doc(

"Escribe un informe de tendencias de la industria de Modelos de Lenguaje Grandes para 2026, de 5 páginas",

"pdf"

)

print(f"PDF guardado: {pdf_path}")

ppt_path = generate_doc(

"Crea una presentación de 10 diapositivas para el lanzamiento del producto de la API de Grok 4.3",

"pptx"

)

print(f"PPTX guardado: {ppt_path}")

💡 Sugerencia de integración: La función de generación de documentos se puede transmitir directamente a través del servicio proxy de API de APIYI (apiyi.com) sin necesidad de parámetros adicionales; tanto el SDK de Python como el de Node.js pueden realizar la invocación del modelo tal cual.

API de voz lanzada simultáneamente con Grok 4.3

Lo que a menudo se pasa por alto es que, el mismo día que xAI lanzó Grok 4.3, también introdujo APIs independientes de STT (voz a texto) y TTS (texto a voz), las cuales se facturan por separado del modelo principal.

| API de voz | Precio xAI | Precio similar OpenAI | Diferencia de precio |

|---|---|---|---|

| STT (equivalente a Whisper) | $4.20 / millón de caracteres | ~$30 / millón de caracteres | 86% más barato |

| TTS (alta expresividad) | $4.20 / millón de caracteres | ~$50 / millón de caracteres (ElevenLabs) | 92% más barato |

Esta estrategia de precios significa que xAI ha reducido el precio base de la IA de voz a 1/10 del estándar de la industria. Para escenarios de alto volumen de audio, como bots de atención al cliente, generación de podcasts y asistentes de voz para vehículos, la curva de precios ha sido completamente reescrita.

Análisis del impacto de la API de Grok 4.3 para los desarrolladores

Impacto directo en los desarrolladores de aplicaciones de IA

| Dimensión del impacto | Cambio específico | Sugerencia de respuesta |

|---|---|---|

| Estructura de costos | Costos de aplicaciones de razonamiento ↓ 40–60% | Reevaluar la proporción de uso de modelos avanzados |

| Selección de arquitectura | La ventana de contexto de 1M reduce la necesidad de RAG | A corto plazo, usar contexto largo para reemplazar parte de la recuperación |

| Productos multimodales | La entrada de video reduce la barrera de la IA visual | Proyectos de video para vigilancia/educación/salud merecen ser iniciados |

| Productos de agentes | 16-Agent Heavy eleva el límite de tareas complejas | La arquitectura multi-agente entra en una fase práctica |

| Productos de voz | Caída drástica en costos de TTS/STT | El front-end de voz puede ser totalmente basado en IA |

Impacto a mediano y largo plazo en la industria de la IA

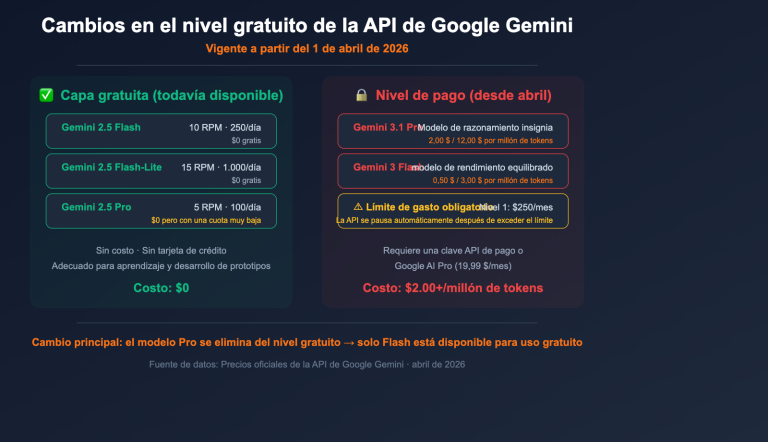

Primero, la guerra de precios de los modelos de razonamiento ha comenzado oficialmente. Grok 4.3 presiona el precio de la combinación de 1M de contexto + razonamiento a aproximadamente 1/12 del de Claude Opus 4.7. Este precio no es una prueba menor, sino que rompe por completo el consenso de la industria de que "los modelos de razonamiento deben ser caros", lo que obligará a OpenAI y Anthropic a responder con precios en la segunda mitad de 2026, ya sea igualándolos o diferenciándose en otras dimensiones (mejor codificación, mayor memoria).

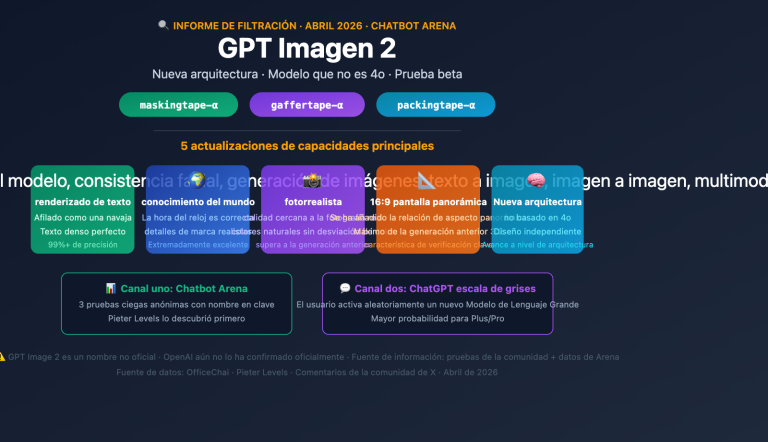

Segundo, la "entrada nativa de video" pasa de ser una demostración a la producción. Antes de esto, Gemini era la única API comercial que ofrecía entrada de video a escala. Con la incorporación de Grok 4.3, la multimodalidad de video entra en una verdadera era de doble proveedor. Esto significa que los productos de IA de video que antes no se iniciaban por el "riesgo de proveedor único" ahora pueden programarse formalmente.

Tercero, los Multi-Agentes entran en la era de la "suscripción". La arquitectura de 16 agentes de SuperGrok Heavy se ofrece como suscripción. Si este modelo de negocio funciona, allanará el camino para productos facturados por "número de agentes". En el pasado, los multi-agentes se implementaban principalmente en la capa de aplicación mediante marcos de código abierto (LangGraph, AutoGen, CrewAI); ahora, xAI ha bajado esta capa directamente a la plataforma del modelo, lo que significa que el paradigma de "Agente como Servicio" comienza a consolidarse.

Cuarto, la falta de memoria persistente en xAI es una verdadera debilidad. ChatGPT y Claude ya admiten memoria entre sesiones desde hace más de un año, y Grok 4.3 aún no lo ha implementado, lo cual es una desventaja significativa en productos de tipo "asistente personal". La única solución a corto plazo es construir una capa de memoria propia en la capa de aplicación (base de datos vectorial + recuperación RAG). Las soluciones comunitarias como Mem0 y Letta ya son maduras, pero solo la memoria nativa oficial podrá desbloquear formas de producto más profundas.

Quinto, la velocidad de razonamiento se convierte en una nueva dimensión competitiva. Una velocidad de salida de 207 tokens/segundo es la más rápida de la industria para modelos de razonamiento, lo que permite que tareas que antes requerían procesamiento por lotes puedan realizarse en interacción en tiempo real, como revisiones de código, preguntas y respuestas sobre documentos largos o generación de contenido dinámico. La ventaja de velocidad, sumada al bajo precio, dará lugar a una nueva categoría de aplicaciones: microservicios de razonamiento de alta frecuencia y baja latencia.

Matriz de decisión para la selección de la API de Grok 4.3

No todos los escenarios son ideales para migrar a Grok 4.3. Hemos recopilado las consultas de negocio reales de las últimas dos semanas en una matriz de decisión para ayudarte a elegir.

Escenarios altamente recomendados para la API de Grok 4.3

| Escenario | Razón de la recomendación |

|---|---|

| Resumen y análisis de documentos largos | 1M de ventana de contexto + 207 tps de salida; procesa libros enteros o informes de 200 páginas sin problemas |

| Agentes de atención al cliente / gestión de quejas | Razonamiento activado por defecto y precio lo suficientemente bajo para tener "un agente por persona" |

| Comprensión de contenido de video | El único, junto con Gemini, con entrada nativa de video y a un precio más competitivo |

| Etiquetado de datos offline a gran escala | Con el descuento de la API Batch, el costo se acerca a $0.65 por millón de tokens, reduciendo drásticamente los costos |

| Actas de reuniones multimodales | Integración de video + audio + texto; genera documentos directamente en PDF/PPTX |

| Tareas de agentes de cadena larga | Los datos de Vending-Bench confirman que este es el punto fuerte de Grok 4.3 |

Escenarios no recomendados para la API de Grok 4.3

| Escenario | Razón de la no recomendación |

|---|---|

| Agente de programación (coding) de alto nivel | SWE-bench sigue estando un 14% por detrás de Claude Opus 4.7 |

| Asistente personal (memoria fuerte) | Carece de memoria persistente; requiere construir una capa de memoria propia |

| Interacción de latencia ultra baja | 207 tps es rápido, pero Grok 4 Fast (235 tps) es más adecuado y económico |

| Sensibilidad extrema al chino nativo | El rendimiento en chino es bueno, pero ligeramente inferior a Claude / GPT-5 |

| Escritura legal / médica de cumplimiento estricto | Conocimiento limitado hasta noviembre de 2024; menos actualizado que Claude Opus 4.7 |

Sugerencias de división de tareas: Grok 4.3 vs. Grok 4 Fast

Muchos equipos nos hacen una pregunta muy práctica: ¿deberíamos usar Grok 4.3 o Grok 4 Fast en el mismo proyecto? Nuestra recomendación es dividir el tráfico según la complejidad de la tarea.

| Tipo de tarea | Modelo recomendado | Razón |

|---|---|---|

| Respuestas FAQ simples | Grok 4 Fast | El precio unitario es 1/4 del de 4.3 y es más rápido |

| Clasificación de moderación de contenido | Grok 4 Fast | No requiere razonamiento; Fast es suficiente |

| Generación de planes complejos | Grok 4.3 | El razonamiento es obligatorio; 4.3 es la opción por defecto |

| Invocación de herramientas de varios pasos | Grok 4.3 | La cadena de herramientas del lado del servidor requiere razonamiento |

| Procesamiento de documentos largos (>200k) | Grok 4.3 | El contexto de Fast es de solo 256k; 4.3 ofrece 1M |

💡 Sugerencia de arquitectura: En el servicio proxy de API APIYI (apiyi.com), puedes enrutar automáticamente las solicitudes a Grok 4 Fast o Grok 4.3 basándote en la longitud del token o etiquetas de tarea. Usando el mismo SDK y la misma clave API, solo cambias un campo para alternar modelos, reduciendo significativamente los costos de ingeniería.

Tutorial completo de acceso a la API de Grok 4.3 en China

El acceso a la interfaz oficial de xAI desde China enfrenta barreras de red y de pago. A continuación, presentamos la ruta de acceso más estable.

Pasos de conexión de la API de Grok 4.3 (Compatible con SDK de OpenAI)

# Ejemplo completo de conexión, usando el SDK oficial de OpenAI

from openai import OpenAI

client = OpenAI(

api_key="Tu clave API de APIYI",

base_url="https://vip.apiyi.com/v1" # base_url del servicio proxy de APIYI

)

response = client.chat.completions.create(

model="grok-4.3",

messages=[

{"role": "system", "content": "Eres un analista senior de productos de IA"},

{"role": "user", "content": "Analiza tres impactos a largo plazo de Grok 4.3 en la industria de los agentes inteligentes"}

],

temperature=0.7,

max_tokens=2048

)

print(response.choices[0].message.content)

Ver código completo para salida en streaming + entrada de imagen

from openai import OpenAI

import base64

client = OpenAI(

api_key="Tu clave API de APIYI",

base_url="https://vip.apiyi.com/v1"

)

# 1. Salida en streaming

def stream_chat(prompt: str):

stream = client.chat.completions.create(

model="grok-4.3",

messages=[{"role": "user", "content": prompt}],

stream=True

)

for chunk in stream:

content = chunk.choices[0].delta.content

if content:

print(content, end="", flush=True)

print()

# 2. Entrada de imagen

def vision_chat(image_path: str, question: str):

with open(image_path, "rb") as f:

b64 = base64.b64encode(f.read()).decode()

response = client.chat.completions.create(

model="grok-4.3",

messages=[{

"role": "user",

"content": [

{"type": "text", "text": question},

{"type": "image_url", "image_url": {

"url": f"data:image/png;base64,{b64}"

}}

]

}]

)

return response.choices[0].message.content

if __name__ == "__main__":

stream_chat("Explica en tres párrafos el impacto de una ventana de contexto de 1M en la arquitectura RAG")

answer = vision_chat(

"./screenshot.png",

"¿En qué capa se encuentra Grok 4.3 en este diagrama de arquitectura?"

)

print(answer)

Uso práctico de herramientas (Tool Use) en la API de Grok 4.3

Además del protocolo compatible con OpenAI, Grok 4.3 admite de forma nativa tres tipos de herramientas del lado del servidor. Solo necesitas declararlas a través del campo tools y el modelo decidirá por sí mismo cuándo y cuál llamar, sin necesidad de programación adicional en la capa de aplicación.

# Ejemplo de invocación de herramientas del lado del servidor en Grok 4.3:

# permitir que el modelo busque en la web + ejecute código en sandbox

from openai import OpenAI

client = OpenAI(

api_key="Tu clave API de APIYI",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="grok-4.3",

messages=[{

"role": "user",

"content": "Consulta el precio de los tokens de Grok 4.3 hoy en xAI y usa Python para calcular el costo total de 1 millón de llamadas"

}],

tools=[

{"type": "web_search"}, # Búsqueda web

{"type": "code_execution"} # Ejecución en sandbox

]

)

print(response.choices[0].message.content)

El modelo encadenará las herramientas según sea necesario; por ejemplo, primero usará web_search para obtener el precio más reciente y luego code_execution para realizar el cálculo matemático, entregando finalmente una respuesta estructurada. Esta capacidad de "cadena de herramientas autónoma" requería programación manual en la era de Grok 4.20, pero con Grok 4.3 se puede completar en una sola solicitud.

Mejores prácticas para migrar de OpenAI a la API de Grok 4.3

Muchos equipos han construido sistemas basados en la interfaz de OpenAI; al migrar a Grok 4.3, solo deben tener en cuenta estos puntos clave.

| Elemento de migración | Escritura original en OpenAI | Escritura recomendada para Grok 4.3 |

|---|---|---|

| base_url | https://api.openai.com/v1 |

https://vip.apiyi.com/v1 |

| Campo de modelo | gpt-5 |

grok-4.3 |

| Configuración de razonamiento | reasoning_effort="high" |

Activado por defecto, no requiere configuración |

| Declaración de herramientas | tools=[{"type": "function", ...}] |

Igual, las herramientas del lado del servidor usan tipos integrados como web_search |

| Salida en streaming | stream=True |

Totalmente compatible |

| Modo JSON | response_format={"type": "json_object"} |

Totalmente compatible |

En proyectos reales, recomendamos tres pasos: primero, cambiar solo la base_url y el model en el entorno de prueba para verificar la comunicación básica; segundo, enrutar las solicitudes de razonamiento de alto valor a Grok 4.3 mientras las conversaciones normales siguen usando el modelo original para realizar una comparación A/B; tercero, decidir si realizar una migración completa o mantener una arquitectura híbrida según los datos reales.

🎯 Sugerencia de arquitectura híbrida: En la plataforma APIYI (apiyi.com), todos los modelos principales (Grok 4.3, Claude Opus 4.7, GPT-5, Gemini 3 Pro) comparten la misma

base_urly clave API. Solo necesitas cambiar el campomodelen la capa de aplicación para alternar entre ellos, sin trabajo de integración adicional.

Notas sobre la conexión a la API de Grok 4.3

| Nota | Descripción |

|---|---|

| Campo de modelo | Usar estrictamente grok-4.3 (no grok4.3 ni Grok-4.3) |

| base_url | Se recomienda https://vip.apiyi.com/v1 para estabilidad y baja latencia |

| Campo de razonamiento | Activado por defecto, no requiere parámetros adicionales |

| Contexto ultra largo | Se recomienda una entrada ≤ 800k tokens para dejar margen al razonamiento |

| Entrada de video | Se pasa a través del campo video_url; actualmente se recomienda menos de 5 minutos |

🎯 Sugerencia de uso real: Recomendamos solicitar una clave de prueba en APIYI (apiyi.com) para completar el ciclo mínimo de validación antes de cambiar a la cuota de producción. La plataforma admite prepago de saldo y pago por uso, sin necesidad de vincular tarjetas de crédito extranjeras, lo que se adapta a los procesos financieros de los equipos locales.

Preguntas frecuentes sobre la API de Grok 4.3

Q1: ¿Es realmente más barata la API de Grok 4.3 que la de Grok 4.20? ¿Cuál es la reducción de precio?

Sí, y la reducción es significativa. Mientras que el precio anterior de Grok 4.20 era de aproximadamente $3.00 / $15.00 (entrada/salida), Grok 4.3 se ha ajustado a $1.25 / $2.50. Esto representa una disminución de aproximadamente el 58% en el precio de entrada y un 83% en el de salida. Si calculamos con una relación de entrada/salida de 3:1, el ahorro de costes global es de alrededor del 70%. Es una señal clara de que xAI está pasando a la ofensiva en el mercado de modelos de razonamiento.

Q2: ¿Está disponible la ventana de contexto de 1M de la API de Grok 4.3 en China?

Sí, está disponible. La ventana de contexto de 1M es una capacidad propia del modelo y no tiene restricciones geográficas. Cuando los desarrolladores en China acceden a través de un servicio proxy de API como APIYI (apiyi.com), el contexto largo también es compatible. Sin embargo, ten en cuenta que cuanto mayor sea el número de tokens en una sola solicitud, mayor será la latencia (podría superar los 30 segundos de extremo a extremo). Se recomienda realizar un procesamiento asíncrono o una programación segmentada para contextos extremadamente largos en entornos de producción.

Q3: ¿Cómo elegir entre Grok 4.3 y Claude Opus 4.7?

Elige según el tipo de tarea: si el núcleo de tu negocio es la generación de código o agentes de codificación de larga cadena, elige Claude Opus 4.7, que sigue liderando en SWE-bench por unos 14 puntos porcentuales. Si tu negocio se centra en resúmenes de contexto largo, agentes tipo Vending-Bench o comprensión de vídeo multimodal, elige Grok 4.3; es 12 veces más barato y tiene una mejor adaptación a esas tareas. La arquitectura híbrida es la tendencia principal para 2026: utilizar un servicio proxy de API unificado para gestionar ambos modelos.

Q4: ¿Qué es el sistema 16-Agent Heavy de Grok 4.3? ¿Se puede invocar mediante API?

El 16-Agent Heavy es un sistema de programación paralela que xAI superpone al modelo principal. Un orquestador coordina hasta 16 agentes trabajadores para procesar subtareas en paralelo, lo que lo hace ideal para planificaciones complejas y simulaciones de larga duración. Actualmente, el modo Heavy solo está disponible para suscriptores de SuperGrok Heavy ($300/mes). La interfaz estándar de la API no expone directamente la entrada de 16 agentes, pero puedes implementar tu propia orquestación multi-agente en la capa de aplicación usando Grok 4.3, logrando resultados cercanos al modo Heavy nativo.

Q5: La API de Grok 4.3 no tiene memoria persistente, ¿existen alternativas?

Necesitas construir un módulo de memoria en la capa de aplicación. El enfoque común es almacenar el historial de conversaciones del usuario en una base de datos vectorial y, antes de realizar la invocación del modelo, recuperar los fragmentos top-k mediante RAG para volver a integrarlos en el contexto. La comunidad cuenta con soluciones maduras como Mem0 o Letta que se conectan directamente a interfaces compatibles con OpenAI, por lo que también son compatibles con Grok 4.3. Recomendamos cambiar primero la base_url a APIYI (apiyi.com) para establecer la conversación básica y luego añadir la capa de memoria; es la forma más económica de iterar.

Q6: ¿Qué escenarios admite la entrada de vídeo de Grok 4.3 y tiene límites de duración?

La recomendación oficial es utilizar vídeos de ≤ 5 minutos, ≤ 1080p y en formatos mp4/mov/webm, los cuales se facturan según los tokens de imagen tras la extracción de fotogramas. Las aplicaciones típicas incluyen: extracción de eventos clave de vídeos de vigilancia, actas estructuradas de reuniones grabadas, notas de capítulos de vídeos educativos y documentación automática de vídeos de demostración de productos. Si el vídeo es más largo, se recomienda realizar cortes en el lado del cliente y luego realizar llamadas paralelas a Grok 4.3 para su procesamiento.

Q7: ¿Es necesario modificar el código para migrar de OpenAI / Claude a Grok 4.3?

Solo necesitas cambiar dos campos. La API de Grok 4.3 es totalmente compatible con el protocolo Chat Completions de OpenAI. Cambia el campo del modelo de gpt-5 o claude-opus-4-7 a grok-4.3, y la base_url del dominio del proveedor original a https://vip.apiyi.com/v1. La salida por streaming, la llamada a herramientas (tool calling) y el modo JSON mantienen los mismos nombres de campo que en OpenAI, por lo que no es necesario reescribir la lógica del cliente. La entrada de vídeo es exclusiva de Grok 4.3 y se pasa a través del campo video_url, sin afectar al flujo de entrada de imágenes original.

Q8: ¿Para qué escenarios es adecuado el modo Batch de la API de Grok 4.3?

Es ideal para tareas por lotes que no requieren tiempo real y que pueden esperar hasta 24 horas para obtener una respuesta, como el etiquetado de datos offline, el análisis de registros históricos, el preprocesamiento de documentos a gran escala o el archivo de moderación de contenido. La API Batch permite ahorrar entre un 20% y un 50% adicional sobre el precio estándar. Para tareas de procesamiento por lotes con mucha entrada y poca salida, el coste real puede reducirse hasta un mínimo de $0.65 por millón de tokens. Si tu negocio no es sensible a la latencia, migrar el tráfico a Batch es la ruta más económica.

Puntos clave para desarrolladores chinos sobre la API de Grok 4.3

A continuación, presento una lista de verificación para equipos chinos, cubriendo aspectos técnicos, de cumplimiento y de costes.

Dimensión de acceso técnico

Primero, prioriza el uso de un servicio proxy de API estable en lugar de construir tu propio proxy. La interfaz oficial de xAI para Grok 4.3 requiere una red externa estable; los proxies autoconstruidos suelen sufrir inestabilidad en la conexión bajo alta concurrencia. Los servicios proxy de API cuentan con despliegues en múltiples centros de datos en China, ofreciendo mejor latencia y estabilidad. Segundo, tras cambiar la base_url a https://vip.apiyi.com/v1, el SDK no requiere ningún cambio, ya sea el SDK de OpenAI para Python, el paquete openai para Node.js o go-openai para Go, todos funcionan directamente.

Dimensión de cumplimiento y facturación

Primero, los equipos chinos pueden utilizar el servicio proxy de API para realizar pagos en RMB, evitando problemas de cumplimiento con tarjetas de crédito extranjeras y pagos transfronterizos. Segundo, las plataformas de proxy suelen facturar por uso con saldo prepago, lo cual es más sencillo para los procesos financieros de las empresas nacionales. Tercero, en cuanto al cumplimiento de la transferencia de datos al extranjero, se recomienda anonimizar la información sensible en la capa de aplicación y no enviar datos privados de los clientes directamente al modelo de razonamiento.

Dimensión de control de costes

Primero, aprovecha el descuento cached_input de Grok 4.3; en escenarios con indicaciones del sistema largas y fijas, el precio unitario real puede reducirse a $0.31 por millón de tokens. Segundo, dirige todas las tareas que no sean en tiempo real a Batch para ahorrar otro 20-50%. Tercero, enruta las tareas simples a Grok 4 Fast y reserva el modelo 4.3 solo para tareas de razonamiento; el coste total puede reducirse entre un 60% y un 70%.

🎯 Resumen para la implementación local: Recomendamos a los equipos chinos la siguiente ruta para Grok 4.3: Servicio proxy de API (APIYI apiyi.com) + SDK de OpenAI + enrutamiento híbrido de modelos + prioridad a la API Batch. Esta combinación equilibra la estabilidad y el control de costes, y ya ha sido validada en múltiples productos SaaS nacionales.

Resumen: El verdadero significado de la API de Grok 4.3

Volviendo a la conclusión inicial, Grok 4.3 no es una actualización de "un modelo más inteligente", sino una actualización que "redefine la curva de costes de los modelos de razonamiento". Tres cifras lo dicen todo: 1,25 $ por entrada, 1M de ventana de contexto y una velocidad de salida de 207 tokens/segundo; esta combinación es única en la categoría de modelos de razonamiento.

Los mejores casos de uso para la API de Grok 4.3 se centran en: resumen y análisis de contextos largos, procesamiento estructurado de múltiples flujos de vídeo, flujos de trabajo de colaboración multi-agente y razonamiento de alto rendimiento sensible a la latencia en tiempo real. No es un sustituto directo de Claude Opus 4.7, pero en muchas tareas que antes requerían Opus 4.7, Grok 4.3 ofrece una nueva opción "12 veces más barata y con un contexto 5 veces mayor".

Para los desarrolladores, la ruta de acceso a la API de Grok 4.3 ya es muy madura. Recomendamos realizar la integración y las pruebas directamente a través de la plataforma APIYI (apiyi.com). El base_url es compatible con el SDK de OpenAI y solo hay que utilizar grok-4.3 en el campo del modelo, sin necesidad de realizar cambios en el código. En la misma plataforma, también puedes invocar Claude Opus 4.7, GPT-5 y Gemini 3 Pro, lo que facilita enormemente las comparaciones horizontales y la orquestación híbrida.

La verdadera prueba para Grok 4.3 llegará en la segunda mitad de 2026: ¿seguirán OpenAI y Anthropic con una bajada de precios?, ¿podrá xAI compensar la falta de memoria persistente?, ¿podrá el modo "16-Agent Heavy" salir del muro de las suscripciones? Hasta entonces, es una de las API de razonamiento con mejor relación calidad-precio del mercado actual, y merece que cada desarrollador de aplicaciones de agentes la pruebe con sus propios datos reales.

Referencias

-

Documentación oficial de modelos de xAI: ID del modelo, precios y especificaciones de capacidad

- Enlace:

docs.x.ai/developers/models - Descripción: Incluye los parámetros completos de la API de Grok 4.3 y las reglas de facturación.

- Enlace:

-

Noticias oficiales de xAI: Anuncios de lanzamientos y actualizaciones de productos

- Enlace:

x.ai/news - Descripción: Presentación y funciones de Grok 4.3.

- Enlace:

-

Tabla de precios en tiempo real de OpenRouter: Comparativa de múltiples modelos y precios históricos

- Enlace:

openrouter.ai/x-ai/grok-4.3 - Descripción: Precios en tiempo real y monitorización de latencia.

- Enlace:

-

Ranking de inteligencia de Artificial Analysis: Índice de inteligencia integral y datos de velocidad

- Enlace:

artificialanalysis.ai/models/grok-4-3 - Descripción: Comparativa de dimensiones como el índice AA, velocidad y ventana de contexto.

- Enlace:

-

Documentación de integración de APIYI: Tutorial completo para acceder a Grok 4.3 mediante un servicio proxy de API

- Enlace:

help.apiyi.com - Descripción: Incluye ejemplos de SDK para Python/Node.js y explicaciones de facturación.

- Enlace:

Autor: Equipo de APIYI — Especialistas en servicios proxy de API para Modelos de Lenguaje Grande, ayudando a los desarrolladores a invocar modelos líderes como Grok 4.3, Claude Opus 4.7 y GPT-5 con un solo clic. Visita APIYI en apiyi.com para obtener saldo de prueba gratuito.