Le 30 avril 2026, xAI a finalisé le déploiement complet de l'API Grok 4.3. Avec une réduction directe du prix d'entrée d'environ 40 %, une fenêtre de contexte étendue à 1 million de jetons et, pour la première fois, une prise en charge native des entrées vidéo, ces trois avancées redéfinissent quasiment le modèle de coût des applications d'agents intelligents. Cet article propose une analyse complète des mises à jour majeures, des détails tarifaires, des performances et des méthodes d'intégration de l'API Grok 4.3.

Valeur ajoutée : Comprenez en 3 minutes toutes les informations clés sur l'API Grok 4.3, son importance pour l'industrie et le chemin le plus rapide pour y accéder en Chine via un service proxy API.

Aperçu des informations clés de l'API Grok 4.3

Cette mise à jour de xAI mise sur une combinaison gagnante : « baisse de prix + augmentation de capacité + multimodalité ». Seulement quatre mois après la génération précédente, Grok 4.20, xAI a utilisé une itération de version majeure pour abaisser globalement la courbe de coût des modèles de raisonnement. Commençons par un tableau récapitulatif des paramètres clés, que nous détaillerons par la suite.

Avant d'aborder le tableau, il est utile de clarifier le positionnement de Grok 4.3 dans la gamme de produits xAI. Actuellement, xAI propose trois niveaux de modèles API : Grok 4 Fast, axé sur le « rapport qualité-prix optimal », Grok 4.3, le « fleuron du raisonnement », et Grok Code Fast 1, dédié aux tâches de codage. Grok 4.3 est le modèle recommandé par xAI pour tous les utilisateurs d'API, décrit dans la documentation comme le modèle « le plus intelligent et le plus rapide ».

Paramètres clés de l'API Grok 4.3

| Élément | Détails |

|---|---|

| Date de sortie officielle | 30 avril 2026 (Lancement complet de l'API) |

| Sortie Beta | 17 avril 2026 (Utilisateurs SuperGrok Heavy) |

| ID du modèle | grok-4.3 |

| Fenêtre de contexte | 1 000 000 jetons (1M) |

| Vitesse de sortie | Env. 207 jetons/seconde |

| Prix d'entrée | 1,25 $ / million de jetons |

| Prix de sortie | 2,50 $ / million de jetons |

| Modalités supportées | Texte, images (≤ 20 Mo par image), vidéo (nouveau) |

| Mode de raisonnement | Activé par défaut (Reasoning Always-On) |

| Date limite de connaissances | Novembre 2024 |

| Remise Batch API | 50–80 % du prix standard (traitement sous 24h) |

| Indice d'intelligence AA | 53 (bien au-dessus de la médiane de 34 pour ce prix) |

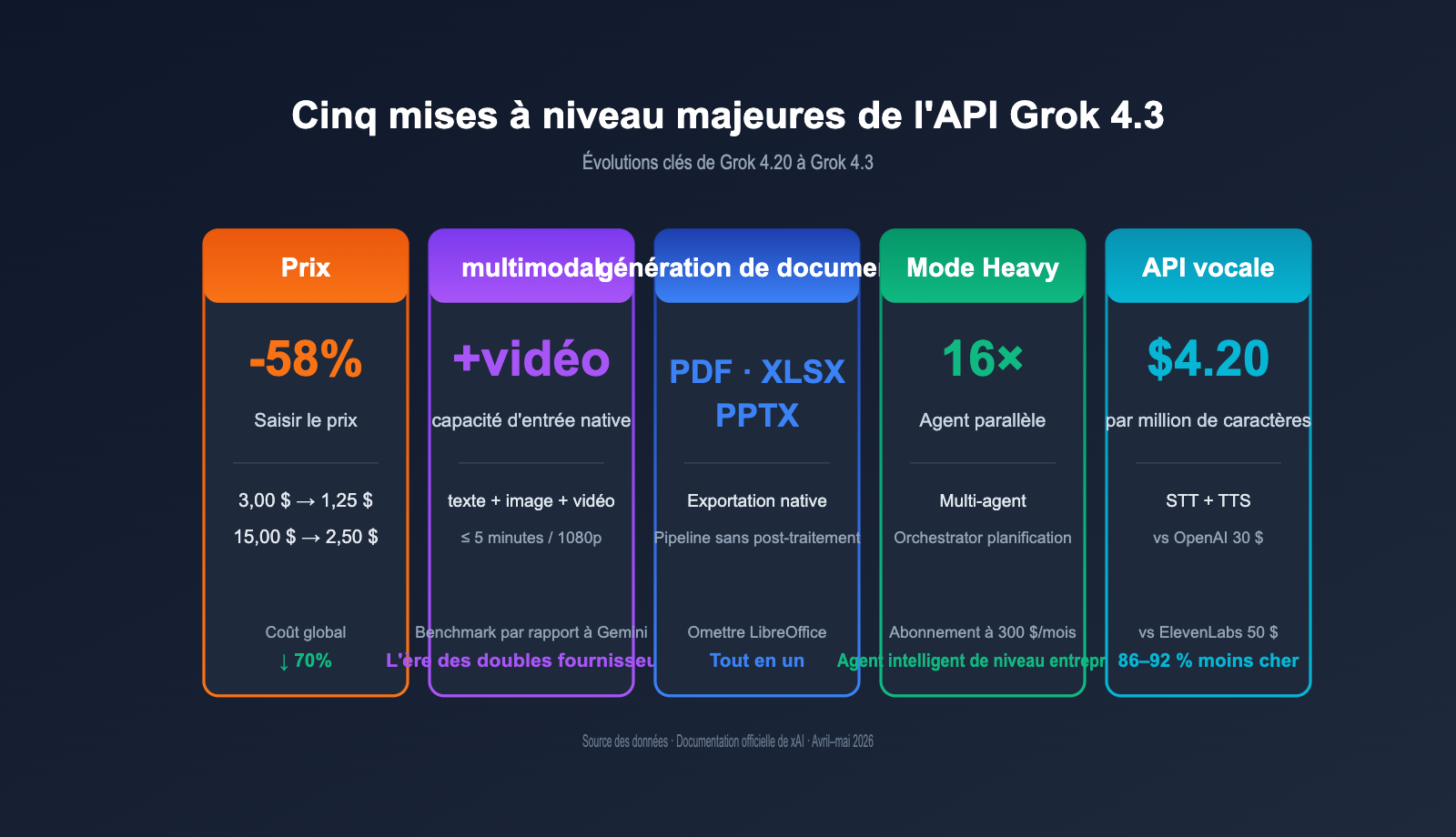

Cinq mises à jour majeures de l'API Grok 4.3

La mise à jour de xAI ne se limite pas aux prix. Nous avons synthétisé toutes les nouveautés en cinq dimensions pour une compréhension rapide.

| Axe d'amélioration | Ère 4.20 | État actuel Grok 4.3 | Impact |

|---|---|---|---|

| Prix | 3,00 $ / 15,00 $ | 1,25 $ / 2,50 $ | Baisse du prix d'entrée ~58 % |

| Multimodalité | Texte + Image | Texte + Image + Vidéo | Les agents peuvent analyser des vidéos |

| Génération de documents | Sortie texte uniquement | Sortie native PDF/XLSX/PPTX | Évite le pipeline de post-traitement |

| Système Heavy | Agent unique | Orchestration parallèle de 16 agents | Tâches complexes traitées en une fois |

| API Vocale | Aucune API dédiée | API STT/TTS 4,20 $/million de caractères | 86–92 % moins cher qu'OpenAI |

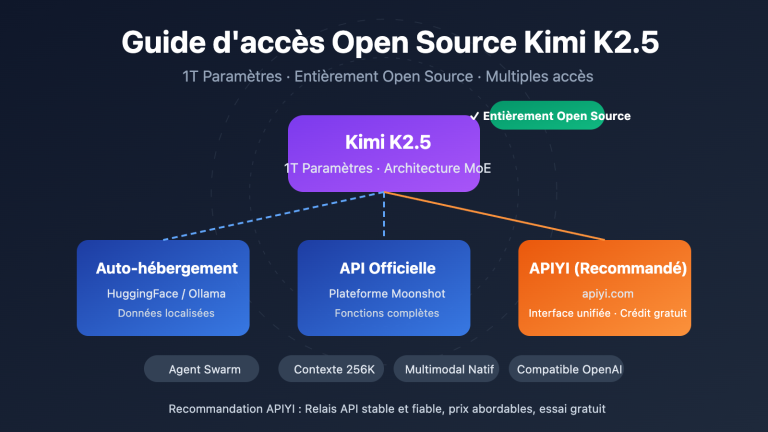

🎯 Conseil pour un essai rapide : Pour les développeurs en Chine, l'utilisation du service proxy API APIYI (apiyi.com) est l'un des moyens les plus fiables pour accéder à l'API Grok 4.3. Il suffit de définir l'URL de base sur

https://vip.apiyi.com/v1et le champ du modèle surgrok-4.3. La vitesse de réponse est identique à l'officielle, avec une compatibilité totale avec le SDK OpenAI.

Analyse approfondie de la tarification de l'API Grok 4.3

La tarification est l'aspect qui a suscité le plus d'intérêt dans cette version. Examinons la facture en détail à travers quatre niveaux : prix unitaire, traitement par lots (Batch), appels d'outils et abonnement.

Tarification standard de l'API Grok 4.3

La grille tarifaire officielle de xAI précise les taux au niveau des jetons (tokens). Les données ci-dessous proviennent de la documentation officielle de xAI et des tarifs en temps réel d'OpenRouter.

| Élément | Prix unitaire | Remarques |

|---|---|---|

| Jetons d'entrée | 1,25 $ / million | Inclut les jetons textuels d'images et de trames vidéo |

| Jetons de sortie | 2,50 $ / million | Inclut les jetons de sortie des étapes de raisonnement |

| Jetons d'entrée mis en cache | 0,31 $ / million | Facturé lors d'une correspondance dans le cache |

| Entrée image | Facturé par jeton | 20 Mio max par image |

| Entrée vidéo | Facturé par jeton d'échantillonnage | Nouvelle fonctionnalité |

Si l'on convertit selon le ratio courant de 3:1 entre l'entrée et la sortie, le prix mixte de l'API Grok 4.3 est d'environ 1,56 $ par million de jetons. Comparé aux séries GPT-5 et Claude Opus 4.7, ce tarif se situe dans la tranche la plus compétitive pour les modèles de raisonnement.

Prix des appels d'outils côté serveur pour Grok 4.3

L'API Grok 4.3 intègre des outils côté serveur. Ces trois types d'outils sont facturés au nombre d'appels, indépendamment des frais liés aux jetons.

| Type d'outil | Prix | Scénarios d'utilisation |

|---|---|---|

| Recherche Web | 5 $ / 1k appels | Recherche en temps réel sur le Web |

| Recherche X (Twitter) | 5 $ / 1k appels | Recherche dans la timeline de la plateforme X |

| Exécution de code | 5 $ / 1k appels | Exécution de code en environnement isolé (sandbox) |

💡 Conseil d'optimisation des coûts : Pour les scénarios à concurrence moyenne, nous recommandons de combiner Grok 4.3 et Grok 4 Fast. Acheminez les requêtes simples vers 4 Fast (dont le coût est seulement 1/4 de celui du 4.3) et confiez les tâches de raisonnement complexes au 4.3. La plateforme APIYI (apiyi.com) permet de basculer entre les deux modèles sous la même

base_url, sans avoir à réécrire la logique d'authentification.

Abonnement SuperGrok Heavy pour Grok 4.3

En plus de la facturation à l'usage (API), xAI a lancé l'abonnement SuperGrok Heavy pour les utilisateurs intensifs.

| Niveau d'abonnement | Frais mensuels | Contenu inclus |

|---|---|---|

| Grok Free | 0 $ | Utilisation limitée de Grok 4.3 |

| SuperGrok | 30 $ / mois | Quota plus élevé + entrée vidéo |

| SuperGrok Heavy | 300 $ / mois | Mode 16-Agent Heavy + priorité + accès anticipé |

Les niveaux d'abonnement se positionnent face à ChatGPT Pro (200 $/mois) et Claude Max (200 $/mois). Le prix est légèrement plus élevé, mais le mode 16-Agent Heavy est actuellement le produit le plus proche d'un « cluster d'agents intelligents de niveau entreprise » parmi les modèles publics.

Estimation des coûts réels de l'API Grok 4.3

La question que se posent de nombreuses équipes est : « Combien vais-je réellement économiser en passant à Grok 4.3 ? ». Voici une estimation basée sur trois volumes d'activité typiques, avec un ratio entrée/sortie de 3:1.

| Volume d'activité | Jetons mensuels | Coût mensuel Grok 4.3 | Coût mensuel Claude Opus 4.7 | Économies |

|---|---|---|---|---|

| Développeur individuel | 10M | ~15 $ | ~185 $ | -92 % |

| SaaS moyen | 500M | ~780 $ | ~9 200 $ | -92 % |

| Service client entreprise | 5 000M | ~7 800 $ | ~92 000 $ | -92 % |

Notez que lorsque le taux de réussite du prompt caching de Claude Opus 4.7 est élevé, le coût réel peut diminuer de 30 à 50 %. Grok 4.3 prend également en charge la réduction sur les entrées mises en cache (0,31 $ / million de jetons). Le tableau présente donc des « prix bruts sans cache » ; l'écart réel sera légèrement inférieur, mais restera de l'ordre de 6 à 8 fois moins cher.

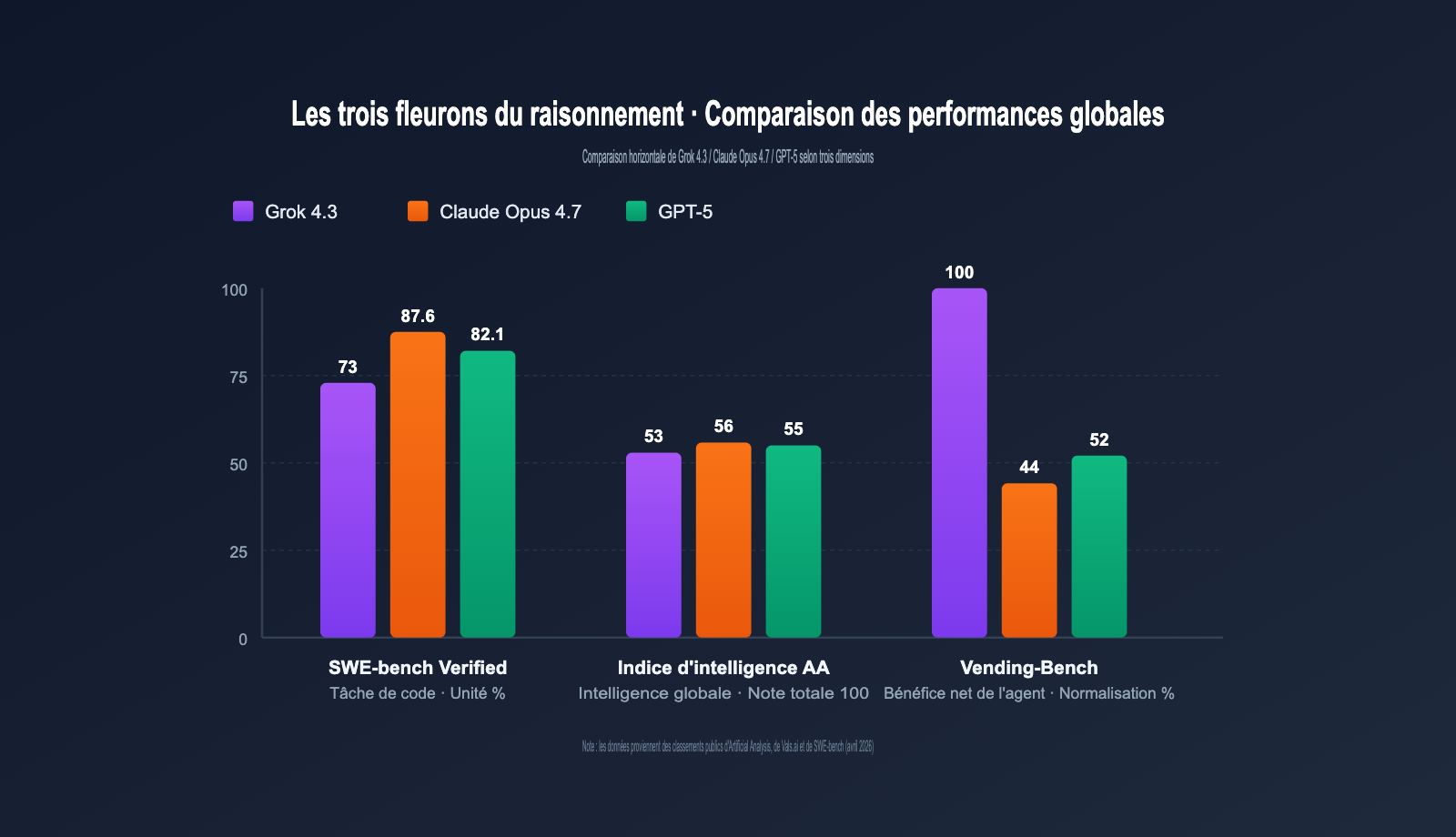

Comparaison des performances de l'API Grok 4.3

Le prix ne fait pas tout. Nous utilisons les données publiques des classements récents pour évaluer la position réelle de Grok 4.3 sur les tâches de raisonnement, de codage et d'agentivité.

Comparaison globale de Grok 4.3 avec des modèles équivalents

Le tableau ci-dessous résume les données de référence disponibles publiquement avant fin avril 2026. Les prix correspondent aux tarifs API officiels.

| Modèle | Indice AA | SWE-bench Verified | Vitesse de sortie | Prix entrée | Contexte |

|---|---|---|---|---|---|

| Grok 4.3 | 53 | ~73 % | 207 tps | 1,25 $ | 1M |

| Claude Opus 4.7 | 56 | 87,6 % | 78 tps | 15,00 $ | 200k |

| GPT-5 (Raisonnement) | 55 | 82,1 % | 95 tps | 5,00 $ | 400k |

| Gemini 3 Pro | 54 | 79,4 % | 130 tps | 3,50 $ | 2M |

| Grok 4 Fast | 41 | 58,2 % | 235 tps | 0,30 $ | 256k |

Plusieurs conclusions s'imposent :

- Le codage n'est pas le point fort de Grok 4.3 : Il accuse un retard d'environ 14 points de pourcentage sur Claude Opus 4.7 au SWE-bench.

- L'agentivité est le terrain de prédilection de Grok 4.3 : Sur les tâches de simulation longue durée comme Vending-Bench, Grok 4.3 surpasse Opus 4.7 d'environ 1,26 fois.

- Un combo débit + prix imbattable : Avec 207 tps et un prix d'entrée à 1,25 $, il est unique dans la catégorie des modèles de raisonnement.

Performances de Grok 4.3 par type de tâche

Voici les résultats observés en conditions réelles selon la granularité des tâches :

| Type de tâche | Performance Grok 4.3 | Scénarios recommandés |

|---|---|---|

| Résumé longue fenêtre | ⭐⭐⭐⭐⭐ | Fenêtre 1M + haut débit, idéal pour des livres entiers |

| Flux de travail agentique | ⭐⭐⭐⭐⭐ | Performance de haut niveau sur les tâches longues |

| Génération et refactorisation | ⭐⭐⭐⭐ | Inférieur à Opus 4.7, mais l'avantage prix compense |

| Raisonnement mathématique | ⭐⭐⭐⭐ | Proche de GPT-5 sur la série AIME |

| Compréhension multimodale | ⭐⭐⭐⭐ | L'entrée vidéo est une nouveauté, précision correcte |

| Mémoire à long terme | ⭐⭐ | Pas encore de mémoire persistante, nécessite une couche externe |

🎯 Conseil de sélection : Le choix du modèle dépend principalement de votre cas d'usage et de vos exigences de qualité. Nous vous recommandons d'effectuer des tests réels via la plateforme APIYI (apiyi.com), qui prend en charge l'invocation unifiée de modèles de raisonnement majeurs comme Grok 4.3, Claude Opus 4.7 et GPT-5, facilitant ainsi les comparaisons transversales sur vos données métier.

Analyse détaillée des trois nouvelles capacités de l'API Grok 4.3

Au-delà de la tarification, Grok 4.3 apporte trois nouvelles capacités majeures qui n'existaient absolument pas à l'ère de Grok 4.20.

Capacité d'entrée vidéo de Grok 4.3

Grok 4.3 est le premier modèle d'API de xAI à prendre en charge nativement l'entrée vidéo. Il ne s'agit pas d'une "transcription suivie d'un traitement textuel", mais d'un traitement direct des images vidéo via un encodeur visuel.

Paramètres vidéo pris en charge :

| Paramètre | Limite |

|---|---|

| Durée par vidéo | ≤ 5 minutes (recommandé par l'officiel) |

| Résolution vidéo | ≤ 1080p |

| Échantillonnage de fréquence d'images | Extraction automatique à 1–4 fps |

| Format de fichier | mp4, mov, webm |

| Méthode de facturation | Facturation basée sur les jetons d'image après extraction |

Dans les scénarios d'application réels, deux directions se distinguent : l'extraction d'événements clés dans les vidéos de surveillance/sécurité, et le résumé structuré de vidéos de formation ou de réunions. Pour ce dernier, combiné à une fenêtre de contexte de 1M, il est possible de "fournir un cours complet de 4 heures et d'obtenir des notes de chapitre complètes".

Le tableau ci-dessous résume plusieurs types d'applications typiques pour l'entrée vidéo et les points techniques correspondants.

| Scénario d'application | Points techniques clés | Difficulté de mise en œuvre |

|---|---|---|

| Détection d'événements vidéo de surveillance | Définir une invite système pour surveiller les événements, fps réglé sur 2 | Faible |

| Procès-verbaux de réunion | Combiner avec STT pour extraire la voix, les images vidéo servent à identifier le changement d'intervenant | Moyenne |

| Notes de chapitre de vidéos pédagogiques | Découper les longues vidéos en segments de 5 minutes, puis faire une synthèse | Faible |

| Documentation de démonstration de produit | Extraire des images pour identifier les étapes de l'interface utilisateur, générer des tutoriels illustrés | Moyenne |

| Modération de contenu de vidéos courtes | Vidéo unique ≤ 60 secondes, appels simultanés par lots | Faible |

Capacité de génération de documents de Grok 4.3

La fonctionnalité la plus sous-estimée de cette nouvelle version est la génération de documents. Grok 4.3 peut générer directement dans la conversation des fichiers PDF, Excel (XLSX) et PowerPoint (PPTX) téléchargeables, dont le contenu est rempli en temps réel par le modèle.

# Exemple minimal : demander à Grok 4.3 de générer directement un fichier Excel de rapport financier

from openai import OpenAI

client = OpenAI(

api_key="VOTRE_CLE_API",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="grok-4.3",

messages=[{

"role": "user",

"content": "Génère-moi un fichier XLSX de comparaison des rapports financiers du secteur SaaS pour le T4 2025, incluant les colonnes revenus, taux de croissance et marge brute"

}],

extra_body={"output_format": "xlsx"}

)

# La réponse contient l'URL du fichier téléchargeable

print(response.choices[0].message.attachments[0].url)

Voir le code complet de génération de documents (incluant la commutation entre les formats PDF/PPTX)

from openai import OpenAI

import requests

import os

client = OpenAI(

api_key="VOTRE_CLE_API",

base_url="https://vip.apiyi.com/v1"

)

OUTPUT_FORMATS = ["pdf", "xlsx", "pptx"]

def generate_doc(prompt: str, fmt: str, save_dir: str = "./outputs"):

"""Appeler Grok 4.3 pour générer un document au format spécifié et l'enregistrer localement"""

if fmt not in OUTPUT_FORMATS:

raise ValueError(f"le format doit être l'un des suivants : {OUTPUT_FORMATS}")

response = client.chat.completions.create(

model="grok-4.3",

messages=[{"role": "user", "content": prompt}],

extra_body={"output_format": fmt}

)

attachment = response.choices[0].message.attachments[0]

file_url = attachment.url

file_name = attachment.filename or f"output.{fmt}"

os.makedirs(save_dir, exist_ok=True)

save_path = os.path.join(save_dir, file_name)

file_resp = requests.get(file_url, timeout=60)

file_resp.raise_for_status()

with open(save_path, "wb") as f:

f.write(file_resp.content)

return save_path

if __name__ == "__main__":

pdf_path = generate_doc(

"Rédiger un rapport sur les tendances du secteur des grands modèles de langage en 2026, 5 pages",

"pdf"

)

print(f"PDF enregistré : {pdf_path}")

ppt_path = generate_doc(

"Créer une présentation PPT de 10 pages pour le lancement du produit API Grok 4.3",

"pptx"

)

print(f"PPTX enregistré : {ppt_path}")

💡 Conseil d'intégration : La fonctionnalité de génération de documents peut être transmise directement via le service proxy API APIYI (apiyi.com), sans adaptation de paramètres supplémentaires. Les SDK Python/Node.js peuvent être utilisés tels quels.

API vocale lancée simultanément avec Grok 4.3

Ce qui est souvent négligé, c'est que le jour même du lancement de Grok 4.3, xAI a également introduit des API STT (parole vers texte) et TTS (texte vers parole) indépendantes, facturées séparément du modèle principal.

| API vocale | Prix xAI | Prix équivalent OpenAI | Différence de prix |

|---|---|---|---|

| STT (équivalent Whisper) | 4,20 $ / million de caractères | ~30 $ / million de caractères | 86 % moins cher |

| TTS (haute expressivité) | 4,20 $ / million de caractères | ~50 $ / million de caractères (ElevenLabs) | 92 % moins cher |

Cette stratégie tarifaire signifie que xAI a réduit le prix plancher de l'IA vocale à 1/10ème du marché. Pour les scénarios à fort volume audio tels que les robots de service client, la génération de podcasts et les assistants vocaux embarqués, la courbe des prix est totalement redéfinie.

Analyse de l'impact de l'API Grok 4.3 sur les développeurs

Impact direct sur les développeurs d'applications IA

| Dimension d'impact | Changement spécifique | Conseil de réponse |

|---|---|---|

| Structure des coûts | Coûts des applications de raisonnement ↓ 40–60 % | Réévaluer la part d'utilisation des modèles avancés |

| Choix d'architecture | La fenêtre de contexte de 1M réduit la nécessité du RAG | À court terme, utiliser le contexte long pour remplacer certaines recherches |

| Produits multimodaux | L'entrée vidéo abaisse la barrière de l'IA visuelle | Les applications vidéo de surveillance/éducation/santé méritent d'être lancées |

| Produits d'agents | 16-Agent Heavy augmente le plafond des tâches complexes | L'architecture multi-agents entre dans une phase pratique |

| Produits vocaux | Chute des coûts TTS/STT | Le front-end vocal peut être entièrement automatisé par l'IA |

Impact à moyen et long terme sur l'industrie de l'IA

Premièrement, la guerre des prix des modèles de raisonnement est officiellement lancée. Grok 4.3 réduit le prix de la combinaison fenêtre de contexte 1M + raisonnement à environ 1/12ème de celui de Claude Opus 4.7. Ce n'est pas un test mineur, mais une rupture totale avec le consensus industriel selon lequel "les modèles de raisonnement doivent être coûteux". Cela forcera OpenAI et Anthropic à réagir sur les prix au second semestre 2026, soit en s'alignant, soit en se différenciant sur d'autres dimensions (meilleur codage, mémoire plus longue).

Deuxièmement, l'"entrée vidéo native" passe de la démonstration à la production. Auparavant, Gemini était la seule API commerciale à proposer une entrée vidéo à grande échelle. Avec l'arrivée de Grok 4.3, le multimodal vidéo entre dans une véritable ère de double fournisseur. Cela signifie que les produits d'IA vidéo qui n'osaient pas se lancer par peur du "risque lié au fournisseur unique" peuvent désormais être planifiés.

Troisièmement, le multi-agents entre dans l'ère de l'"abonnement". L'architecture 16-Agent de SuperGrok Heavy est proposée sous forme d'abonnement. Si ce modèle commercial fonctionne, il ouvrira la voie à des formes de produits facturées au "nombre d'agents". Auparavant, le multi-agents était principalement mis en œuvre au niveau de l'application par des frameworks open source (LangGraph, AutoGen, CrewAI). Aujourd'hui, xAI abaisse cette couche directement au niveau de la plateforme de modèle, ce qui signifie que le paradigme "Agent-as-a-Service" commence à s'établir.

Quatrièmement, l'absence de mémoire persistante chez xAI est une véritable lacune. ChatGPT et Claude prennent en charge la mémoire inter-sessions depuis plus d'un an, ce que Grok 4.3 n'a pas encore comblé, ce qui constitue un désavantage significatif pour les produits de type "assistant personnel". La solution à court terme consiste à construire une couche de mémoire au niveau de l'application (base de données vectorielle + recherche RAG).

Cinquièmement, la vitesse de raisonnement devient une nouvelle dimension de compétition. La vitesse de sortie de 207 jetons/seconde est la plus rapide du secteur pour un modèle de raisonnement, permettant aux tâches qui nécessitaient auparavant un traitement par lots de passer à une interaction en temps réel, comme la revue de code, les questions-réponses sur de longs documents, etc. La combinaison de la vitesse et du bas prix favorise une nouvelle catégorie d'applications : les microservices de raisonnement à haute fréquence et faible latence.

Matrice de décision pour l'API Grok 4.3

Tous les scénarios ne justifient pas une migration vers Grok 4.3. Nous avons compilé les retours de nos clients sur les deux dernières semaines dans une matrice de décision pour vous aider dans votre choix.

Scénarios fortement recommandés pour l'API Grok 4.3

| Scénario | Raison de la recommandation |

|---|---|

| Résumé et analyse de documents longs | Contexte de 1M + 207 tps en sortie, traite un livre entier ou un rapport de 200 pages sans effort |

| Agent de service client / gestion de plaintes | Raisonnement activé par défaut, à un coût assez bas pour offrir "un agent par personne" |

| Compréhension de contenu vidéo | Seul modèle avec Gemini à proposer une entrée vidéo native, à un prix plus compétitif |

| Annotation de données hors ligne à grande échelle | Coût proche de 0,65 $ / million de tokens avec l'API Batch, réduction drastique des coûts |

| Compte-rendu de réunion multimodal | Fusion vidéo + audio + texte, génération directe de documents PDF/PPTX |

| Tâches complexes d'agents | Les benchmarks Vending-Bench confirment que c'est le point fort de Grok 4.3 |

Scénarios non recommandés pour l'API Grok 4.3

| Scénario | Raison de la non-recommandation |

|---|---|

| Agent de codage de haut niveau | Le score SWE-bench reste environ 14 points derrière Claude Opus 4.7 |

| Assistant personnel (mémoire forte) | Absence de mémoire persistante, nécessite une couche de mémoire externe |

| Interaction à très faible latence | 207 tps est rapide, mais Grok 4 Fast (235 tps) est plus adapté et moins cher |

| Sensibilité extrême au chinois natif | Performances correctes, mais légèrement en retrait par rapport à Claude / GPT-5 |

| Rédaction juridique / médicale stricte | Connaissances limitées à novembre 2024, moins récent que Claude Opus 4.7 |

Conseils de répartition : Grok 4.3 vs Grok 4 Fast

Beaucoup d'équipes nous posent une question pratique : faut-il utiliser Grok 4.3 ou Grok 4 Fast dans un même projet ? Notre conseil est de segmenter selon la complexité de la tâche.

| Type de tâche | Modèle recommandé | Raison |

|---|---|---|

| Réponses FAQ simples | Grok 4 Fast | Prix unitaire 4x inférieur, vitesse supérieure |

| Classification de modération | Grok 4 Fast | Pas besoin de raisonnement, Fast suffit largement |

| Génération de plans complexes | Grok 4.3 | Le raisonnement est indispensable, 4.3 est le choix par défaut |

| Appel d'outils multi-étapes | Grok 4.3 | La chaîne d'outils côté serveur nécessite le support du raisonnement |

| Traitement de documents longs (>200k) | Grok 4.3 | Le contexte de Fast est limité à 256k, 4.3 offre 1M |

💡 Conseil d'architecture : Via le service proxy API APIYI (apiyi.com), vous pouvez router automatiquement les requêtes vers Grok 4 Fast ou Grok 4.3 en fonction de la longueur des tokens ou des tags de tâche. Avec le même SDK et la même clé API, il suffit de changer un champ pour basculer de modèle, réduisant ainsi considérablement les coûts d'ingénierie.

Tutoriel complet d'accès à l'API Grok 4.3

L'accès aux interfaces officielles de xAI depuis la Chine se heurte à des obstacles réseau et de paiement. Voici le chemin d'accès le plus fiable.

Étapes d'accès à l'API Grok 4.3 (compatible SDK OpenAI)

# Exemple complet d'accès, utilisant le SDK officiel OpenAI

from openai import OpenAI

client = OpenAI(

api_key="Votre clé API APIYI",

base_url="https://vip.apiyi.com/v1" # base_url du service proxy APIYI

)

response = client.chat.completions.create(

model="grok-4.3",

messages=[

{"role": "system", "content": "Vous êtes un analyste produit IA expérimenté"},

{"role": "user", "content": "Analysez trois impacts à long terme de Grok 4.3 sur l'industrie des agents intelligents"}

],

temperature=0.7,

max_tokens=2048

)

print(response.choices[0].message.content)

Voir le code complet pour le streaming et l’entrée d’image

from openai import OpenAI

import base64

client = OpenAI(

api_key="Votre clé API APIYI",

base_url="https://vip.apiyi.com/v1"

)

# 1. Sortie en streaming

def stream_chat(prompt: str):

stream = client.chat.completions.create(

model="grok-4.3",

messages=[{"role": "user", "content": prompt}],

stream=True

)

for chunk in stream:

content = chunk.choices[0].delta.content

if content:

print(content, end="", flush=True)

print()

# 2. Entrée d'image

def vision_chat(image_path: str, question: str):

with open(image_path, "rb") as f:

b64 = base64.b64encode(f.read()).decode()

response = client.chat.completions.create(

model="grok-4.3",

messages=[{

"role": "user",

"content": [

{"type": "text", "text": question},

{"type": "image_url", "image_url": {

"url": f"data:image/png;base64,{b64}"

}}

]

}]

)

return response.choices[0].message.content

if __name__ == "__main__":

stream_chat("Expliquez en trois paragraphes l'impact d'une fenêtre de contexte de 1M sur l'architecture RAG")

answer = vision_chat(

"./screenshot.png",

"Où se situe Grok 4.3 dans ce schéma d'architecture ?"

)

print(answer)

Utilisation pratique des outils (Tool Use) avec l'API Grok 4.3

En plus du protocole compatible OpenAI, Grok 4.3 supporte nativement trois types d'outils côté serveur. Il suffit de les déclarer via le champ tools, et le modèle décidera lui-même quand et lequel appeler, sans orchestration supplémentaire au niveau de l'application.

# Exemple d'appel d'outils côté serveur : recherche web + exécution de code en bac à sable

from openai import OpenAI

client = OpenAI(

api_key="Votre clé API APIYI",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="grok-4.3",

messages=[{

"role": "user",

"content": "Vérifiez la tarification des tokens de Grok 4.3 aujourd'hui et calculez le coût total pour 1 million d'appels avec Python"

}],

tools=[

{"type": "web_search"}, # Recherche web

{"type": "code_execution"} # Exécution de code

]

)

print(response.choices[0].message.content)

Le modèle enchaîne les appels d'outils selon ses besoins (par exemple, web_search pour récupérer les prix, puis code_execution pour le calcul mathématique) pour fournir une réponse structurée. Cette capacité de "chaîne d'outils autonome" nécessitait une orchestration manuelle à l'époque de Grok 4.20, alors que Grok 4.3 le réalise en une seule requête.

Meilleures pratiques pour migrer de l'API OpenAI vers Grok 4.3

De nombreuses équipes ayant construit leurs systèmes sur l'interface OpenAI n'ont que quelques points clés à retenir pour migrer vers Grok 4.3.

| Élément de migration | Ancienne écriture OpenAI | Écriture recommandée Grok 4.3 |

|---|---|---|

| base_url | https://api.openai.com/v1 |

https://vip.apiyi.com/v1 |

| Champ modèle | gpt-5 |

grok-4.3 |

| Configuration raisonnement | reasoning_effort="high" |

Activé par défaut, aucune config requise |

| Déclaration d'outils | tools=[{"type": "function", ...}] |

Idem, outils serveur via types intégrés comme web_search |

| Sortie en streaming | stream=True |

Entièrement compatible |

| Mode JSON | response_format={"type": "json_object"} |

Entièrement compatible |

Pour les projets réels, nous recommandons une approche en trois étapes : premièrement, modifier uniquement base_url et model dans l'environnement de test pour valider les échanges de base ; deuxièmement, router les requêtes de raisonnement à haute valeur ajoutée vers Grok 4.3 tout en gardant les dialogues simples sur l'ancien modèle pour effectuer un test A/B ; troisièmement, décider d'une bascule totale ou d'une architecture hybride selon les données réelles.

🎯 Conseil d'architecture hybride : Sur la plateforme APIYI (apiyi.com), tous les modèles majeurs (Grok 4.3, Claude Opus 4.7, GPT-5, Gemini 3 Pro) partagent la même

base_urlet la même clé API. Il suffit de changer le champmodeldans votre code pour basculer, sans travail d'intégration supplémentaire.

Précautions pour l'accès à l'API Grok 4.3

| Point d'attention | Explication |

|---|---|

| Champ modèle | Utilisez strictement grok-4.3 (pas grok4.3 ou Grok-4.3) |

| base_url | Recommandé : https://vip.apiyi.com/v1 pour une stabilité et une latence réduite |

| Champ Raisonnement | Activé par défaut, aucun paramètre supplémentaire nécessaire |

| Contexte ultra-long | Input recommandé ≤ 800k tokens pour laisser de la marge au raisonnement |

| Entrée vidéo | Transmise via le champ video_url, actuellement recommandée pour moins de 5 minutes |

🎯 Conseil d'utilisation : Nous vous suggérons de demander une clé de test sur APIYI (apiyi.com) pour valider le flux minimal avant de passer aux quotas de production. La plateforme supporte le prépaiement et la facturation à l'usage, sans nécessiter de carte bancaire étrangère, ce qui est idéal pour les processus financiers des équipes locales.

FAQ sur l'API Grok 4.3

Q1 : L’API Grok 4.3 est-elle vraiment moins chère que Grok 4.20, et quelle est la réduction ?

Oui, et la baisse est significative. Alors que le tarif de Grok 4.20 était d'environ 3,00 $ / 15,00 $ (entrée/sortie), Grok 4.3 est passé à 1,25 $ / 2,50 $. Cela représente une réduction d'environ 58 % pour les entrées et 83 % pour les sorties. Avec un ratio entrée/sortie de 3:1, la réduction globale des coûts est d'environ 70 %. C'est un signal clair de la part de xAI pour bousculer le marché des modèles de raisonnement.

Q2 : La fenêtre de contexte de 1M de l’API Grok 4.3 est-elle disponible en Chine ?

Oui. La fenêtre de contexte de 1M est une capacité intrinsèque du modèle et n'est soumise à aucune restriction géographique. Les développeurs chinois peuvent y accéder via des services proxy API comme APIYI (apiyi.com). Attention toutefois : plus le nombre de jetons par requête est élevé, plus la latence augmente (elle peut dépasser 30 secondes). Pour les contextes très longs, nous recommandons un traitement asynchrone ou une planification par segments en environnement de production.

Q3 : Comment choisir entre Grok 4.3 et Claude Opus 4.7 ?

Le choix dépend du type de tâche : si votre cœur de métier est la génération de code ou les agents de codage à longue chaîne, choisissez Claude Opus 4.7, qui conserve une avance d'environ 14 points sur SWE-bench. Si votre priorité est le résumé de longs contextes, les agents de type Vending-Bench ou la compréhension vidéo multimodale, privilégiez Grok 4.3 : il est 12 fois moins cher et plus adapté à ces tâches. L'architecture hybride est la norme en 2026 : utilisez un service proxy API unifié pour orchestrer les deux modèles.

Q4 : Qu’est-ce que le système 16-Agent Heavy de Grok 4.3 ? Peut-on l’appeler via l’API ?

Le système 16-Agent Heavy est un système de planification parallèle superposé au modèle principal par xAI. Un orchestrateur coordonne jusqu'à 16 agents travailleurs pour traiter des sous-tâches en parallèle, ce qui est idéal pour la planification complexe et les simulations à long terme. Actuellement, le mode Heavy est réservé aux abonnés SuperGrok Heavy (300 $/mois). L'interface API standard n'expose pas directement l'entrée 16-agent, mais vous pouvez implémenter votre propre orchestration multi-agents au niveau applicatif avec Grok 4.3 pour obtenir des résultats proches du mode natif.

Q5 : L’API Grok 4.3 ne dispose pas de mémoire persistante, quelles sont les alternatives ?

Vous devez construire un module de mémoire au niveau applicatif. La méthode courante consiste à stocker l'historique des conversations des utilisateurs dans une base de données vectorielle, puis à utiliser le RAG pour récupérer les segments top-k et les réinjecter dans le contexte avant chaque invocation du modèle. Des solutions communautaires comme Mem0 ou Letta sont compatibles avec l'interface OpenAI et donc avec Grok 4.3. Nous recommandons de configurer d'abord votre base_url sur APIYI (apiyi.com) pour valider la conversation de base, puis d'ajouter la couche de mémoire pour minimiser les coûts d'itération.

Q6 : Quels scénarios sont pris en charge par l’entrée vidéo de Grok 4.3, et y a-t-il une limite de durée ?

La recommandation officielle est une vidéo ≤ 5 minutes, ≤ 1080p, au format mp4/mov/webm. La facturation se fait par jetons d'image après extraction des trames. Les applications typiques incluent : l'extraction d'événements clés de vidéos de surveillance, la structuration de comptes-rendus de réunions, la prise de notes par chapitre pour des vidéos pédagogiques ou la documentation automatique de démos produits. Pour des vidéos plus longues, nous suggérons de les découper côté client, puis d'appeler Grok 4.3 en parallèle.

Q7 : Faut-il modifier le code pour migrer d’OpenAI / Claude vers Grok 4.3 ?

Il suffit de modifier deux champs. L'API Grok 4.3 est entièrement compatible avec le protocole Chat Completions d'OpenAI. Remplacez simplement le champ du modèle (gpt-5 ou claude-opus-4-7 par grok-4.3) et la base_url (remplacez le domaine du fournisseur d'origine par https://vip.apiyi.com/v1). La diffusion en continu (streaming), l'appel d'outils (tool calling) et le mode JSON conservent les mêmes noms de champs qu'OpenAI, sans réécriture de la logique client. L'entrée vidéo est spécifique à Grok 4.3 et se transmet via le champ video_url, sans affecter le flux d'entrée d'image existant.

Q8 : À quels scénarios le mode Batch de l’API Grok 4.3 est-il adapté ?

Il est idéal pour les tâches par lots non temps réel acceptant un délai de 24 heures, comme l'annotation de données hors ligne, l'analyse de logs historiques, le prétraitement de documents à grande échelle ou la modération de contenu. L'API Batch permet d'économiser 20 à 50 % supplémentaires sur le prix standard. Pour des tâches de traitement par lots avec beaucoup d'entrées et peu de sorties, le coût réel peut descendre jusqu'à environ 0,65 $ par million de jetons. Si votre activité n'est pas sensible à la latence, basculer le trafic vers le mode Batch est le moyen le plus économique de migrer.

Points d'attention pour les développeurs chinois utilisant l'API Grok 4.3

Voici une liste de contrôle pour les équipes chinoises, couvrant les aspects techniques, la conformité et les coûts.

Accès technique

Premièrement, privilégiez un service proxy API stable plutôt qu'un proxy auto-hébergé. L'interface officielle de xAI nécessite une connexion internationale stable, et les proxys auto-hébergés souffrent souvent de gigue de connexion en cas de forte concurrence. Les services proxy API, déployés sur plusieurs serveurs en Chine, offrent une latence et une stabilité bien meilleures. Deuxièmement, une fois la base_url basculée sur https://vip.apiyi.com/v1, aucun changement n'est nécessaire dans vos SDK (Python OpenAI SDK, Node.js openai, ou Go go-openai).

Conformité et facturation

Premièrement, les équipes chinoises peuvent utiliser le paiement en RMB via les services proxy API, évitant ainsi les problèmes de cartes bancaires étrangères et de conformité des paiements transfrontaliers. Deuxièmement, ces plateformes proposent généralement une facturation à l'usage avec prépaiement, ce qui facilite les processus financiers pour les entreprises locales. Troisièmement, pour la conformité des données sortantes, nous recommandons d'anonymiser les informations sensibles au niveau applicatif et de ne pas envoyer de données privées clients brutes aux modèles de raisonnement.

Contrôle des coûts

Premièrement, utilisez la remise cached_input de Grok 4.3 : pour les scénarios avec des invites système longues et fixes, le prix unitaire réel peut descendre à 0,31 $ par million de jetons. Deuxièmement, basculez toutes les activités non temps réel vers le mode Batch pour économiser 20 à 50 % supplémentaires. Troisièmement, acheminez les tâches simples vers Grok 4 Fast et réservez le 4.3 pour les tâches de raisonnement, ce qui peut réduire les coûts globaux de 60 à 70 %.

🎯 Résumé pour un déploiement en Chine : Nous recommandons aux équipes chinoises le parcours suivant pour Grok 4.3 : Service proxy API (APIYI apiyi.com) + SDK OpenAI + Routage hybride des modèles + Priorité à l'API Batch. Cette combinaison garantit stabilité et contrôle des coûts, et a déjà été validée sur plusieurs produits SaaS nationaux.

Résumé : La véritable portée de l'API Grok 4.3

Pour revenir à notre analyse initiale, Grok 4.3 n'est pas une simple mise à jour vers un « modèle plus intelligent », mais une refonte totale de la courbe de coût des modèles de raisonnement. Trois chiffres suffisent à illustrer ce changement : 1,25 $ pour le prix d'entrée, 1 million de jetons pour la fenêtre de contexte et une vitesse de sortie de 207 jetons/seconde. Cette combinaison est unique dans la catégorie des modèles de raisonnement.

Les meilleurs cas d'usage pour l'API Grok 4.3 se concentrent sur : le résumé et l'analyse de longs contextes, le traitement structuré de flux vidéo multiples, les flux de travail multi-agents et le raisonnement à haut débit sensible à la latence. Ce n'est pas un remplaçant direct de Claude Opus 4.7, mais pour de nombreuses tâches auparavant confiées à Opus 4.7, Grok 4.3 offre une alternative « 12 fois moins chère avec une fenêtre de contexte 5 fois plus grande ».

Pour les développeurs francophones, le chemin d'accès à l'API Grok 4.3 est désormais parfaitement mature. Nous recommandons de passer par la plateforme APIYI (apiyi.com) pour l'intégration et les tests. L'URL de base (base_url) est compatible avec le SDK OpenAI, et il suffit d'utiliser le champ de modèle grok-4.3 sans aucune modification de code. La même plateforme permet également d'invoquer Claude Opus 4.7, GPT-5 et Gemini 3 Pro, facilitant ainsi les comparaisons transversales et l'orchestration hybride.

Le véritable test pour Grok 4.3 aura lieu au second semestre 2026 : OpenAI et Anthropic suivront-ils cette baisse de prix ? xAI pourra-t-il combler ses lacunes en matière de mémoire persistante ? Le mode « 16-Agent Heavy » pourra-t-il s'affranchir des contraintes d'abonnement ? En attendant, c'est l'une des API de raisonnement au meilleur rapport qualité-prix du moment, et chaque développeur d'applications basées sur des agents devrait l'essayer avec ses propres données réelles.

Références

-

Documentation officielle des modèles xAI : ID du modèle, tarification, spécifications des capacités

- Lien :

docs.x.ai/developers/models - Description : Contient les paramètres complets de l'API Grok 4.3 et les règles de facturation.

- Lien :

-

Actualités officielles xAI : Annonces de produits et mises à jour

- Lien :

x.ai/news - Description : Conférence de lancement et présentation des fonctionnalités de Grok 4.3.

- Lien :

-

Tableau des prix en temps réel OpenRouter : Comparaison entre plusieurs modèles et historique des prix

- Lien :

openrouter.ai/x-ai/grok-4.3 - Description : Tarification en temps réel et suivi de la latence.

- Lien :

-

Classement intelligent Artificial Analysis : Indice d'intelligence global et données de vitesse

- Lien :

artificialanalysis.ai/models/grok-4-3 - Description : Comparaison dimensionnelle incluant l'indice AA, la vitesse et la fenêtre de contexte.

- Lien :

-

Documentation d'intégration APIYI : Tutoriel complet pour accéder à Grok 4.3 via un service proxy API

- Lien :

help.apiyi.com - Description : Inclut des exemples de SDK Python/Node.js et des explications sur la facturation.

- Lien :

Auteur : Équipe APIYI — Spécialisée dans le service proxy API pour les grands modèles de langage, aidant les développeurs à invoquer en un clic des modèles de premier plan tels que Grok 4.3, Claude Opus 4.7 et GPT-5. Visitez APIYI (apiyi.com) pour obtenir un crédit de test gratuit.