El servicio de generación de imágenes por IA de Google, Nano Banana Pro, implementó importantes ajustes en sus políticas a finales de enero de 2026 (alrededor del 24 de enero). Dos cambios principales han captado la atención de la comunidad de desarrolladores: el fortalecimiento significativo del filtrado de contenido IMAGE_SAFETY y las restricciones estrictas a la generación de personajes de IP (Propiedad Intelectual) famosas. En este artículo, analizaremos a fondo esta dinámica para ayudar a los desarrolladores a comprender el contexto de estos cambios y encontrar soluciones adecuadas.

Valor principal: Entiende en 3 minutos el contenido principal, las razones y el impacto real del ajuste de políticas de Nano Banana Pro, y domina 5 estrategias de respuesta.

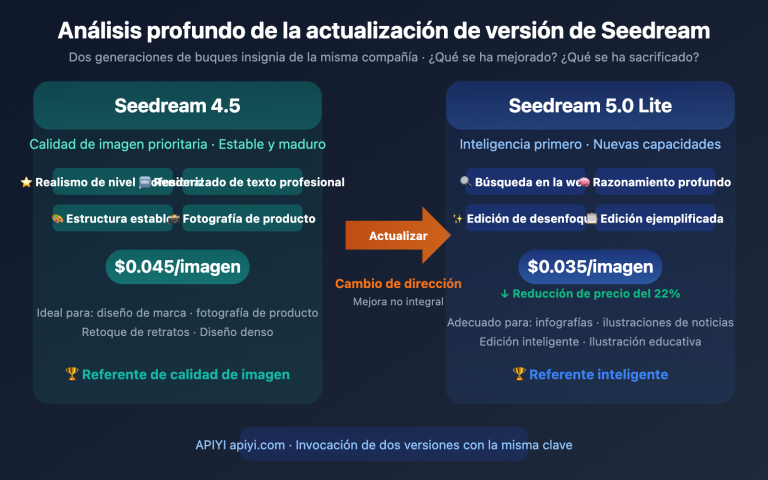

Información clave sobre el ajuste de políticas de Nano Banana Pro

Resumen del evento

| Elemento | Detalle |

|---|---|

| Fecha del ajuste | Alrededor del 24 de enero de 2026 |

| Responsable | Google (Nano Banana Pro / Serie Imagen) |

| Cambios principales | Refuerzo de filtrado IMAGE_SAFETY + Restricciones de generación de IP famosas |

| Alcance del impacto | Todos los desarrolladores y aplicaciones que utilizan la API de Nano Banana Pro |

| Explicación oficial | Violación de la Política de Uso Prohibido de IA Generativa de Google |

Detalle de los 2 cambios principales

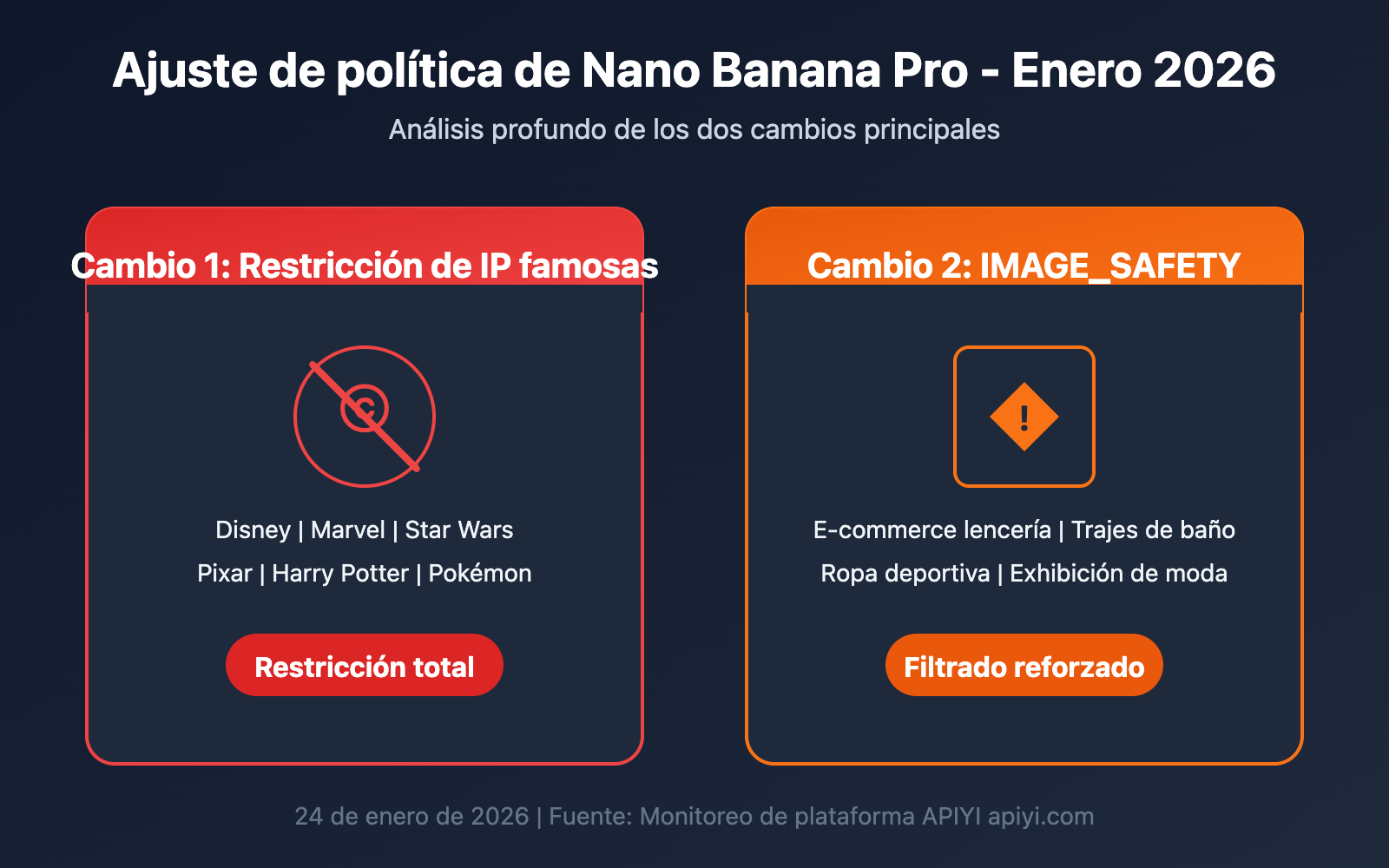

Cambio 1: Generación de personajes de IP famosas restringida

Descripción del fenómeno:

Al intentar generar imágenes que contengan personajes de marcas conocidas (como Disney, Marvel, Star Wars, etc.), el sistema rechazará la solicitud. Contenidos relacionados con IP que antes se podían generar con normalidad ahora activan mecanismos de protección de derechos de autor.

Alcance de las IP afectadas:

| Categoría de IP | Obras representativas | Nivel de restricción |

|---|---|---|

| Clásicos de Disney | Frozen, El Rey León, La Sirenita | Restricción total |

| Universo Marvel | Deadpool, Guardianes de la Galaxia, Iron Man | Restricción total |

| Star Wars | Personajes de toda la serie | Restricción total |

| Animación Pixar | Toy Story, Buscando a Nemo | Restricción total |

| Otras IP famosas | Harry Potter, Pokémon, etc. | Restricción parcial |

Ejemplo de error devuelto:

{

"finishReason": "SAFETY",

"finishMessage": "The image was filtered because it may contain copyrighted characters or content."

}

Cambio 2: Refuerzo del filtrado de contenido IMAGE_SAFETY

Descripción del fenómeno:

La revisión de seguridad del contenido se ha vuelto mucho más estricta. Contenidos que antes cumplían con las normas y se generaban normalmente (como fotos de productos para comercio electrónico o fotografía de moda), ahora pueden activar el filtro IMAGE_SAFETY.

Error típico devuelto:

{

"finishReason": "IMAGE_SAFETY",

"finishMessage": "Unable to show the generated image. The image was filtered out because it violated Google's Generative AI Prohibited Use policy. You will not be charged for blocked images. Try rephrasing the prompt. If you think this was an error, send feedback.",

"safetyInfo": {

"category": "HARM_CATEGORY_SEXUALLY_EXPLICIT",

"blocked": true

}

}

Escenarios afectados:

| Escenario | Estado anterior | Estado actual | Nivel de impacto |

|---|---|---|---|

| Productos de lencería para e-commerce | Generación normal | Interceptado frecuentemente | Alto |

| Fotografía de moda en trajes de baño | Generación normal | Interceptado parcialmente | Medio-Alto |

| Ropa deportiva y de fitness | Generación normal | Interceptado ocasionalmente | Medio |

| Ropa deportiva ajustada | Generación normal | Interceptado ocasionalmente | Medio |

| Exhibición de ropa convencional | Generación normal | Básicamente normal | Bajo |

Análisis del contexto del ajuste de políticas de Nano Banana Pro

Impulsado por el litigio de derechos de autor de Disney

En diciembre de 2025, Disney envió una carta de cese y desistimiento (Cease and Desist Letter) a Google, alegando que el servicio de generación de imágenes por IA de Google incurre en una "infracción de derechos de autor a gran escala".

Puntos clave de la acusación de Disney:

| Contenido de la acusación | Descripción detallada |

|---|---|

| Escala de la infracción | "massive scale" (escala masiva) |

| Productos infractores | Veo, Imagen, Nano Banana, etc. |

| Método de infracción | Generación de imágenes "pristine" (en alta definición) de personajes de Disney |

| IP involucradas | Star Wars, Marvel, Frozen, El Rey León, entre otras |

Disney presentó pruebas en la carta de cómo los usuarios podían generar imágenes de sus personajes con simples indicaciones de texto, argumentando que Google está "ampliando intencionadamente el alcance de su infracción" (intentionally amplifying the scope of its infringement).

🎯 Información de contexto: Resulta curioso que, mientras acusa a Google de infracción, Disney también anunció una colaboración de 1.000 millones de dólares con OpenAI para autorizar el uso de sus personajes en la plataforma de vídeo Sora. Esto sugiere que Disney no se opone a la generación por IA per se, sino que exige licencias formales y una participación en los beneficios comerciales.

Aumento de la presión de cumplimiento en la industria

Además de Disney, un grupo de artistas visuales también ha presentado demandas por derechos de autor contra Google, alegando que el modelo Imagen utilizó sus obras para entrenamiento sin autorización. Estas presiones legales han llevado a Google a reforzar proactivamente el filtrado de contenido.

Ajustes en las políticas de Google

En diciembre de 2024, Google actualizó su Política de Uso Prohibido de IA Generativa, prohibiendo explícitamente:

- La generación de contenido que infrinja los derechos de propiedad intelectual de terceros.

- El uso de datos personales o biométricos sin consentimiento.

- La generación de contenido de tipo "deepfake".

- La creación de imágenes íntimas no consentidas.

Este ajuste en las políticas de Nano Banana Pro es la implementación concreta de estas directrices a nivel de producto.

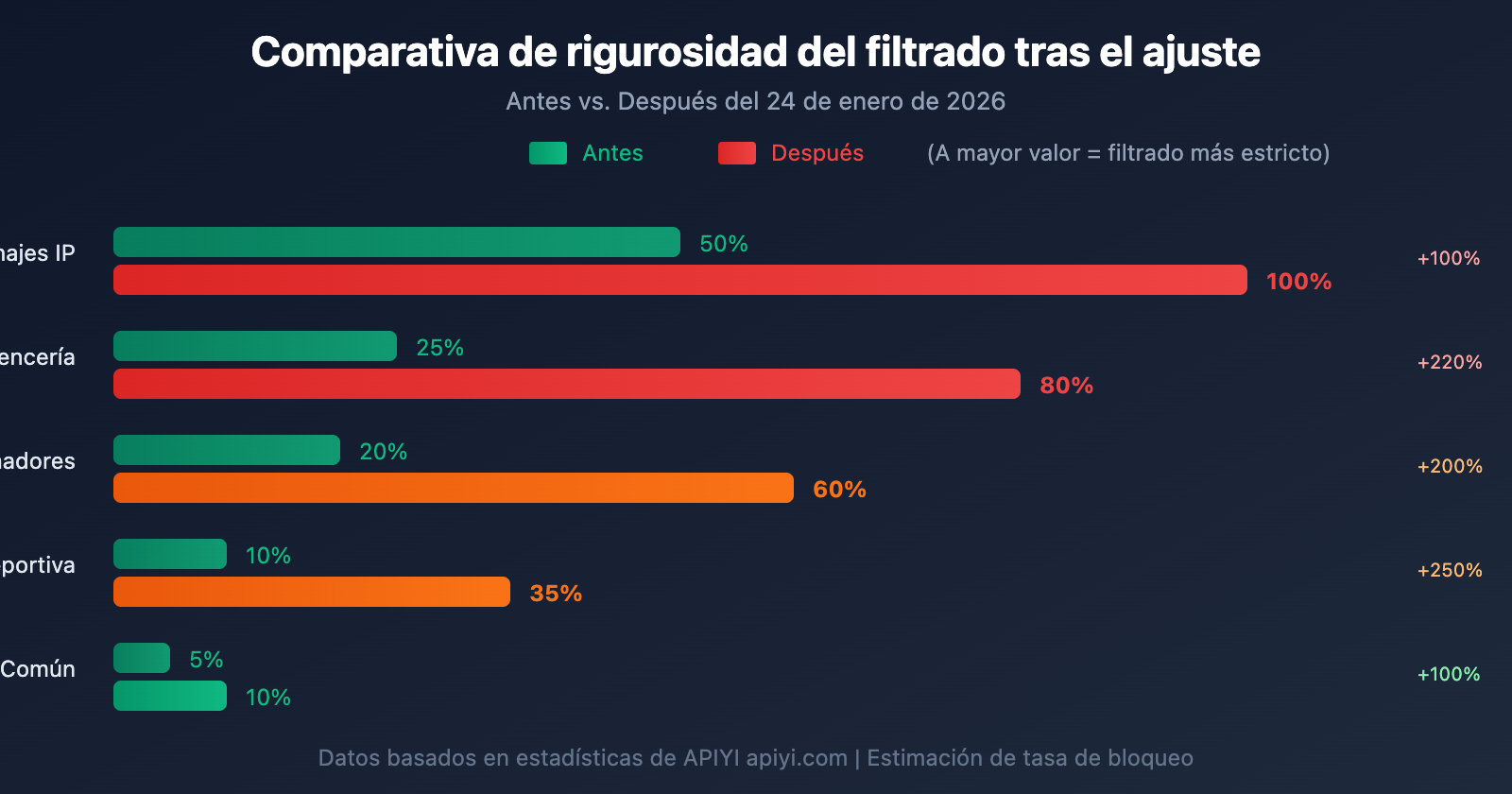

Análisis del mecanismo de filtrado IMAGE_SAFETY en Nano Banana Pro

Cómo funciona el filtro

El sistema de filtrado de seguridad de Nano Banana Pro emplea un mecanismo de revisión multicapa:

Primera capa: Revisión de la indicación

- Analiza la indicación de texto introducida por el usuario.

- Detecta palabras clave sensibles e intención semántica.

- Identifica descripciones potencialmente relacionadas con derechos de autor.

Segunda capa: Monitoreo durante el proceso de generación

- Detecta en tiempo real las características de la imagen que se está generando.

- Realiza comparaciones con una base de datos de características de IP conocidas.

- Evalúa la puntuación de seguridad del contenido.

Tercera capa: Revisión de la salida

- Escanea exhaustivamente la imagen final.

- Aplica clasificadores

HARM_CATEGORY. - Decide si permite la salida o la bloquea.

Detalle de las categorías de filtrado

| Código de categoría | Nombre de categoría | Escenario de activación | Nivel de rigurosidad |

|---|---|---|---|

HARM_CATEGORY_SEXUALLY_EXPLICIT |

Contenido sexual explícito | Ropa reveladora, poses íntimas | Muy estricto |

HARM_CATEGORY_DANGEROUS_CONTENT |

Contenido peligroso | Armas, escenas de violencia | Estricto |

HARM_CATEGORY_HATE_SPEECH |

Discurso de odio | Contenido discriminatorio | Estricto |

HARM_CATEGORY_HARASSMENT |

Acoso | Ataques dirigidos | Estricto |

HARM_CATEGORY_VIOLENCE |

Violencia | Escenas sangrientas o dañinas | Estricto |

COPYRIGHT_INFRINGEMENT |

Infracción de copyright | Personajes de IP famosas | Muy estricto |

¿Por qué se bloquea contenido legítimo?

Hay muchos comentarios en foros de desarrolladores preguntando: ¿por qué se bloquean fotos de productos de lencería para un e-commerce legítimo mediante IMAGE_SAFETY?

Análisis de las causas:

- Sobreajuste del modelo de seguridad: Para garantizar que no se escape ningún contenido infractor, el modelo tiende a ser "más vale prevenir que lamentar".

- Falta de juicio de contexto: Al sistema le resulta difícil distinguir entre una "foto de producto comercial" y "contenido inapropiado".

- Endurecimiento de la estrategia global: Bajo la presión de las demandas legales, Google ha optado por elevar el umbral general de filtrado.

- Decisiones de "caja negra": Los usuarios no pueden conocer con exactitud qué regla específica se ha activado.

💡 Perspectiva técnica: A través de las funciones de análisis de registros de peticiones de la plataforma APIYI (apiyi.com), los desarrolladores pueden comprender mejor las razones específicas de las peticiones bloqueadas, lo que ayuda a optimizar las estrategias de las indicaciones.

Impacto del ajuste de políticas de Nano Banana Pro en los desarrolladores

Impacto directo

| Área de impacto | Manifestación específica | Nivel de gravedad |

|---|---|---|

| Aplicaciones de PI | Las herramientas de creación para fans y los servicios de generación de fan art dejan de funcionar directamente | Crítico |

| Imágenes de e-commerce | Bloqueos en la generación de imágenes para categorías de lencería y trajes de baño | Grave |

| Fotografía de moda | Algunos escenarios de exhibición de ropa son detectados como falsos positivos | Medio |

| Diseño creativo | Restricciones en creaciones que hacen referencia al estilo de personajes famosos | Medio |

| Uso general | El impacto es relativamente menor | Leve |

Impacto a nivel de negocio

Para el sector del e-commerce:

- Las soluciones de generación de imágenes de productos con IA para tiendas de ropa necesitan ajustes.

- El impacto es más significativo en las categorías de lencería y trajes de baño.

- Es posible que sea necesario volver a la fotografía tradicional o cambiar a otros servicios.

Para los creadores de contenido:

- Las creaciones secundarias y la generación de obras derivadas (fan art) están limitadas.

- Se requiere más diseño original en lugar de apoyarse en Propiedad Intelectual (PI) existente.

- La libertad creativa se ha visto reducida.

Para los desarrolladores de aplicaciones de IA:

- Es necesario añadir más lógica de manejo de errores en los productos.

- La experiencia del usuario podría degradarse debido a las frecuentes interceptaciones.

- Podría ser necesario introducir servicios de generación de imágenes de respaldo.

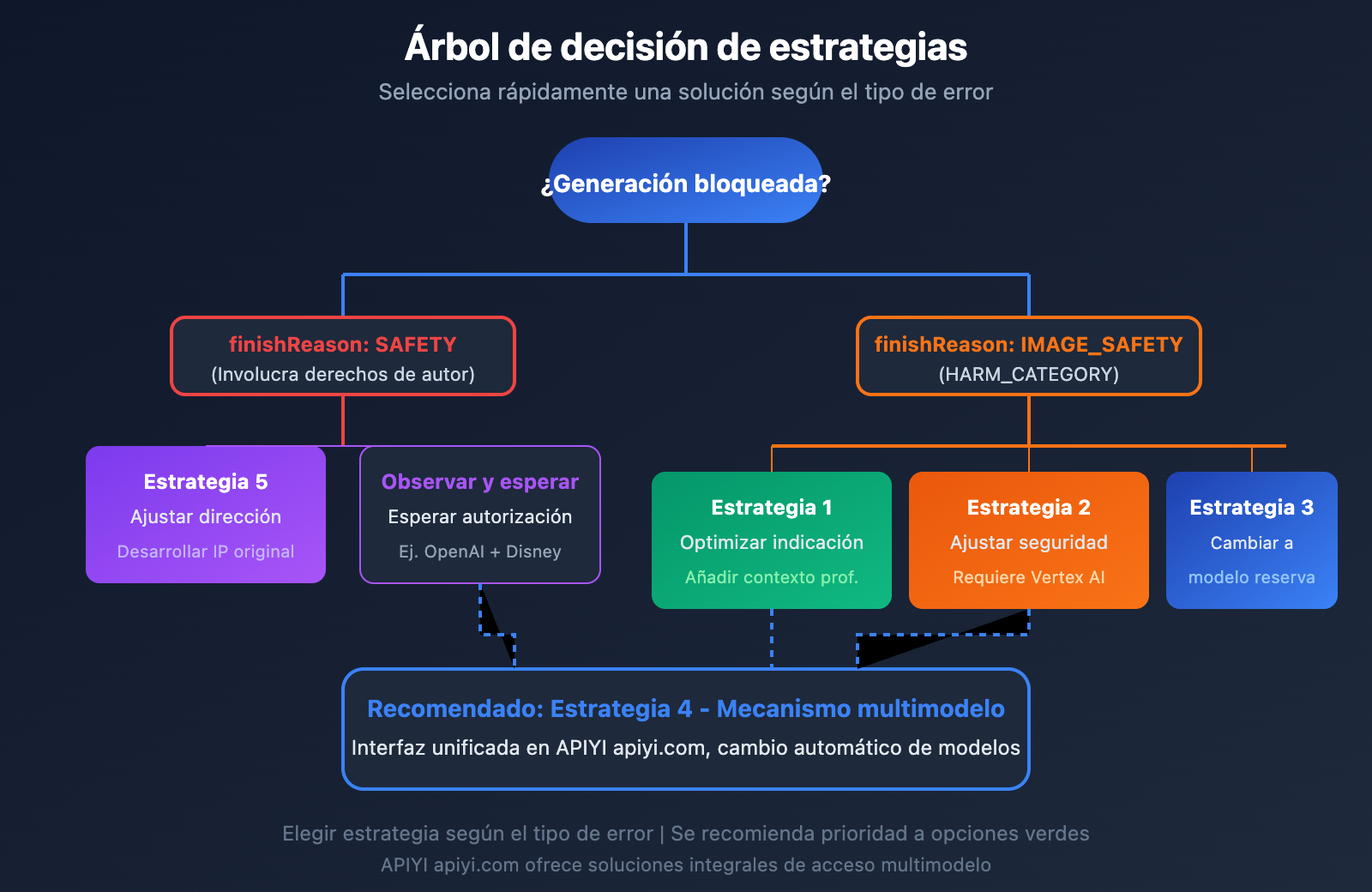

5 estrategias para afrontar los ajustes de política de Nano Banana Pro

Estrategia 1: Optimizar la redacción de las indicaciones

Ante los falsos positivos de IMAGE_SAFETY, puedes intentar ajustar la forma en que redactas tu indicación:

# 优化前 - 容易被拦截

prompt_before = "model wearing lace bra, fashion photography"

# 优化后 - 降低误判概率

prompt_after = "fashion catalog photo, model in elegant intimate apparel, professional studio lighting, clean background"

Técnicas de optimización:

| Técnica | Descripción | Ejemplo |

|---|---|---|

| Añadir escenarios profesionales | Enfatizar el uso comercial o profesional | "e-commerce product photo" |

| Usar expresiones eufemísticas | Evitar descripciones directas | "intimate apparel" en lugar de "bra" |

| Agregar descripción del entorno | Hacer que el contenido parezca más formal | "professional studio setting" |

| Especificar el propósito | Indicar una intención de cumplimiento | "for fashion catalog" |

Estrategia 2: Ajustar la configuración del filtro de seguridad

Si estás utilizando la versión de Imagen en Vertex AI, puedes intentar ajustar los umbrales del filtro de seguridad:

from google.cloud import aiplatform

from vertexai.preview.vision_models import ImageGenerationModel

# 调整安全设置

safety_settings = {

"HARM_CATEGORY_SEXUALLY_EXPLICIT": "BLOCK_ONLY_HIGH",

"HARM_CATEGORY_DANGEROUS_CONTENT": "BLOCK_ONLY_HIGH",

}

model = ImageGenerationModel.from_pretrained("imagen-3.0")

response = model.generate_images(

prompt="your prompt here",

safety_filter_level="block_only_high" # 降低过滤敏感度

)

⚠️ Nota: En la versión gratuita de AI Studio no se pueden ajustar las configuraciones de seguridad; es necesario utilizar la versión de pago de Vertex AI.

Estrategia 3: Utilizar servicios de generación de imágenes alternativos

Cuando Nano Banana Pro no sea adecuado, considera otros servicios de generación de imágenes:

| Servicio | Ventaja | Escenario ideal | Soporte en APIYI |

|---|---|---|---|

| DALL-E 3 | Gran creatividad, alto cumplimiento | Diseño creativo, ilustración | ✅ |

| Midjourney | Estilo artístico excepcional | Creación artística, arte conceptual | ✅ |

| Stable Diffusion | Flexible y controlable | Necesidades personalizadas | ✅ |

| Flux | Rápido y rentable | Generación por lotes | ✅ |

🚀 Cambio rápido: A través de la plataforma APIYI (apiyi.com), los desarrolladores pueden usar una interfaz API unificada para llamar a múltiples modelos de generación de imágenes sin modificar el código. Si un servicio se bloquea, puedes cambiar sin problemas a uno de respaldo.

Estrategia 4: Establecer un mecanismo de tolerancia a fallos multimodelo

Implementa una lógica de degradación automática (fallback) en tu aplicación:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # 使用 APIYI 统一接口

)

def generate_image_with_fallback(prompt, models=None):

"""带容错的图像生成函数"""

if models is None:

models = ["nano-banana-pro", "dall-e-3", "flux-schnell"]

for model in models:

try:

response = client.images.generate(

model=model,

prompt=prompt,

size="1024x1024"

)

return {

"success": True,

"model_used": model,

"image_url": response.data[0].url

}

except Exception as e:

error_msg = str(e)

if "IMAGE_SAFETY" in error_msg or "SAFETY" in error_msg:

print(f"{model} 被安全过滤拦截,尝试下一个模型...")

continue

else:

print(f"{model} 调用失败: {error_msg}")

continue

return {"success": False, "error": "所有模型都无法生成该内容"}

# 使用示例

result = generate_image_with_fallback("fashion product photography, elegant dress")

Ver código completo de tolerancia a fallos (incluye reintentos y logs)

import openai

import time

import logging

from typing import Optional, List, Dict, Any

# 配置日志

logging.basicConfig(level=logging.INFO)

logger = logging.getLogger(__name__)

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # 使用 APIYI 统一接口

)

class ImageGenerationService:

"""带容错和重试的图像生成服务"""

DEFAULT_MODELS = ["nano-banana-pro", "dall-e-3", "flux-schnell", "sd-xl"]

def __init__(self, models: Optional[List[str]] = None, max_retries: int = 2):

self.models = models or self.DEFAULT_MODELS

self.max_retries = max_retries

self.stats = {"success": 0, "safety_blocked": 0, "errors": 0}

def generate(self, prompt: str, size: str = "1024x1024") -> Dict[str, Any]:

"""生成图像,自动容错切换模型"""

for model in self.models:

for attempt in range(self.max_retries):

try:

logger.info(f"尝试使用 {model} 生成图像 (第 {attempt + 1} 次)")

response = client.images.generate(

model=model,

prompt=prompt,

size=size

)

self.stats["success"] += 1

logger.info(f"✅ 使用 {model} 成功生成图像")

return {

"success": True,

"model_used": model,

"image_url": response.data[0].url,

"attempts": attempt + 1

}

except Exception as e:

error_msg = str(e)

if "IMAGE_SAFETY" in error_msg or "SAFETY" in error_msg:

self.stats["safety_blocked"] += 1

logger.warning(f"⚠️ {model} 被安全过滤拦截")

break # 安全拦截不重试,直接换模型

elif "rate_limit" in error_msg.lower():

logger.warning(f"⏳ {model} 触发限速,等待后重试...")

time.sleep(2 ** attempt) # 指数退避

continue

else:

self.stats["errors"] += 1

logger.error(f"❌ {model} 调用失败: {error_msg}")

break

return {

"success": False,

"error": "所有模型都无法生成该内容",

"stats": self.stats

}

def get_stats(self) -> Dict[str, int]:

"""获取统计信息"""

return self.stats

# 使用示例

service = ImageGenerationService()

result = service.generate("professional fashion photography, model in elegant evening dress")

if result["success"]:

print(f"生成成功! 使用模型: {result['model_used']}")

print(f"图片地址: {result['image_url']}")

else:

print(f"生成失败: {result['error']}")

Estrategia 5: Ajustar la estrategia de negocio

Para las aplicaciones que dependen fuertemente de PI conocidas, puede ser necesario ajustar fundamentalmente la dirección del negocio:

| Negocio original | Dirección del ajuste | Viabilidad |

|---|---|---|

| Generar imágenes de personajes de Disney | Crear personajes originales y desarrollar una PI propia | Medio-largo plazo |

| Herramientas de creación secundaria de PI | Cambiar hacia la imitación de estilos originales (sin incluir personajes específicos) | Viable a corto plazo |

| Generación de fan art para fans | Esperar por canales de autorización oficiales (como la colaboración OpenAI+Disney) | Observación |

Preguntas frecuentes

Q1: ¿Por qué el contenido que antes se podía generar ahora ya no funciona?

Google realizó ajustes de política en Nano Banana Pro a finales de enero de 2026, impulsado principalmente por presiones legales como las demandas de derechos de autor de Disney. El umbral de filtrado de IMAGE_SAFETY se elevó significativamente, lo que puede provocar que contenido que antes cumplía con las normas ahora sea malinterpretado como no apto. Te sugerimos probar diversos modelos a través de la plataforma APIYI (apiyi.com) para encontrar la alternativa que mejor se adapte a tu escenario de negocio.

Q2: ¿Qué hacer si se bloquean las fotos de productos de lencería para e-commerce?

Primero, intenta optimizar la indicación añadiendo descripciones de escenarios profesionales como "e-commerce product photo" o "professional catalog". Si el bloqueo persiste, te recomendamos cambiar a otros servicios de generación de imágenes como DALL-E 3 o Flux. La plataforma APIYI (apiyi.com) admite el uso de múltiples modelos mediante una interfaz unificada, lo que permite realizar pruebas y cambios rápidos.

Q3: ¿Se puede generar contenido con un «estilo similar a cierto personaje»?

Describir un "estilo similar" suele ser menos propenso a activar los filtros de derechos de autor que mencionar directamente el nombre del personaje, pero aun así existe un riesgo. Se recomienda usar descripciones más abstractas, como "colorful cartoon princess style" en lugar de "Elsa from Frozen style". Lo más seguro es crear basándose completamente en conceptos originales.

Q4: ¿Este ajuste de política es permanente?

Por lo visto, es muy probable que las restricciones de protección de derechos de autor para IPs conocidas continúen, ya que es un requisito de cumplimiento legal. Sin embargo, los problemas de falsos positivos en IMAGE_SAFETY podrían mejorar en versiones posteriores. Ya hay comentarios al respecto en los foros de desarrolladores de Google, y la compañía ha indicado que está recopilando feedback. Te sugerimos estar atento a los registros de actualización oficiales.

Q5: ¿Cómo distinguir si es un problema de derechos de autor o de seguridad de contenido?

Observa la información de error devuelta: si el finishReason es SAFETY y el mensaje menciona "copyrighted" o "trademarked", se trata de un problema de derechos de autor. Si el finishReason es IMAGE_SAFETY y el safetyInfo.category es HARM_CATEGORY_SEXUALLY_EXPLICIT u otros similares, entonces es un problema de seguridad de contenido. Las estrategias para abordar cada uno son diferentes.

Impacto de los ajustes de política de Nano Banana Pro en la industria

Impacto en el sector de generación de imágenes por IA

Este ajuste de política marca un punto de inflexión importante para la industria de la generación de imágenes por IA:

| Tendencia | Descripción |

|---|---|

| Cumplimiento de derechos de autor como estándar | Los principales servicios de IA reforzarán la protección de derechos de autor, impulsados por el entorno legal actual. |

| Endurecimiento de la moderación de contenido | Para evitar riesgos legales, los proveedores tienden a elevar los umbrales de filtrado. |

| Colaboraciones bajo licencia como tendencia | El modelo de colaboración entre Disney y OpenAI podría convertirse en el estándar de la industria. |

| Protagonismo del contenido original | Las aplicaciones que dependen del uso de IPs de terceros enfrentarán desafíos mucho mayores. |

Impacto en el ecosistema de desarrolladores

- Las estrategias multi-modelo son ahora una necesidad: Ya no es viable depender de un único servicio de generación de imágenes.

- Fortalecimiento de los mecanismos de tolerancia a fallos: Las aplicaciones deben ser capaces de gestionar con elegancia los errores en la generación.

- Mayor conciencia sobre el cumplimiento normativo: Los desarrolladores necesitan entender mejor los límites de los derechos de autor y la seguridad de los contenidos.

💡 Sugerencia de desarrollo: Se recomienda a los desarrolladores utilizar plataformas de interfaz unificada como APIYI (apiyi.com) para acceder a múltiples servicios de generación de imágenes. Esto no solo reduce el riesgo de dependencia de un solo proveedor, sino que también permite alternar con flexibilidad entre los mejores modelos según cada escenario.

Resumen

Los ajustes de política de Nano Banana Pro en enero de 2026 trajeron dos cambios fundamentales: la restricción en la generación de IPs conocidas y el fortalecimiento del filtrado IMAGE_SAFETY. Esto es el resultado de la presión legal de titulares de derechos como Disney y del esfuerzo proactivo de Google por elevar sus estándares de cumplimiento.

Repaso de los puntos clave:

| Punto clave | Contenido |

|---|---|

| Cambio 1 | Bloqueo de la generación de personajes de IPs famosas (como Disney). |

| Cambio 2 | Filtrado de seguridad de contenido significativamente reforzado; algunos contenidos legítimos son marcados erróneamente. |

| Causas de fondo | Demandas por derechos de autor de Disney + presión de cumplimiento en toda la industria. |

| Estrategias de respuesta | Optimizar las indicaciones, ajustar configuraciones de seguridad, usar servicios de respaldo, establecer mecanismos de tolerancia a fallos y pivotar la dirección del negocio. |

Para los desarrolladores, lo más pragmático es aceptar estos cambios y adaptarse activamente. Se recomienda utilizar APIYI (apiyi.com) para probar rápidamente diversos modelos de generación de imágenes y encontrar la solución que mejor se adapte a su caso de negocio. La plataforma ofrece una API unificada que permite cambiar entre diferentes modelos con un solo clic, siendo una garantía eficaz ante los cambios de política de los proveedores.

Referencias:

-

Google Generative AI Prohibited Use Policy: Documento oficial de políticas de uso.

- Enlace:

policies.google.com/terms/generative-ai/use-policy

- Enlace:

-

Documentación de filtrado de seguridad de Vertex AI Imagen: Guía de configuración de seguridad.

- Enlace:

docs.cloud.google.com/vertex-ai/generative-ai/docs/image/responsible-ai-imagen

- Enlace:

-

Google AI Developers Forum: Hilo de discusión sobre IMAGE_SAFETY en Nano Banana Pro.

- Enlace:

discuss.ai.google.dev/t/nano-banana-pro-suddenly-blocking-non-nsfw-ecommerce-underwear-images-with-image-safety-error/113109

- Enlace:

-

Reporte sobre Disney vs Google: Noticia sobre el envío de cartas de cese y desista por parte de Disney.

- Fuente: Hollywood Reporter, The Wrap (diciembre de 2025)

📝 Autor: Equipo de APIYI

📅 Fecha de publicación: 26 de enero de 2026

🔗 Soporte técnico: APIYI (apiyi.com) – Tu plataforma integral de servicios API para modelos de IA