xAI hat am 30. April 2026 den vollständigen Rollout der Grok 4.3 API abgeschlossen. Mit der Senkung der Eingabepreise um etwa 40 %, der Erweiterung des Kontextfensters auf 1 Mio. Token und der erstmaligen nativen Unterstützung für Videoeingaben wurden die Kostenmodelle für Agenten-Anwendungen praktisch neu geschrieben. Dieser Artikel bietet eine vollständige Analyse der wichtigsten Upgrades, Preisdetails, Leistungsvergleiche und Implementierungswege der Grok 4.3 API.

Kernnutzen: In 3 Minuten alle wichtigen Informationen und die Branchenbedeutung der Grok 4.3 API verstehen sowie den schnellsten Weg für die Anbindung über einen API-Proxy-Dienst in China erfahren.

Grok 4.3 API – Überblick der Kerninformationen

Das Versions-Update von xAI setzt auf eine Kombination aus „Preissenkung + Kapazitätserweiterung + Multimodalität“. Nur 4 Monate nach der Vorgängerversion Grok 4.20 hat xAI mit einem Hauptversions-Update die Kostenkurve für Reasoning-Modelle insgesamt eine Stufe gesenkt. Wir stellen zunächst alle Schlüsselparameter in einer Tabelle gegenüber und gehen in den folgenden Abschnitten auf die Details ein.

Bevor wir zur Parametertabelle kommen, ist es wichtig, die Positionierung von Grok 4.3 innerhalb des xAI-Produktportfolios zu verstehen. Derzeit bietet xAI drei Kategorien von API-Modellen an: Grok 4 Fast für „maximale Kosteneffizienz“, Grok 4.3 als „Reasoning-Flaggschiff“ und Grok Code Fast 1 für Programmieraufgaben. Grok 4.3 ist das Modell, das xAI allen API-Nutzern standardmäßig empfiehlt; in der Dokumentation wird es explizit als das „intelligenteste und schnellste“ Vorzeigemodell bezeichnet.

Wichtige Parameter der Grok 4.3 API

| Information | Details |

|---|---|

| Offizielles Release | 30. April 2026 (Vollständiger API-Rollout) |

| Beta-Release | 17. April 2026 (für SuperGrok Heavy-Nutzer) |

| Modell-ID | grok-4.3 |

| Kontextfenster | 1.000.000 Token (1M) |

| Ausgabegeschwindigkeit | ca. 207 Token/Sekunde |

| Eingabepreis | $1,25 / Million Token |

| Ausgabepreis | $2,50 / Million Token |

| Unterstützte Modalitäten | Text, Bild (einzelnes Bild ≤ 20 MiB), Video (neu) |

| Reasoning-Modus | Standardmäßig aktiviert (Reasoning Always-On) |

| Wissensstand | November 2024 |

| Batch API Rabatt | 50–80 % des Standardpreises (24h Bearbeitung) |

| AA-Intelligenzindex | 53 (weit über dem Median von 34 in dieser Preisklasse) |

Die fünf Kern-Upgrades der Grok 4.3 API

Das Update von xAI umfasst mehr als nur Preisänderungen. Wir haben alle Neuerungen in fünf Dimensionen zusammengefasst, um einen schnellen Überblick zu ermöglichen.

| Upgrade-Bereich | Ära 4.20 | Aktueller Stand Grok 4.3 | Auswirkung |

|---|---|---|---|

| Preis | $3,00 / $15,00 | $1,25 / $2,50 | Eingabepreis ~58 % gesenkt |

| Multimodalität | Text + Bild | Text + Bild + Video | Agenten können Videos direkt analysieren |

| Dokumentengenerierung | Nur Textausgabe | Native Ausgabe von PDF/XLSX/PPTX | Nachbearbeitungs-Pipeline entfällt |

| Heavy-System | Einzelner Agent | 16-Agenten-Parallel-Scheduling | Komplexe Aufgaben in einem Durchgang |

| Sprach-API | Keine eigene API | STT/TTS API $4,20/Mio. Zeichen | 86–92 % günstiger als OpenAI |

🎯 Empfehlung für den Schnellstart: Für Entwickler in China ist die Anbindung der Grok 4.3 API über den API-Proxy-Dienst von APIYI (apiyi.com) eine der zuverlässigsten Methoden. Geben Sie als

base_urleinfachhttps://vip.apiyi.com/v1ein und als Modellfeldgrok-4.3. Die Antwortgeschwindigkeit entspricht der offiziellen API, und es wird die OpenAI-SDK-Kompatibilität unterstützt.

Detaillierte Analyse der Preisgestaltung der Grok 4.3 API

Die Preisgestaltung ist der Aspekt, der bei dieser Version am meisten Aufmerksamkeit erregt. Im Folgenden schlüsseln wir die Kosten anhand von Einzelpreisen, Batch-Verarbeitung, Tool-Aufrufen und Abonnements auf.

Standard-Preisgestaltung der Grok 4.3 API

Die offizielle Preisliste von xAI legt die Tarife auf Token-Ebene klar fest. Die folgenden Daten basieren auf der offiziellen Dokumentation von xAI und den Echtzeit-Angeboten von OpenRouter.

| Posten | Einzelpreis | Anmerkung |

|---|---|---|

| Eingabe-Tokens | $1,25 / Mio. | Inklusive textualisierter Tokens für Bilder und Videoframes |

| Ausgabe-Tokens | $2,50 / Mio. | Inklusive Ausgabe-Tokens für Reasoning-Schritte |

| Zwischengespeicherte Eingabe-Tokens | $0,31 / Mio. | Abrechnung bei Cache-Treffern |

| Bildeingabe | Abrechnung pro Token | Max. 20 MiB pro Bild |

| Videoeingabe | Abrechnung pro Frame-Token | Neue Funktion |

Bei einem üblichen Eingabe-Ausgabe-Verhältnis von 3:1 ergibt sich ein Mischpreis für die Grok 4.3 API von etwa $1,56 pro Million Tokens. Im Vergleich zur GPT-5-Serie und Claude Opus 4.7 gehört dieser Preis im Bereich der Reasoning-Modelle zur günstigsten Kategorie.

Preise für serverseitige Tool-Aufrufe bei Grok 4.3

Die Grok 4.3 API verfügt über integrierte serverseitige Tools. Die folgenden drei Tool-Kategorien werden nach Anzahl der Aufrufe berechnet und sind von den Token-Kosten getrennt.

| Tool-Typ | Preis | Anwendungsfall |

|---|---|---|

| Websuche | $5 / 1k Aufrufe | Echtzeit-Webrecherche |

| X (Twitter) Suche | $5 / 1k Aufrufe | Suche in der X-Plattform-Timeline |

| Code-Ausführung | $5 / 1k Aufrufe | Sandbox-Code-Ausführung |

💡 Tipp zur Kostenoptimierung: Wir empfehlen bei Szenarien mit mittlerer Auslastung eine Kombination aus Grok 4.3 und Grok 4 Fast. Einfache Anfragen können an 4 Fast geroutet werden (Kosten nur 1/4 von 4.3), während komplexe Reasoning-Aufgaben von 4.3 übernommen werden. Die Plattform APIYI (apiyi.com) unterstützt den Wechsel zwischen beiden Modellen unter derselben

base_url, ohne dass die Authentifizierungslogik neu geschrieben werden muss.

SuperGrok Heavy Abonnement für Grok 4.3

Neben der Token-basierten API hat xAI das SuperGrok Heavy Abonnement für Power-User eingeführt.

| Abonnement-Stufe | Monatliche Gebühr | Inhalt |

|---|---|---|

| Grok Free | $0 | Geschwindigkeitsbegrenzte Nutzung von Grok 4.3 |

| SuperGrok | $30 / Monat | Höhere Limits + Videoeingabe |

| SuperGrok Heavy | $300 / Monat | 16-Agent Heavy-Modus + Priorisierte Geschwindigkeit + Early-Access-Funktionen |

Die Abonnement-Stufen orientieren sich an ChatGPT Pro ($200/Monat) und Claude Max ($200/Monat). Der Preis liegt etwas höher, aber der 16-Agent Heavy-Modus ist derzeit das am nächsten an ein "Enterprise-Agenten-Cluster" heranreichende Produkt unter den öffentlich verfügbaren Modellen.

Schätzung der tatsächlichen Kosten der Grok 4.3 API

Viele Teams interessiert vor allem: "Wie viel spare ich wirklich, wenn ich zu Grok 4.3 wechsle?" Wir haben dies anhand von drei typischen Geschäftsvolumina geschätzt, unter der Annahme eines Eingabe-Ausgabe-Verhältnisses von 3:1.

| Geschäftsvolumen | Monatliches Token-Volumen | Grok 4.3 Monatsgebühr | Claude Opus 4.7 Monatsgebühr | Einsparung |

|---|---|---|---|---|

| Einzelentwickler | 10 Mio. | ~$15 | ~$185 | -92% |

| Mittelständisches SaaS | 500 Mio. | ~$780 | ~$9.200 | -92% |

| Unternehmens-Kundenservice | 5.000 Mio. | ~$7.800 | ~$92.000 | -92% |

Hinweis: Bei einer hohen Trefferquote für Prompt Caching bei Claude Opus 4.7 können die tatsächlichen Kosten um weitere 30–50 % sinken. Da Grok 4.3 ebenfalls Rabatte für zwischengespeicherte Eingaben ($0,31 / Mio. Tokens) bietet, handelt es sich in der Tabelle um "Preise ohne Caching". Der tatsächliche Unterschied fällt also etwas geringer aus, liegt aber immer noch im Bereich des 6- bis 8-Fachen.

Leistungsvergleich der Grok 4.3 API

Der Preis allein ist nicht alles. Wir bewerten die tatsächliche Position von Grok 4.3 bei Reasoning-, Coding- und Agenten-Aufgaben anhand aktueller öffentlicher Benchmarks.

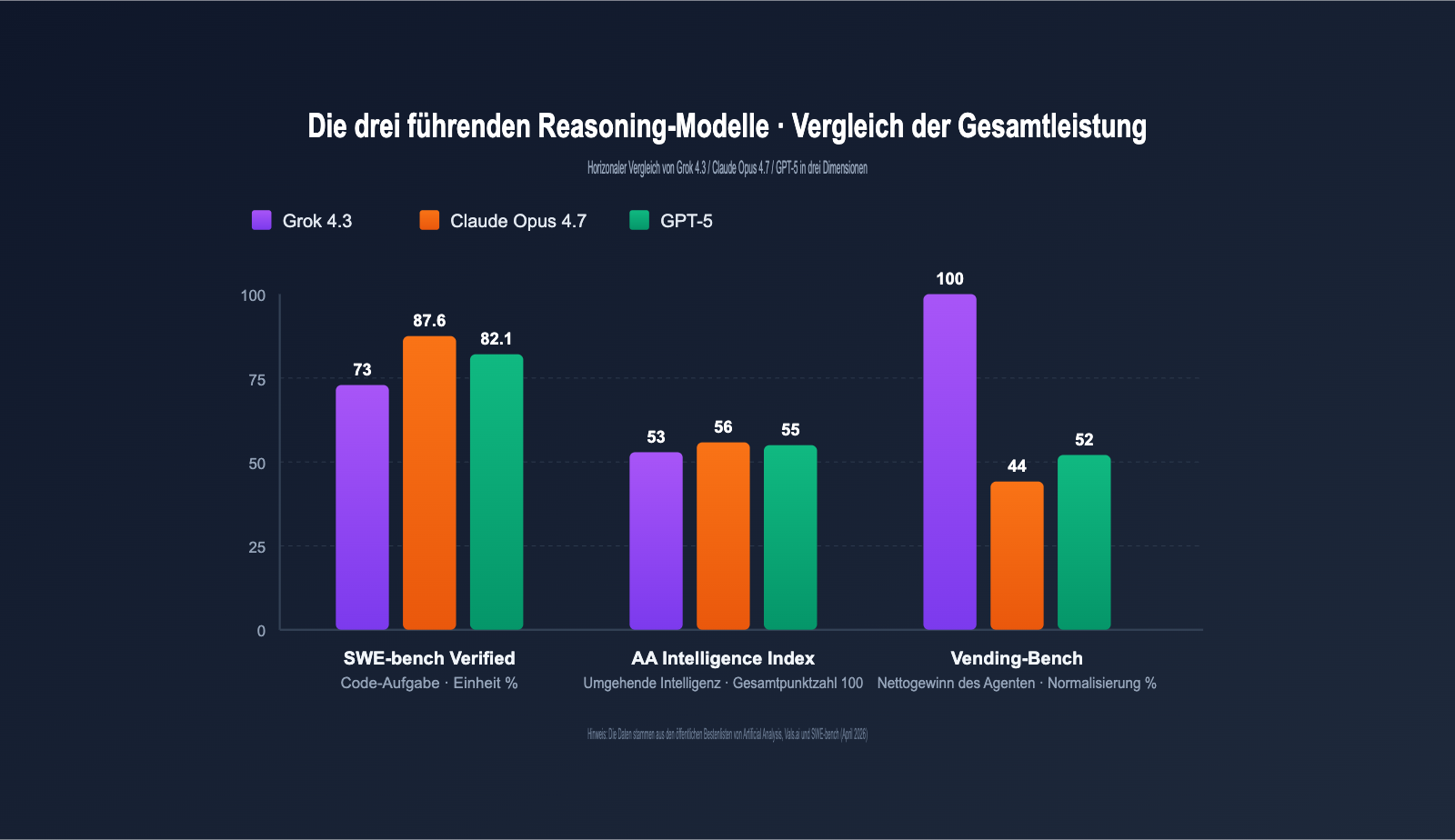

Umfassender Vergleich von Grok 4.3 mit ähnlichen Modellen

Die folgende Tabelle fasst die bis Ende April 2026 öffentlich verfügbaren Benchmark-Daten zusammen. Die Preise beziehen sich auf die API-Listenpreise.

| Modell | AA Intelligenz-Index | SWE-bench Verified | Ausgabegeschwindigkeit | Eingabepreis | Kontext |

|---|---|---|---|---|---|

| Grok 4.3 | 53 | ~73% | 207 tps | $1,25 | 1 Mio. |

| Claude Opus 4.7 | 56 | 87,6% | 78 tps | $15,00 | 200k |

| GPT-5 (High Reasoning) | 55 | 82,1% | 95 tps | $5,00 | 400k |

| Gemini 3 Pro | 54 | 79,4% | 130 tps | $3,50 | 2 Mio. |

| Grok 4 Fast | 41 | 58,2% | 235 tps | $0,30 | 256k |

Daraus lassen sich einige klare Schlussfolgerungen ziehen:

- Coding ist nicht die Stärke von Grok 4.3: Bei SWE-bench liegt es etwa 14 Prozentpunkte hinter Claude Opus 4.7.

- Agenten-Aufgaben sind das Heimspiel von Grok 4.3: Bei langwierigen Sequenz-Simulationsaufgaben wie Vending-Bench übertrifft Grok 4.3 Opus 4.7 um den Faktor 1,26.

- Unschlagbare Kombination aus Durchsatz und Preis: Mit 207 tps Geschwindigkeit und einem Eingabepreis von $1,25 ist es in der Kategorie der Reasoning-Modelle konkurrenzlos.

Leistung von Grok 4.3 bei verschiedenen Aufgabentypen

Unterteilt nach Aufgaben-Granularität ergeben sich folgende tatsächliche Anwendungsergebnisse:

| Aufgabentyp | Grok 4.3 Leistung | Empfohlene Anwendung |

|---|---|---|

| Zusammenfassung langer Kontexte | ⭐⭐⭐⭐⭐ | 1 Mio. Fenster + hoher Durchsatz, ideal für ganze Bücher |

| Agenten-Workflows | ⭐⭐⭐⭐⭐ | Erstklassige Leistung bei langkettigen Aufgaben (Vending-Bench) |

| Code-Generierung und Refactoring | ⭐⭐⭐⭐ | Unterlegen gegenüber Opus 4.7, aber Preisvorteil gleicht dies aus |

| Komplexe mathematische Schlussfolgerungen | ⭐⭐⭐⭐ | AIME-Serie nahe an GPT-5 |

| Multimodales Verständnis | ⭐⭐⭐⭐ | Videoeingabe ist eine neue Funktion, Genauigkeit ist solide |

| Langzeitgedächtnis | ⭐⭐ | Noch keine Unterstützung für persistentes Gedächtnis, externe Memory-Ebene erforderlich |

🎯 Empfehlung zur Modellauswahl: Die Wahl des richtigen Modells hängt von Ihrem spezifischen Anwendungsfall und den Qualitätsanforderungen ab. Wir empfehlen, praktische Tests über die Plattform APIYI (apiyi.com) durchzuführen. Diese unterstützt die einheitliche Schnittstellenabfrage für führende Reasoning-Modelle wie Grok 4.3, Claude Opus 4.7 und GPT-5, was einen direkten Vergleich mit Ihren realen Geschäftsdaten erleichtert.

Detaillierte Analyse der drei neuen Funktionen der Grok 4.3 API

Abgesehen von der Preisgestaltung bringt Grok 4.3 drei neue Funktionen mit sich, die eine gesonderte Betrachtung wert sind und die in der Ära von Grok 4.20 noch völlig fehlten.

Grok 4.3 Video-Eingabefunktion

Grok 4.3 ist das erste API-Modell von xAI, das nativ Videoeingaben unterstützt. Es handelt sich dabei nicht um eine „Transkription vor der Textverarbeitung“, sondern um eine direkte Verarbeitung der Videobilder durch einen visuellen Encoder.

Unterstützte Videoparameter:

| Parameter | Einschränkung |

|---|---|

| Videolänge | ≤ 5 Minuten (offizielle Empfehlung) |

| Videoauflösung | ≤ 1080p |

| Frame-Sampling | Automatische Extraktion mit 1–4 fps |

| Dateiformate | mp4, mov, webm |

| Abrechnung | Abrechnung nach Bild-Token nach dem Sampling |

Die zwei direktesten Anwendungsbereiche in der Praxis sind: Erstens die Extraktion kritischer Ereignisse aus Überwachungs- oder Sicherheitsvideos und zweitens die strukturierte Zusammenfassung von Lehr- oder Konferenzvideos. Letzteres ermöglicht in Kombination mit dem 1M-Kontextfenster: „Ein vierstündiger Kurs wird hochgeladen und als vollständige Kapitelnotizen ausgegeben.“

Die folgende Tabelle fasst einige typische Anwendungsfälle für Videoeingaben und die entsprechenden technischen Schwerpunkte zusammen.

| Anwendungsfall | Technische Schwerpunkte | Implementierungsschwierigkeit |

|---|---|---|

| Ereigniserkennung in Überwachungsvideos | System-Eingabeaufforderung auf Ereignisse fokussieren, fps auf 2 setzen | Niedrig |

| Konferenzprotokolle | Kombination mit STT zur Spracherkennung, Videobilder zur Sprecheridentifikation | Mittel |

| Kapitelnotizen für Lehrvideos | Lange Videos in 5-Minuten-Segmente schneiden, abschließende Zusammenfassung | Niedrig |

| Dokumentation von Produktdemos | UI-Schritte durch Frame-Analyse erkennen, bebilderte Anleitungen erstellen | Mittel |

| Inhaltsprüfung für Kurzvideos | Einzelvideo ≤ 60 Sekunden, Batch-Aufrufe | Niedrig |

Grok 4.3 Dokumentengenerierungsfunktion

Die am meisten unterschätzte Funktion der neuen Version ist die Dokumentengenerierung. Grok 4.3 kann direkt im Chat herunterladbare PDF-, Excel- (XLSX) und PowerPoint-Dateien (PPTX) erstellen, wobei die Inhalte in Echtzeit vom Modell befüllt werden.

# Minimalbeispiel: Grok 4.3 erstellt direkt eine Excel-Finanzübersicht

from openai import OpenAI

client = OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="grok-4.3",

messages=[{

"role": "user",

"content": "Erstelle für mich einen XLSX-Finanzbericht der SaaS-Branche für Q4 2025 mit den Spalten Umsatz, Wachstumsrate und Bruttomarge"

}],

extra_body={"output_format": "xlsx"}

)

# Die Antwort enthält die URL zum herunterladbaren Dokument

print(response.choices[0].message.attachments[0].url)

Vollständigen Code zur Dokumentengenerierung anzeigen (inkl. PDF/PPTX-Formatwechsel)

from openai import OpenAI

import requests

import os

client = OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

OUTPUT_FORMATS = ["pdf", "xlsx", "pptx"]

def generate_doc(prompt: str, fmt: str, save_dir: str = "./outputs"):

"""Ruft Grok 4.3 auf, um ein Dokument im angegebenen Format zu erstellen und lokal zu speichern"""

if fmt not in OUTPUT_FORMATS:

raise ValueError(f"Format muss eines der folgenden sein: {OUTPUT_FORMATS}")

response = client.chat.completions.create(

model="grok-4.3",

messages=[{"role": "user", "content": prompt}],

extra_body={"output_format": fmt}

)

attachment = response.choices[0].message.attachments[0]

file_url = attachment.url

file_name = attachment.filename or f"output.{fmt}"

os.makedirs(save_dir, exist_ok=True)

save_path = os.path.join(save_dir, file_name)

file_resp = requests.get(file_url, timeout=60)

file_resp.raise_for_status()

with open(save_path, "wb") as f:

f.write(file_resp.content)

return save_path

if __name__ == "__main__":

pdf_path = generate_doc(

"Schreibe einen Bericht über die Trends bei großen Sprachmodellen für 2026, 5 Seiten",

"pdf"

)

print(f"PDF gespeichert unter: {pdf_path}")

ppt_path = generate_doc(

"Erstelle eine 10-seitige Produktpräsentation für die Grok 4.3 API",

"pptx"

)

print(f"PPTX gespeichert unter: {ppt_path}")

💡 Integrationshinweis: Die Dokumentengenerierungsfunktion kann über den API-Proxy-Dienst von APIYI (apiyi.com) direkt durchgereicht werden. Es sind keine zusätzlichen Parameteranpassungen erforderlich; Python/Node.js SDKs können unverändert verwendet werden.

Die mit Grok 4.3 eingeführte Sprach-API

Oft übersehen: Am selben Tag wie Grok 4.3 hat xAI eigenständige STT- (Sprache-zu-Text) und TTS- (Text-zu-Sprache) APIs eingeführt. Diese werden getrennt vom Hauptmodell abgerechnet.

| Sprach-API | xAI-Preis | Preis bei OpenAI/Vergleichbar | Preisunterschied |

|---|---|---|---|

| STT (entspricht Whisper) | $4.20 / Mio. Zeichen | ~$30 / Mio. Zeichen | 86% günstiger |

| TTS (hohe Ausdruckskraft) | $4.20 / Mio. Zeichen | ~$50 / Mio. Zeichen (ElevenLabs) | 92% günstiger |

Diese Preisstrategie bedeutet, dass xAI die Untergrenze für KI-Sprachverarbeitung auf ein Zehntel des Branchenstandards gesenkt hat. Für Szenarien mit hohem Audioaufkommen wie Kundenservice-Bots, Podcast-Erstellung oder Sprachassistenten im Auto wird die Preiskurve grundlegend neu definiert.

Analyse der Auswirkungen der Grok 4.3 API auf Entwickler

Direkte Auswirkungen auf KI-Anwendungsentwickler

| Einflussdimension | Konkrete Änderung | Empfehlung |

|---|---|---|

| Kostenstruktur | Kosten für Reasoning-Anwendungen ↓ 40–60% | Anteil der Nutzung von High-End-Modellen neu bewerten |

| Architekturwahl | 1M-Kontextfenster reduziert Notwendigkeit von RAG | Kurzfristig kann Long-Context teilweise die Suche ersetzen |

| Multimodale Produkte | Videoeingabe senkt Hürde für visuelle KI | Projekte für Videoüberwachung/Bildung/Medizin lohnen sich |

| Agenten-Produkte | 16-Agent Heavy erhöht Obergrenze für komplexe Aufgaben | Multi-Agent-Architekturen werden praxistauglich |

| Sprachprodukte | Kosten für TTS/STT drastisch gesunken | Sprach-Frontends können vollständig auf KI umgestellt werden |

Mittel- bis langfristige Auswirkungen auf die KI-Branche

Erstens: Der Preiskampf bei Reasoning-Modellen hat offiziell begonnen. Grok 4.3 drückt den Preis für die Kombination aus 1M-Kontext und Reasoning auf etwa 1/12 von Claude Opus 4.7. Dies ist kein kleiner Test, sondern bricht den alten Branchenkonsens, dass „Reasoning-Modelle teuer sein müssen“. Dies wird OpenAI und Anthropic in der zweiten Jahreshälfte 2026 zu einer preislichen Reaktion zwingen – entweder durch Nachziehen oder durch Differenzierung in anderen Bereichen (besseres Coding, längeres Gedächtnis).

Zweitens: „Native Videoeingabe“ wandert vom Demo-Status in die Produktion. Bisher war Gemini die einzige kommerzielle API, die Videoeingaben in großem Maßstab anbot. Mit dem Einstieg von Grok 4.3 beginnt das Zeitalter der echten Video-Multimodalität mit zwei Anbietern. Dies bedeutet, dass KI-Videoprodukte, die zuvor aufgrund des „Single-Vendor-Risikos“ nicht gestartet wurden, nun offiziell auf die Agenda gesetzt werden können.

Drittens: Multi-Agent-Systeme treten in die Ära des „Abonnement-Modells“ ein. Die 16-Agenten-Architektur von SuperGrok Heavy wird als Abo angeboten. Sollte sich dieses Geschäftsmodell durchsetzen, ebnet es den Weg für Abrechnungsformen nach „Anzahl der Agenten“. Während Multi-Agent-Systeme bisher hauptsächlich über Open-Source-Frameworks (LangGraph, AutoGen, CrewAI) auf Anwendungsebene realisiert wurden, verlagert xAI dies nun direkt auf die Modellebene, was das Paradigma „Agent-as-a-Service“ etabliert.

Viertens: Das Fehlen eines dauerhaften Gedächtnisses bei xAI ist ein echter Schwachpunkt. ChatGPT und Claude unterstützen bereits seit über einem Jahr ein sitzungsübergreifendes Gedächtnis; Grok 4.3 hat dies noch nicht nachgeholt, was bei Produkten für „persönliche Assistenten“ ein deutlicher Nachteil ist. Kurzfristig bleibt nur der Aufbau einer eigenen Memory-Ebene auf Anwendungsebene (Vektordatenbank + RAG). Community-Lösungen wie Mem0 oder Letta sind bereits ausgereift, aber erst ein natives Gedächtnis würde tiefere Produktformen ermöglichen.

Fünftens: Die Reasoning-Geschwindigkeit wird zu einer neuen Wettbewerbsdimension. Die Ausgabegeschwindigkeit von 207 Token/Sekunde ist für Reasoning-Modelle branchenweit führend. Dies ermöglicht es, Aufgaben, die bisher im Batch-Verfahren bearbeitet werden mussten, in Echtzeit-Interaktionen zu überführen, wie z. B. Code-Reviews, Fragen zu langen Dokumenten oder dynamische Inhaltsgenerierung. Geschwindigkeit kombiniert mit niedrigen Preisen fördert eine neue Art von Anwendungen: hochfrequente, latenzarme Reasoning-Microservices.

Entscheidungsmatrix für die Auswahl der Grok 4.3 API

Nicht jedes Szenario ist für den Wechsel auf Grok 4.3 geeignet. Wir haben die Anfragen aus unserem Tagesgeschäft der letzten zwei Wochen in einer Entscheidungsmatrix zusammengefasst, die Ihnen als Orientierungshilfe dienen soll.

Szenarien mit klarer Empfehlung für die Grok 4.3 API

| Szenario | Empfehlungsgrund |

|---|---|

| Zusammenfassung & Analyse langer Dokumente | 1M Kontextfenster + 207 tps Output; verarbeitet ganze Bücher oder 200-seitige Berichte mühelos |

| KI-Agenten für Kundenservice / Beschwerdemanagement | Reasoning ist standardmäßig aktiviert; die Kosten sind so niedrig, dass "ein Agent pro Mitarbeiter" möglich ist |

| Verständnis von Videoinhalten | Einzige native Video-Eingabe neben Gemini, dabei kostengünstiger |

| Große Offline-Datenannotation | Batch API nach Rabatten bei ca. $0,65 / Mio. Tokens; drastische Senkung der Annotationskosten |

| Multimodale Protokollierung | Zusammenführung von Video, Audio und Text; direkte Erstellung von PDF/PPTX-Dokumenten |

| Langkettige Agenten-Aufgaben | Vending-Bench-Daten belegen, dass dies eine Kernstärke von Grok 4.3 ist |

Szenarien ohne Empfehlung für die Grok 4.3 API

| Szenario | Grund für Nicht-Empfehlung |

|---|---|

| Top-Coding-Agenten | SWE-bench liegt noch etwa 14 Prozentpunkte hinter Claude Opus 4.7 |

| Persönliche Assistenten (mit starkem Gedächtnis) | Fehlendes Langzeitgedächtnis; eine Memory-Schicht muss selbst gebaut werden |

| Interaktionen mit extrem niedriger Latenz | 207 tps ist schnell, aber Grok 4 Fast (235 tps) ist günstiger und besser geeignet |

| Extreme Sensibilität für chinesische Muttersprachler | Gute Leistung, aber leicht hinter der Spitzenklasse von Claude / GPT-5 |

| Streng regulierte Rechts- / Medizin-Texte | Wissensstand bis Nov. 2024; nicht so aktuell wie Claude Opus 4.7 |

Empfehlungen zur internen Aufgabenteilung: Grok 4.3 vs. Grok 4 Fast

Viele Teams stellen sich die praktische Frage: Sollten wir im selben Projekt Grok 4.3 oder Grok 4 Fast verwenden? Unsere Empfehlung lautet, die Last nach Aufgabenkomplexität zu verteilen.

| Aufgabentyp | Empfohlenes Modell | Grund |

|---|---|---|

| Einfache FAQ-Antworten | Grok 4 Fast | Stückpreis nur 1/4 von 4.3, höhere Geschwindigkeit |

| Inhaltsmoderation & Klassifizierung | Grok 4 Fast | Kein Reasoning erforderlich, Fast ist völlig ausreichend |

| Generierung komplexer Pläne | Grok 4.3 | Reasoning ist zwingend erforderlich, 4.3 ist die Standardwahl |

| Mehrstufige Tool-Aufrufe | Grok 4.3 | Server-seitige Tool-Chain benötigt Reasoning-Unterstützung |

| Verarbeitung langer Dokumente (>200k) | Grok 4.3 | Fast hat nur 256k Kontext, 4.3 bietet volle 1M |

💡 Architektur-Tipp: Über den API-Proxy-Dienst von APIYI (apiyi.com) können Sie Anfragen basierend auf der Token-Länge oder Aufgaben-Tags automatisch an Grok 4 Fast oder Grok 4.3 weiterleiten. Mit demselben SDK-Code und demselben API-Schlüssel müssen Sie nur ein Feld ändern, um das Modell zu wechseln – das spart massiv Entwicklungsaufwand.

Vollständige Anleitung zur Anbindung der Grok 4.3 API in China

Der Zugriff auf die offiziellen xAI-Schnittstellen aus China stößt auf Netzwerk- und Zahlungshürden. Hier ist der stabilste Weg zur Anbindung.

Grok 4.3 API-Anbindung (OpenAI SDK kompatibel)

# Vollständiges Beispiel für die Anbindung in China mit dem offiziellen OpenAI SDK

from openai import OpenAI

client = OpenAI(

api_key="Ihr APIYI API-Schlüssel",

base_url="https://vip.apiyi.com/v1" # APIYI API-Proxy-Dienst base_url

)

response = client.chat.completions.create(

model="grok-4.3",

messages=[

{"role": "system", "content": "Sie sind ein erfahrener KI-Produktanalyst"},

{"role": "user", "content": "Analysieren Sie die drei langfristigen Auswirkungen von Grok 4.3 auf die KI-Agenten-Branche"}

],

temperature=0.7,

max_tokens=2048

)

print(response.choices[0].message.content)

Vollständiger Code für Streaming-Output + Bildeingabe

from openai import OpenAI

import base64

client = OpenAI(

api_key="Ihr APIYI API-Schlüssel",

base_url="https://vip.apiyi.com/v1"

)

# 1. Streaming-Output

def stream_chat(prompt: str):

stream = client.chat.completions.create(

model="grok-4.3",

messages=[{"role": "user", "content": prompt}],

stream=True

)

for chunk in stream:

content = chunk.choices[0].delta.content

if content:

print(content, end="", flush=True)

print()

# 2. Bildeingabe

def vision_chat(image_path: str, question: str):

with open(image_path, "rb") as f:

b64 = base64.b64encode(f.read()).decode()

response = client.chat.completions.create(

model="grok-4.3",

messages=[{

"role": "user",

"content": [

{"type": "text", "text": question},

{"type": "image_url", "image_url": {

"url": f"data:image/png;base64,{b64}"

}}

]

}]

)

return response.choices[0].message.content

if __name__ == "__main__":

stream_chat("Erklären Sie in drei Absätzen die Auswirkungen des 1M-Kontextfensters auf die RAG-Architektur")

answer = vision_chat(

"./screenshot.png",

"Auf welcher Ebene befindet sich Grok 4.3 in diesem Architekturdiagramm?"

)

print(answer)

Grok 4.3 API Tool Use in der Praxis

Grok 4.3 unterstützt über das OpenAI-kompatible Protokoll hinaus nativ drei Arten von server-seitigen Tools. Diese werden einfach über das tools-Feld deklariert; das Modell entscheidet selbstständig, wann und welches Tool aufgerufen wird, ohne dass eine zusätzliche Orchestrierung auf Anwendungsebene erforderlich ist.

# Beispiel für server-seitige Tool-Aufrufe: Modell führt eigenständig Websuche + Code-Ausführung durch

from openai import OpenAI

client = OpenAI(

api_key="Ihr APIYI API-Schlüssel",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="grok-4.3",

messages=[{

"role": "user",

"content": "Suchen Sie nach der aktuellen Token-Preisgestaltung von xAI für Grok 4.3 und berechnen Sie mit Python die Gesamtkosten für 1 Million Aufrufe"

}],

tools=[

{"type": "web_search"}, # Websuche

{"type": "code_execution"} # Sandbox-Code-Ausführung

]

)

print(response.choices[0].message.content)

Das Modell führt die Tools bei Bedarf verkettet aus – zum Beispiel erst web_search, um die neuesten Preise abzurufen, und dann code_execution für die mathematische Berechnung, um schließlich eine strukturierte Antwort zu liefern. Diese Fähigkeit zur "autonomen Tool-Kette" erforderte in der Ära von Grok 4.20 noch manuelle Orchestrierung; Grok 4.3 erledigt dies mit einer einzigen Anfrage.

Best Practices für die Migration von OpenAI zu Grok 4.3

Viele Teams haben ihre Systeme bisher auf OpenAI-Schnittstellen aufgebaut. Bei der Migration auf Grok 4.3 sollten Sie folgende Punkte beachten.

| Migrationspunkt | OpenAI-Schreibweise | Empfohlene Schreibweise für Grok 4.3 |

|---|---|---|

| base_url | https://api.openai.com/v1 |

https://vip.apiyi.com/v1 |

| Modell-Feld | gpt-5 |

grok-4.3 |

| Reasoning-Konfiguration | reasoning_effort="high" |

Standardmäßig aktiviert, keine Konfiguration nötig |

| Tool-Deklaration | tools=[{"type": "function", ...}] |

Wie links, server-seitige Tools nutzen Typen wie web_search |

| Streaming-Output | stream=True |

Vollständig kompatibel |

| JSON-Modus | response_format={"type": "json_object"} |

Vollständig kompatibel |

Für reale Projekte empfehlen wir ein Drei-Schritte-Vorgehen: Erstens: Im Testumfeld nur base_url und model anpassen, um die grundlegende Kommunikation zu testen. Zweitens: Hochwertige Reasoning-Anfragen an Grok 4.3 routen, während normale Dialoge über das bisherige Modell laufen, um einen A/B-Vergleich durchzuführen. Drittens: Basierend auf den echten Daten entscheiden, ob eine vollständige Umstellung oder eine hybride Architektur sinnvoll ist.

🎯 Tipp zur hybriden Architektur: Auf der APIYI-Plattform (apiyi.com) teilen sich alle gängigen Modelle (Grok 4.3, Claude Opus 4.7, GPT-5, Gemini 3 Pro) dieselbe

base_urlund denselben API-Schlüssel. Sie müssen auf Anwendungsebene nur dasmodel-Feld ändern, um zwischen den Modellen zu wechseln – ohne zusätzlichen Integrationsaufwand.

Hinweise zur Grok 4.3 API-Anbindung

| Hinweis | Beschreibung |

|---|---|

| Modell-Feld | Verwenden Sie strikt grok-4.3 (nicht grok4.3 oder Grok-4.3) |

| base_url | Empfohlen für China: https://vip.apiyi.com/v1 (stabil und geringe Latenz) |

| Reasoning-Feld | Standardmäßig aktiviert, keine zusätzlichen Parameter erforderlich |

| Extralanger Kontext | Empfohlener Input ≤ 800k Tokens, um Puffer für Reasoning zu lassen |

| Video-Eingabe | Über das Feld video_url übergeben; derzeit werden Videos bis 5 Minuten empfohlen |

🎯 Praxistipp: Wir empfehlen, zunächst einen Test-Key auf APIYI (apiyi.com) zu beantragen, um den kleinstmöglichen Kreislauf zu testen, und erst nach Stabilität auf Produktionskontingente umzusteigen. Die Plattform unterstützt Prepaid-Guthaben und verbrauchsabhängige Abrechnung ohne die Notwendigkeit einer ausländischen Kreditkarte – ideal für die Finanzprozesse chinesischer Teams.

Häufig gestellte Fragen zur Grok 4.3 API

Q1: Ist die Grok 4.3 API wirklich günstiger als Grok 4.20, und wie hoch ist die Ersparnis?

Ja, die Preissenkung ist signifikant. Während Grok 4.20 zuvor bei etwa 3,00 $ / 15,00 $ (Input/Output) lag, wurde Grok 4.3 auf 1,25 $ / 2,50 $ angepasst. Dies entspricht einer Senkung der Input-Kosten um ca. 58 % und der Output-Kosten um ca. 83 %. Bei einem angenommenen Input-Output-Verhältnis von 3:1 sinken die Gesamtkosten um etwa 70 %. Dies ist ein klares Signal von xAI, den Markt für Reasoning-Modelle aktiv anzugreifen.

Q2: Ist das 1M-Kontextfenster der Grok 4.3 API in China verfügbar?

Ja, es ist verfügbar. Das 1M-Kontextfenster ist eine inhärente Fähigkeit des Modells und unterliegt keinen regionalen Beschränkungen. Entwickler in China können über einen API-Proxy-Dienst wie APIYI (apiyi.com) auf den langen Kontext zugreifen. Beachten Sie jedoch: Je höher die Token-Anzahl pro Anfrage, desto höher die Latenz (End-to-End kann dies über 30 Sekunden dauern). Es wird empfohlen, in Produktionsumgebungen bei extrem langen Kontexten asynchrone Prozesse oder eine segmentierte Verarbeitung zu nutzen.

Q3: Wie sollte man sich zwischen Grok 4.3 und Claude Opus 4.7 entscheiden?

Wählen Sie basierend auf dem Aufgabentyp: Wenn der Kern Ihres Geschäfts in der Codegenerierung oder bei komplexen Coding-Agents liegt, wählen Sie Claude Opus 4.7, da es im SWE-bench-Test immer noch um etwa 14 Prozentpunkte führt. Wenn der Fokus auf Zusammenfassungen langer Kontexte, intelligenten Agenten (wie Vending-Bench) oder multimodaler Videoverarbeitung liegt, ist Grok 4.3 die bessere Wahl – es ist 12-mal günstiger und bietet eine höhere Aufgabenrelevanz. Eine hybride Architektur ist der Trend für 2026: Nutzen Sie einen einheitlichen API-Proxy-Dienst, um beide Modelle je nach Bedarf zu steuern.

Q4: Was ist das 16-Agent Heavy-System von Grok 4.3? Kann man es über die API aufrufen?

Das 16-Agent Heavy-System ist ein paralleles Steuerungssystem, das xAI über das Hauptmodell gelegt hat. Ein Orchestrator koordiniert bis zu 16 Worker-Agenten, die Teilaufgaben parallel bearbeiten – ideal für komplexe Planungen und langfristige Simulationen. Derzeit ist der Heavy-Modus nur für SuperGrok Heavy-Abonnenten (300 $/Monat) verfügbar. Die API bietet derzeit keinen direkten Zugriff auf den 16-Agent-Einstiegspunkt, aber Sie können auf Anwendungsebene eine Multi-Agenten-Orchestrierung mit Grok 4.3 implementieren, die dem nativen Heavy-Modus sehr nahe kommt.

Q5: Die Grok 4.3 API hat kein persistentes Gedächtnis. Welche Alternativen gibt es?

Sie müssen ein Memory-Modul auf Anwendungsebene aufbauen. Ein gängiger Ansatz: Speichern Sie den historischen Dialog der Benutzer in einer Vektordatenbank und rufen Sie vor dem Modellaufruf die Top-k-Fragmente mittels RAG ab, um sie wieder in den Kontext einzufügen. Es gibt ausgereifte Lösungen wie Mem0 oder Letta, die direkt mit OpenAI-kompatiblen Schnittstellen funktionieren und somit auch mit Grok 4.3 kompatibel sind. Wir empfehlen, zuerst die base_url auf APIYI (apiyi.com) umzustellen, um grundlegende Dialoge zu ermöglichen, und dann die Memory-Schicht hinzuzufügen, um die Iterationskosten zu minimieren.

Q6: Welche Szenarien unterstützt die Videoeingabe von Grok 4.3 und gibt es eine Zeitbegrenzung?

Offiziell werden Videos bis zu 5 Minuten und 1080p in den Formaten mp4/mov/webm empfohlen. Die Abrechnung erfolgt nach dem Extrahieren von Frames als Bild-Token. Typische Anwendungen sind: Extraktion von Schlüsselereignissen aus Überwachungsvideos, strukturierte Protokolle von Konferenzvideos, Kapitelnotizen für Lehrvideos oder die automatische Dokumentation von Produkt-Demo-Videos. Bei längeren Videos empfiehlt es sich, diese clientseitig zu schneiden und dann parallel von Grok 4.3 verarbeiten zu lassen.

Q7: Muss ich meinen Code ändern, wenn ich von OpenAI / Claude zu Grok 4.3 migriere?

Sie müssen lediglich zwei Felder anpassen. Die Grok 4.3 API ist vollständig kompatibel mit dem Chat-Completions-Protokoll von OpenAI. Ändern Sie das Modellfeld von gpt-5 oder claude-opus-4-7 zu grok-4.3 und die base_url vom ursprünglichen Anbieter zu https://vip.apiyi.com/v1. Streaming-Ausgabe, Tool-Calling und JSON-Modus behalten die OpenAI-Feldnamen bei, eine Neuschreibung der Client-Logik ist nicht erforderlich. Die Videoeingabe ist eine Besonderheit von Grok 4.3 und wird über das Feld video_url übergeben, was den bestehenden Prozess für Bildeingaben nicht beeinträchtigt.

Q8: Für welche Szenarien eignet sich der Batch-Modus der Grok 4.3 API?

Er eignet sich für nicht-echtzeitkritische Aufgaben, bei denen eine Antwort innerhalb von 24 Stunden akzeptabel ist, wie z. B. Offline-Datenannotation, Analyse historischer Protokolle, groß angelegte Dokumentenvorverarbeitung oder Inhaltsmoderation. Die Batch-API bietet zusätzlich zum Standardpreis weitere 20–50 % Rabatt. Bei Batch-Aufgaben mit hohem Input und niedrigem Output können die tatsächlichen Kosten auf ein Minimum von nahezu 0,65 $ pro Million Token sinken. Wenn Ihr Geschäft nicht latenzempfindlich ist, ist die Umstellung auf Batch der kosteneffizienteste Migrationspfad.

Wichtige Punkte für Entwickler in China bei der Nutzung der Grok 4.3 API

Hier ist eine Checkliste für chinesische Teams, unterteilt in Technik, Compliance und Kosten.

Technische Anbindung

Erstens: Bevorzugen Sie einen stabilen API-Proxy-Dienst gegenüber einem selbst gehosteten Proxy. Die offizielle xAI-Schnittstelle erfordert eine stabile Verbindung ins Ausland; selbst gehostete Proxys neigen bei hoher Last zu Verbindungsabbrüchen. API-Proxy-Dienste verfügen über inländische Serverstandorte, was Latenz und Stabilität verbessert. Zweitens: Nach der Umstellung der base_url auf https://vip.apiyi.com/v1 sind keine Änderungen am SDK erforderlich – egal ob Python OpenAI SDK, Node.js openai-Paket oder Go go-openai, alles funktioniert direkt.

Compliance und Abrechnung

Erstens: Chinesische Teams können über API-Proxy-Dienste in RMB abrechnen, was Probleme mit ausländischen Kreditkarten und grenzüberschreitenden Zahlungen vermeidet. Zweitens: Proxy-Plattformen bieten meist nutzungsbasierte Abrechnung und Vorauszahlungen, was die Finanzprozesse für inländische Unternehmen vereinfacht. Drittens: Für die Compliance beim Datentransfer ins Ausland empfehlen wir, sensible Informationen auf Anwendungsebene zu anonymisieren und keine Kundendaten im Klartext an Reasoning-Modelle zu senden.

Kostenkontrolle

Erstens: Nutzen Sie den cached_input-Rabatt von Grok 4.3. Bei Szenarien mit langen, festen System-Eingabeaufforderungen kann der effektive Preis auf 0,31 $ pro Million Token gedrückt werden. Zweitens: Wickeln Sie alle nicht echtzeitkritischen Aufgaben über Batch ab, um weitere 20–50 % zu sparen. Drittens: Leiten Sie einfache Aufgaben an Grok 4 Fast weiter und nutzen Sie 4.3 nur für komplexe Reasoning-Aufgaben; so lassen sich die Gesamtkosten um 60–70 % senken.

🎯 Fazit für den Einsatz in China: Wir empfehlen chinesischen Teams den folgenden Pfad für Grok 4.3: API-Proxy-Dienst (APIYI apiyi.com) + OpenAI SDK + hybrides Modell-Routing + Priorisierung der Batch-API. Diese Kombination bietet sowohl Stabilität als auch Kostenkontrolle und hat sich bereits in mehreren SaaS-Produkten in China bewährt.

Zusammenfassung: Die wahre Bedeutung der Grok 4.3 API

Um auf unsere anfängliche Einschätzung zurückzukommen: Grok 4.3 ist kein Update im Sinne eines „intelligenteren Modells“, sondern eine Neudefinition der Kostenkurve für Reasoning-Modelle. Drei Zahlen verdeutlichen dies am besten: 1,25 $ Eingabepreis, 1 Mio. Kontextfenster und eine Ausgabegeschwindigkeit von 207 Token/Sekunde. Diese Kombination ist in der Kategorie der Reasoning-Modelle einzigartig.

Die besten Anwendungsszenarien für die Grok 4.3 API konzentrieren sich auf: Zusammenfassungen und Analysen langer Kontexte, strukturierte Verarbeitung mehrerer Videostreams, kollaborative Multi-Agenten-Workflows sowie echtzeitsensibles Reasoning mit hohem Durchsatz. Es ist kein direkter Ersatz für Claude Opus 4.7, aber für viele Aufgaben, die bisher mit Opus 4.7 erledigt wurden, bietet Grok 4.3 eine neue Option, die „12-mal günstiger ist und ein 5-mal größeres Kontextfenster“ bietet.

Für Entwickler in China ist der Zugang zur Grok 4.3 API bereits bestens etabliert. Wir empfehlen, die Anbindung und Tests direkt über die Plattform APIYI (apiyi.com) durchzuführen. Die base_url ist mit dem OpenAI-SDK kompatibel; als Modellbezeichner verwenden Sie einfach grok-4.3, ohne dass Codeanpassungen erforderlich sind. Über dieselbe Plattform können Sie zudem Claude Opus 4.7, GPT-5 und Gemini 3 Pro aufrufen, was direkte Vergleiche und hybride Orchestrierungen sehr komfortabel macht.

Die wahre Bewährungsprobe für Grok 4.3 kommt in der zweiten Jahreshälfte 2026: Werden OpenAI und Anthropic mit Preissenkungen nachziehen? Kann xAI die Lücke bei der dauerhaften Speicherung schließen? Und kann der 16-Agent-Heavy-Modus die Grenzen des Abonnement-Modells überwinden? Bis dahin ist dies eine der kosteneffizientesten Reasoning-APIs auf dem Markt, die jeder Entwickler von Agenten-Anwendungen einmal mit seinen eigenen, realen Daten testen sollte.

Referenzen

-

Offizielle xAI-Modelldokumentation: Modell-IDs, Preisgestaltung, Leistungsspezifikationen

- Link:

docs.x.ai/developers/models - Hinweis: Enthält vollständige API-Parameter und Abrechnungsregeln für Grok 4.3

- Link:

-

Offizielle xAI-News: Produktveröffentlichungen und Update-Ankündigungen

- Link:

x.ai/news - Hinweis: Grok 4.3-Launch-Event und Funktionsvorstellungen

- Link:

-

OpenRouter Echtzeit-Preistabelle: Vergleich verschiedener Modelle und historische Preisdaten

- Link:

openrouter.ai/x-ai/grok-4.3 - Hinweis: Echtzeit-Preise und Latenzüberwachung

- Link:

-

Artificial Analysis Intelligenz-Ranking: Umfassender Intelligenzindex und Geschwindigkeitsdaten

- Link:

artificialanalysis.ai/models/grok-4-3 - Hinweis: Vergleich nach AA-Index, Geschwindigkeit, Kontextfenster usw.

- Link:

-

APIYI-Dokumentation: Vollständiges Tutorial zur Anbindung von Grok 4.3 über einen API-Proxy-Dienst

- Link:

help.apiyi.com - Hinweis: Enthält Python/Node.js SDK-Beispiele und Abrechnungsinformationen

- Link:

Autor: APIYI Team — Spezialisiert auf API-Proxy-Dienste für große Sprachmodelle, die es Entwicklern ermöglichen, Grok 4.3, Claude Opus 4.7, GPT-5 und andere führende Modelle mit einem Klick aufzurufen. Besuchen Sie APIYI unter apiyi.com, um kostenloses Testguthaben zu erhalten.