ملاحظة من المؤلف: أطلقت Meta نموذجي Llama 4 Scout وMaverick، اللذين يعتمدان على بنية MoE متعددة الوسائط بشكل أصلي. يتميز Scout بنافذة سياق تصل إلى 10 ملايين رمز (token)، بينما يتفوق Maverick في التقييمات الشاملة على GPT-4o. يقدم هذا المقال تحليلاً عميقاً للتفاصيل التقنية وتأثيرها على المطورين.

أطلقت Meta رسمياً عائلة نماذج Llama 4، حيث أثار أول نماذج مفتوحة المصدر تعتمد على بنية MoE متعددة الوسائط بشكل أصلي، وهما Llama 4 Scout وMaverick، اهتماماً واسعاً في مجتمع الذكاء الاصطناعي. يقدم هذا المقال قراءة سريعة للتأثيرات بعيدة المدى لهذا الإنجاز على مطوري الذكاء الاصطناعي والصناعة ككل.

القيمة الجوهرية: تعرف في 3 دقائق على الاختراقات التقنية الأساسية، وأداء التقييم، والقيمة التطبيقية العملية لنموذجي Llama 4 Scout وMaverick.

نظرة سريعة على المعلومات الجوهرية لـ Llama 4 Scout وMaverick

| عنصر المعلومات | Llama 4 Scout | Llama 4 Maverick |

|---|---|---|

| تاريخ الإصدار | 5 أبريل 2025 | 5 أبريل 2025 |

| نوع البنية | MoE متعدد الوسائط أصلي | MoE متعدد الوسائط أصلي |

| المعلمات النشطة | 17 مليار | 17 مليار |

| عدد الخبراء | 16 خبيراً | 128 خبيراً |

| إجمالي عدد المعلمات | 109 مليار | 400 مليار |

| نافذة السياق | 10 ملايين رمز (token) | مليون رمز (token) |

| ترخيص المصدر المفتوح | ترخيص Llama | ترخيص Llama |

التموضع الاستراتيجي لـ Llama 4 Scout وMaverick

تعد Llama 4 الجيل الرابع من عائلة نماذج اللغة الكبيرة التي أطلقتها Meta، وهي أيضاً أول إصدار من سلسلة Llama يعتمد بنية متعددة الوسائط بشكل أصلي وخليط من الخبراء (MoE). مقارنة بسلسلة Llama 3 السابقة، خضعت Llama 4 لإعادة هيكلة جذرية على مستوى البنية.

يتموضع نموذج Scout كنموذج فعال لمعالجة النصوص الطويلة، حيث يوفر أطول نافذة سياق في الصناعة تصل إلى 10 ملايين رمز (token) بتكلفة استنتاج منخفضة للغاية. أما Maverick، فيتموضع كنموذج عام عالي الأداء، حيث حقق قدرات شاملة تتجاوز GPT-4o من خلال شبكة مكونة من 128 خبيراً.

تمت إتاحة أوزان كلا النموذجين للتحميل، ويمكن للمطورين الحصول عليها عبر llama.com ومنصة Hugging Face.

تحليل البنية التقنية لـ Llama 4 Scout و Maverick

بنية الوسائط المتعددة الأصلية (Early Fusion)

تكمن أكبر ابتكارات Llama 4 المعمارية في التدريب متعدد الوسائط الأصلي. وخلافاً للمقاربات السابقة التي كانت تعتمد على ربط وحدات الرؤية بنماذج اللغة في مراحل لاحقة، تتبنى Llama 4 منذ مرحلة التدريب المسبق نهج "الدمج المبكر" (Early Fusion)، حيث يتم دمج رموز (tokens) النصوص والصور بشكل موحد في الشبكة الرئيسية للنموذج.

وهذا يعني أن Llama 4 عند معالجة المحتوى المختلط بين الصور والنصوص، لا تعتمد على معالجة من مرحلتين "رؤية الصورة ثم التحدث"، بل تقوم فعلياً بفهم الصور والنصوص كمدخلات متكاملة لإجراء الاستنتاج.

آلية خليط الخبراء (MoE) في Llama 4

| التفاصيل التقنية | Scout (16 خبيراً) | Maverick (128 خبيراً) |

|---|---|---|

| إجمالي عدد المعلمات | 109 مليار | 400 مليار |

| المعلمات النشطة لكل استنتاج | 17 مليار معلمة | 17 مليار معلمة |

| عدد خبراء التوجيه | 16 + خبير مشترك | 128 + خبير مشترك |

| كفاءة الاستنتاج | تعمل على بطاقة H100 واحدة (INT4) | تعمل على جهاز H100 DGX واحد |

| بنية نافذة السياق | iRoPE (انتباه دون تداخل ترميز الموقع) | انتباه قياسي |

تكمن الميزة الأساسية لبنية MoE في أنه على الرغم من أن إجمالي عدد المعلمات يصل إلى 109 مليار و400 مليار على التوالي، إلا أنه يتم تفعيل 17 مليار معلمة فقط في كل عملية استنتاج. وهذا يسمح لنموذج Llama 4 Scout بالعمل على بطاقة NVIDIA H100 واحدة باستخدام تقنية التكميم INT4، مما يقلل بشكل كبير من متطلبات النشر.

بيانات التدريب وحجم Llama 4

وصل حجم بيانات تدريب Llama 4 إلى أكثر من 30 تريليون رمز (token)، وهو ضعف حجم بيانات Llama 3. كما أن حجم البيانات متعددة اللغات أكبر بـ 10 مرات من Llama 3، حيث تغطي 200 لغة. تم التدريب باستخدام دقة FP8، مما حقق كفاءة تدريب بلغت 390 TFLOPs لكل وحدة معالجة رسومية (GPU) في نموذج Behemoth.

أداء تقييم Llama 4 Scout و Maverick

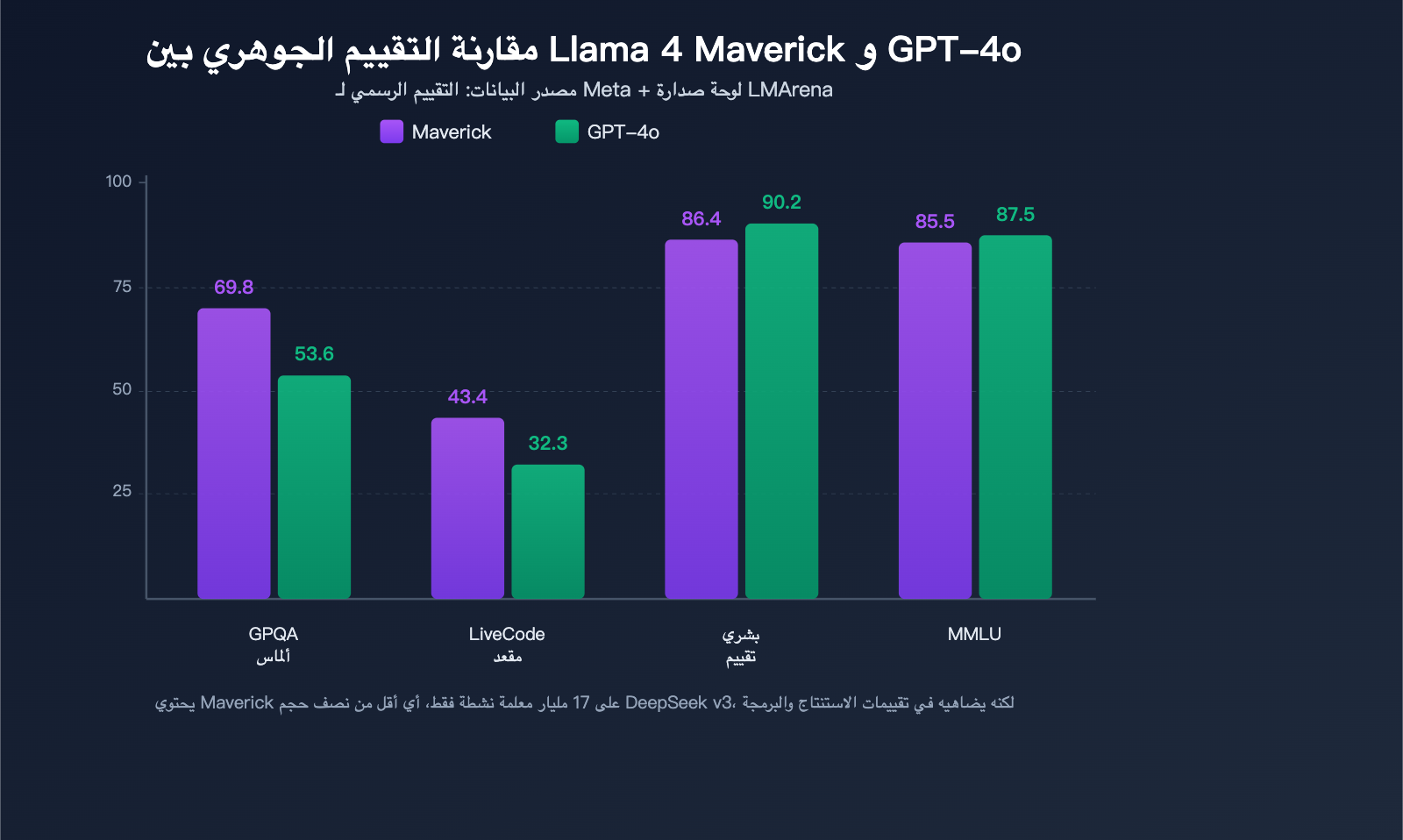

بيانات تقييم Llama 4 Maverick

يتفوق Maverick في العديد من اختبارات التقييم الموثوقة، حيث تتجاوز قدراته الشاملة كلًا من GPT-4o و Gemini 2.0 Flash:

| معيار التقييم | Llama 4 Maverick | GPT-4o | Gemini 2.0 Flash | التقييم |

|---|---|---|---|---|

| MMLU | 85.5 | ~87-88 | – | يقترب من القمة |

| GPQA Diamond | 69.8 | 53.6 | – | تفوق كبير |

| LiveCodeBench | 43.4 | 32.3 | – | تفوق ملحوظ |

| HumanEval | 86.4% | 90.2% | – | مستوى متقارب |

| LMArena ELO | 1417 | أقل من 1417 | أقل من 1417 | مستوى النخبة |

نقاط بارزة تستحق الاهتمام:

التفوق في الاستدلال العلمي (GPQA Diamond): سجل Maverick في اختبار GPQA Diamond درجة 69.8، متجاوزًا GPT-4o الذي سجل 53.6 بفارق يزيد عن 16 نقطة مئوية، مما يبرز قدراته القوية في الاستدلال التخصصي.

قدرات برمجية متميزة (LiveCodeBench): في اختبار البرمجة اللحظي LiveCodeBench، تفوق Maverick بـ 43.4 نقطة مقابل 32.3 لـ GPT-4o، كما تعادل مع DeepSeek v3 في مهام الاستدلال والبرمجة، مع العلم أن عدد المعاملات النشطة في Maverick يقل عن نصف ما لدى DeepSeek v3.

تصنيف النخبة في تقييم التفضيل البشري (LMArena): حصلت النسخة التجريبية من Maverick على تقييم 1417 ELO في LMArena (Chatbot Arena)، مما يضعه ضمن قائمة أفضل النماذج عالميًا.

أبرز نتائج تقييم Llama 4 Scout

باعتباره نموذجًا "صغيرًا" بـ 17 مليار معامل نشط فقط، يقدم Scout أداءً مثيرًا للإعجاب:

- يتفوق على Gemma 3 و Gemini 2.0 Flash-Lite و Mistral 3.1 في مجموعة واسعة من معايير التقييم.

- يتفوق على جميع نماذج Llama 3 من الجيل السابق، بما في ذلك Llama 3.3 70B الأكبر حجمًا.

- يتميز بأطول نافذة سياق في الصناعة تصل إلى 10 ملايين توكن، مما يسمح بمعالجة حوالي 7.5 مليون كلمة.

- يمكن تشغيله على بطاقة رسوميات H100 واحدة، مع تكلفة استدلال منخفضة للغاية.

🎯 نصيحة للمطورين: يدعم كل من Llama 4 Scout و Maverick واجهات برمجة التطبيقات المتوافقة مع OpenAI. إذا كنت بحاجة إلى اختبار التأثير الفعلي لهذه النماذج بسرعة، يمكنك الحصول على واجهة API موحدة عبر منصة APIYI (apiyi.com)، حيث يمكنك التبديل بين استدعاء نماذج مفتوحة ومغلقة المصدر باستخدام مفتاح API واحد فقط.

تأثير Llama 4 Scout و Maverick على المطورين

القيمة التطبيقية لنافذة السياق بسعة 10 ملايين رمز (Token)

تعد نافذة السياق بسعة 10 ملايين رمز في نموذج Scout الأطول بين النماذج المتاحة للجمهور حالياً، وتفتح هذه القدرة آفاقاً تطبيقية جديدة تماماً للمطورين:

- تحليل قواعد الأكواد البرمجية الكاملة: إمكانية إدخال مشاريع برمجية متوسطة إلى كبيرة الحجم بالكامل في النموذج لتحليلها دفعة واحدة.

- معالجة المستندات الطويلة: التعامل مع مئات الصفحات من الوثائق التقنية، العقود القانونية، أو الأوراق البحثية في عملية واحدة.

- ذاكرة المحادثات متعددة الجولات: الحفاظ على ذاكرة سياق طويلة للغاية في التطبيقات الحوارية.

- استخراج البيانات على نطاق واسع: استخراج المعلومات المهيكلة بكميات كبيرة من نصوص ضخمة غير مهيكلة.

تأثير Llama 4 على النظام البيئي مفتوح المصدر

| بُعد التأثير | التغيير المحدد | فوائد المطورين |

|---|---|---|

| عتبة النشر | يمكن تشغيل Scout على بطاقة واحدة | خفض تكاليف الأجهزة |

| قدرات النموذج | تتجاوز مستوى GPT-4o | النماذج مفتوحة المصدر تضاهي المغلقة |

| متعدد الوسائط | فهم أصيل للنصوص والصور | لا حاجة لوحدات رؤية إضافية |

| نافذة السياق | 10 ملايين رمز | سيناريوهات تطبيقية جديدة كلياً |

| التخصيص | إتاحة ضبط الأوزان (Fine-tuning) | تحسين الأداء للسيناريوهات المتخصصة |

يمثل إطلاق Llama 4 المرة الأولى التي تضاهي فيها النماذج مفتوحة المصدر النماذج التجارية المغلقة السائدة أو تتفوق عليها في القدرات الشاملة. بالنسبة للمطورين، يعني هذا:

ميزة التكلفة: الاعتماد على Llama 4 للنشر الخاص يمكن أن يقلل بشكل كبير من تكاليف استدعاء النموذج، وهو أمر مناسب بشكل خاص لسيناريوهات الإنتاج ذات الاستدعاء العالي.

حرية التخصيص: تعني الأوزان المفتوحة أن المطورين يمكنهم إجراء عمليات الضبط الدقيق، التكميم (Quantization)، والتقطير (Distillation) على Llama 4 لبناء نماذج مخصصة للقطاعات الرأسية.

ازدهار النظام البيئي: حظي Llama 4 في يوم إطلاقه بدعم العديد من منصات السحابة مثل AWS وGoogle Cloud وAzure وTogether.ai وGroq وFireworks وغيرها.

تكامل منصة Llama 4

قامت Meta بدمج Llama 4 في منصاتها الاجتماعية لتوفير قدرات متعددة الوسائط لمساعد Meta AI:

- WhatsApp: دعم إرسال الصور لتحليلها بواسطة الذكاء الاصطناعي وإجراء محادثات حولها.

- Messenger: تفاعل وأسئلة وأجوبة متعددة الوسائط.

- Instagram Direct: فهم الصور والمساعدة الإبداعية.

- Meta.ai: الاستخدام المباشر عبر متصفح الويب.

هذه هي المرة الأولى التي يتم فيها نشر نموذج لغة كبير بهذا الحجم مباشرة للمستهلكين، ليغطي مليارات المستخدمين.

Llama 4 Behemoth: النموذج الرائد الذي لا يزال قيد التدريب

بالإضافة إلى Scout وMaverick، كشفت Meta عن النموذج الرائد في عائلة Llama 4 وهو Behemoth:

| المعلمة | مواصفات Behemoth |

|---|---|

| المعلمات النشطة | 288 مليار |

| عدد الخبراء | 16 خبيراً |

| إجمالي عدد المعلمات | حوالي 2 تريليون |

| حالة التدريب | قيد التنفيذ |

وفقاً لبيانات نقاط التحقق المبكرة التي نشرتها Meta، تفوق Behemoth على GPT-4.5 وClaude Sonnet 3.7 وGemini 2.0 Pro في العديد من تقييمات مجالات العلوم والتكنولوجيا والهندسة والرياضيات (STEM). وقد اكتسب Maverick قدراته أثناء التدريب من خلال تقطير المعرفة من Behemoth، وهو ما يفسر تحقيق Maverick لأداء فائق بمعلمات نشطة أصغر.

💡 نصيحة للمتابعة: سيؤدي الإصدار النهائي لـ Behemoth إلى دفع سقف قدرات النماذج مفتوحة المصدر إلى أبعد من ذلك. يمكن للمطورين في المرحلة الحالية بناء تطبيقاتهم بناءً على Scout وMaverick، وإجراء اختبارات مقارنة بين النماذج على منصة APIYI apiyi.com، ثم الانتقال بسلاسة عند إطلاق Behemoth.

الوصول السريع إلى Llama 4 Scout و Maverick

مثال بسيط لاستدعاء API

من خلال واجهة متوافقة مع OpenAI، يمكنك استدعاء نموذج Llama 4 في 10 أسطر برمجية فقط:

import openai

# إعداد العميل للاتصال بـ APIYI

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# استدعاء النموذج

response = client.chat.completions.create(

model="meta-llama/llama-4-maverick",

messages=[{"role": "user", "content": "اشرح مبدأ عمل بنية MoE"}]

)

print(response.choices[0].message.content)

عرض مثال لاستدعاء متعدد الوسائط

import openai

import base64

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# قراءة الصورة المحلية وترميزها

with open("image.jpg", "rb") as f:

image_data = base64.b64encode(f.read()).decode()

# استدعاء النموذج مع صورة

response = client.chat.completions.create(

model="meta-llama/llama-4-maverick",

messages=[{

"role": "user",

"content": [

{"type": "text", "text": "يرجى وصف محتوى هذه الصورة"},

{"type": "image_url", "image_url": {

"url": f"data:image/jpeg;base64,{image_data}"

}}

]

}]

)

print(response.choices[0].message.content)

🚀 ابدأ بسرعة: نوصي بالحصول على مفتاح API ورصيد تجريبي مجاني عبر منصة APIYI (apiyi.com). تدعم المنصة واجهة موحدة لاستدعاء نماذج Llama 4 Scout و Maverick وغيرها من النماذج الرائدة، مما يسهل عليك مقارنة أداء النماذج المختلفة عملياً.

الأسئلة الشائعة

س1: كيف أختار بين Llama 4 Scout و Maverick؟

إذا كنت بحاجة إلى معالجة نصوص طويلة جداً (مثل قواعد الأكواد البرمجية الكاملة أو تحليل المستندات الطويلة)، اختر Scout (نافذة سياق تصل إلى 10 ملايين توكن). أما إذا كنت تبحث عن نموذج عام يتمتع بأقوى قدرات شاملة، فاختر Maverick (يحتوي على 128 خبيراً، ويتفوق في التقييمات على GPT-4o). يمكنك اختبار أداء كل منهما عملياً عبر منصة APIYI (apiyi.com) لاتخاذ القرار الأنسب.

س2: هل Llama 4 مجاني بالكامل؟

يستخدم Llama 4 ترخيص Llama الذي يتيح الوصول إلى الأوزان ويسمح بالاستخدام التجاري. ومع ذلك، يجب على الشركات التي يتجاوز عدد مستخدميها النشطين شهرياً 700 مليون مستخدم التقدم بطلب للحصول على ترخيص خاص من Meta. بالنسبة للغالبية العظمى من المطورين والشركات، يمكن استخدامه مجاناً. وإذا كنت لا ترغب في نشره ذاتياً، يمكنك استدعاؤه عبر API حسب الطلب من خلال منصات طرف ثالث مثل APIYI (apiyi.com).

س3: هل Llama 4 Maverick أقوى حقاً من GPT-4o؟

في تقييمات رئيسية مثل GPQA Diamond (للاستدلال العلمي) و LiveCodeBench (للبرمجة اللحظية)، يتفوق Maverick بالفعل بشكل ملحوظ على GPT-4o. أما في تقييمي MMLU و HumanEval، فكلاهما متقاربان. وفي تقييم التفضيل البشري LMArena، حقق Maverick أيضاً درجات ELO عالية جداً. بشكل عام، يقع Maverick في نفس فئة GPT-4o في التقييمات الشاملة، بل ويتفوق عليه في بعض المؤشرات.

ملخص

النقاط الجوهرية حول Llama 4 Scout و Maverick:

- ابتكار في البنية: أول نماذج لغة كبيرة مفتوحة المصدر تعتمد على بنية "خليط الخبراء" (MoE) ومتعددة الوسائط بشكل أصلي، حيث تحقق بنية "الدمج المبكر" (Early Fusion) فهماً حقيقياً وموحداً للنصوص والصور.

- قفزة في الأداء: يتفوق Maverick على GPT-4o في اختبار GPQA Diamond بأكثر من 16 نقطة مئوية، بينما يتفوق Scout بـ 17 مليار معامل نشط على نموذج Llama 3.3 70B.

- تحول في التطبيقات: نافذة سياق تصل إلى 10 ملايين رمز (token) وأوزان مفتوحة المصدر، مما يفتح آفاقاً جديدة للمطورين في سيناريوهات التطبيقات ونشر النماذج.

يمثل إصدار Llama 4 دخول نماذج اللغة الكبيرة مفتوحة المصدر إلى حقبة جديدة تماماً. سواء كنت تبني تطبيقات على مستوى المؤسسات أو مشاريع شخصية، يمكنك الاستفادة من Llama 4 للحصول على قدرات تضاهي أفضل النماذج المغلقة. نوصي بتجربة سلسلة نماذج Llama 4 بسرعة عبر APIYI (apiyi.com)، حيث توفر المنصة رصيداً مجانياً وواجهة موحدة لاستدعاء النماذج، مما يساعد المطورين على اختيار النموذج الأنسب بكفاءة.

📚 المراجع

-

مدونة Meta AI الرسمية – إعلان إصدار Llama 4: المصدر الموثوق للتفاصيل التقنية للنماذج وبيانات التقييم.

- الرابط:

ai.meta.com/blog/llama-4-multimodal-intelligence - ملاحظة: تتضمن مقدمة كاملة عن البنية، وبيانات التقييم، وتفاصيل الإصدار.

- الرابط:

-

موقع Llama الرسمي – تحميل النماذج: للحصول على أوزان نموذج Llama 4 والوثائق الخاصة به.

- الرابط:

llama.com/models/llama-4 - ملاحظة: يوفر إمكانية تحميل النماذج، ومعلومات الترخيص، والوثائق التقنية.

- الرابط:

-

Hugging Face – مكتبة نماذج Llama 4: دليل الاستضافة والاستخدام في مجتمع المصادر المفتوحة.

- الرابط:

huggingface.co/meta-llama - ملاحظة: يوفر بطاقات النماذج، والنسخ المكممة (quantized)، ونقاشات المجتمع.

- الرابط:

الكاتب: الفريق التقني لـ APIYI

تبادل الخبرات: نرحب بمناقشة تجاربكم مع Llama 4 في قسم التعليقات، ولمزيد من المعلومات حول دمج نماذج الذكاء الاصطناعي، يمكنكم زيارة مركز توثيق APIYI عبر الرابط docs.apiyi.com.