Replicate Alternative:當「冷啓動」成爲生產環境的致命瓶頸

Replicate 是開發者社區中知名的 ML 模型託管平臺,憑藉簡潔的 API 和海量社區模型贏得了廣泛認可。但在生產環境中,一個架構層面的問題持續困擾着開發者:冷啓動延遲可達 10-60 秒以上,對於需要實時響應的應用來說,這是無法接受的。

更關鍵的是,Replicate 的按計算時間計費模式讓成本變得不可預測——同一個模型在不同時段、不同負載下的費用可能相差數倍。再加上失敗的調用仍然計費、私有部署產生閒置成本,開發者不得不開始搜索「replicate alternative」。

核心價值: 看完本文,你將理解 API易 在冷啓動、成本可預測性、失敗調用策略上與 Replicate 的根本差異——零冷啓動,NB Pro 固定 $0.05/次,失敗不收費。

<!– 左側: API易 –>

<!– 中間 VS –>

<!– 右側: Replicate –>

<!– 底部 –>

API易 vs Replicate 核心差異:7 維度全面對比

| 對比維度 | API易 (APIYI) | Replicate | 勝出 |

|---|---|---|---|

| 冷啓動 | 零延遲 / 即時響應 | 公共模型常見 10-60 秒冷啓動 | API易 ✅ |

| 定價模型 | 固定價格(媒體)/ Token(對話) | 計算時間 × 硬件類型,按秒計費 | API易 ✅ |

| 閒置成本 | 無 | 私有部署有閒置成本(~$99/天) | API易 ✅ |

| 失敗調用收費 | 退還 / 不收費 | 已消耗的計算時間仍收費 | API易 ✅ |

| Playground | 有,支持所有模型在線測試 | Web UI(基礎) | API易 ✅ |

| LLM 支持 | 商業模型(Claude/GPT/Gemini) | 僅開源模型(Llama/Mistral) | API易 ✅ |

| 平臺定位 | 統一多模態平臺 | 模型託管平臺 | API易 ✅ |

🎯 選型建議: 如果你需要即時響應、固定成本、商業 LLM 支持的 AI API 平臺,API易 apiyi.com 從架構層面解決了 Replicate 的冷啓動問題,同時提供遠低於 Replicate 的固定價格。

Replicate Alternative 對比維度一:冷啓動——生產環境的頭號敵人

Replicate 的冷啓動問題

冷啓動是 Replicate 用戶的第一大痛點。當一個模型一段時間未被調用時,GPU 資源會被釋放。下次請求到來時,模型需要重新加載到 GPU 上:

| 模型類型 | 冷啓動時間 | 說明 |

|---|---|---|

| 小型圖像分類器 | 10-15 秒 | 最快的冷啓動場景 |

| SDXL / FLUX 圖像生成 | 15-30 秒 | 中等等待時間 |

| 大型 LLM(Llama 70B) | 30-60+ 秒 | 接近 1 分鐘 |

| 視頻生成模型 | 60+ 秒 | 最慢,大型權重文件 |

對用戶的影響: 如果你在電商應用中使用 AI 圖像生成,用戶點擊「生成產品圖」後需要等待 30 秒纔看到響應——這遠超用戶的耐心閾值(通常 3-5 秒)。

Replicate 的解決方案: 提供「Deployments」(私有部署),保持實例常駐。但這引入了新問題——閒置成本。一臺 A100 (40GB) 的 Deployment 全天候運行成本約 $99/天($2,970/月),即使沒有任何請求。

API易 的零冷啓動

API易 完全沒有冷啓動問題:

- 所有模型即時響應,無加載等待

- NB Pro 作爲平臺日消耗第一的主力模型,始終保持熱狀態

- 無需爲避免冷啓動而支付閒置成本

- 首次請求和後續請求的響應時間一致

💡 架構差異: Replicate 是 Serverless GPU 計算平臺——模型按需加載到 GPU 上,因此存在冷啓動。API易 是 API 中轉平臺——直接連接上游模型提供商的常駐服務,從架構上就不存在冷啓動問題。這不是優化的差異,而是根本架構的不同。

Replicate Alternative 對比維度二:定價模型與成本可預測性

Replicate 的計算時間計費

Replicate 按計算時間 × 硬件類型計費,按秒收費:

| GPU 類型 | 每秒費用 | 每小時費用 |

|---|---|---|

| CPU | $0.0001/秒 | $0.36/小時 |

| Nvidia T4 | $0.000225/秒 | $0.81/小時 |

| Nvidia A40 | $0.000463/秒 | $1.67/小時 |

| Nvidia A100 (40GB) | $0.00115/秒 | $4.14/小時 |

| Nvidia A100 (80GB) | $0.0014/秒 | $5.04/小時 |

| Nvidia H100 | $0.0032/秒 | $11.52/小時 |

成本不可預測的原因:

- 同一模型在不同負載下的計算時間不同

- 冷啓動時間可能被計入(取決於模型)

- 分辨率、步數、參數不同導致耗時差異

- 高峯期 GPU 排隊導致總耗時增加

Replicate 上圖像生成的實際成本:

- FLUX.1 schnell: ~$0.003-0.005/張

- FLUX.1 dev: ~$0.01-0.03/張

- FLUX.1 pro: ~$0.05-0.07/張

- SDXL: ~$0.005-0.015/張

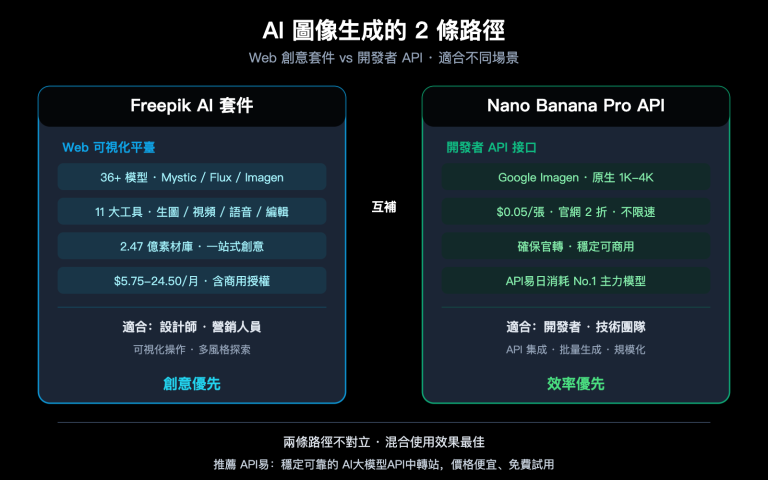

API易 的固定價格

API易 的圖像生成採用固定價格,簡單透明:

| 模型 | API易 價格 | 說明 |

|---|---|---|

| NB Pro(1K-4K) | $0.05/次 | 全分辨率統一價,官網 2 折 |

| NB 2 | $0.035/次 | 速度更快,價格更低 |

成本完全可預測: 調用前就知道精確費用,不受計算時間、GPU 負載、冷啓動影響。

<!– API易 NB Pro –>

<!– Replicate FLUX schnell –>

<!– Replicate FLUX dev –>

<!– Replicate FLUX pro –>

<!– Replicate SDXL –>

<!– 說明框 –>

💰 成本對比: API易 NB Pro $0.05/次可生成 4K 超高清圖片,畫質水平(Gemini 3 Pro 架構)遠超 Replicate 上同價位的 FLUX.1 pro。通過 API易 apiyi.com 註冊即可獲取免費測試額度。

Replicate Alternative 對比維度三:隱性成本——閒置費和失敗收費

Replicate 的兩大隱性成本

1. 閒置成本(Deployments)

爲解決冷啓動問題,你必須使用 Deployments 保持實例常駐:

| GPU | 月閒置成本 | 說明 |

|---|---|---|

| A40 | ~$1,200/月 | 最低配置 |

| A100 (40GB) | ~$2,970/月 | 常用配置 |

| A100 (80GB) | ~$3,629/月 | 大模型需要 |

| H100 | ~$8,294/月 | 高性能需求 |

即使深夜沒有任何請求,這些費用照常產生。

2. 失敗調用仍收費

- 模型開始處理後失敗 → 按已消耗計算時間收費

- 用戶取消請求 → 按取消前已消耗時間收費

- 對於實驗性模型或不穩定的社區模型,失敗率可達 5-15%

API易 的零隱性成本

- 零閒置成本: 不使用不產生任何費用

- 失敗不收費: 服務端錯誤不收費,保護用戶利益

- 無冷啓動附加費: 不需要爲避免冷啓動支付額外成本

🚀 實際影響: 假設你使用 Replicate A100 Deployment 避免冷啓動,每月閒置成本 $2,970。即使你每月只生成 5,000 張圖片,光閒置成本就相當於每張圖 $0.594。加上計算費用,實際單價遠高於 API易 的 $0.05/次。在 API易 apiyi.com 上,5,000 張圖總費用僅 $250。

Replicate Alternative 對比維度四:LLM 能力——商業模型 vs 僅開源

Replicate 的 LLM 侷限

Replicate 僅支持開源 LLM:

- Meta Llama 系列(Llama 2/3/3.1)

- Mistral / Mixtral

- Phi、Vicuna 等

- 不支持: GPT-4o、Claude、Gemini Pro 等商業模型

對於需要最頂級推理能力的應用(複雜代碼生成、專業寫作、高級分析),開源模型與商業模型之間仍有明顯差距。

API易 的全棧 LLM 支持

API易 原生支持所有主流商業和開源 LLM:

- Claude 全系列(Opus/Sonnet/Haiku)

- GPT-4o、GPT-4.1 等 OpenAI 模型

- Gemini Pro 全系列

- DeepSeek、Qwen 等

- 統一接口,一個 Key 調用全部

| LLM 能力 | API易 | Replicate |

|---|---|---|

| Claude Opus/Sonnet | ✅ 原生支持 | ❌ 不可用 |

| GPT-4o | ✅ 原生支持 | ❌ 不可用 |

| Gemini Pro | ✅ 原生支持 | ❌ 不可用 |

| Llama / Mistral | ✅ 支持 | ✅ 支持 |

| 與圖像生成統一接口 | ✅ 一個 Key | ❌ 需另找 LLM 服務 |

💡 架構建議: 如果你的應用需要「GPT/Claude 對話 + NB Pro 圖像生成」,在 Replicate 上你需要分別接入兩個不同平臺並管理兩套 API Key。在 API易 apiyi.com 上,一個 Key 即可統一調用。

Replicate Alternative 對比維度五:集成體驗

Replicate 的集成方式

# Replicate 調用圖像生成

import replicate

output = replicate.run(

"stability-ai/sdxl:latest",

input={

"prompt": "A cat sitting on a windowsill",

"width": 1024,

"height": 1024

}

)

# 返回 URL 列表,需要額外下載

注意事項:

- 返回的是臨時 URL,需要自行下載存儲

- 異步模型需要輪詢或使用 Webhook

- 冷啓動期間請求會被阻塞

API易 的集成方式

# API易 調用 NB Pro —— Google 官方 SDK,零冷啓動

import google.generativeai as genai

genai.configure(

api_key="your-apiyi-key",

client_options={"api_endpoint": "api.apiyi.com"}

)

model = genai.GenerativeModel("gemini-3-pro-image-preview")

response = model.generate_content(

"一隻貓坐在窗臺上看雨,溫暖的室內燈光",

generation_config=genai.GenerationConfig(

response_modalities=["TEXT", "IMAGE"],

image_config={"image_size": "4K", "aspect_ratio": "16:9"}

)

)

# 直接返回 Base64 圖片數據,無需額外下載

- Google 官方文檔:

ai.google.dev/gemini-api/docs/image-generation - 在線出圖測試:

imagen.apiyi.com - 示例代碼下載:

xinqikeji.feishu.cn/wiki/W4vEwdiCPi3VfTkrL5hcVlDxnQf

🎯 技術建議: API易 apiyi.com 兼容 Google 官方

generateContent格式,意味着你可以直接使用 Google 官方文檔和社區資源進行開發。結果直接返回 Base64 數據,無需臨時 URL 下載和存儲邏輯。

<!– 表頭 –>

<!– 行1: Cold Boots –>

<!– 行2: Pricing Model –>

<!– 行3: Idle Costs –>

<!– 行4: Failed Run Charges –>

<!– 行5: Playground –>

<!– 行6: LLM Generation –>

<!– 行7: Platform Scope –>

Replicate Alternative 場景推薦

選擇 API易 的場景

- 實時響應應用: 零冷啓動,即時返回結果

- NB Pro / NB2 圖像生成: $0.05/次固定價,畫質頂級

- 需要商業 LLM: Claude/GPT/Gemini + 圖像生成一站式

- 成本敏感項目: 固定價格,無閒置費、無失敗收費

- 商用部署: 核心模型專項運維,穩定可商用

- 預算可控: 固定價格讓財務預算完全可預測

選擇 Replicate 的場景

- 需要社區開源模型: Replicate 有大量社區上傳的特定模型

- LoRA 微調需求: Replicate 支持 SDXL/Llama 等模型的在線微調

- 自定義模型部署: 通過 Cog 容器打包自己的模型

- 純開源技術棧: 項目要求不依賴商業 API

其他 Replicate Alternative 參考

| 替代方案 | 定位 | 優勢 | 侷限 |

|---|---|---|---|

| API易 | 全棧 AI API 平臺 | 零冷啓動、NB Pro 2 折、商業 LLM | 不支持自定義模型部署 |

| Fal.ai | 媒體生成推理 | 高速推理、600+ 模型 | 計算時間計費 |

| Together AI | 開源模型推理 | FP8 降本、高吞吐 | 圖像生成能力有限 |

| Modal | Serverless GPU | 冷啓動比 Replicate 快 | 仍有冷啓動問題 |

| RunPod | GPU 租賃 | 完全控制、透明定價 | 需自行管理基礎設施 |

常見問題

Q1: API易 的 NB Pro 畫質能和 Replicate 上的 FLUX Pro 比嗎?

NB Pro 基於 Google Gemini 3 Pro 架構,在文字渲染、指令遵循、世界知識方面優於 FLUX Pro。FLUX Pro 在藝術風格靈活性上有優勢。兩者價格接近(API易 NB Pro $0.05 vs Replicate FLUX Pro ~$0.05-0.07),但 API易 的 NB Pro 支持 4K 且同價,FLUX Pro 在 Replicate 上高分辨率成本更高。可以在 imagen.apiyi.com 在線測試 NB Pro 出圖效果後再決定。

Q2: Replicate 的冷啓動在實際中有多嚴重?

非常嚴重。對於公共模型(不使用 Deployments),首次調用或長時間未調用後的請求可能等待 10-60 秒。即使是常用模型如 SDXL,冷啓動也需要 15-20 秒。要消除冷啓動需要使用 Deployments(~$2,970/月起),對中小團隊來說成本過高。API易 apiyi.com 完全沒有冷啓動問題,因爲架構本身就是直連常駐服務。

Q3: 從 Replicate 遷移到 API易 需要改多少代碼?

核心改動是將 replicate.run() 調用替換爲 Google 官方 SDK 的 generateContent 調用。代碼結構會有變化(從 Replicate 的 URL 返回模式改爲 Base64 數據返回),但代碼量通常更少。參考 Google 官方文檔 ai.google.dev/gemini-api/docs/image-generation,典型遷移可在 1-2 小時內完成。通過 API易 apiyi.com 獲取免費測試額度,先驗證再遷移。

總結:Replicate Alternative 選型核心建議

在「replicate alternative」的選型中,API易 與 Replicate 的核心差異在於架構層面:

- 零冷啓動: API易 直連常駐服務 vs Replicate Serverless GPU 需要冷啓動 10-60 秒

- 固定價格: API易 NB Pro $0.05/次(1-4K 同價)vs Replicate 按計算時間浮動計費

- 零隱性成本: 無閒置費、失敗不收費 vs Replicate Deployments ~$2,970/月 + 失敗仍收費

- 商業 LLM: Claude/GPT/Gemini 原生支持 vs Replicate 僅開源模型

- 統一平臺: 一個 Key 調用 LLM + 圖像 vs Replicate 需另找 LLM 服務

Nano Banana Pro 是 API易 日消耗第一的主力模型,平臺投入大量運維資源確保穩定可商用。推薦通過 API易 apiyi.com 接入,在 imagen.apiyi.com 在線體驗出圖效果。

技術支持: API易 apiyi.com —— 穩定可靠的 AI 大模型 API 中轉平臺,零冷啓動、固定價格、穩定可商用