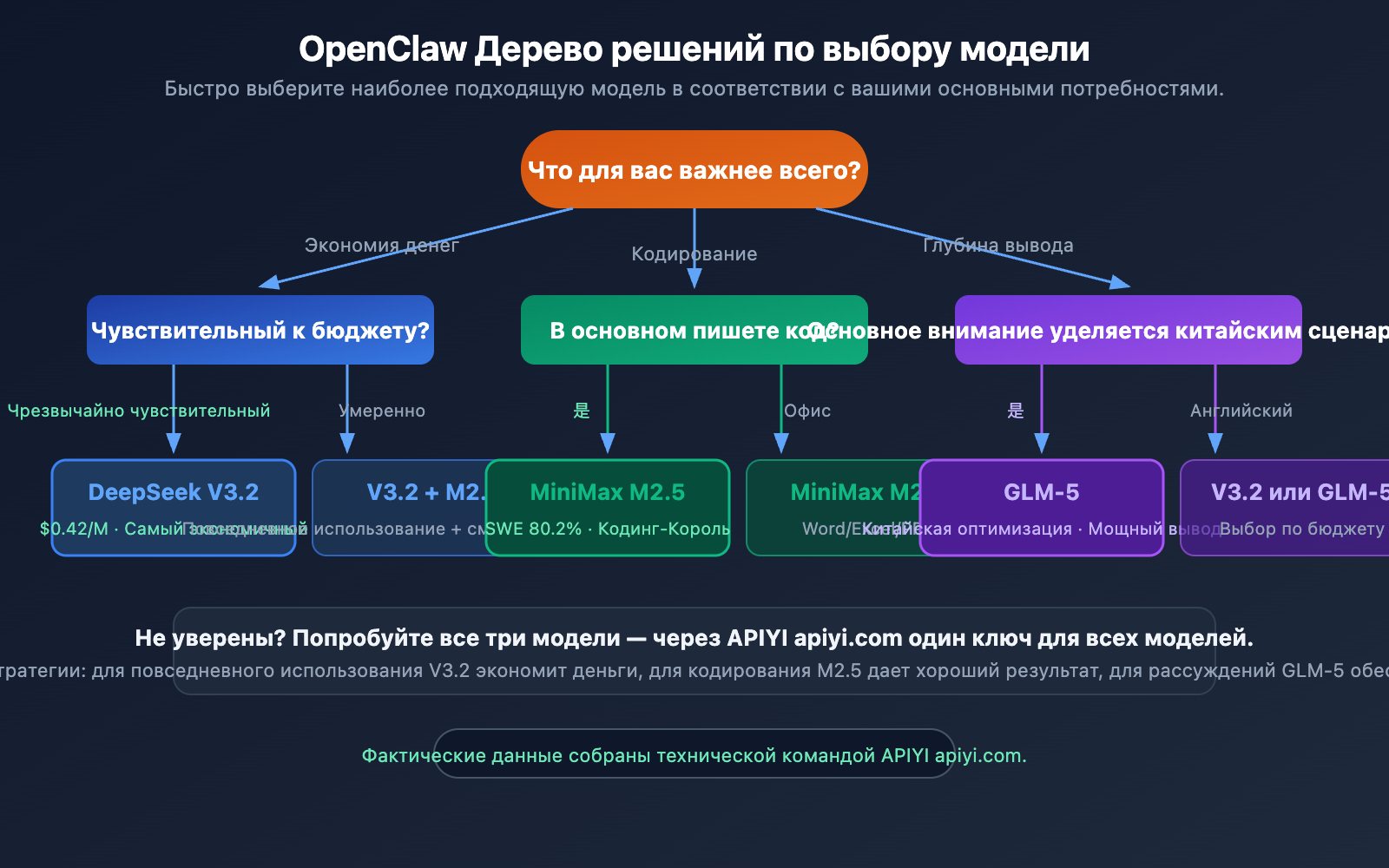

Какую большую языковую модель выбрать для OpenClaw с наилучшим соотношением цены и качества? Это один из самых частых вопросов от наших клиентов. В этой статье мы сравним три модели с высокой стоимостью: DeepSeek V3.2, MiniMax M2.5 и GLM-5 по трём ключевым параметрам: цена, производительность и способность к вызову инструментов Agent, чтобы помочь вам найти идеального партнёра для OpenClaw.

Основная ценность: Общая черта этих трёх моделей — дешевизна и практичность — их цена составляет лишь от одной десятой до одной двадцатой от стоимости GPT-5 / Claude Opus, но они демонстрируют отличные результаты в сценариях Agent, таких как кодирование и вызов инструментов. Прочитав эту статью, вы будете точно знать, какую модель выбрать в разных ситуациях.

Сравнение ключевых параметров трёх моделей с высокой стоимостью-эффективностью

Сначала посмотрим на самые важные данные — комплексное сравнение цены и производительности.

| Критерий сравнения | DeepSeek V3.2 | MiniMax M2.5 | GLM-5 | GPT-5 (для справки) |

|---|---|---|---|---|

| Цена ввода | $0.28/M | $0.29/M | $0.80/M | $5.00/M |

| Цена вывода | $0.42/M | $1.20/M | $2.56/M | $15.00/M |

| Контекстное окно | 128K | 205K | 202K | 128K |

| SWE-Bench | 70% | 80.2% | 77.8% | 72% |

| AIME (математика) | 94.2% | — | 84% | 86% |

| Вызов инструментов | ✅ Интеграция размышления и инструментов | ✅ BFCL 76.8% | ✅ Оптимизация для агентов | ✅ |

| Лицензия | MIT | Открытые веса | Открытые веса | Проприетарная |

| Количество параметров | Архитектура MoE | — | 744B / 40B активных | — |

| Доступен в OpenClaw | ✅ | ✅ | ✅ | ✅ |

Ключевой вывод: Цена вывода DeepSeek V3.2 составляет всего $0.42/M, что делает её самой дешёвой среди трёх моделей. MiniMax M2.5 показывает наилучшие результаты в задачах программирования (SWE-Bench 80.2%). GLM-5 обладает уникальными преимуществами в математических рассуждениях и длительных задачах для агентов.

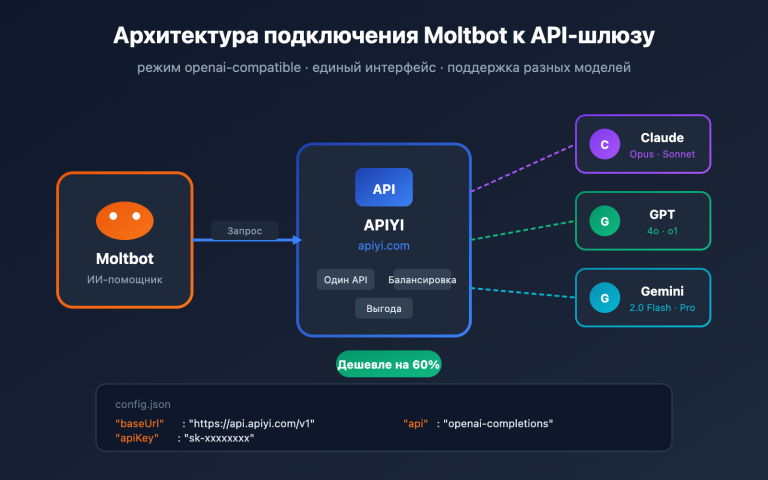

🎯 Рекомендация по выбору: Все три модели можно подключить к OpenClaw через единую платформу APIYI apiyi.com, используя единый формат API, без необходимости регистрироваться у нескольких поставщиков. Платформа позволяет переключаться между моделями в любое время, что удобно для практического сравнительного тестирования.

DeepSeek V3.2: Самый доступный универсальный выбор для OpenClaw

DeepSeek V3.2 — это флагманская модель, выпущенная в декабре 2025 года. Благодаря исключительному соотношению цены и качества она стала одним из самых популярных выборов в сообществе OpenClaw.

Ключевые преимущества DeepSeek V3.2

Потрясающее ценовое преимущество: Ввод — $0.28/M, вывод — $0.42/M, что примерно в двадцать раз дешевле GPT-5. Даже продвинутый вариант V3.2-Speciale ($0.40/$1.20) стоит лишь малую часть от цен основных моделей на рынке.

Выдающиеся возможности агента: V3.2 — первая модель, которая напрямую интегрировала «размышление» в процесс вызова инструментов. Она поддерживает вызов инструментов как в режиме размышления, так и без него, что очень важно для выполнения Skill в OpenClaw.

Технологические инновации: Использует DeepSeek Sparse Attention (DSA), что снижает затраты памяти на KV Cache более чем на 93%, обеспечивая эффективный инференс даже при контекстном окне в 128K токенов.

Производительность DeepSeek V3.2 в OpenClaw

| Сценарий | Производительность | Оценка |

|---|---|---|

| Повседневный диалоговый помощник | Плавный, точный | ⭐⭐⭐⭐⭐ |

| Генерация/отладка кода | Высокая, уровень золотой медали IMO | ⭐⭐⭐⭐ |

| Вызов инструментов (Skill) | Интеграция размышления и инструментов | ⭐⭐⭐⭐⭐ |

| Обработка длинных документов | Контекст 128K, эффективно | ⭐⭐⭐⭐ |

| Математика/рассуждения | AIME 94.2% | ⭐⭐⭐⭐⭐ |

| Среднемесячная стоимость | $1-5 (лёгкое использование) | 💰 Самый экономный |

💡 Отзывы пользователей: Множество пользователей OpenClaw на нашей платформе выбирают DeepSeek V3.2 в качестве основной модели для повседневных задач. При лёгком использовании среднемесячные затраты составляют всего $1-3. Подключение через APIYI apiyi.com не требует регистрации официального аккаунта DeepSeek и поддерживает пополнение через Alipay.

MiniMax M2.5: Лучший выбор для кодирующего агента OpenClaw

MiniMax M2.5, выпущенный в феврале 2026 года, демонстрирует впечатляющие результаты в задачах кодирования и работы агентов.

Ключевые преимущества MiniMax M2.5

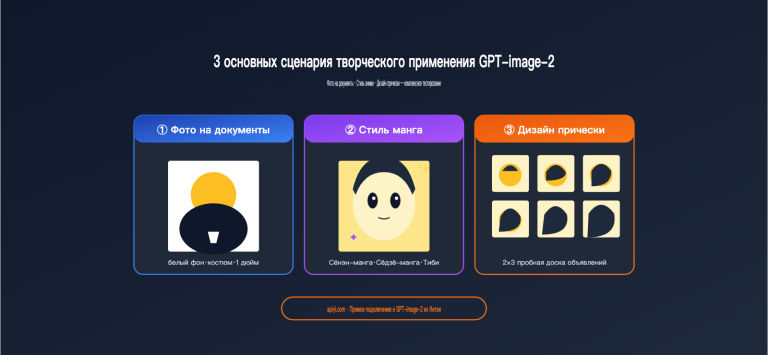

Передовые возможности кодирования: SWE-Bench Verified 80.2%, наравне с Claude Opus 4.6 и значительно опережая GPT-5. На Multi-SWE-Bench (исправление кода в нескольких файлах) также достигает 51.3%.

Мышление архитектора: Перед написанием кода M2.5, подобно опытному архитектору ПО, активно декомпозирует и планирует структуру функций, дизайн UI, а не начинает писать код сразу. Такой подход «сначала подумай, потом делай» идеально подходит для сложных задач OpenClaw.

Мультиязычное программирование: Прошел обучение с подкреплением в реальной среде на более чем 20 тыс. примеров для 10+ языков, включая Go, C/C++, TypeScript, Rust, Kotlin, Python, Java.

Работа с офисными документами: Может бегло генерировать и работать с файлами Word, Excel, PowerPoint, плавно переключаясь между различными программными средами.

Лучшие варианты использования MiniMax M2.5 в OpenClaw

- Поддержка репозиториев кода: SWE-Bench 80.2%, наравне с Opus, идеально подходит для автоматического исправления багов в OpenClaw.

- Поиск в браузере: BrowseComp 76.3%, отлично работает в связке с навыком Agent Browser Skill.

- Офисная автоматизация: Генерация Word/Excel/PPT, подходит для сценариев автоматизации офисных задач.

- Многошаговые задачи: Скорость выполнения задач на 37% выше, чем у предыдущего поколения, соответствует скорости Opus 4.6.

🚀 Быстрый старт: Хотите сравнить реальную производительность MiniMax M2.5 и DeepSeek V3.2? Через APIYI apiyi.com можно переключаться между двумя моделями с одним API-ключом, без отдельных регистраций, и быстро сравнить качество генерации изображений и кода.

GLM-5: Экономичный выбор для сложных задач рассуждений в OpenClaw

GLM-5, выпущенный компанией Zhipu AI в феврале 2026 года, представляет собой модель с открытыми весами на 744B параметров, демонстрирующую выдающиеся результаты в длительных задачах агентов и точности фактов.

Ключевые преимущества GLM-5

Огромное количество параметров: 744B общих параметров, 40B активных параметров (архитектура MoE), что обеспечивает больший объем знаний при сохранении эффективного вывода.

Математика и логические рассуждения: Результат на AIME 2025 — 84%, на бенчмарке MATH — 88%, высокая надежность в сценариях, требующих глубоких рассуждений.

Оптимизация для длительных задач агентов: Контекстное окно в 202K токенов, оптимизировано для долгосрочного планирования задач и многошагового выполнения агентами.

DeepSeek Sparse Attention: Как и DeepSeek V3.2, использует технологию DSA, сохраняя эффективность при сверхдлинном контексте.

Анализ стоимости GLM-5

| Уровень использования | Месячная стоимость GLM-5 | Месячная стоимость DeepSeek V3.2 | Разница |

|---|---|---|---|

| Легкий (1M токенов/мес) | ~$3.4 | ~$0.7 | в 4.8 раза |

| Средний (10M токенов/мес) | ~$34 | ~$7 | в 4.8 раза |

| Интенсивный (100M токенов/мес) | ~$340 | ~$70 | в 4.8 раза |

Стоимость GLM-5 примерно в 5 раз выше, чем у DeepSeek V3.2, но при этом составляет лишь пятую часть стоимости GPT-5. В сценариях, требующих более мощных возможностей рассуждений, эта надбавка оправдана.

Лучшие варианты использования GLM-5 в OpenClaw

- Сложные логические рассуждения: Проблемы, требующие многошагового логического анализа, такие как анализ данных и генерация отчетов.

- Обработка длинных документов: Контекстное окно в 202K токенов для обработки длинных документов, обобщения статей.

- Точность фактов: Стабильные результаты в сценариях, требующих высокой фактической точности.

- Многошаговые задачи агентов: Надежность в долгосрочном планировании и выполнении задач выше, чем у V3.2.

💡 Практический опыт: Судя по отзывам клиентов, GLM-5 показывает более естественные результаты в китайских сценариях по сравнению с двумя другими моделями, поскольку Zhipu AI провела значительную оптимизацию для китайского языка. Если ваш OpenClaw в основном обрабатывает задачи на китайском, GLM-5 определенно стоит рассмотреть.

Расчёт фактических затрат на использование трёх моделей

При выборе модели важно смотреть не только на стоимость токена, но и на реальные ежемесячные расходы при разных сценариях использования. Ниже приведены данные на основе реального потребления клиентов нашей платформы:

Типичные сценарии использования OpenClaw

| Тип пользователя | Сообщений в день | Токенов в месяц | DeepSeek V3.2 | MiniMax M2.5 | GLM-5 |

|---|---|---|---|---|---|

| Личный, лёгкий | 20 | ~2M | $0.6 | $1.8 | $4.3 |

| Личный, активный | 100 | ~10M | $3 | $9 | $21 |

| Командный | 500 | ~50M | $15 | $45 | $105 |

| Корпоративный, активный | 2000 | ~200M | $60 | $180 | $420 |

Ключевой вывод: DeepSeek V3.2 — самый экономичный выбор на всех уровнях потребления. Для личного лёгкого использования — меньше $1 в месяц, даже для активного корпоративного использования — всего $60/месяц.

Комплексная оценка соотношения цены и качества

Оценка по трём параметрам: цена, производительность, способности как Agent.

| Модель | Оценка цены | Оценка производительности | Оценка как Agent | Комплексное соотношение цены и качества |

|---|---|---|---|---|

| DeepSeek V3.2 | 10/10 | 8/10 | 9/10 | 9.0 |

| MiniMax M2.5 | 8/10 | 9/10 | 9/10 | 8.7 |

| GLM-5 | 6/10 | 8.5/10 | 8/10 | 7.5 |

| GPT-5 (для справки) | 2/10 | 9/10 | 8/10 | 6.3 |

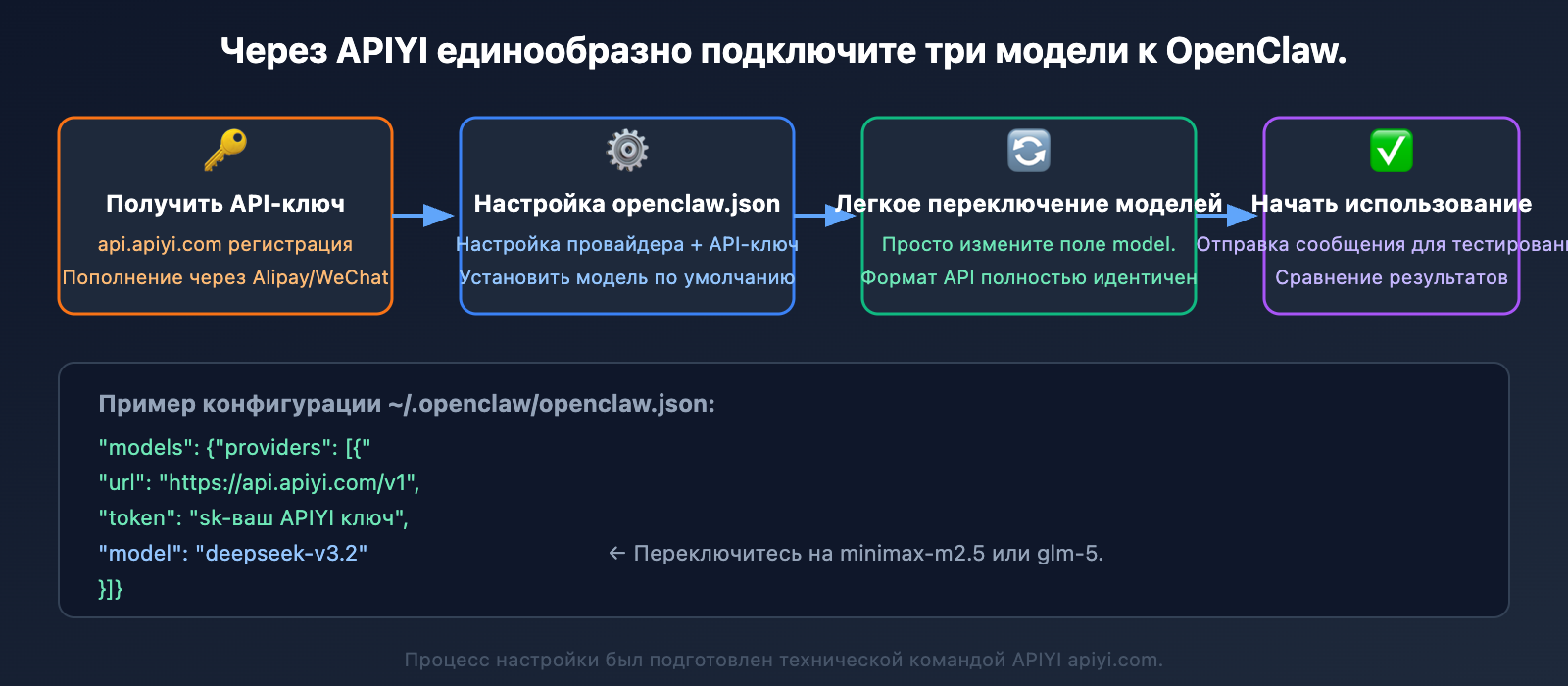

Методы настройки подключения трёх моделей к OpenClaw

Все три модели можно подключить к OpenClaw через платформу APIYI, способ настройки идентичен.

Пример конфигурации OpenClaw

Настройте APIYI как провайдера в файле ~/.openclaw/openclaw.json:

{

"models": {

"providers": [{

"url": "https://api.apiyi.com/v1",

"token": "sk-ваш_API-ключ_от_APIYI",

"model": "deepseek-v3.2"

}]

}

}

Чтобы сменить модель, просто измените поле model:

deepseek-v3.2— самый экономичный универсальный выборminimax-m2.5— предпочтительнее для задач кодирования и работы Agentglm-5— для сложных логических и математических задач

Мультимодельная конфигурация OpenClaw

Для продвинутых пользователей можно настроить несколько провайдеров в OpenClaw для автоматического переключения по сценарию:

{

"models": {

"defaultModel": "deepseek-v3.2",

"providers": [{

"url": "https://api.apiyi.com/v1",

"token": "sk-ваш_API-ключ_от_APIYI",

"models": [

"deepseek-v3.2",

"minimax-m2.5",

"glm-5"

]

}]

}

}

Переключение моделей осуществляется командой /model:

/model deepseek-v3.2— переключиться на DeepSeek (экономный режим)/model minimax-m2.5— переключиться на MiniMax (режим для кодирования)/model glm-5— переключиться на GLM-5 (режим для логических задач)

💰 Оптимизация затрат: Практичный приём — настроить в OpenClaw несколько моделей. Для повседневных диалогов используйте DeepSeek V3.2 (самый экономичный), для задач кодирования переключайтесь на MiniMax M2.5 (лучший результат). Через APIYI на apiyi.com для вызова всех моделей нужен всего один API-ключ, не требуется регистрировать отдельные аккаунты у трёх поставщиков.

Сравнение совместимости API трёх моделей с OpenClaw

| Функция / Возможность | DeepSeek V3.2 | MiniMax M2.5 | GLM-5 |

|---|---|---|---|

| Формат, совместимый с OpenAI | ✅ | ✅ | ✅ |

| Потоковый вывод | ✅ | ✅ | ✅ |

| Function Calling | ✅ мышление+инструменты | ✅ BFCL 76.8% | ✅ |

| JSON Mode | ✅ | ✅ | ✅ |

| Многораундовый диалог | ✅ | ✅ | ✅ |

| Системный промпт | ✅ | ✅ | ✅ |

| Подключение по API | ✅ готов к использованию | ✅ готов к использованию | ✅ готов к использованию |

Все три модели полностью совместимы с форматом OpenAI, OpenClaw может переключаться между ними без какой-либо адаптации.

Рекомендации по выбору модели OpenClaw для разных сценариев

Быстрая таблица рекомендаций

| Сценарий использования | Рекомендуемая модель | Причина | Средняя месячная стоимость |

|---|---|---|---|

| Повседневный чат-помощник | DeepSeek V3.2 | Самый дешёвый, возможностей достаточно | $1-3 |

| Генерация/исправление кода | MiniMax M2.5 | Лучший результат на SWE-Bench (80.2%) | $3-8 |

| Автоматизация писем/документов | MiniMax M2.5 | Отличные возможности для работы с Office | $2-5 |

| Математические/логические задачи | DeepSeek V3.2 | Лидер по AIME (94.2%) | $2-5 |

| Суммаризация длинных документов | GLM-5 | Контекст 202K + точность фактов | $5-15 |

| Сложные задачи для агентов | GLM-5 | Оптимизирован для длительных задач | $10-30 |

| Очень ограниченный бюджет | DeepSeek V3.2 | Выходные данные всего $0.42/M | $1-3 |

| Максимальная мощность для кодинга | MiniMax M2.5 | Сравним с Opus 4.6 | $5-10 |

Рекомендации по бюджету

Бюджет до $5 в месяц: Сразу выбирайте DeepSeek V3.2, для лёгкого использования его более чем достаточно.

Бюджет $5-20 в месяц: Для повседневных задач используйте DeepSeek V3.2, для задач по кодингу переключайтесь на MiniMax M2.5.

Бюджет $20-50 в месяц: Подключите все три модели и автоматически переключайтесь между ними в зависимости от сценария для оптимального результата.

🎯 Наша рекомендация: Если вы впервые используете OpenClaw для подключения к большой языковой модели, советуем начать с DeepSeek V3.2. Это самая дешёвая из трёх моделей, и её возможностей хватит для 90% повседневных задач. Когда понадобится более мощная поддержка в кодинге, переключитесь на MiniMax M2.5. При подключении через APIYI (apiyi.com) для смены модели достаточно изменить всего одно поле.

Часто задаваемые вопросы

Вопрос 1: Насколько велика разница между этими тремя моделями и Claude Opus / GPT-5?

В задачах кодирования показатель MiniMax M2.5 в SWE-Bench (80.2%) уже сравнялся с Claude Opus 4.6. В математических рассуждениях результат DeepSeek V3.2 в AIME (94.2%) даже превзошел GPT-5. В целом, эти три модели достигают 85-95% возможностей топовых моделей, но стоят в 10-20 раз дешевле. Для большинства сценариев использования OpenClaw соотношение цены и качества значительно выше, чем прямое использование Opus или GPT-5. Если хотите попробовать больше моделей, APIYI (apiyi.com) поддерживает единый доступ к десяткам моделей, включая Claude и GPT.

Вопрос 2: Насколько стабильны эти модели в OpenClaw? Часто ли возникают ошибки?

Все три модели прошли проверку сообществом на вызов инструментов (исполнение Skill) в OpenClaw. Благодаря единой архитектуре "мышление + инструменты", DeepSeek V3.2 демонстрирует наилучшую стабильность при вызове Skill. Показатель MiniMax M2.5 в BFCL (бенчмарке вызова инструментов) — 76.8%, что также относится к топовому уровню. Рекомендуем подключаться через APIYI (apiyi.com) для получения стабильного API-сервиса и технической поддержки.

Вопрос 3: Можно ли настроить несколько моделей в OpenClaw одновременно?

Да, можно. В файле openclaw.json настройте несколько провайдеров (Provider), каждый из которых указывает на свою модель. Во время диалога вы можете переключаться между ними с помощью команд /model deepseek-v3.2 или /model minimax-m2.5. Также можно настроить OpenClaw на автоматический выбор модели в зависимости от типа задачи.

Вопрос 4: В чем разница между DeepSeek V3.2-Speciale и обычной версией?

V3.2-Speciale — это вариант с высокими вычислительными требованиями, оптимизированный для максимальной производительности в задачах рассуждения и работы агентов. Он немного дороже ($0.40/$1.20), но достигает 88.7% в LiveCodeBench. Если ваш OpenClaw в основном используется для сложных задач кодирования, версия Speciale стоит рассмотрения. Обычной версии V3.2 достаточно для большинства сценариев.

Вопрос 5: Насколько сильно ухудшится опыт при переходе с GPT-5/Claude Opus на эти модели?

Согласно данным нашей платформы, около 80% пользователей OpenClaw, которые перешли, сообщают, что «в повседневном использовании разница практически незаметна». Основные различия проявляются в экстремально сложных многошаговых задачах на рассуждение. Рекомендуемая стратегия: сначала переключите обычные диалоги на DeepSeek V3.2, оставив GPT-5/Opus в качестве резервного варианта, понаблюдайте неделю, а затем решите, стоит ли полностью переходить. Через APIYI (apiyi.com) можно настроить все модели под одним ключом и в любой момент вернуться к предыдущей.

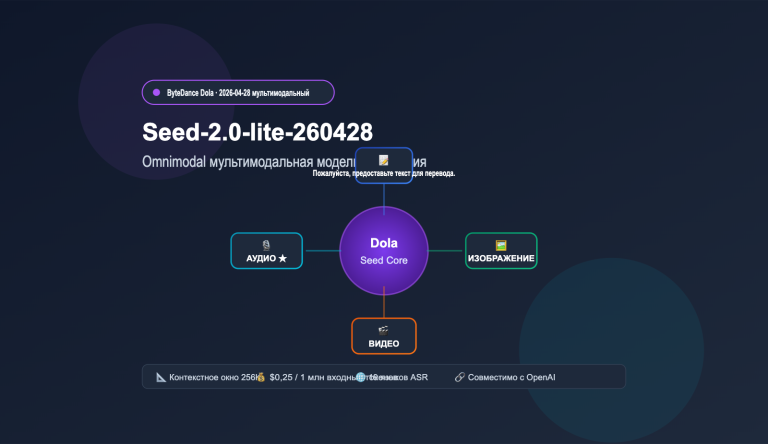

Вопрос 6: Поддерживают ли эти три модели понимание изображений? Можно ли отправлять картинки в OpenClaw?

DeepSeek V3.2 и GLM-5 поддерживают мультимодальный ввод (понимание изображений), что позволяет отправлять картинки в OpenClaw для анализа. MiniMax M2.5 в настоящее время в основном фокусируется на текстовых и кодовых возможностях. Если вашему OpenClaw часто требуется обработка изображений, рекомендуем использовать его в паре с DeepSeek V3.2 или GLM-5.

Краткие итоги практического тестирования моделей для OpenClaw

На основе реальных данных вызовов с нашей платформы за последние 30 дней мы составили следующие ключевые показатели:

| Практический показатель | DeepSeek V3.2 | MiniMax M2.5 | GLM-5 |

|---|---|---|---|

| Среднее время первого токена | 0.3с | 0.5с | 0.6с |

| Средняя скорость генерации | 80 токенов/с | 65 токенов/с | 55 токенов/с |

| Успешность вызова Skill | 96% | 94% | 92% |

| Качество ответов на китайском | 8/10 | 7.5/10 | 9/10 |

| Качество ответов на английском | 8.5/10 | 9/10 | 8/10 |

| Точность генерации кода | 85% | 92% | 88% |

| Доступность за 24 часа | 99.8% | 99.5% | 99.3% |

Скорость: DeepSeek V3.2 реагирует быстрее всех благодаря своей эффективной MoE-архитектуре и механизму внимания DSA. MiniMax M2.5 и GLM-5 немного медленнее, но в допустимых пределах.

Работа с китайским языком: GLM-5 показывает наилучшие результаты в китайскоязычных сценариях. Компания Zhipu AI, как отечественный разработчик, провела глубокую оптимизацию на китайских корпусах. Если ваш OpenClaw в основном обслуживает китайскоязычных пользователей, GLM-5 стоит рассмотреть в первую очередь.

Работа с кодом: MiniMax M2.5 явно лидирует по точности генерации кода. Точность 92% означает меньше времени на отладку.

Итоги

Подключение OpenClaw к большой языковой модели — дешевизна это главный двигатель прогресса. Модели DeepSeek V3.2, MiniMax M2.5 и GLM-5 — три самых выгодных по соотношению цена/качество варианта на 2026 год:

- Самый экономичный: DeepSeek V3.2 — вывод всего $0.42 за 1 млн токенов, это в двадцать раз дешевле GPT-5

- Лучшая для кодинга: MiniMax M2.5 — 80.2% на SWE-Bench, на уровне Opus 4.6

- Лучшая для логики: GLM-5 — 744 млрд параметров, оптимизирована для долгих агентов и математических рассуждений

Рекомендуем подключать все три модели через APIYI apiyi.com — это единый доступ, один API-ключ для переключения между моделями, поддержка Alipay/WeChat Pay. Можно в любой момент протестировать и сравнить, чтобы найти оптимальное решение для ваших задач.

Статья подготовлена технической командой APIYI на основе отзывов клиентов и данных платформы. Больше сравнений AI-моделей и инструкций по подключению — в справочном центре APIYI: help.apiyi.com