Одну и ту же китайскую статью перевели с помощью Gemini и DeepSeek на английский, японский и французский языки — качество и полнота перевода совпадают идеально, но API вернул Completion Token, отличающиеся в 2-2,5 раза. Это баг в расчёте платежей API? Или за этим стоит более глубокая техническая причина?

Ценность материала: на основе реальных тестовых данных разберёмся, как различия в Tokenizer влияют на стоимость API, и научимся выбирать наиболее экономичную модель для многоязычных переводов.

Ключевые данные сравнения Gemini и DeepSeek Tokenizer

| Параметр сравнения | Gemini 3 Flash | DeepSeek V3.2 | Разница |

|---|---|---|---|

| Completion Token для английского | 1 631 | 636 | Gemini больше в 2,56x |

| Completion Token для японского | 2 141 | 856 | Gemini больше в 2,50x |

| Completion Token для французского | 1 630 | 812 | Gemini больше в 2,01x |

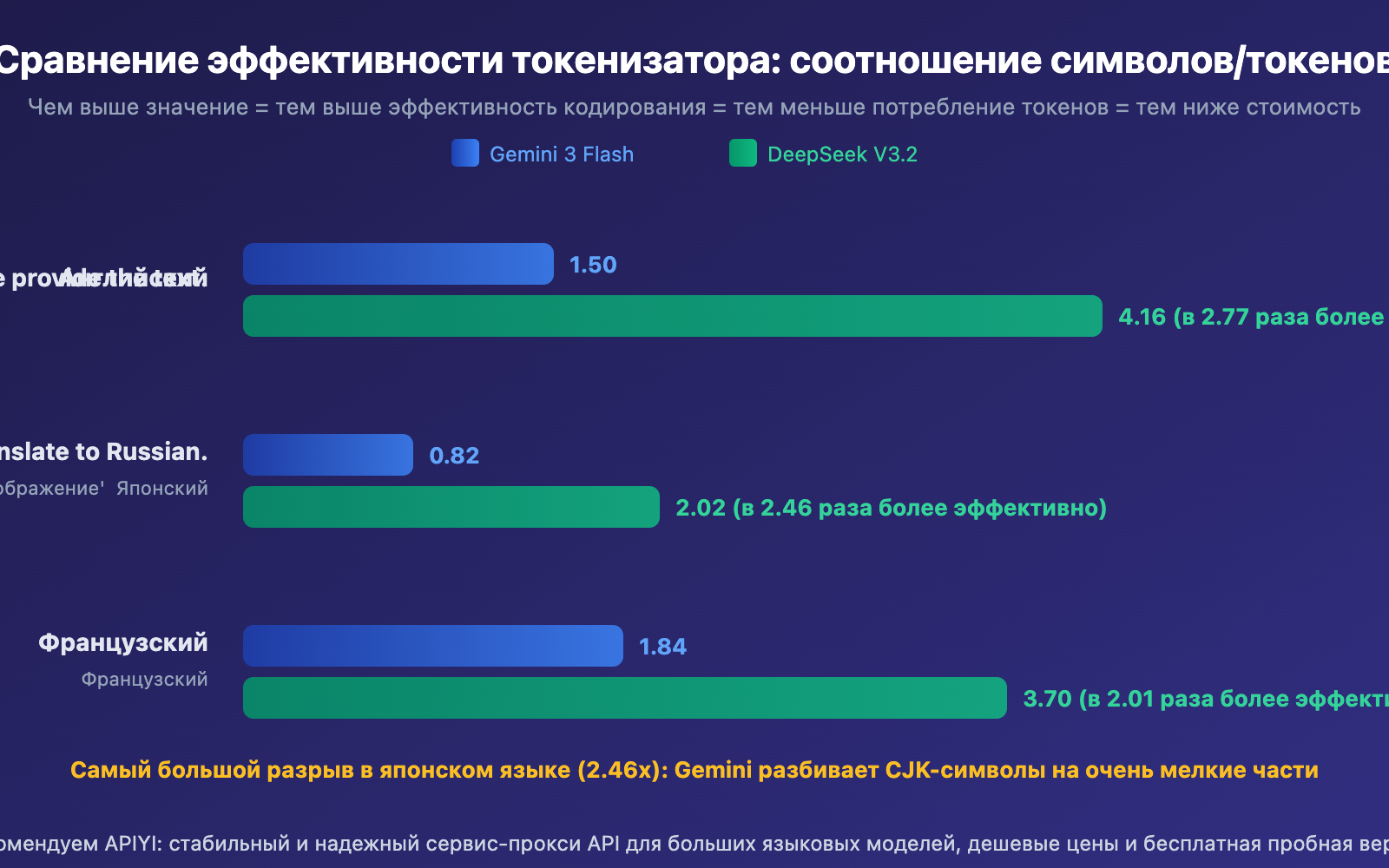

| Эффективность кодирования (символов/Token) | 0,82–1,84 | 2,02–4,16 | DeepSeek выше в 2–2,8x |

| Строк в выводе перевода | 64 строки | 64 строки | Полное совпадение |

Корень различий между Tokenizer Gemini и DeepSeek

Мы взяли один и тот же тестовый текст из 1 403 символов на китайском (с таблицами Markdown, блоками кода, SVG-заполнителями и CTA), вызвали gemini-3-flash-preview и deepseek-v3.2 для перевода на английский, японский и французский, а затем сравнили статистику токенов из API и реальный объём выходных данных.

Результат очень показателен: количество выходных символов практически идентично (разница менее 1%), но количество токенов отличается в 2–2,5 раза. Это доказывает, что проблема именно в Tokenizer (разбивателе текста), а не в стратегии генерации модели.

Технические принципы Tokenizer Gemini и DeepSeek

Что такое Tokenizer? Проще говоря, это инструмент, который разбивает текст на минимальные единицы, понятные модели (токены). Разные модели используют разные Tokenizer — как разные архиваторы: один и тот же файл ZIP и RAR сжимают по-разному, но при распаковке содержимое идентично.

SentencePiece Tokenizer в Gemini: использует языковую модель Unigram, словарь содержит около 256 000 токенов. Для символов CJK (китайский, японский, корейский) склонен разбивать текст на более мелкие подсловные единицы. В наших тестах японский вывод показал эффективность всего 0,82 символа/токен — в среднем каждый японский символ требует 1,2 токена.

Byte-level BPE Tokenizer в DeepSeek: словарь содержит около 128 000 токенов, но специально оптимизирован для многоязычных сценариев. Включает комбинированные токены пунктуации и переносов строк, что повышает эффективность сжатия текста CJK. Японский вывод достигает 2,02 символа/токен — в 2,46 раза эффективнее, чем у Gemini.

Gemini vs DeepSeek Tokenizer: анализ влияния на стоимость

Разобрались с различиями в эффективности Tokenizer — теперь главный вопрос: больше Token = больше денег? Не обязательно. Финальная стоимость зависит от количества Token × цены за единицу.

Практическое сравнение стоимости перевода Gemini vs DeepSeek

Возьмём типичную техническую статью (примерно 30 000 Prompt Token) и переведём её на 11 языков:

| Параметр стоимости | Gemini 3 Flash | DeepSeek V3.2 |

|---|---|---|

| Прогнозируемый Completion Token на один язык | ~80 000 | ~30 000 |

| Completion Token для 11 языков | ~880 000 | ~330 000 |

| Цена Output (за миллион Token) | $3.00 | $0.42 |

| Общая стоимость Output для 11 языков | $2.64 | $0.14 |

| Цена Input (за миллион Token) | $0.50 | $0.28 |

| Общая стоимость Input для 11 переводов | $0.17 | $0.09 |

| Итоговая стоимость перевода одной статьи | $2.81 | $0.23 |

По результатам практического тестирования преимущество DeepSeek в многоязычных переводах очевидно — для одной и той же задачи перевода DeepSeek обходится примерно в 1/12 от стоимости Gemini. Такой разрыв складывается из двух факторов: эффективность Tokenizer (2-2.5x) × разница в цене за Token (5-7x).

Скорость и качество перевода: Gemini vs DeepSeek

Однако стоимость — не единственный критерий:

| Метрика | Gemini 3 Flash | DeepSeek V3.2 |

|---|---|---|

| Скорость обработки | 145-189 token/s | 12-26 token/s |

| Разница в скорости | в 6-10 раз быстрее | базовый уровень |

| Качество перевода | отличное | отличное |

| Полнота перевода | 100% (64 строки) | 100% (64 строки) |

| Сохранение Markdown | хорошо | хорошо |

Gemini обрабатывает информацию в 6-10 раз быстрее DeepSeek. Если вам нужны быстрые массовые переводы и время критично, Gemini остаётся лучшим выбором.

🎯 Рекомендация по выбору: при большом объёме переводов и отсутствии жёстких временных рамок DeepSeek даёт значительную экономию. Если нужна быстрая доставка результата, скорость Gemini неоспорима. Через APIYI (apiyi.com) вы можете подключить обе модели и гибко переключаться через единый интерфейс, найдя оптимальный баланс для вашего сценария.

Влияние различий Tokenizer на разные языки

Tokenizer по-разному влияет на разные языки. Языки CJK (китайский, японский, корейский) страдают больше всего, а латинские языки — меньше.

Из данных видно следующее:

- Японский язык пострадал больше всего: эффективность кодирования японского в Gemini составляет всего 0.82 символа/Token, что объясняет значительный рост потребления Token при переводе текстов с большим объёмом китайского и японского

- Французский показывает минимальные различия: латинские языки имеют меньший разрыв в эффективности Tokenizer (всего 2.01x), так как большинство Tokenizer обучены в основном на английском языке, что выгодно латинским языкам

- Китайский занимает промежуточное положение: примерно в 1.76 раза менее эффективен, чем английский, но при использовании моделей, оптимизированных для китайского (например, DeepSeek, Qwen), этот разрыв сокращается

🎯 Совет для многоязычных переводов: если ваши переводы включают японский, корейский и другие языки CJK, выбор модели с более эффективным Tokenizer (например, DeepSeek, Qwen) может значительно снизить затраты. Через единый интерфейс APIYI (apiyi.com) вы можете удобно переключаться между разными моделями и тестировать их.

Gemini vs DeepSeek Tokenizer: Руководство по выбору сценариев

| Сценарий использования | Рекомендуемая модель | Основная причина |

|---|---|---|

| Массовый перевод на несколько языков | DeepSeek V3.2 | Высокая эффективность токенов + низкая цена, стоимость всего 1/12 |

| Срочная доставка перевода | Gemini 3 Flash | Скорость в 6-10 раз выше, идеально для срочных задач |

| Перевод с интенсивным использованием CJK | DeepSeek V3.2 | Преимущество CJK Tokenizer достигает 2.5x |

| Перевод латинских языков | Различия минимальны | Разница в эффективности всего 2x, выбирайте по цене |

| Сценарии реального времени | Gemini 3 Flash | Низкая задержка, лучший пользовательский опыт |

| Пакетная обработка с ограничением бюджета | DeepSeek V3.2 | Минимальная общая стоимость |

🎯 Практический совет: В реальных проектах часто нужно балансировать между стоимостью и скоростью. Рекомендуем подключить одновременно Gemini и DeepSeek через APIYI (apiyi.com) и динамически переключаться между моделями в зависимости от срочности задачи. Платформа поддерживает единый ключ для вызова всех основных моделей.

Часто задаваемые вопросы

В1: Высокое потребление токенов Gemini — это баг в расчётах API?

Нет, это не баг. Это нормальное явление, вызванное разницей в эффективности кодирования Tokenizer. Как файл, сжатый ZIP и RAR, имеет разный размер, так и разные модели генерируют разное количество токенов для одного и того же текста. Однако обрабатываемое содержание полностью идентично. Наши тесты подтвердили, что разница в количестве выходных символов составляет менее 1%.

В2: Означает ли большее количество токенов лучшее качество перевода?

Нет. Количество токенов отражает только способ кодирования Tokenizer и не связано с качеством перевода. В наших тестах обе модели показали отличное качество и полноту перевода, количество строк вывода полностью совпадало (64 строки). При выборе модели следует обращать внимание на качество перевода, скорость и общую стоимость, а не только на количество токенов.

В3: Как оптимизировать стоимость токенов для многоязычного перевода в проекте?

Рекомендуем следующую стратегию:

- Для языков CJK (китайский, японский, корейский) приоритетно используйте модели с высокой эффективностью Tokenizer, такие как DeepSeek

- Для латинских языков можно гибко выбирать, разница небольшая

- Подключите несколько моделей через APIYI (apiyi.com) и реализуйте автоматическую маршрутизацию по языкам с единым API

- При настройке мониторинга потребления токенов устанавливайте разные пороги для разных моделей, чтобы избежать ложных срабатываний

Резюме

Ключевые выводы сравнения эффективности токенизаторов Gemini и DeepSeek:

- Различия в токенах — результат работы токенизаторов, не ошибка: На одном и том же тексте токенизатор DeepSeek кодирует текст в 2–2,8 раза эффективнее, чем Gemini. Наиболее заметна разница для языков CJK

- Различия в стоимости накапливаются: Разница в эффективности токенизаторов (2–2,5x) × разница в цене за токен (5–7x) = реальная разница в стоимости может достигать 12 раз

- Компромисс между скоростью и стоимостью: Gemini работает в 6–10 раз быстрее, но токены дороже, DeepSeek дешевле, но медленнее — выбирайте модель в зависимости от задачи

Понимание различий в эффективности токенизаторов — ключ к оптимизации затрат на использование AI API. В сценариях с интенсивным использованием токенов, таких как многоязычный перевод, правильный выбор модели может сэкономить значительные средства.

Рекомендуем использовать APIYI (apiyi.com) для единого доступа к нескольким моделям — с одним API-ключом вы сможете гибко переключаться между ними и найти оптимальное соотношение цены и качества для каждого сценария.

📚 Справочные материалы

-

Benchmark производительности токенизаторов: Комплексное сравнение эффективности токенизаторов популярных моделей

- Ссылка:

llm-calculator.com/blog/tokenization-performance-benchmark - Описание: Содержит данные об эффективности токенизаторов GPT-4o, DeepSeek, Qwen и других моделей

- Ссылка:

-

CJK-текст и лучшие практики работы с большими языковыми моделями: Механизм обработки символов CJK токенизаторами

- Ссылка:

tonybaloney.github.io/posts/cjk-chinese-japanese-korean-llm-ai-best-practices.html - Описание: Подробный анализ различий в потреблении токенов для языков CJK в разных токенизаторах

- Ссылка:

-

Разбор токенизатора Gemini: Принципы работы SentencePiece-токенизатора Google Gemini

- Ссылка:

dejan.ai/blog/gemini-toknizer - Описание: Детальный анализ механизма кодирования и особенностей эффективности словаря из 256K токенов Gemini

- Ссылка:

-

Технический отчёт DeepSeek V3: Оптимизация многоязычности в Byte-level BPE токенизаторе

- Ссылка:

arxiv.org/html/2412.19437v1 - Описание: Концепция проектирования и эффективность сжатия для нескольких языков в словаре из 128K токенов DeepSeek

- Ссылка:

Автор: Техническая команда APIYI

Обсуждение: Добро пожаловать к обсуждению в комментариях. Дополнительные материалы доступны в центре документации APIYI — docs.apiyi.com