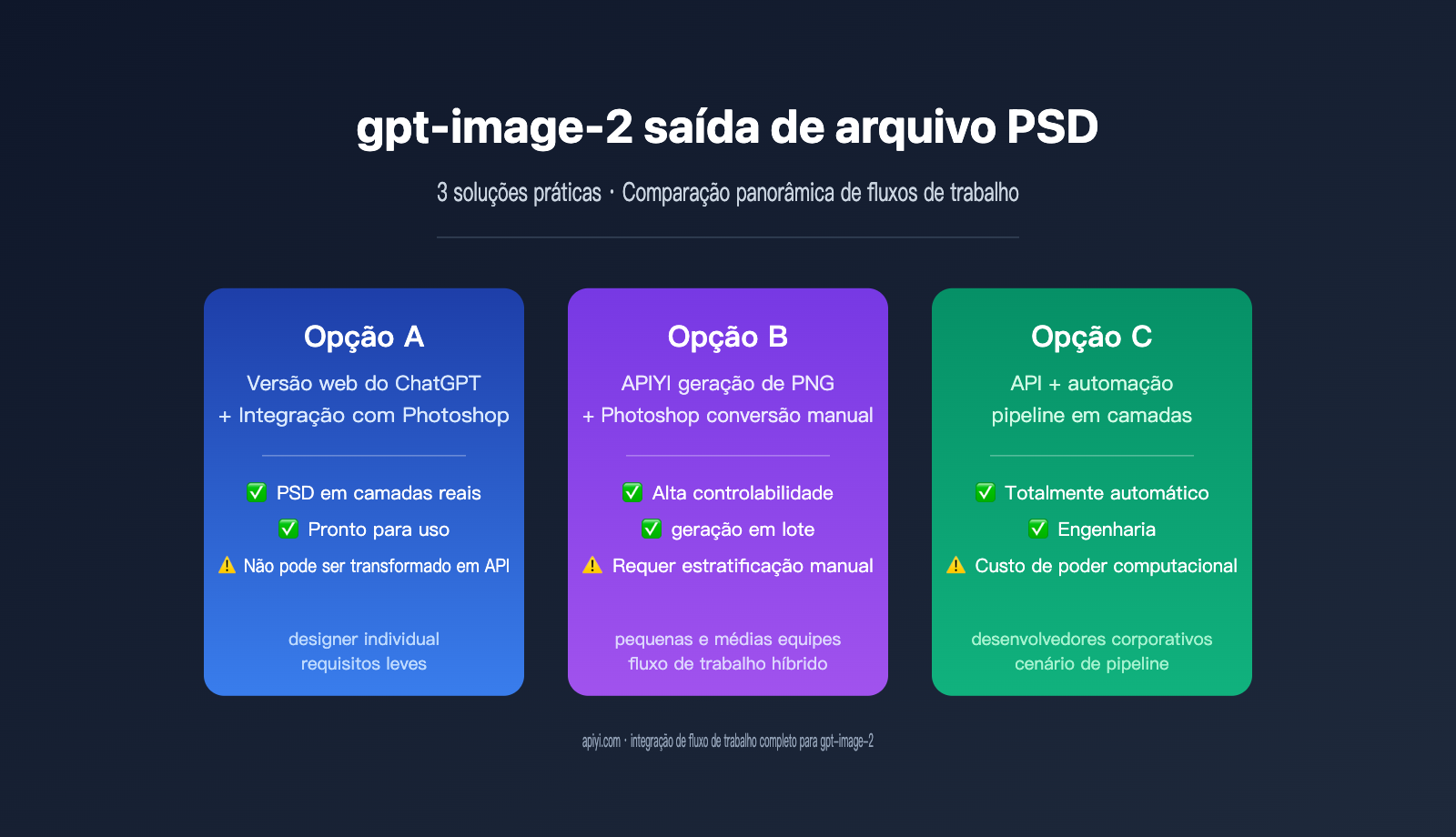

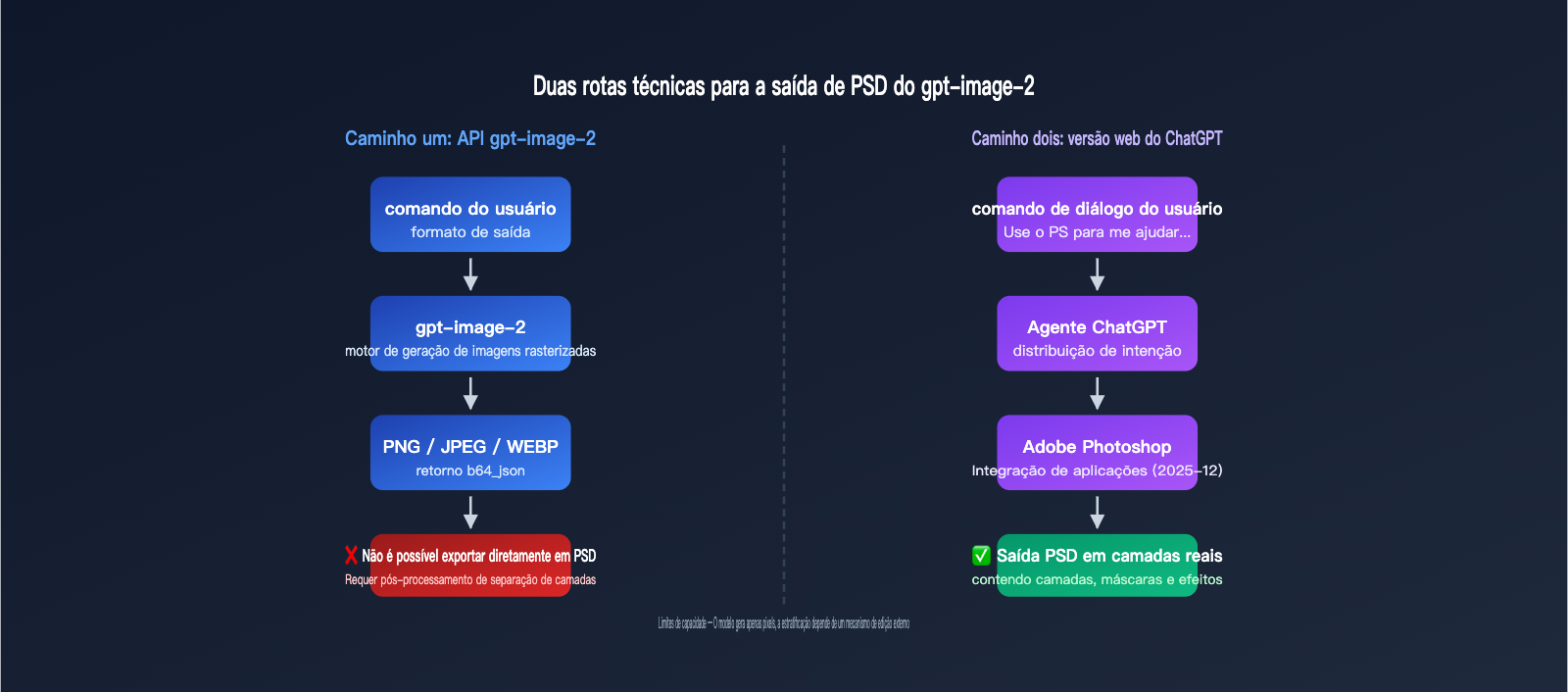

Muitos designers e desenvolvedores que utilizam o gpt-image-2 fazem a mesma pergunta: "É possível gerar arquivos PSD com camadas diretamente?" A resposta tem dois lados — a versão web do ChatGPT, com a integração do Adobe Photoshop, consegue realizar edições em camadas, mas a API do gpt-image-2, por si só, só consegue exportar nos formatos convencionais PNG, JPEG ou WEBP.

Este artigo esclarecerá de vez os limites reais da exportação de PSD pelo gpt-image-2, oferecendo 3 fluxos de trabalho práticos para que você escolha o caminho mais adequado ao seu cenário. Seja você um criador individual ou um desenvolvedor de equipe, encontrará aqui a solução ideal.

Entendimento central sobre a saída PSD do gpt-image-2

Antes de começar, é preciso esclarecer um fato fundamental: o gpt-image-2 é um modelo de geração de imagens, não um software de edição de imagens. Ele não possui a capacidade de gerar "arquivos com camadas"; qualquer saída PSD precisa de ferramentas externas para ser concluída.

Diferenças essenciais nas capacidades de saída

A definição oficial da OpenAI para a série gpt-image é clara: o modelo suporta apenas 3 formatos de imagem rasterizada:

| Formato de Saída | Extensão | Com camadas? | Canal Transparente | Cenário Típico |

|---|---|---|---|---|

| PNG | .png |

❌ Não | ✅ Suporta | Formato padrão, ideal para ativos com fundo transparente |

| JPEG | .jpg |

❌ Não | ❌ Não suporta | Tamanho de arquivo reduzido, ideal para fotos |

| WEBP | .webp |

❌ Não | ✅ Suporta | Formato web moderno, bom equilíbrio entre tamanho/qualidade |

| PSD | .psd |

✅ Sim | ✅ Suporta | API não suporta, requer pós-processamento |

🎯 Conclusão principal: A API do gpt-image-2 aceita apenas os valores

png,jpegewebpatravés do parâmetrooutput_format. Não existe nenhum parâmetro que permita a saída direta de arquivos PSD. Se você precisa realizar chamadas estáveis do gpt-image-2 em projetos corporativos, pode utilizar o serviço proxy de API da APIYI (apiyi.com), que é compatível com as especificações da interface oficial da OpenAI e suporta todos os parâmetros dos três formatos mencionados.

Por que a API não consegue gerar PSD diretamente?

O PSD é um formato proprietário da Adobe com camadas, contendo camadas, máscaras, modos de mesclagem e camadas de ajuste. Para gerar um PSD real, não é necessário um modelo de geração de imagem, mas sim um motor de edição de imagem. É por isso que:

- API do gpt-image-2: Gera uma imagem rasterizada achatada de uma vez só, sem entender o conceito de "camadas".

- ChatGPT (versão web): Com a integração do Adobe Photoshop, o trabalho de camadas é realizado, na verdade, pelo Photoshop.

Ambos pertencem a sistemas completamente diferentes, e explicaremos cada um deles a seguir.

3 abordagens para a saída de PSD do gpt-image-2

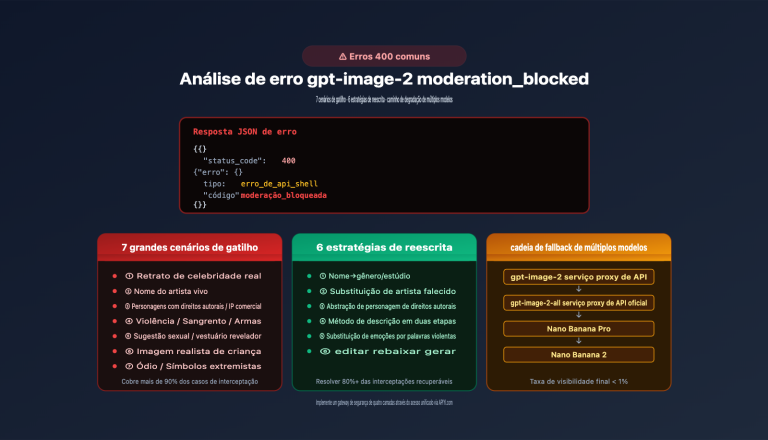

Para atender à demanda de "eu preciso de um arquivo PSD", existem atualmente 3 caminhos viáveis, cada um adequado a diferentes cenários. A tabela abaixo compara as características principais:

| Solução | Método de implementação | PSD com camadas reais | Nível de automação | Público-alvo |

|---|---|---|---|---|

| Solução A: Integração ChatGPT + Photoshop | Chamada via plugin Adobe na web | ✅ Sim | Semi-automático | Designers individuais, demandas leves |

| Solução B: Geração via API + Photoshop manual | Gerar PNG via API, importar manualmente no PS | ⚠️ Pseudo-camadas (camada única) | Totalmente manual | Desenvolvedores que precisam de geração em lote |

| Solução C: Geração via API + Ferramenta de terceiros | Gerar imagem via API e usar script/IA para separar camadas | ✅ Sim (estimativa por algoritmo) | Totalmente automático | Cenários de engenharia, pipelines |

🎯 Sugestão de escolha: Se você precisa apenas ocasionalmente de uma ou duas imagens com camadas, a Solução A é a mais simples; se você precisa incorporar recursos de geração de imagem em seu produto, a integração via APIYI apiyi.com para chamar a API do gpt-image-2 + backend (Solução B ou C) é a escolha mais controlável.

Solução A: Implementação via ChatGPT Web + Integração com Photoshop

Este é um recurso lançado oficialmente pela OpenAI em dezembro de 2025. A Adobe colaborou com a OpenAI para trazer o Adobe Photoshop, Adobe Express e Adobe Acrobat para o ChatGPT, permitindo que 800 milhões de usuários utilizem recursos profissionais de edição de imagem diretamente na conversa.

Passos para ativar o Photoshop no ChatGPT

O segredo de todo o fluxo é o ChatGPT atuar como um "Agente abrangente", distribuindo a intenção em linguagem natural do usuário para o gpt-image-2 gerar a imagem e, em seguida, entregando-a ao Adobe Photoshop para processamento de camadas.

Entrada do usuário → ChatGPT analisa a intenção

├─ Chama o gpt-image-2 para gerar a imagem original

└─ Chama o aplicativo Photoshop para processamento de camadas

↓

Saída do arquivo PSD baixável

Fluxo de operação detalhado:

- Acesse a versão web do ChatGPT (chatgpt.com) e confirme se sua conta foi atualizada para a versão que inclui recursos de imagem.

- Na caixa de entrada, clique em "+" → "Mais" → selecione o aplicativo "Adobe Photoshop".

- Insira um comando, por exemplo:

Use o Adobe Photoshop para me ajudar a gerar uma ilustração de uma cidade noturna e separe o personagem em primeiro plano, os edifícios em plano médio e o céu ao fundo em camadas diferentes. - O ChatGPT chamará automaticamente o gpt-image-2 para gerar a imagem base.

- Em seguida, chamará o aplicativo Photoshop para realizar o processamento de camadas, ajustes e mesclagem.

- Após a conclusão, clique no botão de download na conversa para obter o arquivo PSD com camadas.

Escopo de recursos do Photoshop para ChatGPT

A documentação oficial de ajuda da Adobe lista as principais operações suportadas pela versão integrada:

| Tipo de operação | Suportado | Descrição |

|---|---|---|

| Ajuste de área local | ✅ | Pode ajustar brilho e contraste de partes específicas da imagem |

| Efeitos criativos | ✅ | Filtros integrados como Glitch, Glow, etc. |

| Desfoque/substituição de fundo | ✅ | Implementado usando Adobe Firefly |

| Separação de camadas | ✅ | Separa sujeito, primeiro plano e fundo em camadas |

| Máscaras e seleções | ⚠️ Parcial | Seleções complexas ainda são recomendadas na versão desktop |

| Objetos inteligentes | ❌ | Não suporta a criação de objetos inteligentes editáveis |

| Modos de mesclagem avançados | ❌ | Suporta apenas mesclagem básica |

🎯 Dica de capacidade: O Photoshop dentro do ChatGPT é adequado para edições leves; a capacidade completa ainda reside na versão desktop do Photoshop. Se você precisa gerar PSDs com alta frequência ou em lote, um fluxo de trabalho mais eficiente é conectar-se diretamente à API do gpt-image-2 via APIYI apiyi.com para gerar PNGs e, em seguida, entregá-los ao Photoshop desktop.

Limitações da Solução A

Embora a integração ChatGPT + Photoshop ofereça uma experiência fluida, existem algumas limitações rígidas que você deve conhecer:

- Impossibilidade de chamada via API: Este é um recurso limitado à versão web, não há interface de API pública para você reproduzir esse fluxo de trabalho em seus próprios programas.

- Velocidade de geração lenta: A geração única + processamento de camadas geralmente leva de 60 a 120 segundos.

- Controle fraco: A quantidade de camadas, nomenclatura e ordem são decididas pelo próprio ChatGPT, não aceitando restrições forçadas via comando.

- Limites de cota: Usuários gratuitos têm um número limitado de chamadas diárias, e usuários Plus também possuem um limite superior.

Essas limitações determinam que a Solução A é adequada para "exploração de inspiração" e "criação única", não sendo ideal para ambientes de produção estáveis.

Solução B: API gpt-image-2 + conversão manual para PSD no Photoshop

Se o seu objetivo é "gerar imagens em lote via código e, após uma curadoria humana, convertê-las para PSD", a Solução B é a mais direta. Este caminho desacopla completamente a geração por IA do processamento de camadas.

Exemplo minimalista de invocação da API gpt-image-2

Abaixo está o código mínimo funcional para gerar imagens via API, utilizando uma interface compatível com OpenAI:

import requests

import base64

response = requests.post(

"https://api.apiyi.com/v1/images/generations",

headers={"Authorization": "Bearer YOUR_API_KEY"},

json={

"model": "gpt-image-2",

"prompt": "Cidade cyberpunk à noite, luzes de neon, rua em noite chuvosa",

"size": "1024x1024",

"quality": "high",

"output_format": "png"

}

)

data = response.json()["data"][0]

image_bytes = base64.b64decode(data["b64_json"])

with open("output.png", "wb") as f:

f.write(image_bytes)

📦 Exemplo completo em Python (com tratamento de erros e descrição de parâmetros)

import os

import base64

import requests

from typing import Optional

def generate_image(

prompt: str,

output_path: str,

size: str = "1024x1024",

quality: str = "high",

output_format: str = "png",

background: Optional[str] = None

) -> dict:

"""

Invoca o gpt-image-2 para gerar uma imagem

Args:

prompt: Descrição da imagem

output_path: Caminho do arquivo de saída

size: 1024x1024 / 1024x1536 / 1536x1024

quality: low / medium / high

output_format: png / jpeg / webp

background: transparent / opaque (apenas para png/webp)

"""

api_key = os.getenv("APIYI_API_KEY")

if not api_key:

raise ValueError("Por favor, defina a variável de ambiente APIYI_API_KEY")

payload = {

"model": "gpt-image-2",

"prompt": prompt,

"size": size,

"quality": quality,

"output_format": output_format,

}

if background:

payload["background"] = background

response = requests.post(

"https://api.apiyi.com/v1/images/generations",

headers={

"Authorization": f"Bearer {api_key}",

"Content-Type": "application/json"

},

json=payload,

timeout=180

)

response.raise_for_status()

result = response.json()

image_data = result["data"][0]["b64_json"]

with open(output_path, "wb") as f:

f.write(base64.b64decode(image_data))

return {

"path": output_path,

"usage": result.get("usage", {}),

"size": size

}

if __name__ == "__main__":

info = generate_image(

prompt="Uma ilustração de cidade futurista, pronta para um cartaz de promoção de produto",

output_path="hero.png",

size="1536x1024",

quality="high",

background="transparent"

)

print(f"Geração bem-sucedida: {info}")

🎯 Dica de integração: Ao usar o APIYI apiyi.com para invocar o gpt-image-2, basta substituir a URL oficial da OpenAI

api.openai.comporapi.apiyi.com. Os outros parâmetros são totalmente compatíveis e o suporte aoutput_formatpermite escolher entre png, jpeg e webp.

Importando PNG para o Photoshop para converter em PSD

Após receber o PNG da API, o fluxo padrão para convertê-lo em PSD no Photoshop é:

- Abra o arquivo PNG na versão desktop do Photoshop (

Arquivo → Abrir) - A imagem estará em uma camada única, geralmente exibida como "Plano de fundo"

- Dê um clique duplo na camada para desbloqueá-la e torná-la editável

- Separe o objeto principal conforme necessário:

- Use a Ferramenta Seleção de Objeto para identificar o assunto automaticamente

- Use a Expansão Generativa para redesenhar o fundo

- Use os Canais Alfa para extrair áreas transparentes

- Salve como PSD:

Arquivo → Salvar Como → Photoshop (.PSD)

Capacidade real de separação de camadas da Solução B

É importante notar que, ao converter diretamente de PNG para PSD, você terá apenas 1 camada por padrão. Para obter um PSD com múltiplas camadas reais, você precisará realizar o trabalho de separação manualmente. As abordagens comuns incluem:

| Método de separação | Complexidade | Qualidade das camadas |

|---|---|---|

| Seleção manual + Duplicar camada | Alta | Altíssima |

| Ferramentas de remoção de fundo (Remove.bg) | Baixa | Média |

| Seleção de Objeto + Preenchimento Generativo | Média | Alta |

| Filtros neurais de estimativa de profundidade | Baixa | Média (pseudo-3D) |

Dicas de engenharia de comando (prompt) para saída em PSD com gpt-image-2

Para maximizar a eficiência da separação na Solução B, considere a possibilidade de camadas futuras já na fase de prompt. Abaixo está um modelo de comando validado na prática:

[Assunto]: Um cartaz de promoção de produto, o objeto principal é um tênis futurista

[Requisitos de composição]:

- Assunto centralizado, ocupando 60% da área da imagem

- Fundo com cor sólida ou gradiente simples, para facilitar a remoção

- Diferença de cor clara e separação de profundidade entre o assunto e o fundo

- Não inclua elementos semelhantes ao assunto no fundo

[Parâmetros de saída]:

- Resolução: 1536x1024

- Fundo: transparent (se suportado)

- Estilo: Qualidade de fotografia comercial

Esse estilo de comando torna o PNG gerado mais "amigável" para a separação posterior, aumentando significativamente a precisão das ferramentas de recorte.

| Palavras-chave do comando | Impacto na separação |

|---|---|

pure background / solid color background |

Bordas de recorte mais limpas |

clear subject separation |

Fronteira clara entre assunto e fundo |

centered composition |

Facilita a detecção automática do assunto |

studio lighting |

Reduz sombras projetadas, diminuindo erros |

no overlapping elements |

Evita que camadas se sobreponham |

🎯 Aumento de eficiência: Ao conectar ao gpt-image-2 do APIYI apiyi.com, você pode usar modelos de comando de nível de sistema para pré-definir essas restrições, garantindo que todas as imagens geradas pela equipe sejam amigáveis ao fluxo de trabalho de PSD.

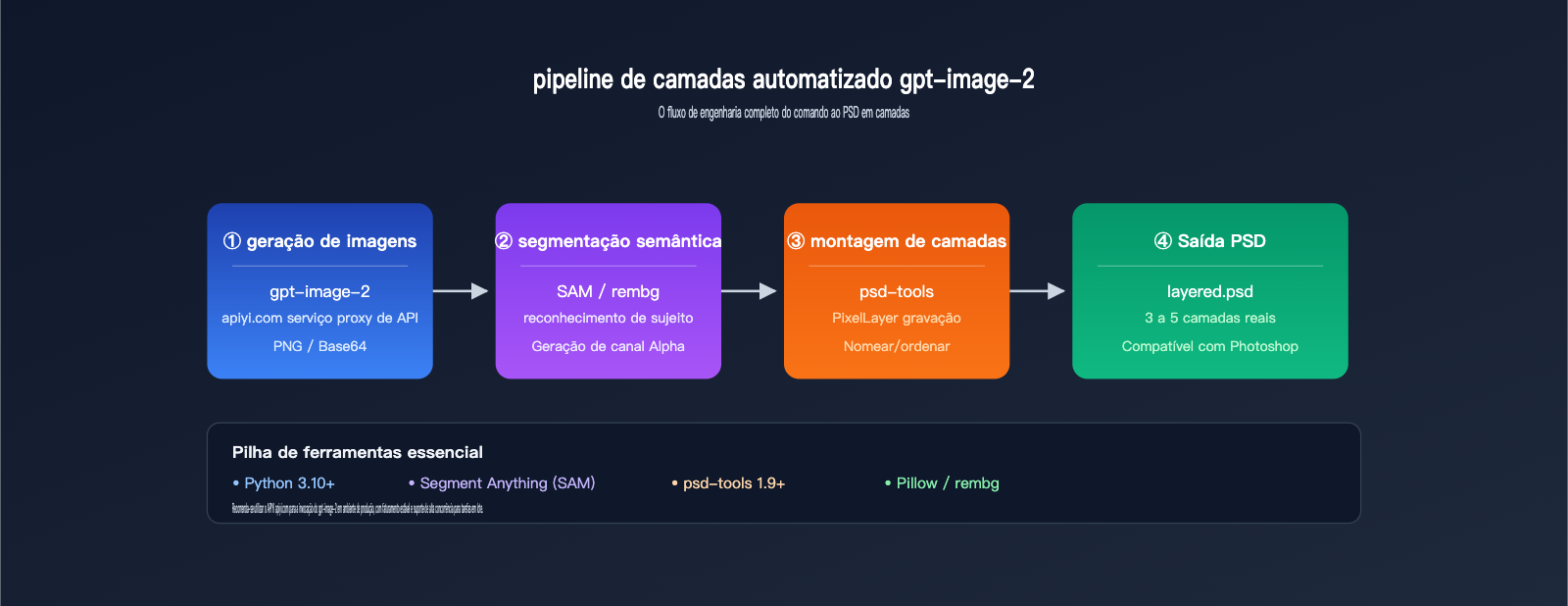

Solução C: API + Ferramentas de separação de terceiros para saída automática de PSD

Para cenários de produção (como geração automática de materiais de e-commerce ou pipelines de publicidade), a operação manual no Photoshop não é viável. Nesse caso, é necessário introduzir ferramentas de separação automatizadas.

Arquitetura do fluxo de trabalho automatizado

[Comando do usuário]

↓

[Geração da imagem original via API gpt-image-2]

↓

[Modelo de segmentação semântica identifica áreas] (ex: SAM, Florence)

↓

[Geração de canais Alfa para cada camada]

↓

[Escrita do PSD via psd-tools / photoshop-python-api]

↓

[Saída do arquivo PSD com múltiplas camadas]

Todo o pipeline pode ser implementado via código, sem a necessidade de abrir o cliente Photoshop.

Combinação de ferramentas essenciais

| Ferramenta | Função | Recomendação |

|---|---|---|

| psd-tools (Python) | Leitura e escrita de arquivos PSD | ⭐⭐⭐⭐⭐ |

| Pillow | Processamento básico de imagem | ⭐⭐⭐⭐⭐ |

| SAM (Segment Anything) | Segmentação semântica da Meta | ⭐⭐⭐⭐⭐ |

| rembg | Recorte de um clique, remoção de fundo | ⭐⭐⭐⭐ |

| MiDaS | Estimativa de profundidade, separação de planos | ⭐⭐⭐⭐ |

| Photopea API | Edição de PSD online | ⭐⭐⭐ |

Exemplo de código para separação automatizada

from psd_tools import PSDImage

from psd_tools.api.layers import PixelLayer

from PIL import Image

from rembg import remove

original = Image.open("gpt_image_2_output.png")

foreground = remove(original)

background = Image.new("RGBA", original.size, (255, 255, 255, 0))

psd = PSDImage.new(mode="RGBA", size=original.size)

psd.append(PixelLayer.frompil(background, psd, "Background"))

psd.append(PixelLayer.frompil(foreground, psd, "Foreground"))

psd.save("layered_output.psd")

🎯 Sugestão de engenharia: Em ambientes de produção, recomenda-se encapsular o processo "invocar gpt-image-2 → remover fundo → escrever PSD" em um microsserviço. A invocação via APIYI apiyi.com suporta alta concorrência e faturamento estável, sendo ideal como capacidade upstream para pipelines de imagem.

Observações sobre a Solução C

- Qualidade das camadas depende do modelo de segmentação: O SAM é mais preciso que o rembg, porém tem custo de inferência maior.

- Compatibilidade do PSD: PSDs gerados pelo psd-tools funcionam bem nas versões principais do Photoshop, mas versões muito antigas podem perder metadados.

- Custo computacional em lote: Executar o modelo de segmentação em cada imagem aumenta significativamente o custo de GPU.

- Soluções híbridas são mais realistas: Uma alternativa é a geração via API + separação de fundo simples + um pouco de refinamento humano.

Avançado: Código prático para separação de múltiplos personagens

Quando for necessário colocar objetos semânticos diferentes (como pessoas, produtos, textos) em camadas independentes, você pode combinar o SAM (Segment Anything Model) para uma segmentação mais refinada:

📦 Exemplo completo de separação de múltiplos objetos semânticos com SAM + psd-tools

import torch

import numpy as np

from PIL import Image

from segment_anything import SamPredictor, sam_model_registry

from psd_tools import PSDImage

from psd_tools.api.layers import PixelLayer

def gpt_image_to_layered_psd(image_path: str, output_psd: str, points: list):

"""

Divide o PNG gerado pelo gpt-image-2 em um PSD com camadas de objetos semânticos

Args:

image_path: Caminho do PNG gerado pelo gpt-image-2

output_psd: Caminho do arquivo PSD de saída

points: Lista de pontos centrais dos objetos a serem segmentados [(x, y, label), ...]

"""

image = Image.open(image_path).convert("RGBA")

image_np = np.array(image)

sam = sam_model_registry["vit_h"](checkpoint="sam_vit_h.pth")

sam.to("cuda" if torch.cuda.is_available() else "cpu")

predictor = SamPredictor(sam)

predictor.set_image(image_np[:, :, :3])

psd = PSDImage.new(mode="RGBA", size=image.size)

for idx, (x, y, label) in enumerate(points):

masks, scores, _ = predictor.predict(

point_coords=np.array([[x, y]]),

point_labels=np.array([1]),

multimask_output=False

)

mask = masks[0]

layer_array = image_np.copy()

layer_array[~mask] = [0, 0, 0, 0]

layer_image = Image.fromarray(layer_array, "RGBA")

psd.append(PixelLayer.frompil(layer_image, psd, label))

background_array = image_np.copy()

background_image = Image.fromarray(background_array, "RGBA")

background_layer = PixelLayer.frompil(background_image, psd, "Background")

psd.insert(0, background_layer)

psd.save(output_psd)

print(f"✅ PSD com múltiplas camadas gerado: {output_psd}")

if __name__ == "__main__":

gpt_image_to_layered_psd(

image_path="gpt_image_2_poster.png",

output_psd="layered_poster.psd",

points=[

(512, 400, "Subject"),

(200, 600, "ProductLeft"),

(800, 600, "ProductRight"),

]

)

Através deste fluxo, um cartaz gerado pelo gpt-image-2 pode ser dividido em 3 a 5 camadas reais de um PSD, permitindo que cada camada seja editada independentemente no Photoshop.

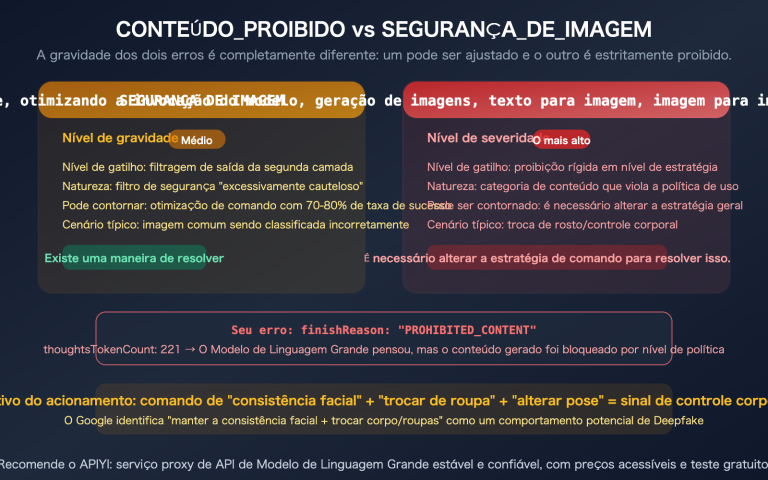

Tratamento de erros e solução de problemas

Em cenários de engenharia, tanto a invocação do gpt-image-2 quanto a separação posterior podem falhar. A tabela abaixo resume os problemas frequentes e como resolvê-los:

| Fenômeno | Causa raiz | Solução |

|---|---|---|

API retorna invalid output_format |

Valor não suportado (ex: psd) enviado |

Use apenas png/jpeg/webp |

Campo b64_json vazio |

Bloqueio por moderação de conteúdo | Otimize o comando, evite descrições sensíveis |

| Bordas serrilhadas após recorte | Precisão insuficiente do modelo de segmentação | Use SAM + pós-processamento de borda (feather) |

| PSD não abre no Photoshop | Metadados incompletos escritos pelo psd-tools | Atualize o psd-tools para a versão 1.9+ |

| Camadas desalinhadas após separação | Canais RGBA não alinhados | Unifique o tamanho da tela antes de escrever |

| Velocidade de chamada lenta | Limite de taxa (rate limit) por alta concorrência | Use o roteamento de múltiplos canais do APIYI apiyi.com |

🎯 Dica de estabilidade: Em ambientes de produção, recomenda-se adicionar lógica de repetição e fallback na camada de invocação da API. As solicitações feitas via APIYI apiyi.com identificam automaticamente as respostas de limite de taxa da OpenAI e suportam alternância inteligente, reduzindo a taxa de falha em tarefas em lote.

Perguntas frequentes sobre a saída PSD do gpt-image-2

Aqui estão as respostas para as dúvidas mais frequentes que surgem durante o uso prático.

Q1: A API do gpt-image-2 realmente não consegue gerar PSD diretamente?

Confirmado, não consegue. A documentação oficial da OpenAI limita explicitamente os valores do parâmetro output_format a png, jpeg e webp. Qualquer serviço que afirme "gerar PSD diretamente via API" está, na verdade, executando um processo de separação de camadas (como o descrito na Solução C) em seus próprios servidores e, em seguida, empacotando o resultado em um arquivo PSD para retornar ao usuário — isso não é uma capacidade nativa do modelo gpt-image-2.

🎯 Esclarecimento: Para acessar o gpt-image-2 oficial de forma estável, você pode utilizar um serviço proxy de API compatível com a interface da OpenAI, como o APIYI (apiyi.com). Isso garante que o comportamento dos parâmetros seja exatamente igual ao da OpenAI, evitando "modificações" feitas por camadas de encapsulamento.

Q2: O PSD gerado pela versão web do ChatGPT possui camadas reais?

Sim, possui. Isso acontece porque, por trás da interface, há uma instância real do Adobe Photoshop executando operações de edição, resultando em um PSD com camadas, máscaras e efeitos reais. No entanto, você não consegue controlar com precisão a quantidade ou o nome das camadas; na maioria dos casos, você obterá de 3 a 5 camadas (fundo, objeto principal, primeiro plano, camadas de ajuste, etc.).

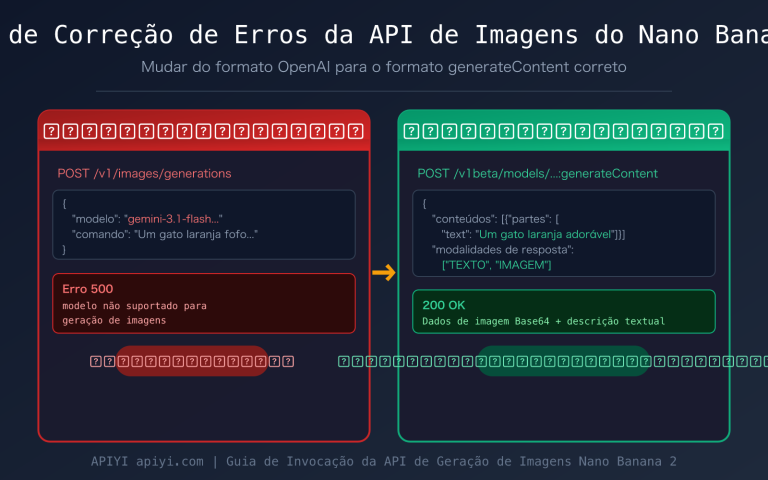

Q3: Existe diferença no formato de saída entre o gpt-image-2 e o gpt-image-2-all?

Existem pequenas diferenças. O gpt-image-2-all utiliza o canal reverso equivalente ao do ChatGPT web, e o campo b64_json retornado inclui o prefixo data:image/png;base64,. Já o gpt-image-2 conecta-se diretamente à API de Imagens da OpenAI e retorna uma string base64 pura, sem prefixo. Ambos não suportam a saída em PSD, mas o código de processamento de strings subjacente precisa ser tratado de forma diferente para cada um.

Q4: Se eu só preciso de um PNG com fundo transparente, não preciso de um PSD?

Para muitos cenários, isso é verdade. A API do gpt-image-2 suporta o parâmetro background: "transparent", gerando diretamente PNGs com fundo transparente, o que é ideal para:

- Recorte de produtos para e-commerce

- Logotipos, ícones e materiais de adesivos

- Elementos de interface (UI)

Apenas quando você precisa ajustar camadas da parte não principal do objeto é que o fluxo de trabalho em PSD se torna necessário.

Q5: Como controlar o custo da geração em lote de PSDs?

O custo é composto principalmente por três partes:

| Item de custo | Parte da API gpt-image-2 | Parte do pós-processamento |

|---|---|---|

| Custo por unidade | ~$0.03 – $0.20/imagem | Poder computacional de GPU para recorte ~$0.001 |

| Tempo | 60-120 segundos | 5-30 segundos |

| Estabilidade | Sujeito a limites da OpenAI | Poder computacional próprio controlável |

🎯 Estratégia de redução de custos: Em cenários de grande volume, recomenda-se realizar a separação de camadas apenas para as imagens candidatas de alta qualidade. Primeiro, use parâmetros de baixa qualidade (

quality=low) no gpt-image-2 para gerar pré-visualizações rápidas, verifique o consumo através da fatura unificada do APIYI (apiyi.com) e, após confirmar que está satisfeito, gere novamente com alta qualidade (high) para entrar no pipeline de separação de camadas.

Q6: Posso usar o gpt-image-2 para editar arquivos PSD existentes?

Não. A interface de edição de imagem do gpt-image-2 aceita apenas entradas PNG/JPEG/WEBP e não consegue identificar a estrutura interna de camadas de um PSD. Se você deseja "fazer uma nova pintura via IA em uma camada específica de um PSD", o procedimento padrão é:

- Exportar essa camada como PNG (com Alpha) no Photoshop.

- Usar a interface de edição do gpt-image-2 junto com uma máscara para a nova pintura.

- Importar o resultado de volta ao PSD original como uma nova camada.

Casos de uso prático do gpt-image-2 com saída PSD

Diferentes setores possuem demandas distintas para a saída em PSD; a escolha da solução depende do cenário de negócio. Abaixo, apresentamos 3 fluxos de trabalho típicos.

Caso 1: Produção em lote de pôsteres de produtos para e-commerce

Uma equipe de e-commerce transfronteiriço precisa gerar mais de 300 pôsteres de produtos por dia. A necessidade é: uma camada para o produto, uma para o fundo e uma para o texto, facilitando a substituição rápida de textos pela equipe de marketing.

Design do fluxo de trabalho:

- Após o upload do produto, a equipe preenche as palavras-chave de venda no sistema.

- Chama a API do gpt-image-2 para gerar a imagem principal (

output_format=png,background=transparent). - Usa o rembg para confirmar as bordas do recorte.

- Gera uma estrutura de 3 camadas via psd-tools:

- Camada 1: Produto (fundo transparente)

- Camada 2: Fundo de cenário gerado por IA

- Camada 3: Camada de texto reservada

- O designer só precisa editar a camada de texto no PSD para publicar.

Ganhos de eficiência: O tempo de produção por pôster caiu de 30 minutos para 2 minutos, restando ao designer apenas a revisão final.

🎯 Seleção de cenário: Para cenários de alta repetição, o uso da interface gpt-image-2 via APIYI (apiyi.com), combinado com um plano de faturamento corporativo, permite custos previsíveis e capacidade de produção escalável.

Caso 2: Prototipagem rápida de ativos de UI para jogos

A equipe de arte de jogos precisa de muitos ativos de UI "temporários" (botões, ícones, banners, etc.) na fase de protótipo, exigindo o formato PSD para refinamento posterior.

Design do fluxo de trabalho:

gpt-image-2 gera visual base

↓

SAM segmenta automaticamente a forma do objeto

↓

Exporta múltiplos PNGs (frame, icon, glow, etc.)

↓

psd-tools integra em um PSD com camadas

↓

Artista refina a versão final no Photoshop

| Tipo de ativo | Saída gpt-image-2 | Ação de pós-processamento | Nº final de camadas |

|---|---|---|---|

| Botão | PNG transparente | Fatiamento de estado (padrão/hover/clique) | 3 |

| Ícone | PNG transparente | Separação de brilho/sombra | 2-4 |

| Banner | PNG RGB | Separação de objeto/fundo/efeitos de luz | 3-5 |

| Cartão | PNG RGB | Separação de borda/fundo/selo | 3-4 |

Caso 3: Versões multilíngues de conteúdo de marketing

A equipe de publicidade precisa adaptar um visual principal para 10 idiomas, com a necessidade central de manter a camada de texto independente e a camada de imagem fixa.

Operação chave:

- Usar o gpt-image-2 para gerar um visual principal "sem texto" (especificar

no text,no lettersno comando). - Criar um espaço reservado para a camada de texto via psd-tools.

- Posteriormente, basta modificar a camada de texto para exportar as 10 versões de idioma.

A vantagem deste fluxo é: o visual principal é gerado apenas uma vez e a camada de texto é totalmente controlável, evitando erros de ortografia comuns quando a IA gera textos em múltiplos idiomas.

🎯 Dica sobre idiomas: O gpt-image-2 é relativamente confiável para gerar textos em inglês, mas tende a cometer erros em chinês, japonês e coreano. Ao chamar o gpt-image-2 via APIYI (apiyi.com), recomenda-se excluir explicitamente o texto no comando e gerenciá-lo centralmente através da camada de texto do PSD.

Caso 4: Auxílio em storyboard para mangás e ilustrações

Ilustradores costumam usar o gpt-image-2 para gerar inspirações de rascunho e, em seguida, refiná-las no Photoshop. Esse fluxo híbrido de "IA para inspiração + refinamento humano" exige uma estrutura de camadas bem organizada.

Esquema de camadas típico:

- Camada de rascunho: Imagem original do gpt-image-2, mantida como base de referência.

- Camada de lineart: Traços desenhados com base no rascunho.

- Camada de cor base: Preenchimento de blocos de cor.

- Camada de sombra: Definição de áreas escuras.

- Camada de brilho: Detalhes de luz.

- Camada de efeitos: Elementos decorativos.

Pontos de operação:

1. gpt-image-2 gera composição vertical 1024x1536

2. No Photoshop, defina esta imagem como Camada 0 (bloqueada para edição)

3. Crie 5-6 novas camadas vazias acima dela para desenhar

4. Salve como PSD após concluir

Este fluxo transforma o rascunho da IA em um ativo que permite a continuação da criação, em vez de ser apenas uma imagem descartável.

Comparação do gpt-image-2 com outros formatos de imagem

Para entender melhor a posição do PSD no seu fluxo de trabalho, vamos fazer uma análise comparativa dele com outros formatos de saída comuns.

| Formato | Tamanho do arquivo | Facilidade de edição | Compatibilidade entre softwares | Adequado para pós-processamento do gpt-image-2 |

|---|---|---|---|---|

| PNG | Médio | Baixa (achatado) | ✅ Excelente | ⭐⭐⭐⭐⭐ Padrão recomendado |

| JPEG | Pequeno | Muito baixa | ✅ Excelente | ⭐⭐⭐ Apenas para visualização |

| WEBP | Pequeno | Baixa | ⚠️ Focado na Web | ⭐⭐⭐ Adequado para cenários Web |

| PSD | Grande | ✅ Muito alta | ⚠️ Ecossistema Adobe | ⭐⭐⭐⭐ Requer pós-processamento |

| TIFF | Muito grande | Média | ✅ Focado em impressão | ⭐⭐ Cenários de impressão |

| SVG | Pequeno | ✅ Muito alta (vetorial) | ✅ Web/Impressão | ❌ Não suportado pelo gpt-image-2 |

Como podemos ver nesta tabela, o valor central do PSD é a "facilidade de edição", algo difícil de substituir por outros formatos. Se você não precisa de edição posterior, o PNG geralmente é a escolha mais adequada.

Resumo das melhores práticas para saída de PSD no gpt-image-2

Voltando à pergunta inicial: como o gpt-image-2 gera arquivos PSD? Após uma análise completa, podemos resumir a conclusão em três pontos principais:

- O caminho da API não gera PSD diretamente: A API do gpt-image-2 suporta apenas os três formatos rasterizados (PNG / JPEG / WEBP); este é o limite de capacidade do próprio modelo.

- A versão web do ChatGPT pode gerar PSDs com camadas reais via Photoshop: O aplicativo Adobe Photoshop assume o processamento das camadas, sendo ideal para demandas leves de designers individuais.

- Cenários de engenharia exigem uma solução combinada de "geração via API + pós-processamento": Utilizando ferramentas como SAM/rembg para separar camadas automaticamente e o

psd-toolspara gravar o arquivo, é possível alcançar automação em lote.

| Perfil de usuário | Solução recomendada | Combinação de ferramentas |

|---|---|---|

| Designer individual | Solução A | Integração ChatGPT + Photoshop |

| Pequenas/médias equipes | Solução B | API do gpt-image-2 + separação manual no Photoshop desktop |

| Desenvolvedores corporativos | Solução C | API do gpt-image-2 + pipeline de separação automatizada |

🎯 Recomendação final: Experimente primeiro a integração com o Photoshop na versão web do ChatGPT para entender o fluxo de camadas antes de decidir construir um pipeline de API. Se decidir pela integração de engenharia, você pode acessar o gpt-image-2 de forma unificada através da APIYI (apiyi.com). A plataforma oferece interfaces compatíveis com OpenAI acessíveis no país, garantindo estabilidade de nível corporativo e transparência na cobrança.

Esperamos que este guia completo sobre saída de PSD no gpt-image-2 ajude você a evitar caminhos desnecessários. A verdadeira dificuldade em gerar arquivos PSD com o gpt-image-2 não está na API, mas na escolha do fluxo de trabalho adequado. Ao combinar suas necessidades de volume, orçamento e automação com as soluções A, B ou C, você geralmente conseguirá implementar o fluxo completo em uma semana.

Autor: Equipe Técnica APIYI | apiyi.com — Plataforma de serviço proxy de API para Modelos de Linguagem Grande de nível corporativo