Ao utilizar a API gpt-image-2 em ambientes de produção, os desenvolvedores frequentemente se deparam com este erro 400 confuso:

{

"status_code": 400,

"error": {

"message": "Your request was rejected by the safety system. If you believe this is an error, contact us at Azure support ticket and include the request ID 76fd2cbc-63ee-4e30-8bea-5fc2a2e1faa3.",

"type": "shell_api_error",

"code": "moderation_blocked"

}

}

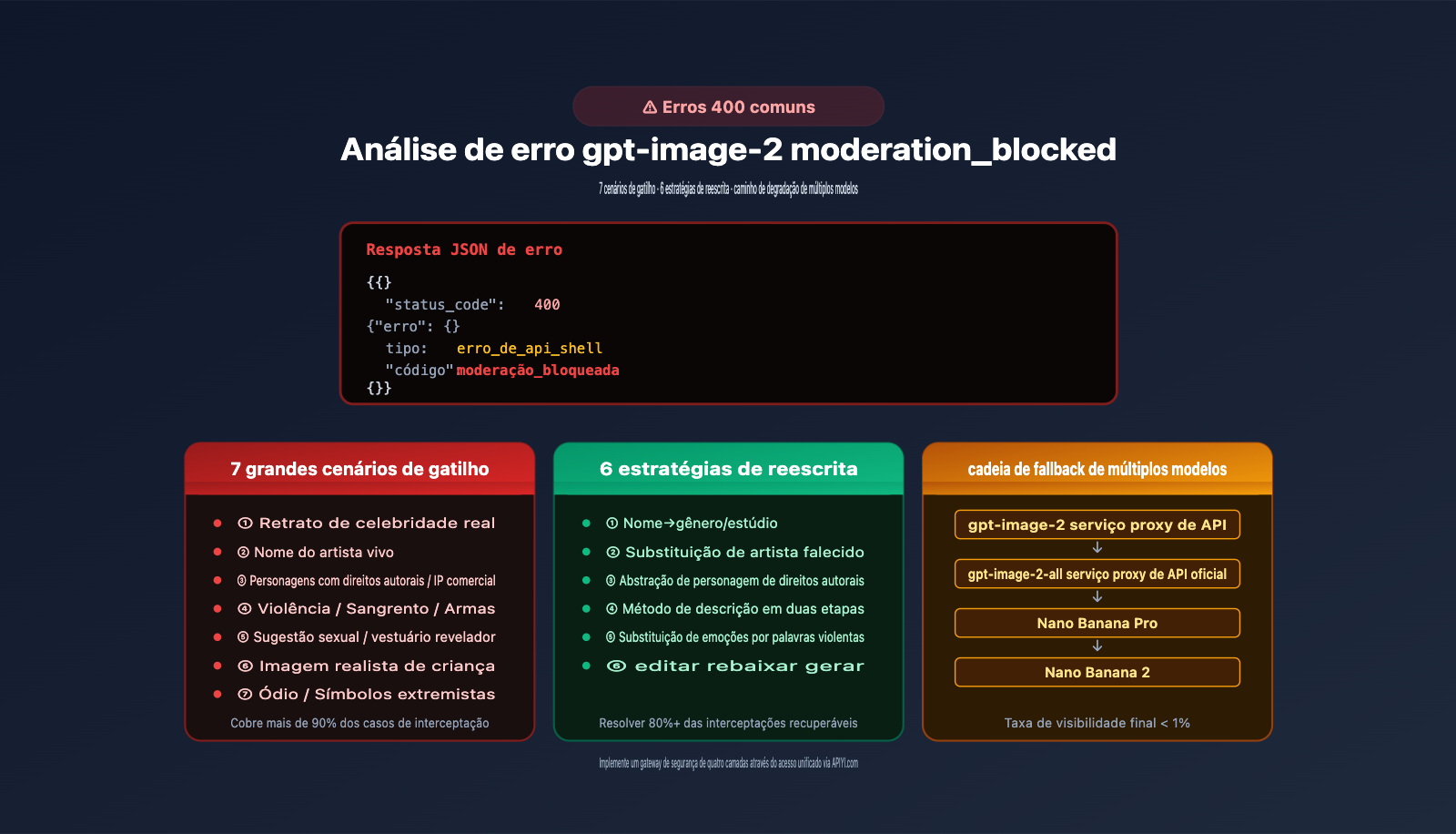

Este erro moderation_blocked vem do sistema de segurança de conteúdo da OpenAI/Azure. Ele intercepta ativamente solicitações que considera violarem as políticas, antes ou depois da inferência do modelo. Diferente de um erro comum de limite de taxa (429) ou erro de serviço (500), o moderation_blocked não desaparece sozinho — se você não alterar o comando, pode tentar dez mil vezes e continuará sendo bloqueado.

Este artigo analisa sistematicamente os princípios técnicos do erro moderation_blocked, os 7 cenários de gatilho mais comuns, métodos de diagnóstico e reprodução, além de apresentar 6 estratégias de reescrita de comando e soluções alternativas com outros modelos, ajudando você a reduzir a incidência desses erros a um nível aceitável.

1. Princípios técnicos do erro 400 moderation_blocked no gpt-image-2

1.1 Decomposição da estrutura do erro

O corpo do erro mencionado acima contém vários campos fundamentais:

| Campo | Significado |

|---|---|

status_code: 400 |

HTTP 400 Bad Request, indica que a solicitação do cliente foi rejeitada |

type: shell_api_error |

Erro na camada de gateway da API, não um erro de inferência do modelo |

code: moderation_blocked |

Código de erro principal: bloqueado pelo sistema de segurança de conteúdo |

message |

Explicação legível para humanos, contendo o ID da solicitação |

request id |

ID de rastreamento para suporte ou investigação |

Note que a mensagem menciona "Azure support ticket" — esta é uma pista importante: alguns fluxos de implantação do gpt-image-2 são hospedados pelo Azure OpenAI, portanto, o sistema de segurança é o filtro de conteúdo do Azure. As regras de filtragem do Azure são mais rigorosas do que a conexão direta com a OpenAI, o que é a causa fundamental da grande variação na taxa de acionamento do moderation_blocked entre diferentes canais.

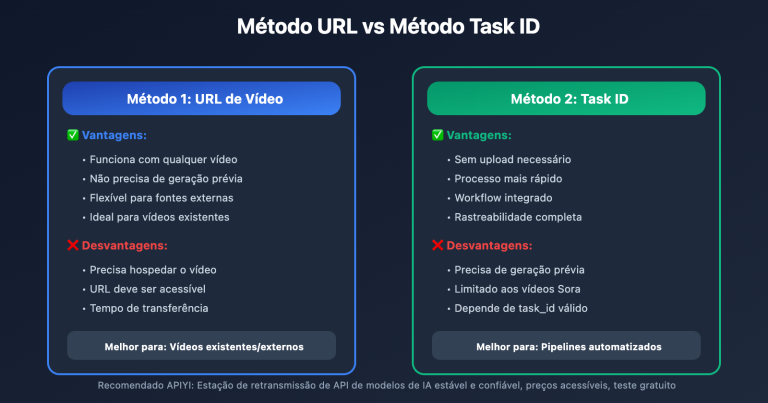

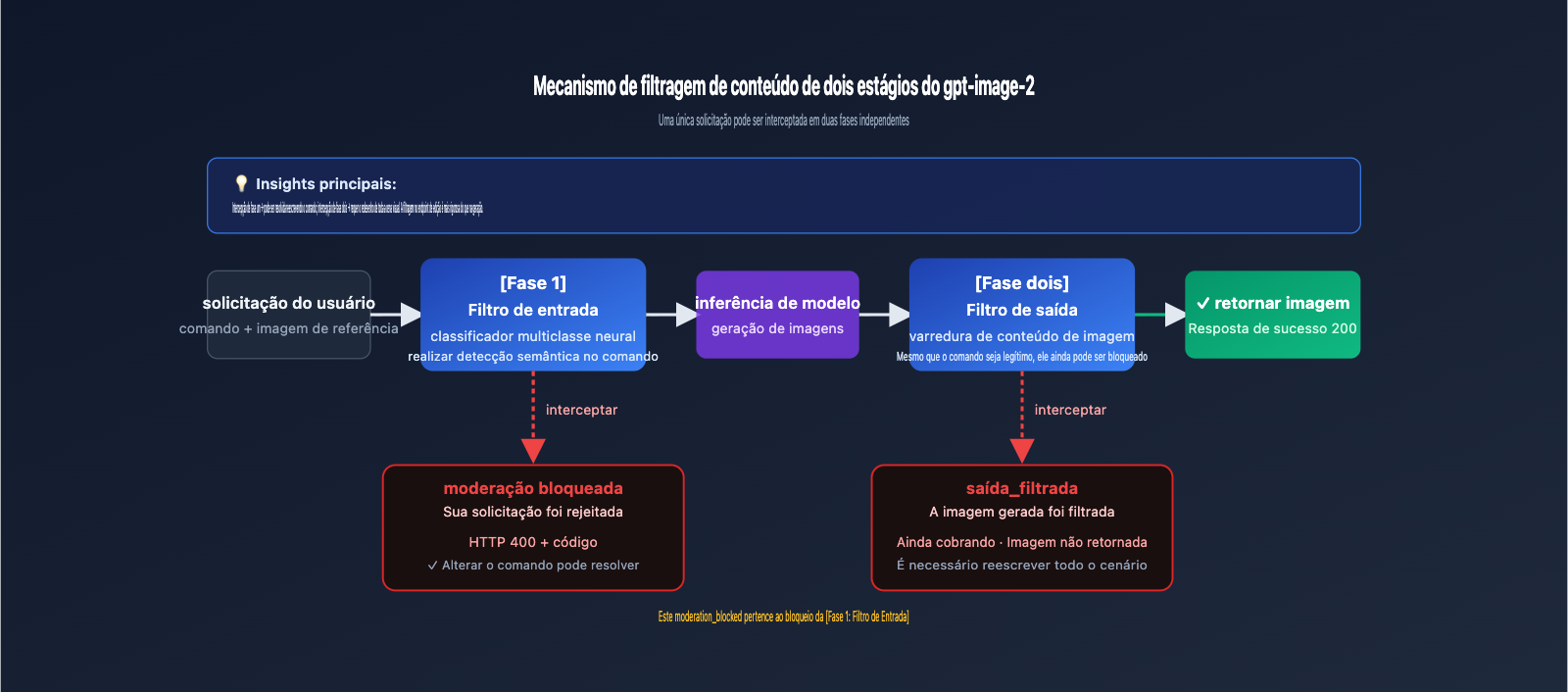

1.2 Mecanismo de filtragem de conteúdo em duas etapas do gpt-image-2

De acordo com o System Card oficial do ChatGPT Images 2.0 da OpenAI e a documentação do Azure OpenAI, a revisão de conteúdo do gpt-image-2 adota uma filtragem em duas etapas:

Solicitação do usuário

↓

【Etapa 1: Filtro de entrada (Input Filter)】

↓ (Passou)

Inferência do modelo para gerar a imagem

↓

【Etapa 2: Filtro de saída (Output Filter)】

↓ (Passou)

Retorno da imagem ao usuário

Etapa 1 (Filtro de entrada): Antes da inferência do modelo, realiza-se uma detecção de classificação no texto do comando + imagem de referência. Utiliza-se um classificador neural multiclasse para detectar conteúdos que violam as políticas da OpenAI (ódio, violência, sexual, automutilação, figuras públicas, direitos autorais, etc.).

Etapa 2 (Filtro de saída): Após a geração da imagem, realiza-se uma nova varredura. Mesmo que o comando seja legítimo, se a imagem gerada "parecer" violar as políticas, ela ainda será bloqueada.

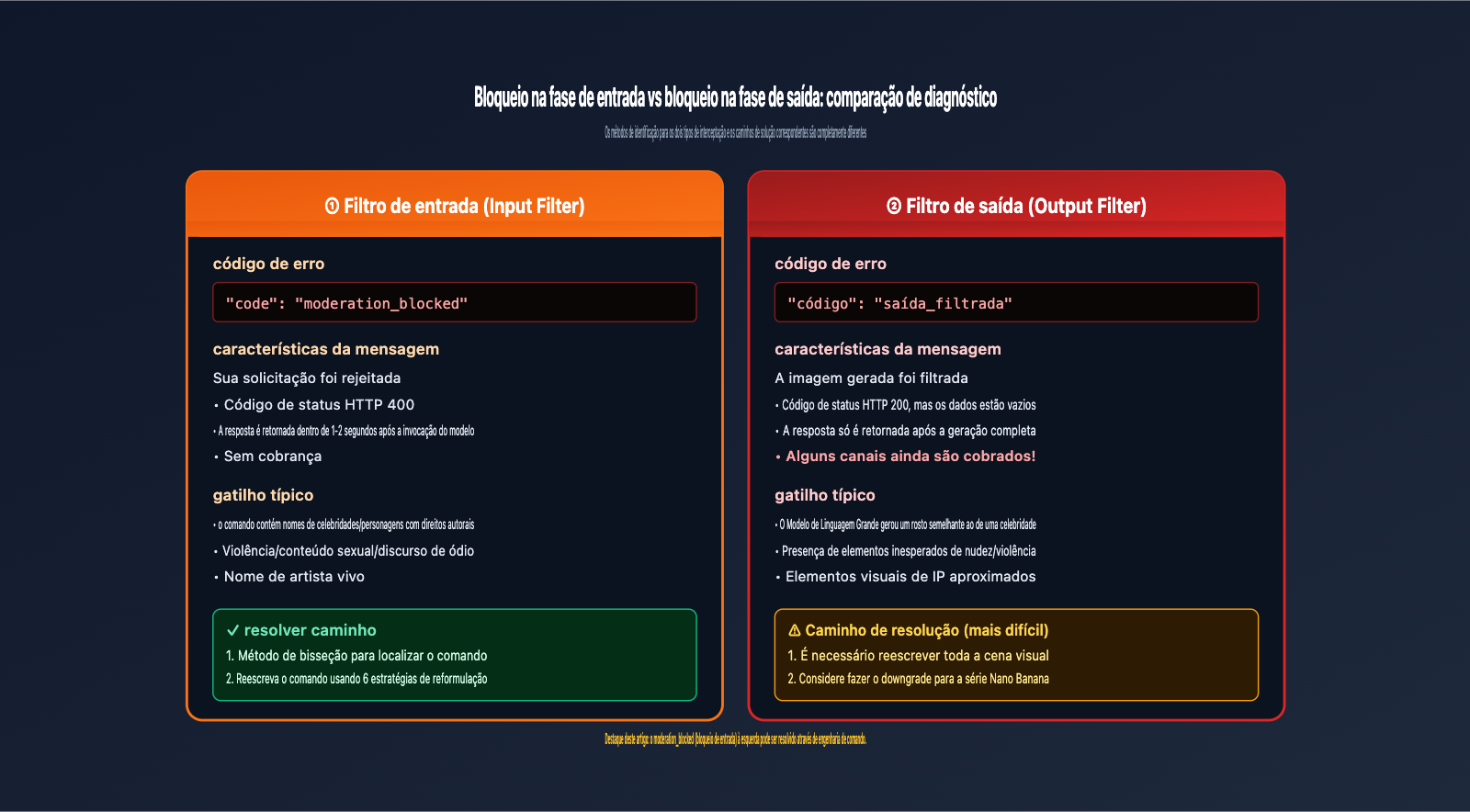

Diferença chave:

- Se o erro for

"Your request was rejected"→ Bloqueado na etapa de entrada, pode ser resolvido alterando o comando. - Se o erro for

"Generated image was filtered"→ Bloqueado na etapa de saída, é necessário reescrever todo o cenário.

O moderation_blocked discutido neste artigo pertence ao primeiro caso — bloqueado na etapa de entrada, o que significa que a otimização no nível do comando ainda é a forma mais eficaz de resolução.

1.3 A filtragem do endpoint de edição do gpt-image-2 é mais rigorosa

Um fato frequentemente negligenciado: a estratégia de filtragem do endpoint /v1/images/edits é mais rigorosa do que a do /v1/images/generations.

A documentação oficial do Azure esclarece: para edição de imagens, são adicionadas verificações de segurança extras sobre a filtragem de geração, o que significa que o mesmo comando + imagem pode passar no endpoint de geração, mas ser bloqueado por moderation_blocked no endpoint de edições. Este é um comportamento de design intencional para evitar que usuários façam modificações indevidas em fotos existentes (como deepfake, remoção de roupas, etc.).

二、 7 principais cenários que disparam o erro moderation_blocked no gpt-image-2

Os 7 cenários a seguir estão listados por frequência real de ocorrência e cobrem mais de 90% dos casos de moderation_blocked.

2.1 Cenário 1: Retratos de pessoas reais e nomes de celebridades

Este é o motivo mais comum. Qualquer comando (prompt) nos formatos abaixo tem grande chance de ser bloqueado:

❌ Padrão de alto risco:

- Gerar uma foto do Elon Musk em Marte

- Uma foto de Trump e Obama juntos

- Palco do show da Taylor Swift

- Uma atriz que se parece com Scarlett Johansson

A OpenAI aplica proteção rigorosa por padrão a retratos de celebridades que não optaram por sair (opt-out). Após o incidente com Bryan Cranston em outubro de 2025, essa estratégia foi ainda mais endurecida. Mesmo que você queira gerar alguém "que se pareça com" em vez de usar o nome diretamente, se o comando mencionar o nome de uma figura pública, ele será bloqueado.

2.2 Cenário 2: Artistas vivos famosos e expressões estilizadas

O nome de artistas/criadores vivos é uma palavra-chave de bloqueio forte:

❌ Alto risco:

- Ilustração no estilo de Hayao Miyazaki

- Cena noturna urbana com tons de Makoto Shinkai

- Grafite de rua no estilo Banksy

✅ Escrita equivalente de baixo risco:

- Estilo Ghibli / Estilo de animação japonesa moderna e brilhante

- Cena de animação japonesa juvenil com cores saturadas

- Estilo de arte de rua urbana moderna

Regra: Converta "nome do artista" em "gênero/estúdio/nome do estilo". Artistas falecidos (Van Gogh, Monet) geralmente não são bloqueados.

2.3 Cenário 3: Personagens com direitos autorais e IP comercial

Personagens nomeados sob IPs como Disney, Marvel, Ghibli, Pixar, Nintendo, etc., são bloqueios rígidos:

❌ Alto risco:

- Homem-Aranha balançando entre prédios

- Cena de festa do Mickey Mouse

- Um Pikachu na floresta

✅ Escrita equivalente de baixo risco:

- Um personagem vigilante original vestindo um traje de super-herói vermelho e azul, balançando em uma metrópole neon com teias

- Uma festa retrô organizada por um rato antropomórfico de desenho animado

- Uma criatura amarela de desenho animado do tipo elétrico na floresta

Regra: Use "inspirado em" ou "estilo similar" em vez de nomear o personagem diretamente.

2.4 Cenário 4: Violência, sangue e detalhes de armas

❌ Alto risco:

- Close de ferimento sangrando

- Sangue espirrando no momento de uma explosão

- Foto detalhada de produto de uma AK-47

✅ Escrita de evasão:

- Imagem abstrata com respingos de tinta vermelho-escura

- Cena de super-herói com explosão de luz brilhante acompanhada de fragmentos

- Conceito de arma em um jogo tático (estilizado, não realista)

Regra: Substitua descrições "realistas, detalhadas, clínicas" por "artísticas, abstratas, estilizadas".

2.5 Cenário 5: Sugestões sexuais e vestimentas reveladoras

Esta é uma das áreas mais rigorosas do gpt-image-2. Qualquer conteúdo que possa ser interpretado como sugestão sexual será bloqueado, incluindo descrições aparentemente inofensivas:

❌ Alto risco (parece inofensivo, mas será bloqueado):

- Cena de praia com biquíni

- Mulher com ombros expostos

- Roupa justa colada ao corpo

- Pose sedutora

✅ Escrita de evasão:

- Cena de férias em praia de verão, plano aberto

- Mulher vestindo um vestido de noite elegante

- Foto de moda esportiva estilo revista

- Pose de modelo confiante

Regra: Evite adjetivos como "justo, exposto, sexy, sedutor" e use termos neutros como "elegante, fashion, confiante".

2.6 Cenário 6: Imagens realistas relacionadas a crianças

A OpenAI adota uma política de tolerância quase zero para a geração realista de crianças. Qualquer uma das escritas abaixo será bloqueada:

❌ Alto risco:

- Foto realista de uma menina de 8 anos

- Criança de roupa de banho na beira da piscina

- Foto detalhada de um bebê

✅ Escrita segura:

- Ilustração de cena de infância estilo desenho animado

- Cena familiar realista em plano aberto, sem focar em nenhum indivíduo

- Ilustração artística de uma mãe segurando um bebê

Regra: Para conteúdos relacionados a crianças, tente usar estilo de ilustração/desenho animado e evite palavras como "realista, close, detalhado, qualidade fotográfica".

2.7 Cenário 7: Ódio, política extrema e símbolos sensíveis

Símbolos de ódio, totens políticos extremos e representações de conflitos religiosos são bloqueios rígidos:

❌ Alto risco:

- Suástica nazista

- Cena de oposição política extrema

- Narrativa de conflito de países específicos

Esse tipo de conteúdo quase não tem espaço para reescrita de comando; recomenda-se evitar completamente essa direção temática.

III. Fluxo de diagnóstico para o erro moderation_blocked no gpt-image-2

3.1 Fluxograma de diagnóstico

Ao receber o erro moderation_blocked, siga este processo de diagnóstico:

Passo 1. Registre a mensagem de erro completa + request id

↓

Passo 2. Determine se é "rejected" (bloqueio de entrada) ou "filtered" (bloqueio de saída)

↓

Passo 3. Compare com os 7 cenários de disparo para localizar a causa

↓

Passo 4. Remova gradualmente palavras-chave do comando usando busca binária para reproduzir

↓

Passo 5. Escolha a estratégia de reescrita correspondente (veja o capítulo 4)

↓

Passo 6. Tente novamente após reescrever e registre a mudança na taxa de sucesso

3.2 Reprodução de palavras de gatilho por busca binária no comando

Quando não tiver certeza de qual palavra no comando disparou o bloqueio, você pode usar a busca binária:

from openai import OpenAI

client = OpenAI(

api_key="SUA_CHAVE_APIYI",

base_url="https://api.apiyi.com/v1"

)

def binary_search_trigger(full_prompt: str):

"""Usa busca binária para encontrar a palavra-chave que dispara o moderation_blocked"""

words = full_prompt.split()

mid = len(words) // 2

left_half = " ".join(words[:mid])

right_half = " ".join(words[mid:])

for test_prompt in [left_half, right_half]:

try:

client.images.generate(

model="gpt-image-2",

prompt=test_prompt,

size="1024x1024",

quality="low",

n=1

)

print(f"✓ Passou: {test_prompt[:40]}...")

except Exception as e:

if "moderation_blocked" in str(e):

print(f"✗ Disparou: {test_prompt[:40]}...")

binary_search_trigger("Conteúdo original do comando ...")

Ao executar este script através da APIYI apiyi.com, use quality="low" para reduzir o custo de cada teste ao mínimo ($0,006/imagem) e localizar rapidamente a palavra de gatilho.

3.3 Pré-verificação com a API de Moderação da OpenAI

A OpenAI fornece um endpoint gratuito /v1/moderations que permite pré-verificar o texto do comando antes da invocação do modelo de geração de imagens para ver se ele será bloqueado:

def pre_check_prompt(prompt: str):

result = client.moderations.create(

model="omni-moderation-latest",

input=prompt

)

categories = result.results[0].categories

scores = result.results[0].category_scores

flagged_categories = [

(cat, scores.model_dump()[cat])

for cat, flagged in categories.model_dump().items()

if flagged

]

if flagged_categories:

print(f"⚠️ Comando marcado: {flagged_categories}")

return False

return True

Atenção: A pré-verificação só consegue verificar a dimensão do texto e não consegue detectar bloqueios de "julgamento semântico", como direitos autorais ou celebridades. No entanto, possui alta precisão para palavras obviamente proibidas como "violência, sexo, ódio".

IV. 6 estratégias de reescrita de comandos para o erro moderation_blocked no gpt-image-2

4.1 Estratégia 1: Substituir nomes por gêneros ou estúdios

| Escrita original | Reescrita |

|---|---|

| Estilo Hayao Miyazaki | Ghibli / Estilo de animação japonesa moderna e brilhante |

| Estilo Makoto Shinkai | Animação japonesa juvenil com cores saturadas |

| Estilo Disney | Estilo clássico de desenho animado americano |

| Anne Hathaway | Uma atriz elegante de 35 anos |

| Elon Musk | Um fundador de empresa de tecnologia vestindo terno |

4.2 Estratégia 2: Substituir artistas vivos por artistas falecidos

Artista vivo → Artista falecido do mesmo gênero:

| Artista vivo (bloqueado) | Artista falecido (permitido) |

|---|---|

| Grafite estilo Banksy | Grafite estilo Basquiat / Arte de rua dos anos 80 |

| Estilo Makoto Shinkai | (Use diretamente "estilo de animação japonesa") |

| Hayao Miyazaki | (Use "Ghibli") |

| Takashi Murakami | Estilo Pop Art / Estilo Andy Warhol |

Mestres clássicos como Van Gogh, Monet, Picasso, Rembrandt, Hokusai, etc., são referências seguras.

4.3 Estratégia 3: Abstração de personagens com direitos autorais

Abstraia IPs nomeados em "características gerais + descrição narrativa":

Escrita original: Homem-Aranha balançando sobre Nova York

Reescrita: Um jovem vestindo um traje de super-herói justo nas cores vermelho e azul, usando uma máscara, balançando entre arranha-céus de uma metrópole neon com teias, cheio de dinamismo e vitalidade

Escrita original: Pikachu na floresta

Reescrita: Uma criatura de desenho animado amarela, redonda e fofa, do tipo elétrico, com bochechas vermelhas e orelhas pontudas, saltando em uma floresta verde densa

Dica principal: mantenha as características visuais, remova o nome.

4.4 Estratégia 4: Descrição em duas etapas (Two-Step Description)

Para cenas complexas que podem violar as diretrizes, use o método de duas etapas:

Passo 1: Peça ao Gemini Pro ou Claude 4 Sonnet para "traduzir" sua ideia original em uma descrição de elementos puramente visuais, removendo proativamente todos os nomes de celebridades/IPs/palavras sensíveis.

Passo 2: Use a saída do Passo 1 como o comando real para o gpt-image-2.

def two_step_generate(raw_idea: str):

# O rewriter_response traduz a ideia para uma descrição visual segura

rewriter_response = client.chat.completions.create(

model="gemini-3-pro",

messages=[

{

"role": "system",

"content": (

"Você é um especialista em descrição visual. Reescreva a ideia do usuário como uma descrição de elementos puramente visuais:"

"Remova todos os nomes reais, nomes de marcas, nomes de personagens com direitos autorais e palavras sensíveis;"

"Mantenha: cores, composição, iluminação, ação, atmosfera, textura, lente."

"Produza uma narrativa coerente de 150-250 palavras, sem listas."

)

},

{"role": "user", "content": raw_idea}

]

)

safe_prompt = rewriter_response.choices[0].message.content

return client.images.generate(

model="gpt-image-2",

prompt=safe_prompt,

size="1024x1024",

quality="medium"

)

Este método utiliza a integração multimodal da APIYI (apiyi.com) para usar um LLM de texto como uma "camada de purificação de segurança" frontal, reduzindo drasticamente a taxa de acionamento do moderation_blocked na API de imagens.

4.5 Estratégia 5: Substituir vocabulário violento/sexual por emoção/atmosfera

| Palavra original | Substituição neutra |

|---|---|

| Sangrento (bloody) | Tons de vermelho profundo / Dramático |

| Violento (violent) | Intenso / Cheio de tensão |

| Sexy (sexy) | Elegante / Confiante / Atraente |

| Nu (naked/nude) | Estilo de escultura clássica / Arte corporal |

| Sedutor (seductive) | Temperamento encantador |

| Matança (killing) | Confronto dramático |

| Arma (weapon) | Adereço / Ferramenta |

4.6 Estratégia 6: Rebaixar para o endpoint de geração ao usar o endpoint de edição

Como mencionado anteriormente, o endpoint de edições possui filtros mais rigorosos. Se sua tarefa é "editar com base em uma imagem existente", tente:

Fluxo original: /v1/images/edits (bloqueado)

Fluxo alternativo:

- Use um LLM para descrever os elementos visuais da imagem original.

- Adicione os "pontos de modificação".

- Use

/v1/images/generationspara regenerar.

Embora sacrifique a consistência em nível de pixel, isso evita os filtros de edição rigorosos.

V. Soluções de backup com múltiplos modelos para o erro moderation_blocked no gpt-image-2

Quando um único modelo encontra um bloqueio rígido, o roteamento de múltiplos modelos é a prática padrão em aplicações corporativas.

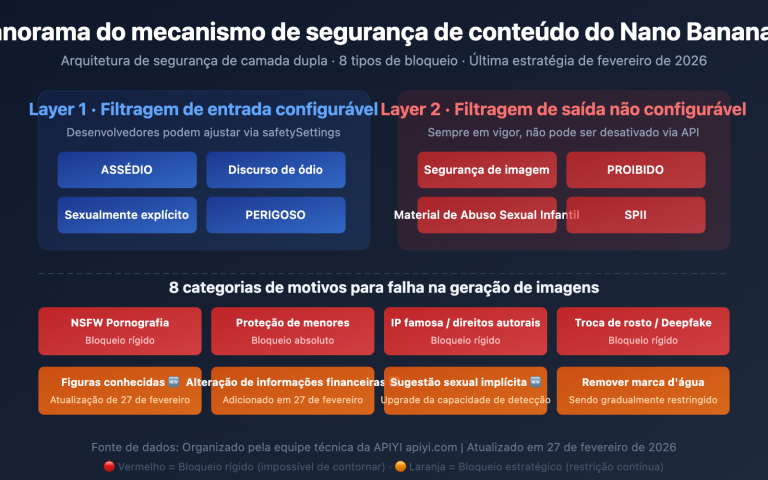

5.1 Comparação da rigorosidade de filtragem dos modelos de imagem

| Modelo | Rigor de filtragem | Tolerância a celebridades | Tolerância a IP | Expressão artística |

|---|---|---|---|---|

gpt-image-2 (Oficial) |

🔴 Rigoroso | Extremamente rigoroso | Rigoroso | Conservador |

gpt-image-2-all (Inverso) |

🟡 Médio | Médio | Médio | Flexível |

| Nano Banana Pro | 🟢 Mais relaxado | Médio | Médio | Flexível |

| Nano Banana 2 | 🟢 Mais relaxado | Médio | Médio | Flexível |

| Série Imagen | 🟡 Médio | Rigoroso | Médio | Médio |

Sugestão prática: Quando o gpt-image-2 oficial for bloqueado, você pode tentar o rebaixamento sequencial:

gpt-image-2 (Oficial) [moderation_blocked]

↓

gpt-image-2-all (Inverso) [pode passar]

↓

Nano Banana Pro [maior probabilidade de passar]

↓

Nano Banana 2 [mais flexível, qualidade ligeiramente inferior]

5.2 Exemplo de código para rebaixamento automático

from openai import OpenAI

client = OpenAI(

api_key="SUA_CHAVE_APIYI",

base_url="https://api.apiyi.com/v1"

)

MODEL_FALLBACK_CHAIN = [

("gpt-image-2", "images"),

("gpt-image-2-all", "chat"),

("gemini-3-pro-image-preview", "images"),

("gemini-3.1-flash-image-preview", "images"),

]

def generate_with_fallback(prompt: str):

last_error = None

for model_id, endpoint in MODEL_FALLBACK_CHAIN:

try:

if endpoint == "images":

return client.images.generate(

model=model_id,

prompt=prompt,

size="1024x1024"

)

else:

return client.chat.completions.create(

model=model_id,

messages=[{"role": "user", "content": prompt}]

)

except Exception as e:

if "moderation_blocked" in str(e) or "content_policy" in str(e):

print(f"Modelo {model_id} bloqueado, tentando o próximo")

last_error = e

continue

raise

raise Exception(f"Todos os modelos foram bloqueados, erro final: {last_error}")

O valor central deste padrão: sob a mesma conta APIYI (apiyi.com), você implementa o rebaixamento de múltiplos modelos apenas alterando o parâmetro do modelo, sem precisar registrar vários serviços ou gerenciar várias credenciais.

5.3 Estratégia avançada de roteamento por tipo de conteúdo

Uma abordagem mais refinada é prever o modelo mais adequado de acordo com o tipo de conteúdo:

| Tipo de conteúdo | Modelo preferencial | Motivo |

|---|---|---|

| Material de marca corporativa | gpt-image-2 (Oficial) | Estável, em conformidade |

| Cartazes com texto em chinês | gpt-image-2-all (Inverso) | Otimizado nativamente para chinês |

| Imagens criativas com possível IP | Nano Banana Pro | Filtragem mais relaxada |

| Geração em lote rápida | Nano Banana 2 | Rápido, baixo custo |

| Imagens artísticas de estilo especial | Nano Banana Pro | Expressão artística flexível |

VI. Processo de apelação empresarial para moderation_blocked do gpt-image-2

Quando você tiver certeza de que o comando é legítimo e não deveria ter sido bloqueado (falso positivo), você pode iniciar o processo de apelação.

6.1 Lista de verificação de informações necessárias para a apelação

Antes de enviar a apelação, reúna as seguintes informações:

- Resposta de erro completa (incluindo o ID da requisição)

- Comando completo que disparou o moderation_blocked

- Timestamp da invocação

- ID da sua conta

- Descrição do cenário de negócio (por que este comando é necessário)

- Passos para reprodução (se é um erro estável ou esporádico)

6.2 Canais de apelação

L1: Nível de autoatendimento (mais rápido)

Tente primeiro as 6 estratégias de reescrita do capítulo 4 deste artigo. Mais de 90% dos casos de moderation_blocked podem ser resolvidos neste nível, com custo zero.

L2: Canal de serviço empresarial APIYI (recomendado)

Para clientes corporativos, a APIYI (apiyi.com) oferece suporte técnico dedicado, fornecendo para casos específicos de moderation_blocked:

- Sugestões de reescrita de comandos

- Design de planos de fallback entre modelos

- Processo de apelação junto à OpenAI/Azure

Este nível oferece uma resposta rápida, e a equipe da APIYI acumulou vasta experiência em apelações de falsos positivos em modelos de imagem, sendo muito mais eficiente do que abrir chamados oficiais por conta própria.

L3: Apelação oficial (mais lenta, porém definitiva)

Envie uma apelação através do ticket de suporte da Azure ou da Central de Ajuda oficial da OpenAI mencionados na mensagem de erro, anexando o ID da requisição completo. O ciclo de resposta geralmente leva de 3 a 10 dias úteis.

6.3 Práticas de engenharia para reduzir sistematicamente a taxa de bloqueio

Para sistemas de produção com alta frequência de chamadas, recomendamos a construção de um Gateway de Segurança de Comandos:

Requisição original do usuário

↓

[1] Pré-triagem de lista negra de palavras-chave (nível de segundos)

↓

[2] Pré-verificação da API de Moderações da OpenAI (gratuito, 300ms)

↓

[3] Reescrita do comando para um formato seguro via LLM de texto (opcional, 1-2 segundos)

↓

[4] Invocação do gpt-image-2

↓

[5] Fallback automático para modelo reserva ao receber moderation_blocked

↓

Retorno do resultado

Com essas 5 camadas de proteção, é possível reduzir a taxa de visibilidade do moderation_blocked para o usuário final para menos de 1%.

🎯 Dica de implementação: Todas as chamadas externas desta rede de segurança (API de Moderações, LLM de texto, múltiplos modelos de imagem) podem ser feitas através de um único ponto de acesso na APIYI (apiyi.com), com faturamento e logs unificados, reduzindo drasticamente a complexidade da engenharia.

VII. FAQ: Perguntas frequentes sobre o erro moderation_blocked no gpt-image-2

Q1: Por que o mesmo comando funciona hoje, mas é bloqueado por moderation_blocked amanhã?

Os classificadores de segurança da OpenAI e da Azure são atualizados continuamente, especialmente após eventos importantes (como o opt-out de celebridades), o que causa bloqueios em massa. Recomendamos registrar um snapshot do comando que gerou o moderation_blocked em seu sistema de produção para análise posterior.

Q2: O uso do gpt-image-2-all (versão reversa oficial) pode contornar o moderation_blocked?

Em alguns cenários sim, mas não é uma solução mágica. O link da versão oficial também possui suas próprias verificações de segurança, apenas com limites e regras ligeiramente diferentes. Para certos tipos de bloqueios (como nomes de celebridades), ambos os modelos irão bloquear. Recomendamos realizar testes A/B entre os dois modelos via APIYI (apiyi.com) para descobrir qual caminho oferece maior tolerância para o seu caso de uso.

Q3: O erro moderation_blocked gera cobrança?

Não. O erro 400 é um erro do cliente; nem a OpenAI nem a APIYI cobram por solicitações bloqueadas. Você pode realizar a depuração de comandos com tranquilidade.

Q4: Por que comandos em chinês têm uma probabilidade maior de acionar o moderation_blocked do que em inglês?

Não é um problema do idioma em si, mas sim porque comandos em chinês podem trazer palavras de gatilho em inglês inesperadas ao serem traduzidos para a representação interna do modelo. Sugestões: (1) Evite nomear celebridades/IPs diretamente no comando em chinês; (2) Tente usar o gpt-image-2-all, que possui otimização nativa para comandos em chinês.

Q5: Se eu quiser gerar fotos dos meus funcionários para uso interno, serei bloqueado?

Muito provavelmente. O sistema de segurança da OpenAI não consegue determinar se "você é realmente o funcionário"; se for identificado como um retrato de uma pessoa real, o sistema bloqueará. Recomendamos usar o endpoint de edição (enviar a imagem original + máscara para modificação) ou usar um "processamento artístico estilizado" em vez de fotos realistas.

Q6: Clientes corporativos podem solicitar a redução do limite de filtragem?

Com a conexão direta à OpenAI, é quase impossível. Em alguns contratos corporativos da Azure OpenAI, é possível solicitar o ajuste do nível de filtro de conteúdo (sujeito a aprovação). Através do canal de serviços corporativos da APIYI (apiyi.com), podemos ajudá-lo a lidar com o processo de aprovação da Azure ou fornecer soluções multimodelo personalizadas para contornar restrições de ponto único.

Q7: A filtragem do Nano Banana Pro é realmente mais flexível que a do gpt-image-2?

Em testes extensivos, o Nano Banana Pro é de fato mais tolerante com expressões artísticas e referências a IPs menos rígidas, mas em áreas críticas como conteúdo infantil, conteúdo sexual e violência extrema, ele é quase idêntico à OpenAI — nenhum modelo convencional consegue contornar essas linhas vermelhas.

Q8: O que significa o "Azure support ticket" na mensagem de erro?

Isso indica que o link subjacente passa pela Azure OpenAI. Diferentes serviços proxy de API conectam-se a backends distintos; alguns conectam-se diretamente à OpenAI, outros via Azure. A rigidez da filtragem varia entre os backends, e é por isso que o mesmo comando pode ter comportamentos diferentes em provedores distintos.

VIII. Resumo: Estratégias para lidar com o erro moderation_blocked no gpt-image-2

Voltando à mensagem de erro inicial, agora sabemos que:

- Essência do erro:

moderation_blockednão é um problema de capacidade do modelo, mas um bloqueio proativo do classificador de segurança antes da inferência do modelo. - Erro não recuperável: Sem alterar o comando, tentar dez mil vezes resultará no mesmo erro.

- 7 cenários de gatilho: Celebridades / Artistas vivos / IPs protegidos por direitos autorais / Violência / Sugestão sexual / Imagens realistas de crianças / Símbolos de ódio.

- 6 estratégias de reescrita: Substituição de nomes / Substituir vivos por falecidos / Abstração de personagens / Descrição em duas etapas / Substituir violência por emoção / Rebaixar para o endpoint de edição.

- Backup multimodelo: Cadeia de degradação: gpt-image-2 → gpt-image-2-all → Nano Banana Pro → Nano Banana 2.

- Proteção de engenharia: Gateway de quatro camadas (pré-verificação + reescrita + degradação + apelação) para reduzir a taxa de falsos positivos para < 1%.

Para equipes que utilizam o gpt-image-2 em produção, o princípio fundamental é: não lute contra o sistema de segurança, transforme a engenharia de comandos e o roteamento multimodelo em uma capacidade sistêmica. Um erro de moderation_blocked geralmente significa que existem outros 10 erros semelhantes esperando no seu nível de comando ou arquitetura.

Recomendamos utilizar o portal unificado da APIYI (apiyi.com) para acessar simultaneamente o gpt-image-2, gpt-image-2-all, Nano Banana Pro/2 e outros modelos, implementando rapidamente o roteamento de degradação sob a mesma conta e base de código. Este é o caminho mais rápido para transformar o moderation_blocked de uma "falha que interrompe o negócio" em uma "otimização de experiência imperceptível".

Sobre o autor: Equipe técnica da APIYI, com vasta experiência na implementação corporativa de modelos de geração de imagens, apelações de segurança de conteúdo e arquiteturas de roteamento multimodelo. Visite o site oficial da APIYI em apiyi.com para obter soluções de acesso ao gpt-image-2, gpt-image-2-all, Nano Banana Pro e outros modelos principais, além de suporte técnico corporativo para problemas comuns como o moderation_blocked.