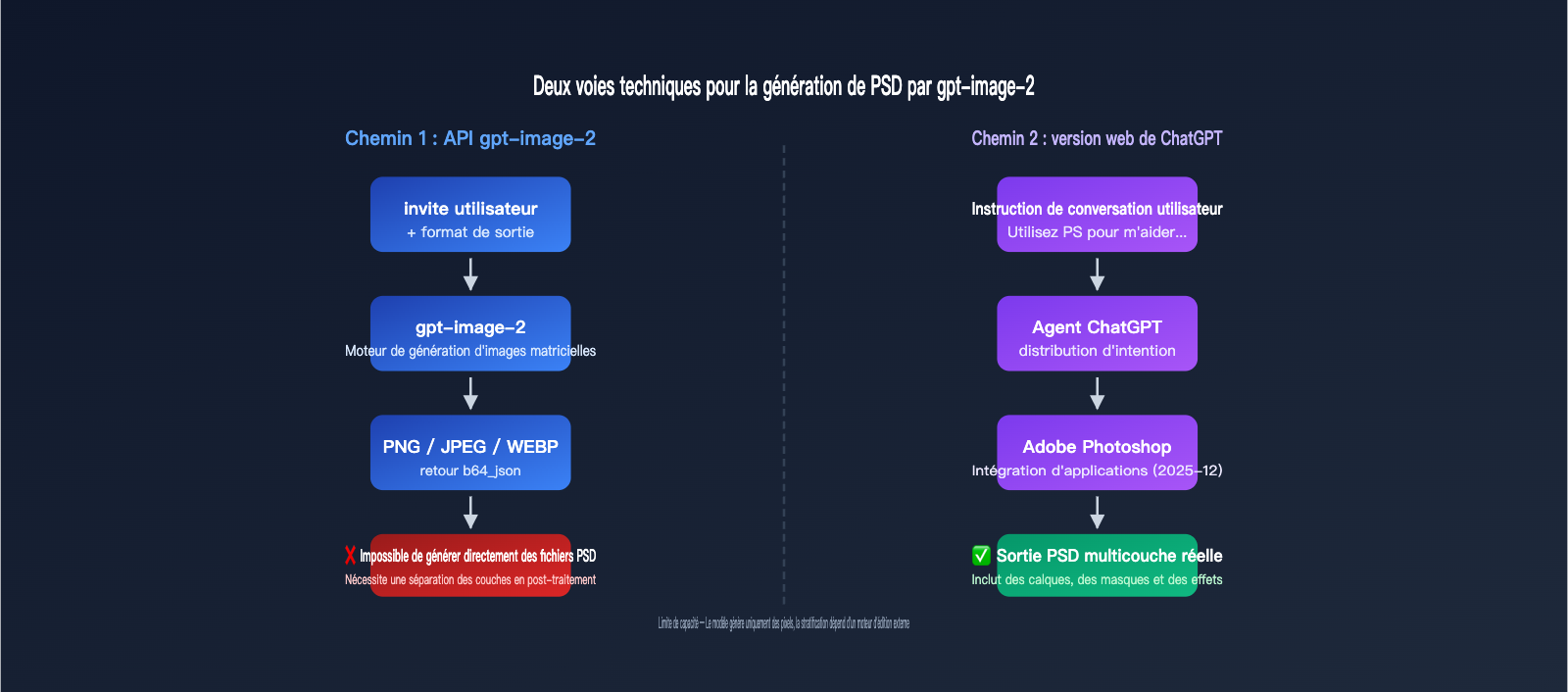

Beaucoup de designers et de développeurs posent la même question lorsqu'ils utilisent gpt-image-2 : « Est-il possible de générer directement des fichiers PSD avec des calques ? ». La réponse se divise en deux volets : la version web de ChatGPT peut y parvenir grâce à son intégration avec Adobe Photoshop, tandis que l'API gpt-image-2, elle, ne peut sortir que des formats standards comme PNG, JPEG ou WEBP.

Cet article clarifie les limites réelles de la génération de PSD via gpt-image-2 et vous propose 3 flux de travail concrets pour choisir la solution la plus adaptée à vos besoins. Que vous soyez un créateur indépendant ou un développeur en équipe, vous trouverez ici les pistes de réflexion nécessaires.

Comprendre les limites de gpt-image-2 pour le format PSD

Avant de vous lancer, il est crucial de comprendre un fait : gpt-image-2 est un modèle de génération d'images, pas un logiciel de retouche. Il ne possède pas la capacité de générer des "fichiers avec calques" ; toute sortie PSD nécessite l'utilisation d'outils externes.

Différences fondamentales dans les capacités de sortie

La définition officielle d'OpenAI pour la série gpt-image est très claire : le modèle ne prend en charge que 3 formats d'image matricielle (rasterized) :

| Format de sortie | Extension | Calques | Transparence | Cas d'usage typique |

|---|---|---|---|---|

| PNG | .png |

❌ Non | ✅ Oui | Format par défaut, idéal pour les éléments avec fond transparent |

| JPEG | .jpg |

❌ Non | ❌ Non | Taille de fichier réduite, idéal pour la photographie |

| WEBP | .webp |

❌ Non | ✅ Oui | Format Web moderne, excellent équilibre poids/qualité |

| PSD | .psd |

✅ Oui | ✅ Oui | API non supportée, nécessite un post-traitement |

🎯 Conclusion clé : L'API gpt-image-2 n'accepte que les valeurs

png,jpegetwebpvia le paramètreoutput_format. Il n'existe aucun paramètre permettant d'obtenir directement un fichier PSD. Si vous avez besoin d'intégrer gpt-image-2 de manière stable dans vos projets d'entreprise, vous pouvez passer par le service proxy API APIYI (apiyi.com), qui est compatible avec les spécifications officielles d'OpenAI et supporte tous les paramètres pour ces trois formats.

Pourquoi l'API ne peut pas générer directement de PSD

Le PSD est un format propriétaire d'Adobe Photoshop qui contient des calques, des masques, des modes de fusion, des calques de réglage, etc. Pour générer un véritable PSD, il ne faut pas un modèle de génération d'images, mais un moteur d'édition d'images. C'est pourquoi :

- API gpt-image-2 : Produit une image matricielle aplatie en une seule fois, incapable de comprendre le concept de "calque".

- ChatGPT (version web) : Utilise l'intégration avec l'application Adobe Photoshop, où c'est Photoshop qui effectue réellement la gestion des calques.

Ces deux approches sont totalement distinctes, et nous détaillerons ces deux systèmes dans la suite de cet article.

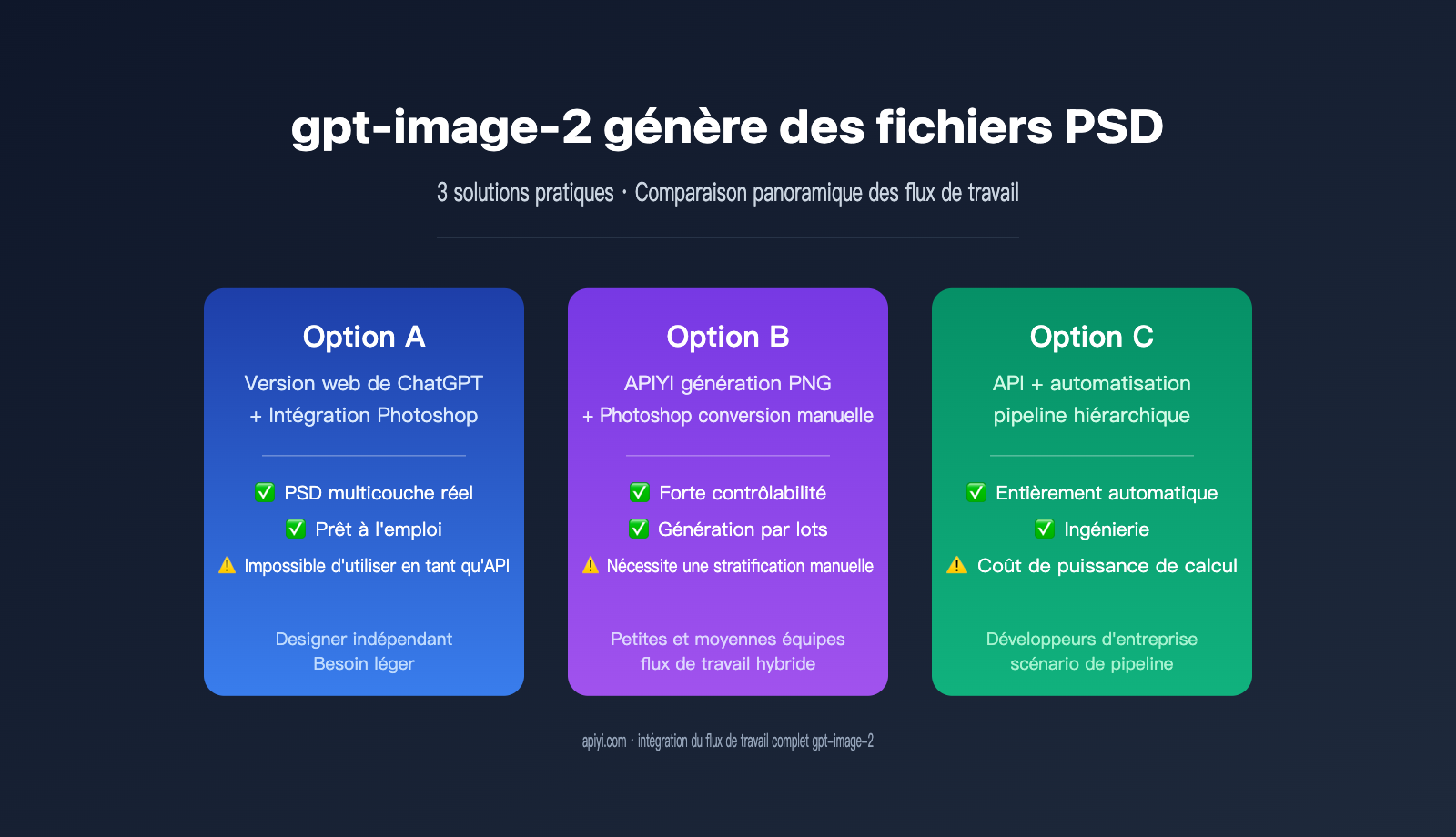

3 solutions pour exporter des fichiers PSD avec gpt-image-2

Si votre objectif est d'obtenir des fichiers PSD, il existe actuellement trois voies exploitables, chacune adaptée à des besoins spécifiques. Le tableau ci-dessous compare leurs caractéristiques principales :

| Solution | Méthode de mise en œuvre | Vrais calques PSD | Automatisation | Public cible |

|---|---|---|---|---|

| Solution A: Intégration ChatGPT + Photoshop | Appel du plugin Adobe via le Web | ✅ Oui | Semi-automatique | Designers, besoins ponctuels |

| Solution B: Génération API + conversion manuelle | Génération PNG via API, puis import manuel | ⚠️ Pseudo-calques (monocouche) | Manuel | Développeurs (génération en masse) |

| Solution C: Génération API + outil de découpe tiers | Script/IA après génération via API | ✅ Oui (estimation par algo) | Entièrement automatique | Scénarios industriels, pipelines |

🎯 Conseil de choix : Si vous n'avez besoin que d'une ou deux images avec calques de temps en temps, la Solution A est la plus simple. Si vous devez intégrer des capacités de génération d'images dans vos produits, l'appel de l'API gpt-image-2 via APIYI (apiyi.com) avec une intégration backend (Solution B ou C) est une option beaucoup plus maîtrisable.

Solution A : Intégration ChatGPT + Photoshop pour l'export PSD

Il s'agit d'une fonctionnalité officiellement lancée par OpenAI en décembre 2025. Adobe a collaboré avec OpenAI pour intégrer Adobe Photoshop, Adobe Express et Adobe Acrobat directement dans ChatGPT, permettant à 800 millions d'utilisateurs d'accéder à des outils d'édition professionnelle au sein même de leurs conversations.

Étapes pour activer Photoshop pour ChatGPT

Le cœur du processus repose sur le rôle de "Agent complet" de ChatGPT, qui distribue l'intention exprimée en langage naturel par l'utilisateur : il génère l'image via gpt-image-2, puis transmet le résultat à Adobe Photoshop pour le traitement des calques.

Entrée utilisateur → ChatGPT analyse l'intention

├─ Appel de gpt-image-2 pour générer l'image source

└─ Appel de l'application Photoshop pour le traitement des calques

↓

Export du fichier PSD téléchargeable

Procédure opérationnelle :

- Connectez-vous à la version Web de ChatGPT (chatgpt.com) et vérifiez que votre compte dispose de la version incluant les fonctionnalités d'image.

- Dans la zone de saisie, cliquez sur "+" → "Plus" → sélectionnez l'application "Adobe Photoshop".

- Saisissez votre invite, par exemple :

Utilise Adobe Photoshop pour générer une illustration de ville nocturne, et sépare le personnage au premier plan, les bâtiments au plan moyen et le ciel en arrière-plan sur des calques distincts. - ChatGPT appellera automatiquement gpt-image-2 pour générer l'image de base.

- Il enchaînera immédiatement avec l'application Photoshop pour effectuer la séparation des calques, les ajustements et les mélanges.

- Une fois terminé, cliquez sur le bouton de téléchargement dans la conversation pour obtenir votre fichier PSD avec calques.

Étendue des capacités de Photoshop pour ChatGPT

La documentation officielle d'Adobe répertorie les opérations principales prises en charge par cette version intégrée :

| Type d'opération | Supporté | Remarques |

|---|---|---|

| Ajustement de zone locale | ✅ | Luminosité, contraste sur une partie spécifique |

| Effets créatifs | ✅ | Filtres intégrés (Glitch, Glow, etc.) |

| Flou/Remplacement d'arrière-plan | ✅ | Utilise Adobe Firefly |

| Séparation des calques | ✅ | Sépare le sujet, le premier plan et l'arrière-plan |

| Masques et sélections | ⚠️ Partiel | Pour les sélections complexes, préférez la version bureau |

| Objets dynamiques | ❌ | Création d'objets dynamiques non supportée |

| Modes de fusion avancés | ❌ | Uniquement les modes de fusion de base |

🎯 Note sur les capacités : Photoshop pour ChatGPT est idéal pour des éditions légères. Les fonctionnalités complètes restent réservées à la version bureau de Photoshop. Si vous avez besoin de générer des PSD fréquemment ou en masse, un flux de travail plus efficace consiste à utiliser l'API gpt-image-2 via APIYI (apiyi.com) pour sortir des PNG, puis à les traiter dans Photoshop bureau.

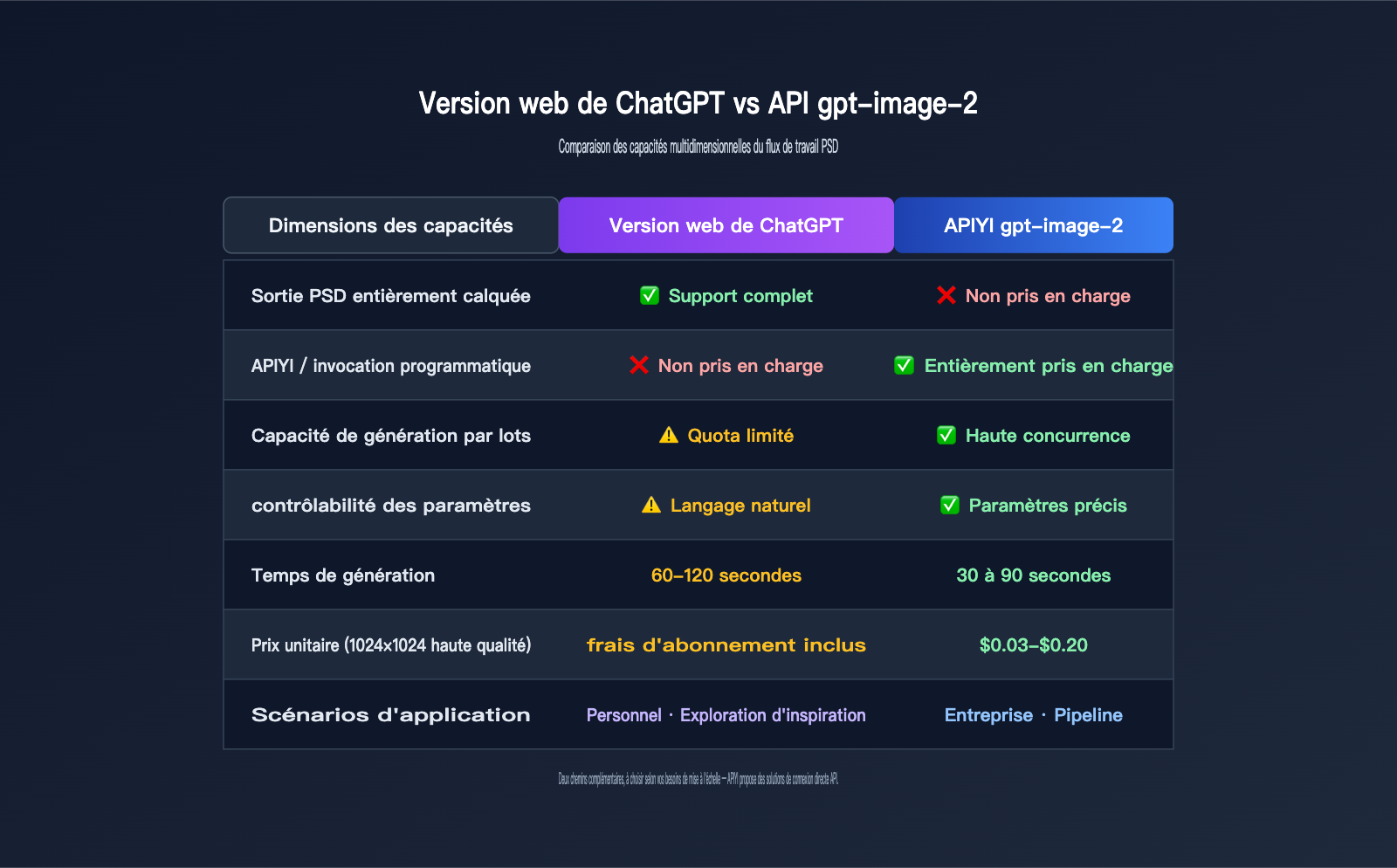

Limites de la Solution A

Bien que l'intégration ChatGPT + Photoshop soit fluide, elle comporte des limites strictes à connaître :

- Pas d'appel API possible : Il s'agit d'une fonctionnalité réservée à l'interface Web, aucune interface API publique n'existe pour reproduire ce flux de travail dans vos propres programmes.

- Vitesse de génération lente : Une génération suivie d'un traitement par calques prend généralement entre 60 et 120 secondes.

- Faible contrôlabilité : Le nombre de calques, leur nommage et leur ordre sont décidés par ChatGPT et ne peuvent pas être contraints par une invite.

- Limites de quota : Les utilisateurs gratuits ont un nombre d'appels limité par jour, et les utilisateurs Plus ont également un plafond.

Ces contraintes font de la Solution A un outil adapté à la "recherche d'inspiration" et à la création ponctuelle, mais inadapté aux environnements de production stables.

Option B : API gpt-image-2 + Conversion manuelle vers PSD dans Photoshop

Si votre besoin est de « générer des images en masse par programme, puis de les sélectionner manuellement pour les convertir en PSD », l'option B est le choix le plus direct. Ce chemin découple totalement la génération par IA du traitement des calques.

Exemple minimal d'invocation de l'API gpt-image-2

Voici le code minimal exécutable pour générer des images via l'API, en utilisant une interface compatible avec OpenAI :

import requests

import base64

response = requests.post(

"https://api.apiyi.com/v1/images/generations",

headers={"Authorization": "Bearer YOUR_API_KEY"},

json={

"model": "gpt-image-2",

"prompt": "Ville cyberpunk de nuit, néons, rue sous la pluie",

"size": "1024x1024",

"quality": "high",

"output_format": "png"

}

)

data = response.json()["data"][0]

image_bytes = base64.b64decode(data["b64_json"])

with open("output.png", "wb") as f:

f.write(image_bytes)

📦 Exemple Python complet (avec gestion des erreurs et description des paramètres)

import os

import base64

import requests

from typing import Optional

def generate_image(

prompt: str,

output_path: str,

size: str = "1024x1024",

quality: str = "high",

output_format: str = "png",

background: Optional[str] = None

) -> dict:

"""

Appel de gpt-image-2 pour générer une image

Args:

prompt: Description de l'image

output_path: Chemin du fichier de sortie

size: 1024x1024 / 1024x1536 / 1536x1024

quality: low / medium / high

output_format: png / jpeg / webp

background: transparent / opaque (uniquement pour png/webp)

"""

api_key = os.getenv("APIYI_API_KEY")

if not api_key:

raise ValueError("Veuillez définir la variable d'environnement APIYI_API_KEY")

payload = {

"model": "gpt-image-2",

"prompt": prompt,

"size": size,

"quality": quality,

"output_format": output_format,

}

if background:

payload["background"] = background

response = requests.post(

"https://api.apiyi.com/v1/images/generations",

headers={

"Authorization": f"Bearer {api_key}",

"Content-Type": "application/json"

},

json=payload,

timeout=180

)

response.raise_for_status()

result = response.json()

image_data = result["data"][0]["b64_json"]

with open(output_path, "wb") as f:

f.write(base64.b64decode(image_data))

return {

"path": output_path,

"usage": result.get("usage", {}),

"size": size

}

if __name__ == "__main__":

info = generate_image(

prompt="Une illustration de ville futuriste, prête pour une affiche publicitaire",

output_path="hero.png",

size="1536x1024",

quality="high",

background="transparent"

)

print(f"Génération réussie : {info}")

🎯 Conseil d'intégration : Lors de l'utilisation de gpt-image-2 via APIYI (apiyi.com), il suffit de remplacer l'URL officielle

api.openai.comparapi.apiyi.com. Les autres paramètres sont entièrement compatibles et le format de sortieoutput_formatprend en charge png, jpeg et webp.

Importer le PNG dans Photoshop pour le convertir en PSD

Une fois le PNG reçu de l'API, voici le flux de travail standard pour le convertir en PSD dans Photoshop :

- Ouvrez le fichier PNG dans la version bureau de Photoshop (

Fichier → Ouvrir) - L'image est alors sur un seul calque, généralement affiché comme calque "Arrière-plan"

- Double-cliquez sur le calque pour le déverrouiller et le transformer en calque modifiable

- Séparez le sujet selon vos besoins :

- Utilisez l'outil Sélection d'objet pour identifier automatiquement le sujet

- Utilisez le Remplissage génératif pour redessiner l'arrière-plan

- Utilisez les couches Alpha pour extraire les zones transparentes

- Enregistrez en tant que PSD :

Fichier → Enregistrer sous → Photoshop (.PSD)

Capacité réelle de séparation des calques de l'option B

Notez que la conversion directe de PNG en PSD ne donne par défaut qu'un seul calque. Pour obtenir un véritable PSD multi-calques, vous devez effectuer un travail de séparation supplémentaire. Les méthodes courantes incluent :

| Méthode de séparation | Complexité | Qualité de séparation |

|---|---|---|

| Sélection manuelle + duplication de calque | Élevée | Très élevée |

| Outil de détourage IA (Remove.bg) | Faible | Moyenne |

| Sélection d'objet Photoshop + Remplissage génératif | Moyenne | Élevée |

| Filtres neuronaux Photoshop (estimation de profondeur) | Faible | Moyenne (pseudo 3D) |

Astuces de Prompt Engineering pour la sortie PSD avec gpt-image-2

Pour maximiser l'efficacité de la séparation dans l'option B, il faut anticiper les besoins de séparation dès l'étape du prompt. Voici un modèle d'invite éprouvé :

[Sujet] : Une affiche publicitaire, le sujet principal est une basket futuriste

[Exigences de composition] :

- Sujet centré, occupant 60 % de la surface

- Arrière-plan de couleur unie ou dégradé simple, pour faciliter le détourage

- Différence de couleur et séparation de profondeur marquées entre le sujet et l'arrière-plan

- Ne pas ajouter d'éléments similaires au sujet dans l'arrière-plan

[Paramètres de sortie] :

- Résolution : 1536x1024

- Arrière-plan : transparent (si pris en charge)

- Style : Qualité photographie commerciale

Cette méthode d'écriture de prompt rend le PNG généré plus "convivial" pour la séparation ultérieure, augmentant considérablement la précision des outils de détourage.

| Mots-clés du prompt | Impact sur la séparation |

|---|---|

pure background / solid color background |

Bords de détourage plus nets |

clear subject separation |

Frontière claire entre sujet et fond |

centered composition |

Facilite la détection automatique du sujet |

studio lighting |

Réduit les ombres portées, diminue les erreurs |

no overlapping elements |

Évite le chevauchement des calques |

🎯 Gain d'efficacité : Lors de l'utilisation de gpt-image-2 via APIYI (apiyi.com), vous pouvez utiliser des modèles d'invites au niveau système pour prédéfinir ces contraintes et garantir que toutes les images générées par l'équipe sont adaptées au flux de travail PSD.

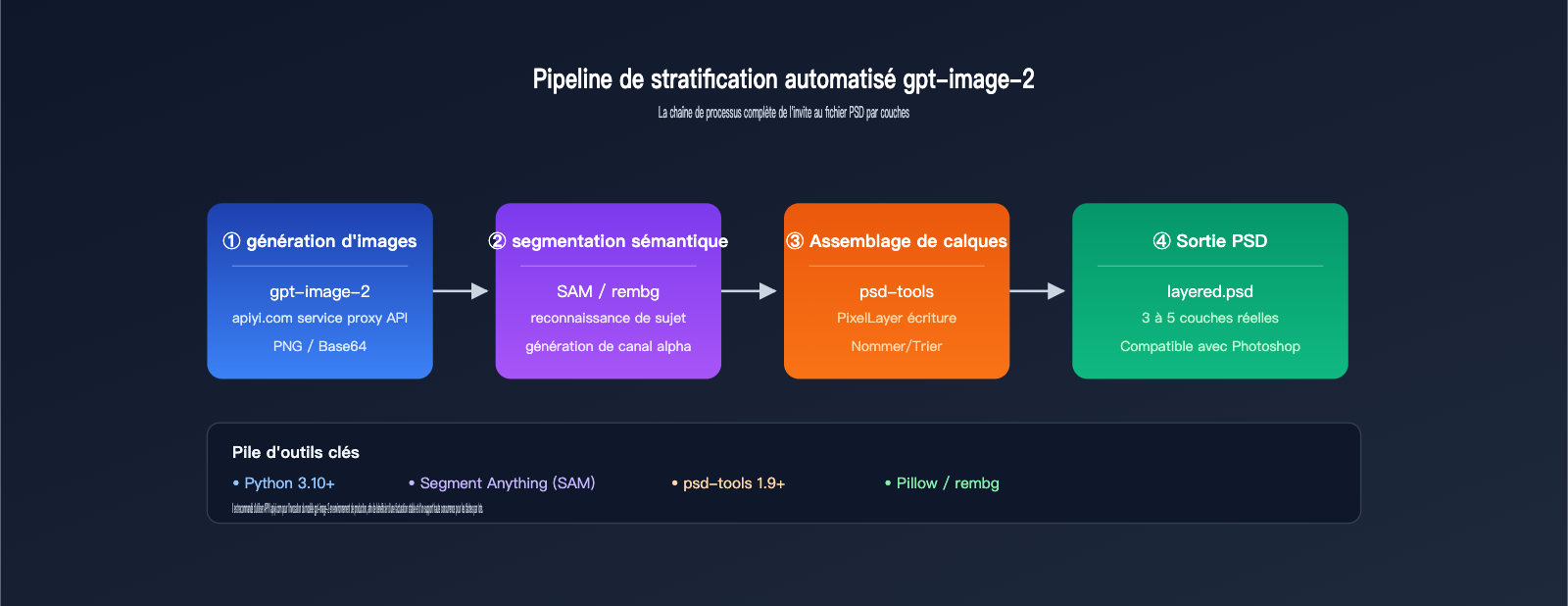

Option C : API + Outil de séparation tiers pour une sortie PSD automatisée

Pour les scénarios de production (génération automatique de ressources e-commerce, pipelines publicitaires), l'utilisation manuelle de Photoshop n'est pas viable. Il est nécessaire d'introduire des outils de séparation automatisés.

Architecture du flux de travail automatisé

[Saisie de l'invite par l'utilisateur]

↓

[Génération de l'image brute via API gpt-image-2]

↓

[Modèle de segmentation sémantique pour identifier les zones] (ex: SAM, Florence)

↓

[Génération des calques via couches Alpha]

↓

[Écriture du PSD via psd-tools / photoshop-python-api]

↓

[Sortie du fichier PSD multi-calques]

L'ensemble du pipeline peut être entièrement codé sans ouvrir le client Photoshop.

Combinaison d'outils clés

| Outil | Rôle | Recommandation |

|---|---|---|

| psd-tools (Python) | Lecture/écriture de la structure PSD | ⭐⭐⭐⭐⭐ |

| Pillow | Traitement d'image de base | ⭐⭐⭐⭐⭐ |

| SAM (Segment Anything) | Segmentation sémantique de Meta | ⭐⭐⭐⭐⭐ |

| rembg | Détourage en un clic, suppression du fond | ⭐⭐⭐⭐ |

| MiDaS | Estimation de profondeur, séparation avant/arrière-plan | ⭐⭐⭐⭐ |

| Photopea API | Édition PSD en ligne | ⭐⭐⭐ |

Exemple de code pour la séparation automatisée

from psd_tools import PSDImage

from psd_tools.api.layers import PixelLayer

from PIL import Image

from rembg import remove

original = Image.open("gpt_image_2_output.png")

foreground = remove(original)

background = Image.new("RGBA", original.size, (255, 255, 255, 0))

psd = PSDImage.new(mode="RGBA", size=original.size)

psd.append(PixelLayer.frompil(background, psd, "Background"))

psd.append(PixelLayer.frompil(foreground, psd, "Foreground"))

psd.save("layered_output.psd")

🎯 Conseil d'ingénierie : En environnement de production, il est conseillé d'encapsuler le processus "Appel gpt-image-2 → Détourage → Écriture PSD" dans un micro-service. L'utilisation de l'API gpt-image-2 via APIYI (apiyi.com) permet une haute concurrence et une facturation stable, idéale pour les pipelines d'images.

Points d'attention pour l'option C

- Qualité des calques dépendante du modèle de segmentation : SAM est plus précis que rembg, mais son coût d'inférence est plus élevé.

- Compatibilité PSD : Les PSD générés par psd-tools fonctionnent bien dans les versions récentes de Photoshop, mais de très anciennes versions pourraient perdre des métadonnées.

- Coût de calcul pour les lots : Exécuter un modèle de segmentation sur chaque image augmente considérablement les coûts GPU.

- Approche hybride plus réaliste : Une solution intermédiaire consiste à générer l'image via API, effectuer une séparation simple du fond, puis une retouche humaine légère.

Avancé : Code pratique pour la séparation multi-personnages

Lorsqu'il est nécessaire de placer plusieurs objets sémantiques (personnages, produits, textes) sur des calques indépendants, vous pouvez combiner SAM (Segment Anything Model) pour une segmentation plus fine :

📦 Exemple complet de séparation multi-objets avec SAM + psd-tools

import torch

import numpy as np

from PIL import Image

from segment_anything import SamPredictor, sam_model_registry

from psd_tools import PSDImage

from psd_tools.api.layers import PixelLayer

def gpt_image_to_layered_psd(image_path: str, output_psd: str, points: list):

"""

Sépare le PNG généré par gpt-image-2 en un PSD avec plusieurs calques d'objets sémantiques

Args:

image_path: Chemin du PNG généré par gpt-image-2

output_psd: Chemin du fichier PSD de sortie

points: Liste des points centraux des objets à segmenter [(x, y, label), ...]

"""

image = Image.open(image_path).convert("RGBA")

image_np = np.array(image)

sam = sam_model_registry["vit_h"](checkpoint="sam_vit_h.pth")

sam.to("cuda" if torch.cuda.is_available() else "cpu")

predictor = SamPredictor(sam)

predictor.set_image(image_np[:, :, :3])

psd = PSDImage.new(mode="RGBA", size=image.size)

for idx, (x, y, label) in enumerate(points):

masks, scores, _ = predictor.predict(

point_coords=np.array([[x, y]]),

point_labels=np.array([1]),

multimask_output=False

)

mask = masks[0]

layer_array = image_np.copy()

layer_array[~mask] = [0, 0, 0, 0]

layer_image = Image.fromarray(layer_array, "RGBA")

psd.append(PixelLayer.frompil(layer_image, psd, label))

background_array = image_np.copy()

background_image = Image.fromarray(background_array, "RGBA")

background_layer = PixelLayer.frompil(background_image, psd, "Background")

psd.insert(0, background_layer)

psd.save(output_psd)

print(f"✅ PSD multi-calques généré : {output_psd}")

if __name__ == "__main__":

gpt_image_to_layered_psd(

image_path="gpt_image_2_poster.png",

output_psd="layered_poster.psd",

points=[

(512, 400, "Subject"),

(200, 600, "ProductLeft"),

(800, 600, "ProductRight"),

]

)

Grâce à ce flux, une affiche générée par gpt-image-2 peut être divisée en 3 à 5 calques réels dans un PSD, chaque calque pouvant être édité indépendamment dans Photoshop.

Gestion des erreurs et dépannage

Dans les scénarios d'ingénierie, l'appel à gpt-image-2 et la séparation ultérieure peuvent échouer. Le tableau ci-dessous résume les problèmes fréquents et les solutions :

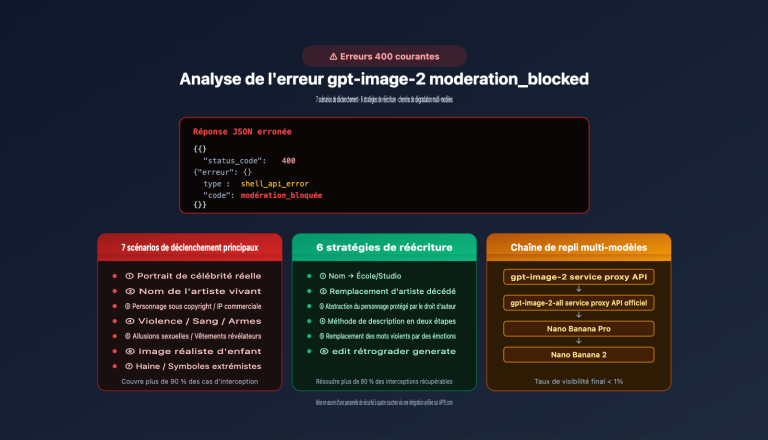

| Problème | Cause profonde | Solution |

|---|---|---|

L'API renvoie invalid output_format |

Valeur non prise en charge (ex: psd) |

Utiliser uniquement png/jpeg/webp |

Champ b64_json vide |

Blocage par la modération de contenu | Optimiser le prompt, éviter les descriptions sensibles |

| Bords dentelés après détourage | Précision insuffisante du modèle | Utiliser SAM + post-traitement de type feather |

| PSD impossible à ouvrir dans Photoshop | Métadonnées mal écrites par psd-tools | Mettre à jour psd-tools vers la version 1.9+ |

| Calques décalés après séparation | Canaux RGBA non alignés | Uniformiser la taille du canevas avant l'écriture |

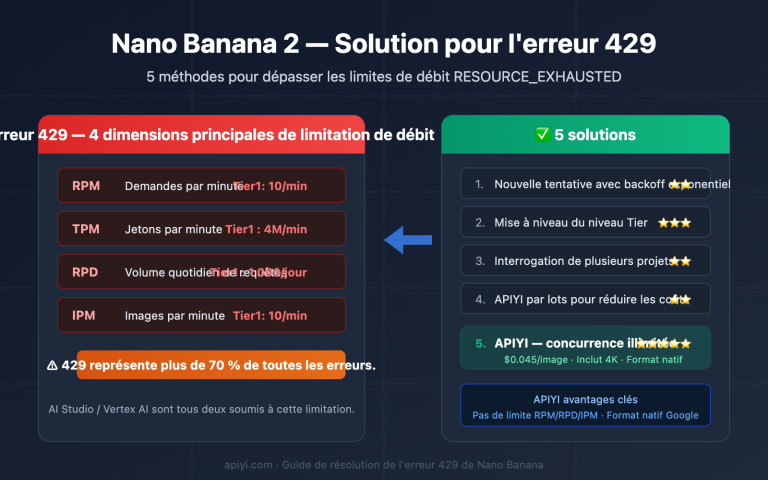

| Vitesse d'appel lente | Limitation de débit (rate limit) | Utiliser le routage multi-canaux d'APIYI (apiyi.com) |

🎯 Conseil de stabilité : En environnement de production, il est recommandé d'ajouter une logique de réessai et de repli lors de l'appel API. Les requêtes transitant par APIYI (apiyi.com) détectent automatiquement les réponses de limitation de débit d'OpenAI et prennent en charge une commutation intelligente, réduisant ainsi le taux d'échec des tâches par lots.

FAQ sur la sortie PSD de gpt-image-2

Voici les réponses aux questions les plus fréquentes concernant l'utilisation pratique de cet outil.

Q1 : L'API gpt-image-2 ne peut-elle vraiment pas exporter directement en PSD ?

C'est confirmé, non. La documentation officielle d'OpenAI limite strictement les valeurs du paramètre output_format à png, jpeg et webp. Tout service prétendant offrir une "sortie PSD directe via API" exécute en réalité un processus de séparation des calques (solution C) sur ses propres serveurs avant de vous renvoyer le résultat encapsulé dans un fichier PSD. Ce n'est pas une capacité native du modèle gpt-image-2 lui-même.

🎯 Clarification importante : Pour accéder de manière stable au modèle gpt-image-2 officiel, vous pouvez utiliser un service proxy API compatible avec les interfaces OpenAI comme APIYI (apiyi.com). Cela garantit que le comportement des paramètres est identique à celui d'OpenAI, évitant ainsi les "modifications sauvages" par des couches d'encapsulation tierces.

Q2 : Le PSD généré par la version web de ChatGPT possède-t-il de vrais calques ?

Oui. C'est parce qu'en arrière-plan, une véritable instance d'Adobe Photoshop effectue les opérations d'édition. Le PSD généré contient donc de vrais calques, masques et effets. Cependant, vous ne pouvez pas contrôler précisément le nombre de calques ni leur nom. Dans la plupart des cas, vous obtiendrez entre 3 et 5 calques (arrière-plan, sujet, premier plan, calques de réglage, etc.).

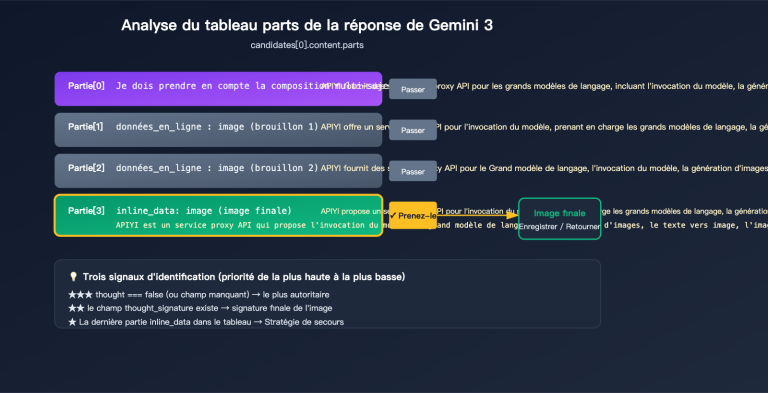

Q3 : Y a-t-il une différence de format de sortie entre gpt-image-2 et gpt-image-2-all ?

Il existe de légères différences. gpt-image-2-all utilise le canal inverse équivalent à la version web de ChatGPT, et le champ b64_json renvoyé inclut le préfixe data:image/png;base64,. À l'inverse, gpt-image-2 se connecte directement à l'API Images d'OpenAI et renvoie une chaîne base64 pure sans préfixe. Bien qu'aucun des deux ne supporte la sortie PSD, votre code de traitement des chaînes de caractères devra être adapté en conséquence.

Q4 : Si je n'ai besoin que d'un PNG avec fond transparent, ai-je encore besoin du PSD ?

Pour de nombreux cas, effectivement non. L'API gpt-image-2 supporte le paramètre background: "transparent", ce qui permet de générer directement des PNG à fond transparent, parfaits pour :

- Le détourage de produits e-commerce

- Les logos, icônes et autocollants

- Les éléments d'interface utilisateur (UI)

Le flux de travail PSD n'est nécessaire que si vous devez ajuster des éléments autres que le sujet principal après coup.

Q5 : Comment contrôler les coûts de génération massive de PSD ?

Les coûts se décomposent en trois parties :

| Poste de coût | Partie API gpt-image-2 | Partie post-traitement |

|---|---|---|

| Coût unitaire | Env. 0,03 $ – 0,20 $/image | Puissance GPU de détourage ~0,001 $ |

| Temps | 60-120 secondes | 5-30 secondes |

| Stabilité | Soumis aux limites d'OpenAI | Puissance de calcul propre contrôlable |

🎯 Stratégie d'optimisation : Pour les gros volumes, il est conseillé de ne séparer les calques que pour les images candidates de haute qualité. Utilisez d'abord gpt-image-2 avec des paramètres de basse qualité (

quality=low) pour générer rapidement des aperçus, vérifiez la consommation via la facturation unifiée d'APIYI (apiyi.com), puis relancez la génération en haute qualité uniquement pour les images validées avant de les envoyer dans le pipeline de séparation.

Q6 : Puis-je utiliser gpt-image-2 pour modifier directement un fichier PSD existant ?

Non. L'interface d'édition d'image de gpt-image-2 n'accepte que des entrées PNG/JPEG/WEBP et ne peut pas reconnaître la structure interne des calques d'un PSD. Si vous souhaitez "redessiner une partie d'un calque spécifique d'un PSD avec l'IA", la méthode standard est la suivante :

- Exporter ce calque en PNG (avec canal Alpha) depuis Photoshop.

- Utiliser l'interface d'édition de gpt-image-2 avec un masque pour le redessin.

- Réimporter le résultat dans le PSD original en tant que nouveau calque.

Cas pratiques : La sortie PSD avec gpt-image-2

Chaque secteur a des exigences différentes en matière de sortie PSD. Voici trois flux de travail types.

Cas 1 : Production en série d'affiches e-commerce

Une équipe e-commerce doit générer plus de 300 affiches par jour. Besoin : un calque pour le produit, un pour l'arrière-plan et un pour le texte, afin que les équipes marketing puissent modifier les textes rapidement.

Conception du flux de travail :

- Après le téléchargement du produit, l'équipe marketing saisit les mots-clés.

- Appel de l'API gpt-image-2 pour générer l'image principale (

output_format=png,background=transparent). - Utilisation de

rembgpour confirmer les bords du détourage. - Utilisation de

psd-toolspour créer une structure à 3 calques :- Calque 1 : Sujet du produit (fond transparent)

- Calque 2 : Arrière-plan généré par l'IA

- Calque 3 : Calque de texte réservé

- Le graphiste n'a plus qu'à modifier le texte dans le PSD pour finaliser.

Gain d'efficacité : Le temps de création passe de 30 minutes à 2 minutes par affiche.

🎯 Choix de la solution : Pour ce type de tâches répétitives, l'utilisation de l'interface gpt-image-2 via APIYI (apiyi.com) permet une prévisibilité des coûts et une montée en charge flexible.

Cas 2 : Prototypage rapide d'actifs UI de jeu

Les équipes artistiques ont besoin de nombreux éléments d'interface (boutons, icônes, bannières) au format PSD pour les retouches finales.

Conception du flux de travail :

Génération visuelle de base avec gpt-image-2

↓

Segmentation automatique du sujet avec SAM

↓

Exportation de plusieurs PNG (cadre, icône, lueur, etc.)

↓

Assemblage en PSD multicouche avec psd-tools

↓

Retouche finale par l'artiste dans Photoshop

| Type d'actif | Sortie gpt-image-2 | Action de post-traitement | Nb de calques final |

|---|---|---|---|

| Bouton | PNG transparent | Découpe d'état (défaut/survol/clic) | 3 |

| Icône | PNG transparent | Séparation reflets/ombres | 2-4 |

| Bannière | PNG RVB | Séparation sujet/fond/effets | 3-5 |

| Carte | PNG RVB | Séparation bordure/fond/badge | 3-4 |

Cas 3 : Versions multilingues de contenus marketing

L'équipe publicitaire doit adapter un visuel principal en 10 langues, avec un texte indépendant et une image fixe.

Opération clé :

- Générer le visuel principal "sans texte" avec gpt-image-2 (en précisant

no text,no lettersdans l'invite). - Créer un calque de texte réservé via

psd-tools. - Il suffit ensuite de modifier uniquement le calque de texte pour générer les 10 versions.

Avantage : Le visuel principal n'est généré qu'une seule fois et le calque de texte est parfaitement contrôlable, évitant les fautes d'orthographe courantes de l'IA.

🎯 Conseil multilingue : gpt-image-2 est fiable pour l'anglais, mais moins pour le chinois, le japonais ou le coréen. Lors de vos appels via APIYI (apiyi.com), excluez explicitement le texte de l'invite et gérez-le via un calque PSD dédié.

Cas 4 : Aide au storyboard pour la BD et l'illustration

Les illustrateurs utilisent gpt-image-2 pour générer des croquis d'inspiration avant de finaliser dans Photoshop.

Structure de calques typique :

- Calque de croquis : Image originale de gpt-image-2, conservée comme référence.

- Calque de line-art : Dessin des lignes basé sur le croquis.

- Calque de couleurs de base : Remplissage des zones.

- Calque d'ombres : Travail sur les zones sombres.

- Calque de reflets : Touches de lumière.

- Calque d'effets : Éléments décoratifs.

Points clés :

1. Sortie gpt-image-2 en format vertical 1024x1536

2. Importation dans Photoshop en tant que Calque 0 (verrouillé)

3. Création de 5-6 calques vides au-dessus pour le dessin

4. Sauvegarde en PSD une fois terminé

Ce flux transforme un croquis IA en un actif de travail durable plutôt qu'en une image jetable.

Comparaison de gpt-image-2 avec d'autres formats d'image

Pour mieux comprendre la place du format PSD dans votre flux de travail, voici une analyse comparative avec les formats de sortie les plus courants.

| Format | Taille du fichier | Facilité d'édition | Compatibilité logicielle | Adapté au post-traitement gpt-image-2 |

|---|---|---|---|---|

| PNG | Moyenne | Faible (aplati) | ✅ Excellente | ⭐⭐⭐⭐⭐ Choix par défaut |

| JPEG | Petite | Très faible | ✅ Excellente | ⭐⭐⭐ Aperçu uniquement |

| WEBP | Petite | Faible | ⚠️ Orienté Web | ⭐⭐⭐ Scénarios Web |

| PSD | Grande | ✅ Très élevée | ⚠️ Écosystème Adobe | ⭐⭐⭐⭐ Nécessite un post-traitement |

| TIFF | Très grande | Moyenne | ✅ Orienté impression | ⭐⭐ Scénarios d'impression |

| SVG | Petite | ✅ Très élevée (vectoriel) | ✅ Web/Impression | ❌ Non supporté par gpt-image-2 |

Comme le montre ce tableau, la valeur ajoutée du PSD réside dans sa "facilité d'édition", un aspect difficile à remplacer par d'autres formats. Si vous n'avez pas besoin de retouches ultérieures, le PNG est généralement plus approprié.

Résumé des meilleures pratiques pour la sortie PSD avec gpt-image-2

Revenons à la question initiale : comment obtenir un fichier PSD avec gpt-image-2 ? Après analyse, nous pouvons résumer les conclusions en trois points :

- Le chemin API ne permet pas une sortie directe en PSD : L'API gpt-image-2 ne prend en charge que les formats matriciels PNG, JPEG et WEBP ; c'est une limite technique propre au modèle.

- La version web de ChatGPT permet d'obtenir un PSD avec calques réels via Photoshop : L'application Adobe Photoshop prend en charge le traitement des calques, ce qui est idéal pour les besoins légers des designers indépendants.

- Les scénarios d'ingénierie nécessitent une approche combinée "Génération API + Post-traitement" : L'utilisation d'outils comme SAM ou rembg pour la segmentation automatique, couplée à

psd-toolspour l'écriture du fichier, permet une automatisation à grande échelle.

| Profil utilisateur | Solution recommandée | Combinaison d'outils |

|---|---|---|

| Designer indépendant | Solution A | Intégration ChatGPT + Photoshop |

| Petite/Moyenne équipe | Solution B | API gpt-image-2 + Photoshop (traitement manuel des calques) |

| Développeur en entreprise | Solution C | API gpt-image-2 + Pipeline de segmentation automatisé |

🎯 Conseil final : Commencez par tester l'intégration Photoshop via la version web de ChatGPT pour bien comprendre le processus de segmentation avant de décider de construire un pipeline API. Si vous confirmez le besoin d'une intégration industrielle, vous pouvez accéder à gpt-image-2 via APIYI (apiyi.com). Cette plateforme fournit des interfaces compatibles OpenAI accessibles localement, garantissant une stabilité de niveau entreprise et une transparence totale sur la facturation.

Nous espérons que ce guide complet sur la sortie PSD avec gpt-image-2 vous évitera bien des détours. La véritable difficulté ne réside pas dans l'API, mais dans le choix du flux de travail adapté. En fonction de votre volume, de votre budget et de vos besoins en automatisation, le choix entre les solutions A, B ou C vous permettra généralement de mettre en place un processus opérationnel en une semaine.

Auteur : Équipe technique APIYI | apiyi.com — Plateforme de service proxy API pour grands modèles de langage en entreprise