Anmerkung des Autors: Tiefenanalyse der wahren Gründe für das Aus von OpenAI Sora 2, der Wettbewerbsdruck durch Seedance 2.0 und die Strategie der Rechenleistungskonzentration hinter Anthropic, das bewusst auf Bild- und Videomodelle verzichtet.

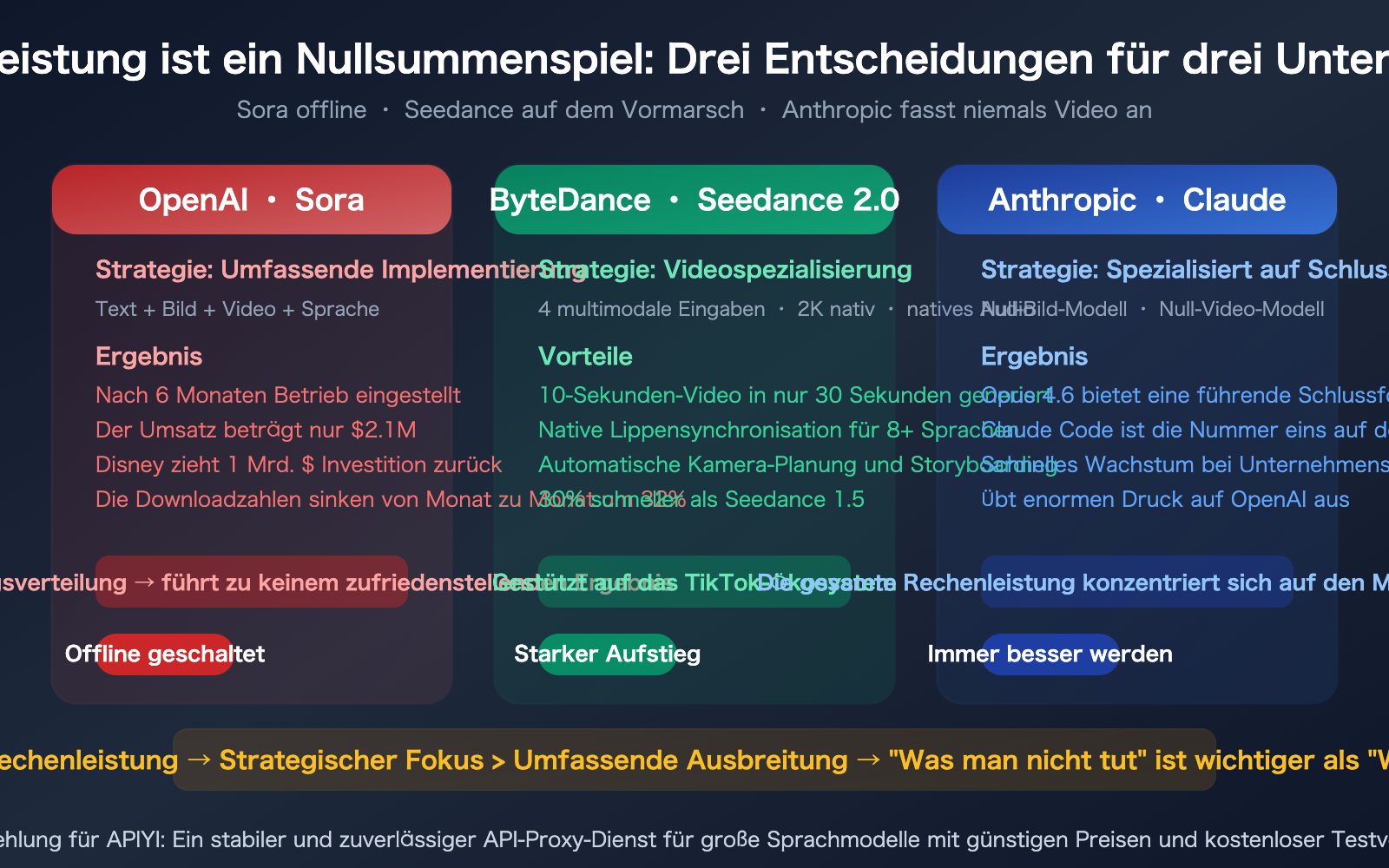

Am 24. März 2026 gab OpenAI offiziell die Einstellung von Sora bekannt – nach nur 6 Monaten Laufzeit, einem kumulierten Umsatz von lediglich 2,1 Millionen US-Dollar und dem Rückzug einer 1-Milliarden-Dollar-Investition durch Disney. Gleichzeitig eroberte Seedance 2.0 von ByteDance mit nativer 2K-Auflösung, 4-modalem Input und einer extrem schnellen 30-Sekunden-Generierung den Markt. Doch noch bemerkenswerter ist eine andere Tatsache: Anthropic hat von Anfang an kein einziges Bild- oder Videogenerierungsmodell entwickelt und setzt sich dennoch im KI-Wettbewerb immer stärker durch. Dieser Artikel analysiert aus Sicht der Rechenleistungsökonomie die zugrunde liegende Logik hinter dem Aus von Sora, dem Aufstieg von Seedance und der Fokus-Strategie von Anthropic.

Kernwert: Verstehen Sie in 3 Minuten das Dilemma der Rechenleistung auf dem Markt für KI-Videogenerierung und warum strategisches "Nichtstun" wichtiger ist als das, was man tut.

Die Fakten zur Einstellung von Sora 2

Schauen wir uns zunächst an, was genau passiert ist, bevor wir die Hintergründe analysieren.

| Fakt | Details | Auswirkungen |

|---|---|---|

| Abschaltung | Offizielle Ankündigung am 24. März 2026 | Nur 6 Monate nach Start |

| Kumulierter Umsatz | Ca. 2,1 Mio. $ durch In-App-Käufe | Deckt Rechenkosten bei weitem nicht |

| Download-Trend | November-Peak 3,33 Mio. → Februar 1,13 Mio. | Monatlicher Rückgang um 32 % |

| Disney-Rückzug | Stornierung des 1-Mrd.-$-Investitionsplans | Verlust des wichtigsten Content-Partners |

| Offizielle Begründung | "Wachsende Rechenlast, Fokus auf Weltsimulation für Robotik" | Ressourcen-Umschichtung auf Text-/Reasoning-Modelle |

| CEO-Haltung | Sam Altman zu Mitarbeitern: Einstellung setzt Ressourcen für nächste Modellgeneration frei | Video hat keine Priorität mehr |

Das Sora-Team verabschiedete sich mit den Worten: „Wir verabschieden uns von Sora. Danke an alle, die mit Sora kreiert, geteilt und eine Community aufgebaut haben. Eure Arbeit mit Sora war wichtig, und wir wissen, dass diese Nachricht enttäuschend ist.“

Gleichzeitig berichtete CNBC, dass OpenAI vor dem geplanten Börsengang (IPO) kostenintensive Projekte reduziert; die Einstellung von Sora ist Teil dieser Kostenkontrolle.

3 tieferliegende Gründe für das Aus von Sora 2

Grund 1: Das Rechenleistungs-Schwarze-Loch der Bilderzeugung

Dies ist der fundamentale Grund. Der Rechenaufwand für die Bilderzeugung ist um ein Vielfaches höher als bei der Textgenerierung:

| Aufgabentyp | Rechenaufwand pro Vorgang | Output pro Dollar | GPU-Effizienz |

|---|---|---|---|

| Text-Dialog | Millisekunden | Tausende Dialoge | Sehr hoch |

| Bilderzeugung | Sekunden | Hunderte Bilder | Hoch |

| Videoerzeugung (10 Sek.) | Minuten | Dutzende Videos | Niedrig |

Jede Videoanfrage an Sora belastete die Server-Infrastruktur von OpenAI so stark, dass selbst Abomodelle die Kosten nicht decken konnten. Entscheidender ist: Diese GPUs erzielen einen deutlich höheren wirtschaftlichen Wert, wenn sie für Text- und Reasoning-Modelle (GPT-5, o3 etc.) eingesetzt werden.

Grund 2: Der Wettbewerbsdruck durch Seedance 2.0 und andere

Das im Februar 2026 veröffentlichte Seedance 2.0 von ByteDance übertraf Sora in fast jeder Hinsicht:

| Vergleichsdimension | Sora | Seedance 2.0 |

|---|---|---|

| Auflösung | 1080p | Nativ 2K (2048×1080) |

| Generierungsgeschwindigkeit | ca. 60-120 Sek./10 Sek. Video | ca. 30 Sek./10 Sek. Video |

| Input-Modalitäten | Text + Bild | Text + Bild (9) + Video (3) + Audio (3) |

| Natives Audio | Nicht unterstützt | Unterstützt (Lippensynchronisation in 8+ Sprachen) |

| Kamerasteuerung | Basis | Automatische Szenenplanung |

| Ökosystem-Vorteil | Standalone-App | Anbindung an TikTok-Ökosystem |

Seedance 2.0 profitiert von der TikTok-Infrastruktur und verfügt über eine natürliche Basis für Videokonsum. Sora hingegen fehlte als Standalone-App ein klarer Distributionskanal für die generierten Inhalte.

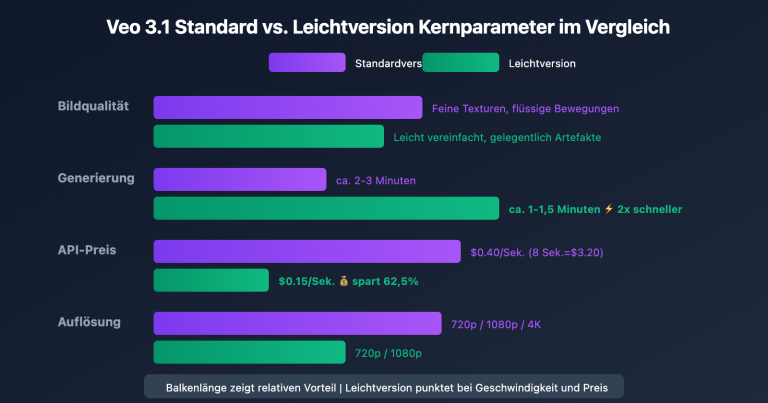

Neben Seedance haben auch Googles Veo 3, Klings Kling 2.0 und Lumas Ray 2 Anfang 2026 neue Produkte veröffentlicht. Der Markt für Bilderzeugung ist extrem gesättigt; der Vorsprung von Sora wurde eingeholt oder übertroffen.

Grund 3: Strategische Neuausrichtung von OpenAI

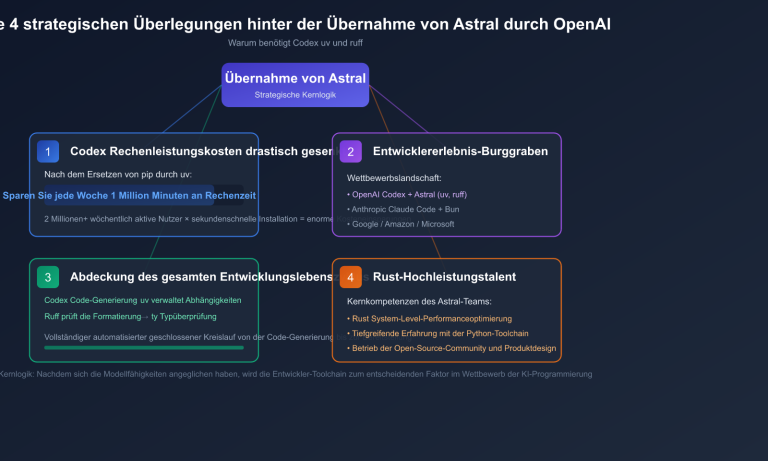

OpenAI steht unter massivem Wettbewerbsdruck durch Anthropic. Berichte von Bloomberg und CNBC deuten darauf hin, dass die KI-Systeme von Anthropic bei Unternehmenskunden und Softwareentwicklern stark an Beliebtheit gewinnen, was eine direkte geschäftliche Bedrohung darstellt.

Unter diesem Druck muss OpenAI seine Rechenkapazitäten auf das Kernfeld konzentrieren: Text-Reasoning und Coding-Fähigkeiten. Jede GPU, die für das Rendern von Sora-Videos genutzt wird, fehlt beim Training von GPT-5 oder der Optimierung von o3.

🎯 Branchen-Insight: Die Einstellung von Sora bedeutet nicht, dass "Bilderzeugung tot ist", sondern dass "OpenAI mit Bilderzeugung kein Geld verdient". Die Zersplitterung der Rechenleistung auf zu viele Produktlinien verhinderte Spitzenleistungen in allen Bereichen.

Falls Ihre KI-Anwendung sowohl Text- als auch Videomodelle benötigt, empfiehlt sich die zentrale Verwaltung über APIYI (apiyi.com) – eine Plattform, die Seedance, Kling, Claude und weitere Modelle bündelt.

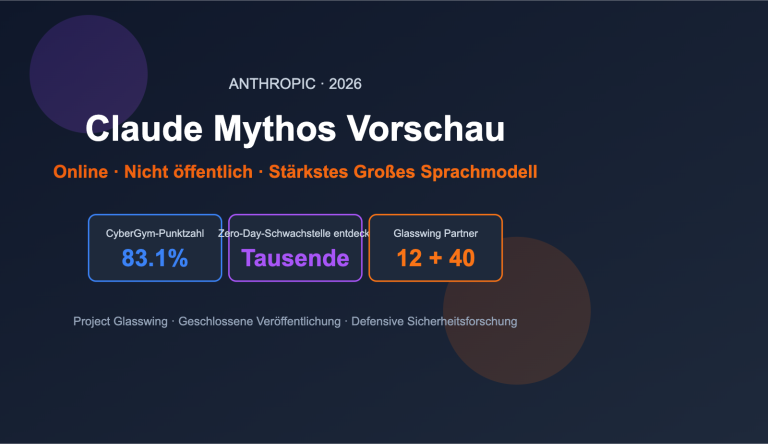

Warum Anthropic niemals Bild- und Videomodelle anfasst

Dies ist eine strategische Entscheidung, die zum Nachdenken anregt. Seit der Gründung von Anthropic hat das Unternehmen keinerlei Modelle zur Bilderzeugung oder Videogenerierung veröffentlicht – sie sind nicht einmal den Weg gegangen, den Google mit Nano Banana (Gemini-Bilderzeugung) eingeschlagen hat, bei dem ein "Textmodell um Bildfähigkeiten ergänzt" wird.

Die Strategie der Rechenleistungskonzentration bei Anthropic

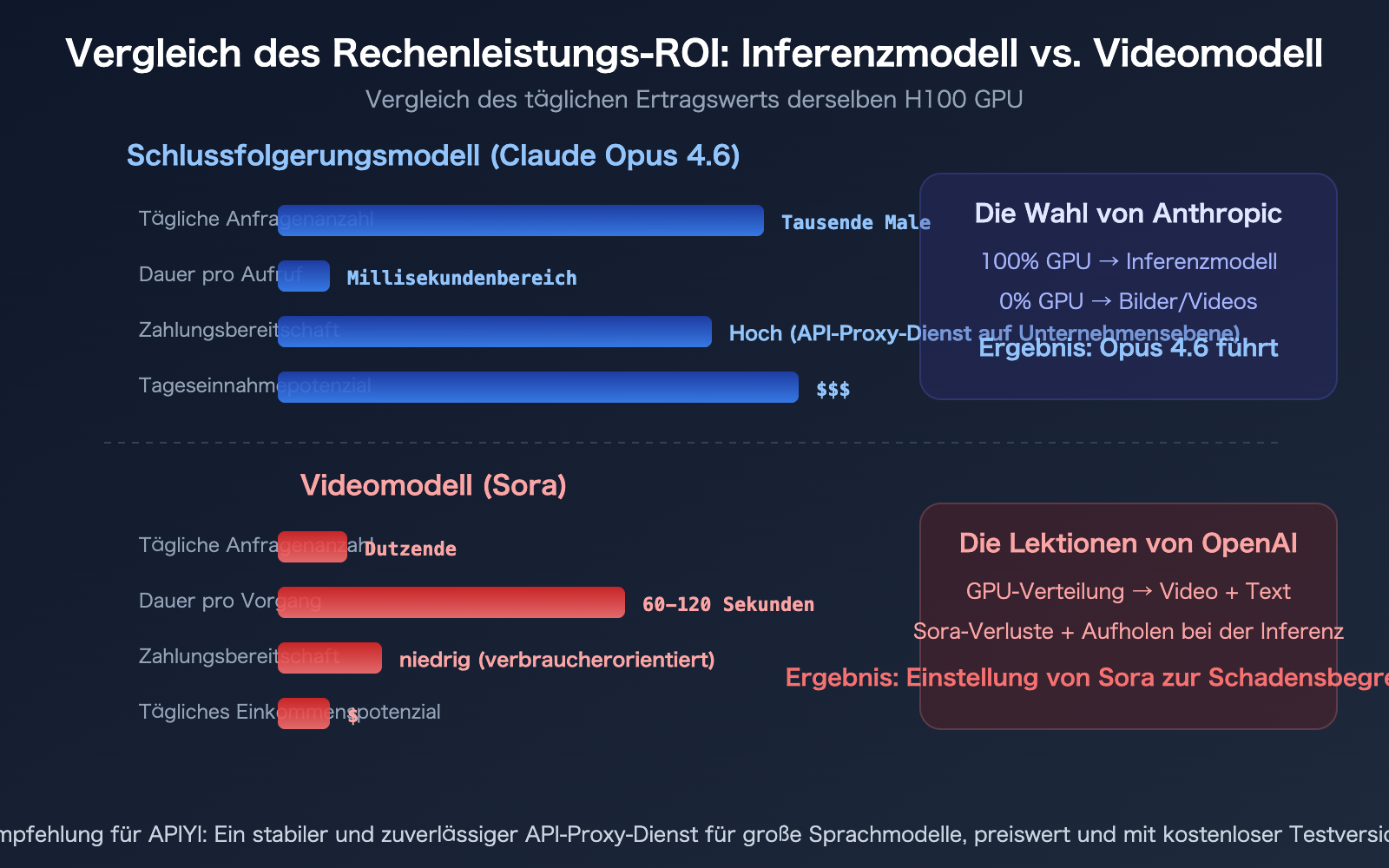

Die Logik von Anthropic ist simpel: Rechenleistung ist begrenzt und muss vollständig auf die wertvollsten Bereiche konzentriert werden.

Für Anthropic sind Schlussfolgerungen (Reasoning) und Code die wertvollsten Bereiche – das sind die Kernkompetenzen, für die Unternehmenskunden bereit sind, hohe Preise zu zahlen. Dass die Reasoning-Fähigkeiten von Opus 4.6 die der Konkurrenz übertreffen, liegt zu einem großen Teil daran, dass Anthropic keine GPU-Ressourcen für Bild- und Videomodelle abgezweigt hat.

Dies steht in krassem Gegensatz zu OpenAI:

| Strategische Dimension | OpenAI (diversifiziert) | Anthropic (konzentriert) |

|---|---|---|

| Produktlinie | GPT + DALL·E + Sora + Whisper + Jukebox | Claude (reiner Text/Code) |

| Ressourcenverteilung | Text + Bild + Video + Audio | 100 % Text-Reasoning |

| Kernkompetenz | "Kann alles" | "Beste Reasoning- und Code-Leistung" |

| Geschäftsmodell | Consumer + API + Enterprise | API + Enterprise (hoher Umsatz pro Kunde) |

| Sora-Ergebnis | Nach 6 Monaten eingestellt, $2,1 Mio. Umsatz | — |

| Claude Code-Ergebnis | — | Marktführer bei Coding-Agenten |

Warum der ROI von Reasoning-Modellen weit über dem von Videomodellen liegt

Aus geschäftlicher Sicht spielen Reasoning-Modelle und Videomodelle in einer völlig anderen Liga, was den Ertrag pro Recheneinheit angeht:

- Reasoning-Modelle: Unternehmenskunden zahlen pro Token, die Gewinnmargen sind hoch, die Nutzungshäufigkeit ist hoch und sie lassen sich in Arbeitsabläufe integrieren.

- Videomodelle: Die Zahlungsbereitschaft der Verbraucher ist gering (was Sora bewiesen hat), der Rechenaufwand ist gigantisch und die Nutzungshäufigkeit ist niedrig.

Eine H100-GPU, die für Claude Opus 4.6 eingesetzt wird, kann täglich Tausende von Unternehmensanfragen bearbeiten und so beträchtliche API-Einnahmen generieren. Dieselbe GPU für die Videogenerierung eingesetzt, könnte nur Dutzende Videos pro Tag erstellen – und die meisten Nutzer sind nicht bereit, dafür zu bezahlen.

Das Signal hinter dem Verzicht auf Bilderzeugung bei Anthropic

Obwohl durchgesickerte Konfigurationsdateien Funktionsnamen wie create_image und edit_image im Inneren von Claude zeigten, hat Anthropic bis heute keine Bilderzeugungsfunktionen offiziell veröffentlicht. Die Prognosen auf Manifold zur Wahrscheinlichkeit, dass "Anthropic bis 2026 ein Bilderzeugungsmodell veröffentlicht", sinken kontinuierlich.

Die Unternehmenskultur und die Strategie zur Ressourcenallokation von Anthropic zielen in eine Richtung: Die Reasoning-Fähigkeiten zur Perfektion zu bringen, anstatt die Energie auf Bilder und Videos zu verteilen.

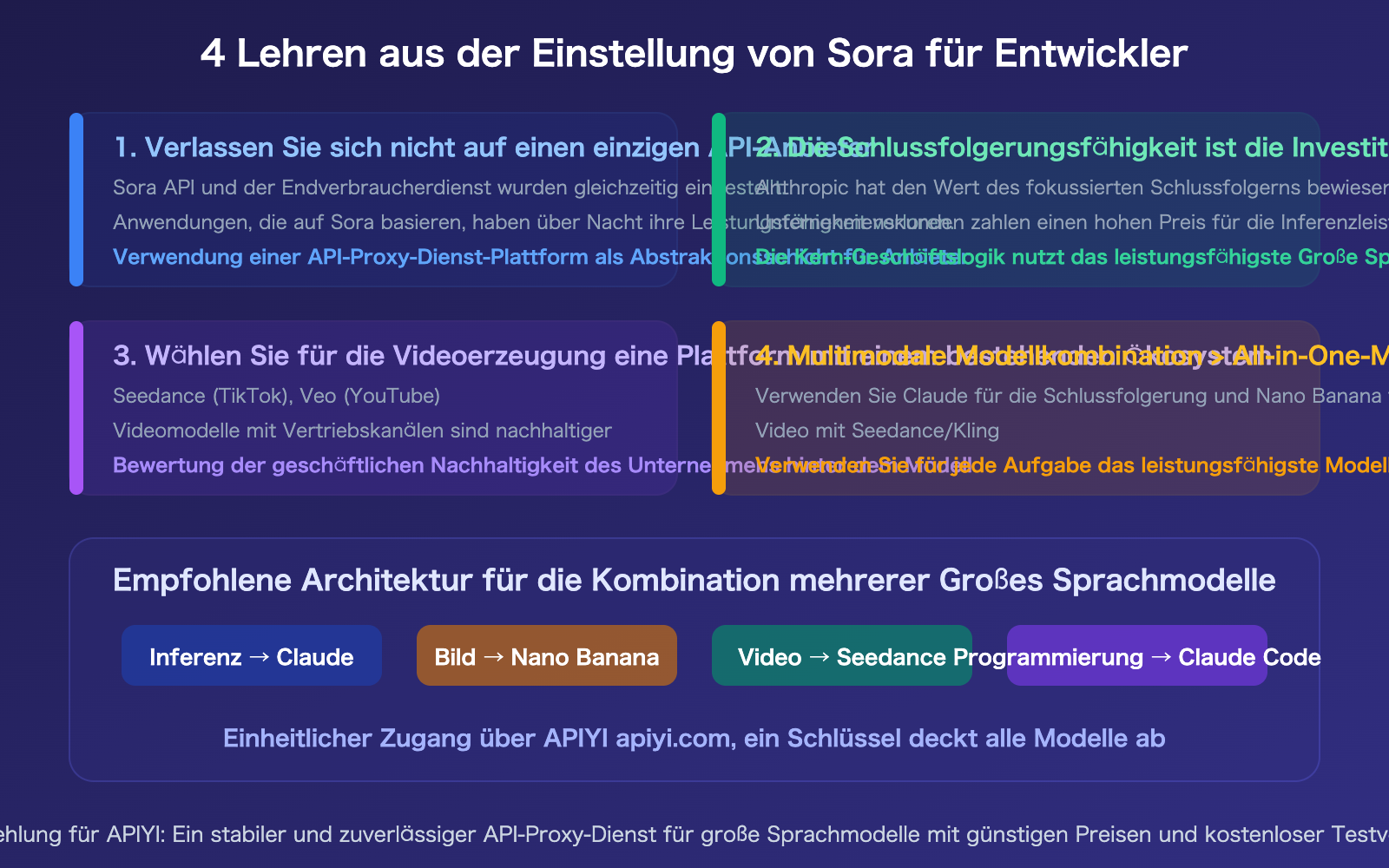

🎯 Empfehlung für Entwickler: Dass Anthropic keine Bilder/Videos anbietet, bedeutet nicht, dass Ihre Anwendung diese Fähigkeiten nicht haben kann. Über APIYI (apiyi.com) können Sie gleichzeitig Claude (Reasoning), Nano Banana 2 (Bilderzeugung) und Seedance (Videogenerierung) einbinden und die Stärken verschiedener Modelle komplementär nutzen.

Die Rechenökonomie im Bereich der KI-Videogenerierung

Die Einstellung von Sora war ein Weckruf für die gesamte KI-Videobranche: Es klafft eine riesige Lücke zwischen dem Rechenaufwand von Videomodellen und ihrer kommerziellen Rentabilität.

Preisvergleich der APIs für die KI-Videogenerierung

| Modell | Preis pro Sekunde | Kosten für 10 Sek. | Generierungsgeschwindigkeit | Auflösung |

|---|---|---|---|---|

| Sora | $0,10/Sek. | $1,00 | 60-120 Sek. | 1080p |

| Kling 2.0 | $0,07/Sek. | $0,70 | Mittel | 1080p |

| Ray 2 | $0,05-0,16/Sek. | $0,50-1,62 | 47-167 Sek. | 1080p |

| Ray 2 Flash | $0,02-0,05/Sek. | $0,17-0,54 | 30-53 Sek. | 720p |

| Seedance 2.0 | Nicht öffentlich | Gestaffelte Preise | ~30 Sek. | 2K |

Zum Vergleich der Kosten für Textmodelle: Der Preis für ausgegebene Token bei Claude Opus 4.6 liegt bei etwa $60 pro Million Token. Eine vollständige Inferenz-Konversation (~1000 Output-Token) kostet etwa $0,06 – das entspricht gerade einmal den Kosten für 0,6 Sekunden Sora-Videomaterial.

Wer kann im Videobereich überleben?

Die Einstellung von Sora bedeutet nicht, dass die KI-Videogenerierung keine Zukunft hat, sondern verdeutlicht eine entscheidende Voraussetzung: Nur Unternehmen mit einem eigenen Content-Ökosystem können im Videobereich langfristig bestehen.

- ByteDance (Seedance): Dank TikTok und Douyin gibt es natürliche Konsumszenarien für Videos und eine breite Nutzerbasis.

- Google (Veo): Mit YouTube im Rücken verfügen sie über die weltweit größte Videoplattform.

- Kuaishou (Kling): Eine etablierte Kurzvideo-Plattform mit einem geschlossenen Ökosystem.

OpenAI hingegen besitzt keine eigene Content-Plattform – die von Sora generierten Videos haben keinen direkten Konsumkanal; Nutzer wissen nach der Erstellung schlicht nicht, wo sie diese veröffentlichen sollen.

Hinweis: Auch wenn Sora offline ist, bleibt der Markt für Video-Generierungs-APIs aktiv. Modelle wie Kling, Seedance und Ray 2 können über APIYI (apiyi.com) einheitlich angebunden werden, sodass Sie mit nur einem Schlüssel auf verschiedene Videogenerierungs-Funktionen zugreifen können.

Erkenntnisse für Entwickler

Häufig gestellte Fragen

Q1: Was passiert mit meiner Sora-API-Integration nach der Abschaltung von Sora?

Da sowohl die Sora-API als auch die Endkunden-Dienste eingestellt wurden, werden alle API-Integrationen ungültig. Wir empfehlen den sofortigen Wechsel zu Alternativen: Seedance 2.0 (höchste Qualität und Geschwindigkeit), Kling 2.0 (bestes Preis-Leistungs-Verhältnis, 0,07 $/Sek.) oder Ray 2 Flash (günstigste Option ab 0,02 $/Sek.). Über APIYI (apiyi.com) können Sie schnell zu diesen Ersatzmodellen wechseln, indem Sie lediglich den Modellnamen anpassen.

Q2: Wird Anthropic in Zukunft Bilder oder Videos generieren?

Kurzfristig ist das unwahrscheinlich. Obwohl durchgesickerte Dateien einen create_image-Funktionsnamen innerhalb von Claude zeigen, priorisieren die Unternehmenskultur und die Ressourcenallokation von Anthropic die Schlussfolgerungsfähigkeit (Reasoning). Auch Prognosemärkte wie Manifold schätzen die Wahrscheinlichkeit als gering ein. Der Wettbewerbsvorteil von Anthropic liegt gerade in dieser strategischen Disziplin, sich auf das zu konzentrieren, was sie nicht tun – und die gesamte Rechenleistung auf die Schlussfolgerung zu fokussieren.

Q3: Welches Modell, Seedance 2.0 oder Kling 2.0, eignet sich besser für die API-Integration?

Das hängt von Ihren Anforderungen ab: Seedance 2.0 ist bei Qualität und Funktionsumfang überlegen (natives 2K, natives Audio, multimodale Eingabe), jedoch ist die API-Preisgestaltung derzeit noch nicht transparent. Kling 2.0 bietet eine transparentere API-Preisgestaltung (0,07 $/Sek.) und ein offeneres Ökosystem. Wenn Sie höchste Qualität suchen, wählen Sie Seedance; wenn Sie auf das Preis-Leistungs-Verhältnis achten, ist Kling die bessere Wahl. Beide sind über APIYI (apiyi.com) integrierbar.

Q4: Beeinflusst die Abschaltung von Sora durch OpenAI die Entwicklung von GPT-5?

Im Gegenteil: Die Abschaltung von Sora dient dazu, Rechenleistung für GPT-5 freizugeben. Sam Altman hat den Mitarbeitern gegenüber klargestellt, dass die durch Sora frei gewordenen Ressourcen für das Modell der nächsten Generation genutzt werden. Aus Wettbewerbssicht steht OpenAI durch das starke Auftreten von Anthropic Claude im Unternehmensmarkt unter Druck und muss die Rechenleistung auf Text- und Schlussfolgerungsfähigkeiten konzentrieren, um wettbewerbsfähig zu bleiben.

Zusammenfassung

Die wichtigsten Erkenntnisse aus der Abschaltung von Sora:

- Rechenleistung ist ein Nullsummenspiel: Das Beispiel OpenAI zeigt, dass der gleichzeitige Betrieb von Text-, Bild-, Video- und Audio-Modellen dazu führt, dass kein Bereich optimal bedient wird. Anthropic verzichtet auf Bild- und Videogenerierung und konzentriert 100 % der Rechenleistung auf die Schlussfolgerung, was dazu führt, dass die Schlussfolgerungsfähigkeit von Opus 4.6 die Konkurrenz übertrifft.

- Der Videomarkt benötigt ein Content-Ökosystem: Sora fehlten Distributionskanäle, was zu einer geringen Nutzerbindung und einem Umsatz von nur 2,1 Mio. $ führte. Seedance profitiert von TikTok und Veo von YouTube; sie verfügen über natürliche Szenarien für den Videokonsum.

- Die Kombination mehrerer Modelle ist die optimale Lösung: Die Strategie, zu wissen, was man nicht tut, ist wichtiger als das, was man tut. Entwickler sollten die jeweils stärksten Modelle für verschiedene Bereiche kombinieren, anstatt sich auf ein "Alleskönner"-Modell zu verlassen.

Wir empfehlen die Verwaltung Ihrer Modellaufrufe über APIYI (apiyi.com) – nutzen Sie Claude für Schlussfolgerungen, Nano Banana für Bilder und Seedance/Kling für Videos. Die Plattform bietet kostenlose Kontingente und eine einheitliche Schnittstelle, mit der ein einziger API-Schlüssel alle Modelle abdeckt.

📚 Referenzmaterialien

-

TechCrunch: OpenAI stellt Sora ein: Vollständiger Bericht zur Einstellung von Sora

- Link:

techcrunch.com/2026/03/24/openais-sora-was-the-creepiest-app-on-your-phone-now-its-shutting-down/ - Beschreibung: Enthält Download-Zahlen, Umsatzdaten und die offizielle Stellungnahme von OpenAI

- Link:

-

CNBC: OpenAI schließt Sora aufgrund von Kosteneinsparungen: Analyse aus Sicht der Rechenleistungskosten und des Börsengangs

- Link:

cnbc.com/2026/03/24/openai-shutters-short-form-video-app-sora-as-company-reels-in-costs.html - Beschreibung: Enthält Finanzdaten und eine Analyse des Wettbewerbsdrucks

- Link:

-

Variety: Disney lässt Pläne für 1-Milliarde-Dollar-Investition fallen: Bericht über den Rückzug von Disney

- Link:

variety.com/2026/digital/news/openai-shutting-down-sora-video-disney-1236698277/ - Beschreibung: Detaillierter Hintergrund zum Ausstieg von Disney aus der Partnerschaft

- Link:

-

Offizielle Website von Seedance 2.0: Vollständige Funktionsübersicht des Videogenerierungsmodells von ByteDance

- Link:

seedance2.ai - Beschreibung: Enthält detaillierte Informationen zu 4-modalen Eingaben, 2K-Ausgabe und nativer Audiofunktion

- Link:

-

APIYI Dokumentationszentrum: Einheitliche API-Anbindung für mehrere Modelle

- Link:

docs.apiyi.com - Beschreibung: Unterstützt die zentrale Anbindung von Claude, Nano Banana und Videogenerierungsmodellen

- Link:

Autor: APIYI Technik-Team

Technischer Austausch: Diskutieren Sie gerne in den Kommentaren. Weitere Informationen finden Sie im APIYI Dokumentationszentrum unter docs.apiyi.com.