Nota del autor: Análisis profundo sobre las verdaderas razones del cierre de OpenAI Sora 2, la presión competitiva de Seedance 2.0 y la estrategia de concentración de potencia de cómputo detrás de la negativa de Anthropic a desarrollar modelos de imagen y video, junto con sus lecciones para la industria.

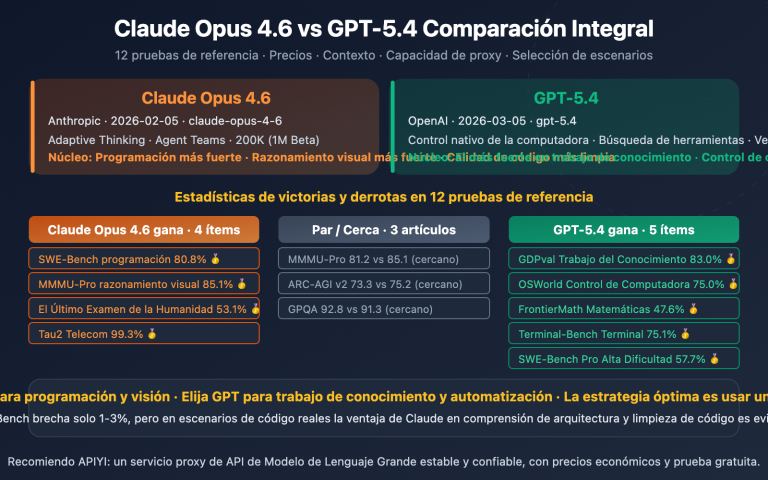

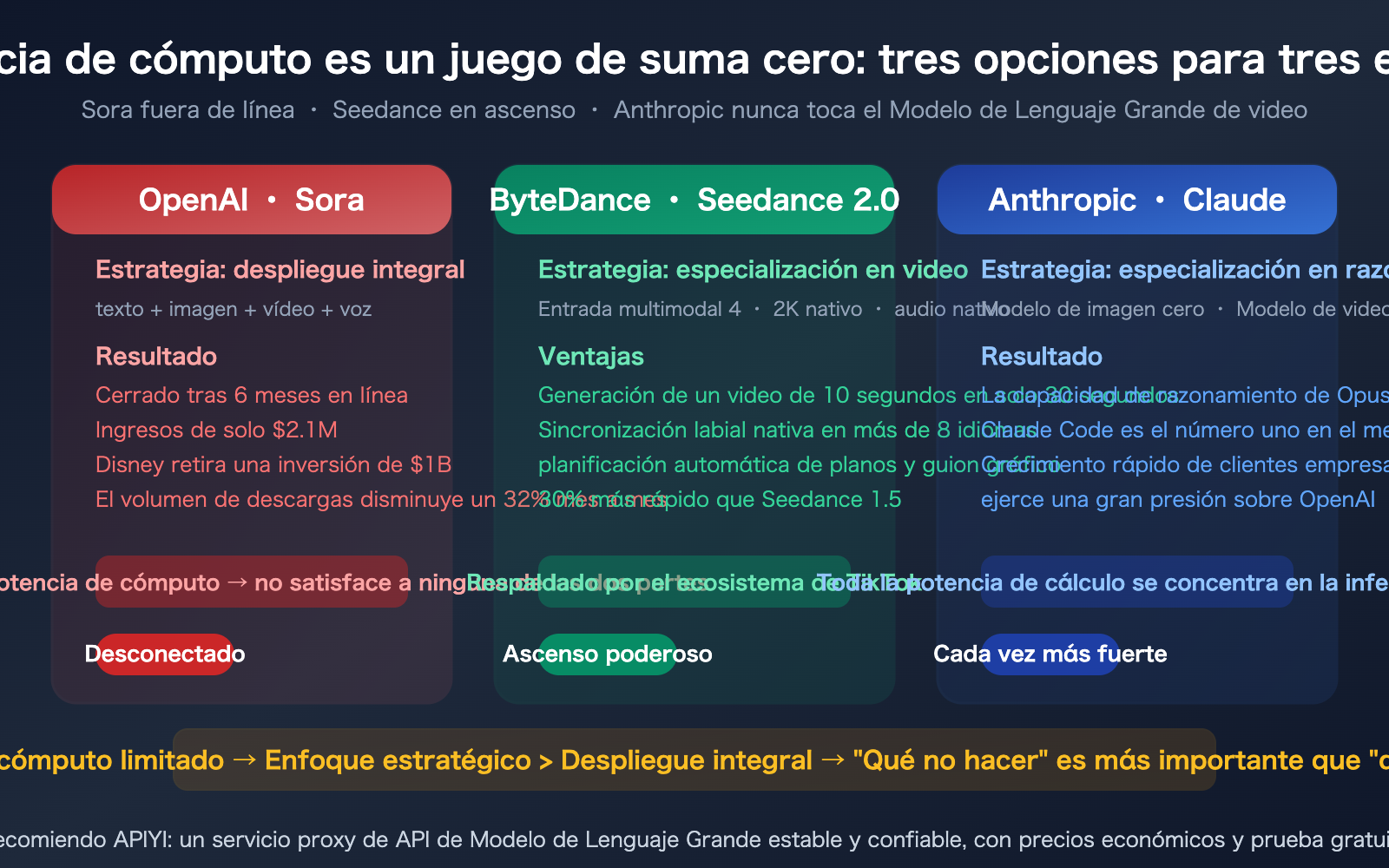

El 24 de marzo de 2026, OpenAI anunció oficialmente el cierre de Sora: tras solo 6 meses en línea, acumuló unos ingresos de apenas 2,1 millones de dólares y Disney retiró su plan de inversión de 1.000 millones de dólares. Mientras tanto, Seedance 2.0 de ByteDance capturó rápidamente el mercado con una resolución nativa de 2K, entrada multimodal y una generación ultrarrápida de 30 segundos. Pero lo que merece una reflexión más profunda es otro hecho: Anthropic no ha desarrollado ningún modelo de generación de imágenes o video en todo este tiempo, y aun así, sigue ganando terreno en la competencia de la IA. En este artículo, analizaremos la lógica subyacente detrás del cierre de Sora, el ascenso de Seedance y la estrategia de enfoque de Anthropic desde la perspectiva de la economía de la potencia de cómputo.

Valor central: Entiende en 3 minutos el dilema de la potencia de cómputo en el mercado de generación de video por IA y por qué la estrategia de "qué no hacer" es más importante que "qué hacer".

Hechos clave sobre el cierre de Sora 2

Primero veamos qué ha sucedido exactamente y luego analicemos el porqué.

| Hecho | Detalles | Impacto |

|---|---|---|

| Fecha de cierre | Anunciado oficialmente el 24 de marzo de 2026 | Solo 6 meses en línea |

| Ingresos acumulados | Aprox. $2.1M en compras dentro de la app | Insuficiente para cubrir costos de cómputo |

| Tendencia de descargas | Pico de 3.33M en noviembre → 1.13M en febrero | Descenso mensual del 32% |

| Retirada de Disney | Cancelación de plan de inversión de $1 mil millones | Pérdida del socio de contenido más importante |

| Versión oficial | "Crecimiento en demanda de cómputo, enfoque en simulación del mundo para robótica" | Redistribución de cómputo a modelos de texto/razonamiento |

| Postura del CEO | Sam Altman a los empleados: cerrar Sora libera recursos para modelos de próxima generación | La prioridad no es el video |

En su declaración de despedida, el equipo de Sora comentó: "Nos despedimos de Sora. Gracias a todos los que crearon, compartieron y construyeron comunidad con Sora. Lo que hicieron con Sora es importante y sabemos que esta noticia es decepcionante".

Al mismo tiempo, CNBC señaló que OpenAI está recortando proyectos de alto costo antes de su salida a bolsa (IPO), por lo que el cierre de Sora también es parte de una estrategia de control de costos.

3 razones profundas detrás del cierre de Sora 2

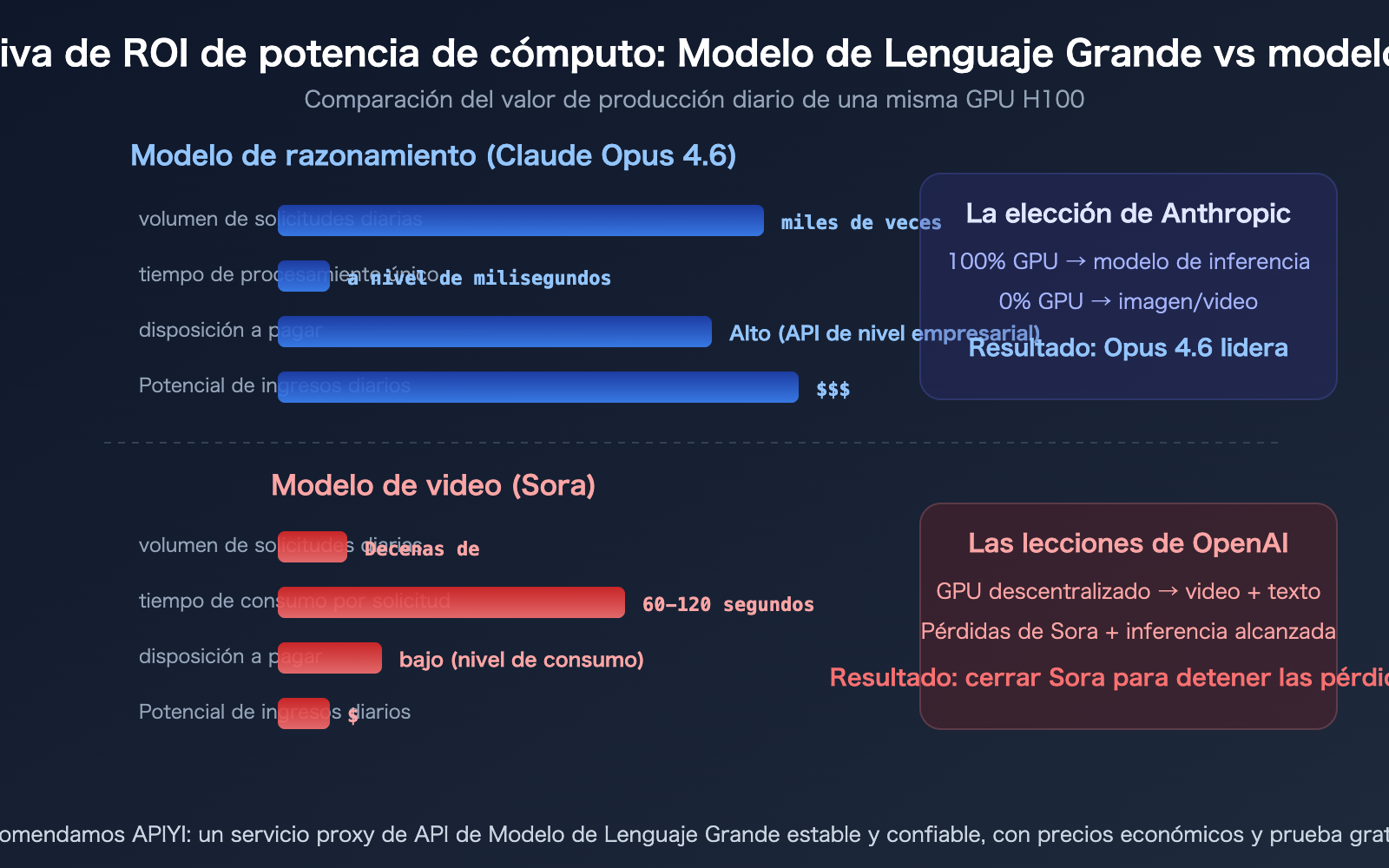

Razón 1: El agujero negro de cómputo de la generación de video

Esta es la razón fundamental. El consumo de cómputo para la generación de video es cientos de veces mayor que para la generación de texto:

| Tipo de tarea | Consumo de cómputo por tarea | Rendimiento por dólar | Eficiencia de uso de GPU |

|---|---|---|---|

| Conversación de texto | Nivel de milisegundos | Miles de conversaciones | Muy alta |

| Generación de imágenes | Nivel de segundos | Cientos de imágenes | Alta |

| Generación de video (10s) | Nivel de minutos | Decenas de videos | Baja |

Cada solicitud de video en Sora "golpeaba" la infraestructura de servidores de OpenAI, y ni siquiera el modelo de suscripción podía cubrir los costos. Más importante aún, si estas GPU se destinan a modelos de texto y razonamiento (GPT-5, o3, etc.), pueden generar un valor comercial mucho mayor.

Razón 2: El impacto competitivo de Seedance 2.0 y otros

Seedance 2.0 de ByteDance se lanzó en febrero de 2026 y superó a Sora en casi todas las dimensiones:

| Dimensión de comparación | Sora | Seedance 2.0 |

|---|---|---|

| Resolución de salida | 1080p | 2K nativo (2048×1080) |

| Velocidad de generación | ~60-120 seg/10 seg de video | ~30 seg/10 seg de video |

| Modalidades de entrada | Texto + Imagen | Texto + Imagen (9) + Video (3) + Audio (3) |

| Audio nativo | No compatible (requiere post-doblaje) | Compatible (sincronización labial en 8+ idiomas) |

| Control de cámara | Básico | Planificación automática de planos y cámaras |

| Ventaja del ecosistema | Aplicación independiente | Respaldado por el ecosistema de TikTok / Douyin |

Seedance 2.0 cuenta con el respaldo del ecosistema TikTok de ByteDance, lo que le otorga escenarios de consumo de video y una base de usuarios natural. Como aplicación independiente, Sora carecía de canales de distribución de contenido; los usuarios generaban videos pero no tenían una salida clara para consumirlos.

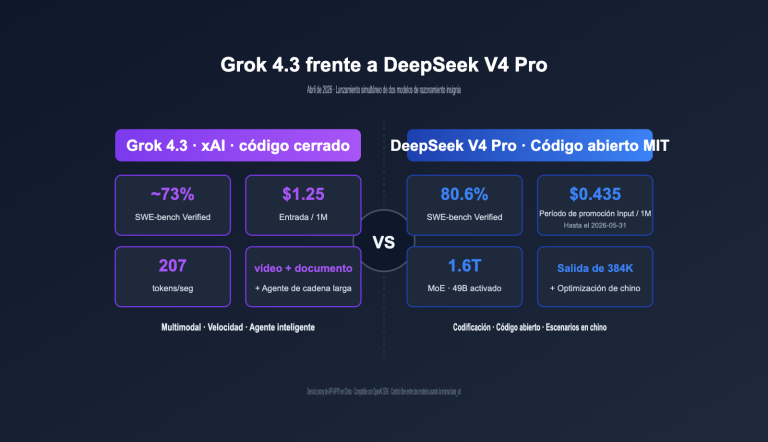

Además de Seedance, Veo 3 de Google, Kling 2.0 de Kuaishou y Ray 2 de Luma lanzaron competidores a principios de 2026. El sector de la generación de video está extremadamente saturado y la ventaja de ser el primero de Sora ha sido igualada o superada.

Razón 3: Ajuste estratégico de OpenAI

OpenAI enfrenta una enorme presión competitiva por parte de Anthropic. Informes de Bloomberg y CNBC mencionan que el sistema de IA de Anthropic ha ganado una popularidad creciente entre clientes corporativos e ingenieros de software, lo que representa una amenaza comercial directa para OpenAI.

Bajo esta presión, OpenAI debe concentrar su capacidad de cómputo en el campo de batalla principal: el razonamiento de texto y la capacidad de codificación. Cada GPU utilizada para renderizar un video de Sora es una GPU que no se está utilizando para entrenar GPT-5 u optimizar o3.

🎯 Perspectiva de la industria: El cierre de Sora no significa que "la generación de video haya fracasado", sino que "para OpenAI, hacer generación de video no es rentable". Dispersar el cómputo en demasiadas líneas de productos impide que cualquiera de ellas alcance su máximo potencial.

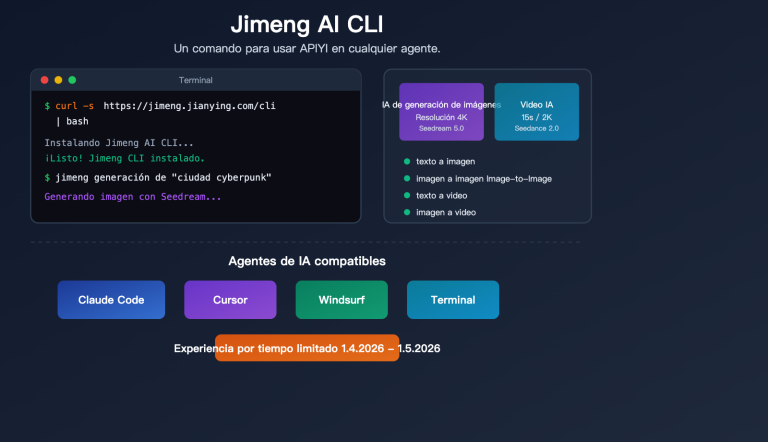

Si tu aplicación de IA necesita invocar modelos de texto y video simultáneamente, te recomendamos gestionarlos de forma unificada a través de APIYI (apiyi.com), una plataforma que cubre múltiples modelos como Seedance, Kling, Claude y más.

Por qué Anthropic nunca se ha metido con los modelos de imagen y vídeo

Esta es una elección estratégica que merece una reflexión más profunda. Desde su fundación, Anthropic nunca ha lanzado ningún modelo de generación de imágenes o vídeo; ni siquiera ha seguido la ruta de "modelo de texto con capacidades de imagen" como el Nano Banana (generación de imágenes de Gemini) de Google.

La estrategia de concentración de potencia de cómputo de Anthropic

La lógica de Anthropic es sencilla: la potencia de cómputo es limitada y debe concentrarse totalmente en las áreas de mayor valor.

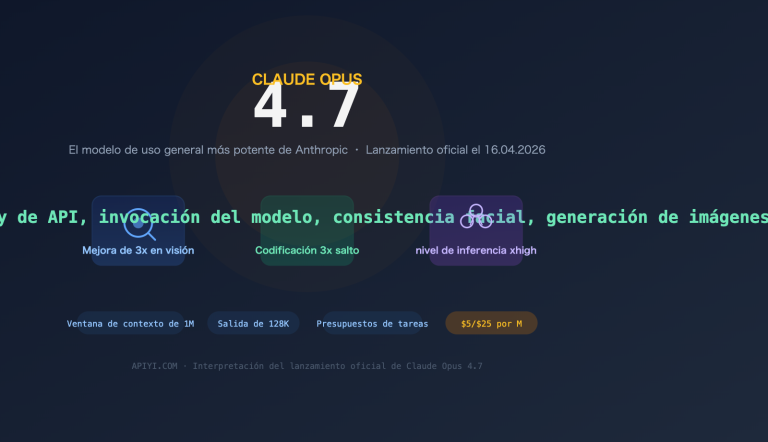

Para Anthropic, las áreas de mayor valor son el razonamiento y el código, que son las capacidades fundamentales por las que los clientes empresariales están dispuestos a pagar precios elevados. El hecho de que la capacidad de razonamiento de Opus 4.6 pueda superar a la de sus competidores se debe, en gran medida, a que Anthropic no ha dispersado sus GPU en modelos de imagen y vídeo.

Esto contrasta notablemente con OpenAI:

| Dimensión estratégica | OpenAI (Dispersión) | Anthropic (Concentración) |

|---|---|---|

| Línea de productos | GPT + DALL·E + Sora + Whisper + Jukebox | Claude (solo texto/código) |

| Asignación de cómputo | Texto + Imagen + Vídeo + Audio | 100% razonamiento de texto |

| Competitividad central | "Puede hacerlo todo" | "El mejor en razonamiento y código" |

| Modelo de negocio | Consumo + API + Empresa | API + Empresa (alto valor por cliente) |

| Resultado de Sora | Descontinuado en 6 meses, $2.1M ingresos | — |

| Resultado de Claude Code | — | Líder en el mercado de agentes de codificación |

Por qué el ROI de los modelos de razonamiento es muy superior al de los modelos de vídeo

Desde una perspectiva comercial, el retorno por unidad de cómputo de los modelos de razonamiento y los de vídeo no están en el mismo nivel:

- Modelos de razonamiento: Los clientes empresariales pagan por token, tienen márgenes de beneficio altos, alta frecuencia de uso y pueden integrarse en flujos de trabajo.

- Modelos de vídeo: La disposición a pagar de los consumidores es baja (Sora lo demostró), el consumo de cómputo es enorme y la frecuencia de uso es baja.

Una GPU H100 utilizada para ejecutar Claude Opus 4.6 puede atender miles de solicitudes de razonamiento de nivel empresarial al día, generando ingresos significativos por API. La misma GPU utilizada para la generación de vídeo solo podría producir unas pocas docenas de vídeos al día, y la mayoría de los usuarios no están dispuestos a pagar por ello.

La señal de que Anthropic no hará generación de imágenes

A pesar de que archivos de configuración filtrados muestran que existen nombres de funciones como create_image y edit_image dentro de Claude, Anthropic no ha lanzado oficialmente ninguna capacidad de generación de imágenes hasta la fecha. Las predicciones en Manifold sobre si "Anthropic lanzará un modelo de generación de imágenes en 2026" siguen bajando.

La cultura institucional y la estrategia de asignación de recursos de Anthropic apuntan en la misma dirección: llevar la capacidad de razonamiento al extremo, en lugar de dispersar esfuerzos en imágenes y vídeos.

🎯 Consejo para desarrolladores: Que Anthropic no haga imágenes/vídeos no significa que tu aplicación no pueda tener estas capacidades. A través de APIYI apiyi.com puedes acceder simultáneamente a Claude (razonamiento), Nano Banana 2 (generación de imágenes) y Seedance (generación de vídeo), aprovechando las fortalezas complementarias de cada modelo.

La economía de la potencia de cómputo en la generación de vídeo por IA

El cierre de Sora ha hecho sonar las alarmas en toda la industria de la generación de vídeo por IA: existe una brecha enorme entre el consumo de potencia de cómputo de los modelos de vídeo y su monetización comercial.

Comparativa de precios de API de generación de vídeo por IA

| Modelo | Precio por segundo de vídeo | Coste de vídeo de 10 s | Velocidad de generación | Resolución |

|---|---|---|---|---|

| Sora | $0.10/s | $1.00 | 60-120 s | 1080p |

| Kling 2.0 | $0.07/s | $0.70 | Media | 1080p |

| Ray 2 | $0.05-0.16/s | $0.50-1.62 | 47-167 s | 1080p |

| Ray 2 Flash | $0.02-0.05/s | $0.17-0.54 | 30-53 s | 720p |

| Seedance 2.0 | No público | Niveles de pago | ~30 s | 2K |

Si comparamos esto con el coste de los modelos de texto: el precio de salida de tokens de Claude Opus 4.6 es de unos $60 por millón de tokens; una conversación de inferencia completa (~1000 tokens de salida) cuesta unos $0.06, lo que equivale apenas al coste de generar 0.6 segundos de vídeo con Sora.

Quién puede sobrevivir en el sector del vídeo

El cierre de Sora no significa que la generación de vídeo por IA no tenga futuro, sino que subraya una condición clave: solo las empresas que poseen un ecosistema de contenido pueden sobrevivir a largo plazo en el sector del vídeo.

- ByteDance (Seedance): Respaldada por TikTok y Douyin, cuenta de forma natural con escenarios de consumo de vídeo y una base de usuarios.

- Google (Veo): Respaldada por YouTube, la plataforma de vídeo más grande del mundo.

- Kuaishou (Kling): Plataforma de vídeos cortos nacional con un ecosistema cerrado.

Por su parte, OpenAI no tiene su propia plataforma de contenido: los vídeos generados por Sora carecen de una salida de consumo; los usuarios no saben dónde publicar los vídeos una vez creados.

Nota: Aunque Sora ha dejado de estar disponible, el mercado de API de generación de vídeo sigue activo. Modelos como Kling, Seedance y Ray 2 pueden integrarse de forma unificada a través de APIYI apiyi.com, permitiendo acceder a múltiples capacidades de generación de vídeo con una sola clave.

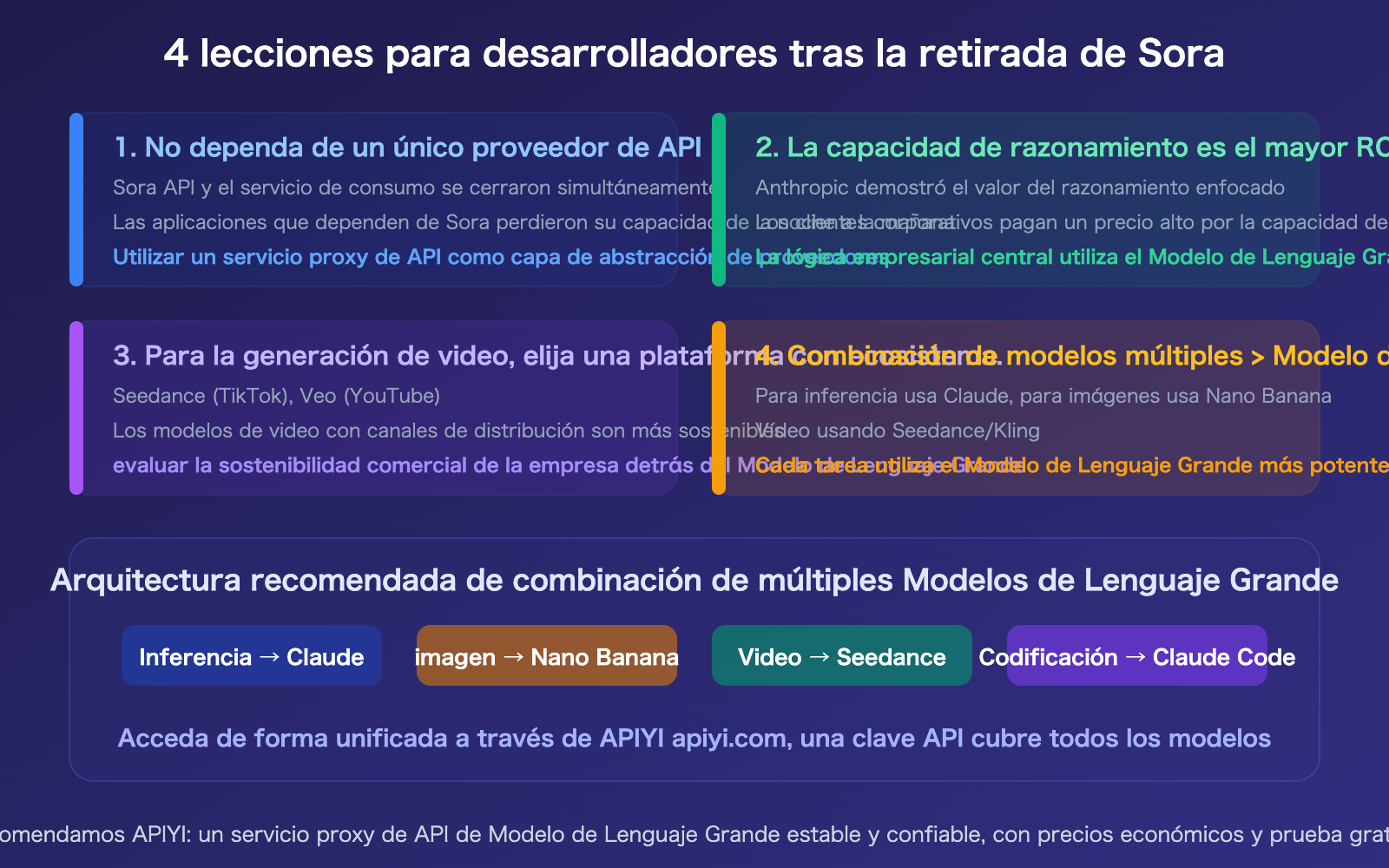

Lecciones para desarrolladores

Preguntas frecuentes

Q1: Tras el cierre de Sora, ¿qué pasará con mi integración de la API de Sora?

La API de Sora y su versión para el consumidor se han cerrado simultáneamente, por lo que todas las integraciones de API dejarán de funcionar. Te recomendamos migrar de inmediato a alternativas como: Seedance 2.0 (la de mayor calidad y velocidad), Kling 2.0 (la mejor relación calidad-precio, $0.07/seg) o Ray 2 Flash (la más económica, desde $0.02/seg). A través de APIYI (apiyi.com) puedes cambiar rápidamente a estos modelos alternativos simplemente modificando el nombre del modelo.

Q2: ¿Anthropic desarrollará generación de imágenes o videos en el futuro?

Es poco probable a corto plazo. Aunque se han filtrado archivos que muestran la existencia de una función create_image dentro de Claude, la cultura institucional y la estrategia de asignación de recursos de Anthropic priorizan la capacidad de razonamiento. Los mercados de predicción de Manifold también indican una probabilidad baja. La ventaja competitiva de Anthropic reside precisamente en esa disciplina estratégica de "saber qué no hacer", concentrando toda su potencia de cómputo en el razonamiento.

Q3: ¿Cuál es más adecuado para la integración de API: Seedance 2.0 o Kling 2.0?

Depende de tus necesidades: Seedance 2.0 es superior en calidad y funciones (nativo 2K, audio nativo, entrada multimodal), pero su precio de API aún no es transparente. Kling 2.0 ofrece una estructura de precios más clara ($0.07/seg) y un ecosistema más abierto. Si buscas la máxima calidad, elige Seedance; si buscas rentabilidad, elige Kling. Ambos están disponibles en APIYI (apiyi.com).

Q4: ¿El cierre de Sora por parte de OpenAI afectará el desarrollo de GPT-5?

Al contrario: el cierre de Sora se realizó precisamente para liberar potencia de cómputo para GPT-5. Sam Altman ha dejado claro a sus empleados que los recursos liberados por Sora se destinarán al modelo de próxima generación. Desde una perspectiva competitiva, OpenAI enfrenta un fuerte desafío por parte de Claude de Anthropic en el mercado empresarial, por lo que debe concentrar su cómputo en texto y razonamiento para mantenerse competitivo.

Resumen

Lecciones clave del cierre de Sora:

- El cómputo es un juego de suma cero: La lección de OpenAI demuestra que intentar abarcar texto, imágenes, video y audio simultáneamente impide alcanzar la excelencia en cada área. Anthropic, al no tocar imágenes ni videos y concentrar el 100% de su cómputo en el razonamiento, ha logrado que la capacidad de razonamiento de Opus 4.6 supere a la competencia.

- El sector del video requiere un ecosistema de contenido: La falta de canales de distribución de Sora provocó una baja retención de usuarios y unos ingresos de solo $2.1M. Seedance cuenta con el respaldo de TikTok y Veo con el de YouTube, lo que les proporciona escenarios naturales de consumo de video.

- La combinación de múltiples modelos es la solución óptima: La estrategia de que "lo que no haces" es más importante que "lo que haces" implica que los desarrolladores deberían utilizar una combinación de los mejores modelos en cada campo, en lugar de depender de un modelo "todoterreno".

Te recomendamos gestionar tus invocaciones de modelos de forma unificada a través de APIYI (apiyi.com): usa Claude para razonamiento, Nano Banana para imágenes y Seedance/Kling para video. La plataforma ofrece cuotas gratuitas y una interfaz unificada, permitiéndote cubrir todos los modelos con una sola clave API.

📚 Referencias

-

TechCrunch: OpenAI cierra Sora: Informe completo sobre el cierre de Sora

- Enlace:

techcrunch.com/2026/03/24/openais-sora-was-the-creepiest-app-on-your-phone-now-its-shutting-down/ - Descripción: Incluye datos de descarga, cifras de ingresos y el comunicado oficial de OpenAI

- Enlace:

-

CNBC: OpenAI cierra Sora mientras la empresa recorta costes: Análisis desde la perspectiva de los costes de computación y la salida a bolsa (IPO)

- Enlace:

cnbc.com/2026/03/24/openai-shutters-short-form-video-app-sora-as-company-reels-in-costs.html - Descripción: Incluye datos financieros y un análisis de la presión competitiva

- Enlace:

-

Variety: Disney retira sus planes de inversión de 1.000 millones de dólares: Informe sobre la retirada de capital de Disney

- Enlace:

variety.com/2026/digital/news/openai-shutting-down-sora-video-disney-1236698277/ - Descripción: Antecedentes detallados sobre la ruptura de la colaboración con Disney

- Enlace:

-

Sitio web oficial de Seedance 2.0: Presentación completa de las funciones del modelo de generación de vídeo de ByteDance

- Enlace:

seedance2.ai - Descripción: Incluye detalles sobre la entrada multimodal, salida en 2K y funciones de audio nativo

- Enlace:

-

Centro de documentación de APIYI: Acceso unificado a la API para múltiples modelos

- Enlace:

docs.apiyi.com - Descripción: Soporte para la integración integral de Claude, Nano Banana y modelos de generación de vídeo

- Enlace:

Autor: Equipo técnico de APIYI

Intercambio técnico: Te invitamos a participar en la sección de comentarios. Para más información, visita el centro de documentación de APIYI en docs.apiyi.com