Note de l'auteur : Une analyse approfondie des véritables raisons de l'arrêt de Sora d'OpenAI, de la pression concurrentielle exercée par Seedance 2.0, et de la stratégie de concentration des ressources informatiques derrière le refus d'Anthropic de développer des modèles d'image ou de vidéo, ainsi que ses enseignements pour l'industrie.

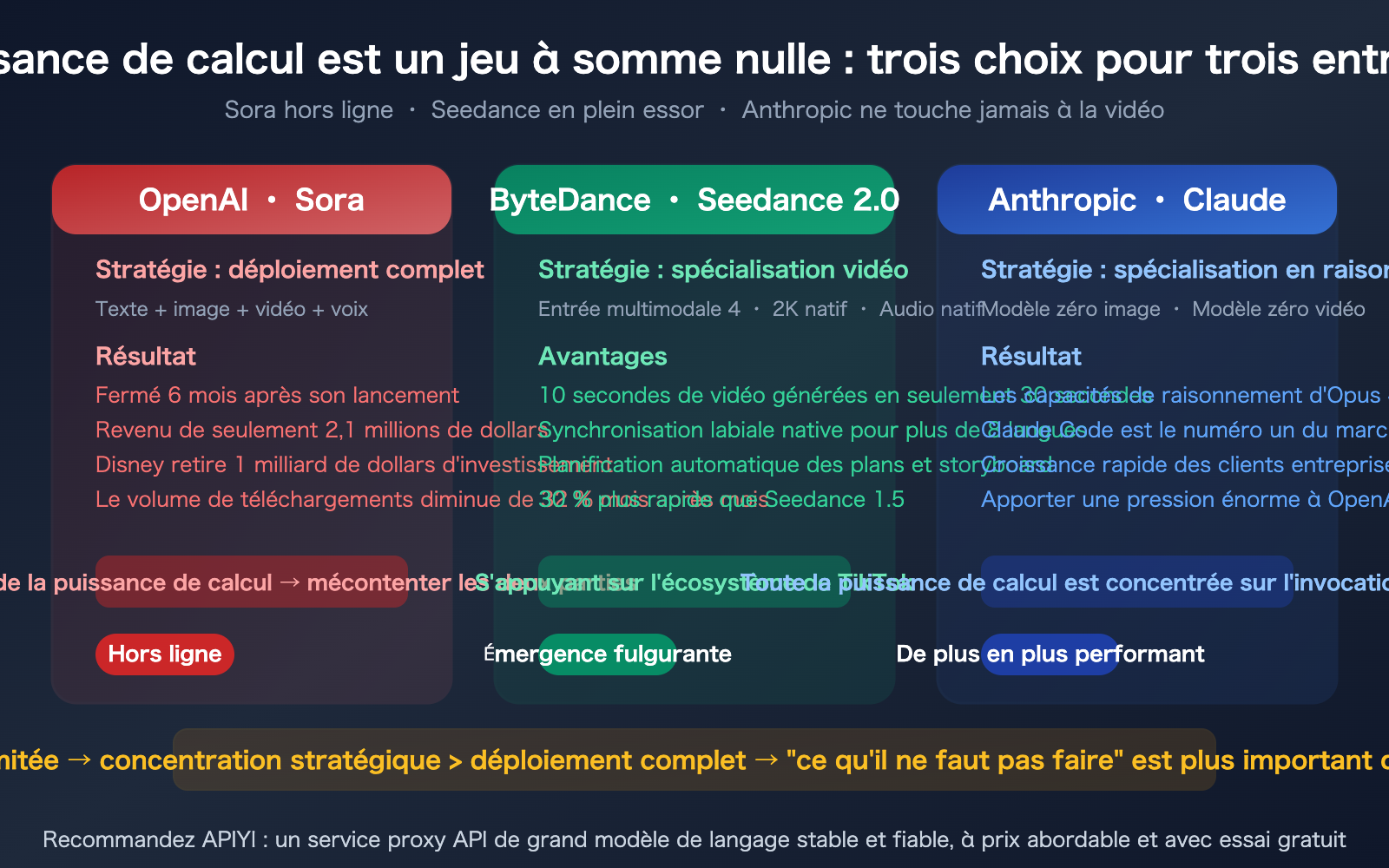

Le 24 mars 2026, OpenAI a officiellement annoncé l'arrêt de Sora — après seulement 6 mois d'exploitation, avec un revenu cumulé de seulement 2,1 millions de dollars et le retrait d'un plan d'investissement d'un milliard de dollars par Disney. Parallèlement, Seedance 2.0 de ByteDance a rapidement conquis le marché grâce à sa résolution native 2K, ses entrées multimodales et sa génération ultra-rapide en 30 secondes. Mais un autre fait mérite réflexion : Anthropic n'a jamais développé de modèle de génération d'images ou de vidéos, et pourtant, ils ne cessent de gagner en puissance dans la course à l'IA. Cet article analyse, sous l'angle de l'économie de la puissance de calcul, la logique sous-jacente à l'arrêt de Sora, à l'ascension de Seedance et à la stratégie de focalisation d'Anthropic.

Valeur ajoutée : Comprenez en 3 minutes l'impasse de la puissance de calcul sur le marché de la génération vidéo par IA, et pourquoi savoir "ce qu'il ne faut pas faire" est une réflexion stratégique plus importante que "ce qu'il faut faire".

Faits marquants sur l'arrêt de Sora 2

Analysons d'abord ce qui s'est réellement passé, avant d'en comprendre les raisons.

| Fait | Détails | Impact |

|---|---|---|

| Date de fermeture | Annoncée officiellement le 24 mars 2026 | Seulement 6 mois après le lancement |

| Revenus cumulés | Environ 2,1 M$ via achats intégrés | Loin de couvrir les coûts de calcul |

| Tendance des téléchargements | Pic de 3,33 millions en novembre → 1,13 million en février | Baisse mensuelle de 32 % |

| Retrait de Disney | Annulation d'un plan d'investissement d'un milliard de dollars | Perte du partenaire de contenu le plus important |

| Déclaration officielle | "Croissance des besoins en calcul, focus sur la simulation mondiale pour la robotique" | Réallocation de la puissance de calcul vers les modèles de texte/raisonnement |

| Position du CEO | Sam Altman aux employés : l'arrêt de Sora libère des ressources pour les modèles de nouvelle génération | La vidéo n'est clairement plus une priorité |

Dans sa déclaration d'adieu, l'équipe Sora a affirmé : "Nous devons dire au revoir à Sora. Merci à tous ceux qui ont créé, partagé et construit une communauté avec Sora. Ce que vous avez accompli avec Sora est important, et nous savons que cette nouvelle est décevante."

Parallèlement, CNBC a souligné qu'OpenAI réduit ses projets coûteux avant son introduction en bourse (IPO), et que l'arrêt de Sora s'inscrit dans cette stratégie de contrôle des coûts.

3 raisons profondes de l'arrêt de Sora 2

Raison 1 : Le trou noir de la puissance de calcul pour la génération vidéo

C'est la cause fondamentale. La consommation de calcul pour la génération vidéo est des centaines de fois supérieure à celle de la génération de texte :

| Type de tâche | Consommation de calcul par requête | Rendement par dollar | Efficacité d'utilisation GPU |

|---|---|---|---|

| Dialogue textuel | Niveau milliseconde | Des milliers de dialogues | Très élevée |

| Génération d'images | Niveau seconde | Des centaines d'images | Élevée |

| Génération vidéo (10s) | Niveau minute | Des dizaines de vidéos | Faible |

Chaque requête vidéo de Sora "martelait" l'infrastructure serveur d'OpenAI, et même le modèle d'abonnement ne permettait pas de couvrir les coûts. Plus important encore, si ces GPU étaient utilisés pour des modèles de texte et de raisonnement (GPT-5, o3, etc.), ils généreraient une valeur commerciale bien plus élevée.

Raison 2 : La concurrence déloyale de Seedance 2.0 et autres

Seedance 2.0 de ByteDance, lancé en février 2026, a surpassé Sora sur presque tous les plans :

| Dimension de comparaison | Sora | Seedance 2.0 |

|---|---|---|

| Résolution de sortie | 1080p | 2K natif (2048×1080) |

| Vitesse de génération | Env. 60-120 s / 10 s de vidéo | Env. 30 s / 10 s de vidéo |

| Modalités d'entrée | Texte + Image | Texte + Image (9) + Vidéo (3) + Audio (3) |

| Audio natif | Non supporté (doublage post-prod) | Supporté (synchronisation labiale 8+ langues) |

| Contrôle de caméra | Basique | Découpage automatique et planification de plans |

| Avantage écosystémique | Application indépendante | Adossé à l'écosystème TikTok / Douyin |

Seedance 2.0 s'appuie sur l'écosystème TikTok de ByteDance, bénéficiant naturellement de scénarios de consommation vidéo et d'une base d'utilisateurs solide. En tant qu'application indépendante, Sora manquait de canaux de distribution : une fois la vidéo générée, les utilisateurs n'avaient aucun endroit clair où la diffuser.

Outre Seedance, Veo 3 de Google, Kling 2.0 de Kuaishou et Ray 2 de Luma ont également lancé des concurrents au début de l'année 2026. Le secteur de la génération vidéo est devenu extrêmement saturé, et l'avantage du premier arrivé de Sora a été rattrapé, voire dépassé.

Raison 3 : Le réajustement stratégique d'OpenAI

OpenAI fait face à une pression concurrentielle immense de la part d'Anthropic. Les rapports de Bloomberg et CNBC mentionnent que les systèmes d'IA d'Anthropic gagnent rapidement en popularité auprès des entreprises clientes et des ingénieurs logiciels, constituant une menace commerciale directe pour OpenAI.

Face à cette pression, OpenAI doit concentrer sa puissance de calcul sur son champ de bataille principal : le raisonnement textuel et les capacités de codage. Chaque GPU utilisé pour le rendu d'une vidéo Sora est un GPU qui n'est pas utilisé pour entraîner GPT-5 ou optimiser o3.

🎯 Analyse du secteur : L'arrêt de Sora ne signifie pas que "la génération vidéo est morte", mais plutôt que "la génération vidéo n'est pas rentable pour OpenAI". La dispersion de la puissance de calcul sur trop de lignes de produits empêchait l'excellence sur chacune d'elles.

Si vos applications d'IA nécessitent d'invoquer simultanément des modèles de texte et de vidéo, nous vous recommandons de les gérer de manière centralisée via APIYI (apiyi.com), une plateforme couvrant une large gamme de modèles tels que Seedance, Kling, Claude, et bien d'autres.

Pourquoi Anthropic ne s'est jamais lancé dans les modèles d'image et de vidéo

C'est un choix stratégique qui mérite réflexion. Depuis sa création, Anthropic n'a jamais publié le moindre modèle de génération d'images ou de vidéos — ils n'ont même pas suivi la voie empruntée par Google avec Nano Banana (génération d'images intégrée aux modèles textuels).

La stratégie de concentration de la puissance de calcul d'Anthropic

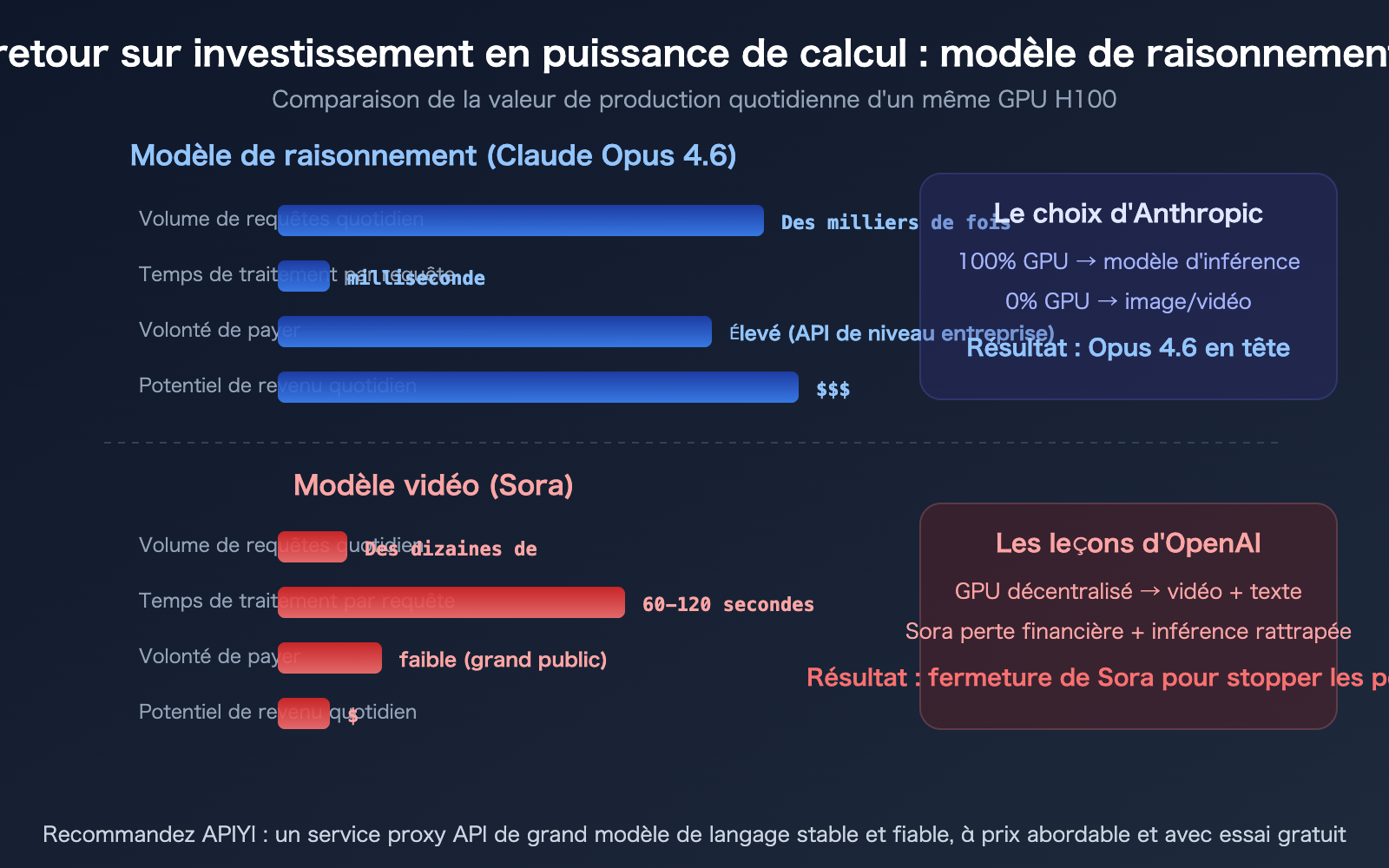

La logique d'Anthropic est limpide : la puissance de calcul est une ressource limitée qui doit être concentrée sur les domaines à plus forte valeur ajoutée.

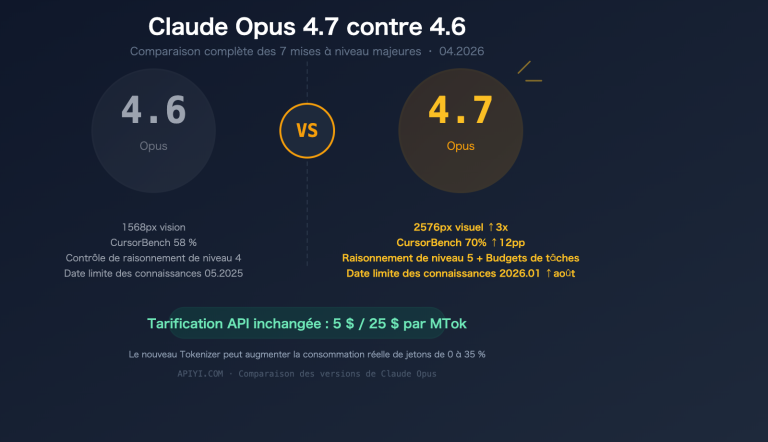

Pour Anthropic, ces domaines sont le raisonnement et le code, car ce sont les capacités clés pour lesquelles les entreprises sont prêtes à payer le prix fort. Si les capacités de raisonnement d'Opus 4.6 surpassent celles de ses concurrents, c'est en grande partie parce qu'Anthropic n'a pas dispersé ses GPU dans des modèles d'images ou de vidéos.

Cela contraste fortement avec OpenAI :

| Dimension stratégique | OpenAI (Dispersion) | Anthropic (Concentration) |

|---|---|---|

| Gamme de produits | GPT + DALL·E + Sora + Whisper + Jukebox | Claude (texte/code uniquement) |

| Allocation de calcul | Texte + Image + Vidéo + Audio | 100 % raisonnement textuel |

| Compétence clé | "Capable de tout faire" | "L'excellence en raisonnement et code" |

| Modèle économique | Grand public + API + Entreprise | API + Entreprise (panier moyen élevé) |

| Résultat Sora | Arrêté après 6 mois, 2,1 M$ de revenus | — |

| Résultat Claude Code | — | Leader sur le marché des agents de codage |

Pourquoi le ROI des modèles de raisonnement est bien supérieur à celui des modèles vidéo

D'un point de vue commercial, le rendement par unité de calcul n'est pas du tout le même :

- Modèles de raisonnement : Les entreprises paient à la requête (Token), avec des marges élevées, une fréquence d'utilisation soutenue et une intégration directe dans les flux de travail.

- Modèles vidéo : La volonté de payer des consommateurs est faible (Sora l'a prouvé), la consommation de calcul est colossale et la fréquence d'utilisation est basse.

Un GPU H100 utilisé pour faire tourner Claude Opus 4.6 peut servir des milliers de requêtes de raisonnement professionnelles par jour, générant ainsi des revenus API substantiels. Le même GPU, utilisé pour la génération vidéo, ne produirait que quelques dizaines de vidéos par jour, pour lesquelles la plupart des utilisateurs ne sont pas prêts à payer.

Le signal envoyé par l'absence de génération d'images chez Anthropic

Bien que des fichiers de configuration aient révélé l'existence de fonctions create_image et edit_image en interne, Anthropic n'a jamais officiellement déployé de capacités de génération d'images. Sur Manifold, la probabilité que le marché accorde à une sortie de modèle d'image par Anthropic en 2026 ne cesse de diminuer.

La culture d'entreprise et la stratégie d'allocation des ressources d'Anthropic pointent toutes dans la même direction : pousser les capacités de raisonnement à leur paroxysme plutôt que de s'éparpiller dans l'image et la vidéo.

🎯 Conseil aux développeurs : Le fait qu'Anthropic ne fasse pas d'images ou de vidéos ne signifie pas que vos applications ne peuvent pas en bénéficier. Grâce à APIYI (apiyi.com), vous pouvez accéder simultanément à Claude (raisonnement), Nano Banana 2 (génération d'images) et Seedance (génération vidéo), en combinant les forces complémentaires de chaque modèle.

L'économie de la puissance de calcul dans le secteur de la génération vidéo par IA

La fermeture de Sora a sonné comme un signal d'alarme pour toute l'industrie de la génération vidéo par IA : il existe un fossé immense entre la consommation de puissance de calcul des modèles vidéo et leur rentabilité commerciale.

Comparaison des tarifs des API de génération vidéo par IA

| Modèle | Prix par seconde | Coût pour 10 s | Vitesse de génération | Résolution |

|---|---|---|---|---|

| Sora | 0,10 $ / s | 1,00 $ | 60-120 s | 1080p |

| Kling 2.0 | 0,07 $ / s | 0,70 $ | Moyen | 1080p |

| Ray 2 | 0,05-0,16 $ / s | 0,50-1,62 $ | 47-167 s | 1080p |

| Ray 2 Flash | 0,02-0,05 $ / s | 0,17-0,54 $ | 30-53 s | 720p |

| Seedance 2.0 | Non public | Niveaux payants | ~30 s | 2K |

Comparons cela aux coûts des modèles textuels : le prix des jetons de sortie de Claude Opus 4.6 est d'environ 60 $ par million de jetons. Une conversation d'inférence complète (~1000 jetons de sortie) coûte environ 0,06 $ — soit l'équivalent de seulement 0,6 seconde de vidéo générée par Sora.

Qui survivra dans le secteur de la vidéo ?

La fermeture de Sora ne signifie pas que la génération vidéo par IA n'a pas d'avenir, mais elle met en lumière une condition sine qua non : seules les entreprises possédant un écosystème de contenu peuvent survivre à long terme dans ce domaine.

- ByteDance (Seedance) : S'appuie sur TikTok et Douyin, disposant naturellement de scénarios de consommation vidéo et d'une base d'utilisateurs.

- Google (Veo) : S'appuie sur YouTube, la plus grande plateforme vidéo mondiale.

- Kuaishou (Kling) : Plateforme de vidéos courtes, avec une boucle fermée d'écosystème.

De son côté, OpenAI ne possède pas de plateforme de contenu propre — les vidéos générées par Sora manquent de débouchés de consommation ; les utilisateurs ne savent pas où publier leurs créations.

Conseil : Bien que Sora soit hors ligne, le marché des API de génération vidéo reste très actif. Des modèles comme Kling, Seedance et Ray 2 peuvent être intégrés de manière unifiée via APIYI apiyi.com, permettant d'accéder à plusieurs capacités de génération vidéo avec une seule clé API.

Enseignements pour les développeurs

Foire aux questions (FAQ)

Q1 : Que devient mon intégration API Sora suite à son arrêt ?

L'API et les services grand public de Sora ont été arrêtés simultanément, rendant toutes les intégrations API inopérantes. Nous vous recommandons de migrer immédiatement vers des alternatives : Seedance 2.0 (meilleure qualité et vitesse), Kling 2.0 (meilleur rapport qualité-prix, 0,07 $/s) ou Ray 2 Flash (le plus économique, à partir de 0,02 $/s). Via APIYI (apiyi.com), vous pouvez basculer rapidement vers ces modèles alternatifs en modifiant simplement le nom du modèle.

Q2 : Anthropic va-t-il se lancer dans la génération d’images ou de vidéos à l’avenir ?

C'est peu probable à court terme. Bien que des documents ayant fuité mentionnent une fonction create_image au sein de Claude, la culture d'entreprise et la stratégie d'allocation des ressources d'Anthropic privilégient les capacités de raisonnement. Les marchés de prédiction Manifold indiquent également une faible probabilité. L'avantage concurrentiel d'Anthropic réside précisément dans cette discipline stratégique du "ce qu'il ne faut pas faire" : concentrer toute la puissance de calcul sur le raisonnement.

Q3 : Lequel de Seedance 2.0 ou Kling 2.0 est le plus adapté à une intégration API ?

Tout dépend de vos besoins : Seedance 2.0 est supérieur en termes de qualité et de fonctionnalités (natif 2K, audio natif, entrée multimodale à 4 canaux), mais sa tarification API n'est pas encore totalement transparente. L'API de Kling 2.0 est plus transparente (0,07 $/s) et son écosystème plus ouvert. Si vous recherchez la meilleure qualité, choisissez Seedance ; si vous privilégiez le rapport coût-efficacité, choisissez Kling. Les deux sont accessibles via APIYI (apiyi.com).

Q4 : L’arrêt de Sora par OpenAI affectera-t-il le développement de GPT-5 ?

C'est tout le contraire : l'arrêt de Sora vise justement à libérer de la puissance de calcul pour GPT-5. Sam Altman a clairement indiqué à ses employés que les ressources libérées par Sora seraient réallouées au modèle de nouvelle génération. D'un point de vue concurrentiel, OpenAI fait face à la montée en puissance de Claude d'Anthropic sur le marché des entreprises et doit concentrer ses ressources sur le texte et le raisonnement pour rester compétitif.

Conclusion

Les leçons clés de l'arrêt de Sora :

- La puissance de calcul est un jeu à somme nulle : L'expérience d'OpenAI prouve que vouloir gérer simultanément le texte, l'image, la vidéo et l'audio empêche d'atteindre l'excellence sur chaque segment. Anthropic, en évitant les images et les vidéos pour concentrer 100 % de sa puissance sur le raisonnement, a réussi à propulser les capacités de raisonnement d'Opus 4.6 devant ses concurrents.

- Le secteur de la vidéo nécessite un écosystème de contenu : Le manque de canaux de distribution de Sora a entraîné une faible rétention des utilisateurs et des revenus limités à 2,1 millions de dollars. Seedance s'appuie sur TikTok et Veo sur YouTube, disposant ainsi de scénarios de consommation vidéo naturels.

- La combinaison de modèles est la solution optimale : La stratégie du "ce qu'il ne faut pas faire" est plus importante que celle du "quoi faire". Cela signifie que les développeurs devraient combiner les meilleurs modèles dans chaque domaine plutôt que de dépendre d'un modèle "tout-en-un".

Nous vous recommandons d'utiliser APIYI (apiyi.com) pour gérer de manière centralisée vos invocations du modèle : Claude pour le raisonnement, Nano Banana pour les images, et Seedance/Kling pour la vidéo. La plateforme offre des crédits gratuits et une interface unifiée, vous permettant d'accéder à tous les modèles avec une seule clé API.

📚 Références

-

TechCrunch : OpenAI ferme Sora : Rapport complet sur la fermeture de Sora

- Lien :

techcrunch.com/2026/03/24/openais-sora-was-the-creepiest-app-on-your-phone-now-its-shutting-down/ - Description : Inclut les données de téléchargement, les revenus et la déclaration officielle d'OpenAI

- Lien :

-

CNBC : OpenAI ferme Sora alors que l'entreprise réduit ses coûts : Analyse sous l'angle des coûts de calcul et de l'introduction en bourse (IPO)

- Lien :

cnbc.com/2026/03/24/openai-shutters-short-form-video-app-sora-as-company-reels-in-costs.html - Description : Inclut des données financières et une analyse de la pression concurrentielle

- Lien :

-

Variety : Disney abandonne ses plans d'investissement d'un milliard de dollars : Rapport sur le désinvestissement de Disney

- Lien :

variety.com/2026/digital/news/openai-shutting-down-sora-video-disney-1236698277/ - Description : Contexte détaillé du retrait de la collaboration avec Disney

- Lien :

-

Site officiel de Seedance 2.0 : Présentation complète des fonctionnalités du modèle de génération vidéo de ByteDance

- Lien :

seedance2.ai - Description : Inclut des détails sur l'entrée multimodale, la sortie 2K et les fonctionnalités audio natives

- Lien :

-

Centre de documentation APIYI : Accès API unifié pour plusieurs modèles

- Lien :

docs.apiyi.com - Description : Prise en charge de l'accès tout-en-un à Claude, Nano Banana et aux modèles de génération vidéo

- Lien :

Auteur : Équipe technique APIYI

Échanges techniques : N'hésitez pas à discuter dans la section des commentaires. Pour plus d'informations, visitez le centre de documentation APIYI sur docs.apiyi.com.