作者注:DeepSeek V4 の兆パラメータ級マルチモーダルモデルのコアアーキテクチャ、性能ベンチマーク、API 価格設定、およびアクセス方法について深く解説します。開発者がこのオープンソース大規模言語モデルを迅速に評価し、使用できるよう支援します。

DeepSeek V4 がまもなくリリースされます。これは兆パラメータ級のネイティブマルチモーダルモデルであり、テキスト、画像、動画の統一生成をサポートします。本稿では、DeepSeek V4 のコアアーキテクチャの革新、性能、および API アクセス方法を迅速に解説し、開発者が事前に技術評価を行う手助けをします。

コアバリュー: DeepSeek V4 の主要な技術的ブレークスルー、GPT-5 / Claude との性能比較、そして API を介した迅速なアクセス方法を 3 分で理解できます。

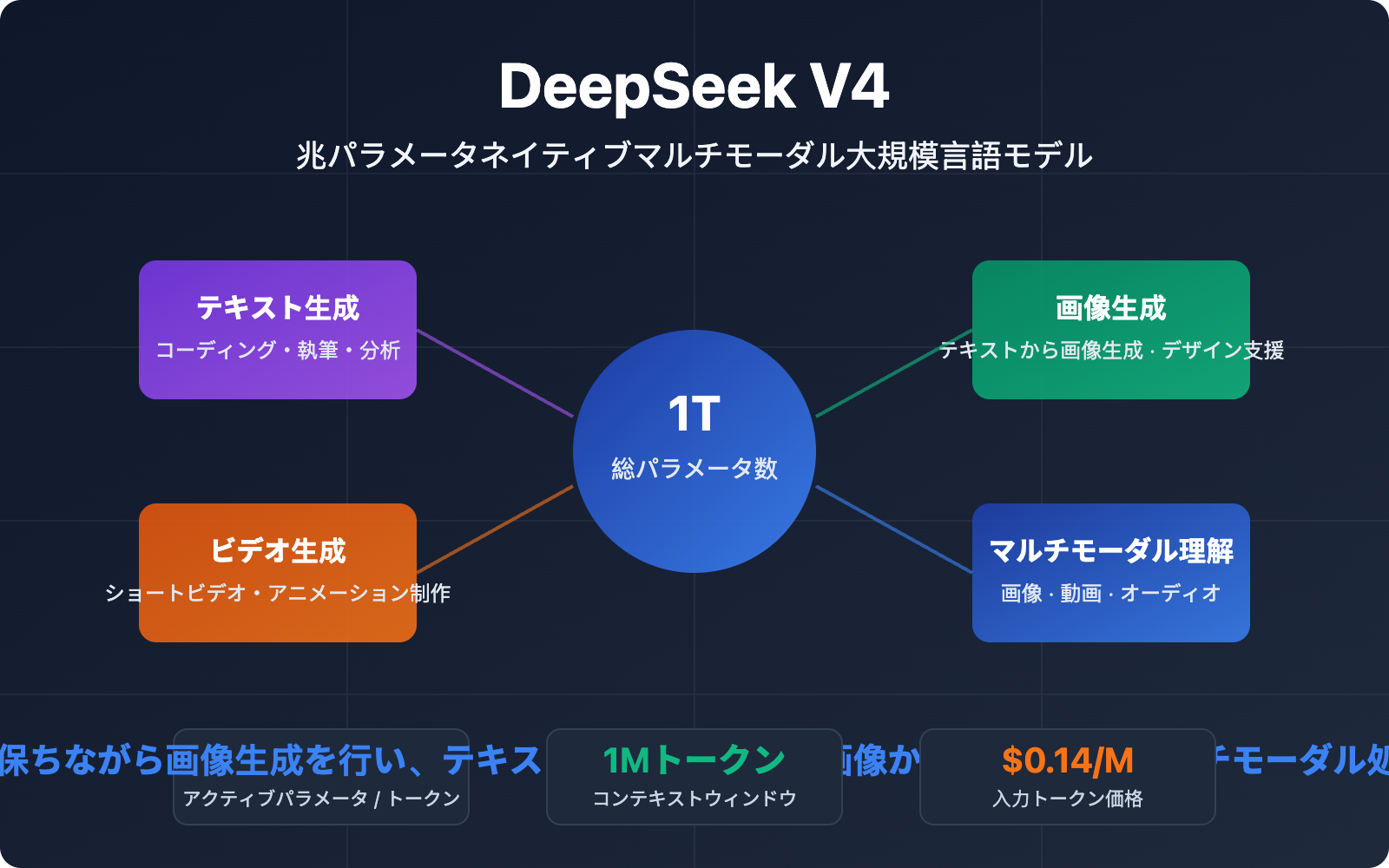

DeepSeek V4 コアパラメータと能力概要

DeepSeek V4 は DeepSeek チームが発表した次世代フラッグシップモデルで、兆パラメータの MoE(Mixture of Experts)アーキテクチャを採用し、ネイティブでマルチモーダル入出力をサポートします。以下は DeepSeek V4 のコアパラメータです:

| パラメータ指標 | DeepSeek V4 仕様 | V3 との比較 |

|---|---|---|

| 総パラメータ数 | 1 兆(1T) | 約 1.5 倍向上 |

| アクティブパラメータ | ~37B / token | MoE 効率的推論 |

| コンテキストウィンドウ | 100 万 token | 10 倍以上向上 |

| モーダルサポート | テキスト + 画像 + 動画 | 画像・動画生成を新規追加 |

| オープンソースライセンス | オープンソースライセンス | オープンソースの伝統を維持 |

DeepSeek V4 の三大アーキテクチャ革新

DeepSeek V4 は、その性能ブレークスルーの技術的基盤となる、3つの重要なアーキテクチャ革新を導入しています:

1. 多様体制約超接続(mHC): これは、高次元多様体空間内でエキスパートネットワーク間の情報伝達経路を制約することにより、MoE アーキテクチャ下でのマルチエキスパート協調推論の効率を大幅に向上させる、新しいパラメータ接続方式です。従来のスパースゲーティングメカニズムと比較して、mHC は計算効率を維持しながら、エキスパート間情報利用率を約 40% 向上させました。

2. Engram 条件付き記憶システム: 神経科学における「記憶痕跡」の概念に着想を得て、DeepSeek V4 は条件付き記憶モジュールを導入しました。このシステムは、超長文脈処理において重要な情報インデックスを動的に維持することができ、モデルが 100 万 token のコンテキストを処理する際にも、初期の内容を正確に検索・参照できるようにします。これは、大規模なコードベース分析や長文書処理に極めて重要です。

3. スパースアテンション機構のアップグレード: 標準的なアテンション機構に基づき、DeepSeek V4 は階層的スパース戦略を採用し、token 間の意味的関連性に応じてアテンション計算密度を動的に調整します。これにより、モデルはフルアテンションよりもはるかに低い計算コストで超長シーケンスを処理でき、推論コストを約 40% 削減します。

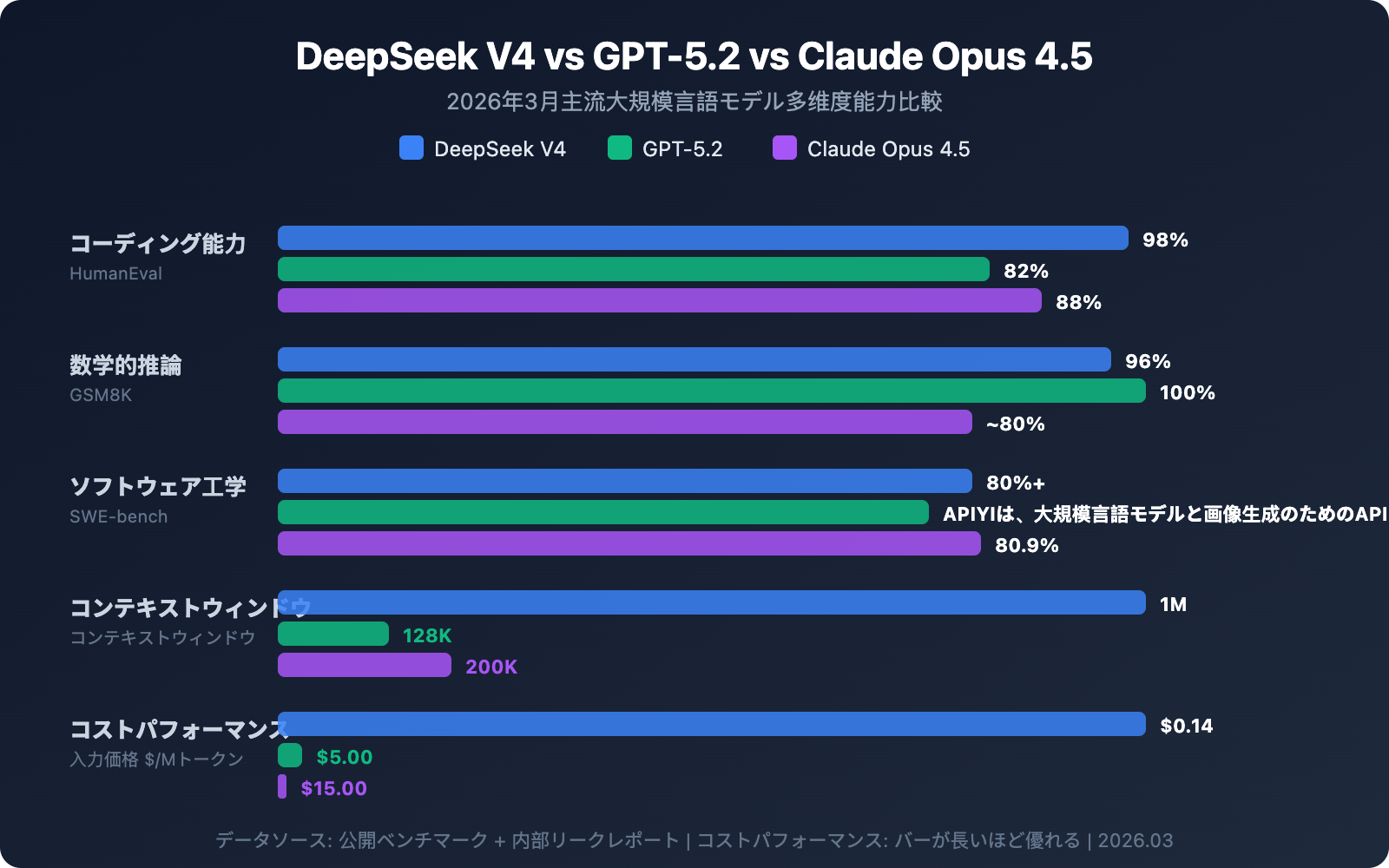

DeepSeek V4 性能ベンチマークとモデル比較

DeepSeek V4は、複数の主要ベンチマークテストで強力な競争力を示しています。以下は、DeepSeek V4と現在の主流モデルの性能比較です:

| ベンチマークテスト | DeepSeek V4 | Claude Opus 4.5 | GPT-5.2 | テスト説明 |

|---|---|---|---|---|

| HumanEval(コーディング) | 98% | 88% | 82% | コード生成精度 |

| SWE-bench Verified | 80%+ | 80.9% | ~75% | 実際のGitHub Issue解決率 |

| GSM8K(数学) | 96% | ~80% | 100% | 数学的推論能力 |

| AIME 2025 | ~85% | ~80% | 100% | 高難度数学コンテスト |

| コンテキスト長 | 100万トークン | 20万トークン | 12.8万トークン | 最大入力長 |

📊 データ説明: 上記のDeepSeek V4ベンチマークデータは内部テストとリーク報告に基づいており、独立した第三者の検証はまだ行われていません。実際のリリース後のパフォーマンスは異なる場合があります。実際の使用体験を得るためには、APIYI apiyi.comプラットフォームで実テスト比較を行うことをお勧めします。

DeepSeek V4 コーディング能力の詳細解説

DeepSeek V4は、コーディング分野でのパフォーマンスが特に際立っています。100万トークンのコンテキストウィンドウを活用することで、DeepSeek V4は単一の推論でコードリポジトリ全体を処理し、真のマルチファイル関連推論を実現できます。

具体的な利点は以下の通りです:

- リポジトリ全体の理解: プロジェクトコード全体を一度に読み込み、コンポーネント間の依存関係を理解

- クロスファイルリファクタリング: 大規模なコードリファクタリング時にグローバルな一貫性を維持

- 長いチェーンのデバッグ: 複数モジュールにまたがるバグの呼び出しチェーンを追跡

これは、複雑なソフトウェアエンジニアリングタスクを処理する際に、DeepSeek V4が単一ファイルの断片的な理解に限定されることなく、上級開発者のようにグローバルな分析を行えることを意味します。

DeepSeek V4 マルチモーダル能力の詳細解説

前世代の純粋なテキストモデルとは異なり、DeepSeek V4はネイティブマルチモーダルモデルであり、トレーニング段階からテキスト、画像、動画、音声データを同時に処理します。テキストモデルに視覚能力を「後付け」するのではありません。

DeepSeek V4 マルチモーダル能力マトリックス

| 能力次元 | サポート状況 | 典型的なアプリケーションシナリオ |

|---|---|---|

| テキスト生成 | ✅ コア能力 | コーディング、執筆、分析、翻訳 |

| 画像生成 | ✅ ネイティブサポート | テキストから画像生成、デザイン支援、チャート生成 |

| 動画生成 | ✅ ネイティブサポート | ショート動画生成、アニメーション制作 |

| 画像理解 | ✅ ネイティブサポート | 画像分析、OCR、視覚的質問応答 |

| 動画理解 | ✅ ネイティブサポート | 動画要約、コンテンツ分析 |

| 音声処理 | 🔄 確認待ち | 音声認識、音声分析 |

ネイティブマルチモーダル設計の核心的な利点は、クロスモーダル推論の一貫性にあります。例えば、ユーザーが「このコードに基づいてアーキテクチャ図を生成してください」と要求した場合、モデルはコードロジックを理解すると同時に、外部ツールチェーンに依存することなく、高品質の可視化チャートを直接出力できます。

DeepSeekはまた、生成されたすべてのメディアコンテンツに強制透かしを追加し、リアルタイムコンテンツフィルタリングシステムを備えることで、生成コンテンツの安全性とコンプライアンスを確保することを約束しています。

DeepSeek V4 API の料金体系とアクセス方法

DeepSeek V4 の API 料金は、DeepSeek が一貫して追求する高コストパフォーマンス戦略を継承しており、主要な競合製品と比較して顕著なコスト優位性があります:

| 課金項目 | DeepSeek V4 料金 | GPT-5 参考価格 | コスト優位性 |

|---|---|---|---|

| 入力トークン | $0.14 / 100万 | $5.00 / 100万 | 約 35 倍 |

| 出力トークン | $0.28 / 100万 | $15.00 / 100万 | 約 53 倍 |

| キャッシュ入力 | $0.07 / 100万 | – | キャッシュヒットでさらに 50% 節約 |

| 無料枠 | 500 万トークン | – | 新規ユーザー登録で即時付与 |

DeepSeek V4 API クイックスタート

以下は、API を通じて DeepSeek V4 を呼び出す最小限のコード例です:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1" # APIYI 統一インターフェース

)

response = client.chat.completions.create(

model="deepseek-v4",

messages=[{"role": "user", "content": "このコードのアーキテクチャ設計を分析してください"}],

max_tokens=4096

)

print(response.choices[0].message.content)

マルチモーダル呼び出し例(画像生成)を表示

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1" # APIYI 統一インターフェース

)

# テキストから画像生成の呼び出し例

response = client.images.generate(

model="deepseek-v4",

prompt="コードを書いている可愛いロボット、サイバーパンクスタイル",

size="1024x1024",

quality="hd"

)

print(response.data[0].url)

🚀 クイックスタート: DeepSeek V4 への迅速なアクセスには、APIYI apiyi.com プラットフォームの利用をお勧めします。このプラットフォームは、複雑な設定なしで即座に使用できる統一 API インターフェースを提供し、登録時に無料テスト枠が付与され、5 分以内に統合を完了できます。

DeepSeek V4 のオープンソースエコシステムと戦略的影響

DeepSeek V4 はオープンソースライセンスでの公開を計画しており、世界中の開発者がこのモデルを無料でダウンロード、微調整、デプロイできるようになります。この戦略は AI 業界の構造に深い影響を与えます:

開発者への影響:

- プライベート環境で兆パラメータ級のモデルをデプロイ可能、データプライバシーを確保

- 特定分野向けの微調整をサポート、業界専用モデルの構築が可能

- コミュニティ主導のエコシステムにより、モデル能力のイテレーションが加速

業界への影響:

- オープンソースの兆パラメータモデルにより、AI アプリケーション開発のハードルが大幅に低下

- API 価格のさらなる下落を促進、中小企業が恩恵を受ける

- マルチモーダル AI アプリケーションの普及と革新が加速

ハードウェアエコシステム:

注目すべきは、DeepSeek V4 が Huawei や寒武紀などの国産 AI チップ向けに最適化されており、NVIDIA GPU への依存を軽減している点です。これは単なる技術的な選択ではなく、現在の AI サプライチェーンの多様化のトレンドを反映しています。

💡 開発アドバイス: クラウド API 呼び出しとプライベートデプロイのどちらを選択する場合でも、まず APIYI apiyi.com プラットフォームで機能検証とパフォーマンス評価を行い、ビジネス要件を満たすことを確認してからデプロイ方法を決定することをお勧めします。

よくある質問

Q1: DeepSeek V4 はいつ正式リリースされますか?

複数の情報源によると、DeepSeek V4 は 2026 年 3 月第 1 週にリリースされる見込みです。タイミングは中国の「両会」(3 月 4 日開始)の前に選ばれています。モデルはオープンソースライセンスでリリースされ、API サービスも同時に開始されます。最新のリリース情報は DeepSeek 公式チャネルをフォローするか、APIYI apiyi.com プラットフォームを通じて、いち早く体験・接続することをお勧めします。

Q2: DeepSeek V4 の 100 万トークンコンテキストは本当に実用的ですか?

100 万トークンのコンテキストは特定のシナリオで非常に実用的です。特に、大規模なコードベース分析(プロジェクト全体を一度にロード)、長文書処理(法律契約書、技術マニュアル)、複雑な多ターン対話などで威力を発揮します。しかし、日常的な短いテキストタスクにはこれほど大きなコンテキストウィンドウは必要ありません。実際のニーズに応じて適切なパラメータ設定を選択し、APIYI apiyi.com で柔軟に呼び出しパラメータを調整してテストすることをお勧めします。

Q3: DeepSeek V4 の価格がこれほど低いのに、品質は保証されていますか?

DeepSeek の低コストは、MoE アーキテクチャ(毎回の推論で 1T 全体ではなく 37B パラメータのみを活性化)とエンジニアリングの最適化によるものであり、品質を下げて実現しているわけではありません。公開されているベンチマークテストによると、DeepSeek V4 はコーディングと数学タスクにおいて GPT-5 や Claude と同等のパフォーマンスを示しています。正式採用前には、実際のシナリオでの十分なテストを行うことをお勧めします。

まとめ

DeepSeek V4 の主な注目点:

- 1兆パラメータ MoE アーキテクチャ:1T 総パラメータ、37B 活性化パラメータにより、性能と効率の間で画期的なバランスを実現

- ネイティブマルチモーダル能力:「テキスト+視覚プラグイン」ではなく、トレーニング段階からテキスト、画像、動画を統一して処理

- 100 万トークンコンテキスト:大規模コードベース分析や長文書処理に革命的な意味を持つ

- 究極のコストパフォーマンス:API 価格は GPT-5 の 1/35 と、開発者コストを大幅に削減

- オープンソースエコシステム:オープンソースリリース戦略により、コミュニティのイノベーションと業界応用を加速

DeepSeek V4 のリリースは、オープンソース大規模言語モデルが正式に 1兆パラメータマルチモーダルの時代に入ったことを示しています。開発者にとって、これはより低い参入障壁とより豊富な技術選択肢を意味します。

DeepSeek V4 の完全な能力をいち早く体験するには、APIYI apiyi.com の利用をお勧めします。プラットフォームでは無料枠と複数モデル統一インターフェースを提供しており、迅速な比較評価が可能です。

📚 参考文献

-

TechNode レポート: DeepSeek V4 マルチモーダルモデルのリリース計画

- リンク:

technode.com/2026/03/02/deepseek-plans-v4-multimodal-model-release-this-week-sources-say/ - 説明: DeepSeek V4 のリリース時期とハードウェア連携に関する権威ある報道

- リンク:

-

DeepSeek API 公式ドキュメント: モデル価格設定とインターフェース仕様

- リンク:

api-docs.deepseek.com/quick_start/pricing - 説明: 公式 API 価格設定と技術文書、開発者必読

- リンク:

-

AI モデルベンチマーク比較: 2026年 主要大規模言語モデル性能ランキング

- リンク:

lmcouncil.ai/benchmarks - 説明: 独立した第三者ベンチマークテストプラットフォーム、客観的なモデル性能比較データを提供

- リンク:

著者: APIYI 技術チーム

技術交流: コメント欄で DeepSeek V4 の使用体験について議論を歓迎します。その他の API 接続資料は APIYI docs.apiyi.com ドキュメントセンターをご覧ください。