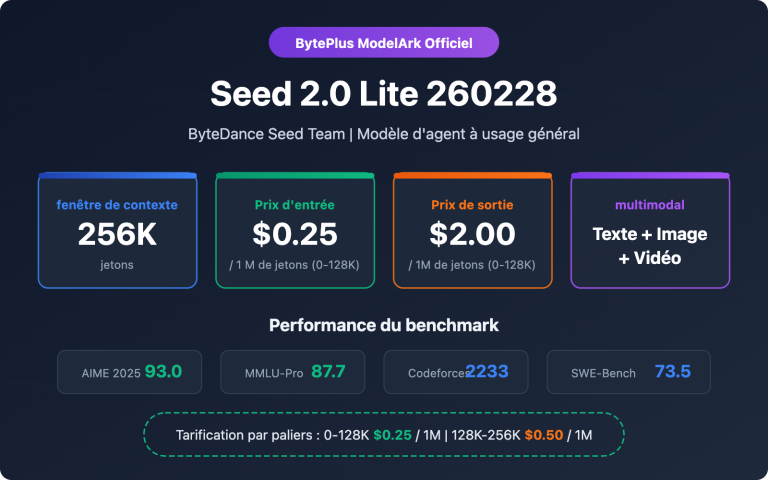

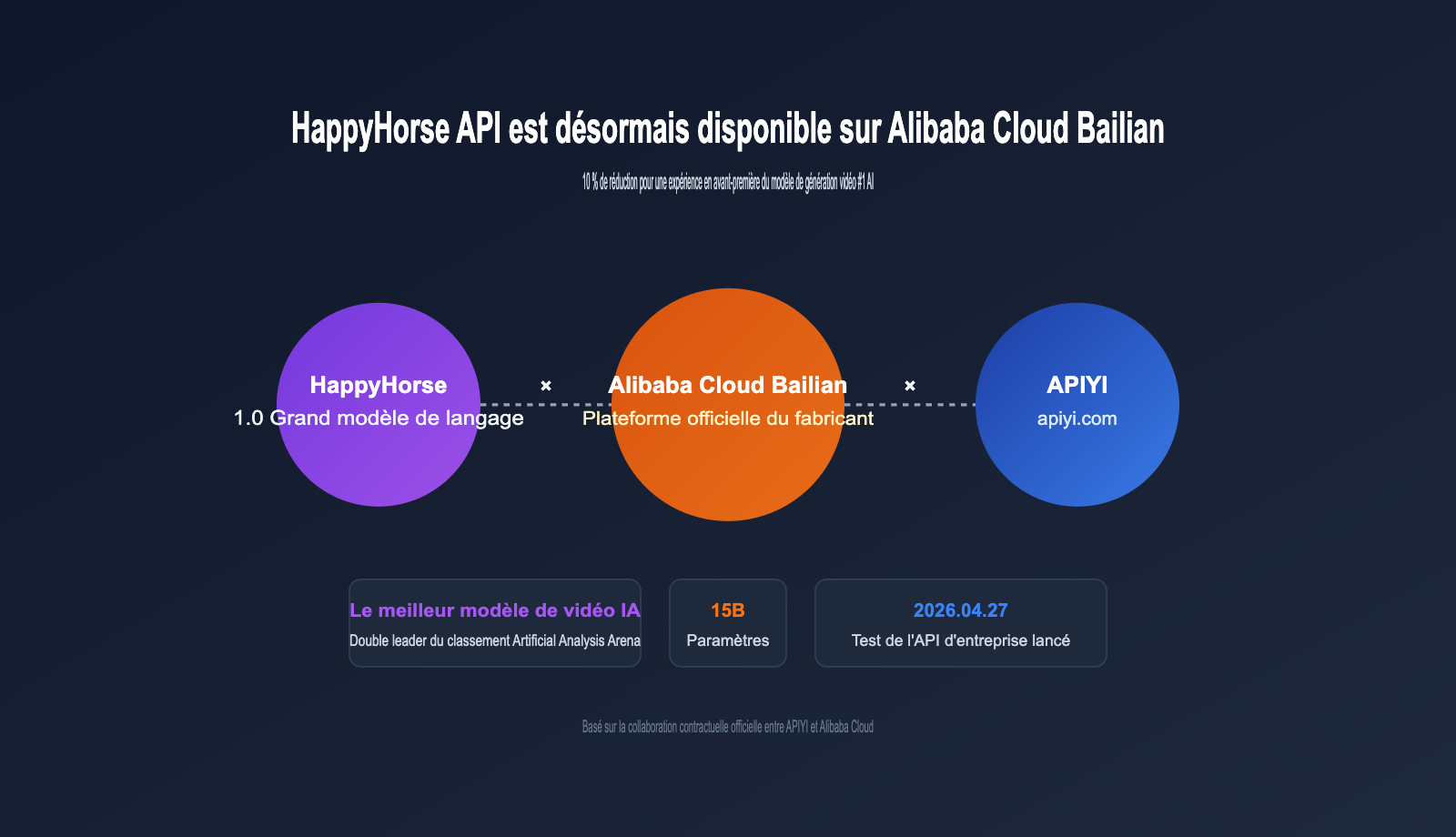

Le 27 avril 2026, Alibaba a officiellement confirmé le lancement des tests en entreprise de l'API HappyHorse sur la plateforme Alibaba Cloud Bailian. Ce modèle de génération vidéo, qui occupe la première place des classements « texte vers vidéo » et « image vers vidéo » de l'Artificial Analysis Video Arena, passe enfin du stade de test anonyme à celui de commercialisation. Grâce à son architecture multimodale unifiée de 15 milliards de paramètres, sa sortie native en 1080p HD et sa capacité de génération audio synchronisée, l'API HappyHorse est devenue l'un des modèles vidéo les plus attendus par les développeurs et les équipes de création de contenu.

En tant que partenaire officiel d'Alibaba Cloud, APIYI (apiyi.com) a signé un contrat de collaboration et travaille activement à l'intégration de l'API HappyHorse. Une fois disponible, le tarif d'invocation du modèle sur APIYI sera identique à celui du site officiel d'Alibaba Cloud Bailian. De plus, une offre promotionnelle de 10 $ offerts pour tout rechargement de 100 $ (soit environ 10 % de réduction) sera appliquée, permettant aux développeurs d'accéder à cette technologie de pointe à un coût optimisé.

Aperçu des informations clés sur l'API HappyHorse

Avant d'entrer dans les détails techniques de l'API HappyHorse, résumons les faits marquants de cette annonce dans le tableau ci-dessous. Ces informations sont basées sur des sources publiques anglophones (Alibaba Cloud, Bloomberg, CNBC, Artificial Analysis, etc.).

| Dimension | Faits clés sur l'API HappyHorse |

|---|---|

| Version du modèle | HappyHorse-1.0 |

| Équipe de développement | Division innovation ATH d'Alibaba (incluant Tongyi Lab, Alibaba Platform Tech, Taotian Tech) |

| Taille du modèle | ~15B de paramètres, 40 couches Transformer |

| Type d'architecture | Transformer multimodal unifié à flux unique (unified single-stream) |

| Capacités clés | Texte vers vidéo (T2V) / Image vers vidéo (I2V) / Synchronisation audio native |

| Format de sortie | 1080p HD natif, ~10 secondes par génération en moyenne |

| Styles visuels | 50+ (cinéma, anime, documentaire, publicité, science-fiction, etc.) |

| Longueur de l'invite | Jusqu'à 2500 caractères |

| Mode d'invocation | pro / std (standard) |

| Mode de tâche | Tâche asynchrone (POST /api/generate → GET /api/status) |

| Lancement sur Bailian | Tests API en entreprise ouverts le 27/04/2026 |

| Commercialisation | Lancement commercial officiel en mai 2026 |

| Performances | T2V (sans audio) Elo 1333, I2V (sans audio) Elo 1392, #1 mondial |

🎯 Conseils d'intégration : Si vous prévoyez de finaliser votre intégration technique avant le lancement commercial officiel en mai, nous vous recommandons de surveiller les notifications de disponibilité de l'API HappyHorse sur APIYI (apiyi.com). La plateforme s'appuie sur des contrats officiels avec Alibaba Cloud Bailian pour garantir une tarification identique à l'original, tout en permettant de tester et de basculer entre plusieurs modèles vidéo via une interface unifiée, facilitant ainsi l'évaluation de l'API HappyHorse par rapport à vos solutions actuelles.

Analyse de l'architecture technique de l'API HappyHorse

La conception multimodale unifiée de l'API HappyHorse

La différence majeure entre HappyHorse-1.0 et la génération précédente de modèles vidéo réside dans son architecture. Selon les détails du livre blanc technique révélés par des médias comme Bloomberg, Heise et TechNode, le modèle derrière l'API HappyHorse utilise une architecture Transformer à flux unique unifié (unified single-stream Transformer), intégrant les jetons vidéo et audio dans une même séquence pour un entraînement conjoint.

Cette conception entraîne trois conséquences directes :

- Synchronisation audio-visuelle native : L'audio n'est pas ajouté a posteriori, mais généré simultanément avec le visuel. Ainsi, le mouvement des lèvres, les bruits ambiants et les effets sonores correspondent naturellement à l'axe temporel physique.

- Partage sémantique transmodal : Lors de la génération, le modèle peut directement « entendre » le son qu'il s'apprête à produire, ce qui garantit une cohérence narrative entre l'image et le son.

- Chemin d'inférence unifié : Les quatre modalités (texte vers image, image vers vidéo, avec ou sans audio) suivent le même chemin d'inférence ; il suffit de basculer les paramètres lors de l'invocation du modèle.

Le Transformer de 40 couches adopte une disposition en « sandwich » : les 4 premières et dernières couches utilisent des projections spécifiques à chaque modalité, tandis que les 32 couches centrales partagent les paramètres. Cette structure permet à l'API HappyHorse de conserver les représentations uniques de chaque modalité tout en fusionnant efficacement les informations transmodales dans le tronc commun.

Modèle de tâches asynchrones de l'API HappyHorse

L'invocation de l'API HappyHorse repose sur un modèle de tâches asynchrones et non sur une réponse immédiate. Les développeurs créent d'abord une tâche via une requête POST pour obtenir un task_id, puis interrogent le statut via une requête GET (ou utilisent un mécanisme de rappel/webhook), ce qui diffère nettement des API de dialogue synchrones classiques.

Voici un exemple minimal d'utilisation de l'API HappyHorse :

import requests

import time

# Point de terminaison unifié APIYI (après mise en ligne)

API_BASE = "https://vip.apiyi.com/v1"

API_KEY = "votre_clé_API_APIYI"

headers = {

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json"

}

# 1. Création de la tâche de génération vidéo

create_payload = {

"model": "happyhorse-1.0/video",

"prompt": "Un cheval blanc courant dans un champ de blé doré, coucher de soleil, mouvement de caméra cinématographique",

"mode": "pro", # pro ou std

"duration": 5, # durée de la vidéo (secondes)

"with_audio": True # générer l'audio synchronisé ?

}

create_resp = requests.post(

f"{API_BASE}/happyhorse/generate",

headers=headers,

json=create_payload

)

task_id = create_resp.json()["task_id"]

# 2. Interrogation du statut de la tâche

while True:

status_resp = requests.get(

f"{API_BASE}/happyhorse/status/{task_id}",

headers=headers

)

status = status_resp.json()["status"]

if status in ["succeeded", "failed"]:

break

time.sleep(3)

# 3. Récupération de l'URL de la vidéo

if status == "succeeded":

video_url = status_resp.json()["output"]["video_url"]

print(f"Vidéo générée : {video_url}")

💡 Note sur le code : Dans l'exemple ci-dessus, l'URL de base utilise le point de terminaison unifié d'APIYI

https://vip.apiyi.com/v1. Grâce à nos partenariats officiels, l'API HappyHorse est entièrement compatible avec les interfaces officielles d'Alibaba Cloud Bailian. Vous pouvez utiliser la même structure de requête sans avoir à réécrire votre logique d'invocation pour différents modèles vidéo.

Tableau des paramètres clés de l'API HappyHorse

| Paramètre | Type | Requis | Description |

|---|---|---|---|

model |

string | Oui | Fixé à happyhorse-1.0/video |

prompt |

string | Oui | Description textuelle, max 2500 caractères |

mode |

string | Non | pro ou std, par défaut std |

duration |

int | Non | Durée en secondes (typiquement 3-10s) |

with_audio |

boolean | Non | Générer l'audio synchronisé, par défaut false |

image_url |

string | Non | URL de l'image de référence pour l'image vers vidéo |

style |

string | Non | Tag de style visuel (cinematic / anime / etc.) |

aspect_ratio |

string | Non | Format d'image, ex: 16:9 / 9:16 / 1:1 |

seed |

int | Non | Graine aléatoire pour la reproductibilité |

webhook_url |

string | Non | URL de rappel une fois la tâche terminée |

Analyse détaillée des 5 capacités clés de l'API HappyHorse

Capacité 1 : Texte vers vidéo (T2V) n°1 mondial

Dans les tests en aveugle de l'Artificial Analysis Video Arena, le mode texte vers vidéo (sans audio) de l'API HappyHorse a obtenu un score Elo de 1333-1357, dépassant le leader de longue date, ByteDance Seedance 2.0, d'environ 60 points. Il ne s'agit pas d'une légère avance, mais d'un véritable saut générationnel.

En termes de qualité, l'API HappyHorse excelle particulièrement dans :

- Capture de mouvements complexes : Les actions rapides comme la course, les sauts d'animaux ou les virages de véhicules ne présentent pas l'effet de « gélatine » courant dans les modèles vidéo traditionnels.

- Cohérence physique : La gravité, les fluides et les tissus suivent des lois proches de la réalité.

- Respect des invites longues : Avec une limite de 2500 caractères, les développeurs peuvent décrire des scènes avec un scénario complet, et le modèle suit ces instructions avec une précision nettement supérieure à la génération précédente.

Capacité 2 : Image vers vidéo (I2V) la plus performante

L'image vers vidéo (I2V) est la catégorie où l'API HappyHorse brille le plus, avec un score Elo de 1392. Dans les tests comparatifs entre fal.ai et WaveSpeedAI, l'API HappyHorse se distingue par :

- Préservation de l'identité : Après avoir fourni un portrait, les traits du visage, la coiffure et les vêtements sont conservés avec une grande fidélité dans la vidéo générée.

- Extension de scène cohérente : À partir d'une image statique, le modèle déduit intelligemment la structure spatiale hors champ.

- Contrôle des mouvements de caméra : Les invites permettent de spécifier des mouvements professionnels comme le zoom, le panoramique ou le travelling circulaire.

Capacité 3 : Génération audio native synchronisée

C'est la caractéristique la plus différenciante de l'API HappyHorse. Alors que les modèles classiques génèrent la vidéo puis l'audio séparément, l'API HappyHorse utilise son Transformer unifié pour placer les jetons audio et visuels dans la même séquence, générant simultanément la vidéo et l'audio en une seule inférence.

Les types d'audio pris en charge incluent :

- Dialogues (avec synchronisation labiale)

- Bruit ambiant (vent, eau, fond urbain)

- Effets sonores Foley (pas, portes, vaisselle)

- Doublage multilingue (basé sur les indications de langue dans l'invite)

Capacité 4 : Résolution native 1080p HD et génération rapide

L'API HappyHorse produit par défaut une résolution native de 1920×1080, sans nécessiter d'upscaling post-traitement. Le temps de génération moyen est d'environ 10 secondes (pour des vidéos courtes), ce qui en fait l'un des modèles les plus rapides de sa catégorie.

| Indicateur | Performance de l'API HappyHorse |

|---|---|

| Résolution par défaut | 1920×1080 (1080p HD) |

| Fréquence d'images | 24 / 30 fps au choix |

| Temps (vidéo 3s) | ~10 secondes |

| Temps (vidéo 5s) | ~25 secondes |

| Temps (vidéo 10s) | ~60 secondes |

| Échantillonnage audio | 48 kHz généré en synchronisation |

Capacité 5 : Plus de 50 styles visuels prédéfinis

L'API HappyHorse intègre plus de 50 styles visuels prédéfinis, couvrant le cinéma, l'animation, le documentaire, la publicité, la mode, la science-fiction et le film rétro. Il suffit d'ajouter des mots-clés de style dans l'invite ou de spécifier le paramètre style pour obtenir l'esthétique souhaitée.

🎯 Conseil d'utilisation : Pour la création de contenu commercial, nous vous recommandons de comparer les performances des différents styles sur la plateforme APIYI (apiyi.com). La plateforme permet d'utiliser un seul compte pour appeler l'API HappyHorse et d'autres modèles vidéo, facilitant ainsi vos évaluations comparatives avant de passer à une production à grande échelle.

Comparaison de l'API HappyHorse avec les principaux modèles vidéo

Pour aider les développeurs à mieux comprendre le paysage actuel, nous avons compilé une comparaison des dimensions clés de l'API HappyHorse par rapport aux modèles de génération vidéo dominants. Les données proviennent d'Artificial Analysis, fal.ai, WaveSpeedAI et de la documentation officielle de chaque modèle.

Comparaison : API HappyHorse vs ByteDance Seedance 2.0

| Dimension de comparaison | API HappyHorse | ByteDance Seedance 2.0 |

|---|---|---|

| Elo T2V (Artificial Analysis) | 1333-1357 (#1) | env. 1273 (#2) |

| Elo I2V (Artificial Analysis) | 1392 (#1) | env. 1331 (#2) |

| Génération audio native | ✅ Sortie simultanée | ❌ Synthèse secondaire requise |

| Résolution par défaut | 1080p HD | 1080p HD |

| Limite de caractères (invite) | 2500 caractères | 1800 caractères |

| Préréglages de style | 50+ | 30+ |

| État commercial | Commercialisé (mai 2026) | Déjà commercialisé |

Comparaison : API HappyHorse vs OpenAI Sora 2

| Dimension de comparaison | API HappyHorse | OpenAI Sora 2 |

|---|---|---|

| Cohérence physique | Forte (Transformer unifié) | Forte (Architecture DiT) |

| Synchronisation audio-vidéo | ✅ Inférence native unique | ⚠️ Génération séparée requise |

| Limite de durée vidéo | ~10 secondes | Jusqu'à 60 secondes |

| Suivi des invites en chinois | Excellent (entraînement natif) | Moyen (principalement anglais) |

| Accès depuis la Chine | ✅ Connexion directe (Alibaba) | ❌ Ligne internationale requise |

| Transparence des prix | Élevée (tarification publique) | Moyenne (par abonnement) |

Comparaison : API HappyHorse vs Google Veo 3.1

| Dimension de comparaison | API HappyHorse | Google Veo 3.1 |

|---|---|---|

| Elo Texte vers image | 1333+ (#1) | env. 1290 |

| Sortie 4K | Non supporté | ✅ Supporté |

| Narration multi-plans | Principalement plan unique | ✅ Supporte les changements de plan |

| Cohérence des personnages | Forte | Moyenne |

| Disponibilité écosystème | Alibaba Bailian | Écosystème Google Cloud |

| Rapport qualité-prix | Élevé (avantage accès local) | Moyen (accès international requis) |

💡 Conseil de sélection : Chaque modèle vidéo a ses forces (physique, durée, 4K, montage). Nous vous recommandons d'utiliser APIYI (apiyi.com) pour tester et comparer l'API HappyHorse, Sora et Veo via une interface unique. Grâce à notre partenariat officiel avec Alibaba, les tarifs de l'API HappyHorse sont alignés sur ceux de Bailian, garantissant une maîtrise totale de vos coûts.

Accès à l'API HappyHorse : Alibaba Bailian vs APIYI

Accès direct via Alibaba Bailian

Alibaba Bailian est la plateforme officielle de l'API HappyHorse. Depuis le 27 avril 2026, Bailian a ouvert les tests API pour les entreprises, avec une commercialisation complète depuis mai. L'accès direct est idéal si :

- Votre entreprise est déjà déployée dans l'écosystème Alibaba Cloud.

- Vous avez des besoins stricts en matière de conformité et de localisation des données en Chine.

- Votre équipe possède déjà un compte entreprise Alibaba Cloud.

Accès via APIYI

APIYI (apiyi.com) a signé un contrat de partenariat officiel avec Alibaba pour intégrer l'API HappyHorse. Une fois disponible, les tarifs d'appel de l'API HappyHorse sur APIYI seront identiques à ceux d'Alibaba Bailian, avec en prime des avantages sur les recharges. C'est la solution idéale si :

- Vous souhaitez appeler plusieurs modèles (HappyHorse, Sora, Veo, Runway) via une interface unifiée.

- Vous êtes un développeur indépendant ou une petite équipe cherchant à simplifier la gestion des comptes.

- Vous recherchez des bonus de recharge.

- Vous avez besoin d'une facturation en dollars, de factures internationales ou d'un support client multicanal.

Comparaison complète des deux chemins d'accès

| Dimension | Accès direct Alibaba Bailian | Accès unifié APIYI |

|---|---|---|

| Prix de l'API HappyHorse | Prix officiel | Identique à Bailian |

| Promotions de recharge | Offres Alibaba | 100 $ + 10 $ offerts (env. -10%) |

| Difficulté d'accès | Moyenne (qualifications requises) | Faible (particuliers/entreprises) |

| Variété de modèles | Principalement Alibaba | HappyHorse, Sora, Veo, Runway, etc. |

| Support client | Tickets principalement | WeChat 7×24 / Tickets |

| Public cible | Utilisateurs intensifs Alibaba | Développeurs multi-plateformes |

| Compatibilité API | Native Alibaba | Compatible OpenAI + Native Alibaba |

| Facturation | RMB / Packs de crédit | Recharge en USD, remise de 10% |

🎯 Conseil de choix : Si vous êtes déjà un utilisateur intensif d'Alibaba, l'accès direct est naturel. Si vous avez besoin de flexibilité entre plusieurs modèles ou souhaitez bénéficier de remises, nous vous conseillons de suivre le lancement sur APIYI (apiyi.com). Notre plateforme, basée sur un contrat officiel, vous offre les mêmes tarifs que Bailian avec, en plus, une remise de 10% sur vos recharges.

Campagne de recharge et stratégie tarifaire de l'API HappyHorse

Estimation des coûts de l'API HappyHorse sur APIYI

Bien que le prix unitaire spécifique de l'API HappyHorse soit basé sur les tarifs officiels d'Alibaba Cloud Bailian, le mécanisme de recharge d'APIYI vous permet de réduire vos coûts unitaires réels d'environ 10 %. Prenons l'exemple d'une recharge de 100 USD :

| Élément | Montant |

|---|---|

| Recharge réelle | 100 USD |

| Bonus de la plateforme | 10 USD |

| Solde réel du compte | 110 USD |

| Remise équivalente | Environ 10 % (taux de paiement effectif de 90,9 %) |

| Limite de recharge | Aucune limite par transaction, cumulable |

Exemple concret : si le coût de génération unitaire de l'API HappyHorse en mode standard (std) sur Bailian est de 0,10 USD, avec une recharge de 100 USD sur APIYI :

- Coût via connexion directe Bailian : 100 USD ÷ 0,10 = environ 1 000 générations

- Coût via recharge APIYI : 110 USD ÷ 0,10 = environ 1 100 générations

La différence équivaut à 100 générations gratuites supplémentaires. Pour les équipes de création de contenu de taille moyenne, cela permet de réduire significativement le coût marginal de production vidéo dès le premier mois.

Structure des coûts prévisionnels par mode d'appel de l'API HappyHorse

| Mode d'appel | Scénarios d'utilisation | Coût relatif | Usage recommandé |

|---|---|---|---|

| std (Standard) | Tests internes, prototypage | Faible | Génération de contenu en masse |

| pro (Professionnel) | Contenu commercial, produit fini | Élevé | Plans clés, livrables clients |

| Avec audio | Produits audiovisuels complets | Légèrement supérieur au pro | Vidéos courtes, publicités |

| Sans audio | Post-production sonore indépendante | Le plus bas | Création de bibliothèques visuelles |

💡 Conseil de contrôle des coûts : Nous recommandons d'utiliser le mode "std" sans audio lors de la phase de prototypage pour générer de nombreux brouillons, puis de passer au mode "pro" avec audio pour la version finale. Cette stratégie d'appel par paliers est particulièrement facile à mettre en œuvre sur la plateforme APIYI (apiyi.com), qui permet de basculer entre les différents modes de l'API HappyHorse avec une seule clé API, tout en profitant de la remise de 10 % sur les recharges pour compresser davantage les coûts unitaires.

Cas d'utilisation typiques de l'API HappyHorse

Application 1 : Production de vidéos courtes

Les vidéos courtes sont le terrain de prédilection de l'API HappyHorse. Avec un temps de génération moyen de 10 secondes, un support audio natif et plus de 50 styles prédéfinis, il devient possible de produire des centaines de vidéos courtes par jour.

Flux de travail typique :

- Découpage du script en plans de 5 à 10 secondes.

- Génération de chaque plan via l'API HappyHorse (texte vers vidéo).

- Assemblage, montage simple et ajout de sous-titres.

Application 2 : Vidéos de produits e-commerce

L'image vers vidéo (I2V) est extrêmement précieuse dans le secteur de l'e-commerce. Le marchand télécharge une image principale du produit, et l'API HappyHorse génère automatiquement une vidéo de présentation, sans avoir besoin de refaire un shooting.

ecommerce_payload = {

"model": "happyhorse-1.0/video",

"image_url": "https://cdn.example.com/product.jpg",

"prompt": "Présentation du produit à 360 degrés, lumière douce en intérieur, style e-commerce",

"mode": "pro",

"duration": 5,

"style": "commercial",

"aspect_ratio": "1:1"

}

Application 3 : Supports publicitaires et marketing

Les publicités commerciales exigent une grande qualité d'image et une cohérence de marque. La combinaison du mode "pro" et du style prédéfini "cinematic" permet à l'API HappyHorse de délivrer un rendu cinématographique optimal.

Application 4 : Vidéos éducatives et de formation

Le contenu éducatif nécessite une précision dans l'explication des concepts. La limite de 2 500 caractères pour l'invite de l'API HappyHorse est idéale pour décrire des scénarios pédagogiques complets à partir d'un script détaillé.

Application 5 : Prévisualisation de jeux vidéo et de films

Lors de la pré-production cinématographique, les réalisateurs ont souvent besoin de prévisualiser leurs scripts avec des images dynamiques. La cohérence physique et le contrôle des mouvements de caméra de l'API HappyHorse en font une alternative économique pour la réalisation de storyboards animés.

FAQ sur l'intégration de l'API HappyHorse

Q1 : Quand l'API HappyHorse sera-t-elle officiellement disponible pour un usage commercial ?

Selon les annonces officielles d'Alibaba Cloud, l'API HappyHorse a débuté ses tests en entreprise le 27 avril 2026, avec une entrée en phase commerciale prévue pour mai. APIYI travaille actuellement sur la finalisation de son contrat de partenariat officiel avec Alibaba Cloud. La date de lancement sera synchronisée avec le calendrier commercial d'Alibaba Cloud. Pour les détails, veuillez surveiller les annonces sur APIYI (apiyi.com).

Q2 : Le prix de l'API HappyHorse sur APIYI sera-t-il plus élevé que sur Alibaba Cloud Bailian ?

Non. Grâce à notre partenariat officiel avec Alibaba Cloud, les tarifs de l'API HappyHorse sur APIYI seront identiques à ceux pratiqués sur le site officiel d'Alibaba Cloud Bailian. De plus, APIYI propose une offre de recharge (10 $ offerts pour 100 $ crédités), ce qui équivaut à une réduction d'environ 10 % par rapport au tarif officiel, rendant le coût réel plus avantageux qu'une connexion directe à Bailian.

Q3 : L'API HappyHorse prend-elle en charge les invites en chinois ?

Absolument. HappyHorse a été développé sous la direction du département d'innovation ATH d'Alibaba, avec une équipe centrale incluant le laboratoire Tongyi. Le modèle a été entraîné en profondeur sur des corpus chinois ; sa compréhension sémantique et sa capacité de restitution de scènes pour les invites en chinois sont nettement supérieures à celles des concurrents internationaux axés sur l'anglais.

Q4 : Quelle est la durée maximale des vidéos générées par l'API HappyHorse ?

Durant la phase de test, la durée des vidéos est limitée à 10 secondes par tâche, conformément aux échantillons de test observés sur Artificial Analysis. Pour une éventuelle extension de la durée après la commercialisation, veuillez vous référer aux futures annonces d'Alibaba Cloud Bailian. Pour des vidéos longues avec plusieurs plans, vous pouvez utiliser la génération segmentée suivie d'un montage.

Q5 : Entre HappyHorse, Sora et Veo, lequel choisir ?

Si vous ciblez principalement le marché chinois, que vous privilégiez la synchronisation native audio-vidéo et que vous êtes attentif à la transparence des coûts, l'API HappyHorse est actuellement le meilleur choix. Si vous avez besoin de vidéos longues (60 secondes) ou d'une sortie native en 4K, envisagez plutôt Sora ou Veo. Nous vous recommandons d'effectuer des tests comparatifs via l'interface unifiée d'APIYI (apiyi.com). La plateforme prend en charge HappyHorse, Sora et Veo, garantissant des prix officiels grâce à nos contrats de partenariat et facilitant le contrôle des coûts lors de vos évaluations.

Q6 : L'API HappyHorse prend-elle en charge les notifications de rappel (webhook) pour éviter le polling ?

Oui. L'API HappyHorse propose un mécanisme de rappel webhook. Lors de la création d'une tâche, vous pouvez spécifier une URL de rappel via le paramètre webhook_url. Une fois la tâche terminée, l'API enverra une notification POST, évitant ainsi les surcoûts liés au polling.

Q7 : Quelles sont les limites de débit de l'API HappyHorse ?

Durant la phase de test, les limites de débit suivent les annonces d'Alibaba Cloud Bailian, généralement mesurées en RPM (requêtes par minute) et TPM (tâches par minute). Une fois l'API HappyHorse lancée sur APIYI, nous appliquerons les mêmes limites officielles que Bailian, avec la possibilité pour les entreprises de demander une augmentation de quota.

Q8 : Les vidéos générées par l'API HappyHorse peuvent-elles être utilisées commercialement ?

Durant la phase de test, le service est prioritairement destiné aux entreprises ; les conditions d'utilisation commerciale dépendent de l'accord utilisateur d'Alibaba Cloud Bailian. En règle générale, le client possède les droits d'exploitation commerciale du contenu généré via l'API payante, mais nous vous conseillons de confirmer les clauses spécifiques avec notre support client avant toute signature.

Feuille de route et recommandations pour l'intégration de l'API HappyHorse

Pour les développeurs et les équipes souhaitant adopter l'API HappyHorse dès que possible, voici nos recommandations par étapes :

Phase 1 : Observation (27/04/2026 – 05/2026)

- Suivez les annonces officielles d'Alibaba Cloud Bailian pour les retours sur les tests de l'API HappyHorse.

- Consultez les études de cas sur les communautés anglophones (Artificial Analysis, fal.ai, WaveSpeedAI).

- Préparez vos modèles d'invites et vos bibliothèques de ressources en attendant l'ouverture commerciale.

Phase 2 : Intégration (Mai 2026, premier mois commercial)

- Pour les utilisateurs de l'écosystème Alibaba, utilisez la connexion directe à Bailian pour une validation rapide.

- Pour les besoins de comparaison multi-modèles, surveillez l'annonce de lancement de l'API HappyHorse sur APIYI (apiyi.com).

- Réalisez un premier PoC pour valider les performances réelles de l'API HappyHorse dans votre environnement métier.

Phase 3 : Mise à l'échelle (à partir de juin 2026)

- Établissez une base de coûts sur la plateforme APIYI avec l'offre de recharge (100 $ + 10 $ offerts).

- Utilisez le mode "std" pour le volume et le mode "pro" pour la livraison afin d'optimiser vos coûts.

- Intégrez l'API HappyHorse en profondeur dans vos pipelines de production vidéo existants.

🎯 Recommandation globale : L'API HappyHorse est l'une des sorties les plus prometteuses de 2026 dans le domaine des modèles vidéo. Nous conseillons aux équipes techniques de finaliser leur PoC rapidement et aux équipes de contenu de constituer des bibliothèques de styles et d'invites. Sur la plateforme APIYI (apiyi.com), vous pouvez optimiser vos coûts grâce à notre remise de 10 % sur les recharges. Notre partenariat officiel avec Alibaba Cloud garantit une tarification identique à celle de Bailian et vous permet de réaliser des tests comparatifs avec d'autres modèles vidéo majeurs.

Résumé du lancement de l'API HappyHorse

Le lancement de l'API HappyHorse marque une étape charnière, faisant passer les modèles de génération vidéo de la simple « concaténation multimodale » à une véritable « génération multimodale unifiée ». Avec ses 15 milliards de paramètres, son architecture Transformer unifiée à 40 couches, sa synchronisation native audio-vidéo et sa première place au classement Artificial Analysis, l'API HappyHorse s'impose comme un acteur extrêmement compétitif sur le marché des modèles vidéo en 2026.

En tant que plateforme source, Alibaba Cloud Bailian a ouvert les tests aux entreprises le 27 avril, avec une mise en service commerciale prévue pour mai. APIYI (apiyi.com), grâce à un partenariat officiel avec Alibaba Cloud, travaille activement à l'intégration de l'API HappyHorse. Une fois en ligne, la tarification sera identique à celle du site officiel de Bailian, et cumulable avec notre offre promotionnelle (10 $ offerts pour 100 $ de crédit), soit une remise effective de 10 %. C'est la solution idéale pour les développeurs indépendants et les équipes de création de contenu multiplateformes.

Pour ceux qui souhaitent adopter l'API HappyHorse dès sa sortie, voici nos recommandations :

- Créez dès maintenant votre compte sur APIYI (apiyi.com) et surveillez l'annonce de mise en ligne de l'API HappyHorse.

- Préparez vos modèles d'invite et vos supports de test en attendant l'ouverture de l'accès.

- Profitez de l'offre de bonus sur recharge pour optimiser les coûts de votre PoC et de votre production à grande échelle.

La nouvelle course à la génération vidéo est lancée. Choisir le bon point d'accès, c'est garantir une structure de coûts optimale pour votre production de contenu vidéo au cours des six prochains mois.

Auteur : Équipe technique d'APIYI

Dernière mise à jour : 27/04/2026

Contact : Consultez le site officiel d'APIYI (apiyi.com) pour suivre l'état d'avancement de l'intégration de l'API HappyHorse et découvrir les dernières offres de recharge.