title: "Análisis de GPT-5.4-mini y GPT-5.4-nano: Especificaciones, precios y rendimiento"

description: "Descubre los nuevos modelos ligeros de OpenAI: GPT-5.4-mini y GPT-5.4-nano. Analizamos su rendimiento, precios competitivos y cómo integrarlos vía API."

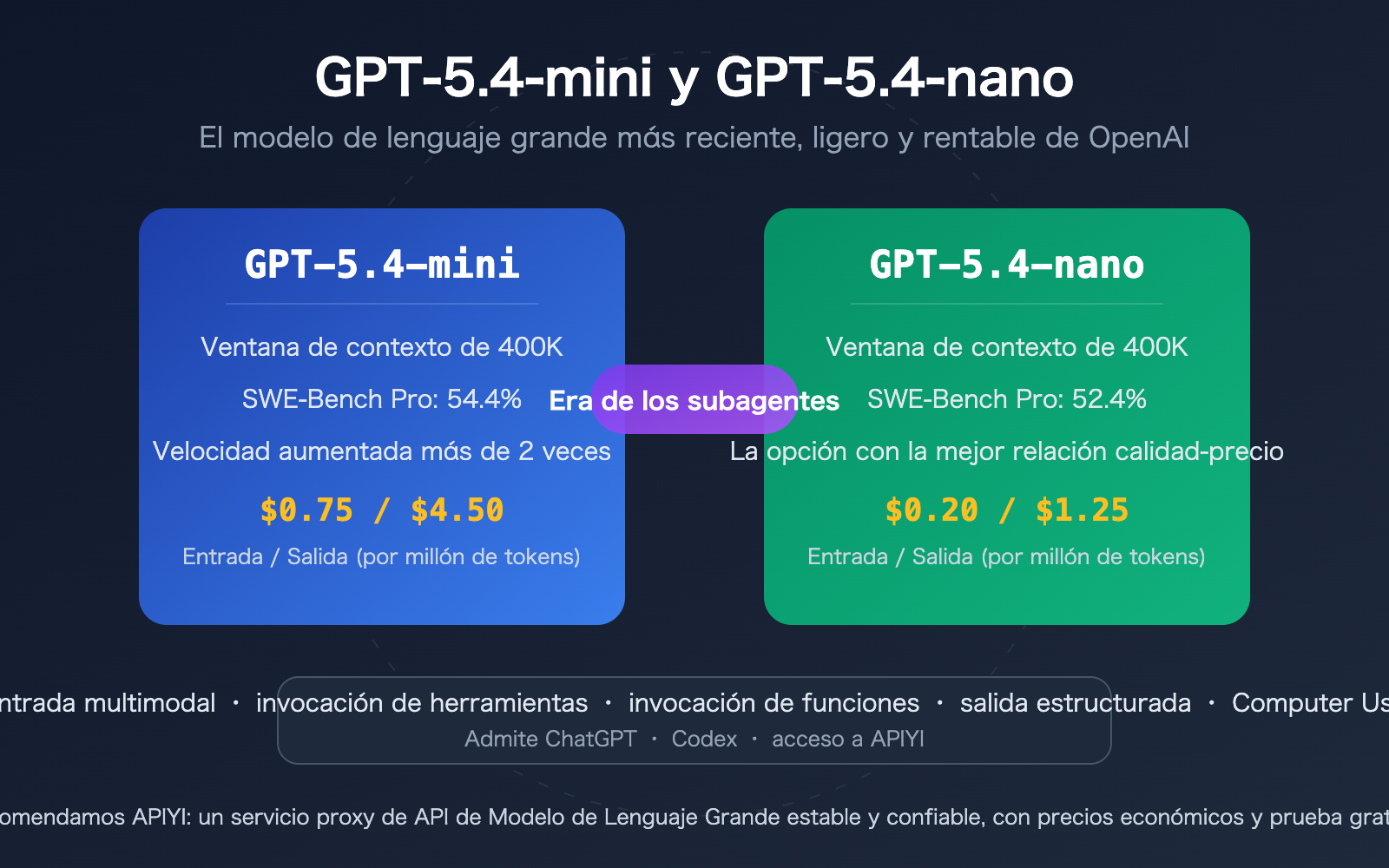

Nota del autor: GPT-5.4-mini y GPT-5.4-nano son los modelos ligeros más recientes lanzados por OpenAI, con una velocidad 2 veces mayor y precios desde $0.20 por millón de tokens. En este artículo detallamos sus especificaciones, precios, pruebas de rendimiento (benchmarks) y cómo acceder a su API.

OpenAI lanzó oficialmente los modelos ligeros GPT-5.4-mini y GPT-5.4-nano el 17 de marzo de 2026. GPT-5.4-mini supera al GPT-5 mini en codificación, razonamiento, comprensión multimodal y llamadas a herramientas, con una velocidad más de 2 veces superior. Por su parte, GPT-5.4-nano se posiciona como el modelo más económico de la serie GPT-5.4, con un precio de $0.20 por millón de tokens de entrada.

Valor principal: Conoce en 3 minutos las especificaciones clave, el rendimiento y los métodos de acceso de GPT-5.4-mini y GPT-5.4-nano para encontrar la solución ligera que mejor se adapte a tus necesidades de negocio.

Especificaciones clave de GPT-5.4-mini y GPT-5.4-nano

| Especificación | GPT-5.4-mini | GPT-5.4-nano | GPT-5.4 (Flagship) |

|---|---|---|---|

| Ventana de contexto | 400K Token | 400K Token | 400K Token |

| Precio de entrada | $0.75/millón de tokens | $0.20/millón de tokens | Más alto |

| Precio de salida | $4.50/millón de tokens | $1.25/millón de tokens | Más alto |

| Entrada multimodal | Texto + Imagen | Texto + Imagen | Texto + Imagen |

| Llamada a herramientas | Compatible | Compatible | Compatible |

| Canales disponibles | ChatGPT + Codex + API | Solo API | ChatGPT + Codex + API |

Análisis detallado de las capacidades de GPT-5.4-mini

GPT-5.4-mini es la versión ligera de la serie GPT-5.4 con un rendimiento más cercano al modelo insignia. En el benchmark de codificación SWE-Bench Pro, obtuvo un 54.4%, acercándose al 57.7% de la versión insignia; en el benchmark de operación informática OSWorld-Verified alcanzó un 72.1% (frente al 75.0% de la versión insignia); y en la prueba de razonamiento científico de nivel de posgrado GPQA Diamond, obtuvo un 88.0% (frente al 93.0% de la versión insignia). Esto significa que GPT-5.4-mini puede ofrecer una experiencia casi de nivel insignia en la gran mayoría de los escenarios, siendo además más de 2 veces más rápido.

En ChatGPT, GPT-5.4-mini está disponible para usuarios gratuitos y usuarios de Go a través de la función "Thinking". A nivel de API, admite un conjunto completo de capacidades que incluyen entrada de texto e imagen, llamadas a herramientas, llamadas a funciones, búsqueda web, búsqueda de archivos, uso de computadora (Computer Use) y Skills.

Análisis de la rentabilidad extrema de GPT-5.4-nano

GPT-5.4-nano está diseñado específicamente para escenarios sensibles a la velocidad y al costo. Con un precio de entrada de solo $0.20 por millón de tokens y un precio de salida de $1.25 por millón de tokens, es la opción más económica de la serie GPT-5.4. Simon Willison descubrió en sus pruebas que usar GPT-5.4-nano para describir 76,000 imágenes costaba solo $52. GPT-5.4-nano se ofrece exclusivamente a través de API y se recomienda especialmente para tareas automatizadas de alta frecuencia y baja complejidad, como clasificación, extracción de datos, ordenamiento y subagentes de codificación.

🎯 Sugerencia de integración: Tanto GPT-5.4-mini como GPT-5.4-nano ya están disponibles en la plataforma APIYI (apiyi.com). Los precios son iguales a los del sitio oficial de OpenAI, con recargas de API oficial desde un 10% de descuento, lo que facilita a los usuarios locales una integración y prueba rápidas.

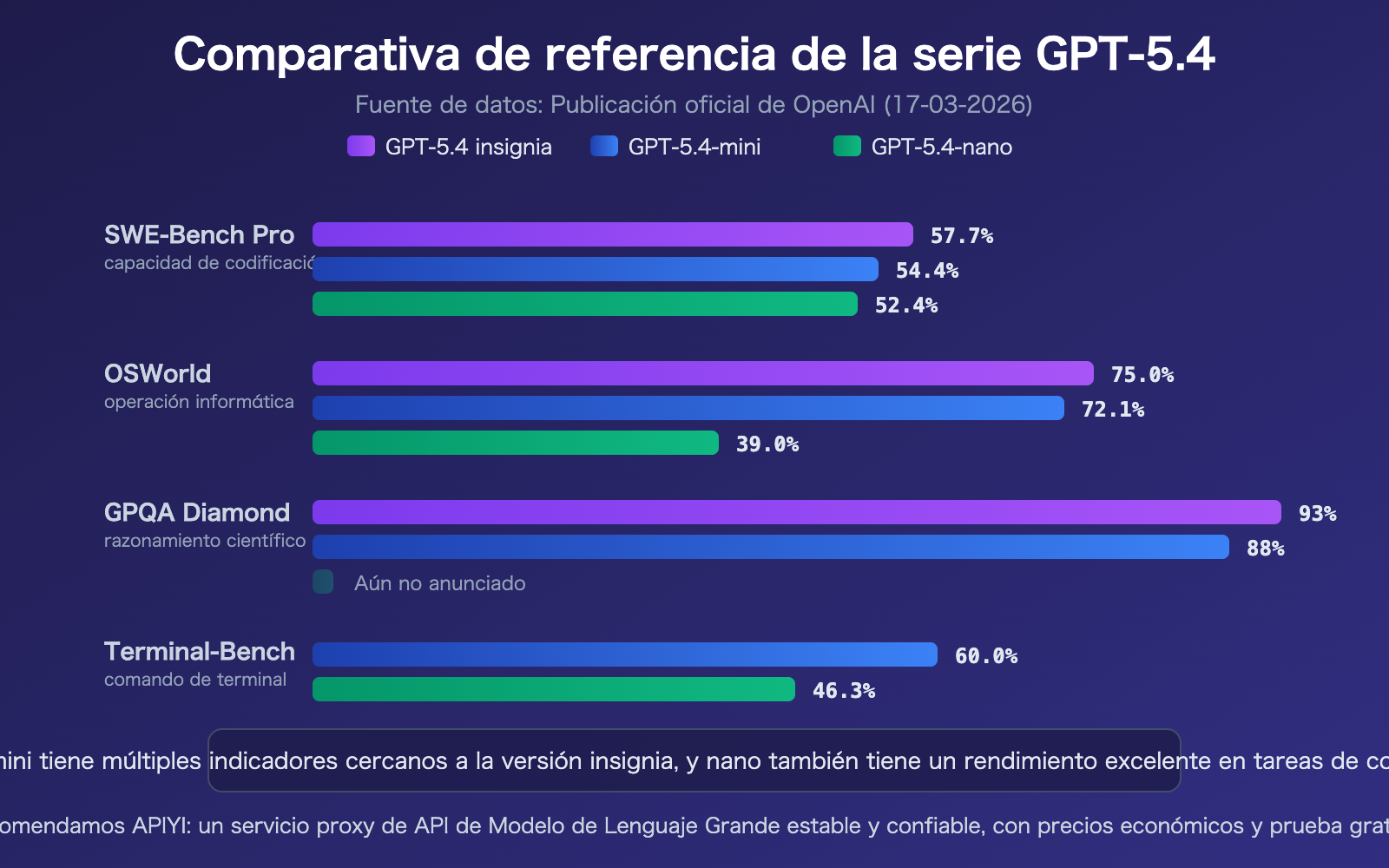

Comparativa de benchmarks: GPT-5.4-mini y GPT-5.4-nano

| Benchmark | GPT-5.4 Insignia | GPT-5.4-mini | GPT-5.4-nano | Notas |

|---|---|---|---|---|

| SWE-Bench Pro | 57.7% | 54.4% | 52.4% | Capacidad de codificación real |

| OSWorld-Verified | 75.0% | 72.1% | 39.0% | Operación informática |

| GPQA Diamond | 93.0% | 88.0% | — | Razonamiento nivel posgrado |

| Terminal-Bench 2.0 | — | 60.0% | 46.3% | Comandos de terminal |

El rendimiento de GPT-5.4-mini en SWE-Bench Pro (54.4%) supone una mejora de casi 10 puntos porcentuales respecto al GPT-5 mini (45.7%), acercándose al nivel del modelo insignia. GPT-5.4-nano también alcanzó un 52.4%, superando al modelo mini de la generación anterior. Cabe destacar que GPT-5.4-mini sobresale especialmente en escenarios de "Computer Use" (OSWorld 72.1%), siendo capaz de interpretar rápidamente capturas de pantalla densas de interfaces de usuario para completar tareas.

Análisis de precios y costes de GPT-5.4-mini y GPT-5.4-nano

| Modelo | Precio de entrada | Precio de salida | Estimación por 10k diálogos | Casos de uso |

|---|---|---|---|---|

| GPT-5.4-nano | $0.20/M | $1.25/M | ~$2-5 | Clasificación, extracción, sub-agentes |

| GPT-5.4-mini | $0.75/M | $4.50/M | ~$8-15 | Conversación general, código, razonamiento |

| GPT-5.4 Insignia | Más alto | Más alto | ~$30+ | Razonamiento complejo, investigación |

OpenAI aplica automáticamente el almacenamiento en caché de indicaciones (Prompt Caching) para instrucciones del sistema y documentos extensos enviados repetidamente, lo que reduce aún más los costes operativos. En escenarios de alta frecuencia, el coste de entrada tras un acierto de caché puede disminuir significativamente.

🎯 Consejo de optimización de costes: Accede a GPT-5.4-mini y GPT-5.4-nano a través de la plataforma APIYI (apiyi.com), donde puedes obtener descuentos desde el 10% en recargas de API. Para desarrolladores con un gran volumen de llamadas, combinar el uso de Prompt Caching con las ofertas de la plataforma permite optimizar los costes al máximo.

Primeros pasos con GPT-5.4-mini y GPT-5.4-nano

Ejemplo minimalista

Aquí tienes la forma más sencilla de empezar; con solo 10 líneas de código puedes invocar a GPT-5.4-mini:

import openai

client = openai.OpenAI(

api_key="TU_CLAVE_API",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.4-mini",

messages=[{"role": "user", "content": "Explica en una frase qué es una arquitectura de subagentes"}]

)

print(response.choices[0].message.content)

Ver ejemplo de invocación de GPT-5.4-nano

import openai

client = openai.OpenAI(

api_key="TU_CLAVE_API",

base_url="https://vip.apiyi.com/v1"

)

# GPT-5.4-nano es ideal para tareas de clasificación y extracción de datos

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": "Eres un clasificador de texto, devuelve el resultado en formato JSON"},

{"role": "user", "content": "Clasifica el siguiente comentario como positivo/neutro/negativo: El producto está bien, pero el envío es un poco lento"}

],

response_format={"type": "json_object"}

)

print(response.choices[0].message.content)

Sugerencia: Obtén tu clave API a través de APIYI (apiyi.com) para probar rápidamente GPT-5.4-mini y GPT-5.4-nano. La plataforma admite la invocación unificada de toda la serie de modelos de OpenAI, sin necesidad de cambiar la

base_url.

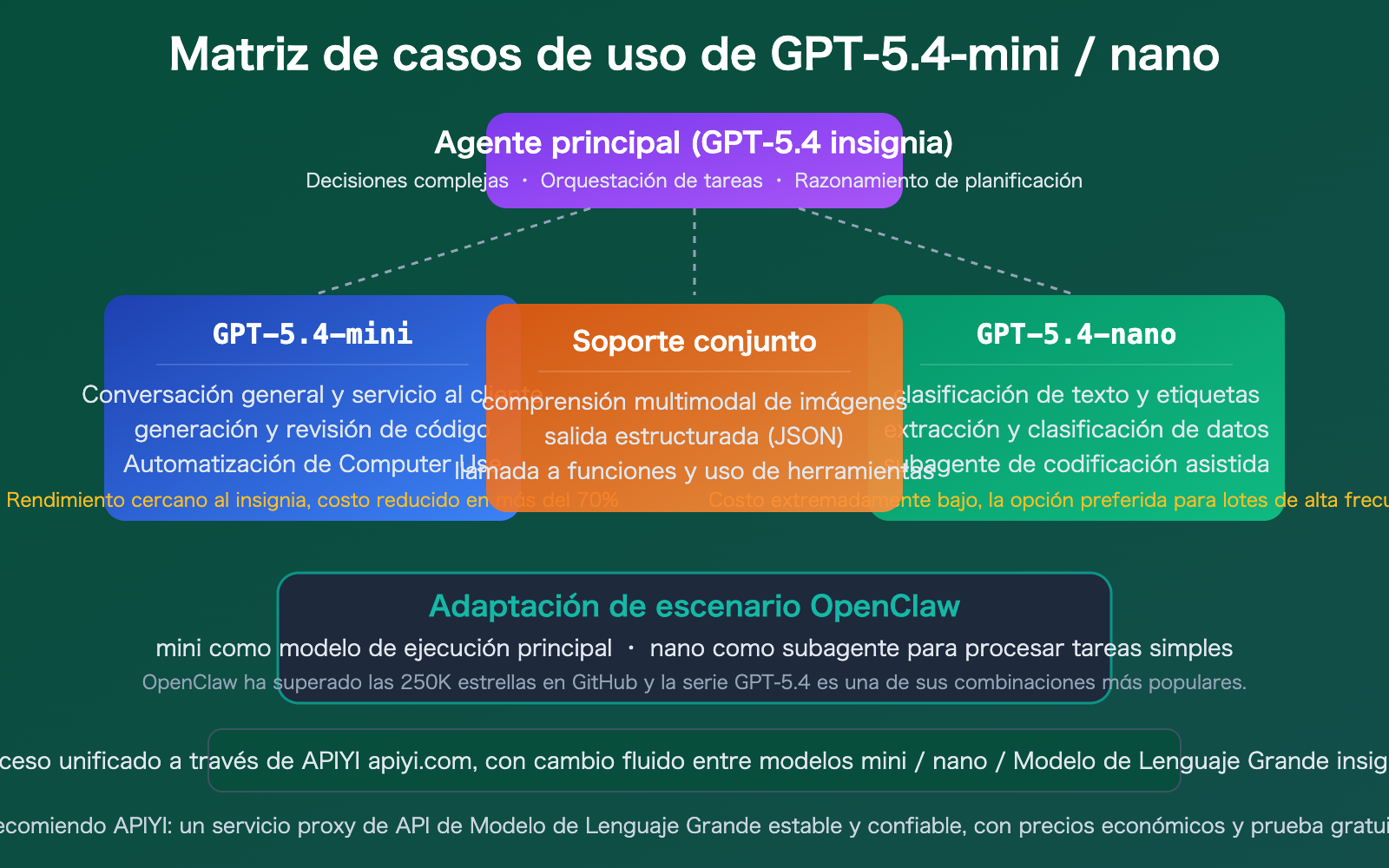

Casos de uso para GPT-5.4-mini y GPT-5.4-nano

Uso de GPT-5.4-mini y GPT-5.4-nano en OpenClaw

OpenClaw es la herramienta de agentes de IA de código abierto con mayor crecimiento en 2026, acumulando más de 250,000 estrellas en GitHub. Permite conectar modelos de lenguaje grandes como GPT y Claude a software real, logrando flujos de trabajo automatizados, operaciones de archivos e invocaciones de API.

En el contexto de OpenClaw, la combinación de GPT-5.4-mini y GPT-5.4-nano es muy eficiente:

- GPT-5.4-mini como modelo principal: gestiona la interacción conversacional, la generación de código y la comprensión de instrucciones complejas, con un uso ligero mensual de unos 12-25 dólares.

- GPT-5.4-nano como subagente: se encarga de tareas de decisión sencillas como clasificación, extracción y enrutamiento, con un coste extremadamente bajo.

- Colaboración multimodelo: en la arquitectura multiagente de OpenClaw, el modelo mini se encarga de "pensar" y el nano de "ejecutar".

🎯 Plan recomendado: Accede a OpenClaw a través de APIYI (apiyi.com); podrás gestionar la invocación de toda la serie GPT-5.4 con una única clave API, simplificando la configuración y el control de costes.

Preguntas frecuentes

Q1: ¿Cuál debería elegir entre GPT-5.4-mini y GPT-5.4-nano?

Si necesitas capacidades generales (conversación, programación, razonamiento, uso de computadora), elige GPT-5.4-mini; si necesitas procesar tareas sencillas de forma masiva y frecuente (clasificación, extracción, ordenamiento), elige GPT-5.4-nano. Ambos pueden combinarse en un mismo proyecto: el mini para decisiones complejas y el nano para ejecuciones simples.

Q2: ¿Cuánto ha mejorado el GPT-5.4-mini respecto a la generación anterior GPT-5 mini?

En SWE-Bench Pro pasó del 45.7% al 54.4% (+8.7 puntos porcentuales), la velocidad aumentó más de 2 veces y se añadieron capacidades como Computer Use y Skills. El precio se mantiene, pero el rendimiento ha mejorado drásticamente, aumentando significativamente la relación costo-beneficio.

Q3: ¿Cómo realizar una integración rápida a través de la plataforma APIYI?

Recomendamos usar APIYI apiyi.com para una integración rápida:

- Visita APIYI apiyi.com y registra una cuenta.

- Obtén tu clave API; las recargas oficiales tienen un descuento de aproximadamente el 10%.

- Configura la

base_urlcomohttps://vip.apiyi.com/v1. - Utiliza directamente los nombres de modelo

gpt-5.4-miniogpt-5.4-nanopara la invocación del modelo.

Resumen

Puntos clave sobre GPT-5.4-mini y GPT-5.4-nano:

- GPT-5.4-mini con rendimiento cercano al buque insignia: 54.4% en SWE-Bench Pro, 72.1% en OSWorld y el doble de velocidad; es la opción ligera preferida por la mayoría de los desarrolladores.

- GPT-5.4-nano con una relación costo-beneficio extrema: $0.20 por millón de tokens de entrada, diseñado específicamente para escenarios de alta frecuencia como clasificación, extracción y sub-agentes.

- Componente central de la arquitectura de sub-agentes: En herramientas de agentes como OpenClaw, la combinación de mini + nano es el equilibrio perfecto entre costo y rendimiento.

Estos dos modelos marcan la entrada oficial de OpenAI en la "era de los sub-agentes": no todas las tareas requieren un modelo insignia; combinar modelos ligeros de forma inteligente permite reducir drásticamente los costos manteniendo la calidad.

Recomendamos acceder rápidamente a GPT-5.4-mini y GPT-5.4-nano a través de APIYI apiyi.com. La plataforma ofrece precios consistentes con el sitio oficial, descuentos de aproximadamente el 10% en recargas y una interfaz unificada para múltiples modelos.

📚 Referencias

-

Anuncio oficial de OpenAI: Detalles del lanzamiento de GPT-5.4 mini y nano

- Enlace:

openai.com/index/introducing-gpt-5-4-mini-and-nano/ - Descripción: Especificaciones oficiales, precios y presentación de capacidades

- Enlace:

-

Página de precios de la API de OpenAI: Información actualizada sobre los precios de los modelos

- Enlace:

openai.com/api/pricing/ - Descripción: Referencia oficial de precios, incluyendo costos de caché

- Enlace:

-

Documentación para desarrolladores de OpenAI – GPT-5.4-mini: Documentación de la API del modelo

- Enlace:

developers.openai.com/api/docs/models/gpt-5.4-mini - Descripción: Parámetros detallados de la API y métodos de uso

- Enlace:

-

Análisis de Simon Willison: Análisis de uso real de GPT-5.4 mini y nano

- Enlace:

simonwillison.net/2026/Mar/17/mini-and-nano/ - Descripción: Evaluación profunda y análisis de costos realizados por un desarrollador independiente

- Enlace:

-

Documentación oficial de OpenClaw – Configuración de OpenAI: Guía de integración de OpenClaw

- Enlace:

docs.openclaw.ai/providers/openai - Descripción: Métodos para configurar la serie de modelos GPT-5.4 en OpenClaw

- Enlace:

Autor: Equipo técnico de APIYI

Intercambio técnico: Te invitamos a discutir tus experiencias con GPT-5.4-mini y GPT-5.4-nano en la sección de comentarios. Para más información, visita la documentación de APIYI en docs.apiyi.com.