Anmerkung des Autors: GPT-5.4-mini und GPT-5.4-nano sind die neuesten leichtgewichtigen Modelle von OpenAI. Sie bieten eine 2-fache Geschwindigkeitssteigerung und Preise ab nur 0,20 $ pro Million Token. Dieser Artikel erläutert die Spezifikationen, die Preisgestaltung, Benchmarks und die API-Anbindung im Detail.

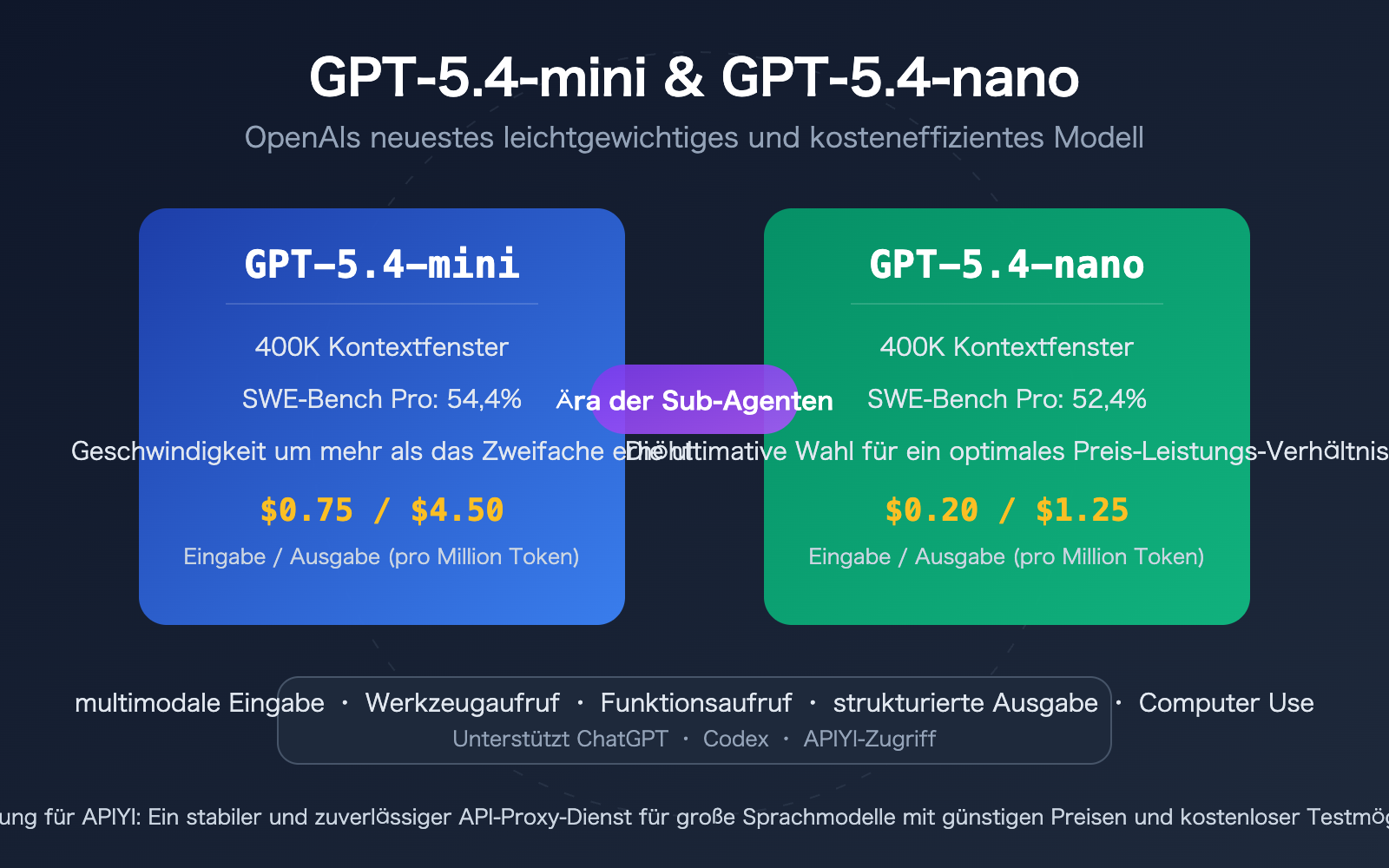

OpenAI hat am 17. März 2026 offiziell die beiden leichtgewichtigen Modelle GPT-5.4-mini und GPT-5.4-nano veröffentlicht. GPT-5.4-mini übertrifft das GPT-5 mini in den Bereichen Programmierung, Schlussfolgerung, multimodales Verständnis und Tool-Aufrufe bei einer mehr als doppelt so hohen Geschwindigkeit. GPT-5.4-nano ist mit einem Preis von 0,20 $ pro Million Eingabe-Token das derzeit günstigste Modell der GPT-5.4-Serie.

Kernnutzen: Erfahren Sie in 3 Minuten alles über die wichtigsten Spezifikationen, die Performance und die Anbindung von GPT-5.4-mini und GPT-5.4-nano, um die optimale leichtgewichtige Lösung für Ihre Geschäftsanforderungen zu finden.

Kernspezifikationen von GPT-5.4-mini und GPT-5.4-nano

| Spezifikation | GPT-5.4-mini | GPT-5.4-nano | GPT-5.4 (Flaggschiff) |

|---|---|---|---|

| Kontextfenster | 400K Token | 400K Token | 400K Token |

| Eingabepreis | 0,75 $/Mio. Token | 0,20 $/Mio. Token | Höher |

| Ausgabepreis | 4,50 $/Mio. Token | 1,25 $/Mio. Token | Höher |

| Multimodale Eingabe | Text + Bild | Text + Bild | Text + Bild |

| Tool-Aufrufe | Unterstützt | Unterstützt | Unterstützt |

| Verfügbare Kanäle | ChatGPT + Codex + API | Nur API | ChatGPT + Codex + API |

Detaillierte Fähigkeiten von GPT-5.4-mini

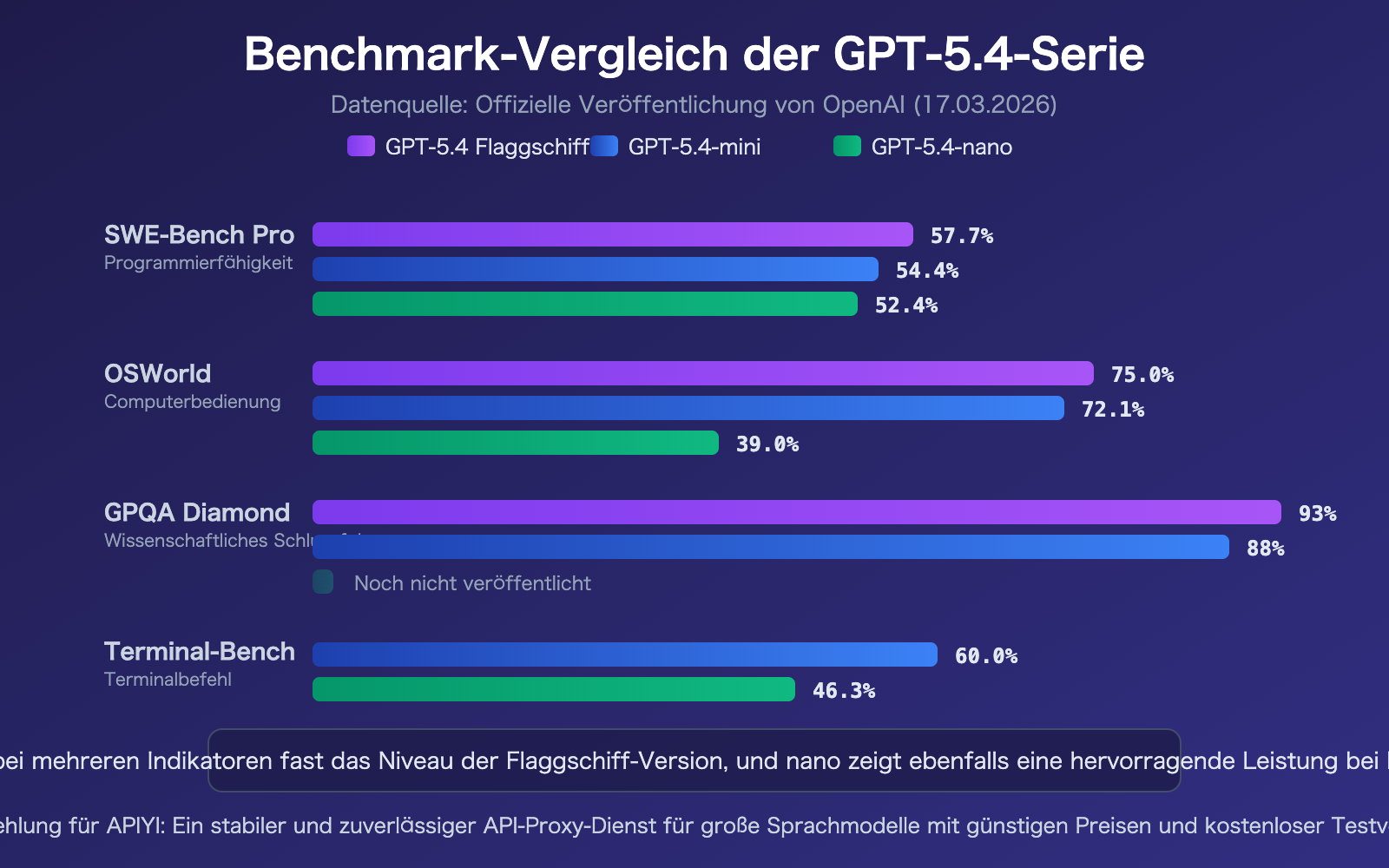

GPT-5.4-mini ist die leichtgewichtige Version der GPT-5.4-Serie, die in ihrer Leistung am nächsten an das Flaggschiff-Modell heranreicht. Im SWE-Bench Pro Coding-Benchmark erreicht es 54,4 % (im Vergleich zu 57,7 % beim Flaggschiff), im OSWorld-Verified Computer-Bedienungs-Benchmark 72,1 % (Flaggschiff 75,0 %) und im GPQA Diamond Test für wissenschaftliche Schlussfolgerungen auf Graduiertenniveau 88,0 % (Flaggschiff 93,0 %). Das bedeutet, dass GPT-5.4-mini in den meisten Szenarien eine nahezu erstklassige Erfahrung bei mehr als doppelter Geschwindigkeit bietet.

In ChatGPT steht GPT-5.4-mini kostenlosen Nutzern sowie Go-Nutzern über die „Thinking“-Funktion zur Verfügung. Auf API-Ebene unterstützt es den vollständigen Funktionsumfang, einschließlich Text- und Bildeingabe, Tool-Aufrufe, Funktionsaufrufe, Websuche, Dateisuche, Computer Use und Skills.

Maximale Kosteneffizienz mit GPT-5.4-nano

GPT-5.4-nano wurde speziell für geschwindigkeits- und kostensensible Szenarien entwickelt. Mit einem Eingabepreis von nur 0,20 $ pro Million Token und einem Ausgabepreis von 1,25 $ pro Million Token ist es die günstigste Wahl der GPT-5.4-Serie. Simon Willison stellte in Tests fest, dass die Beschreibung von 76.000 Bildern mit GPT-5.4-nano lediglich 52 $ kostet. GPT-5.4-nano ist ausschließlich über die API verfügbar und wird besonders für hochfrequente, weniger komplexe Automatisierungsaufgaben wie Klassifizierung, Datenextraktion, Sortierung und Coding-Sub-Agenten empfohlen.

🎯 Anbindungsempfehlung: GPT-5.4-mini und GPT-5.4-nano sind bereits auf der Plattform APIYI (apiyi.com) verfügbar. Die Preise entsprechen denen der offiziellen OpenAI-Website, wobei für offizielle Proxy-API-Aufladungen ein Rabatt von ca. 10 % gewährt wird, was es für Nutzer in China einfach macht, schnell eine Anbindung für Tests einzurichten.

Benchmark-Vergleich von GPT-5.4-mini und GPT-5.4-nano

| Benchmark | GPT-5.4 Flaggschiff | GPT-5.4-mini | GPT-5.4-nano | Erläuterung |

|---|---|---|---|---|

| SWE-Bench Pro | 57,7% | 54,4% | 52,4% | Tatsächliche Programmierleistung |

| OSWorld-Verified | 75,0% | 72,1% | 39,0% | Computerbedienung |

| GPQA Diamond | 93,0% | 88,0% | — | Schlussfolgerungen auf Graduiertenniveau |

| Terminal-Bench 2.0 | — | 60,0% | 46,3% | Terminal-Befehlsfähigkeit |

Die Leistung von GPT-5.4-mini bei SWE-Bench Pro (54,4%) stellt eine Steigerung von fast 10 Prozentpunkten gegenüber dem GPT-5 mini (45,7%) dar und nähert sich dem Niveau des Flaggschiff-Modells an. Auch GPT-5.4-nano erreichte 52,4% und übertraf damit das Mini-Modell der vorherigen Generation. Besonders hervorzuheben ist die Leistung von GPT-5.4-mini in Computer-Use-Szenarien (OSWorld 72,1%), bei denen es komplexe Screenshots von Benutzeroberflächen schnell interpretieren und Aufgaben ausführen kann.

Preis- und Kostenanalyse für GPT-5.4-mini und GPT-5.4-nano

| Modell | Eingabepreis | Ausgabepreis | Geschätzte Kosten pro 10k Dialoge | Anwendungsbereich |

|---|---|---|---|---|

| GPT-5.4-nano | $0,20/Mio. | $1,25/Mio. | ~2-5 $ | Klassifizierung, Extraktion, Sub-Agenten |

| GPT-5.4-mini | $0,75/Mio. | $4,50/Mio. | ~8-15 $ | Allgemeine Dialoge, Programmierung, Logik |

| GPT-5.4 Flaggschiff | Höher | Höher | ~30 $+ | Komplexe Logik, Forschungsaufgaben |

OpenAI wendet automatisch Prompt Caching für wiederholt gesendete Systemanweisungen und große Dokumente an, was die tatsächlichen Nutzungskosten weiter senkt. Bei Szenarien mit hoher Abruffrequenz können die Eingabekosten nach einem Cache-Treffer erheblich sinken.

🎯 Tipp zur Kostenoptimierung: Nutzen Sie die Plattform APIYI (apiyi.com), um GPT-5.4-mini und GPT-5.4-nano zu integrieren; Aufladungen für offizielle API-Proxys beginnen bei etwa 10 % Rabatt. Für Entwickler mit hohem Abrufvolumen lassen sich die tatsächlichen Kosten durch die Kombination von Prompt Caching und Plattform-Rabatten weiter optimieren.

Schnelleinstieg in GPT-5.4-mini und GPT-5.4-nano

Minimalistisches Beispiel

Hier ist der einfachste Weg, um loszulegen. Mit nur 10 Zeilen Code können Sie GPT-5.4-mini aufrufen:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.4-mini",

messages=[{"role": "user", "content": "Erkläre in einem Satz, was eine Sub-Agent-Architektur ist"}]

)

print(response.choices[0].message.content)

Beispiel für den Aufruf von GPT-5.4-nano anzeigen

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# GPT-5.4-nano eignet sich hervorragend für Klassifizierungs- und Datenextraktionsaufgaben

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": "Du bist ein Textklassifizierer und gibst das Ergebnis im JSON-Format aus"},

{"role": "user", "content": "Bitte klassifiziere folgendes Feedback als positiv/neutral/negativ: Das Produkt ist ganz gut, aber die Lieferung war etwas langsam"}

],

response_format={"type": "json_object"}

)

print(response.choices[0].message.content)

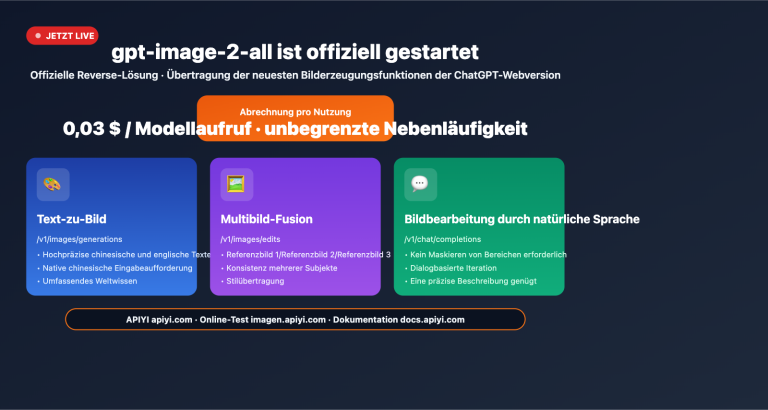

Empfehlung: Holen Sie sich Ihren API-Schlüssel über APIYI (apiyi.com), um GPT-5.4-mini und GPT-5.4-nano schnell zu testen. Die Plattform unterstützt einheitliche Modellaufrufe für die gesamte OpenAI-Modellreihe, ohne dass die base_url gewechselt werden muss.

Anwendungsbereiche für GPT-5.4-mini und GPT-5.4-nano

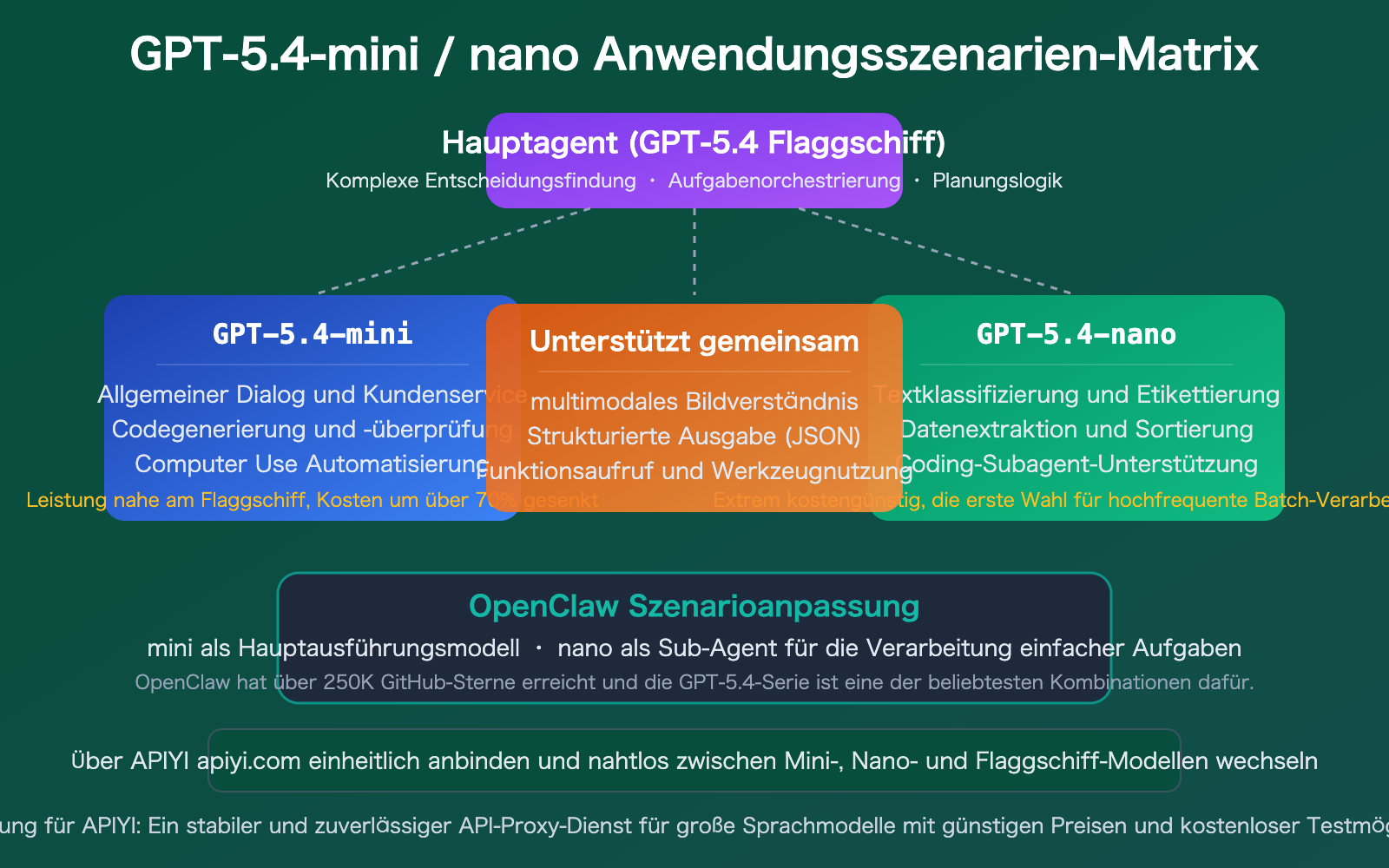

Verwendung von GPT-5.4-mini und GPT-5.4-nano in OpenClaw

OpenClaw ist das am schnellsten wachsende Open-Source-KI-Agenten-Tool des Jahres 2026 und hat auf GitHub bereits über 250.000 Sterne erhalten. Es ermöglicht die Anbindung von Großsprachmodellen wie GPT oder Claude an echte Software, um automatisierte Workflows, Dateimanipulationen und API-Aufrufe zu realisieren.

Im Kontext von OpenClaw ist die Kombination von GPT-5.4-mini und GPT-5.4-nano sehr sinnvoll:

- GPT-5.4-mini als Hauptmodell: Übernimmt Dialoginteraktionen, Code-Generierung und das Verständnis komplexer Anweisungen; bei moderater Nutzung ca. 12–25 $ pro Monat.

- GPT-5.4-nano als Sub-Agent: Übernimmt einfache Entscheidungsaufgaben wie Klassifizierung, Extraktion und Routing zu extrem niedrigen Kosten.

- Multimodale Zusammenarbeit: In der Multi-Agenten-Architektur von OpenClaw ist mini für das „Denken“ und nano für die „Ausführung“ zuständig.

🎯 Empfohlene Vorgehensweise: Binden Sie OpenClaw über APIYI (apiyi.com) an, um die Aufrufe der gesamten GPT-5.4-Modellreihe mit einem einzigen API-Schlüssel zu verwalten und so Konfiguration sowie Kostenmanagement zu vereinfachen.

Häufig gestellte Fragen

Q1: Sollte ich GPT-5.4-mini oder GPT-5.4-nano wählen?

Wenn Sie allgemeine Fähigkeiten (Dialoge, Programmierung, Schlussfolgerungen, Computer Use) benötigen, wählen Sie GPT-5.4-mini. Wenn Sie hochfrequente Stapelverarbeitung für einfache Aufgaben (Klassifizierung, Extraktion, Sortierung) benötigen, ist GPT-5.4-nano die richtige Wahl. Beide können im selben Projekt kombiniert werden: mini für komplexe Entscheidungen, nano für die einfache Ausführung.

Q2: Wie stark wurde GPT-5.4-mini gegenüber dem Vorgänger GPT-5 mini verbessert?

Der Wert bei SWE-Bench Pro stieg von 45,7 % auf 54,4 % (+8,7 Prozentpunkte), die Geschwindigkeit hat sich mehr als verdoppelt und neue Funktionen wie Computer Use und Skills wurden hinzugefügt. Bei gleichbleibendem Preis wurde die Leistung massiv gesteigert, was das Preis-Leistungs-Verhältnis deutlich verbessert.

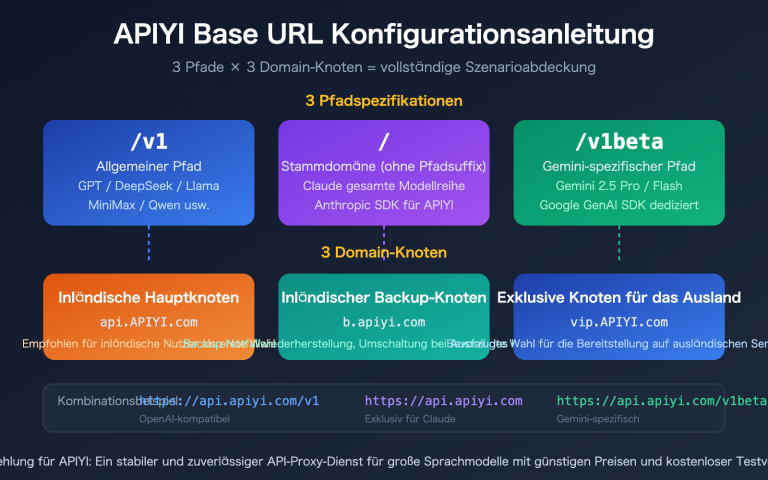

Q3: Wie erfolgt die schnelle Anbindung über die APIYI-Plattform?

Wir empfehlen die schnelle Anbindung über APIYI apiyi.com:

- Besuchen Sie APIYI apiyi.com und registrieren Sie ein Konto.

- Erhalten Sie Ihren API-Schlüssel; Aufladungen für offizielle Weiterleitungen erhalten Sie ab ca. 10 % Rabatt.

- Setzen Sie die

base_urlaufhttps://vip.apiyi.com/v1. - Verwenden Sie direkt die Modellnamen

gpt-5.4-miniodergpt-5.4-nanofür den Modellaufruf.

Zusammenfassung

Die Kernpunkte zu GPT-5.4-mini und GPT-5.4-nano:

- GPT-5.4-mini mit nahezu Flaggschiff-Leistung: 54,4 % bei SWE-Bench Pro, 72,1 % bei OSWorld, doppelt so schnell – die bevorzugte Leichtgewicht-Lösung für die meisten Entwickler.

- GPT-5.4-nano mit ultimativem Preis-Leistungs-Verhältnis: 0,20 $ pro Million Eingabe-Token, speziell für hochfrequente Szenarien wie Klassifizierung, Extraktion und Sub-Agenten entwickelt.

- Kernkomponente der Sub-Agenten-Architektur: In Agenten-Tools wie OpenClaw ist die Kombination aus mini + nano das optimale Gleichgewicht zwischen Kosten und Leistung.

Diese beiden Modelle markieren den offiziellen Eintritt von OpenAI in die „Ära der Sub-Agenten“ – nicht jede Aufgabe erfordert ein Flaggschiff-Modell. Durch die sinnvolle Kombination leichtgewichtiger Modelle lassen sich die Kosten massiv senken, ohne die Qualität zu beeinträchtigen.

Wir empfehlen die schnelle Anbindung von GPT-5.4-mini und GPT-5.4-nano über APIYI apiyi.com. Die Plattformpreise entsprechen denen der offiziellen Website, Aufladungen für offizielle Weiterleitungen bieten ca. 10 % Rabatt und eine einheitliche Schnittstelle für mehrere Modelle.

📚 Referenzen

-

Offizielle Ankündigung von OpenAI: Details zur Veröffentlichung von GPT-5.4 mini und nano

- Link:

openai.com/index/introducing-gpt-5-4-mini-and-nano/ - Beschreibung: Offizielle Spezifikationen, Preisgestaltung und Funktionsübersicht

- Link:

-

OpenAI API-Preisseite: Aktuelle Informationen zu Modellpreisen

- Link:

openai.com/api/pricing/ - Beschreibung: Offizielle Preisreferenz, inklusive Cache-Preisen

- Link:

-

OpenAI Entwicklerdokumentation – GPT-5.4-mini: API-Dokumentation für das Modell

- Link:

developers.openai.com/api/docs/models/gpt-5.4-mini - Beschreibung: Detaillierte API-Parameter und Anwendungshinweise

- Link:

-

Testbericht von Simon Willison: Analyse zur praktischen Nutzung von GPT-5.4 mini und nano

- Link:

simonwillison.net/2026/Mar/17/mini-and-nano/ - Beschreibung: Tiefgehende Analyse und Kostenbewertung durch einen unabhängigen Entwickler

- Link:

-

OpenClaw-Dokumentation – OpenAI-Konfiguration: Leitfaden zur Anbindung an OpenClaw

- Link:

docs.openclaw.ai/providers/openai - Beschreibung: Anleitung zur Konfiguration der GPT-5.4-Modellreihe in OpenClaw

- Link:

Autor: APIYI Technik-Team

Technischer Austausch: Diskutieren Sie gerne in den Kommentaren über Ihre Erfahrungen mit GPT-5.4-mini und GPT-5.4-nano. Weitere Informationen finden Sie im APIYI-Dokumentationszentrum unter docs.apiyi.com