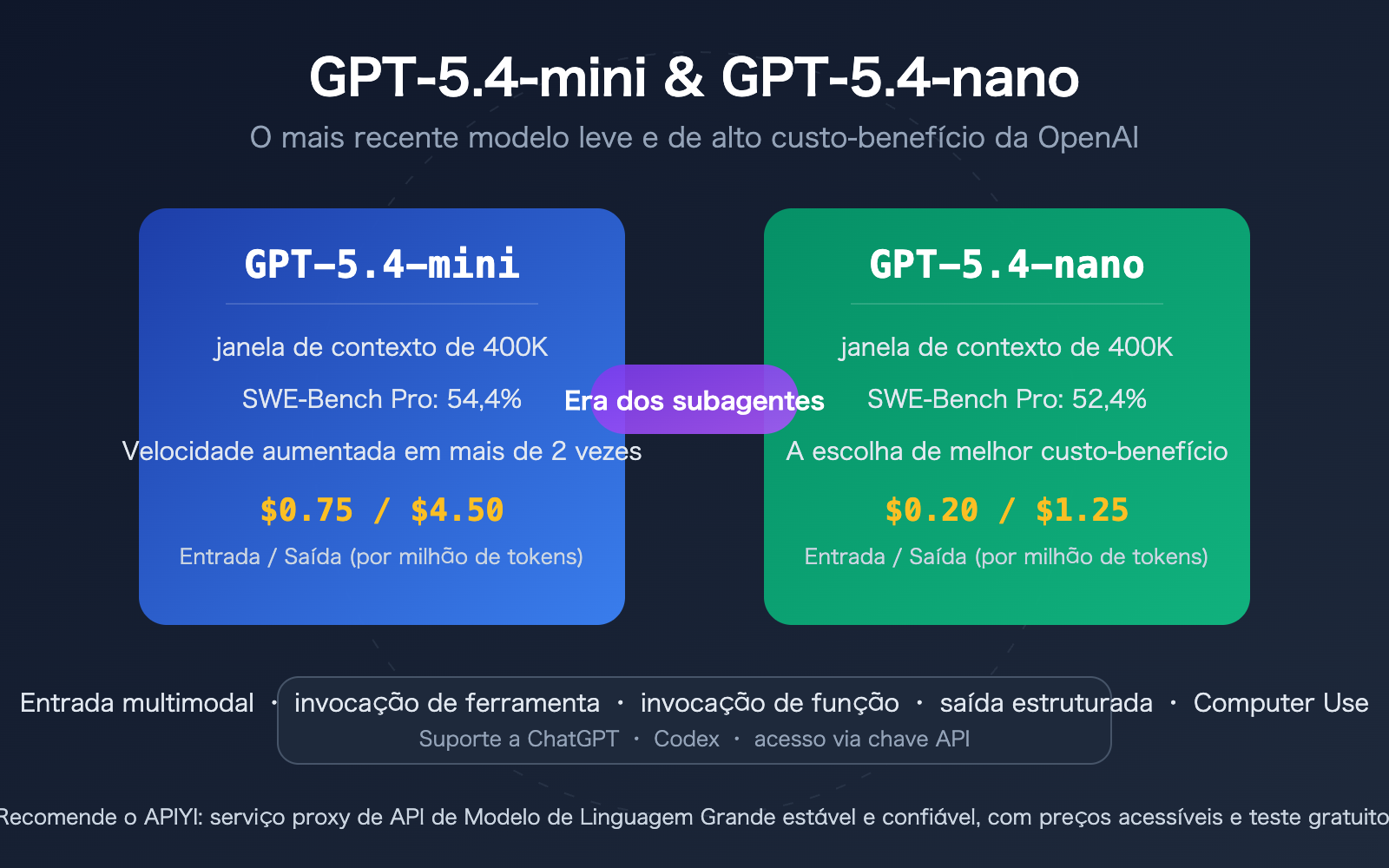

Nota do autor: O GPT-5.4-mini e o GPT-5.4-nano são os mais novos modelos leves lançados pela OpenAI, oferecendo o dobro da velocidade e preços a partir de $0,20 por milhão de tokens. Este artigo detalha as especificações, precificação, benchmarks e métodos de integração via API.

A OpenAI lançou oficialmente em 17 de março de 2026 os modelos leves GPT-5.4-mini e GPT-5.4-nano. O GPT-5.4-mini supera o GPT-5 mini em codificação, raciocínio, compreensão multimodal e invocação de ferramentas, com uma velocidade duas vezes maior. Já o GPT-5.4-nano, com um custo de $0,20 por milhão de tokens de entrada, torna-se o modelo mais acessível da série GPT-5.4.

Valor central: Entenda em 3 minutos as especificações, o desempenho e como integrar o GPT-5.4-mini e o GPT-5.4-nano para encontrar a solução leve ideal para o seu negócio.

Especificações principais do GPT-5.4-mini e GPT-5.4-nano

| Especificação | GPT-5.4-mini | GPT-5.4-nano | GPT-5.4 (Flagship) |

|---|---|---|---|

| Janela de contexto | 400K Tokens | 400K Tokens | 400K Tokens |

| Preço de entrada | $0,75/milhão de tokens | $0,20/milhão de tokens | Mais alto |

| Preço de saída | $4,50/milhão de tokens | $1,25/milhão de tokens | Mais alto |

| Entrada multimodal | Texto + Imagem | Texto + Imagem | Texto + Imagem |

| Invocação de ferramentas | Suportado | Suportado | Suportado |

| Canais disponíveis | ChatGPT + Codex + API | Apenas API | ChatGPT + Codex + API |

Detalhes das capacidades do GPT-5.4-mini

O GPT-5.4-mini é a versão leve da série GPT-5.4 com desempenho mais próximo ao modelo flagship. No benchmark de codificação SWE-Bench Pro, ele obteve 54,4%, aproximando-se dos 57,7% da versão principal; no benchmark de operação de computador OSWorld-Verified, atingiu 72,1% (contra 75,0% do flagship); e no teste de raciocínio científico de nível de pós-graduação GPQA Diamond, pontuou 88,0% (contra 93,0% do flagship). Isso significa que o GPT-5.4-mini oferece uma experiência quase equivalente ao modelo principal na maioria dos cenários, sendo duas vezes mais rápido.

No ChatGPT, o GPT-5.4-mini está disponível para usuários gratuitos e Plus, podendo ser acessado através da função "Thinking". Em nível de API, ele suporta todo o conjunto de capacidades, incluindo entrada de texto e imagem, invocação de ferramentas, chamadas de função, busca na web, busca de arquivos, Computer Use e Skills.

Detalhes do custo-benefício do GPT-5.4-nano

O GPT-5.4-nano foi projetado para cenários sensíveis a velocidade e custo. Com um preço de entrada de apenas $0,20 por milhão de tokens e saída de $1,25 por milhão de tokens, é a opção mais econômica da série GPT-5.4. Simon Willison descobriu em testes que usar o GPT-5.4-nano para descrever 76.000 imagens custou apenas $52. O GPT-5.4-nano é oferecido exclusivamente via API, sendo altamente recomendado para tarefas de automação de alta frequência e baixa complexidade, como classificação, extração de dados, ordenação e subagentes de codificação.

🎯 Dica de integração: O GPT-5.4-mini e o GPT-5.4-nano já estão disponíveis na plataforma APIYI (apiyi.com). Os preços são consistentes com o site oficial da OpenAI, com recargas de API a partir de 90% do valor original, facilitando o acesso e testes rápidos para usuários locais.

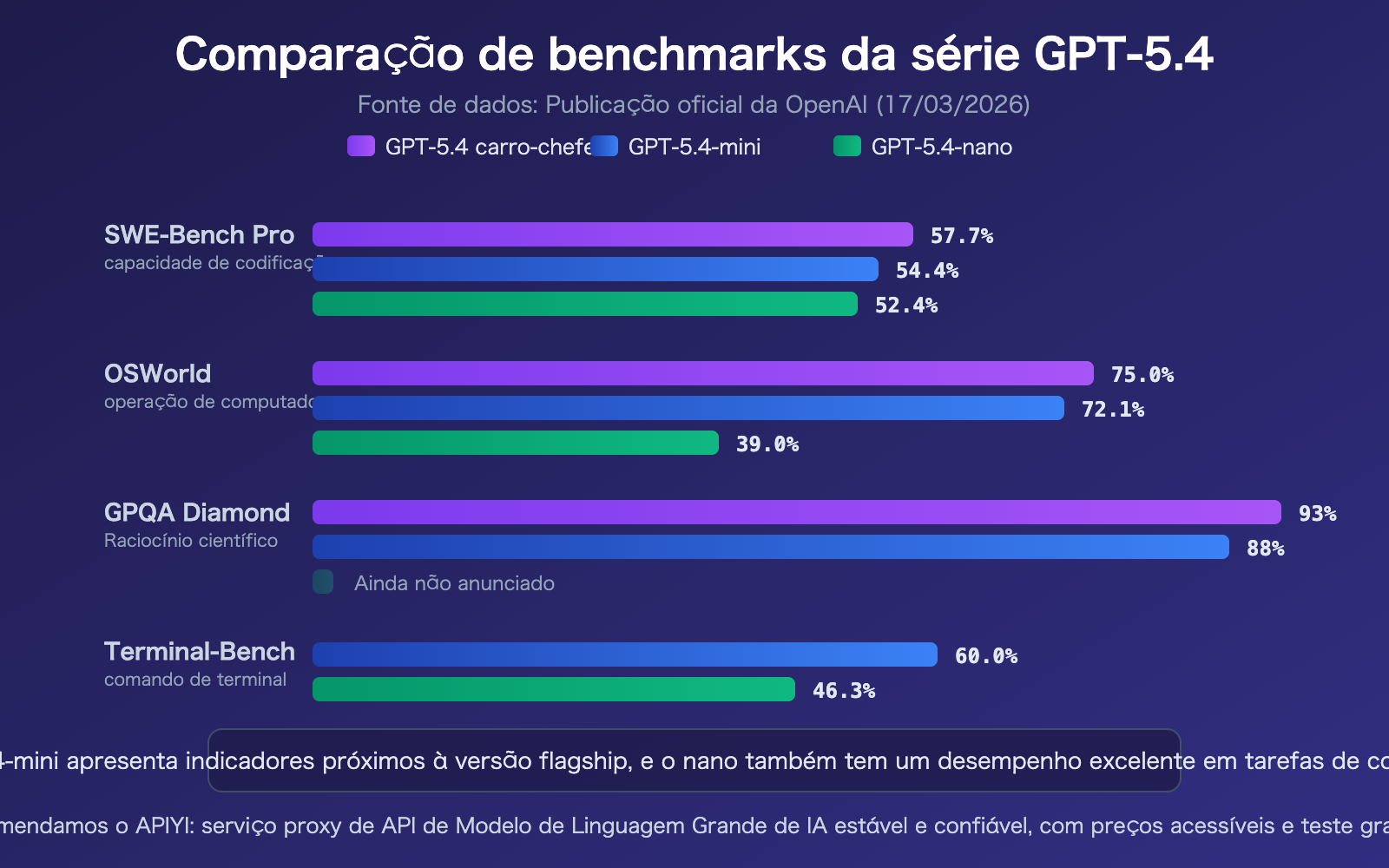

title: Comparativo de Benchmarks: GPT-5.4-mini e GPT-5.4-nano

Comparativo de Benchmarks: GPT-5.4-mini e GPT-5.4-nano

| Benchmark | GPT-5.4 Flagship | GPT-5.4-mini | GPT-5.4-nano | Descrição |

|---|---|---|---|---|

| SWE-Bench Pro | 57.7% | 54.4% | 52.4% | Capacidade de codificação real |

| OSWorld-Verified | 75.0% | 72.1% | 39.0% | Operação de computador |

| GPQA Diamond | 93.0% | 88.0% | — | Raciocínio nível pós-graduação |

| Terminal-Bench 2.0 | — | 60.0% | 46.3% | Capacidade de comandos de terminal |

O desempenho do GPT-5.4-mini no SWE-Bench Pro (54,4%) representa um aumento de quase 10 pontos percentuais em comparação ao GPT-5 mini (45,7%), aproximando-se do nível da versão flagship. O GPT-5.4-nano também atingiu 52,4%, superando a geração anterior de modelos mini. Vale destacar que o GPT-5.4-mini se sobressai especialmente em cenários de "Computer Use" (OSWorld 72,1%), sendo capaz de interpretar rapidamente capturas de tela densas de interfaces de usuário e concluir tarefas operacionais.

Análise de Preços e Custos do GPT-5.4-mini e GPT-5.4-nano

| Modelo | Preço de Entrada | Preço de Saída | Estimativa por 10k chamadas | Casos de uso |

|---|---|---|---|---|

| GPT-5.4-nano | $0.20/milhão | $1.25/milhão | ~$2-5 | Classificação, extração, sub-agentes |

| GPT-5.4-mini | $0.75/milhão | $4.50/milhão | ~$8-15 | Conversação geral, codificação, raciocínio |

| GPT-5.4 Flagship | Mais alto | Mais alto | ~$30+ | Raciocínio complexo, pesquisa |

A OpenAI aplica automaticamente o Prompt Caching para comandos de sistema repetidos e documentos extensos, reduzindo ainda mais o custo real de uso. Para cenários de alta frequência, o custo de entrada pode cair significativamente após o cache hit.

🎯 Dica de otimização de custos: Ao acessar o GPT-5.4-mini e o GPT-5.4-nano pela plataforma APIYI (apiyi.com), você obtém descontos a partir de 10% em recargas de API oficial. Para desenvolvedores com alto volume de invocações, combinar o Prompt Caching com as vantagens da plataforma permite otimizar os custos de forma expressiva.

Guia de Início Rápido: GPT-5.4-mini e GPT-5.4-nano

Exemplo Minimalista

Aqui está a forma mais simples de começar; com apenas 10 linhas de código, você pode realizar a invocação do modelo GPT-5.4-mini:

import openai

client = openai.OpenAI(

api_key="SUA_CHAVE_API",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.4-mini",

messages=[{"role": "user", "content": "Explique em uma frase o que é uma arquitetura de subagentes"}]

)

print(response.choices[0].message.content)

Ver exemplo de invocação do GPT-5.4-nano

import openai

client = openai.OpenAI(

api_key="SUA_CHAVE_API",

base_url="https://vip.apiyi.com/v1"

)

# O GPT-5.4-nano é ideal para tarefas de classificação e extração de dados

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": "Você é um classificador de texto, retorne no formato JSON"},

{"role": "user", "content": "Classifique o seguinte feedback como positivo/neutro/negativo: Este produto é bom, mas a entrega foi um pouco lenta"}

],

response_format={"type": "json_object"}

)

print(response.choices[0].message.content)

Dica: Obtenha sua chave API através da APIYI (apiyi.com) para testar rapidamente o GPT-5.4-mini e o GPT-5.4-nano. A plataforma oferece suporte à interface unificada para toda a linha de modelos da OpenAI, sem a necessidade de alterar a

base_url.

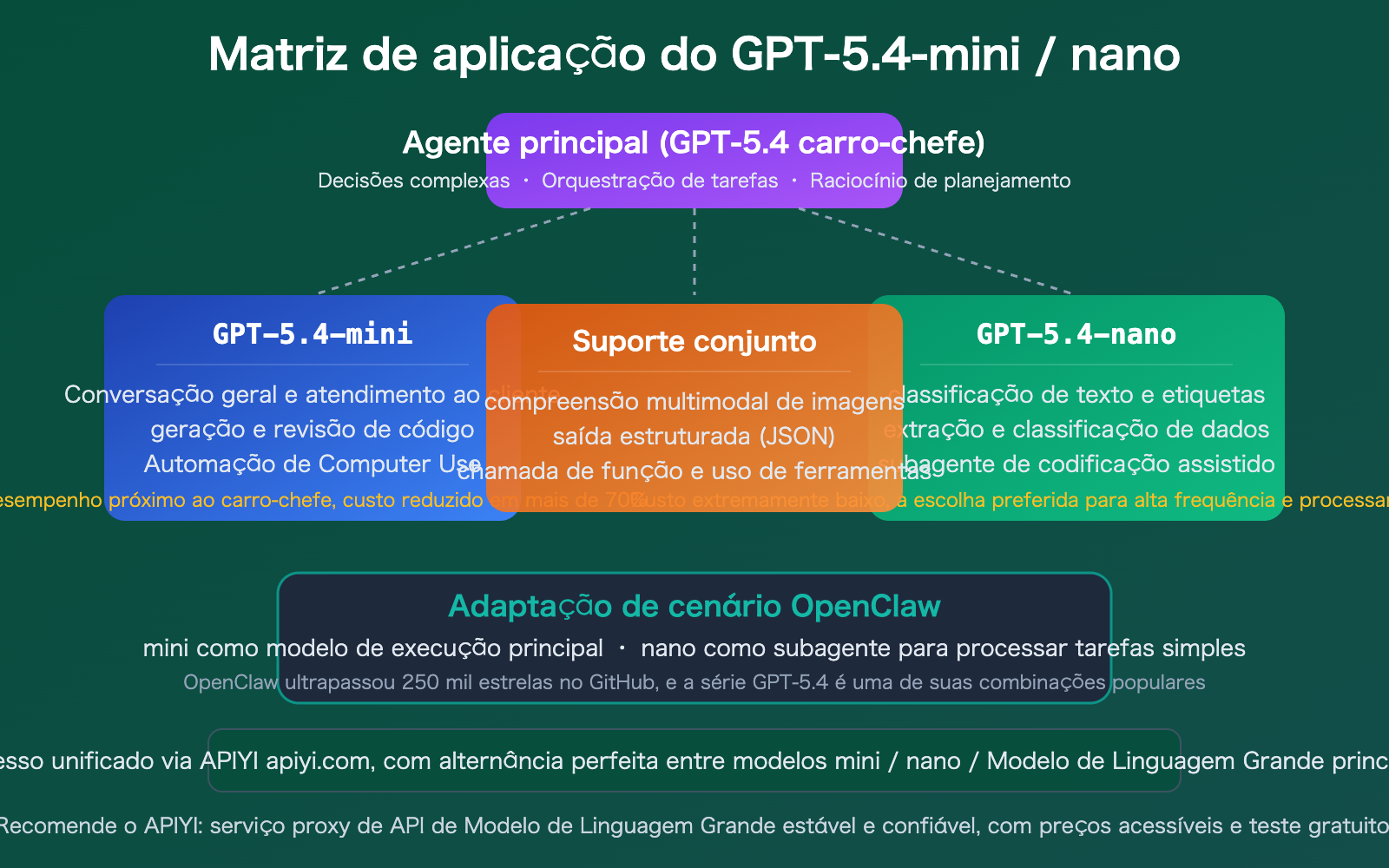

Cenários de Aplicação do GPT-5.4-mini e GPT-5.4-nano

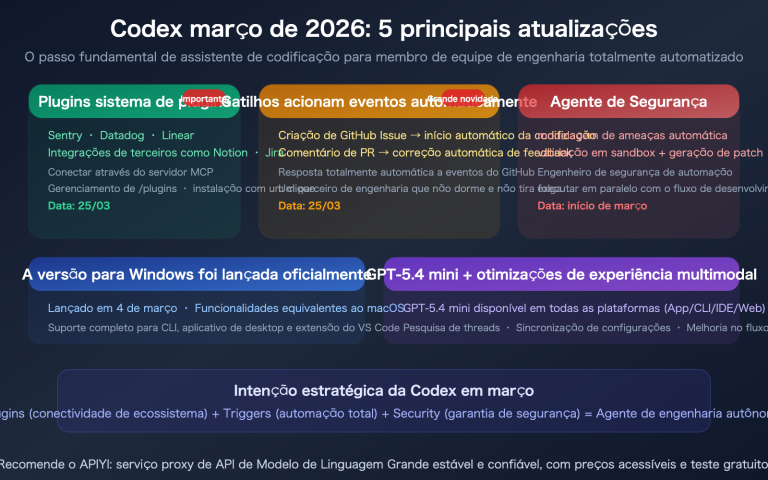

Uso do GPT-5.4-mini e GPT-5.4-nano no OpenClaw

O OpenClaw é a ferramenta de agentes de IA de código aberto que mais cresceu em 2026, acumulando mais de 250 mil estrelas no GitHub. Ele permite conectar Modelos de Linguagem Grandes, como GPT e Claude, a softwares reais, possibilitando o gerenciamento de fluxos de trabalho automatizados, manipulação de arquivos e chamadas de API.

No cenário do OpenClaw, a combinação do GPT-5.4-mini e do GPT-5.4-nano é extremamente eficiente:

- GPT-5.4-mini como modelo principal: Lida com interações de chat, geração de código e compreensão de comandos complexos, com um custo mensal de uso leve em torno de $12-25.

- GPT-5.4-nano como subagente: Lida com tarefas de classificação, extração, roteamento e outras decisões simples, com um custo extremamente baixo.

- Colaboração multimodelo: Na arquitetura de múltiplos agentes do OpenClaw, o mini fica responsável pelo "pensamento", enquanto o nano cuida da "execução".

🎯 Recomendação: Ao conectar o OpenClaw via APIYI (apiyi.com), você pode gerenciar a invocação de toda a linha GPT-5.4 com uma única chave API, simplificando a configuração e o controle de custos.

Perguntas Frequentes

Q1: Qual escolher entre o GPT-5.4-mini e o GPT-5.4-nano?

Se você precisa de capacidades gerais (conversação, codificação, raciocínio, uso de computador), escolha o GPT-5.4-mini; se você precisa de processamento em lote de alta frequência para tarefas simples (classificação, extração, ordenação), escolha o GPT-5.4-nano. Ambos podem ser usados juntos no mesmo projeto: o mini para decisões complexas e o nano para execução simples.

Q2: Quanto o GPT-5.4-mini melhorou em relação à geração anterior, o GPT-5 mini?

O SWE-Bench Pro subiu de 45,7% para 54,4% (+8,7 pontos percentuais), a velocidade aumentou mais de 2 vezes e novos recursos como Uso de Computador e Habilidades foram adicionados. O preço permanece o mesmo, mas o desempenho melhorou drasticamente, aumentando significativamente o custo-benefício.

Q3: Como integrar rapidamente através da plataforma APIYI?

Recomendamos usar a APIYI apiyi.com para uma integração rápida:

- Acesse APIYI apiyi.com e crie uma conta

- Obtenha sua chave API; recargas via serviço proxy de API oficial oferecem cerca de 10% de desconto

- Defina a

base_urlcomohttps://vip.apiyi.com/v1 - Use diretamente os nomes de modelo

gpt-5.4-miniougpt-5.4-nanopara a invocação do modelo

Resumo

Pontos principais sobre o GPT-5.4-mini e o GPT-5.4-nano:

- GPT-5.4-mini com desempenho próximo ao topo de linha: 54,4% no SWE-Bench Pro, 72,1% no OSWorld, 2 vezes mais rápido; é a escolha preferida da maioria dos desenvolvedores como solução leve.

- GPT-5.4-nano com custo-benefício extremo: US$ 0,20 por milhão de tokens de entrada, projetado especificamente para cenários de alta frequência, como classificação, extração e subagentes.

- Componente central da arquitetura de subagentes: Em ferramentas de agente como o OpenClaw, a combinação de mini + nano é o equilíbrio ideal entre custo e desempenho.

Esses dois modelos marcam a entrada oficial da OpenAI na "era dos subagentes" — nem todas as tarefas exigem um modelo topo de linha; combinar modelos leves de forma inteligente pode reduzir drasticamente os custos mantendo a qualidade.

Recomendamos integrar o GPT-5.4-mini e o GPT-5.4-nano rapidamente através da APIYI apiyi.com. Os preços da plataforma são consistentes com o site oficial, com recargas via serviço proxy de API oferecendo cerca de 10% de desconto e fornecendo uma interface unificada para múltiplos modelos.

📚 Referências

-

Comunicado oficial da OpenAI: Detalhes do lançamento do GPT-5.4 mini e nano

- Link:

openai.com/index/introducing-gpt-5-4-mini-and-nano/ - Descrição: Especificações oficiais, preços e apresentação das capacidades

- Link:

-

Página de preços da API da OpenAI: Informações atualizadas sobre os preços dos modelos

- Link:

openai.com/api/pricing/ - Descrição: Referência oficial de preços, incluindo custos de cache

- Link:

-

Documentação para desenvolvedores da OpenAI – GPT-5.4-mini: Documentação da API do modelo

- Link:

developers.openai.com/api/docs/models/gpt-5.4-mini - Descrição: Parâmetros detalhados da API e métodos de uso

- Link:

-

Avaliação de Simon Willison: Análise de uso prático do GPT-5.4 mini e nano

- Link:

simonwillison.net/2026/Mar/17/mini-and-nano/ - Descrição: Avaliação aprofundada e análise de custos feita por um desenvolvedor independente

- Link:

-

Documentação oficial do OpenClaw – Configuração OpenAI: Guia de integração do OpenClaw

- Link:

docs.openclaw.ai/providers/openai - Descrição: Métodos para configurar a série de modelos GPT-5.4 no OpenClaw

- Link:

Autor: Equipe técnica da APIYI

Troca de conhecimentos: Sinta-se à vontade para discutir suas experiências com o GPT-5.4-mini e o GPT-5.4-nano na seção de comentários. Para mais materiais, acesse a central de documentação da APIYI em docs.apiyi.com.