Note de l'auteur : GPT-5.4-mini et GPT-5.4-nano sont les tout derniers modèles légers publiés par OpenAI, offrant une vitesse multipliée par 2 et des tarifs aussi bas que 0,20 $ par million de jetons. Cet article détaille leurs spécifications, leur tarification, leurs benchmarks et les méthodes d'accès via API.

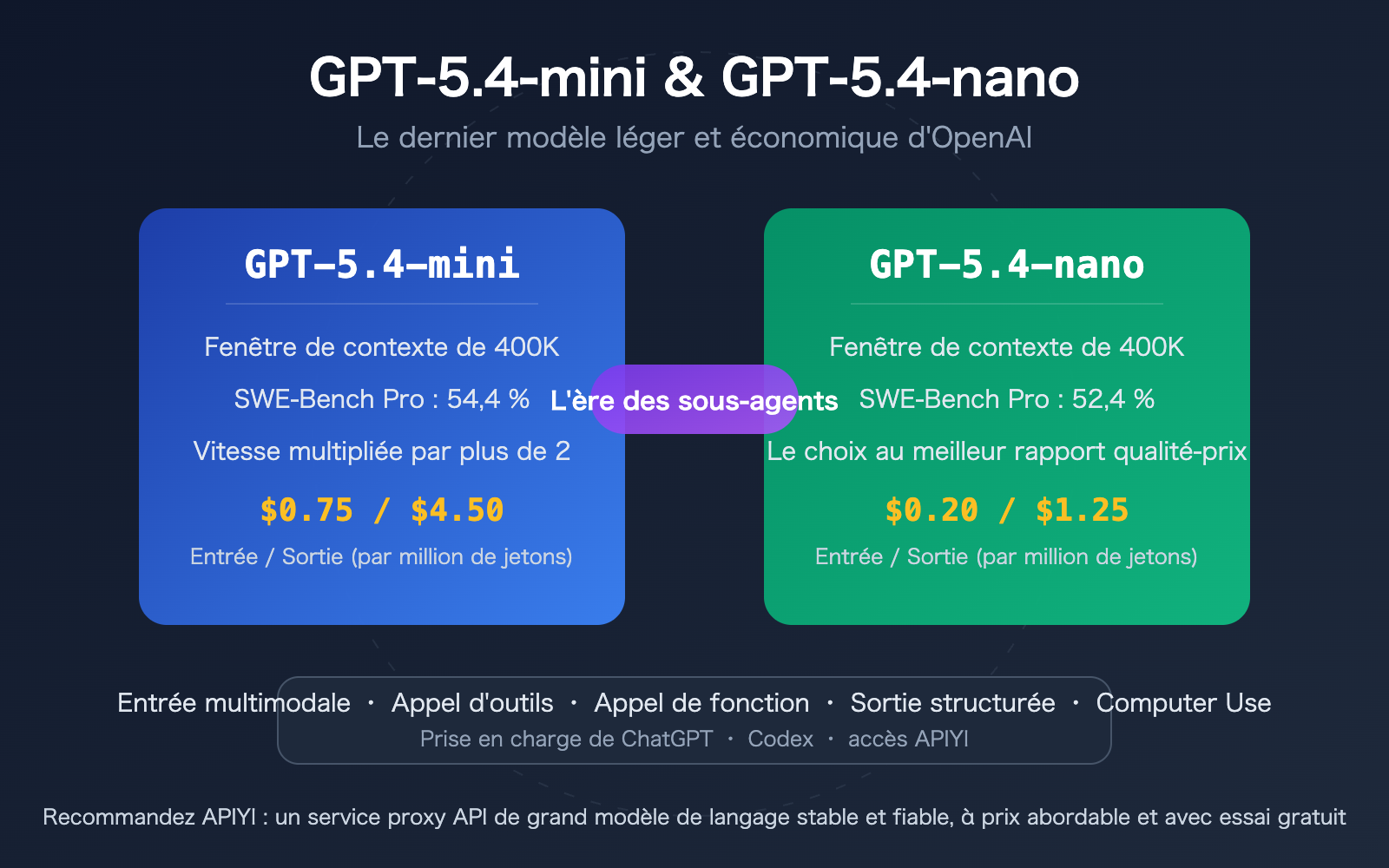

OpenAI a officiellement lancé les modèles légers GPT-5.4-mini et GPT-5.4-nano le 17 mars 2026. Le GPT-5.4-mini surpasse globalement le GPT-5 mini en matière de codage, de raisonnement, de compréhension multimodale et d'appel d'outils, avec une vitesse plus de deux fois supérieure. Le GPT-5.4-nano, quant à lui, s'impose comme le modèle le plus abordable de la série GPT-5.4, avec un prix de 0,20 $ par million de jetons en entrée.

Valeur ajoutée : Découvrez en 3 minutes les spécifications clés, les performances et les méthodes d'intégration du GPT-5.4-mini et du GPT-5.4-nano pour identifier la solution légère la plus adaptée à vos besoins métier.

Spécifications clés du GPT-5.4-mini et du GPT-5.4-nano

| Spécification | GPT-5.4-mini | GPT-5.4-nano | GPT-5.4 (Flagship) |

|---|---|---|---|

| Fenêtre de contexte | 400K jetons | 400K jetons | 400K jetons |

| Prix entrée | 0,75 $ / million de jetons | 0,20 $ / million de jetons | Plus élevé |

| Prix sortie | 4,50 $ / million de jetons | 1,25 $ / million de jetons | Plus élevé |

| Entrée multimodale | Texte + Image | Texte + Image | Texte + Image |

| Appel d'outils | Supporté | Supporté | Supporté |

| Canaux disponibles | ChatGPT + Codex + API | API uniquement | ChatGPT + Codex + API |

Analyse détaillée des capacités du GPT-5.4-mini

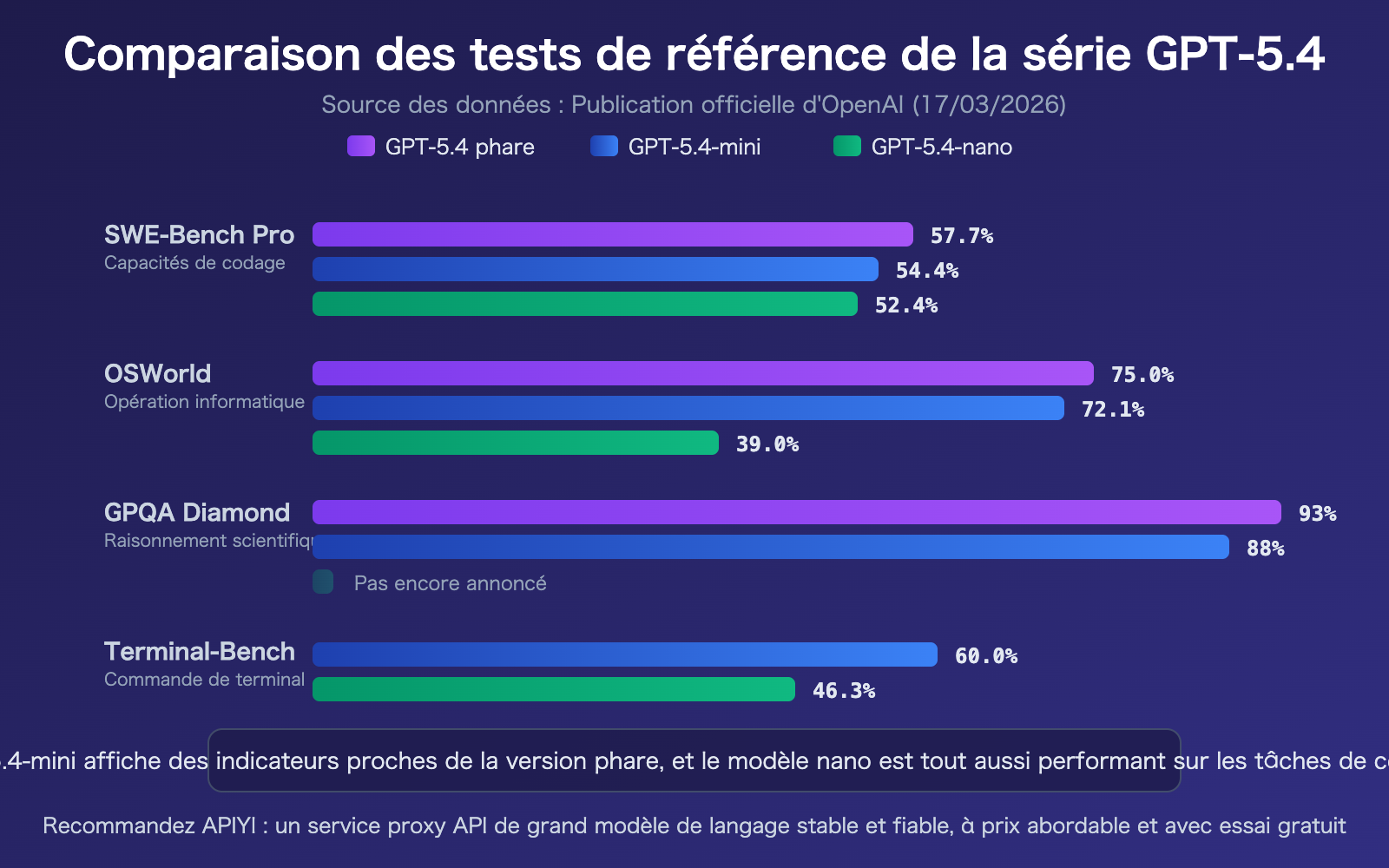

Le GPT-5.4-mini est la version légère de la série GPT-5.4 dont les performances se rapprochent le plus du modèle phare. Il obtient un score de 54,4 % au benchmark de codage SWE-Bench Pro, proche des 57,7 % du modèle phare ; il atteint 72,1 % au benchmark d'utilisation informatique OSWorld-Verified (contre 75,0 % pour le modèle phare) ; et 88,0 % au test de raisonnement scientifique de niveau universitaire GPQA Diamond (contre 93,0 % pour le modèle phare). Cela signifie que le GPT-5.4-mini offre une expérience quasi équivalente au modèle phare dans la grande majorité des scénarios, tout en étant deux fois plus rapide.

Dans ChatGPT, le GPT-5.4-mini est accessible aux utilisateurs gratuits et aux utilisateurs Go via la fonctionnalité « Thinking ». Au niveau de l'API, il prend en charge l'ensemble complet des capacités, y compris les entrées texte et image, l'appel d'outils, l'appel de fonctions, la recherche Web, la recherche de fichiers, l'utilisation informatique (Computer Use) et les Skills.

Analyse détaillée du rapport qualité-prix du GPT-5.4-nano

Le GPT-5.4-nano est conçu spécifiquement pour les scénarios sensibles à la vitesse et aux coûts. Avec un prix d'entrée de seulement 0,20 $ par million de jetons et un prix de sortie de 1,25 $ par million de jetons, c'est l'option la plus économique de la série GPT-5.4. Simon Willison a constaté lors de ses tests que l'utilisation du GPT-5.4-nano pour décrire 76 000 images ne coûtait que 52 $. Le GPT-5.4-nano est disponible uniquement via API et est particulièrement recommandé pour les tâches automatisées à haute fréquence et faible complexité, telles que la classification, l'extraction de données, le tri et les sous-agents de codage.

🎯 Conseils d'intégration : Le GPT-5.4-mini et le GPT-5.4-nano sont désormais disponibles sur la plateforme APIYI apiyi.com. Les tarifs sont identiques à ceux du site officiel d'OpenAI, avec des remises sur les recharges d'API (jusqu'à 10 % de réduction), facilitant ainsi l'accès et les tests pour les utilisateurs locaux.

title: "Analyse comparative des performances et coûts : GPT-5.4-mini vs GPT-5.4-nano"

description: "Analyse détaillée des performances des nouveaux modèles GPT-5.4-mini et nano, incluant leurs benchmarks et une étude de rentabilité pour les développeurs."

Analyse comparative des benchmarks : GPT-5.4-mini et GPT-5.4-nano

| Benchmark | GPT-5.4 Flagship | GPT-5.4-mini | GPT-5.4-nano | Description |

|---|---|---|---|---|

| SWE-Bench Pro | 57,7 % | 54,4 % | 52,4 % | Capacité de codage réelle |

| OSWorld-Verified | 75,0 % | 72,1 % | 39,0 % | Manipulation informatique |

| GPQA Diamond | 93,0 % | 88,0 % | — | Raisonnement niveau master |

| Terminal-Bench 2.0 | — | 60,0 % | 46,3 % | Commandes terminal |

Les performances du GPT-5.4-mini sur SWE-Bench Pro (54,4 %) marquent une progression de près de 10 points par rapport au GPT-5 mini (45,7 %), se rapprochant ainsi du niveau du modèle phare. Le GPT-5.4-nano atteint également 52,4 %, dépassant lui aussi la génération précédente de modèles mini. Il est intéressant de noter que le GPT-5.4-mini excelle particulièrement dans les scénarios de "Computer Use" (OSWorld 72,1 %), démontrant une grande efficacité pour interpréter des captures d'écran d'interfaces utilisateur denses et exécuter des tâches opérationnelles.

Analyse des prix et des coûts de GPT-5.4-mini et GPT-5.4-nano

| Modèle | Prix entrée | Prix sortie | Estimation pour 10k requêtes | Cas d'usage |

|---|---|---|---|---|

| GPT-5.4-nano | 0,20 $/M | 1,25 $/M | ~2-5 $ | Classification, extraction, sous-agents |

| GPT-5.4-mini | 0,75 $/M | 4,50 $/M | ~8-15 $ | Dialogue général, codage, raisonnement |

| GPT-5.4 Flagship | Plus élevé | Plus élevé | ~30 $+ | Raisonnement complexe, recherche |

OpenAI applique automatiquement le Prompt Caching pour les instructions système répétées et les documents volumineux, ce qui réduit considérablement les coûts réels d'utilisation. Pour les scénarios d'invocation à haute fréquence, le coût d'entrée diminue nettement après la mise en cache.

🎯 Conseil d'optimisation des coûts : En accédant aux modèles GPT-5.4-mini et GPT-5.4-nano via la plateforme APIYI (apiyi.com), vous bénéficiez de remises sur les clés API officielles (dès 10 % de réduction). Pour les développeurs effectuant des appels en masse, la combinaison du Prompt Caching et des offres de la plateforme permet d'optimiser encore davantage vos coûts opérationnels.

Prise en main rapide de GPT-5.4-mini et GPT-5.4-nano

Exemple minimaliste

Voici la méthode la plus simple pour démarrer. Il suffit de 10 lignes de code pour invoquer GPT-5.4-mini :

import openai

client = openai.OpenAI(

api_key="VOTRE_CLE_API",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.4-mini",

messages=[{"role": "user", "content": "Explique en une phrase ce qu'est une architecture de sous-agents"}]

)

print(response.choices[0].message.content)

Voir l’exemple d’invocation pour GPT-5.4-nano

import openai

client = openai.OpenAI(

api_key="VOTRE_CLE_API",

base_url="https://vip.apiyi.com/v1"

)

# GPT-5.4-nano est idéal pour les tâches de classification et d'extraction de données

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": "Tu es un classificateur de texte, réponds au format JSON"},

{"role": "user", "content": "Classifie le retour suivant en positif/neutre/négatif : Ce produit est plutôt pas mal, mais la livraison est un peu lente"}

],

response_format={"type": "json_object"}

)

print(response.choices[0].message.content)

Conseil : Obtenez votre clé API via APIYI (apiyi.com) pour tester rapidement GPT-5.4-mini et GPT-5.4-nano. La plateforme prend en charge l'invocation du modèle via une interface unifiée pour toute la gamme OpenAI, sans avoir à modifier la base_url.

Scénarios d'application pour GPT-5.4-mini et GPT-5.4-nano

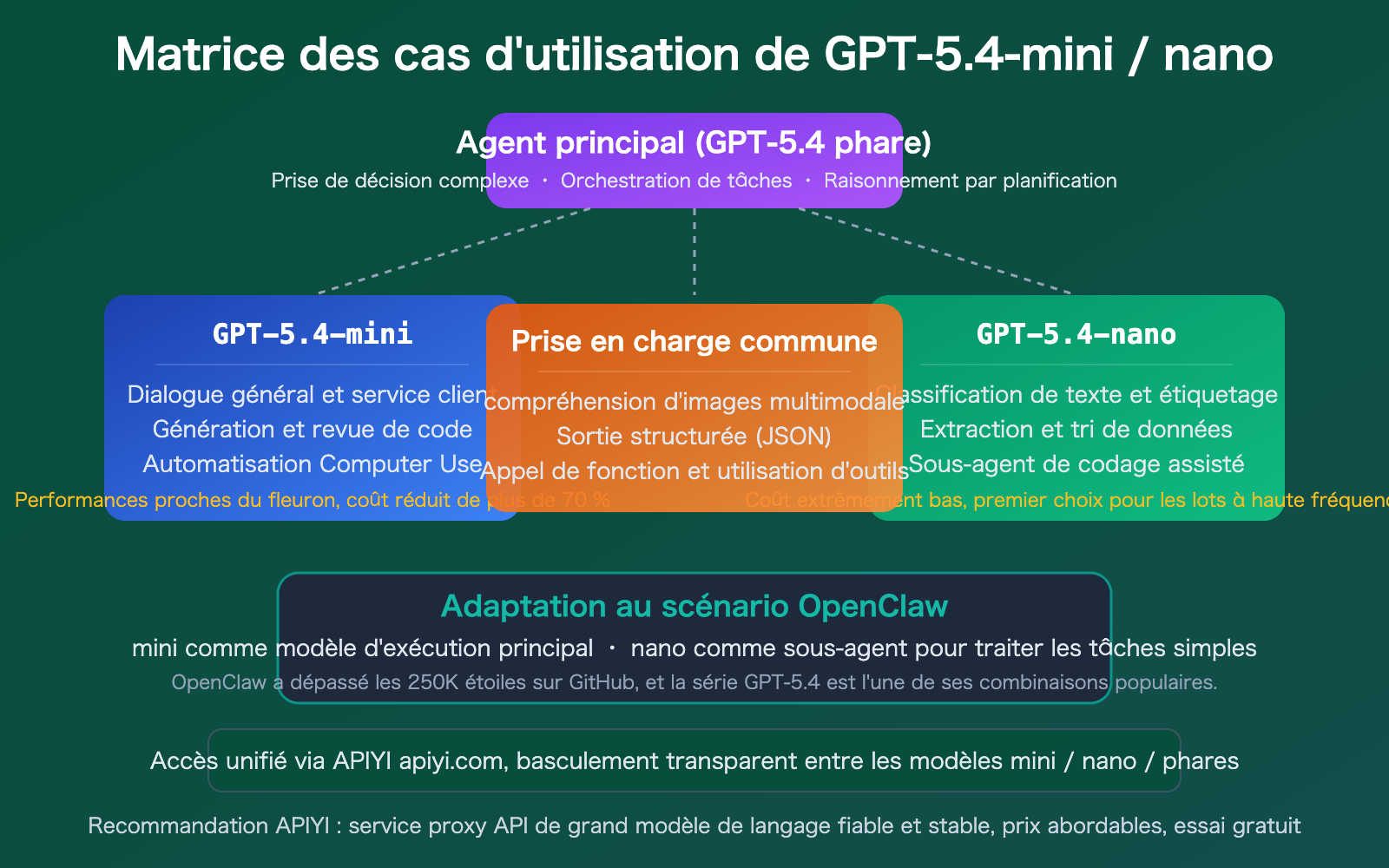

Utilisation de GPT-5.4-mini et GPT-5.4-nano dans OpenClaw

OpenClaw est l'outil d'agent IA open source à la croissance la plus rapide en 2026, avec plus de 250 000 étoiles sur GitHub. Il permet de connecter des grands modèles de langage comme GPT ou Claude à des logiciels réels pour automatiser la gestion des flux de travail, les opérations sur les fichiers et les appels API.

Dans le contexte d'OpenClaw, l'association de GPT-5.4-mini et GPT-5.4-nano est très pertinente :

- GPT-5.4-mini comme modèle principal : gère les interactions conversationnelles, la génération de code et la compréhension d'instructions complexes, pour un coût mensuel d'utilisation légère d'environ 12 à 25 $.

- GPT-5.4-nano comme sous-agent : traite les tâches de classification, d'extraction et de routage, ainsi que les décisions simples, à un coût extrêmement bas.

- Collaboration multi-modèles : dans l'architecture multi-agents d'OpenClaw, le modèle mini se charge de la « réflexion » tandis que le modèle nano se charge de l'« exécution ».

🎯 Solution recommandée : En accédant à OpenClaw via APIYI (apiyi.com), vous pouvez gérer l'invocation de toute la gamme GPT-5.4 avec une seule clé API, simplifiant ainsi la configuration et la gestion des coûts.

FAQ

Q1 : Lequel choisir entre GPT-5.4-mini et GPT-5.4-nano ?

Si vous avez besoin de capacités polyvalentes (conversation, codage, raisonnement, utilisation de l'ordinateur), optez pour le GPT-5.4-mini. Si vous devez traiter des tâches simples en masse et à haute fréquence (classification, extraction, tri), choisissez le GPT-5.4-nano. Vous pouvez combiner les deux au sein d'un même projet : le mini pour les décisions complexes et le nano pour l'exécution simple.

Q2 : Quelle est l’amélioration du GPT-5.4-mini par rapport à la génération précédente, le GPT-5 mini ?

Le score SWE-Bench Pro passe de 45,7 % à 54,4 % (+8,7 points de pourcentage), la vitesse est multipliée par plus de 2, et de nouvelles capacités comme l'utilisation de l'ordinateur (Computer Use) et les Skills ont été ajoutées. Le prix reste inchangé tandis que les performances font un bond en avant, offrant un rapport qualité-prix nettement supérieur.

Q3 : Comment s’intégrer rapidement via la plateforme APIYI ?

Nous recommandons d'utiliser APIYI (apiyi.com) pour une intégration rapide :

- Visitez APIYI sur apiyi.com pour créer un compte.

- Obtenez votre clé API ; les recharges pour le service proxy API bénéficient d'une réduction d'environ 10 %.

- Configurez l'URL de base (

base_url) surhttps://vip.apiyi.com/v1. - Appelez directement les modèles en utilisant les noms

gpt-5.4-miniougpt-5.4-nano.

Résumé

Les points clés à retenir sur le GPT-5.4-mini et le GPT-5.4-nano :

- GPT-5.4-mini, des performances proches du haut de gamme : 54,4 % au SWE-Bench Pro, 72,1 % à OSWorld, deux fois plus rapide ; c'est le choix léger privilégié par la plupart des développeurs.

- GPT-5.4-nano, un rapport qualité-prix ultime : 0,20 $ par million de jetons en entrée, conçu spécifiquement pour les scénarios à haute fréquence comme la classification, l'extraction ou les sous-agents.

- Composants clés de l'architecture de sous-agents : Dans les outils d'agents comme OpenClaw, la combinaison mini + nano représente l'équilibre idéal entre coût et performance.

Ces deux modèles marquent l'entrée officielle d'OpenAI dans « l'ère des sous-agents » : toutes les tâches ne nécessitent pas un modèle phare. Une combinaison judicieuse de modèles légers permet de réduire considérablement les coûts tout en maintenant la qualité.

Nous vous recommandons d'accéder rapidement aux GPT-5.4-mini et GPT-5.4-nano via APIYI (apiyi.com). Les prix de la plateforme sont alignés sur ceux du site officiel, avec des recharges pour le service proxy API à environ -10 % et une interface unifiée pour plusieurs modèles.

📚 Références

-

Annonce officielle d'OpenAI : Détails sur le lancement de GPT-5.4 mini et nano

- Lien :

openai.com/index/introducing-gpt-5-4-mini-and-nano/ - Description : Spécifications officielles, tarification et présentation des capacités

- Lien :

-

Page de tarification de l'API OpenAI : Informations sur les prix des modèles récents

- Lien :

openai.com/api/pricing/ - Description : Référence tarifaire officielle, incluant les coûts de mise en cache

- Lien :

-

Documentation développeur OpenAI – GPT-5.4-mini : Documentation de l'API du modèle

- Lien :

developers.openai.com/api/docs/models/gpt-5.4-mini - Description : Paramètres détaillés de l'API et méthodes d'utilisation

- Lien :

-

Évaluation de Simon Willison : Analyse pratique de GPT-5.4 mini et nano

- Lien :

simonwillison.net/2026/Mar/17/mini-and-nano/ - Description : Évaluation approfondie et analyse des coûts par un développeur indépendant

- Lien :

-

Documentation officielle OpenClaw – Configuration OpenAI : Guide d'intégration OpenClaw

- Lien :

docs.openclaw.ai/providers/openai - Description : Méthodes de configuration des modèles de la série GPT-5.4 dans OpenClaw

- Lien :

Auteur : Équipe technique APIYI

Échanges techniques : N'hésitez pas à discuter de vos retours d'expérience sur GPT-5.4-mini et GPT-5.4-nano dans les commentaires. Pour plus d'informations, consultez le centre de documentation APIYI sur docs.apiyi.com.