Fehler bei der Bilderzeugung mit Nano Banana 2 sind eines der häufigsten Probleme, auf die Entwickler bei der Nutzung der Gemini Image Generation API stoßen. Nach dem offiziellen Start von Nano Banana 2 am 27. Februar 2026 erfuhren die Inhaltssicherheitsmechanismen von Google ein signifikantes Upgrade. Die Sicherheitsfilterung für Szenarien wie prominente Personen, Änderungen von Finanzinformationen, Gesichts- oder Outfit-Tausch bei Personen sowie implizite sexuelle Anspielungen wurde deutlich verschärft.

Kernwert: Nach der Lektüre dieses Artikels werden Sie die zweistufige Sicherheitsarchitektur von Nano Banana 2, die 8 spezifischen Gründe für fehlgeschlagene Bilderzeugungen, die Bedeutung der API-Fehlercodes sowie Strategien für verschiedene Szenarien umfassend verstehen.

Nano Banana 2 Sicherheitsmechanismen für Inhalte – Kernpunkte

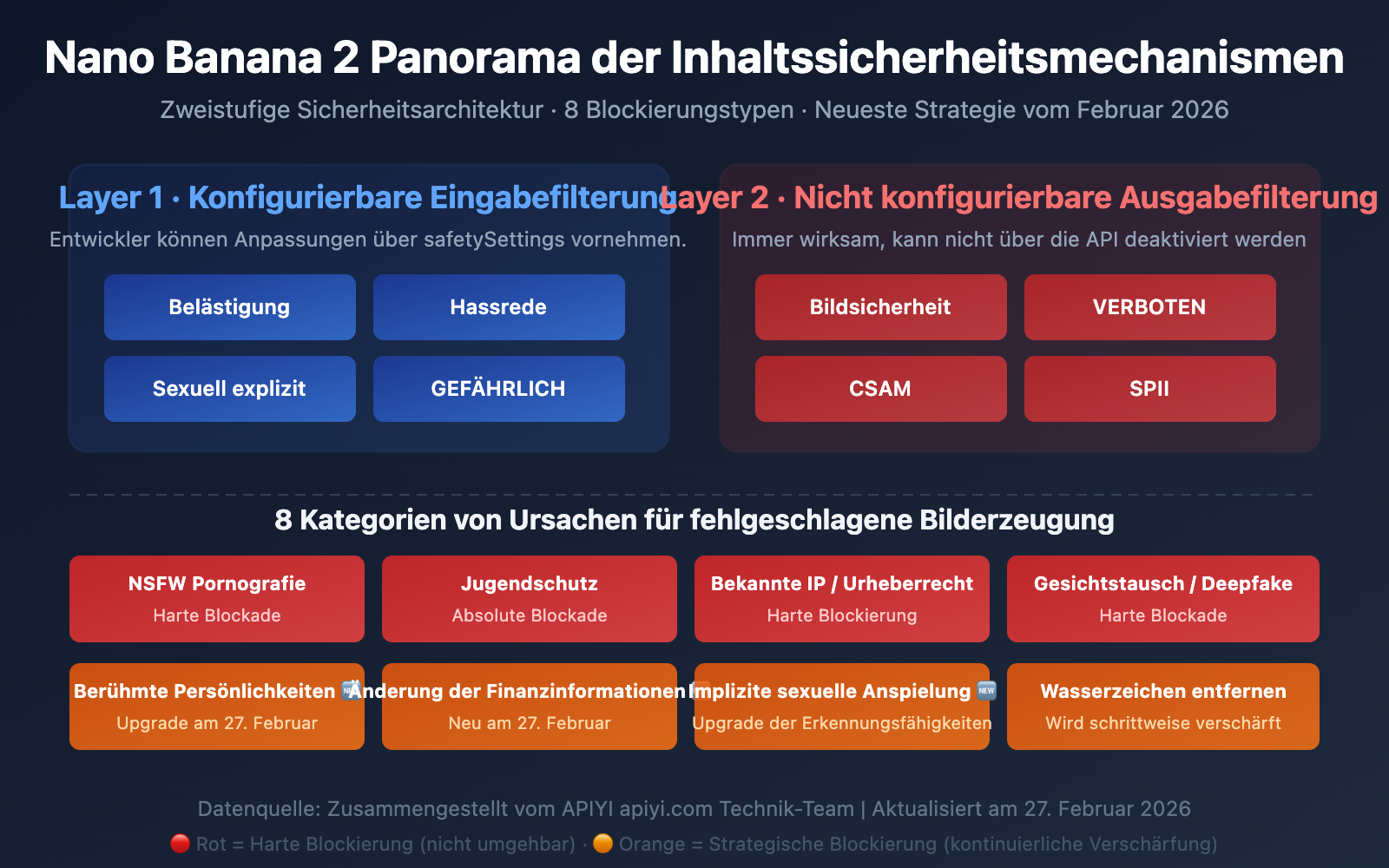

Der Sicherheitsmechanismus von Nano Banana 2 (dem Gemini-Bilderzeugungsmodell) ist keine einfache Filterung von Schlüsselwörtern, sondern eine zweistufige Sicherheitsarchitektur. Das Verständnis dieser Architektur ist entscheidend, um Probleme bei fehlgeschlagenen Bildgenerierungen zu lösen.

| Kernpunkt | Beschreibung | Auswirkungen für Entwickler |

|---|---|---|

| Zweistufige Architektur | Layer 1: Konfigurierbare Eingabefilterung + Layer 2: Nicht konfigurierbare Ausgabefilterung | Selbst mit der Einstellung BLOCK_NONE können nicht alle Einschränkungen umgangen werden. |

| 8 Blockierungskategorien | NSFW, Wasserzeichen, bekannte IPs, Minderjährige, Prominente, Finanzen, Gesichtstausch, implizite Anspielungen | Verschiedene Kategorien erfordern unterschiedliche Strategien. |

| Verschärfung der Richtlinien | Zwei große Updates im Januar und Februar 2026 | Inhalte, die zuvor funktionierten, könnten jetzt blockiert werden. |

| Transparenter Proxy | APIYI leitet die Originalantworten von Google direkt weiter | Statuscode 200, aber kein Bild = Blockierung durch den Google-Sicherheitsfilter. |

Nano Banana 2 Inhaltssicherheit – Details zur zweistufigen Architektur

Layer 1 — Konfigurierbare Eingabefilterung (Safety Settings)

Dies ist die erste Filterebene, die Entwickler über API-Parameter anpassen können. Sie wird angewendet, bevor die Text-Eingabeaufforderung das Modell erreicht. Sie umfasst 4 anpassbare Gefahrenkategorien:

HARM_CATEGORY_HARASSMENT— BelästigungHARM_CATEGORY_HATE_SPEECH— HassredeHARM_CATEGORY_SEXUALLY_EXPLICIT— Sexuell explizite InhalteHARM_CATEGORY_DANGEROUS_CONTENT— Gefährliche Inhalte

Jede Kategorie unterstützt 5 Schwellenwert-Stufen:

| Schwellenwert-Einstellung | Verhalten | Strenge |

|---|---|---|

BLOCK_LOW_AND_ABOVE |

Blockiert Inhalte mit niedriger, mittlerer und hoher Wahrscheinlichkeit | Am strengsten |

BLOCK_MEDIUM_AND_ABOVE |

Blockiert Inhalte mit mittlerer und hoher Wahrscheinlichkeit | Standardwert |

BLOCK_ONLY_HIGH |

Blockiert nur Inhalte mit hoher Wahrscheinlichkeit | Lockerer |

BLOCK_NONE |

Deaktiviert die wahrscheinlichkeitsbasierte Blockierung für diese Kategorie | Am lockersten |

HARM_BLOCK_THRESHOLD_UNSPECIFIED |

Verwendet den Plattform-Standardwert | Plattformabhängig |

Layer 2 — Nicht konfigurierbare Ausgabefilterung (Hard Blocks)

Dies ist die zweite Filterebene, die immer aktiv ist und über keine API-Parameter deaktiviert werden kann. Sie wird nach der Bilderzeugung angewendet:

IMAGE_SAFETY— Sicherheitsbewertung des BildinhaltsPROHIBITED_CONTENT— Verstoß gegen Richtlinien für verbotene Inhalte (Urheberrecht/IP)CSAM— Erkennung von Material über sexuellen Missbrauch von Kindern (absolute harte Blockierung)SPII— Sensible personenbezogene Daten

🎯 Wichtige Erkenntnis: Viele Entwickler stellen alle Sicherheitskategorien auf

BLOCK_NONEund stellen fest, dass Bilder dennoch blockiert werden. Der Grund dafür ist, dass die harten Blockierungen von Layer 2 immer in Kraft sind. Bei Aufrufen über die Plattform APIYI (apiyi.com) leitet unser transparenter Proxy die Originalantworten von Google direkt weiter. Die Fehlermeldungen, die Sie sehen, sind also das echte Feedback des Google-Sicherheitssystems.

Nano Banana 2 Analyse der 8 Kategorien für fehlgeschlagene Bilderzeugung

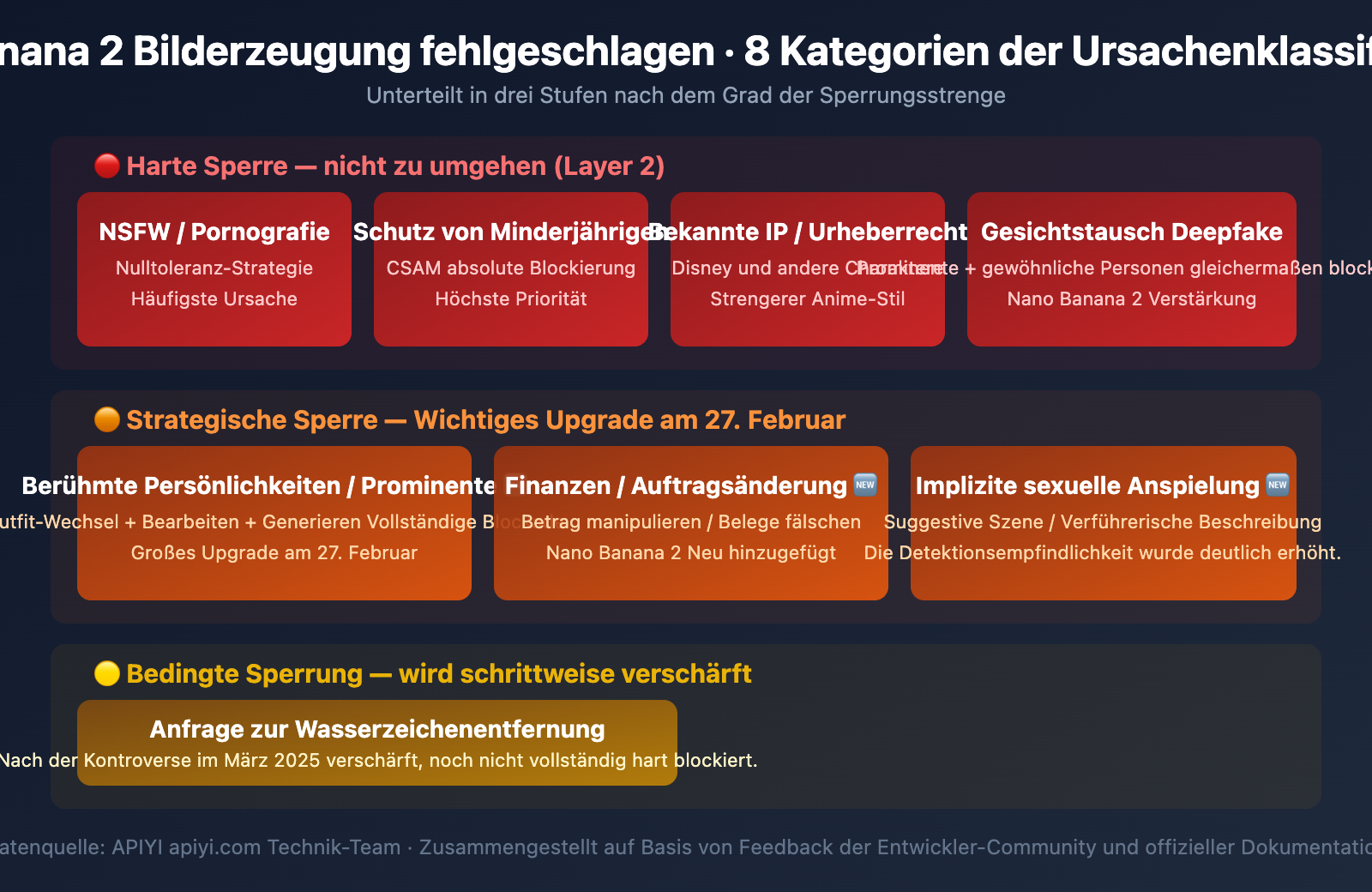

Basierend auf den Sicherheitsrichtlinien von Google und umfangreichem Feedback aus der Entwickler-Community lassen sich die Gründe für das Scheitern der Bilderzeugung bei Nano Banana 2 in die folgenden 8 Kategorien einteilen:

Kategorie 1: NSFW / Pornografische Inhalte (Harte Blockierung)

Blockierungsstufe: 🔴 Harte Blockierung — nicht umgehbar

Dies ist der häufigste Grund für eine fehlgeschlagene Bilderzeugung. Gemini verfolgt bei pornografischen Inhalten eine „Null-Toleranz“-Strategie, die strenger ist als bei anderen gängigen KI-Modellen.

Blockierte Inhalte umfassen:

- Pornografische oder erotische Inhalte

- Szenen mit sexueller Gewalt oder sexuellem Missbrauch

- Sexszenen mit realen oder fiktiven Personen

- Explizite sexuelle Inhalte und Nacktheit

Typische Fehlermeldungen:

"I can't generate that image."

"The prompt couldn't be submitted — it might violate our policies."

Hinweis für Entwickler: Eine Sicherheitsbewertung im November 2025 ergab, dass zwar direkte pornografische Eingabeaufforderungen effektiv abgefangen wurden, jedoch Multi-Turn-Dialoge und wiederholte Prompt-Injections in 19 von 21 Testfällen die Überprüfung erfolgreich umgingen. Google verstärkt kontinuierlich die Verteidigung in diesem Bereich.

Kategorie 2: Anfragen zur Wasserzeichenentfernung (Spezielle Blockierung)

Blockierungsstufe: 🟠 Richtlinienbasierte Blockierung — schrittweise Verschärfung nach März 2025

Die Entfernung von Wasserzeichen ist ein spezieller Fall. Im März 2025 wurde in den Medien berichtet, dass Gemini 2.0 Flash in der Lage sei, Urheberrechts-Wasserzeichen wie die von Getty Images zu entfernen und das Bild nahtlos zu reparieren, was eine große Kontroverse auslöste.

Wichtige Erkenntnisse:

- Die Gemini-App für Endverbraucher zeigt ethische Warnungen an.

- Beim Zugriff über die AI Studio API weist dasselbe Modell jedoch keine dieser Schutzmechanismen auf.

- Anthropic Claude und OpenAI GPT-4o lehnen Anfragen zur Wasserzeichenentfernung explizit ab.

Aktueller Status: Google erklärt, dass die Entfernung von Wasserzeichen gegen die Nutzungsbedingungen verstößt, und verstärkt schrittweise die technische Blockierung. Im Gegensatz zu NSFW hat die Blockierung der Wasserzeichenentfernung jedoch noch keine 100%ige harte Blockierung erreicht.

Kategorie 3: Bekannte IPs / Urheberrechtlich geschützte Charaktere (Harte Blockierung)

Blockierungsstufe: 🔴 Harte Blockierung — fast nicht umgehbar

Disney-Charaktere, bekannte Anime-Figuren und andere urheberrechtlich geschützte IPs lösen den PROHIBITED_CONTENT-Filter aus.

Besonderes Phänomen — Übermäßige Blockierung von Anime-Stilen:

In der Entwickler-Community wird häufig berichtet, dass Bilder im Anime-Stil aggressiver blockiert werden als realistische Stile. Bei derselben Eingabeaufforderung für ein Katzenbild wird der Anime-Stil abgefangen, während der realistische Stil durchgeht. Dies scheint eher ein überempfindlicher heuristischer Algorithmus zu sein als eine bewusste Strategie.

Kategorie 4: Jugendschutz (Absolute Blockierung)

Blockierungsstufe: 🔴🔴 Absolute harte Blockierung — keinerlei Ausnahmen

Die CSAM-Erkennung (Material über sexuellen Missbrauch von Kindern) ist die höchste Stufe aller Sicherheitsmechanismen und kann in keiner Konfiguration deaktiviert werden.

- Jegliche sexuell bezogenen Inhalte, die Minderjährige betreffen, werden absolut blockiert.

- Anfang 2025 stellten Medien fest, dass selbst bei Konten, die mit 13 Jahren registriert wurden, Sicherheitsbeschränkungen durch Multi-Turn-Dialoge umgangen werden konnten – Google hat dieses Problem bestätigt und behoben.

Kategorie 5: Bekannte Persönlichkeiten / Prominente (Großes Update am 27. Februar)

Blockierungsstufe: 🔴 Harte Blockierung — strenger seit Nano Banana 2

Dies ist der Bereich mit den größten Änderungen nach dem Start von Nano Banana 2 am 27. Februar 2026.

Zuvor richteten sich die Einschränkungen hauptsächlich gegen:

- Politische Persönlichkeiten

- Realistische Bilder von Stars und Prominenten

Neue Einschränkungen in Nano Banana 2:

- Die Generierung jeglicher erkennbarer Bilder bekannter Persönlichkeiten wird strenger blockiert.

- Das Umkleiden von Personen (Prominenten andere Kleidung geben) wird abgefangen.

- Gesichtstausch (das Gesicht eines Prominenten in andere Szenen einfügen) wird abgefangen.

- Selbst wenn Fotos von Prominenten zur Bearbeitung hochgeladen werden, werden diese erkannt und blockiert.

Typische Fehlermeldungen:

"I can't generate that image. It involves a celebrity in a distorted

or exaggerated context, which isn't allowed."

"I can't complete the modification of xxx."

💡 Hintergrund: Nach der Einführung leistungsfähigerer Bildbearbeitungsfunktionen in Gemini 2.5 Flash Ende 2025 entdeckten Forscher, dass das Hochladen von Prominentenfotos mit der Aufforderung zum „Neu-Vorstellen“ die Blockierung von Text-Eingabeaufforderungen umgehen konnte. Google behob diese Lücke innerhalb von 24 Stunden und verstärkte das gesamte Prominenten-Erkennungssystem in Nano Banana 2 weiter.

Kategorie 6: Finanzen / Änderung von Bestellinformationen (Neu seit 27. Februar)

Blockierungsstufe: 🟠 Richtlinienbasierte Blockierung — neu in Nano Banana 2

Dies ist eine neue Blockierungskategorie seit dem Start von Nano Banana 2.

Folgende Szenarien lösen nun Sicherheitsfilter aus:

- Ändern von Beträgen in Finanzdokumenten

- Manipulation von Bestellinformationen oder Rechnungsinhalten

- Fälschen von Bankauszügen

- Ändern von Schlüsselzahlen in Verträgen

Diese Art der Blockierung basiert auf den Klauseln zu Betrug und Täuschung in Googles „Richtlinien für die Nutzung generativer KI“. Obwohl sie in der öffentlichen technischen Dokumentation nicht als eigenständige Filterkategorie aufgeführt ist, wird sie in der Praxis effektiv abgefangen.

Kategorie 7: Umkleiden / Gesichtstausch (Deepfake-Prävention)

Blockierungsstufe: 🔴 Harte Blockierung

Gesichtstausch und virtuelles Umkleiden sind Kernanwendungen der Deepfake-Technologie. Gemini blockiert diese streng:

| Szenario | Nano Banana Pro (zuvor) | Nano Banana 2 (jetzt) |

|---|---|---|

| Kleidung einer Person auf einem Foto ändern | Teilweise verfügbar | Größtenteils blockiert |

| Gesicht von A auf B übertragen | Bereits blockiert | Vollständig blockiert |

| Umkleiden von Prominenten | Teilweise verfügbar | Vollständig blockiert |

| Umkleiden von Originalcharakteren | Normalerweise verfügbar | Normalerweise verfügbar |

Kategorie 8: Implizite sexuelle Anspielungen (Update am 27. Februar)

Blockierungsstufe: 🟠 Richtlinienbasierte Blockierung — Erkennungsfähigkeit deutlich verbessert

Nano Banana 2 hat die Fähigkeit zur Erkennung impliziter sexueller Anspielungen erheblich verbessert. Selbst wenn die Eingabeaufforderung keine offensichtlichen pornografischen Schlüsselwörter enthält, werden Inhalte mit sexuellem Unterton abgefangen:

- Zweideutige Beschreibungen der Körpersprache

- Suggestive Szeneneinstellungen

- Verführerische Beschreibungen der Kleidung

- Subtile sexuelle Anspielungen in Texten

Fehlermeldungen lauten meist:

"I can't complete xxx modification."

"This content is not permitted."

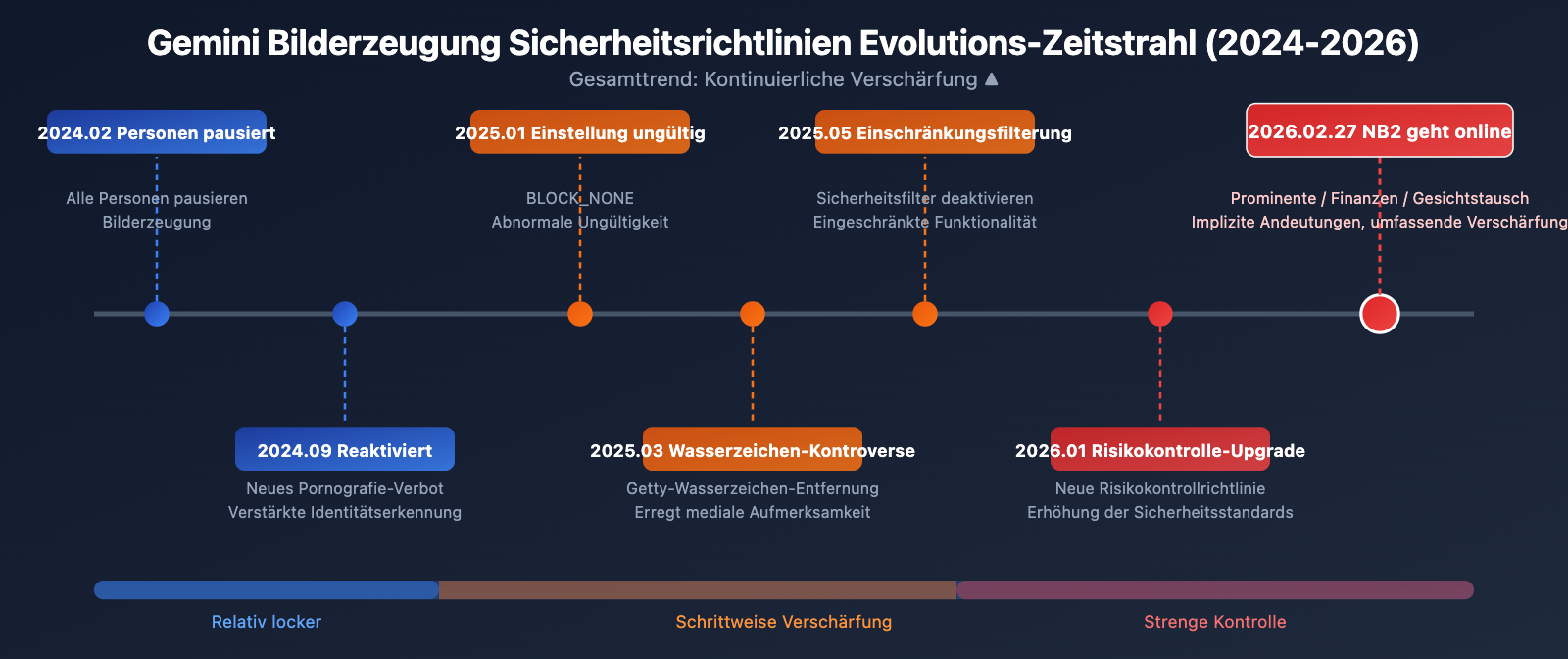

Nano Banana 2 Sicherheitsrichtlinien: Zeitliche Entwicklung

Das Verständnis der Entwicklung der Sicherheitsrichtlinien hilft Entwicklern, die aktuelle Logik hinter den Einschränkungen nachzuvollziehen:

| Zeit | Ereignis | Auswirkung |

|---|---|---|

| Februar 2024 | Google pausiert die Generierung von Personenbildern in Gemini | Öffentliche Kontroversen aufgrund ungenauer historischer Darstellungen |

| September 2024 | Personenerzeugung wieder aktiviert | Neues Verbot von pornografischen Inhalten, Verschärfung der Identitätsbeschränkungen |

| Januar 2025 | BLOCK_NONE-Einstellung wird unwirksam |

Entwickler berichten, dass Sicherheitseinstellungen fälschlicherweise überschrieben werden |

| März 2025 | Kontroverse um Wasserzeichen-Entfernung | Google verschärft Blockierungen nach Medienberichten |

| Mai 2025 | Deaktivierung von Sicherheitsfiltern eingeschränkt | BLOCK_NONE in bestimmten Konfigurationen nicht mehr verfügbar |

| Ende 2025 | Deepfake-Schwachstelle aufgedeckt | Umgehung von Textblockaden durch Foto-Uploads wurde behoben |

| 23. Januar 2026 | Google passt Risikokontroll-Richtlinien an | Allgemeine Sicherheitsstandards erneut angehoben |

| 27. Februar 2026 | Nano Banana 2 geht live | Umfassende Verschärfung bei Prominenten, Finanzen, Face-Swaps und impliziten Andeutungen |

Gesamttrend: Google hat die Sicherheitsbeschränkungen von 2024 bis 2026 kontinuierlich verschärft. Es ist nicht zu erwarten, dass sich dieser Trend in naher Zukunft umkehrt.

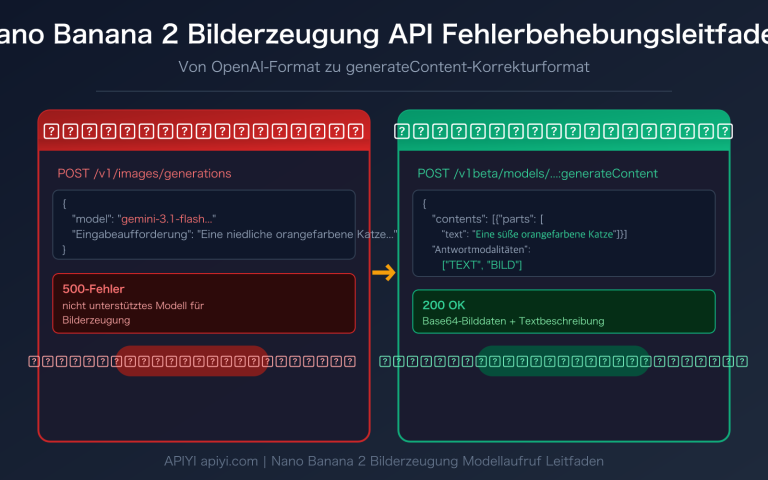

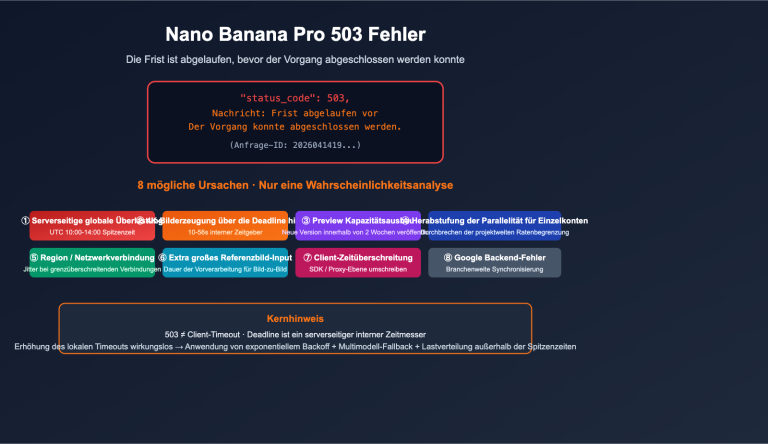

Nano Banana 2: Interpretation von API-Fehlercodes bei fehlgeschlagener Bilderzeugung

Wenn der Sicherheitsfilter von Nano Banana 2 die Bilderzeugung blockiert, gibt die API einen spezifischen finishReason-Wert zurück. Das korrekte Verständnis dieser Fehlercodes ist der erste Schritt zur Problemlösung.

| finishReason | Bedeutung | Auslöse-Ebene | Durch Konfiguration lösbar? |

|---|---|---|---|

SAFETY |

Schwellenwert für konfigurierbare Sicherheitskategorien erreicht | Layer 1 | ✅ Über safetySettings anpassbar |

IMAGE_SAFETY |

Inhalt des erzeugten Bildes verstößt gegen Richtlinien | Layer 2 | ❌ Nicht konfigurierbar |

PROHIBITED_CONTENT |

Verstoß gegen Richtlinien für verbotene Inhalte (IP/Urheberrecht) | Layer 2 | ❌ Nicht konfigurierbar |

OTHER |

Nicht eindeutig klassifizierte Blockierung (meist IP-bezogen) | Layer 2 | ❌ Nicht konfigurierbar |

Fehlersuche bei fehlgeschlagener Bilderzeugung

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # Einheitlicher Modellaufruf über den APIYI-Proxy-Dienst

)

try:

response = client.images.generate(

model="nano-banana-2",

prompt="your prompt here",

n=1,

size="1024x1024"

)

# Bild erfolgreich erhalten

print(response.data[0].url)

except Exception as e:

error_msg = str(e)

# Blockierungstyp basierend auf der Fehlermeldung bestimmen

if "SAFETY" in error_msg:

print("Layer 1 Sicherheitsfilter: Versuchen Sie, die safetySettings anzupassen")

elif "PROHIBITED_CONTENT" in error_msg:

print("Layer 2 Verbotener Inhalt: Möglicherweise Urheberrecht/IP betroffen")

elif "IMAGE_SAFETY" in error_msg:

print("Layer 2 Bildsicherheit: Erzeugter Inhalt verstößt gegen Richtlinien")

else:

print(f"Anderer Fehler: {error_msg}")

Beispiel für nativen Gemini-API-Aufruf anzeigen (inkl. Sicherheitseinstellungen)

import google.generativeai as genai

genai.configure(api_key="YOUR_API_KEY")

# Sicherheitseinstellungen konfigurieren — Hinweis: Dies betrifft nur Layer 1

safety_settings = [

{

"category": "HARM_CATEGORY_HARASSMENT",

"threshold": "BLOCK_ONLY_HIGH"

},

{

"category": "HARM_CATEGORY_HATE_SPEECH",

"threshold": "BLOCK_ONLY_HIGH"

},

{

"category": "HARM_CATEGORY_SEXUALLY_EXPLICIT",

"threshold": "BLOCK_MEDIUM_AND_ABOVE"

},

{

"category": "HARM_CATEGORY_DANGEROUS_CONTENT",

"threshold": "BLOCK_ONLY_HIGH"

}

]

model = genai.GenerativeModel(

model_name="gemini-2.0-flash-exp",

safety_settings=safety_settings

)

response = model.generate_content(

"Generate an image of a sunset over mountains"

)

# Ergebnisse der Sicherheitsfilterung prüfen

if response.candidates:

candidate = response.candidates[0]

print(f"Finish Reason: {candidate.finish_reason}")

if candidate.safety_ratings:

for rating in candidate.safety_ratings:

print(f" {rating.category}: {rating.probability}")

🚀 Schneller Tipp zur Fehlersuche: Wenn Sie einen Statuscode 200 erhalten, aber kein Bild zurückgegeben wird, liegt dies an einer Blockierung durch den Google-Sicherheitsfilter. Bei Aufrufen über die Plattform APIYI (apiyi.com) fungieren wir als transparenter Proxy und leiten die Originalantwort von Google direkt weiter, ohne zusätzliche Blockierungen vorzunehmen – wir möchten natürlich, dass jeder Kunde erfolgreich Bilder erzeugen kann.

Nano Banana 2 Inhaltssicherheit: Unsichtbarer SynthID-Wasserzeichenmechanismus

Zusätzlich zu den eingangs- und ausgangsseitigen Sicherheitsfiltern bettet Google in alle von Gemini erzeugten Bilder ein unsichtbares SynthID-Wasserzeichen ein:

| Merkmal | Beschreibung |

|---|---|

| Einbettungsmethode | Unsichtbares Wasserzeichen auf Pixelebene, für das menschliche Auge nicht wahrnehmbar |

| Robustheit | Bleibt auch nach Zuschneiden, Skalieren, Farbanpassung oder Screenshots wirksam |

| Entfernungsaufwand | Das Entfernen des Wasserzeichens würde die Bildqualität erheblich verschlechtern |

| Geltungsbereich | Alle von Gemini erzeugten Bilder, unabhängig von der Preisstufe |

| Verifizierung | Dritte können über SynthID prüfen, ob ein Bild von einer KI generiert wurde |

Bemerkenswerter Widerspruch: Während Google seine eigenen Bilder mit unentfernbaren Wasserzeichen versieht, wurde festgestellt, dass seine Modelle in der Lage sind, Wasserzeichen von Bildern anderer zu entfernen – diese Asymmetrie löste im März 2025 weitreichende Diskussionen aus.

Nano Banana 2: Strategien bei Fehlern bei der Bilderzeugung

Für verschiedene Arten von Fehlern bei der Bilderzeugung können Entwickler unterschiedliche Strategien anwenden:

Anpassbare Szenarien (Layer 1)

Wenn der Fehlercode SAFETY lautet, bedeutet dies, dass ein konfigurierbarer Filter der Ebene 1 (Layer 1) ausgelöst wurde:

- safetySettings anpassen: Ändern Sie die Schwellenwerte der relevanten Kategorien von

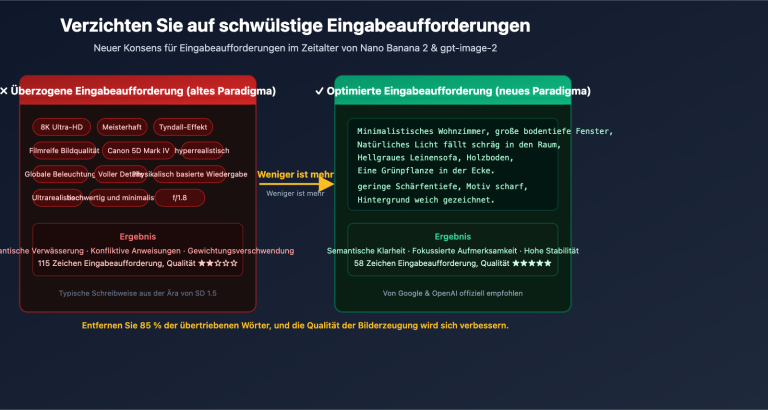

BLOCK_MEDIUM_AND_ABOVEaufBLOCK_ONLY_HIGH. - Eingabeaufforderung optimieren: Vermeiden Sie sensible Begriffe, die Sicherheitskategorien auslösen könnten.

- Schrittweise Erzeugung: Zerlegen Sie komplexe Szenarien in mehrere einfache Schritte.

Nicht anpassbare Szenarien (Layer 2)

Wenn der Fehlercode IMAGE_SAFETY, PROHIBITED_CONTENT oder OTHER lautet:

- Kreative Ausrichtung anpassen: Vermeiden Sie sensible Themen wie Prominente oder urheberrechtlich geschützte Charaktere.

- Originalcharaktere verwenden: Entwerfen Sie eigene Charaktere, um IP-Konflikte zu vermeiden.

- Szenarien vereinfachen: Reduzieren Sie komplexe Elemente, die die Sicherheitsprüfung auslösen könnten.

- Bildeingabe prüfen: Stellen Sie bei der Bild-zu-Bild-Erzeugung sicher, dass das Eingabebild keine Gesichter von Prominenten enthält.

Spezielle Empfehlungen für Entwickler von B2C-Produkten

Wenn Sie Produkte für Endnutzer entwickeln, wird Folgendes dringend empfohlen:

- Vorgeschaltete Inhaltsprüfung: Führen Sie eine Vorfilterung der Benutzereingaben durch, bevor Sie den Modellaufruf tätigen.

- Benutzerfreundliche Fehlermeldungen: Übersetzen Sie die englischen API-Fehlermeldungen in nutzerfreundliche deutsche Hinweise.

- Retry-Strategie: Bei

SAFETY-Fehlern der Ebene 1 kann nach Anpassungen ein erneuter Versuch unternommen werden; bei Fehlern der Ebene 2 sollte kein Retry erfolgen. - Nutzungsüberwachung: Anfragen, die vom Sicherheitsfilter blockiert werden, verbrauchen dennoch das API-Kontingent.

💰 Kostenhinweis: Anfragen, die vom Sicherheitsfilter blockiert werden, liefern zwar kein Bild zurück, verursachen aber dennoch API-Aufrufgebühren. Über die Plattform APIYI (apiyi.com) können Sie detaillierte Aufrufprotokolle einsehen, um Ihre Eingabeaufforderungen zu optimieren und unnötige Aufrufe zu reduzieren.

Wenn Sie B2C-Produkte entwickeln, empfehlen wir diesen ausführlicheren Leitfaden zur Fehlerbehandlung: „Leitfaden zur Fehlerbehandlung der Gemini 3 Pro Image Preview API“ xinqikeji.feishu.cn/wiki/Rslqw724YiBwlokHmRLcMVKHnRf

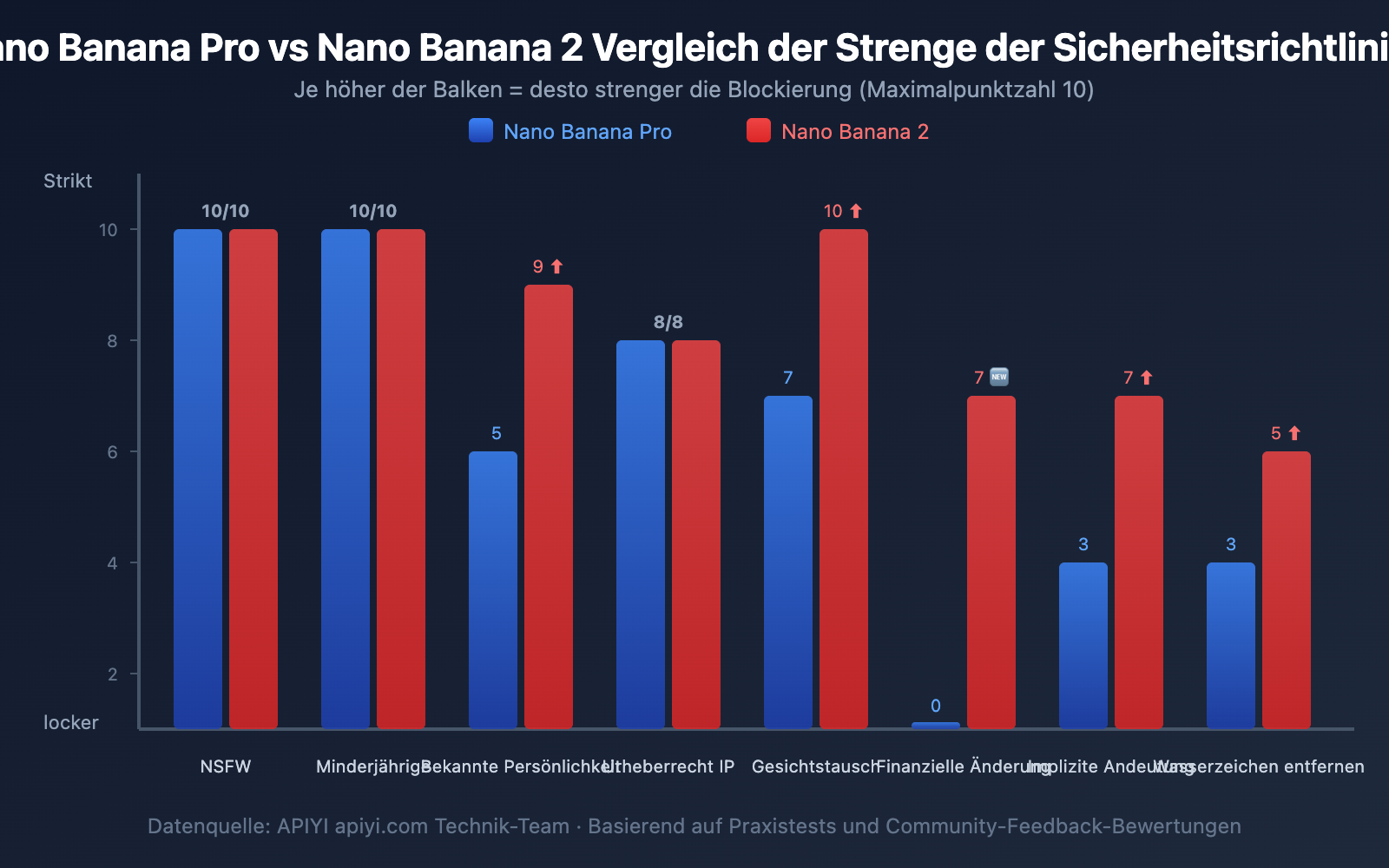

Vergleich der Inhaltssicherheit: Nano Banana Pro vs. Nano Banana 2

| Sicherheitsdimension | Nano Banana Pro | Nano Banana 2 | Änderung |

|---|---|---|---|

| NSFW / Erotische Inhalte | Strenge Blockierung | Strenge Blockierung | Gleichbleibend |

| Generierung prominenter Personen | Teilweise Blockierung | Vollständige Blockierung | ⬆️ Deutlich verschärft |

| Bearbeitung von Kleidung (Personen) | Teilweise verfügbar | Größtenteils blockiert | ⬆️ Deutlich verschärft |

| Gesichtstausch (Face Swap) | Blockiert | Komplette Blockierung | ⬆️ Leicht verschärft |

| Änderung von Finanzinformationen | Keine explizite Blockierung | Neue Blockierung hinzugefügt | 🆕 Neue Einschränkung |

| Implizite sexuelle Anspielungen | Teilweise Erkennung | Verbesserte Erkennung | ⬆️ Erkennungsfähigkeit gesteigert |

| Urheberrechtlich geschützte IPs | Blockiert | Blockiert | Gleichbleibend |

| Jugendschutz | Absolute Blockierung | Absolute Blockierung | Gleichbleibend |

| Entfernung von Wasserzeichen | Teilweise verfügbar | Schrittweise Verschärfung | ⬆️ Kontinuierliche Verschärfung |

| Fehlinterpretationen im Anime-Stil | Vorhanden | Vorhanden | Gleichbleibend (verbesserungsbedürftig) |

Häufig gestellte Fragen (FAQ)

Q1: Statuscode 200, aber kein Bild zurückgegeben – was ist die Ursache?

Der Statuscode 200 bedeutet, dass die API-Anfrage an sich erfolgreich war, die Bilderzeugung jedoch vom Layer-2-Sicherheitsfilter von Google abgefangen wurde. Bei Aufrufen über die Plattform APIYI (apiyi.com) leiten wir als transparenter Proxy die Originalantwort von Google direkt weiter, ohne zusätzliche Einschränkungen vorzunehmen. Überprüfen Sie das Feld finishReason in den zurückgegebenen Daten, um den genauen Grund für die Blockierung zu erfahren.

Q2: Warum wird das Bild trotz der Einstellung BLOCK_NONE blockiert?

BLOCK_NONE kann nur die probabilistische Blockierung in Layer 1 (konfigurierbare Eingabefilterung) deaktivieren. Die Filter von Layer 2 (nicht konfigurierbare Ausgabefilterung) wie IMAGE_SAFETY, PROHIBITED_CONTENT oder CSAM sind immer aktiv und können über keine API-Parameter deaktiviert werden. Dies entspricht dem Design von Google und ist kein Fehler.

Q3: Blockiert Nano Banana 2 mehr Inhalte als Nano Banana Pro?

Ja. Seit dem Start von Nano Banana 2 am 27. Februar 2026 hat Google die Sicherheitsrichtlinien in vier Bereichen deutlich verschärft: bekannte Persönlichkeiten, Manipulation von Finanzinformationen, Kleiderwechsel/Gesichtstausch bei Personen sowie implizite sexuelle Anspielungen. Wenn Eingabeaufforderungen, die zuvor mit Nano Banana Pro funktionierten, nun fehlschlagen, liegt das höchstwahrscheinlich an diesen neuen Einschränkungen. Wir empfehlen, die genaue Ursache über die Aufrufprotokolle auf APIYI (apiyi.com) zu analysieren.

Q4: Warum werden Bilder im Anime-Stil häufiger blockiert?

Dies ist ein Problem, das in der Entwickler-Community häufig berichtet wird. Bei identischer Eingabeaufforderung wird der Anime-Stil blockiert, während der realistische Stil durchgeht. Dies scheint an einem übermäßig sensiblen heuristischen Algorithmus im Sicherheitsfilter zu liegen, der möglicherweise eher auf Urheberrechte oder IP-Schutz anspringt. Es gibt bisher keine offizielle Erklärung, aber es handelt sich dabei nicht um eine beabsichtigte strategische Einschränkung.

Q5: Wie unterscheide ich zwischen Einschränkungen von APIYI und Google?

APIYI fungiert als transparenter Proxy und leitet die Originalantworten von Google direkt weiter, ohne zusätzliche Inhaltsbeschränkungen einzuführen. Wenn eine Bilderzeugung fehlschlägt, ist dies zu 100 % auf die Rückmeldung der Sicherheitsfilter von Google zurückzuführen. APIYI möchte natürlich, dass jeder Kunde erfolgreich Bilder erzeugen kann. Sie können dies bestätigen, indem Sie die detaillierten API-Aufrufprotokolle auf der Plattform apiyi.com einsehen.

Zusammenfassung

Die Inhalts-Sicherheitsmechanismen von Nano Banana 2 haben sich von 2024 bis 2026 kontinuierlich weiterentwickelt, wobei der allgemeine Trend zu einer stetigen Verschärfung geht. Für Entwickler bedeutet das:

- Die Zwei-Schichten-Architektur verstehen ist die Basis zur Lösung von Problemen bei der Bilderzeugung — Layer 1 ist anpassbar, Layer 2 nicht.

- Strategieänderungen im Blick behalten — Die Aktualisierungen im Januar und Februar 2026 haben signifikante neue Einschränkungen mit sich gebracht.

- Eingabeaufforderungen optimieren ist effektiver als das Anpassen von Sicherheitseinstellungen — die meisten Blockierungen finden in Layer 2 statt.

- Fehlerbehandlung implementieren — Besonders bei Endkundenprodukten müssen verschiedene Sicherheits-Interceptionen elegant abgefangen werden.

Wir empfehlen, API-Aufrufe für Nano Banana 2 über die Plattform APIYI (apiyi.com) zu testen. Die Plattform bietet eine einheitliche Schnittstelle und detaillierte Protokolle, um die spezifischen Ursachen für fehlgeschlagene Bilderzeugungen schnell zu identifizieren.

📝 Autor: APIYI Team | APIYI Technik-Team

🔗 Technischer Austausch: Besuchen Sie apiyi.com für weitere Leitfäden zur Nutzung von KI-Modellen und technischen Support.

📅 Aktualisierungsdatum: 27. Februar 2026