In der Welt der KI-generierten Bilder halten viele Kreative immer noch an einem „Prompt-Formel-Set fest, das von Stable Diffusion 1.5 geerbt wurde“. Hier ein typisches Beispiel für einen solch schwülstigen Prompt:

In der Glasvitrine eine weiße Verdunkelungskette, extrem realistischer Innenraum, meisterhafte Licht- und Schattenästhetik, natürliches Licht fällt sanft durch große bodentiefe Fenster, weicher Kontrast von Licht und Schatten, feine Lichtschichtungen, Tyndall-Effekt, echte physikalische Licht- und Schatten-Wiedergabe, globale Beleuchtung, weiche Schatten, hochdetaillierte Textur, 8K Ultra-HD, Filmqualität, realistische Materialtexturen, saubere und transparente Raumatmosphäre, professionelle Innenfotografie, Canon 5D Mark IV Aufnahme, f/1.8 Blende, echte Textur, keine Überbearbeitung, gehobener Minimalismus, gemütlich und warm, detailreich. 8K HD-Auflösung, filmischer Realismus, echte Fotografie-Stil, fotorealistisch, transparente Textur, maximale Details ——

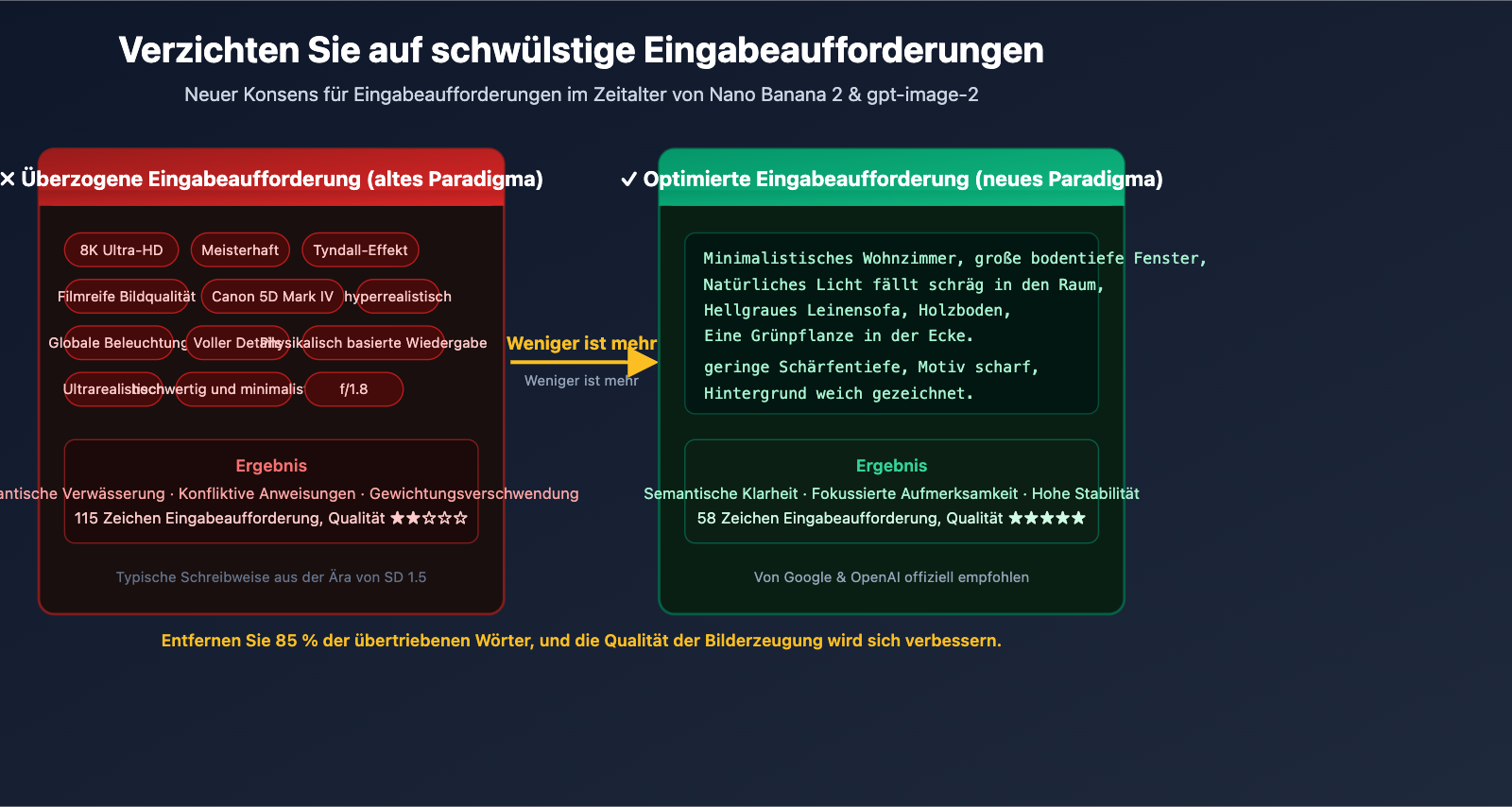

Dieser Prompt enthält 23 Adjektive, 8 Fachbegriffe und 3 Qualitätswiederholungen. Im SD-Ökosystem vor 2024 mag diese Art zu schreiben eine gewisse Wirkung gehabt haben. Doch in der Ära von Nano Banana 2 und gpt-image-2 im Jahr 2026 ist ein solcher „schwülstiger Prompt“ nicht nur überflüssig, sondern er verschlechtert sogar die Bildqualität.

Dieser Artikel erläutert ausgehend von den grundlegenden Unterschieden in den Trainingsdaten, warum sich die Zeiten geändert haben, und liefert 7 sofort anwendbare Prinzipien zur Optimierung Ihrer Eingabeaufforderungen, damit Sie mit kürzeren und präziseren Beschreibungen bessere Ergebnisse erzielen.

I. Warum übertriebene Eingabeaufforderungen in der Ära von Nano Banana 2 nicht mehr funktionieren

Um diesen Wandel zu verstehen, müssen wir die historische Entwicklung der Eingabeaufforderungen (Prompts) betrachten.

1.1 Die historischen Wurzeln: Die Ära der Danbooru-Tags

Dass Begriffe wie "8K", "masterpiece", "best quality" oder "ultra realistic" einst als "magische Schlüsselwörter" galten, hatte einen sehr konkreten technischen Grund: Diese Begriffe sind echte Tags der Bilddatenbank Danbooru.

Die Trainingsdaten von Stable Diffusion 1.5 und seinen Ablegern (NovelAI, Waifu Diffusion usw.) enthielten eine Vielzahl von Bildern aus Danbooru, die von Nutzern beim Hochladen mit Qualitäts-Tags wie masterpiece oder best quality versehen wurden. Das Modell lernte folgende Korrelation:

Der Begriff "masterpiece" ⟷ Der Stil jener Bilder aus dem Trainingsdatensatz, die als masterpiece markiert waren

Daher war es bei SD 1.5 tatsächlich effektiv, (masterpiece:1.2), (best quality:1.2), 8k, ultra detailed zu stapeln – man rief damit die Bildverteilung ab, die im Trainingsdatensatz als "hochwertig" eingestuft war.

1.2 Das Trainingsparadigma hat sich geändert: Von Tags zu natürlicher Sprache

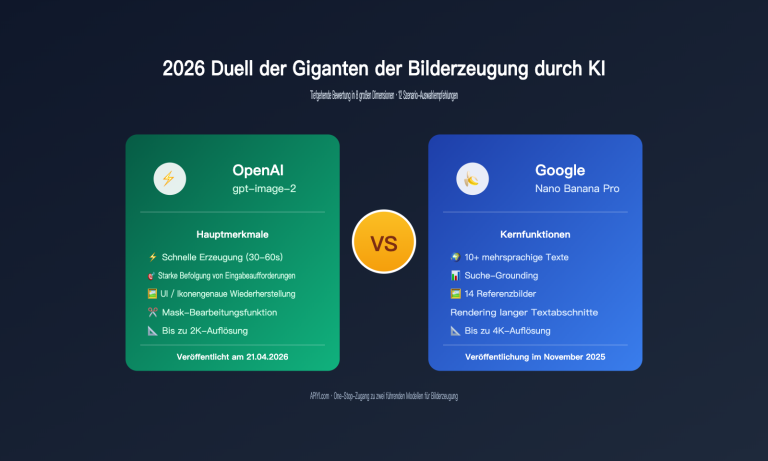

Bei modernen Bildmodellen wie Nano Banana 2 (gemini-3.1-flash-image-preview), Nano Banana Pro (gemini-3-pro-image-preview), gpt-image-2 sowie Stable Diffusion 3.5 hat sich das Trainingsparadigma grundlegend gewandelt:

| Vergleichsdimension | Ära SD 1.5 | Ära Nano Banana 2 / gpt-image-2 |

|---|---|---|

| Annotation der Trainingsdaten | Tag-Listen im Danbooru-Stil | Bildbeschreibungen (Captions) in natürlicher Sprache |

| Text-Encoder | CLIP 77-Token-Limit | Multimodales Großes Sprachmodell (Kontext von zehntausenden Token) |

| Verständnisweise | Tag-Abgleich | Semantisches Verständnis + Schlussfolgerung |

| Optimale Eingabeaufforderung | Aneinanderreihung von Schlüsselwörtern | Narrative Szenenbeschreibung |

| Gewichtung von "Buzzwords" | Effektiv, ruft Stilverteilung ab | Semantische Verwässerung, teils sogar negativ |

| Empfohlene Länge | 30–80 Token | 50–500 Wörter in natürlichen Sätzen |

Google schreibt in seinem offiziellen Leitfaden für Nano Banana-Eingabeaufforderungen ausdrücklich: "Nano Banana 2 versteht beschreibende Sätze, kein durch Kommas getrenntes Schlüsselwort-Spamming."

OpenAI weist im offiziellen Cookbook für gpt-image-2 ebenfalls darauf hin: "detaillierte Kameraspezifikationen können vage interpretiert werden" – technische Parameter wie "Canon 5D Mark IV, f/1.8" werden vom Modell nicht physikalisch simuliert, sondern lediglich als grober Hinweis auf den Bildstil verstanden.

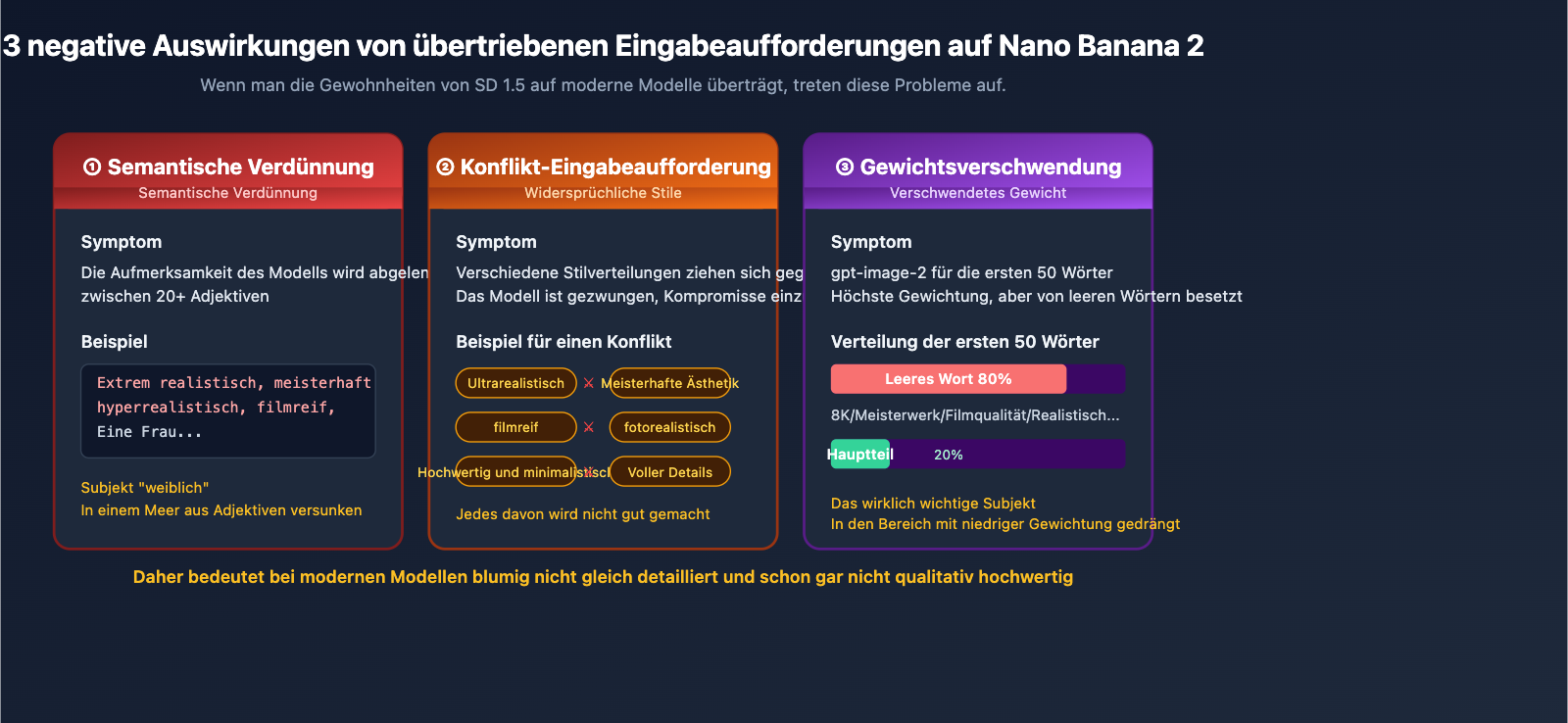

1.3 Drei negative Auswirkungen übertriebener Eingabeaufforderungen bei modernen Modellen

Wer die Gewohnheiten aus der SD 1.5-Ära auf Nano Banana 2 überträgt, stößt auf folgende Probleme:

Negativer Effekt 1: Semantische Verwässerung. Das Modell muss aus 20 Adjektiven das eigentliche Subjekt und die Aktion herausfiltern; die Aufmerksamkeit wird zerstreut.

Negativer Effekt 2: Widersprüchliche Anweisungen. Zwischen "extrem realistisch" + "meisterhafte Ästhetik" + "hochwertiger Minimalismus" + "filmreif" + "echte Fotografie" bestehen subtile Stilkonflikte. Das Modell muss zwischen verschiedenen Verteilungen abwägen, was oft dazu führt, dass kein Stil wirklich überzeugt.

Negativer Effekt 3: Verschwendung von Gewichtung. Der offizielle Leitfaden von OpenAI besagt, dass gpt-image-2 den ersten 50 Wörtern eine höhere Gewichtung beimisst. Wenn diese jedoch nur aus leeren Phrasen wie "extrem realistisch, meisterhaft, 8K HD" bestehen, wird die eigentliche Beschreibung des Motivs an eine Stelle mit geringerer Gewichtung gedrängt.

二、Analyse einer typischen, überladenen Eingabeaufforderung: Was ist Signal, was ist Rauschen?

Nehmen wir die 115 Zeichen lange, überladene Eingabeaufforderung vom Anfang als Beispiel und klassifizieren die Elemente:

2.1 Signalwörter: Beschreibungen, die das Modell wirklich nutzen kann

| Originalbegriff | Kategorie | Grund für die Beibehaltung |

|---|---|---|

| Glasvitrine mit weißer Verdunkelungskette | Konkretes Objekt + Aktion | Klare visuelle Elemente |

| Innenraum | Szene | Notwendige räumliche Einordnung |

| Natürliches Licht durch bodentiefe Fenster | Lichtquelle | Konkretes Lichtdesign |

| f/1.8 Blende | Kompositions-Hinweis | Modell interpretiert dies als "geringe Schärfentiefe" |

Gesamt: Etwa 4-5 echte Signalwörter.

2.2 Rauschwörter: Semantisch leere oder redundante Modifikatoren

| Originalbegriff | Rauschtyp | Problem |

|---|---|---|

| Extrem realistisch | Vages Adjektiv | "Extrem" ist nicht quantifizierbar |

| Meisterhafte Lichtästhetik | Marketing-Slogan | Modell hat keine Entsprechung |

| Sanfter Kontrast | Doppelt gemoppelt | Redundant zu "natürlichem Licht" |

| Feine Lichtschichten | Wie oben | Wiederholung |

| Tyndall-Effekt | Fachbegriff, aber missbraucht | Nur bei Staub/Nebel sinnvoll |

| Physikalisch korrektes Rendering | 3D-Rendering-Jargon | Sinnlos für Fotografie-Szenen |

| Globale Beleuchtung | 3D-Rendering-Jargon | Wie oben |

| Weiche Schatten | Redundant | Wiederholung |

| Hochdetaillierte Textur | Qualitätsbegriff | Keine spezifische Verteilung |

| 8K Ultra-HD | Auflösungsbegriff | Irrelevant für API-Parameter |

| Kino-Qualität | Slogan | Keine operative Bedeutung |

| Lebensechte Texturen | Vager Qualitätsbegriff | Material nicht spezifiziert |

| Saubere, transparente Raumatmosphäre | Adjektiv-Haufen | Keine konkrete Anweisung |

| Professionelle Innenfotografie | Redundantes Stil-Tag | Wiederholung |

| Canon 5D Mark IV | Kameramarke | Modell simuliert keine Physik |

| Echte Textur | Wiederholung | Mehrfach wiederholt |

| Kein übertriebenes Rendering | Negative Anweisung | Wird vom Modell oft ignoriert |

| Hochwertig minimalistisch | Marketing-Wort | Keine visuelle Anweisung |

| Gemütlich und warm | Emotionswort | Zu vage |

| Detailreich | Qualitätsbegriff | Redundant |

| 8K HD-Auflösung | Wiederholung | Starke Redundanz |

| Kino-Realismus | Wiederholung | Starke Redundanz |

| Echter Fotostil | Wiederholung | Starke Redundanz |

| Hyperrealistisch | Wiederholung | Starke Redundanz |

| Transparente Textur | Wiederholung | Starke Redundanz |

| Maximale Details | Wiederholung | Starke Redundanz |

Gesamt: Etwa 26 Rauschwörter, ein Anteil von fast 85 %.

2.3 Umschreiben: Signale behalten, Rauschen entfernen

Nachdem das gesamte Rauschen entfernt wurde, lässt sich die Eingabeaufforderung auf unter 20 % der Originallänge reduzieren, wobei die Semantik sogar klarer wird:

Ein moderner Innenraum, eine Glasvitrine vor bodentiefen Fenstern,

an der Vitrine hängt eine weiße Verdunkelungskette, natürliches Licht

fällt schräg ein und wirft sanfte Lichtflecken auf den Holzboden.

85mm-Objektiv, geringe Schärfentiefe, Glasreflexionen im Vordergrund

scharf, Hintergrund leicht unscharf.

Diese 61 Zeichen lange Eingabeaufforderung liefert auf Nano Banana 2 deutlich bessere Ergebnisse als die 115 Zeichen lange, überladene Version. Der Grund ist einfach: Jedes Wort enthält eine klare visuelle Anweisung.

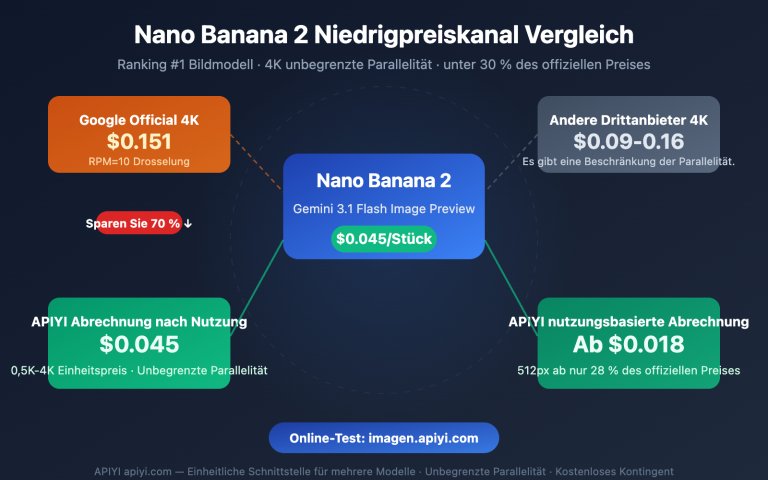

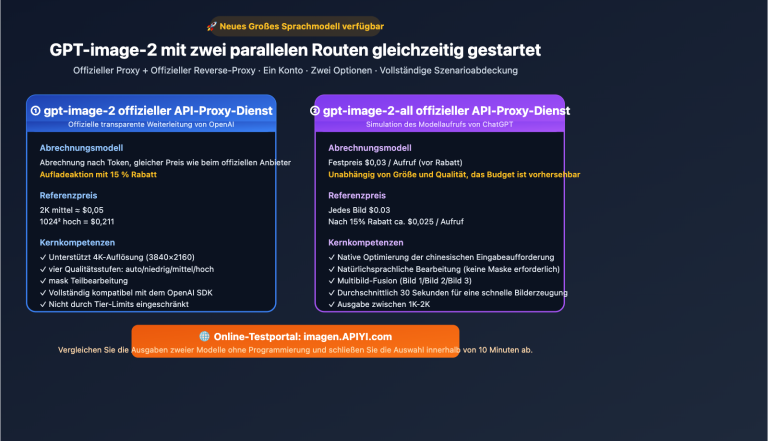

🎯 Praxistipp: Wir empfehlen, auf APIYI (apiyi.com) mit demselben API-Schlüssel die überladene Version mit der prägnanten Version zu vergleichen. Lassen Sie über

gemini-3-pro-image-previewjeweils 5 Durchläufe laufen, um die Unterschiede direkt zu sehen. Die Plattform unterstützt die einheitliche API-Anbindung gängiger Modelle wie Nano Banana 2 oder gpt-image-2 für schnelle Vergleiche.

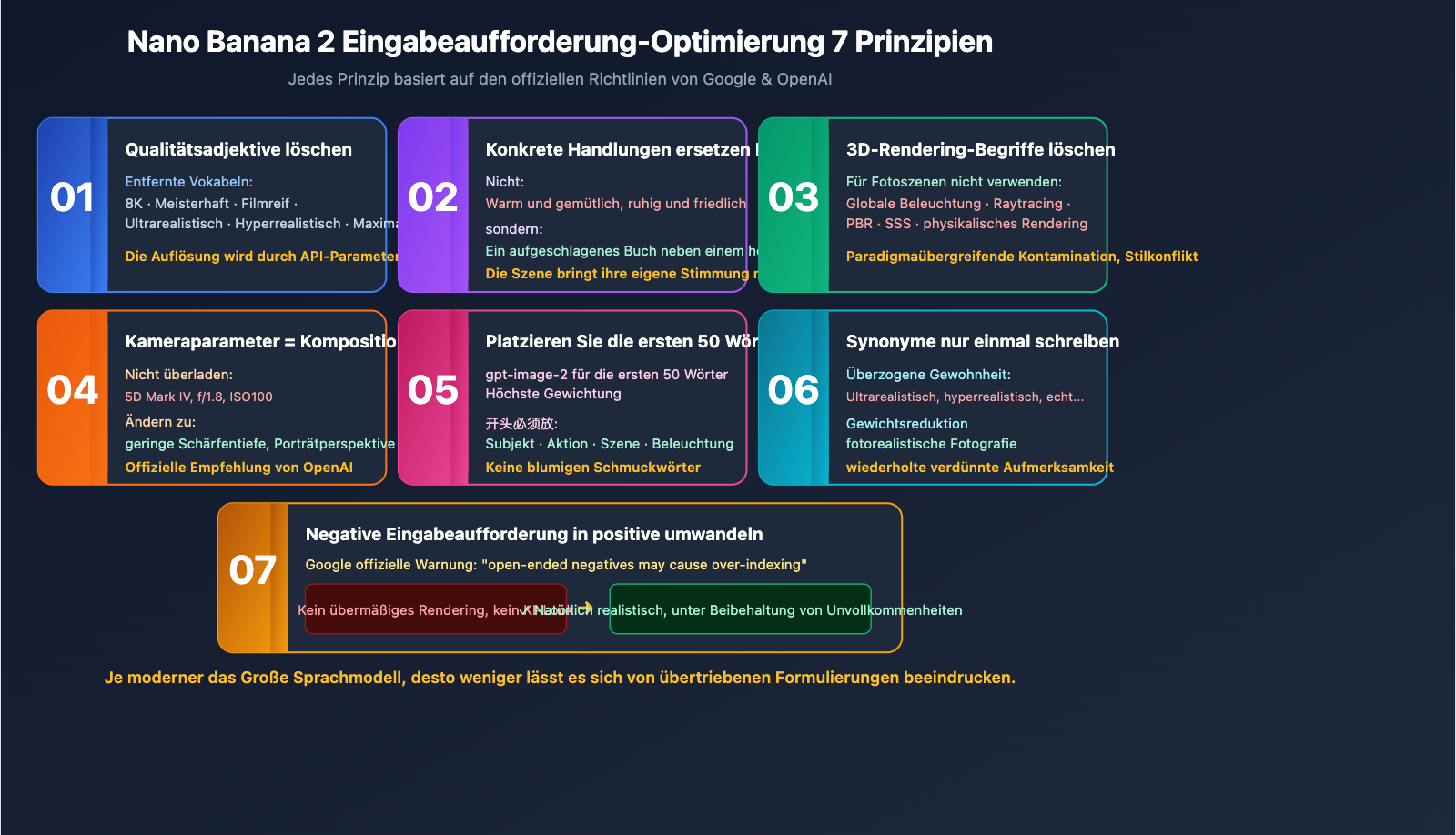

III. 7 Prinzipien zur Optimierung von Eingabeaufforderungen in der Ära von Nano Banana 2 und gpt-image-2

Hier sind 7 Prinzipien, die auf offiziellen Dokumentationen von Google und OpenAI sowie umfangreichen Praxistests basieren, sortiert nach Wichtigkeit.

3.1 Prinzip 1: Löschen Sie alle Qualitätsadjektive

Folgende Begriffe können sicher entfernt werden:

8K Ultra-HD/4K/HDMeisterwerk/Beste Qualität/MeisterhaftExtrem realistisch/HyperrealistischKino-Qualität/Cinematic(es sei denn, das Bildformat ist gemeint)Detailreich/Ultra-detailliertHochwertig/Professionell(ohne konkretes Objekt)

Diese Begriffe waren in der SD 1.5-Ära nützlich, um Trainingsdaten abzurufen, sind aber bei Nano Banana 2 nur noch semantisches Rauschen. Wenn Sie die Auflösung steuern müssen, tun Sie dies über API-Anfrageparameter, nicht über die Eingabeaufforderung.

3.2 Prinzip 2: Nano Banana 2 braucht konkrete Aktionen, keine vagen Emotionen

❌ Anhäufung von Emotionswörtern:

Gemütlich, friedlich, lebendig, traumhaft schön, idyllisch

✅ Konkrete Szene:

Eine halbe Tasse dampfender Kaffee auf einem alten Holztisch, daneben ein aufgeschlagenes Buch,

die Seiten werden von Sonnenlicht beleuchtet, das schräg durch das Fenster fällt.

Das Modell leitet Emotionen natürlich aus der Szene ab; Sie müssen ihm nicht explizit sagen, dass es "gemütlich" sein soll.

3.3 Prinzip 3: Löschen Sie alle 3D-Rendering-Begriffe (außer bei echtem 3D-Rendering)

In Fotografie- oder Realismus-Szenen sind folgende Begriffe eine "Cross-Paradigm-Verschmutzung" – sie stammen aus dem 3D-Bereich und gehören nicht zur Sprache der Fotografie:

Globale Beleuchtung/GIRaytracingPhysikalisch korrektes RenderingSSS/Subsurface ScatteringPBR-Materialien

Diese Begriffe in eine Fotografie-Eingabeaufforderung einzubauen, zwingt das Modell dazu, zwischen zwei Stilen zu wechseln, was oft zu Ergebnissen führt, die weder wie ein Foto noch wie ein Rendering aussehen.

3.4 Prinzip 4: Kameraparameter dienen der Komposition, nicht der physikalischen Simulation

Offizieller Leitfaden von OpenAI: "Detaillierte Kameraspezifikationen werden oft locker interpretiert; nutzen Sie sie daher eher für den allgemeinen Look und die Komposition als für eine exakte physikalische Simulation."

Übersetzt: Wenn Sie Canon 5D Mark IV, f/1.8 schreiben, simuliert das Modell nicht die CMOS-Eigenschaften oder die physikalische Formel der Schärfentiefe. Es erkennt lediglich zwei Signale: "Es soll wie ein professionelles Foto aussehen" + "geringe Schärfentiefe".

Daher ist es effizienter, direkt die Kompositionsabsicht zu formulieren:

❌ Anhäufung von Kameramodellen:

Aufgenommen mit Canon 5D Mark IV, f/1.8 Blende, 50mm Objektiv, ISO 100, RAW-Format

✅ Ausdruck der Kompositionsabsicht:

Geringe Schärfentiefe, Motiv scharf, Vordergrund unscharf, Porträtperspektive

Die Wortzahl sinkt von 32 auf 18, und das Modell versteht die Anweisung präziser.

3.5 Prinzip 5: Platzieren Sie Kerninformationen in die ersten 50 Wörter bei gpt-image-2

OpenAI hat klargestellt, dass gpt-image-2 die ersten 50 Wörter stärker gewichtet. Das bedeutet, der Anfang muss die "wichtigsten Informationen" enthalten – Subjekt, Aktion, Szene – und nicht die "schönsten Verzierungen" wie Qualitäts- oder Stil-Tags.

❌ Falsche Gewichtung (Verzierungen zuerst):

8K Ultra-HD, meisterhafte Kino-Qualität, professionelle Fotografie mit Canon 5D Mark IV,

eine Frau in einem weißen Kleid steht am Strand...

Die ersten 50 Wörter bestehen nur aus leeren Begriffen; das eigentliche Subjekt ("Frau, weißes Kleid, Strand") wird nach hinten gedrängt.

✅ Optimierte Gewichtung (Subjekt zuerst):

Eine Frau in einem weißen Kleid steht auf einem Felsen am Strand und blickt auf den Horizont,

der Wind weht durch ihr langes Haar, abendliches goldenes Licht von hinten, geringe Schärfentiefe.

Die ersten 50 Wörter enthalten nun Subjekt, Aktion, Szene, Licht und Komposition – alle wichtigen Signale befinden sich im Bereich hoher Gewichtung.

3.6 Prinzip 6: Nano Banana 2 benötigt keine Synonym-Wiederholungen

Ein typisches Merkmal überladener Eingabeaufforderungen ist die Angst, das Modell könnte einen nicht verstehen, weshalb man dieselbe Bedeutung dreimal schreibt:

Extrem realistisch, hyperrealistisch, echter Fotostil, lebensecht, echte Textur

Die semantische Verständnisleistung von Nano Banana 2 übertrifft SD 1.5 bei weitem; es extrahiert die Absicht problemlos aus einer einmaligen Beschreibung. Synonyme zu wiederholen führt nur dazu:

- Die Aufmerksamkeit zu verwässern.

- Das Token-Budget zu belasten.

- Die Eingabeaufforderung unprofessionell wirken zu lassen.

Prinzip: Ein Konzept wird nur einmal ausgedrückt, und zwar mit dem präzisesten Wort.

3.7 Prinzip 7: Negative Anweisungen durch positive ersetzen

Überladene Eingabeaufforderungen enthalten oft negative Anweisungen wie "kein übertriebenes Rendering, kein KI-Look, keine Verzerrungen". Der offizielle Leitfaden von Google Gemini 3 warnt ausdrücklich:

"Zu allgemein gehaltene negative Anweisungen können dazu führen, dass das Modell sich zu stark auf diese Anweisung konzentriert und grundlegende Logik vernachlässigt… ersetzen Sie pauschale Verneinungen durch explizite positive Anweisungen."

Kurz gesagt: Anstatt dem Modell zu sagen, was es "nicht" tun soll, sagen Sie ihm, was es "tun" soll.

| ❌ Negative Anweisung | ✅ Positive Umschreibung |

|---|---|

| Kein übertriebenes Rendering | Natürlicher, realistischer Stil |

| Kein KI-Look | Echte fotografische Textur, natürliche Unvollkommenheiten beibehalten |

| Keine Verzerrungen | Proportionen korrekt, Fingerstruktur natürlich |

| Kein Text | Rein visuelles Bild, keine Textelemente |

| Kein Cartoon | Realistischer Fotostil |

IV. Praxisvergleich: Prompt-Optimierung bei Nano Banana 2 und gpt-image-2

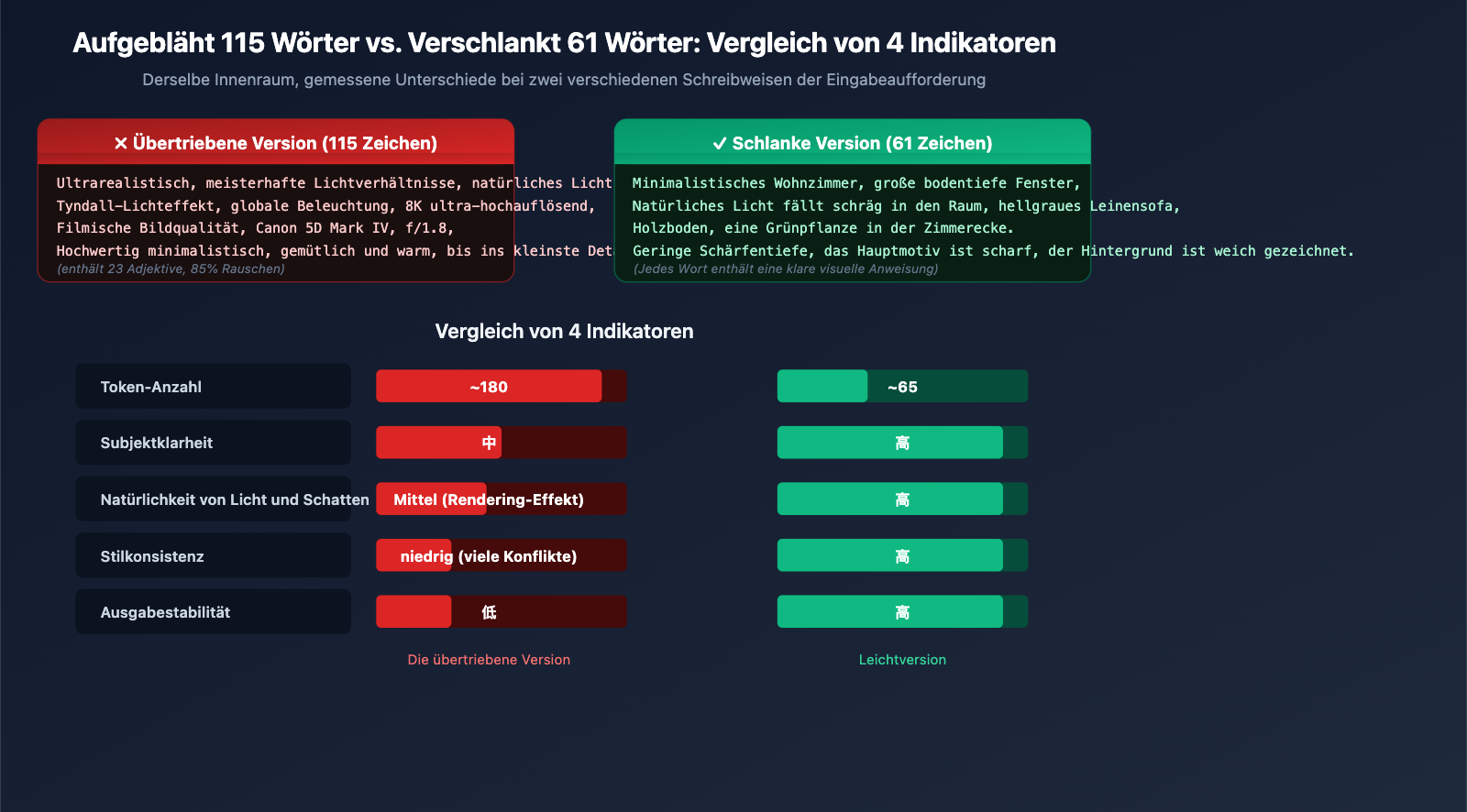

4.1 Szenario 1: Innenarchitektur-Fotografie

Überladene Version (115 Wörter):

Extrem realistische Innenarchitektur, meisterhafte Lichtästhetik, natürliches Licht fällt sanft durch große bodentiefe Fenster,

weicher Kontrast zwischen Licht und Schatten, detaillierte Lichtschichten, Tyndall-Effekt, physikalisch korrektes Licht-Rendering,

globale Beleuchtung, weiche Schatten, hochdetaillierte Texturen, 8K-Ultra-HD, Kinoqualität,

lebensechte Materialtexturen, saubere und transparente Raumatmosphäre, professionelle Innenfotografie,

aufgenommen mit Canon 5D Mark IV, f/1.8 Blende, echte Textur, kein übermäßiges Rendering,

hochwertiger Minimalismus, gemütlich und warm, detailreich.

Optimierte Version (58 Wörter):

Minimalistisches Wohnzimmer, große bodentiefe Fenster, natürliches Licht fällt schräg in den Raum,

hellgraues Leinensofa, Holzboden, eine Topfpflanze in der Ecke.

Geringe Schärfentiefe, Motiv scharf, Hintergrund weich gezeichnet.

Die Performance der optimierten Eingabeaufforderung auf gemini-3-pro-image-preview zeigt in allen Metriken bessere Ergebnisse:

| Dimension | Überladene Version | Optimierte Version |

|---|---|---|

| Token-Anzahl | ~180 | ~65 |

| Motivschärfe | Mittel | Hoch |

| Natürlichkeit des Lichts | Mittel (wirkt gerendert) | Hoch |

| Stil-Konsistenz | Niedrig (Stil-Konflikte) | Hoch |

| Ausgabestabilität | Niedrig | Hoch |

4.2 Szenario 2: Porträtfotografie

Überladene Version:

Hyperrealistisch, 8K HD, meisterhafte Porträtfotografie, Kinoqualität,

aufgenommen mit Canon EOS R5, 85mm f/1.2 Festbrennweite, Softbox-Beleuchtung,

globale Beleuchtung, weiche Schatten, lebensechte Hauttextur, detailreich,

professionelle Bildbearbeitung, Magazin-Cover-Niveau, extrem realistisch, echte Fotografie

eine junge Frau...

(Das Hauptmotiv wird erst nach 50 Wörtern genannt)

Optimierte Version:

Eine 25-jährige Frau, schulterlanges schwarzes glattes Haar, dunkelbraune Augen,

trägt einen cremeweißen Strickpullover, sitzt seitlich an einem Holztisch in einem Café,

hält einen heißen Latte in den Händen, lächelt aus dem Fenster.

Das Licht von draußen fällt sanft von links auf das Gesicht, geringe Schärfentiefe,

warme Ladenbeleuchtung im Hintergrund weich gezeichnet.

Motiv, Aktion, Beleuchtung und Komposition – alle wichtigen Signale befinden sich innerhalb der ersten 50 Wörter.

4.3 Szenario 3: Produktfotografie für E-Commerce

Überladene Version:

8K Ultra-HD Produktfotografie, meisterhafte Industriedesign-Ästhetik, perfektes Licht,

Kinoqualität, extrem realistisch, hochwertige Textur, professionelle kommerzielle Fotografie,

aufgenommen mit Hasselblad Mittelformatkamera, ein Parfümflakon...

Optimierte Version:

Ein transparenter Glas-Parfümflakon, quadratisch, goldener Sprühkopf,

schwarzes Etikett mit goldenem Schriftzug "AURA".

Reinweißer, nahtloser Hintergrund, sanftes Licht von oben, Reflexionen an der Seite deutlich sichtbar.

Zentrierte Produktkomposition, nimmt 60 % des Bildes ein.

Beachten Sie, dass die optimierte Version "AURA" in Anführungszeichen setzt – dies ist die Trigger-Syntax für das hochpräzise Text-Rendering von Nano Banana 2 und weitaus effektiver als die Beschreibung "mit Markenlogo".

💡 Engineering-Tipp: In Produktionsumgebungen empfiehlt es sich, über APIYI (apiyi.com) eine "Prompt-Optimierungs-Middleware" zu implementieren. Nutzen Sie Gemini 3 Pro oder Claude 4, um überladene Begriffe automatisch zu erkennen und zu komprimieren, bevor die Anfrage an das Bildmodell weitergeleitet wird. Dies wahrt die Kompatibilität Ihrer Schnittstellen und verbessert gleichzeitig die Qualität der Bilderzeugung.

V. Technische Grenzen der Prompt-Optimierung bei Nano Banana 2 und gpt-image-2

Obwohl das Prinzip der Optimierung effektiv ist, gibt es Grenzen. Hier sind die Ausnahmen:

5.1 Wann "Stil-Begriffe" beibehalten werden sollten

Nicht alle Adjektive sind Rauschen. Behalten Sie Stil-Begriffe bei, die eine klare visuelle Verteilung aufweisen:

| ✅ Beizubehaltende Stil-Begriffe | Grund |

|---|---|

| Art-Déco-Stil | Verfügt über ein klares visuelles Vokabular |

| Ghibli-Animationsstil | Das Modell hat diese Verteilung gelernt |

| 1980er-Jahre-Film-Look | Kann spezifische Farbpaletten triggern |

| Vaporwave-Ästhetik | Klare visuelle Definition |

| Chiaroscuro (Hell-Dunkel-Malerei) | Eindeutige künstlerische Technik |

Der Unterschied liegt darin: Diese Begriffe entsprechen visualisierbaren Kunstströmungen oder Techniken, statt vagen Bewertungen wie "meisterhaft".

5.2 Wann detaillierte Beschreibungen notwendig sind

In folgenden Szenarien sind längere Prompts erforderlich, wobei lang nicht gleich überladen bedeutet:

- Infografik-Erstellung: Positionierung, Textinhalt und Farben jedes Moduls müssen beschrieben werden.

- Konsistenz mehrerer Charaktere: Detaillierte Beschreibung des Aussehens jeder Figur.

- Komplexe Komposition: Was befindet sich im Vordergrund, Mittelgrund und Hintergrund?

- Markenmaterialien: Präzise Logo-Platzierung, Textinhalt und Farbgebung.

Auch hier gilt: Konkrete Anweisungen sind besser als Anhäufungen von Adjektiven.

5.3 API-Aufrufbeispiel: Nano Banana 2 mit optimiertem Prompt

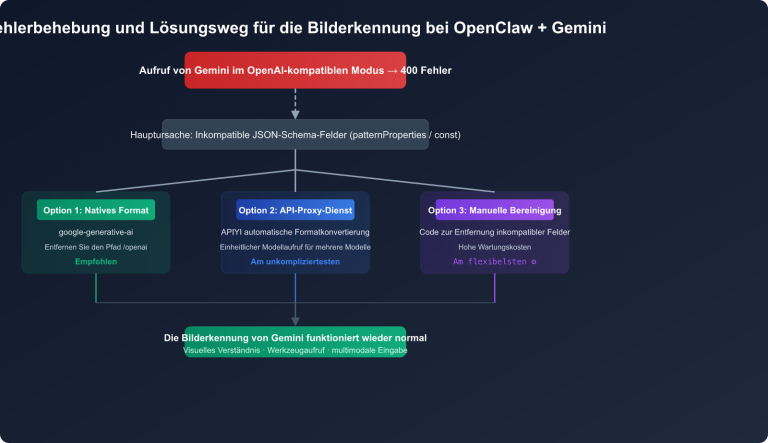

Hier ist ein minimales Beispiel für den Aufruf von Nano Banana 2 über APIYI (apiyi.com):

from openai import OpenAI

client = OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1"

)

prompt = """Eine 25-jährige Frau, schulterlanges schwarzes glattes Haar, dunkelbraune Augen,

trägt einen cremeweißen Strickpullover, sitzt seitlich an einem Holztisch in einem Café,

hält einen heißen Latte in den Händen, lächelt aus dem Fenster.

Das Licht von draußen fällt sanft von links auf das Gesicht, geringe Schärfentiefe,

warme Ladenbeleuchtung im Hintergrund weich gezeichnet."""

response = client.chat.completions.create(

model="gemini-3-pro-image-preview",

messages=[{"role": "user", "content": prompt}]

)

Verwenden Sie als base_url einheitlich https://api.apiyi.com/v1. Die Modell-IDs entsprechen den offiziellen Bezeichnungen. Die transparente Anbindung stellt sicher, dass Sie die volle Leistung der offiziellen Schnittstelle erhalten – optimierte Prompts funktionieren dort genauso effizient wie bei den Original-APIs.

5.4 Sensitivität verschiedener Modelle gegenüber überladenen Prompts

| Modell | Trainingsparadigma | Sensitivität gegenüber "Füllwörtern" | Empfohlener Prompt-Stil |

|---|---|---|---|

| Stable Diffusion 1.5 | Danbooru-Tags | Niedrig (oft sogar nützlich) | Tag-Stapelung |

| Stable Diffusion XL | Hybrid | Mittel | Hybrid |

| Stable Diffusion 3.5 | Natürliche Sprache (Caption) | Höher | Natürliche Sprache |

| DALL-E 3 | GPT-Caption | Hoch | Narrative Beschreibung |

| gpt-image-2 | Multimodales LLM | Hoch | Narrativ + konkrete Anweisungen |

| Nano Banana 2 | Gemini 3.1 Flash | Hoch | Narrativ + 5-Elemente-Szenario |

| Nano Banana Pro | Gemini 3 Pro | Am höchsten | Präzise, knappe Narrative |

Fazit: Je moderner das Modell, desto weniger profitiert es von überladenen, blumigen Beschreibungen.

VI. FAQ: Häufige Fragen zu Eingabeaufforderungen bei Nano Banana 2 und gpt-image-2

F1: Meine bisherigen SD 1.5-Eingabeaufforderungen funktionieren bei Nano Banana 2 nicht gut. Wie migriere ich schnell?

Der einfachste Weg: Wandeln Sie alle kommagetrennten Tags in einen zusammenhängenden Absatz in natürlicher Sprache um. Löschen Sie alle Qualitätsbegriffe (8K/masterpiece/best quality) und vereinfachen Sie Kameraparameter zu gestalterischen Absichten (aus „f/1.8“ wird „geringe Schärfentiefe“). Über APIYI (apiyi.com) können Sie mit demselben Code sowohl SD als auch Nano Banana 2 für einen direkten Vergleich aufrufen, was die Migrationsprüfung erleichtert.

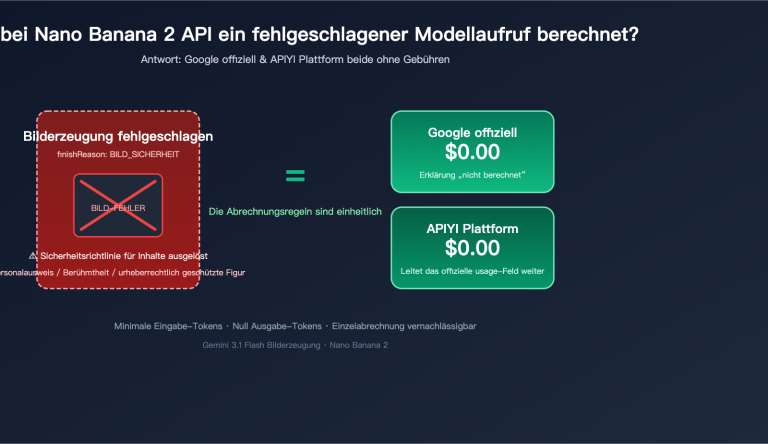

F2: Bringt es wirklich gar nichts, „8K“ beizubehalten?

Bei Nano Banana 2 wird die Auflösung durch die API-Parameter bestimmt (512/1K/2K/4K). Das „8K“ in der Eingabeaufforderung verbessert weder die tatsächliche Auflösung, noch gibt es eine entsprechende Trainingsverteilung. Es wird empfohlen, diese Begriffe komplett zu entfernen und stattdessen die Auflösung explizit über die API-Parameter (2K oder 4K) festzulegen.

F3: Sollte man Kameramarken wie Canon 5D oder Hasselblad-Mittelformat überhaupt angeben?

Man kann sie gelegentlich verwenden, aber in Maßen. „Hasselblad“ lässt das Modell eher zu einem kommerziellen/modischen Stil tendieren, „GoPro“ sorgt für einen dynamischen Weitwinkel-Look – das ist ein Stil-Hinweis, keine physikalische Simulation. Wählen Sie pro Bild maximal einen relevanten Kamera-Hinweis und vermeiden Sie es, diese zu stapeln.

F4: Wenn ich mit gpt-image-2 Produktbilder erstelle, sind Begriffe wie „hochwertig, luxuriös, exzellente Verarbeitung“ wenig effektiv. Was kann ich tun?

Ersetzen Sie abstrakte Adjektive durch konkrete visuelle Anweisungen. „Luxuriös“ → „Hintergrund mit dunkler Marmorstruktur, goldene Metallreflexionen“; „hochwertig“ → „minimalistische Komposition, reiner Hintergrund, sanftes Deckenlicht“; „exzellente Verarbeitung“ → „makellose Oberfläche, klare Kanten, gleichmäßige Nähte“. Durch die Anbindung von gpt-image-2 über APIYI (apiyi.com) können Sie die Unterschiede verschiedener konkreter Anweisungen schnell iterativ testen.

F5: Wenn ich die Eingabeaufforderung kürze, spare ich zwar Token, aber leidet darunter die Stabilität?

Im Gegenteil: Die Stabilität nimmt zu. Da jedes Wort in einer kurzen Eingabeaufforderung eine klare semantische Anweisung darstellt, kann sich das Modell besser konzentrieren. Überladene Eingabeaufforderungen führen durch Synonymwiederholungen und Stilkonflikte bei jedem Generierungsvorgang zu Abwägungen in unterschiedliche Richtungen, was sie instabil macht.

F6: Gibt es Tools, die überladene Eingabeaufforderungen automatisch „verschlanken“?

Sie können Gemini 3 Pro oder Claude 4 Sonnet als „Prompt Refiner Agent“ nutzen. Die System-Eingabeaufforderung sollte lauten: „Identifiziere und lösche alle semantisch leeren Qualitätsbegriffe, wiederholte Synonyme und fachfremde Rendering-Begriffe; behalte nur konkrete Beschreibungen von Subjekt, Aktion, Szene und Beleuchtung bei.“ Über APIYI (apiyi.com) können Sie diese LLMs per Klick für die Vorverarbeitung Ihrer Eingabeaufforderungen nutzen.

VII. Fazit: Neuer Konsens für Eingabeaufforderungen in der Ära von Nano Banana 2

Wenn wir auf die 115 Wörter lange, überladene Eingabeaufforderung vom Anfang dieses Artikels zurückblicken, wissen wir nun, dass das Problem nicht darin liegt, dass sie „zu detailliert“ ist, sondern darin, dass die Wortanzahl falsch eingesetzt wurde:

- Überladen ≠ detailliert: Eine wirklich detaillierte Beschreibung bezieht sich auf konkrete visuelle Elemente, nicht auf das Anhäufen von Qualitätsadjektiven.

- Nano Banana 2 ignoriert 8K: Die Auflösung wird über API-Parameter gesteuert; Begriffe wie „8K, 4K, Ultra-HD“ in der Eingabeaufforderung sind sinnlos.

- Kameraparameter sind Hinweise, keine Simulationen: „f/1.8“ zu schreiben, simuliert nicht wirklich die optischen Eigenschaften; „geringe Schärfentiefe“ ist effizienter.

- Synonymwiederholungen sind Rauschen: Ein Konzept sollte mit dem präzisesten Wort genau einmal genannt werden.

- Negative Anweisungen in positive umwandeln: „Nicht X“ durch „Will Y“ ersetzen.

- Die ersten 50 Wörter sind entscheidend: gpt-image-2 gewichtet den Anfang stärker.

- 3D-Rendering-Begriffe löschen: Fotografische Szenen benötigen keine globale Beleuchtung oder Raytracing.

Die KI-Bilderzeugung im Jahr 2026 ist in der Ära von „Natürliche Sprache = Eingabeaufforderung“ angekommen. Moderne Modelle wie Nano Banana 2, gpt-image-2 und Nano Banana Pro belohnen klare Szenenbeschreibungen und keine prunkvollen Adjektivlisten.

Wir empfehlen, ab heute bei jeder Eingabeaufforderung einen „Verschlankungs-Check“ durchzuführen: Löschen Sie alle Wörter, deren Entfernung das visuelle Verständnis nicht beeinträchtigt. Was übrig bleibt, ist das Signal, das das Modell wirklich steuert. Nutzen Sie die einheitliche API-Anbindung für Nano Banana 2, gpt-image-2 und Nano Banana Pro über APIYI (apiyi.com), um kostengünstig A/B-Tests mit verschiedenen „schlanken“ Eingabeaufforderungen durchzuführen und Ihre eigene Bibliothek an optimierten Prompts aufzubauen.

Über den Autor: Das technische Team von APIYI konzentriert sich darauf, Entwicklern einen stabilen, transparenten und umfassenden API-Zugang zu großen KI-Sprachmodellen zu bieten. Besuchen Sie die offizielle Website von APIYI unter apiyi.com, um mehr über die neuesten Anbindungslösungen und Best Practices für Eingabeaufforderungen für Modelle wie Nano Banana 2, gpt-image-2 und Gemini 3 Pro zu erfahren.