Anmerkung des Autors: Tiefgehende Analyse der Kern-Upgrades von ByteDances Jimeng Seedance 2.0 Videogenerierung und Seedream 5.0 Bildgenerierung, inklusive API-Anleitung und Praxisvergleich.

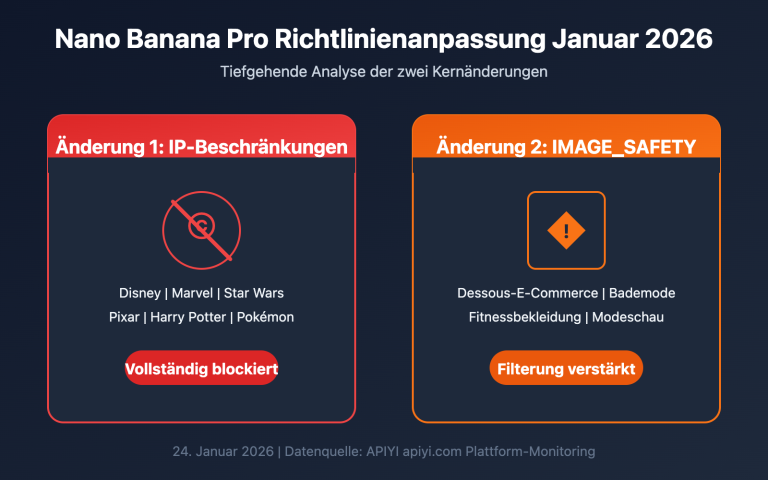

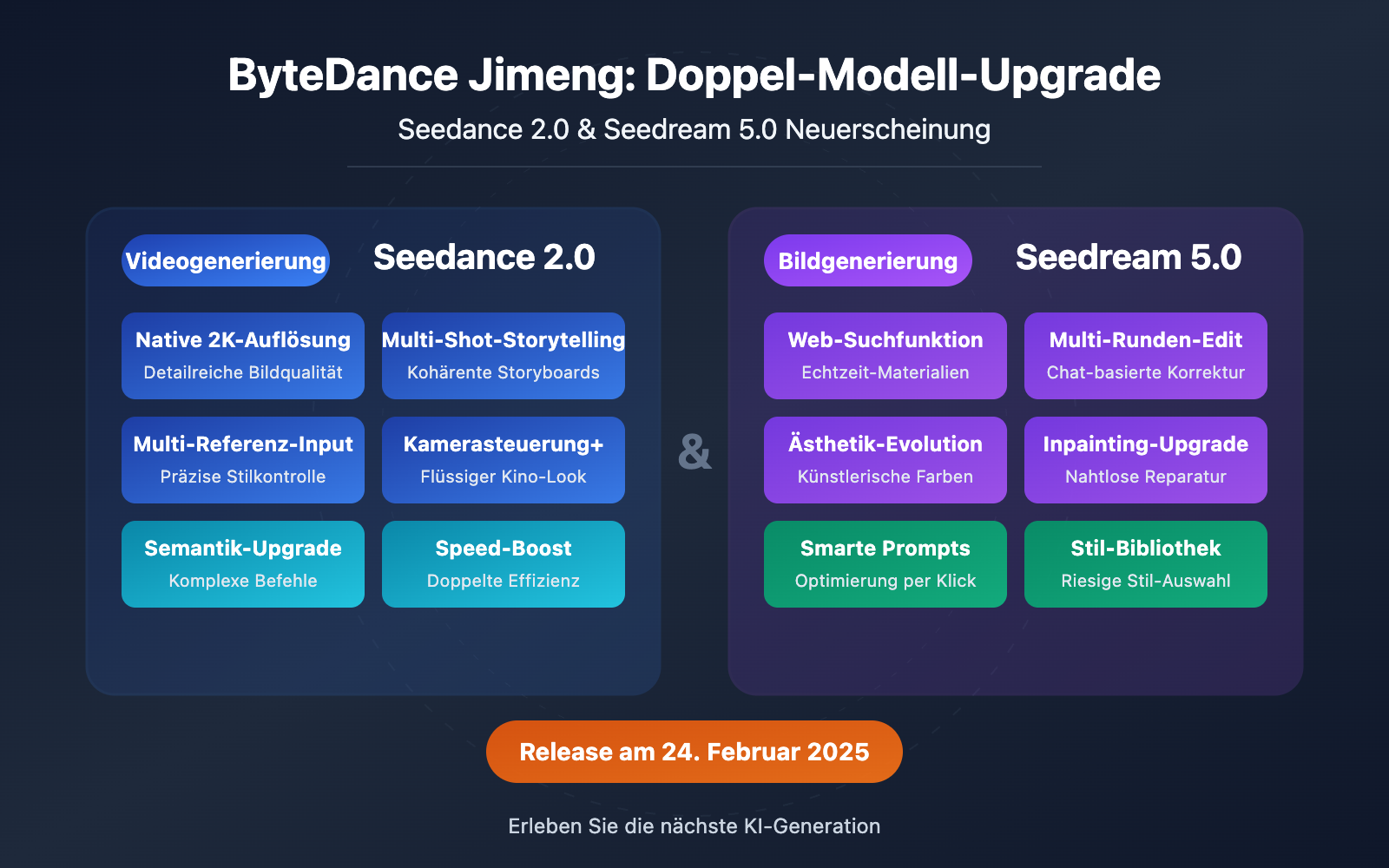

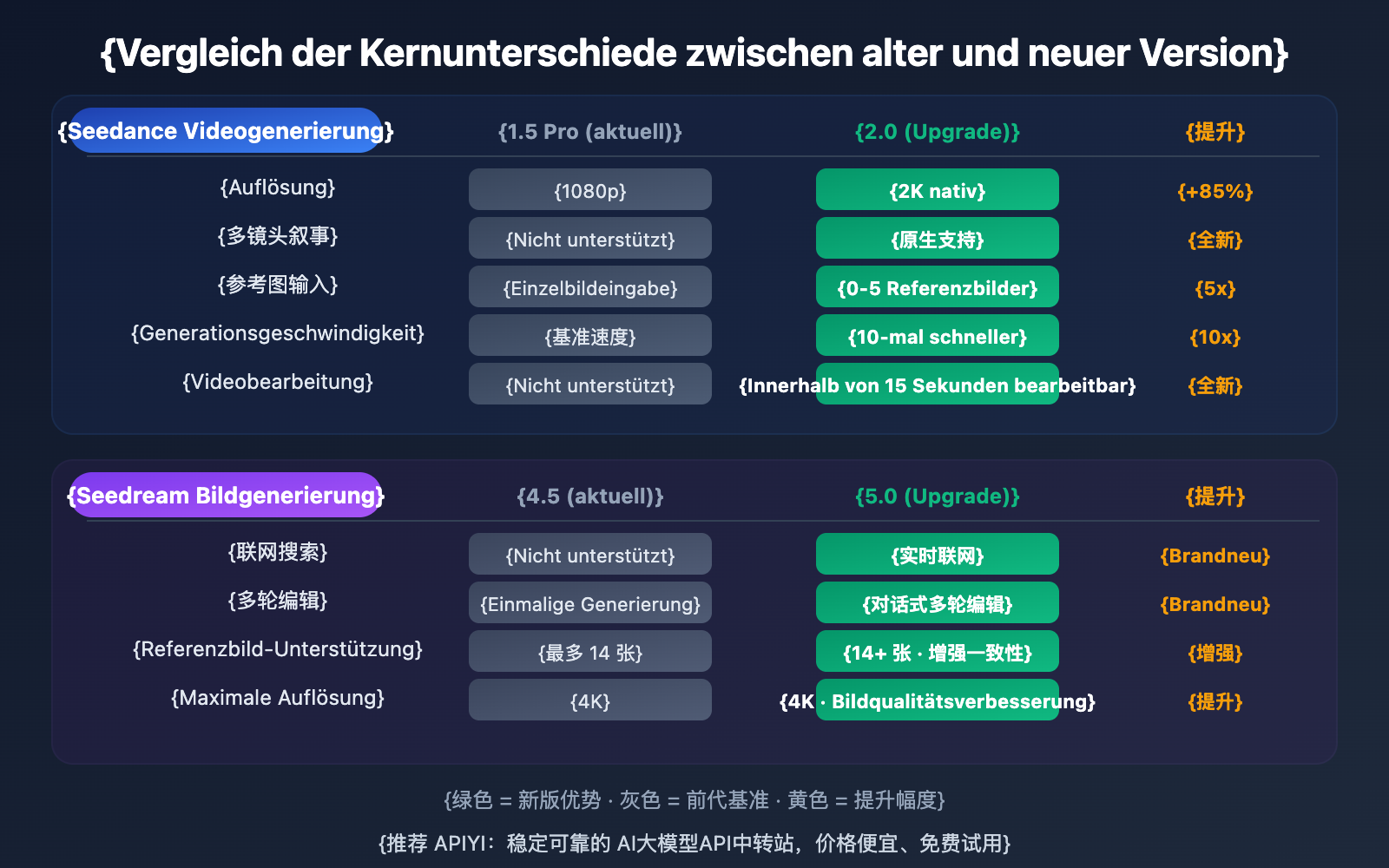

Zuverlässigen Quellen zufolge wird das Seed-Team von ByteDance am 24. Februar gleichzeitig das Seedance 2.0 Videogenerierungsmodell und das Seedream 5.0 Bildgenerierungsmodell veröffentlichen. Dies markiert das bisher umfangreichste Doppel-Modell-Upgrade der Jimeng-Plattform. Seedance 2.0 bietet bahnbrechende Funktionen wie native 2K-Auflösung, Multi-Shot-Storytelling und Multi-Referenzbild-Input. Seedream 5.0 führt erstmals eine Websuche und mehrstufige Bild-Text-Bearbeitung ein, was den Beginn der Ära der interaktiven KI-Bildgestaltung einläutet.

Kernvorteile: Erfahren Sie in 3 Minuten alles über die Highlights von Seedance 2.0 und Seedream 5.0, meistern Sie die API-Anbindung und testen Sie als Erster die KI-Tools der nächsten Generation.

Seedance 2.0 und Seedream 5.0: Kerninformationen im Überblick

| Information | Seedance 2.0 (Videogenerierung) | Seedream 5.0 (Bildgenerierung) |

|---|---|---|

| Herausgeber | ByteDance Seed-Team | ByteDance Seed-Team |

| Voraussichtlicher Release | 24. Februar 2025 | 24. Februar 2025 |

| Kern-Upgrades | Mehrere Referenzbilder + Video-Vervollständigung + 2K-Qualität | Online-Suche + Mehrstufige Text-Bild-Bearbeitung |

| Vorgängerversion | Seedance 1.5 Pro | Seedream 4.5 |

| Anwendungsplattformen | Jimeng / Volcengine / Drittanbieter-API | Jimeng / Volcengine / Drittanbieter-API |

Die Branchenbedeutung der Doppel-Veröffentlichung von Seedance 2.0 und Seedream 5.0

Die Entscheidung von ByteDance, gleichzeitig neue Modelle für die Video- und Bildgenerierung zu veröffentlichen, verdeutlicht die „Video+Bild“-Doppelstrategie des Unternehmens im Bereich AIGC. Seedance 2.0 stellt ein umfassendes Upgrade gegenüber der Version 1.5 Pro dar – von der Bildqualität über den physikalischen Realismus bis hin zum multimodalen Input wurde jeder Aspekt gezielt optimiert, um reale Herausforderungen im kreativen Prozess zu adressieren. Seedream 5.0 hingegen überspringt die herkömmliche Iterationslogik und führt direkt Online-Suchfunktionen sowie eine mehrstufige Bearbeitung ein. Damit ist die Bildgenerierung kein „Einmal-Prozess“ mehr, sondern kann in einem dialogähnlichen Verfahren wie bei einem Chat kontinuierlich angepasst werden.

Für Entwickler und Kreative bedeutet dies, dass ein einziger API-Aufruf den Weg für die gesamte Schöpfungskette ebnet – vom Text zum Video oder von der Skizze zum fertigen Film. Dies senkt die Hürden für die Produktion hochwertiger multimodaler Inhalte erheblich.

Seedance 2.0: 7 Kern-Upgrades für die Jimeng-Videogenerierung

Im Vergleich zur Vorgängerversion 1.5 Pro markiert Seedance 2.0 einen evolutionären Sprung von der „Generierung einzelner Videoclips“ hin zur „vollständigen Szenenerzählung“. Hier sind die 7 wichtigsten Verbesserungen:

Seedance 2.0 Text-to-Video (T2V) Upgrades

Deutliche Steigerung der physikalischen Realität: Seedance 2.0 verfügt über ein neu trainiertes Physik-Engine-Modul, wodurch komplexe Effekte wie fließendes Wasser, Rauch und Stoffbewegungen weitaus realistischer wirken. Die Trägheit menschlicher Bewegungen, die Reaktion auf Schwerkraft und das Kollisionsfeedback wurden präzise optimiert, was das in AI-Videos oft übliche „Schwebegefühl“ eliminiert.

Quantensprung in Ästhetik und Bildqualität: Das Modell unterstützt nativ die Ausgabe in 2K-Kinoauflösung – ein massiver Fortschritt von 1080p auf 2K. Gleichzeitig wurden die Farbwissenschaft, das Licht- und Schattenspiel sowie die Tiefenschärfekontrolle erheblich verbessert, was den generierten Bildern eine echte Filmästhetik verleiht.

Automatisches Storyboarding und Szenengenerierung: Dies ist eine der bahnbrechendsten Funktionen von Seedance 2.0. Durch die Eingabe einer Textbeschreibung kann das Modell diese automatisch in mehrere Einstellungen unterteilen. Dabei bleiben Charakterkonsistenz, Lichtkontinuität und Handlungsverlauf gewahrt, was den Übergang von einem „einzelnen Fragment“ zu einer „kompletten Szene“ ermöglicht.

Seedance 2.0 Image-to-Video (I2V) Upgrades

| Dimension des Upgrades | Seedance 1.5 Pro | Seedance 2.0 | Steigerungsrate |

|---|---|---|---|

| Mikroexpressionen | Grundlegende Mimik | Präzise Erfassung von Mikroexpressionen | Deutlich verbessert |

| Bewegungskontinuität | Gelegentliche Frame-Sprünge | Flüssige, natürliche Übergänge | Massiv gesteigert |

| Charakterkonsistenz | Konsistent innerhalb eines Clips | Kameraübergreifende Identitätssperre | Großer Durchbruch |

| Produktdetails | Teilweise unscharf/verloren | High-Fidelity-Wiedergabe | Deutlich verbessert |

| Videobearbeitung | Nicht unterstützt | Videos bis 15 Sek. editierbar | Neue Funktion |

Seedance 2.0 Multimodale Eingabe und Sprachverbesserung

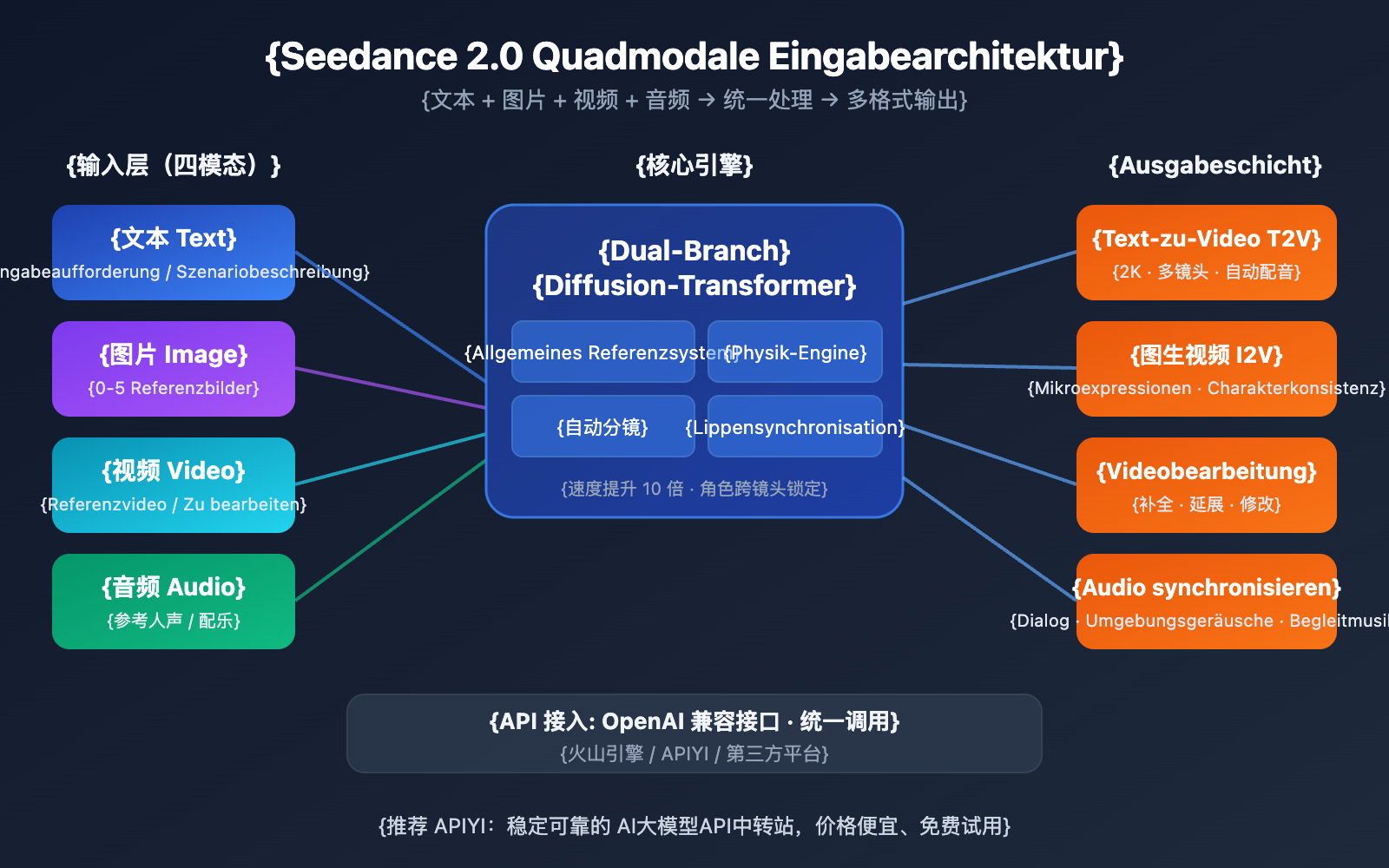

Eingabe mehrerer Referenzbilder (0-5 Bilder): Seedance 2.0 führt ein „universelles Referenzsystem“ ein, das die gleichzeitige Eingabe von bis zu fünf Referenzbildern unterstützt. Das System kopiert präzise Komposition, Kamerabewegung und Charakteraktionen aus den Referenzen, wodurch Probleme bei der Charakterkonsistenz und physikalischen Kontinuität grundlegend gelöst werden.

Gleichzeitige Eingabe von Video und Bild: Es wird unterstützt, in einem Generierungsvorgang sowohl Bilder als auch Videos als Referenzmaterial bereitzustellen, was einen präziseren Stiltransfer und eine bessere Inhaltskontrolle ermöglicht.

Video-Vervollständigung und -Erweiterung: Bestehende Videoclips können vervollständigt oder verlängert werden – ideal für die Erstellung längerer Videos oder das Reparieren fehlender Videoteile.

Unterstützung für realistische Stimmen: Die Sprachsynthese orientiert sich an echten menschlichen Stimmen und unterstützt Dialogszenen mit mehr als zwei Charakteren. In multilingualen Szenarien wie Chinesisch, Englisch oder Spanisch wurde die Genauigkeit der Sprachgenerierung deutlich erhöht und die Lippensynchronisation wirkt natürlicher.

🎯 Technischer Tipp: Die Funktionen für mehrere Referenzbilder und die Videobearbeitung von Seedance 2.0 eignen sich hervorragend für die kommerzielle Content-Erstellung. Nach dem Release können Entwickler über die Plattform APIYI (apiyi.com) auf eine einheitliche API-Schnittstelle zugreifen, um schnelle Integrationstests durchzuführen.

Seedream 5.0: Kern-Durchbrüche in der Jimeng-Bildgenerierung

Seedream 5.0 ist das neueste Meisterwerk des Seed-Teams von ByteDance im Bereich der Bildgenerierung und erzielt im Vergleich zu Seedream 4.5 mehrere „Von 0 auf 1“-Durchbrüche.

Seedream 5.0 Online-Suchfunktion

Seedream 5.0 führt erstmals eine Online-Suchfunktion für Bildgenerierungsmodelle ein. Das bedeutet, dass das Modell nicht mehr nur auf das Wissen aus seinen Trainingsdaten beschränkt ist. Wenn Sie beispielsweise das „neueste Tesla Model Y von 2025“ generieren möchten, kann das Modell in Echtzeit nach aktuellen Produktbildern und Spezifikationen suchen, um ein Bild zu erstellen, das der Realität exakt entspricht.

Diese Fähigkeit ist besonders wichtig für folgende Szenarien:

- Pressebilder: Erstellung präziser Bilder zu aktuellen Ereignissen.

- Produktmarketing: Generierung von Werbematerial für brandneue Produkte.

- Trend-Design: Kreative Inhalte, die aktuellen Trends folgen.

Seedream 5.0 Mehrstufige Text-Bild-Bearbeitung

Die traditionelle Bildgenerierung war ein „einmaliger“ Prozess – war man mit dem Ergebnis unzufrieden, musste man die Beschreibung anpassen und neu generieren. Seedream 5.0 ändert dieses Paradigma durch die Einführung einer dialogbasierten, mehrstufigen Bearbeitung:

| Bearbeitungsfunktion | Beschreibung | Anwendungsszenario |

|---|---|---|

| Lokale Modifikation | Präzise Änderung in einem bestimmten Bereich | Mimik anpassen, Hintergrundelemente austauschen |

| Stiltransfer | Inhalt beibehalten, Stil ändern | Foto zu Illustration, Realismus zu Anime |

| Elemente hinzufügen/löschen | Spezifische Objekte hinzufügen oder entfernen | Produkte ergänzen, störende Objekte entfernen |

| Text-Rendering | Präzises Rendern von Text im Bild | Posterdesign, Logo-Erstellung |

| Kontinuierliche Anpassung | Weiterbearbeitung basierend auf dem vorherigen Ergebnis | Progressives Design, feiner Feinschliff |

Kern-Upgrades von Seedream 5.0 gegenüber Seedream 4.5

Seedream 4.5 war bereits stark in der Synthese mehrerer Bilder und der Charakterkonsistenz (Unterstützung von bis zu 14 Referenzbildern). Seedream 5.0 baut darauf auf und ergänzt die zwei Kernfunktionen Online-Suche und interaktive Bearbeitung, während die allgemeine Bildqualität weiter gesteigert wurde.

💡 Empfehlung: Die Online-Suche und die mehrstufigen Bearbeitungsfunktionen von Seedream 5.0 sind ideal für kreative Prozesse, die viele Iterationen erfordern. Wir empfehlen, die Modelle über APIYI (apiyi.com) selbst zu testen, um die Performance in spezifischen Szenarien zu vergleichen.

Seedance 2.0 API Schnellstart-Anleitung

Minimales Beispiel

Hier ist der Basiscode für den Aufruf der Seedance 2.0 Text-zu-Video-Generierung über die OpenAI-kompatible Schnittstelle:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1" # Verwendung der einheitlichen APIYI-Schnittstelle

)

# Seedance 2.0 Text-zu-Video-Aufruf

response = client.chat.completions.create(

model="seedance-2.0",

messages=[

{

"role": "user",

"content": "Ein Golden Retriever rennt am Strand bei Sonnenuntergang, Zeitlupen-Nahaufnahme, filmische Qualität"

}

]

)

print(response.choices[0].message.content)

Vollständigen Code für Seedance 2.0 Bild-zu-Video anzeigen

import openai

import base64

from pathlib import Path

def seedance_image_to_video(

image_path: str,

prompt: str,

reference_images: list = None,

duration: int = 5

) -> str:

"""

Seedance 2.0 Bild-zu-Video API-Aufruf

Argumente:

image_path: Pfad zum Hauptbild

prompt: Videobeschreibung (Eingabeaufforderung)

reference_images: Liste der Referenzbilder (0-5 Bilder)

duration: Videodauer (Sekunden)

Rückgabe:

Video-URL oder Base64-Daten

"""

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1" # Einheitliche APIYI-Schnittstelle

)

# Hauptbild lesen und kodieren

image_data = base64.b64encode(

Path(image_path).read_bytes()

).decode()

messages = [

{

"role": "user",

"content": [

{

"type": "image_url",

"image_url": {

"url": f"data:image/png;base64,{image_data}"

}

},

{"type": "text", "text": prompt}

]

}

]

response = client.chat.completions.create(

model="seedance-2.0-i2v",

messages=messages,

max_tokens=4096

)

return response.choices[0].message.content

# Anwendungsbeispiel

result = seedance_image_to_video(

image_path="product.png",

prompt="Ein Produkt dreht sich langsam auf einem Tisch zur Präsentation, sanftes Licht, Werbefilm-Stil",

duration=8

)

print(result)

🚀 Schnellstart: Wir empfehlen die Nutzung der Plattform APIYI (apiyi.com) für den schnellen Zugriff auf Seedance 2.0 und Seedream 5.0. Die Plattform bietet eine einheitliche OpenAI-kompatible Schnittstelle, sodass Sie nicht mit mehreren Anbietern interagieren müssen. Die Integration ist in nur 5 Minuten abgeschlossen.

Vergleich von Seedance 2.0 mit konkurrierenden Videomodellen

| Vergleichsdimension | Seedance 2.0 | Sora 2 | Veo 3.1 | Wan 2.6 |

|---|---|---|---|---|

| Höchste Auflösung | Natives 2K | 1080p | 1080p | 1080p |

| Multi-Shot-Narrativ | Native Unterstützung | Eingeschränkt | Nicht unterstützt | Nicht unterstützt |

| Audio-Video-Sync | Native kombinierte Generierung | Erfordert Postproduktion | Native Unterstützung | Nicht unterstützt |

| Mehrere Referenzbilder | 0-5 Bilder | Nicht unterstützt | Nicht unterstützt | Eingeschränkt |

| Lippensynchronisation | 8+ Sprachen | Hauptsächlich Englisch | Mehrsprachig | Chinesisch & Englisch |

| Videobearbeitung | Unterstützt bis 15 Sek. | Eingeschränkt | Nicht unterstützt | Nicht unterstützt |

| Generierungsgeschwindigkeit | 10x schneller als 1.5 Pro | Langsamer | Mittel | Schneller |

| Verfügbare Plattformen | Jimeng / APIYI etc. | Offiziell OpenAI | Offiziell Google | Open-Source-Community |

Vergleichshinweis: Die oben genannten Daten basieren auf offiziell veröffentlichten Parametern der jeweiligen Modelle sowie öffentlichen Testergebnissen. Die tatsächliche Leistung kann je nach Szenario variieren. Es wird empfohlen, nach dem offiziellen Release der Modelle eigene Vergleichstests durchzuführen.

Auswirkungen von Seedance 2.0 und Seedream 5.0 auf Entwickler

Auswirkungen auf KI-Videoproduzenten

Die Multi-Shot-Narrative und die Fixierung der Charakterkonsistenz in Seedance 2.0 markieren den Übergang der KI-Videoproduktion von der „Erstellung kurzer Fragmente“ hin zum „Erzählen kompletter Geschichten“. Für die Werbeproduktion, Kurzvideo-Erstellung, Bildungsinhalte und andere Szenarien bedeutet dies:

- Steigerung der Produktionseffizienz: Mit einer einzigen Eingabeaufforderung können zusammenhängende Videos mit mehreren Kameraeinstellungen generiert werden, ohne dass einzelne Segmente nacheinander erstellt und mühsam zusammengeschnitten werden müssen.

- Charakterkontinuität: Serieninhalte, IP-Charaktere und Markenbotschafter behalten über verschiedene Videos hinweg ein konsistentes Erscheinungsbild bei.

- Massive Kostensenkung: Die Kosten für Videoproduktionen auf kommerziellem Niveau könnten von mehreren tausend Euro auf einen zweistelligen Bereich sinken.

Auswirkungen auf KI-Bildgestalter

Die Multi-Turn-Editierfunktionen von Seedream 5.0 verändern den Workflow der Bilderstellung grundlegend – weg von der „Einmal-Generierung“ hin zur „kontinuierlichen, dialogbasierten Erstellung“. Für Designer, Marketingteams und Content-Ersteller bedeutet dies einen fundamentalen Effizienzschub.

Auswirkungen auf Entwickler und API-Nutzer

Beide Modelle werden über Volcano Ark (Volcano Engine) als API-Dienste bereitgestellt. Für Entwickler, die bereits die APIs von Seedance 1.5 Pro oder Seedream 4.5 nutzen, ist der Migrationsaufwand auf die neuen Versionen extrem gering – die API-Schnittstellen weisen eine hohe Kompatibilität auf.

💰 Kostentipp: In der Anfangsphase nach dem Launch neuer Modelle gibt es häufig Rabattaktionen. Über die Anbindung via APIYI (apiyi.com) lassen sich flexiblere Abrechnungsmodelle nutzen, was ideal für kleine und mittlere Teams ist, um vor dem produktiven Einsatz umfassende Tests durchzuführen.

Häufig gestellte Fragen (FAQ)

F1: Ab wann sind Seedance 2.0 und Seedream 5.0 verfügbar?

Insider-Informationen zufolge werden beide Modelle voraussichtlich am 24. Februar 2025 offiziell an den Start gehen. Sie werden zeitgleich über die Jimeng-Plattform und die Volcano Engine API verfügbar sein. Drittanbieter-API-Aggregatoren werden den Zugang sukzessive nachziehen.

F2: Wie nutzt man die Multi-Referenzbild-Funktion von Seedance 2.0?

Seedance 2.0 unterstützt die Eingabe von 0 bis 5 Referenzbildern. Bei einem API-Aufruf können die Base64-Kodierung oder die URL der Referenzbilder einfach in der Anfrage mitgesendet werden. Das System extrahiert automatisch Bildkomposition, Charaktermerkmale und Kamerabewegungen aus den Referenzbildern. Es wird empfohlen, über APIYI (apiyi.com) Gratis-Guthaben für erste Tests zu beziehen.

F3: Erhöht die Websuche-Funktion von Seedream 5.0 die Latenz?

Die Websuche verlängert die Generierungszeit geringfügig (voraussichtlich um 2–5 Sekunden), bietet dafür jedoch Bildinhalte, die hochgradig mit der realen Welt übereinstimmen. Für Szenarien, die keine Websuche erfordern, kann die Funktion deaktiviert werden, um die ursprüngliche Geschwindigkeit beizubehalten.

F4: Muss der Code für das Upgrade von Seedance 1.5 Pro auf 2.0 angepasst werden?

Die API-Schnittstellen sind weitestgehend kompatibel. Die wichtigste Änderung betrifft den Parameter für den Modellnamen. Wenn Sie eine OpenAI-kompatible Schnittstelle verwenden, müssen Sie in der Regel nur den Parameter model von seedance-1.5-pro in seedance-2.0 ändern; weitere Code-Anpassungen sind nicht erforderlich.

Fazit

Die Kernpunkte von Seedance 2.0 und Seedream 5.0 im Überblick:

- Seedance 2.0 Videogenerierung: Native 2K-Auflösung, Multi-Shot-Narrative, Input von 0 bis 5 Referenzbildern, Video-Completion-Editing, mehrsprachige Lippensynchronisation.

- Seedream 5.0 Bildgenerierung: Erstmals mit integrierter Websuche, mehrstufige dialogbasierte Bild- und Textbearbeitung, kontinuierliche Verbesserung der Bildqualität.

- Veröffentlichungsdatum: Voraussichtlicher synchroner Launch am 24. Februar 2025 über die Jimeng-Plattform und die Volcengine API.

- Vorteile für Entwickler: Abwärtskompatible API-Schnittstellen, geringer Migrationsaufwand und ein reichhaltiges Angebot an Ökosystem-Tools.

Die Strategie von ByteDance, beide Modelle gleichzeitig zu aktualisieren, unterstreicht die Ambition, ein umfassendes „Video+Bild“-Kreativ-Ökosystem aufzubauen. Sowohl für die kommerzielle Content-Erstellung als auch für den persönlichen kreativen Ausdruck werden diese beiden Modelle signifikante Effizienzsteigerungen und Qualitätssprünge ermöglichen.

Wir empfehlen, die tatsächliche Leistung von Seedance 2.0 und Seedream 5.0 schnell über APIYI (apiyi.com) zu validieren. Die Plattform bietet kostenlose Testguthaben und eine einheitliche Schnittstelle für verschiedene Modelle, sodass Sie die neuesten KI-Kreativwerkzeuge direkt ausprobieren können.

Referenzen

⚠️ Hinweis zum Linkformat: Alle externen Links verwenden das Format

Name: domain.com. Sie sind zum einfachen Kopieren gedacht, aber nicht direkt anklickbar, um den SEO-Wert zu erhalten.

-

Offizielle ByteDance Seed-Seite: Vorstellung der Seedance- und Seedream-Modellreihen

- Link:

seed.bytedance.com/en/seedance - Beschreibung: Offizielle technische Dokumentation und Modellspezifikationen.

- Link:

-

Technische Dokumentation zu Seedance 1.5 Pro: Vollständige technische Parameter der aktuellen Version

- Link:

seed.bytedance.com/en/seedance1_5_pro - Beschreibung: Referenzwert zum Verständnis der Upgrades in Version 2.0.

- Link:

-

Offizielle Seedream 4.5-Seite: Technische Spezifikationen des aktuellen Bildgenerierungsmodells

- Link:

seed.bytedance.com/en/seedream4_5 - Beschreibung: Referenzwert zum Verständnis der Upgrades in Version 5.0.

- Link:

-

Volcengine API-Dokumentation: Leitfaden zur API-Integration der Seedance-Serie

- Link:

byteplus.com/en/product/seedance - Beschreibung: Offizielle Referenz für die API-Integration auf Unternehmensebene.

- Link:

Autor: APIYI Team

Technischer Austausch: Diskutieren Sie gerne in den Kommentaren über Ihre Erfahrungen mit Seedance 2.0 und Seedream 5.0. Weitere Leitfäden zur API-Integration von KI-Modellen finden Sie in der APIYI (apiyi.com) Tech-Community.