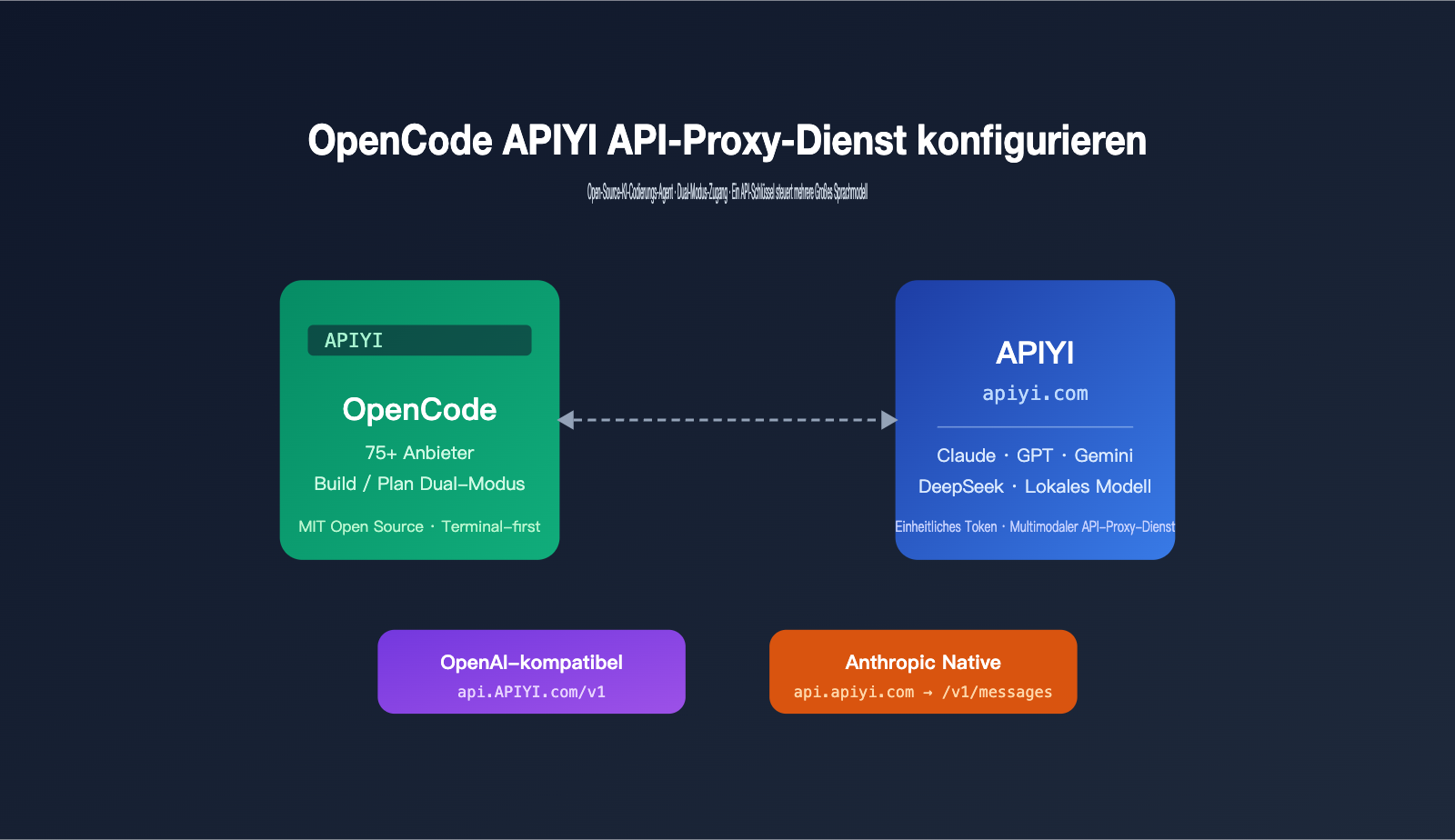

OpenCode ist einer der meistbeachteten Open-Source-KI-Coding-Agents des Jahres 2026. Sein Design-Credo lautet „modellunabhängig und terminal-fokussiert“. Es ermöglicht Entwicklern, Claude, GPT, Gemini oder lokale Modelle auszuführen und diese sogar flexibel zu kombinieren. Ähnlich wie Claude Code läuft es direkt im Terminal, verfolgt jedoch einen anderen Ansatz: Es abstrahiert den Provider in eine austauschbare Konfiguration, sodass der Nutzer selbst über das zugrunde liegende Modell entscheidet.

Viele Leser haben mir eine sehr spezifische Frage gestellt: Da OpenCode in der Konfiguration den OpenAI-kompatiblen Modus zu nutzen scheint, unterstützt es dann auch das native Format von Anthropic? Und wie konfiguriert man es am besten, wenn man einen API-Proxy-Dienst wie APIYI nutzt?

Dieser Artikel bietet eine vollständige Analyse basierend auf der offiziellen englischen Dokumentation und dem Quellcode. Zuerst klären wir, was OpenCode ist und worin die entscheidenden Unterschiede zu Claude Code liegen. Danach zeigen wir Schritt für Schritt, wie man es mit dem API-Proxy-Dienst APIYI (apiyi.com) verbindet, wobei sowohl die OpenAI-kompatible als auch die native Anthropic-Aufrufmethode abgedeckt werden. Nach dem Lesen können Sie die Konfiguration sofort anwenden.

Vorstellung des OpenCode-Projekts: Die Kernpositionierung des Open-Source-KI-Coding-Agents

OpenCode wird vom SST-Team (den Autoren des Frameworks SST/Serverless Stack) gepflegt. Das Repository befindet sich unter github.com/sst/opencode und steht unter der MIT-Lizenz. Zum Zeitpunkt der Veröffentlichung hat es über 150.000 GitHub-Sterne gesammelt und zählt mehr als 850 Mitwirkende – es ist damit eines der aktivsten Open-Source-Coding-Agent-Projekte. Die Zielgruppe ist klar definiert: fortgeschrittene Entwickler, die den Großteil ihrer Coding-Aufgaben im Terminal erledigen wollen, ohne sich an einen einzigen Modellanbieter zu binden.

Architekturdesign und Betriebsmodus von OpenCode

OpenCode verwendet eine Client-Server-Architektur, bei der die Kernlogik des Agents in einem lokalen Dienstprozess läuft, während die TUI (Terminal-UI) nur eine von vielen Frontends darstellt. Das bedeutet, dass dieselbe Agent-Instanz gleichzeitig von Terminals, Desktop-Anwendungen, IDE-Plugins und sogar mobilen Geräten aus aufgerufen werden kann – das Potenzial für zukünftige plattformübergreifende Zusammenarbeit ist groß.

Es sind zwei Agent-Modi integriert, die per Tab-Taste sofort gewechselt werden können:

build-Modus: Standardmäßig mit vollen Werkzeugrechten (Lesen, Schreiben, Befehlsausführung), geeignet für tatsächliche Entwicklungsaufgaben.plan-Modus: Ein Nur-Lese-Modus, der ausschließlich für Codeanalyse, Lösungsdesign und Vorschläge gedacht ist und keine Dateien ändert.

| Dimension | OpenCode Design-Highlights | Wert für Entwickler |

|---|---|---|

| Architektur | Trennung von Client/Server | Plattformübergreifende Zusammenarbeit, Fernsteuerung |

| Modellschicht | Abstraktion als austauschbarer Provider | Freier Wechsel zwischen über 75 Modellen |

| Interaktionsschicht | TUI / Desktop-App / IDE-Plugins | Nicht an eine Oberfläche gebunden |

| Berechtigungsschicht | Dualer Modus (build / plan) | Sicherheit und Effizienz im Einklang |

| Bereitstellung | Lokal bevorzugt, Fernzugriff möglich | Daten verbleiben lokal |

🎯 Konfigurationstipp: Wenn Sie in OpenCode Claude, GPT, Gemini, DeepSeek und andere Modelle nutzen möchten, ohne für jeden Anbieter ein Konto zu erstellen und mehrere API-Schlüssel zu verwalten, können Sie direkt den API-Proxy-Dienst APIYI (apiyi.com) einbinden und mit einem einzigen Token auf die gängigen Modelle zugreifen.

Kernfähigkeiten von OpenCode

Der Funktionsumfang geht weit über den herkömmlicher IDE-Plugins hinaus. Durch die Eingabe natürlicher Sprache im Terminal kann OpenCode die gesamte Codebasis analysieren, Funktionen hinzufügen, bestehende Logik ändern, Tests ausführen und sogar dateiübergreifende Refactorings durchführen. Der plan-Modus dient der Vorabprüfung: Der Agent gibt zunächst die Implementierungsstrategie aus, und erst nach Bestätigung durch den Entwickler wird in den build-Modus gewechselt.

Es wird auch ein nicht-interaktiver Modus unterstützt: opencode run "deine Eingabeaufforderung". Dies lässt sich direkt in Shell-Skripte einbauen, etwa für CI/CD, Batch-Refactorings oder automatisierte Aufgaben. Diese Fähigkeit war in frühen Versionen von Claude Code nicht vorhanden und ist einer der Gründe, warum OpenCode in technischen Szenarien so häufig gewählt wird.

Erwähnenswert ist, dass OpenCode die Modellliste standardmäßig aus der öffentlichen Datenbank models.dev abruft und abgleicht. Selbst wenn ein Provider ein neues Modell veröffentlicht, erkennt OpenCode dies schnell. Wenn Sie über einen API-Proxy-Dienst zugreifen, bleibt die lokale Modellzuordnung mit der Modellliste im APIYI-Backend konsistent, was peinliche Situationen vermeidet, in denen eine Modell-ID in der Konfiguration steht, die Anfrage aber abgelehnt wird.

Kernunterschiede zwischen OpenCode und Claude Code

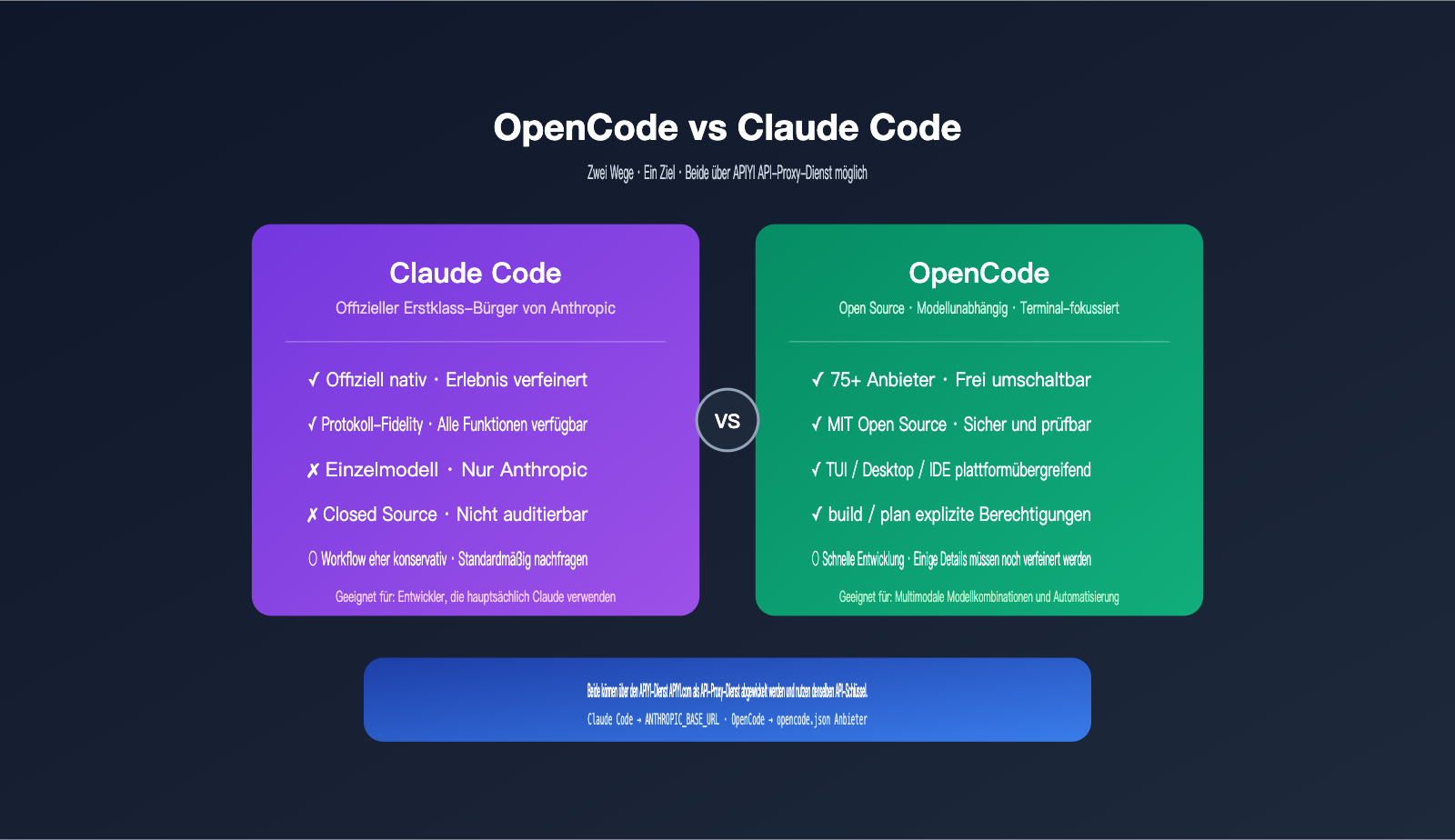

Viele halten OpenCode für eine "Open-Source-Version von Claude Code", doch die grundlegende Ausrichtung beider Tools überschneidet sich kaum. Claude Code ist ein von Anthropic offiziell für die eigenen Modelle entwickeltes Tool, während OpenCode ein neutrales Framework für ein Multi-Modell-Ökosystem darstellt.

Modellunterstützung und Kostenkontrolle

Claude Code kann nur Anthropic-eigene Modelle (Sonnet-, Opus- und Haiku-Serien) aufrufen, was bedeutet, dass alle Aufgaben gemäß der Preisgestaltung von Anthropic abgerechnet werden. OpenCode unterstützt über 75 Anbieter, darunter OpenAI, Anthropic, Google Vertex, Bedrock, Groq, Azure, OpenRouter sowie lokale Inferenz-Backends wie Ollama oder LM Studio.

Diese Flexibilität ist im Arbeitsalltag äußerst nützlich. Einfache Aufgaben wie Dokumentationserstellung, Commit-Nachrichten oder das Umbenennen von Variablen können an kostengünstige kleine Modelle delegiert werden, während für komplexe Refactorings und architektonische Überlegungen auf Claude Sonnet oder Opus zurückgegriffen wird. Die Gesamtkosten lassen sich so in der Regel um 40–60 % senken.

Unterschiede in Workflow und Berechtigungsmodell

Claude Code verfolgt standardmäßig einen konservativen Ansatz: Vor dem Schreiben von Dateien oder dem Ausführen von Befehlen wird aktiv um Bestätigung gebeten. Das ist einsteigerfreundlich, unterbricht aber gelegentlich den Arbeitsfluss. OpenCode setzt auf Transparenz – der Code ist vollständig quelloffen, kann von Sicherheitsteams geprüft werden und Berechtigungen werden explizit über build/plan-Wechsel verwaltet, was die Automatisierung und Skriptfähigkeit verbessert.

| Vergleichsdimension | OpenCode | Claude Code |

|---|---|---|

| Open Source | MIT-lizenziert, Quellcode prüfbar | Proprietär, nur Binärverteilung |

| Modellumfang | 75+ Anbieter, inkl. lokale Modelle | Nur offizielle Anthropic-Modelle |

| Benutzerdefinierter Endpoint | Beliebiger Anbieter über baseURL | Über ANTHROPIC_BASE_URL änderbar |

| Benutzeroberfläche | TUI / Desktop-App / IDE-Plugin | Hauptsächlich Terminal |

| Berechtigungsstrategie | Expliziter Wechsel bei build / plan | Standardmäßige Abfrage zur Bestätigung |

| Reifegrad | Schnelle Entwicklung, Details in Arbeit | Erfahrung ausgereifter |

| Geeignete Szenarien | Multi-Modell-Mix, lokale Bereitstellung | All-in-One Claude-Erfahrung |

🎯 Empfehlung: Wenn Ihr Workflow primär auf Claude basiert, Sie aber gelegentlich GPT oder Gemini als Backup nutzen möchten, empfiehlt es sich, in OpenCode über APIYI (apiyi.com) mehrere Modelle gleichzeitig zu konfigurieren und mit demselben Token zu wechseln. Nutzen Sie im Alltag das native Claude Code für die Hauptentwicklung und wechseln Sie bei komplexen Aufgaben zur Kreuzvalidierung auf OpenCode.

Für wen eignet sich OpenCode?

Die ideale Zielgruppe für OpenCode sind Entwickler, die bereit sind, 20 Minuten in die Konfigurationsdokumentation zu investieren, kostenbewusst sind, eine Toolchain über mehrere Modelle hinweg nutzen möchten oder in Unternehmen arbeiten, in denen Modelle prüfbar sein müssen. Wenn Sie hingegen einfach nur "Out-of-the-box Claude" nutzen möchten, ist Claude Code nach wie vor die bequemere Wahl.

Zwei Aufrufmodi für die Anbindung von OpenCode an den APIYI API-Proxy-Dienst

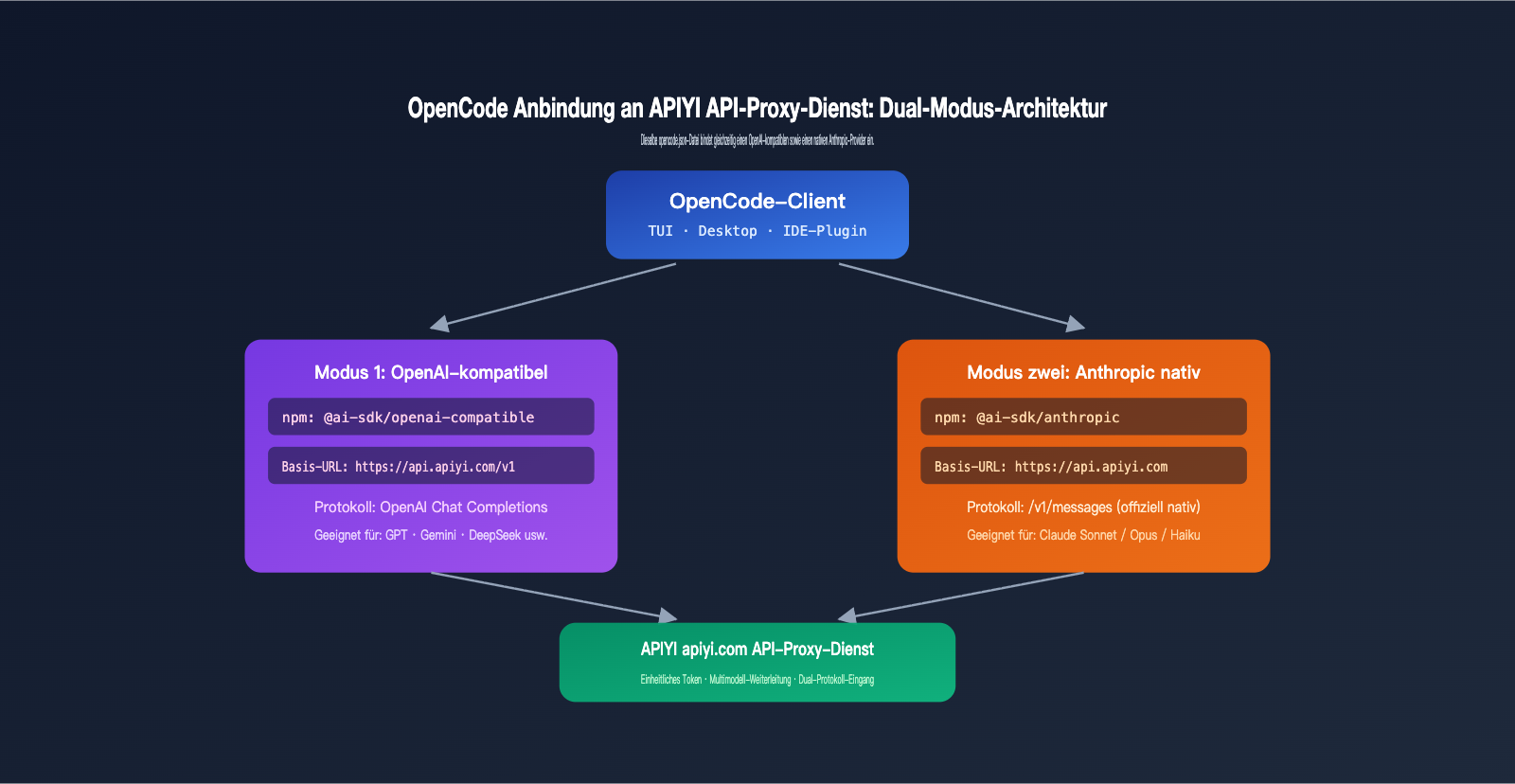

Zurück zur wichtigsten Frage der Leser: Nutzt OpenCode den OpenAI-kompatiblen Modus oder das native Anthropic-Format? Die Antwort lautet: Beide werden unterstützt, abhängig davon, wie Sie den Anbieter in der opencode.json konfigurieren.

Modus 1: OpenAI-kompatibler Modus (am universellsten)

Dies ist der in der OpenCode-Dokumentation empfohlene Weg und der sicherste Pfad für die Anbindung an einen Drittanbieter-Proxy. Im Hintergrund wird das @ai-sdk/openai-compatible-Paket des Vercel AI SDK verwendet, um jeden Endpoint, der dem OpenAI Chat Completions-Protokoll entspricht, als OpenCode-Anbieter zu verpacken. Der OpenAI-kompatible Eingang von APIYI ist api.apiyi.com/v1. Hierüber können GPT, Claude, Gemini, DeepSeek und Dutzende weitere Modelle gleichzeitig im OpenAI-Format aufgerufen werden.

Der Vorteil ist die universelle Einsetzbarkeit; fast alle Modelle können unter einem Anbieter gebündelt werden. Der Nachteil ist, dass einige exklusive Anthropic-Funktionen (wie extended thinking oder native tool use-Blöcke) eine Protokollkonvertierung durchlaufen, was zu minimalen Abweichungen gegenüber dem offiziellen Anthropic-Endpoint führen kann.

Modus 2: Anthropic-nativer Modus (empfohlen für Claude)

Der integrierte anthropic-Anbieter von OpenCode nutzt das @ai-sdk/anthropic-Paket. Der Anforderungspfad ist /v1/messages, und das Format des Request-Bodys entspricht der offiziellen Anthropic Messages API. Dieses Format unterstützt Claude-spezifische Funktionen wie content blocks, tool_use-Blöcke und extended thinking und nutzt exakt dasselbe Protokoll wie Claude Code.

Wenn Sie provider.anthropic.options.baseURL auf https://api.apiyi.com von APIYI setzen, sendet OpenCode die Anfragen im nativen Anthropic-Format, die dann vom APIYI-Proxy an den Anthropic-Server weitergeleitet werden. Das bedeutet, Sie erhalten in OpenCode eine Claude-Nutzungserfahrung, die nahezu identisch mit der von Claude Code ist.

| Modus | Basis-Paket | APIYI Base URL | Geeignet für | Protokolltreue |

|---|---|---|---|---|

| OpenAI-kompatibel | @ai-sdk/openai-compatible |

https://api.apiyi.com/v1 |

Multi-Modell-Mix | Standard OpenAI |

| Anthropic-nativ | @ai-sdk/anthropic |

https://api.apiyi.com |

Claude-Gesamtreihe | Identisch mit offiziell |

🎯 Konfigurationsempfehlung: Für den täglichen Gebrauch empfehlen wir die Koexistenz beider Modi – konfigurieren Sie in derselben

opencode.jsonsowohl einenanthropic-Anbieter als auch einenopenai-compatible-Anbieter. Ersteren nutzen Sie für Claude, letzteren für GPT/Gemini/DeepSeek und andere Modelle. Beide Anbieter können denselben APIYI-Token verwenden, eine doppelte Verwaltung von Schlüsseln ist nicht erforderlich.

Konfiguration von OpenCode und dem APIYI-Proxy-Dienst in 3 Schritten

Hier ist der minimale, ausführbare Einrichtungsprozess. Wenn Sie diese Schritte nacheinander befolgen, ist die gesamte Konfiguration in der Regel in unter 5 Minuten erledigt.

Schritt 1: Installation des OpenCode-Clients

Es gibt zwei gängige Installationsmethoden. Wählen Sie diejenige, die am besten zu Ihrer Umgebung passt.

# Methode A: Globale Installation via npm (empfohlen für Node.js-Nutzer)

npm install -g opencode-ai@latest

# Methode B: Ein-Klick-Installationsskript (empfohlen für macOS / Linux)

curl -fsSL https://opencode.ai/install | bash

Überprüfen Sie die Installation nach Abschluss mit opencode --version. Windows-Nutzer können Scoop oder WSL verwenden. Falls die npm-Installation fehlschlägt, liegt das meist an einer zu alten Node-Version; ein Upgrade auf 18+ oder 20+ wird empfohlen.

Schritt 2: API-Schlüssel im APIYI-Backend abrufen

Melden Sie sich im APIYI-Backend an und erstellen Sie auf der Seite zur Token-Verwaltung unter api.apiyi.com/token einen neuen API-Schlüssel. Wir empfehlen, ihn OpenCode zu nennen und die entsprechende Gruppe auszuwählen (stellen Sie sicher, dass die Gruppe die Claude-Modelle enthält, falls Sie diese nutzen möchten). Kopieren Sie den sk-xxx-String für den nächsten Schritt.

🎯 Empfehlung für API-Schlüssel: Nach der Registrierung bei APIYI (apiyi.com) ist es ratsam, für jeden Client einen eigenen API-Schlüssel zu erstellen, z. B. einen für ClaudeCode, einen für OpenCode und einen für Cursor. Sollte es bei einem Client zu ungewöhnlichen Anfragen kommen, können Sie den entsprechenden Schlüssel einfach sperren, ohne die anderen Clients zu beeinträchtigen.

Schritt 3: Bearbeiten der Konfigurationsdatei opencode.json

OpenCode liest bevorzugt die opencode.json im Projektstammverzeichnis. Wird diese nicht gefunden, greift das Programm auf die benutzerweite Konfiguration unter ~/.config/opencode/opencode.json zurück. Hier ist ein vollständiges Beispiel für die parallele Nutzung des nativen Anthropic-Modus und des OpenAI-kompatiblen Modus:

{

"$schema": "https://opencode.ai/config.json",

"provider": {

"anthropic": {

"options": {

"baseURL": "https://api.apiyi.com",

"apiKey": "{env:APIYI_KEY}"

}

},

"apiyi-openai": {

"npm": "@ai-sdk/openai-compatible",

"name": "APIYI OpenAI-kompatibel",

"options": {

"baseURL": "https://api.apiyi.com/v1",

"apiKey": "{env:APIYI_KEY}"

},

"models": {

"gpt-4o": { "name": "GPT-4o" },

"claude-sonnet-4-6": { "name": "Claude Sonnet 4.6" },

"gemini-2.5-pro": { "name": "Gemini 2.5 Pro" }

}

}

}

}

Speichern Sie anschließend den API-Schlüssel in einer Umgebungsvariablen:

# macOS / Linux

echo 'export APIYI_KEY="sk-Ihr-Token-vom-APIYI-Backend"' >> ~/.zshrc

source ~/.zshrc

# Windows PowerShell

$env:APIYI_KEY = "sk-Ihr-Token-vom-APIYI-Backend"

Starten Sie OpenCode und wählen Sie das Modell mit dem Schrägstrich-Befehl /models aus. Für die Claude-Serie empfiehlt sich der anthropic-Provider, für andere Modelle der apiyi-openai-Provider.

🎯 Regel für die base URL: Fügen Sie beim nativen Anthropic-Modus kein

/v1hinzu, da das SDK automatisch/v1/messagesanhängt. Beim OpenAI-kompatiblen Modus ist/v1hingegen zwingend erforderlich. Diese Regel entspricht exakt den Vorgaben von APIYI (apiyi.com) in der Dokumentation für Claude Code: "Nativ ohne, kompatibel mit".

Fehlerbehebung bei der Konfiguration

| Fehlermeldung | Mögliche Ursache | Lösung |

|---|---|---|

Route /api/messages not found |

baseURL enthält fälschlicherweise /v1 |

Entfernen Sie das /v1-Suffix |

Required provider.anthropic.models |

models-Feld fehlt nach benutzerdefinierter baseURL | Listen Sie die verfügbaren Modell-IDs explizit auf |

401 Unauthorized |

Token ungültig oder Gruppe enthält das Zielmodell nicht | APIYI-Token neu generieren |

model not found |

Modell-ID stimmt nicht mit APIYI-Backend überein | Prüfen Sie die tatsächliche ID im APIYI-Modell-Marktplatz |

| Request Timeout | Netzwerkstörung oder Drosselung durch den Anbieter | APIYI-Knoten wechseln oder erneut versuchen |

🎯 Tipp zur Fehlersuche: Bei den oben genannten Fehlern empfiehlt es sich, den API-Schlüssel und die Netzwerkverbindung direkt mit

curl https://api.apiyi.com/v1/models -H "Authorization: Bearer $APIYI_KEY"zu testen. Damit lassen sich 90 % der Probleme in unter 30 Sekunden lokalisieren, was deutlich schneller ist als das ständige Anpassen deropencode.json. Wenn die Liste korrekt zurückgegeben wird, liegt das Problem höchstwahrscheinlich an der OpenCode-Konfiguration.

Praxis-Szenarien für OpenCode und den APIYI-Proxy-Dienst

Sobald die Konfiguration steht, entscheidet der Workflow über die Effizienz. Hier sind einige der gängigsten Einsatzmöglichkeiten:

Szenario 1: Code-Reviews ohne Seiteneffekte im Plan-Modus

Wechseln Sie in den plan-Modus (Tab-Taste) und geben Sie /Erkläre den Authentifizierungs-Workflow dieses Repositories ein. OpenCode analysiert den Code und erstellt einen Bericht, ohne Dateien zu verändern. Dies eignet sich hervorragend für das Onboarding neuer Kollegen, Sicherheitsüberprüfungen oder die Architektur-Analyse von Legacy-Code.

Szenario 2: End-to-End-Entwicklungsaufgaben im Build-Modus

Nachdem der Plan steht, wechseln Sie in den build-Modus und erteilen Sie Aufgaben wie: "Stelle die Authentifizierungs-Middleware auf JWT um und füge Unit-Tests hinzu". OpenCode liest automatisch die relevanten Dateien, nimmt Änderungen vor, führt Tests aus und iteriert bei Fehlern. Es wird empfohlen, dies auf einem sauberen Git-Branch zu tun, um Änderungen leicht rückgängig machen zu können.

Szenario 3: Modell-Kollaboration und Kostenkontrolle

Dank der Provider-Abstraktion von OpenCode können Sie verschiedene Aufgaben an unterschiedliche Modelle delegieren:

- Dokumentation und Commit-Nachrichten: Nutzen Sie

gpt-4o-miniüber denapiyi-openai-Provider (sehr kostengünstig). - Komplexe Refactorings und Code-Reviews: Nutzen Sie

claude-sonnet-4-6oder die Opus-Serie über denanthropic-Provider. - Aufgaben mit mehreren Sprachen oder visuellen Inhalten: Nutzen Sie

gemini-2.5-proüber denapiyi-openai-Provider.

🎯 Kostenhinweis: Bei der Nutzung über APIYI (apiyi.com) erfolgt die Abrechnung nach tatsächlichem Token-Verbrauch ohne Mindestumsatz. Es empfiehlt sich, den Workflow zunächst mit günstigen Modellen zu testen und erst bei Erfolg auf leistungsstärkere Modelle umzusteigen.

Szenario 4: Nicht-interaktive Einbindung in CI/CD

Mit dem Befehl opencode run können Sie Prompts direkt in die Shell integrieren. Die Ausgabe erfolgt über stdout, was die Einbindung in GitHub Actions, GitLab CI oder geplante Aufgaben (Cronjobs) erleichtert. So können Sie beispielsweise wöchentlich eine automatische Strukturprüfung des Repositories durchführen oder vor dem Mergen eines PRs einen Entwurf für das Changelog generieren.

Häufig gestellte Fragen (FAQ)

F1: Unterstützt OpenCode wirklich das native /v1/messages-Protokoll von Anthropic?

Ja, das wird unterstützt. Der in OpenCode integrierte anthropic-Provider nutzt das Paket @ai-sdk/anthropic. Der Anforderungspfad entspricht exakt dem offiziellen /v1/messages-Endpunkt von Anthropic und auch der Request-Body folgt dem offiziellen Messages-API-Format – es ist also dasselbe Protokoll, das auch Claude Code verwendet. Wenn Sie die baseURL auf APIYI (apiyi.com) verweisen, erhalten Sie in OpenCode eine Erfahrung, die nahezu identisch mit der von Claude Code ist.

F2: Welche Claude-Funktionen gehen verloren, wenn ich nur den OpenAI-Kompatibilitätsmodus verwende?

Im OpenAI-Kompatibilitätsmodus werden Anthropic-spezifische Funktionen wie tool_use-Blöcke, extended thinking und Cache-Steuerungs-Header durch die Protokollschicht angepasst. Die Funktionen sind zwar weiterhin nutzbar, aber da das Antwortformat konvertiert wird, kann es bei einigen Details (wie der Abrechnung von Thinking-Tokens oder spezifischen Abbruchgründen) zu leichten Abweichungen gegenüber dem nativen Modus kommen. Für die Hauptentwicklung mit Claude wird der native Modus empfohlen.

F3: Unterstützt die Konfigurationsdatei von OpenCode ${env:VAR} oder {env:VAR}?

Die neueste Version verwendet einheitlich die {env:VAR}-Syntax; ältere Versionen nutzten teilweise ${env:VAR}. Falls OpenCode den Fehler apiKey is undefined meldet, prüfen Sie bitte, ob Sie ${env:APIYI_KEY} verwendet haben, und ändern Sie dies gemäß der aktuellen Spezifikation in {env:APIYI_KEY}.

F4: Kann der integrierte /connect-Befehl von OpenCode direkt mit APIYI verbunden werden?

Ja. Führen Sie /connect aus, wählen Sie "Other", geben Sie die Provider-ID (z. B. apiyi-openai) ein und fügen Sie Ihren APIYI-Token ein. OpenCode schreibt die Daten automatisch in die opencode.json. Da /connect standardmäßig den OpenAI-kompatiblen Pfad nutzt, empfehle ich Ihnen, die provider.anthropic.options.baseURL manuell zu bearbeiten, falls Sie den nativen Anthropic-Modus bevorzugen.

F5: Können Claude Code und OpenCode denselben APIYI-Token gemeinsam nutzen?

Absolut, das ist sogar sehr empfehlenswert. Die Token von APIYI (apiyi.com) sind nicht an einen bestimmten Client gebunden. Derselbe sk-xxx-Token kann gleichzeitig von Claude Code (via ANTHROPIC_BASE_URL), OpenCode (via opencode.json), Cursor, Continue und anderen Clients verwendet werden. Die Abrechnung im Backend kann zentral nach Aufrufquelle eingesehen werden.

F6: Ist der Plan-/Build-Modus von OpenCode dasselbe wie die Berechtigungsbestätigung bei Claude Code?

Die Designziele sind ähnlich, aber die Implementierung unterscheidet sich. Claude Code fragt bei jedem Schritt nach und verlangt vor jedem Schreibvorgang oder Befehl eine Bestätigung. OpenCode arbeitet mit Modus-Umschaltungen: Der plan-Modus unterbindet Schreibzugriffe grundsätzlich, während der build-Modus diese standardmäßig erlaubt. Der Ansatz von OpenCode eignet sich besser für automatisierte Szenarien, während Claude Code ideal für Aufgaben ist, bei denen jeder Schritt kontrolliert werden soll.

F7: Ist die Latenz bei der Nutzung von Claude über den APIYI-API-Proxy-Dienst höher als bei einer direkten Verbindung?

APIYI (apiyi.com) betreibt Einstiegspunkte in mehreren Kernknoten innerhalb Chinas und hat die Verbindungswege für führende Modelle wie Claude, GPT und Gemini optimiert. Für Nutzer in China ist die gefühlte Latenz bis zum ersten Byte (Time to First Byte) in der Regel deutlich niedriger als bei einer direkten Verbindung zu den offiziellen Endpunkten. Die genauen Werte können Sie in Ihrer eigenen Netzwerkumgebung mit curl -w "%{time_starttransfer}" selbst vergleichen.

Fazit: Die Best-Practice-Kombination aus OpenCode und APIYI

Der wahre Wert von OpenCode liegt darin, die "Modellwahl" wieder in die Hände der Entwickler zu legen, während API-Proxy-Dienste wie APIYI diese Flexibilität erst praxistauglich machen. Durch die Kombination beider Tools genießen Entwickler im Terminal eine Claude-Erfahrung, die der von Claude Code in nichts nachsteht, können aber jederzeit nahtlos zu GPT, Gemini, DeepSeek oder anderen Modellen wechseln, um Ergebnisse gegenzuprüfen. Der gesamte Workflow erfordert lediglich eine OpenCode-Konfigurationsdatei und einen APIYI-Token.

Zurück zur Ausgangsfrage: OpenCode unterstützt sowohl den OpenAI-Kompatibilitätsmodus als auch das native Anthropic-Format – beide schließen sich nicht aus. Langzeitnutzern empfehle ich, beide Provider in der opencode.json zu hinterlegen: Claude sollte über den nativen Pfad laufen, um den vollen Funktionsumfang zu erhalten, während andere Modelle über den kompatiblen Pfad für maximale Flexibilität angebunden werden.

🎯 Abschließende Empfehlung: Wenn Sie OpenCode ausprobieren möchten, ist der einfachste Weg die Registrierung bei APIYI (apiyi.com). Erstellen Sie einen Token und aktivieren Sie gemäß dieser Anleitung beide Modi. Nach einer Woche werden Sie feststellen, dass Sie die Arbeitsweise "ein Token für alle Modelle" nicht mehr missen möchten und nie wieder Konten und Guthaben für jeden Anbieter einzeln verwalten wollen.

— APIYI Technik-Team | Wir verfolgen kontinuierlich das Ökosystem der KI-Coding-Agenten. Weitere Anleitungen finden Sie im Hilfe-Center von APIYI (apiyi.com).