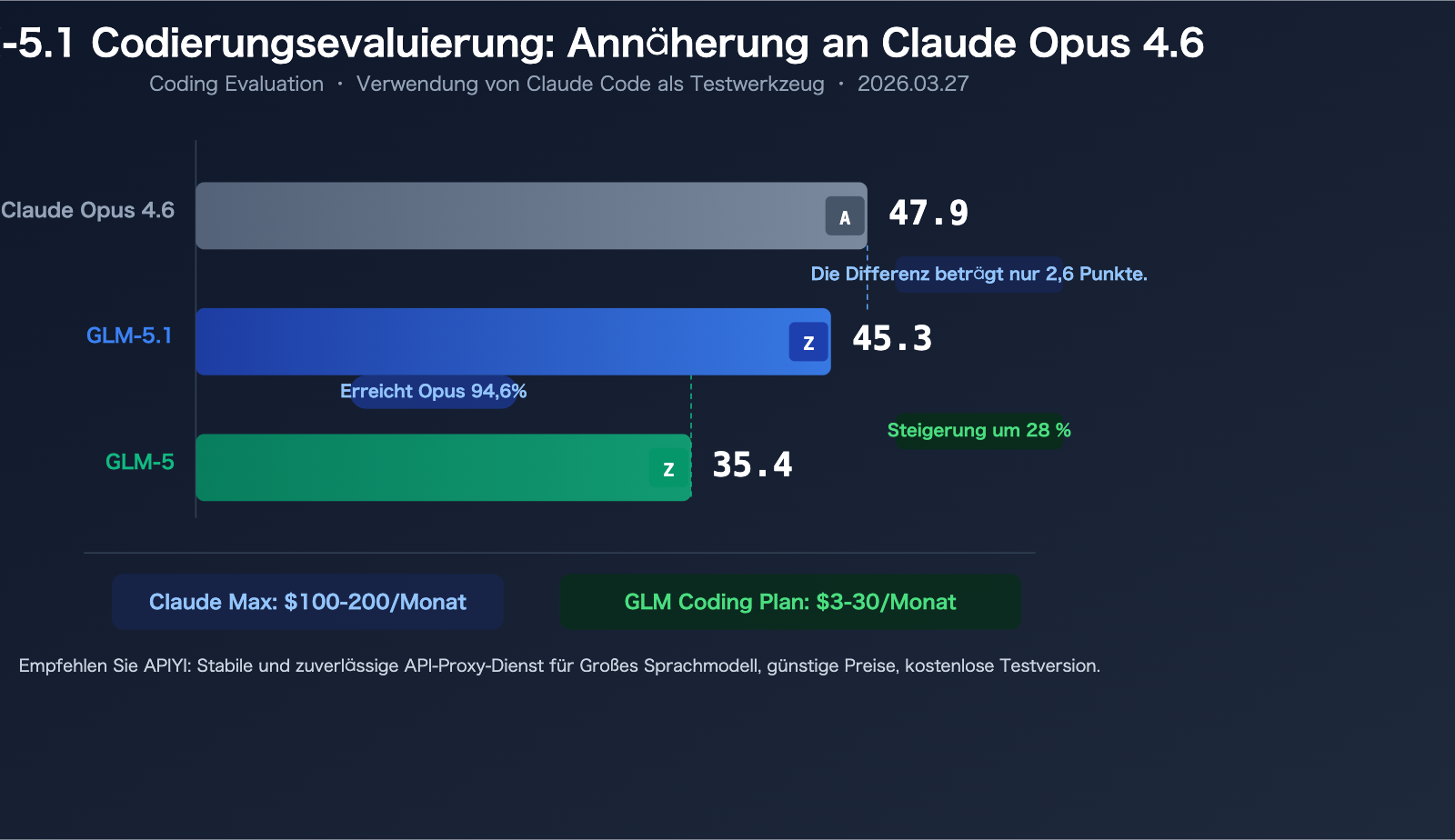

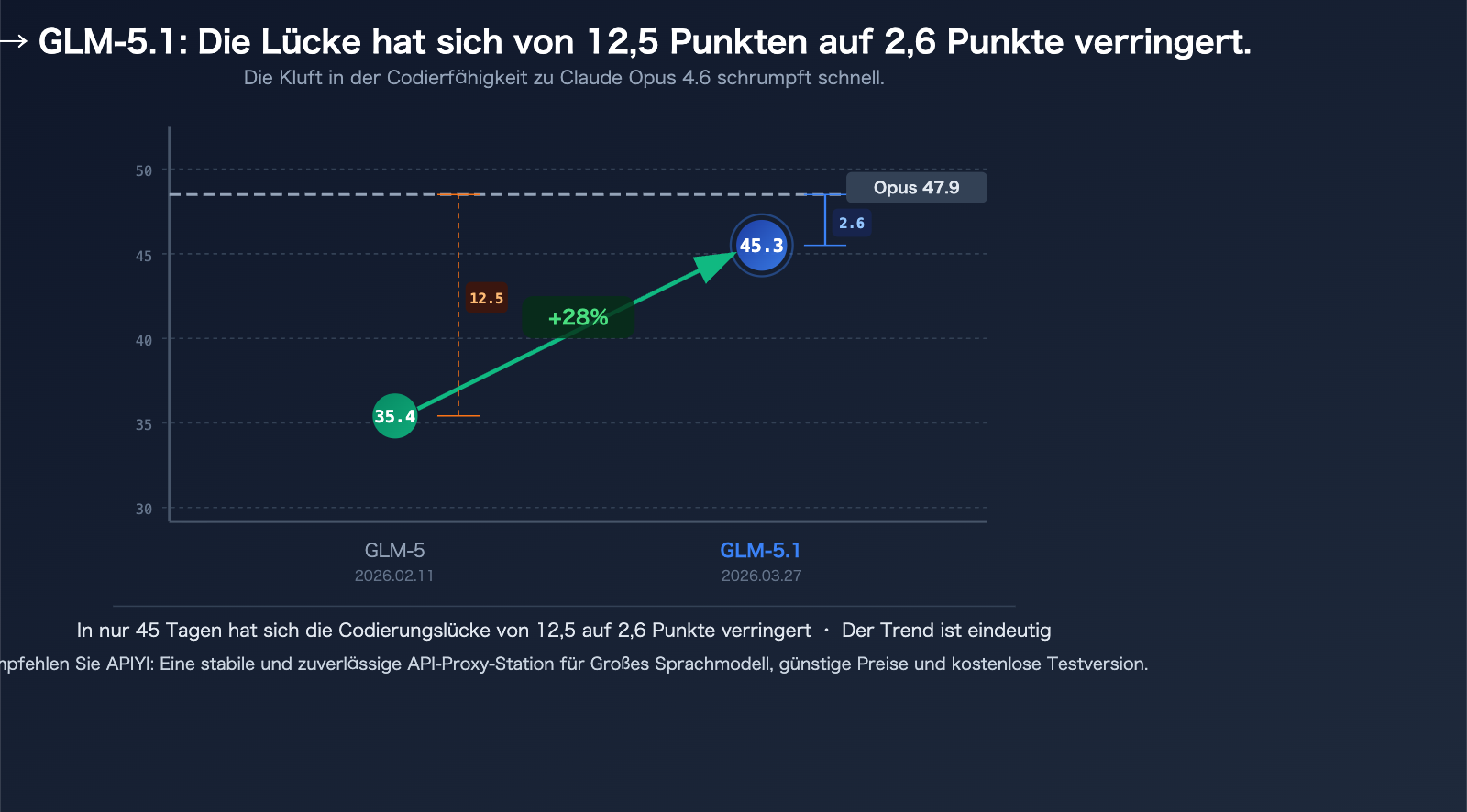

Am 27. März 2026 gab Z.ai (ehemals ZhiPu AI) offiziell bekannt: GLM-5.1 ist jetzt verfügbar und kann von allen Nutzern des GLM Coding Plans verwendet werden. In einem Codierungs-Benchmark, der Claude Code als Testwerkzeug nutzte, erzielte GLM-5.1 45,3 Punkte – nur 2,6 Punkte weniger als die 47,9 Punkte von Claude Opus 4.6, was 94,6 % des Opus-Niveaus entspricht.

Noch überraschender ist, dass GLM-5.1 im Vergleich zu seinem Vorgänger GLM-5 (35,4 Punkte) eine Verbesserung von 28 % erzielt – ein enormer Sprung zwischen den Generationen.

Und was kostet der Einstieg? Der GLM Coding Plan beginnt bei nur 3 US-Dollar pro Monat (im Angebot), der reguläre Preis startet bei nur 10 US-Dollar pro Monat.

Kernwert: Dieser Artikel analysiert die verbesserte Codierungsfähigkeit von GLM-5.1, die Details und Nutzungsmöglichkeiten des Coding Plans sowie seinen praktischen Wert als kostengünstige Alternative zu den hohen offiziellen Claude-Preisen und gelegentlichen Rechenleistungsproblemen. Sobald die API verfügbar ist, wird APIYI sie umgehend integrieren.

Kernaussagen: Claude Code als Testwerkzeug

Die von Z.ai offiziell veröffentlichten Codierungsevaluierungen (Coding Evaluation) verwenden Claude Code als Testframework – ein wichtiges Detail. GLM-5.1 zeigt in der eigenen Testumgebung von Claude eine Leistung, die nahe an Opus heranreicht.

| Modell | Coding Evaluation Score | Abstand zu Opus | vs GLM-5 Verbesserung |

|---|---|---|---|

| Claude Opus 4.6 | 47.9 | — | — |

| GLM-5.1 | 45.3 | -2.6 (94.6%) | +28% |

| GLM-5 | 35.4 | -12.5 (73.9%) | Basis |

Drei wichtige Erkenntnisse:

1. GLM-5.1 erreicht 94.6% von Claude Opus 4.6

Ein Abstand von 2,6 Punkten ist in den meisten praktischen Codierungsszenarien vernachlässigbar. Das bedeutet, dass die Nutzererfahrung bei der täglichen Code-Assistenz mit GLM-5.1 bereits sehr nahe an Opus herankommt.

2. Der Sprung von GLM-5 zu GLM-5.1 ist bemerkenswert

Von 35,4 auf 45,3 – eine Verbesserung um 28%. Bedenkt man, dass GLM-5 erst im Februar 2026 veröffentlicht wurde (mit einem SWE-bench Verified Score von 77,8%, was bereits führend unter Open-Source-Modellen war), ist eine so große Iteration in nur etwas mehr als einem Monat beeindruckend und spricht für die technischen Fähigkeiten von Z.ai.

3. Fairness der Testumgebung

Die Verwendung von Claude Code als Testframework bedeutet, dass diese Evaluation für Claude-Modelle einen inhärenten Vorteil bietet (Claude Code ist für die Claude-Serie optimiert). Dass GLM-5.1 "auswärts" 94,6% erreicht, deutet darauf hin, dass seine tatsächliche Fähigkeit möglicherweise noch höher ist.

Technische Verbesserungen von GLM-5.1 gegenüber GLM-5

Obwohl der vollständige technische Bericht zu GLM-5.1 noch nicht veröffentlicht ist, lassen sich auf Basis von GLM-5 und bekannten Informationen Rückschlüsse ziehen:

| Technische Dimension | GLM-5 | GLM-5.1 (bekannt/geschätzt) |

|---|---|---|

| Gesamtparameter | 7440 Milliarden | Nicht öffentlich (voraussichtlich ≥GLM-5) |

| Aktivierte Parameter | 400 Milliarden | Nicht öffentlich |

| Architektur | MoE | MoE (vermutlich verbessert) |

| Kontext | 200K Tokens | Nicht öffentlich (voraussichtlich ≥200K) |

| Trainingsdaten | 28,5T Tokens | Nicht öffentlich (voraussichtlich mehr) |

| Lizenz | MIT Open Source | Bestätigt wird Open Source sein |

| Coding Evaluation | 35,4 | 45,3 (+28%) |

Der globale Leiter von Z.ai, Li Zixuan, bestätigte am 20. März via Tweet: "Don't panic. GLM-5.1 will be open source." – Das bedeutet, dass die Modellgewichte von GLM-5.1 letztendlich wie bei GLM-5 unter der MIT-Lizenz veröffentlicht werden.

🎯 Branchenperspektive: Das Open-Source-Versprechen für GLM-5.1 ist sehr wichtig. Es bedeutet, dass Drittanbieter-Inferenzplattformen (einschließlich APIYI apiyi.com) das Modell nach dem offiziellen API-Start schnell integrieren können, möglicherweise sogar zu niedrigeren Preisen als der offizielle Dienst anbieten.

GLM Coding Plan im Detail: KI-Codierung ab 3 US-Dollar

Der GLM Coding Plan ist ein abonnementbasierter KI-Codierungsdienst von Z.ai. Sein Hauptvorteil: Sie erhalten ein Codierungserlebnis auf nahezu Claude-Niveau zu einem weitaus niedrigeren Preis.

Vergleich der drei Tarife

| Tarif | Monatspreis (regulär) | Aktionspreis | Anfragen / 5 Std. | Monatliche Suchen |

|---|---|---|---|---|

| Lite | 10 $/Monat | 3 $ (erster Monat) | 120 | 100 |

| Pro | 30 $/Monat | 15 $ (erster Monat) | 600 | 1.000 |

| Max | Höher | — | Mehr | 4.000 |

Unterstützte Modelle und Tools im Coding Plan

Enthaltene Modelle:

- GLM-5.1 (neueste Version, Codierungs-Benchmark: 45,3)

- GLM-5 (Codierungs-Benchmark: 35,4)

- GLM-5-Turbo (schnellere Version)

- GLM-4.7

Kompatible Codierungstools:

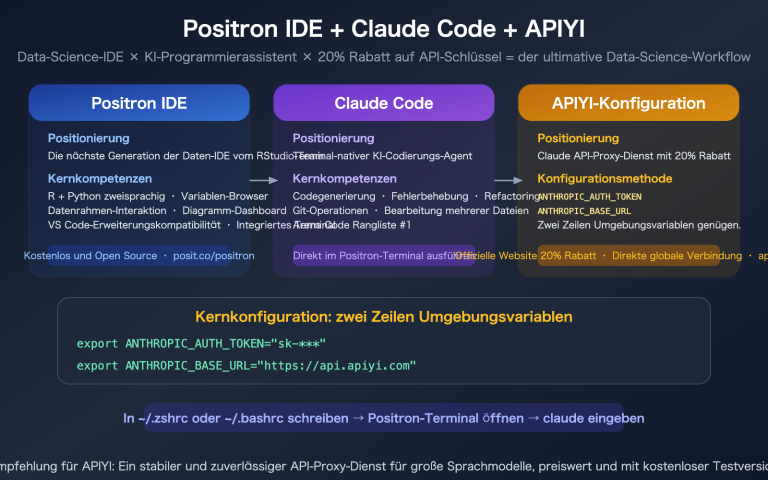

- Claude Code (über API-Kompatibilitätsschicht)

- Cline

- Kilo Code

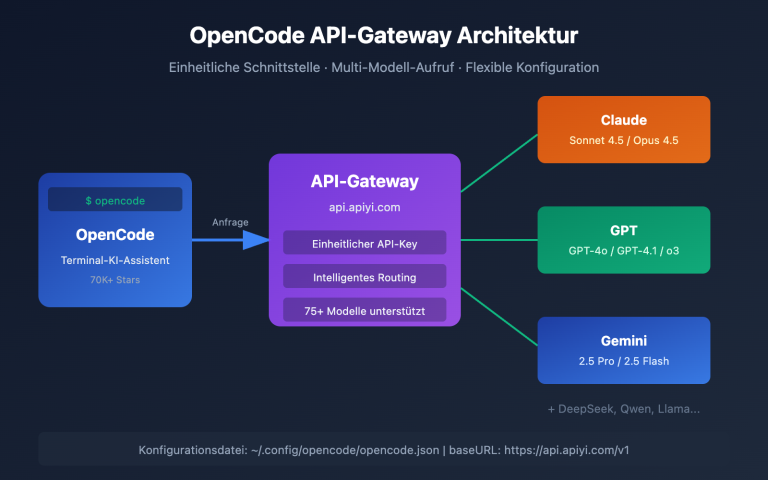

- OpenCode

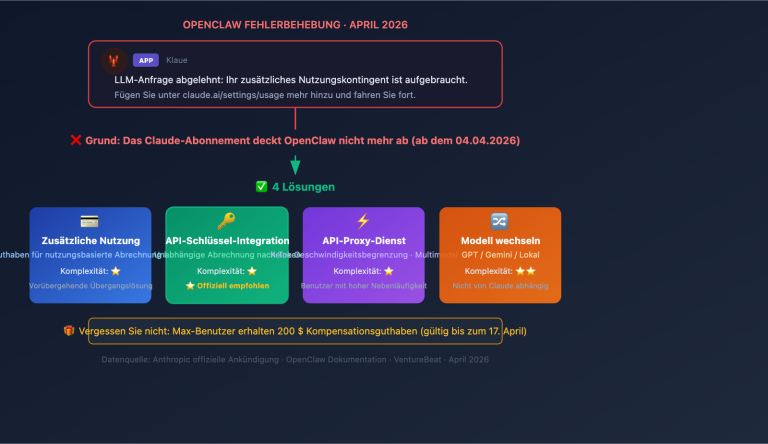

- Clawdbot / OpenClaw

Zusätzliche Funktionen:

- Visuelles Verständnis (Vision Understanding)

- Web Search MCP

- Web Reader MCP

- Zread MCP

- Generierungsgeschwindigkeit: 55+ Tokens/Sekunde

- Keine Netzwerkbeschränkungen, kein Risiko von Kontosperrungen

Kostenvergleich: Coding Plan vs. Claude-Abonnement

Hier der direkte Preis-Leistungs-Vergleich:

| Vergleich | GLM Coding Lite | GLM Coding Pro | Claude Pro | Claude Max |

|---|---|---|---|---|

| Monatspreis | 10 $ (Aktion: 3 $) | 30 $ (Aktion: 15 $) | 20 $ | 100-200 $ |

| Codierfähigkeit | 45,3 (GLM-5.1) | 45,3 (GLM-5.1) | Sonnet-Level | Opus-Level (47,9) |

| Anteil an Opus-Leistung | 94,6 % | 94,6 % | ~80 % | 100 % |

| Kosten/Leistungs-Verhältnis | Sehr hoch | Hoch | Mittel | Mittel bis niedrig |

Ein Entwickler teilte auf Medium: "Mit dem GLM Coding Plan erhalte ich für 30 $/Monat die dreifache Nutzungsmenge wie mit Claude Max." – Diese subjektive Bewertung spiegelt echte Community-Erfahrungen wider.

💰 Kostencheck: Wenn Sie monatlich mehr als 30 $ für die Claude-API ausgeben, hauptsächlich für Codieraufgaben, ist der GLM Coding Pro Plan eine ernsthafte Überlegung wert. Für 30 $/Monat erhalten Sie ein Modell mit 94,6 % der Codierleistung von Opus – das Preis-Leistungs-Verhältnis ist wirklich gut.

Unsere Perspektive: Kostengünstige Alternative bei instabiler Claude-Leistung

Als API-Aggregator-Plattform beobachtet APIYI im täglichen Betrieb einen echten Schmerzpunkt: Die Rechenleistung von Claude ist gelegentlich instabil. Besonders in Stoßzeiten nehmen die Antwortverzögerung von Opus 4.6 und die Wartezeit in der Anfragewarteschlange zu, was die Produktivität von Entwicklern beeinträchtigt.

Warum ist der GLM Coding Plan eine gute Alternative?

Grund 1: Die Codierfähigkeit ist bereits sehr nah dran

45,3 vs. 47,9 – dieser Unterschied von 2,6 Punkten ist im täglichen Coding kaum spürbar. GLM-5.1 kann die meisten Aufgaben problemlos bewältigen, außer Sie arbeiten an extrem komplexer Code-Architektur oder tiefgreifenden Denkaufgaben.

Grund 2: Der Preisunterschied ist enorm

Claude Max kostet 100-200 $/Monat, GLM Coding Pro nur 30 $. Wenn Sie das gesparte Geld für wirklich opus-würdige Szenarien verwenden (z.B. bedarfsgerechte API-Aufrufe), könnten Ihre Gesamtkosten sogar noch niedriger sein.

Grund 3: Keine Sorge vor instabiler Leistung

Der GLM Coding Plan verspricht keine Netzwerkbeschränkungen und kein Risiko von Kontosperrungen. Zwar hatte Z.ai selbst Ende Februar mit knapper Rechenleistung zu kämpfen, aber das Abonnementmodell ermöglicht eine vorhersehbarere Kapazitätsplanung.

Grund 4: Gute Tool-Kompatibilität

Direkte Kompatibilität mit Claude Code – Sie müssen Ihr Codierungstool nicht wechseln, sondern nur den API-Endpunkt anpassen, um von Claude auf GLM umzusteigen. Für Entwickler, die bereits an den Claude-Code-Workflow gewöhnt sind, sind die Migrationskosten nahezu null.

Wann sollten Sie weiterhin Claude verwenden?

GLM-5.1 ist eine gute Alternative, aber nicht für alle Szenarien die optimale Lösung:

- Benötigung eines 1M-Kontextfensters: Claude Opus 4.6 unterstützt 1 Mio. Tokens, die GLM-5-Serie 200K.

- Benötigung maximaler Denktiefe: Opus hat bei tiefgreifendem Denken und komplexen Analysen immer noch Vorteile.

- Benötigung multimodaler Ausgaben: Claudes Bildverständnis und Langtext-Erstellung sind in manchen Szenarien stärker.

- Unternehmens-Compliance-Anforderungen: Einige Unternehmen haben spezifische Anforderungen an Modellanbieter.

🎯 Empfohlene Strategie: Nutzen Sie den GLM Coding Plan als Hauptwerkzeug für das tägliche Coding und rufen Sie Claude Opus bei Bedarf über APIYI (apiyi.com) für komplexe Aufgaben auf. Diese Kombination aus "GLM für den Alltag + Claude für schwere Geschütze" kann bei gleicher Effektivität die Gesamtkosten erheblich senken.

GLM-5.1 API-Integration: Aktueller Status und Vorbereitung

Aktueller Status

Stand 27. März 2026 ist der Status von GLM-5.1 wie folgt:

| Kanal | Status | Erläuterung |

|---|---|---|

| GLM Coding Plan (z.ai) | ✅ Verfügbar | Für alle Coding Plan-Nutzer nutzbar |

| Z.ai offizielle API | ⏳ Noch nicht verfügbar | Warten auf offizielle Freigabe |

| APIYI apiyi.com | ⏳ Wartet auf Integration | Unterstützung direkt nach API-Start |

| Open-Source-Gewichte | ⏳ Open Source zugesagt | Konkreter Zeitpunkt noch unklar |

Vorbereitungen, die Sie jetzt treffen können

Möglichkeit 1: Direkte Nutzung von GLM Coding Plan

Besuchen Sie z.ai/subscribe, um den Coding Plan zu abonnieren. Anschließend können Sie GLM-5.1 in Claude Code verwenden.

Möglichkeit 2: GLM-5 über API aufrufen (aktuell verfügbar)

Die API für GLM-5 ist bereits verfügbar. Die Preise liegen bei $1,00/M Tokens für Input und $3,20/M Tokens für Output. Obwohl die Bewertung im Coding-Benchmark (35,4) niedriger ist als bei GLM-5.1 (45,3), ist es bei anderen Aufgaben immer noch sehr leistungsfähig (SWE-bench Verified 77,8%).

import openai

client = openai.OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1" # APIYI einheitliche Schnittstelle

)

# Aktuell verfügbar: GLM-5

response = client.chat.completions.create(

model="glm-5",

messages=[

{"role": "user", "content": "Optimieren Sie die Leistung dieses Python-Codes"}

]

)

# Nach Start der GLM-5.1 API umschalten

# model="glm-5.1"

print(response.choices[0].message.content)

Vollständigen Code anzeigen (inkl. GLM + Claude Hybrid-Aufrufstrategie)

import openai

import time

# Über APIYI einheitliche Schnittstelle mehrere Modelle aufrufen

client = openai.OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

# Modellauswahlstrategie: Einfache Aufgaben mit GLM, komplexe mit Claude

def smart_route(prompt, complexity="normal"):

"""

Wählt automatisch das Modell basierend auf der Aufgabenkomplexität

- simple: GLM-5 (niedrigste Kosten)

- normal: GLM-5.1 (nach Start umschalten)

- complex: Claude Opus 4.6 (stärkste Schlussfolgerung)

"""

model_map = {

"simple": "glm-5",

"normal": "glm-5", # Nach GLM-5.1-Start auf "glm-5.1" ändern

"complex": "claude-opus-4-6"

}

model = model_map.get(complexity, "glm-5")

start = time.time()

response = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}],

max_tokens=2000,

temperature=0.7

)

elapsed = time.time() - start

return {

"model": model,

"content": response.choices[0].message.content,

"time": f"{elapsed:.2f}s",

"tokens": response.usage.total_tokens

}

# Beispiel: Alltägliches Codieren mit GLM, tiefgehende Analyse mit Claude

tasks = [

("Schreiben Sie eine Python-Implementierung für Quicksort", "simple"),

("Refaktorisieren Sie den Datenbank-Verbindungspool für diesen Microservice", "normal"),

("Entwerfen Sie einen Kompensationsmechanismus für eine verteilte Transaktion", "complex"),

]

for prompt, complexity in tasks:

result = smart_route(prompt, complexity)

print(f"[{complexity}] Modell: {result['model']}")

print(f" Dauer: {result['time']} | Tokens: {result['tokens']}")

print(f" Antwort: {result['content'][:100]}...\n")

🚀 Schnellstart: APIYI apiyi.com unterstützt bereits jetzt API-Aufrufe für GLM-5. Sobald die GLM-5.1 API offiziell startet, wird APIYI sie sofort integrieren. Bei der Registrierung erhalten Sie kostenloses Guthaben, gleichzeitig unterstützt es den einheitlichen Aufruf mehrerer Modelle wie Claude, GPT, Gemini und GLM.

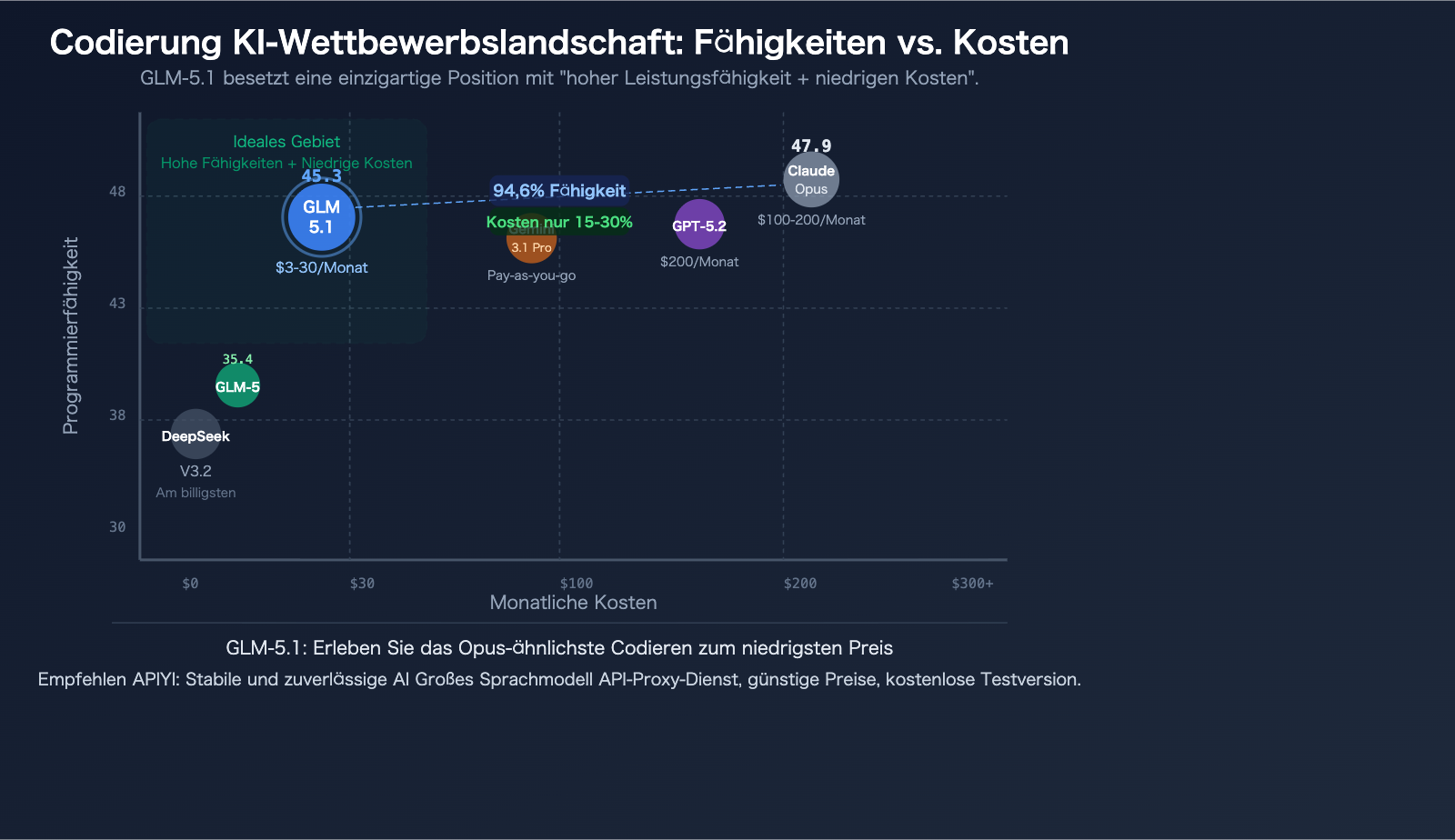

GLM-5.1 und das Wettbewerbsumfeld anderer Coding-KIs

Der Start von GLM-5.1 macht das Wettbewerbsfeld der Coding-KIs noch interessanter:

| Modell | Positionierung der Coding-Fähigkeiten | Preispositionierung | API-Status | Open-Source-Status |

|---|---|---|---|---|

| Claude Opus 4.6 | Stärkste (47,9) | Höchste | Öffentlich verfügbar | Closed Source |

| GLM-5.1 | Nahe an Opus (45,3) | Niedrig ($3-30/Monat) | Über Coding Plan verfügbar | Wird Open Source |

| Gemini 3.1 Pro | Stark (in mehreren Benchmarks führend) | Mittel | Als Preview verfügbar | Closed Source |

| GPT-5.2 | Stark | Hoch | Öffentlich verfügbar | Closed Source |

| DeepSeek V3.2 | Mittel | Niedrigste | Öffentlich verfügbar | Open Source |

| GLM-5 | Gut (35,4) | Niedrig | Öffentlich verfügbar | MIT Open Source |

Die einzigartige Positionierung von GLM-5.1 liegt darin: Mit der Transparenz eines Open-Source-Modells und den niedrigen Preisen eines Abonnements bietet es Coding-Fähigkeiten, die den Closed-Source-Spitzenmodellen nahekommen. Dies gab es zuvor nicht – zum ersten Mal kommen Open-Source-Modelle in ihren Coding-Fähigkeiten den Closed-Source-Spitzenreitern so nahe.

Häufig gestellte Fragen

Q1: Wann wird die GLM-5.1-API verfügbar sein?

Es gibt derzeit kein genaues Datum. GLM-5.1 ist im Coding Plan verfügbar, aber eine eigenständige API-Schnittstelle wurde noch nicht veröffentlicht. Basierend auf dem Zeitraum zwischen Veröffentlichung und API-Freigabe von GLM-5, könnte die GLM-5.1-API innerhalb weniger Wochen online gehen. APIYI apiyi.com wird die API sofort nach der offiziellen Freigabe integrieren. Anschließend können Sie GLM-5.1 direkt über die einheitliche Schnittstelle aufrufen.

Q2: Wie kann ich den GLM Coding Plan in Claude Code verwenden?

Die API von Z.ai ist mit dem Anthropic-API-Format kompatibel. Daher kann Claude Code Anfragen an Z.ai weiterleiten, indem der API-Endpunkt geändert wird. Konkret müssen Sie in der Konfiguration von Claude Code den API-Endpunkt von der offiziellen Anthropic-URL auf den von Z.ai bereitgestellten Endpunkt ändern. Alle anderen Einstellungen bleiben unverändert. Detaillierte Konfigurationsanweisungen finden Sie in der Z.ai-Entwicklerdokumentation: docs.z.ai.

Q3: Kann GLM-5.1 Claude Opus 4.6 vollständig ersetzen?

Bei Codierungsaufgaben hat GLM-5.1 (45,3 Punkte) Claude Opus (47,9 Punkte) fast eingeholt. Im täglichen Einsatz sind die Unterschiede kaum spürbar. Opus hat jedoch in folgenden Szenarien noch deutliche Vorteile: extrem lange Kontexte mit 1M Token, tiefgreifende Schlussfolgerungen und komplexe mehrstufige Agenten-Workflows. Wir empfehlen die Strategie "GLM für den Alltag + Claude für schwere Aufgaben" – nutzen Sie GLM für die tägliche Codierung, um Kosten zu sparen, und rufen Sie Opus bei komplexen Aufgaben über APIYI apiyi.com bei Bedarf auf.

Fazit: GLM-5.1 verändert das Preis-Leistungs-Verhältnis bei KI für die Codierung

Die Einführung von GLM-5.1 ist ein wichtiger Meilenstein im Bereich der KI für die Codierung im Jahr 2026 – erstmals hat ein Open-Source-Modell (das bald Open-Source wird) in einem Codierungs-Benchmark 94,6 % der Leistung von Claude Opus 4.6 erreicht, und das zu einem Bruchteil des Preises.

3 Kernpunkte:

- Codierungsfähigkeit nahe am Maximum: 45,3 vs. 47,9, nur 2,6 Punkte Unterschied, im Alltag kaum merkbar.

- Überragender Preisvorteil: Coding Plan 3-30 $/Monat vs. Claude Max 100-200 $/Monat.

- API kommt bald: APIYI wird die GLM-5.1-API sofort nach Verfügbarkeit integrieren, dann ist der Aufruf über die einheitliche Schnittstelle möglich.

In einer Zeit, in denen die offiziellen Claude-Preise hoch sind und die Rechenleistung gelegentlich instabil ist, hat sich der GLM Coding Plan bereits als zuverlässige und kostengünstige Alternative bewährt. Egal, ob Sie sich für das Abonnementmodell des Coding Plans entscheiden oder auf die nutzungsbasierte API warten – GLM-5.1 gehört in Ihren Werkzeugkasten für KI-gestützte Codierung.

Autor: APIYI Team | APIYI apiyi.com wird GLM-5.1 sofort nach API-Freigabe unterstützen. Besuchen Sie uns für kostenlose Testguthaben und nutzen Sie einheitliche Aufrufe für Claude, GLM, GPT und Gemini.

📚 Referenzen

-

Z.ai Offizielle Ankündigung: GLM-5.1 Coding Plan ist verfügbar

- Link:

z.ai/subscribe - Beschreibung: GLM Coding Plan abonnieren, um GLM-5.1 zu nutzen

- Link:

-

Z.ai Offizieller Blog: Technische Einführung zu GLM-5

- Link:

z.ai/blog/glm-5 - Beschreibung: Details zur Architektur, Trainingsdaten und Benchmark-Ergebnissen von GLM-5

- Link:

-

Z.ai Entwicklerdokumentation: API-Integration und Preisgestaltung

- Link:

docs.z.ai/guides/overview/pricing - Beschreibung: Modellpreise, API-Aufrufspezifikationen und Anleitungen zur Tool-Integration

- Link:

-

Artificial Analysis: Unabhängige Bewertung von GLM-5

- Link:

artificialanalysis.ai/models/glm-5 - Beschreibung: Drittanbieter-Benchmark-Daten und Modellvergleiche

- Link:

-

GLM-5 GitHub Repository: Open-Source-Modellgewichte

- Link:

github.com/zai-org/GLM-5 - Beschreibung: Unter MIT-Lizenz veröffentlicht, enthält Modellgewichte und Nutzungsanleitungen

- Link: