ملاحظة المؤلف: تحليل عميق للأسباب التقنية لعدم دعم Nano Banana Pro لمعلمة seed، وما هي البدائل العملية المتاحة عندما ترغب في إعادة إنتاج تأثير معين نال إعجابك في عمليات توليد جماعية.

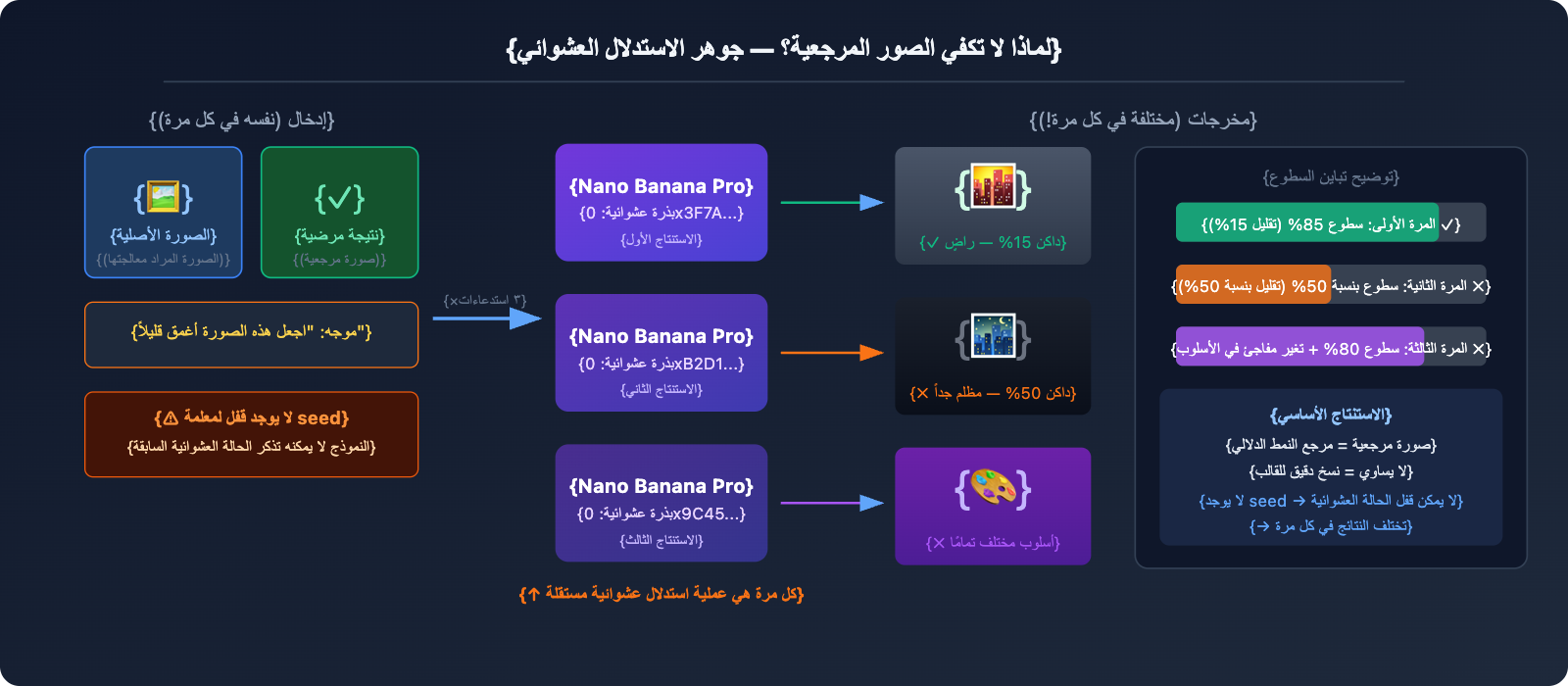

إليك ملاحظة من مستخدم حقيقي: "لقد قمت بتعديل صورة وحصلت على نتيجة مرضية جداً، وأريد الآن تطبيق نفس التأثير تماماً على عدة صور أخرى، فما العمل؟ لأن النتائج تختلف في كل مرة." هذه هي المشكلة الشائعة عند استخدام Nano Banana Pro للقيام بعمليات "صورة إلى صورة" (img2img) بالجملة. فحتى لو وضعت الصورة التي أعجبتك كصورة مرجعية، ستظل النتائج غير متسقة — والسبب بسيط: Nano Banana Pro لا يدعم رسمياً معلمة seed، وكل عملية توليد هي عملية استنتاج عشوائية جديدة تماماً.

القيمة الجوهرية: هذا المقال يدخل في صلب الموضوع مباشرة، حيث يوضح أولاً لماذا لا يوجد seed ولماذا لا تكفي الصورة المرجعية، ثم يقدم 5 بدائل فعالة لمساعدتك على إعادة إنتاج التأثيرات المرضية قدر الإمكان في غياب الـ seed.

لنوضح الأمر أولاً: لماذا لا يمتلك Nano Banana Pro خاصية الـ Seed؟

نظرة عامة على المعلمات الرسمية

يدعم generationConfig في Nano Banana Pro (gemini-3-pro-image-preview) المعلمات التالية:

| اسم المعلمة | الوظيفة | قيمة مثال |

|---|---|---|

responseModalities |

تحديد نوع المخرجات | ["IMAGE"] |

resolution |

دقة الصورة | "1K" / "2K" / "4K" |

aspectRatio |

نسبة العرض إلى الارتفاع | "16:9" / "1:1" / "2:3" |

candidateCount |

عدد النتائج المرشحة في وقت واحد | 1 (ثابت عند 1 لتوليد الصور) |

temperature |

العشوائية في جزء النص (لا تؤثر على الصورة) | 1.0 (يُنصح بالافتراضي) |

معلمة seed: ليست موجودة في القائمة، وغير مدعومة رسمياً.

محاولة تمرير seed في الكود ستؤدي إلى خطأ مباشر:

# ❌ سيؤدي هذا إلى خطأ: Unknown field 'seed' in GenerationConfig

response = model.generate_content(

prompt,

generation_config=genai.GenerationConfig(

response_modalities=["IMAGE"],

seed=42 # ← خطأ! النموذج لا يدعم هذه المعلمة رسمياً

)

)

Gemini Image API مقابل Imagen API: خدمتان مختلفتان

قد يجد الكثيرون عند البحث في مستندات Google الرسمية وجود معلمة seed بالفعل، ولكن ذلك يخص Imagen API (خدمة توليد الصور على Vertex AI)، وليس Nano Banana Pro:

| وجه المقارنة | Nano Banana Pro | Imagen API (Vertex AI) |

|---|---|---|

| معرف النموذج | gemini-3-pro-image-preview |

imagen-3.0-generate-002 |

| دعم الـ Seed | ❌ غير مدعوم | ✅ مدعوم (معلمة seed) |

| نقطة نهاية API | Google Generative AI | Vertex AI |

| حزمة SDK | google-generativeai |

google-cloud-aiplatform |

| جودة الصورة | واقعية فائقة، معالجة قوية للنصوص | جودة عالية، أنماط متنوعة |

| السعر (APIYI) | 0.05 دولار / للصورة | تسعير منفصل |

الخلاصة: إذا كنت بحاجة ماسة إلى قابلية التكرار (reproducibility) عبر الـ seed، فيجب عليك الانتقال إلى Imagen API، بدلاً من محاولة استخدام معلمات غير موجودة في Nano Banana Pro. علماً بأن الموزعين الخارجيين مثل APIYI لا يدعمون Imagen API حالياً، حيث لا يمكن استخدام هذا الـ API إلا عبر مفتاح (KEY) من الموقع الرسمي.

لماذا لا تكفي الصور المرجعية أيضاً؟

قد تبدو فكرة إدخال نتيجة مرضية كصورة مرجعية مرة أخرى هي الحل الأكثر بديهية، لكن التأثير الفعلي "متواضع". والسبب الجذري هو:

يفهم Nano Banana Pro الصورة المرجعية كـ "مرجع للنمط" وليس كـ "قالب للنسخ". عندما ترفع صورة مرجعية وتقول "اجعل هذه الصورة أغمق قليلاً"، سيقوم النموذج بـ:

- تحليل النمط العام، التكوين، والمحتوى للصورة المرجعية.

- إعادة فهم الموجه "اجعلها أغمق قليلاً".

- توليد صورة جديدة تماماً من الصفر تتوافق مع التوجيهات.

هذه العملية تتضمن عشوائية في كل مرة، لذا فإن "أغمق قليلاً" قد تكون في المرة الأولى انخفاضاً في السطوع بنسبة 15% كما تريد تماماً، وفي المرة الثانية قد تصبح 50%، وفي المرة الثالثة قد يظهر نمط مختلف تماماً.

5 بدائل: من الحلول المباشرة إلى الحلول الجذرية

الخيار الأول: صياغة الموجهات بدقة رقمية (الأكثر تأثيراً وفورية)

سيناريو المشكلة: "اجعل الصورة أغمق قليلاً" ← النتيجة تكون أحياناً داكنة جداً وأحياناً فاتحة جداً.

السبب الجذري هو أن كلمة "قليلاً" غامضة للغاية. لا يمكن لـ Nano Banana Pro ضمان فهم ثابت لكلمة "قليلاً" في كل مرة. الحل هو استبدال الأوصاف الغامضة بقيم عددية:

❌ 模糊提示词:

"Make this image slightly darker"

"让图暗一点点"

✅ 量化提示词:

"Apply a subtle darkening effect equivalent to reducing brightness by

approximately 15-20%. The image should feel slightly moodier but all

details must remain clearly visible. Do NOT go dark. The result should

be close to: brightness 85% of original, contrast unchanged."

طريقة الكتابة الرقمية للتعديلات الشائعة:

亮度调整:

"brightness at 85% of original" (降低 15%)

"increase brightness by 10%, keep contrast" (提亮 10%)

色调调整:

"add a very subtle warm orange tint, color shift about 10%"

"slight cool blue cast, saturation unchanged"

风格强度:

"apply film grain texture at 20% opacity, barely noticeable"

"add very subtle vignette at corners, 15% strength"

💡 نصيحة جوهرية: استخدم في الموجه كلمات محددة للمدى مثل "approximately X%" (حوالي X%)، أو "not exceeding Y%" (لا يتجاوز Y%)، أو "subtle/barely noticeable" (خفيف/بالكاد يلاحظ)، لتخبر النموذج بوضوح بحدود نطاق التغيير.

الخيار الثاني: الجمع بين نتيجة مرضية وموجهات دقيقة (الخيار المفضل)

رفع صورة مرجعية وحدها يعطي نتائج غير مستقرة، لكن الجمع بين الصورة المرجعية والموجهات الرقمية يحسن النتائج بشكل كبير:

import google.generativeai as genai

import base64

genai.configure(

api_key="YOUR_APIYI_KEY",

client_options={"api_endpoint": "vip.apiyi.com"} # APIYI $0.05/次

)

model = genai.GenerativeModel("gemini-3-pro-image-preview")

def apply_consistent_effect(

source_image_path: str, # 要处理的新图

approved_result_path: str, # 第一次满意的结果(作为风格参考)

effect_description: str, # 精准量化的效果描述

output_path: str

) -> str:

"""

将满意的效果复现到新图上

使用参考图 + 精准量化提示词双重锚定

"""

# 读取两张图

with open(source_image_path, "rb") as f:

source_data = base64.b64encode(f.read()).decode()

with open(approved_result_path, "rb") as f:

approved_data = base64.b64encode(f.read()).decode()

prompt = f"""

I have two reference images:

- Image 1 (source): The new image I want to process

- Image 2 (approved result): A previous edit I was very happy with

Please apply the SAME effect from Image 2 to Image 1.

The effect is: {effect_description}

Critical instructions:

- The degree of change should match Image 2 EXACTLY

- Do not over-apply the effect

- Keep all other image properties unchanged

- If unsure about intensity, err on the side of LESS change

"""

response = model.generate_content(

[

{"inline_data": {"mime_type": "image/jpeg", "data": source_data}},

{"inline_data": {"mime_type": "image/jpeg", "data": approved_data}},

prompt

],

generation_config=genai.GenerationConfig(

response_modalities=["IMAGE"],

resolution="4K",

aspect_ratio="1:1"

)

)

for part in response.candidates[0].content.parts:

if part.inline_data and part.inline_data.mime_type.startswith("image/"):

with open(output_path, "wb") as f:

f.write(base64.b64decode(part.inline_data.data))

return output_path

return None

# 使用示例

result = apply_consistent_effect(

source_image_path="new_product_photo.jpg",

approved_result_path="approved_dark_edit.jpg",

effect_description="subtle darkening, brightness reduced by approximately 15-20%, "

"image should be slightly moodier but all details clearly visible",

output_path="output_consistent.png"

)

# 每次 $0.05(APIYI apiyi.com)

🚀 نصيحة من واقع التجربة: ترفع هذه الطريقة مستوى الاتساق من "عشوائي تماماً" إلى "مطابق للتوقعات بنسبة كبيرة"، لكنها ليست مضمونة بنسبة 100%. يُنصح بتوليد 2-3 بدائل لكل دفعة (باستخدام استدعاءات متعددة لأن

candidateCountقد يسبب خطأ)، ثم اختيار الأقرب يدوياً. تكلفة APIYI المنخفضة (0.05 دولار للمرة) تجعل أخذ عينات متعددة أمراً مجدياً.

الخيار الثالث: أخذ عينات متعددة + التصفية الجماعية (مناسب للعمليات الضخمة)

هذا هو الحل الأكثر واقعية في الوقت الحالي: توليد 3-5 بدائل لكل صورة جديدة، ثم اختيار الأقرب يدوياً أو برمجياً.

import asyncio

import base64

import os

import google.generativeai as genai

genai.configure(

api_key="YOUR_APIYI_KEY",

client_options={"api_endpoint": "vip.apiyi.com"} # APIYI $0.05/次

)

model = genai.GenerativeModel("gemini-3-pro-image-preview")

EFFECT_PROMPT = """

Apply subtle darkening effect:

- Brightness: approximately 85% of original (reduce by ~15%)

- Mood: slightly darker, more atmospheric

- Details: all elements must remain clearly visible

- Do NOT: make it too dark, change colors dramatically, lose details

This is a subtle, refined adjustment - less is more.

"""

async def generate_variants(image_path: str, n_variants: int = 3) -> list:

"""对同一张图生成 n 个变体,供筛选"""

with open(image_path, "rb") as f:

img_data = base64.b64encode(f.read()).decode()

async def one_call(i: int) -> str:

output = image_path.replace(".jpg", f"_v{i+1}.png")

loop = asyncio.get_event_loop()

try:

response = await loop.run_in_executor(None, lambda: model.generate_content(

[{"inline_data": {"mime_type": "image/jpeg", "data": img_data}},

EFFECT_PROMPT],

generation_config=genai.GenerationConfig(

response_modalities=["IMAGE"],

resolution="4K"

)

))

for part in response.candidates[0].content.parts:

if part.inline_data:

with open(output, "wb") as f:

f.write(base64.b64decode(part.inline_data.data))

return output

except Exception as e:

print(f" 变体 {i+1} 失败: {e}")

return None

# 并发生成多个变体

results = await asyncio.gather(*[one_call(i) for i in range(n_variants)])

return [r for r in results if r]

async def batch_process(image_list: list, n_variants: int = 3):

"""批量处理多张图,每张生成多个变体"""

for img_path in image_list:

print(f"\n处理: {img_path}")

variants = await generate_variants(img_path, n_variants)

cost = len(variants) * 0.05

print(f" 生成 {len(variants)} 个变体,成本 ${cost:.2f}(APIYI)")

print(f" 文件: {variants}")

print(f" → 请人工选出最满意的变体")

# 示例:处理 5 张图,每张生成 3 个变体

images = ["photo_01.jpg", "photo_02.jpg", "photo_03.jpg", "photo_04.jpg", "photo_05.jpg"]

asyncio.run(batch_process(images, n_variants=3))

# 5张图 × 3个变体 = 15次调用,APIYI总成本 $0.75

تقدير التكلفة:

| النطاق | عدد البدائل | إجمالي المحاولات | تكلفة APIYI |

|---|---|---|---|

| 10 صور | 3 لكل صورة | 30 مرة | $1.50 |

| 50 صورة | 3 لكل صورة | 150 مرة | $7.50 |

| 100 صورة | 2 لكل صورة | 200 مرة | $10.00 |

الخيار الرابع: الانتقال إلى نماذج تدعم الـ Seed (الحل الجذري)

إذا كان عملك يتطلب دقة في إعادة الإنتاج، فإن الحل الأكثر جذرياً هو الانتقال إلى نماذج تدعم الـ seed بشكل أصلي:

Imagen API (Vertex AI) —— من إنتاج Google أيضاً، ويدعم الـ seed:

from google.cloud import aiplatform

from vertexai.preview.vision_models import ImageGenerationModel

# Imagen API 支持 seed 参数

model = ImageGenerationModel.from_pretrained("imagen-3.0-generate-002")

response = model.generate_images(

prompt="your prompt here",

seed=42, # ✅ 官方支持!

number_of_images=1,

add_watermark=False # 使用 seed 时必须关闭水印

)

# 相同 seed + 相同 prompt → 相同结果(高可复现)

Stable Diffusion / Flux —— منظومة متكاملة لدعم الـ seed:

# 通过 APIYI apiyi.com 接入 Flux,支持 seed

import requests

response = requests.post(

"https://vip.apiyi.com/v1/images/generations",

headers={"Authorization": "Bearer YOUR_APIYI_KEY"},

json={

"model": "flux-dev", # 或 flux-schnell

"prompt": "your prompt",

"seed": 12345, # ✅ 完整 seed 支持

"width": 1024,

"height": 1024

}

)

# 锁定 seed → 批量生成完全一致的基础图

الخيار الخامس: المعالجة اللاحقة للصور (الأعلى دقة والأكثر استقراراً)

إذا كانت حاجتك هي إجراء تعديلات ثابتة على السطوع أو اللون لمجموعة من الصور (مثل تعتيمها بنسبة 15% بشكل موحد)، فإن استخدام الذكاء الاصطناعي التوليدي ليس الخيار الأمثل أصلاً — المعالجة اللاحقة للصور هي الأداة الصحيحة:

from PIL import Image, ImageEnhance

import os

def batch_darken(input_dir: str, output_dir: str, brightness_factor: float = 0.85):

"""

精确批量调整亮度

brightness_factor: 0.85 = 降低15%,完全可复现,零随机性

"""

os.makedirs(output_dir, exist_ok=True)

files = [f for f in os.listdir(input_dir) if f.lower().endswith(('.jpg', '.png', '.webp'))]

for filename in files:

img = Image.open(os.path.join(input_dir, filename))

enhancer = ImageEnhance.Brightness(img)

# 精确控制亮度,每次结果完全一致

darkened = enhancer.enhance(brightness_factor)

darkened.save(os.path.join(output_dir, filename))

print(f"✓ {filename} → 亮度 {brightness_factor*100:.0f}%")

# 批量处理,零 API 成本,100% 可复现

batch_darken("input_images/", "darkened_output/", brightness_factor=0.85)

مقارنة سيناريوهات الاستخدام:

| نوع التعديل | الأداة الموصى بها | السبب |

|---|---|---|

| توحيد السطوع/التباين/التشبع | PIL / معالجة Photoshop الجماعية | دقيق، قابل لإعادة الإنتاج، بدون تكلفة |

| توحيد فلاتر الألوان (دافئ/بارد) | PIL / فلاتر LUT | اتساق بنسبة 100% |

| نقل الأنماط المعقدة (تغيير الخلفية/العنصر) | Nano Banana Pro | هنا تكمن القيمة الحقيقية للذكاء الاصطناعي |

| الحاجة لإعادة إنتاج دقيقة مع تغييرات إبداعية | Imagen API (مع seed) | يجمع بين الجودة والاتساق |

🎯 نصيحة صادقة: إذا كنت تريد فقط "تعتيم الصور بنسبة 15%" بشكل جماعي، فاستخدم

ImageEnhance.Brightnessمن مكتبة PIL؛ فهي مجانية، متسقة بنسبة 100%، وتنجز المهمة بسطر برمج واحد. تكمن قيمة توليد الصور بالذكاء الاصطناعي في فهم المحتوى المعقد والتوليد الإبداعي، وليس في التعديلات الرقمية الدقيقة.

مقارنة دعم الـ Seed في نماذج صور الذكاء الاصطناعي الرائدة

| النموذج | دعم الـ Seed | استقرار إعادة التوليد | ملاحظات |

|---|---|---|---|

| Nano Banana Pro | ❌ غير مدعوم | منخفض، عشوائي في كل مرة | يمكن تحسينه جزئياً باستخدام صورة مرجعية + موجه |

| Imagen API | ✅ مدعوم رسمياً | عالي | يمكن إعادة توليد نفس النتيجة باستخدام نفس الـ seed ونفس الموجه |

| Stable Diffusion | ✅ مدعوم بالكامل | عالي جداً | نظام بيئي مفتوح المصدر، نشر ذاتي أو سحابي |

| Flux Dev/Pro | ✅ مدعوم | عالي | واقعية قوية، متاح عبر API |

| Midjourney | ✅ بارامتر --seed |

متوسط (مستوى مرجعي) | الأنماط متشابهة لنفس الـ seed ولكنها ليست متطابقة تماماً |

| DALL-E 3 | ❌ غير مدعوم | منخفض | قيود مشابهة لنموذج Nano Banana Pro |

💡 نصيحة المنصة: من خلال APIYI (apiyi.com)، يمكنك الوصول بشكل موحد إلى نماذج صور متعددة مثل Nano Banana Pro وFlux وStable Diffusion وغيرها. استخدم مفتاح API واحد للتبديل بين النماذج المختلفة، مما يسهل الاختيار بمرونة حسب حاجتك لوجود seed من عدمه.

الأسئلة الشائعة

س1: هل توجد طريقة لـ “اختراق” نظام Nano Banana Pro للحصول على تأثير الـ seed؟

لا توجد طريقة اختراق بالمعنى الحقيقي. بعض المنصات الخارجية (مثل fal.ai) أضافت معامل seed في طبقة تغليف الـ API الخاصة بها، لكن هذا يتحكم فقط في العشوائية على مستوى منصتهم، ولا يعادل الـ seed الأصلي في توليد الصور من Google Gemini — في الواقع، تأثيره على إمكانية إعادة إنتاج الصورة النهائية محدود للغاية.

أقرب تركيبة لمحاكاة "تأثير الـ seed" هي: تكميم الموجهات بدقة + استخدام نتيجة مرضية كصورة مرجعية + التصفية من عينات متعددة. الجمع بين هذه العناصر الثلاثة يمكن أن يرفع نسبة التطابق من العشوائية الكاملة إلى حوالي 60-70%، لكنها لن تصل أبداً إلى 100%.

إذا كان سير عملك يتطلب إمكانية إعادة إنتاج النتائج بشكل صارم، فنحن نوصي بالانتقال إلى Imagen API، ومن خلال APIYI (apiyi.com) يمكنك الوصول إلى خدمات متعددة في وقت واحد لإجراء اختبارات مقارنة.

س2: أريد إعادة إنتاج تأثير “أغمق قليلاً” بشكل دفعي (Batch)، ما هي أسرع طريقة؟

يعتمد ذلك على طبيعة "الظلام" المطلوب:

- إذا كان مجرد تعديل في السطوع/التعريض: استخدم معالجة دفعية مباشرة بواسطة مكتبة Python PIL عبر الكود

ImageEnhance.Brightness(img).enhance(0.85)، 10 أسطر من الكود، تكلفة صفرية، وتطابق بنسبة 100%. - إذا كان الأمر يتعلق بالنمط، الأجواء، أو محتوى مولد بالذكاء الاصطناعي (مثل "درجة لون داكنة مع إعطاء الخلفية طابعاً سينمائياً أكثر"): استخدم الحل الثاني (صورة مرجعية + موجه مكمم)، وقم باستدعاء الخدمة بشكل دفعي عبر APIYI (apiyi.com) بتكلفة 0.05 دولار لكل صورة، ثم اختر يدوياً الأقرب من بين 2-3 متغيرات مولدة.

س3: هل سيدعم Nano Banana Pro معامل الـ seed مستقبلاً؟

لا يوجد إعلان رسمي حالياً. من منظور خارطة طريق منتجات Google، فإن Imagen API هي الخدمة المخصصة لتوليد الصور بدقة وتحكم (بما في ذلك الـ seed)، بينما يتجه توليد الصور في Gemini أكثر نحو "التوليد الإبداعي عالي الجودة" — التوجهان مختلفان، لذا فإن احتمالية إضافة الـ seed إلى Nano Banana Pro موجودة ولكنها غير مؤكدة.

يمكنك متابعة مدونة Google AI الرسمية (blog.google/technology/google-deepmind) وسجل تغييرات Gemini API (ai.google.dev/gemini-api/docs/changelog) للحصول على آخر التحديثات. في حال وجود أي تحديث، سنقوم بنشر دليل الاستخدام ذي الصلة فوراً على APIYI (apiyi.com).

ملخص

يجب تقبل حقيقة أن Nano Banana Pro لا يدعم معامل الـ seed، واختيار أحد البدائل الخمسة حسب السيناريو:

- تكميم الموجهات بدقة: استبدل الأوصاف الغامضة مثل "قليلاً" بقيم عددية، وستلاحظ النتائج فوراً.

- صورة مرجعية + موجه مكمم: إدخال صورتين (الصورة الأصلية + النتيجة المرضية) مع وصف دقيق لدرجة التأثير المراد إعادة إنتاجها.

- التصفية من عينات متعددة: توليد 2-3 متغيرات لكل صورة، فالتكلفة منخفضة عبر APIYI (0.05 دولار للمرة)، ثم الاختيار اليدوي للأقرب.

- التبديل إلى Imagen API / Flux: إذا كان عملك يتطلب إمكانية إعادة إنتاج النتائج بشكل صارم، فاستخدم النماذج التي تدعم الـ seed أصلاً.

- المعالجة اللاحقة باستخدام PIL: إذا كان التعديل ثابتاً في السطوع أو درجة اللون، فالذكاء الاصطناعي ليس الأداة الأمثل، استخدام PIL أكثر دقة.

لا يوجد حل سحري واحد، اختر الحل الأنسب لسيناريو عملك الحالي. التكلفة المنخفضة لأخذ عينات متعددة (0.05 دولار للمرة) تجعل استراتيجية "التجربة والتصفية" مجدية تماماً على منصة APIYI (apiyi.com)، بينما ستكون التكلفة أعلى بـ 5 مرات بالأسعار الرسمية (0.24 دولار للمرة).

المصادر والمراجع

-

وثائق معلمات توليد الصور في Google Gemini API

- الرابط:

ai.google.dev/gemini-api/docs/image-generation - التوضيح: قائمة المعلمات المدعومة رسميًا في generationConfig، مع التأكيد على عدم وجود حقل seed.

- الرابط:

-

وثائق Vertex AI Imagen API (مع دعم الـ seed)

- الرابط:

cloud.google.com/vertex-ai/generative-ai/docs/image/generate-images - التوضيح: طريقة استخدام وقيود معلمة seed في Imagen API.

- الرابط:

-

مشكلة GitHub رقم 536 لـ Gemini Python SDK

- الرابط:

github.com/google-gemini/deprecated-generative-ai-python/issues/536 - التوضيح: نقاشات المجتمع التي تؤكد عدم دعم معلمة seed في توليد الصور عبر Gemini.

- الرابط:

-

الوصول إلى نماذج متعددة عبر منصة APIYI

- الرابط:

docs.apiyi.com - التوضيح: تعليمات الوصول الموحد لنماذج Nano Banana Pro / Imagen / Flux.

- الرابط:

المؤلف: الفريق التقني

التواصل التقني: هل تواجه مشكلات مماثلة في اتساق التوليد الجماعي؟ نرحب بمناقشاتكم في قسم التعليقات. لمزيد من الخبرات العملية في توليد الصور بالذكاء الاصطناعي، تفضل بزيارة مجتمع APIYI التقني عبر apiyi.com.