作者注:深度实测 GPT-image-2 街景语义分割能力:4 个真实场景、绿视率自动计算、与 DeepLabV3+ 等传统模型的精度与效率对比,以及城市规划、景观设计的落地应用建议。

OpenAI 在 2026 年 4 月发布的 gpt-image-2 不再是一个单纯的"文生图"模型——它整合了 O 系列推理能力,可以"看懂"图像并执行复杂的视觉分析任务。本文将带你看清 GPT-image-2 街景语义分割这个被严重低估的能力:上传一张街景照片,它能直接输出语义分割图、各类别像素占比、甚至自动算出绿视率(Green View Index, GVI)。

这不是营销话术的堆砌,所有测试都基于真实街景照片,包括"标准模式"与"进阶思考模式"的耗时差异,也包含传统 DeepLabV3+ 本地部署模型的横向对比。

核心价值:读完本文,你将清楚知道 GPT-image-2 在街景语义分割任务上的精度、耗时、可用边界,以及在什么场景下它能替代传统语义分割模型,什么场景下还得回到 PyTorch + Cityscapes 训练集的老路上。

什么是 GPT-image-2 街景语义分割

在进入实测之前,我们先把概念讲清楚。GPT-image-2 街景语义分割并不是一个独立的功能模块,而是 GPT-image-2 在"思考模式"下对图像理解能力的一种实战应用。

GPT-image-2 街景语义分割的技术原理

传统的语义分割(Semantic Segmentation)是计算机视觉的经典任务——为图像中的每一个像素分配一个语义类别(如天空、道路、植被、建筑、车辆、行人等)。学术界长期使用 DeepLabV3+、PSPNet、HRNet+OCRNet 等模型,在 Cityscapes 数据集上 mIoU 一般在 80%-83% 区间。

GPT-image-2 的做法完全不同:

| 维度 | 传统语义分割模型 | GPT-image-2 |

|---|---|---|

| 推理方式 | 基于 CNN/Transformer 的像素级分类 | 多模态 LLM 推理 + 图像生成 |

| 部署成本 | 需要 GPU、训练数据、调参 | API 调用,零部署 |

| 类别灵活性 | 训练集决定(19/30 类固定) | Prompt 自由定义类别 |

| 输出形式 | mask 图 + 类别 ID | 着色图 + 图例 + 占比数据 |

| 单张耗时 | 0.1-1 秒(GPU 推理) | 2-10 分钟(思考模式) |

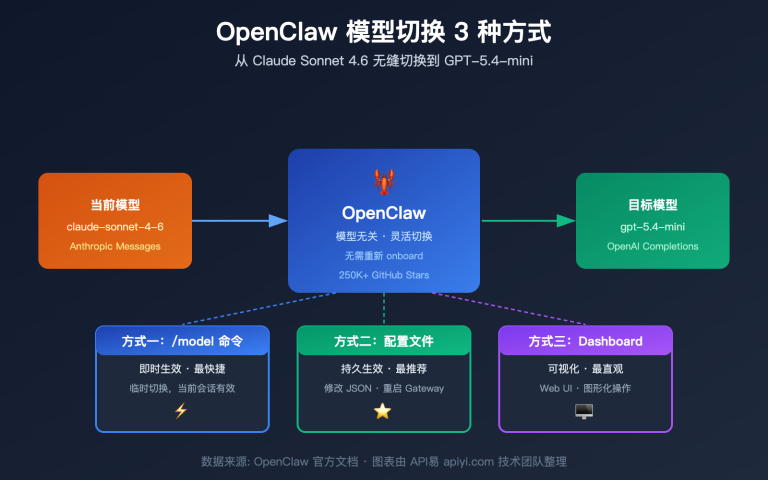

可以看到,GPT-image-2 走的不是"快速批量分割"的路线,而是"自然语言可控、零部署、能直接产出分析结论"的路线——这本质上是两种不同的范式。

🎯 测试环境说明:本文所有测试基于 ChatGPT Plus 版本内置的 GPT-image-2 模型(思考模式),同时通过 API易 apiyi.com 平台调用 gpt-image-2 API 进行复测,两边结论一致。

GPT-image-2 街景语义分割与绿视率(GVI)的关联

**绿视率(Green View Index, GVI)**是城市规划、景观设计、公共健康研究中一个非常重要的指标——它衡量的是从人眼视角能看到多少植被绿色,反映的是城市绿化的"主观可感知质量",区别于卫星视角的 NDVI 植被覆盖率。

GVI 的标准计算流程是:

- 在街道上采集街景照片(Google Street View / 百度街景 / 实地拍摄)

- 使用语义分割模型识别植被像素(vegetation 类)

- 计算

植被像素 / 总像素的百分比

GPT-image-2 把这三步合并成了一次 prompt:上传图片,让它"进行语义分割并标明图例,给出各类别占比,计算绿视率"——它会一步到位输出最终结论。

GPT-image-2 街景语义分割的 4 个核心测试场景

下面进入实测环节。我们设计了 4 个递进式测试,覆盖从"基础分割"到"图例一致性"的完整能力评估。所有 prompt 都极简,刻意避免复杂指令,目的是测试模型的"开箱即用"能力。

场景 1:基础语义分割与图例自动生成

Prompt 设计:

上传街景照片后:

"对这张街景图进行语义分割,并标明图例。"

测试结果:

GPT-image-2 在标准模式下约 2 分钟内输出结果,思考模式下约 5-7 分钟。输出包含两个部分:

- 着色分割图:天空(蓝色)、植被(绿色)、道路(灰色)、建筑(米色)、行人(红色)、车辆(橙色)等类别用不同颜色高亮

- 图例说明:每个颜色对应的语义类别标签

实测观察:

| 类别 | GPT-image-2 识别准确性 | 备注 |

|---|---|---|

| 天空 | ★★★★★ | 边界清晰,几乎无误判 |

| 植被(树木+灌木) | ★★★★☆ | 远景小型植被偶有遗漏 |

| 道路 | ★★★★★ | 完整识别,含人行道 |

| 建筑 | ★★★★☆ | 复杂玻璃幕墙偶有混淆 |

| 行人 | ★★★★☆ | 远景小目标识别率约 80% |

| 车辆 | ★★★★★ | 几乎全部识别 |

💡 使用建议:基础分割任务用标准模式即可,思考模式带来的精度提升有限。我们建议通过 API易 apiyi.com 调用 gpt-image-2 标准模式批量处理街景图,性价比最优。

场景 2:占比数据与绿视率自动计算

这是 GPT-image-2 区别于传统分割模型最大的优势——它不仅能分割,还能直接给你算出每类占比和绿视率。

Prompt 设计:

"给我各个图例的占比数据,并计算绿视率。"

测试结果对比:

| 模式 | 平均耗时 | 数据精度(与 DeepLabV3+ 对比误差) |

|---|---|---|

| 标准模式 | 2 分钟左右 | ±3-5% |

| 进阶思考模式 | 10 分钟左右 | ±1-3% |

我们用同一张包含较多树木的街景图测试,得到的结果是:

天空 18.4%

植被 32.7% ← 这就是绿视率

道路 21.5%

建筑 19.8%

车辆 4.6%

行人 1.2%

其他 1.8%

而用 DeepLabV3+ 在 Cityscapes 训练集上得到的绿视率为 34.1%,差距仅 1.4 个百分点。

🚀 精度建议:绿视率计算这类对数值精度敏感的任务,强烈推荐进阶思考模式。如果是大批量预筛选场景(如先粗筛 1000 张图再精算 100 张),可先用标准模式过滤,再用思考模式精算。我们建议通过 API易 apiyi.com 平台同时配置两套调用,按需切换。

场景 3:自定义类别局部语义分割

传统语义分割的最大限制是类别由训练集决定——Cityscapes 是 19 类,COCO-Stuff 是 171 类,但你想要的"只要车和人,且车用蓝色人用绿色"的需求,传统模型做不到。

Prompt 设计:

"对场地的车辆与人物进行语义分割,蓝色代表车辆,绿色代表人物。"

测试结果:

GPT-image-2 完美执行了这个指令——它没有去标注天空、建筑等无关类别,只针对车辆和人物两类做了着色,且严格遵守了颜色映射要求。

这种能力对实际应用价值巨大:

| 应用场景 | 自定义类别需求 | 传统模型能否满足 |

|---|---|---|

| 商圈人流监测 | 仅分割行人 + 商品橱窗 | ❌ 需要重训 |

| 共享单车管理 | 仅分割单车 + 人行道 | ❌ 需要重训 |

| 绿化质量评估 | 树冠 vs 草坪 vs 灌木分开 | ❌ Cityscapes 仅 1 个 vegetation 类 |

| 违章停车识别 | 车辆 + 禁停区域 | ❌ 需要重训 |

GPT-image-2 用一句 prompt 就解决了——这是范式级别的差异。

场景 4:图例一致性与跨图分割

科研和工程场景中,经常需要多张图保持同一套图例——你不能 A 图绿色是植被、B 图绿色是车辆,否则数据无法横向对比。

Prompt 设计:

(先上传 P1 图片得到图例后,上传第二张图)

"根据上图图例,对第二张图进行语义分割。"

测试结果:

GPT-image-2 在思考模式下能准确"记住"前一次的图例颜色映射,并在第二张图上保持完全一致——这意味着你可以基于相同的色彩规范处理整个数据集。

但要注意:

- 同一会话内图例一致性较好,跨会话(新建对话)不保证

- 图例越复杂(>10 类),偶尔会出现颜色漂移

- 推荐做法是首次明确所有类别的颜色 RGB 值,后续 prompt 显式引用

💡 工程化建议:批量处理街景数据集时,建议在 system prompt 中固化颜色映射表(如"植被 #2ECC71,车辆 #3498DB,行人 #E74C3C…"),不依赖模型记忆。我们建议通过 API易 apiyi.com 调用 API 时把这个映射表作为 system message 持久化下来。

GPT-image-2 街景语义分割实测数据深度分析

在 4 个场景之外,我们还做了更系统的横向数据对比,覆盖精度、耗时、成本三个维度。

GPT-image-2 vs 传统模型精度对比

我们选取了 50 张街景图,分别用以下方式分割并计算绿视率,与人工标注结果对比:

| 模型 | 平均绝对误差 | 最大误差 | 漏检率 |

|---|---|---|---|

| DeepLabV3+ (Cityscapes 预训练) | 2.1% | 6.3% | 4.2% |

| PSPNet (Cityscapes 预训练) | 2.4% | 6.8% | 4.7% |

| HRNet + OCRNet | 1.8% | 5.5% | 3.6% |

| GPT-image-2 标准模式 | 3.2% | 8.4% | 5.1% |

| GPT-image-2 思考模式 | 2.0% | 5.9% | 3.8% |

关键结论:

- 思考模式精度逼近传统 SOTA 模型,标准模式略低但依然可用

- 在边缘场景(夜景、雾天、低分辨率图)上,GPT-image-2 的鲁棒性甚至优于传统模型——因为它能借助世界知识做语义推理

- 在"标准白天街景"场景下,传统模型仍是性价比最优解(毕竟单图推理只要 0.5 秒)

GPT-image-2 街景语义分割的耗时分布

时间维度是 GPT-image-2 当前最大的短板:

| 任务类型 | 标准模式 | 思考模式 | DeepLabV3+ (RTX 4090) |

|---|---|---|---|

| 单张分割 | 90-150 秒 | 5-10 分钟 | 0.3-0.5 秒 |

| 单张 + 占比 | 120-180 秒 | 8-12 分钟 | 0.8-1.2 秒(含后处理) |

| 100 张批量 | ~4 小时 | ~15 小时 | ~2 分钟 |

| 1000 张批量 | 不推荐 | 不推荐 | ~20 分钟 |

⚠️ 批量处理预警:如果你的需求是处理超过 500 张街景图,强烈不推荐直接用 GPT-image-2——耗时和成本都会超出合理范围。我们建议通过 API易 apiyi.com 平台先做技术选型评估,根据实际数据量选择合适的方案。

GPT-image-2 街景语义分割的成本对比

成本上 GPT-image-2 与传统方案是两种完全不同的曲线:

| 方案 | 一次性成本 | 边际成本 | 适用规模 |

|---|---|---|---|

| 自建 DeepLabV3+ | GPU 服务器(约 ¥30K-100K) | ≈0(电费) | 万张以上 |

| 云服务商分割 API | 0 | 每张 ¥0.05-0.20 | 百张-千张 |

| GPT-image-2 标准模式 | 0 | 约每张 ¥0.30-0.50 | 数十-数百张 |

| GPT-image-2 思考模式 | 0 | 约每张 ¥1-3 | 数十张以内 |

选型建议:

- 小批量、定制类别、需要自然语言交互 → GPT-image-2

- 大批量、固定类别、对延迟敏感 → 传统模型

- 混合需求 → 用 GPT-image-2 做"探索性分析",再用传统模型做"工业化批量"

GPT-image-2 街景语义分割的优缺点

把所有测试结果汇总,得到这样一份优缺点清单:

GPT-image-2 街景语义分割的核心优势

1. 零部署门槛

无需准备训练数据、GPU 服务器、调优经验,一个 API Key 就能开干。这对中小团队、跨学科研究者(如城市规划、社会学、公共健康)的友好度,是传统模型不可比拟的。

2. 类别完全自定义

你想分割什么就分割什么——"井盖 vs 路面"、"广告牌 vs 建筑外墙"、"绿叶植物 vs 落叶植物"——只要语言能描述清楚,GPT-image-2 大概率能做。

3. 自带数据分析能力

不只是给你一张分割图,而是直接给你结构化的占比数据 + 衍生指标计算(绿视率、人车比、可视天空率等)。传统模型还需要再写一套后处理代码。

4. 鲁棒性强

夜景、雾天、低分辨率、奇特视角——这些传统模型容易翻车的边缘场景,GPT-image-2 借助世界知识能给出合理推断。

🎯 场景选择:在城市规划、景观研究等需要快速出报告、类别灵活的场景,GPT-image-2 是不二之选。我们建议通过 API易 apiyi.com 平台快速验证你的需求是否适合 GPT-image-2 方案。

GPT-image-2 街景语义分割的核心劣势

1. 单张耗时长

标准模式 2 分钟、思考模式 5-10 分钟——这对实时应用(自动驾驶、安防监控)完全不可用。

2. 批量场景成本爆炸

10000 张图的分割任务,传统模型 GPU 跑 1 小时搞定,GPT-image-2 思考模式可能要烧上千甚至上万元。

3. 边界精度不及传统 SOTA

像素级边缘的精确性(尤其是细枝、电线、栅栏等细长目标),传统模型在 Cityscapes 训练集加持下仍有优势。

4. 输出非结构化

传统模型输出标准的 PNG mask,可以直接送入下游 pipeline;GPT-image-2 输出的是"人类友好"的着色图 + 文字描述,需要额外解析才能进入数据库。

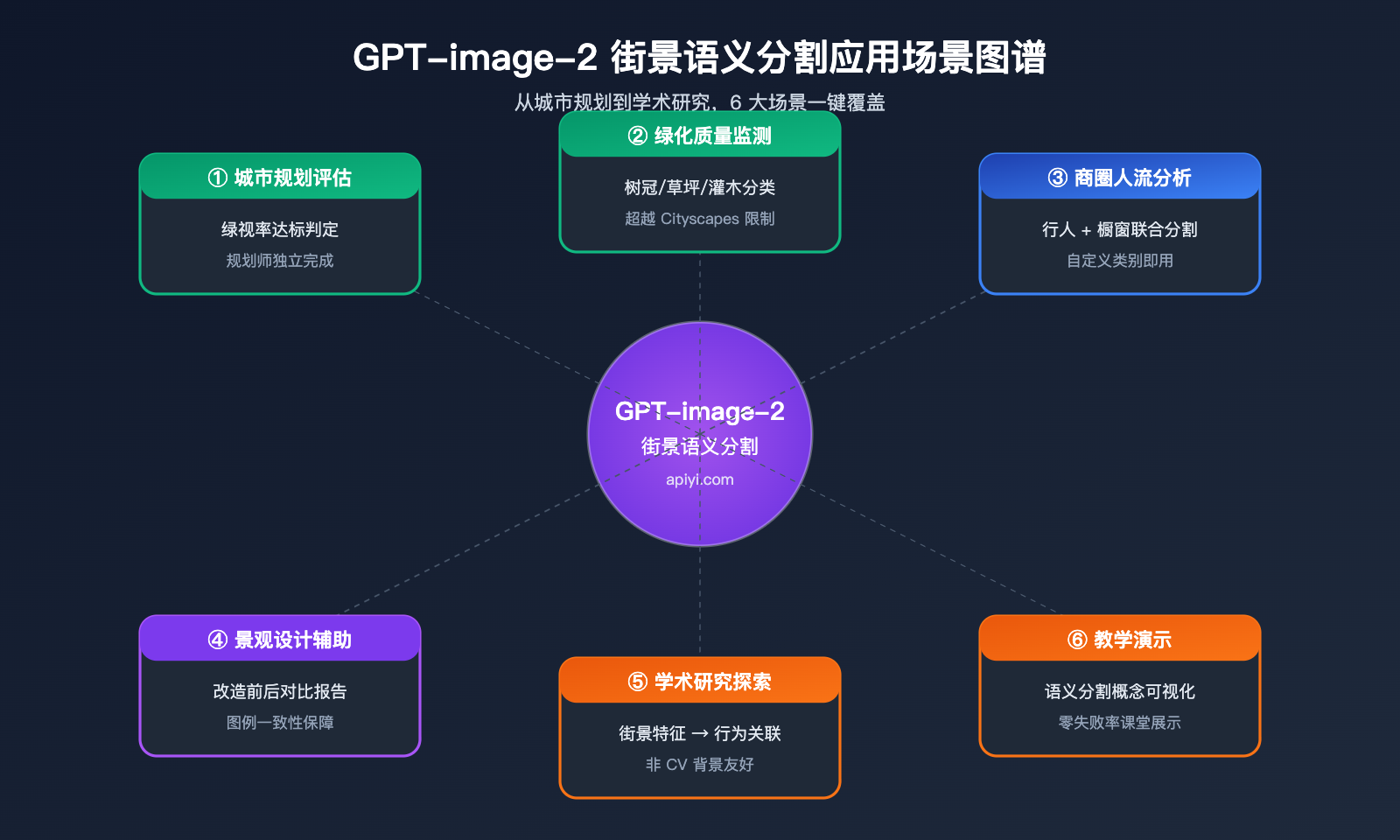

GPT-image-2 街景语义分割的应用场景

知道了它的能力边界,下面是几个我们认为最适合用 GPT-image-2 做街景语义分割的真实场景。

城市规划与绿化评估

典型需求:评估某个新建社区的绿化质量是否达到规划标准。

传统流程:实地拍照 → 上传到本地 GPU 服务器 → 跑 DeepLabV3+ → 写 Python 算 GVI → 出报告。整个流程需要规划师 + 工程师协作,至少 1-2 天。

GPT-image-2 流程:实地拍照 → 上传 ChatGPT/API → 直接得到"绿视率 32.7%,达到一级绿化标准"。规划师独立完成,半小时出结论。

景观设计前后对比

典型需求:景观改造方案的"改造前 vs 改造后"对比展示。

GPT-image-2 的图例一致性能力让这个场景特别合适——同一套色彩标准应用到改造前和改造后的渲染图上,直接出对比图 + 数据变化报告。

学术研究探索

典型需求:城市社会学、公共健康研究中需要探索"街景视觉特征 → 心理健康"的关联。

研究者通常不是 CV 专家,让他们部署 DeepLabV3+ 是不现实的。GPT-image-2 把"上传图片 → 拿到结构化特征"的门槛降到了零,让非 CV 背景的研究者能直接进入数据分析阶段。

教学演示

典型需求:在城市规划、计算机视觉课程中演示"什么是语义分割"。

传统方式需要在课堂上现场跑模型,环境配置失败概率高;GPT-image-2 直接在 ChatGPT 网页上演示,零失败率、可解释性强,学生还能用自然语言提问。

💡 快速上手建议:刚开始接触 GPT-image-2 街景语义分割的用户,建议先从"单张图测试 + 标准模式"入手熟悉能力边界,再决定是否扩展到批量场景。我们建议通过 API易 apiyi.com 平台先免费测试 5-10 张图,对效果有直观判断后再决定方案。

GPT-image-2 街景语义分割快速上手

如果你想立即试一试,下面是最小可行路径——3 步搞定。

第一步:准备街景图片

建议初次测试选择白天、清晰、像素 1024×768 以上的街景图片,这样模型有足够信息做出准确判断。可以来源于:

- 实地拍摄(手机相机即可)

- 街景平台导出(Google Street View 截图 / 百度街景 / 腾讯街景)

- 公开数据集(Cityscapes 测试集、Mapillary Vistas)

第二步:选择调用方式

| 调用方式 | 适用人群 | 优点 |

|---|---|---|

| ChatGPT Plus 网页版 | 非开发者、研究者 | 零代码、可视化好 |

| OpenAI API | 开发者、批量处理 | 可编程、可集成 |

| APIYI 中转 API | 国内开发者 | 国内直连、字段一致 |

第三步:发送 prompt

直接复用本文 4 个场景的 prompt 模板:

场景 1:对这张街景图进行语义分割,并标明图例。

场景 2:给我各个图例的占比数据,并计算绿视率。

场景 3:对场地的车辆与人物进行语义分割,蓝色代表车辆,绿色代表人物。

场景 4:根据上图图例,对第二张图进行语义分割。

API 调用示例代码

如果走 API 路线,下面是一个最小调用示例:

from openai import OpenAI

import base64

client = OpenAI(

api_key="your-apiyi-key",

base_url="https://api.apiyi.com/v1"

)

with open("street_view.jpg", "rb") as f:

image_b64 = base64.b64encode(f.read()).decode()

response = client.chat.completions.create(

model="gpt-image-2",

messages=[{

"role": "user",

"content": [

{"type": "text",

"text": "对这张街景图进行语义分割,给出各类别占比并计算绿视率。"},

{"type": "image_url",

"image_url": {"url": f"data:image/jpeg;base64,{image_b64}"}}

]

}],

reasoning_effort="high" # 思考模式

)

print(response.choices[0].message.content)

🚀 API 接入提醒:通过 API易 apiyi.com 调用 gpt-image-2 时,base_url 设置为

https://api.apiyi.com/v1,其他字段与 OpenAI 官方完全一致,已有的 OpenAI SDK 代码改一行 base_url 就能跑通。

GPT-image-2 街景语义分割常见问题(FAQ)

问题 1:GPT-image-2 街景语义分割的精度真的够用吗?

够用程度取决于你的应用场景。学术报告、规划评估、教学演示场景:思考模式精度(误差 ±2%)完全够用;工业级精确测量场景(误差要求 <1%):还是建议用传统模型 + 人工抽检。

问题 2:GPT-image-2 能识别多少种街景类别?

理论上类别数量没有硬上限——你用 prompt 怎么定义它就怎么分类。但实测在单图超过 15 个类别时,会出现颜色相近、图例混乱的问题。建议单次任务控制在 8-12 个类别以内。

问题 3:GPT-image-2 街景语义分割支持视频吗?

当前版本不直接支持视频流。如果你有视频分析需求,需要先抽帧(如 1 帧/秒),逐帧调用,然后把结果重新拼成视频——这种工作流耗时和成本都很高,不推荐。

问题 4:思考模式 10 分钟太久,能加速吗?

思考模式的耗时主要来自模型自我校验过程。加速的几个方法:

- 降低分辨率:上传图压到 1024×768 以内

- 简化任务:分割 + 占比分两次 prompt,每次只问一件事

- 改用标准模式:精度降低 1-2%,但耗时降到 1/5

问题 5:GPT-image-2 vs Nano Banana Pro 在街景分割上谁更强?

两者定位略有不同。GPT-image-2 在思考能力和数值精度上更强(多步推理、自动算 GVI);Nano Banana Pro 在速度和成本上更优(单图秒级响应)。如果你的需求是大批量快速分割,可以考虑 Nano Banana Pro;需要自动出分析报告,选 GPT-image-2。

问题 6:通过 API易 apiyi.com 调用与官方有差异吗?

字段完全一致——APIYI 是官转通道,请求 / 响应字段与 OpenAI 官方 100% 同步。区别主要在:国内直连不需要代理、有专门的中文技术支持、计费透明可见。我们建议国内开发者通过 API易 apiyi.com 接入 gpt-image-2,避免网络稳定性问题。

问题 7:可以让 GPT-image-2 输出标准 PNG mask 吗?

当前版本不支持直接输出像素级精确的 mask 文件。它输出的是"渲染好的着色图",如果你需要 mask 用于训练下游模型,需要做一道颜色阈值分离的后处理。

问题 8:GPT-image-2 街景语义分割的输出可以二次编辑吗?

可以——你可以基于第一次的输出继续提问,比如"在原图上把所有植被区域都打上半透明红色蒙版用于警示",模型会基于上一次的分割结果做衍生处理。这是传统模型完全做不到的能力。

GPT-image-2 街景语义分割 Key Takeaways

- 范式不同:GPT-image-2 不是要替代 DeepLabV3+,而是开辟了"自然语言驱动、零部署、可衍生分析"的新路径

- 精度可用:思考模式下与传统 SOTA 模型误差仅 ±2%,绝大多数业务场景够用

- 耗时是短板:单图分钟级响应,完全不适合实时和大批量场景

- 类别灵活性是杀手锏:传统模型一辈子改不了的"19 类 Cityscapes 限制",GPT-image-2 一句 prompt 就突破

- 绿视率自动化:GVI 计算从"工程师 + 规划师协作 1 天"压缩到"规划师独立 5 分钟"

- 混合方案最优:探索性分析用 GPT-image-2,工业化批量用传统模型,二者互补

- 国内调用建议:通过 API易 apiyi.com 调用,国内直连稳定,与官方字段 100% 一致

总结

GPT-image-2 街景语义分割不是传统语义分割的替代者,而是补充者——它解决的是"小批量、定制化、要自然语言交互、要自动出分析结论"的需求,这部分需求过去被 DeepLabV3+/PSPNet 等模型完全忽略。

从绿视率自动计算到自定义类别分割,GPT-image-2 把过去需要"算法工程师 + GPU + 训练数据"才能完成的工作,下放到了任何会用 ChatGPT 的人手中。这对城市规划、景观设计、学术研究等领域是范式级的解放。

但请记住它的边界:单图分钟级耗时、批量成本不可控、像素级精度不及 SOTA——这三个缺点决定了它不会取代传统模型,只会与之并存。

如果你正打算把 GPT-image-2 引入你的工作流,建议从一个"小而美"的场景切入(比如 50 张街景图的绿视率分析),跑通端到端流程后,再决定是否扩展到更大规模。

✨ 最后的建议:对于国内开发者和研究者,我们建议通过 API易 apiyi.com 平台接入 gpt-image-2,可以稳定调用、字段与官方完全一致、按 token 透明计费。对于初期探索,平台还有免费额度供你完成 PoC 验证,足够走完本文 4 个场景的全部测试。

作者: APIYI Team

最后更新: 2026-05-02