2026 年 4 月 7 日,Z.ai(原智谱 AI)正式把 GLM-5.1 的完整权重以 MIT 协议 推上了 Hugging Face 仓库 zai-org/GLM-5。这次发布在英文 AI 圈瞬间引爆——不是因为它"又一个开源大模型",而是因为它在 SWE-Bench Pro 软件工程基准上以 58.4 分直接登顶全球榜首,正面超过了 GPT-5.4 的 57.7 分、Claude Opus 4.6 的 57.3 分以及 Gemini 3.1 Pro 的 54.2 分。这是开源模型第一次在一项被工业界广泛引用的"真实代码修复"基准上把闭源前沿全部压在身后。

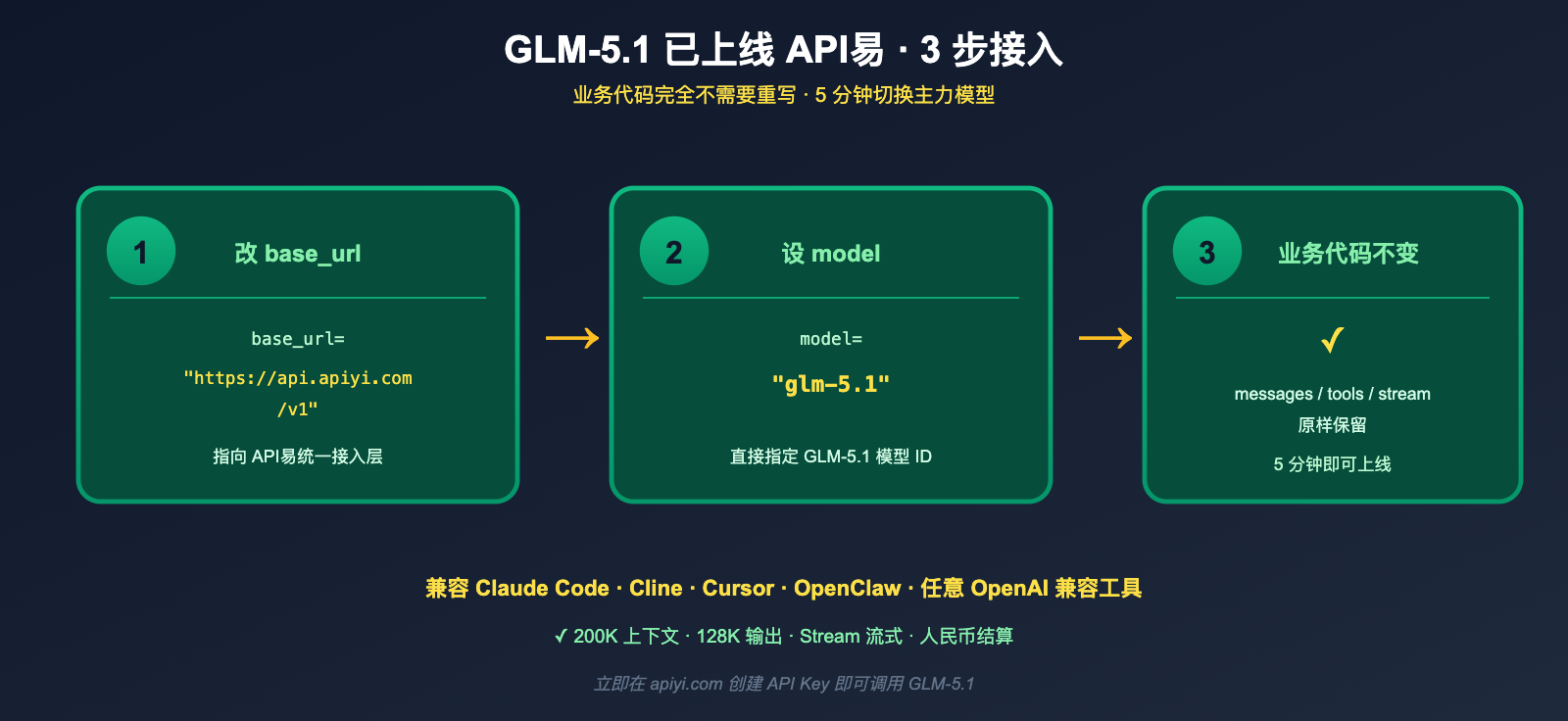

更让中国大陆开发者关心的是,这次 GLM-5.1 API 的上线节奏非常快——API易 apiyi.com 已经在第一时间完成接入,你不再需要自己去 Hugging Face 拉 754B 参数的权重、也不需要申请 Z.ai 官方账号,直接用现有的 OpenAI SDK 改一个 base_url 就能调用。本文将从架构、基准、训练硬件、定价、接入方式 7 个维度,完整介绍 GLM-5.1,并给出在 API易 上调用 GLM-5.1 的最小代码示例。

GLM-5.1 核心信息一览(2026 年 4 月版)

在拆解之前,我们先用一张表把"GLM-5.1" 这件事的所有关键事实压到一屏之内。

| 维度 | GLM-5.1 已知信息 |

|---|---|

| 发布厂商 | Z.ai(原智谱 AI,2026 年 1 月港股上市,估值约 313 亿美元) |

| 开源时间 | 2026 年 4 月 7 日 |

| 开源协议 | MIT(允许商用 + 二次修改 + 闭源衍生) |

| 仓库地址 | huggingface.co/zai-org/GLM-5 |

| 模型架构 | MoE(混合专家),754B 总参数 / 40B 激活参数 |

| 上下文窗口 | 200,000 tokens |

| 最大输出 | 128,000 tokens |

| 训练数据 | 28.5T tokens(GLM-5 基础上从 23T 提升) |

| 训练硬件 | 全部使用 Huawei Ascend 910B + MindSpore 框架(无 Nvidia / AMD) |

| 部署框架 | vLLM / SGLang / KTransformers |

| 旗舰能力 | 长程 Agent 编码(单任务可持续工作约 8 小时) |

| 定价(API 直采) | 输入 $1.00 / 百万 token,输出 $3.20 / 百万 token |

| 编码套餐 | GLM Coding Plan 起价约 $3/月 |

| API易接入 | ✅ 已上线,通过 https://api.apiyi.com/v1 即可调用 |

| 兼容工具 | Claude Code / OpenClaw / Cline / 任意 OpenAI 兼容编辑器 |

🎯 快速上手建议:GLM-5.1 已经在 API易 apiyi.com 完成接入,你只需要把现有 OpenAI SDK 的

base_url改成https://api.apiyi.com/v1、model改成对应的 GLM-5.1 模型名,就能立刻在你的 Agent / Cursor / Cline 工作流里替换主力模型,无需重写任何业务代码。

GLM-5.1 为什么是一次"开源拐点"

要理解 GLM-5.1 为什么被英文 AI 圈称为"开源拐点",必须把它的几个关键事实对照在一起看。

第一次:开源模型在 SWE-Bench Pro 登顶

SWE-Bench Pro 是目前业界公认最难的真实代码修复基准之一,任务全部来自工业级代码仓库,模型必须理解上下文、定位 bug、写出可以通过测试的修复——和"刷一个 LeetCode" 完全不是一个量级。在这次 GLM-5.1 发布之前,这个榜单几乎被 GPT-5.x 与 Claude Opus 系列轮流霸占,开源模型从未真正接近过前三名。

而这一次,GLM-5.1 以 58.4 分直接登顶:

| 模型 | SWE-Bench Pro 分数 | 是否开源 |

|---|---|---|

| GLM-5.1 | 58.4 ⭐ | ✅ MIT 开源 |

| GPT-5.4 | 57.7 | ❌ |

| Claude Opus 4.6 | 57.3 | ❌ |

| Gemini 3.1 Pro | 54.2 | ❌ |

这不是 0.x 的擦边球,而是把"开源 vs 闭源"在最难的工业基准上的差距彻底抹平。即便考虑到"基准是 Z.ai 自报、独立评测尚未跟进"的免责声明,这件事本身的产业意义已经无法忽视:开源社区第一次拥有了一个在"真实代码修复"上能跟前沿闭源同台竞争的免费模型。

第二次:真正可商用的 MIT 协议

GLM-5.1 的另一项关键事实是它的开源协议——MIT,而不是常见的 Apache 2.0,更不是某些"研究专用 / 不可商用"的限制性协议。MIT 的含义非常直白:任何人可以下载、修改、微调、部署、商用、闭源衍生、卖钱,完全没有限制,只需要保留版权声明。

对企业用户来说,这意味着 GLM-5.1 可以毫无顾虑地用于:

- 自研产品的内部 Coding Agent;

- 商业 SaaS 中的代码生成 / 审查模块;

- 私有化部署的 IDE 插件;

- 任何需要"模型权重不能依赖某家厂商 API"的合规场景。

在 2026 年 4 月这个时间点,能同时满足"前沿性能 + MIT 开源 + 工业级基准登顶"的模型,GLM-5.1 几乎是唯一选择。

GLM-5.1 架构与训练:754B MoE + Huawei 全栈

第二个让 GLM-5.1 与众不同的事实,是它的训练栈。

MoE 架构:754B 总参数 / 40B 激活

GLM-5.1 采用混合专家(MoE)架构,总参数 754B,每次推理只激活约 40B。这种"大模型 + 稀疏激活" 的设计已经被 DeepSeek、Qwen、Mixtral 等开源大模型反复验证过,核心好处是:

- 训练时模型容量大,能吸收更多知识(28.5T token 预训练数据);

- 推理时只激活一小部分专家,显存与延迟接近一个 40B Dense 模型;

- 对话与代码任务可以走不同专家路径,长程任务的连贯性更好。

| 维度 | GLM-5(前代) | GLM-5.1(本次) |

|---|---|---|

| 总参数 | 355B | 754B |

| 激活参数 | 32B | 40B |

| 预训练数据 | 23T tokens | 28.5T tokens |

| 上下文窗口 | 受限 | 200K |

| 最大输出 | 受限 | 128K |

| Coding 专项 | 有 | ✅ 显著增强 |

| Agent 长程任务 | 有 | ✅ 单任务约 8 小时 |

关键工程亮点:8 小时长程 Agent

Z.ai 在公告里反复强调 GLM-5.1 的"8 小时单任务"能力。它的含义是:你可以把一个真实工程任务(比如修一个跨文件的 bug、迁移一个老库、补一组测试)交给 GLM-5.1,它能在不需要人为干预的情况下持续 规划 → 执行 → 测试 → 修复 → 二次优化,直到给出生产可用的结果,整个过程长达约 8 小时。这种"耐力型 Agent"的能力曲线,过去只在 Claude Opus 系列上被工业界稳定复现过——GLM-5.1 是开源世界第一个把这条能力线打到同一档位的模型。

训练硬件:全 Huawei 栈,无任何美国芯片

第三个值得专门拎出来的事实,是 GLM-5.1 的训练硬件——全部使用 Huawei Ascend 910B 芯片 + MindSpore 框架完成,完全没有用任何 Nvidia 或 AMD GPU。这件事在英文 AI 圈引起了相当大的讨论,因为它直接证明了:在 Hopper / Blackwell 受限的环境下,中国大陆团队已经能够在国产硬件上完成 754B MoE 这一量级模型的预训练。这不只是模型本身的技术胜利,更是一次中国大陆 AI 训练基础设施的产业级展示。

GLM-5.1 完整基准成绩单

为了不遗漏任何重要数据点,我们把 Z.ai 公布的 GLM-5.1 基准成绩单整理成下表。

| 基准 | GLM-5.1 分数 | 含义 |

|---|---|---|

| SWE-Bench Pro | 58.4 ⭐ | 真实代码修复,#1 全球(开源) |

| SWE-bench Verified | 77.8% | 通用代码修复,接近 Claude Opus 4.6 (80.8%) 的 ~94.6% |

| CyberGym | 68.7 | 安全/CTF 推理(单跑 1507 任务) |

| MCP-Atlas | 71.8 | MCP 工具调用基准 |

| T3-Bench | 70.6 | 工具使用与 Agent 任务 |

| Humanity's Last Exam | 31.0 / 52.3 | 极难推理(无工具 / 有工具) |

| AIME 2026 | 95.3 | 美国奥数竞赛级别 |

| GPQA-Diamond | 86.2 | 专家级科学推理 |

简单解读一下重点:

- 代码层面:SWE-Bench Pro 已经登顶,SWE-bench Verified 达到 Claude Opus 4.6 的 94.6%——意味着对绝大多数日常工程任务,GLM-5.1 的代码能力已经和当今最强的 Claude Opus 处在同一档;

- 数学推理:AIME 2026 拿下 95.3,GPQA-Diamond 86.2,属于"前沿水平";

- Agent 与工具使用:MCP-Atlas 71.8、T3-Bench 70.6,长程任务能力已经被基准证实;

- 诚实评估:这套数据当前全部来自 Z.ai 自报,截至发稿时尚未有完全独立的第三方评测室复现,使用时可以参考但不要当作"绝对值"看待。

🎯 基准验证建议:面对自报基准,最务实的态度是用自己业务的真实任务跑一次。GLM-5.1 已经在 API易 apiyi.com 完成上线,你可以直接用你团队最常见的 5-10 个真实编码 prompt 在 GLM-5.1、Claude Opus 4.6、GPT-5.4 上各跑一遍,用自己的业务数据反向验证 SWE-Bench Pro 的结论。

GLM-5.1 价格结构:为什么说是"性价比黑马"

GLM-5.1 的另一个让人无法忽视的特点是价格。我们把它直接放到主流前沿模型的同一张表里对比。

Token 单价对比

| 模型 | 输入($/M) | 输出($/M) | 是否开源 |

|---|---|---|---|

| GLM-5.1 | $1.00 | $3.20 | ✅ MIT |

| Claude Opus 4.6 | 显著更贵 | 显著更贵 | ❌ |

| GPT-5.4 | 较贵 | 较贵 | ❌ |

| Gemini 3.1 Pro | 中等 | 中等 | ❌ |

$1.00 / $3.20 这一对数字,在"前沿编码模型"的价格区间里属于地板价:对照 Claude Opus 4.6 这一档闭源模型,GLM-5.1 的实际单价大约只有它的几分之一,而 Z.ai 自己把"94.6% 的 Claude Opus 4.6 编码性能"作为核心宣传卖点之一。

GLM Coding Plan 与套餐玩法

除了按 token 计费,Z.ai 还推出了 GLM Coding Plan——一种面向 Cursor、Cline、Claude Code 这类"重度编码场景"的固定套餐,起价约 $3/月,包含 120 个 prompt 提示,远低于同类闭源 Coding 套餐。这类套餐通常会与 Max / Pro / Lite 多个档位绑定,在"日常码农工作流" 这种"调用频繁但单次便宜"的场景下,可以做到"用 Opus 级编码能力 + 接近免费的成本"。

🎯 价格选型建议:对于希望"用 Claude Opus 级别的代码能力,但又不想被 Opus 价格压垮"的团队,我们建议直接通过 API易 apiyi.com 调用 GLM-5.1:既能享受统一接口与人民币结算,也能在同一份业务代码里随时切换 GPT-5.4 / Claude Opus 4.6 做横向 A/B,用真实账单数据反推哪个模型性价比最高。

GLM-5.1 已上线 API易:最小调用示例

最后,也是中文开发者最关心的一段——GLM-5.1 已经上线 API易 apiyi.com,通过现有 OpenAI 兼容 SDK 即可直接调用,完全不需要去 Hugging Face 自己部署 754B 参数的权重。

Python 最小示例

下面是一个最小的 Python 调用示例,展示如何用官方 OpenAI SDK 调用 GLM-5.1:

from openai import OpenAI

# 把 base_url 改成 API易,api_key 换成你的 APIYI Key

client = OpenAI(

base_url="https://api.apiyi.com/v1",

api_key="YOUR_APIYI_KEY"

)

resp = client.chat.completions.create(

model="glm-5.1", # 直接指定 GLM-5.1 模型 ID

messages=[

{"role": "system", "content": "You are an expert software engineer."},

{"role": "user", "content": "用 Python 写一个 LRU 缓存,带过期时间和容量上限。"}

],

max_tokens=4096

)

print(resp.choices[0].message.content)

业务代码完全不变——之前调 GPT-4 / Claude / DeepSeek 用的什么逻辑,现在调 GLM-5.1 还是同一套。

接入 Cursor / Cline / Claude Code

Z.ai 官方明确写出 GLM-5.1 兼容所有 OpenAI 标准的 Coding 工具,包括 Claude Code、OpenClaw、Cline。在这些工具里把 OpenAI 兼容入口指向 https://api.apiyi.com/v1 并选择 GLM-5.1 模型,即可在不修改任何工作流的情况下,把主力 Coding 模型从 Opus / GPT-5 切到 GLM-5.1。对于 Cursor 这类同样支持 OpenAI Custom Endpoint 的 IDE,流程也完全一致。

流式调用与长上下文示例

GLM-5.1 在 API易 上完整保留了 200K 上下文与 128K 输出能力。对长程 Agent 任务,可以打开 stream 模式获得更低的首 token 延迟:

stream = client.chat.completions.create(

model="glm-5.1",

messages=[

{"role": "user", "content": "完整审查这份 5000 行的 Python 仓库,列出潜在 bug 与重构建议。"}

],

stream=True,

max_tokens=128000

)

for chunk in stream:

delta = chunk.choices[0].delta

if delta.content:

print(delta.content, end="", flush=True)

🎯 接入建议:GLM-5.1 在 API易 apiyi.com 已经支持 OpenAI 兼容接口、Stream 流式输出与完整 200K 上下文。我们建议你今天就把团队的 Cursor / Cline / Claude Code 工具入口指向 API易,把 GLM-5.1 作为新的主力编码模型试用一周,用真实工程任务验证它能不能取代你正在用的 Opus / GPT-5。

GLM-5.1 适合谁、不适合谁

适合的人群

| 人群 | 适合理由 |

|---|---|

| 重度 Coding Agent 用户 | SWE-Bench Pro 登顶,8 小时长程任务能力 |

| 想用前沿模型但预算有限的团队 | $1.00/$3.20 的单价远低于 Opus / GPT-5 |

| 需要 MIT 协议商用部署的企业 | 完全无限制,可商用、可闭源衍生 |

| Cursor / Cline / Claude Code 用户 | 原生兼容 OpenAI 接口,一键替换 |

| 对国产 AI 训练栈感兴趣的研究者 | 全 Huawei Ascend 910B + MindSpore 训练 |

| 数学 / 科学推理重度场景 | AIME 2026 95.3 / GPQA-Diamond 86.2 |

不太适合的人群

| 人群 | 原因 |

|---|---|

| 极度看重"独立第三方基准"的用户 | 当前数据全部为 Z.ai 自报,需自行复现 |

| 任务以多模态(图像/视频)为主 | GLM-5.1 主打文本与代码,多模态非强项 |

| 完全依赖 Anthropic / OpenAI 工具生态 | 部分高级特性仍以原厂接口为准 |

GLM-5.1 常见问题 FAQ

Q1:GLM-5.1 真的开源了吗?可以商用吗?

是的。GLM-5.1 在 2026 年 4 月 7 日由 Z.ai 在 Hugging Face(zai-org/GLM-5)上以 MIT 协议 完整开源,允许商用、允许闭源衍生、允许二次微调,只需保留版权声明。这是目前最宽松的开源协议之一,意味着你可以把 GLM-5.1 直接放进自己的商业产品、SaaS、私有化部署,不需要支付任何授权费。

Q2:GLM-5.1 真的比 GPT-5.4 和 Claude Opus 4.6 强吗?

在 SWE-Bench Pro 这一项基准上,Z.ai 公布的成绩(58.4)确实超过了 GPT-5.4(57.7)和 Claude Opus 4.6(57.3)。但需要注意:这套数据目前为 Z.ai 自报,尚未被独立第三方评测室完全复现。我们建议你不要把这些数字当成"绝对真理",而是用自己业务的真实任务跑一次——这件事现在可以直接在 API易 apiyi.com 上的 GLM-5.1 完成,无需自己部署。

Q3:GLM-5.1 的 API 已经上线 API易了吗?怎么调?

已经上线。你只需要把 OpenAI 官方 SDK 的 base_url 改成 https://api.apiyi.com/v1、api_key 替换为你的 APIYI Key、model 设为 GLM-5.1 对应的模型 ID,就能立刻调用,业务代码完全不需要重写。文章的"最小调用示例"里给出了 Python 版本,Node / Go / Rust SDK 同样适用。

Q4:GLM-5.1 比 DeepSeek、Qwen、Kimi 这些其他国产开源模型强吗?

GLM-5.1 的最大差异化在 "长程 Agent 编码 + SWE-Bench Pro 登顶"——这是过去 DeepSeek、Qwen、Kimi 都没有正面拿下的方向。如果你的业务是"日常对话 + RAG",DeepSeek 与 Qwen 仍然非常有竞争力;如果你的业务是 Coding Agent / IDE 集成 / 代码修复,GLM-5.1 是当前开源世界的第一选择。在 API易 上你可以把这几家放进同一个对比测试里,15 分钟形成自己的判断。

Q5:本地部署 GLM-5.1 需要什么硬件?

GLM-5.1 是 754B 总参数 / 40B 激活的 MoE 架构,本地部署需要专业级多卡 GPU 集群,普通团队几乎不现实。Z.ai 官方推荐使用 vLLM / SGLang / KTransformers 进行大规模推理服务化部署。如果你只是想用 GLM-5.1 而不是研究它,最高效的方式是直接通过 API易 apiyi.com 调用 —— 不需要 GPU、不需要运维、按用量付费。

Q6:GLM-5.1 的训练是不是真的没有用 Nvidia GPU?

是的。Z.ai 公开披露 GLM-5.1 完全在 Huawei Ascend 910B 芯片 + MindSpore 框架上完成训练,没有使用任何 Nvidia / AMD GPU。这是 2026 年开源大模型领域第一个在公开层面完成"全国产硬件 + 754B MoE 大模型"训练的案例,具有相当的产业象征意义。

总结:GLM-5.1 是 2026 年开源 AI 的拐点事件

把架构、基准、价格、训练栈与 API 接入路径全部串起来之后,GLM-5.1 在 2026 年 4 月这个时间点上的位置已经非常清晰:它不是又一个普通的开源模型升级,而是一次"开源真的能打过闭源前沿"的标志性事件。SWE-Bench Pro 58.4 的全球第一、MIT 协议的彻底开放、$1.00/$3.20 的极低价格、200K 上下文 + 128K 输出、8 小时长程 Agent 能力,以及全 Huawei Ascend 910B 训练栈——这些事实任何一个单独拿出来都值得写一篇报道,叠加在一起就成了"开源拐点"。

对中国大陆开发者更好的消息是,GLM-5.1 API 已经上线 API易:你不需要自己部署 754B 权重、不需要海外信用卡、不需要等任何审批,只要把 base_url 改成 https://api.apiyi.com/v1、把 model 改成 GLM-5.1,今天就能在 Cursor / Cline / Claude Code 里把主力编码模型替换成这个新的开源王者。如果你还在为 Opus / GPT-5 的账单头疼,这是一个非常值得花一个下午测试的机会窗口。

🎯 最终建议:想要第一时间体验 GLM-5.1 的"前沿编码能力 + 开源价格 + API易稳定接入",我们建议你今天就在 apiyi.com 创建一个 API Key,把现有 OpenAI SDK 的 base_url 改成

https://api.apiyi.com/v1、model 改成 GLM-5.1,用你团队最日常的代码任务跑一周。无论你最终是否决定切换主力模型,这一周的实测都会让你对 2026 年开源 AI 的真实水平形成第一手认知。

作者:APIYI Team | 关注 AI 大模型落地与开源生态,更多 GLM-5.1 / Claude / GPT-5 实战调用与对比请访问 API易 apiyi.com。