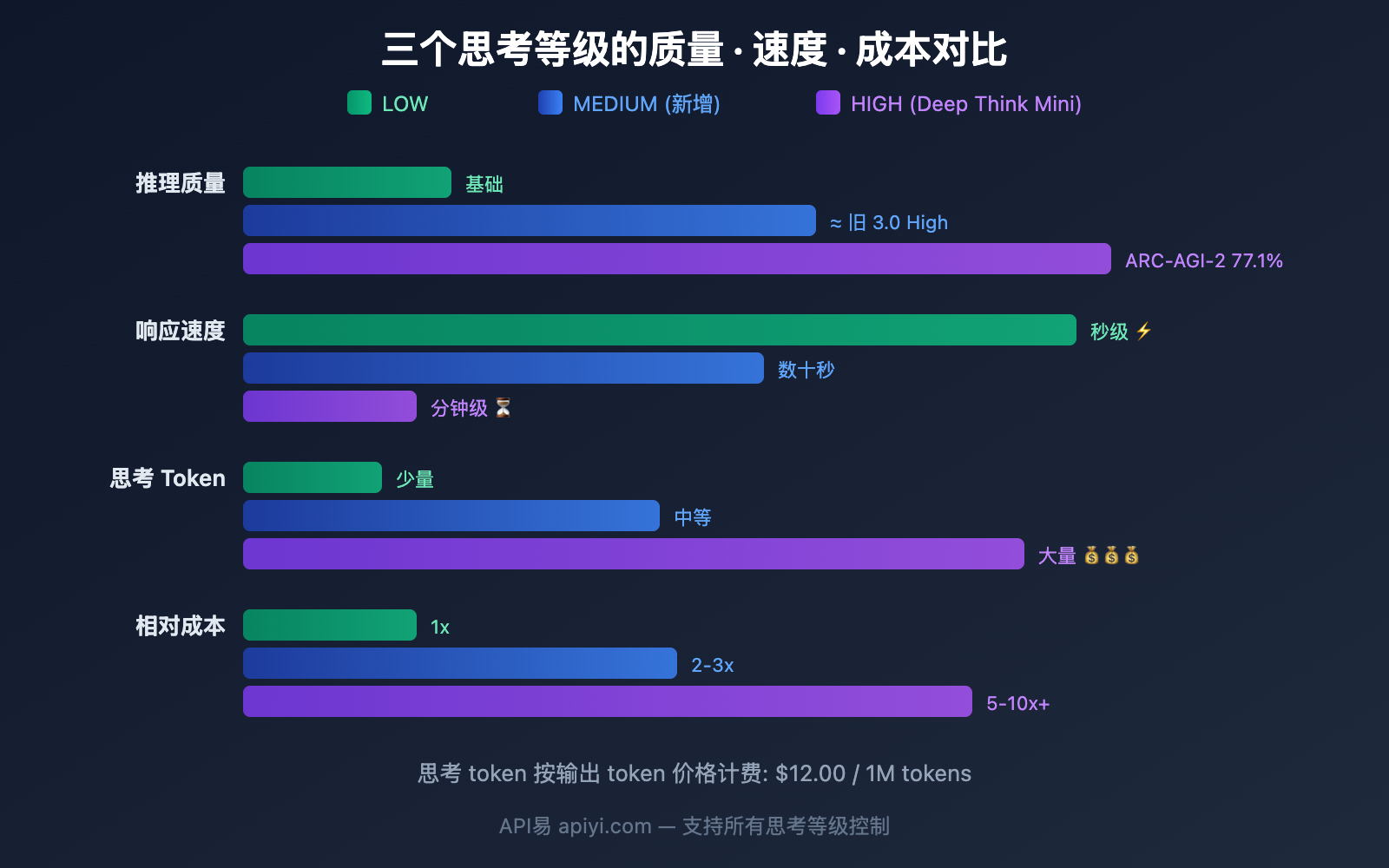

Gemini 3.1 Pro Preview 新增了 medium 思考等级,这是与前代 Gemini 3 Pro 最大的区别之一。现在你可以在 low、medium、high 三个等级间精确控制模型的推理深度,而 high 模式更是激活了 Deep Think Mini 能力。

核心价值: 读完本文,你将掌握 thinkingLevel 参数的完整配置方法,学会在质量、速度和成本之间找到最优平衡。

Gemini 3.1 Pro 思考等级完整支持矩阵

先看全局: 不同 Gemini 模型支持的思考等级不同。

| 思考等级 | Gemini 3.1 Pro | Gemini 3 Pro | Gemini 3 Flash | 说明 |

|---|---|---|---|---|

| minimal | ❌ 不支持 | ❌ 不支持 | ✅ 支持 | 接近关闭思考,仅 Flash 支持 |

| low | ✅ 支持 | ✅ 支持 | ✅ 支持 | 快速响应,最低成本 |

| medium | ✅ 新增支持 | ❌ 不支持 | ✅ 支持 | 平衡推理,3.1 Pro 的核心升级 |

| high | ✅ 支持 (默认) | ✅ 支持 (默认) | ✅ 支持 (默认) | 最深推理,激活 Deep Think Mini |

关键变化: 3 Pro → 3.1 Pro 的思考等级升级

| 对比 | Gemini 3 Pro | Gemini 3.1 Pro |

|---|---|---|

| 可用等级 | low, high (仅 2 级) | low, medium, high (3 级) |

| 默认等级 | high | high |

| high 模式含义 | 深度推理 | Deep Think Mini (更强) |

| 能否关闭思考 | 不能 | 不能 |

核心理解: Gemini 3 Pro 的 high 推理深度 ≈ Gemini 3.1 Pro 的 medium。而 3.1 Pro 的 high 是全新的 Deep Think Mini,推理深度远超上代。

🎯 迁移建议: 如果你之前用 Gemini 3 Pro 的 high 模式,切换到 3.1 Pro 后建议先用 medium (保持类似的质量和成本),只在需要深度推理时开启 high。API易 apiyi.com 同时支持所有 Gemini 模型和思考等级。

Gemini 3.1 Pro 思考等级 API 设置方法

通过 API易 调用 (OpenAI 兼容格式)

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # API易 统一接口

)

# LOW 模式: 快速响应

response_low = client.chat.completions.create(

model="gemini-3.1-pro-preview",

messages=[{"role": "user", "content": "把这段英文翻译成中文: Hello World"}],

extra_body={

"thinking": {"type": "enabled", "budget_tokens": 1024}

}

)

# MEDIUM 模式: 平衡推理 (新增!)

response_med = client.chat.completions.create(

model="gemini-3.1-pro-preview",

messages=[{"role": "user", "content": "审查这段代码有没有内存泄漏风险"}],

extra_body={

"thinking": {"type": "enabled", "budget_tokens": 8192}

}

)

# HIGH 模式: Deep Think Mini

response_high = client.chat.completions.create(

model="gemini-3.1-pro-preview",

messages=[{"role": "user", "content": "证明: 对所有正整数n, n^3-n能被6整除"}],

extra_body={

"thinking": {"type": "enabled", "budget_tokens": 32768}

}

)

通过 Google SDK 原生调用

from google import genai

from google.genai import types

client = genai.Client()

# 使用 thinkingLevel 参数

response = client.models.generate_content(

model="gemini-3.1-pro-preview",

contents="你的提示词",

config=types.GenerateContentConfig(

thinking_config=types.ThinkingConfig(

thinking_level="MEDIUM" # "LOW" / "MEDIUM" / "HIGH"

)

),

)

# 查看思考 token 消耗

print(f"思考 token: {response.usage_metadata.thoughts_token_count}")

print(f"输出 token: {response.usage_metadata.candidates_token_count}")

REST API 调用

POST https://generativelanguage.googleapis.com/v1beta/models/gemini-3.1-pro-preview:generateContent

{

"contents": [{"parts": [{"text": "你的提示词"}]}],

"generationConfig": {

"thinkingConfig": {

"thinkingLevel": "MEDIUM"

}

}

}

⚠️ 重要提醒:

thinkingLevel和thinkingBudget不能同时使用,否则会返回 400 错误。Gemini 3+ 模型推荐使用thinkingLevel,Gemini 2.5 模型使用thinkingBudget。

3 个思考等级的 Gemini 3.1 Pro 详细对比

LOW: 最快最便宜

| 维度 | 详情 |

|---|---|

| 推理深度 | 最少的思考 token,仍优于不思考的模型 |

| 响应速度 | 秒级 (最快) |

| 成本 | 最低 (思考 token 少 → 输出 token 少 → 费用低) |

| 适用场景 | 自动补全、分类、结构化数据提取、简单翻译、摘要 |

| 不适合 | 复杂推理、数学证明、多步调试 |

MEDIUM: 平衡首选 (新增)

| 维度 | 详情 |

|---|---|

| 推理深度 | 中等思考 token,≈ 旧版 3.0 Pro 的 high 水平 |

| 响应速度 | 中等延迟 |

| 成本 | 中等 |

| 适用场景 | 代码审查、文档分析、日常编码、标准 API 调用、问答 |

| 不适合 | IMO 级数学、极复杂的多步推理 |

HIGH: Deep Think Mini (默认)

| 维度 | 详情 |

|---|---|

| 推理深度 | 最大化推理,激活 Deep Think Mini 能力 |

| 响应速度 | 可能需要数分钟 (IMO 题 ~8 分钟) |

| 成本 | 最高 (大量思考 token 按输出价格计费) |

| 适用场景 | 复杂调试、算法设计、数学证明、研究任务、Agent 工作流 |

| 特殊能力 | 思考签名 (thought signatures) 保持跨 API 调用的推理连续性 |

Gemini 3.1 Pro 思考 Token 计费规则

理解计费是选择思考等级的关键。

核心计费原则

| 计费项 | 说明 |

|---|---|

| 思考 token 是否计费 | 是,按输出 token 同等价格计费 |

| 输出 token 价格 | $12.00 / 1M tokens (包含思考 token) |

| 计费基准 | 按完整内部推理链计费,不仅是摘要 |

| 思考摘要 | API 仅返回思考摘要,但按完整思考 token 数计费 |

谷歌官方说明:

"Thinking models generate full thoughts to improve the quality of the final response, and then output summaries to provide insight into the thought process. Pricing is based on the full thought tokens the model needs to generate to create a summary, despite only the summary being output from the API."

三个等级的成本估算

| 等级 | 估算思考 token | 以 1000 次调用计 | 月成本趋势 |

|---|---|---|---|

| LOW | ~500-2K / 次 | $6-24 | 最低 |

| MEDIUM | ~2K-8K / 次 | $24-96 | 中等 |

| HIGH | ~8K-32K+ / 次 | $96-384+ | 较高,复杂任务更多 |

💰 成本优化: 不是每个请求都需要 HIGH。将 80% 的日常任务设为 LOW 或 MEDIUM,仅 20% 的复杂任务用 HIGH,可以将 API 支出降低 50-70%。通过 API易 apiyi.com 平台可以灵活配置。

任务类型与 Gemini 3.1 Pro 思考等级匹配指南

详细场景推荐

| 任务类型 | 推荐等级 | 理由 | 延迟预期 |

|---|---|---|---|

| 简单翻译 | LOW | 不需要推理 | <5 秒 |

| 文本分类 | LOW | 模式匹配任务 | <5 秒 |

| 摘要提取 | LOW | 信息压缩,非推理 | <10 秒 |

| 自动补全 | LOW | 延迟敏感 | <3 秒 |

| 代码审查 | MEDIUM | 需要适度分析 | 10-30 秒 |

| 文档问答 | MEDIUM | 理解 + 回答 | 10-30 秒 |

| 日常编码 | MEDIUM | 常规代码生成 | 15-40 秒 |

| Bug 分析 | MEDIUM | 中等复杂度推理 | 20-40 秒 |

| 复杂调试 | HIGH | 多步推理链 | 1-5 分钟 |

| 数学证明 | HIGH | Deep Think Mini | 3-8 分钟 |

| 算法设计 | HIGH | 深度推理 | 2-5 分钟 |

| 研究分析 | HIGH | 多维度深度分析 | 2-5 分钟 |

| Agent 工作流 | HIGH | 思考签名保持连续 | 视任务而定 |

动态等级选择: 最佳实践代码

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # API易 统一接口

)

# 根据任务类型自动选择思考等级

THINKING_CONFIG = {

"simple": {"type": "enabled", "budget_tokens": 1024}, # LOW

"medium": {"type": "enabled", "budget_tokens": 8192}, # MEDIUM

"complex": {"type": "enabled", "budget_tokens": 32768}, # HIGH

}

def smart_think(prompt, complexity="medium"):

"""根据任务复杂度自动设置思考等级"""

return client.chat.completions.create(

model="gemini-3.1-pro-preview",

messages=[{"role": "user", "content": prompt}],

extra_body={"thinking": THINKING_CONFIG[complexity]}

)

# 简单翻译 → LOW

resp1 = smart_think("翻译: Good morning", "simple")

# 代码审查 → MEDIUM

resp2 = smart_think("审查这段代码的安全性: ...", "medium")

# 数学证明 → HIGH (Deep Think Mini)

resp3 = smart_think("证明黎曼猜想的某个特殊情况", "complex")

Gemini 3.1 Pro vs 3 Pro: 思考等级演进对照

Deep Think Mini 到底强在哪

Gemini 3.1 Pro 的 HIGH 模式激活的 Deep Think Mini 是这次升级的最大亮点。

Deep Think Mini 是什么

Deep Think Mini 不是一个独立模型,而是 Gemini 3.1 Pro 在 HIGH 思考等级下的特殊推理模式。谷歌将其描述为「Gemini Deep Think 的迷你版本」— Deep Think 是谷歌的专用重型推理模型 (ARC-AGI-2 得分 84.6%)。

Deep Think Mini 的实测表现

| 测试项 | Deep Think Mini (3.1 Pro HIGH) | Gemini 3 Pro HIGH | 提升幅度 |

|---|---|---|---|

| ARC-AGI-2 | 77.1% | 31.1% | +148% |

| IMO 数学题 | ~8 分钟解出 | 无法解出 | 从不能到能 |

| 复杂规划任务 | 基准提升 40-60% | 对比 Gemini 2.5 Pro | 显著提升 |

思考签名 (Thought Signatures)

Deep Think Mini 引入了一项独特技术: 思考签名 (thought signatures)。这是加密的、防篡改的中间推理状态表示。

在 Agent 工作流中,模型的推理往往跨越多个 API 调用。思考签名可以将前一次调用的推理上下文传递给下一次调用,保持推理连续性。这对多步骤 Agent 任务尤为重要。

什么任务值得用 Deep Think Mini

| 值得用 HIGH (Deep Think Mini) | 不值得用 HIGH |

|---|---|

| 数学竞赛级推理 | 简单四则运算 |

| 复杂 Bug 跨文件调试 | 语法错误修复 |

| 算法设计和优化 | CRUD 代码生成 |

| 学术论文方法论分析 | 文章摘要 |

| 多步骤 Agent 长任务 | 单轮问答 |

| 安全漏洞深度分析 | 格式转换 |

💡 实用建议: Deep Think Mini 的强大是有代价的 — 延迟和成本都很高。建议只在真正需要「深度思考」的任务上使用 HIGH,日常任务用 MEDIUM 足矣。通过 API易 apiyi.com 可以在每个请求级别灵活切换。

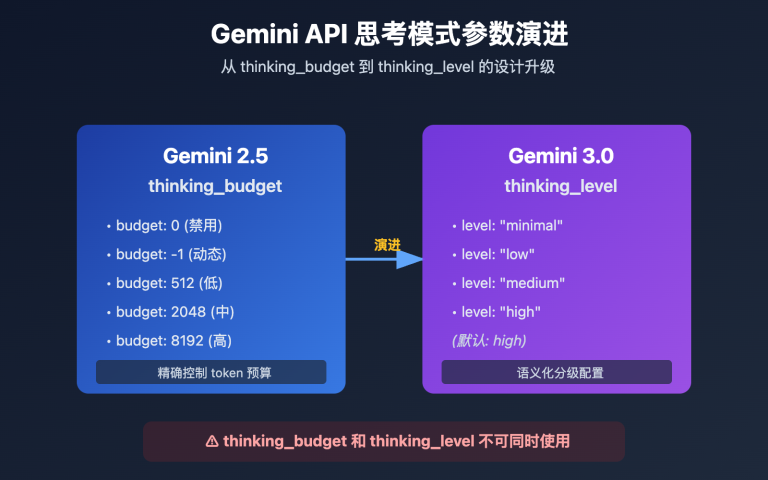

thinkingLevel vs thinkingBudget: 别混淆

谷歌有两个控制思考的参数,适用于不同模型系列:

| 参数 | 适用模型 | 值类型 | 说明 |

|---|---|---|---|

| thinkingLevel | Gemini 3+ (3 Flash, 3 Pro, 3.1 Pro) | 枚举: MINIMAL/LOW/MEDIUM/HIGH | 推荐用于 Gemini 3 系列 |

| thinkingBudget | Gemini 2.5 (Pro, Flash, Flash Lite) | 整数: 0-32768 | 适用于 2.5 系列 |

⚠️ 两个参数不能同时使用! 同时传入会返回 400 错误。

| 场景 | 正确做法 | 错误做法 |

|---|---|---|

| 调用 Gemini 3.1 Pro | 用 thinkingLevel: "MEDIUM" |

用 thinkingBudget: 8192 |

| 调用 Gemini 2.5 Pro | 用 thinkingBudget: 8192 |

用 thinkingLevel: "MEDIUM" |

| 两个参数都传 | — | 400 错误 ❌ |

🎯 简单记忆: Gemini 3 系列 → thinkingLevel (字符串等级),Gemini 2.5 系列 → thinkingBudget (数字 token 数)。API易 apiyi.com 支持两种参数格式。

常见问题

Q1: 默认不设置 thinkingLevel 是什么等级?

默认是 HIGH。这意味着如果你不主动设置,每次调用都会使用 Deep Think Mini 的全部推理能力,消耗最多的思考 token。建议根据任务实际需要设置合适的等级以节省成本。通过 API易 apiyi.com 可以在请求级别灵活控制。

Q2: 思考 token 怎么计费? 很贵吗?

思考 token 按输出 token 同等价格计费 ($12.00 / 1M tokens)。HIGH 模式下一个复杂请求可能消耗 3 万+ 思考 token,费用约 $0.36。而 LOW 模式同样的请求可能只消耗 1000 思考 token,费用约 $0.012。差距可达 30 倍。

Q3: 3.1 Pro 的 MEDIUM 就是 3.0 Pro 的 HIGH 吗?

基本等价。谷歌的描述是 3.1 Pro 的 MEDIUM 提供「平衡的思维,适合处理大多数任务」,这和 3.0 Pro 的 HIGH 的定位一致。如果你从 3.0 Pro 迁移到 3.1 Pro,把 HIGH 改成 MEDIUM 可以保持相似的质量和成本。通过 API易 apiyi.com 可以同时调用两个版本做对比。

Q4: 能关闭思考功能吗?

Gemini 3.1 Pro 不能完全关闭思考。最低只能设为 LOW,仍会进行基础推理。如果需要完全无思考的响应,可以考虑 Gemini 3 Flash 的 MINIMAL 模式。

Gemini 3.1 Pro 思考等级常见误区

| 误区 | 事实 |

|---|---|

| 「HIGH 等级回答质量最好,应该一直用」 | HIGH 在简单任务上的质量和 MEDIUM 接近,但成本高 5-10 倍 |

| 「LOW 等级推理能力很差」 | LOW 仍然优于完全不思考的模型,只是思考 token 更少 |

| 「MEDIUM 是新功能,可能不稳定」 | MEDIUM 的推理深度 ≈ 旧版 3.0 Pro 的 HIGH,已经过充分验证 |

| 「思考 token 不计费」 | 计费! 按输出 token 同价 ($12/MTok) 计费 |

| 「可以关闭 3.1 Pro 的思考」 | 不能,最低只能设为 LOW,仍有基础推理 |

| 「thinkingLevel 和 thinkingBudget 可以一起用」 | 不行! 同时使用会返回 400 错误 |

| 「设高等级延迟会更长但结果立即返回」 | HIGH 模式可能需要数分钟才能开始返回,不是延迟一小会 |

总结: Gemini 3.1 Pro 思考等级选择速查

| 等级 | 一句话 | 适用场景 | 相对成本 |

|---|---|---|---|

| LOW | 最快最便宜 | 翻译、分类、摘要、补全 | 1x |

| MEDIUM | 平衡首选 (新增) | 编码、审查、分析、问答 | 2-3x |

| HIGH | Deep Think Mini | 数学、调试、研究、Agent | 5-10x+ |

核心建议:

- 日常开发用 MEDIUM — 质量好、成本合理,等价于旧版 HIGH

- 简单任务用 LOW — 节省 70%+ 的思考 token 费用

- 深度推理用 HIGH — Deep Think Mini 能力独一无二,但注意成本

- 默认是 HIGH — 不设置就是最贵模式,记得主动调整

推荐通过 API易 apiyi.com 平台根据任务类型动态切换思考等级,实现质量与成本的最优平衡。

参考资料

-

Google AI 文档: Gemini 思考配置指南

- 链接:

ai.google.dev/gemini-api/docs/thinking - 说明: thinkingLevel 参数的完整文档

- 链接:

-

Google AI 文档: Gemini 3.1 Pro 模型页

- 链接:

ai.google.dev/gemini-api/docs/models/gemini-3.1-pro-preview - 说明: 思考等级支持矩阵和注意事项

- 链接:

-

Gemini API 定价页面: 思考 token 计费说明

- 链接:

ai.google.dev/gemini-api/docs/pricing - 说明: 思考 token 按输出 token 价格计费

- 链接:

-

VentureBeat: Deep Think Mini 深度体验

- 链接:

venturebeat.com/technology/google-gemini-3-1-pro-first-impressions - 说明: IMO 题 8 分钟解出的实测数据

- 链接:

-

Google 官方博客: Gemini 3.1 Pro 发布公告

- 链接:

blog.google/innovation-and-ai/models-and-research/gemini-models/gemini-3-1-pro - 说明: 三级思考系统和 Deep Think Mini 的官方介绍

- 链接:

📝 作者: APIYI Team | 技术交流请访问 API易 apiyi.com

📅 更新时间: 2026 年 2 月 20 日

🏷️ 关键词: Gemini 3.1 Pro 思考等级, thinkingLevel, Deep Think Mini, LOW MEDIUM HIGH, API 调用, 推理控制