作者注:詳解阿里通義千問 Qwen3.5-Omni 原生多模態模型的 Thinker-Talker MoE 架構、256K 上下文、音視頻編碼能力以及 Audio-Visual Vibe Coding 湧現能力

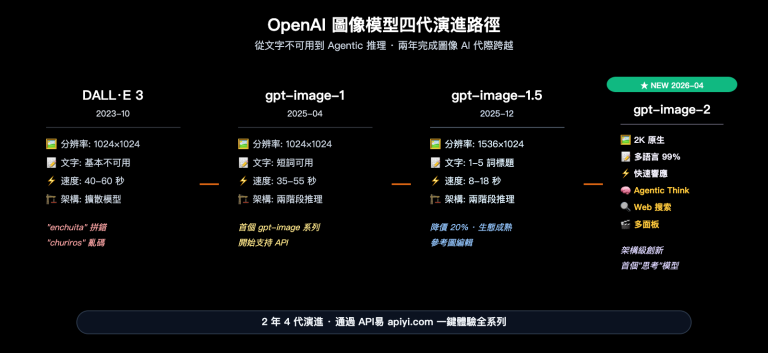

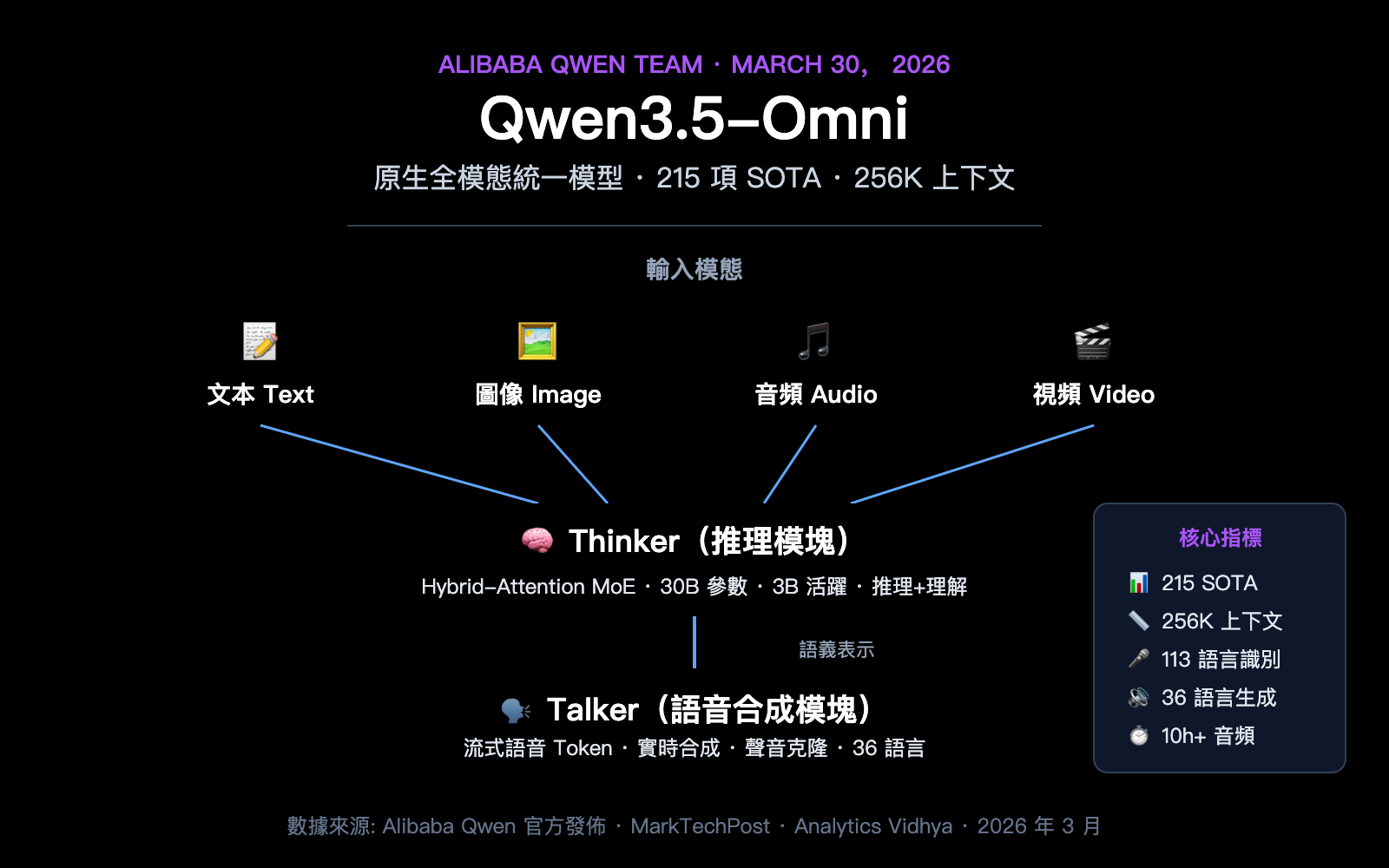

阿里巴巴通義千問團隊於 2026 年 3 月 30 日正式發佈了 Qwen3.5-Omni,這是一款在單一計算管道內同時處理文本、圖像、音頻和視頻四種模態的原生多模態統一模型。作爲阿里 3-4 月密集發佈攻勢的組成部分,Qwen3.5-Omni 在 215 項基準測試中達到 SOTA,標誌着中國 AI 廠商在全模態大模型領域的重要突破。

核心價值: 3 分鐘瞭解 Qwen3.5-Omni 的 Thinker-Talker 架構設計、三種模型變體的選擇策略,以及 Audio-Visual Vibe Coding 湧現能力。

Qwen3.5-Omni 多模態模型核心信息

Qwen3.5-Omni 關鍵參數速覽

| 參數項 | 詳情 |

|---|---|

| 發佈日期 | 2026 年 3 月 30 日 |

| 發佈方 | 阿里巴巴通義千問(Qwen)團隊 |

| 架構 | Thinker-Talker + Hybrid-Attention MoE |

| 模型變體 | Plus(30B-A3B MoE)、Flash(輕量 MoE)、Light(稠密模型/開放權重) |

| 上下文窗口 | 256K Token |

| 音頻容量 | 10+ 小時連續音頻 |

| 視頻容量 | 400+ 秒 720p 視頻(1 FPS 採樣) |

| 語音識別 | 113 種語言和方言(前代僅 19 種) |

| 語音生成 | 36 種語言(前代僅 10 種) |

| 訓練數據 | 超過 1 億小時音視頻數據 |

| 基準成績 | 215 項音頻/視頻理解基準達到 SOTA |

Qwen3.5-Omni 模型定位

Qwen3.5-Omni 的核心意義在於原生多模態——這不是一個文本模型外接音頻和視頻模塊的拼裝方案,而是從頭開始在超過 1 億小時音視頻數據上預訓練的統一模型。所有模態在同一個計算管道中處理,這意味着模型可以真正理解音頻和視頻中的語義信息,而非簡單地將音視頻轉錄爲文本後再處理。

同時,Qwen3.5-Omni 是阿里在 2026 年 3-4 月密集發佈的系列模型之一。僅數天後的 4 月 2 日,阿里又發佈了面向企業級應用的 Qwen3.6-Plus 模型(支持 100 萬 Token 上下文,主攻代理式編程),顯示出阿里在大模型領域的強勁投入。

Qwen3.5-Omni Thinker-Talker 架構詳解

Thinker-Talker 雙模塊設計

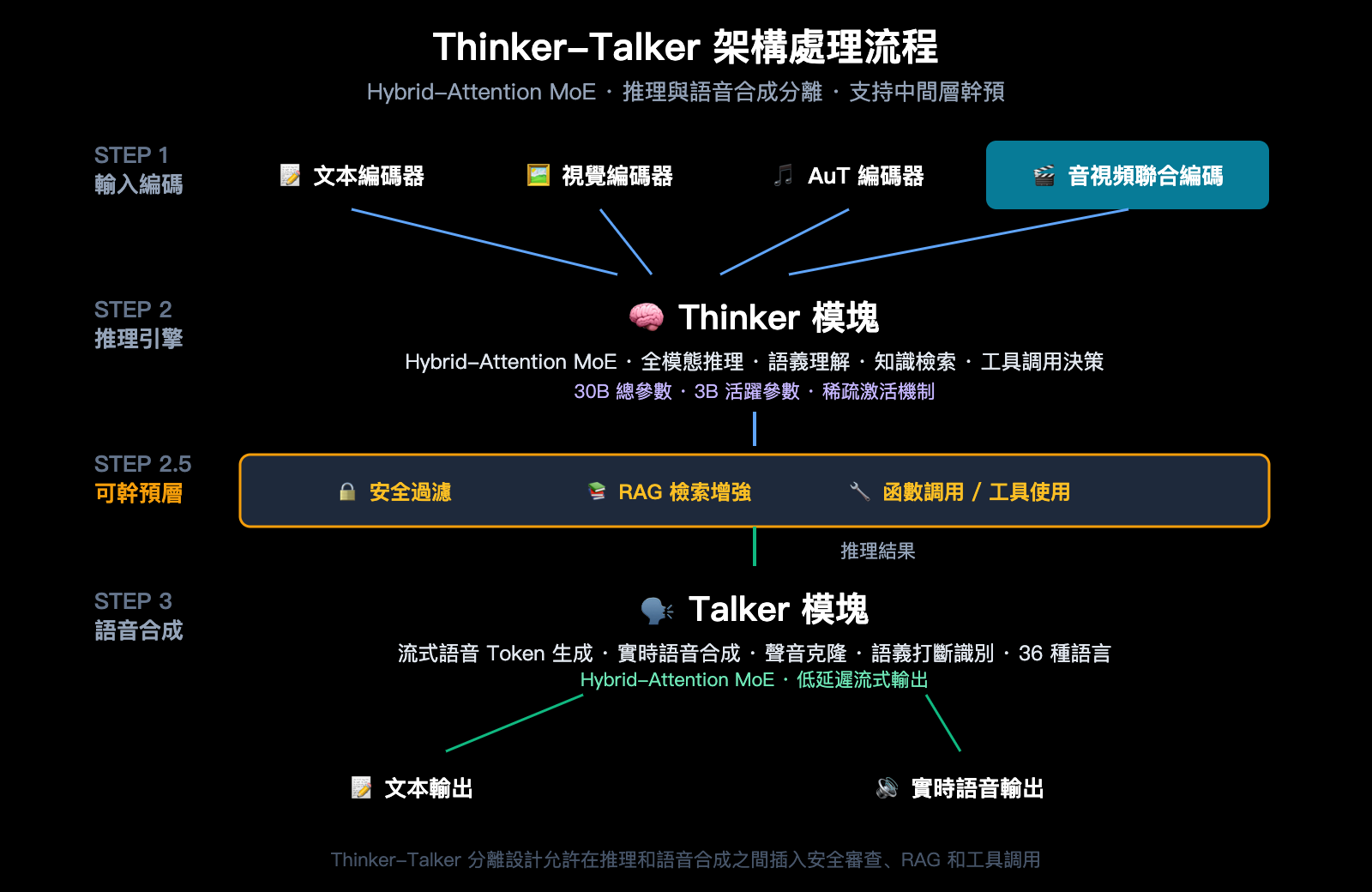

Qwen3.5-Omni 採用了獨特的 Thinker-Talker 雙模塊架構,這一設計首次在 Qwen2.5-Omni 中引入,在 3.5 版本中得到了重大升級——兩個模塊都採用了 Hybrid-Attention MoE(混合注意力專家混合)架構。

Thinker 模塊(思考者):

- 處理所有輸入模態:文本、圖像、音頻、視頻

- 執行推理和理解任務

- 生成內部推理表示

- 使用原生 Audio Transformer(AuT)編碼器處理音頻

- 輸出結構化的語義表示

Talker 模塊(表達者):

- 接收 Thinker 的推理表示

- 將語義表示轉換爲流式語音 Token

- 支持實時語音合成

- 實現自然的語音表達(包括語調、情感、停頓)

Thinker-Talker 架構的工程價值

這種分離式設計帶來的核心優勢是中間可干預性——外部系統(RAG 檢索管道、安全過濾器、函數調用)可以在 Thinker 輸出和 Talker 合成之間進行干預。這意味着:

- 企業可以在語音輸出前添加安全審查

- 開發者可以在推理結果基礎上觸發工具調用

- RAG 系統可以在回答前補充知識檢索結果

MoE 稀疏激活機制

Hybrid-Attention MoE 設計的核心是稀疏激活——模型在處理每個 Token 時只激活部分參數(30B 總參數中僅 3B 活躍)。這一機制讓模型在保持高容量的同時,將單次推理計算成本控制在可接受範圍內,這對實時應用(如語音對話)至關重要。

🎯 開發建議: Qwen3.5-Omni 的 Thinker-Talker 分離架構非常適合構建多步驟 AI 工作流。如果你需要在自己的應用中集成多模態能力,可以通過 API易 apiyi.com 平臺快速測試 Qwen3.5-Omni 和其他主流多模態模型的效果差異。

Qwen3.5-Omni 三種模型變體對比

Plus / Flash / Light 選擇指南

Qwen3.5-Omni 提供三種面向不同場景的模型變體:

| 變體 | 架構類型 | 參數規模 | 可用方式 | 適用場景 |

|---|---|---|---|---|

| Plus | MoE(30B-A3B) | 30B 總參/3B 活躍 | API(DashScope) | 最高質量推理、複雜多模態任務 |

| Flash | 輕量 MoE | 更少參數 | API(DashScope) | 低延遲場景、實時對話 |

| Light | 稠密模型 | 較小規模 | 開放權重(HuggingFace) | 本地部署、邊緣設備 |

選擇建議:

- 追求最佳效果 → 選擇 Plus 變體,在 215 項基準測試中均爲最高分

- 追求低延遲 → 選擇 Flash 變體,適合實時語音對話和流式交互

- 需要本地部署 → 選擇 Light 變體,開放權重可在本地 GPU 上運行

Qwen3.5-Omni API 接入方式

Qwen3.5-Omni 的 API 遵循標準的 /v1/chat/completions 格式,通過 modalities 參數指定輸出類型:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # 通過 API易 統一接入

)

response = client.chat.completions.create(

model="qwen3.5-omni-plus",

modalities=["text", "audio"],

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "請分析這段視頻的內容"},

{"type": "video_url", "video_url": {"url": "https://example.com/video.mp4"}}

]

}

]

)

查看多模態輸入完整示例

import openai

import base64

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1"

)

# 圖像 + 音頻 + 文本的多模態輸入

response = client.chat.completions.create(

model="qwen3.5-omni-plus",

modalities=["text", "audio"],

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "請根據圖片和語音描述生成分析報告"},

{

"type": "image_url",

"image_url": {"url": "data:image/png;base64,..."}

},

{

"type": "input_audio",

"input_audio": {

"data": base64.b64encode(audio_bytes).decode(),

"format": "wav"

}

}

]

}

],

max_tokens=2000

)

# 獲取文本回復

print(response.choices[0].message.content)

# 如果請求了音頻輸出,獲取語音數據

if hasattr(response.choices[0].message, 'audio'):

audio_data = response.choices[0].message.audio

print(f"音頻格式: {audio_data.format}")

💡 接入提示: Qwen3.5-Omni 的 API 兼容 OpenAI SDK 格式。如果你已有基於 OpenAI SDK 的代碼,只需修改

base_url和model參數即可快速切換。通過 API易 apiyi.com 平臺可以同時測試 Qwen3.5-Omni 和 GPT-4o 等模型的多模態效果。

Qwen3.5-Omni 基準測試性能分析

音頻理解能力

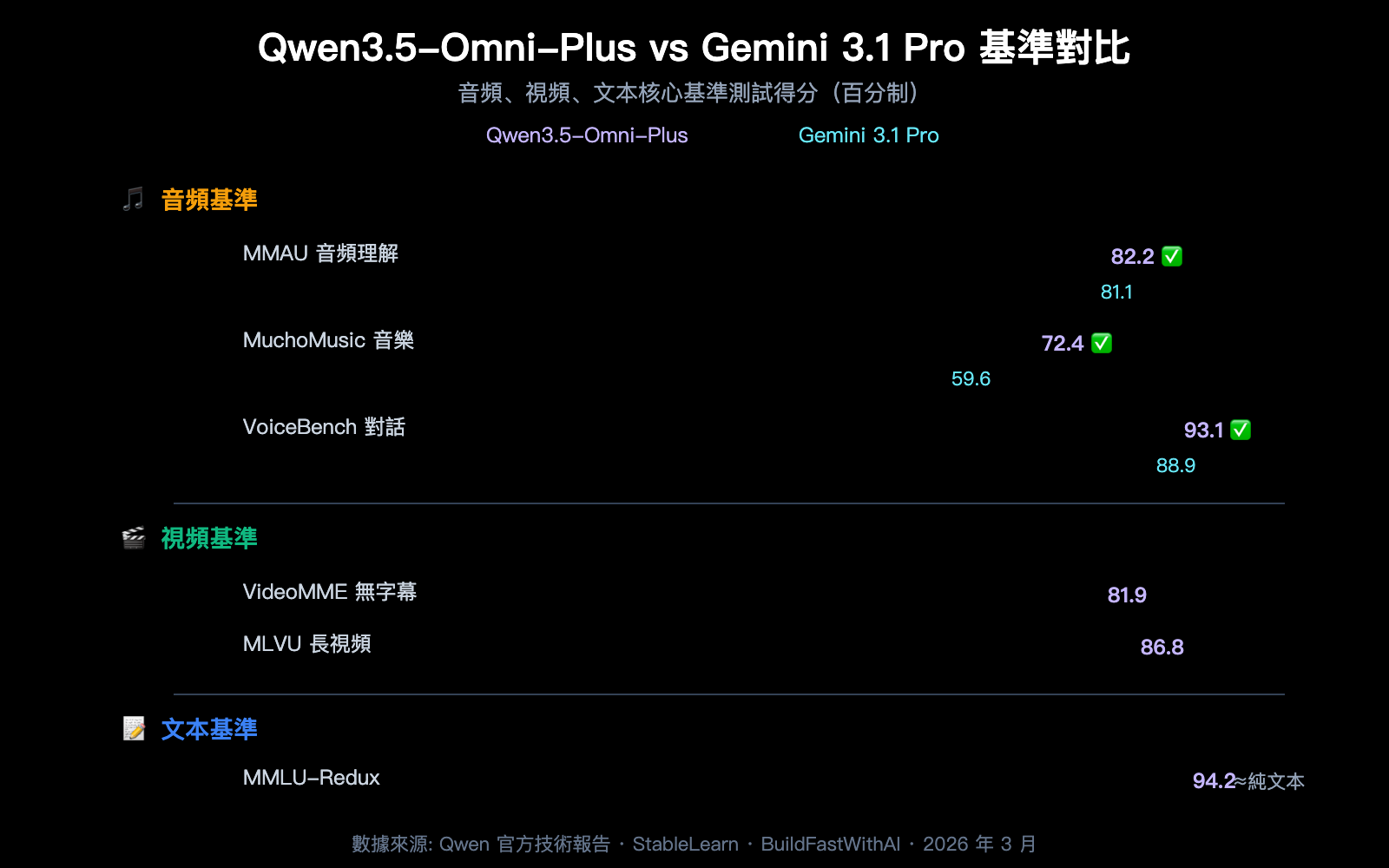

Qwen3.5-Omni-Plus 在音頻相關基準中全面超越 Google Gemini 3.1 Pro:

| 基準測試 | Qwen3.5-Omni-Plus | Gemini 3.1 Pro | 勝出 |

|---|---|---|---|

| MMAU 音頻理解 | 82.2 | 81.1 | Qwen |

| MuchoMusic 音樂理解 | 72.4 | 59.6 | Qwen(+21%) |

| VoiceBench 對話 | 93.1 | 88.9 | Qwen |

在音樂理解(MuchoMusic)上 Qwen3.5-Omni 的優勢尤爲顯著,領先幅度達 21%。

視覺和視頻能力

| 基準測試 | Qwen3.5-Omni-Plus | 說明 |

|---|---|---|

| MMMU-Pro | 73.9 | 多模態理解最高分 |

| RealWorldQA | 84.1 | 真實世界視覺問答 |

| VideoMME(無字幕) | 81.9 | 視頻多模態理解 |

| MLVU | 86.8 | 長視頻理解 |

| MVBench | 79.0 | 多維度視頻基準 |

| LVBench | 71.2 | 長視頻基準 |

文本推理能力保持

Qwen3.5-Omni 在獲得全模態能力的同時,文本推理性能幾乎沒有下降:

| 基準測試 | Qwen3.5-Omni-Plus | Qwen3.5-Plus(純文本) | 差距 |

|---|---|---|---|

| MMLU-Redux | 94.2 | 94.3 | -0.1 |

| C-Eval | 92.0 | 92.3 | -0.3 |

| IFEval | 89.7 | 89.7 | 0 |

這意味着選擇 Qwen3.5-Omni 不會犧牲文本推理質量——你可以用一個模型同時覆蓋文本和多模態場景。

🎯 選型建議: Qwen3.5-Omni 在音頻和音樂理解上優勢明顯,如果你的應用涉及語音交互或音頻分析,建議優先考慮這個模型。可以通過 API易 apiyi.com 快速對比 Qwen3.5-Omni 和 GPT-4o 在你具體場景下的表現差異。

Qwen3.5-Omni 的 3 大差異化能力

能力 1: Audio-Visual Vibe Coding

Qwen3.5-Omni 展現了一種被通義千問團隊稱爲「Audio-Visual Vibe Coding」的湧現能力——模型可以通過觀看視頻 + 聽取語音指令來編寫可運行的代碼,而無需專門針對此能力進行訓練。

在實際測試中,模型能夠:

- 將手繪草圖(通過攝像頭拍攝)轉換爲可運行的 React 網頁

- 根據視頻演示和口頭描述編寫功能代碼

- 理解視覺設計意圖並生成對應的前端實現

這一能力對於快速原型開發和低代碼場景具有顯著價值。

能力 2: 語義打斷識別

傳統語音交互系統無法區分用戶的「嗯」「啊」等回應性反饋和真正的打斷意圖。Qwen3.5-Omni 引入了原生的 Turn-Taking Intent Recognition(輪次接管意圖識別),可以區分:

- 回應反饋(Backchanneling): 如「嗯」「對」等無語義打斷意圖的反饋

- 語義打斷(Semantic Interruption): 用戶有明確意圖接管對話的情況

這使得 Qwen3.5-Omni 的語音對話體驗更接近真人交流。

能力 3: 聲音克隆

用戶可以上傳一段語音錄音,Qwen3.5-Omni 會學習並克隆該聲音特徵,在後續所有語音輸出中使用克隆的聲音。克隆的聲音在多語言場景下能保持自然度和穩定性。

Qwen3.5-Omni 在阿里 AI 發佈攻勢中的位置

阿里 2026 年 3-4 月 AI 模型發佈節奏

| 發佈時間 | 模型 | 定位 | 關鍵特性 |

|---|---|---|---|

| 3 月 30 日 | Qwen3.5-Omni | 原生全模態模型 | 文本/圖像/音頻/視頻統一處理 |

| 4 月 2 日 | Qwen3.6-Plus | 企業級代理模型 | 100 萬 Token 上下文、代理式編程 |

| 持續更新 | Qwen3-TTS | 語音合成 | 開源 TTS 系列,支持聲音克隆 |

這種密集發佈節奏表明阿里正在全方位推進大模型能力建設。Qwen3.5-Omni 覆蓋了多模態感知與理解,Qwen3.6-Plus 覆蓋了企業級代碼生成和代理能力,兩者形成互補。

值得注意的是,Qwen3.5-Omni 的 Plus 和 Flash 變體採用了閉源 API 發佈方式,打破了阿里此前以開源爲主的策略。WinBuzzer 等媒體分析認爲,這反映了阿里在商業化壓力下對利潤的關注——Bloomberg 的報道標題直接寫道「阿里推出第三款閉源 AI 模型,聚焦利潤」。

💰 成本建議: 如果你正在考慮將 Qwen3.5-Omni 集成到產品中,建議先通過 API易 apiyi.com 平臺的免費額度進行概念驗證,確認模型效果後再投入生產部署。平臺支持 Qwen、GPT、Claude、Gemini 等全系模型,便於在不同場景下靈活選擇。

常見問題

Q1: Qwen3.5-Omni 是開源的還是閉源的?

Qwen3.5-Omni 分三個變體:Plus 和 Flash 目前僅通過阿里雲 DashScope API 提供(閉源),Light 變體的權重開放在 HuggingFace 上可以下載(開源)。前代 Qwen3-Omni 採用 Apache 2.0 協議完全開源,但 3.5 版本的 Plus/Flash 變體轉向了 API-only 模式。如果需要本地部署,可以選擇 Light 變體。

Q2: Qwen3.5-Omni 和 GPT-4o 相比如何?

在音頻理解和音樂理解方面,Qwen3.5-Omni-Plus 明顯領先於 GPT-4o。在視頻理解方面兩者各有優勢。在文本推理方面,Qwen3.5-Omni 與自家純文本模型 Qwen3.5-Plus 幾乎持平。建議通過 API易 apiyi.com 平臺在你的具體應用場景下進行對比測試,不同場景下表現差異可能很大。

Q3: 如何快速開始使用 Qwen3.5-Omni API?

Qwen3.5-Omni 的 API 兼容標準 OpenAI SDK 格式,接入非常簡單。只需安裝 openai SDK,設置對應的 API Key 和 base_url,即可調用。通過 API易 apiyi.com 可以獲取免費測試額度,用本文代碼示例快速驗證多模態調用效果。

總結

Qwen3.5-Omni 多模態模型的核心要點:

- 原生全模態: 在單一管道內統一處理文本、圖像、音頻、視頻四種模態,非拼裝方案

- Thinker-Talker 架構: 推理和語音合成分離,支持中間層干預和工具調用

- 3 種變體選擇: Plus(最強)、Flash(低延遲)、Light(開放權重本地部署)

- 215 項 SOTA: 在音頻理解、音樂理解方面顯著領先 Gemini 3.1 Pro

- 湧現能力: Audio-Visual Vibe Coding 讓模型通過視頻+語音編寫代碼

Qwen3.5-Omni 代表了多模態 AI 的重要進展——一個模型同時覆蓋文本、視覺、音頻、視頻四種模態,且文本推理能力幾乎不打折。對於需要多模態能力的開發者,這是一個值得認真評估的選項。

推薦通過 API易 apiyi.com 快速測試 Qwen3.5-Omni 和其他主流多模態模型,平臺提供免費額度和統一 API 接口,便於對比和選型。

📚 參考資料

-

MarkTechPost 報道: Qwen3.5-Omni 發佈詳解

- 鏈接:

marktechpost.com/2026/03/30/alibaba-qwen-team-releases-qwen3-5-omni-a-native-multimodal-model-for-text-audio-video-and-realtime-interaction - 說明: 詳細的技術分析和架構解讀

- 鏈接:

-

Qwen3-Omni GitHub 倉庫: 開源代碼和模型權重

- 鏈接:

github.com/QwenLM/Qwen3-Omni - 說明: 前代 Qwen3-Omni 的完整代碼和文檔

- 鏈接:

-

Analytics Vidhya 深度解讀: Qwen3.5-Omni 技術報告分析

- 鏈接:

analyticsvidhya.com/blog/2026/03/qwen3-5-omni-ai-model - 說明: 涵蓋聲音克隆、Vibe Coding 等能力的詳細分析

- 鏈接:

-

eWeek 報道: Qwen3.5-Omni 作爲阿里最先進多模態模型

- 鏈接:

eweek.com/news/qwen3-5-omni-alibaba-multimodal-ai-launch - 說明: 行業視角的分析和競品對比

- 鏈接:

-

HuggingFace 模型頁: Qwen3-Omni-30B-A3B-Instruct

- 鏈接:

huggingface.co/Qwen/Qwen3-Omni-30B-A3B-Instruct - 說明: 模型權重下載和技術規格

- 鏈接:

作者: APIYI 技術團隊

技術交流: 歡迎在評論區討論多模態 AI 應用實踐,更多 AI 開發資料可訪問 API易 docs.apiyi.com 文檔中心