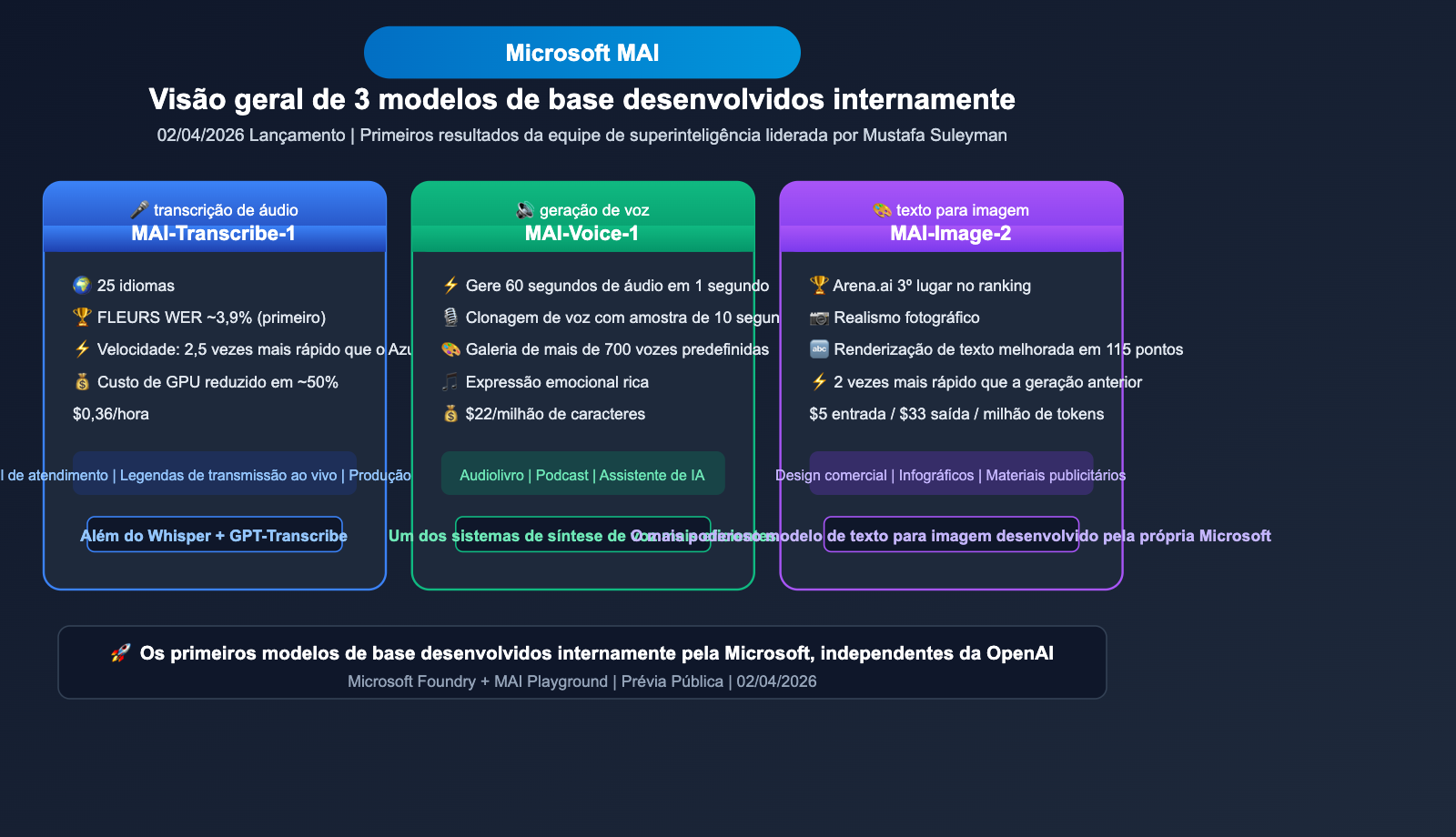

Em 2 de abril de 2026, a equipe de superinteligência MAI da Microsoft lançou oficialmente 3 modelos fundamentais desenvolvidos internamente: MAI-Transcribe-1 (transcrição de áudio), MAI-Voice-1 (geração de voz) e MAI-Image-2 (texto para imagem). Este é o primeiro grande lançamento de produto desde a formação da equipe MAI, liderada por Mustafa Suleyman, marcando o início da construção de capacidades de IA da Microsoft independentes da OpenAI.

Valor central: Entenda em 3 minutos os parâmetros técnicos, desempenho de referência, precificação de API e o impacto desses três novos modelos da Microsoft no setor de IA.

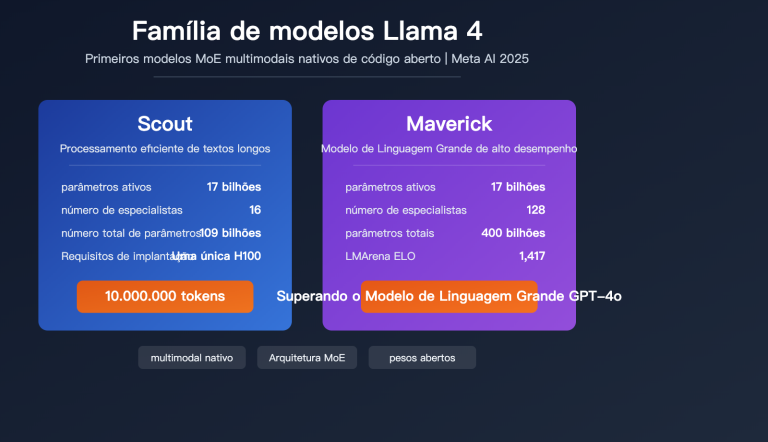

Visão geral rápida dos 3 novos modelos da Microsoft MAI

| Item de informação | Detalhes |

|---|---|

| Data de lançamento | 2 de abril de 2026 |

| Responsável | Equipe de Superinteligência MAI da Microsoft (CEO: Mustafa Suleyman) |

| Modelos lançados | MAI-Transcribe-1 / MAI-Voice-1 / MAI-Image-2 |

| Acesso à plataforma | Microsoft Foundry + MAI Playground |

| Significado estratégico | Primeiros modelos fundamentais multimodais desenvolvidos internamente pela Microsoft, reduzindo a dependência da OpenAI |

| Status atual | Visualização pública (Public Preview) |

Estes três modelos cobrem as áreas de reconhecimento de voz, geração de voz e geração de imagens, marcando o primeiro lançamento independente de modelos fundamentais competitivos pela Microsoft após a renegociação dos termos de parceria com a OpenAI.

Análise profunda do modelo de transcrição de voz MAI-Transcribe-1 da Microsoft

Parâmetros técnicos principais do MAI-Transcribe-1

O MAI-Transcribe-1 é o modelo de reconhecimento de voz mais poderoso da Microsoft até o momento, alcançando o primeiro lugar geral no benchmark FLEURS.

| Dimensão do parâmetro | MAI-Transcribe-1 |

|---|---|

| Idiomas suportados | 25 idiomas |

| WER no benchmark FLEURS | ~3,9% (1º lugar geral) |

| Velocidade de processamento | 2,5 vezes mais rápido que a solução Azure Fast |

| Custo de GPU | Cerca de 50% menor que os concorrentes |

| Preço da API | US$ 0,36/hora |

| Vantagem principal | Menor WER em 11 idiomas principais |

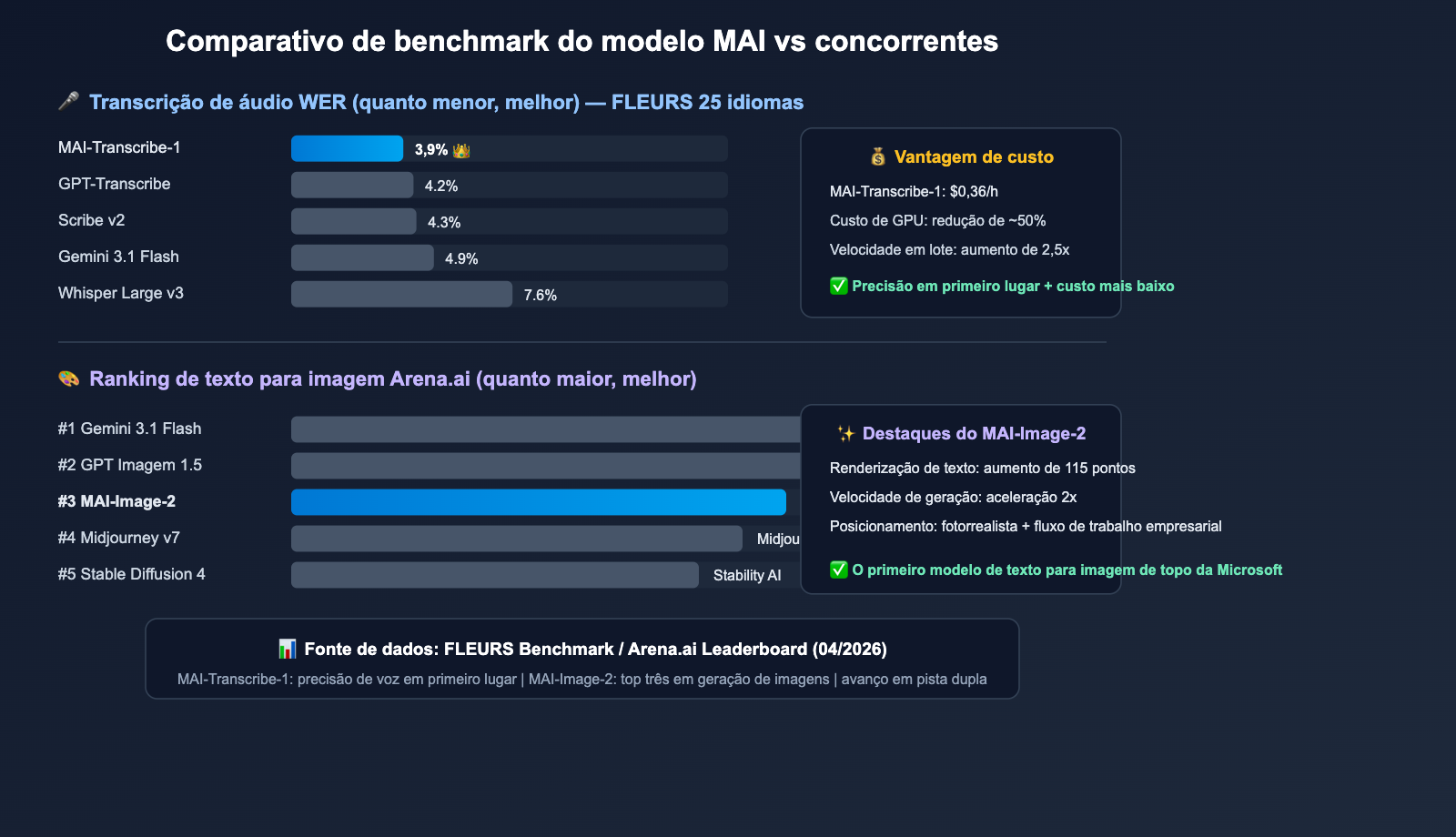

Comparação de WER do MAI-Transcribe-1 com concorrentes

No benchmark FLEURS de 25 idiomas, a taxa de erro de palavras (WER) do MAI-Transcribe-1 lidera em todos os aspectos:

| Modelo | FLEURS WER | Idiomas com vantagem | Referência de preço |

|---|---|---|---|

| MAI-Transcribe-1 | ~3,9% | 1º em 11/25 | US$ 0,36/hora |

| GPT-Transcribe (OpenAI) | ~4,2% | — | Cobrança por token |

| Scribe v2 (ElevenLabs) | ~4,3% | — | A partir de US$ 0,40/hora |

| Gemini 3.1 Flash | ~4,9% | — | Cobrança por token |

| Whisper Large v3 | ~7,6% | — | Código aberto gratuito |

As 5 principais vantagens do MAI-Transcribe-1

1. Precisão multilíngue de nível empresarial

O MAI-Transcribe-1 ocupa o primeiro lugar geral entre 25 idiomas, com o menor WER do setor em 11 idiomas principais (incluindo inglês, chinês, japonês, espanhol, etc.). Nos outros 14 idiomas, também supera o Whisper Large v3 e supera o Gemini 3.1 Flash em 11 deles.

2. Velocidade de processamento em lote 2,5 vezes maior

Comparado à solução de transcrição Azure Fast anterior da Microsoft, a velocidade de processamento em lote do MAI-Transcribe-1 aumentou 2,5 vezes. Isso significa um ganho de eficiência significativo para cenários como revisão de gravações de call center, geração em lote de atas de reuniões e produção de legendas de vídeo.

3. Redução de cerca de 50% no custo de GPU

Graças à otimização da arquitetura do modelo, o custo de inferência em GPU foi reduzido pela metade, mantendo a precisão de ponta. Isso reduz drasticamente o custo total de propriedade para tarefas de transcrição de voz em larga escala.

4. Ampla gama de cenários de aplicação

- Sistemas IVR: Transcrição em tempo real de resposta de voz interativa

- Call Centers: Transcrição e análise automática de conversas de atendimento ao cliente

- Legendas ao vivo: Geração de legendas em tempo real para eventos e reuniões

- Produção de vídeo: Geração automática de legendas para conteúdo de vídeo

- Pesquisa de mercado: Transcrição em lote de gravações de entrevistas

5. Preço de API competitivo

O preço de US$ 0,36/hora oferece uma vantagem competitiva clara em serviços de transcrição de voz corporativos, especialmente considerando seu desempenho superior de WER.

🎯 Dica para desenvolvedores: Para desenvolvedores que precisam integrar recursos de transcrição de voz em suas aplicações, o MAI-Transcribe-1 oferece acesso via API através do Microsoft Foundry. Se você precisar invocar vários modelos de IA simultaneamente (como transcrição de voz + geração de texto + geração de imagens), pode usar a plataforma APIYI (apiyi.com) para gerenciar centralizadamente as chamadas de API de diferentes fornecedores, simplificando a complexidade de engenharia da integração de múltiplos modelos.

MAI-Voice-1: Análise técnica do modelo de geração de voz da Microsoft

Parâmetros principais do MAI-Voice-1

O MAI-Voice-1 é um modelo de geração de voz de alta eficiência lançado pela Microsoft, cujo grande destaque é a sua performance extrema.

| Dimensão do parâmetro | MAI-Voice-1 |

|---|---|

| Eficiência de geração | Menos de 1 segundo para gerar 60 segundos de áudio em uma única GPU |

| Clonagem de voz | Criação de voz personalizada com apenas 10 segundos de amostra |

| Biblioteca de vozes | 700+ vozes pré-definidas disponíveis |

| Preço da API | $22 por milhão de caracteres |

| Integração | Azure Speech / Microsoft Foundry |

| Aplicações existentes | Recursos de áudio e podcast do Copilot |

Características técnicas do MAI-Voice-1

1. Eficiência de geração extrema

É possível gerar 60 segundos de voz de alta qualidade em menos de 1 segundo usando uma única GPU. Essa eficiência torna o MAI-Voice-1 um dos sistemas de síntese de voz mais rápidos da atualidade, sendo ideal para aplicações que exigem feedback de voz em tempo real.

2. Clonagem de voz em 10 segundos

O recurso Personal Voice permite que os usuários criem uma voz personalizada altamente realista com apenas 10 segundos de amostra de áudio. Vale lembrar que, para utilizar essa funcionalidade, é necessária a aprovação nos processos de IA responsável da Microsoft.

3. Galeria com mais de 700 vozes

Por meio da integração com o Azure Speech, os desenvolvedores têm acesso a mais de 700 vozes pré-definidas, abrangendo diversos idiomas, sotaques e estilos, atendendo às necessidades de diferentes cenários de uso.

4. Saída de voz expressiva

O MAI-Voice-1 não apenas gera uma fala clara, mas também simula nuances emocionais — incluindo variações de tom, ritmo de pausas e entonação, tornando a voz gerada muito mais natural e expressiva.

💡 Cenários de aplicação: O MAI-Voice-1 é especialmente adequado para a produção de audiolivros, geração automática de podcasts, respostas de voz para atendimento ao cliente e recursos de acessibilidade. Os desenvolvedores podem combinar o uso de Modelos de Linguagem Grandes para gerar o texto e, em seguida, convertê-lo em voz com o MAI-Voice-1, construindo um pipeline completo de assistente de voz por IA. Você pode acessar facilmente a etapa de geração de texto via LLM através da plataforma APIYI (apiyi.com).

MAI-Image-2: Detalhes do modelo de texto para imagem mais poderoso da Microsoft

Parâmetros principais do MAI-Image-2

O MAI-Image-2 é o primeiro modelo de texto para imagem desenvolvido internamente pela Microsoft que possui competitividade de alto nível nos rankings do setor.

| Dimensão do parâmetro | MAI-Image-2 |

|---|---|

| Ranking Arena.ai | 3º lugar (atrás apenas do Gemini 3.1 Flash e GPT Image 1.5) |

| Velocidade de geração | Mais de 2 vezes mais rápido que a geração anterior |

| Melhoria na renderização de texto | Aumento de 115 pontos em relação à geração anterior |

| Preço de entrada | $5/milhão de tokens |

| Preço de saída | $33/milhão de tokens |

| Vantagens principais | Realismo fotográfico, renderização de texto forte, precisão em layouts complexos |

Posição do MAI-Image-2 no ranking Arena.ai

| Ranking | Modelo | Fabricante | Vantagem principal |

|---|---|---|---|

| 1 | Gemini 3.1 Flash Image | O mais forte em multimodalidade abrangente | |

| 2 | GPT Image 1.5 | OpenAI | Liderança em diversidade criativa |

| 3 | MAI-Image-2 | Microsoft | Renderização de texto + realismo fotográfico |

| 4 | Midjourney v7 | Midjourney | Estilo artístico de destaque |

| 5 | Stable Diffusion 4 | Stability AI | Ecossistema open source |

4 destaques técnicos do MAI-Image-2

1. Realismo fotográfico

O MAI-Image-2 atingiu um novo patamar na geração de imagens com estilo fotográfico realista. Detalhes como efeitos de luz volumétrica, texturas de materiais e transições de luz e sombra aproximam-se do nível de fotos reais, sendo ideal para publicidade comercial e cenários de exibição de produtos.

2. Capacidade de renderização de texto significativamente aprimorada

Comparado ao modelo anterior, a capacidade de renderização de texto dentro da imagem do MAI-Image-2 aumentou em 115 pontos. Isso significa que, ao gerar infográficos, pôsteres, placas de sinalização e outras imagens que contêm elementos textuais, a clareza e a precisão do texto são notavelmente superiores.

3. Precisão no processamento de layouts complexos

Em tarefas de geração que envolvem múltiplos objetos, relações espaciais complexas e cenas detalhadas, o MAI-Image-2 demonstra uma precisão de composição superior à dos concorrentes, reduzindo problemas de sobreposição de objetos e desproporção.

4. Integração de fluxo de trabalho de nível empresarial

O WPP, maior grupo publicitário do mundo, já está utilizando o MAI-Image-2 em larga escala para produção criativa. A Microsoft posiciona este modelo como uma ferramenta de produtividade para designers e profissionais de marketing, com integração profunda ao ecossistema Microsoft 365.

🔧 Prática técnica: Em aplicações reais de geração de imagens por IA, os desenvolvedores geralmente precisam comparar os resultados de vários modelos. Através da plataforma APIYI (apiyi.com), é possível integrar de forma unificada APIs de diversos modelos de geração de imagens, como DALL-E e Stable Diffusion, facilitando a alternância rápida e a comparação de resultados entre diferentes modelos.

Estratégia MAI da Microsoft: O primeiro passo para romper a dependência da OpenAI

Por que a Microsoft quer desenvolver seus próprios modelos

A relação entre a Microsoft e a OpenAI está passando por mudanças sutis. O lançamento dos três modelos MAI é um sinal estratégico claro.

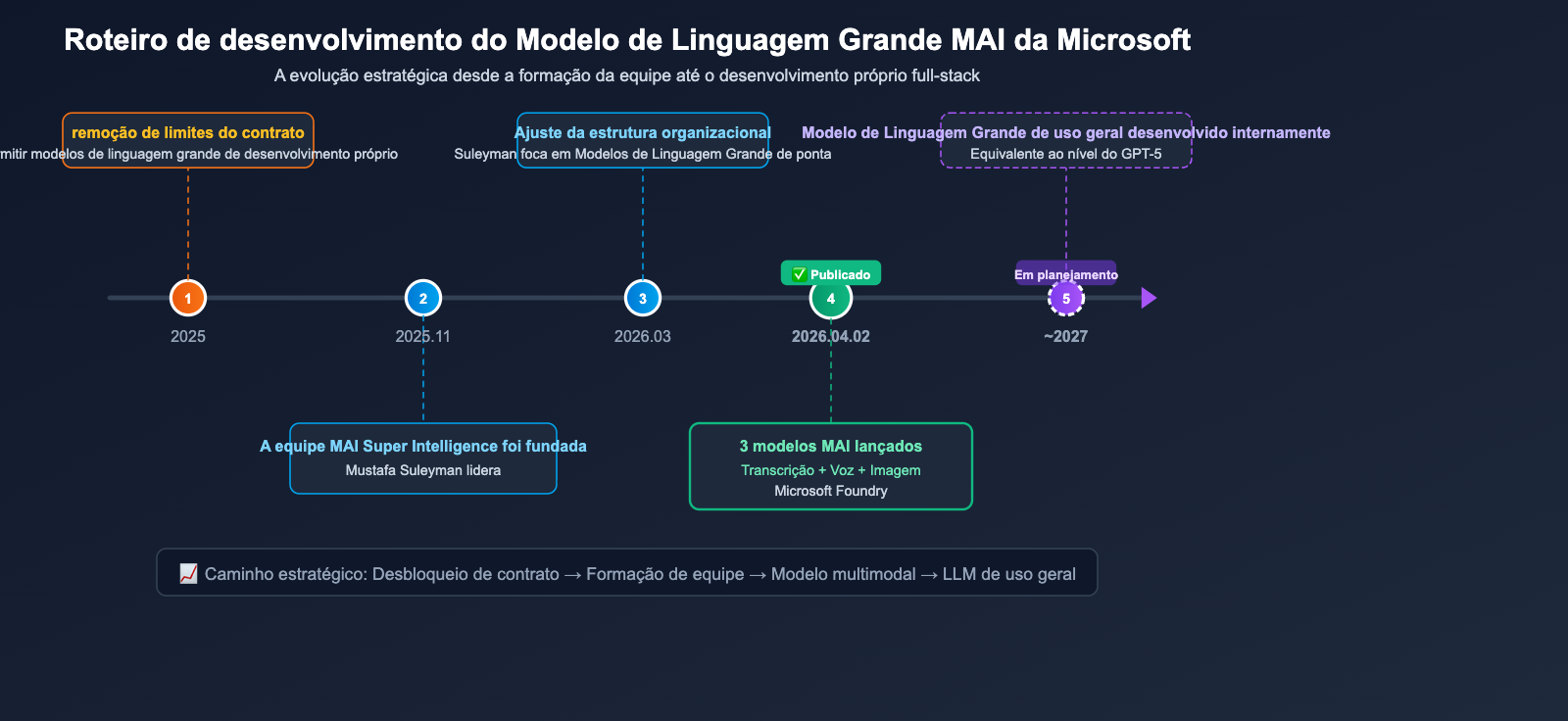

Linha do tempo fundamental:

- 2025: A Microsoft renegocia os termos de cooperação com a OpenAI, cancelando as restrições contratuais que limitavam a Microsoft a desenvolver seus próprios modelos de IA de uso geral.

- Novembro de 2025: Mustafa Suleyman forma a equipe de superinteligência MAI, focada na pesquisa e desenvolvimento de modelos de fronteira.

- Março de 2026: Satya Nadella anuncia ajustes na estrutura organizacional; Suleyman foca totalmente em modelos de fronteira, deixando de ser responsável pelas operações diárias do Copilot.

- 2 de abril de 2026: A equipe MAI lança os três primeiros modelos base desenvolvidos internamente.

- Meta para 2027: Planejamento do lançamento de um Modelo de Linguagem Grande de uso geral para competir no nível do GPT-5.

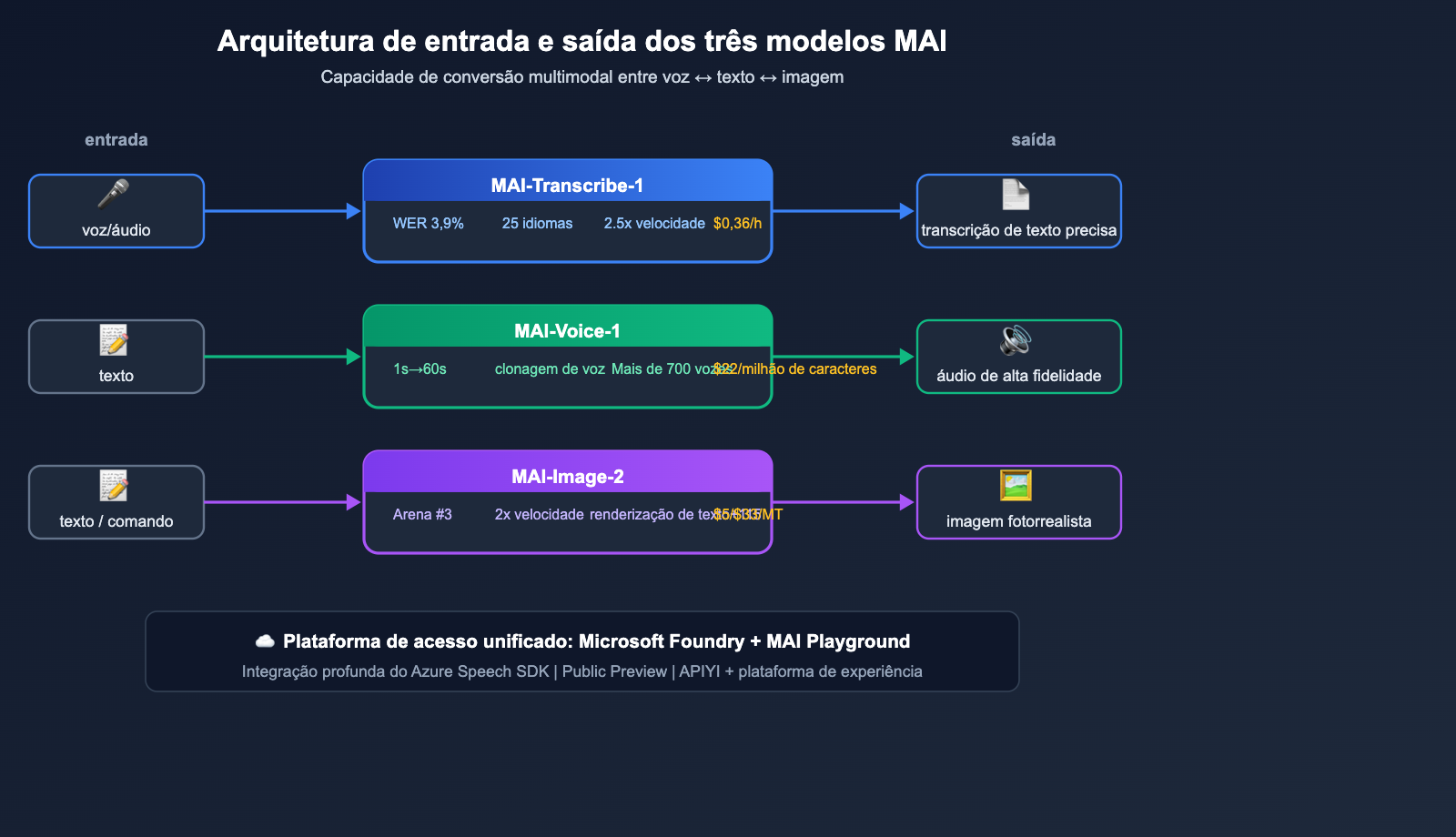

Status atual da matriz de modelos de IA da Microsoft

| Categoria do modelo | Fornecido pela OpenAI | Desenvolvido pela Microsoft (MAI) |

|---|---|---|

| LLM de uso geral | GPT-5.4 (Núcleo do Copilot) | Em planejamento (2027) |

| Reconhecimento de voz | Whisper / GPT-Transcribe | MAI-Transcribe-1 ✅ |

| Geração de voz | — | MAI-Voice-1 ✅ |

| Texto para imagem | DALL-E 3 | MAI-Image-2 ✅ |

| Modelo de código | Codex | Em planejamento |

O que isso significa para os desenvolvedores

A Microsoft está construindo um sistema de fornecimento de modelos de IA de "trilho duplo": por um lado, continua usando o LLM de uso geral da OpenAI (GPT-5.4) e, por outro, lança alternativas próprias nas áreas de voz e imagem. Isso significa que os desenvolvedores terão mais opções dentro do ecossistema da Microsoft.

🎯 Insight do setor: O lançamento dos modelos desenvolvidos pela Microsoft significa que a concorrência no mercado de modelos de IA se intensificará ainda mais. Para os desenvolvedores, escolher qual modelo usar e por qual canal integrar torna-se ainda mais crucial. Através da plataforma APIYI (apiyi.com), é possível integrar de forma unificada as APIs de modelos de IA de vários fabricantes, permitindo alternar modelos subjacentes de forma flexível sem modificar o código, lidando assim com o cenário de mercado em rápida mudança.

Precificação e Acesso à API dos Modelos Microsoft MAI

Visão geral da precificação dos três modelos

| Modelo | Método de cobrança | Preço | Plataforma de acesso |

|---|---|---|---|

| MAI-Transcribe-1 | Por duração de áudio | $0,36/hora | Microsoft Foundry / Azure Speech |

| MAI-Voice-1 | Por número de caracteres | $22/milhão de caracteres | Microsoft Foundry / Azure Speech |

| MAI-Image-2 | Por número de Tokens | Entrada $5/milhão + Saída $33/milhão de Tokens | Microsoft Foundry |

Formas de acesso

Opção 1: Microsoft Foundry

Todos os três modelos estão disponíveis para acesso via API em visualização pública através da plataforma de desenvolvedores Microsoft Foundry. Os desenvolvedores podem realizar a invocação do modelo diretamente pelos endpoints de API do Foundry.

Opção 2: MAI Playground

O MAI Playground é a nova plataforma de experimentação de modelos da Microsoft, onde os desenvolvedores podem testar gratuitamente as capacidades do MAI-Transcribe-1 e do MAI-Voice-1, avaliando rapidamente se atendem aos seus cenários de aplicação.

Opção 3: Integração com Azure Speech

O MAI-Transcribe-1 e o MAI-Voice-1 estão profundamente integrados ao serviço Azure Speech, permitindo que usuários atuais do Azure realizem a invocação do modelo diretamente pelo SDK do Azure Speech.

💰 Otimização de custos: Ao construir aplicações de IA multimodal, a transcrição de voz, a geração de texto e a geração de imagens geralmente exigem a combinação de modelos de diferentes fornecedores. Através da plataforma APIYI apiyi.com, você pode gerenciar centralmente suas chaves API e o uso, evitando os custos administrativos de se registrar em várias plataformas separadamente. A plataforma suporta a integração de modelos de diversos fornecedores, incluindo Microsoft, OpenAI, Anthropic, Alibaba Cloud e outros.

Análise do impacto dos modelos Microsoft MAI na indústria de IA

Impacto no mercado de modelos de IA

1. Mudança no cenário de reconhecimento de voz

O MAI-Transcribe-1 desafia diretamente o GPT-Transcribe da OpenAI (4,2%) e o Scribe v2 da ElevenLabs (4,3%) com uma taxa de erro de palavra (WER) de ~3,9%. Somado a uma vantagem de custo de 50%, ele tem potencial para conquistar rapidamente uma fatia do mercado corporativo de transcrição de voz.

2. Intensificação da disputa no mercado de texto para imagem

O MAI-Image-2 alcançou o top 3 do Arena.ai, consolidando um cenário de três grandes competidores no segmento de texto para imagem: Google (Gemini 3.1 Flash), OpenAI (GPT Image 1.5) e Microsoft (MAI-Image-2). Isso coloca uma pressão ainda maior sobre fabricantes independentes como Midjourney e Stability AI.

3. A tendência da "autopesquisa full-stack" entre gigantes da IA

Seguindo os passos do Google (série Gemini) e da Meta (série Llama), a Microsoft também começou a construir capacidades de Modelo de Linguagem Grande full-stack. Isso significa que a concorrência no mercado de IA será cada vez mais concentrada entre poucos grandes players.

Impacto para os desenvolvedores

- Mais opções de modelos: O ecossistema da Microsoft não se limita mais apenas à OpenAI.

- Concorrência de preços acirrada: A competição entre múltiplos fornecedores impulsionará a queda dos preços das APIs.

- Uso combinado de múltiplos modelos: Os desenvolvedores precisam aprender a escolher de forma flexível os modelos de diferentes fornecedores de acordo com cada cenário.

🚀 Dica de desenvolvimento: Diante do rápido crescimento das opções de modelos de IA, recomendamos que os desenvolvedores utilizem plataformas de acesso unificado, como a APIYI apiyi.com, para gerenciar a invocação do modelo e evitar o aprisionamento tecnológico (vendor lock-in) por um único fornecedor. A plataforma oferece um formato de interface padrão compatível com OpenAI; para trocar de modelo, basta alterar o parâmetro

model.

Perguntas frequentes sobre os modelos MAI da Microsoft

Q1: Qual é a relação entre os modelos MAI e os modelos da OpenAI?

Os modelos MAI foram desenvolvidos de forma independente pela equipe de superinteligência MAI da Microsoft e não têm relação com a OpenAI. Atualmente, a Microsoft adota uma estratégia de "trilha dupla": os Modelos de Linguagem Grande (LLM) de uso geral continuam utilizando o GPT-5.4 da OpenAI, enquanto a série MAI, desenvolvida internamente, é focada em voz e imagem. Após a renegociação entre a Microsoft e a OpenAI em 2025, as cláusulas contratuais que restringiam o desenvolvimento de modelos próprios pela Microsoft foram removidas.

Q2: O MAI-Transcribe-1 é muito melhor que o Whisper?

No benchmark de 25 idiomas FLEURS, o MAI-Transcribe-1 apresenta uma taxa de erro de palavras (WER) de aproximadamente 3,9%, enquanto o Whisper Large v3 fica em torno de 7,6%, o que mostra uma diferença clara de precisão. Além disso, a velocidade de processamento em lote do MAI-Transcribe-1 é 2,5 vezes superior à solução Azure Fast, com uma redução de cerca de 50% nos custos de GPU. No entanto, a vantagem do Whisper reside no fato de ser código aberto e gratuito, sendo ideal para cenários extremamente sensíveis a custos.

Q3: O MAI-Image-2 pode substituir o DALL-E?

Com base no ranking do Arena.ai, o MAI-Image-2 (3º lugar) ocupa uma posição geral superior à do DALL-E 3. Ele se destaca especialmente na renderização de textos e no fotorrealismo. Contudo, o DALL-E ainda mantém um desempenho único em certos estilos criativos. Para usuários corporativos, a integração profunda do MAI-Image-2 com o ecossistema da Microsoft pode ser um diferencial ainda mais atrativo.

Q4: Como experimentar rapidamente estes três modelos MAI?

A maneira mais rápida é acessar o MAI Playground (a nova plataforma de experimentação de modelos da Microsoft) para testes gratuitos. O acesso oficial via API deve ser feito através da plataforma de desenvolvedores Microsoft Foundry. Se a sua aplicação precisa realizar a invocação do modelo de várias fontes simultaneamente, você pode usar a plataforma APIYI (apiyi.com) para gerenciar centralizadamente o acesso às chaves API de diferentes fornecedores, simplificando o seu fluxo de desenvolvimento.

Q5: Quando a Microsoft planeja lançar seu próprio Modelo de Linguagem Grande de uso geral?

De acordo com informações públicas, a Microsoft está implantando clusters de chips Nvidia GB200 e planeja construir uma capacidade computacional de ponta nos próximos 12 a 18 meses. A previsão é que, por volta de 2027, seja lançado um Modelo de Linguagem Grande de uso geral desenvolvido internamente, capaz de competir com o nível do GPT-5. Até lá, o LLM principal do Copilot continuará utilizando o GPT-5.4 da OpenAI.

Resumo dos 3 novos modelos da Microsoft MAI

A equipe MAI da Microsoft entregou resultados impressionantes em apenas 5 meses de existência:

- MAI-Transcribe-1: Primeiro lugar no benchmark FLEURS em WER (~3,9%), com um aumento de 2,5x na velocidade, redução de 50% nos custos e preço de US$ 0,36/hora.

- MAI-Voice-1: Gera 60 segundos de áudio em menos de 1 segundo utilizando uma única GPU, suporta clonagem de voz de 10 segundos e conta com mais de 700 vozes pré-definidas.

- MAI-Image-2: 3º lugar no ranking de texto para imagem da Arena.ai, com uma melhoria de 115 pontos na renderização de texto, suportando layouts complexos e fotorrealismo.

O lançamento desses três modelos não apenas demonstra a capacidade de pesquisa e desenvolvimento da Microsoft, mas também sinaliza que a tendência de "desenvolvimento full-stack por gigantes" no setor de IA está se acelerando. Para os desenvolvedores, as opções de modelos estão cada vez mais numerosas; utilizar plataformas de acesso unificado como a APIYI (apiyi.com) para gerenciar a invocação do modelo de múltiplos fornecedores será uma estratégia fundamental para aumentar a eficiência do desenvolvimento e reduzir os custos de troca.

📝 Autor: Equipe APIYI | Para mais análises técnicas de modelos de IA e guias de acesso via API, visite a Central de Ajuda da APIYI: help.apiyi.com