Em 14 de abril de 2026, a OpenAI lançou oficialmente o GPT-5.4-Cyber, uma variante ajustada do GPT-5.4 com foco em "cyber-permissive" (cibersegurança permissiva), projetada especificamente para trabalhos de cibersegurança defensiva. A maior diferença em relação ao modelo comum de consumo é que ele reduz o limiar de recusa para tarefas relacionadas à pesquisa de segurança e, pela primeira vez, oferece suporte público à capacidade de engenharia reversa binária — permitindo analisar arquivos executáveis compilados sem a necessidade de código-fonte para identificar vulnerabilidades e códigos maliciosos.

Este modelo é disponibilizado apenas para pesquisadores de segurança e instituições que possuem a certificação de nível mais alto do programa Trusted Access for Cyber da OpenAI, não sendo uma API pública para desenvolvedores comuns. O momento do lançamento também é digno de nota: aconteceu exatamente uma semana após o produto equivalente da Anthropic, o Claude Mythos, indicando que a disputa entre as duas empresas no novo setor de "IA × Cibersegurança" está esquentando.

O que é o GPT-5.4-Cyber? Um resumo rápido

Deixando de lado os detalhes técnicos por um momento, aqui está uma tabela para você entender os pontos principais deste lançamento em 30 segundos:

| Dimensão | Fato |

|---|---|

| Data de lançamento | 14 de abril de 2026 |

| Desenvolvedor | OpenAI |

| Posicionamento do modelo | Variante ajustada do GPT-5.4 com "cibersegurança permissiva" |

| Objetivo principal | Trabalhos de cibersegurança defensiva |

| Nova capacidade principal | Engenharia reversa binária (sem necessidade de código-fonte) |

| Forma de acesso | Certificação de nível mais alto no programa Trusted Access for Cyber |

| Acesso individual | chatgpt.com/cyber (verificação de identidade por documento) |

| Acesso empresarial | Solicitação via representante de clientes da OpenAI |

| Escala de cobertura | Milhares de defensores individuais, centenas de equipes de segurança |

| Precificação | Não revelada oficialmente |

| Principal concorrente | Anthropic Claude Mythos (lançado uma semana antes) |

Este modelo é diferente de qualquer GPT que os desenvolvedores conheciam até hoje — ele não foi feito para conversar, escrever código ou servir como assistente comum, mas sim como uma "chave de conformidade" para pesquisadores de segurança, permitindo desbloquear cenários específicos que, por restrições de segurança, o GPT-5.4 comum se recusaria a responder.

📌 Conclusão em uma frase: O GPT-5.4-Cyber é uma porta estreita aberta pela OpenAI para o grupo de "pesquisadores de segurança de alto nível", não sendo um modelo público para desenvolvedores comuns. Mais adiante neste artigo, responderemos à questão crucial: "É possível acessá-lo via plataformas de API de terceiros?".

Análise das cinco capacidades principais do GPT-5.4-Cyber

De acordo com as declarações oficiais da OpenAI e relatórios de terceiros, as diferenças entre este modelo e o GPT-5.4 comum concentram-se em cinco dimensões.

Capacidade 1: Estratégia de segurança flexível (cyber-permissive)

Esta é a filosofia central de todo o modelo. Ao ser treinado, o GPT-5.4 comum recusa por padrão solicitações que "pareçam ataques maliciosos ou explorações de vulnerabilidades". Essa estratégia de "prevenir em vez de remediar" protege o usuário comum, mas causa transtornos enormes para pesquisadores de segurança legítimos, que frequentemente são barrados pela mensagem "sinto muito, não posso ajudá-lo com isso" ao realizar testes de penetração, pesquisas de vulnerabilidades ou análise de código malicioso.

O GPT-5.4-Cyber abaixa essa barreira especificamente para "pesquisadores de segurança autenticados", permitindo a análise aprofundada de conceitos de exploração de vulnerabilidades, a discussão de princípios de exploit e a assistência na criação de PoCs — cenários que as versões comuns se recusam a processar.

Capacidade 2: Engenharia reversa de binários

Esta é a nova capacidade com maior conteúdo técnico deste lançamento. Tradicionalmente, a engenharia reversa de binários depende de ferramentas profissionais como IDA Pro, Ghidra ou Binary Ninja, combinadas com a análise manual de pesquisadores de segurança. O GPT-5.4-Cyber consegue analisar diretamente arquivos binários compilados, sendo capaz de:

- Identificar vulnerabilidades potenciais na ausência de código-fonte (transbordamento de buffer, strings de formatação, UAF, etc.)

- Analisar o comportamento de amostras maliciosas (comunicação C2, persistência, anti-depuração)

- Reconstruir a lógica de fluxo de controle de arquivos executáveis

- Auxiliar na geração ou validação de regras YARA

Isso significa que as equipes de segurança podem delegar a triagem inicial para a IA, permitindo que os pesquisadores humanos foquem nas partes mais complexas.

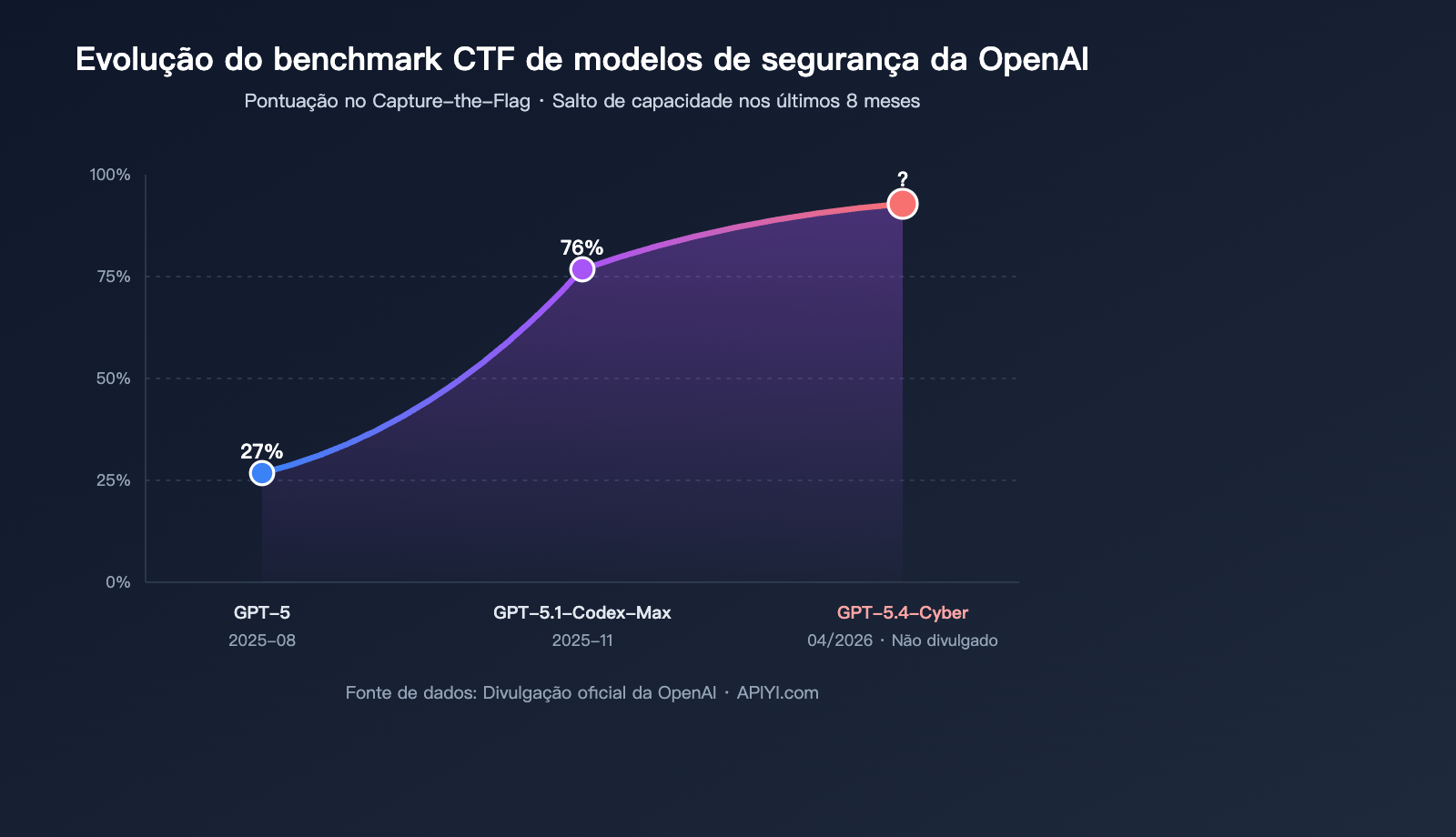

Capacidade 3: Salto rápido no benchmark CTF

A OpenAI divulgou em seus materiais de lançamento um conjunto de dados de desempenho com valor de referência, refletindo a evolução do modelo em cenários de segurança cibernética:

- GPT-5 (agosto de 2025) pontuação no benchmark Capture-the-Flag: 27%

- GPT-5.1-Codex-Max (novembro de 2025) pontuação no benchmark CTF: 76%

Embora a pontuação específica do GPT-5.4-Cyber no CTF não tenha sido divulgada, esta curva demonstra que a OpenAI investiu recursos significativos em treinamento e alinhamento de capacidades de segurança durante o último ano.

Capacidade 4: Redução do limiar de recusa (Refusal Boundary)

Os filtros de segurança do GPT tradicional apresentam uma taxa de erro de recusa muito alta em contextos de pesquisa de segurança. A decisão estratégica de produto para o GPT-5.4-Cyber foi: delegar o controle do limiar de recusa aos resultados da "verificação de identidade". Entre os grupos de usuários autenticados, o modelo utilizará uma escala mais apropriada para lidar com tópicos de segurança — sem se transformar em um "GPT com jailbreak", nem agir como a versão comum, que recusa qualquer palavra de risco de forma genérica.

Por trás disso, existe uma cadeia de confiança de identidade completa: verificação de documento de identificação (Persona) → autenticação em camadas de Acesso Confiável (Trusted Access) → ajuste da estratégia de resposta do modelo conforme o nível de autenticação.

Capacidade 5: Foco defensivo (Defensive Only)

A OpenAI enfatiza repetidamente em todos os seus materiais de divulgação a "cibersegurança defensiva" em vez da "ofensiva". Trata-se de um posicionamento político deliberado: o modelo é destinado aos defensores (times azuis, fabricantes de segurança, instituições de pesquisa) e não aos atacantes. Esse posicionamento determina que a auditoria de acesso será extremamente rigorosa — falaremos disso mais à frente.

| Dimensão da capacidade | GPT-5.4 comum | GPT-5.4-Cyber |

|---|---|---|

| Rigor da estratégia de segurança | Alto (recusa padrão de solicitações de risco) | Liberação controlada (baseada em nível de autenticação) |

| Engenharia reversa de binários | Suporte limitado | Suporte profundo (principal diferencial) |

| Discussão sobre princípios de exploits | Recusa na maioria dos casos | Discussão aprofundada após autenticação |

| Análise de amostras maliciosas | Descrição superficial | Auxílio na análise completa |

| Barreiras de acesso | API paga pública | Requer Trusted Access de nível superior |

| Público-alvo | Todos os desenvolvedores | Pesquisadores de segurança autenticados |

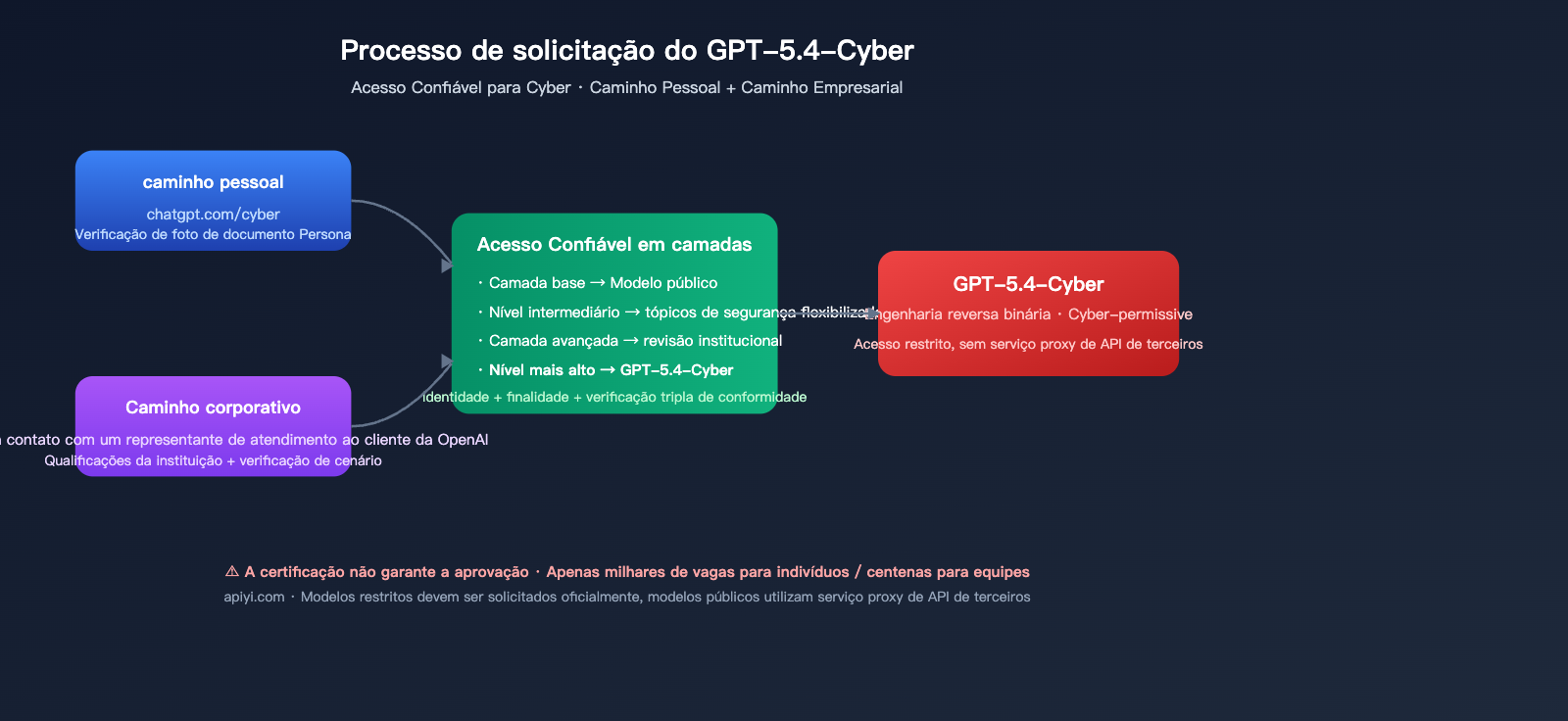

Como solicitar o GPT-5.4-Cyber? Níveis de Trusted Access e processos

Trusted Access for Cyber é um projeto iniciado pela OpenAI em fevereiro de 2026, que incluiu também o lançamento de um fundo de financiamento de 10 milhões de dólares para cibersegurança. A atualização de 14 de abril trouxe como principal novidade a expansão daquele "acesso ou recusa" básico para um acesso em camadas, vinculando a qualificação de nível mais alto ao GPT-5.4-Cyber.

Comparativo de autenticação em camadas

| Camada | Público-alvo | Capacidades disponíveis | Forma de verificação |

|---|---|---|---|

| Base | Usuários registrados do ChatGPT | GPT-5.4 comum e outros modelos públicos | Conta convencional |

| Intermediária | Profissionais de segurança autenticados | Menos restrições para tópicos de segurança | Fotos de documentos (Persona) |

| Avançada | Equipes e instituições de segurança autenticadas | Processamento de tarefas de segurança mais flexível | Dupla verificação (institucional + pessoal) |

| Superior | Pesquisadores essenciais de instituições certificadas pelo Trusted Access | Possibilidade de solicitar o GPT-5.4-Cyber | Requer auditoria da OpenAI |

Processo de solicitação individual

- Acesse

chatgpt.com/cyber - Utilize o serviço de verificação de identidade Persona para enviar uma foto do documento de identidade oficial

- O sistema determina o nível de autenticação

- Se possuir o nível superior, é possível solicitar a inclusão na lista de espera para o GPT-5.4-Cyber

Processo de solicitação empresarial

- Entre em contato com o representante de contas da OpenAI na sua empresa

- Submeta o histórico da equipe, a descrição dos casos de uso e o compromisso de conformidade

- Após aprovação, habilite o nível superior de Trusted Access para membros específicos no ambiente de trabalho

- O membro solicita o acesso ao GPT-5.4-Cyber dentro do ambiente de trabalho

⚠️ Nota: A OpenAI esclareceu que expandirá o acesso com muita cautela no início e que, mesmo após a conclusão da verificação de identidade, não há garantia de que o acesso ao GPT-5.4-Cyber será concedido. A meta de cobertura é de "milhares de defensores individuais e centenas de equipes de segurança", um recurso bastante escasso quando comparado à escala da indústria global de segurança.

É possível invocar o GPT-5.4-Cyber através de plataformas de API de terceiros? A resposta honesta

Esta é a pergunta que mais preocupa muitos leitores. Com base no design de produto atual divulgado pela OpenAI, aqui está uma resposta sem rodeios.

🚨 Conclusão atual: Não é possível

O acesso ao GPT-5.4-Cyber está profundamente vinculado à identidade da conta OpenAI e não é fornecido através de canais de API convencionais. Isso significa que:

- ❌ Não pode ser disponibilizado ao público ou desenvolvedores em geral através da API oficial da OpenAI.

- ❌ Não pode ser invocado através de qualquer plataforma de serviço proxy de API de terceiros, como a APIYI (apiyi.com).

- ❌ Não pode ser obtido através da compra de uma chave API, pois trata-se de uma "credencial de identidade" e não de uma "credencial de pagamento".

- ✅ Somente pode ser utilizado através de contas com a certificação de nível mais alto "Trusted Access for Cyber" no ChatGPT ou em espaços de trabalho corporativos exclusivos.

Isso é determinado pelo posicionamento do produto: se o GPT-5.4-Cyber pudesse contornar a verificação de identidade e ser acessado via proxy de API, sua característica "cyber-permissive" se tornaria imediatamente um alvo para abuso por parte de atacantes. A OpenAI bloqueou esse caminho desde o design.

Comparação de alternativas disponíveis

Para desenvolvedores e pesquisadores com diferentes necessidades, sugerimos os seguintes caminhos realistas:

| Sua necessidade | Solução recomendada |

|---|---|

| Sou um pesquisador de segurança de alto nível e preciso das capacidades originais do GPT-5.4-Cyber | Solicite via chatgpt.com/cyber, não utilize nenhum proxy |

| Preciso de uma versão comum do GPT-5.4 para desenvolvimento de IA geral | Invoque o GPT-5.4 através da interface unificada da APIYI (apiyi.com) |

| Desenvolvo scripts de auxílio à segurança, mas não sou o público-alvo do GPT-5.4-Cyber | Invoque modelos públicos como GPT-5 / GPT-5.4 / Claude via APIYI |

| Só quero aprender sobre segurança e fazer análises não sensíveis | O GPT-5.4 comum é suficiente; qualquer plataforma de API pública serve |

💡 Lembrete honesto importante: A APIYI (apiyi.com) não oferece a invocação do GPT-5.4-Cyber. Isso é determinado pela estratégia de lançamento restrito da OpenAI, não sendo uma escolha comercial da APIYI. Se no futuro alguma plataforma de terceiros alegar que "pode invocar o GPT-5.4-Cyber", é muito provável que seja um serviço cinzento que viola os termos de uso da OpenAI ou que até mesmo envolva falsificação de identidade. Por favor, tenha cautela.

O que a APIYI pode fazer por você?

Para a grande maioria dos cenários que não envolvem o GPT-5.4-Cyber, a APIYI (apiyi.com) ainda pode te ajudar:

from openai import OpenAI

client = OpenAI(

api_key="SUA-CHAVE-APIYI",

base_url="https://api.apiyi.com/v1"

)

# Tanto o GPT-5.4 comum quanto o GPT-5 podem ser invocados

response = client.chat.completions.create(

model="gpt-5.4",

messages=[

{"role": "user", "content": "Ajude-me a analisar os riscos de SQL injection neste código"}

]

)

print(response.choices[0].message.content)

O código acima pode ser executado de forma estável na interface unificada da APIYI, correspondendo ao GPT-5.4 versão pública, e não ao GPT-5.4-Cyber. É perfeitamente adequado para revisões de código convencionais, geração de documentos e integração de negócios.

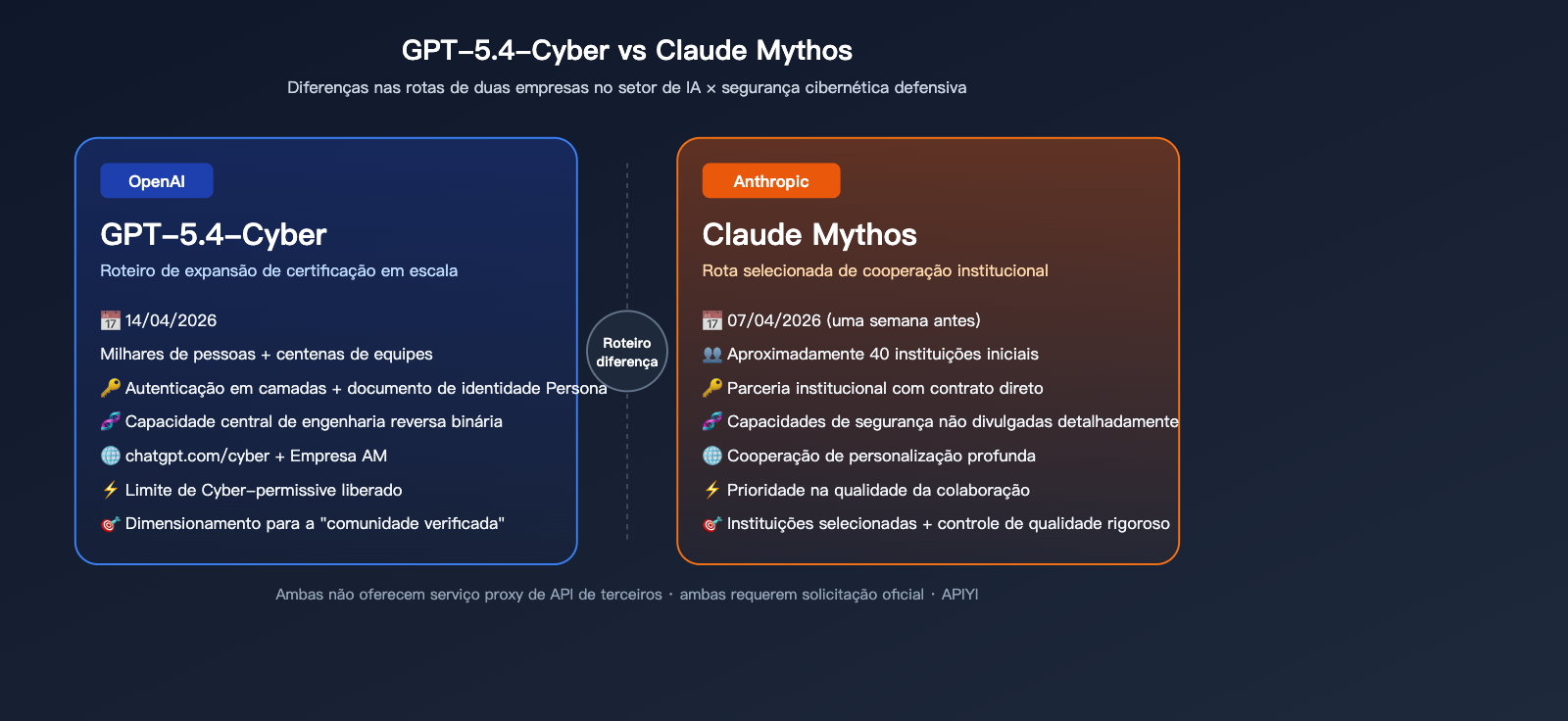

GPT-5.4-Cyber vs Anthropic Claude Mythos: Diferenças de estratégia

O Claude Mythos foi lançado uma semana antes do GPT-5.4-Cyber, e ambos representam duas rotas distintas de "IA × Segurança Cibernética Defensiva".

| Dimensão de comparação | OpenAI GPT-5.4-Cyber | Anthropic Claude Mythos |

|---|---|---|

| Data de lançamento | 14/04/2026 | 07/04/2026 (aprox. uma semana antes) |

| Modelo base | Variante ajustada do GPT-5.4 | Variante do Claude |

| Estratégia de acesso | Acesso em camadas, nível máximo sob solicitação | Sistema de instituições parceiras profundas |

| Escala inicial | Milhares de indivíduos + centenas de equipes | Aprox. 40 instituições |

| Diferencial principal | Engenharia reversa binária + cyber-permissive | Não divulgado detalhadamente |

| Canais de distribuição | chatgpt.com/cyber + AM corporativo | Parcerias institucionais |

| Tendência estratégica | Escala ampliada para "comunidade certificada" | Modelo selecionado de cooperação profunda |

Podemos ver que as escolhas de caminho das duas empresas são completamente diferentes: a OpenAI escolhe o modelo de escala de "verificação como acesso", esperando beneficiar o maior número possível de profissionais de segurança certificados; a Anthropic escolhe o modelo selecionado de "cooperação institucional", sacrificando a escala de cobertura em troca de um controle de qualidade mais rigoroso. A longo prazo, ambas as rotas têm seus mercados — é muito provável que coexistam por muitos anos.

Análise de impacto para a indústria e desenvolvedores

Impacto 1: O papel da IA na cadeia de ferramentas de segurança foi "oficializado"

No passado, pesquisadores de segurança usavam o ChatGPT para revisão de código e análise de vulnerabilidades "por conta própria", sendo frequentemente bloqueados por políticas de segurança. O lançamento do GPT-5.4-Cyber significa que, pela primeira vez, a OpenAI trata os "pesquisadores de segurança" como um grupo de usuários independente. No futuro, veremos cada vez mais modelos verticais específicos para a indústria.

Impacto 2: Autenticação de identidade + desbloqueio de capacidades torna-se um novo paradigma

O GPT-5.4-Cyber utiliza verificação de identidade via Persona e acesso em camadas para desbloquear capacidades, um modelo de produto que ainda é bastante inovador em produtos de IA de uso geral. No futuro, em cenários altamente regulamentados como finanças, saúde e direito, podemos esperar o surgimento de mais combinações de "identidade + camadas de capacidade do modelo".

Impacto 3: O posicionamento de plataformas de API de terceiros torna-se mais claro

Para plataformas de API unificadas de terceiros como a APIYI (apiyi.com), o caso do GPT-5.4-Cyber traçou, na verdade, uma linha divisória: modelos com acesso restrito seguem via conexão oficial, enquanto modelos públicos são atendidos por plataformas de serviço proxy de API para garantir a conveniência do desenvolvedor. Os dois mercados são complementares, não concorrentes.

Impacto 4: Aumento real na eficiência da equipe azul (Blue Team)

Se a capacidade de engenharia reversa de binários do GPT-5.4-Cyber for tão madura quanto a oficial alega, a eficiência das equipes azuis em tarefas como análise de amostras maliciosas, auditoria de firmware e análise de Patch Diff terá um salto de magnitude. Isso é uma ótima notícia para toda a indústria.

FAQ – Perguntas Frequentes

Q1: Desenvolvedores individuais têm chance de usar o GPT-5.4-Cyber?

Se você é um pesquisador de segurança registrado com cenários de negócios claros, passando pela verificação de identidade Persona para atingir o nível mais alto do Trusted Access, há uma chance. Se você está apenas curioso e quer testar o modelo, basicamente não há chance. Sugerimos que desenvolvedores comuns foquem no GPT-5.4 de acesso público, que pode ser acessado de forma estável através da interface unificada da APIYI (apiyi.com).

Q2: É possível contornar as restrições via VPN ou falsificação de identidade?

Não recomendamos e não faça isso. Uma vez detectada a falsificação de identidade ou uso indevido, a conta será banida diretamente e isso pode afetar a elegibilidade de acesso de toda a sua instituição. O controle de risco do Trusted Access é muito rigoroso.

Q3: Existem informações sobre preços?

A OpenAI não divulgou publicamente os preços do GPT-5.4-Cyber. Seguindo a prática da indústria, modelos verticais altamente restritos provavelmente são fornecidos via contratos corporativos ou assinaturas por assento, não através da cobrança por token (per-token) das APIs comuns.

Q4: Posso usar o GPT-5.4-Cyber para realizar ataques?

Tanto pelo design quanto pelos termos de uso, isso não é permitido. O posicionamento do modelo é para "cibersegurança defensiva"; violar os termos resultará em banimento da conta e riscos legais. O Trusted Access da OpenAI exigirá que você assine um compromisso de normas de uso.

Q5: Quando a APIYI (apiyi.com) disponibilizará o GPT-5.4-Cyber?

A previsão é que não seja disponibilizado, pois o mecanismo de distribuição do modelo foi projetado para excluir proxies de terceiros. A APIYI continuará expandindo o suporte para o GPT-5, GPT-5.4, série o, Claude e outros modelos de lançamento público, cobrindo as necessidades diárias da maioria dos desenvolvedores.

Q6: Qual a relação entre o GPT-5.4-Cyber, o Codex e a série o?

Os três são linhas de produtos da OpenAI, mas com posicionamentos diferentes: o Codex é voltado para geração de código, a série o para raciocínio profundo e o GPT-5.4-Cyber é uma variante ajustada para cenários de segurança. As capacidades podem se sobrepor, mas os mecanismos de acesso são completamente diferentes.

Q7: Como pequenas e médias equipes de segurança podem se candidatar?

Através dos representantes de clientes da OpenAI (ou canais comerciais), enviando qualificações da equipe, cenários de uso e compromissos de conformidade. Inicialmente, a OpenAI priorizará instituições com qualificações claras e propósitos de uso definidos. Pequenas equipes sem canais diretos devem acumular materiais de conformidade antes de se candidatar.

Q8: Empresas na China podem usar?

Os serviços da OpenAI estão sujeitos a restrições geográficas, e a conexão direta de entidades chinesas apresenta problemas de conformidade e disponibilidade. Se o objetivo é apenas usar o GPT-5.4 comum para construir capacidades de IA, você pode usar a interface acessível da APIYI (apiyi.com); para capacidades altamente sensíveis como o GPT-5.4-Cyber, recomenda-se contatar os negócios internacionais da OpenAI através de canais de conformidade.

Resumo: Um modelo "de nicho, mas com impacto gigantesco"

Voltando à pergunta inicial: o que o GPT-5.4-Cyber realmente significa?

- Para pesquisadores de segurança: É uma chave certificada oficialmente, capaz de desbloquear tarefas de análise que modelos comuns não conseguem, especialmente em engenharia reversa de binários, o que mudará substancialmente o fluxo de trabalho diário das equipes de defesa (Blue Teams).

- Para desenvolvedores comuns: É muito provável que você não precise deste modelo, mas não entre em pânico — a versão pública do GPT-5.4 já é suficiente para cobrir 95% das necessidades diárias de desenvolvimento com IA, e você pode acessá-la de forma estável e conveniente através da APIYI apiyi.com.

- Para a indústria: O modelo de produto baseado em autenticação de identidade + acesso em camadas será adotado por mais cenários verticais; a divisão de trabalho entre plataformas de API de terceiros e modelos restritos oficiais ficará cada vez mais clara.

- Para o cenário competitivo: O confronto direto entre OpenAI e Anthropic no campo de modelos de cibersegurança já começou, e a diferença de abordagem entre as duas empresas reflete suas visões distintas sobre o que é "segurança em IA".

📢 Uma recomendação rápida: Pesquisadores de segurança em conformidade devem solicitar acesso oficial via chatgpt.com/cyber; desenvolvedores comuns podem continuar usando o GPT-5.4 padrão através da APIYI apiyi.com, que é o suficiente. Fique atento a qualquer serviço de terceiros que afirme "poder realizar invocações do modelo GPT-5.4-Cyber" em seu nome; isso viola os termos de serviço ou é simplesmente um golpe.

Autor: Equipe APIYI · Acompanhando continuamente as tendências de lançamento e integração de Modelos de Linguagem Grande · apiyi.com