Am 14. April 2026 veröffentlichte OpenAI offiziell GPT-5.4-Cyber. Dabei handelt es sich um eine „cyber-permissive“ (für Cybersicherheit gelockerte) feinabgestimmte Variante von GPT-5.4, die speziell für die defensive Cybersicherheitsarbeit entwickelt wurde. Der größte Unterschied zu herkömmlichen Consumer-Modellen besteht darin, dass die Ablehnungsschwelle für sicherheitsrelevante Aufgaben gesenkt wurde und erstmals offiziell Binär-Reverse-Engineering unterstützt wird – es ist möglich, kompilierte ausführbare Dateien ohne Quellcode zu analysieren, um Schwachstellen und Schadcode zu identifizieren.

Dieses Modell ist nur für Sicherheitsforscher und Institutionen zugänglich, die die höchste Stufe der Trusted Access for Cyber-Zertifizierung von OpenAI durchlaufen haben, und ist keine öffentliche API für normale Entwickler. Der Veröffentlichungszeitpunkt ist ebenfalls bemerkenswert: Er liegt genau eine Woche nach dem Erscheinen des vergleichbaren Produkts Claude Mythos von Anthropic. Der Wettbewerb zwischen beiden Unternehmen im neuen Bereich „KI × Cybersicherheit“ spitzt sich damit weiter zu.

Was ist GPT-5.4-Cyber? Die wichtigsten Fakten auf einen Blick

Lassen Sie uns die technischen Details kurz beiseite schieben. Hier ist eine Übersicht, mit der Sie alle wichtigen Informationen zur Veröffentlichung in 30 Sekunden erfassen können:

| Dimension | Fakt |

|---|---|

| Veröffentlichungsdatum | 14. April 2026 |

| Herausgeber | OpenAI (offiziell) |

| Modell-Positionierung | „cyber-permissive“ feinabgestimmte Variante von GPT-5.4 |

| Kernziel | Defensive Cybersicherheitsarbeit (Defensive Cybersecurity) |

| Neue Kernfähigkeit | Binär-Reverse-Engineering (ohne Quellcode) |

| Zugangsweg | Personen mit höchster Zertifizierung durch das Programm „Trusted Access for Cyber“ |

| persönlicher Zugang | chatgpt.com/cyber (Identitätsprüfung via Personalausweis) |

| Unternehmenszugang | Antragstellung über OpenAI-Kundenbetreuer |

| Reichweite | Tausende individuelle Verteidiger, Hunderte Sicherheitsteams |

| Preisgestaltung | Bisher nicht offiziell bekannt gegeben |

| Hauptkonkurrent | Anthropic Claude Mythos (eine Woche zuvor veröffentlicht) |

Dieses Modell unterscheidet sich von jedem GPT, das Entwickler bisher kannten – es ist nicht zum Chatten, Codieren oder als Assistent gedacht, sondern fungiert als „Compliance-Schlüssel“ für Sicherheitsforscher, um spezifische Szenarien freizuschalten, die bei gewöhnlichen GPT-5.4-Modellen aufgrund von Sicherheitsrichtlinien blockiert sind.

📌 Fazit in einem Satz: GPT-5.4-Cyber ist ein schmaler Zugang, den OpenAI für eine „hochkarätige Gruppe von Sicherheitsforschern“ öffnet. Es ist kein öffentliches Modell für Standard-Entwickler. Im weiteren Verlauf dieses Artikels gehen wir gezielt auf die Frage ein, ob man es über Drittanbieter-API-Plattformen nutzen kann.

Aufschlüsselung der fünf Schlüsselkompetenzen von GPT-5.4-Cyber

Basierend auf den offiziellen Erklärungen von OpenAI und Berichten Dritter konzentrieren sich die Unterschiede zwischen diesem Modell und dem Standard-GPT-5.4 auf fünf Dimensionen.

Kompetenz 1: „cyber-permissive“ Sicherheitsstrategie

Dies ist die Kernphilosophie des Modells. Das Standard-GPT-5.4 lehnt Anfragen, die „wie böswillige Angriffe oder Exploits aussehen“, während des Trainings standardmäßig ab. Diese „Lieber zu vorsichtig“-Strategie schützt zwar den Durchschnittsnutzer, bereitet jedoch legitimen Sicherheitsforschern große Probleme – bei Penetrationstests, Schwachstellenanalysen oder der Untersuchung von Schadcode werden sie oft mit einem „Entschuldigung, dabei kann ich nicht helfen“ abgewiesen.

GPT-5.4-Cyber senkt diese Hürde für „verifizierte Sicherheitsforscher“ gezielt ab und erlaubt eine tiefgehende Analyse von Exploit-Ansätzen, Diskussionen über Funktionsweisen von Exploits sowie Unterstützung bei der Erstellung von PoCs – Szenarien, in denen die Standardversion die Zusammenarbeit verweigern würde.

Kompetenz 2: Binäres Reverse Engineering

Dies ist die technisch anspruchsvollste Neuerung dieser Veröffentlichung. Traditionell ist Reverse Engineering von Binärdateien auf professionelle Tools wie IDA Pro, Ghidra oder Binary Ninja in Kombination mit manueller Analyse durch Forscher angewiesen. GPT-5.4-Cyber kann kompilierte Binärdateien direkt analysieren und ermöglicht:

- Identifizierung potenzieller Schwachstellen ohne Quellcode (Buffer Overflows, Format-String-Fehler, UAF etc.)

- Analyse des Verhaltens von Schadsoftware (C2-Kommunikation, Persistenz, Anti-Debugging)

- Rekonstruktion der Kontrollflusslogik ausführbarer Dateien

- Unterstützung bei der Erstellung oder Validierung von YARA-Regeln

Dies bedeutet, dass Sicherheitsteams die Vorfilterung an die KI delegieren können, während sich menschliche Forscher auf die komplexesten Aufgaben konzentrieren.

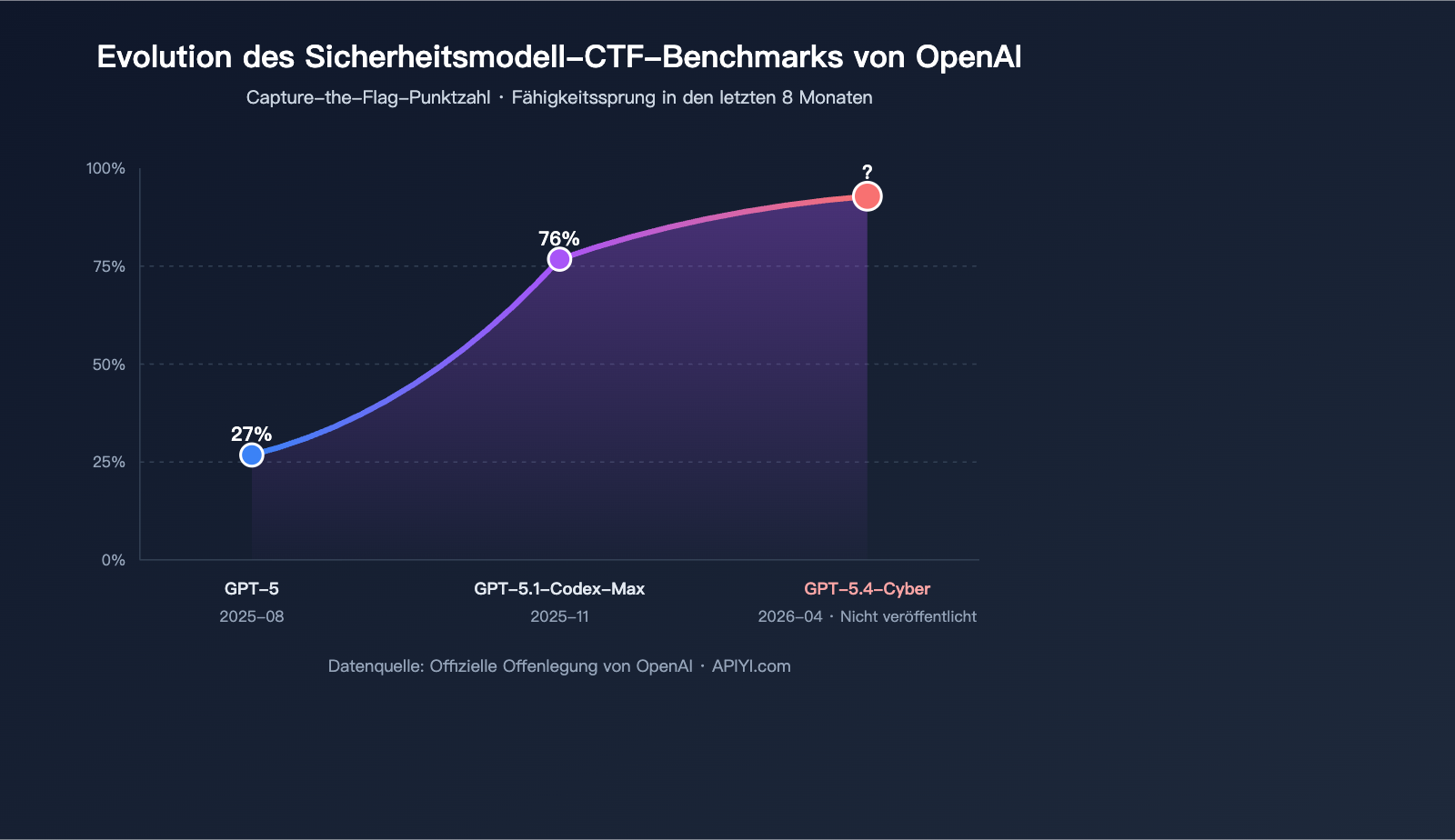

Kompetenz 3: Schneller Aufstieg bei CTF-Benchmarks

OpenAI hat in den Veröffentlichungsunterlagen Leistungsdaten vorgelegt, die die Evolution des Modells im Bereich Cybersicherheit verdeutlichen:

- GPT-5 (August 2025) Capture-the-Flag Benchmark-Ergebnis: 27 %

- GPT-5.1-Codex-Max (November 2025) CTF-Benchmark-Ergebnis: 76 %

Obwohl der spezifische CTF-Wert von GPT-5.4-Cyber selbst nicht veröffentlicht wurde, zeigt diese Kurve, dass OpenAI im letzten Jahr enorme Ressourcen in das Training und die Ausrichtung auf Sicherheitsfähigkeiten investiert hat.

Kompetenz 4: Senkung der Ablehnungsschwelle (Refusal Boundary)

Die Sicherheitsbarrieren herkömmlicher GPT-Modelle führen bei Sicherheitsrecherchen zu einer sehr hohen Fehlablehnungsrate. Die entscheidende Produktentscheidung bei GPT-5.4-Cyber lautet: Die Kontrolle über die Ablehnungsschwelle wird an das „Identitätsverifizierungsergebnis“ übertragen. Innerhalb der verifizierten Nutzergruppe wendet das Modell einen angemesseneren Maßstab für Sicherheitsthemen an – es wird weder zu einer „Jailbreak-Version von GPT“, noch lehnt es bei jedem Risikobegriff pauschal ab.

Dahinter steht eine vollständige Identitäts-Vertrauenskette: Ausweisverifizierung → gestufte Trusted-Access-Authentifizierung → Anpassung der Antwortstrategie durch das Modell basierend auf der Authentifizierungsstufe.

Kompetenz 5: Defensive Ausrichtung (Defensive Only)

OpenAI betont in allen Veröffentlichungsunterlagen wiederholt „defensive Cybersicherheit“ statt „offensive“. Dies ist ein bewusstes politisches Statement: Das Modell ist für die Verteidiger (Blue Teams, Sicherheitsanbieter, Forschungseinrichtungen) gedacht, nicht für die Angreifer. Diese Position bestimmt, dass die Zugangsprüfung sehr streng sein wird – dazu später mehr.

| Kompetenzdimension | Standard GPT-5.4 | GPT-5.4-Cyber |

|---|---|---|

| Strenge der Sicherheitsstrategie | Hoch (Standard-Ablehnung bei Risiko) | Kontrolliert gelockert (basierend auf Stufe) |

| Binäres Reverse Engineering | Begrenzte Unterstützung | Tiefgehende Unterstützung (Hauptmerkmal) |

| Diskussion von Exploit-Prinzipien | Meist abgelehnt | Nach Verifizierung vertieft möglich |

| Analyse von Schadsoftware | Oberflächliche Beschreibung | Unterstützung bei vollständiger Analyse |

| Zugangshürde | Öffentliche bezahlte API | Erfordert höchste Trusted-Access-Stufe |

| Zielgruppe | Alle Entwickler | Verifizierte Sicherheitsforscher |

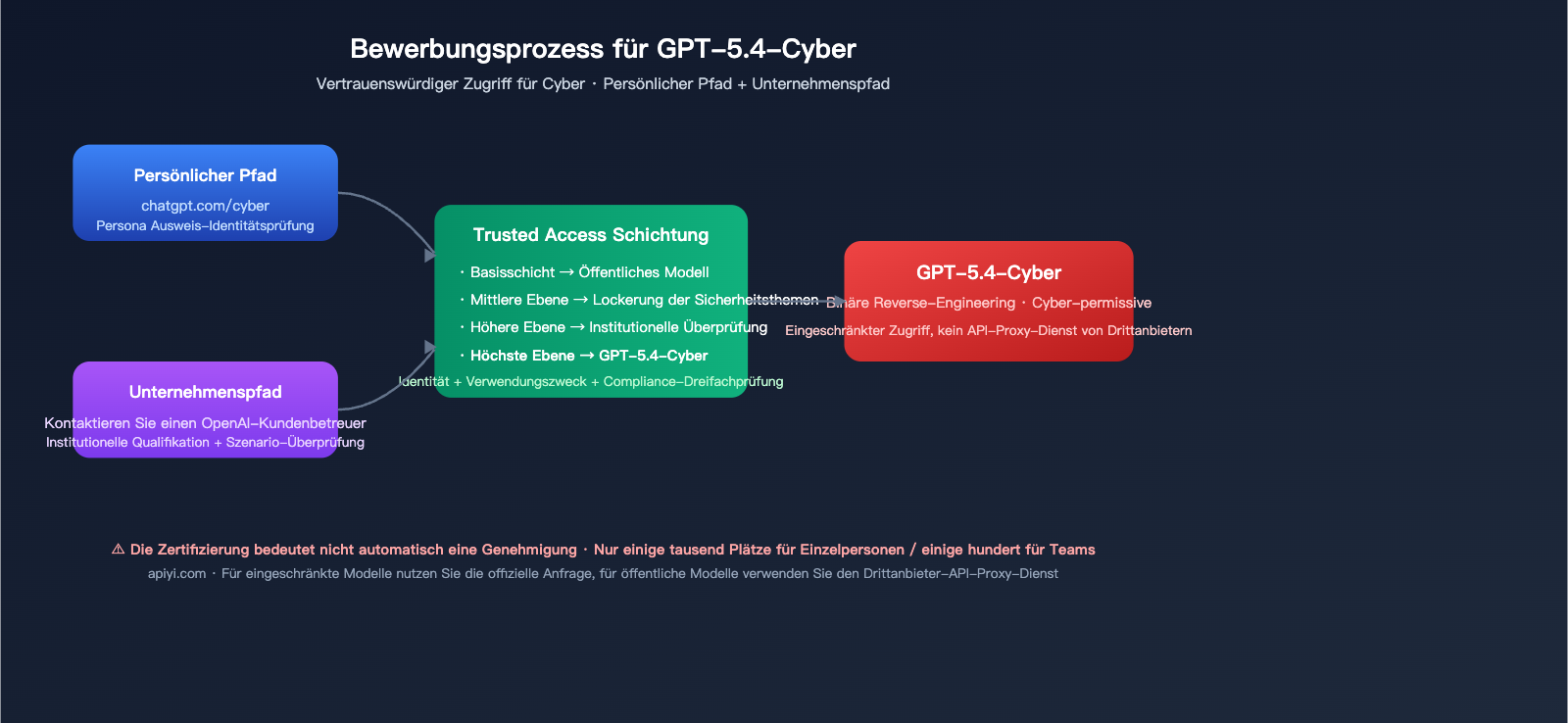

title: Wie beantragt man GPT-5.4-Cyber? Trusted Access Stufen und Prozess

Wie beantragt man GPT-5.4-Cyber? Trusted Access Stufen und Prozess

Trusted Access for Cyber ist ein Projekt, das OpenAI im Februar 2026 startete und mit einem 10-Millionen-Dollar-Förderfonds für Cybersicherheit einherging. Das Update vom 14. April führte nun eine gestufte Zugangsberechtigung ein, wobei die höchste Stufe fest an GPT-5.4-Cyber gebunden ist.

Vergleich der Zertifizierungsstufen

| Stufe | Zielgruppe | Verfügbare Fähigkeiten | Verifizierungsmethode |

|---|---|---|---|

| Basisstufe | Registrierte ChatGPT-Nutzer | Reguläres GPT-5.4 u.a. öffentliche Modelle | Standard-Account |

| Mittelstufe | Verifizierte Sicherheitsexperten | Weniger eingeschränkte Antworten zu Sicherheitsthemen | Persona-Ausweisdokument |

| Oberstufe | Zertifizierte Sicherheitsteams & Institutionen | Lockerere Bearbeitung von Sicherheitsaufgaben | Institutionelle + persönliche Doppelverifizierung |

| Höchststufe | Kernforscher zertifizierter Trusted Access-Organisationen | Anfrage von GPT-5.4-Cyber möglich | OpenAI-Prüfung erforderlich |

Prozess für Einzelpersonen

- Besuchen Sie

chatgpt.com/cyber - Laden Sie ein Foto Ihres staatlichen Ausweisdokuments über den Persona-Identitätsdienst hoch

- Das System ermittelt die Zertifizierungsstufe

- Bei Qualifizierung für die Höchststufe können Sie sich für die Beta-Liste von GPT-5.4-Cyber bewerben

Prozess für Unternehmen

- Kontaktieren Sie Ihren OpenAI Account Manager

- Reichen Sie Teamhintergrund, Anwendungsszenarien und Compliance-Verpflichtungen ein

- Nach erfolgreicher Prüfung wird für spezifische Mitglieder im Arbeitsbereich die Trusted Access-Höchststufe freigeschaltet

- Mitglieder können den Zugriff auf GPT-5.4-Cyber innerhalb des Arbeitsbereichs anfragen

⚠️ Hinweis: OpenAI hat klargestellt, dass die Zugriffserweiterung zu Beginn sehr vorsichtig erfolgt. Selbst eine abgeschlossene Identitätsprüfung garantiert keinen Zugriff auf GPT-5.4-Cyber. Die Zielabdeckung von "tausenden Verteidigern und hunderten Sicherheitsteams" macht dies im Vergleich zur globalen Sicherheitsbranche zu einer äußerst knappen Ressource.

Kann man GPT-5.4-Cyber über Drittanbieter-API-Plattformen nutzen? Die ehrliche Antwort

Dies ist die brennendste Frage vieler Leser. Basierend auf dem aktuellen Produktdesign von OpenAI geben wir eine unverblümte Antwort.

🚨 Aktuelles Fazit: Nein

Der Zugriff auf GPT-5.4-Cyber ist untrennbar mit der Identität des OpenAI-Accounts verknüpft und wird nicht über reguläre API-Kanäle angeboten. Das bedeutet:

- ❌ Nicht über die offizielle OpenAI-API für die Öffentlichkeit / allgemeine Entwickler verfügbar

- ❌ Nicht über APIYI (apiyi.com) oder andere Drittanbieter-API-Proxy-Dienste abrufbar

- ❌ Nicht durch den Kauf eines API-Schlüssels zu erhalten, da es sich um einen "Identitätsnachweis" und nicht um einen "Zahlungsnachweis" handelt

- ✅ Ausschließlich nutzbar über Konten mit Trusted Access for Cyber-Zertifizierung der Höchststufe innerhalb von ChatGPT oder exklusiven Unternehmens-Arbeitsbereichen

Dies liegt in der Produktpositionierung begründet: Könnte man GPT-5.4-Cyber über einen API-Proxy unter Umgehung der Identitätsprüfung anbinden, würden dessen "cyber-permissive" Eigenschaften sofort missbraucht werden. OpenAI hat diesen Weg konsequent unterbunden.

Verfügbare Alternativen

Für Entwickler und Forscher mit unterschiedlichen Anforderungen empfehlen wir folgende realistische Pfade:

| Dein Anliegen | Empfohlener Weg |

|---|---|

| Ich bin ein hochrangiger Sicherheitsforscher und brauche die volle Leistung von GPT-5.4-Cyber | Offizieller Antrag über chatgpt.com/cyber, keine Umwege über Proxys |

| Ich brauche ein reguläres GPT-5.4 für allgemeine KI-Entwicklung | Modellaufruf über die APIYI (apiyi.com) Schnittstelle |

| Ich entwickle Sicherheits-Skripte, bin aber kein Zielnutzer von GPT-5.4-Cyber | Öffentliche Modelle wie GPT-5 / GPT-5.4 / Claude über APIYI nutzen |

| Ich möchte nur Sicherheitswissen lernen und nicht-sensible Analysen durchführen | Reguläres GPT-5.4 reicht völlig aus, über jede öffentliche API verfügbar |

💡 Wichtiger ehrlicher Hinweis: APIYI (apiyi.com) bietet keinen Zugriff auf GPT-5.4-Cyber an. Dies entspricht der restriktiven Veröffentlichungsstrategie von OpenAI und ist keine geschäftliche Entscheidung von APIYI. Sollten zukünftig Plattformen behaupten, sie könnten "GPT-5.4-Cyber vermitteln", handelt es sich mit hoher Wahrscheinlichkeit um Graumarkt-Dienste, die gegen die Nutzungsbedingungen von OpenAI verstoßen oder Identitätsfälschung betreiben. Bitte seien Sie vorsichtig.

Was kann APIYI für dich tun?

Für die überwiegende Mehrheit der Anwendungsfälle, die nicht GPT-5.4-Cyber betreffen, unterstützt dich APIYI (apiyi.com) weiterhin:

from openai import OpenAI

client = OpenAI(

api_key="DEIN-APIYI-KEY",

base_url="https://api.apiyi.com/v1"

)

# Reguläres GPT-5.4 / GPT-5 kann problemlos aufgerufen werden

response = client.chat.completions.create(

model="gpt-5.4",

messages=[

{"role": "user", "content": "Hilf mir, diesen Code auf potenzielle SQL-Injection-Risiken zu analysieren"}

]

)

print(response.choices[0].message.content)

Der obige Code läuft stabil über die einheitliche Schnittstelle von APIYI und greift auf die öffentliche Version von GPT-5.4 zu – nicht auf GPT-5.4-Cyber. Für reguläre Code-Reviews, Dokumentationserstellung und Geschäftsintegrationen ist dies absolut ausreichend.

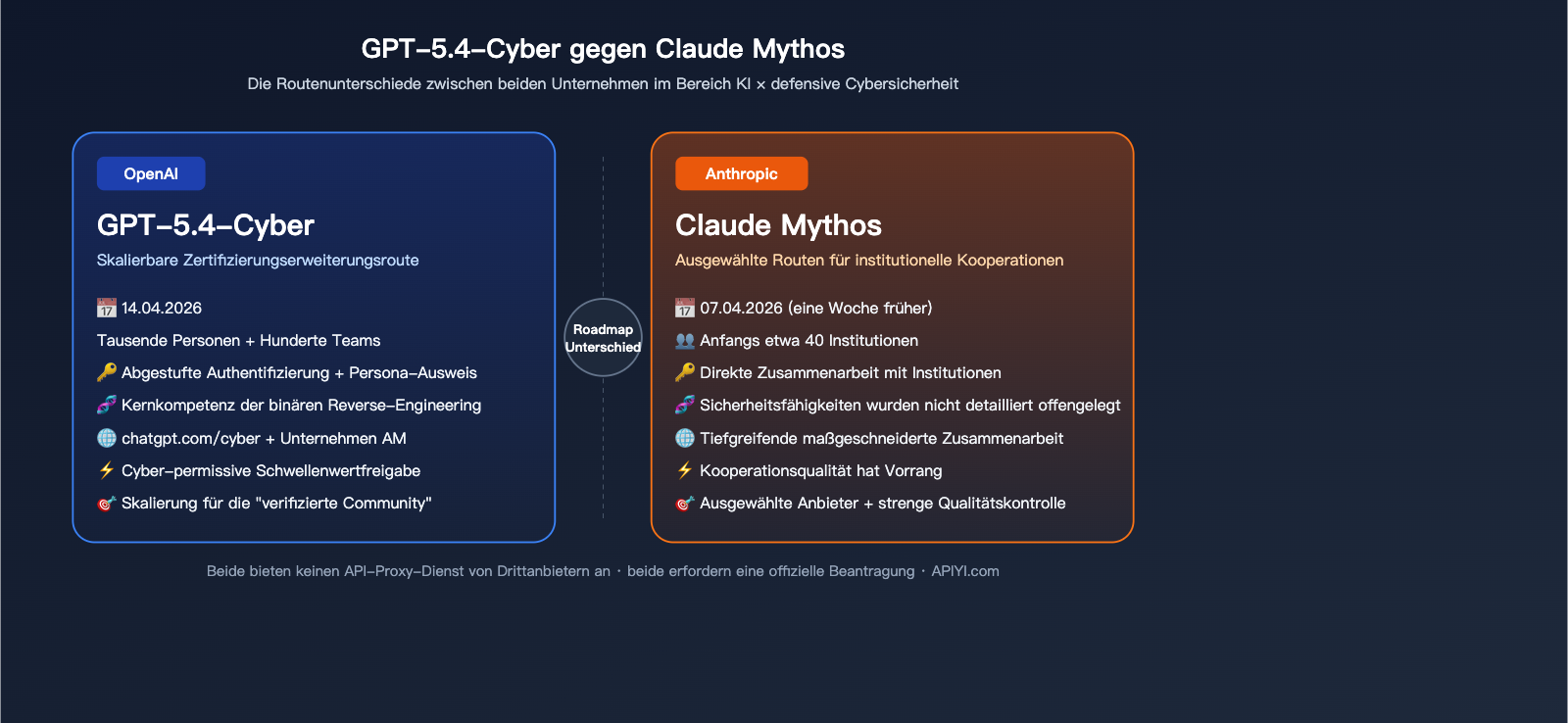

GPT-5.4-Cyber vs. Anthropic Claude Mythos: Unterschiedliche Ansätze

Claude Mythos wurde eine Woche vor GPT-5.4-Cyber veröffentlicht. Beide Modelle repräsentieren zwei unterschiedliche Ansätze im Bereich "KI × defensive Cybersicherheit".

| Vergleichsdimension | OpenAI GPT-5.4-Cyber | Anthropic Claude Mythos |

|---|---|---|

| Veröffentlichungsdatum | 14.04.2026 | 07.04.2026 (ca. eine Woche früher) |

| Basismodell | GPT-5.4 (Fine-Tuning-Variante) | Claude-Variante |

| Zugangsstrategie | Gestufter Zugang, auf Anfrage | Partnerschaften mit Institutionen |

| Anfangsgröße | Tausende Einzelpersonen + Hunderte Teams | Ca. 40 Institutionen |

| Kernvorteile | Binäres Reverse Engineering + cyber-permissive | Nicht öffentlich detailliert |

| Vertriebskanäle | chatgpt.com/cyber + Enterprise AM | Institutionelle Kooperationen |

| Strategische Ausrichtung | Skalierbare Erweiterung für "verifizierte Community" | Exklusive Zusammenarbeit mit Institutionen |

Man sieht deutlich, dass die beiden Unternehmen völlig unterschiedliche Wege gehen: OpenAI setzt auf ein skalierbares Modell nach dem Prinzip "Verifizierung gleich Zugang", um möglichst vielen zertifizierten Sicherheitsexperten zu helfen. Anthropic wählt ein exklusives Modell durch institutionelle Partnerschaften, bei dem die Reichweite zugunsten einer strengeren Qualitätskontrolle geopfert wird. Langfristig gesehen haben beide Ansätze ihre Daseinsberechtigung – sie werden höchstwahrscheinlich viele Jahre lang koexistieren.

Auswirkungen auf die Branche und Entwickler

Einfluss 1: Die Rolle von KI in der Sicherheits-Toolchain wird offiziell

In der Vergangenheit mussten Sicherheitsforscher ChatGPT für Code-Reviews oder Schwachstellenanalysen "auf eigene Faust" nutzen und wurden dabei oft von Sicherheitsrichtlinien blockiert. Die Veröffentlichung von GPT-5.4-Cyber markiert das erste Mal, dass OpenAI "Sicherheitsforscher" als eigenständige Nutzergruppe betrachtet. Wir werden in Zukunft immer mehr solcher branchenspezifischen Modelle sehen.

Einfluss 2: Identitätsprüfung + Funktionsfreischaltung als neues Paradigma

GPT-5.4-Cyber nutzt die Verifizierung durch Personalausweise und einen gestuften Zugang, um Funktionen freizuschalten – ein Produktmodell, das bei allgemeinen KI-Produkten noch recht neu ist. In hochregulierten Bereichen wie Finanzen, Gesundheitswesen oder Recht können wir in Zukunft mit weiteren Kombinationen aus "Identität + gestufter Modellkapazität" rechnen.

Einfluss 3: Klarere Positionierung von Drittanbieter-API-Plattformen

Für Plattformen wie APIYI (apiyi.com) verdeutlicht das Ereignis um GPT-5.4-Cyber die Grenzen: Modelle mit eingeschränktem Zugriff werden direkt über die offiziellen Kanäle genutzt, während öffentliche Modelle über Proxy-Dienste die Entwicklerfreundlichkeit bedienen. Beide Märkte ergänzen sich, anstatt miteinander zu konkurrieren.

Einfluss 4: Wesentliche Effizienzsteigerung für Blue Teams

Sollte die Fähigkeit zum binären Reverse Engineering von GPT-5.4-Cyber tatsächlich so ausgereift sein wie behauptet, wird die Effizienz von Blue Teams bei Aufgaben wie Analyse bösartiger Samples, Firmware-Audits und Patch-Diff-Analysen massiv steigen. Das ist eine hervorragende Nachricht für die gesamte Branche.

FAQ Häufig gestellte Fragen

F1: Haben Einzelentwickler die Möglichkeit, GPT-5.4-Cyber zu nutzen?

Wenn Sie ein registrierter Sicherheitsforscher mit einem nachweisbaren Geschäftsszenario sind und die Identitätsprüfung über "Trusted Access" auf der höchsten Ebene bestehen, haben Sie eine Chance. Wenn Sie nur aus Neugier mit dem Modell experimentieren möchten, haben Sie praktisch keine Chance. Wir empfehlen normalen Entwicklern, sich auf das öffentlich zugängliche GPT-5.4 zu konzentrieren, das über die einheitliche Schnittstelle von APIYI (apiyi.com) stabil aufgerufen werden kann.

F2: Kann man die Beschränkungen durch ein VPN oder gefälschte Identitäten umgehen?

Das ist nicht ratsam und sollte unterlassen werden. Sobald eine Identitätsfälschung oder ein Missbrauch festgestellt wird, wird das Konto sofort gesperrt. Dies kann zudem die allgemeine Zugangsberechtigung Ihrer Institution beeinträchtigen. Die Risikokontrolle von "Trusted Access" ist äußerst streng.

F3: Gibt es Informationen zur Preisgestaltung?

OpenAI hat die Preise für GPT-5.4-Cyber nicht öffentlich bekannt gegeben. Branchenüblich werden solche hochgradig eingeschränkten vertikalen Modelle wahrscheinlich über Unternehmensverträge oder Abonnementmodelle pro Arbeitsplatz bereitgestellt und nicht über die übliche Abrechnung pro Token (per-token).

F4: Kann ich GPT-5.4-Cyber für Angriffe nutzen?

Dies ist sowohl konzeptionell als auch durch die Nutzungsbedingungen untersagt. Die Positionierung des Modells ist auf "defensive cybersecurity" ausgelegt; ein Verstoß gegen die Bedingungen führt zu Kontosperrungen und rechtlichen Risiken. OpenAI verlangt bei "Trusted Access" die Unterzeichnung einer Nutzungsvereinbarung.

F5: Wann wird APIYI (apiyi.com) GPT-5.4-Cyber integrieren?

Das Modell wird voraussichtlich nicht integriert, da der Verteilungsmechanismus des Modells den Zugriff durch Drittanbieter-Proxys von Grund auf ausschließt. APIYI wird weiterhin das reguläre GPT-5, GPT-5.4, die o-Serie, Claude und andere öffentlich zugängliche Modelle ausbauen, um die täglichen Anforderungen der meisten Entwickler abzudecken.

F6: In welcher Beziehung steht GPT-5.4-Cyber zu Codex und der o-Serie?

Alle drei sind Produktlinien von OpenAI, haben aber unterschiedliche Schwerpunkte: Codex ist auf die Codegenerierung spezialisiert, die o-Serie auf tiefgreifendes Schlussfolgern, und GPT-5.4-Cyber ist eine für Sicherheitsaspekte feinabgestimmte Variante. Es kann Überschneidungen bei den Fähigkeiten geben, aber die Zugangsberechtigungen unterscheiden sich grundlegend.

F7: Wie können sich kleine und mittlere Sicherheitsteams bewerben?

Über Kundenbetreuer von OpenAI (oder geschäftliche Kanäle) müssen Teamqualifikationen, Nutzungsszenarien und Compliance-Verpflichtungen eingereicht werden. In der Anfangsphase priorisiert OpenAI Institutionen mit klaren Qualifikationen und einem eindeutigen Nutzungszweck. Kleinen Teams ohne direkten Kanal wird empfohlen, zunächst Compliance-Unterlagen zusammenzustellen, bevor sie sich bewerben.

F8: Können Unternehmen in China das Modell nutzen?

Die Dienste von OpenAI unterliegen regionalen Beschränkungen; für Akteure in China gibt es bei einer direkten Anbindung Compliance- und Verfügbarkeitsprobleme. Wenn Sie lediglich GPT-5.4 für allgemeine KI-Anwendungen nutzen möchten, können Sie die für China erreichbaren Schnittstellen von APIYI (apiyi.com) verwenden. Für hochsensible Funktionen wie bei GPT-5.4-Cyber wird empfohlen, sich über offizielle Compliance-Kanäle mit dem internationalen Geschäftsbereich von OpenAI in Verbindung zu setzen.

Fazit: Ein Modell für eine "kleine Zielgruppe mit enormem Einfluss"

Kommen wir auf die Ausgangsfrage zurück: Was bedeutet GPT-5.4-Cyber eigentlich?

- Für Sicherheitsforscher: Dies ist ein offiziell verifizierter Schlüssel, um Analyseaufgaben zu lösen, die für Standardmodelle zu komplex sind – insbesondere im Bereich der Binär-Reverse-Engineering. Dies wird den Arbeitsablauf des Blue Teams nachhaltig verändern.

- Für normale Entwickler: Sie werden dieses Modell höchstwahrscheinlich nicht benötigen, aber kein Grund zur Sorge – das öffentliche GPT-5.4 deckt bereits 95 % der täglichen KI-Entwicklungsanforderungen ab und lässt sich stabil und bequem über APIYI (apiyi.com) einbinden.

- Für die Branche: Das Produktmodell aus Identitätsprüfung und gestuftem Zugang wird zunehmend von anderen vertikalen Bereichen übernommen; die Aufgabenteilung zwischen API-Plattformen von Drittanbietern und offiziellen, eingeschränkten Modellen wird klarer.

- Für die Wettbewerbslandschaft: Das direkte Duell zwischen OpenAI und Anthropic bei Modellen für Cybersicherheit hat begonnen. Die unterschiedlichen Ansätze beider Firmen spiegeln ihr jeweiliges Verständnis von "KI-Sicherheit" wider.

📢 Kurzempfehlung: Konforme Sicherheitsforscher sollten sich offiziell über chatgpt.com/cyber bewerben; normale Entwickler nutzen weiterhin das reguläre GPT-5.4 über APIYI (apiyi.com). Seien Sie vorsichtig bei Drittanbieterdiensten, die behaupten, "GPT-5.4-Cyber vermitteln zu können" – das verstößt entweder gegen die Bedingungen oder ist schlichtweg Betrug.

Autor: APIYI Team · Wir verfolgen kontinuierlich Trends bei der Veröffentlichung und Einbindung großer KI-Sprachmodelle · apiyi.com