Le 14 avril 2026, OpenAI a officiellement lancé GPT-5.4-Cyber, une variante affinée du modèle GPT-5.4, conçue spécifiquement pour la cybersécurité défensive avec une approche « cyber-permissive ». La différence majeure avec le modèle grand public réside dans son seuil de refus abaissé pour les tâches liées à la recherche en sécurité. Il offre également, pour la première fois, une prise en charge native de l'ingénierie inverse binaire, permettant d'analyser des fichiers exécutables compilés sans code source pour identifier des vulnérabilités ou du code malveillant.

Ce modèle n'est pas accessible via une API publique pour les développeurs. Il est réservé aux chercheurs et institutions en cybersécurité ayant obtenu la certification de niveau supérieur du programme Trusted Access for Cyber d'OpenAI. Le timing de ce lancement est stratégique : il intervient exactement une semaine après la sortie de Claude Mythos, le produit équivalent d'Anthropic, marquant une intensification de la concurrence sur le créneau « IA × Cybersécurité ».

Qu'est-ce que GPT-5.4-Cyber ? Aperçu des faits essentiels

Passons les détails techniques et résumons l'essentiel de ce lancement en 30 secondes :

| Dimension | Fait |

|---|---|

| Date de lancement | 14 avril 2026 |

| Éditeur | OpenAI |

| Positionnement | Variante affinée « cyber-permissive » de GPT-5.4 |

| Objectif principal | Cybersécurité défensive |

| Nouvelle capacité clé | Ingénierie inverse binaire (sans code source) |

| Accès | Certifiés du programme Trusted Access for Cyber |

| Accès individuel | chatgpt.com/cyber (vérification d'identité) |

| Accès entreprise | Via les représentants commerciaux OpenAI |

| Échelle | Des milliers de défenseurs et centaines d'équipes sécurité |

| Tarification | Non communiquée |

| Concurrent principal | Anthropic Claude Mythos (lancé une semaine avant) |

Ce modèle est radicalement différent de tout ce que les développeurs connaissent : il n'est pas conçu pour discuter, coder ou assister au quotidien, mais agit comme une « clé de conformité » pour les chercheurs en sécurité, permettant de débloquer des scénarios normalement restreints par les politiques de sécurité du GPT-5.4 standard.

📌 En résumé : GPT-5.4-Cyber est une porte étroite ouverte par OpenAI aux chercheurs en sécurité de haut niveau. Il ne s'agit pas d'un modèle public pour les développeurs. Nous répondrons plus loin dans cet article à la question cruciale : « Peut-on y accéder via des plateformes API tierces ? ».

title: "Analyse des cinq capacités clés de GPT-5.4-Cyber"

description: "Découvrez les capacités révolutionnaires de GPT-5.4-Cyber, le nouveau modèle d'OpenAI dédié à la cybersécurité défensive et à l'ingénierie inverse."

Analyse des cinq capacités clés de GPT-5.4-Cyber

D'après les déclarations officielles d'OpenAI et les rapports tiers, les différences entre ce modèle et le GPT-5.4 standard se concentrent sur cinq dimensions.

Capacité 1 : Stratégie de sécurité permissive (cyber-permissive)

C'est la philosophie centrale de ce modèle. Lors de son entraînement, le GPT-5.4 standard rejette par défaut toute requête qui "ressemble à une attaque malveillante ou à une exploitation de vulnérabilité". Cette stratégie de "prudence excessive" protège l'utilisateur moyen, mais rend la tâche difficile aux chercheurs en sécurité légitimes, qui se voient souvent répondre "Désolé, je ne peux pas vous aider" lors de tests d'intrusion, de recherches de vulnérabilités ou d'analyse de code malveillant.

GPT-5.4-Cyber abaisse cette barrière spécifiquement pour les "chercheurs en sécurité certifiés", leur permettant d'analyser en profondeur les vecteurs d'attaque, de discuter des principes d'exploitation et d'assister à la rédaction de preuves de concept (PoC), des scénarios que la version standard refuse de traiter.

Capacité 2 : Ingénierie inverse binaire

Il s'agit de la nouvelle capacité la plus technique de cette version. Traditionnellement, l'ingénierie inverse binaire repose sur des outils spécialisés comme IDA Pro, Ghidra ou Binary Ninja, combinés à l'analyse manuelle des chercheurs. GPT-5.4-Cyber peut analyser directement les fichiers binaires compilés pour :

- Identifier des vulnérabilités potentielles sans code source (dépassement de tampon, chaînes de formatage, UAF, etc.)

- Analyser le comportement d'échantillons malveillants (communication C2, persistance, anti-débogage)

- Restituer la logique de flux de contrôle des exécutables

- Aider à générer ou vérifier des règles YARA

Cela signifie que les équipes de sécurité peuvent déléguer le tri préliminaire à l'IA, permettant aux chercheurs humains de se concentrer sur les aspects les plus complexes.

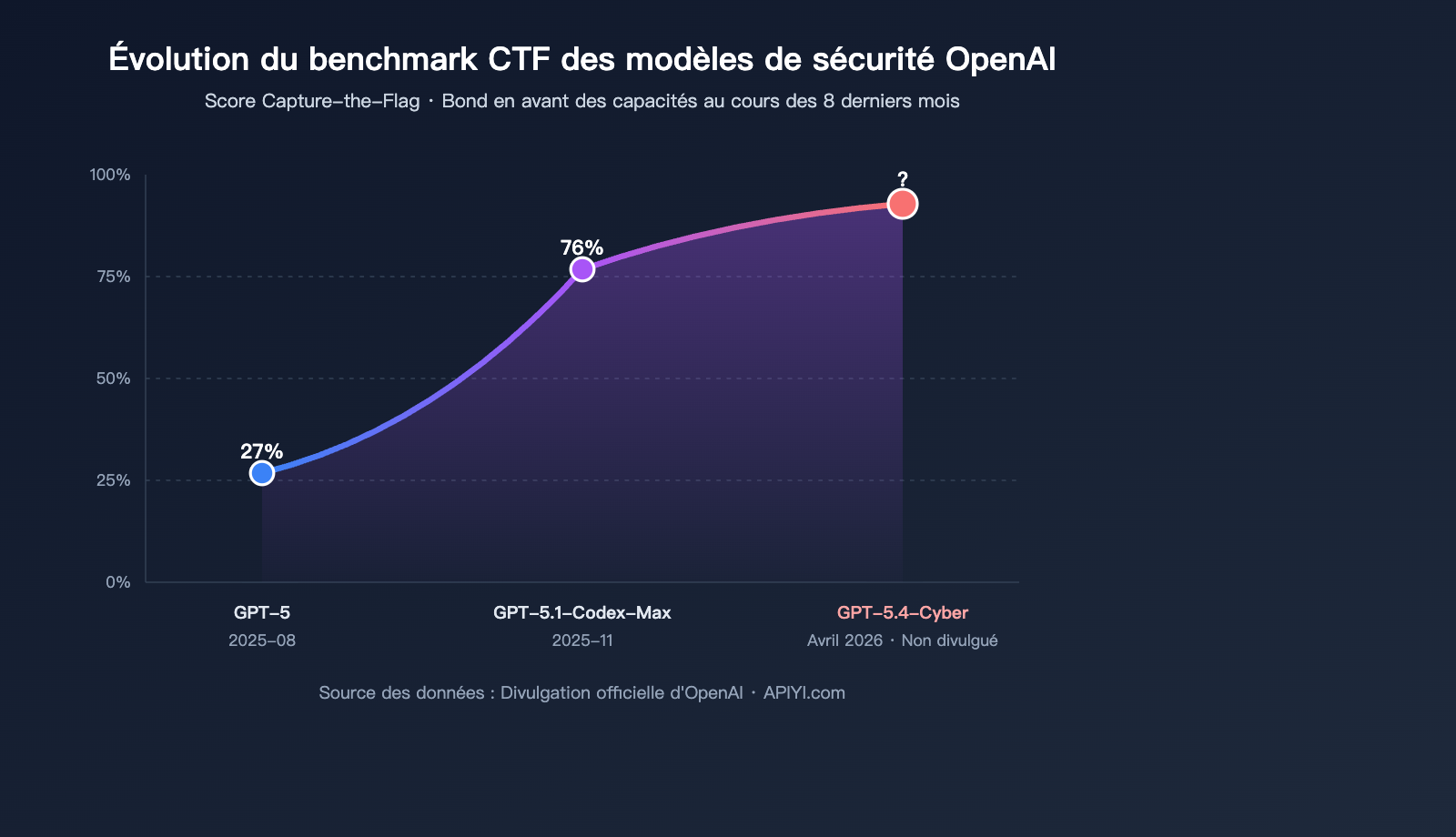

Capacité 3 : Progression rapide des benchmarks CTF

OpenAI a divulgué des données de performance révélatrices de l'évolution du modèle dans les scénarios de cybersécurité :

- Score au benchmark Capture-the-Flag (CTF) de GPT-5 (août 2025) : 27 %

- Score au benchmark CTF de GPT-5.1-Codex-Max (novembre 2025) : 76 %

Bien que le score spécifique de GPT-5.4-Cyber ne soit pas public, cette courbe montre qu'OpenAI a investi des ressources considérables en entraînement et en alignement sur les capacités de sécurité au cours de l'année écoulée.

Capacité 4 : Réduction du seuil de refus (Refusal Boundary)

Les garde-fous de sécurité des GPT traditionnels présentent un taux de faux refus très élevé dans les scénarios de recherche en sécurité. La décision produit clé de GPT-5.4-Cyber est de : confier le réglage du seuil de refus aux "résultats de vérification d'identité". Pour les groupes d'utilisateurs certifiés, le modèle traite les sujets de sécurité avec une échelle plus appropriée — sans devenir un "GPT jailbreaké", mais sans bloquer systématiquement tout terme lié aux risques comme le fait la version standard.

Derrière cela se trouve une chaîne de confiance d'identité complète : vérification de pièce d'identité Persona → authentification hiérarchisée Trusted Access → ajustement de la stratégie de réponse du modèle selon le niveau d'accréditation.

Capacité 5 : Positionnement défensif (Defensive Only)

Dans tous ses documents de publication, OpenAI insiste lourdement sur la "cybersécurité défensive" plutôt que sur l'offensive. Il s'agit d'un positionnement politique délibéré : le modèle est destiné aux défenseurs (équipes bleues, éditeurs de sécurité, instituts de recherche), pas aux attaquants. Cette position dicte une vérification d'accès très stricte, que nous détaillerons plus loin.

| Dimension de capacité | GPT-5.4 standard | GPT-5.4-Cyber |

|---|---|---|

| Rigueur de la stratégie | Élevée (refus par défaut) | Assouplie (selon accréditation) |

| Ingénierie inverse binaire | Support limité | Support approfondi (argument clé) |

| Discussion sur les exploits | Refus fréquent | Discussion approfondie après certif. |

| Analyse de malwares | Description superficielle | Analyse complète assistée |

| Accès | API payante publique | Accès Trusted Access requis |

| Public cible | Tous les développeurs | Chercheurs en sécurité certifiés |

Comment demander l'accès à GPT-5.4-Cyber ? Niveaux et processus Trusted Access

Trusted Access for Cyber est un projet lancé par OpenAI en février 2026, accompagné d'un fonds de subvention pour la cybersécurité de 10 millions de dollars. La mise à jour du 14 avril marque une étape majeure en étendant l'ancien système binaire "accès ou refus" à un accès hiérarchisé, tout en liant le niveau d'accès le plus élevé à GPT-5.4-Cyber.

Comparatif des niveaux d'accréditation

| Niveau | Public cible | Capacités disponibles | Méthode de vérification |

|---|---|---|---|

| Basique | Utilisateurs ChatGPT enregistrés | Modèles publics (GPT-5.4, etc.) | Compte standard |

| Intermédiaire | Professionnels de la sécurité certifiés | Réponses sur sujets de sécurité moins restreintes | Pièce d'identité Persona |

| Avancé | Équipes et institutions de sécurité certifiées | Traitement de tâches de sécurité plus souple | Double certif. (institution + individu) |

| Maximal | Chercheurs clés d'institutions certifiées | Accès à GPT-5.4-Cyber | Examen par OpenAI |

Processus de demande individuelle

- Visitez

chatgpt.com/cyber - Utilisez le service de vérification d'identité Persona pour télécharger une photo de votre pièce d'identité officielle

- Le système détermine votre niveau d'accréditation

- Si vous êtes éligible au niveau maximal, vous pouvez demander à rejoindre la liste d'attente pour GPT-5.4-Cyber

Processus de demande entreprise

- Contactez votre responsable de compte OpenAI

- Soumettez le profil de votre équipe, une description des cas d'usage et un engagement de conformité

- Après validation, activez le niveau Trusted Access maximal pour des membres spécifiques dans votre espace de travail

- Les membres peuvent alors demander l'accès à GPT-5.4-Cyber au sein de l'espace de travail

⚠️ Attention : OpenAI a clairement indiqué qu'ils étendraient l'accès avec une extrême prudence. Même après avoir complété la vérification d'identité, cela ne garantit pas l'obtention de l'accès à GPT-5.4-Cyber. L'objectif est de couvrir "quelques milliers de défenseurs individuels et quelques centaines d'équipes de sécurité", ce qui en fait une ressource très rare à l'échelle mondiale.

Est-il possible d'accéder à GPT-5.4-Cyber via une plateforme API tierce ? La réponse honnête

C'est la question qui préoccupe le plus nos lecteurs. Nous nous basons sur la conception actuelle des produits OpenAI pour vous donner une réponse sans langue de bois.

🚨 Conclusion actuelle : Non

L'accès à GPT-5.4-Cyber est étroitement lié à l'identité du compte OpenAI et n'est pas fourni via les canaux API classiques. Cela signifie que :

- ❌ Il n'est pas disponible pour le grand public ou les développeurs via l'API officielle d'OpenAI.

- ❌ Il ne peut pas être appelé via des plateformes de service proxy API tierces comme APIYI (apiyi.com).

- ❌ Il est impossible de l'obtenir en achetant une clé API, car il s'agit d'un "justificatif d'identité" et non d'un "justificatif de paiement".

- ✅ Il est uniquement accessible via ChatGPT ou des espaces de travail d'entreprise dédiés, pour les comptes bénéficiant de la certification de haut niveau Trusted Access for Cyber.

Ce choix est dicté par le positionnement du produit : si GPT-5.4-Cyber pouvait contourner l'authentification via une API proxy, sa nature "cyber-permissive" deviendrait immédiatement une cible pour les attaquants. OpenAI a délibérément verrouillé cette voie dès la conception.

Alternatives recommandées

Pour les développeurs et chercheurs ayant des besoins différents, voici les pistes réalistes :

| Votre besoin | Solution recommandée |

|---|---|

| Je suis un chercheur en sécurité certifié et je veux la puissance brute de GPT-5.4-Cyber | Faites une demande officielle sur chatgpt.com/cyber, n'utilisez aucun proxy |

| J'ai besoin d'un GPT-5.4 standard pour du développement IA général | Utilisez l'interface unifiée d'APIYI (apiyi.com) pour appeler GPT-5.4 |

| Je développe des scripts de sécurité, mais je ne suis pas la cible de GPT-5.4-Cyber | Utilisez APIYI pour appeler les modèles publics comme GPT-5 / GPT-5.4 / Claude |

| Je veux juste apprendre la sécurité ou faire de l'analyse non sensible | Le GPT-5.4 standard suffit, disponible sur n'importe quelle plateforme API publique |

💡 Rappel honnête important : APIYI (apiyi.com) ne propose pas l'invocation de GPT-5.4-Cyber. Cela est dû à la politique de diffusion restreinte d'OpenAI, et non à un choix commercial d'APIYI. Si une plateforme tierce prétend pouvoir "appeler GPT-5.4-Cyber pour vous", il s'agit très probablement d'un service douteux enfreignant les conditions d'utilisation d'OpenAI, voire impliquant une usurpation d'identité. Soyez vigilants.

Que peut faire APIYI pour vous ?

Pour la grande majorité des scénarios hors GPT-5.4-Cyber, APIYI (apiyi.com) reste votre allié :

from openai import OpenAI

# Configuration du client APIYI

client = OpenAI(

api_key="VOTRE-CLE-APIYI",

base_url="https://api.apiyi.com/v1"

)

# Appel possible pour GPT-5.4 / GPT-5 standard

response = client.chat.completions.create(

model="gpt-5.4",

messages=[

{"role": "user", "content": "Aide-moi à analyser les risques d'injection SQL dans ce code"}

]

)

print(response.choices[0].message.content)

Ce code fonctionne de manière stable sur l'interface unifiée d'APIYI et correspond à la version publique de GPT-5.4, et non à GPT-5.4-Cyber. C'est largement suffisant pour les revues de code classiques, la génération de documentation et l'intégration métier.

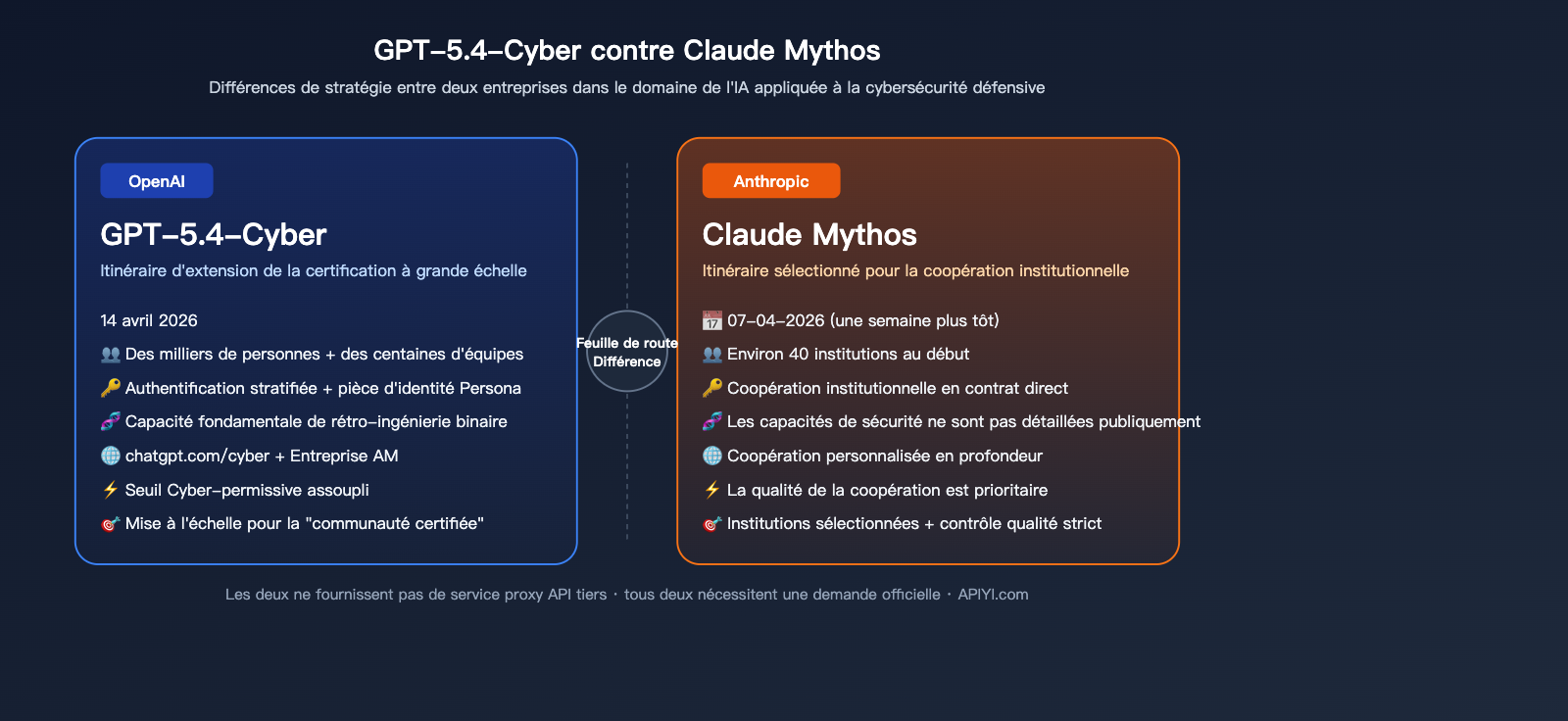

GPT-5.4-Cyber vs Anthropic Claude Mythos : deux approches différentes

Claude Mythos a été publié une semaine avant GPT-5.4-Cyber, et les deux représentent deux approches distinctes de l'IA appliquée à la cybersécurité défensive.

| Dimension de comparaison | OpenAI GPT-5.4-Cyber | Anthropic Claude Mythos |

|---|---|---|

| Date de sortie | 14/04/2026 | 07/04/2026 (environ une semaine avant) |

| Modèle de base | Variante affinée de GPT-5.4 | Variante de Claude |

| Stratégie d'accès | Accès hiérarchisé, sur demande | Partenariats institutionnels |

| Échelle initiale | Milliers d'individus + centaines d'équipes | Environ 40 institutions |

| Argument clé | Rétro-ingénierie binaire + cyber-permissive | Non divulgué en détail |

| Canaux de distribution | chatgpt.com/cyber + AM entreprise | Partenariats institutionnels |

| Orientation stratégique | Modèle à grande échelle pour "communauté certifiée" | Modèle sélectif via partenariats profonds |

On constate que les choix stratégiques sont radicalement différents : OpenAI privilégie un modèle de mise à l'échelle basé sur la vérification, souhaitant faire bénéficier le plus grand nombre de professionnels de la sécurité certifiés ; Anthropic privilégie un modèle sélectif via des partenariats institutionnels, sacrifiant la couverture au profit d'un contrôle qualité plus strict. À long terme, ces deux approches ont chacune leur marché et coexisteront probablement pendant de nombreuses années.

Analyse de l'impact sur l'industrie et les développeurs

Impact 1 : Le rôle de l'IA dans la chaîne d'outils de sécurité est officiellement "institutionnalisé"

Auparavant, les chercheurs en sécurité utilisaient ChatGPT pour la revue de code ou l'analyse de vulnérabilités de manière "artisanale", se heurtant souvent aux politiques de sécurité. Le lancement de GPT-5.4-Cyber marque la première fois qu'OpenAI considère les "chercheurs en sécurité" comme un groupe d'utilisateurs distinct. À l'avenir, les modèles verticaux spécialisés par secteur vont se multiplier.

Impact 2 : L'authentification d'identité couplée au déblocage de capacités devient un nouveau paradigme

GPT-5.4-Cyber utilise une vérification d'identité via Persona et un accès par paliers pour débloquer ses capacités. Il s'agit d'un modèle de produit encore assez novateur dans le domaine de l'IA généraliste. Dans des secteurs hautement réglementés comme la finance, la santé ou le droit, on peut s'attendre à voir apparaître davantage de combinaisons de type "identité + accès gradué aux capacités du modèle".

Impact 3 : Le positionnement des plateformes API tierces devient plus clair

Pour les plateformes API unifiées tierces comme APIYI (apiyi.com), l'arrivée de GPT-5.4-Cyber délimite clairement les frontières : les modèles à accès restreint passent par les canaux officiels, tandis que les modèles publics sont pris en charge par les plateformes de service proxy API pour faciliter le travail des développeurs. Ces deux marchés sont complémentaires et non concurrents.

Impact 4 : Une amélioration substantielle de l'efficacité pour les équipes Blue Team

Si les capacités d'ingénierie inverse binaire de GPT-5.4-Cyber sont aussi matures que ce que prétend l'annonce officielle, l'efficacité des équipes Blue Team sur des tâches telles que l'analyse d'échantillons malveillants, l'audit de firmware et l'analyse de différences de correctifs (Patch Diff) connaîtra un bond significatif. C'est une excellente nouvelle pour l'ensemble du secteur.

FAQ – Foire aux questions

Q1 : Les développeurs individuels ont-ils une chance d'utiliser GPT-5.4-Cyber ?

Si vous êtes un chercheur en sécurité enregistré avec des cas d'usage professionnels clairement définis, et que vous atteignez le niveau le plus élevé d'accès via la vérification d'identité Persona, c'est possible. Si vous êtes simplement curieux et souhaitez tester le modèle, il n'y a pratiquement aucune chance. Nous conseillons aux développeurs classiques de concentrer leurs efforts sur GPT-5.4, accessible publiquement, et de l'utiliser de manière stable via l'interface unifiée d'APIYI (apiyi.com).

Q2 : Peut-on contourner les restrictions via un VPN ou une fausse identité ?

C'est fortement déconseillé, ne le faites pas. En cas de détection de falsification d'identité ou d'abus, votre compte sera immédiatement banni, ce qui pourrait également compromettre l'éligibilité de votre organisation. Les contrôles de sécurité de l'accès de confiance (Trusted Access) sont très stricts.

Q3 : Existe-t-il des informations sur la tarification ?

OpenAI n'a pas divulgué les tarifs de GPT-5.4-Cyber. Selon les pratiques du secteur, ce type de modèle vertical hautement restreint est probablement proposé via des contrats d'entreprise ou des abonnements par siège, et non via la facturation classique par jeton (per-token) des API standards.

Q4 : Peut-on utiliser GPT-5.4-Cyber pour mener des attaques ?

Non, tant par sa conception que par ses conditions d'utilisation. Le modèle est positionné pour la "cybersécurité défensive". Toute violation des conditions entraînera un bannissement du compte et des risques juridiques. L'accès de confiance d'OpenAI vous demandera de signer un engagement de conformité d'utilisation.

Q5 : Quand APIYI (apiyi.com) proposera-t-il GPT-5.4-Cyber ?

Il n'est pas prévu qu'il soit ajouté, car le mécanisme de distribution du modèle est conçu pour exclure les services proxy tiers. APIYI continuera d'étendre son offre avec les modèles publics comme GPT-5, GPT-5.4, la série o, Claude, etc., pour couvrir les besoins quotidiens de la majorité des développeurs.

Q6 : Quel est le lien entre GPT-5.4-Cyber, Codex et la série o ?

Tous trois sont des gammes de produits OpenAI, mais avec des positionnements différents : Codex est orienté vers la génération de code, la série o vers le raisonnement approfondi, et GPT-5.4-Cyber est une variante affinée pour les scénarios de sécurité. Leurs capacités peuvent se chevaucher, mais leurs mécanismes d'accès sont totalement distincts.

Q7 : Comment les petites et moyennes équipes de sécurité peuvent-elles postuler ?

En soumettant les qualifications de l'équipe, les cas d'usage et les engagements de conformité via les représentants commerciaux d'OpenAI. Dans un premier temps, OpenAI donnera la priorité aux institutions ayant des qualifications claires et des objectifs d'utilisation précis. Pour les petites équipes sans canal direct, il est conseillé de constituer d'abord un dossier de conformité solide avant de postuler.

Q8 : Les entreprises basées en Chine peuvent-elles l'utiliser ?

Les services d'OpenAI sont soumis à des restrictions géographiques ; une connexion directe depuis des entités locales pose des problèmes de conformité et d'accessibilité. Si vous utilisez simplement GPT-5.4 pour des besoins d'IA généraliste, vous pouvez passer par les interfaces accessibles localement d'APIYI (apiyi.com). Pour les capacités hautement sensibles comme GPT-5.4-Cyber, il est recommandé de passer par les canaux de conformité officiels pour traiter avec les activités internationales d'OpenAI.

Résumé : Un modèle "de niche, mais à fort impact"

Revenons à la question initiale : que signifie réellement GPT-5.4-Cyber ?

- Pour les chercheurs en sécurité : Il s'agit d'une clé officiellement certifiée, capable de débloquer des tâches d'analyse inaccessibles aux modèles classiques, notamment en matière d'ingénierie inverse binaire. Cela va transformer concrètement le quotidien des équipes bleues (Blue Teams).

- Pour les développeurs classiques : Vous n'aurez probablement pas besoin de ce modèle, mais pas de panique : la version publique de GPT-5.4 couvre déjà 95 % des besoins courants en développement IA. Vous pouvez y accéder de manière stable et simple via APIYI apiyi.com.

- Pour le secteur : Le modèle de produit basé sur l'authentification d'identité et l'accès hiérarchisé sera adopté par davantage de domaines verticaux ; la répartition des rôles entre les plateformes API tierces et les modèles officiels restreints deviendra de plus en plus claire.

- Pour le paysage concurrentiel : La confrontation directe entre OpenAI et Anthropic sur les modèles de cybersécurité a commencé, et leurs différences d'approche reflètent des visions divergentes de ce qu'est la "sécurité de l'IA".

📢 Conseil en une phrase : Les chercheurs en sécurité autorisés doivent passer par la demande officielle sur chatgpt.com/cyber ; les développeurs classiques peuvent continuer à utiliser le GPT-5.4 standard via APIYI apiyi.com. Méfiez-vous de tout service tiers prétendant pouvoir "accéder pour vous à GPT-5.4-Cyber" : il s'agit soit d'une violation des conditions d'utilisation, soit d'une arnaque.

Auteur : Équipe APIYI · Suivi continu des tendances de publication et d'accès aux grands modèles de langage · apiyi.com