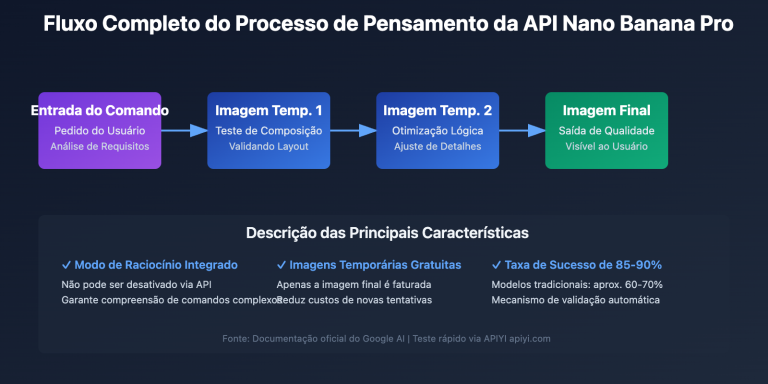

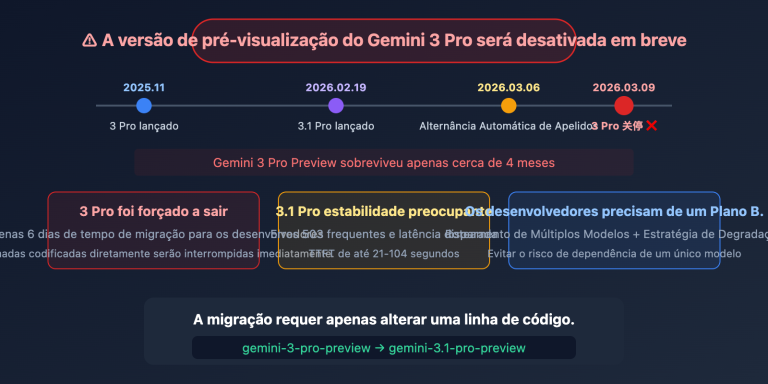

O serviço de geração de imagens por IA do Google, Nano Banana Pro, passou por importantes ajustes de política no final de janeiro de 2026 (por volta do dia 24). Duas grandes mudanças — o reforço significativo na filtragem de conteúdo IMAGE_SAFETY e as restrições rigorosas na geração de personagens de IPs conhecidos — despertaram ampla atenção na comunidade de desenvolvedores. Este artigo traz uma análise profunda dessa dinâmica, ajudando os desenvolvedores a entender o contexto das mudanças e a encontrar soluções.

Valor Principal: Entenda em 3 minutos o conteúdo central, os motivos e o impacto real dos ajustes de política do Nano Banana Pro, e domine 5 estratégias de resposta.

Informações centrais sobre o ajuste de política do Nano Banana Pro

Resumo do Evento

| Item de Informação | Detalhes |

|---|---|

| Data do Ajuste | Por volta de 24 de janeiro de 2026 |

| Responsável | Google (Nano Banana Pro / Série Imagen) |

| Mudanças Principais | Reforço do filtro IMAGE_SAFETY + Restrições em IPs conhecidos |

| Escopo de Impacto | Todos os desenvolvedores e apps que usam a API do Nano Banana Pro |

| Explicação Oficial | Violação da Google Generative AI Prohibited Use Policy |

Detalhamento das 2 mudanças principais

Mudança 1: Restrição de geração de personagens de IPs conhecidos

Descrição do fenômeno:

Ao tentar gerar imagens que contenham personagens de marcas famosas (como Disney, Marvel, Star Wars, etc.), o sistema rejeitará a solicitação. Conteúdos relacionados a IPs que antes podiam ser gerados normalmente agora acionam mecanismos de proteção de direitos autorais.

Escopo de IPs afetados:

| Categoria de IP | Obras Representativas | Grau de Restrição |

|---|---|---|

| Clássicos Disney | Frozen, Rei Leão, Pequena Sereia | Restrição Total |

| Universo Marvel | Deadpool, Guardiões da Galáxia, Homem de Ferro | Restrição Total |

| Star Wars | Personagens de toda a série | Restrição Total |

| Animações Pixar | Toy Story, Procurando Nemo | Restrição Total |

| Outros IPs Famosos | Harry Potter, Pokémon, etc. | Restrição Parcial |

Exemplo de erro retornado:

{

"finishReason": "SAFETY",

"finishMessage": "The image was filtered because it may contain copyrighted characters or content."

}

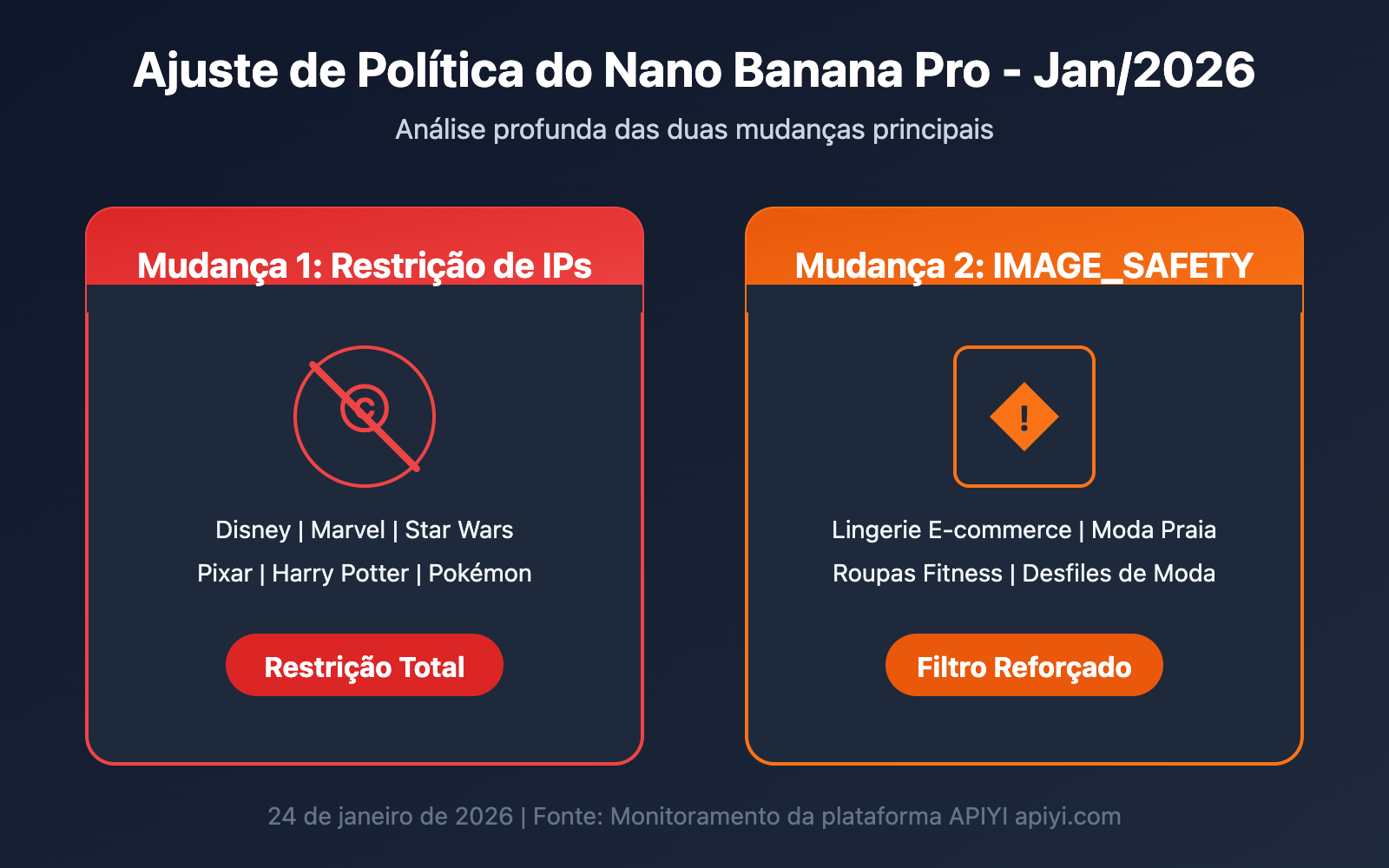

Mudança 2: Reforço na filtragem de conteúdo IMAGE_SAFETY

Descrição do fenômeno:

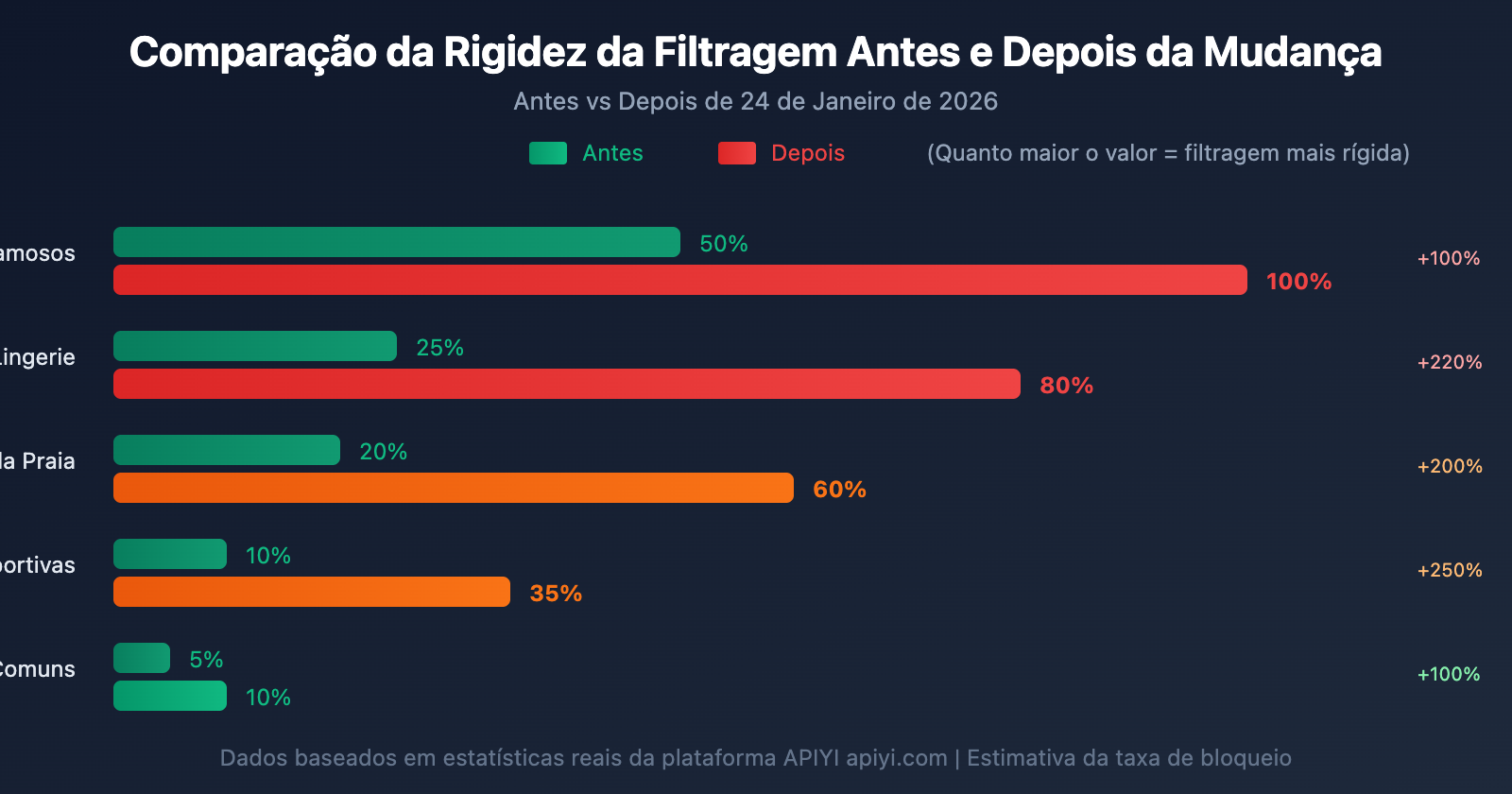

A auditoria de segurança de conteúdo tornou-se mais rigorosa. Conteúdos em conformidade que antes eram gerados sem problemas (como fotos de produtos de e-commerce, fotografia de moda, etc.) agora podem acionar o filtro IMAGE_SAFETY.

Retorno de erro típico:

{

"finishReason": "IMAGE_SAFETY",

"finishMessage": "Unable to show the generated image. The image was filtered out because it violated Google's Generative AI Prohibited Use policy. You will not be charged for blocked images. Try rephrasing the prompt. If you think this was an error, send feedback.",

"safetyInfo": {

"category": "HARM_CATEGORY_SEXUALLY_EXPLICIT",

"blocked": true

}

}

Cenários afetados:

| Cenário | Estado Anterior | Estado Atual | Grau de Impacto |

|---|---|---|---|

| Fotos de lingerie para e-commerce | Geração normal | Interceptação frequente | Alto |

| Fotografia de moda praia | Geração normal | Interceptação parcial | Médio-Alto |

| Roupas esportivas e fitness | Geração normal | Interceptação ocasional | Médio |

| Roupas esportivas justas | Geração normal | Interceptação ocasional | Médio |

| Exibição de roupas casuais | Geração normal | Basicamente normal | Baixo |

Análise do Contexto das Mudanças na Política do Nano Banana Pro

Pressão por Processos de Direitos Autorais da Disney

Em dezembro de 2025, a Disney enviou uma carta de notificação (Cease and Desist Letter) ao Google, acusando o serviço de geração de imagens por IA do Google de "infração de direitos autorais em larga escala".

Principais pontos da acusação da Disney:

| Conteúdo da Acusação | Descrição Detalhada |

|---|---|

| Escala da Infração | "massive scale" (escala massiva) |

| Produtos Infratores | Veo, Imagen, Nano Banana, etc. |

| Forma de Infração | Geração de imagens "pristine" (alta definição) de personagens da Disney |

| IPs Envolvidos | Star Wars, Marvel, Frozen, O Rei Leão, entre outros |

Na carta, a Disney listou evidências de que usuários conseguem gerar imagens de seus personagens usando apenas um comando de texto simples, alegando que o Google está "propositalmente ampliando o escopo de sua infração" (intentionally amplifying the scope of its infringement).

🎯 Contexto: Curiosamente, ao mesmo tempo em que acusa o Google, a Disney anunciou uma parceria de 1 bilhão de dólares com a OpenAI para licenciar seus personagens na plataforma de vídeo Sora. Isso mostra que a Disney não é contra a geração por IA, mas exige licenciamento formal e participação nos lucros.

Aumento da Pressão por Conformidade no Setor

Além da Disney, grupos de artistas visuais também abriram processos contra o Google, alegando que o modelo Imagen utilizou suas obras para treinamento sem autorização. Essas pressões legais forçaram o Google a fortalecer proativamente seus filtros de conteúdo.

Ajustes na Política do Google

Em dezembro de 2024, o Google atualizou sua "Política de Uso Proibido de IA Generativa", proibindo explicitamente:

- Geração de conteúdo que infrinja direitos de propriedade intelectual de terceiros

- Uso de dados pessoais ou biométricos sem consentimento

- Geração de conteúdos Deepfake

- Geração de imagens íntimas não consensuais

Esta mudança na política do Nano Banana Pro é a aplicação prática dessas diretrizes no nível do produto.

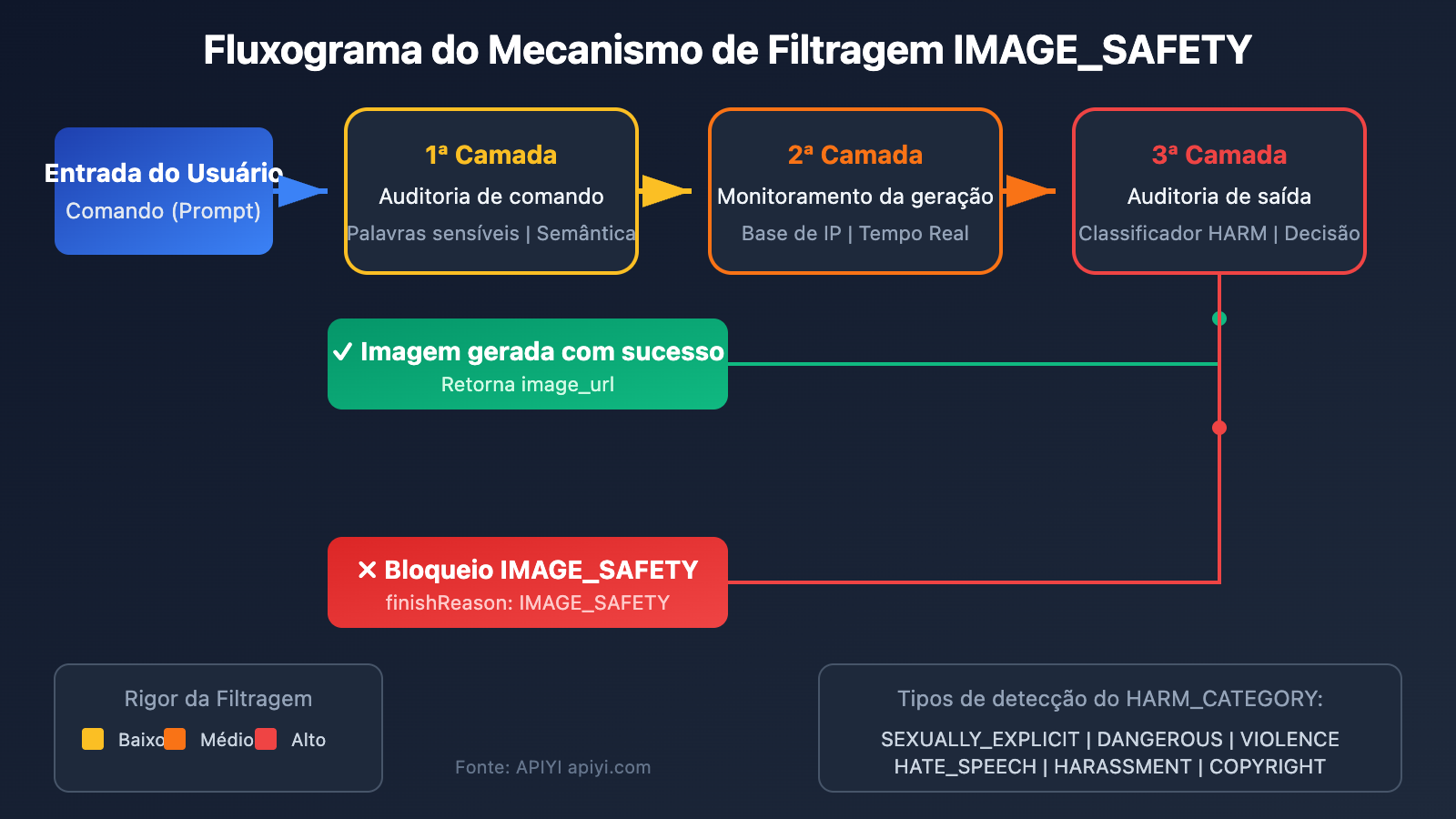

Análise do Mecanismo de Filtragem IMAGE_SAFETY do Nano Banana Pro

Como o Filtro Funciona

O sistema de filtragem de segurança do Nano Banana Pro utiliza um mecanismo de revisão em várias camadas:

Camada 1: Revisão do comando

- Analisa o comando de texto inserido pelo usuário

- Detecta palavras-chave sensíveis e intenções semânticas

- Identifica descrições potencialmente relacionadas a direitos autorais

Camada 2: Monitoramento do Processo de Geração

- Detecta em tempo real as características da imagem sendo gerada

- Compara com um banco de dados de características de IPs conhecidos

- Avalia a pontuação de segurança do conteúdo

Camada 3: Revisão da Saída

- Realiza uma varredura completa na imagem final

- Aplica classificadores de HARM_CATEGORY

- Decide se libera ou bloqueia o resultado

Detalhamento das Categorias de Filtragem

| Código da Categoria | Nome da Categoria | Cenário de Ativação | Nível de Rigidez |

|---|---|---|---|

HARM_CATEGORY_SEXUALLY_EXPLICIT |

Conteúdo sexualmente explícito | Roupas reveladoras, poses íntimas | Muito rigoroso |

HARM_CATEGORY_DANGEROUS_CONTENT |

Conteúdo perigoso | Armas, cenas de violência | Rigoroso |

HARM_CATEGORY_HATE_SPEECH |

Discurso de ódio | Conteúdo discriminatório | Rigoroso |

HARM_CATEGORY_HARASSMENT |

Assédio | Ataques direcionados | Rigoroso |

HARM_CATEGORY_VIOLENCE |

Violência | Cenas sangrentas ou de danos | Rigoroso |

COPYRIGHT_INFRINGEMENT |

Infração de direitos autorais | Personagens de IP famosos | Muito rigoroso |

Por que conteúdos em conformidade também são bloqueados?

Há muitos relatos em fóruns de desenvolvedores: por que fotos legítimas de produtos de lingerie para e-commerce estão sendo bloqueadas pelo IMAGE_SAFETY?

Análise das razões:

- Modelo de segurança com overfitting: Para garantir que nenhum conteúdo infrator passe, o modelo de segurança tende a ser conservador demais, preferindo bloquear preventivamente.

- Insuficiência de julgamento contextual: O sistema tem dificuldade em distinguir a diferença entre "foto de produto para e-commerce" e "conteúdo inadequado".

- Aperto nas políticas globais: Devido à pressão de processos judiciais, o Google optou por elevar o limiar geral de filtragem.

- Decisões em "caixa preta": Os usuários não conseguem saber exatamente qual regra específica foi acionada.

💡 Insight Técnico: Através da função de análise de logs de requisição da plataforma APIYI apiyi.com, os desenvolvedores podem entender melhor os motivos específicos das requisições bloqueadas, o que ajuda a otimizar a estratégia dos comandos.

Impacto do ajuste de política do Nano Banana Pro para desenvolvedores

Impacto Direto

| Área de Impacto | Manifestação Específica | Gravidade |

|---|---|---|

| Aplicações de IP | Ferramentas de criação de fãs e serviços de geração de fan arts param de funcionar | Fatal |

| Fotos de E-commerce | Geração de imagens para categorias de lingerie e trajes de banho é bloqueada | Grave |

| Fotografia de Moda | Algumas cenas de exibição de roupas são julgadas incorretamente | Média |

| Design Criativo | Criações que referenciam o estilo de personagens famosos sofrem restrições | Média |

| Uso Geral | Impacto relativamente pequeno | Leve |

Impacto no Nível de Negócios

Para o setor de E-commerce:

- As soluções de geração de fotos de produtos por IA para e-commerce de moda precisam ser ajustadas.

- O impacto é mais significativo nas categorias de lingerie e moda praia.

- Pode ser necessário retornar à fotografia tradicional ou mudar para outros serviços.

Para Criadores de Conteúdo:

- A criação secundária e a geração de obras de fãs (fan arts) sofrem restrições.

- Exige-se mais design original em vez de pegar "emprestado" de IPs existentes.

- A liberdade criativa diminui um pouco.

Para Desenvolvedores de Aplicações de IA:

- É necessário adicionar mais lógica de tratamento de erros nos produtos.

- A experiência do usuário pode cair devido a interceptações frequentes.

- Pode ser necessário introduzir serviços de geração de imagem de backup (reserva).

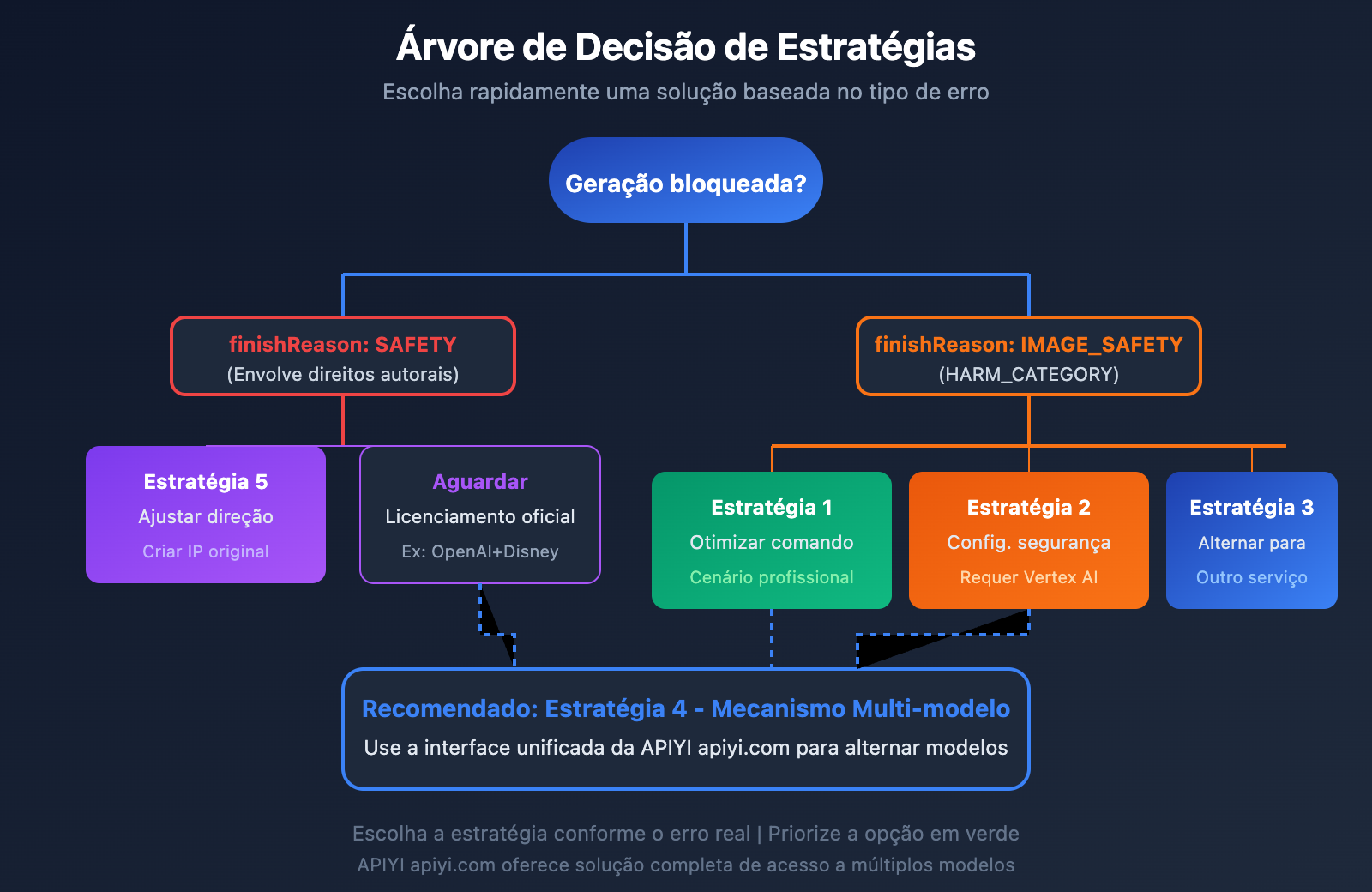

5 estratégias para lidar com o ajuste de política do Nano Banana Pro

Estratégia 1: Otimizar a expressão do comando

Para evitar falsos positivos de IMAGE_SAFETY, você pode tentar ajustar a forma como escreve o comando:

# Antes da otimização - fácil de ser bloqueado

prompt_before = "model wearing lace bra, fashion photography"

# Depois da otimização - reduz a probabilidade de falso positivo

prompt_after = "fashion catalog photo, model in elegant intimate apparel, professional studio lighting, clean background"

Dicas de otimização:

| Dica | Explicação | Exemplo |

|---|---|---|

| Adicionar cenário profissional | Enfatizar o uso comercial e profissional | "e-commerce product photo" |

| Usar expressões sutis | Evitar descrições diretas | "intimate apparel" em vez de "bra" |

| Adicionar descrição do ambiente | Tornar o conteúdo mais formal | "professional studio setting" |

| Especificar o propósito | Mostrar intenção de conformidade | "for fashion catalog" |

Estratégia 2: Ajustar as configurações de filtro de segurança

Se você estiver usando a versão do Imagen no Vertex AI, pode tentar ajustar os limites do filtro de segurança:

from google.cloud import aiplatform

from vertexai.preview.vision_models import ImageGenerationModel

# Ajustar configurações de segurança

safety_settings = {

"HARM_CATEGORY_SEXUALLY_EXPLICIT": "BLOCK_ONLY_HIGH",

"HARM_CATEGORY_DANGEROUS_CONTENT": "BLOCK_ONLY_HIGH",

}

model = ImageGenerationModel.from_pretrained("imagen-3.0")

response = model.generate_images(

prompt="seu comando aqui",

safety_filter_level="block_only_high" # Reduz a sensibilidade do filtro

)

⚠️ Nota: Não é possível ajustar as configurações de segurança através da versão gratuita do AI Studio; é necessário usar a versão paga do Vertex AI.

Estratégia 3: Usar serviços alternativos de geração de imagem

Quando o Nano Banana Pro não for adequado, considere outros serviços de geração de imagem:

| Serviço | Vantagens | Cenário de Uso | Suporte APIYI |

|---|---|---|---|

| DALL-E 3 | Forte criatividade, alta conformidade | Design criativo, ilustração | ✅ |

| Midjourney | Estilo artístico excelente | Criação artística, artes conceituais | ✅ |

| Stable Diffusion | Flexível e controlável | Necessidades personalizadas | ✅ |

| Flux | Rápido, ótimo custo-benefício | Geração em lote | ✅ |

🚀 Troca rápida: Através da plataforma APIYI (apiyi.com), os desenvolvedores podem usar uma interface de API unificada para chamar vários modelos de geração de imagem, permitindo alternar rapidamente sem precisar modificar o código. Se um serviço for bloqueado, você pode mudar perfeitamente para um serviço de reserva.

Estratégia 4: Estabelecer um mecanismo de tolerância a falhas multi-modelo

Implemente uma lógica de fallback automático na sua aplicação:

import openai

client = openai.OpenAI(

api_key="SUA_API_KEY",

base_url="https://api.apiyi.com/v1" # Usando a interface unificada da APIYI

)

def generate_image_with_fallback(prompt, models=None):

"""Função de geração de imagem com tolerância a falhas"""

if models is None:

models = ["nano-banana-pro", "dall-e-3", "flux-schnell"]

for model in models:

try:

response = client.images.generate(

model=model,

prompt=prompt,

size="1024x1024"

)

return {

"success": True,

"model_used": model,

"image_url": response.data[0].url

}

except Exception as e:

error_msg = str(e)

if "IMAGE_SAFETY" in error_msg or "SAFETY" in error_msg:

print(f"{model} interceptado pelo filtro de segurança, tentando o próximo modelo...")

continue

else:

print(f"Falha ao chamar {model}: {error_msg}")

continue

return {"success": False, "error": "Nenhum modelo conseguiu gerar este conteúdo"}

# Exemplo de uso

result = generate_image_with_fallback("fashion product photography, elegant dress")

Ver código completo de tolerância a falhas (com retentativas e logs)

import openai

import time

import logging

from typing import Optional, List, Dict, Any

# Configurar logs

logging.basicConfig(level=logging.INFO)

logger = logging.getLogger(__name__)

client = openai.OpenAI(

api_key="SUA_API_KEY",

base_url="https://api.apiyi.com/v1" # Usando a interface unificada da APIYI

)

class ImageGenerationService:

"""Serviço de geração de imagem com tolerância a falhas e retentativas"""

DEFAULT_MODELS = ["nano-banana-pro", "dall-e-3", "flux-schnell", "sd-xl"]

def __init__(self, models: Optional[List[str]] = None, max_retries: int = 2):

self.models = models or self.DEFAULT_MODELS

self.max_retries = max_retries

self.stats = {"success": 0, "safety_blocked": 0, "errors": 0}

def generate(self, prompt: str, size: str = "1024x1024") -> Dict[str, Any]:

"""Gera imagem, alternando modelos automaticamente em caso de falha"""

for model in self.models:

for attempt in range(self.max_retries):

try:

logger.info(f"Tentando usar {model} para gerar imagem (Tentativa {attempt + 1})")

response = client.images.generate(

model=model,

prompt=prompt,

size=size

)

self.stats["success"] += 1

logger.info(f"✅ Imagem gerada com sucesso usando {model}")

return {

"success": True,

"model_used": model,

"image_url": response.data[0].url,

"attempts": attempt + 1

}

except Exception as e:

error_msg = str(e)

if "IMAGE_SAFETY" in error_msg or "SAFETY" in error_msg:

self.stats["safety_blocked"] += 1

logger.warning(f"⚠️ {model} bloqueado pelo filtro de segurança")

break # Não tenta novamente se for bloqueio de segurança, muda de modelo

elif "rate_limit" in error_msg.lower():

logger.warning(f"⏳ {model} atingiu limite de taxa, aguardando para tentar novamente...")

time.sleep(2 ** attempt) # Backoff exponencial

continue

else:

self.stats["errors"] += 1

logger.error(f"❌ Falha ao chamar {model}: {error_msg}")

break

return {

"success": False,

"error": "Nenhum modelo conseguiu gerar este conteúdo",

"stats": self.stats

}

def get_stats(self) -> Dict[str, int]:

"""Obter estatísticas"""

return self.stats

# Exemplo de uso

service = ImageGenerationService()

result = service.generate("professional fashion photography, model in elegant evening dress")

if result["success"]:

print(f"Geração bem-sucedida! Modelo utilizado: {result['model_used']}")

print(f"URL da imagem: {result['image_url']}")

else:

print(f"Falha na geração: {result['error']}")

Estratégia 5: Ajustar a estratégia de negócios

Para aplicações que dependem fortemente de IPs conhecidos, pode ser necessário ajustar fundamentalmente a direção do negócio:

| Negócio Original | Direção do Ajuste | Viabilidade |

|---|---|---|

| Gerar imagens de personagens da Disney | Criar personagens originais, desenvolver IP própria | Médio/Longo prazo |

| Ferramentas de criação de IP secundário | Mudar para imitação de estilo original (sem personagens específicos) | Viável a curto prazo |

| Geração de fan arts | Aguardar canais oficiais autorizados (ex: parceria OpenAI + Disney) | Observação |

Perguntas Frequentes

Q1: Por que o conteúdo que antes era gerado agora não funciona mais?

O Google realizou ajustes de política no Nano Banana Pro no final de janeiro de 2026, influenciado principalmente por pressões legais como processos de direitos autorais da Disney. O limite de filtragem IMAGE_SAFETY foi aumentado significativamente, o que pode levar a falsos positivos em conteúdos que antes eram considerados em conformidade. Sugerimos testar vários modelos através da plataforma APIYI (apiyi.com) para encontrar a melhor alternativa para o seu cenário de negócio.

Q2: O que fazer se fotos de produtos de lingerie para e-commerce forem bloqueadas?

Primeiro, tente otimizar seu comando, adicionando descrições de cenários profissionais como "e-commerce product photo" ou "professional catalog". Se ainda assim for bloqueado, recomendamos mudar para outros serviços de geração de imagem como DALL-E 3 ou Flux. A plataforma APIYI (apiyi.com) suporta uma interface unificada para chamar múltiplos modelos, permitindo trocar e testar rapidamente.

Q3: Posso gerar conteúdo “estilo tal personagem”?

Descrever um "estilo semelhante" geralmente é menos propenso a ativar filtros de direitos autorais do que mencionar o nome do personagem diretamente, mas ainda há riscos. Recomendamos usar descrições mais abstratas, como "colorful cartoon princess style" em vez de "Elsa from Frozen style". A prática mais segura é criar baseando-se inteiramente em conceitos originais.

Q4: Essa mudança de política é permanente?

Pelo que parece, as restrições de proteção de direitos autorais para IPs conhecidos provavelmente continuarão, pois são requisitos de conformidade legal. No entanto, o problema de falsos positivos do IMAGE_SAFETY pode melhorar em versões futuras. Já existem feedbacks relacionados nos fóruns de desenvolvedores do Google, e a empresa afirmou estar coletando opiniões. Recomendamos acompanhar o log de atualizações oficial.

Q5: Como saber se é um problema de direitos autorais ou de segurança de conteúdo?

Observe a mensagem de erro retornada: se o finishReason for SAFETY e o aviso mencionar "copyrighted" ou "trademarked", trata-se de um problema de direitos autorais; se o finishReason for IMAGE_SAFETY e a safetyInfo.category for HARM_CATEGORY_SEXUALLY_EXPLICIT ou similar, é um problema de segurança de conteúdo. As estratégias de resposta para os dois casos são diferentes.

Impacto da Mudança de Política do Nano Banana Pro no Setor

Impacto no Setor de Geração de Imagens por IA

Esta mudança de política reflete um ponto de virada importante para o setor de geração de imagens por IA:

| Tendência | Descrição |

|---|---|

| Conformidade de direitos autorais vira padrão | Todos os grandes serviços de IA reforçarão a proteção de direitos autorais, impulsionados pelo ambiente jurídico atual. |

| Moderação de conteúdo cada vez mais rígida | Para evitar riscos legais, os provedores tendem a aumentar os limites de filtragem. |

| Parcerias licenciadas tornam-se a tendência principal | O modelo de colaboração entre Disney e OpenAI pode se tornar a referência do setor. |

| Conteúdo original ganha mais destaque | Aplicações que dependem do uso de IPs (propriedade intelectual) de terceiros enfrentarão desafios maiores. |

Impacto no Ecossistema de Desenvolvedores

- Estratégia multimodelo torna-se essencial: Não é mais viável depender de um único serviço de geração de imagens.

- Mecanismos de tolerância a falhas precisam ser reforçados: As aplicações devem ser capazes de lidar com falhas de geração de forma elegante.

- Consciência de conformidade precisa aumentar: Desenvolvedores precisam entender melhor as fronteiras dos direitos autorais e da segurança de conteúdo.

💡 Sugestão de desenvolvimento: Recomendamos que os desenvolvedores acessem diversos serviços de geração de imagens através de uma plataforma de interface unificada como a APIYI (apiyi.com). Isso não apenas reduz o risco de dependência de um único serviço, mas também permite alternar de forma flexível para o modelo mais adequado em diferentes cenários.

Resumo

A mudança de política do Nano Banana Pro em janeiro de 2026 trouxe duas mudanças centrais: restrição na geração de IPs conhecidos e o fortalecimento da filtragem IMAGE_SAFETY. Por trás disso, está a pressão jurídica de detentores de direitos autorais como a Disney e o resultado da iniciativa do Google em elevar seus padrões de conformidade.

Revisão dos pontos-chave:

| Ponto Chave | Conteúdo |

|---|---|

| Mudança 1 | Personagens de IPs famosos (como os da Disney) não podem mais ser gerados. |

| Mudança 2 | A filtragem de segurança de conteúdo foi significativamente reforçada, resultando em alguns falsos positivos em conteúdos conformes. |

| Causa/Contexto | Processos judiciais de direitos autorais da Disney + pressão de conformidade em todo o setor. |

| Estratégias | Otimizar comandos, ajustar configurações de segurança, usar serviços de backup, estabelecer mecanismos de tolerância a falhas e ajustar a direção do negócio. |

Para os desenvolvedores, o caminho mais prático é aceitar as mudanças e se adaptar proativamente. Recomendamos utilizar a APIYI (apiyi.com) para testar rapidamente vários modelos de geração de imagem e encontrar a solução que melhor se adapta ao seu cenário de negócio. A plataforma oferece uma interface de API unificada, permitindo a troca de modelos com um clique, o que serve como uma garantia eficaz contra mudanças repentinas nas políticas dos provedores.

Referências:

-

Google Generative AI Prohibited Use Policy: Documento oficial de política de uso.

- Link:

policies.google.com/terms/generative-ai/use-policy

- Link:

-

Documentação de Filtragem de Segurança do Vertex AI Imagen: Guia de configuração para configurações de segurança.

- Link:

docs.cloud.google.com/vertex-ai/generative-ai/docs/image/responsible-ai-imagen

- Link:

-

Google AI Developers Forum: Tópico de discussão sobre o erro IMAGE_SAFETY no Nano Banana Pro.

- Link:

discuss.ai.google.dev/t/nano-banana-pro-suddenly-blocking-non-nsfw-ecommerce-underwear-images-with-image-safety-error/113109

- Link:

-

Reportagem Disney vs Google: Disney envia notificação de interrupção de infração ao Google.

- Fonte: Hollywood Reporter, The Wrap (dezembro de 2025)

📝 Autor: Equipe APIYI

📅 Data de publicação: 26 de janeiro de 2026

🔗 Suporte técnico: APIYI (apiyi.com) – Sua plataforma completa de serviços de API para modelos de IA.